Материалы по тегу: облако

|

28.05.2026 [16:41], Руслан Авдеев

SB Energy подаст заявку на IPO в США, а сама SoftBank готовит японское GPU-облако AI Data Center GPU CloudДочерняя структура SoftBank — компания SB Energy планирует подать заявку на IPO в США. Тем временем сама SoftBank. запускает с октября 2026 года облачное решение AI Data Center GPU Cloud, сообщает Datacenter Dynamics. По данным SB Energy, дочерняя структура намерена подать на IPO на фоне растущего спроса инвесторов на вложения в компании, строящие энергетическую инфраструктуру, особенно для рынка ИИ ЦОД. Компания уже привлекла более $1,8 млрд на строительство инфраструктуры, в том числе от OpenAI. Изначально SB Energy основали в 2021 году как застройщика солнечных электростанций и аккумуляторных энергохранилищ. Так, в октябре 2024 года она заключила серию «солнечных» контрактов в Техасе для энергоснабжения дата-центров Google в формате PPA (Power Purchase Agreement). Головная SB Energy Global основана в 2015 году и ориентирована на проекты за пределами Японии. Недавно SB Energy диверсифицировала свои энергетические и инфраструктурные предложения, начав предлагать решения на природном газе и поддерживать строительство цифровой инфраструктуры для ЦОД. Например, в январе она подписала договор о строительстве кампуса Stargate в округе Майлам (Milam County) в Техасе мощностью 1,2 ГВт и управлении им. В марте SoftBank объявила о планах строительства многогигаваттного кампуса ЦОД на федеральной земле в Огайо. В частности, SB Energy должна построить 10 ГВт новых генерирующих мощностей, включая 9,2 ГВт на природном газе. Энергией будет обеспечиваться 10-ГВт ЦОД на площадке Portsmouth Site в округе Пайк (Pike County). Строительство должно начаться до конца 2026 года.

Источник изображения: Jakub Żerdzicki/unsplash.com Тем временем SoftBank Corp. намерена запустить в Японии облачный проект AI Data Center GPU Cloud в октябре 2026 года. Он станет частью неооблачного бизнеса SoftBank и будет основано на стеке Infrinia AI Cloud OS, бета-версия уже доступна. ИИ-облако будет работать на ИИ-инфраструктуре SoftBank в дата-центрах в Японии, в т.ч. решениях NVIDIA GB200 NVL72, хотя компания не уточняла, какие ЦОД она будет использовать. При этом Infrinia AI Cloud OS обеспечит сервисы Kubernetes-as-a-Service и Inference-as-a-Service. Сегодня SoftBank управляет ЦОД с помощью дочернего подразделения IDC Frontier. В апреле 2025 года компания начала строительство 1-ГВт кампуса в Томакомай (Tomakomai) на о. Хоккайдо. Также у неё имеются дата-центры в Токийской агломерации, в регионе Тохоку (Tohoku), Кансай (Kansai) и на острове Кюсю. Также компания намерена построить 150-МВт ЦОД на территории недавно закрытого LCD-завода Sharp. SoftBank представила Infrinia AI Cloud OS в январе 2026 года. Компания утверждает, что ПО максимизирует производительность ИИ-ускорителей, в то же время обеспечивая лёгкое внедрение облачных сервисов. Также SoftBank предлагает в Японии облачный сервис с использованием платформы Oracle Alloy. Получивший название Cloud PF Type A сервис также будет базироваться в дата-центрах SoftBank, с площадками как на востоке, так и на западе Японии. В Японии есть и другая альтернатива американским гиперскейлерам — в 2025 году alt и Highreso запустили в стране собственное GPU-облако.

28.05.2026 [16:14], Руслан Авдеев

ByteDance разрабатывает собственные CPU для поддержки своей ИИ-инфраструктурыКитайский техногигант ByteDance работает над собственными CPU, чтобы поддержать растущие потребности в ИИ-инфраструктуре на фоне того, что цены на чипы растут, а дефицит поставок мешает расширению бизнеса, сообщает Reuters со ссылкой на три источника, знакомых с вопросом. Компания работает с двумя архитектурами, Arm и «открытой» RISC-V, и пока взвешивает, какой именно дизайн лучше всего закроет потребностям собственных ЦОД в долгосрочной перспективе. Инициатива косвенно свидетельствует о быстром смене приоритетов индустрии с обучения ИИ на инференс — современным ИИ-агентам всё больше нужны CPU, работающие в тандеме с ИИ-ускорителями. Google, Amazon, Microsoft и Alibaba разрабатывают собственные облачные CPU для снижения затрат и оптимизации производительности своих систем для конкретных задач. Также это в некоторой степени помогло ключевым производителям CPU — Intel и AMD выступить «лидерами сопротивления» доминированию NVIDIA в сфере ИИ. ByteDance намерена внедрять процессоры собственной разработки в собственных серверах и ЦОД для поддержки своих внутренних операций. По имеющимся данным, она готовит масштабную премьеру агентных продуктов, включая платформу Coze. AWS уже давно портировала значительную часть внутренних нагрузок на чипы Graviton, которые всё чаще пользуются спросом и у сторонних заказчиков, включая Meta✴ и Uber. Google тоже активно переносит нагрузки на чипы Axion. Пекинский бизнес обратился к нескольким партнёром, чтобы те помогли компании в реализации проекта и те должны не только помочь с разработкой чипов, но и обеспечить «бронирование» производственных мощностей Проект пока находится на ранней стадии реализации и, кроме данных источников, информации пока нет. Инициатива ByteDance ставит компанию в один ряд с многочисленными технологическими компаниями, решившими, что выпускать собственные чипы будет выгоднее несмотря на сложность их разработки. Стремление разрабатывать собственные полупроводники происходит на фоне того, что Intel ещё в феврале предупредила китайских клиентов о возможном росте сроков поставок CPU до шести месяцев. В апреле компания объявила, что спрос на её CPU со стороны ИИ-компаний был таким высоким в I квартале, что производитель распродал даже запасы предназначавшихся к списанию, ранее считавшихся неликвидными, чипов. На днях AMD предупредила об ухудшении положения на рынке CPU — спрос превышает прогнозы и проблемы со своевременными поставками сохранятся. Сегодня ByteDance закупает CPU у Intel и AMD, которые уже значительно подняли цены, рост квартал к кварталу в последние месяцы составил 10–35 %, что лишь подтолкнуло ByteDance к разработке собственных альтернатив. NVIDIA также развивает активность на рынке CPU и надеется, что новые Arm-процессоры Vera, которые оказались конкурентоспособны EPYC и Xeon, обеспечат компании доступ к новому рынку объёмом в $200 млрд. Сама Arm тоже планирует заработать миллиарды долларов на CPU Arm AGI, фактически конкурируя с собственными заказчиками.

27.05.2026 [22:48], Владимир Мироненко

Avanpost открыла публичное тестирование облачного сервиса Avanpost Identity CloudКомпания Avanpost объявила о запуске облачного сервиса Avanpost Identity Cloud и о старте его публичного тестирования. Его участникам предоставляется пробный период с доступом ко всем функциям сервиса до 1 сентября, с неограниченным числом пользователей и возможностью выстроить защиту корпоративного доступа: от базовой многофакторной аутентификации до тарифа E-Passport. Компания отметила, что Avanpost Identity Cloud построен как продолжение on-premise практики Avanpost, при этом возможности и архитектурные принципы корпоративного решения перенесены в облако без потери уровня защиты. Для каждого клиента разворачивается независимое окружение со степенью изоляции, сопоставимой с выделенным on-premise решением. Защищённую интеграцию платформы с корпоративными системами заказчика обеспечивает компонент Access Bridge. Сервис отличается гибкостью развёртывания с возможностью адаптации под любую архитектуру. Поддержка офлайн-аутентификации обеспечивает непрерывность работы даже при сбоях связи, а централизованное управление из единой административной консоли упрощает эксплуатацию — благодаря использованию принципа plug-and-play нет надобности в ручной настройке локальных компонентов. Критически важные секреты приложений (LDAP, RADIUS) обрабатываются внутри контура заказчика, обеспечивая высокий уровень безопасности. Пользователям Avanpost Identity Cloud предлагаются четыре тарифных плана с возможностью перехода по мере расширения числа и сложности выполняемых задач: Start, Expert, E-passport и Zero Trust. С 1 сентября 2026 года будет доступна выгодная ежемесячная тарификация по уникальным пользователям с оплатой по факту использования сервиса.

27.05.2026 [10:21], Руслан Авдеев

Безумству храбрых: французский инженер троллит IT-гигантов сатирическими ИИ-нарезками с индюкомФранцузский разработчик и SRE (Site Reliability Engineer) Амин Раити (Amine Raiti) объявил настоящую войну облачным гиперскейлерам, включая AWS, Google Cloud и Microsoft Azure. Он потребовал от них отказа от огромных комиссий за прекращение использования услуг. В противном случае гиперскейлерам грозит бесконечный поток сгенерированного ИИ сатирического музыкального контента, сообщает The Register. Раити, работающий в некой финансовой организации, находящейся под надзором европейского центробанка, выбрал оружием генерируемые ИИ песни, сатирические стихи и музыкальные пародии, от K-pop до финской польки и музыки в стиле Шопена, назвав свою кампанию «Операция индюк» (Operation Dindon). Идея появилась, когда Раити работал управленцем в одной из французских Adtech-компаний. Бизнес был связан многолетними облачными договорами, которые действовали даже на фоне падения выручки компании и сокращения штата. Хотя конкретные облачные провайдеры в тех увольнениях не обвиняются, именно тогда привязка к вендору якобы перестала быть для Раити абстрактной технической проблемой. Требования организатора интернет-протеста чрезвычайно просты: гиперскейлеры должны дать клиентам возможность отказаться от многолетних соглашений, если бизнес заходит в финансовый тупик, прекратить взимать огромные средства за выгрузку данных из своих облаков и обеспечить отказ от проприетарных сервисов гиперскейлеров без огромных трат на миграцию. Журналистам Раити привёл вопиющие примеры. По его словам, одна конфигурация AWS NAT Gateway может обойтись в €6,7 тыс. ($7777) ежегодно за функциональность, которую, по его словам, администраторы Linux-систем обеспечивали ещё в конце 1990-х гг. Управляемые Kubernetes-сервисы могут обходиться ежегодно в €14 тыс. ($16251) и более. В отличие от обычных разговоров, не уходящих дальше отдельных IT-команд или публикации постов в LinkedIn, Раити превратил свой протест в настоящее представление, создав сатирический музыкальный сериал «Легенда об индюке» (The Legend of Dindon). Главный герой — вымышленный индюк, регулярно попадающий в зависимость от облачных сервисов и не способный выбраться из ловушек. Каждая серия посвящена отдельной проблеме: скрытым расходам, юридическим привязкам к вендорам или, например, завышенным тарифам. В начале мая Раити опубликовал т.н. «Железный ультиматум» (Iron Ultimatum) на 11 языках, адресовав его AWS, Google и Microsoft. Организатор музыкальных протестов готов даже выпустить хвалебный поэтический сборник с похвалами в адрес облачных компаний, если те проведут значимые реформы. Если нет — операция продлится бессрочно, благо, создание одного трека занимает около двух минут, а обойдётся это не дороже €50/мес. «Коллекция» Раити уже включает порядка 50 сгенерированных ИИ треков. Сами облачные гиганты пока не ответили на ультиматум и до объявленного «дедлайна» в сентябре остаётся довольно много времени. Впрочем, нередко они и сами обвиняют друг друга в огромных платежах за отказ от сервисов и выгрузку данных.

27.05.2026 [09:30], Сергей Карасёв

РТК-ЦОД запустил сервис Unit-colocation в «Облаке КИИ»РТК-ЦОД представил услугу Unit-colocation на базе своего «Облака КИИ»: она предполагает возможность размещения клиентского оборудования в ЦОД компании с последующим подключением к безопасной облачной платформе. «Облако КИИ» предназначено для размещения критической информационной инфраструктуры. В составе этой платформы задействованы аппаратные решения, внесенные в реестр Минпромторга, а также программное обеспечение из реестра Минцифры России. Сам ЦОД соответствует уровню Tier III, что гарантирует работу инженерных систем в случае чрезвычайных ситуаций. Благодаря услуге Unit-colocation заказчики смогут формировать гибридную ИТ-инфраструктуру со своими серверами, расположенными в «Облаке КИИ». В рамках сервиса клиентское оборудование размещается в монтажных шкафах в зоне внешних подключений (ЗВП) дата-центра — вне пределов аттестованного контура «Облака КИИ», но в контролируемой зоне. Подключение серверов выполняется в соответствии с резервируемой и отказоустойчивой схемой — через коммутаторы сетевого доступа 1 GE и оптические порты с пропускной способностью от 1 до 25 Гбит/с. Клиенты смогут выбрать наиболее подходящие для себя сетевые интерфейсы в соответствии с потребностями. Реализованная модель, как утверждается, обеспечивает высокий уровень связности клиентского оборудования с инфраструктурой «Облака КИИ». «Наша новая услуга Unit-colocation обеспечивает объединение "Облака КИИ", частных корпоративных сетей и публичных облаков в единую IT-инфраструктуру организации. Такая схема гарантирует заказчику отказоустойчивость функционирования его гибридных IT-ресурсов и позволяет гибко ими управлять, а также аттестовать информационные системы на соответствие требованиям регуляторов», — говорит Алексей Суравикин, директор продуктового офиса «Перспективные продукты» РТК-ЦОД. Ожидается, что гибридная инфраструктура, сочетающая собственное оборудование и защищённое облако, заинтересует клиентов из госсектора и операторов персональных данных, а также крупные компании и организации из сфер финансов, промышленности, ТЭК, здравоохранения и транспорта. Заявку на подключение можно оформить на официальном сайте РТК-ЦОД.

26.05.2026 [23:24], Руслан Авдеев

Сделка Anthropic и Microsoft расширит спрос на ИИ ASIC и повлияет на цепочки поставок для облачного рынкаКак сообщает The Information, Anthropic ведёт с Microsoft переговоры об использовании фирменных ускорителей последней для работы с ИИ-моделями Claude. Подобный шаг способен ускорить широкое внедрение Maia 200 и поддержать спрос на ASIC по всей «облачной» цепочке поставок, сообщает DigiTimes. Выиграют и поставщики компонентов для облачного рынка, от Global Unichip до Marvell с Broadcom. Как сообщают отраслевые источники, Anthropic фактически стала главным драйвером спроса на ASIC. В отличие от OpenAI, которая ранее заключала крупные долгосрочные сделки по покупке чипов, закупки Anthropic обычно соответствовали актуальному спросу на вычислительные мощности. Тем не менее, в последние месяцы она тоже повысила активность. Во-первых, компания заключила соглашение на использование ASIC с Google и (AWS), арендовала ИИ-мощности у xAI и, теперь, возможно, будет арендовать их у Microsoft. Эксперты считают, что это свидетельствует о значительном росте популярности Claude, из-за чего выросла необходимость в вычислительных ресурсах. По словам источников, Anthropic активно применяет ASIC разных поставщиков — они предпочтительнее для компании, чем более дорогие ИИ-ускорители NVIDIA, что позволяет обеспечить эффективность расходов. Подобная стратегия позволяет компании избежать зависимости от единственного поставщика, что усиливает переговорные позиции компании и снижает для неё риски, связанные с концентрацией доступных вычислительных ресурсов у одного партнёра.

Источник изображения: Microsoft Благодаря сделке Microsoft может поддержать собственные разработки ASIC, пока уступающие по многим параметрам решениям Google и AWS. Те уже некоторое время сдают ИИ-чипы собственной разработки в аренду. Если Microsoft удастся повторить подобный успех, компания сможет сократить расходы на расширение выпуска чипов и расширить их закупки, что создаст дополнительные стимулы для фактических производителей ASIC и их партнёров. На фоне роста внимания ИИ-бизнеса к ASIC, эксперты прогнозируют увеличение соответствующего рынка. По некоторым оценкам, если их будут использовать только облачные провайдеры, закупки на рынке останутся ограниченными, но рост спроса со стороны крупных клиентов облачных платформ может существенно помочь развитию всей ниши. Текущий вектор её развития указывает на то, что спрос будет расти и дальше. В феврале сообщалось, что Anthropic планирует увеличить к 2029 году расходы на облака до $80 млрд.

26.05.2026 [09:00], Сергей Карасёв

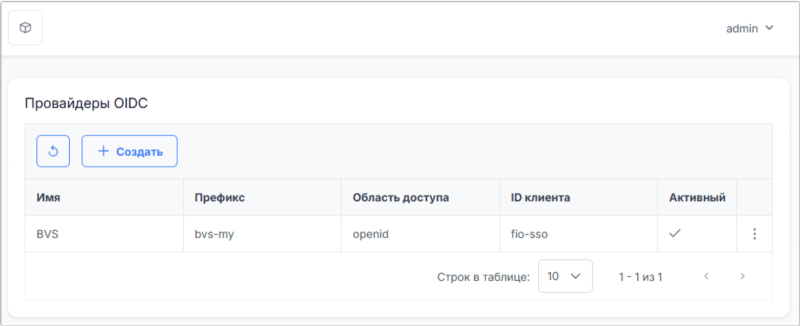

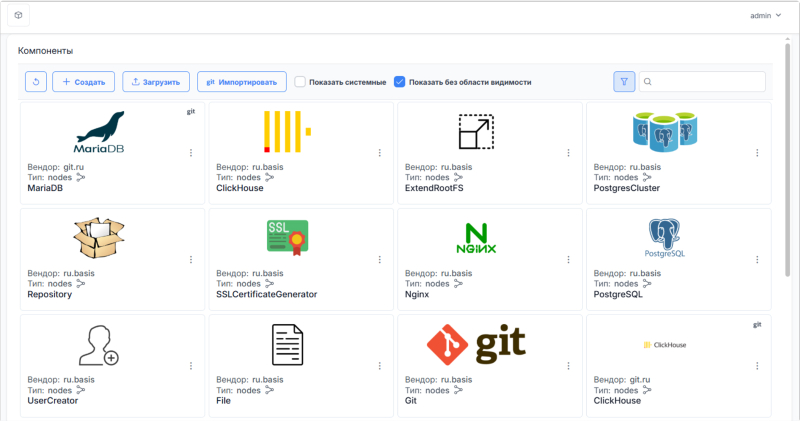

Гибкие настройки безопасности и новые инструменты для работы с шаблонами — «Базис» обновил конструктор Basis Automation Studio до версии 2.4Компания «Базис», лидер российского рынка ПО управления динамической инфраструктурой, представила версию 2.4 конструктора платформенных сервисов Basis Automation Studio — модуля, входящего в расширенную версию облачной платформы Basis Dynamix Cloud Control. Свежий релиз предлагает интеграцию со средством защиты виртуализации Basis Virtual Security, гибкую ролевую модель и поддержку работы с внешними системами версионирования через веб-портал. Basis Automation Studio представляет собой среду автоматизации развёртывания сервисов с инструментами визуального проектирования виртуальной инфраструктуры на основе готовых компонентов и связей между ними. В состав конструктора входит расширяемый каталог шаблонов виртуальных инфраструктур и платформенных сервисов, а также расширяемая библиотека компонентов с образцами популярного ПО — ClickHouse, Consul, Docker, MariaDB, PostgreSQL и других. Алгоритм развёртывания построен на архитектуре TOSCA с использованием языков YAML, Ansible, Python и Bash. Управление правами и доступомОдной из ключевых доработок релиза стала интеграция конструктора с решением защиты Basis Virtual Security. Конструктор использует Basis Virtual Security в качестве единого провайдера идентификации, что даёт администраторам возможность централизованно управлять учётными записями и правами доступа пользователей, а также обеспечивает поддержку технологии единого входа (Single Sign-On, SSO). В результате можно централизованно применять политики безопасности, что снижает нагрузку на администраторов, а пользователей платформы избавляет от необходимости вводить учётные данные при переходе между компонентами экосистемы «Базиса». В Basis Automation Studio 2.4 — в дополнение к имеющейся ролевой модели — была представлена её расширенная версия, которая позволяет тонко настраивать права доступа пользователей: администратор может собирать собственные роли из атомарных разрешений и назначать их в нужном объёме конкретным пользователям. Миграция на новую модель уже выполнена на уровне архитектуры конструктора. Интеграция с внешними Git-репозиториямиВ новой версии Basis Automation Studio появилась возможность загружать компоненты и шаблоны сервисов из Git-репозиториев. Загрузка и обновление компонентов и шаблонов сервисов осуществляется, используя графический интерфейс, по выбранному Git-тегу с возможностью пакетной загрузки. Поддерживаются разные способы аутентификации (пароль, токен). Загруженный компонент шаблон сервиса поддерживает версионирование (с возможностью обновления «вперед и назад»). Тем самым продолжается развитие веб-портала как единой точки работы с конструктором. Ранее в портал были добавлены инструменты создания и редактирования компонентов и шаблонов. В новой версии конструктора добавилась интеграция с внешними Git-репозиториями. Это позволяет встроить разработку TOSCA-шаблонов в привычные для команд процессы работы с исходным кодом, обеспечить отслеживаемость изменений и упростить совместную работу над каталогом сервисов. В новом релизе также была добавлена оценка ресурсов для развёрнутых сервисов. Это позволяет пользователям анализировать ресурсные требования сервисов и точнее планировать их эксплуатацию. «Ключевая задача, которую Basis Automation Studio решает для бизнеса — упрощение процесса развёртывания ИТ-систем и сервисов внутри виртуального ЦОД. Поэтому мы развиваем продукт сразу в нескольких направлениях, связанных с решением этой задачи. В частности, мы уже реализовали централизацию управления доступом через интеграцию с другим нашим продуктом, Basis Virtual Security, а также более гибкое разграничение прав пользователей и включение конструктора в стандартные процессы разработки через поддержку Git в веб-портале», — отметил Дмитрий Сорокин, технический директор компании «Базис».

25.05.2026 [21:15], Руслан Авдеев

Accenture и OneView Commerce получили контракт на замену скандально известного ПО Fujitsu Horizon для Почты ВеликобританииПочтовая служба Великобритании Royal Mail заключила с Accenture и OneView Commerce контракт на £410 млн для замены проблемного ПО Horizon, ставшего причиной одной из крупнейших судебных ошибок в истории страны, сообщает The Register. Accenture стала победителем тендера на замену ПО компании Fujitsu, с 1996 года отвечавшего за работу POS-системы и финансовой отчётности почты в соответствии с принципом Walk In Take Over (WITO). Это означает, что подрядчик берёт под контроль действующую систему, обслуживая её, но параллельно внедряя новую — готовится полная трансформация делопроизводства. В частности, будет обеспечено управление миграцией на новое SaaS-решение, сумма сделки составит £269 млн на пять лет (с возможностью дважды дополнительно продлять контракт на год). Менее известная OneView Commerce выступает поставщиком SaaS-решений для розничной торговли. Эта компания также выиграла тендер на поставку ПО стоимостью £141 млн. Программное обеспечение должно «трансформировать технологическую платформу розничной торговли почты в соответствии с меняющимися бизнес-требованиями, операционными процессами и потребностями клиентов». Новую систему поместят в облако с возможностью отладки под нужды почты. Ожидается, что она будет включать POS-терминалы для обслуживания посетителей, мобильные сервисы, службы взаимодействия с клиентами и аналитические сервисы, а также киоски самообслуживания и т.п.

Источник изображения: Federico Di Dio photography/unsplash.com В 1999 году Почта Великобритании начала внедрять систему Horizon компании Fujitsu для бухгалтерского учёта и дважды обновляла это ПО. Со временем выяснилось, что с 1999 по 2015 гг. более 700 сотрудников почты неправомерно привлекли к ответственности из-за ошибок в Horizon, в том числе уголовной. Расследование уже показало, высокопоставленные сотрудники почты и представители подрядчиков — Fujitsu и ICL должны были знать о дефектах в Horizon. При этом представители Почты и Fujitsu пытаются переложить вину друг на друга, а многие пострадавшие до сих пор не могут дождаться компенсаций. Попутно выяснилось, что и прошлые версии ПО для Почты, Capture и ECCO/ECCO+, также содержали аналогичные ошибки. В мае 2025 года Почта Великобритании отказалась от планов создания собственной замены ПО компании Fujitsu и объявила тендер на £410 млн, победителями которого и стали Accenture и OneView Commerce. В числе не прошедших конкурсный отбор — IBM и Escher Software. Последняя занимается поставками ПО для розничной торговли и электронной коммерции.

22.05.2026 [16:15], Руслан Авдеев

Anthropic заплатит SpaceX $45 млрд за аренду ИИ-мощностей xAI

anthropic

hardware

ipo

spacex

xai

ии

инвестиции

космос

облако

полезные ископаемые

сделка

спутник

финансы

цод

экология

электропитание

Согласно документации, поданной SpaceX регуляторам перед выходом на IPO, Anthropic будет платить по $1,25 млрд/мес. следующие три года за аренду ЦОД xAI, сообщает Datacenter Dynamics. Частично раскрыты и другие данные об империи Илона Маска. В начале года SpaceX объединилась с xAI, владеющей суперкомпьютерами в Мемфисе (шт. Теннеси) и соседнем Саутхейвене (Southaven), а также социальной сетью X. Общая капитализация компаний после IPO может превысить $1 трлн. Ранее в мае SpaceX объявила о сдаче в аренду Anthropic 300 МВт мощностей ЦОД xAI Colossus. Anthropic, как теперь выяснилось, будет ежемесячно платить $1,25 млрд до мая 2029 года (суммарно $45 млрд), но стороны могут расторгнуть контракт с уведомлением за 90 дней. Отдельное соглашение со стартапом Cursor также предполагает аренду мощностей у xAI. В заявке на IPO сообщается, что арендовать мощности могут и другие бизнесы — фактически компания превратится в облачного провайдера, помимо поддержки собственных вычислений. Необходимость сдачи в аренду предсказуема с учётом убытков, понесённых xAI. В документе отмечено, что за первые три месяца 2026 года компания потеряла $2,4 млрд, тогда как годом ранее речь шла о $936 млн. Убытки связаны с капитальными вложениями в ЦОД. В 2025 году компания потратила на ИИ-инфраструктуру $12,7 млрд, а в I квартале 2026 года уже $7,7 млрд. Предположительно, за весь год расходы соответствующего профиля составят порядка $30 млрд. Правда, под вопросом действительно доступные мощности империи Маска и то, имеется ли у него в распоряжении действительно 1 ГВт. В 2024 году в Мемфисе компания запустила суперкомпьютер Colossus в новом ЦОД на территории бывшего завода Electrolux. В марте 2025 года приобретена площадка для Colossus 2, а соответствующий ЦОД заработал в январе 2026 года. Хотя Маск заявлял, что мощность составила 1 ГВт, спутниковые снимки за январь свидетельствуют, что установленное охладительное оборудование способно справиться лишь с 350 МВт. Также известно, что SpaceX намерена инвестировать $2,8 млрд в газовые турбины для своих ЦОД, несмотря на протесты и иски. Последний поданный иск обвиняет xAI и дочернюю MZX Tech в незаконном использовании 27 газовых турбин для питания ЦОД.

Источник изображения: xAI В заявке на IPO упоминается «номинальная вычислительная мощность» 1 ГВт в распоряжении SpaceX, причём она рассчитывается умножением количества ИИ-ускорителей на их энергопотребление. В поданных документах отмечено, что номинальная мощность на март 2026 года действительно составляет 1 ГВт, на 300 МВт больше, чем годом ранее, но отмечается, что речь не идёт о фактическом энергопотреблении. Другими словами, многие установленные ускорители, возможно, ещё не используются. В заявке на IPO напрямую упоминаются только 330 МВт вычислительных мощностей (130 МВт на Colossus 1 и 210 МВт на Colossus 2. При этом подчёркивается, что на следующем этапе для Colossus 2 могут быть введены в эксплуатацию не менее 220 тыс. ускорителей NVIDIA GB300 и более 400 МВт, но даты этого этапа не указываются. Кроме того, как выяснилось ранее, процент утилизации Colossus 1 оказался значительно ниже среднерыночного, компания фактически недоиспользовала его возможности. Что касается орбитальных ЦОД, в январе SpaceX запросила разрешение на вывод на орбиту до миллиона соответствующих спутников, в заявке на IPO сообщается, что вывод на орбиту может состояться уже в 2028 году. Другие компании, включая Blue Origin, тоже рассматривают возможности размещения ЦОД в космосе, но у SpaceX имеется огромное преимущество благодаря группировке Starlink. Кроме того, планируется использовать в космических ЦОД межспутниковую лазерную связь, разработанную именно в рамках проекта Starlink. Существующая группировка насчитывает уже боле 23 тыс. межспутниковых оптических соединений, и именно она станет большим подспорьем в обеспечении космических ЦОД связью, в т.ч. и с Землёй. Также сообщается, что микро-ЦОД SpaceX будут спроектированы таким образом, чтобы обеспечить их быстрое автоматизированное производство, что позволит создать вычислительную группировку большого масштаба. Будут использованы наработки Starlink в области терморегулирования. Впрочем, в документе признаётся, что многие технологии и системы для космических ЦОД пока являются новыми и непроверенными. Также подчёркивается необходимость значительных капитальных затрат в ближайшие годы, чтобы продукты компании и ИИ-сервисы, а также другие проекты, стали прибыльными. Причём успех начинаний не гарантирован.

21.05.2026 [23:43], Владимир Мироненко

Без техподдержки, апдейтов и прав: почти треть крупного российского бизнеса использует зарубежное ПО

software

виртуализация

импортозамещение

информационная безопасность

исследование

лицензия

облако

почта

резервное копирование

россия

телеметрия

техподдержка

цкит

Согласно исследованию аналитического центра АНО «ЦКИТ» «Ландшафт российского рынка прикладного программного обеспечения и его сопоставление с мировым рынком и общими тенденциями (2019–2026)», отчёты об устойчивом росте российского рынка прикладного ПО во всех ключевых сегментах скрывают реальное положение и эксплуатационную «серую зону». Согласно приведённым данным, в 2025 году российский рынок облачных платформ (IaaS+PaaS) вырос с 28 млрд руб. в 2019 году до 235 млрд руб., рынок систем виртуализации — с 10,7 млрд руб. в 2021 году до 19,4 млрд руб., рынок корпоративной почты — с 5,5 млрд руб. в 2021 году до 6,98 млрд руб. В облачном сегменте доля иностранных провайдеров не превышает 1 % легальных продаж при общем объёме рынка в 416,5 млрд руб. (оценка iKS-Consulting); в виртуализации на российские продукты приходится 80 % новых продаж; в системах резервного копирования доля отечественных решений превышает 70 %; в новых продажах почтовых систем доля отечественных систем выросла с 10 % в 2021 году до 58 % в 2025 году. Если же копнуть глубже, выясняется, что многие крупные компании, в том числе из числа системообразующих, продолжают использовать иностранное ПО, приобретённое до 2022 года. По данным ЦКИТ, расходы крупнейших потребителей в 2022–2025 гг. фактически не выросли, поскольку они по-прежнему используют оплаченные лицензии с истёкшим сроком поддержки. В сегменте резервного копирования Veeam до 2022 года занимал более 50 % российского рынка, а сейчас около 30 % крупных компаний продолжают эксплуатировать его без поддержки, так как личные кабинеты заблокированы с марта 2024 года. Виртуализация VMware до 2022 года использовалась на ~80 % корпоративных серверов страны — сейчас её около 39 %, а это десятки тысяч серверов, причём без обновлений, поскольку новые лицензии недоступны. Наиболее плачевно обстоят дела в сегменте корпоративных почтовых систем. Около половины компаний по-прежнему используют Microsoft Exchange или Microsoft 365 без продления лицензий, технической поддержки и обновлений безопасности. До 2022 года Microsoft занимала 70–80 % российского рынка корпоративной почты. В 2025 году её доля снизилась примерно до 50 %, хотя эти цифры отражают лишь новые продажи в пользу отечественных решений — в действительности инсталляционная база Microsoft в B2B остаётся массивной и продолжает работать без актуальных патчей, утверждают исследователи. Помимо того, что речь идёт о нарушении законодательства, те же почтовые серверы без патчей — первоочередная цель для атак. По данным Positive Technologies, в 2023 году на Microsoft Exchange пришлось 50 % всех расследованных атак на публично доступные приложения в России, а 92 % вредоносной доставки осуществляется именно посредством email. По данным ФСТЭК, только одна уязвимость в Exchange затронула около 77 тыс. российских серверов. Как сообщают в BI.ZONE, 68 % целевых атак начинаются с почты. При этом корпоративные адреса сотрудников 94 из 100 крупнейших российских компаний можно найти в публичных утечках. Ещё один фактор риска — телеметрия: механизмы передачи диагностических данных Microsoft (MS Diagnostic Data) продолжают бесконтрольно направлять сведения за рубеж. Также существует риск удалённого отключения инфраструктуры, что наряду с несовместимостью с российскими ОС, деградацией SLA и утратой внутренних компетенций по обслуживанию устаревающих систем делают корпоративную почту точкой потенциального операционного коллапса. К тому же серый импорт лицензий и компонентов несёт дополнительные издержки, поскольку обходится на 30–100 % дороже официальных предложений. Следует добавить, что публичный инцидент, связанный с компрометацией почтовой инфраструктуры на объекте КИИ, грозит компании большими репутационными потерями. ЦКИТ систематизировал риски продолжения эксплуатации западного ПО по шести категориям. Три из них (технологические, кибербезопасность и юридико-регуляторные) отнесены к критическим. Операционные, экономические и репутационно-финансовые риски оцениваются как высокие. Исследователи отметили, что российский рынок корпоративной почты, систем резервного копирования, виртуализации и облачных платформ предлагает зрелые продукты, уже прошедшие испытания в крупных корпоративных средах. Плановый переход на них позволит пройти процедуры сертификации без спешки, обеспечить обучение персонала и сохранить непрерывность бизнес-процессов, устранив риски работы в серой зоне. |

|