Материалы по тегу: ии

|

09.05.2026 [14:12], Руслан Авдеев

Mitsubishi Heavy Industries модернизирует производство газовых турбин, чтобы удовлетворить спрос операторов ИИ ЦОД

hardware

mitsubishi

дефицит

инвестиции

полезные ископаемые

производство

финансы

цод

электропитание

энергетика

япония

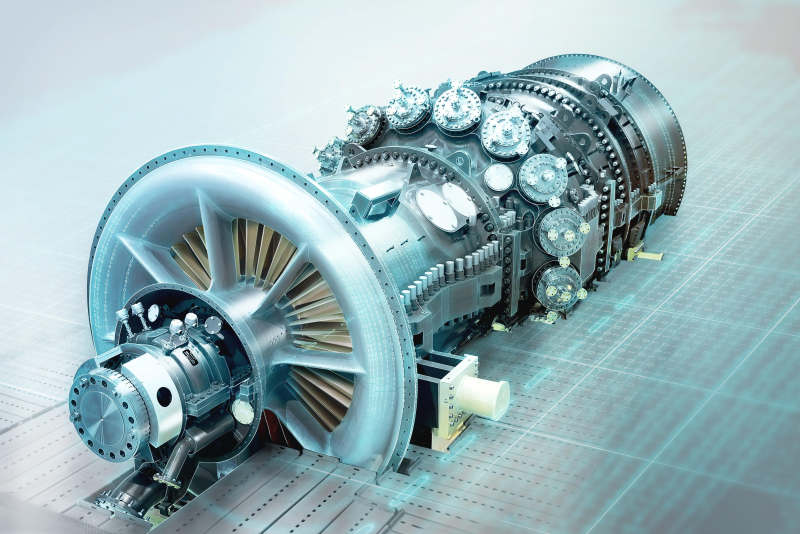

Японская Mitsubishi Heavy Industries (MHI), занимающаяся производством газовых турбин, заявила о модернизации своих производственных процессов для увеличения объёмов выпуска продукции, сообщает Datacenter Dynamics. Таким образом компания рассчитывает нарастить объёмы производства и сократить время изготовления турбин, чтобы удовлетворить спрос индустрии ИИ ЦОД. Ожидается, что оптимизацию на заводе Takasago Machinery Works на западе Японии возглавит президент компании Эйсаку Ито (Eisaku Ito). Там пересмотрели более 1 тыс. процессов в сфере закупок, сборки, тестирования и проектирования. Компания сообщает, что инициатива направлена на повышение эффективности газотурбинных парогазовых генераторов и сокращение числа невыполненных заказов. За последний год заказы энергетических систем у MHI увеличились приблизительно на 40 %, до ¥3,6 трлн ($23 млрд). В ходе оптимизации разделили сборочные линии для разных вариантов турбин и сократили количество переналадок оборудования. Ожидается, что это поможет нарастить производство на 30 % даже с ограниченными дополнительными инвестициями. Компания уже обязалась вложить ¥50 млрд ($320 млн) в расширение производства турбин, что скромнее ниже планов масштабирования соответствующего бизнеса у GE Vernova и Siemens Energy. Выросли заказы и на переделанные старые авиадвигатели с гражданских и военных судов. В сентябре 2025 года MHI сообщила о намерении вдвое нарастить выпуск газовых турбин в ответ на рост спроса со стороны индустрии ЦОД. Правда, уже тогда заявлялось, что простого роста производственных мощностей не хватит для удовлетворения спроса. Последний значительно увеличился благодаря развитию рынка ЦОД. Как энергетические компании, так и строители дата-центров хотят пользоваться газовыми турбинами, чтобы наращивать подконтрольные мощности. В результате роста спроса наметился дефицит турбин, появились данные о задержках поставок вплоть до 2030-х гг.

Источник изображения: Mitsubishi Heavy Industries По имеющимся данным, крупные производители турбин уже начали ограничивать инвестиции в производство новых турбин, чтобы не столкнуться с перепроизводством и прочими рисками в случае, если рост мощностей дата-центров будет не столь активным, как ожидалось. Хотя поставки турбин замедлились, индустрия ЦОД, от малых до крупных компаний, по-прежнему рассматривает природный газ в качестве решения для быстрого удовлетворения энергетических потребностей. Например, это сказалось на недавних шагах гиперскейлеров, которые всё чаще обращаются к поставщикам природного газа для удовлетворения растущих энергетических потребностей ИИ. Так в апреле Microsoft достигла соглашения с Chevron и Engine No. 1 о получении для своего нового ЦОД до 2,5 ГВт электричества. Впрочем, против турбин нередко протестуют экоактивисты.

08.05.2026 [14:11], Сергей Карасёв

Selectel запускает программу поддержки AI-проектов с грантом до 2 млн рублей на IT-инфраструктуруSelectel, крупнейший независимый провайдер IT-инфраструктуры в России, объявил о запуске программы поддержки для компаний, разрабатывающих решения в области искусственного интеллекта. Участники смогут получить грант до 2 000 000 руб. на использование вычислительных ресурсов Selectel, а также техническую помощь в организации IT-инфраструктуры для ML-задач от экспертов компании. В условиях растущего спроса на вычислительные мощности для обучения, инференса и запуска генеративных моделей для бизнеса крайне важен доступ к надёжной, производительной и масштабируемой IT-инфраструктуре. Для этого Selectel создал специальную программу, в рамках которой компании смогут получить поддержку для развития своих AI-проектов. После подачи заявки и прохождения интервью участникам будут доступны до 2 000 000 руб. на IT-инфраструктуру для ML-задач, включая серверы с GPU, Managed Kubernetes с GPU и Foundation Models Catalog. «Selectel последовательно развивает AI-направление, обеспечивая вычислительные мощности для бизнеса любого масштаба и создавая продуктовые решения для ML-задач. Mы строим вертикально интегрированное предложение и в этом году анонсировали сразу несколько запусков: собственный AI-сервер, обновление AI-платформы для инференса, а также интеграцию партнёрского решения с GlowByte и Data Sapience. Поэтому мы можем помочь компаниям реализовывать любые проекты на нашей инфраструктуре — и для нас это не просто поддержка, а возможность лучше понимать потребности рынка и усиливать нашу платформу», — поделился Александр Тугов, директор AI-вертикали Selectel. Для реализации проектов с использованием ML-инструментов компаниям нужны мощные вычислительные GPU-ресурсы, гибкая архитектура и поддержка на всех этапах: от запуска MVP до вывода в продакшен и последующего масштабирования. Selectel готов взять на себя эту нагрузку, чтобы компании могли не просто запустить, а вывести свои проекты на новый уровень. При этом программа направлена не только на создание условий для технологического роста компаний, но и на популяризацию российских AI-решений. В рамках проекта планируется публикация совместных кейсов и статей с участниками, чтобы поделиться опытом и наглядным примером, как IT-инфраструктура может способствовать развитию AI-инициатив. Принять участие в программе могут новые клиенты Selectel — юридические лица или индивидуальные предприниматели. Для подачи заявки необходимо заполнить анкету на сайте программы, после чего команда Selectel выберет наиболее перспективные проекты и предложит участникам грант до 2 000 000 руб. для решения их задач. Ознакомиться с более подробными условиями участия и подать заявку можно на сайте программы.

08.05.2026 [09:14], Сергей Карасёв

NVIDIA и Iren объединили усилия для создания ИИ-инфраструктуры мощностью до 5 ГВтКомпании NVIDIA и Iren (ранее Iris Energy) объявили о стратегическом партнёрстве с целью ускорения развёртывания инфраструктуры ИИ следующего поколения. Речь идёт о создании объектов суммарной мощностью до 5 ГВт, рассчитанных на наиболее ресурсоёмкие нагрузки. В рамках проекта планируется использовать платформу NVIDIA DSX. Это эталонная архитектура ИИ-фабрик, которая охватывает все уровни инфраструктуры — от отдельных ускорителей до сети. Благодаря DSX операторы крупных дата-центров могут максимизировать энергоэффективность, отказоустойчивость, масштабируемость и производительность ИИ-кластеров. При этом ускоряется их построение и снижаются эксплуатационные расходы. Цель нового партнёрства заключается в том, чтобы сократить время развёртывания крупномасштабных ИИ-фабрик путём объединения архитектуры DSX с опытом Iren в области энергетики, землепользования, ЦОД и инфраструктурных решений. Флагманским объектом будущей сети станет кампусе Iren Sweetwater мощностью 2 ГВт в Техасе (США). В перспективе реализуемый проект позволит предоставлять вычислительные мощности для задач ИИ корпоративным клиентам по всему миру. Генеральный директор NVIDIA Дженсен Хуанг (Jensen Huang) отмечает, что фабрики ИИ становятся одним из основополагающих компонентов мировой экономики. Однако развёртывание таких систем в масштабе требует глубокой интеграции по всему стеку — от вычислительных ресурсов и ПО до сетей и электропитания. Iren, по словам Хуанга, обладает необходимым опытом для выполнения этих комплексных работ. По условиям подписанного соглашения, Iren предоставит NVIDIA право на приобретение до 30 млн своих обыкновенных акций сроком на пять лет по цене $70/шт. Это даёт NVIDIA возможность инвестировать до $2,1 млрд при соблюдении определённых условий, включая требования регулирующих органов.

08.05.2026 [01:10], Владимир Мироненко

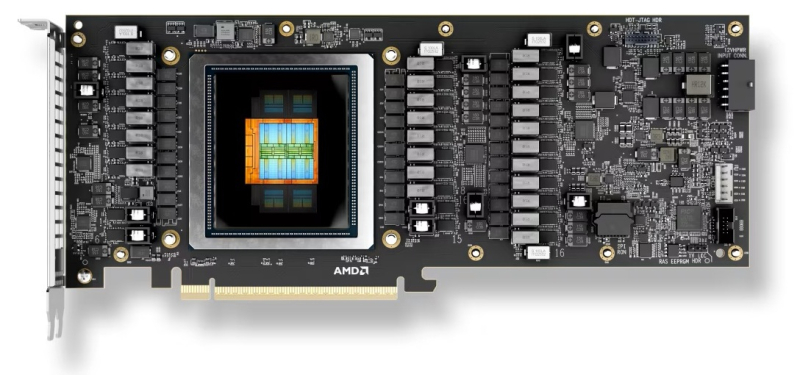

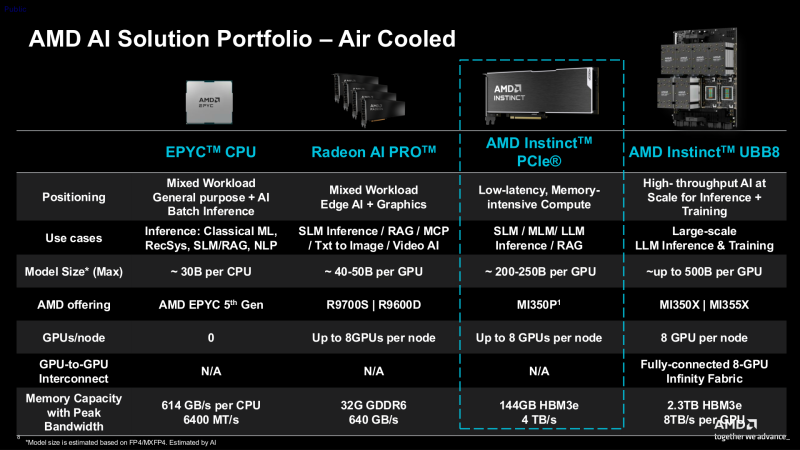

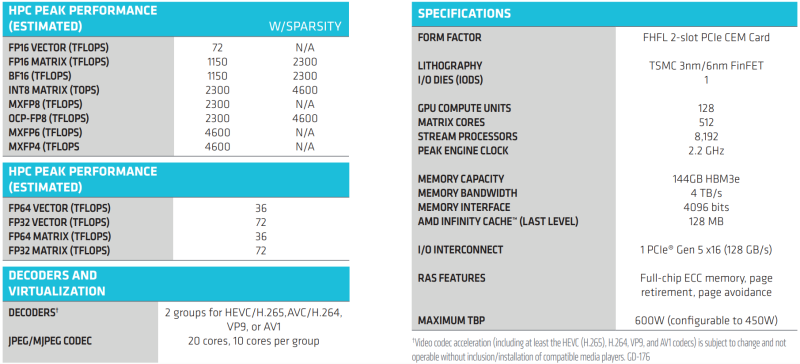

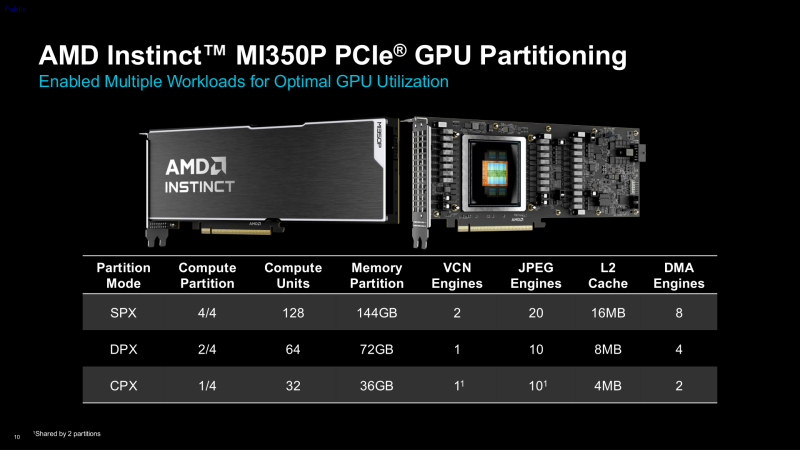

AMD представила ускоритель Instinct MI350P — CDNA 4 в формате PCIeAMD представила Instinct MI350P с интерфейсом PCIe — двухслотовую FHFL-карту для стандартных серверов с воздушным охлаждением. MI350P предназначена для локального развёртывания инференса в рамках существующей инфраструктуры электропитания, охлаждения и серверных стоек ЦОД предприятий. AMD отметила, что новинки с возможностью установки до 8 ед. в одно шасси «идеально подходят для инференса малых, средних и крупных ИИ-моделей и конвейеров RAG». Это первая PCIe-карта Instinct, выпущенная AMD за последние четыре года после выхода модели Instinct MI210. 600-Вт чип MI350P, по сути, представляет собой половинку MI350X (четыре XCD). У MI350P PCIe вдвое меньше вычислительных блоков — 128, что соответствует 8192 потоковым процессорам и 512 матричным ядрам. Пиковая частота составляет 2200 МГц. Кроме того, вместо двух IOD-кристаллов тут только один, он изготовлен по 6-нм техпроцессу TSMC. Сам ускоритель сделан по 3-нм технологии TSMC как MI350X. Весь чип содержит 73 млрд транзисторов. Ускоритель оснащён 128 Мбайт кеш-памяти Infinity Cache и 144 Гбайт памяти HBM3E с 4096-бит шиной, обеспечивающей пропускную способность 4 Тбайт/с. Для сравнения, MI350X оснащён 288 Гбайт памяти HBM3E с 8192-бит шиной. Плата 16-контактный разъём для подачи дополнительного питания. TBP можно установить на уровне 450 Вт вместо стандартных 600 Вт, что снизит производительность и ещё больше — энергопотребление. Интерфейс — PCIe 5.0 x16. Чуть позже будет реализована поддержка SR-IOV и возможность поделить чип на два или четыре vGPU. Расчётная производительность Instinct MI350P в MXFP4-расчётах составляет 2,3 Пфлопс, а пиковая — 4,6 Пфлопс. Это самая высокая производительность среди PCIe-ускорителей корпоративного класса, отметила компания. Предусмотрена поддержка разрежённости для форматов FP16, BF16, INT8 и OCP-FP8, что позволяет ускорить обработку данных. Векторная и матричная FP64-производительности составляет 36 Тфлопс. Кроме того, ускоритель снабжён декодерами HEVC/H.265, AVC/h.264, VP9 и AV1, а также кодеками (M)JPEG. Самым существенным недостатком новинки — это отсутствие прямой связи между ускорителями посредством Infinity Fabric. Всё общение внутри одного узла происходит посредством PCIe-шины, так что наличие восьми MI350P в одном сервере позволит эффективно обслуживать восемь отдельных моделей (до 200–250 млрд параметров), а не одну большую, которая не помещается в памяти единичного ускорителя. NVIDIA попыталась чуть смягчить эту проблему, представив для своих PCIe-ускорителей плату с адаптерами ConnectX-8 SuperNIC со встроенными коммутаторами PCIe 6.0. Сообщается, что Instinct MI350P доступны у различных партнёров компании. Они предлагают полностью открытую экосистему и программный стек Enterprise Ready AI с поддержкой ROCm. AMD заявила, что её эталонный open source пакет AMD Enterprise AI предоставляется партнёрам без каких-либо затрат на лицензирование. Это обеспечивает большую прозрачность кода и помогает снизить операционные расходы. В сочетании с картами Instinct MI350P и решениями от партнёров этот стек позволяет компаниям быстро развёртывать локальные системы без постоянных затрат на токены, говорит AMD.

07.05.2026 [14:02], Руслан Авдеев

Arm рассчитывает заработать миллиарды долларов на серверных процессорах Arm AGIКомпания Arm отчиталась о рекордной квартальной выручке и в докладе особо подчеркнула своё стремление усилить позиции на рынке ИИ-инфраструктур, CPU для дата-центров и ИИ-задачи в целом. По итогам IV квартала 2026 финансового года выручка компании составила $1,49 млрд, рост составил 20 % г/г, сообщает Converge! Digest. Важная роль в стратегии развития компании отводится новым CPU Arm AGI. Отмечается, что роялти принесли компании $671 млн (+11 % г/г), а выручка от лицензирования увеличилась на 29 % до $819 млн. По данным Arm, рост связан с расширенным внедрением архитектуры Armv9, платформы Compute Subsystems (CSS) и возрастающей востребованностью Arm-процессоров в облачных ИИ ЦОД. Особое внимание уделено частичному отходу от обычного лицензирования интеллектуальной собственности в пользу выпуска собственных полупроводников для гиперскейлеров. Не так давно компания совместно с Meta✴ разработала и представила процессор Arm AGI CPU. По оценкам компании, в ближайшие два года спрос на такие чипы превысит $2 млрд. Arm позиционирует AGI CPU как специализированный процессор для координации работы крупных ИИ-кластеров. В компании уверены, что развитие агентных ИИ-систем существенно увеличит нагрузку на процессоры, поскольку ИИ-ускорители отвечают преимущественно за генерацию токенов. В то же время, CPU займутся планированием, управлением памятью, сетевым взаимодействием и координацией вычислений.

Источник изображения: Arm Компания располагает долгосрочным прогнозом развития ИИ-инфраструктуры. По её расчётам, совокупный рынок облачной ИИ-инфраструктуры вырастет с $245 млрд в 2026 финансовом году до более $1 трлн — к 2031. Это произойдёт благодаря развитию систем инференса и агентного ИИ. В компании рассчитывают, что бизнес AGI CPU к 2031 году позволит генерировать порядка $15 млрд/год при одновременном росте сегментов бизнеса, связанных с традиционным лицензированием и получением роялти. Руководство Arm уверено, что процессоры компании со временем превратятся в специальный «слой оркестрации» для ИИ-кластеров гиперскейлеров, в т.ч. AWS, Google Cloud, Microsoft Azure, Meta✴, Oracle Cloud Infrastructure и даже NVIDIA. Arm подчёркивает, что выручка третий год подряд растёт более чем на 20 % благодаря высокому спросы на вычислительную платформу компании, а поскольку ИИ становится всё более «агентным», спрос на Arm AGI превысил ожидания, и это укрепляет позиции компании в качестве вычислительной платформы для эпохи ИИ. По словам отраслевых экспертов, в отчёте Arm отражается более масштабный сдвиг ИИ-инфрастурктуры в направлении «гетерогенных» вычислительных архитектур, в которых CPU вновь приобрели важнейшее значение, поскольку обеспечивают координацию крупных ИИ-кластеров. Хотя при обучении и инференсе доминирующую роль играют ИИ-ускорители на базе GPU и ASIC, гиперскейлеры всё чаще делают ставку на использование CPU для координации ключевых задач, от оркестрации нагрузок до управления энергопотреблением. В то же время Arm фактически начинает конкурировать с продуктами собственных клиентов. При этом компания продолжает получать финансовые поступления как от NVIDIA Grace, так и от гиперскейлеров, которые используют Arm-архитектуры в своих собственных CPU. Так, у У Microsoft имеются Arm-процессоры Cobalt 200, у AWS — Graviton 5, у Alibaba Cloud — Yitian 710, а у Google — Axion. Oracle долгое время полагалась чипы Ampere Computing, которая теперь принадлежит SoftBank.

07.05.2026 [12:21], Руслан Авдеев

Anthropic достанутся все мощности ИИ-кластера xAI Colossus 1Anthropic рассчитывает использовать все вычислительные мощности ИИ-кластера Colossus 1 компании xAI в рамках сделки с её новым владельцем — компанией SpaceX, сообщает Datacenter Dynamics. Anthropic в течение месяца получит доступ к более 300 МВт мощностей ЦОД, обеспечивающих работу более 220 тыс. ИИ-ускорителей NVIDIA. Новый ЦОД значительно расширит возможности пользователей Claude Pro и Claude Max. Кроме того, к Anthropic присоединится Росс Нордин (Ross Nordeen), один из сооснователей xAI, который ранее покинул стартап. Дополнительно Anthropic «выразила заинтересованность» в партнёрском соглашении со SpaceX для строительства орбитальных ЦОД на несколько гигаватт. SpaceX ещё в январе 2026 года подала заявку в Федеральную комиссию по связи США (FCC), чтобы получить разрешение на развёртывание группировки космических ЦОД из миллиона спутников с ИИ-модулями. Проект по-прежнему не одобрен, а AWS даже препятствует его реализации. В апреле xAI объявила, что мощности простаивающего Colossus будет использовать компания Cursor, занимающаяся написанием кода с применением ИИ. Последняя согласилась на возможное поглощение со стороны SpaceX с оценкой в $60 млрд. По существующей договорённости, если SpaceX не купит этот бизнес, она должна будет выплатить Cursor $10 млрд. В рамках соглашения с Anthropic ей будет отдано чуть менее половины общего парка ИИ-ускорителей, сегодня насчитывающего порядка 500 тыс. ускорителей. Сколько именно чипов будет использовать Cursor, неизвестно. По словам Илона Маска (Elon Musk), стоящего за xAI и SpaceX, он согласился сдать в аренду Colossus 1, поскольку обучение LLM xAI переведено на Colossus 2. В дата-центре Colossus 1 используются NVIDIA H100, H200 и GB200. Активисты критикуют кампус ЦОД за использование газовых турбин. ИИ-суперкомпьютер Colossus 1 заработал в Мемфисе в 2024 году, в ЦОД на площадке бывшего завода Electrolux. В марте 2025 года приобретён участок под строительство Colossus 2, дата-центр ввели в эксплуатацию в январе 2026 года. Сейчас ведётся работа над третьим кампусом в Саутхейвене (Southaven), дополнительно будет инвестировано ещё $659 млн в строительство ещё одного здания.

06.05.2026 [17:39], Руслан Авдеев

ДАТАРК расширила производство модульных ЦОДРоссийская компания ДАТАРК, занимающаяся разработкой и производством модульных ЦОД, нарастила полезные производственные площади с 2,9 до 4 тыс. м2 — почти на 40 %. Это связано с ростом востребованности модульных ЦОД и переходом бизнеса к более масштабным решениям. На следующем этапе предусмотрена модернизация производства. В частности, рассматривается внедрение лазерной сварки, а также роботизация ряда операций. Это должно снизить трудоёмкость производства и ускорить выпуск готовых модулей. С прошлого года активно ведётся развитие направления мультимодульных дата-центров. Так, предлагаются варианты, включающие от двух смежных блоков до крупных решений из 20 и более секций. Расширение производства позволит производить более 50 единиц продукции ежегодно. Кроме того, расширенная площадка позволяет выстроить поточное производство в одном месте, от доставки металла на сварочный участок до выхода готовой продукции с монтажной площадки. Чтобы обеспечить производству полную загрузку, сварочный и монтажный участки перевели на непрерывный, сменный график работы, что даёт возможность сократить сроки выполнения заказов.

Источник изображения: Benjamin Wedemeyer/unsplash.com По словам компании, если ранее логистику распределяли между разными локациями, то теперь всё производство сосредоточили в посёлке Большой Исток под Екатеринбургом. В компании уверены, что это сократит расходы и повысит управляемость производственными и бизнес-процессами. Кроме того, до конца 2026 года в Большом Истоке запустят покрасочно-сушильную камеру. По расчётам ДАТАРК, время на покраску и сушку модульных ЦОД должно сократиться в разы.

06.05.2026 [17:08], Сергей Карасёв

Президент OpenAI оказался владельцем долей в Cerebras и CoreWeave, у которых миллиардные сделки с самой OpenAIСоучредитель и президент OpenAI Грег Брокман (Greg Brockman), по сообщению ресурса Datacenter Dynamics, владеет долями в ряде технологических компаний: Cerebras, CoreWeave, Stripe и Helion. С дувмя из них OpenAI имеет контракты на десятки миллиардов долларов. Об этом стало известно в ходе судебного разбирательства, инициированного миллиардером Илоном Маском (Elon Musk). В декабре 2015 года Брокман вместе с Маском, Сэмом Альтманом (Sam Altman) и др. основали некоммерческую организацию OpenAI с целью разработки безопасного и самодостаточного ИИ. После того, как Маск в 2019 году покинул компанию, Альтман стал генеральным директором, и OpenAI сформировала дочернюю коммерческую структуру для привлечения средств. В тот момент Брокман получил крупную долю в OpenAI, оцениваемую сейчас примерно в $30 млрд. В своём иске Маск пытается получить от OpenAI крупную материальную компенсацию, добиться отстранения Альтмана и Брокмана от управления компанией и трансформировать её обратно исключительно в некоммерческую организацию. Примечательно, что Брокман в момент основания OpenAI пообещал пожертвовать организации $100 тыс., но так этого и не сделал.

Источник изображения: персональный сайт Брокмана В том же 2019 году, как стало известно, Брокман начал покупать акции CoreWeave: его доля по состоянию на апрель 2026 года оценивается в $817,37 тыс. Между тем сама OpenAI заключила ряд соглашений по аренде ИИ-инфраструктуры у CoreWeave, обязавшись потратить на услуги этой компании в общей сложности $22,4 млрд. В ходе более раннего судебного разбирательства, инициированного Маском в 2024 году, выяснилось, что OpenAI рассматривала возможность приобретения компании Cerebras — разработчика ИИ-ускорителей. С этим стартапом OpenAI недавно заключила соглашение на приобретение оборудования стоимостью более $20 млрд. Выяснилось, что по состоянию на конец 2025 года стоимость доли Брокмана в Cerebras составляет $2,82 млн. В 2023 году Брокман также начал скупать акции Helion Energy, которая занимается разработкой термоядерных реакторов: на конец прошлого года его доля в деньгах составляла $433,58 тыс. Любопытно, что Альтман инвестирует в эту компанию с 2015-го и до нынешнего года входил в совет её директоров. При этом OpenAI намерена закупать термоядерную энергию у Helion в «огромных объёмах». Что касается компании Stripe (создаёт решения для приёма и обработки электронных платежей), то в ней Брокман получил долю ещё до начала работы в OpenAI. В Stripe он трудился на позиции технического директора, а его доля в этой фирме составляет в акциях $471,26 млн. Stripe обрабатывает часть платежей OpenAI. В 2023 году было объявлено о трёхлетнем контракте стоимостью $60 млн.

06.05.2026 [16:01], Владимир Мироненко

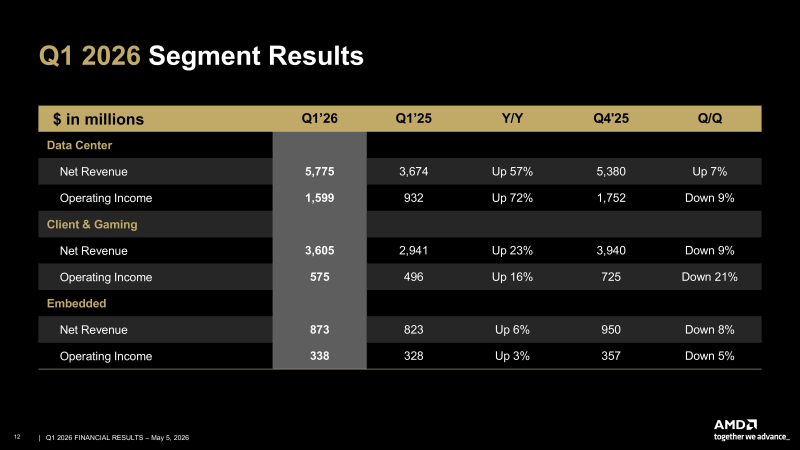

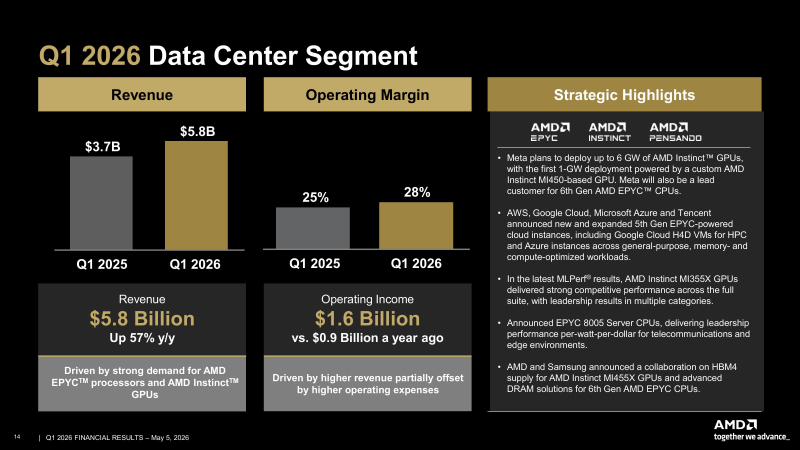

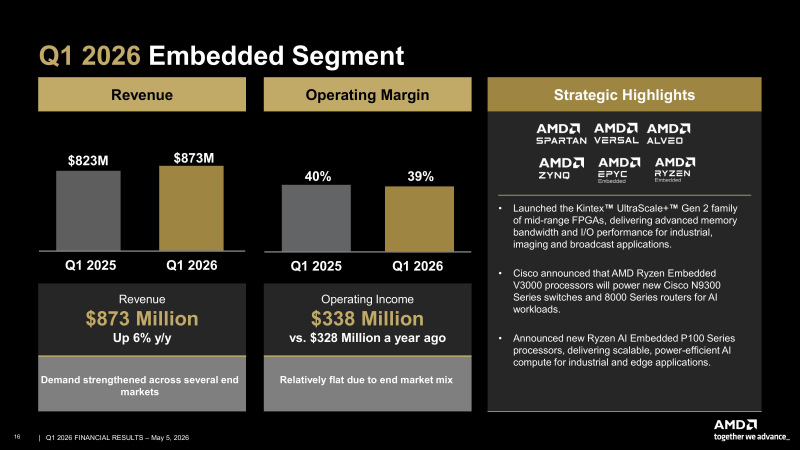

Выручка AMD от чипов выросла в полтора раза — акции компании на подъёмеAMD опубликовала финансовые результаты за I квартал 2026 финансового года, завершившийся 27 марта. Показатели превысили ожидания Уолл-стрит, как и прогноз компании на текущий квартал благодаря растущему спросу на чипы для ИИ ЦОД. В результате акции AMD подскочили примерно на 15 % на дополнительных торгах. Выручка AMD выросла на 38 % до $10,25 млрд с $7,44 млрд годом ранее при прогнозе аналитиков, опрошенных LSEG, в размере $9,89 млрд (по данным CNBC). Скорректированная прибыль (Non-GAAP) на разводнённую акцию составила $1,37, превысив прогноз от LSEG в $1,29. Чистая прибыль (GAAP) выросла почти вдвое — до $1,38 млрд, или 84 цента на акцию, по сравнению с $709 млн, или 44 центами на акцию, годом ранее. Генеральный директор AMD Лиза Су (Lisa Su) указала в своём заявлении, что подразделение ЦОД, поставляющее CPU и ИИ-ускорители, стало «основным драйвером роста выручки и прибыли». «В перспективе мы ожидаем значительного ускорения роста продаж серверов по мере того, как мы будем наращивать поставки для удовлетворения спроса», — сказала Су. Так, AMD ожидает выручку за II финансовый квартал в размере около $11,2 млрд ± $300 млн против прогнозируемых Уолл-стрит $10,52 млрд. Продажи подразделения ЦОД AMD выросли год к году на 57 % до $5,8 млрд, тогда как аналитики, опрошенные LSEG, ожидали выручку в размере $5,64 млрд (по данным Reuters). Успеху способствовал высокий спрос на серверные чипы EPYC и продолжающееся наращивание производства ускорителей Instinct. Компания прогнозирует рост выручки от продаж процессоров для серверов более чем на 70 % в годовом исчислении в текущем квартале. Другие подразделения компании также показали неплохие результаты. Сегмент клиентских и игровых устройств AMD принес $3,6 млрд выручки (рост год к году на 23 %). Сегмент встраиваемых систем увеличил выручку на 6 % до $873 млн. «AMD использует ненасытный спрос на вычислительные мощности для ИИ, и этот квартал показал, что спрос реален, но теперь фокус смещается на то, насколько эффективно они смогут преобразовать его в высокорентабельную выручку», — отметили в Direxion. Ранее Су заявила, что компания «обладает сильной и растущей уверенностью» в своей способности получить «десятки миллиардов долларов» выручки в сегменте ЦОД в следующем году. Она также надеется «превысить долгосрочный целевой показатель роста более чем на 80 % в ближайшие годы». Как ожидает AMD, потенциальный рынок серверных CPU будет расти более чем на 35 % в год, достигнув более $120 млрд к 2030 году. Это выше прогнозируемого в ноябре прошлого года темпа роста в 18 %/год. Акции AMD демонстрируют устойчивый рост уже долгое время, за последние 12 месяцев их стоимость выросла более чем на 253 %, а с начала года — почти на 66 %. Хотя компания по-прежнему значительно отстает от NVIDIA по выручке, её акции пользуются спросом у инвесторов, считающих, что рынок ИИ достаточно велик, чтобы поддерживать нескольких производителей чипов, пишет SiliconANGLE. Помимо процессоров и GPU, AMD также планирует выпустить свою первую полнофункциональную стоечную систему для ИИ ЦОД, AMD Helios AI, в конце этого года. Предполагается, что эта система будет конкурировать с системами NVIDIA Grace Blackwell и Vera Rubin. OpenAI и Meta✴ уже заключили соглашения о поставках Helios, что делает систему AMD жизнеспособным вариантом для ИИ-гигантов и гиперскейелров, стремящихся обеспечить себя достаточными вычислительными ресурсами, отметил ресурс CNBC. Хотя аналитики считают, что AMD лучше подготовлена к тому, чтобы извлечь выгоду из растущего спроса на CPU благодаря увеличению доли рынка и плану развития продуктов, конкуренция со стороны Intel усилилась. В отличие от Intel, которая полагается на собственные производственные, AMD передает производство на аутсорсинг контрактным производителям чипов, таким как TSMC, и зависит от их ограниченных мощностей. Кроме того, NVIDIA теперь тоже осваивает рынок серверных CPU.

06.05.2026 [14:06], Руслан Авдеев

Iren купит Mirantis за $625 млн, чтобы расширить свой ИИ-стекНеооблачная Iren Limited подписала соглашение о покупке компании Mirantis в рамках сделки, предусматривающей оплату обыкновенными акциями на сумму $625 млн. Это позволит добавить облачной платформе компетенции по оркестрации на основе Kubernetes, ПО для облачной инфраструктуры и сервисы корпоративной поддержки, сообщает Converge! Digest. Сделка даст Iren возможность расширить бизнес за пределы предоставления лишь масштабной инфраструктуры ИИ-ускорителей и перейти к развёртыванию ИИ с оркестрацией, мониторингом и управлением жизненным циклом рабочих нагрузок. После закрытия сделки Mirantis будет работать как самостоятельная дочерняя структура и продолжит поддержку существующих клиентов. Iren заявила, что покупка усилит ключевые векторы развития её платформы AI Cloud: от развёртывания и мониторинга до поддержки клиентов и доступа к рынку. На сегодня Mirantis обеспечит приток более 1,5 тыс. корпоративных клиентов и богатый опыт работы с Kubernetes, OpenStack и контейнеризированной инфраструктурой. Кроме того, у Mirantis имеется собственная платформа k0rdent AI для управления ИИ-инфраструктурой на физических и виртуальных серверах и в средах Kubernetes. Также компания — один из основателей инициативы NVIDIA AI Cloud Ready и разработчик ПО в её рамках. В результате сделки вертикально интегрированная модель Iren, включающая электроснабжение, земельные участки, ЦОД и кластеры ИИ-ускорителей, будет дополнена опытом Mirantis в сфере ПО и корпоративных операций.

Источник изображения: Mirantis Неооблачные провайдеры вроде Iren, CoreWeave и гиперскейлеры всё чаще нуждаются не только в масштабной физической инфраструктуре, но и оркестрации, мониторинге и управлении жизненным циклом для того, чтобы выделиться на рынке не только наличием ИИ-ускорителей. Покупка Mirantis позволит конкурировать за сложные многопользовательские ИИ-нагрузки. В марте сообщалось, что Iren объявила о заключении соглашения о покупке более 50 тыс. ускорителей NVIDIA B300. Эта сделка позволит компании расширить парк ускорителей примерно до 150 тыс. ед., что к концу 2026 года обеспечит доход от облачных ИИ-вычислений в размере свыше $3,7 млрд. |

|