Материалы по тегу: разработка

|

17.05.2026 [16:24], Владимир Мироненко

Мейнфреймы тоже «поржавеют»: для IBM z готовится поддержка Rust в ядре LinuxЯн Поленски (Jan Polensky) представил первый набор патчей под названием «s390: включение поддержки Rust и добавление необходимой архитектурной привязки», позволяющих реализовать поддержку языка программирования Rust в сборке ядра Linux для мейнфреймов IBM z. Поддержка уже реализована для архитектур x86-64, ARM, ARM64, LoongArch и RISC-V, но не для s390, отметил ресурс Phoronix. И если Fujitsu готова распрощаться с мейнфреймами, то IBM это направление пока забрасывать не планирует. Она даже намерена «подружит» их с Arm. В примечаниях Ян Поленски сообщил, что поддержка Rust на s390 требует небольшого набора специфических для архитектуры компонентов, прежде чем можно будет использовать общую инфраструктуру ядра Rust: недостающие интерфейсы ассемблера, корректировка параметров сборки для избегания конфликтов и т.д. В настоящее время s390 требует «ночные» сборки rustc. Набор патчей затрагивает всего несколько десятков строк кода, поэтому есть надежда, они будут приняты уже в ядро Linux 7.2. Как отметил ресурс The Register, использование нерелизных версий компилятора Rust, включающих самые свежие изменения, экспериментальные функции и новые возможности, что предполагает нестабильную работу, вряд ли будет воспринято с энтузиазмом многими консервативными компаниями, работающими с мейнфреймами. Тем не менее, набор патчей Поленски — значительный шаг. Когда Rust был добавлен в ядро в 2022 году, The Register упомянул проблему, которая редко поднимается где-либо ещё: хотя ядро обычно компилируется с помощью GCC, стандартный компилятор Rust — rustc — основан на LLVM. Список бэкендов LLVM хотя и растёт, но гораздо короче, чем набор из 48 компиляторов GCC. Существует экспериментальный фронтенд GCC для Rust, но он ещё не готов к полноценному использованию. Само ядро Linux поддерживает компиляцию с использованием LLVM с версии ядра 6.9, выпущенной более двух лет назад.

13.05.2026 [00:40], Владимир Мироненко

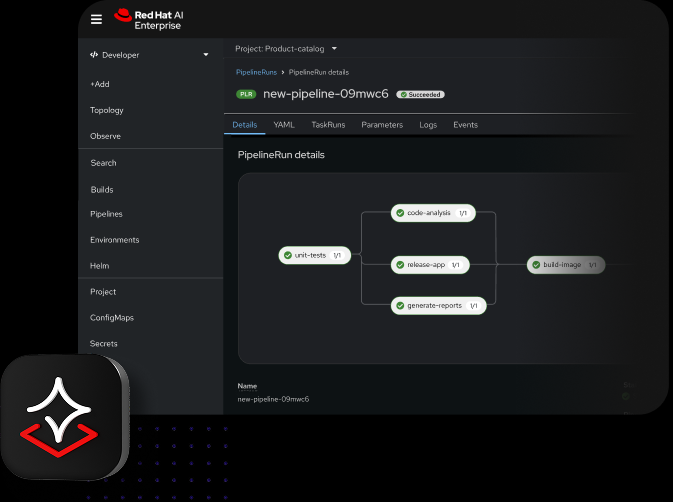

Red Hat анонсировала интегрированную ИИ-платформу Red Hat AI 3.4Red Hat представила Red Hat AI 3.4, обновлённую версию корпоративной ИИ-платформы, разработанную для поддержки крупномасштабного инференса и развёртывания агентного ИИ в гибридных облачных средах. В качестве комплексной платформы Red Hat AI 3.4 предлагает архитектурную основу и операционные инструменты, необходимые для масштабирования моделей и рабочих процессов агентов в гибридном облаке. Стратегия Red Hat в области ИИ разделена на четыре ключевых направления, заявил Джо Фернандес (Joe Fernandes), вице-президент и генеральный директор Red Hat AI. «Во-первых, мы помогаем клиентам быстро, гибко и эффективно выполнять инференс, предоставляя модели в их среде, — передаёт SiliconANGLE. — Во-вторых, мы подключаем их корпоративные данные к этим моделям и агентам. В-третьих, мы помогаем им ускорить развёртывание и управление агентами в гибридной облачной среде. В-четвёртых, мы объединяем всё это на нашей интегрированной ИИ-платформе, позволяя им запускать любую модель в любом агенте на любом оборудовании и в любой облачной среде». Как отметила компания, ключевым элементом этого релиза является предоставление модели как услуги (MaaS), которое обеспечивает единый управляемый интерфейс для разработчиков, позволяющий получать доступ к тщательно отобранным моделям, а администраторам — отслеживать их использование и применять политики. Разработчики получают доступ к моделям через стандартные OpenAI-совместимые API. Таким образом, единое управление применяется как к внутренним, так и к внешним моделям. А инструменты AutoRAG и AutoML автоматизируют сложные задачи ИИ, начиная с выбора наиболее эффективных стратегий извлечения данных для конкретных наборов и заканчивая построением и оптимизацией моделей. В основе системы лежит открытая библиотека vLLM. Её дополняет Kubernetes-нативный стек для инференса llm-d. Поддержка спекулятивного декодирования, которая в этом релизе стала общедоступной, повышает скорость ответа в два-три раза с минимальным влиянием на его качество и снижает стоимость взаимодействия. Кроме того, vLLM теперь поддерживает работу на CPU, что актуально для небольших языковых моделей. Для управления инструментами для агентов Red Hat представляет каталог серверов MCP и связанный с ним шлюз MCP. Новый инструментарий AgentOps даёт возможность управления агентами в масштабе, независимо от используемой платформы, на протяжении всего их жизненного цикла. Это включает в себя интегрированную трассировку вызовов LLM, вызовов инструментов и этапов рассуждений, а также управление криптографической идентификацией через SPIFFE/SPIRE. Последний позволяет организациям заменять статические, жёстко закодированные ключи кратковременными токенами. Это поддерживает операции с минимальными привилегиями для автономных агентов на всех уровнях стека и помогает подтвердить, что действия агентов связаны с проверенной личностью. Для обеспечения интеграции корпоративных данных с моделями и агентами Red Hat AI 3.4 представляет управление с помощью промптов и центр оценки точности, качества и безопасности моделей и агентов. Последний не зависит от фреймворков и заменяет разрозненные методы тестирования единым интегрированным подходом. Prompt Lab and Registry, централизованное хранилище промптов в виде полноценных информационных ресурсов, предоставляет разработчикам и администраторам единый источник достоверной информации о входных данных, управляющих моделями и агентами.

Источник изображения: Red Hat Новые возможности трассировки построены на основе MLflow. Интеграция MLflow обеспечивает прозрачность работы агента, позволяя осуществлять сквозную трассировку вызовов LLM, этапов рассуждений, запуска инструментов, ответов модели и использования токенов через OpenTelemetry. Это создаёт прозрачный журнал аудита для всего жизненного цикла подсказок, эмбеддингов и конфигураций RAG для поддержки отладки и аудита. MLflow также обеспечивает интегрированное отслеживание экспериментов и управление артефактами для сценариев использования генеративного ИИ и прогнозного ИИ. Платформа Red Hat AI позволяет пользователям проверять безопасность моделей и агентов с помощью автоматизированного сканирования на наличие угроз, которое теперь интегрировано непосредственно в цикл разработки. Используются инструменты Chatterbox Labs и Garak. Платформа проверяет модели и агентных систем на наличие таких рисков как взлом, промпт-инъекций и предвзятость, в сочетании с NVIDIA NeMo Guardrails для обеспечения безопасности во время выполнения. Сообщается, что Red Hat AI 3.4 изначально поддерживает ускорители NVIDIA Blackwell и AMD Instinct MI325X. Расширяя эту унифицированную архитектуру платформы для работы непосредственно в управляемых облаках сторонних разработчиков, в том числе посредством Red Hat AI Inference в IBM Cloud, Red Hat обеспечивает операционную согласованность на широком спектре оборудования и облачных провайдеров.

12.05.2026 [13:24], Сергей Карасёв

Новое бизнес-подразделение OpenAI поможет клиентам во внедрении ИИГруппа OpenAI Group PBC сформировала бизнес-подразделение OpenAI Deployment Company, которое будет оказывать сторонним заказчикам услуги по внедрению ИИ-моделей и их оптимизации под конкретные задачи. Инвестиции в OpenAI Deployment Company на первом этапе составят $4 млрд при оценке этой структуры в $14 млрд. Средства поступят от самой OpenAI и более чем десяти других инвесторов, крупнейшим из которых является управляющая компания TPG. В раунде также приняли участие SoftBank Group, Bain Capital, Brookfield, Capgemini SE и McKinsey & Co. Контроль над формируемой организацией сохранит за собой OpenAI. Компания обязалась обеспечить минимальную доходность в размере 17,5% для внешних инвесторов OpenAI Deployment Company. Новая структура поможет крупным предприятиям во внедрении ИИ-моделей OpenAI. Для этого на объекты заказчиков будут направляться инженеры по развёртыванию (Forward Deployed Engineer, FDE) — специалисты, обладающие навыками разработки ПО и взаимодействия с клиентами. Такие инженеры выступают в качестве связующего звена между поставщиком продуктов и заказчиком. Внедрение ИИ-моделей на стороне клиента OpenAI намерена осуществлять в рамках многоэтапного процесса. Сначала специалисты оценят возможные варианты применения ИИ на площадке заказчика и разработают наиболее эффективные сценарии использования. Затем будет осуществлено пилотное развёртывание для «небольшого количества приоритетных рабочих процессов»: это поможет продемонстрировать отдачу от применения продуктов OpenAI. На финальном этапе произойдёт полноценное внедрение. Кроме того, по запросу клиента специалисты OpenAI Deployment Company могут осуществить сопутствующие работы, например, интегрировать ИИ-модель с существующими приложениями в IT-инфраструктуре заказчика. Для развития бизнеса OpenAI Deployment Company приобрела лондонскую фирму Tomoro AI Ltd., предоставляющую технологические услуги. В результате этой сделки, финансовые условия которой не раскрываются, OpenAI получила около 150 инженеров FDE и других технических специалистов.

12.05.2026 [12:00], Сергей Карасёв

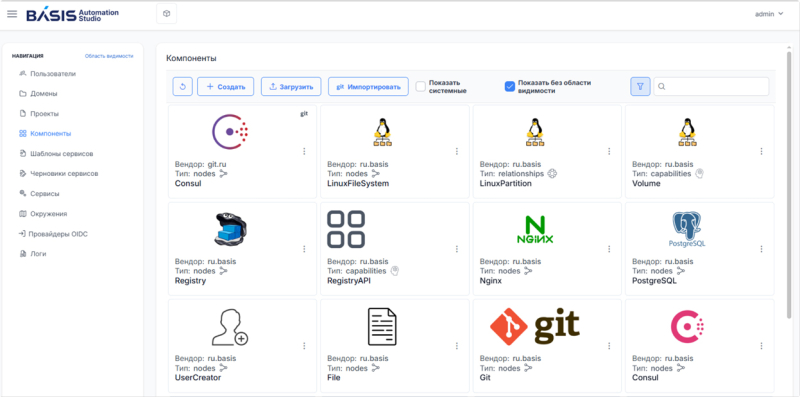

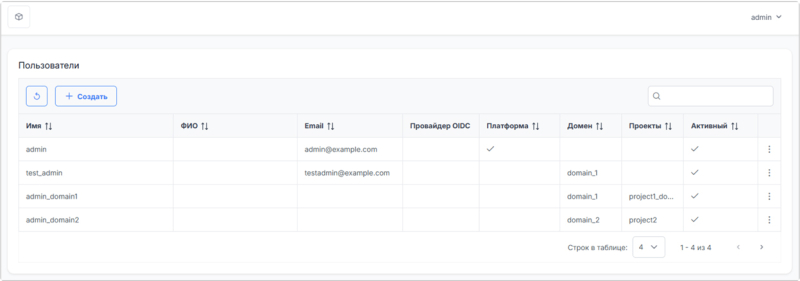

«Базис» представил конструктор платформенных сервисов Basis Automation StudioКомпания «Базис», крупнейший российский разработчик решений для управления динамической ИТ-инфраструктурой, представила конструктор платформенных сервисов Basis Automation Studio (BAS). Решение является частью расширенной конфигурации облачной платформы Basis Dynamix Cloud Control и будет актуально в первую очередь для заказчиков, которые хотят автоматизировать развёртывание сложных ИТ-систем и платформенных сервисов, использующих виртуальную инфраструктуру. Для решения этой задачи Basis Automation Studio предоставляет системным администраторам и архитекторам заказчика инструменты для проектирования, развёртывания и сопровождения платформенных сервисов в виртуальной инфраструктуре. Конструктор позволяет визуально проектировать инфраструктуру на основе готовых компонентов и связей между ними, использовать каталог шаблонов виртуальных инфраструктур и платформенных сервисов, а также расширяемую библиотеку типовых элементов и образцов востребованного ПО, включая ClickHouse, Consul, Docker, MariaDB и PostgreSQL. Basis Automation Studio поддерживает стандартные для облачной инфраструктуры инструменты и подходы, включая архитектуру TOSCA, формат сериализации YAML, систему управления конфигурациями Ansible, язык Python, интерпретатор Bash. Они используются для описания облачной инфраструктуры и управления её компонентами, развёртывания сервисов и их настройки. После развёртывания сервисов администраторы могут создавать day-2 операции для их сопровождения, мониторинга, обновления и поддержания работоспособности. Готовые сервисы можно публиковать на витрине портала самообслуживания, где они доступны для заказа в один клик пользователям облачной инфраструктуры. Для администрирования продукта и разработки шаблонов в BAS предусмотрен веб-интерфейс, включая визуальный редактор сервисов, а также инструменты управления правами и контроля доступа к компонентам инфраструктуры. В Basis Automation Studio реализована иерархическая мультитенантная модель, которая обеспечивает строгую логическую изоляцию ресурсов и детализированное управление доступом. На каждом уровне иерархии могут быть независимо назначены права доступа, роли и разрешения для взаимодействия с конструктором и запущенными с его помощью сервисами. Например, можно разграничить доступ между различными департаментами (или другими бизнес-единицами) одной компании, группируя принадлежащие им проекты и пользовательские учётные записи в специальные контейнеры, называемые доменами. В этом случае пользователи и ресурсы одного домена будут невидимы и недоступны для другого, что помогает заказчику обеспечивать конфиденциальность и сохранность данных в рамках масштабируемой и разветвлённой ИТ-инфраструктуры. Дополнительно Basis Automation Studio предлагает ролевую модель управления пользователями платформы. По умолчанию доступны следующие роли: администратор с полными правами на управление конструктором, архитектор для управления компонентами и сервисами, разработчик компонентов и сервисов, администратор проектов, пользователь. При необходимости одному аккаунту внутри конструктора может быть назначено несколько ролей, в этом случае их права суммируются. В результате заказчик получает простой в то же время достаточно гибкий инструмент для обеспечения безопасности виртуальной инфраструктуры. «Интенсивное развитие облачной платформы Basis Dynamix Cloud Control и, в частности, появление конструктора платформенных сервисов Basis Automation Studio стало нашим ответом на растущий интерес рынка к облачной и гибридной инфраструктурам. Задача Basis Automation Studio — облегчить декларирование облачной инфраструктуры, а также развёртывание внутри неё необходимых для бизнеса ИТ-систем и сервисов, в первую очередь за счёт автоматизации этих процессов. Мы планируем активно развивать наш продукт под задачи российских заказчиков», — отметил Дмитрий Сорокин, технический директор компании «Базис».

08.05.2026 [14:11], Сергей Карасёв

Selectel запускает программу поддержки AI-проектов с грантом до 2 млн рублей на IT-инфраструктуруSelectel, крупнейший независимый провайдер IT-инфраструктуры в России, объявил о запуске программы поддержки для компаний, разрабатывающих решения в области искусственного интеллекта. Участники смогут получить грант до 2 000 000 руб. на использование вычислительных ресурсов Selectel, а также техническую помощь в организации IT-инфраструктуры для ML-задач от экспертов компании. В условиях растущего спроса на вычислительные мощности для обучения, инференса и запуска генеративных моделей для бизнеса крайне важен доступ к надёжной, производительной и масштабируемой IT-инфраструктуре. Для этого Selectel создал специальную программу, в рамках которой компании смогут получить поддержку для развития своих AI-проектов. После подачи заявки и прохождения интервью участникам будут доступны до 2 000 000 руб. на IT-инфраструктуру для ML-задач, включая серверы с GPU, Managed Kubernetes с GPU и Foundation Models Catalog. «Selectel последовательно развивает AI-направление, обеспечивая вычислительные мощности для бизнеса любого масштаба и создавая продуктовые решения для ML-задач. Mы строим вертикально интегрированное предложение и в этом году анонсировали сразу несколько запусков: собственный AI-сервер, обновление AI-платформы для инференса, а также интеграцию партнёрского решения с GlowByte и Data Sapience. Поэтому мы можем помочь компаниям реализовывать любые проекты на нашей инфраструктуре — и для нас это не просто поддержка, а возможность лучше понимать потребности рынка и усиливать нашу платформу», — поделился Александр Тугов, директор AI-вертикали Selectel. Для реализации проектов с использованием ML-инструментов компаниям нужны мощные вычислительные GPU-ресурсы, гибкая архитектура и поддержка на всех этапах: от запуска MVP до вывода в продакшен и последующего масштабирования. Selectel готов взять на себя эту нагрузку, чтобы компании могли не просто запустить, а вывести свои проекты на новый уровень. При этом программа направлена не только на создание условий для технологического роста компаний, но и на популяризацию российских AI-решений. В рамках проекта планируется публикация совместных кейсов и статей с участниками, чтобы поделиться опытом и наглядным примером, как IT-инфраструктура может способствовать развитию AI-инициатив. Принять участие в программе могут новые клиенты Selectel — юридические лица или индивидуальные предприниматели. Для подачи заявки необходимо заполнить анкету на сайте программы, после чего команда Selectel выберет наиболее перспективные проекты и предложит участникам грант до 2 000 000 руб. для решения их задач. Ознакомиться с более подробными условиями участия и подать заявку можно на сайте программы.

30.04.2026 [15:41], Руслан Авдеев

VK Tech предложила бизнесу платформу VK AI Space для создания и запуска ИИ-агентовVK Tech представила платформу VK AI Space, позволяющую разрабатывать и запускать кастомных ИИ-агентов. Основой платформы стали большие языковые модели (LLM), в том числе — собственные разработки группы VK, обученные на российских данных. Кроме того, использованы популярные модели open source, а также ML-модели, предназначенные для работы систем компьютерного зрения, распознавания аудио и др. Подчёркивается, что интеграция с корпоративным ПО VK Tech позволяет быстро включать новые ИИ-сценарии в рабочую среду сотрудников компаний-клиентов, например — создавать ИИ-боты в VK WorkSpace. Платформа имеет набор уже готовых ИИ-агентов под распространённые задачи: для подготовки документов и создания протоколов встреч, перевода материалов, составления кратких резюме представленных данных, поиска по корпоративным базам знаний. Платформу протестировали на реальных внутренних ИИ-проектах VK. Особенностью платформы является возможность VK AI Space создавать изолированный контур для каждого ИИ-агента, что позволяет клиентам выбирать заранее, к каким системам агент получит доступ и что именно ему разрешено делать. После получения задачи агент самостоятельно планирует этапы её выполнения, работает с доступными инструментами и адаптируется к новым данным. Даже если принятое решение будет ошибочным, ИИ-агент не сможет выйти за пределы сферы своей ответственности и нанести ущерб смежным системам. При этом можно в любое время проверить шаги агента и наличие ошибок. Изолированные контуры VK Tech позволят сокращать время от пилотного проекта до начала реальной эксплуатации, что даст возможность масштабировать применение ИИ в организациях экономически эффективно, говорит компания. Помимо возможности развернуть VK AI Space на собственных мощностях клиента, предусмотрена работа платформы в облаке VK Cloud. Кроме того, предусмотрено предоставление готового программно-аппаратного комплекса по подписке.

28.04.2026 [15:15], Владимир Мироненко

NEC с помощью Anthropic создаст крупнейшую в Японии команду специалистов в области ИИ, хотя сами японцы скептически относятся к ИИЯпонская корпорация NEC объявила о стратегическом сотрудничестве с ИИ-стартапом Anthropic PBC с целью ускорения внедрения ИИ в корпоративном секторе страны. Как отмечено в пресс-релизе, NEC станет первым глобальным партнёром Anthropic, базирующимся в Японии. NEC и Anthropic будут совместно разрабатывать в рамках сотрудничества безопасные, специализированные продукты на основе ИИ для японских клиентов. Около 30 тыс. сотрудников NEC по всему миру будут использовать ИИ-модели Claude для разработки ПО с ИИ. На первом этапе совместная разработка будет сосредоточена на ИИ-решениях для таких секторов, как финансы, производство и местное самоуправление. NEC отметила, что уже использует передовые ИИ-технологии Anthropic в работе сервисов Центра оперативного управления безопасностью (SOC) для защиты цифровой инфраструктуры компаний, работающих как в Японии, так и по всему миру, от всё более сложных киберугроз. В дальнейшем корпорации планирует использовать новые разработки и опыт, накопленный в рамках сотрудничества, для создания новых предложений в сфере кибербезопасности нового поколения с использованием Claude. Компании также интегрируют Claude, включая Claude Opus 4.7 и Claude Code, в платформу NEC BluStellar Scenario, которая объединяет консалтинг, ИИ-инструменты, безопасность и услуги цифровой инфраструктуры для бизнеса, начиная с предложений по управлению на основе данных и улучшению клиентского опыта, и постепенно расширяясь на другие области. Процесс интеграции NEC начнёт с использования Claude в двух сценариях из пакета BluStellar Scenario — «Сценарии для управления на основе данных» и «Сценарии для трансформации клиентского опыта» — и постепенно распространит её применение на другие сценарии. Совместные планы включают создание NEC Центра передового опыта (CoE) с целью подготовки высококвалифицированных специалистов по разработке с применением ИИ, используя техническую поддержку и обучение, предоставляемые Anthropic, с интеграцией Claude Code и других инструментов в повседневные рабочие процессы. Благодаря запуску центра NEC намерена создать одну из крупнейших в Японии команд инженеров, специализирующихся на ИИ. NEC применяет подход Client Zero (клиент-ноль) к выпуску продуктов, то есть её сотрудники сначала используют продукты во внутренних бизнес-операциях, прежде чем продавать их потенциальным клиентам. В рамках партнёрства NEC расширит использование Claude Cowork в своих внутренних бизнес-операциях для Client Zero. Использование ИИ-помощника, который частично автоматизирует задачи во многих областях, позволит повысить эффективность и сэкономить время. «Это долгосрочное партнёрство с Anthropic позволит NEC максимально использовать потенциал ИИ на японском рынке, — заявил исполнительный директор и главный операционный директор NEC Corporation. — Вместе мы стремимся создавать решения, отвечающие высоким стандартам безопасности, надёжности и качества, которые требуются компаниям и государственным учреждениям в Японии». Хотя японские компании и государственный сектор стремятся продвигать ИИ-технологии, общественность относится к внедрению ИИ с осторожностью, сообщил ресурс Cybernews. По данным опросов SPF, отношение японской общественности к внедрению ИИ «поразительно пессимистично» по сравнению с другими странами — японцы не уверены в способности ИИ существенно улучшить их личную жизнь и японского общества в целом. Согласно отчёту Организации экономического сотрудничества и развития (OECD), скептицизм в отношении ИИ в Японии выше, чем в других странах Азии. Основные опасения жителей Японии включают массовую автоматизацию и потерю из-за этого рабочих мест, а также потерю доверия к властям, которые, по сути, предают свои принципы и сильно зависят от массового ИИ-производства, принадлежащего крупным транснациональным технологическим компаниям.

27.04.2026 [13:45], Владимир Мироненко

SUSE анонсировала SUSE AI Factory with NVIDIA, упрощающую предприятиям создание собственных ИИ-стековSUSE объявила о запуске платформы SUSE AI Factory with NVIDIA, разработанной специально для решения строгих глобальных задач обеспечения цифрового суверенитета. SUSE AI Factory with NVIDIA представляет собой предварительно протестированный унифицированный программный стек для корпоративного ИИ, созданный на основе SUSE AI и NVIDIA AI Enterprise, призванный преодолеть разрыв между локальной разработкой и масштабируемым корпоративным развёртыванием, позволяя предприятиям создавать, управлять и масштабировать рабочие ИИ-нагрузки на периферии сети, в ЦОД и в публичных облачных средах, сохраняя при этом более жесткий контроль над данными и инфраструктурой. Как отметил StorageReview.com, SUSE позиционирует SUSE AI Factory with NVIDIA как стандартизированный программный слой для корпоративного ИИ, а не как автономную модель или сервис. Стек объединяет несколько компонентов NVIDIA, включая микросервисы NIM, открытые модели Nemotron, NeMo для разработки и управления агентами, Run:ai для оркестрации GPU, NVIDIA Kubernetes Operators, OpenShell для безопасной поддержки среды выполнения агентов и NemoClaw, который использует SUSE K3s в качестве части эталонной архитектуры для более безопасного развёртывания автономных агентов.

Источник изображения: SUSE SUSE AI Factory with NVIDIA стандартизирует развёртывание и запуск приложений ИИ, позволяя разработчикам создавать и тестировать приложения в изолированной среде, в то время как команды платформы управляют развёртыванием либо через единый интерфейс на основе Rancher, либо с помощью автоматизированных рабочих процессов GitOps для управления в масштабе предприятия. Это позволит сократить время настройки и ускорит переход от концепции к производству, уменьшая операционные издержки без необходимости использования разрозненных инструментов. SUSE AI Factory with NVIDIA включает в себя следующие возможности:

17.04.2026 [12:00], Сергей Карасёв

Конференция OS DAY 2026 «Встроенные операционные системы, реальное время»Ежегодная XIII научно-практическая конференция «OS DAY. Встроенные ОС, реальное время» пройдёт 4–5 июня на базе РЭУ им. Г.В. Плеханова. Центральными на OS DAY 2026 станут вопросы, касающиеся операционных систем для встроенных устройств и ОС реального времени. Необходимость создания собственных локализованных автоматических систем управления технологическими процессами и сопутствующей им инфраструктуры становится сегодня вопросом национальной безопасности, что делает темы этого года особенно актуальными. Участие в конференции примут специалисты в области системного программирования, представители отраслевых регуляторов, руководители высших учебных заведений, профильных факультетов и кафедр. Приглашены к диалогу и представители компаний-производителей аппаратных систем: успешное решение задачи безопасности АСУТП может быть только комплексным, с учётом как операционных систем и средств их разработки, так и «железа». Только так можно добиться максимальной надёжности встроенных систем. Участники OS DAY обсудят, какие задачи ставит промышленность перед компактными устройствами, каковы границы применения одноплатных компьютеров и микрокомпьютеров, как из решаемых задач получаются требования к операционным системам, где применяется «мягкое» и «жёсткое» реальное время, как производители встраиваемых устройств и ПО для них решают задачи построения разносторонних экосистем своих продуктов. Председатель программного комитета OS DAY, директор ИСП РАН, академик Арутюн Аветисян отметил: «Развитие отечественных встроенных систем — один из ключевых факторов достижения технологической независимости России. Перед отраслью стоят традиционные задачи: надёжность, безопасность и работа в реальном времени. Однако формируются и новые вызовы, связанные с внедрением технологий искусственного интеллекта. Их применение во встроенных системах требует глубокой оптимизации в условиях ограниченных вычислительных ресурсов, а также сотрудничества с отечественными производителями аппаратного обеспечения. Поэтому ключевая задача — сбалансировать традиционные инженерные подходы и новые ИИ-технологии, обеспечив устойчивое формирование таких решений». В рамках OS DAY 2026 состоится панельная дискуссия «Технологический суверенитет промышленного производства: встраиваемые устройства», в которой примут участие разработчики российских операционных систем и систем автоматического управления технологическими процессами, представители промышленных предприятий и отраслевых регуляторов. Участники обсудят безопасность встраиваемых устройств и программное обеспечение для них — ОС и прикладные программы, пути достижения технологического суверенитета встраиваемых АСУТП. На второй день конференции запланировано проведение круглого стола, посвящённого преподаванию системного программирования в современной образовательной системе. Его участниками станут топ-менеджеры компаний, специализирующихся на создании операционных систем, и представители отечественных профильных вузов. Основной темой для обсуждения станет необходимость перемен в системе подготовки специалистов в области системного программирования, достижение синергии в работе высших учебных заведений, готовящих кадры для отрасли, и компаний-разработчиков ОС, как работодателей. Будет уделено внимание будущим переменам в образовательном процессе после отмены болонской системы, необходимости корректировки программ преподавания системного программирования. История проведения OS DAY показывает, что принятые на конференции решения становятся не просто важными, а ключевыми для отрасли системного программирования. Есть все основания полагать, что в этом году они окажутся таковыми и для системы образования. На конференцию OS DAY 2026 принимаются доклады до 28 апреля по темам:

Программный комитет традиционно рассматривает доклады, которые не вписываются в указанную тематику, но укладываются в общее направление конференции — разработка операционных систем и системного инструментария. Конференцию организует консорциум OS DAY: ИСП РАН, «Лаборатория Касперского», «Открытая мобильная платформа», «Базальт СПО», «РЕД СОФТ» и НТЦ ИТ РОСА. Конференция проводится при поддержке: РАН, ФСТЭК России, АРПП «Отечественный софт», НП «РУССОФТ». Партнёр конференции: управление цифровой трансформации РЭУ им. Г.В. Плеханова. Время и место проведения: 04–05 июня 2026 г., РЭУ им. Г.В. Плеханова. Адрес: Москва, ул. Большая Серпуховская, д. 11, корпус 9, этаж 6, «Точка-кипения РЭУ». Для участия просьба зарегистрироваться на сайте https://osday.ru. Зарегистрированным участникам, выбравшим формат онлайн, будет предоставлен доступ на адрес электронной почты, указанный при регистрации. По дополнительным вопросам просьба обращаться: Анна Новомлинская, исполнительный директор OS DAY, an@ispras.ru.

16.04.2026 [23:55], Владимир Мироненко

Ядро Linux лишается поддержки российских процессоров «Байкал-Т1»Как сообщают ресурс OpenNET и Phoronix, в состав ядра Linux 7.1 приняты изменения, удаляющие поддержку контроллеров AHCI SATA и PCIe, применяемых в SoC Baikal-T1. Процесс начался не сегодня — в ядре 7.0 уже была удалена поддержка драйверов i2c и spi dw. В качестве причины удаления указано отсутствие сопровождения и незавершённая интеграция в состав ядра компонентов платформы Baikal. В частности, драйвер PCIe так и не был доведён до полностью работоспособного состояния.  Помимо этого, на рассмотрении находятся pull-запросы на удаление связанных с Baikal драйверов таймера, памяти, physmap, шины, hwmon, dwc и bt1-rom. Поддержка «Байкал-Т1» была включена в ядро Linux, начиная с ветки 5.8. Сохранилась она и в ядре Linux 6.18 LTS. В 2023 году сообщество разработчиков ядра Linux отказалось принимать от российской компании «Байкал Электроникс» патчи для ядра в связи с введением в отношении неё санкций США. По этой же причине из официального файла MAINTAINERS были удалены упоминания о ряде разработчиков, потенциально связанных с Россией — создатель проекта Linux Линус Торвальдс (Linus Torvalds) поддержал это решение. |

|