Материалы по тегу: nvidia

|

08.05.2026 [09:14], Сергей Карасёв

NVIDIA и Iren объединили усилия для создания ИИ-инфраструктуры мощностью до 5 ГВтКомпании NVIDIA и Iren (ранее Iris Energy) объявили о стратегическом партнёрстве с целью ускорения развёртывания инфраструктуры ИИ следующего поколения. Речь идёт о создании объектов суммарной мощностью до 5 ГВт, рассчитанных на наиболее ресурсоёмкие нагрузки. В рамках проекта планируется использовать платформу NVIDIA DSX. Это эталонная архитектура ИИ-фабрик, которая охватывает все уровни инфраструктуры — от отдельных ускорителей до сети. Благодаря DSX операторы крупных дата-центров могут максимизировать энергоэффективность, отказоустойчивость, масштабируемость и производительность ИИ-кластеров. При этом ускоряется их построение и снижаются эксплуатационные расходы. Цель нового партнёрства заключается в том, чтобы сократить время развёртывания крупномасштабных ИИ-фабрик путём объединения архитектуры DSX с опытом Iren в области энергетики, землепользования, ЦОД и инфраструктурных решений. Флагманским объектом будущей сети станет кампусе Iren Sweetwater мощностью 2 ГВт в Техасе (США). В перспективе реализуемый проект позволит предоставлять вычислительные мощности для задач ИИ корпоративным клиентам по всему миру. Генеральный директор NVIDIA Дженсен Хуанг (Jensen Huang) отмечает, что фабрики ИИ становятся одним из основополагающих компонентов мировой экономики. Однако развёртывание таких систем в масштабе требует глубокой интеграции по всему стеку — от вычислительных ресурсов и ПО до сетей и электропитания. Iren, по словам Хуанга, обладает необходимым опытом для выполнения этих комплексных работ. По условиям подписанного соглашения, Iren предоставит NVIDIA право на приобретение до 30 млн своих обыкновенных акций сроком на пять лет по цене $70/шт. Это даёт NVIDIA возможность инвестировать до $2,1 млрд при соблюдении определённых условий, включая требования регулирующих органов.

07.05.2026 [15:03], Сергей Карасёв

TotalEnergies создаст суперкомпьютер Pangea 5 за €100 млнФранцузская нефтегазовая компания TotalEnergies объявила о заключении соглашения с Dell Technologies и NVIDIA на создание нового суперкомпьютера под названием Pangea 5. Ожидается, что его ввод в эксплуатацию позволит увеличить вычислительные мощности TotalEnergies в шесть раз по сравнению с нынешними показателями (точные данные не приводятся). Технические подробности о будущей НРС-системе не раскрываются. Отмечается лишь, что в составе комплекса будут применяться «специализированные процессоры, рассчитанные на массово-параллельные вычисления». Речь идёт об ускорителях NVIDIA на основе GPU, а также о решениях InfiniBand и пр. Инвестиции в проект Pangea 5 оцениваются в €100 млн. Суперкомпьютер расположится в Научно-техническом центре Жана Феже в По (Jean Féger Scientific and Technical Center at Pau — CSTJF) на юго-западе Франции. Там же смонтирована нынешняя машина Pangea 4, запущенная в июле 2024 года. По сравнению с этим комплексом при сопоставимой производительности общее энергопотребление Pangea 5 будет ниже примерно на 40 %, а потребление энергии системой охлаждения — меньше в пять раз. Тепло, генерируемое новым суперкомпьютером, планируется использовать для отопления зданий CSTJF, в которых работают более 2,5 тыс. человек. Компания TotalEnergies будет использовать Pangea 5 для ресурсоёмких вычислений с применением передовых методов сейсморазведки для повышения точности визуализации недр и ускорения геологоразведочных работ. Кроме того, суперкомпьютер поможет в реализации проектов, связанных с ИИ. Запуск вычислительного комплекса намечен на следующий год.

06.05.2026 [22:12], Владимир Мироненко

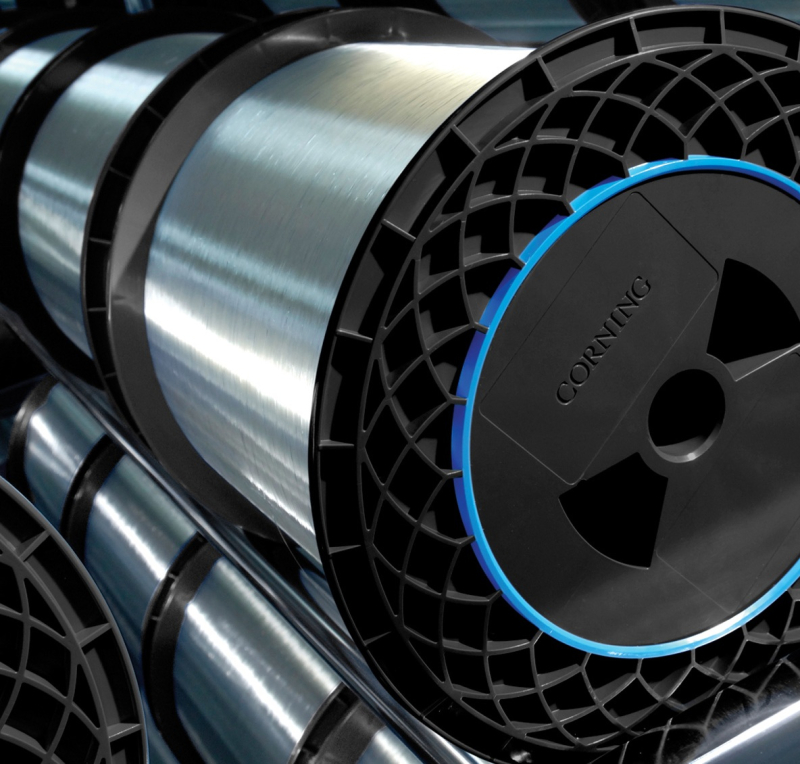

Corning построит в США три завода по выпуску оптоволокна для ИИ ЦОД с чипами NVIDIANVIDIA и Corning объявили о долгосрочном партнёрстве с целью расширения производства в США решений для оптической связи для ИИ-инфраструктуры. Corning построит в Северной Каролине и Техасе три завода по производству средств оптической связи для ЦОД, что позволит создать по меньшей мере 3000 рабочих мест и обеспечить десятикратное увеличение производственных мощностей Corning по выпуску оптики в США. Также это увеличит мощности Corning по производству оптоволокна в США более чем на 50 %, что будет способствовать удовлетворению растущего спроса отрасли. По мере развёртывания ИИ-инфраструктуры оптическая связь становится её важным компонентом. «ИИ является движущей силой крупнейшего в наше время развития инфраструктуры и уникальной возможностью оживить американское производство и цепочки поставок, — заявил основатель и генеральный директор NVIDIA Дженсен Хуанг (Jensen Huang). — Вместе с Corning мы создаем будущее вычислительной техники с использованием передовых оптических технологий — создаём основу для ИИ-инфраструктуры, в которой интеллект развивается со скоростью света». Как сообщает Sherwood News, в рамках сделки Corning предоставила NVIDIA два типа варрантов: предварительно финансируемый (Pre-funded) варрант на покупку до 3 млн акций за $500 млн, а также традиционные варранты, предоставляющие NVIDIA право на покупку до 15 млн акций Corning по цене $180 на сумму до $3,2 млрд, тем самым получая выгоду от того, что цена акций Corning превысит этот уровень в течение трёх лет (если только это партнёрство не будет расторгнуто или Corning не совершит «фундаментальную сделку» до этого). После анонса партнёрства с NVIDIA акции Corning взлетели на более чем на 19 %, сообщает Reuters. Corning также повысила свои долгосрочные цели по продажам в связи с растущим спросом на оптику для ИИ-инфраструктуры. Ранее Corning заявила, что ожидает увеличить годовую регулярную выручку (ARR) до $20 млрд к концу этого года. Компания также планирует к концу 2028 года увеличить годовой оборот до $30 млрд, а к концу 2030 года — до $40 млрд. В январе Corning заключила сделку с Meta✴ на поставку оптоволоконных кабелей для ИИ ЦОД на сумму до $6 млрд в течение периода до 2030 года. Также компания будет выпускать полое волокно (HFC) для дата-центров Microsoft Azure. Ранее NVIDIA инвестировала $4 млрд в поставщиков лазеров и фотоники для ИИ ЦОД Lumentum и Coherent, а также зарезервировала у всех ключевых поставщиков значительную часть мощностей по производству EML-лазеров, необходимых для выпуска оптических модулей связи, что отразилось на доступности компонентов для остальных компаний.

06.05.2026 [11:52], Руслан Авдеев

Nscale развернёт более 66 тыс. ИИ-ускорителей NVIDIA Rubin в Португалии в интересах MicrosoftБританская Nscale рассчитывает развернуть на территории португальской площадки Start Campus более 66 тыс. ИИ-ускорителей NVIDIA Rubin в интересах крупного клиента — компании Microsoft. Речь идёт об одном из крупнейших развёртываний NVIDIA Vera Rubin NVL72 в Европе. Это значительно расширит действие договора между Microsoft и Nscale. В его рамках первая брала на себя обязательства развернуть 12,6 тыс. NVIDIA GB300 в ЦОД в Синеше (Sines, Португалия). Ускорители поколения Blackwell Ultra разместятся в первом построенном здании Start Campus, а в рамках нового, расширенного соглашения Nscale намерена инвестировать в проект ещё €230 млн ($268,9 млн) в общую для кампуса инфраструктуру и ещё €465 млн ($543,7 млн) — в строительство нового здания мощностью 200 МВт на территории того же кампуса. Развёртывание ИИ-ускорителей Rubin компания Nscale начнёт в конце 2027 года. По словам представителя Nscale, речь идёт об одной из крупнейших инвестиций в ИИ-инфраструктуру в истории Португалии и одну из наиболее значимых для Евросоюза. Косвенно это отражает рост спроса на сервисы Nscale. По данным руководства Start Campus, Синиш — один из ведущих европейских хабов для внедрения ИИ, укрепляющий способность Европы реализовать суверенные проекты на основе устойчивости, отказоустойчивости, а также долгосрочного планирования.

Источник изображения: Start Campus Предполагается, что Start Campus в Синише будет иметь мощность 1,2 ГВт. Первый ЦОД SIN01 мощностью 26 МВт запущен в январе 2025 года. Всего запланировано строительство шести зданий. Ожидается, что кампус будет полностью обеспечен возобновляемой энергией, разработчики рассчитывают добиться PUE 1,1 и WUE 0 благодаря использованию для охлаждения океанских вод. Ранее сообщалось, что Microsoft намерена инвестировать $10 млрд в ИИ ЦОД на территории кампуса. Microsoft и Nscale уже реализуют ряд проектов, в т.ч. в Норвегии, Великобритании и США. Ранее компания объявила, что Microsoft в рамках партнёрства будут предоставлены в общей сложности 116 тыс. ИИ-ускорителей NVIDIA GB300. В апреле 2026 года Microsoft заключила соглашение о поставке ещё 30 тыс. ускорителей NVIDIA Rubin в Норвегию.

04.05.2026 [10:46], Руслан Авдеев

Трудный выбор: телеком-операторы хотят и ИИ внедрить, и сэкономить, и избежать привязки к одному поставщикуТелеком-оператор Orange заявил о намерении найти оптимальный вариант для будущих сетей радиодоступа (RAN) на фоне развития ИИ-технологий. Компания предполагает, что ставка на ИИ поможет повысить эффективность мобильных сетей, сообщает блог IEEE ComSoc. Orange уже использует специально разработанные для 5G аппаратные и программные решения Nokia, до недавних пор необходимости в продуктах NVIDIA в сетях компании не было. Тем не менее, последняя сблизилась с Nokia в октябре 2025 года, приобретя 3 % долю в рамках инвестиций в объёме $1 млрд. Сейчас Nokia разрабатывает AI-RAN решения, оптимизированные для использования с ИИ-ускорителями. В немалой степени интерес Orange к ИИ-ускорителям объясняется довольно высокой стоимостью специализированных чипов (ASIC), традиционно применяемых в RAN. Их можно заменить ускорителями «общего назначения». Оправдать разработку и производство кастомных чипов довольно трудно, поскольку их цена высока, а рынок под эти продукты довольно мал и продолжает сокращаться. По данным Omdia, ежегодные расходы телеком-операторов сократились с $45 млрд в 2022 году до приблизительно $35 млрд и больше не растут, а применять такие чипы за пределами телеком-отрасли нецелесообразно.

Источник изображения: MingJun He/unspalsh.com В теории массовые продукты NVIDIA позволяют быстро и относительно экономично масштабировать RAN-сети 5G/6G и улучшить их экономику. При этом кастомные ASIC хоть и дорого, зато эффективнее и энергоэкономичнее для своих задач, а ИИ-ускорители, вероятно, чересчур производительны и энергоёмки. При этом NVIDIA остаётся финансово мощным игроком с высокой маржинальностью, что делает её привлекательным партнёром. Впрочем, Orange ожидает, что Nokia и NVIDIA разработают нечто намного более компактное, чем ускорители для дата-центров класса Blackwell, для шасси AirScale. В то же время Orange изучает возможность замены традиционных алгоритмов L1-уровня для использования ИИ-решений и повышения спектральной эффективности. Замена ASIC на ИИ-ускорители или CPU обсуждается не впервые. Так, Ericsson и Samsung уже давно предлагают облачные RAN-решения на процессорах Intel. Кроме того, ПО для таких процессоров при желании относительно легко переделать для использование с чипами на архитектуре x86 других производителей или даже Arm. Впрочем, пока крупнейшие поставщики оборудования, включая Ericsson и Huawei, продолжают активно вкладывать средства в собственные ASIC. Под вопросом положение и самой Intel, поскольку компания переживает не лучшие времена, а её сетевое подразделение NEX проходит через серию трансформаций. Использование ИИ-ускорителей тоже имеет значимые изъяны. В случае NVIDIA операторы будут зависеть от экосистемы CUDA, что ограничит возможность использования ПО с другим «железом». Orange признаёт опасность «привязки» к одному вендору, но считает, что преимущества масштабируемых архитектур «общего назначения» перевешивают риски, поскольку позволяют снизить совокупную стоимость владения (TCO). Впрочем, Orange не отказались бы от архитектуры, позволяющей сменить поставщика в случае необходимости. По данным IEEE ComSoc, Nokia всё-таки надеется, что значительная часть ПО, написанного для ускорителей NVIDIA, в будущем будет неким образом оптимизировано для использования с другими аппаратными платформами, в том числе и с CPU. Пока же почти монопольное положение NVIDIA оставляет участникам рынка немного альтернатив. Ericsson же пока остаётся верна кастомным ASIC. Для топ-менеджеров телеком-отрасли выбор, сделанный в следующие пару лет, может оказаться решающим для всей отрасли, поскольку на подходе уже сети 6G, внедрение которых должно начаться в 2030 году.

02.05.2026 [13:22], Сергей Карасёв

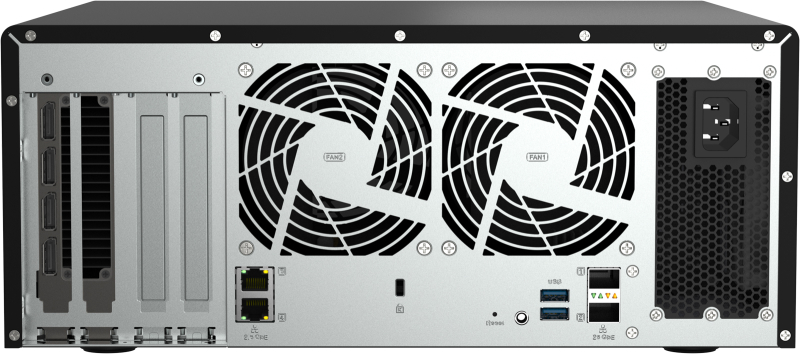

AMD EPYC и NVIDIA RTX Pro Blackwell: QNAP представила хранилище QAI-h1290FX для ИИ-задачКомпания QNAP Systems анонсировала сервер хранения QAI-h1290FX, предназначенный для решения ИИ-задач на периферии. Устройство подходит для работы с большими языковыми моделями (LLM), генеративными приложениями, поисковыми сервисами на базе RAG и пр. Новинка построена на платформе AMD с процессором EPYC Rome 7302P (16C/32T; до 3,3 ГГц). Объём оперативной памяти DDR4 ECC в базовой конфигурации составляет 128 Гбайт, в максимальной — 1 Тбайт. Во фронтальной части расположены 12 отсеков для SFF-накопителей U.2 с интерфейсом PCIe 4.0 x4 (NVMe) или SATA-3 с возможностью горячей замены. Система оснащена тремя слотами PCIe 4.0 x16 и одним слотом PCIe 4.0 x8. Возможна установка GPU-ускорителя NVIDIA RTX Pro 6000 Blackwell Max-Q Workstation Edition с 96 Гбайт памяти GDDR7 или NVIDIA RTX Pro 4500 Blackwell с 32 Гбайт памяти GDDR7. В первом случае обеспечивается возможность использования LLM с более чем 70 млрд параметров, во втором — 30 млрд параметров. Применена ОС QuTS hero h5.2.9. Упомянуты такие предустановленные ИИ-инструменты, как AnythingLLM, OpenWebUI, Ollama, Stable Diffusion, ComfyUI, n8n и vLLM. Устройство располагает двумя портами 2.5GbE и двумя 25GbE-портами SFP28 (SmartNIC), а также тремя разъёмами USB 3.0 Type-A (один находится спереди, два — сзади). Дополнительно может быть установлен сетевой адаптер 100GbE. Габариты сервера составляют 150 × 368 × 362 мм, масса — 10,4 кг. Диапазон рабочих температур — от 0 до +40 °C. Задействованы два вентилятора охлаждения диаметром 92 мм и блок питания мощностью 750 Вт. Производитель предоставляет на новинку пятилетнюю гарантию.

02.05.2026 [13:05], Сергей Карасёв

NVIDIA сворачивает продажи ряда модулей Jetson из-за роста цен на память LPDDR4Компания NVIDIA, по сообщению ресурса CNX Software, определила конец жизненного цикла (EOL) для ряда продуктов семейства Jetson. Их продажи планируется прекратить в связи с дефицитом и ростом цен на чипы памяти DRAM на фоне стремительного развития ИИ-инфраструктуры. Речь идёт об изделиях Jetson с памятью LPDDR4, которые были выпущены до 2021 года включительно. Это, в частности, системы на модуле NVIDIA Jetson TX2 NX (с 4 и 8 Гбайт) и NVIDIA Jetson TX2i (все варианты), NVIDIA Jetson AGX Xavier (с 32 Гбайт, а также индустриальная модификация) и NVIDIA Jetson Xavier NX. В сообщении производителя встраиваемых решений Connect Tech говорится, что отныне все новые заказы на устройства с перечисленными модулями не подлежат отмене и возврату. Заявки на поставку таких продуктов будут приниматься до 1 июля нынешнего года. Все существующие заказы с 15 июля получат статус «невозвратных». Отгружаться решения на базе модулей TX2 NX, TX2i, AGX Xavier и Xavier NX будут до 15 июля 2027 года. В уведомлении отмечается, что NVIDIA приняла решение пересмотреть жизненный цикл устаревающих изделий «в связи с изменениями в динамике мирового рынка DRAM». Connect Tech подчеркивает, что продолжит оказывать поддержку для своих плат, предназначенных для указанных модулей, однако долгосрочная доступность самих Jetson с памятью LPDDR4 будет ограничена. Нужно отметить, что сформировавшийся дефицит DRAM ударил и по другим производителям вычислительных модулей и одноплатных компьютеров. В частности, о повышении цен на продукцию неоднократно сообщала компания Raspberry Pi: некоторые её изделия подорожали сразу на $150.

30.04.2026 [17:07], Сергей Карасёв

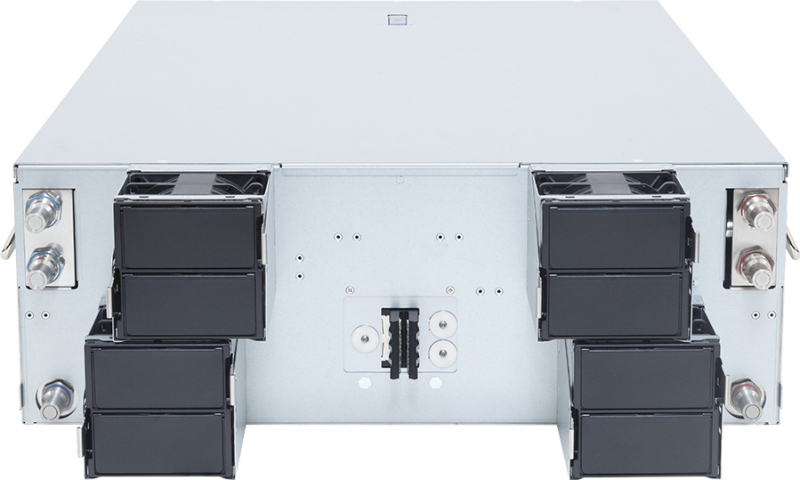

Giga Computing представила 4OU-сервер TO46-SD3 на базе NVIDIA HGX B300 с СЖОGiga Computing, подразделение Gigabyte Group, анонсировала OCP-сервер TO46-SD3-LA07 для ресурсоёмких ИИ-нагрузок. Новинка выполнена на платформе NVIDIA HGX B300 в форм-факторе 4OU и наделена прямым жидкостным охлаждением. Говорится, что применённая СЖО охватывает и секцию GPU, и зону CPU. Предусмотрена функция обнаружения утечек. Система несёт на борту два процессора Intel Xeon 6 6500/6700 поколения Granite Rapids-SP. Доступны 32 слота для модулей DDR5 RDIMM/MRDIMM. Во фронтальной части расположены восемь отсеков для SFF-накопителей (NVMe) с возможностью горячей замены. Кроме того, могут быть установлены два SSD типоразмера M.2 с интерфейсом PCIe 5.0 x4 и PCIe 5.0 x2. Сервер оборудован четырьмя слотами PCIe 5.0 x16 для карт расширения формата FHHL. Говорится о совместимости с DPU NVIDIA BlueField-3. Могут быть реализованы восемь OSFP-портов InfiniBand XDR с пропускной способностью до 800 Гбит/с или сдвоенные 400GbE-порты на базе NVIDIA ConnectX-8 SuperNIC. Кроме того, есть два сетевых порта 10GbE на основе контроллера Intel X710-AT2. Интерфейсные разъёмы, включая гнёзда RJ45 для сетевых кабелей и порты USB Type-A, сосредоточены во фронтальной части. Giga Computing отмечает, что сервер TO46-SD3-LA07 подходит для решения таких задач, как обучение крупных ИИ-моделей и инференс. Система построена с применением открытых стандартов и модульных принципов, обеспечивая масштабируемость и эффективность в рамках корпоративных инфраструктур и дата-центров гиперскейлеров.

27.04.2026 [13:45], Владимир Мироненко

SUSE анонсировала SUSE AI Factory with NVIDIA, упрощающую предприятиям создание собственных ИИ-стековSUSE объявила о запуске платформы SUSE AI Factory with NVIDIA, разработанной специально для решения строгих глобальных задач обеспечения цифрового суверенитета. SUSE AI Factory with NVIDIA представляет собой предварительно протестированный унифицированный программный стек для корпоративного ИИ, созданный на основе SUSE AI и NVIDIA AI Enterprise, призванный преодолеть разрыв между локальной разработкой и масштабируемым корпоративным развёртыванием, позволяя предприятиям создавать, управлять и масштабировать рабочие ИИ-нагрузки на периферии сети, в ЦОД и в публичных облачных средах, сохраняя при этом более жесткий контроль над данными и инфраструктурой. Как отметил StorageReview.com, SUSE позиционирует SUSE AI Factory with NVIDIA как стандартизированный программный слой для корпоративного ИИ, а не как автономную модель или сервис. Стек объединяет несколько компонентов NVIDIA, включая микросервисы NIM, открытые модели Nemotron, NeMo для разработки и управления агентами, Run:ai для оркестрации GPU, NVIDIA Kubernetes Operators, OpenShell для безопасной поддержки среды выполнения агентов и NemoClaw, который использует SUSE K3s в качестве части эталонной архитектуры для более безопасного развёртывания автономных агентов.

Источник изображения: SUSE SUSE AI Factory with NVIDIA стандартизирует развёртывание и запуск приложений ИИ, позволяя разработчикам создавать и тестировать приложения в изолированной среде, в то время как команды платформы управляют развёртыванием либо через единый интерфейс на основе Rancher, либо с помощью автоматизированных рабочих процессов GitOps для управления в масштабе предприятия. Это позволит сократить время настройки и ускорит переход от концепции к производству, уменьшая операционные издержки без необходимости использования разрозненных инструментов. SUSE AI Factory with NVIDIA включает в себя следующие возможности:

26.04.2026 [15:38], Руслан Авдеев

Oklo, NVIDIA и LANL задействуют ИИ для разработки плутониевого топлива и создания передовой атомной инфраструктурыЗанимающаяся разработкой малых модульных реакторов (SMR) американская компания Oklo совместно с NVIDIA и Лос-Аламосской национальной лабораторией США (LANL) займутся научно-прикладными проектами. Они выделят ресурсы на развитие атомной инфраструктуры, исследования с помощью ИИ и разработок, связанных с созданием ядерного топлива — в лаборатории, расположенной в штате Нью-Мексико, сообщает Datacenter Dynamics. В соглашении оговорено сотрудничество в области ИИ, цифровых двойников, моделирования и симуляция для развития критической инфраструктуры и ускоренного внедрения атомной энергетики. По словам Oklo, соглашение касается как внедрения реакторов, так и HPC, а также использования экспертных знаний мирового уровня в области науки о топливе и материаловедении. Предполагается, что это будет способствовать созданию плутониевого топлива для реактора Pluto, выбранного Министерством энергетики США (DoE) в рамках плана Reactor Pilot Program. Также инициатива направлена на обеспечение надёжного энергоснабжения в рамках миссии Genesis, которую прозвали новым Манхэттенским проектом. В рамках партнёрства компании обучат ИИ-модели на данных в области физики и химии — с их помощью будет поддерживаться проверка качества топлива и научно-исследовательские работы, касающиеся энергоносителей на основе плутония. Также ИИ будет способствовать исследованиям в области выработки электроэнергии, обеспечения надёжности энергосистем, резервирования и стабилизации энергоснабжения для поддержки развития ИИ ЦОД в национальной лаборатории.

Источник изображения: Oklo Находящаяся в Нью-Мексико Лос-Аламосская национальная лаборатория США принимала участие в исходном Манхэттенском проекте. Сегодня лаборатория — один из ключевых научных центров Министерства энергетики США, занимающихся ядерными исследованиями. Американская Oklo разрабатывает 75-МВт SMR Aurora Powerhouse. Реактор планируют ввести в эксплуатацию в 2027 году. Oklo входит в число 11 ключевых атомных компаний, отобранных для участия в пилотной программе DoE, посвящённой новым ядерным реакторам и разработке передового ядерного топлива. Oklo — один из наиболее активных разработчиков SMR по количеству заключённых сделок, в основном для питания ЦОД. Совокупный объём заказов уже превысил 14 ГВт, хотя часть сделок не имеет обязательной юридической силы. Среди самых значимых сделок: поставка ЦОД Switch до 12 ГВт до 2044 года; 1,2 ГВт для Meta✴ до 2030 года; 500 МВт для Equinix и до 100 МВт для Prometheus Hyperscale (Wyoming Hyperscale). В последние годы NVIDIA активно взаимодействовала с компаниями, реализующими атомные энергетические проекты, а также инвестировала в них средства. В частности, речь идёт о проектах компаний TerraPower и Commonwealth Fusion Systems (CFS), занимающихся в атомных разработках, в т.ч. в сфере термоядерного синтеза. В январе NVIDIA заключила партнёрское соглашение с CFS и Siemens для «строительства» цифровой копии термоядерного реактора CFS. Это должно помочь упростить начало его коммерческой эксплуатации. |

|