Материалы по тегу: amd

|

31.05.2026 [11:41], Сергей Карасёв

AMD выпустила адаптивные SoC серии Versal Prime Gen 2Компания AMD анонсировала новые адаптивные SoC семейства Versal Prime Gen 2: 2VM3454, 2VM3254 и 2VM3104. Они ориентированы на профессиональное аудиовизуальное оборудование, системы вещания и устройства для промышленного интернета вещей (IIoT). В состав решений входят четыре вычислительных ядра Arm Cortex-A78AE с 64 Кбайт кеша L1 (ECC) и 512 Кбайт кеша L2, тогда как суммарный кеш L3 составляет 2 Мбайт. Кроме того, имеется процессор реального времени с шестью ядами Arm Cortex-R52. Предусмотрен одноядерный графический ускоритель Arm Mali-G78AE. Версии 2VM3254 и 2VM3454 также получили VCU-блок с поддержкой HEVC и AVC (вплоть до 4K60). Объём встроенной памяти — 1 Мбайт (ECC). Программируемая часть 2VM3104 включает 225 400 логических ячеек и 103 040 LUT, а количество движков DSP составляет 420. У версии 2VM3254 эти значения равны соответственно 302 680, 138 368 и 564, у модификации 2VM3454 — 564 760, 258 176 и 1140. Количество трансиверов GTYP — 4, 8 и 16. Может использоваться оперативная память DDR5-6400 и LPDDR5X-8533 с максимальной пропускной способностью 102 Гбайт/с. Общий размер памяти программируемой логики (PL Memory) — до 45,4 Мбит. Реализована поддержка флеш-накопителей UFS 3.1, интерфейсов DisplayPort 1.4, USB 3.2 и USB 2.0, а также 1GbE, 10GbE и 100GbE (1 × 2VM3104/2VM3254 и 2 × 2VM3454). У двух старших версий также имеется контроллер PCIe 5.0 x4. Модель 2VM3454 располагает высокопроизводительным криптомодулем. Изделия 2VM3104 и 2VM3254 имеют размеры 23 × 23 мм, вариант 2VM3454 — 29 × 29 мм. Разработчики смогут использовать пакет AMD Vivado Design Suite для проектирования аппаратного обеспечения и платформу AMD Vitis для создания софта. Поставки 2VM3454 начнутся позднее в текущем году, а чипы 2VM3254 и 2VM3104 появятся в 2027-м.

27.05.2026 [15:41], Сергей Карасёв

Bull поставила Финляндии суперкомпьютер Roihu с производительностью до 49 ПфлопсКомпания Bull, специализирующаяся на высокопроизводительных вычислениях, поставила Финляндии новейший национальный суперкомпьютер Roihu для ресурсоёмких задач, в том числе связанных с ИИ. Система позволит утроить доступные в стране вычислительные мощности. Соглашение о создании Roihu было заключено между компанией Eviden (дочерняя структура Atos) и Финским научным IT-центром CSC в конце 2024 года. Комплекс Roihu смонтирован в дата-центре в Каяани рядом с действующим суперкомпьютером LUMI. Новая НРС-система построена на гибридной платформе Eviden BullSequana XH3000. В общей сложности задействованы 486 узлов на основе CPU и 132 узла на базе GPU. Каждый CPU-узел несёт на борту два 192-ядерных процессора AMD EPYC 9965 поколения Turin, что в сумме даёт 186 624 ядра. При этом 414 узлов располагают 768 Гбайт памяти, а оставшиеся 72 — 1536 Гбайт. В свою очередь, каждый GPU-узел оснащён четырьмя суперчипами NVIDIA GH200. Общее количество GPU в составе суперкомпьютера составляет 528. Все эти CPU и GPU узлы комплектуются локальным SSD вместимостью 960 Гбайт. Кроме того, в состав Roihu входят четыре узла визуализации с двумя процессорами AMD EPYC Turin 9335 (32 ядра) и двумя ускорителями NVIDIA L40 в каждом, а также четыре высокопроизводительных узла с двумя чипами AMD EPYC Turin 9555 (64 ядра) и 6 Тбайт памяти. В комплектацию данных узлов включены два SSD ёмкостью 7,68 Тбайт каждый. Сетевая инфраструктура базируется на 200G-интерконнекте Infiniband NDR. Для Roihu предусмотрено использование двух независимых хранилищ DDN EXAScaler Lustre на основе SSD: это раздел Scratch вместимостью 6 Пбайт и дополнительная секция объёмом 0,5 Пбайт для проектных приложений и личных каталогов пользователей. Пиковая скорость передачи данных у Scratch достигает 560 Гбайт/с при чтение и 280 Гбайт/с при записи. У второй секции эти значения составляют до 120 и 100 Гбайт/с соответственно. Общая FP64-производительность CPU-узлов оценивается в 10,5 Пфлопс, GPU — в 23,4 Пфлопс: в сумме это даёт 33,9 Пфлопс. Пиковое быстродействие достигает 49 Пфлопс. Суперкомпьютер Roihu станет доступен пользователям в июне нынешнего года. При этом действующие в Финляндии НРС-системы Puhti и Mahti будут полностью выведены из эксплуатации в августе 2026-го.

24.05.2026 [07:25], Сергей Карасёв

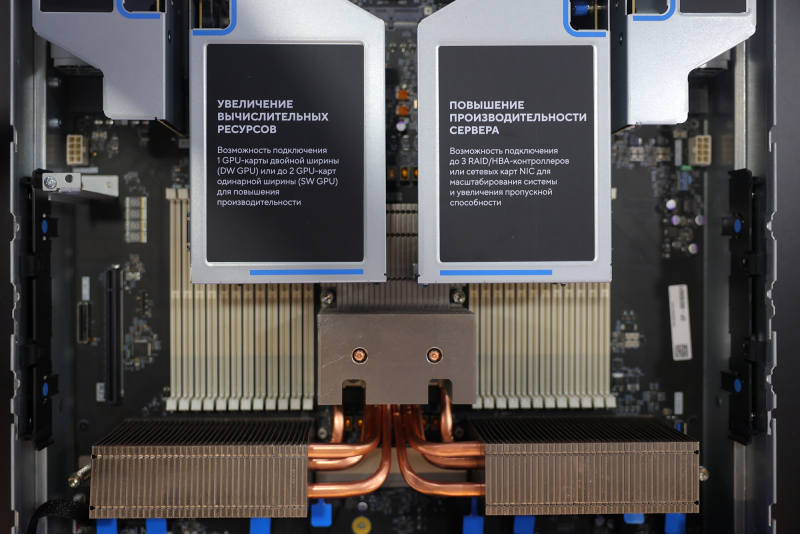

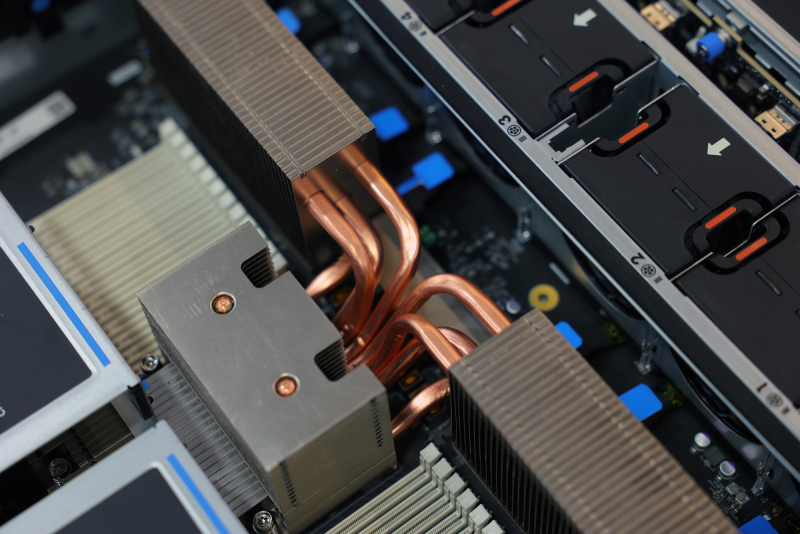

Dell анонсировала серверы PowerEdge на платформе AMD EPYC VeniceDell анонсировала серверы PowerEdge 18-го поколения, рассчитанные на различные рабочие нагрузки, включая ресурсоёмкие задачи ИИ. Утверждается, что прирост производительности по сравнению с предшественниками достигает 70 %. В частности, дебютировала модель PowerEdge M9825 с процессорами AMD EPYC Venice. Это устройство с жидкостным охлаждением ориентировано на платформы высокой плотности. Сервер может монтироваться в 21″ ORv3-стойки серии IR7000 мощностью до 480 кВт. Система PowerEdge M9825, предназначенная для ИИ-развёртываний, появится в продаже во II половине текущего года. Кроме того, представлены ИИ-серверы PowerEdge XE5845 и PowerEdge XE7845 с возможностью установки ускорителей на базе GPU. Эти машины оснащены воздушным охлаждением. Начало продаж намечено на I квартал 2027-го. В число новинок также вошли двухсокетный сервер PowerEdge R9825 формата 3U и односокетный вариант R9815 типоразмера 2U на базе AMD EPYC Venice. Данные модели отличаются высокой плотностью ядер — до 256 на сокет, а также увеличенной пропускной способностью подсистемы ввода-вывода. Устройства могут применяться для ресурсоёмких задач без необходимости внедрения СЖО или модернизации ЦОД. На рынке системы появятся во II полугодии 2026-го.

Источник изображения: Dell Анонсированы и компактные серверы Dell PowerEdge R8815 и R6815 в форм-факторе 1U с чипами AMD EPYC Venice. На платформе AMD также построены универсальные системы Dell PowerEdge R7815 с гибкими возможностями в плане конфигурации PCIe 6.0 и подсистемы хранения данных. Будут выпущены односокетная версия PowerEdge R7815xd и двухсокетная модель R7825, подходящая для задач виртуализации и аналитики. Эти решения выйдут в следующем году. Наконец, дебютировал сервер Dell PowerEdge R9810 типоразмера 2U. Основой данной односокетной машины послужат процессоры Intel следующего поколения с кодовым именем Diamond Rapids. Старт продаж намечен на 2027 год.

19.05.2026 [22:42], Владимир Мироненко

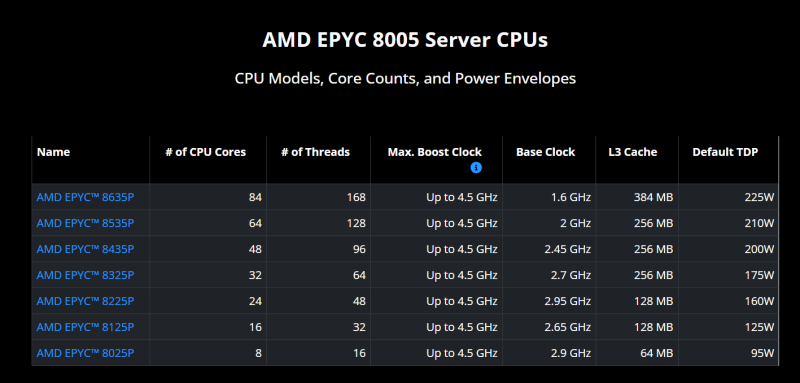

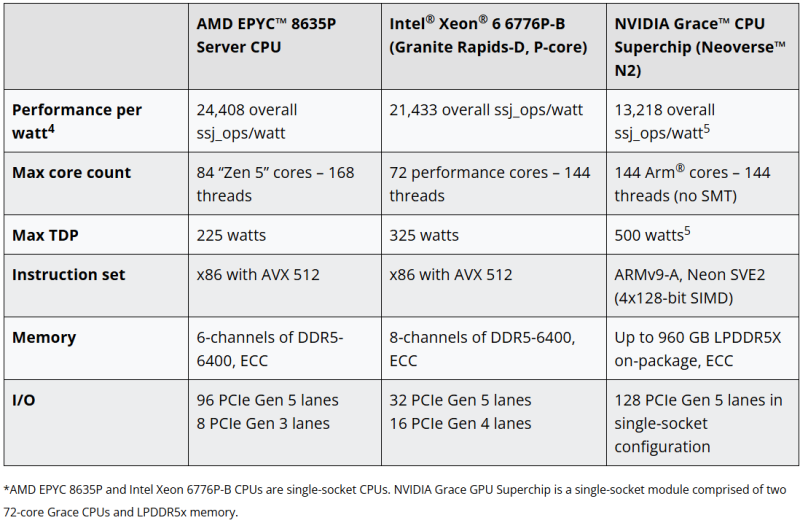

До 84 ядер и 384 Мбайт L3-кеша: AMD опубликовала подробности о телеком-процессорах EPYC 8005 (Sorano)В феварле AMD анонсировала процессоры EPYC 8005 с кодовым именем Sorano для телеком-оборудования, созданные на смену EPYC 8004 Siena, выпущенным в 2023 году. Информация о новых чипах была очень скудной, и лишь сейчас компания опубликовала более подробные сведения об EPYC 8005. Как отметила AMD, серверные процессоры AMD EPYC 8005 на базе ядер Zen 5 разработаны для обеспечения высокой производительности, низкого энергопотребления и компактных размеров с целью ускорения реализации возможностей на периферии сети, в телекоммуникационной отрасли и облачных хранилищах. Возглавляет серию EPYC 8635P — 84-ядерный/168-поточный процессор с Boost-частотой 4,5 ГГц, базовой частотой 1,6 ГГц, 384 Мбайт кеша L3 и TDP по умолчанию 225 Вт. Также в новой серии представлены 64-ядерный EPYC 8535P, 48-ядерный EPYC 8435P, 32-ядерный EPYC 8325P, 24-ядерный EPYC 8225P, 16-ядерный EPYC 8125P и 8-ядерный EPYC 8025P. Следует отметить, что на данный момент в серии EPYC 8005 нет вариантов с суффиксом PN, как это было в серии EPYC 8004, что означает возможность их использования в системах, соответствующих стандартам NEBS. Как отметил ресурс Phoronix, теперь доступен хороший выбор односокетных серверных процессоров AMD EPYC Zen 5 с TDP от 70 до 225 Вт. Эти процессоры призваны напрямую конкурировать с серией Intel Xeon 6 SoC (Granite Rapids-D), которые насчитывают до 72 P-ядер, но дополнительно снабжены функцией vRAN Boost и встроенным 100/200GbE-контроллером. Впрочем, сама AMD сравнивает новинки и с Arm-процессорами NVIDIA Grace.

19.05.2026 [20:19], Сергей Карасёв

YADRO представила российский 2U-сервер Vegman R215 G4 на базе AMD EPYC TurinКомпания YADRO, входящая в «ИКС Холдинг», расширила ассортимент отечественных серверов, анонсировав модель Vegman R215 G4 в форм-факторе 2U. Новинка, как утверждается, подходит для широкого спектра корпоративных и облачных нагрузок. Устройство, выполненное на аппаратной платформе AMD, имеет односокетную конфигурацию. Может устанавливаться процессор EPYC 9005 Turin или EPYC 9004 Genoa с показателем TDP до 500 Вт (до 192 вычислительных ядер). Реализованы 24 слота для модулей оперативной памяти DDR5-6400 (2 DPC) (L)RDIMM ECC суммарным объёмом до 6 Тбайт. Предусмотрены два варианта исполнения подсистемы хранения данных: 12 × LFF SAS/SATA/NVMe или 24 × SFF SAS/SATA/(16 × NVMe). Отсеки для накопителей располагаются во фронтальной части. Кроме того, могут быть установлены два SSD формата M.2/E1.S или два диска SFF SATA в тыльной зоне корпуса. Упомянуты два сетевых порта 1GbE (RJ45) и выделенный сетевой порт управления 1GbE (RJ45). Спереди находятся по одному разъёму USB 2.0 Type-A и D-Sub, а также два порта USB 3.1 Type-C. Сзади сосредоточены два разъёма USB 3.1 Type-A, последовательный порт (разъём USB Type-C, RS-232) и интерфейс Mini DisplayPort (BMC). Сервер предоставляет до восьми слотов PCIe 5.0 (с учетом отсеков OCP 3.0 SFF и гнезда под контроллер RAID/HBA). Доступны различные HBA- или RAID-контроллеры (с поддержкой RAID 0/1/5/6/50/60), а также опциональный суперконденсатор для защиты содержимого кеш-памяти при отключении питания. Питание обеспечивают два блока мощностью до 3400 Вт с сертификатом 80 Plus Platinum. Применена система воздушного охлаждения с шестью вентиляторами диаметром 60 мм с горячей заменой. Диапазон рабочих температур — от +10 до +35 °C. Говорится о совместимости с Astra Linux, ALT Linux, РЕД ОС, zVirt, VDP.

18.05.2026 [14:58], Сергей Карасёв

Kaytus представила All-Flash СХД вместимостью до 7 ПбайтКомпания Kaytus, базирующаяся в Сингапуре, анонсировала системы хранения KR1180 (1U10), KR2280 (2U24) и KR4266 (4U60) типа All-Flash, рассчитанные на применение в инфраструктурах ИИ. Утверждается, что при построении платформ экзабайтного масштаба суммарная пропускная способность достигает 10 Тбайт/с, а показатель IOPS при чтении — 100 млн. Для новинок предусмотрено применение SSD с интерфейсом PCIe 5.0 на основе чипов флеш-памяти QLC NAND. Kaytus подчёркивает, что такие накопители по сравнению с традиционными продуктами на основе TLC NAND позволяют снизить общую стоимость владения на 70 % в течение пяти лет. Могут устанавливаться SSD вместимостью до 122,88 Тбайт. Модель KR1180 выполнена в форм-факторе 1U: она оснащена десятью отсеками для SFF-накопителей SAS/SATA/NVMe. Общая ёмкость может составлять до 1 Пбайт; пропускная способность — 140 Гбайт/с. В зависимости от модификации устанавливается один процессор Intel Xeon 6 (Sierra Forest-SP/Granite Rapids-SP) или AMD EPYC 9005 Turin. Доступны соответственно 16 и 24 слота для модулей DDR5. Есть два внутренних коннектора для SSD типоразмера M.2, три слота PCIe 5.0 x8 для карт расширения HHHL, а также разъём PCIe 5.0 x8/x16 OCP 3.0 NIC. Питание обеспечивают два блока мощностью до 2000 Вт с сертификатом 80 Plus Platinum/Titanium. Применено воздушное охлаждение. Версия KR2280 стандарта 2U рассчитана на 24 накопителя SFF SAS/SATA/NVMe. Могут быть задействованы один или два процессора Intel Xeon 6 или AMD EPYC 9005. Упомянуты соответственно 32 и 24 слота DDR5. В зависимости от конфигурации доступны до семи слотов PCIe 5.0. Используются два блока питания мощностью до 3200 Вт с сертификатом 80 Plus Platinum/Titanium. Предлагаются опции воздушного и жидкостного охлаждения. Вариант KR4266 формата 4U позволяет установить в общей сложности 60 накопителей QLC SSD, а суммарная вместимость достигает 7 Пбайт. Пропускная способность — до 260 Гбайт/с, величина IOPS — до 20 млн. Поддерживаются один или два процессора Intel Xeon 6 и до 32 модулей DDR5-6400. Могут быть задействованы до 12 слотов PCIe 5.0, включая два разъёма для карт OCP 3.0 NIC. Применены блоки питания мощностью до 2700 Вт с сертификатом 80 Plus Platinum/Titanium.

18.05.2026 [08:53], Сергей Карасёв

10 Пбайт в 2U-шасси: Dell и Kioxia анонсировали сервер хранения PowerEdge R7725xd на платформе AMDDell и Kioxia анонсировали сервер хранения PowerEdge R7725xd формата 2U, предназначенный для использования в составе ИИ-инфраструктур, который допускает установку до 40 накопителей типоразмера E3.L, а суммарная вместимость в максимальной конфигурации составляет почти 10 Пбайт, передаёт Blocks & Files. В основу новинки положена аппаратная платформа AMD EPYC 9005 Turin: возможно применение двух процессоров, насчитывающих до 192 вычислительных ядер. Доступны 24 слота для модулей оперативной памяти DDR5-6400 RDIMM общим объёмом до 3 Тбайт. Могут быть задействованы до пяти слотов PCIe 5.0 х16 и разъём OCP3.0. В оснащение входит выделенный сетевой порт управления 1GbE, а дополнительно предлагаются адаптеры 100GbE и 400GbE. Сервер PowerEdge R7725xd может комплектоваться накопителями Kioxia LC9 вместимостью 245,76 Тбайт каждый. При использовании 40 таких SSD общая ёмкость достигает 9,8 Пбайт. А стойка, насчитывающая двадцать подобных 2U-систем, обеспечит вместимость на уровне 196 Пбайт. Указанные SSD поддерживают скорость последовательного чтения до 12 Гбайт/с и скорость последовательной записи до 3 Гбайт/с. Величина IOPS при произвольном чтении составляет до 1,3 млн, при произвольной записи — до 50 тыс. Габариты СХД — 802,4 × 482,0 × 86,8 мм. Устанавливаются блоки питания с резервированием мощностью до 3200 Вт с сертификатом 80 Plus Titanium. Во фронтальной части размерены порты USB 2.0 Type-A, USB 2.0 Type-C и Mini DisplayPort, в тыльной — USB 3.1 Type-A (×2), RJ45 и D-Sub. Заявлена совместимость с Ubuntu Server LTS, Windows Server (с Hyper-V), Red Hat Enterprise Linux и VMware ESXi.

14.05.2026 [18:02], Владимир Мироненко

Благодаря спросу на ИИ AMD нарастила долю на рынке серверных CPU, а Intel потихоньку теснит ArmAMD добилась значительных успехов в сегменте серверных процессоров в I квартале 2026 года. По оценкам Mercury Research, на EPYC пришлось 46,2 % рынка серверных процессоров в денежном выражении, что стало новым историческим максимумом у компании в этой категории продукции. При этом в количественном выражении доля AMD EPYC в общем объёме продаж в сегменте гораздо меньше — 27,4 % (последовательный рост на 230 базисных пунктов), что указывает на их гораздо более высокую среднюю цену продажи (ASP) по сравнению с конкурентами. Общий объём поставок серверных процессоров увеличился примерно на 6 % последовательно и примерно на 19 % год к году. Больше половины рынка серверных чипов в количественном выражении (54,9 %, снижение на 370 базисных пунктов по сравнению с предыдущим кварталом) принадлежит Intel. И судя по её доле рынка в денежном выражении в размере 53,8 % и доле в количественном выражении, можно с уверенностью предположить, что средняя цена серверных процессоров Intel Xeon ниже, чем у AMD EPYC. По данным Mercury Research, на Arm-процессоры для ЦОД приходится около 17,7 % (последовательный рост на 140 базисных пунктов), что составляет почти пятую часть от общего объёма поставок в I квартале 2026 года. Вместе с тем, не уточняется, идёт ли речь о продукции Ampere и других производителей Arm-процессоров, или же о собственных разработках таких компаний, как Google, AWS или Microsoft. В 2026 году ключевым трендом на рынке ИИ стало активное внедрение ИИ-агентов и мультиагентных систем, что обусловило высокий спрос на процессоры и успех AMD. При развёртывании агентного ИИ растёт роль CPU, что привело к изменению конфигурации вычислительных систем от традиционного соотношения, когда один процессор работает в паре с четырьмя или даже восемью ускорителями, в сторону соотношения один к одному. Благодаря возросшему спросу AMD сейчас продаёт каждый произведённый процессор, а Intel реализует заинтересованным клиентам даже то, что ранее списывалось как брак. Вместе с тем в настоящее время AMD удаётся добиваться более высоких средних цен на свою продукцию.

13.05.2026 [15:42], Владимир Мироненко

AMD предупредила об уязвимости в процессорах на базе Zen 2 — для EPYC Rome патчей прошивок не будетКомпания AMD сообщила о выявленной уязвимости (CVE-2025-54518; AMD-SB-7052) уровня CVSS 7.3 в работе кеша операций/микроопераций процессоров на базе микроархитектуры Zen 2, которая может привести к некорректному выполнению инструкций на более высоком уровне привилегий. Например, из пространства пользователя уязвимость позволяет добиться выполнения кода с правами ядра или получить доступ к хост-окружению из виртуальной машины. Сообщается, что проблема вызвана некорректной изоляцией совместно используемых ресурсов. Для веток гипервизора Xen c 4.17 по 4.21 были опубликованы патчи. Исправление для блокирования уязвимости также передано для включения в состав ядра Linux. Компания уже устранила эту уязвимость в десктопных и мобильных сериях CPU AMD Ryzen 3000, 4000, 5000, 7020, 7030 и Threadripper PRO 3000 WX, а также во встраиваемых CPU AMD Ryzen Embedded V2000, подготовив патчи для BIOS. Вместе с тем, для процессоров серии AMD EPYC 7002, включая Embedded-серию, уязвимость предлагается блокировать на уровне операционной системы. Любопытно, что об уязвимости компания сообщила только сейчас, хотя для всех продуктов, получивших патчи, последние были выпущены в конце 2025 года. Для EPYC, по-видимому, для реалиазации защиты останется механизм загрузки микрокода при старте ОС.

12.05.2026 [13:23], Сергей Карасёв

Dell выпустила ИИ-сервер PowerEdge XE9785 с ускорителями AMD Instinct MI355XКомпания Dell анонсировала сервер PowerEdge XE9785 на аппаратной платформе AMD, предназначенный для ресурсоёмких задач в области ИИ, включая обучение моделей и инференс. Двухсокетное устройство выполнено в форм-факторе 10U и оснащено воздушным охлаждением. Допускается установка двух процессоров AMD EPYC 9005 Turin, насчитывающих до 192 вычислительных ядер. Доступны 24 слота для модулей оперативной памяти DDR5-6400 RDIMM суммарным объёмом до 6 Тбайт. Во фронтальной части могут быть установлены до 16 NVMe-накопителей E3.S (PCIe 5.0) общей вместимостью до 245,76 Тбайт или до 10 NVMe-изделий U.2 суммарной ёмкостью до 153,6 Тбайт. Кроме того, есть два внутренних коннектора для SSD типоразмера М.2. Сервер несёт на борту восемь ускорителей AMD Instinct MI355X с 288 Гбайт памяти HBM3E (8 Тбайт/с). Задействован интерконнект AMD Infinity Fabric. В качестве альтернативного варианта предлагается конфигурация с восемью ускорителями NVIDIA HGX B300 и технологией NVIDIA NVLink. Питание обеспечивают 12 блоков мощностью 3200 Вт с сертификатом 80 Plus Titanium (с возможностью горячей замены). Габариты системы составляют 439,5 × 482,3 × 1044,7 мм, масса — 172,3 кг (с установленными картами MI355X). В зоне GPU находятся 15 вентиляторов, в области CPU — пять (все с поддержкой горячей замены). Среди прочего упомянуты слот OCP 3.0 (PCIe 5.0 x8), два сетевых порта RJ45, интерфейс Mini-DisplayPort, по одному порту USB Type-A и Type-C. Кроме того, компания Dell объявила о возможности использования ускорителей AMD Instinct MI350P в составе своих серверов PowerEdge XE7745 и R7725. Эти устройства рассчитаны на приложения ИИ, платформы виртуализации, базы данных и пр. |

|