Материалы по тегу: cpu

|

28.05.2026 [16:14], Руслан Авдеев

ByteDance разрабатывает собственные CPU для поддержки своей ИИ-инфраструктурыКитайский техногигант ByteDance работает над собственными CPU, чтобы поддержать растущие потребности в ИИ-инфраструктуре на фоне того, что цены на чипы растут, а дефицит поставок мешает расширению бизнеса, сообщает Reuters со ссылкой на три источника, знакомых с вопросом. Компания работает с двумя архитектурами, Arm и «открытой» RISC-V, и пока взвешивает, какой именно дизайн лучше всего закроет потребностям собственных ЦОД в долгосрочной перспективе. Инициатива косвенно свидетельствует о быстром смене приоритетов индустрии с обучения ИИ на инференс — современным ИИ-агентам всё больше нужны CPU, работающие в тандеме с ИИ-ускорителями. Google, Amazon, Microsoft и Alibaba разрабатывают собственные облачные CPU для снижения затрат и оптимизации производительности своих систем для конкретных задач. Также это в некоторой степени помогло ключевым производителям CPU — Intel и AMD выступить «лидерами сопротивления» доминированию NVIDIA в сфере ИИ. ByteDance намерена внедрять процессоры собственной разработки в собственных серверах и ЦОД для поддержки своих внутренних операций. По имеющимся данным, она готовит масштабную премьеру агентных продуктов, включая платформу Coze. AWS уже давно портировала значительную часть внутренних нагрузок на чипы Graviton, которые всё чаще пользуются спросом и у сторонних заказчиков, включая Meta✴ и Uber. Google тоже активно переносит нагрузки на чипы Axion. Пекинский бизнес обратился к нескольким партнёром, чтобы те помогли компании в реализации проекта и те должны не только помочь с разработкой чипов, но и обеспечить «бронирование» производственных мощностей Проект пока находится на ранней стадии реализации и, кроме данных источников, информации пока нет. Инициатива ByteDance ставит компанию в один ряд с многочисленными технологическими компаниями, решившими, что выпускать собственные чипы будет выгоднее несмотря на сложность их разработки. Стремление разрабатывать собственные полупроводники происходит на фоне того, что Intel ещё в феврале предупредила китайских клиентов о возможном росте сроков поставок CPU до шести месяцев. В апреле компания объявила, что спрос на её CPU со стороны ИИ-компаний был таким высоким в I квартале, что производитель распродал даже запасы предназначавшихся к списанию, ранее считавшихся неликвидными, чипов. На днях AMD предупредила об ухудшении положения на рынке CPU — спрос превышает прогнозы и проблемы со своевременными поставками сохранятся. Сегодня ByteDance закупает CPU у Intel и AMD, которые уже значительно подняли цены, рост квартал к кварталу в последние месяцы составил 10–35 %, что лишь подтолкнуло ByteDance к разработке собственных альтернатив. NVIDIA также развивает активность на рынке CPU и надеется, что новые Arm-процессоры Vera, которые оказались конкурентоспособны EPYC и Xeon, обеспечат компании доступ к новому рынку объёмом в $200 млрд. Сама Arm тоже планирует заработать миллиарды долларов на CPU Arm AGI, фактически конкурируя с собственными заказчиками.

27.05.2026 [00:56], Владимир Мироненко

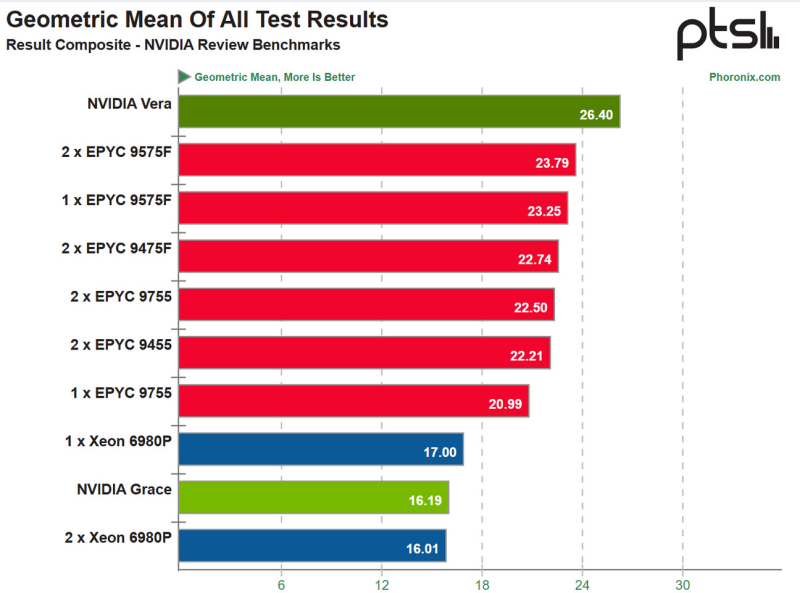

Серверные Arm-процессоры NVIDIA Vera обогнали современные Intel Xeon и AMD EPYC в некоторых тестахПортал Phoronix провёл тестирование серверного Arm-процессора NVIDIA Vera, разработанного специально для обеспечения функционирования агентного ИИ, взяв для сравнения одно- и двухсокетные конфигурации на базе Intel Xeon 6980P (Granite Rapids-AP), а также AMD EPYC Turin: 9755, 9575F и 9475F. Также в сравнительное тестирование включили процессоры NVIDIA первого поколения Grace на базе ядер Arm Neoverse V2 (Demeter). Сообщается, что NVIDIA дала добро на проведение на этом предрелизном чипе тестов только для определённых рабочих нагрузок, соответствующих предполагаемым задачам/областям применения Vera в ЦОД, включая стандартные рабочие нагрузки, такие как компиляция, STREAM, кодирование видео, Python/Java и производительность СУБД. Исходя из среднего геометрического значения результатов тестов NVIDIA Vera занял первое место, превысив почти на 11 % лучшие результаты самых передовых разработок AMD, и примерно на 55,3 % показатели лучшей односокетной конфигурации Intel Xeon. Он также превзошёл в тестах двухсокетные конфигурации, что говорит о проблемах масштабирования некоторых рабочих нагрузок на нескольких сокетах. Эти ограниченные тесты отражают превосходство NVIDIA Vera по сравнению с любой архитектурой на базе Arm, с TDP 450 Вт для процессора и 50 Вт для пула памяти объемом 768 Гбайт. Предполагается, что NVIDIA продаст процессоров Vera и Grace на сумму около $20 млрд, охватив общий потенциальный рынок (TAM) в $200 млрд. NVIDIA сотрудничает со всеми крупными гиперскейлерами для поставки стоек с процессорами Vera (чаще всего в составе Vera Rubin), также наблюдается множество развёртываний у поставщиков инфраструктуры для их собственных задач и предложений для сторонних клиентов. Такой подход позволит NVIDIA выйти на огромный рынок процессоров, став одним из лидеров уже в этом году.

26.05.2026 [15:10], Владимир Мироненко

Европейский Arm-процессор SiPearl Rhea1 для суперкомпьютеров стал на шаг ближе к массовому выпускуФранцузская компания SiPearl объявила об успешном включении Arm-процессора Rhea1, разработанного для использования в суверенных суперкомпьютерах, в частности — в первом европейском суперкомпьютере экзафлопсного класса JUPITER. «Первые результаты очень позитивны, подтверждая, что европейский высокопроизводительный энергоэффективный процессор работает так, как и было задумано», — сообщается в пресс-релизе SiPearl. Компания добавила, что в рамках 12-недельного процесса функциональной проверки в лабораториях будет проведена проверка всех аппаратных и программных функций, интерфейсов и характеристик производительности Rhea1. Как ожидается, продажи Rhea1 начнутся в конце 2026 года. SiPearl отметила, что Rhea1 является самым сложным серверным процессором, когда-либо разработанным в Европе. Он включает 80 ядер Arm Neoverse V1 (Zeus), четыре стека памяти HBM2e (64 Гбайт), а также четыре канала памяти DDR5 (2DPC). Поддерживаются 104 линии PCIe 5.0 в виде шести комплексов x16 и двух x4. Сообщается, что Rhea1 является ключевым компонентом для всеобъемлющего вычислительного/ИИ-стека. Помимо производительности, клиенты ожидают от него безопасности без бэкдоров и аварийных выключателей, энергоэффективности, гибкости и развитой программной экосистемы. «С помощью Rhea1 мы выполняем миссию, возложенную Европейским союзом на консорциум European Processor Initiative (EPIC), а затем и на SiPearl: вернуть в Европу высокопроизводительные процессорные технологии и связанный с ними опыт», — заявил Филипп Ноттон (Philippe Notton, на фото выше), генеральный директор и основатель SiPearl, отметив, что «не может быть цифрового суверенитета без суверенного оборудования».

20.05.2026 [14:13], Руслан Авдеев

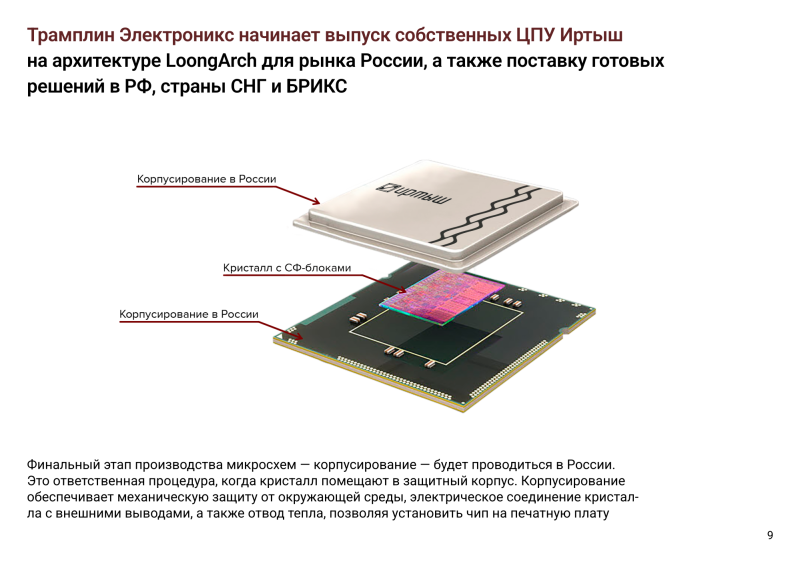

Российские процессоры «Иртыш» на китайской архитектуре LoongArch заподозрили в недостаточном уровне «отечественности»Минпромторг РФ настаивает на привлечении новых экспертов к проверке российских процессоров «Иртыш», разработанных «Трамплин электроникс». В министерстве считают, что такие процессоры, положенные в основу оборудования для критической информационной инфраструктуры (КИИ), потенциально создают угрозу национальной безопасности страны, сообщает CNews со ссылкой на письмо Минпромторга в Торгово-промышленную палату (ТПП) РФ. Подчёркивается, что в России уже разработаны опытные образцы серверов на процессорах «Иртыш». Минпромторг ссылается на сообщения СМИ о том, что в 2025 году «Трамплин Электроникс» приобрела право на использование иностранной архитектуры LoongArch, принадлежащей китайской Loongson, а её чипы практически повторяют процессоры серии C3600. Минпромторг подчёркивает недопустимость попадания в реестр российской продукции чипов на готовых схематических решениях, разработанных за границей. Опрошенные изданием эксперты говорят, что присвоение таким чипам статуса отечественных может негативно сказаться на развитии российской микроэлектроники. «Трамплин электроникс» посетовала на «попытки заранее сформировать позицию и мнение экспертов» и заявила CNews, что утверждения о полной идентичности «Иртыш» китайским чипам голословны и сделаны без учёта собственных проектных и конструкторских работ, выполненных на территории РФ, включая «интеграцию, адаптацию, производство и испытания», выразив уверенность в компетентности и объективности экспертизы ТПП и готовность продемонстрировать «и лицензии, и глубину освоения технологий, а также контроль жизненного цикла процессоров». Вместе с тем экспертами отмечается, что за год существования «Трамплин электроникс» разработать собственные решения физически невозможно. При этом в 2022 КНР запретил экспорт чипов Loongson в другие страны, включая РФ. Компания намерена начать серийные поставки процессоров «Иртыш» C616, C632 и C664 в III квартале 2026 года. Корпусирование процессоров будет проводиться в России, но где производятся сами чипы, не уточняется.

19.05.2026 [22:42], Владимир Мироненко

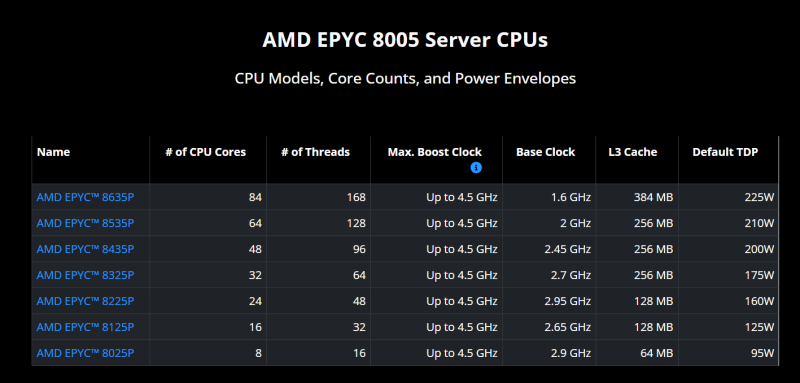

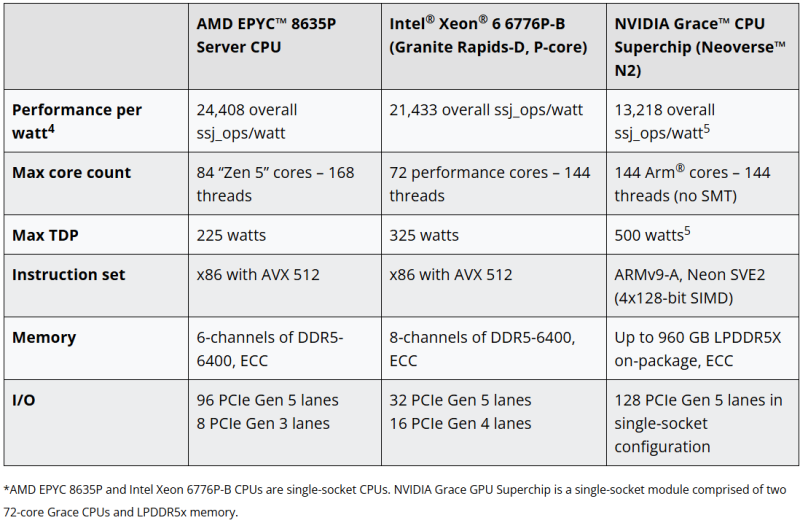

До 84 ядер и 384 Мбайт L3-кеша: AMD опубликовала подробности о телеком-процессорах EPYC 8005 (Sorano)В феварле AMD анонсировала процессоры EPYC 8005 с кодовым именем Sorano для телеком-оборудования, созданные на смену EPYC 8004 Siena, выпущенным в 2023 году. Информация о новых чипах была очень скудной, и лишь сейчас компания опубликовала более подробные сведения об EPYC 8005. Как отметила AMD, серверные процессоры AMD EPYC 8005 на базе ядер Zen 5 разработаны для обеспечения высокой производительности, низкого энергопотребления и компактных размеров с целью ускорения реализации возможностей на периферии сети, в телекоммуникационной отрасли и облачных хранилищах. Возглавляет серию EPYC 8635P — 84-ядерный/168-поточный процессор с Boost-частотой 4,5 ГГц, базовой частотой 1,6 ГГц, 384 Мбайт кеша L3 и TDP по умолчанию 225 Вт. Также в новой серии представлены 64-ядерный EPYC 8535P, 48-ядерный EPYC 8435P, 32-ядерный EPYC 8325P, 24-ядерный EPYC 8225P, 16-ядерный EPYC 8125P и 8-ядерный EPYC 8025P. Следует отметить, что на данный момент в серии EPYC 8005 нет вариантов с суффиксом PN, как это было в серии EPYC 8004, что означает возможность их использования в системах, соответствующих стандартам NEBS. Как отметил ресурс Phoronix, теперь доступен хороший выбор односокетных серверных процессоров AMD EPYC Zen 5 с TDP от 70 до 225 Вт. Эти процессоры призваны напрямую конкурировать с серией Intel Xeon 6 SoC (Granite Rapids-D), которые насчитывают до 72 P-ядер, но дополнительно снабжены функцией vRAN Boost и встроенным 100/200GbE-контроллером. Впрочем, сама AMD сравнивает новинки и с Arm-процессорами NVIDIA Grace.

14.05.2026 [18:02], Владимир Мироненко

Благодаря спросу на ИИ AMD нарастила долю на рынке серверных CPU, а Intel потихоньку теснит ArmAMD добилась значительных успехов в сегменте серверных процессоров в I квартале 2026 года. По оценкам Mercury Research, на EPYC пришлось 46,2 % рынка серверных процессоров в денежном выражении, что стало новым историческим максимумом у компании в этой категории продукции. При этом в количественном выражении доля AMD EPYC в общем объёме продаж в сегменте гораздо меньше — 27,4 % (последовательный рост на 230 базисных пунктов), что указывает на их гораздо более высокую среднюю цену продажи (ASP) по сравнению с конкурентами. Общий объём поставок серверных процессоров увеличился примерно на 6 % последовательно и примерно на 19 % год к году. Больше половины рынка серверных чипов в количественном выражении (54,9 %, снижение на 370 базисных пунктов по сравнению с предыдущим кварталом) принадлежит Intel. И судя по её доле рынка в денежном выражении в размере 53,8 % и доле в количественном выражении, можно с уверенностью предположить, что средняя цена серверных процессоров Intel Xeon ниже, чем у AMD EPYC. По данным Mercury Research, на Arm-процессоры для ЦОД приходится около 17,7 % (последовательный рост на 140 базисных пунктов), что составляет почти пятую часть от общего объёма поставок в I квартале 2026 года. Вместе с тем, не уточняется, идёт ли речь о продукции Ampere и других производителей Arm-процессоров, или же о собственных разработках таких компаний, как Google, AWS или Microsoft. В 2026 году ключевым трендом на рынке ИИ стало активное внедрение ИИ-агентов и мультиагентных систем, что обусловило высокий спрос на процессоры и успех AMD. При развёртывании агентного ИИ растёт роль CPU, что привело к изменению конфигурации вычислительных систем от традиционного соотношения, когда один процессор работает в паре с четырьмя или даже восемью ускорителями, в сторону соотношения один к одному. Благодаря возросшему спросу AMD сейчас продаёт каждый произведённый процессор, а Intel реализует заинтересованным клиентам даже то, что ранее списывалось как брак. Вместе с тем в настоящее время AMD удаётся добиваться более высоких средних цен на свою продукцию.

14.05.2026 [10:56], Сергей Карасёв

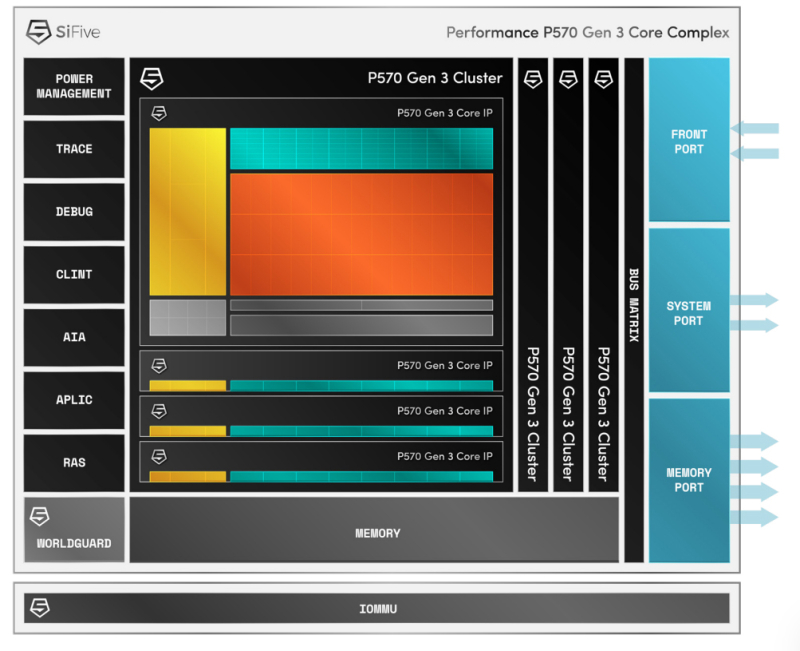

SiFive представила RISC-V-ядра Performance P570 Gen 3 для IoT-приложенийКомпания SiFive анонсировала производительные процессорные ядра Performance P570 третьего поколения (Gen 3) с архитектурой RISC-V. Они ориентированы на требовательные периферийные ИИ-приложения, потребительские и коммерческие решения интернета вещей (IoT) и пр. Новые ядра используют 64-бит архитектуру RISC-V с поддержкой внеочередного исполнения инструкций. Допускаются конфигурации, насчитывающие до четырёх ядер в кластере. При этом возможно использование до четырёх кластеров, что в сумме даёт до 16 вычислительных ядер. Используется общий кеш L3 на уровне кластера и опциональный общий кеш L2. Для Performance P570 Gen 3 заявлена поддержка широкого спектра типов данных: INT8, INT16, INT32, INT64, FP16, FP32, FP64 и BFloat16. Заявлена полная совместимость с профилем RVA23, который стандартизирует набор инструкций ISA. Реализованы такие функции, как векторные операции, инструкции с плавающей запятой и атомарные инструкции, которые востребованы в сферах НРС и ИИ. Добавлены расширения для повышения производительности и улучшения безопасности, включая Smepmp, Zvkng, Zvksg, Zicfilp, Zicfiss, Zfbfmin, Zvfbfmin, Zvfbfwma и Zvdot4a8i. Упомянута возможность работы с современными ОС, включая Android, Ubuntu 26.04 LTS и платформы Red Hat. В тесте Geekbench 6 ядра Performance P570 Gen 3 демонстрируют примерно вдвое более высокую производительность в расчёте на 1 ГГц по сравнению с изделиями P550. При выполнении определённых ИИ-задач, таких как распознавание объектов, достигается 21-кратный прирост быстродействия благодаря 128-битному векторному конвейеру VLEN. Если сравнивать с ядрами P470 Gen2, то у P570 выигрыш в производительности составляет 30 % и 350 %. В традиционных CPU-нагрузках, по данным SpecInt 2006/2017, ядра P570 показывают прирост быстродействия на 7–13 % по сравнению с P550 при сопоставимых значениях с P470. Кроме того, обеспечивается повышение энергетической эффективности. У ядер Performance P570 Gen 3 динамическое энергопотребление (мВт/ГГц) снижено на 13 % и 5 % по сравнению с P550 и P470 соответственно, а потери мощности (мВт) уменьшены на 51 % и 5 %.

13.05.2026 [15:42], Владимир Мироненко

AMD предупредила об уязвимости в процессорах на базе Zen 2 — для EPYC Rome патчей прошивок не будетКомпания AMD сообщила о выявленной уязвимости (CVE-2025-54518; AMD-SB-7052) уровня CVSS 7.3 в работе кеша операций/микроопераций процессоров на базе микроархитектуры Zen 2, которая может привести к некорректному выполнению инструкций на более высоком уровне привилегий. Например, из пространства пользователя уязвимость позволяет добиться выполнения кода с правами ядра или получить доступ к хост-окружению из виртуальной машины. Сообщается, что проблема вызвана некорректной изоляцией совместно используемых ресурсов. Для веток гипервизора Xen c 4.17 по 4.21 были опубликованы патчи. Исправление для блокирования уязвимости также передано для включения в состав ядра Linux. Компания уже устранила эту уязвимость в десктопных и мобильных сериях CPU AMD Ryzen 3000, 4000, 5000, 7020, 7030 и Threadripper PRO 3000 WX, а также во встраиваемых CPU AMD Ryzen Embedded V2000, подготовив патчи для BIOS. Вместе с тем, для процессоров серии AMD EPYC 7002, включая Embedded-серию, уязвимость предлагается блокировать на уровне операционной системы. Любопытно, что об уязвимости компания сообщила только сейчас, хотя для всех продуктов, получивших патчи, последние были выпущены в конце 2025 года. Для EPYC, по-видимому, для реалиазации защиты останется механизм загрузки микрокода при старте ОС.

07.05.2026 [12:10], Владимир Мироненко

AMD усилит кастомизацию серверных процессоров с учётом разнообразия ИИ-нагрузокСовременные рабочие нагрузки в ЦОД очень разнообразны, и практически все гиперскейлеры имеют свои собственные программы по разработке кастомных чипов. Чтобы сохранить конкурентоспособность, AMD планирует расширить свой портфель процессоров для ЦОД, которые будут ориентированы на различные рабочие нагрузки, пишет Tom's Hardware. Судя по заявлению генерального директора AMD Лизы Су (Lisa Su) на конференции с аналитиками, посвящённой квартальному отчёту, компания стремится к выпуску более сегментированных чипов EPYC, включая кастомные решения для конкретных рабочих нагрузок, потенциально различные конфигурации ядер/кеша/интерконнекта, а также процессоры, адаптированные для кластеров инференса, оркестрации, задач ИИ с низкой задержкой и развёртываний с большим количеством ускорителей. Су также намекнула, что это расширение выходит за рамки Venice, которая включает микроархитектуры Zen 7 и, вероятно, Zen 8. «Сейчас мы работаем с клиентами над тем, что выходит за рамки Venice и того, что мы делаем в этих архитектурах», — сказала Су. Она отметила, что отрасли потребуется широкий выбор процессоров для различных задач. «Мы сосредоточились на создании не просто одного типа, а <…> моделей, оптимизированных по пропускной способности, энергопотреблению, стоимости и инфраструктуре ИИ, как мы это сделали в семействе Venice», — сказала Су. В ходе конференции Су сообщила, что AMD больше не рассматривает серверные процессоры как единую однородную категорию. Вместо этого компания теперь видит рынок разделённым на несколько сегментов, ориентированных на конкретные рабочие нагрузки, включая вычислительные системы общего назначения, процессоры для ускорителей и процессоры, оптимизированные для ИИ-задач. И даже внутри этих категорий AMD планирует предлагать дифференциацию, чтобы более точно соответствовать конкретных потребностям клиентов. Что качается AMD EPYC 6-го поколения на базе микроархитектуры Zen 6, то компания планирует предлагать процессоры под кодовым названием Venice с количеством ядер до 256 для серверов общего назначения, а также процессоры под кодовым названием Verona для ИИ-инфраструктуры. «Семейство Venice включает в себя широкий набор процессоров, оптимизированных для пропускной способности, производительности на ватт и производительности на доллар, в том числе Verona, наш первый процессор EPYC, специально разработанный для ИИ-инфраструктуры», — сказала Су.

01.05.2026 [15:08], Сергей Карасёв

Процессоры Hygon C86-4G, китайские наследники AMD Zen1, получили поддержку AVX-512, DDR5 и PCIe 5.0В кодовую базу компилятора GCC 17, по сообщению ресурса Phoronix, добавлена поддержка китайских процессоров семейства Hygon C86-4G. Эти изделия подходят для использования в рабочих станциях, ориентированных на рендеринг графики, редактирование видеоматериалов и пр. Чипы Hygon C86-4G являются наследниками AMD Zen1: соответствующую лицензию китайский разработчик получил в рамках совместного предприятия с AMD, сформированного ещё в 2016 году, но довольно быстро прекратившего своё существование. Тем не менее, интеллектуальная собственность осталась у Hygon, а со времён Dhyana компания внесла ряд усовершенствований в архитектуру Zen с целью обеспечения поддержки современных технологий и теперь говорит создании собственной микроархитектуры. Процессоры серии C86-4G насчитывают 16 вычислительных ядер с возможностью одновременной обработки до 32 потоков инструкций. Тактовая частота составляет 2,8 ГГц. Говорится о совместимости с DDR5 и PCIe 5.0 (отсутствуют в Zen первого поколения), что теоретически возможно при использовании отдельного, современного IOD-чиплета. По производительности чипы должны быть сопоставимы с решениями Intel Core серии Raptor Lake. По неофициальным данным, C86-4G должны были получить 12 каналов DDR5-4800 и 128 линий PCIe 5.0. А поддержка AVX-512 наряду с 16 каналами DDR-5600 и CXL 2.0 должна была появиться в 128-ядерных процессорах С86-5G, которые к тому же якобы должны были получить SMT4 (128C/512T). В компиляторе GCC 17 реализована поддержка трёх модификаций названных процессоров Hygon: C86-4G-M4, C86-4G-M6 и C86-4G-M7. При этом для последних заявлена поддержка 512-бит векторных инструкций AVX-512. В остальном набор реализованных инструкций для всех изделий идентичен: x86-64, MMX, SSE, SSE2, SSE3, SSE4A, CX16, ABM, SSSE3, SSE4.1, SSE4.2, AES, PCLMUL, AVX, AVX2, BMI, BMI2, F16C, FMA, PRFCHW, FXSR, SHA, XSAVE, XSAVEOPT, XSAVEC, FSGSBASE, RDRND, MOVBE, MWAITX, ADX, RDSEED, CLZERO, CLFLUSHOPT, XSAVES, LZCNT, POPCNT. Ранее благодаря патчам в open source проектах появилась информация о загадочном x86-процессоре неясного происхождения. В самом Китае, помимо Hygon, выпуском x86-чипов занимаются Zhaoxin, которая получила лицензию по наследству от Cyrix и VIA, а также Montage Technology, которая фактически дорабатывает самые обычные Intel Xeon. |

|