Материалы по тегу: hpc

|

28.05.2026 [10:13], Руслан Авдеев

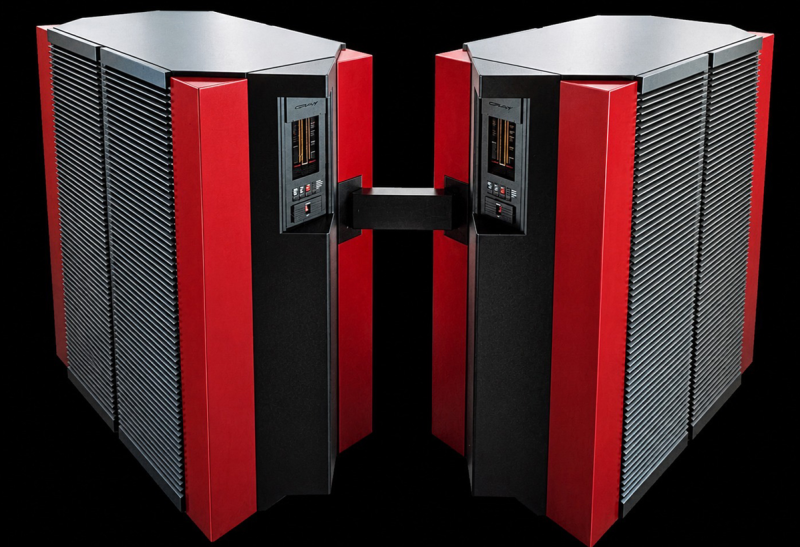

В Великобритании выставили на аукцион три суперкомпьютера Cray из 1990-хКомпания RWB Auctions Limited выставила на аукцион в Великобритании три суперкомпьютера Cray. По её данным, они предоставлены главой Amari Дэном Голдсмитом (Dan Goldsmith), сообщает Datacenter Dynamics. По словам Голдсмита, когда-то ему буквально в шутку предложили оборудование, поскольку никто не рассчитывал, что он действительно его купит. Но он купил и использовал дома около трёх лет. Включать машину можно было только на полчаса за раз, поскольку в комнате становилось чересчур жарко. По словам Голдсмита, теперь пришло время передать старые суперкомпьютеры новому поколению IT-энтузиастов, чтобы сохранить их для будущих поколений. На аукционе представлен первый суперкомпьютер Cray T3D. Система Typhoon в своё время эксплуатировалась в Эдинбургском центре параллельных вычислений (Edinburgh Parallel Computing Centre, EPCC) при Эдинбургском университете. В июне 1996 года она стала самым производительным суперкомпьютером Европы в рейтинге TOP500. Система, окрашенная в «томатно-красный» цвет, представляет собой однокорпусную модель Cray T3D-MC512 с 512 процессорами DEC Alpha 21064 с частотой 150 МГц и СЖО, использующей жидкость 3M Fluorinert. Система весом 771 кг изначально использовалась Cray для внутренних разработок, поэтому обладает уникальной конфигурацией. На пике производительность Typhoon достигала 76,8 Гфлопс, а сам он занимал 22-е место в мире по этому показателю. Последний раз этот суперкомпьютер попал в рейтинг TOP500 в июне 1999 года. По оценкам, в своё время система стоила порядка $15 млн, сегодня начальная ставка на неё составляет £60 тыс. ($80,672).

Источник изображения: The Saleroom Также на аукцион выставлена модель Cray Y-MP4E. Машину из двух шасси с тремя векторными процессорами Cray применяли как фронтенд-систему для суперкомпьютера Cray T3D в Эдинбурге. Она окрашена в характерный красный цвет. По данным RWB, при стартовой ставке £2,4 тыс. ($3227) система представляет собой привлекательный вариант для коллекционеров и структур, интересующихся историей научных и технических вычислений. Наконец, выставлен и суперкомпьютер Cray Triton T-932 — полнофункциональная 32-процессорная конфигурация, одна из трёх сохранившихся систем, которых в своё время было около двадцати. Система весом 4 т первоначально работала в штаб-квартире GCHQ. Данный вариант Голдсмиту пришлось восстанавливать в течение двух лет при участии Cray. На момент запуска система стоила около $39 млн, сейчас начальная ставка составляет £40 тыс. ($53 785). Суперкомпьютеры редко выставляют на аукцион, но изредка это случается. Так, в 2024 году распродавалась коллекция одного из основателей Microsoft, ныне покойного Пола Аллена (Paul Allen). В частности, система Cray-1 1976-1978 гг. выпуска была продана за $1 млн, Cray-2 1985 года продан за $176 400. Суперкомпьютер CDC 6500 в своё время продали за $252 тыс., а в США два года назад за $480 тыс. была продана машина Cheyenne и т.п.

27.05.2026 [15:41], Сергей Карасёв

Bull поставила Финляндии суперкомпьютер Roihu с производительностью до 49 ПфлопсКомпания Bull, специализирующаяся на высокопроизводительных вычислениях, поставила Финляндии новейший национальный суперкомпьютер Roihu для ресурсоёмких задач, в том числе связанных с ИИ. Система позволит утроить доступные в стране вычислительные мощности. Соглашение о создании Roihu было заключено между компанией Eviden (дочерняя структура Atos) и Финским научным IT-центром CSC в конце 2024 года. Комплекс Roihu смонтирован в дата-центре в Каяани рядом с действующим суперкомпьютером LUMI. Новая НРС-система построена на гибридной платформе Eviden BullSequana XH3000. В общей сложности задействованы 486 узлов на основе CPU и 132 узла на базе GPU. Каждый CPU-узел несёт на борту два 192-ядерных процессора AMD EPYC 9965 поколения Turin, что в сумме даёт 186 624 ядра. При этом 414 узлов располагают 768 Гбайт памяти, а оставшиеся 72 — 1536 Гбайт. В свою очередь, каждый GPU-узел оснащён четырьмя суперчипами NVIDIA GH200. Общее количество GPU в составе суперкомпьютера составляет 528. Все эти CPU и GPU узлы комплектуются локальным SSD вместимостью 960 Гбайт. Кроме того, в состав Roihu входят четыре узла визуализации с двумя процессорами AMD EPYC Turin 9335 (32 ядра) и двумя ускорителями NVIDIA L40 в каждом, а также четыре высокопроизводительных узла с двумя чипами AMD EPYC Turin 9555 (64 ядра) и 6 Тбайт памяти. В комплектацию данных узлов включены два SSD ёмкостью 7,68 Тбайт каждый. Сетевая инфраструктура базируется на 200G-интерконнекте Infiniband NDR. Для Roihu предусмотрено использование двух независимых хранилищ DDN EXAScaler Lustre на основе SSD: это раздел Scratch вместимостью 6 Пбайт и дополнительная секция объёмом 0,5 Пбайт для проектных приложений и личных каталогов пользователей. Пиковая скорость передачи данных у Scratch достигает 560 Гбайт/с при чтение и 280 Гбайт/с при записи. У второй секции эти значения составляют до 120 и 100 Гбайт/с соответственно. Общая FP64-производительность CPU-узлов оценивается в 10,5 Пфлопс, GPU — в 23,4 Пфлопс: в сумме это даёт 33,9 Пфлопс. Пиковое быстродействие достигает 49 Пфлопс. Суперкомпьютер Roihu станет доступен пользователям в июне нынешнего года. При этом действующие в Финляндии НРС-системы Puhti и Mahti будут полностью выведены из эксплуатации в августе 2026-го.

20.05.2026 [19:26], Руслан Авдеев

Суперкомпьютер по подписке: Bull предоставила Airbus инфраструктуру HPC-as-a-serviceЕвропейский аэрокосмический гигант Airbus получил доступ по подписке к суперкомпьютерной инфраструктуре, размещённой на площадках в Тулузе (в декабре 2025 года) и Гамбурге (в апреле 2026 года). Официальный запуск системы, производительность которой втрое выше, чем у предыдущего суперкомпьютера компании, состоялся 19 мая, сообщает The Register. Саму Bull французское государство приобрело у Atos несколько месяцев назад. Новая суперкомпьютерная система представляет собой модульную конструкцию: оборудование собиралось в контейнерах перед транспортировкой на площадки Airbus. Система основана на стоечной инфраструктуре BullSequana XH3000 и включает вычислительные модули на основе AMD EPYC Genoa и Turin. Кроме того, используются ИИ-ускорители NVIDIA, хранилища IBM Spectrum Scale и 400G-интерконнект NVIDIA InfiniBand NDR. выделяемое дата-центрами тепло будет применяться для теплоснабжения соседних зданий на подконтрольной Airbus территории. По имеющимся данным, Airbus потратит около €100 млн ($116 млн) в течение пяти лет за комплексное обслуживание. Bull выиграла контракт у HPE, которая ранее обслуживала интересы Airbus. Сообщается, что Airbus была клиентом HPE около 24 лет, после чего была инициирована закупка для замены существующей системы для повышения производительности втрое. Впрочем, Bull пока не сообщает, какая часть проекта уже реализована на сегодняшний день.

Источник изображения: Airbus Хотя физически оборудование разнесено по двум площадкам, сообщается, что они функционируют как единый суперкомпьютер по модели HPC-as-a-Service (HPCaaS). Правда, пока рабочие нагрузки не распределяются между ними, а выполняются лишь на одной. При этом площадка выбирается в зависимости от имеющихся потребностей и ресурсов. Airbus давно нуждается в более мощном HPC-кластере, поскольку намерена использовать его для создания цифровых двойников для моделирования конструкций и полётов вертолётов и других летательных аппаратов. Вероятно, будет использоваться ПО CODA для вычислительной гидродинамики (CFD). Оно разработано Airbus совместно с Немецким аэрокосмическим центром (DLR) и Французской аэрокосмической лабораторией (ONERA). По некоторым данным, Bull также взаимодействует с Airbus для использования квантовых и ИИ-алгоритмов для удовлетворения вычислительных потребностей, но информация «строго конфиденциальна». Заявлено, что ввод в эксплуатацию распределённой суперкомпьютерной инфраструктуры состоялся всего через 14 мес. после подписания контракта. В декабре 2025 года сообщалось, что Airbus перенесёт критически важные нагрузки и приложения в суверенное европейское облако, но тогда речь шла о решениях ERP, CRM, PLM, MES и пр.

19.05.2026 [12:49], Руслан Авдеев

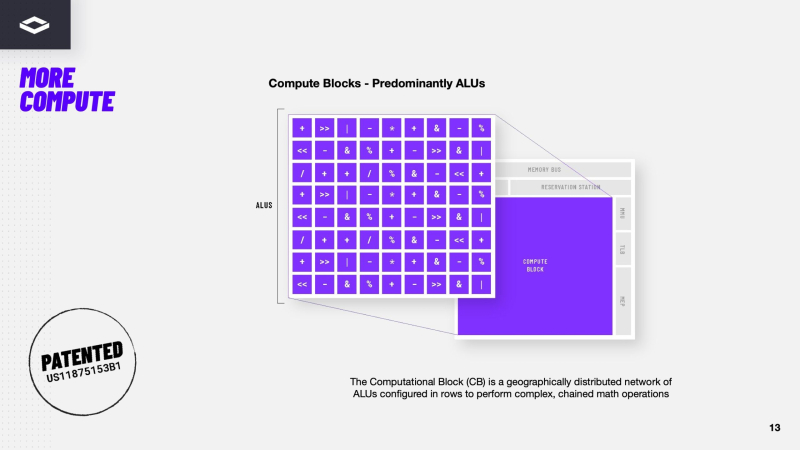

AMD и NVIDIA свернули не туда: следующий крупный американский суперкомпьютер может получить HPC-чипы NextSiliconБольшая часть самых мощнейших суперкомпьютеров мира в рейтинге TOP500 полагаются на ускорители на основе GPU, однако Национальные лаборатории США начали искать новые архитектуры чипов, обеспечивающие высокую производительность в FP64-расчётах, востребованных для симуляций Министерства энергетики США (DoE). Последнее занимается не только вопросами энергетиками, но и управляет одними из мощнейших суперкомпьютеров мира, в т.ч. для моделирования физики ядерного оружия, виртуальных экспериментов, касающихся биологического оружия, а также решения задач обеспечения общественного здоровья и безопасности, сообщает The Register. С запуска суперкомпьютера Titan в 2012 году всё больше систем стали использовать ускорители NVIDIA, а впоследствии и чипы AMD. Однако новый суперкомпьютер Spectra Сандийских национальных лабораторий (SNL), созданный Penguin Solutions и NextSilicon, использует другие решения. В сравнении с экзафлопсными системами уровня Frontier или El Capitan он занимает относительно мало места и состоит всего из 64 узлов. Spectra используют в качестве тестовой площадки для чипов Maverick-2, успешно прошедших все приёмочные испытания. Это открывает возможность их использования в боле крупных системах. Maverick-2 используют перенастраиваемую потоковую (dataflow) архитектуру. Фактически внутри чипа находится сеть связанных вычислительных блоков, работающих не по жёстко заданной схеме, а как узлы графа. В ходе выполнения задачи каждый блок можно настроить под отдельную задачу — сложение, умножение и т.п., благодаря чему происходит адаптация под разные типы вычислений с более эффективной обработкой потоков данных. Главная особенность — возможность одновременных вычислений и передачи данных. В NextSilicon утверждают, что это значительно повышает производительность и энергоэффективность в реальных задачах. Groq, Cerebras и SambaNova и ранее предлагали чипы на «потоковых» архитектурах, но все они были ориентированы на обучение и инференс ИИ, тогда как NextSilicon ориентируется именно на HPC. Подобные архитектуры очень сложны для программирования, поэтому разработчики обычно предлагают готовые сервисы, а не просто продают серверы на их основе. NextSilicon пытается решить подобную проблему, предложив собственный компилятор, позволяющий использовать имеющиеся программы на C, Python, Fortran и CUDA без серьёзной доработки. В Сандийских лабораториях уже проверили технологию на важных HPC-нагрузках, включая HPCG, LAMMPS и Sparta, подтвердив пригодность системы для научных вычислений. Ставка разработчика на HPC контрастирует с вектором развития ИИ-ускорителей NVIDIA. В Rubin компания делает ставку на ИИ-вычисления, снижая «чистую» производительность FP64, полагаясь на эмуляцию посредством схемы Озаки. Если в некоторых HPC-задачах это работает, то в других эффективность подобных обходных решений весьма низкая. AMD помимо ориентированных на ИИ Instinct MI455X готовит и MI430X, где сохранены аппаратные HPC-блоки. Именно на подобные нагрузки ориентируется NextSilicon со своими наработками. Полных системных бенчмарков Maverick-2 и суперкомпьютера пока нет, но компания утверждает, что один такой ускоритель способен обеспечить порядка 600 Гфлопс в тесте HPCG (FP64). По данным стартапа, это сопоставимо по производительности с ведущими GPU, причём энергопотребление у новинки вдвое ниже. Для США главной проблемой может оказаться давление акционеров компаний, поставляющих чипы. Если ИИ сделал NVIDIA финансовым и технологическим гигантом, то рынок решений для HPC остаётся важным, но всё ещё нишевым направлением. Хотя стартапам вроде NextSilicon ещё предстоит доказать право своих продуктов на место под солнцем, Китай уже давно продемонстрировал, что GPU вовсе не обязательны для успешной конкуренции с лучшими суперкомпьютерами Запада. OceanLight и Tianhe-3 полагаются на кастомные процессоры и ускорители на базе DSP вроде Matrix 2000. Последние, по слухам, были созданы в ответ на запрет поставок Intel Xeon Phi в КНР. Также недавно появились данные о новом Arm-суперкомпьютере LineShine.

12.05.2026 [09:35], Сергей Карасёв

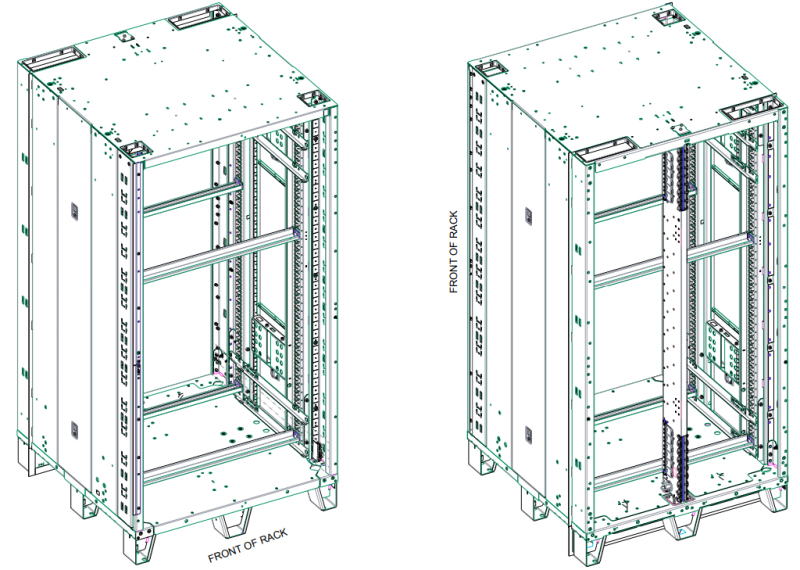

Meta✴ готовит пятитонные ИИ-стойки с чипами AMDНекоммерческая организация Open Compute Project (OCP) обнародовала спецификацию серверных стоек Open Rack Wide (ORW) от Meta✴, которая дополняет более общую базовую спецификацию. Стойки разработаны для дата-центров, ориентированных на ИИ и НРС, разработанную Meta✴ и дополняющую базовый вариант стандарта. Стандарт ORW положен в основу платформы AMD Helios. Габариты стоек ORW составляют 2390 мм в высоту, 1219 мм в глубину и 1200 мм в ширину. Таким образом, стойка ORW вдвое шире стандартных стоек Open Rack V3 (600 мм). Конструкция ORW рассчитана на плотное размещение тяжёлого оборудования — крупногабаритных серверов с GPU-ускорителями, мощных СХД и пр. Грузоподъёмность рамы должна составлять 4700 кг (без учёта массы собственно стойки). Подчёркивается, что на показатель влияет множество факторов, включая пространственное распределение IT-оборудования, количество и расположение поперечных распорок и пр. Любые дополнительные элементы, установленные в стойку, необходимо учитывать при расчёте максимальной грузоподъёмности. ORW-стойка рассчитана на 44OU-единицы для узлов удвоенной ширины или 47U для 19″ узлов. Возможно комбинирование различных типов оборудования — конструкция стойки предусматривает наличие вырезов для кронштейнов крепления серверов обоих типов. Также прописана поддержка обычных 21″ шасси, в этом случае ёмкость стойки составляет 88OU. Интересно, что NVIDIA в стойках Kyber перейдёт к вертикальным узлам. Впрочем, компания наверняка тоже отдаст спецификации OCP, как это было со стойкой Oberon. В стойках ORW обеспечивается циркуляция воздуха от фронтальной области к тыльной. В обычных условиях эксплуатации в верхней, нижней и боковых частях не предусмотрены отверстия, через которые горячий воздух может проникать в холодный коридор дата-центра. Конструкция должна включать передний и задний каналы для организации кабелей, которые могут укладываться вертикально во всех четырёх углах рамы. В спецификации сказано, что доступ к высоковольтным линиям на шине постоянного тока должен быть исключен, если она подключена к IT-оборудованию. Стойки ORW совместимы с различными конструкциями шин питания — как с воздушным, так и с жидкостным охлаждением. Интерфейс шинопровода аналогичен ORv3 HPR (High Power Rack). Предполагаемое номинальное входное напряжение, обеспечиваемое модулем питания ORv3, составляет 51 В DC. Вся подсистема питания IT-оборудования должна поддерживать входные напряжения в диапазоне от 46 В до 52 В. Требуются датчики напряжения и температуры, силовой (100 А) и обратный (100 А) каналы, а также заземление. Типовая мощность — до 4,8 кВт на коннектор (узел). Нужно отметить, что OCP продвигает перевод дата-центров на DC-питание. Предполагается, что такая архитектура позволит повысить плотность и энергоэффективность вычислений. Концепция предусматривает возможность выделение подсистемы питания в отдельную стойку и переход к 400/800 В DC с выносом AC/DC-преобразование AC/DC за пределы машинных залов. Передачу энергии планируется осуществлять через общую DC-шину, соединяющую все стойки, или по отдельным кабелям (либо комбинированно). Между тем перед операторами ИИ-дата-центров встаёт проблема, связанная с ростом массы IT-оборудования. Современные стойки 42U с набором серверов весят 680–1150 кг, а для ORW предусмотрена нагрузка до почти 5 т. Из-за этого возникают сложности с обустройством полов и перекрытий. Из-за большой массы оборудования многие операторы предпочитают строить одноэтажные дата-центры вместо многоэтажных. Хотя как раз для ИИ-кластеров с точки зрения интерконнекта эффективнее именно последние. Однако для Meta✴, возможно, важнее скорость развёртывания — она даже обходится без капитального строительства.

08.05.2026 [09:14], Сергей Карасёв

NVIDIA и Iren объединили усилия для создания ИИ-инфраструктуры мощностью до 5 ГВтКомпании NVIDIA и Iren (ранее Iris Energy) объявили о стратегическом партнёрстве с целью ускорения развёртывания инфраструктуры ИИ следующего поколения. Речь идёт о создании объектов суммарной мощностью до 5 ГВт, рассчитанных на наиболее ресурсоёмкие нагрузки. В рамках проекта планируется использовать платформу NVIDIA DSX. Это эталонная архитектура ИИ-фабрик, которая охватывает все уровни инфраструктуры — от отдельных ускорителей до сети. Благодаря DSX операторы крупных дата-центров могут максимизировать энергоэффективность, отказоустойчивость, масштабируемость и производительность ИИ-кластеров. При этом ускоряется их построение и снижаются эксплуатационные расходы. Цель нового партнёрства заключается в том, чтобы сократить время развёртывания крупномасштабных ИИ-фабрик путём объединения архитектуры DSX с опытом Iren в области энергетики, землепользования, ЦОД и инфраструктурных решений. Флагманским объектом будущей сети станет кампусе Iren Sweetwater мощностью 2 ГВт в Техасе (США). В перспективе реализуемый проект позволит предоставлять вычислительные мощности для задач ИИ корпоративным клиентам по всему миру. Генеральный директор NVIDIA Дженсен Хуанг (Jensen Huang) отмечает, что фабрики ИИ становятся одним из основополагающих компонентов мировой экономики. Однако развёртывание таких систем в масштабе требует глубокой интеграции по всему стеку — от вычислительных ресурсов и ПО до сетей и электропитания. Iren, по словам Хуанга, обладает необходимым опытом для выполнения этих комплексных работ. По условиям подписанного соглашения, Iren предоставит NVIDIA право на приобретение до 30 млн своих обыкновенных акций сроком на пять лет по цене $70/шт. Это даёт NVIDIA возможность инвестировать до $2,1 млрд при соблюдении определённых условий, включая требования регулирующих органов.

07.05.2026 [16:26], Владимир Мироненко

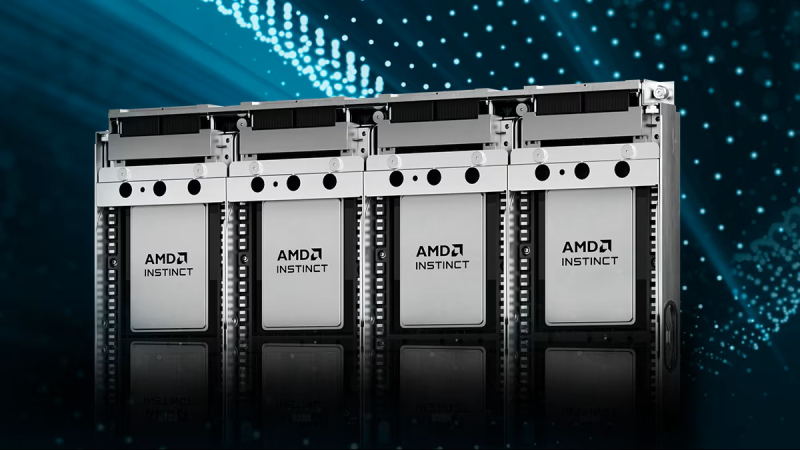

200 Тфлопс в FP64: AMD поделилась первыми подробностями об Instinct MI430XAMD поделилась информацией о производительности Instinct MI430X. Это не ИИ-ускоритель — чип ориентирован на задачи в сегменте высокопроизводительных вычислений (HPC): вычисления с двойной точностью (FP64) остаются чрезвычайно важными в науке, моделировании и многих других приложениях, пишет ресурс ComputerBase. AMD официально подтвердила выпуск чипа прошлой осенью, когда уже получила первые крупные заказы. Теперь компания демонстрирует первые показатели решения с 432 Гбайт HBM4. Обладая производительностью более 200 TFLOPS в нативном режиме FP64, он будет «более чем в шесть раз быстрее» ускорителя NVIDIA Rubin. Однако следует отметить, что сравнение несколько некорректно. Во-первых, Rubin — это чистый ИИ-ускоритель, ориентированный на FP4 и аналогичные форматы, а не на FP64. Во-вторых, AMD прямо не уточняет, идёт ли речь о векторных и/или матричных вычислениях. Хотя, вероятно, речь всё-таки о векторных расчётах, поскольку в режиме эмуляции со схемой Озаки Rubin, как обещает NVIDIA, будет выдавать те же 200 Тфлопс в FP64. При этом реального конкурента, кроме Instinct M430X, у Rubin в FP64 нет. С другой стороны, Rubin, в свою очередь, по всей видимости, превосходит MI430X в приложениях FP4 — AMD пока не раскрыла его возможности в таких вычислениях. Кроме того, компания сама говорила о возможности поддержки схемы Озаки (Ozaki) для чипов Instinct. Фактически AMD в своих же чипах «отклонилась от курса», решив наращивать ИИ-производительность. В Instinct MI355X FP64-производительность и векторных, и матричных вычислений была на уровне 78,6 Тфлопс, тогда как вышедший ранее MI325X выдавал 81,6 Тфлопс, а ещё более «древний» MI300X — 81,7 Тфлопс. О решении AMD нарастить нативную FP64-производительность ускорителя Instinct MI430X стало известно этой весной. До этого компания усомнилась в эффективности эмуляции научных расчётов на тензорных ядрах NVIDIA. NVIDIA же давно сделала ставку исключительно на ИИ, отказавшись от развития в новейших ускорителях FP64-блоков, но учёные указывают на то, что отказ от поддержки этого направления грозит лидерству США в HPC и дальнейшим инновациям. В Министерстве энергетики США (DoE) также отметили, что FP64-вычисления по-прежнему «очень важны» для «Миссии Генезис» (Genesis Mission) и для реализации её цели — ускорения научных открытий с помощью ИИ. AMD добилась больших успехов в сегменте HPC, поставляя оборудование для самых быстрых в мире суперкомпьютеров. Именно этот рынок является целевым для Instinct MI430X, о чем свидетельствуют первые заказы, включая машину Discovery Национальной лаборатории Ок-Ридж (ORNL) в США и Alice Recoque во Франции. Как сообщается, производительность Alice Recoque составит более 1 Эфлопс в FP64, что сделает его одной из самых быстрых HPC-систем в Европе.

07.05.2026 [15:03], Сергей Карасёв

TotalEnergies создаст суперкомпьютер Pangea 5 за €100 млнФранцузская нефтегазовая компания TotalEnergies объявила о заключении соглашения с Dell Technologies и NVIDIA на создание нового суперкомпьютера под названием Pangea 5. Ожидается, что его ввод в эксплуатацию позволит увеличить вычислительные мощности TotalEnergies в шесть раз по сравнению с нынешними показателями (точные данные не приводятся). Технические подробности о будущей НРС-системе не раскрываются. Отмечается лишь, что в составе комплекса будут применяться «специализированные процессоры, рассчитанные на массово-параллельные вычисления». Речь идёт об ускорителях NVIDIA на основе GPU, а также о решениях InfiniBand и пр. Машина получит гибридное хранилище DDN ExaScaler. Инвестиции в проект Pangea 5 оцениваются в €100 млн. Суперкомпьютер расположится в Научно-техническом центре Жана Феже в По (Jean Féger Scientific and Technical Center at Pau — CSTJF) на юго-западе Франции. Там же смонтирована нынешняя машина Pangea 4, запущенная в июле 2024 года. По сравнению с этим комплексом при сопоставимой производительности общее энергопотребление Pangea 5 будет ниже примерно на 40 %, а потребление энергии системой охлаждения — меньше в пять раз. Тепло, генерируемое новым суперкомпьютером, планируется использовать для отопления зданий CSTJF, в которых работают более 2,5 тыс. человек. Компания TotalEnergies будет использовать Pangea 5 для ресурсоёмких вычислений с применением передовых методов сейсморазведки для повышения точности визуализации недр и ускорения геологоразведочных работ. Кроме того, суперкомпьютер поможет в реализации проектов, связанных с ИИ. Запуск вычислительного комплекса намечен на следующий год.

29.04.2026 [15:34], Сергей Карасёв

Китай анонсировал 2,5-Эфлопс Arm-суперкомпьютер LineShine на домашних процессорахКитайский национальный суперкомпьютерный центр в Шэньчжэне (NSCCSZ) анонсировал проект вычислительного комплекса LineShine (LingSheng), производительность которого после полноценного ввода в эксплуатацию окажется на уровне 2 Эфлопс. Особенностью системы является то, что её конфигурация предполагает применение исключительно CPU-серверов — без ускорителей на базе GPU. Как отмечает ресурс HPC Wire, LineShine будет создаваться в несколько этапов. Одна из секций нового суперкомпьютера получит серверы Huawei Kunpeng с десятками тысяч вычислительных ядер. Предусмотрено использование 428 узлов хранения с суммарной вместимостью 650 Пбайт. Заявленная пропускная способность — 10 Тбайт/с. Вторая секция LineShine предполагает применение 20480 вычислительных узлов, каждый из которых будет оснащён двумя процессорами LX2 на архитектуре Armv9. Конструкция чипов LX2 включает два вычислительных кристалла со 152 ядрами (в сумме 304 ядра) и восемь стеков памяти HBM (32 Гбайт, 4 Тбайт/с). Каждый кристалл использует 128 Гбайт внешней памяти DDR. За обмен данными между блоками DDR и HBM отвечает специальный механизм SDMA. Каждый кристалл поделён на четыре NUMA-домена (38 ядер и 4 Гбайт HBM). Узлы соединены между собой высокоскоростным интерконнектом LingQi, обеспечивающим пропускную способность до 1,6 Тбит/с на узел. Говорится о поддержке режимов FP64/FP32/FP16/INT8. Заявленная производительность LX2 достигает 60,3 Тфлопс на операциях FP64 и 120,6 Тфлопс на операциях FP32. Таким образом, пиковая теоретическая FP64-производительность составляет 2,47 Эфлопс.

Источник изображения: South China Morning Post Для сравнения, самый быстрый на сегодняшний день суперкомпьютер в мире по версии TOP500 — американский комплекс El Capitan — обладает быстродействием 1,809 Эфлопс с пиковым значением 2,821 Эфлопс, но в нём применяются как CPU, так и ускорители (AMD Instinct MI300A). Таким образом, LineShine станет самым мощным НРС-комплексом, построенным исключительно на базе CPU. Другой особенностью машины станет то, что в её составе будут применяться только китайские компоненты, включая процессоры, накопители и сетевое оборудование. При этом официально КНР не участвует в TOP500 уже пять лет, да и в целом не любит рассказывать о своих самых мощных суперкомпьютерах. Нужно отметить, что в Китае действует другой суперкомпьютер экзафлопсного класса — система China New-generation Intelligent Supercomputer (CNIS). Этот комплекс имеет гетерогенную конфигурацию с 5632 вычислительными узлами. Каждый из них наделён двумя 64-бит серверными процессорами на базе CISC с 64 ядрами (2,4 ГГц) и восемью ускорителями GPGPU с архитектурой SIMT с 64 Гбайт HBM (1,8 Тбайт/с). Задействованы 8-канальная подсистема памяти DDR5-6400. Каждый GPGPU обеспечивает пиковую производительность 32,7 Тфлопс в режиме FP64, 65,5 Тфлопс на операциях FP32 и 470 Тфлопс в режиме FP16, что в сумме даёт пиковую теоретическую FP64-произвоидительность на уровне 1,47 Эфлопс.

26.04.2026 [15:38], Руслан Авдеев

Oklo, NVIDIA и LANL задействуют ИИ для разработки плутониевого топлива и создания передовой атомной инфраструктурыЗанимающаяся разработкой малых модульных реакторов (SMR) американская компания Oklo совместно с NVIDIA и Лос-Аламосской национальной лабораторией США (LANL) займутся научно-прикладными проектами. Они выделят ресурсы на развитие атомной инфраструктуры, исследования с помощью ИИ и разработок, связанных с созданием ядерного топлива — в лаборатории, расположенной в штате Нью-Мексико, сообщает Datacenter Dynamics. В соглашении оговорено сотрудничество в области ИИ, цифровых двойников, моделирования и симуляция для развития критической инфраструктуры и ускоренного внедрения атомной энергетики. По словам Oklo, соглашение касается как внедрения реакторов, так и HPC, а также использования экспертных знаний мирового уровня в области науки о топливе и материаловедении. Предполагается, что это будет способствовать созданию плутониевого топлива для реактора Pluto, выбранного Министерством энергетики США (DoE) в рамках плана Reactor Pilot Program. Также инициатива направлена на обеспечение надёжного энергоснабжения в рамках миссии Genesis, которую прозвали новым Манхэттенским проектом. В рамках партнёрства компании обучат ИИ-модели на данных в области физики и химии — с их помощью будет поддерживаться проверка качества топлива и научно-исследовательские работы, касающиеся энергоносителей на основе плутония. Также ИИ будет способствовать исследованиям в области выработки электроэнергии, обеспечения надёжности энергосистем, резервирования и стабилизации энергоснабжения для поддержки развития ИИ ЦОД в национальной лаборатории.

Источник изображения: Oklo Находящаяся в Нью-Мексико Лос-Аламосская национальная лаборатория США принимала участие в исходном Манхэттенском проекте. Сегодня лаборатория — один из ключевых научных центров Министерства энергетики США, занимающихся ядерными исследованиями. Американская Oklo разрабатывает 75-МВт SMR Aurora Powerhouse. Реактор планируют ввести в эксплуатацию в 2027 году. Oklo входит в число 11 ключевых атомных компаний, отобранных для участия в пилотной программе DoE, посвящённой новым ядерным реакторам и разработке передового ядерного топлива. Oklo — один из наиболее активных разработчиков SMR по количеству заключённых сделок, в основном для питания ЦОД. Совокупный объём заказов уже превысил 14 ГВт, хотя часть сделок не имеет обязательной юридической силы. Среди самых значимых сделок: поставка ЦОД Switch до 12 ГВт до 2044 года; 1,2 ГВт для Meta✴ до 2030 года; 500 МВт для Equinix и до 100 МВт для Prometheus Hyperscale (Wyoming Hyperscale). В последние годы NVIDIA активно взаимодействовала с компаниями, реализующими атомные энергетические проекты, а также инвестировала в них средства. В частности, речь идёт о проектах компаний TerraPower и Commonwealth Fusion Systems (CFS), занимающихся в атомных разработках, в т.ч. в сфере термоядерного синтеза. В январе NVIDIA заключила партнёрское соглашение с CFS и Siemens для «строительства» цифровой копии термоядерного реактора CFS. Это должно помочь упростить начало его коммерческой эксплуатации. |

|