Материалы по тегу: h200

|

27.05.2026 [15:41], Сергей Карасёв

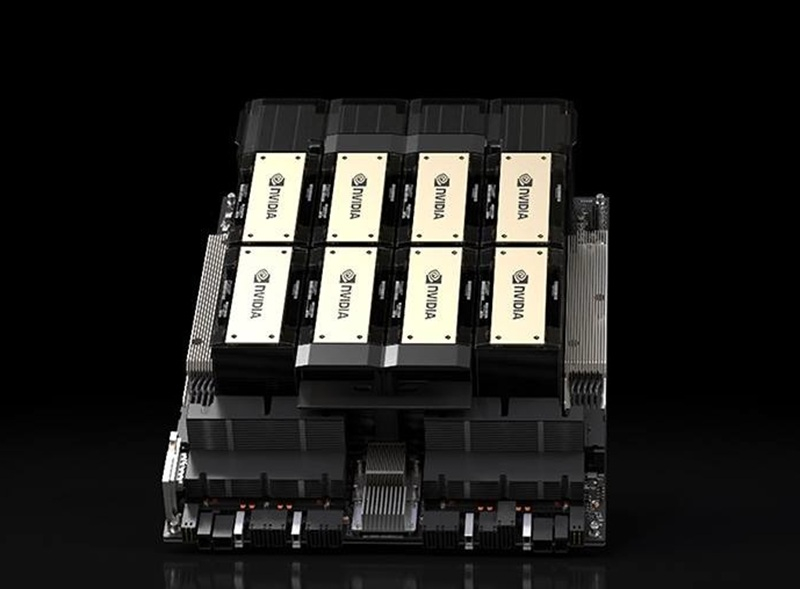

Bull поставила Финляндии суперкомпьютер Roihu с производительностью до 49 ПфлопсКомпания Bull, специализирующаяся на высокопроизводительных вычислениях, поставила Финляндии новейший национальный суперкомпьютер Roihu для ресурсоёмких задач, в том числе связанных с ИИ. Система позволит утроить доступные в стране вычислительные мощности. Соглашение о создании Roihu было заключено между компанией Eviden (дочерняя структура Atos) и Финским научным IT-центром CSC в конце 2024 года. Комплекс Roihu смонтирован в дата-центре в Каяани рядом с действующим суперкомпьютером LUMI. Новая НРС-система построена на гибридной платформе Eviden BullSequana XH3000. В общей сложности задействованы 486 узлов на основе CPU и 132 узла на базе GPU. Каждый CPU-узел несёт на борту два 192-ядерных процессора AMD EPYC 9965 поколения Turin, что в сумме даёт 186 624 ядра. При этом 414 узлов располагают 768 Гбайт памяти, а оставшиеся 72 — 1536 Гбайт. В свою очередь, каждый GPU-узел оснащён четырьмя суперчипами NVIDIA GH200. Общее количество GPU в составе суперкомпьютера составляет 528. Все эти CPU и GPU узлы комплектуются локальным SSD вместимостью 960 Гбайт. Кроме того, в состав Roihu входят четыре узла визуализации с двумя процессорами AMD EPYC Turin 9335 (32 ядра) и двумя ускорителями NVIDIA L40 в каждом, а также четыре высокопроизводительных узла с двумя чипами AMD EPYC Turin 9555 (64 ядра) и 6 Тбайт памяти. В комплектацию данных узлов включены два SSD ёмкостью 7,68 Тбайт каждый. Сетевая инфраструктура базируется на 200G-интерконнекте Infiniband NDR. Для Roihu предусмотрено использование двух независимых хранилищ DDN EXAScaler Lustre на основе SSD: это раздел Scratch вместимостью 6 Пбайт и дополнительная секция объёмом 0,5 Пбайт для проектных приложений и личных каталогов пользователей. Пиковая скорость передачи данных у Scratch достигает 560 Гбайт/с при чтение и 280 Гбайт/с при записи. У второй секции эти значения составляют до 120 и 100 Гбайт/с соответственно. Общая FP64-производительность CPU-узлов оценивается в 10,5 Пфлопс, GPU — в 23,4 Пфлопс: в сумме это даёт 33,9 Пфлопс. Пиковое быстродействие достигает 49 Пфлопс. Суперкомпьютер Roihu станет доступен пользователям в июне нынешнего года. При этом действующие в Финляндии НРС-системы Puhti и Mahti будут полностью выведены из эксплуатации в августе 2026-го.

15.05.2026 [00:29], Владимир Мироненко

США разрешили покупку NVIDIA H200 десяти китайским компаниям, но сделки застопорилисьВ преддверии визита президента США Дональда Трампа (Donald Trump) в Китай правительство страны разрешило десятку китайских компаний приобрести ИИ-ускорители NVIDIA H200, но их поставки пока так и не начались, сообщили источники агентства Reuters, знакомые с ситуацией. Как сообщается, глава NVIDIA Дженсен Хуанг (Jensen Huang) присоединился к американской делегации, и, как ожидается, предпримет усилия, чтобы разрешить зашедшую в тупик ситуацию с поставками. До ужесточения экспортных ограничений США компания NVIDIA контролировала около 95 % китайского рынка передовых чипов и на Китай приходилось 13 % её выручки. После ввода ограничений поставки чипов NVIDIA в Поднебесную практически сошли на нет. По оценкам Хуанга, объём ИИ-рынка в стране в этом году составит $50 млрд. Согласно данным источников, в число компаний, получивших разрешение на покупку H200, вошли Alibaba, Tencent, ByteDance и JD.com. Также добро получили несколько дистрибьюторов, включая Lenovo и Foxconn. Покупателям разрешено приобретать чипы либо напрямую у NVIDIA, либо через избранных посредников, и каждый получивший одобрение клиент может приобрести до 75 тыс. чипов в соответствии с условиями лицензирования США. Из всех названных компаний лишь Lenovo подтвердила Reuters факт получения лицензии на покупку американских чипов, остальные оставили без ответа запрос о комментариях.

Источник изображения: NVIDIA По словам источников, несмотря на одобрение США, поставки H200 застопорились из-за отказа китайских фирм от сотрудничества после указания властей КНР. Это подтвердил министр торговли Говард Лютник (Howard Lutnick), заявивший на слушаниях в Сенате в прошлом месяце, что правительство Китая пока не позволяет компаниям покупать чипы, стремясь сосредоточить инвестиции на отечественной промышленности. Хотя китайские ИИ-чипы уступают решениям той же NVIDIA, китайские компании, как, например, DeepSeek, всё чаще полагаются на отечественные чипы, включая разработанные Huawei. Их переход на чипы Huawei подчёркивает шаткое положение NVIDIA в Китае. Хуанг неоднократно говорил, что экспортный контроль США подрывает позиции компании на местном рынке. При этом, по оценкам некоторых экспертов, у NVIDIA уже скопился запас из примерно 700 тыс. нереализованных H200. Следует отметить, что осуществление поставок H200 затруднено множеством требований с обеих сторон. В частности, США в январе одобрили правила, согласно которым от китайских покупателей требуется продемонстрировать наличие «достаточных мер безопасности» и подтвердить отказ от использования чипов в военных целях. NVIDIA также должна подтвердить наличие достаточных запасов чипов для американских клиентов. В свою очередь, Государственный совет КНР недавно издал два постановления о безопасности цепочек поставок, что побудило правительство заняться выявлением и устранением потенциальной зависимости от иностранных технологий в КИИ.

21.04.2026 [21:56], Андрей Крупин

«Турбо облако» представило платформу для быстрого запуска ИИ-моделей с поминутной тарификацией и автоматическим масштабированиемОблачный провайдер «Турбо облако» (входит в коммерческий IT-кластер «Ростелекома»), запустил Inference Platform — платформу для развёртывания и эксплуатации моделей искусственного интеллекта, в основу которой положены ускорители NVIDIA H200 SXM с интерконнектом InfiniBand. Inference Platform поддерживает различные типы ИИ-моделей, включая open source-решения. Пользователи могут загружать собственные модели или использовать контейнерные образы, разворачивая их в облачной среде без дополнительных инфраструктурных настроек. Сервис обеспечивает автоматическое масштабирование ресурсов (автоскейлинг) в зависимости от нагрузки. Такой подход позволяет оптимизировать использование GPU и снизить затраты при нерегулярной нагрузке, говорит компания. Платформа поддерживает распределённый инференс, позволяя запускать модели объёмом до 1 тплн параметров с размещением на нескольких вычислительных узлах. Также доступно гибкое использование GPU-ресурсов, включая их дробление под задачи меньшего объёма. Дополнительным преимуществом является поминутная тарификация ресурсов, гарантирующая более точный контроль расходов по сравнению с почасовой оплатой.

Источник изображения: Omar Lopez-Rincon / unsplash.com В настоящее время новый продукт доступен для тестирования: компании могут оценить его возможности на собственных моделях.

09.04.2026 [12:22], Руслан Авдеев

TrendForce: начало поставок NVIDIA Rubin задержится, а Hopper для Китая выпустят меньше, чем ожидалосьВысока вероятность, что поставки ИИ-ускорителей семейства NVIDIA Rubin начнутся позже, чем планировалось и в меньших объёмах, чем рассчитывали ранее. По данным The Register, это связано с вероятными проблемами с цепочками поставок. По словам экспертов TrendForce, на долю Rubin придётся 22 % всех поставок передовых ускорителей NVIDIA в 2026 году, хотя раньше в прогнозах речь шла о 29 %. Причинами называются задержки с проверкой новейшей памяти HBM4, применяемой с ускорителями, трудности с переходом на адаптеры NVIDIA ConnectX‑9, а также увеличение энергопотребления ИИ-систем и повышение требований к СЖО. Более того, будут ниже прежних прогнозов поставки ускорителей на архитектуре Hopper, включая модели H200, предназначенные для поставок в Китай. В январе 2026 года одобрили поставки в обмен на 25 % от выручки от продаж этих изделий. Пришлось уговаривать и сам Пекин, который одобрил импорт H200 в КНР лишь недавно. В марте глава NVIDIA Дженсен Хуанг (Jensen Huang) сообщил, что компания наращивает производственные мощности по выпуску H200 для Китая, и уже имеются заказы. TrendForce прогнозирует, что в 2026 году доля поставок ускорителей Hopper составит 7 % от общего объёма поставок NVIDIA, это ниже 10 %, как ожидалось ранее. Впрочем, в TrendForce предполагают, что их место и место недопоставленных Rubin займут чипы Blackwell, включая Blackwell Ultra. На долю Blackwell, вероятно, придётся 71 % об общего объёма продаж ускорителей NVIDIA за 2026 год. Кроме того, TrendForce предрекает неплохие перспективы недавно анонсированным инференс-ускорителям NVIDIA LPU Groq, предназначенным для совместной работы с «классическими» GPU вроде Rubin. Впрочем, из-за ограничений встроенной SRAM-памяти такие модели понадобятся в больших количествах, говорит TrendForce, предрекая спрос в «сотни тысяч единиц» в 2026 году и приблизительно вдвое больше — в следующем. При этом эксперты подчёркивают, что во II квартале цены на DRAM могут вырасти на 45–50 % дополнительно, вдобавок к росту на 75–80 %, отмеченному в I квартале. В последние месяцы цена на память, включая продукты вроде DDR5 и SSD, стремительно растут, они более чем втрое дороже, чем стоили год назад. В значительной степени это обусловлено спросом на ИИ-инфраструктуру и высокой цикличностью ценообразования на рынках модулей памяти.

20.03.2026 [19:45], Владимир Мироненко

Сооснователь Supermicro арестован за контрабанду в Китай ИИ-серверов на $2,5 млрдВ США предъявили обвинения трём людям, связанным с производителем ИИ-серверов Super Micro Computer (Supermicro), включая его соучредителя, в сговоре с целью контрабанды передовых чипов NVIDIA в Китай и нарушении американского экспортного контроля, запрещающего их продажу в КНР без лицензии. Об этом сообщило агентство Reuters со ссылкой на заявление Министерства юстиции США. Акции компании рухнули более чем на четверть. Согласно обвинительному заключению прокуратуры Южного округа Нью-Йорка, И-Шьян Лиау (Yih-Shyan Liaw), известный как Уолли (Wally), Руэй-Цанг Чанг (Ruei-Tsang Chang), известный как Стивен (Steven), и Тин-Вэй Сунь (Ting-Wei Sun), известный как Вилли (Willy) вступили в сговор с целью продажи серверов с запрещёнными для экспорта в Китай чипами. 71-летний Лиау, соучредитель Supermicro и член совета директоров компании, был арестован в четверг в Калифорнии и освобождён под залог. 44-летний Сунь, подрядчик Supermicro, находится под стражей в ожидании слушания по вопросу о мере пресечения. 53-летний Чанг, работавший в тайваньском офисе Supermicro, пока находится на свободе, скрываясь от правосудия. Всем им предъявлено обвинение в сговоре с целью нарушения Закона о реформе экспортного контроля, за что, в случае осуждения, предусмотрено максимальное тюремное заключение сроком на 20 лет. Также они обвиняются по одному пункту обвинения в сговоре с целью контрабанды товаров и по одному пункту в сговоре с целью обмана Соединённых Штатов, за каждый из которых предусмотрено максимальное тюремное заключение сроком на пять лет. По словам прокуроров, серверы зачастую собирались в США и сначала отправлялись на предприятия Supermicro на Тайване, затем доставлялись подставному юрлицу из Юго-Восточной Азии, которое в судебных документах обозначено как «Компания-1», а затем пересылались покупателям в Китае через сторонних брокеров. Сообщается, что китайские клиенты получали «флагманские» продукты Supermicro — серверы с NVIDIA B200 и H200. Как указано в обвинительном заключении, обвиняемые сотрудничали с руководителями компании-посредника, предоставляя производителю серверов фальшивые документы. Они использовали транспортно-логистическую компанию для переупаковки серверов в немаркированные коробки, чтобы скрыть их содержимое перед отправкой в Китай. Чтобы обмануть аудиторов производителя, которые проверяли компанию-посредника на соответствие экспортному законодательству, обвиняемые предъявляли им неработающие макеты серверов, тогда как настоящие серверы были отправлены в Китай. Согласно обвинительному заключению, двое из обвиняемых занимались размещением поддельных серверов на складе, арендованном компанией-посредником. Сунь передал фотографии и видео поддельных серверов одному из аудиторов, который вместо проведения проверки «находился вне офиса, наслаждаясь развлечениями, оплаченными» компанией-посредником. Также у следствия имеются видео с камер видеонаблюдения, зафиксировавших, как мошенники использовали строительные фены для замены этикеток и наклеек с серийными номерами на коробках и макетах серверов. «Схемы перенаправления, подобные тем, которые были раскрыты сегодня, приносят миллиарды долларов незаконной прибыли и представляют прямую угрозу национальной безопасности США», — заявил Джей Клейтон (Jay Clayton), прокурор Южного округа Нью-Йорка. «Преступления, связанные с чувствительными технологиями, должны пресекаться незамедлительно, иначе закон теряет смысл», — добавил он. Компания Supermicro не была прямо упомянута в обвинительном заключении, но подтвердила причастность всех трёх лиц к правонарушению. В своём заявлении она указала, что отстранила Лиау и Чанга от работы и прекратила сотрудничество с Сунем. Компания сообщила, что «в полной мере сотрудничает» с расследованием правительства. Ранее компанию обвинили в поставках подсанкционных изделий в РФ. Кроме того, Supermicro оштрафовали за нелегальные поставки оборудования в Иран. «Действия лиц, указанных в обвинительном заключении, являются нарушением политики компании и мер контроля за соблюдением нормативных требований, включая попытки обойти применимые законы и правила экспортного контроля. Supermicro поддерживает надёжную программу соблюдения нормативных требований и обязуется полностью соблюдать все применимые законы и правила США об экспортном и реэкспортном контроле», — сообщила компания в заявлении для СМИ.

18.03.2026 [10:39], Руслан Авдеев

Глава NVIDIA объявил о запуске производства ускорителей H200 для КитаяПосле длительной паузы в торговле на огромном рынке китайских ИИ-проектов NVIDIA готовится к возвращению. Её глава Дженсен Хуанг (Jensen Huang) заявил о том, что компания будет поставлять ИИ-ускорители некоторым клиентам в КНР, сообщает CNBC. По словам Хуанга, компания уже получила заказы из Китая и находится «в процессе» возобновления производства, а цепочка поставок наращивает активность. Хуанг подчеркнул, что ситуация отличается от того, что было три или даже две недели назад. Ранее сообщалось, что поставки NVIDIA H200 одобрили как американские, так и китайские власти. Теперь эти данные подтвердил и Дженсен Хуанг. В своё время на Китай приходилось около 20 % выручки NVIDIA в сегменте продуктов для ЦОД, но компании фактически запретили работать с КНР после того, как в апреле 2025 года администрация США объявила о необходимости для компании получать лицензии на экспорт чипов в Китай и некоторые другие страны. NVIDIA заявила, что экспортные ограничения привели к убыткам в объёме $5,5 млрд. Действовавшие ранее ограничения заставили NVIDIA специально разработать для китайского рынка ослабленные ускорители H20, но даже их продажи были приостановлены. В декабре 2025 года политика изменилась и NVIDIA разрешили поставлять в Китай более производительные ускорители H200 — при условии, что США будут забирать 25 % от выручки.

Источник изображения: NVIDIA При этом в прошлом месяце никаких изменений на рынке не наблюдалось. После публикации финансового отчёта 25 февраля компания сообщила, что американские власти одобрили продажу в КНР «небольшого количества» H200, но никаких поступлений на тот момент ещё не было. Задержка с возвращением на рынок была связана с ужесточением требований к обеспечению безопасности в обеих странах — несмотря на то, что Хуанг активно занимался лоббированием в США, а в начале 2026 года посетил и Китай. Впрочем, даже без учёта продаж в КНР NVIDIA отчиталась о росте выручки в последнем квартале на 73 % год к году — это уже 11-й подряд период роста, превышающего 55 % ежеквартально. В текущем квартале NVIDIA рассчитывает на рост в 77 % и подчёркивает, что таких показателей она намерена добиться без учёта выручки от рынка дата-центров в Китае. Пока в США требования к получению экспортных лицензий остаются весьма обременительными: ограничиваются объёмы поставок, требуется обязательное тестирование продукции сторонними организациями, а доля от продаж, подлежащая передаче в государственный бюджет, остаётся значительной. При этом стоит отметить, что недавно Министерство торговли США отозвало законопроект, ограничивавший новый порядок экспорта ИИ-чипов в любую точку мира без разрешения американских властей.

25.02.2026 [11:55], Сергей Карасёв

Akash Systems начала поставки первых в мире GPU-серверов с алмазным охлаждениемКомпания Akash Systems, базирующаяся в Сан-Франциско (Калифорния, США), объявила о начале поставок первых в мире ИИ-серверов, оснащённых системой алмазного охлаждения Diamond Cooling. Заказчиком выступил NxtGen AI PVT Ltd — крупнейший в Индии государственный облачный провайдер. Технология Diamond Cooling основана на применении синтетических алмазов. Этот материал обладает самой высокой теплопроводностью из всех известных соединений. Akash Systems подчёркивает, что синтетические алмазы способны отводить тепло от чипов в пять раз эффективнее по сравнению с медью, что открывает качественно новые возможности в плане охлаждения современного оборудования высокой плотности для дата-центров, ориентированных на задачи ИИ и НРС. Akash Systems поставляет серверы на базе NVIDIA H200, для охлаждения которых применяется система Diamond Cooling. В отличие от стандартных ЦОД, оборудование в которых функционирует при температурах от +24 до +29 °C, серверы с технологией Diamond Cooled способны обеспечивать максимальную производительность при температуре окружающей среды до +50 °C. Благодаря этому снижаются общие требования к системам охлаждения дата-центров, что позволяет уменьшить эксплуатационные расходы. Среди одного из ключевых преимуществ Diamond Cooling разработчики называют устранение теплового троттлинга: это обеспечивает наилучшее быстродействие при выполнении ресурсоёмких задач, таких как обучение больших языковых моделей (LLM) и инференс. Кроме того, достигается повышение производительности (Флопс/Вт) до 15 % на каждый сервер. Плюс к этому существенно сокращается общее энергопотребление ЦОД, поскольку отпадает необходимость в интенсивном охлаждении. «Система Diamond Cooling решает две самые сложные проблемы в гонке ИИ — повышение энергоэффективности и сокращение капиталовложений. В ситуации, когда увеличение вычислительной мощности на 1–2 % имеет большое значение, повышение на 15 % фактически меняет правила игры», — говорит доктор Феликс Эджекам (Felix Ejeckam), соучредитель и генеральный директор Akash Systems.

29.01.2026 [10:20], Руслан Авдеев

Конец неопределённости: Пекин одобрил импорт NVIDIA H200Китайские власти начали выдавать разрешения на импорт в страну ИИ-ускорителей NVIDIA H200. Это положит конец неопределённости, царившей после того, как поставки второго по производительности чипа NVIDIA в Поднебесную одобрили представители американских властей, сообщает гонконгская SCMP. Первая партия, как сообщают источники, поступит местным техногигантам, остро нуждающимся в передовых ускорителях. Впрочем, ожидается, что поддерживаемые государством компании вроде телеком-операторов, смогут покупать такие чипы только под жёстким контролем. Пока одобрены поставки более 400 тыс. ускорителей компаниям ByteDance, Alibaba Group Holding и Tencent Holdings, прочие бизнесы продолжают ожидать получения разрешений. В самой NVIDIA новости не комментируют. Это важные изменения китайской политики после того, как Пекин временно придержал поставки H200 ранее в январе 2026 года уже после того, как Вашингтон одобрил экспорт. Это отражает желание китайских властей сохранить баланс между необходимостью покупать передовые ИИ-чипы и стремлением добиться самодостаточности в этой сфере.

Источник изображения: NVIDIA По мнению экспертов, неограниченный доступ к закупкам чипов NVIDIA нанёс бы удар местной китайской индустрии ИИ-полупроводников. Поэтому регуляторам необходимо установить некоторые рамки для ограничения доли использования ИИ-ускорителей иностранного производства и управления спросом. Ранее допускалось, что китайские компании обяжут закупать определённое количество чипов местного производства при покупке H200 у NVIDIA. По мнению экспертов Национального университета Сингапура, одобрение Пекином импорта H200 вызвано стратегическими мотивами — это обеспечит дальнейшее ускоренное развитие китайских ИИ-технологий. Стоит отметить, что разрешение на поставки H200 довольно прохладно принято многочисленными политическими и бизнес-группами в США. Например, глава компании Anthropic сравнил такие продажи с поставками ядерного оружия Северной Корее.

21.01.2026 [17:07], Руслан Авдеев

Глава Anthropic: продажа H200 в Китай равнозначна поставкам ядерного оружия Северной КорееГенеральный директор Anthropic Дарио Амодеи (Dario Amodei) недоволен тем, что США разрешили NVIDIA продавать китайским компаниям передовые ИИ-ускорители. Он сравнил это решение с раздачей ядерного оружия противникам, сообщает The Register. По словам Амодея, выступившего на Международном экономическом форуме в Давосе, руководители китайских компаний заявляют, что эмбарго на поставку американских чипов сдерживает их развитие. Он заявил, что продавать эти чипы — большая ошибка. Ранее США разрешили поставки ускорителей NVIDIA H200 китайским покупателям с пошлиной 25 %. Теперь слово за китайскими властями, которым ещё предстоит разрешить такие сделки. Anthropic желает, чтобы экспорт ИИ-технологий, наоборот, ужесточился — это заметно контрастирует с позициями NVIDIA и AMD, которые предупреждают, что запреты на экспорт только способствуют развитию ИИ-технологий в КНР. При этом на Китай приходится около половины исследователей в области искусственного интеллекта. Ранее Anthropic утверждала, что США и так лидируют в сфере ИИ-полупроводников, а экспортный контроль, на фоне того, что вычислительные мощности чипов удваиваются каждые два года, замедляет развитие Китая и укрепляет лидерство США. Компания уверена, что США на годы опережают Китай в способности выпускать передовые чипы. Доступ к американским разработкам позволит китайским создателям ПО вроде DeepSeek оказаться в лучшей позиции для конкуренции с Западом. При этом, как сообщает The Register, многие из наиболее производительных китайских LLM относятся к open source, поэтому их может использовать любой желающий, не опасаясь того, что данные его компании попадут в обучающий датасет, тогда как LLM американских компаний в основном «скрыты» за API, а сами компании расплывчато обещают не использовать пользовательские данные для обучения своих ИИ. При этом суды полны исков пользователей, связанных с нарушением прав на интеллектуальную собственность.

Источник изображения: CDC/unspalsh.com Слова Амодеи о том, что китайские разработчики LLM угрожают американскому бизнесу, слегка сгущают краски, но всё может действительно измениться, если китайские компании смогут импортировать передовые ускорители из США. Пока же, по словам бизнесмена, ИИ из КНР производителен только «на бумаге», а системы якобы специально оптимизируют для бенчмарков. Так или иначе, корпоративные пользователи действительно имеют немного вариантов, если желают получить доступ к хорошим открытым моделям — они в основном из Китая. Сама Anthropic называет главными конкурентами не стартапы из КНР, а OpenAI, Google и, чуть реже, другие американские компании. Anthropic пока не выкладывала ни одну из своих флагманских моделей в открытый доступ, но участвовала в нескольких совместных проектах с избранными клиентами, самым значимым из которых является AWS. Амодеи подчеркнул, что его продукты почти ни разу не проиграли в борьбе за контракт ИИ-модели из Поднебесной. Ключевое слово — «почти». Это означает, что китайским разработчикам всё-таки удавалось одержать верх несмотря на сложную ситуацию, в которой они находятся из-за экспортных ограничений. Компания последовательно критикует инициативы, способные обеспечить сотрудничество Запада с Китаем и даже не приветствует взаимодействие с другими мировыми игроками. Так, летом 2025 года сообщалось, что она намерена привлечь инвестиции с Ближнего Востока, но только потому, что избежать работы с регионом не удастся. В 2024 году Anthropic даже отказалась от инвестиций из Саудовской Аравии по соображениям «национальной безопасности».

14.01.2026 [15:39], Руслан Авдеев

США разрешили экспорт NVIDIA H200 в Китай, а Китай импорт H200 не разрешилСША официально разрешили поставки чипов NVIDIA H200 китайским клиентам несмотря на неодобрение некоторых политиков. Впрочем, как оказалось, в Китае эти ускорители не очень ждут, сообщает Reuters. Параллельно США прикрыли лазейку в законах, позволявшую КНР пользоваться передовыми ИИ-чипами в зарубежных ЦОД и облаках. Согласно новым американским правилам, продаваемые в КНР чипы должны перед поставками проверяться независимыми лабораториями для подтверждения их технических характеристик. При этом в Поднебесную запрещено продавать более 50 % от общего объёма чипов, продаваемых американским клиентам. NVIDIA придётся доказать, что в США достаточно ускорителей H200, а китайские клиенты должны пройти «необходимые процедуры безопасности» и не должны использовать полупроводники в военных целях. Ранее об этих условиях не сообщалось. В NVIDIA подчёркивают, что критики новых правил непреднамеренно продвигают интересы конкурентов компании, находящихся в американском «чёрном списке». В декабре было объявлено о возможности продавать чипы NVIDIA H200 в КНР с условием уплаты в американский бюджет пошлины в объёме 25 % от их стоимости. Китайским технологическим компаниям нужно порядка 2 млн H200, причём каждый из ускорителей стоит около $27 тыс. Это превышает запасы NVIDIA, на складах которой имеется не более 700 тыс. таких чипов. Глава NVIDIA Дженсен Хуанг (Jensen Huang) заявил, что компания нарастит производство H200. По словам Reuters, пожелавшие остаться анонимными сотрудники китайской таможни заявили, что ввоз чипов NVIDIA H200 в Китай пока не разрешён. Также, по некоторым данным, китайские власти пригласили представителей местных технологических компаний на встречу, в ходе которой недвусмысленно указали не покупать H200 без крайней необходимости. Фактически, по данным источников СЧМИ, речь идёт о временном запрете закупок, который может стать постоянным. H200 в последнее время находится в центре обсуждений американо-китайских отношений. Хотя спрос со стороны китайского бизнеса велик, есть вероятность, что Пекин вовсе запретит ввоз таких чипов, чтобы местные разработчики ИИ-чипов могли развивать собственные проекты. Также возможно, что вопросы, касающиеся поставок H200, станут предметом торга с Вашингтоном. Пока нет данных, касается ли запрет уже сделанных заказов, или только новых. Желая замедлить развитие Китая в сфере ИИ и технологий в целом, США с 2022 года ввела ограничения на экспорт в КНР передовых полупроводников. В 2025 году США сначала запретили, а позже разрешили экспорт ускорителей H20, но поставки с августа фактически заблокировал сам Китай. Дженсен Хуанг заявлял, что доля NVIDIA на рынке ИИ-чипов КНР уменьшилась до нуля. H200 приблизительно в шесть раз производительнее H20 и отказаться от такого предложения полностью КНР будет весьма затруднительно, особенно с учётом того, что собственные чипы китайской разработки далеко не столь производительны. |

|