Материалы по тегу: aws

|

15.05.2026 [12:34], Руслан Авдеев

Великобритания инициировала антимонопольное расследование практик лицензирования ПО в экосистеме Microsoft

aws

google cloud platform

microsoft

microsoft azure

software

великобритания

конкуренция

лицензия

облако

Британский антимонопольный регулятор — Управление по конкуренции и рынкам (CMA) занялся изучением экосистемы Microsoft на предмет присвоения компании «стратегического рыночного статуса» (Strategic Market Status, SMS). Очередное расследование инициировано после введения в Великобритании режима контроля конкуренции на цифровых рынках. В случае, если компанию признают подпадающей под режим SMS, регулятор сможет применять в отношении неё специальные меры для поддержки конкуренции на рынке, сообщает The Register. О грядущем расследовании CMA заявило в конце марта. Регулятора беспокоила практика лицензирования Microsoft программного обеспечения, мешающая конкуренции на рынке облачных сервисов. Сегодня CMA объявило, что «слышало» о том, что британские клиенты не всегда способны эффективно использовать ПО Microsoft с продуктами других вендоров. Это ограничивает возможности доступа к лучшим продуктам по самым конкурентоспособным ценам. В 2025 году AWS и Google призывали (и не в первый раз) регулятора вмешаться в политику Microsoft и ограничить «экстраординарные и беспрецедентные» цены, взимаемые с клиентов за использование продуктов компании на сторонних облачных платформах. Ещё два года назад Google прямо назвала практику запретительного лицензирования по таким ценам «налогом» или «штрафом», который платят клиенты за то, что ПО Microsoft не используется в инфраструктуре Azure. Например, запуск Windows Server в облаке Google обходится до четырёх раз дороже, чем в Azure. С похожими жалобами выступала и AWS.

Источник изображения: UX Indonesia/unspalsh.com CMA оценит, использует ли Microsoft монопольное положение, чтобы ограничить клиентам финансовые возможности выбора, и насколько успешно конкуренты на рынке ИИ могут интегрировать свои сервисы с ПО компании (дело касается агрессивного внедрения Copilot). По словам представителя Open Cloud Coalition, созданной под патронажем Google и раскритикованной Microsoft, новое расследование должно быть «быстрым и окончательным». Утверждается, что оно должно навсегда устранить несправедливые практики лицензирования Microsoft, обеспечив на британском облачном рынке равные условия конкуренции и уверенность в том, что можно будет внедрять инновации и инвестировать в долгосрочной перспективе. Впрочем, результатов не стоит ждать в ближайшее время. Например, CMA потребовался 21 месяц, чтобы опубликовать результаты расследования на облачном рынке услуг Великобритании — утверждалось, что Microsoft и AWS пользуются доминирующим положением, фактически нанося ущерб британским клиентам облачных сервисов. В частности, в нём утверждалось, что Microsoft, возможно, взяла с корпоративных клиентов в Великобритании на £500 млн больше за размещение в облаках AWS и Google, чем если бы они платили за размещение в Azure. В основе того расследования был вопрос, не мешают ли меры лицензирования ПО Microsoft конкуренции на рынке облачных сервисов. Он стал основой и для нынешнего. Последнее расследование должны завершить за девять месяцев, а решение о присвоении компании статуса SMS должны принять к февралю 2027 года. Сама Microsoft заявляет, что полна решимости «оперативно и конструктивно» сотрудничать с CMA. Всестороннее расследование будет касаться ПО для повышения производительности, ОС, СУБД и ИБ-инструментов. В CMA утверждают, что намерены понять, как развиваются соответствующие рынки, какова на них роль Microsoft и какие целенаправленные действия могут потребоваться для того, чтобы у британских клиентов был выбор, доступ к инновациям и конкурентоспособные цены. Стоит отметить, что за лицензионной политикой Microsoft уже следят власти США, Европы, Бразилии, Южной Африки и Японии.

06.05.2026 [14:19], Руслан Авдеев

В 2025 году AWS увеличила площадь своих ЦОД и офисов на 16 %Как следует из отчёта для Комиссии по ценным бумагам и биржам США (SEC), в 2025 году компания AWS имела в общей сложности 5,28 млн м2 площадей ЦОД и офисных помещений, сообщает Datacenter Dynamics. Приблизительно 2,64 млн м2 находится в собственности Amazon, примерно столько же было арендовано. В целом рост год к году составил 16 %. Для сравнения, рост в 2024 году составлял 28 % в сравнении с 2023 годом, в 2023 — 14 % в сравнении с 2022, годом раньше — 28 %. В 2021 году отмечен максимальный годовой рост в процентном соотношении с момента начала составления компанией соответствующей отчётности. Рост составил 44 % в сравнении с 2020 годом, когда речь шла об 1,68 млн м2.

Источник изображения: BoliviaInteligente/unsplash.com В документации не упоминается, какая часть из площадей приходится на дата-центры, а какая — под другие помещения, включая вспомогательную инфраструктуру ЦОД и другую собственность. Также в статистику не входят корпоративные здания и штаб-квартиры. Компания направит на капитальные затраты в текущем финансовом году порядка $200 млрд, значительная часть которых будет потрачена на ИИ ЦОД. На сегодня AWS управляет 123 зонами доступности в 39 (географических) регионах. Компания намеревается открыть ещё семь зон доступности, а также два облачных региона в Саудовской Аравии и Чили. Также AWS управляет 108 периферийными локациями. По данным AWS, портфолио заказов на первый квартал составило $364 млрд, не считая недавно заключённой с Anthropic сделки на $100 млрд, поэтому компания намерена быстрыми темпами возводить новые ЦОД.

30.04.2026 [21:13], Владимир Мироненко

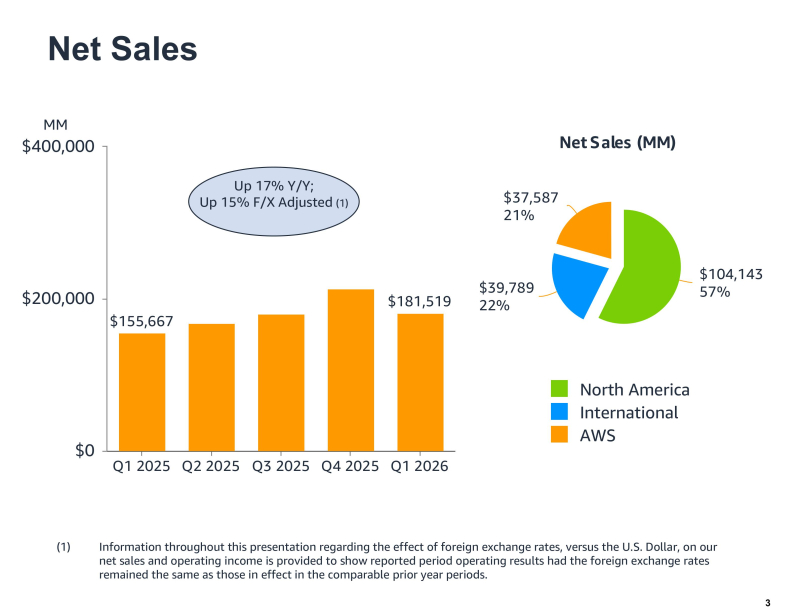

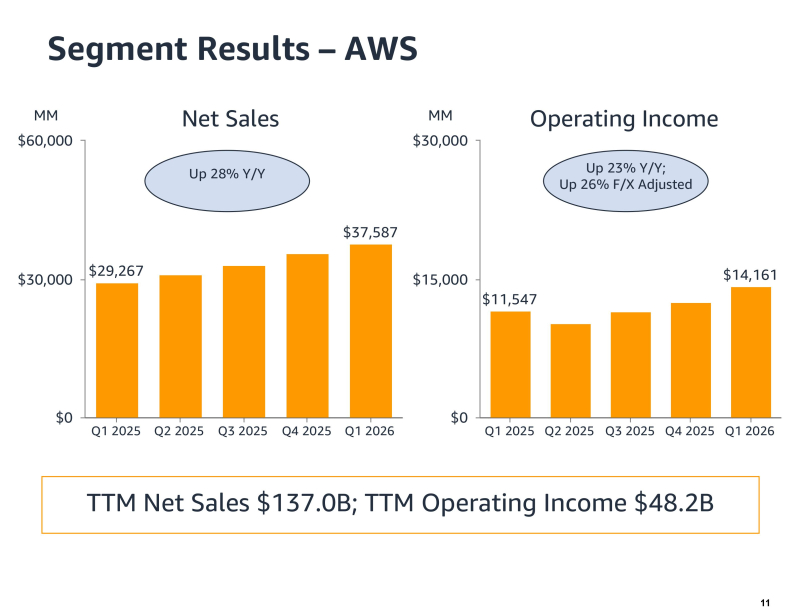

Продажи AWS растут благодаря ИИ, но не так быстро, как у конкурентовAmazon.com объявила финансовые результаты за I квартал, закончившийся 31 марта 2026 года. Квартальные показатели по выручке и прибыли превзошли ожидания Уолл-стрит. Также следует отметить рост продаж облачного подразделения Amazon Web Services (AWS) на 28 % до $37,59 млрд, что оказалось выше среднего прогноза аналитиков, опрошенных LSEG, ожидавших рост на 25 % (по данным Reuters). Это самый быстрый темп роста за последние 15 кварталов. Акции компании выросли на внебиржевых торгах на 4 %. Выручка Amazon увеличилась по итогам I квартала 2026 года на 17 % год к году до $181,52 млрд при среднем прогнозе аналитиков, опрошенных LSEG, в размере $177,30 млрд (по данным CNBC). Чистая прибыль выросла до $30,26 млрд, или $2,78 на разводнённую акцию, по сравнению с $17,13 млрд, или $1,59 на разводнённую акцию, в I квартале 2025 года, превысив также прогноз аналитиков LSEG в размере $1,64 на разводнённую акцию. Выручка AWS за квартал составила $37,59 млрд, превзойдя ожидания аналитиков, опрошенных StreetAccount, в размере $36,64 млрд. Операционная прибыль AWS достигла $14,16 млрд по сравнению с $11,55 млрд годом ранее, что превышает консенсус-прогноз аналитиков в $12,84 млрд (по данным SiliconANGLE) и подчеркивает сохраняющуюся прибыльность сегмента по мере масштабирования предприятий в сфере ИИ. «Значительное ускорение роста продаж AWS — это главная новость», — отметил старший аналитик Investing.com, добавив, что клиенты Amazon «полностью осваивают новые рабочие нагрузки, особенно в области ИИ». Вместе с тем следует отметить, что рост продаж облачного подразделения Google Cloud холдинга Alphabet составил в первом квартале 63 % до $20 млрд, превысив прогноз роста на 50 %. В свою очередь, Microsoft сообщила, что продажи её облачной платформы Azure и связанных с ней сервисов выросли на 40 %. Amazon сообщила, что ее портфель кастомных чипов, включая процессоры Graviton, ускорители Trainium и DPU Nitro, превысил годовой оборот в $20 млрд, демонстрируя трёхзначные темпы роста. За последний год Amazon развернула более 2,1 млн чипов для ИИ, при этом на Trainium приходится более половины. Среди крупных заказчиков значатся Meta✴ и Uber. «Мы находимся в разгаре одного из самых важных переломных моментов в нашей жизни, мы занимаем выгодное положение для лидерства, и я очень оптимистично смотрю в будущее наших клиентов и Amazon», — отметил генеральный директор Энди Джасси (Andy Jassy). Кроме того, пересморт соглашения Microsoft и OpenAI сыграет на руку AWS. Компания сообщила, что расходы на основные средства и оборудование за квартал выросли до $44,2 млрд, превысив прогноз аналитиков, опрошенных FactSet, в размере $43,6 млрд. В то же время свободный денежный поток за последние 12 мес. снизился до $1,2 млрд, что на 95 % меньше, чем годом ранее, в основном из-за инвестиций в ИИ, заявила компания. В феврале Amazon сообщила, что её капитальные затраты достигнут $200 млрд в 2026 году, что значительно больше, чем в прошлом году. Джасси заявил в своем письме акционерам в этом месяце, что большая часть расходов компании в 2026 году окупится в 2027 и 2028 годах. Компания намерена ускорить строительство ЦОД. Выручка в сегменте онлайн-магазина, который по-прежнему занимает наибольшую долю в общем объёме продаж Amazon, выросла на 12 % до $64,25 млрд, что выше прогнозируемых аналитиками $62,7 млрд. Доход от рекламы вырос на 24 % в годовом исчислении до $17,24 млрд, превысив ожидания Уолл-стрит в 21,2 %. В текущем квартале Amazon ожидает получить выручку в диапазоне от $194 до $199 млрд при прогнозе аналитиков LSEG в размере $188,9 млрд. Операционная прибыль, согласно собственному прогнозу компании, во II квартале составит от $20 до $24 млрд. По данным StreetAccount, аналитики прогнозируют операционную прибыль в размере $22,65 млрд.

28.04.2026 [01:11], Владимир Мироненко

Microsoft и OpenAI пересмотрели «брачный договор»: эксклюзивных прав больше нет, но и выручкой делиться не надоMicrosoft и OpenAI объявили о пересмотре условий партнёрского соглашения, что некоторые эксперты рассматривают как победу разработчика ChatGPT, хотя многие считают, обе стороны остаются в выигрыше. Как отметили обе компании, обновлённое соглашение призвано упростить партнерство и способы совместной работы, обеспечивая большую предсказуемость. Согласно обновлённому соглашению, у Microsoft по-прежнему будет лицензия на интеллектуальную собственность OpenAI для моделей и продуктов, срок владения которой ограничен 2032 годом, однако теперь она будет неисключительной. До этого у Microsoft были эксклюзивные права на интеллектуальную собственность OpenAI до тех пор, пока та не создаст «общий ИИ» (AGI). Microsoft по-прежнему является «основным облачным партнёром» OpenAI, т.е. основная часть облачных ресурсов OpenAI, вероятно, будет обслуживаться Azure в течение шести лет, охватываемых этим соглашением, даже несмотря на то, что OpenAI спешит построить собственные ЦОД в сотрудничестве с другими партнёрами. В октябре OpenAI обязалась приобрести облачные ресурсы Microsoft на сумму ещё $250 млрд. Фраза о том, Microsoft по-прежнему является «основным облачным партнёром» — сигнал акционерам Microsoft о том, что OpenAI по-прежнему будет крупным клиентом Azure, отметил ресурс TechCrunch. В обновлённом соглашении указано, что «продукты OpenAI будут в первую очередь поставляться Azure, если только Microsoft не сможет и не решит отказаться от поддержки». Судя по всему, Microsoft теперь будет в числе поставщиков, предлагающих новейшие продукты OpenAI. Но что более важно, «теперь OpenAI может предоставлять все свои продукты клиентам у любого облачного провайдера». Это означает, что Microsoft теперь не сможет подать в суд на OpenAI из-за того, что та в рамках инвестиционного соглашения с Amazon на $50 млрд пообещала, что AWS получит эксклюзивные права на предоставление нового инструмента OpenAI для создания агентов — Frontier. Согласно первоначальному соглашению, OpenAI запрещалось предлагать Frontier эксклюзивно в AWS (или даже не эксклюзивно, а вообще). Когда OpenAI объявила о сделке с AWS, Microsoft публично опровергла эксклюзивные условия AWS, указав: «Microsoft сохраняет свою эксклюзивную лицензию и доступ к интеллектуальной собственности в отношении моделей и продуктов OpenAI. <…> Azure остаётся эксклюзивным поставщиком облачных услуг для stateless API-вызовов OpenAI. <…> Любые stateless-вызовы API к моделям OpenAI, являющиеся результатом сотрудничества OpenAI с любой третьей стороной, включая Amazon, будут размещаться в Azure. <…> Собственные продукты OpenAI, включая Frontier, будут по-прежнему размещаться в Azure». Microsoft также подчеркнула, что её условия действуют до тех пор, пока OpenAI не получит AGI. Financial Times тогда сообщила, что Microsoft даже рассматривала возможность подачи судебного иска по этому поводу. Комментируя заключение обновлённого соглашения, генеральный директор Amazon Энди Джасси (Andy Jassy), в частности, отметил, что это означает, что модели OpenAI станут доступны клиентам на AWS Bedrock. Хотя эта сделка выгодна для OpenAI, Microsoft тоже в выигрыше. Новое соглашение позволяет Microsoft прекратить выплату доли выручки OpenAI, в то время как OpenAI продолжит выплачивать долю выручки Microsoft до 2030 года, независимо от технологического прогресса OpenAI, хотя теперь эта сумма ограничена. В прошлом квартале Microsoft заработала $7,5 млрд благодаря инвестициям в OpenAI. Также Microsoft продолжает напрямую участвовать в развитии OpenAI в качестве крупного акционера. Владея примерно 27 % коммерческой компании, Microsoft будет иметь финансовую выгоду от роста OpenAI, даже в случае продаж её продуктов в AWS.

24.04.2026 [17:11], Сергей Карасёв

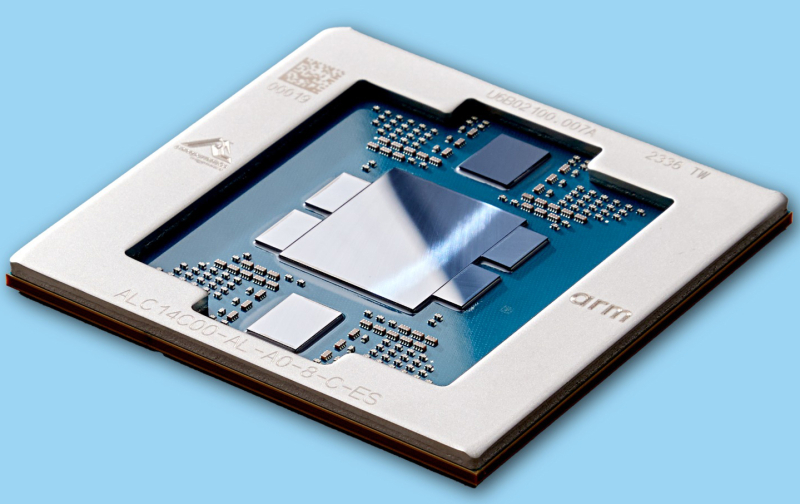

Meta✴ возьмёт на вооружение «десятки миллионов» Arm-ядер AWS Graviton5Компания Meta✴, по сообщению The Register, объявила о расширении сотрудничества с облаком AWS. Речь идёт об использовании Arm-процессоров Graviton5 для поддержания определённых ИИ-нагрузок, в частности, агентных систем. Сама AWS говорит о невероятном спросе на собственные процессоры. Крупным заказчиком является, например, Uber. AWS представила чипы Graviton5 в конце прошлого года. Эти изделия содержат 192 ядра Neoverse V3 (Poseidon), каждое из которых имеет 2 Мбайт кеша L2. Общий объём L3-кеша составляет 192 Мбайт. Присутствуют 12 каналов памяти DDR5-8800. Утверждается, что прирост производительности достигает 25 % по сравнению с процессорами Graviton предыдущего поколения. Meta✴ намерена использовать для своих задач «десятки миллионов» ядер Graviton5. Таким образом, компания станет одним из крупнейших клиентов, применяющих чипы собственной разработки AWS. Руководитель отдела инфраструктуры Meta✴, заявил, что сотрудничество с AWS направлено на диверсификацию вычислительных ресурсов. По его словам, это необходимо в свете реализации масштабных проектов в области ИИ. Ранее Meta✴ объявила о стратегическом партнёрстве с компанией Arm Holdings, которое направлено на «масштабирование эффективности ИИ на каждом уровне вычислений, охватывающем ПО и инфраструктуру ЦОД». В частности, Meta✴ намерена использовать чипы Arm AGI, специально оптимизированные для агентного ИИ. Однако, как уточняет The Register, эти изделия начнут поступать в дата-центры Meta✴ не ранее конца текущего года, поэтому компания пока будет разворачивать соответствующие нагрузки на базе Graviton5 в облаке AWS. Аналитики Counterpoint Research прогнозируют, что к 2029 году на Arm-решения будет приходиться до 90 % рынка серверных ASIC-изделий, ориентированных на ИИ. Между тем сама Meta✴ проектирует фирменные ИИ-ускорители MTIA, которые в зависимости от модификации могут применяться для обучения моделей, инференса и пр.

21.04.2026 [11:19], Сергей Карасёв

Anthropic получит от AWS до 5 ГВт ИИ-мощностей и до $25 млрд инвестицийКомпании Anthropic и Amazon объявили о расширении сотрудничества в области облачной инфраструктуры и технологий ИИ. В рамках партнёрства Anthropic получит до 5 ГВт мощностей в инфраструктуре AWS для обучения и поддержания работы своих передовых ИИ-моделей семейства Claude. В ответ Amazon инвестирует в Anthropic дополнительные $5 млрд, а в будущем — ещё до $20 млрд в зависимости от достижения определённых коммерческих целей. Ранее Amazon уже вложила $8 млрд в Anthropic. Отмечается, что Anthropic и Amazon тесно работают с 2023 года. В настоящее время более 100 тыс. клиентов используют модели Claude на платформе Amazon Bedrock. Партнёры также запустили Project Rainier — крупнейший в истории AWS и один из самых масштабных вычислительных кластеров в мире. На сегодняшний день Anthropic использует более 1 млн ускорителей AWS Trainium2 для обучения и обслуживания Claude. В рамках расширенного соглашения Anthropic обязуется потратить более $100 млрд в течение следующих десяти лет на вычислительные мощности AWS. Речь идёт об использовании изделий Trainium текущих и будущих поколений, включая Trainium4. Кроме того, будут использоваться «десятки миллионов» ядер Graviton. В общей сложности это даст до 5 ГВт вычислительной мощности. Так, к концу 2026 года будет введено в эксплуатацию около 1 ГВт ресурсов на базе Trainium.

Источник изображения: Amazon Договор предполагает использование дата-центров в Азии и Европе, что поможет повысить качество обслуживания растущей международной клиентской базы Claude. При этом пользователи смогут получить доступ к полнофункциональной консоли Claude (биллинг, безопасность, управление) непосредственно в облаке AWS — без необходимости управления дополнительными учётными данными или контрактами. Нужно отметить, что Anthropic сотрудничает и с другими поставщиками облачных услуг. В частности, недавно компания объявила о расширении использования инфраструктуры Google Cloud, а также ускорителей Google TPU. Кроме того, Anthropic взяла на себя обязательство приобрести вычислительные мощности Microsoft Azure стоимостью $30 млрд и заключить контракт на поставку дополнительных мощностей объёмом до 1 ГВт.

17.04.2026 [23:32], Владимир Мироненко

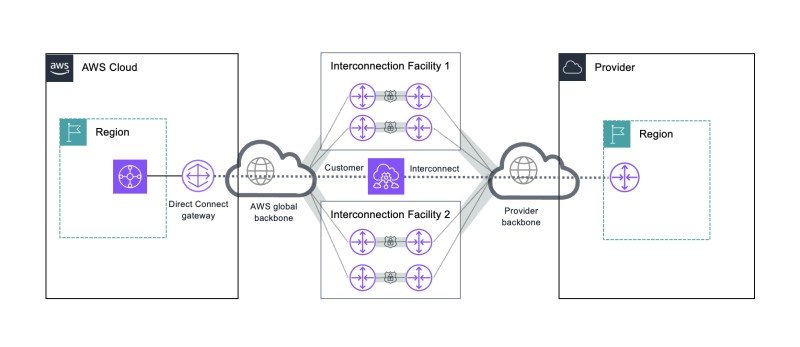

Храним здесь, запускаем там: OCI и AWS подружили свои облачные сетиOracle и Amazon решили объединить усилия для создания частного высокоскоростного соединения между OCI и AWS. Благодаря установлению связи между Oracle Interconnect и AWS Interconnect–multicloud клиенты обеих компаний получат доступ к быстрому, частному, управляемому соединению для бесперебойного запуска приложений и перемещения данных между OCI и AWS. Как отмечено в пресс-релизе, благодаря созданию ранее облачного сервиса Oracle AI Database@AWS компании впервые предложили клиентам более простой способ запуска Oracle AI Database в ЦОД AWS с теми же функциями, архитектурой и производительностью, что и в локальной среде. «Теперь мы развиваем это направление, устанавливая соединение между нашим популярным межоблачным соединением и AWS Interconnect–multicloud. Это поможет нашим общим клиентам модернизировать свои приложения, объединить данные и открыть новые возможности генеративного ИИ», — сообщила Oracle. Этот шаг отражает переход предприятий к мультиоблачным инфраструктурам, использующим десятки отдельных облачных платформ и сервисов, пишет ресурс SiliconANGLE. Современные ИИ-приложения обычно работают на архитектуре с разделённым стеком — например, компания может использовать высокопроизводительную базу данных в OCI вместе с AWS SageMaker. Изменить что-либо после запуска системы непросто, и без высокопроизводительного моста между двумя облаками клиенты будут сталкиваться с экстремальными задержками, что будет отражаться на возможностях ИИ-приложений.

Источник изображения: Oracle SiliconANGLE назвал нынешний анонс довольно неожиданным, учитывая, что отношения компаний долгое время были напряжёнными. Однако, похоже, обе компании только выиграют от партнёрства, обеспечив передачу данных между своими облаками как между единой интегрированной платформой. С этой целью Oracle интегрирует свой собственный сервис межсетевого взаимодействия со спецификацией AWS Interconnect-multicloud для создания безопасного и приватного соединения, полностью обходящего публичный интернет. Это позволит компаниям поддерживать развёртывание с разделением стека, так что организации смогут запускать приложение в OCI и хранить его данные в AWS, или наоборот. Примечательно, что Oracle охарактеризовала новое решение как «управляемое» и «нативное», то есть, клиентам не нужно настраивать вручную маршрутизацию или разрабатывать сложные стратегии репликации данных. Соблюдая спецификации AWS, Oracle, по сути, стандартизирует способ взаимодействия своего облака с платформой конкурента. Роб Стречай (Rob Strechay), ведущий аналитик theCUBE Research и Smuget Consulting, сообщил ресурсу SiliconANGLE, что сегодняшний шаг подчеркивает убеждение в том, что мультиоблачные решения — это уже не просто стратегия, а реальность для каждого предприятия. «Устраняя сложность сетевого взаимодействия между двумя крупнейшими доменами, Oracle и AWS делают межоблачную отказоустойчивость и ИИ-архитектуры гораздо более достижимыми для предприятий», — сказал он. «Будущее ИИ — это когда ваши данные хранятся в одном месте, ваши модели работают в другом, и сеть не мешает, — отметил Стречай. — Это также позволяет организациям легко осуществлять аварийное восстановление в разных облаках. Хотя на бумаге это всегда имело смысл для баз данных, Oracle делает это достижимым на практике без создания масштабного проекта в области сетевых технологий». Следует отметить, что Google Cloud ещё в мае 2023 года запустил мультиоблачное соединение Cross-Cloud Interconnect, а затем, в декабре прошлого года, — выделенное частное соединение с AWS. Со своей стороны, Oracle уже установила межсетевые соединения с Google Cloud и Azure от Microsoft. Oracle отметила, что сотрудничество между OCI и AWS Interconnect–multicloud станет последним дополнением к её комплексным мультиоблачным возможностям, планируя запуск высокопроизводительного канала позже в этом году в регионе AWS us-east-1.

14.04.2026 [16:12], Руслан Авдеев

Как по волшебству: AWS запускает инициативу Project Houdini для ускорения строительства ЦОДAmazon Web Services (AWS) исследует возможность поставить на поток строительство модульных дата-центров для ускорения развёртывания новых мощностей, сообщает Business Insider. Как следует из полученных журналистами внутренних документов компании, инициатива Project Houdini предполагает переход к готовым, собранным ещё на заводе модулям, из которых формируются машинные залы. Предполагается, что такая схема позволит сократить сроки возведения ЦОД «на месяцы». По словам представителя AWS, инновации в сфере строительства дата-центров позволяют создавать ИИ-инфраструктуру «дешевле и быстрее», поэтому клиенты обращаются именно к AWS для выполнения ресурсоёмких рабочих нагрузок. Ожидается, что только в этом году капитальные затраты Amazon составят $200 млрд, большая часть которых пойдёт на ЦОД. На днях руководство AWS сообщало сотрудникам, что компания испытывает недостаток производственных мощностей, из-за чего не может в полной мере удовлетворить спрос на мощности. Отмечается, что сейчас на обустройство машинных залов может уйти до 15 недель, около 60–80 тыс. человеко-часов от момента старта до установки серверов. Рабочие вручную прокладывают коммуникационные сети и электропроводку, готовят стойки т.д. Project Houdini предусматривает создание на производстве крупных секций, объединяющих стойки, системы электропитания, кабельную разводку, освещением, системами пожаротушения и безопасности. 45″ модули массой около 9 т доставляются в ЦОД грузовиками.

Источник изображения: Josh Olalde/unspalsh.com По оценкам AWS, время развёртывания сократится с 15 до 2–3 недель. Предполагается, что технология будет отработана к августу 2026 года, в конечном итоге её можно будет использовать для строительства более 100 ЦОД ежегодно. В рамках инициативы AWS взаимодействует с Cupertino Electric, производство первых модулей планируется начать в Топике (Topeka, Канзас), Хьюстоне (Houston, Техас) и Солт-Лейк-Сити (Salt lake City, Юта). Хотя модульные ЦОД предлагаются уже давно, обычно они используются в небольших проектах, в качестве одиночного периферийного дата-центра или как объекты всего из нескольких модулей. Такие решения предлагают, например, Schneider Electric и Vertiv. Впрочем, есть и иные подходы. Так, Meta✴ вовсе отказалась от капитального строительства, разместив ИИ-оборудование внутри быстровозводимых тентов.

13.04.2026 [22:25], Владимир Мироненко

Amazon призвала акционеров не углубляться в климатические показатели компанииСовет директоров Amazon преддверии ежегодного общего собрания призвал акционеров отклонить предложение обязать компанию раскрывать больше информации о влиянии расширения её парка ЦОД на её же климатические обязательства, сообщил The Register. Это предложение было подано некоммерческой организацией As You Sow, выступающей за корпоративную ответственность, и Mercy Investment Services, инвестиционным подразделением Sisters of Mercy of the Americas. В нём отмечается, что Amazon стремится к масштабному расширению своей облачной инфраструктуры в течение следующих нескольких лет, что ставит под сомнение реалистичность климатических обязательств, сделанных раннее центральным элементом её корпоративной стратегии. Ранее Amazon обязалась «достичь нулевых выбросов углерода к 2040 году» и полностью перейти на возобновляемые источники энергии к 2030 году. Хотя она утверждает, что выполнила последнее обязательство в 2023 году, в предложении выражается сомнение в том, сможет ли компания поддерживать этот уровень в ближайшие годы, учитывая масштабное расширение ЦОД, запланированное AWS. Компания наряду с Meta✴ действительно является одним из крупнейших мире покупателей «чистой» энергии. Однако ранее глава компании Энди Джасси (Andy Jassy) сообщил, что Amazon добавила 3,9 ГВт вычислительных мощностей в течение 2025 года и намерена удвоить этот показатель к концу 2027 года, потратив $200 млрд на расширение инфраструктуры в 2026 году. Для этой инфраструктуры потребуется дополнительная электроэнергия. В предложении отмечено, что коммунальные предприятия в таких штатах, где развиты ЦОД, теперь вынуждены строить новые газовые электростанции для удовлетворения растущего спроса и даже поддерживать работу угольных электростанций. Всё это приводит к выбросам миллионов тонн дополнительных парниковых газов в атмосферу. В связи с этим в предложении задан вопрос, как Amazon планирует решать эту проблему и будет ли увеличен объём закупаемых сертификатов возобновляемой энергии (REC). Инвесторы Amazon выиграют от анализа, объясняющего, как компания будет решать эти проблемы, говорится в документе. В свою очередь, Amazon свой призыв к акционеров отклонить предложение объяснила тем, что считает отчёт, запрошенный в предложении, ненужным. «Мы уже регулярно предоставляем публичные обновления о нашем прогрессе, инициативах и работе по достижению наших климатических целей, включая регулярные отчёты о нашей углеродоёмкости и о наших усилиях по сокращению углеродного следа рабочих нагрузок ИИ и повышению устойчивости и эффективности наших ЦОД, — говорится в обращении Amazon, — В результате, наша текущая публичная отчётность уже решает конкретные проблемы, обозначенные в этом предложении, и делает отчёт, запрошенный в предложении, ненужным».

11.04.2026 [23:18], Владимир Мироненко

Глава Amazon допустил продажу собственных чипов сторонним заказчикамНа этой неделе генеральный директор Amazon Энди Джасси (Andy Jassy) опубликовал ежегодное послание акционерам, в котором отметил высокий спрос на чипы собственной разработки. Если бы компания выделила их производство в отдельный бизнес с продажей чипов как самой AWS, так и сторонним клиентам, то его годовой оборот мог бы составить $50 млрд. Он допустил, что в будущем компания будет продавать их целыми партиями. Джасси также сообщил, что два крупных клиента AWS обратились с просьбой выкупить всю мощность инстансов на Graviton на 2026 год, но компания отклонила эти запросы, и уточнил, что расчётная годовая выручка (Revenue Run Rate, RRR) Amazon на собственных чипах (Graviton, Trainiu, Nitro) составляет $20 млрд. По словам Джасси, 98 % из 1000 крупнейших клиентов EC2 используют чипы Graviton, а мощности ускорителей Trainium2 и Trainium3 «почти полностью зарезервированы». Также уже зарезервирована значительная часть мощностей на базе Trainium4, до массовой доступности которого ещё около 18 мес. Согласно прогнозу Джасси, Trainium сэкономит компании «десятки миллиардов долларов капитальных затрат в год и обеспечит преимущество в несколько сотен базисных пунктов операционной прибыли по сравнению с использованием чипов других компаний для выполнения вычислений». Он также отметил, что, хотя расчётный годовой доход AWS в IV квартале 2025 года составил $142 млрд, 85 % глобальных ИТ-затрат по-прежнему приходится на решения on-premise. «Это изменится», — заявил Джасси. Спустя три года после начала волны развёртывания ИИ, годовой доход AWS (Revenue Run Rate, RRR) от ИИ в I квартале 2026 года превысил $15 млрд и продолжает расти. «И все же у нас по-прежнему есть ограничения по мощности, которые приводят к неудовлетворенному спросу», — говорит гендиректор Amazon. Он сообщил, что AWS будет расти ещё быстрее, если будет обеспечен большим объёмом электроэнергии. В 2025 году AWS получила 3,9 ГВт новых мощностей и намерена удвоить общую подведённую мощность к концу 2027 года. AWS запустила один из крупнейших в мире ИИ-кластеров с около 500 тыс. чипов Trainium2, который будет использоваться ИИ-стартапом Anthropic. А первым из технологических гигантов разрешил использовать собственные чипы вне его инфраструктуры стала Google, благодаря чему Anthropic приобретёт около 1 млн Google TPU v7 (Ironwood) для запуска на контролируемых ею объектах (в Fluidstack). Примерно 400 тыс. чипов компания получит напрямую от Broadcom в составе стоечных систем. |

|