Материалы по тегу: интерконнект

|

15.05.2026 [08:38], Сергей Карасёв

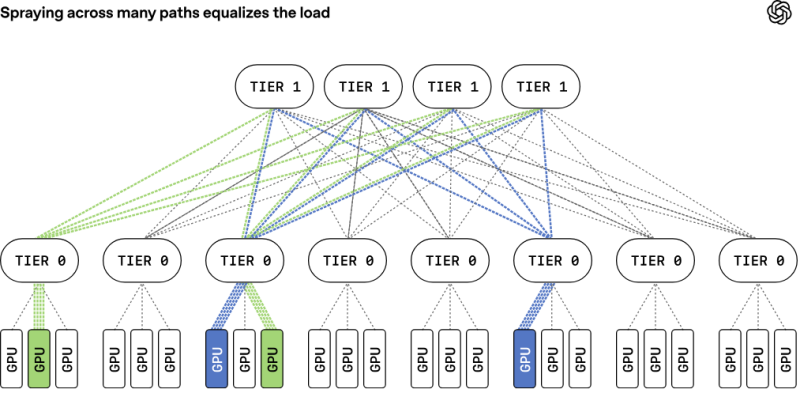

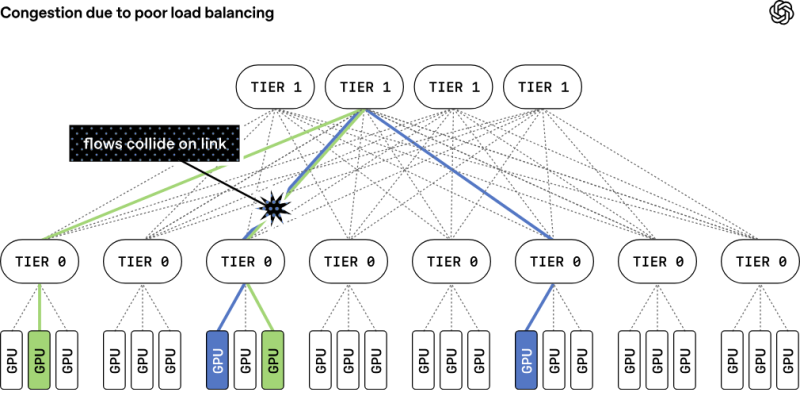

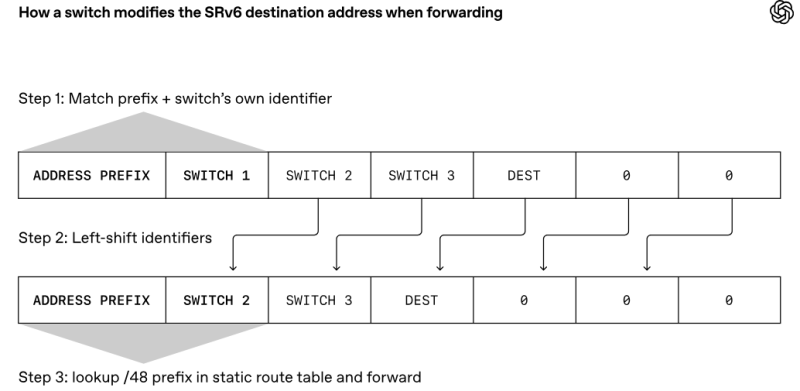

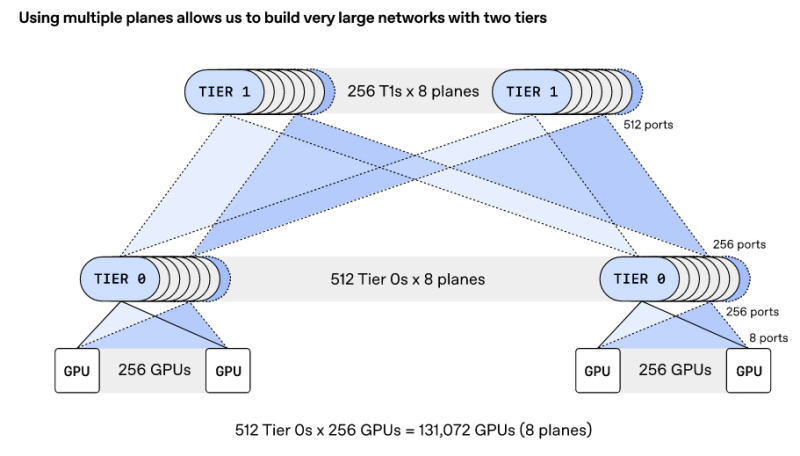

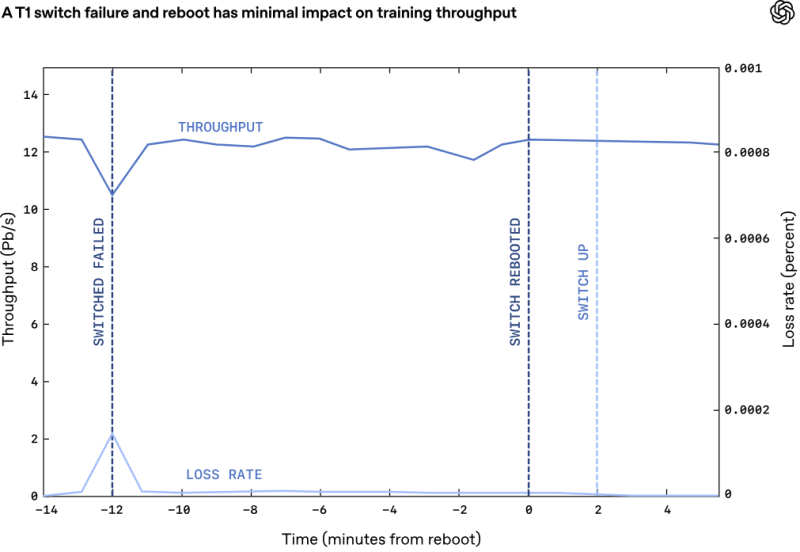

Сетевой протокол Multipath Reliable Connection (MRC) улучшит производительность и надёжность ИИ-кластеровOpenAI в партнёрстве с AMD, Broadcom, Intel, Microsoft и NVIDIA анонсировала технологию Multipath Reliable Connection (MRC) — сетевой протокол, призванный повысить производительность и отказоустойчивость масштабных GPU-кластеров, ориентированных на ресурсоёмкие задачи ИИ. MRC уже используется во всех крупных кластерах OpenAI c NVIDIA GB200, в том числе в первом ЦОД Stargate, а также в ЦОД Microsoft по проекту Fairwater. Отмечается, что при обучении больших языковых моделей (LLM) каждый этап предполагает огромное количество пересылок данных между узлами в кластере. При этом единственная задержка при подобных транзакциях может повлиять на весь процесс, потенциально провоцируя простои тысяч ИИ-ускорителей. Такие прерывания приводят к снижению эффективности использования имеющихся вычислительных мощностей и к увеличению временных затрат. Наиболее распространёнными причинами задержек и нестабильности при передаче данных являются перегрузка сети, сбои в работе каналов связи и коммутационных устройств. Причём по мере увеличения масштабов кластеров проблемы усугубляются: неполадки возникают всё чаще, а их устранение становится более затруднительным. Протокол MRC, как утверждается, устраняет ряд ключевых недостатков сетей Ethernet применительно к инфраструктурам ИИ. В частности, вводятся такие механизмы, как адаптивная многопутевая передача данных, многоканальные перекрёстные Ethernet-фабрики, «распыление» пакетов, быстрое восстановление после сбоев и пр. MRC коренным образом меняет способ передачи трафика по сети. Традиционные платформы RoCE обычно привязывают поток данных к одному сетевому пути, что может снижать эффективность при возникновении неполадок. MRC же распределяет пакеты из одной серии одновременно по сотням путей и нескольким физическим сетевым каналам. В пакетах содержатся сведения об их конечном назначении, что позволяет ускорителям размещать данные в нужной последовательности, даже если пакеты поступают не по порядку. MRC хранит информацию о состоянии множества используемых путей: если обнаруживается перегрузка какого-либо из них, выбирается альтернативный маршрут, что позволяет оперативно перераспределить нагрузку по всей сети. Ещё одной важной особенностью MRC является многоуровневая архитектура, которая изменяет саму физическую концепцию построения интерконнекта. Так, например, сетевой интерфейс 800GbE может быть разделён на 100GbE-каналы, связанные с восемью различными коммутаторами отдельными каналами. В результате можно построить восемь отдельных параллельных сетей. Такой подход оказывает значительное влияние на структуру кластера. В частности, коммутатор c 64 портами 800GbE можно использовать в конфигурации на 512 × 100GbE. И это позволяет построить сеть, объединяющую около 131 тыс. GPU, используя всего два уровня коммутации, против традиционных трёх- или четырёхуровневых топологий. В протоколе MRC также используется новый способ обработки перегрузок и потери пакетов в сетях Ethernet. Обычно применяется технология PFC (Priority Flow Control) — управление потоками на основе приоритетов: этот механизм предполагает приостановку передачи данных для конкретных классов трафика, а не для всего порта целиком. В случае MRC задействован иной подход, основанный на выборочных подтверждениях, явных запросах на повторную передачу и обрезке пакетов. Так, когда коммутатор сталкивается с перегрузкой, он может отрезать полезную нагрузку и переслать в пункт назначения только заголовок пакета, что позволяет получателю быстро идентифицировать отсутствующие данные и запросить повторную передачу. Утверждается, что это даёт возможность восстанавливаться после сбоев и перегрузок в течение микросекунд, что на порядки быстрее по сравнению с обычными архитектурами. С внедрением MRC сокращается необходимость в динамической маршрутизации. Если пакеты теряются на каком-либо пути, система на основе MRC просто перестаёт использовать этот путь. Вместо динамической маршрутизации применяется так называемая сегментная маршрутизация IPv6 (IPv6 Segment Routing, SRv6), которая позволяет отправителю напрямую задать путь прохождения пакета, прописав последовательность идентификаторов коммутаторов. При пересылке данных коммутатор проверяет наличие собственного идентификатора. Если он присутствует, он удаляет из пакета свой идентификатор и ищет следующий за ним идентификатор в статической таблице маршрутизации, которая указывает, куда необходимо отправить пакет данных. В отличие от динамической маршрутизации, такая статическая таблица формируется при первой настройке коммутатора и в дальнейшем не изменяется. MRC использует SRv6 для передачи пакетов по всем физическим каналам и уровням, а также по множеству путей в каждом из них. Если какой-либо путь становится недоступен, система игнорирует его. При этом коммутаторам не нужно пересчитывать маршруты или выполнять другие действия, кроме как строго следовать статическим маршрутам, заложенным в таблице. Протокол MRC выпущен в рамках проекта OCP. В целом, как отмечается, MRC обеспечивает три ключевых преимущества перед стандартными Ethernet-сетями для кластеров ИИ. Во-первых, MRC позволяет создавать многоуровневые высокоскоростные инфраструктуры для платформ с более чем 131 072 конечных точек, используя всего два уровня коммутаторов. Во-вторых, адаптивное распределение пакетов обеспечивает эффективную балансировку нагрузки, благодаря чему практически отсутствуют перегрузки в ядре сети. В-третьих, применение SRv6 обеспечивает быстрый обход сбоев и отправку пакетов только по работающим путям. Компания Broadcom заявила, что её сетевые адаптеры Thor Ultra, а также коммутаторы Tomahawk 5 и Tomahawk 6 изначально поддерживают функциональность MRC. В частности, Thor Ultra позволяет использовать 2, 4 или 8 параллельных сетей на одном порту и распределять трафик одновременно по 128 каналам. При этом Tomahawk 5 обеспечивает коммутационную способность до 51,2 Тбит/с, а Tomahawk 6 — до 102,4 Тбит/с. В свою очередь, NVIDIA отмечает, что протокол MRC, будучи расширением RoCE, совместим с решениями Spectrum-X Ethernet. OpenAI уже использовала MRC при обучении нескольких ИИ-моделей, задействовав коммутаторы Broadcom и NVIDIA. Конкуренцию MRC составляет схожий во многих аспектах Ultra Ethernet.

07.05.2026 [00:55], Владимир Мироненко

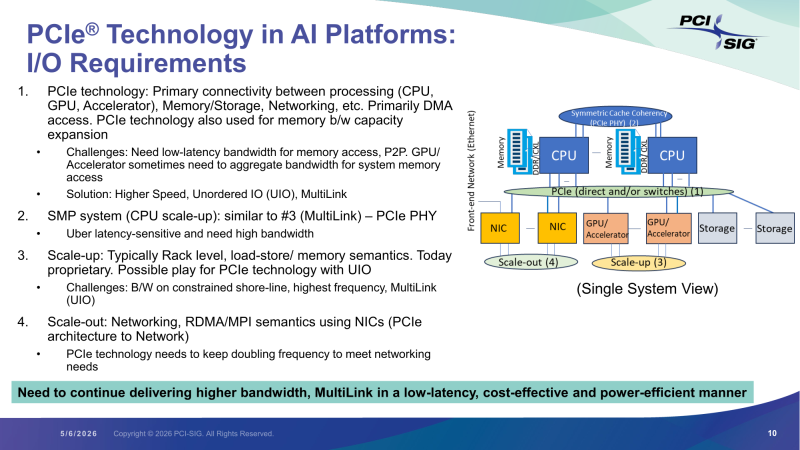

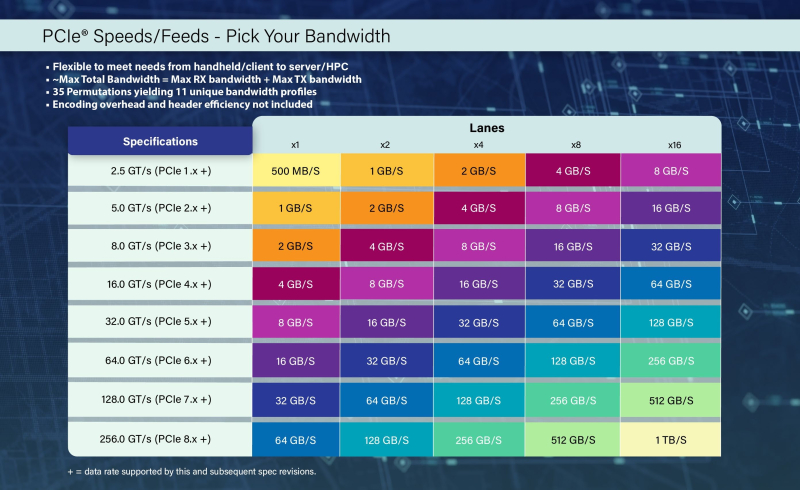

1 Тбайт/с на x16: PCI-SIG раньше срока предоставила спецификации PCI Express 8.0 версии 0.5Некоммерческая организация PCI-SIG объявила о выходе версии 0.5 стандарта PCIe 8.0, которую предоставили отраслевым партнёрам раньше запланированного срока. Это официальный первый вариант спецификации PCIe 8.0, включающий отзывы о прошлогоднем выпуске стандарта 0.3. Как ожидается, стандарт будет полностью готов к 2028 году, что значительно повысит производительность шины PCIe. PCIe 8.0 должен увеличить пропускную способность в два раза по сравнению с PCIe 7.0, который в свою очередь в два раза превосходит по скорости актуальную версию стандарта — PCIe 6.0. Серверные процессоры AMD и Intel получат поддержку PCIe 6.0, и в планы обеих компаний уже включена реализация в будущем стандарта PCIe 7.0. В свою очередь, PCI-SIG стремится выпустить PCIe 8.0 до того, как отрасли потребуется ещё более высокая пропускная способность, что позволит рынку строить дальнейшие планы развития с учётом требований PCIe. Цели спецификации PCIe 8.0:

23.04.2026 [22:49], Владимир Мироненко

Cisco представила прототип универсального квантового коммутатораCisco Systems представила прототип универсального сетевого коммутатора для квантовых систем Cisco Universal Quantum Switch, позволяющий соединять квантовые компьютеры разных производителей, а также квантовые датчики различных типов в единую когерентную сеть, путём перемещения запутанных фотонов с сохранением их квантового состояния. Устройство преобразует все основные режимы квантовой запутанности и кодирования и работает при комнатной температуре, на телекоммуникационных частотах, по стандартному оптоволоконному кабелю, не требует криогенной среды или специальной инфраструктуры. Исследователи и предприятия уже используют квантовые компьютеры в качестве дополнительных сопроцессоров для решения конкретных, математически сложных задач, которые недоступны для классических суперкомпьютеров. Одна из самых актуальных проблем, стоящих перед квантовыми вычислениями, связана с масштабированием. Большинство квантовых систем могут взаимодействовать с другими системами, использующими только тот же режим кодирования. Для того чтобы получить систему на миллионы кубитов, что необходимо для обеспечения научных прорывов, нужно или изыскать возможность создания более крупных и мощных квантовых компьютеров или найти способ соединения вместе нескольких квантовых компьютеров, возможно, от разных вендоров, подобно тому, как классические компьютеры соединяются в ЦОД, чтобы они функционировали как единое целое. Cisco выбрала второй путь. Универсальный коммутатор использует запатентованную Cisco систему преобразования, которая преобразует различные режимы кодирования, используемые различными квантовыми технологиями на входе и выходе. Квантовые системы в основном используют четыре основных метода кодирования: поляризационное, временное, частотное и траекторное, и они используют различные схемы запутанности поверх них. Универсальный квантовый коммутатор Cisco разработан для поддержки всех четырёх модальностей и динамически переключается между ними, позволяя системам с различными физическими архитектурами взаимодействовать без изменения их работы. Cisco заявила, что на данный момент система протестирована с поляризацией, которая использует ориентацию фотонов для передачи информации. Как отметил ресурс SiliconANGLE, преобразование модальностей обеспечивает реальную гетерогенность как для квантовых компьютеров, так и для квантовых датчиков. Квантовый процессор на основе нейтральных атомов может взаимодействовать с квантовым процессором на основе захваченных ионов, который, в свою очередь, может взаимодействовать с фотонным датчиком или сенсором на основе нейтральных атомов через тот же коммутатор. Квантовые ЦОД и сети квантовых датчиков, построенные таким образом, могут развиваться и интегрировать новые технологии по мере их появления, не будучи ограниченными единым стандартом модальности или архитектурой. В настоящее время квантовая индустрия развивается в нескольких направлениях. Производители создают различные типы квантовых систем, и на данный момент неизвестно, какой аппаратный подход и метод кодирования будет преобладать, и какая экосистема станет доминирующей. Поэтому создание универсального коммутатора крайне важно. Коммутатор Cisco Universal Quantum Switch разработан с учётом реальных условий ЦОД, с целью интеграции в уже существующую инфраструктуру. За пределами ЦОД, по словам Cisco, текущая дальность действия коммутатора составляет до 100 км, хотя утверждается, что со временем расстояние перестанет быть ограничивающим фактором. Компания отметила, что коммутатор является частью масштабной инициативы Cisco Quantum Labs по созданию квантовых сетей, охватывающей все уровни — от чипов и протоколов до приложений. В прошлом году Cisco представила прототип специализированного сетевого квантового чипа для генерации запутанных фотонов, позволяющий масштабировать квантовые системы, объединяя квантовые процессоры в единую инфраструктуру.

20.04.2026 [17:38], Владимир Мироненко

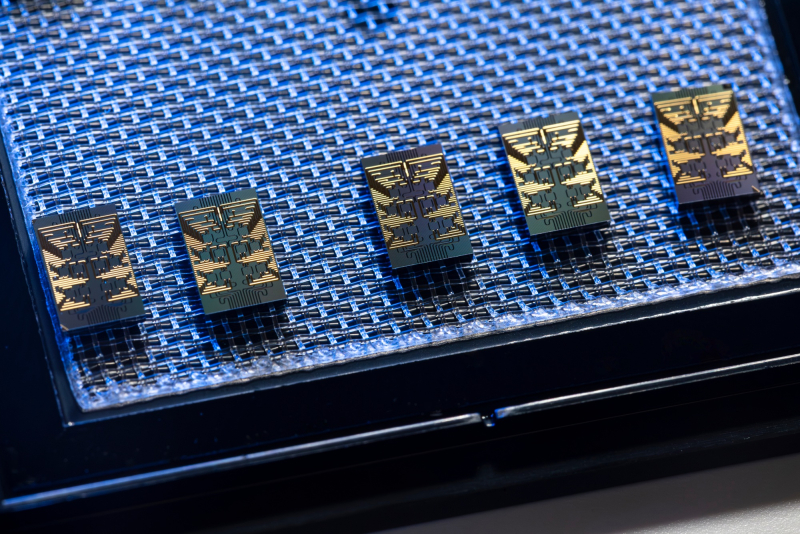

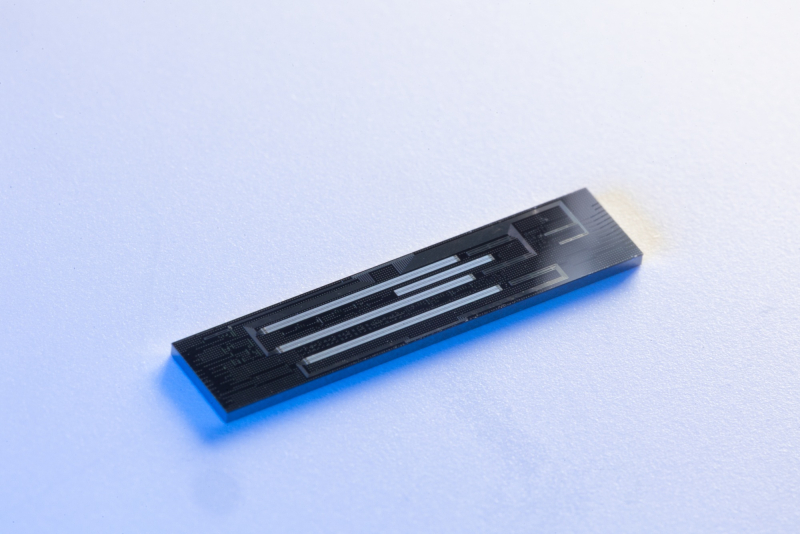

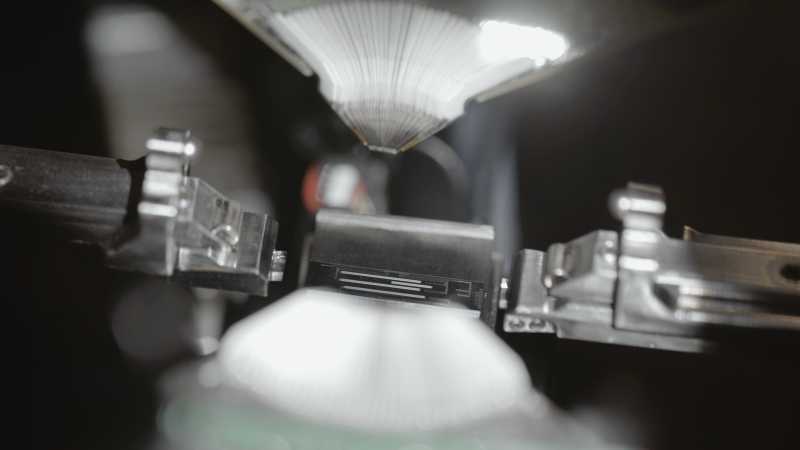

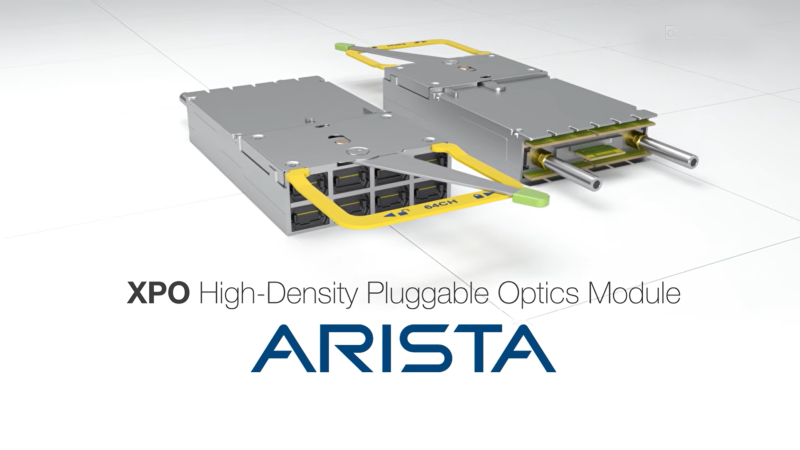

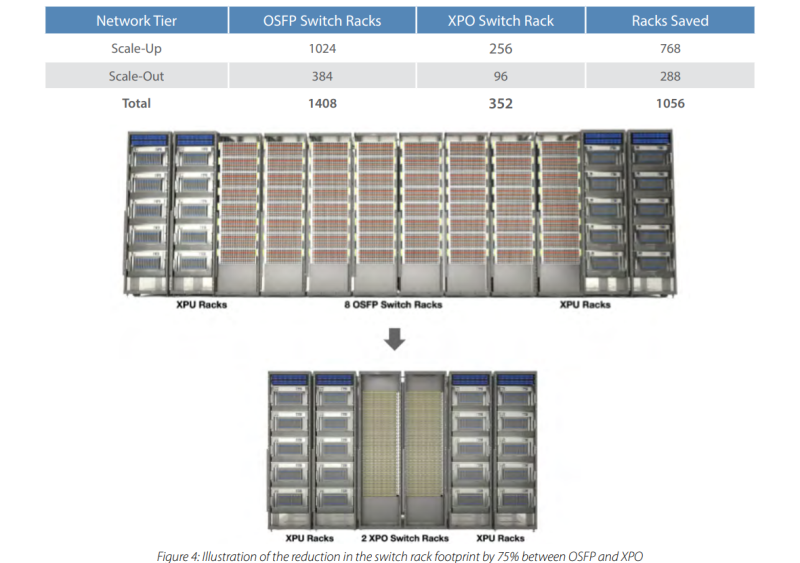

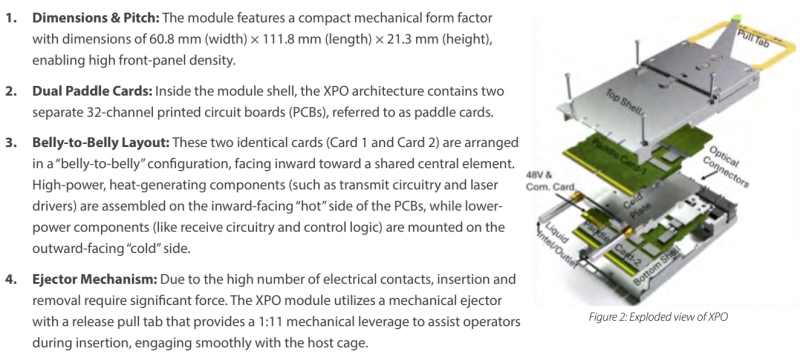

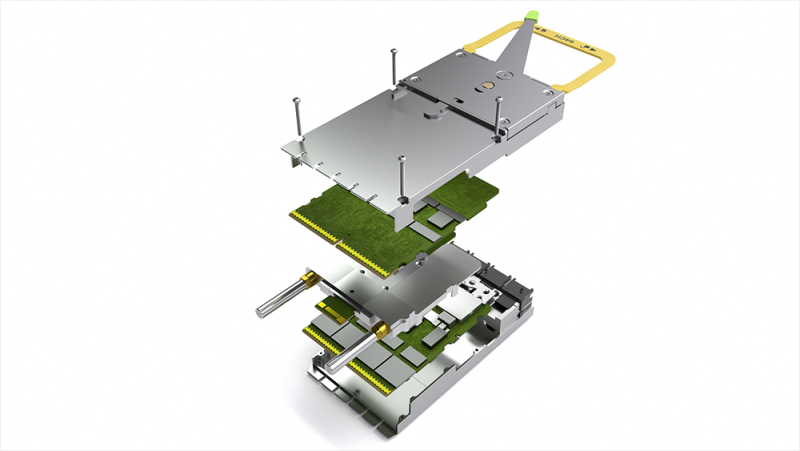

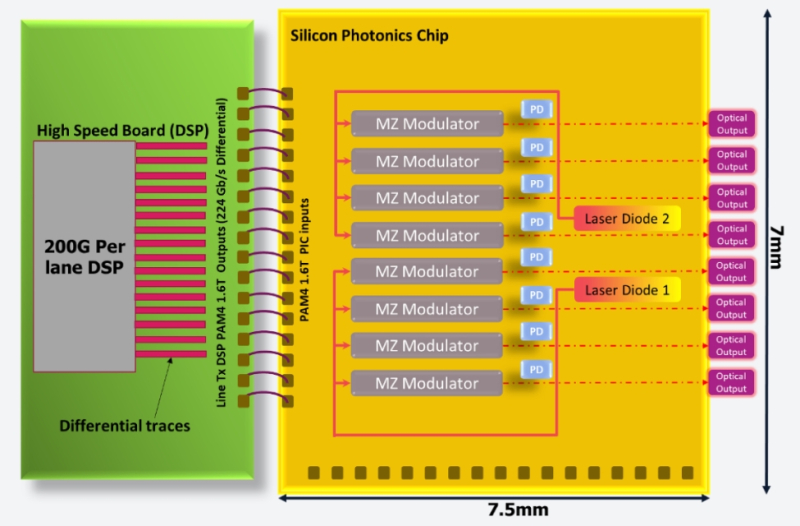

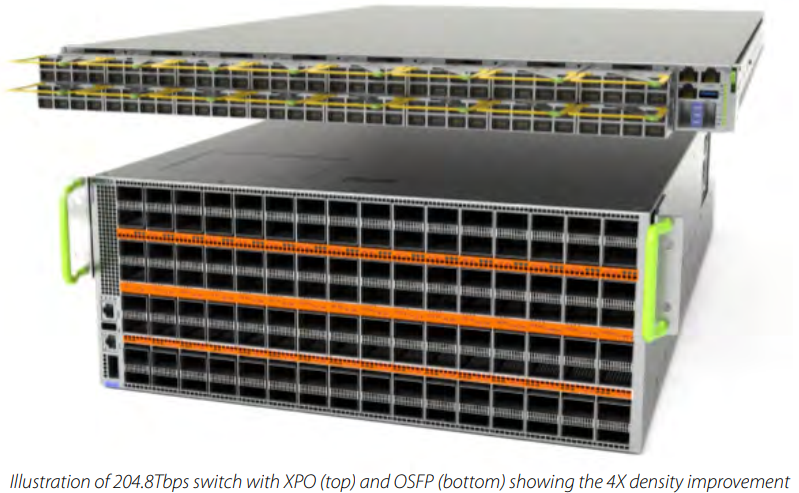

Ещё капельку: XPO-модули повысят плотность сетей в ИИ ЦОД, но CPO всё равно не избежатьЭкосистема XPO (eXtra-dense Pluggable Optics) набирает обороты после презентации на OFC 2026, поскольку производители объединяются вокруг нового формата подключаемых 12,8-Тбит/с модулей, разработанного для ИИ-инфраструктуры, сообщил ресурс Converge Digest. Инициатива, возглавляемая Arista Networks и поддерживаемая растущей группой поставщиков оптических и кремниевых компонентов, ориентирована на следующее поколение ИИ-кластеров, где плотность портов, полоса пропускания и тепловые ограничения будут основными факторами, ограничивающими производительность. Модуль XPO помещает 64 200G-канала (224 Гбит/с PAM4) в то же пространство, что и два модуля OSFP. В 1OU помещается 16 модулей XPO, что даёт 204,8 Тбит/с на юнит или 6,5 Пбит/с на ORv3-стойку. Это примерно вчетверо больше в сравнении 1.6T-модулями OSFP 1,6T, сообщил ресурс The Next Platform. XPO поддерживает интегрированное жидкостное охлаждение (водоблок), позволяет использовать любые типы оптики, а также предлагает значительное повышение отказоустойчивости. XPO поддерживает оптические стандарты SR, DR, FR, LR и ZR/ZR+, а также совместим с LPO. По словам Андреаса Бехтольсхайма (Andreas Bechtolsheim), соучредителя и главного архитектора Arista, в ИИ ЦОД мощностью 400 МВт с 1024 стойками, в каждой из которых размещено по 128 GPU, из расчёта 12,8 Тбит/с на вертикальное масштабирование и 1,6 Тбит/с для горизонтального масштабирования на каждый GPU при использовании коммутаторов с OSFP плотностью 1,6 Пбит/с на стойку потребуется более 1400 стоек. XPO позволит сократить количество стоек на 75 %, попутно сэкономив 44 % площади ЦОД. Бехтольсхайм отметил, что крупные ИИ ЦОД будут охлаждаться жидкостью, и коммутаторы, используемые в них, также должны изначально поддерживать СЖО. Он допустил, что можно добавить охлаждающие пластины с жидкостным охлаждением на модули OSFP с плоской верхней панелью, но это не улучшит существенно тепловые характеристики. В случае XPO водоблок интегрируется внутрь модуля и способен отводить более 400 Вт как от маломощных, так и высокопроизводительных модулей, таких как 8×1.6T-ZR/ZR+, утверждает Бехтольсхайм.  Еще одно дополнительное преимущество заключается в том, что при жидкостном охлаждении компонентов XPO они работают с температурой на 20–25 °C ниже в ZR-модуле на 12,8 Тбит/с, чем в модуле OSFP-ZR на 1,6 Тбит/с с воздушным охлаждением. Кроме того, модули XPO конструктивно значительно проще, чем модули OSPF, что также повышает надёжность. «Каждая 32-канальная плата имеет только один микроконтроллер и один набор преобразователей напряжения, что на 75 % меньше общих компонентов по сравнению с четырьмя модулями OSPF», — сообщил Бехтольсхайм. Вместе с тем повышение плотности размещения ведёт и к повышению энергопотребления. По оценкам Arista, 1,6-Пбит/с стойка с OSFP потребляет порядка 32 кВт, тогда как 6,5-Пбит/с XPO-стойка требует уже 128 кВт. Однако XPO-модули рассчитаны на питание 48/50 В DC непосредственно от общей шины всей стойки и уже сами отдают трансиверам 3,3 В, что способствуют упрощению всей конструкции, повышению компактности и снижению энергопотерь. Arista объявила о заключении многостороннего соглашения (MSA) на поставку XPO, к которому присоединились около 45 ведущих поставщиков оптических модулей, включая Lightmatter, Eoptolink Technology и TeraHop. Ожидается, что серийное производство XPO начнётся в 2027 году. Впрочем, XPO можно рассматривать как временное решение до начала действительно массового внедрения интегрированной оптикой (CPO).

17.04.2026 [14:21], Сергей Карасёв

IonQ разработала фотонный интерконнект для объединения квантовых компьютеровКомпания IonQ, занимающаяся разработкой квантовых платформ, объявила о создании фотонного интерконнекта, предназначенного для объединения квантовых компьютеров в единый вычислительный кластер. Это, как утверждается, основополагающее техническое достижение, которое в перспективе обеспечит возможность масштабирования квантовых систем. В ходе демонстрации IonQ установила связь между двумя удаленными квантовыми компьютерами на основе захваченных ионов. В таких установках в качестве кубитов используются ионы, удерживаемые в вакууме электромагнитными полями. Комплексы данного типа отличаются высокой стабильностью и точностью операций, говорит компания. Объединив две квантовые системы, IonQ впервые подтвердила возможность генерации, передачи и детектирования фотонов, служащих для обеспечения квантовой запутанности. При этом сохраняется когерентность, необходимая для сложных квантовых операций. Предложенное решение открывает путь для создания квантовых вычислительных кластеров большой мощности, способных выполнять сложнейшие задачи. «Масштабирование квантовых вычислений за пределы возможностей одного чипа имеет большое значение для реализации будущего квантового интернета. Эта демонстрация доказывает, что наша платформа на основе захваченных ионов подходит для формирования систем, предназначенных для решения самых сложных глобальных проблем», — говорит Никколо де Маси (Niccolo de Masi), генеральный директор IonQ. Разработкой технологий для объединения квантовых компьютеров занимаются и другие компании. В частности, стартап CavilinQ намерен создать фотонные каналы связи с усилением на базе резонаторов, которые позволят отдельным квантовым процессорам работать сообща в составе кластеров. На реализацию проекта фирма CavilinQ получила $8,8 млн в ходе посевного раунда финансирования.

15.04.2026 [21:40], Владимир Мироненко

Credo купила израильского разработчика кремниевой фотоники DustPhotonicsCredo Technology Group Holding объявила о достижении соглашения о приобретении израильского стартапа в области кремниевой фотоники DustPhotonics, разработчика технологии кремниевых фотонных интегральных схем (SiPho PIC) для оптических трансиверов. В результате сделки Credo получит вертикально интегрированный стек решений, охватывающий SerDes, цифровую обработку сигналов (DSP), кремниевую фотонику и системную интеграцию для масштабируемых и расширяемых сетей, что позволит решить проблемы электрических и оптических интерконнектов для всей ИИ-инфраструктуры. Согласно условиям соглашения, Credo приобретает DustPhotonics за $750 млн наличными и приблизительно 0,92 млн акций обыкновенного акционерного капитала на сумму около $124 млн. Также сделка предусматривает выплату дополнительного вознаграждения в размере до 3,21 млн акций на сумму около $430 млн в зависимости от достижения определённых финансовых показателей, пишет Siliconangle. В итоге сумма сделки может составить около $1,3 млрд. Закрытие сделки ожидается во II квартале 2026 года при условии получения необходимых разрешений регулирующих органов. Приобретение DustPhotonics позволит Credo ускорить разработку линейки оптических интерконнектов и значительно расширить целевой рынок. В DustPhotonics работает около 70 инженеров. Портфель компании включает технологии кремниевой фотоники для оптических трансиверов, работающих на скоростях 400G, 800G и 1.6T, с перспективой освоение 3.2T. Интеграция ключевых оптических функций на одном чипе позволяет снизить сложность изделия, повысить выход годных изделий и обеспечить существенное снижение затрат по мере увеличения скорости портов. В совокупности эти факторы повышают надёжность ИИ-кластеров, что является критически важным фактором для операторов ЦОД. SiPho PIC используются в трансиверах ИИ-кластеров ведущих гиперскейлеров, а также разрабатываются для ведущих приложений Near Port Optics (NPO) и Co-Packaged Optics (CPO). Credo отметила, что технология SiPho PIC является основополагающим компонентом её платформы оптических трансиверов ZeroFlap (ZF). Внедрение этой технологии собственными силами снижает зависимость от внешних поставок, ускоряет циклы разработки продукции и открывает путь к существенному улучшению структуры затрат при массовом производстве. В сочетании с интеллектуальной собственностью и продуктами Credo в области SerDes и DSP приобретение создаёт комплексную платформу решений для оптической связи. Credo ожидает, что её объединённый портфель оптических трансиверов ZeroFlap, оптических DSP и продуктов на основе кремниевой фотоники принесёт более $500 млн от оптических решений в 2027 финансовом году. Согласно оценкам LightCounting и Credo, рынок SiPho PIC вырастет до $6 млрд к 2030 году. На сегодняшний день DustPhotonics привлекла около $150 млн инвестиций. В числе её инвесторов Авигдор Вилленц (Avigdor Willenz), Intel Capital, WRVI Capital, Greenfield Partners, Sienna Venture Capital, Atreides Management LP и Exor Ventures. «Объединение усилий с DustPhotonics знаменует собой определяющий шаг в стратегии Credo по лидерству во всём спектре возможностей подключения ИИ… мы создаём вертикально интегрированную платформу, охватывающую все этапы — от медных проводников до оптических и от чипов до кластеров, что это позволяет нам решить две наиболее важные задачи в масштабе: надёжность и энергоэффективность», — сообщил глава Credo.

14.04.2026 [12:44], Владимир Мироненко

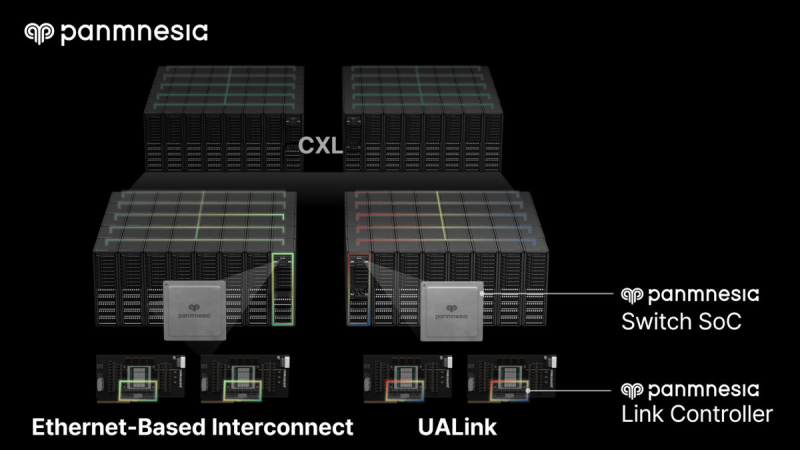

Panmnesia привлёк $10 млн на разработку интерконнекта следующего поколения для ИИ ЦОДЮжнокорейский стартап Panmnesia, специализирующийся на разработке интерконнекта для ИИ-инфраструктур, сообщил о получении финансирования в размере около $10 млн на разработку интерконнекта следующего поколения для ИИ ЦОД. Проект включает разработку контроллеров и коммутаторов на основе открытых стандартов, таких как UALink и протоколов интерконнекта на основе Ethernet. Уже имея обширный портфель продуктов CXL, Panmnesia теперь расширяет свою деятельность в области интерконнекта, ориентированного на ускорители. Компания отметила, что по мере распространения крупномасштабных ИИ-моделей в различных отраслях, ИИ ЦОД всё чаще полагаются на ИИ-ускорители разных вендоров. В этом контексте технологии интерконнекта, обеспечивающие высокоскоростную передачу данных между ускорителями, стали критически важным фактором, определяющим общую производительность ИИ-системы. Также Panmnesia планирует оптимизировать топологию разработанных устройств для ускорения обмена данными между ними и провести валидацию на уровне стойки. Ожидается, что чип-коммутатор с поддержкой интерконнекта, ориентированного на ускорители, такого как UALink, станет доступен во II половине 2027 года. Портфолио продуктов CXL компании включает комплексные решения, в том числе контроллеры и IP-блоки PCIe/CXL, аппаратные SoC, такие, как коммутаторы PCIe/CXL, и специализированные кремниевые решения. В прошлом году Panmnesia представила архитектуру CXL-over-XLink, которая интегрирует специализированные каналы связи для ускорителей (известные как XLink), включая UALink, с CXL для обеспечения расширенной связи в крупных ИИ ЦОД.

08.04.2026 [17:29], Владимир Мироненко

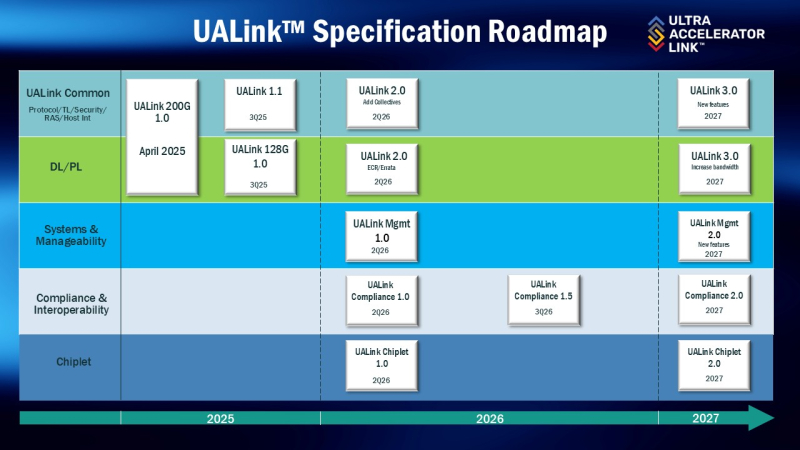

Интерконнект UALink дорос до версии 2.0, хотя до сих пор не воплотился в «железе» — до NVLink ещё далекоКонсорциум UALink, созданный в 2024 году для разработки открытого интерконнекта для масштабируемого ИИ следующего поколения, который может стать альтернативой NVLink и NVSwitch от NVIDIA, объявил о ратификации следующей версии спецификации UALink 2.0, которая включает три основных дополнения — внутрисетевые вычисления (In-Network Compute), определение чиплетов (Chiplet Definition) и управляемость (Manageability). Как указано в пресс-релизе, «новые спецификации поддерживают развёртывание решений UALink в средах с несколькими рабочими нагрузками, одновременно способствуя повышению эффективности технологии UALink, производительности для рабочих нагрузок ИИ и упрощению внедрения». Базовая скорость обмена данными (200G на линию) не изменилась. Более того, до сих пор нет и оборудования стандарта UALink 1.0, представленного год назад. «Усовершенствования технологии UALink, представленные в этом релизе, позволят отрасли быстро и эффективно интегрировать решения UALink в свои архитектуры. Консорциум UALink по-прежнему привержен развитию инфраструктуры ИИ посредством открытых отраслевых стандартов, которые облегчают вывод на рынок приложений ИИ следующего поколения», — заявил Куртис Боуман (Kurtis Bowman), председатель совета директоров консорциума UALink. Консорциумом были представлены:

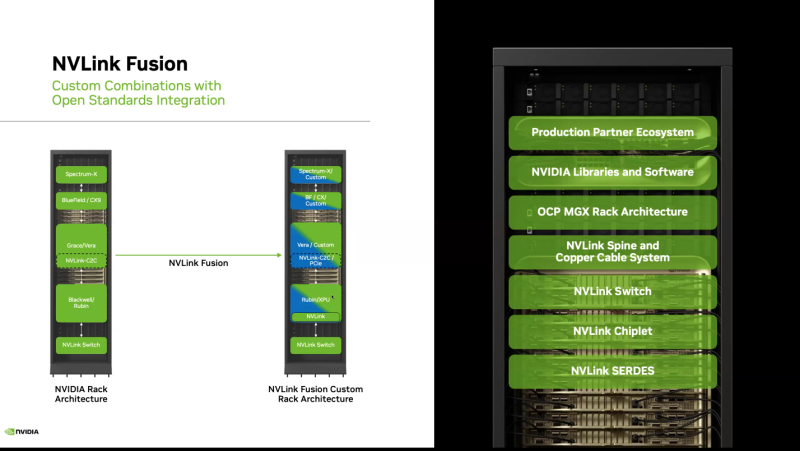

Боуман сообщил The Register, что чипы для спецификации 1.0 поступят в лаборатории во II половине 2026 года и появятся в продаже в 2027 году. К тому времени UALink выпустит спецификации версии 3.0 — задолго до дебюта чипов версии 2.0. Боуман признал, что версии 1.0 и 2.0 не будут полноценными конкурентами интерконнекту NVIDIA, но к версии 3.0, которая появится примерно через год, UALink достигнет паритета по производительности и темпам выпуска стандартов. Консорциум UALink стремится создать альтернативу интерконнекту NVIDIA, которая будет работать с любым ускорителем и соответствовать его уровню производительности. Консорциум считает, что развивающиеся неооблачные платформы, специализирующиеся на размещении ИИ-систем, оценят возможность создания единого интерконнекта с поддержкой любых используемых ими GPU, отметил The Register. Между тем NVIDIA не стоит на месте. В прошлом году она представила технологию NVIDIA NVLink Fusion, которая расширяет доступ к NVLink сторонним чипам. Компания уже заключила соглашения с Arm, AWS, Fujitsu, Intel, Marvell, MediaTek и SiFive. AMD же делает ставку на UALink.

04.04.2026 [14:33], Сергей Карасёв

Стартап CavilinQ получил $8,8 млн на разработку квантового интерконнекта для объединения квантовых компьютеровСтартап CavilinQ, специализирующийся на квантовых технологиях, объявил о проведении посевного (Seed) раунда финансирования, в ходе которого привлечено $8,8 млн. Инвестиционную программу возглавила компания QVT при участии Safar Partners, MFV Partners, Serendipity Capital и Harper Court Ventures. CavilinQ занимается разработкой квантового интерконнекта, который, как ожидается, позволит масштабировать вычислительные платформы на основе квантовых компьютеров. Соучредителями стартапа являются Брэндон Гринкемейер (Brandon Grinkemeyer, на фото слева), который занимает пост технического директора, а также Шанкар Менон (Shankar Menon) — генеральный директор фирмы. Стартап отмечает, что индустрия квантовых вычислений, несмотря на активное развитие, сталкивается с рядом препятствий. Одним из них является проблема масштабируемости, не позволяющая объединять отдельные квантовые процессоры в более крупные системы для повышения производительности. Для устранения этого ограничения CavilinQ намерена разработать фотонные каналы связи с усилением на базе резонаторов, которые позволят отдельным квантовым процессорам работать сообща в составе кластеров. На первом этапе такой интерконнект планируется адаптировать для квантовых платформ на основе нейтральных атомов. В дальнейшем может быть обеспечена совместимость с квантовыми компьютерами других типов. Ожидается, что технология CavilinQ позволит увеличить скорость передачи данных в сети на несколько порядков по сравнению с альтернативными квантовыми решениями. Привлечённые в рамках посевного раунда средства будут направлены на создание специализированной лаборатории в Кембридже (Массачусетс, США), расширение команды и демонстрацию ключевых возможностей технологии.

31.03.2026 [20:09], Владимир Мироненко

NVIDIA инвестировала $2 млрд в Marvell, приобщив её к своей ИИ-экосистеме и NVLink FusionАкции Marvell Technology подскочили более чем на 9 % на предрыночных торгах после объявления NVIDIA об инвестициях в размере $2 млрд в рамках стратегического партнёрства с интеграцией решений Marvell в экосистему NVIDIA. Это позволит Marvell подключиться к ИИ-фабрике NVIDIA и экосистеме AI-RAN посредством NVIDIA NVLink Fusion, предоставляя клиентам, использующим архитектуры NVIDIA, больший выбор и гибкость при разработке инфраструктуры следующего поколения. Marvell предоставит клиентам специализированные XPU и масштабируемые сетевые решения, совместимые с NVLink Fusion, а NVIDIA — вспомогательные технологии, включая процессоры Vera, сетевые решения ConnectX и Bluefield, интерконнект NVLink и коммутаторы Spectrum-X, а также вычислительные ИИ-мощности в стоечном исполнении. Для клиентов, разрабатывающих специализированные XPU, NVLink Fusion предлагает гетерогенную ИИ-инфраструктуру, полностью совместимую с системами NVIDIA, обеспечивая бесшовную интеграцию с платформами NVIDIA GPU, LPU, сетевыми и СХД-платформами, используя технологический стек NVIDIA и глобальную экосистему поставок. Ранее NVIDIA заключила похожие соглашения в отношении NVLink с SiFive, AWS, Arm, Fujitsu, Intel и MediaTek. Компании также будут сотрудничать в ключевых областях, таких как кремниевая фотоника и телекоммуникационные сети с целью преобразования сетей в инфраструктуру ИИ с помощью NVIDIA Aerial AI-RAN для 5G/6G и развития передовых решений для оптического интерконнекта. «Вместе с Marvell мы даём клиентам возможность использовать экосистему ИИ-инфраструктуры NVIDIA и масштабировать её для создания специализированных вычислительных ИИ-мощностей», — заявил гендиректор NVIDIA Дженсен Хуанг (Jensen Huang). Эта сделка является частью более широкой стратегии NVIDIA по инвестированию в ИИ-экосистему с целью укрепления своего лидерства на ИИ-рынке. Недавно NVIDIA инвестировала аналогичные суммы в несколько компаний, включая Synopsys, Nokia, CoreWeave, Coherent, Lumentum и Nebius, тем самым укрепляя свое влияние по всей цепочке создания стоимости. Таким образом NVIDIA стремится удовлетворить экспоненциальный рост спроса на вычислительные мощности, обусловленный ИИ-инференсом и генерацией контента. Используя стратегические партнёрства, NVIDIA намерена ускорить развёртывание специализированной инфраструктуры и обеспечить разработку необходимых технологий для роста сегмента. |

|