Материалы по тегу: qualcomm

|

27.05.2026 [17:25], Руслан Авдеев

ByteDance закупит ИИ-чипы Qualcomm и увеличит капзатраты до $70 млрдКомпания Qualcomm достигла соглашения с китайской ByteDance, предусматривающего выпуск и поставки чипов для ЦОД последней. Это важное достижение для Qualcomm, пытающейся расширить бизнес за пределы производства чипсетов для смартфонов и планшетов, сообщает Bloomberg. Кроме того, Qualcomm заключила договорилась о поставках ASIC с ещё одним неназванным американским облачным провайдером, дополняет DigiTimes. ByteDance намерена приобрести миллионы ИИ ASIC Qualcomm. По данным источников, это поможет владельцу социальной сети TikTok создавать и эксплуатировать агентный ИИ. После появления новостей акции Qualcomm подорожали на 8,3 % обновив дневной исторический максимум. Ранее компания заявила, что уже начала формировать очередь клиентов, желающих приобрести такие чипы. Qualcomm давно стремилась увеличить присутствие в индустрии ИИ-чипов, но главной проблемой был поиск клиентов на её продукцию соответствующего назначения. NVIDIA продолжает доминировать на рынке ИИ-полупроводников, хотя конкуренцию ей пытаются составить AMD, Broadcom и Google. Договор ByteDance поможет Qualcomm получить крупного покупателя и, следовательно, пропуск в один из наиболее быстро растущих сегментов полупроводниковой индустрии. Сегодня американская компания предлагает чипы при посредничестве TSMC, если те соответствуют американским экспортным ограничениям — нарушать санкционный режим даже ради контракта с ByteDance в Qualcomm не будут. По словам одного из источников, новая сделка поможет ByteDance превратить уже разработанный самостоятельно дизайн чипа в готовый к производству продукт. Ещё в 2024 году сообщалось, что ByteDance проектировала собственные ускорители, хотя об отказе от продукции NVIDIA речь не шла. Тем временем ByteDance наращивает расходы. Компания увеличила увеличит капитальные затраты до порядка $70 млрд, большая часть средств пойдёт на ИИ-инфраструкту, включая ЦОД и оборудование. ПО Doubao, предлагаемое компанией, аналогично ChatGPT, Claude и Gemini. Боьшую часть прошлого года, по данным Bloomberg Intelligence, это был самый загружаемый чат-бот в Китае. Вместе с тем ByteDance стремительно осваивает и китайский рынок облачных ИИ-сервисов.

02.05.2026 [23:32], Владимир Мироненко

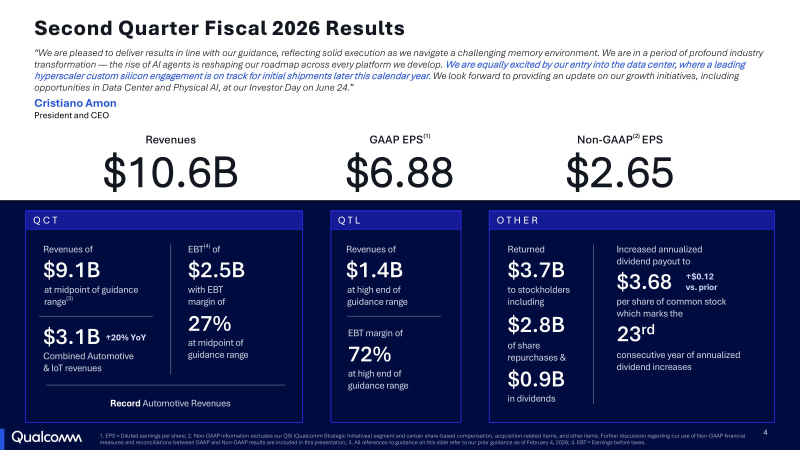

Qualcomm готовится поставлять чипы гиперскейлеру — инвесторы довольны, поскольку на мобильном направлении не всё гладкоАкции Qualcomm выросли более чем на 15 % после сообщения компании о превышении прогнозов Уолл-стрит по прибыли и выручке во II квартале 2026 финансового года, а также заявления президента и гендиректора Кристиано Амона (Cristiano Amon) о планах начать поставки чипов для ЦОД «крупному гиперскейлеру» в течение календарного года, пишет SiliconANGLE. Выручка Qualcomm во II квартале 2026 финансового года, закончившемся 29 марта, составила $10,6 млрд, что на 3 % меньше, чем годом ранее, но чуть выше прогноза Уолл-стрит в размере $10,58 млрд. Компания сообщила о скорректированной прибыли на акцию в размере $2,65, что ниже показателя в $2,85 за тот же квартал прошлого года, но выше прогноза аналитиков в $2,55 на акцию. В полупроводниковом секторе (QCT) выручка увеличилась год к году на 4 % до $9,08 млрд. При этом выручка в автомобильном сегменте выросла на 38 % до $1,33 млрд, в сегменте IoT — на 9 % до $1,73 млрд, а в сегменте мобильных устройств упала на 13 % до $6,02 млрд. Выручка от лицензий (QTL) за квартал составила $1,38 млрд, что на 5 % больше, чем годом ранее. В III финансовом квартале Qualcomm прогнозирует скорректированную прибыль на акцию в размере от $2,10 до $2,30 при прогнозе Уолл-стрит $2,43. Прогноз по выручке тоже значительно ниже консенсус-прогноза аналитиков, опрошенных LSEG (по данным Reuters) — от $9,2 до $10 млрд при прогнозе в $10,27 млрд. Свой осторожный прогноз Qualcomm объяснила ограничениями поставок памяти и связанным с этим ценовым давлением на ряд производителей мобильных устройств. Компания добавила, что выручка от продаж мобильных телефонов китайским клиентам должна достичь минимума в III квартале и вернуться к последовательному росту в следующем квартале. Qualcomm ушла с рынка продуктов для ЦОД в 2018 году, чтобы сосредоточиться на своих разработках в области смартфонов, но в августе 2025 года сообщила, что находится на «ранних этапах» возвращения на рынок и ведёт переговоры с несколькими потенциальными клиентами. Гендиректор тогда также подтвердил, что компания ведёт «продвинутые переговоры с ведущим гиперскейлером». До этого, в мае 2025 года компания подписала меморандум о взаимопонимании с Humain и объявила о работе над серверным процессором, который будет поддерживать NVIDIA NVLink. Фактически после поглощения Nuvia компания не стала выходить на рынок ЦОД. А после долгих судебных разбирательств с Arm в связи с этой сделкой последняя фактически стала конкурентом Qualcomm и другим своим клиентам, взявшись за создание серверных CPU. С ИИ-ускорителями у компании всё тоже сложилось не очень удачно. Первое поколение широкого распространения не получило, но компания пообещала исправиться. При этом на рынке кастомных чипов для гиперскейлеров уже давно работают Broadcom и Marvell, у которых к тому же сильные компетенции в области сетевой инфраструктуры. Как пишет The Register, Кристиано Амон заявил, что компания планирует начать поставки чипов для ЦОД «ведущему гиперскейлеру» «в декабрьском квартале» и ожидает сотрудничество на несколько поколений чипов. По его словам, Qualcomm уже работает над процессором для ЦОД и высокопроизводительными ИИ-ускорителями для инференса, а также получила возможность создавать кастомные ASIC благодаря приобретению Alphawave в прошлом году за $2,4 млрд. «Мы работаем над специализированными ASIC, чего мы и хотели добиться, когда приобрели AlphaWave, — сказал Амон, — и теперь у нас есть много интеллектуальной собственности, позволяющей нам это сделать. Мы работаем над всеми тремя категориями чипов».  Амон рассказал, что Qualcomm также создала так называемый «выделенный процессор для агентских вычислений в ЦОД». По его словам, ИИ начинался с GPU для обучения, затем потребовалось специализированное оборудование для инференса, но сейчас рынок вступает в новую фазу, в которой важно «создать спрос на токены» для работы агентного ИИ. «Я думаю, что когда речь заходит об агентах, CPU становится очень важным», — сказал он, поэтому, по его словам, Qualcomm разработала именно такой чип. Кристиано Амон также прогнозирует появление «агентных смартфонов». Он привёл в качестве примера телефон ZTE, который включает в себя персонального помощника Doubao, разработанного ByteDance, и Xiaomi miclaw — ИИ-ассистента, интегрированного с ядром ОС, который анализирует запрос пользователя и определяет, какие приложения и функции смартфона нужно задействовать для его выполнения. Не исключено, что OpenAI может стать следующим крупным клиентом Qualcomm в сфере смартфонов, если генеральный директор Сэм Альтман (Sam Altman) реализует план выпустить устройство с ИИ в течение двух лет.

09.03.2026 [13:15], Сергей Карасёв

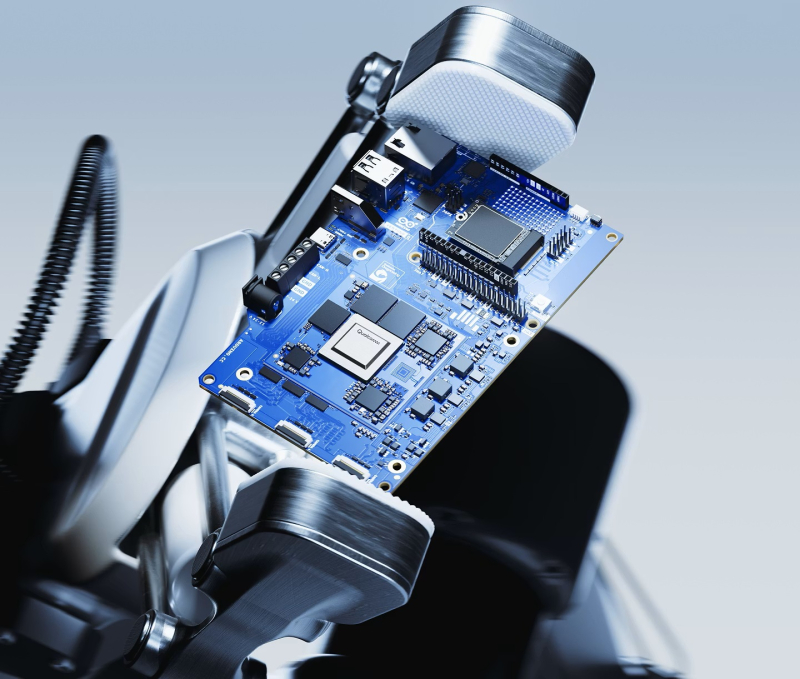

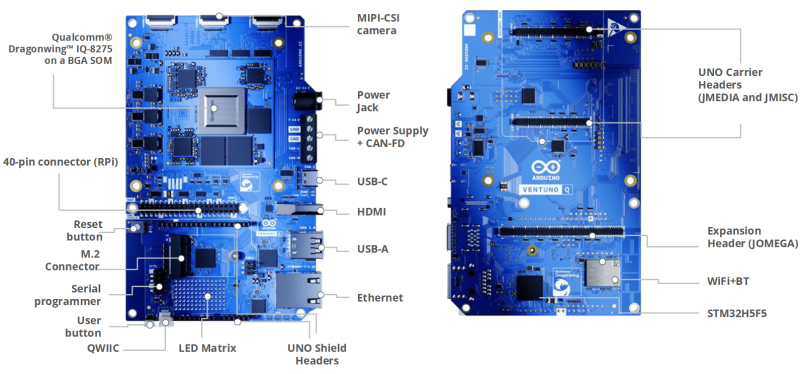

Arduino представила одноплатный компьютер Ventuno Q для ИИ-роботовУчастники проекта Arduino расширили ассортимент одноплатных компьютеров, анонсировав решение Ventuno Q: это старший собрат модели Uno Q, дебютировавшей в октябре прошлого года. Новинка предназначена для построения различных устройств с ИИ-функциями, таких как роботизированные платформы, системы машинного зрения, решения с распознаванием жестов и речи и пр. В основу Ventuno Q положен процессор Qualcomm Dragonwing IQ-8275. Чип содержит восемь вычислительных ядер Kryo с тактовой частотой до 2,35 ГГц, графический ускоритель Adreno 623 с поддержкой OpenGL ES 3.2, блок обработки изображений Spectra 690 и цифровой сигнальный процессор Hexagon. Заявленная ИИ-производительность достигает 40 TOPS. Говорится о возможности использования до 12 камер, двух дисплеев, памяти LPDDR5x-3200, интерфейсов USB 3.1, Ethernet и PCIe. В дополнение к процессору Dragonwing IQ-8275 задействован микроконтроллер реального времени STMicroelectronics STM32H5 на основе ядра Arm Cortex-M33 с частотой до 250 МГц, отвечающий за работу сенсоров, силовых приводов и пр. Основной процессор работает под управлением Ubuntu/Debian, тогда как микроконтроллер STM32H5 использует Arduino Core на базе Zephyr OS. Одноплатный компьютер несёт на борту 16 Гбайт LPDDR5, флеш-накопитель eMMC вместимостью 64 Гбайт, контроллеры Wi-Fi и Bluetooth, а также сетевой адаптер 2.5GbE. Кроме того, предусмотрен коннектор М.2 для дополнительного SSD. Реализованы интерфейсы MIPI-CSI (4 линии), MIPI-DSI, порты USB Type-C, USB Type-А и HDMI, а также 40-контактная колодка, совместимая с Raspberry Pi. Среди прочего упомянуты матрица светодиодов 13 × 8, коннекторы JMISC, JMEDIA и JOMEGA. Могут применяться модули Arduino Modulino, сенсоры Qwiic и платы Raspberry Pi Hat. В продажу Arduino Ventuno Q поступит во II квартале 2026 года. Приобрести одноплатный компьютер можно будет через магазин Arduino Store, а также через площадки реселлеров, включая DigiKey, Farnell, Macfos, Mouser и RS.

02.03.2026 [11:39], Сергей Карасёв

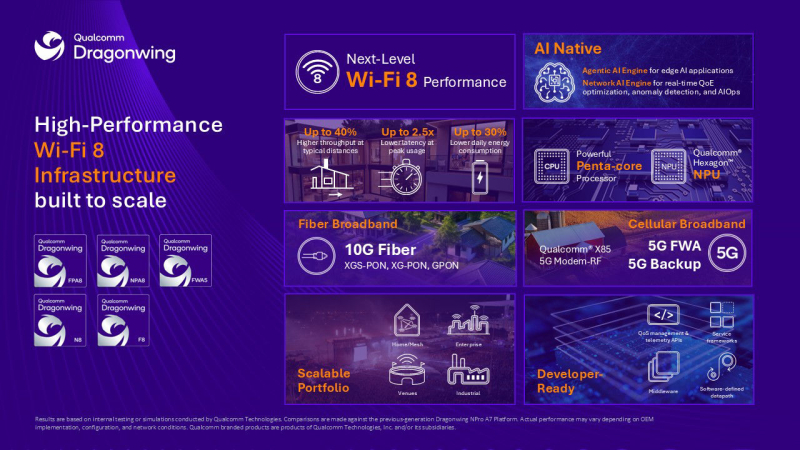

5G-платформа Qualcomm Dragonwing FWA Gen 5 Elite получила поддержку Wi-Fi 8 и встроенный ИИ-движокКомпания Qualcomm представила платформу Dragonwing FWA Gen 5 Elite, предназначенную для построения устройств, обеспечивающих фиксированный беспроводной доступ (FWA) в интернет через сотовую инфраструктуру. Решение рассчитано на работу в сетях 5G в диапазоне ниже 6 ГГц. В состав изделия входит модем Qualcomm X85 5G Modem-RF с поддержкой режима DSDA (Dual SIM Dual Active) — две активные SIM-карты. Пиковая скорость загрузки данных достигает 12,5 Гбит/с, скорость передачи информации в сторону базовой станции — 3,7 Гбит/с. Радиус доступности покрытия составляет до 14 км. Реализована поддержка TDD-TDD, FDD-FDD, FDDTDD, Dynamic Spectrum Sharing (DSS), LTE, LAA, GSM/EDGE, CBRS, 5G FDD, 5G TDD, 5G SA и 5G NSA, F + F ULCA, FDD UL MIMO. Платформа Dragonwing FWA Gen 5 Elite включает контроллер Wi-Fi 8 с частотными диапазонами 2,4, 5 и 6 ГГц. Кроме того, заявлена совместимость с Wi-Fi 7/6E/6/5/4 (стандарты 802.11bn/be/ax/ac/n/g/b/a). Упомянуты средства безопасности WPA3 Personal, WPA3 Enterprise, WPA3 Enhanced Open, WPA3 Easy Connect, WPA2, WPS, 802.11i security, PRNG, TKIP, WAPI2, WAPI1, WEP, шифрование AES-CCMP и AES-GCMP. Могут использоваться два сетевых порта 10GbE. Новинка получила движок Agentic AI Engine на основе нейропроцессорного модуля Qualcomm Hexagon NPU для выполнения ИИ-операций на периферии. Среди таких задач названы обеспечение безопасности, аналитика, автоматизация на основе данных об окружении, регистрация движений и пр. Заявлена совместимость с OpenWRT, RDK-B, prplOS.

02.03.2026 [11:36], Сергей Карасёв

Qualcomm представила Wi-Fi 8 платформу Dragonwing NPro A8 Elite с ИИ-движком и детектором передвижения людейКомпания Qualcomm анонсировала платформу Dragonwing NPro A8 Elite, предназначенную для построения беспроводных решений стандарта Wi-Fi 8 — высокопроизводительных точек доступа корпоративного класса и премиальных маршрутизаторов для домашнего использования. Изделие оснащено пятью вычислительными ядрами с тактовой частотой до 2 ГГц. Задействован движок Packet Processing Engine (PPE), спроектированный для сетей с ультравысокой пропускной способностью — в десятки Гбит/с. Кроме того, в оснащение входит нейропроцессорный модуль Qualcomm Hexagon NPU, обеспечивающий локальное выполнение ИИ-задач, таких как поддержание безопасности, аналитика, обнаружение движения и контекстно-ориентированная автоматизация. Заявлена поддержка Wi-Fi 4/5/6/6E/7/8 (стандарты IEEE 802.11a/b/g/n/ac/ax/be/bn/i/w/d/h/u/r/k/v/mc). Говорится о возможности использования частотных диапазонов 2,4, 5 и 6 ГГц. Кроме того, допускается работа в полосе 4,9 ГГц, которая предназначена для общественных служб безопасности (public safety) и критически важной инфраструктуры. Могут использоваться каналы на 320 МГц и до 20 антенн. Пиковое быстродействие достигает 33 Гбит/с; возможно обслуживание до 1500 клиентов одновременно. Реализованы функции шифрования AES-CCMP и AES-GCMP, а также средства безопасности WPA3 Enhanced Open, WPS, WPA2, WEP, TKIP, PRNG, WAPI2, WAPI1, 802.11i security, WPA3 Personal, WPA3 Enterprise и WPA3 Easy Connect. Упомянута технология 802.11az для отслеживания местоположения в сетях Wi-Fi. Вместе с тем инструмент Wi-Fi Sensing на базе стандарта 802.11bf позволяет Wi-Fi-устройствам функционировать в качестве датчиков для определения присутствия и количества людей, их перемещений и даже жестов. Платформа Dragonwing NPro A8 Elite даёт возможность использовать до шести Ethernet-портов в конфигурации 2 × 25GbE и 4 × 2.5GbE. Поддерживаются оперативная память DDR4/DDR5, флеш-память eMMC/NAND/NOR, интерфейсы USB 3.0, USB 2.0, UART, SPI, I2C, SDIO, GPIO. Возможности расширения включают 4G/5G FWA, 802.15.4 (Zigbee/Thread), Bluetooth. Версия платформы FiberPro A8 Elite также поддерживает XG(S)-PON/GPON,

23.02.2026 [14:14], Сергей Карасёв

Индустриальный компьютер OnLogic Factor 101 получил чип Qualcomm QCS6490 и порт 10GbEКомпания OnLogic анонсировала индустриальный компьютер небольшого формата Factor 101 (FR101), предназначенный для решения ИИ-задач на периферии — например, для организации машинного зрения. В основу новинки положена аппаратная платформа Qualcomm. Применён процессор Dragonwing QCS6490, который содержит восемь ядер Kryo 670: 1 × Gold Plus (Cortex-A78) с частотой 2,7 ГГц, 3 × Gold (Cortex-A78) с частотой 2,4 ГГц и 4 × Silver (Cortex-A55) с частотой 1,9 ГГц. Интегрированный графический ускоритель Adreno 643L (812 МГц) обладает поддержкой Open GL ES 3.2, Open CL 2.0, Vulkan 1.x, DX FL 12. Имеется ИИ-движок Qualcomm AI Engine шестого поколения с сопроцессором Hexagon CP 2.0 и блоком Hexagon Tensor, обеспечивающий производительность на уровне 12 TOPS. Благодаря модулю Adreno 633 VPU возможно декодирование материалов 4K60 H.264/H.265/VP9 и кодирование 4K30 H.264/H.265.

Источник изображения: OnLogic Компьютер несёт на борту 8 Гбайт оперативной памяти LPDDR4x-3200 и флеш-накопитель UFS вместимостью 128 Гбайт. В оснащение входят сетевые контроллеры 10GbE и 1GbE (с разъёмами RJ45), интерфейс HDMI (до 1920 × 1080 пикселей, 60 Гц), четыре порта USB 3.0 Type-A, коннектор USB 3.0 Type-C. Реализован интерфейс цифрового ввода-вывода DIO (4 × DI, 4 × DO) для интеграции сенсоров и автоматизации, в частности, для управления исполнительными механизмами. Новинка заключена в стальной корпус с размерами 157 × 94 × 70,75 мм, а масса составляет около 530 г. Применяется пассивное охлаждение. Диапазон рабочих температур простирается от 0 до +50 °C. Питание 19 В подаётся через DC-разъём. Говорится о поддержке комплекта для разработчиков Qualcomm QAIRT SDK. Приобрести устройство OnLogic Factor 101 можно по ориентировочной цене $600.

27.01.2026 [12:57], Сергей Карасёв

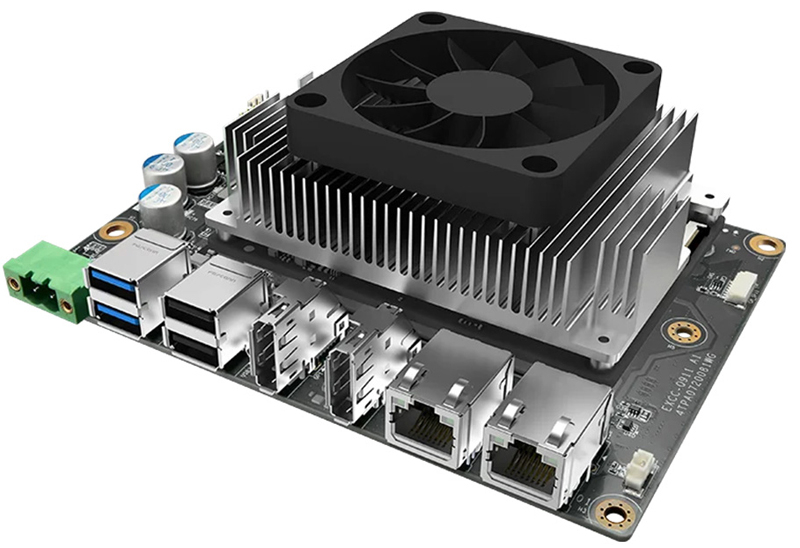

Встраиваемый модуль Innodisk EXEC-Q911 на чипе Qualcomm обладает ИИ-быстродействием до 200 TOPSКомпания Innodisk анонсировала встраиваемый модуль EXEC-Q911 и сопутствующую интерфейсную плату (комплект COM-HPC Mini Starter Kit) для решения ИИ-задач на периферии, в том числе в неблагоприятных условиях при температурах от -40 до +85 °C. В основу новинки положена аппаратная платформа Qualcomm. Задействован чип DragonWing IQ-9075 (QCS9075). Это изделие содержит восемь вычислительных ядер Kryo Gen 6 (Cortex-A78C) с тактовой частотой до 2,36 ГГц и четыре ядра реального времени Cortex-R52 с частотой до 1,85 ГГц. В состав процессора входит графический блок Adreno 663 с поддержкой Vulkan 1.2, OpenGL ES 3.2, OpenCL 2.0 FP, Adreno NN Direct. Встроенный модуль Adreno VPU 765 способен декодировать видео AV1/HEVC/H.265/H.264/VP9/MPEG-2 в формате вплоть до 8Kp60, а также кодировать материалы H.264/H.265/HEIF/HEIC до 4Kp60 (два потока). Интегрированный нейропроцессорный узел (NPU) обеспечивает ИИ-производительность до 200 TOPS на операциях INT8: заявлена поддержка фреймворков TensorFlow, PyTorch, ONNX, Paddle, Caffe, DarkNet и пр.

Источник изображения: Innodisk Изделие EXEC-Q911 несёт на борту 36 Гбай LPDDR5X, флеш-модули UFS 3.1 вместимостью 128 Гбайт, eMMC на 32 Гбайт и NOR Flash ёмкостью 32 Мбайт. Упомянута совместимость с Yocto Linux (Kernel 6.6) и Ubuntu 24.04 (Kernel 6.8). Интерфейсная плата располагает двумя разъёмами DisplayPort 1.2, двумя сетевыми портами 2.5GbE RJ45, тремя портами USB 3.1 Type-A, одним коннектором USB 3.1 Type-C и двумя портами USB 2.0 Type-A. Кроме того, есть 3,5-мм аудиогнездо (кодек WM8904), интерфейсы eDP, MIPI-CSI (два по 4 линии) и RS-232/RS-422/RS-485 (последовательный порт). Доступны слоты M.2 Key-M 2280 (PCIe 4.0 x4) для SSD, M.2 Key-B 3052 (USB 3.2 Gen2, USB 2.0) для модема 4G/5G и M.2 Key-E 2230 (PCIe 4.0 x2, USB 2.0) для адаптера Wi-Fi/Bluetooth. Питание в диапазоне 9–36 В подаётся через 2-контактный коннектор. Размеры составляют 146 × 102 × 56,99 мм (вместе с модулем COM-HPC), масса — 1,7 кг вместе с кулером, в состав которого входят радиатор и вентилятор.

24.01.2026 [14:03], Сергей Карасёв

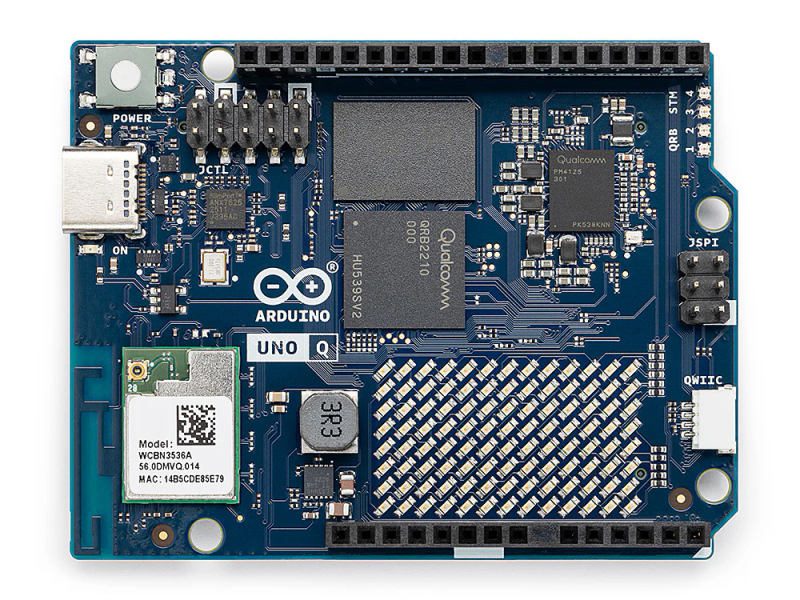

Одноплатный компьютер Arduino UNO Q вышел в версии с 4 Гбайт ОЗУ за $59Участники проекта Arduino, приобретённого компанией Qualcomm в октябре 2025 года, сообщили о доступности одноплатного компьютера UNO Q в модификации с 4 Гбайт оперативной памяти. Это вдвое больше по сравнению с ранее предлагавшейся версией изделия. Устройство Arduino UNO Q, напомним, дебютировало осенью прошлого года. Оно оснащено процессором Qualcomm Dragonwing QRB2210 с четырьмя ядрами Arm Cortex-A53 (2 ГГц), а также микроконтроллером реального времени STMicro STM32U585 с ядром Arm Cortex-M33 (160 МГц). Присутствует графический ускоритель Adreno 702 GPU (845 МГц) с поддержкой OpenGL ES 3.1, Vulkan 1.1, OpenCL 2.0. Есть адаптеры Wi-Fi 5 и Bluetooth 5.1, порт USB Type-C, интерфейсы I2C, I3C, SPI, CAN, UART, PSSI и GPIO. С момента анонса покупателям предлагалась версия Arduino UNO Q с 2 Гбайт ОЗУ и флеш-модулем eMMC вместимостью 16 Гбайт. Новый вариант одноплатного компьютера, помимо 4 Гбайт RAM, получил накопитель на 32 Гбайт. Это позволяет реализовывать проекты, более требовательные к аппаратным ресурсам. В частности, как отмечает Arduino, могут применяться более сложные модели ИИ и алгоритмы машинного обучения для реализации функций компьютерного зрения и обработки аудиоинформации. Изделие имеет размеры 68,58 × 53,34 мм. Питание (5 В) подаётся через коннектор USB Type-C. Модель Arduino UNO Q с 4 Гбайт памяти доступна для заказа по цене $59 против $44 у младшей модификации. Приобрести устройство можно через магазины RS Components, Farnell, DigiKey, Mouser и Robu.in, а также у других авторизованных дистрибьюторов и реселлеров.

23.01.2026 [12:18], Сергей Карасёв

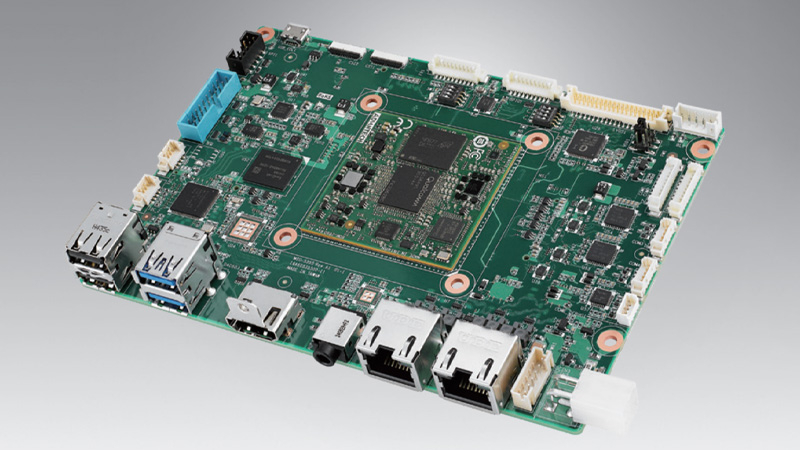

Чип Qualcomm и модуль 5G: одноплатный компьютер Advantech MIO-5355 ориентирован на ИИ-задачи на периферииКомпания Advantech анонсировала индустриальный одноплатный компьютер MIO-5355, выполненный в 3,5″ форм-факторе на аппаратной платформе Qualcomm. Устройство предназначено для решения различных ИИ-задач на периферии, в том числе в суровых условиях эксплуатации — при температурах от -20 до +70 °C. Новинка доступна в двух модификациях. Старшая версия несет на борту процессор Qualcomm DragonWing QCS6490 с восемью ядрами Kryo 670 в конфигурации 1 × Gold Plus (Cortex-A78) с частотой 2,7 ГГц, 3 × Gold (Cortex-A78) с частотой 2,4 ГГц и 4 × Silver (Cortex-A55) с частотой до 1,9 ГГц. В состав чипа входит графический ускоритель Adreno 643 (812 МГц) с поддержкой Open GL ES 3.2, Open CL 2.0, Vulkan 1.x, DX FL 12. Встроенный VPU-блок Adreno 633 обеспечивает возможность декодирования материалов 4K60 H.264/H.265/VP9 и кодирования 4K30 H.264/H.265. Кроме того, имеется ИИ-движок Qualcomm AI Engine шестого поколения с производительностью до 12,3 TOPS.

Источник изображения: Advantech Менее мощная версия получила процессор Qualcomm DragonWing QCS5430 с шестью ядрами Kryo 670 в виде связки 2 × Gold Plus (Cortex-A78) с частотой до 2,1 ГГц и 4 × Silver (Cortex-A55) с частотой до 1,8 ГГц. Графический ускоритель Adreno 642L (812 МГц) обладает поддержкой OpenGL ES 3.2, DirectX FL 12, OpenCL 2.0 и Vulkan. Модуль VPU Adreno 642L способен декодировать материалы 4K60 H.264/H.265/VP9 и кодировать 4K30 H.264/H.265. Быстродействие на операциях ИИ составляет до 3,5 TOPS. Объём оперативной памяти LPDDR5 в обоих вариантах равен 8 Гбайт. Возможна установка флеш-модуля UFS или eMMC вместимостью до 128 Гбайт, NVMe SSD формата M.2 2280 и карты microSD. Есть двухпортовый сетевой контроллер 1GbE на основе Realtek RTL8211FS. Опционально могут быть добавлены комбинированный адаптер Wi-Fi/Bluetooth (модуль M.2 E-Key) и модем 5G/4G (M.2 B-Key плюс слот Nano-SIM). Допускается вывод изображения одновременно на два монитора через интерфейсы HDMI 2.0 (до 4К; 60 Гц) и LVDS (1920 × 1080 пикселей) или eDP 1.4. Предусмотрены по два порта USB 3.0 Type-A и USB 2.0 Type-A, два гнезда RJ45 для сетевых кабелей, аудиогнездо на 3,5 мм (кодек Realtek ALC5682I), два интерфейса камер MIPI-CSI (по 4 линии). Через разъёмы на плате можно задействовать по два последовательных порта RS-232/422/485 и RS-232, а также по два порта USB 3.0 и USB 2.0. Габариты составляют 146 × 102 мм, масса — 128 г (без радиатора охлаждения). Питание подаётся через ATX-коннектор. Заявлена совместимость с Windows 11 IoT Enterprise, Ubuntu 24.04 LTS и Yocto Linux.

11.12.2025 [01:30], Владимир Мироненко

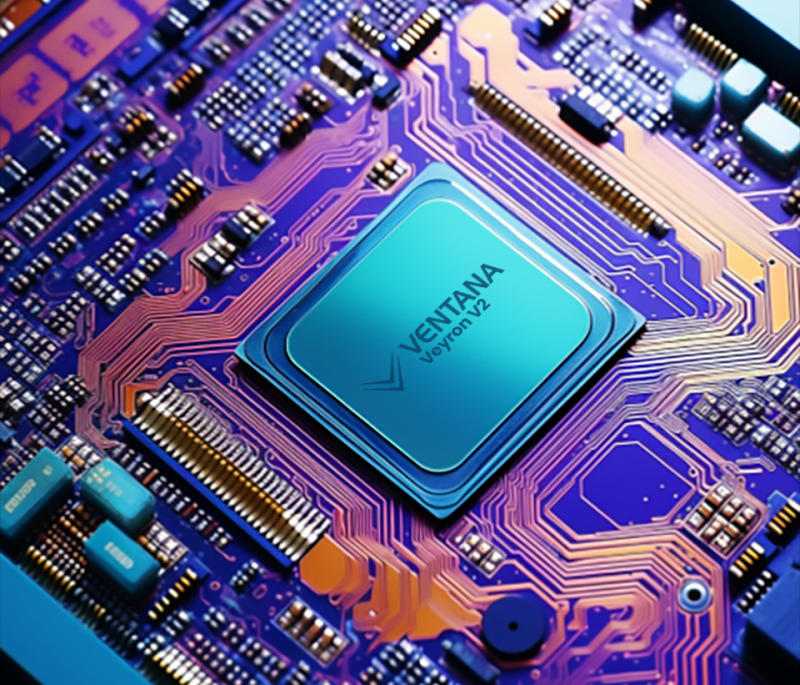

Qualcomm купила разработчика серверных RISC-V процессоров Ventana Micro SystemsQualcomm объявила о приобретении стартапа Ventana Micro Systems, специализирующегося на разработке серверных процессоров на основе архитектуры RISC-V. Как пояснила компания, это свидетельствует о её приверженности развитию RISC-V, открытой альтернативы Arm и x86. По словам Qualcomm, сделка расширит её возможности в разработке чипов на базе RISC-V и кастомных процессоров Oryon за счёт интеграции имеющегося у Ventana опыта в этом направлении. Qualcomm делает ставку на Oryon в деле завоевания новых рынков, в том числе серверного, в рамках продолжающейся диверсификации бизнеса. Компания получила ядра Oryon, совместимые с Arm, вместе с приобретением стартапа Nuvia за $1,4 млрд в 2021 году. Oryon уже прописались в процессорах Snapdragon X Series. Теперь же Qualcomm намерена предпринять ещё одну попытку разработки серверных процессоров. Прошлая попытка с процессорами Centriq 2400 завершилась неудачей. В этом году эти усилия были подкреплены наймом бывшего главного архитектора Intel Xeon и сделкой по приобретению Alphawave Semi за 2,4 млрд, пишет CRN. Qualcomm, которая уже использует архитектуру RISC-V в некоторых продуктах за пределами рынков ПК и серверов, заявила, что вклад Ventana укрепит ее «технологическое лидерство в эпоху ИИ во всех сферах бизнеса», указывая на большие надежды, возлагаемые на это приобретение: «Мы считаем, что ISA RISC-V имеет потенциал для продвижения технологий процессоров, обеспечивая инновации во всех продуктах. Приобретение Ventana Micro Systems знаменует собой важный шаг на нашем пути к предоставлению передовых в отрасли технологий процессоров на базе RISC-V для всех продуктов». Ventana Micro Systems, базирующаяся в Купертино (Cupertino), была основана в 2018 году. Как сообщается на сайте компании, разработанная ею технология изготовления процессоров на базе RISC-V, обеспечивает «производительность, сопоставимую с новейшими процессорами на Arm и x86 для ЦОД». Эта технология доступна в виде многоядерных UCIe-чиплетов, а также может быть интегрирована другими компаниями в собственные SoC. И первое, и второе поколение процессоров Ventana Veyron предлагало до 192 ядер RISC-V. Свои разработки Ventana рассчитывает использовать в различных сферах, включая облачные вычисления, корпоративные ЦОД, системы гиперскейлеров, 5G, периферийные вычисления, ИИ и машинное обучение, а также автомобильную промышленность. По некоторым оценкам, годовая выручка Ventana составляет $37,4 млн. Так что ей в каком-то смысле повезло, поскольку даже достаточно заметные разработчики решений на базе RISC-V часто не могут конкурировать с крупными игроками и готовы или продаться кому-нибудь, или вынуждены сокращать штат, или закрываться целиком. Сообщение о покупке Ventana последовало после того, как Qualcomm в сентябре заявила о «полной победе» в судебном споре с Arm, которая добивалась прекращения продаж и уничтожения всех чипов Qualcomm, содержащих ядра Oryon, из-за предполагаемых нарушений лицензий на архитектуру Arm со стороны Qualcomm и Nuvia. Любопытно, что в 2022 году Ventana объявила о стратегическом партнёрстве с Intel в рамках IFS. Последняя годом позже закрыла программу Pathfinder for RISC-V. |

|