Материалы по тегу: instinct

|

12.05.2026 [13:23], Сергей Карасёв

Dell выпустила ИИ-сервер PowerEdge XE9785 с ускорителями AMD Instinct MI355XКомпания Dell анонсировала сервер PowerEdge XE9785 на аппаратной платформе AMD, предназначенный для ресурсоёмких задач в области ИИ, включая обучение моделей и инференс. Двухсокетное устройство выполнено в форм-факторе 10U и оснащено воздушным охлаждением. Допускается установка двух процессоров AMD EPYC 9005 Turin, насчитывающих до 192 вычислительных ядер. Доступны 24 слота для модулей оперативной памяти DDR5-6400 RDIMM суммарным объёмом до 6 Тбайт. Во фронтальной части могут быть установлены до 16 NVMe-накопителей E3.S (PCIe 5.0) общей вместимостью до 245,76 Тбайт или до 10 NVMe-изделий U.2 суммарной ёмкостью до 153,6 Тбайт. Кроме того, есть два внутренних коннектора для SSD типоразмера М.2. Сервер несёт на борту восемь ускорителей AMD Instinct MI355X с 288 Гбайт памяти HBM3E (8 Тбайт/с). Задействован интерконнект AMD Infinity Fabric. В качестве альтернативного варианта предлагается конфигурация с восемью ускорителями NVIDIA HGX B300 и технологией NVIDIA NVLink. Питание обеспечивают 12 блоков мощностью 3200 Вт с сертификатом 80 Plus Titanium (с возможностью горячей замены). Габариты системы составляют 439,5 × 482,3 × 1044,7 мм, масса — 172,3 кг (с установленными картами MI355X). В зоне GPU находятся 15 вентиляторов, в области CPU — пять (все с поддержкой горячей замены). Среди прочего упомянуты слот OCP 3.0 (PCIe 5.0 x8), два сетевых порта RJ45, интерфейс Mini-DisplayPort, по одному порту USB Type-A и Type-C. Кроме того, компания Dell объявила о возможности использования ускорителей AMD Instinct MI350P в составе своих серверов PowerEdge XE7745 и R7725. Эти устройства рассчитаны на приложения ИИ, платформы виртуализации, базы данных и пр.

08.05.2026 [01:10], Владимир Мироненко

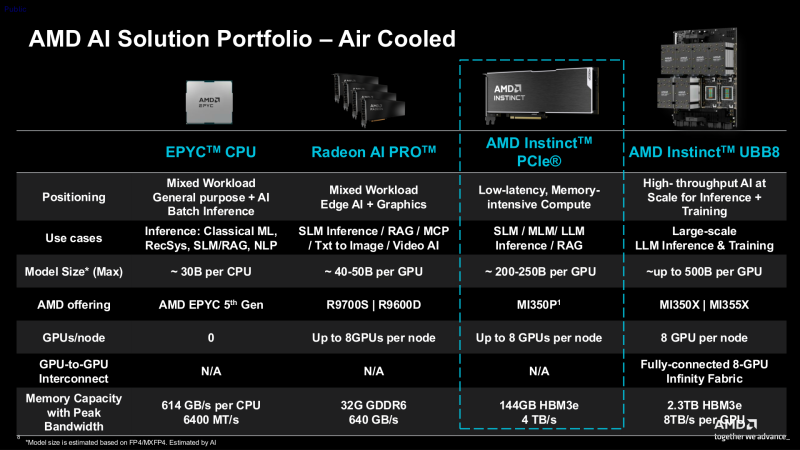

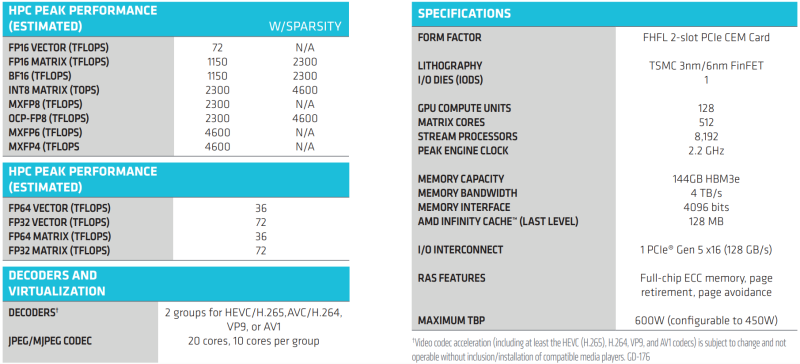

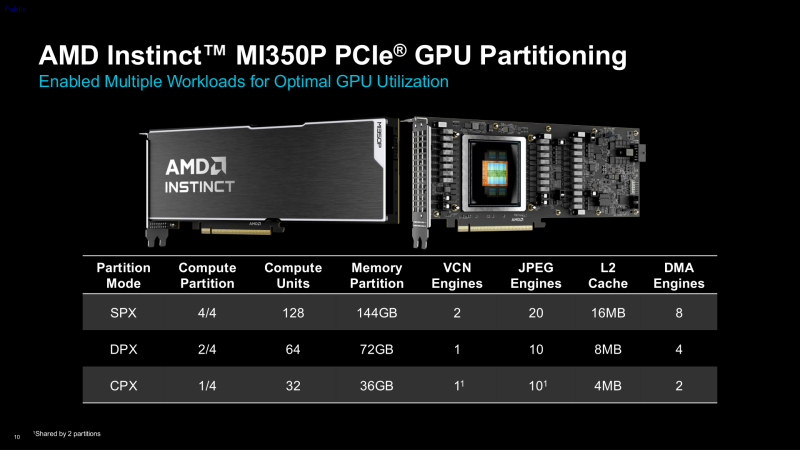

AMD представила ускоритель Instinct MI350P — CDNA 4 в формате PCIeAMD представила Instinct MI350P с интерфейсом PCIe — двухслотовую FHFL-карту для стандартных серверов с воздушным охлаждением. MI350P предназначена для локального развёртывания инференса в рамках существующей инфраструктуры электропитания, охлаждения и серверных стоек ЦОД предприятий. AMD отметила, что новинки с возможностью установки до 8 ед. в одно шасси «идеально подходят для инференса малых, средних и крупных ИИ-моделей и конвейеров RAG». Это первая PCIe-карта Instinct, выпущенная AMD за последние четыре года после выхода модели Instinct MI210. 600-Вт чип MI350P, по сути, представляет собой половинку MI350X (четыре XCD). У MI350P PCIe вдвое меньше вычислительных блоков — 128, что соответствует 8192 потоковым процессорам и 512 матричным ядрам. Пиковая частота составляет 2200 МГц. Кроме того, вместо двух IOD-кристаллов тут только один, он изготовлен по 6-нм техпроцессу TSMC. Сам ускоритель сделан по 3-нм технологии TSMC как MI350X. Весь чип содержит 73 млрд транзисторов. Ускоритель оснащён 128 Мбайт кеш-памяти Infinity Cache и 144 Гбайт памяти HBM3E с 4096-бит шиной, обеспечивающей пропускную способность 4 Тбайт/с. Для сравнения, MI350X оснащён 288 Гбайт памяти HBM3E с 8192-бит шиной. Плата 16-контактный разъём для подачи дополнительного питания. TBP можно установить на уровне 450 Вт вместо стандартных 600 Вт, что снизит производительность и ещё больше — энергопотребление. Интерфейс — PCIe 5.0 x16. Чуть позже будет реализована поддержка SR-IOV и возможность поделить чип на два или четыре vGPU. Расчётная производительность Instinct MI350P в MXFP4-расчётах составляет 2,3 Пфлопс, а пиковая — 4,6 Пфлопс. Это самая высокая производительность среди PCIe-ускорителей корпоративного класса, отметила компания. Предусмотрена поддержка разрежённости для форматов FP16, BF16, INT8 и OCP-FP8, что позволяет ускорить обработку данных. Векторная и матричная FP64-производительности составляет 36 Тфлопс. Кроме того, ускоритель снабжён декодерами HEVC/H.265, AVC/h.264, VP9 и AV1, а также кодеками (M)JPEG. Самым существенным недостатком новинки — это отсутствие прямой связи между ускорителями посредством Infinity Fabric. Всё общение внутри одного узла происходит посредством PCIe-шины, так что наличие восьми MI350P в одном сервере позволит эффективно обслуживать восемь отдельных моделей (до 200–250 млрд параметров), а не одну большую, которая не помещается в памяти единичного ускорителя. NVIDIA попыталась чуть смягчить эту проблему, представив для своих PCIe-ускорителей плату с адаптерами ConnectX-8 SuperNIC со встроенными коммутаторами PCIe 6.0. Сообщается, что Instinct MI350P доступны у различных партнёров компании. Они предлагают полностью открытую экосистему и программный стек Enterprise Ready AI с поддержкой ROCm. AMD заявила, что её эталонный open source пакет AMD Enterprise AI предоставляется партнёрам без каких-либо затрат на лицензирование. Это обеспечивает большую прозрачность кода и помогает снизить операционные расходы. В сочетании с картами Instinct MI350P и решениями от партнёров этот стек позволяет компаниям быстро развёртывать локальные системы без постоянных затрат на токены, говорит AMD.

07.05.2026 [16:26], Владимир Мироненко

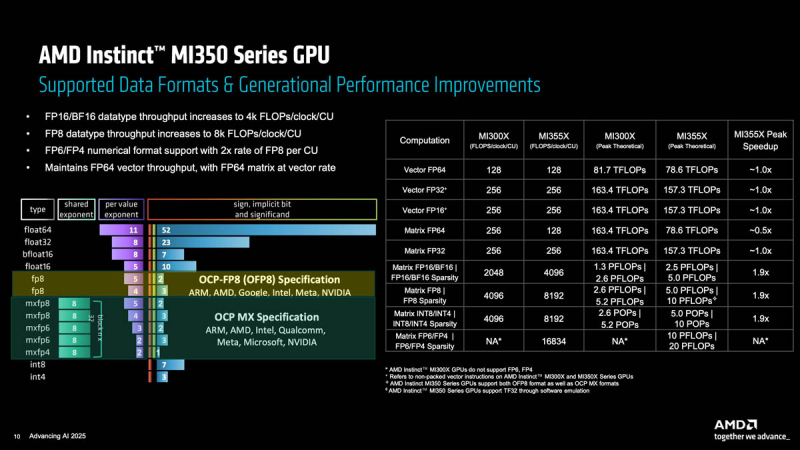

200 Тфлопс в FP64: AMD поделилась первыми подробностями об Instinct MI430XAMD поделилась информацией о производительности Instinct MI430X. Это не ИИ-ускоритель — чип ориентирован на задачи в сегменте высокопроизводительных вычислений (HPC): вычисления с двойной точностью (FP64) остаются чрезвычайно важными в науке, моделировании и многих других приложениях, пишет ресурс ComputerBase. AMD официально подтвердила выпуск чипа прошлой осенью, когда уже получила первые крупные заказы. Теперь компания демонстрирует первые показатели решения с 432 Гбайт HBM4. Обладая производительностью более 200 TFLOPS в нативном режиме FP64, он будет «более чем в шесть раз быстрее» ускорителя NVIDIA Rubin. Однако следует отметить, что сравнение несколько некорректно. Во-первых, Rubin — это чистый ИИ-ускоритель, ориентированный на FP4 и аналогичные форматы, а не на FP64. Во-вторых, AMD прямо не уточняет, идёт ли речь о векторных и/или матричных вычислениях. Хотя, вероятно, речь всё-таки о векторных расчётах, поскольку в режиме эмуляции со схемой Озаки Rubin, как обещает NVIDIA, будет выдавать те же 200 Тфлопс в FP64. При этом реального конкурента, кроме Instinct M430X, у Rubin в FP64 нет. С другой стороны, Rubin, в свою очередь, по всей видимости, превосходит MI430X в приложениях FP4 — AMD пока не раскрыла его возможности в таких вычислениях. Кроме того, компания сама говорила о возможности поддержки схемы Озаки (Ozaki) для чипов Instinct. Фактически AMD в своих же чипах «отклонилась от курса», решив наращивать ИИ-производительность. В Instinct MI355X FP64-производительность и векторных, и матричных вычислений была на уровне 78,6 Тфлопс, тогда как вышедший ранее MI325X выдавал 81,6 Тфлопс, а ещё более «древний» MI300X — 81,7 Тфлопс. О решении AMD нарастить нативную FP64-производительность ускорителя Instinct MI430X стало известно этой весной. До этого компания усомнилась в эффективности эмуляции научных расчётов на тензорных ядрах NVIDIA. NVIDIA же давно сделала ставку исключительно на ИИ, отказавшись от развития в новейших ускорителях FP64-блоков, но учёные указывают на то, что отказ от поддержки этого направления грозит лидерству США в HPC и дальнейшим инновациям. В Министерстве энергетики США (DoE) также отметили, что FP64-вычисления по-прежнему «очень важны» для «Миссии Генезис» (Genesis Mission) и для реализации её цели — ускорения научных открытий с помощью ИИ. AMD добилась больших успехов в сегменте HPC, поставляя оборудование для самых быстрых в мире суперкомпьютеров. Именно этот рынок является целевым для Instinct MI430X, о чем свидетельствуют первые заказы, включая машину Discovery Национальной лаборатории Ок-Ридж (ORNL) в США и Alice Recoque во Франции. Как сообщается, производительность Alice Recoque составит более 1 Эфлопс в FP64, что сделает его одной из самых быстрых HPC-систем в Европе.

08.04.2026 [09:22], Владимир Мироненко

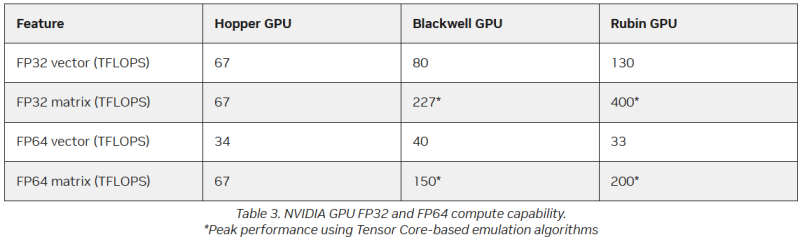

Стране нужен FP64: AMD пообещала повысить HPC-производительность ускорителей Instinct MI430XПосле анализа ограничений эмуляции FP64-вычислений с использованием схемы Озаки разработчики AMD пришли к выводу, что в настоящее время нет замены «сырой» производительности FP64. Как сообщил научный сотрудник AMD Николас Малайя (Nicholas Malaya) ресурсу HPCwire, чтобы обеспечить точность традиционных задач моделирования и симуляции, компания намерена нарастить нативную FP64-производительность ускорителя Instinct MI430X. Ускоритель станет основой суперкомпьютера Discovery, который будет установлен в Национальной лаборатории Ок-Ридж (ORNL) в 2028 году. Как отметил Кацухиса Озаки (Katsuhisa Ozaki) и два других японских исследователя, схема Ozaki — это многообещающая новая техника эмуляции, призванная позволить учёным выполнять высокоточные умножения матриц на оборудовании с поддержкой INT8/FP8, к которому относятся современные ИИ-ускорители, путём многократных вычислений с более низкой точностью. Текущие реализации Ozaki-I и Ozaki-II имеют ограничения, которые исключают их использование в реальных условиях, сообщил Малайя. Он указал на две основные проблемы. Во-первых, ПО не соответствует стандарту IEEE и не даёт того же результата, что и запуск кода на реальном оборудовании с поддержкой FP64. «В некоторых случаях это нормально, — сказал он. — Но во многих распространённых матрицах, которые мы наблюдали, влияние на точность довольно существенно.». Во-вторых, схема Озаки нацелена на квадратные матрицы. Если таковые в расчётах не используется, то итоговая производительность оказывается ниже, чем у нативного FP64-исполнения, говорит Малайя. Кроме того, HPC-приложения традиционно опираются на векторные вычисления, а не на тензорные или матричные, которые характерны для ИИ-нагрузок. Фактически ситуация ещё хуже — менее 10 % реальных HPC-приложений внесли изменения в DGEMM-коды, которые позволяют воспользоваться преимуществами Ozaki. «Насколько мне известно, с Ozaki-I, Ozaki-II или любой другой существующий метод нельзя применить к векторным инструкциям, — говорит Малайя. — Это ключевой нюанс, который, как мне кажется, упускается». На DGEMM действительно уходит много вычислительных ресурсов, что позволяет использовать схему Ozaki, «но она не решает 90 % HPC-задач». AMD собирается поддерживать эмуляцию Ozaki на своих чипах, сообщил Малайя. «Нет причин этого не делать. Это ПО. <…> И у вас могут быть библиотеки, которые позволяют динамически переключаться между нативными расчётами и Ozaki и, вероятно, оценивать его», — сказал он, добавив, что программную эмуляцию можно иметь в виду в качестве резервного варианта для FP64-вычислений. Но в конечном итоге Ozaki не является работоспособной альтернативой «железу» с FP64, сказал Малайя, уточнив, что не он один так считает. В настоящее время компания разрабатывает MI430X, специализированную версию ускорителя следующего поколения MI450, который будет обладать значительной FP64-производительностью. По словам Малайи, она будет значительно больше, чем у ускорителя MI355X, который обеспечивает 78,6 Тфлопс. По факту, это меньше, чем у предыдущей модели MI325X, которая обеспечивала 81,7 Тфлопс — в обоих случаях речь и про векторные, и про матричные FP64-вычисления. В любом случае, у всех этих чипов — от MI325 до MI430 — производительность больше, чем у чипов NVIDIA. И Hopper (34 Тфлопс), и Blackwell (40 Тфлопс) уже были медленнее в векторных FP64-вычислениях, но у Hopper хотя бы были нативные 67 Тфлопс в матричных расчётах, тогда как Blackwell в этом случае уже перешёл к схеме Озаки с «ненативными» 150 Тфлопс. Про Blackwell Ultra, где FP64-производительность упала до 1,3 Тфлопс, NVIDIA в данном контексте вообще не вспоминает, но обещает, что у Rubin будет 33 Тфлопс в векторных FP64-расчётах и 200 Тфлопс в матричных (тоже с Озаки). NVIDIA обосновывает отказ от развития аппаратных FP64-блоков тем, что увеличение собственно вычислительной мощности FP64 на самом деле не ускорит научные приложения, поскольку на практике они упрутся в возможности регистров, кешей и HBM. Rubin обеспечит пропускную способность HBM до 22 Тбайт/с, что в 2,8 раза больше, чем у Blackwell. Instinct MI325X предлагает 6 Тбайт/с, MI355X — 8 Тбайт/с, а у MI430X будет уже 19,6 Тбайт/с, сообщил Малайя. По словам Малайи, лучше всего синхронно «вкладываться» и в HBM, и в количество операций с плавающей запятой. «На самом деле важен коэффициент байт/флопс. С нашей точки зрения, необходимо поддерживать гораздо более близкое соотношение к тому, что мы видим в современных продуктах, — сказал он. — Необходимо значительно приблизиться к этому соотношению с точки зрения увеличения производительности FP64, чтобы сохранить тот же уровень, как это называют, арифметической интенсивности». Поскольку AMD обеспечит 2,5-кратное увеличение ПСП HBM от MI355 до MI430X, аналогичное 2,5-кратное увеличение производительности FP64 также будет оправдано. Таким образом можно примерно прикинуть, что MI430X может обеспечить производительность FP64 от 192 до 204 Тфлопс в зависимости от того, какой из них будет базовым: более новый MI355 или более быстрый MI325, сообщил HPCwire, добавив, что это всего лишь предположение, поскольку компания пока не сообщила точные характеристики будущих чипов. Кроме того, не до конца ясно, будет ли FP64-производительность одинакова для векторных и матричных расчётов. FP64-вычисления «очень важны» для «Миссии Генезис» (Genesis Mission), заявил ранее заместитель министра энергетики США (DoE) по науке и инновациям Дарио Гил (Darío Gil). Он отметил, что и глава AMD Лиза Су (Lisa Su), и глава NVIDIA Дженсен Хуанг (Jensen Huang), выразили твёрдую приверженность FP64, подтвердив, что поддержка формата будет продолжаться. «FP64 имеет решающее значение для поддержки рабочих нагрузок моделирования и симуляции, не только для дальнейшего развития традиционных научных исследований, но и для предоставления исходных данных для обучения новых ИИ-моделей», — добавил Гил. «Всегда существует баланс между тем, сколько требуется FP64- и FP16-вычислений», — сказал Малайя. «AMD утверждает, что нам необходимо поддерживать широкий спектр типов данных в зависимости от их потребностей. Не получится, чтобы всем были нужны FP64, которых хватит для всего.», — отметил он. Малайя сообщил, что всегда бывают исключения. Например, ИИ-симуляции сворачивания белков, такие как AlphaFold и Openfold, используют FP32. Да и некоторым традиционным HPC-задачам, таким как молекулярная динамика, не требуется FP64-точность. Тем не менее, сейчас существует значительный неудовлетворенный спрос на FP64, утверждает учёный. «Что касается высокопроизводительных вычислений, мы считаем, что им по-прежнему потребуется много FP64, — сказал он. — Будут использоваться некоторые коды, которые полностью ограничены пропускной способностью памяти, и им не нужно так много. Но есть, например, коды вычислительной химии и некоторые другие, которые действительно имеют высокую арифметическую интенсивность, и они будут использовать FP64».

03.03.2026 [14:27], Руслан Авдеев

Сделано в США: Flex начала выпуск американских ИИ-серверов с AMD InstinctАмериканская производственная компания Flex, поставляющая решения для дата-центров, анонсировала расширение стратегического сотрудничества с AMD для выпуска решений на платформе Instinct. По словам Flex, это важная веха на пути укрепления локального производства на территории США, в том числе передовых ИИ- и HPC-продуктов. В рамках партнёрства выпуск платформы AMD Instinct MI355X организован на территории головного подразделения Flex в Остине (Техас). В следующем квартале объёмы выпуска должны увеличиться. Речь идёт не только о платформе текущего поколения, компания намерена поддержать выпуск и новых платформ Instinct для удовлетворения спроса со стороны крупномасштабных ИИ-проектов. Сейчас Flex выпускает высокоплотные системы с восемью ускорителями и сопутствующей обвязкой. Каждая платформа, как утверждают в компании, проходит строгие заводские испытания и оценку. Системы оснащаются СЖО JetCool, принадлежащей Flex. По данным производителя, комбинация передовых индустриальных мощностей Flex, надёжной цепочки поставок и производственных мощностей в США с передовыми позициями AMD в HPC-сегменте позволяет клиентам масштабировать свои ИИ-проекты быстрее и с повышенной надёжностью. Головная структура Flex в Техасе занимает площадь более 130 тыс. м2 и создана для поддержки комплексного производства в больших объёмах. Всего у Flex в США есть более 650 тыс. м2 площадей на 17 объектах.

Источник изображения: Flex Планы AMD по локализации производства включают и выпуск чипов на американских фабриках TSMC. NVIDIA идёт по тому же пути, но в части выпуска или хотя бы сборки серверов на территории США, в том числе для обслуживания гиперскейлеров, у неё гораздо больше возможностей. Но и AMD укрепила свои позиции в этой области в результате сделки с ZT Systems и Sanmina. США всеми силами стремятся локализовать производство и разработки на своей территории. В декабре 2025 года было объявлено о заключении партнёрских отношений с 24 ведущими IT-компаниями в рамках «Миссии Генезис», призванной стимулировать ИИ-разработки и производство на американской территории. Например, в конце января 2026 года сообщалось, что Corning построит крупнейшее в мире производство оптоволоконного кабеля для ЦОД в рамках сделки с Meta✴ на $6 млрд.

03.03.2026 [14:10], Сергей Карасёв

Gigabyte представила ИИ-сервер G893-ZX1-AAX4 на базе AMD Instinct MI355XGigabyte Technology анонсировала сервер G893-ZX1-AAX4, предназначенный для выполнения ресурсоёмких задач, таких как ИИ-инференс, сложное моделирование и пр. Новинка построена на аппаратной платформе AMD. Устройство типоразмера 8U рассчитано на два процессора EPYC 9005 Turin или EPYC 9004 Genoa в исполнении Socket SP5 (LGA 6096) с показателем TDP до 500 Вт. Доступны 24 слота для модулей оперативной памяти DDR5-4800/6400. Во фронтальной части расположены восемь отсеков для SFF-накопителей с интерфейсом PCIe 5.0 (NVMe). Кроме того, есть два внутренних коннектора для SSD формата M.2 2280/22110 с интерфейсом PCIe 3.0 x4 и PCIe 3.0 x1. Реализованы восемь разъёмов PCIe 5.0 x16 для однослотовых карт расширения FHHL и четыре разъёма PCIe 5.0 x16 для двухслотовых карт FHHL. В оснащение входят восемь ускорителей AMD Instinct MI355X OAM. Применяется полностью воздушное охлаждение с 15 вентиляторами диаметром 80 мм в области GPU-лотка, шестью кулерами на 60 мм в зоне материнской платы и четырьмя вентиляторами диаметром 80 мм в секции PCIe. Питание обеспечивают 12 блоков мощностью 3000 Вт каждый с сертификатом 80 PLUS Titanium.

Источник изображения: Gigabyte Technology Сервер оборудован контроллером ASPEED AST2600, двумя сетевыми портами 10GbE на базе Intel X710-AT2 (RJ45), выделенным сетевым портом управления 1GbE (RJ45), двумя портами USB 3.2 Gen1 (5 Гбит/с), аналоговым разъёмом D-Sub. Диапазон рабочих температур — от +10 до +30 °C. Габариты составляют 447 × 351 × 923 мм.

20.02.2026 [09:10], Руслан Авдеев

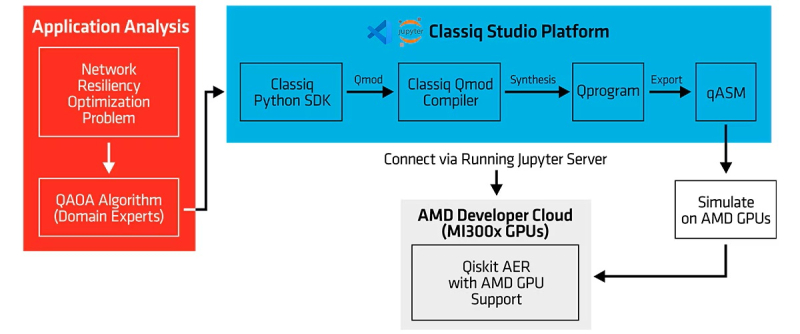

AMD, Classiq и Comcast «квантово» улучшили интернетРазработчик программного обеспечения для квантовых вычислений Classiq совместно с Comcast и AMD объявили о завершении испытаний, направленных на совершенствование доставки интернет-трафика путём использования квантовых алгоритмов для повышения надёжности маршрутизации в Сети, сообщает HPC Wire. Comcast заявила, что клиентам нужно быстрое, безопасное и надёжное подключение, но при управлении большой и динамичной сетью достижение этой цели становится сложной задачей, особенно в условиях растущего спроса. Поэтому в прошлом году были начаты эксперименты по выяснению того, как квантовое ПО и технологии могут решать реальные сетевые задачи. Результаты показали, что квантовые вычисления для оптимизации сети — не теория, а вполне практическое, масштабируемое решение. В ходе тестов решалась фундаментальная задача проектирования сети — определение независимых резервных маршрутов для сетевых узлов в общей конкурентной среде при проведении технического обслуживания и изменении топологии сети, причём с сохранением минимально возможной задержки, высокой устойчивостью к одновременным сбоям и высокой же пропускной способностью. Такая задача регулярно возникает на реальных сетях, где и без планового обслуживания не обойтись, и от одновременных сбоев никто застрахован.

Источник изображения: Dynamic Wang/unsplash.com В ходе эксперимента с использованием квантовых технологий и HPC-платформ AMD на базе ускорителей Instinct MI300X проверялась возможность квантовых алгоритмов успешно определять резервные пути для трафика в режиме реального времени в различных сценариях. Использовались как моделирование с использованием Instinct для достижения значимых вычислительных мощностей (кубитного уровня), что позволило быстро перебирать различные алгоритмы, так и реальный квантовый компьютер IonQ Forte с 29 алгоритмическими кубитами для проверки успешности реализации алгоритмов. Задача оптимизации глобальных телекоммуникационных сетей — крайне ресурсоёмкая комбинаторная задача, экспоненциально усложняющаяся по мере роста размера сети. Такая задача является идеальным вызовом для систем квантовых вычислений. По словам представителя Classiq, исследования и разработки в сфере квантовых технологий требуют быстрых итераций с внесением улучшений на каждом цикле и воспроизводимых рабочих процессов. AMD заявила, что будущее HPC — в конвергенции классических и квантовых вычислений.

04.12.2025 [12:21], Руслан Авдеев

Скромно, но со вкусом: Vultr при поддержке AMD построит за $1 млрд ИИ-кластер с 24 тыс. Instinct MI355XОблачный провайдер Vultr строит кластер мощностью 50 МВт из ИИ-ускорителей AMD в дата-центре в Огайо. Новый проект призван обеспечить дополнительные вычислительные мощности по сниженным ценам, сообщает Bloomberg. Поддерживаемая AMD компания намерена инвестировать в объект более $1 млрд, клиенты смогут обучать и эксплуатировать ИИ-модели. Ввод в эксплуатацию запланирован на I квартал 2026 года. Vultr входит в группу облачных провайдеров, желающих заработать на ажиотажном спросе на ИИ. Новый кластер гораздо меньше гигантских объектов Microsoft, Meta✴ и Google. При этом вычислительные мощности, по словам компании, будут предлагаться по более доступным тарифам. Облако Vultr, как правило, вдвое дешевле, чем предложения гиперскейлеров, сообщают в компании. Утверждается, что её 50-МВт ЦОД с 24 тыс. AMD Instinct MI355X сопоставим с некоторыми гигаваттными проектами по эффективности. Vultr одной из первых получила MI355X, а вскоре перейдёт на MI450. Кластер называют «беспрецедентным» для облачной компании такого масштаба, но для него пока нет готовых к подписанию соглашений клиентов, хотя активные переговоры уже ведутся. По имеющимся данным, действующие клиенты вроде Clarifai Inc. и LiquidMetal AI, а также биотехнологическая MindWalk Holdings уже пользуются сервисами Vultr на базе решений AMD. В общей сложности компания обслуживает «сотни тысяч» клиентов в 185 странах. Vultr была основана в 2014 году и многие годы предлагала доступ к решениям на базе CPU. В 2021 году Vultr начала закупать GPU. В последние пару лет ИИ-инфраструктура стала самой быстрорастущей частью бизнеса компании, т.ч. теперь она обеспечивает большую часть выручки. В 2026 году бизнес намерен уделять ИИ ещё больше внимания. В прошлом году компания привлекла $333 млн, в ходе раунда, возглавленного LuminArx Capital Management и AMD, её капитализация составила $3,5 млрд. В июне 2025 года дополнительно получены $329 млн кредитного финансирования, преимущественно от JPMorgan Chase, Bank of America и Wells Fargo. В эту сумму вошли $74 млн, обеспеченных активами компании, в т.ч. ИИ-ускорителями. Vultr значительно расширила кредитную линию для финансирования кластера AMD. Разрабатывающие ИИ-инфраструктуру компании всё чаще опасаются, что отрасль ожидает формирование пузыря. Также не исключается, что ИИ-ускорителя быстро обесценятся, что тоже способно привести рынок к кризису. В Vultr уверены, что ИИ-инфраструктура всё ещё остаётся «крайне неразвитой», даже если некоторые, чрезвычайно разросшиеся на этом рынке IT-гиганты, вероятно, потерпят неудачу. Что касается времени «обесценивания» технологий, Vultr уверена, что срок службы в шесть лет для ИИ-ускорителей — «разумная, консервативная оценка».

03.12.2025 [20:51], Владимир Мироненко

HPE одной из первых начнёт выпускать интегрированные стоечные ИИ-платформы AMD Helios AI

amd

broadcom

epyc

hardware

hpc

hpe

instinct

juniper networks

mi400

ocp

ualink

venice

германия

ии

суперкомпьютер

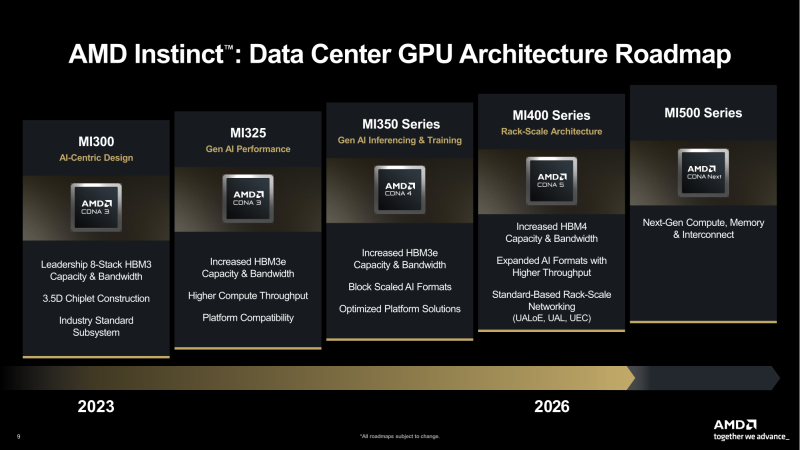

AMD объявила о расширении сотрудничества с HPE, в рамках которого HPE станет одним из первых поставщиков стоечных систем AMD Helios AI, которые получат коммутаторы Juniper Networking (компания с недавних пор принадлежит HPE), разработанные совместно с Broadcom, и ПО для бесперебойного высокоскоростного подключения по Ethernet. AMD Helios AI — открытая полнофункциональная ИИ-платформа на базе архитектуры OCP Open Rack Wide (ORW), разработанная для крупномасштабных рабочих нагрузок и обеспечивающая FP4-производительность до 2,9 Эфлопс на стойку благодаря ускорителям AMD Instinct MI455X, процессорам EPYC Venice шестого поколения и DPU Pensando Vulcano, работающими под управлением открытой программной экосистемы ROCm для нагрузок ИИ и HPC. Как отметил The Register, сетевая архитектура этой системы будет представлять собой масштабируемую реализацию UALink over Ethernet (UALoE) и специализированным коммутатором Juniper Networks на базе сетевого чипа Broadcom Tomahawk 6 (102,4 Тбит/с). Система разработана для упрощения развёртывания крупномасштабных ИИ-кластеров, что позволяет сократить время разработки решений и повысить гибкость инфраструктуры. В отличие от NVIDIA, AMD не выпускает коммутаторы, предлагая открытую экосистему, так что HPE и другие компании могут интегрировать собственные сетевые решения. The Register полагает, что HPE и Broadcom решили не гнаться за отдельной аппаратной реализацией UALink, если данные можно передавать поверх Ethernet. «Это первое в отрасли масштабируемое решение, использующее Ethernet, стандартный Ethernet. Это означает, что оно полностью соответствует открытому стандарту и позволяет избежать привязки к проприетарному поставщику, использует проверенную сетевую технологию HPE Juniper для обеспечения масштабируемости и оптимальной производительности для рабочих нагрузок ИИ», — заявила HPE. HPE заявила, что это позволит её стоечной системе поддерживать трафик, необходимый для обучения модели с триллионами параметров, а также обеспечить высокую пропускную способность инференса. Стоечная система HPE будет включать 72 ускорителя AMD Instinct MI455X с 31 Тбайт HBM4 с агрегиированной пропускной способностью 1,4 Пбайт/с. Агрегированная скорость интерконнекта составит 260 Тбайт/с. Новинка будет доступна в 2026 году. AMD также сообщила, что Herder, новый суперкомпьютер для Центра высокопроизводительных вычислений в Штутгарте (HLRS) (Германия), получит Instinct MI430X и EPYC Venice. Он будет построена на платформе HPE Cray Supercomputing GX5000. Поставка Herder запланирована на II половину 2027 года, а ввод в эксплуатацию — к концу 2027 года. Herder заменит используемый центром суперкомпьютер Hunter.

01.12.2025 [12:28], Сергей Карасёв

MiTAC представила ИИ-сервер G4826Z5 с ускорителями AMD Instinct MI355X и СЖОКомпания MiTAC анонсировала высокопроизводительный GPU-сервер G4826Z5 на аппаратной платформе AMD, предназначенный для ресурсоёмких задач ИИ и НРС. Кроме того, представлены стойки и вычислительные кластеры на его основе. Сервер G4826Z5U2BC-355X-755 выполнен в форм-факторе 4U. Нижняя 2U-секция содержит два процессора AMD EPYC 9005 Turin и 24 слота для модулей оперативной памяти DDR5-6400. Во фронтальной части расположены восемь отсеков для SFF-накопителей; кроме того, есть два внутренних коннектора M.2 для SSD (NVMe). Верхний 2U-модуль несёт на борту восемь ускорителей AMD Instinct MI355X, оборудованных 288 Гбайт памяти HBM3E с пропускной способностью до 8 Тбайт/с. Машина G4826Z5 получила систему жидкостного охлаждения, которая охватывает CPU- и GPU-секции. Предусмотрена функция обнаружения утечек. Подсистема питания с резервированием выполнена по схеме: 1+1 мощностью 3200 Вт и 3+3 мощностью 15 600 Вт. Все блоки питания имеют сертификат 80 Plus Titanium и допускают горячую замену. На основе G4826Z5 формируется стоечная система (MR1100L-64355X-01): она содержит восемь GPU-серверов, что в сумме даёт 64 ускорителя и 18,4 Тбайт памяти HBM3E. Стойка также укомплектована коммутаторами 400GbE на 64 и 32 порта, двумя коммутаторами 1GbE на 48 портов, сервером управления B8056G68CE12HR-2T-TU, сервером хранения B8056T70AE26HR-2T-HE-TU и блоком распределения охлаждающей жидкости (CDU) в формате 4U. В свою очередь, стойки объединяются в кластеры из четырёх и восьми штук. Это в сумме обеспечивает 32 и 64 сервера GPU и 256 и 512 ускорителей Instinct MI355X соответственно. Таким образом, максимальная конфигурация включает приблизительно 147 Тбайт памяти HBM3E. |

|