Материалы по тегу: ocp

|

01.06.2026 [12:35], Сергей Карасёв

Двухтонный ИИ: Dell начала поставки первых стоек NVIDIA Vera Rubin NVL72Компания Dell Technologies поставила свою первую стойку NVIDIA Vera Rubin NVL72. Получателем системы стала компания CoreWeave — неоооблачный провайдер, который активно расширяет инфраструктуру для ресурсоёмких нагрузок ИИ. Стойка содержит 72 ускорителя Rubin и 36 процессоров Vera на архитектуре Arm. Суммарный объём памяти HBM4 составляет 20,7 Тбайт, системной памяти LPDDR5X — 54 Тбайт. Реализовано жидкостное охлаждение горячей водой (+45 °C). Сама стойка в собранном виде весит около 1,8 т и потребляет до 230 кВт. Заявленная ИИ-производительность достигает 3,6 Эфлопс в режиме NVFP4 при инференсе, что примерно в пять раз превышает показатель Blackwell. На задачах обучения быстродействие NVFP4 составляет 2,5 Эфлопс. Отмечается, что Dell успешно провела все необходимые диагностические тесты Vera Rubin NVL72, по результатам которых система готова к дальнейшему развёртыванию на площадке заказчика. CoreWeave намерена использовать новый кластер для расширения своей инфраструктуры НРС. Масштабный вывод платформы на рынок намечен на II половину текущего года. Между тем сама NVIDIA объявила о начале массового производства решений поколения Vera Rubin. В числе партнёров, объявивших о поддержке этих систем, названы Dell Technologies, HPE, Lenovo и Supermicro, а также AIC, Aivres, ASRock Rack, ASUS, Cloudian, Compal, DDN, Everpure, Foxconn, GIGABYTE, Hitachi Vantara, Hyve Solutions, IBM, Inventec, MinIO, MiTAC Computing, MSI, NetApp, Nutanix, Pegatron, Quanta Cloud Technology (QCT), VAST Data, WEKA, Wistron и Wiwynn. Вместе с тем CoreWeave, а также Lambda и Oracle Cloud Infrastructure одними из первых начнут развёртывание стоек Vera Rubin в своих ИИ-инфраструктурах.

30.05.2026 [14:18], Сергей Карасёв

Microchip представила RoT-контроллеры для постквантовой криптографииКомпания Microchip Technology анонсировала новые решения Trust Shield для устройств с поддержкой постквантовой криптографии. В частности, дебютировали контроллеры TS1800, TS500 и TS501, которые доступны в составе предварительно сконфигурированной платформы TrustFLEX, что помогает ускорить вывод конечных продуктов на рынок. Изделие TS1800 — это внешний контроллер Root of Trust (RoT), отвечающий за безопасную загрузку устройства, безопасные обновления прошивки, аттестацию и обработку сертификатов с использованием аппаратного ускорения алгоритмов постквантовой криптографии. Говорится о поддержке таких решений Национального института стандартов и технологий США (NIST), как ML-DSA (Module Lattice‑Based Digital Signature Algorithm), LMS (Leighton–Micali Signature) и ML-KEM (Module Lattice-Based Key Encapsulation Mechanism). В основу контроллера TS1800 положено ядро Arm Cortex-M4F, функционирующее на тактовой частоте до 192 МГц. Достигается двукратный прирост производительности по сравнению с RoT-контроллерами Microchip предыдущего поколения. Кроме того, улучшена энергетическая эффективность. Реализована поддержка интерфейса USB 2.0 и расширенных функций безопасности, предусмотренных стандартами OCP. В свою очередь, изделия TS50x предназначены для обеспечения безопасной загрузки. Они ориентированы на оборудование, которому не требуется полный набор функций RoT, доступный в микросхеме TS1800. При этом в дополнение к алгоритмам постквантовой криптографии поддерживаются традиционные инструменты, в частности, Elliptic Curve Cryptography (ECC) P-384. Поставки контроллеров TS1800 и TS50x уже начались.

26.05.2026 [09:40], Руслан Авдеев

Но есть и плюсы: OCP напомнила местным властям о возможности использования избыточнго тепла ЦОДОрганизация OCP предложила представителям муниципальных властей направить избыточное тепло дата-центров на пользу локальным сообществам, сообщает The Register, чтобы хоть как-то смягчить негативное отношение жителей к самой идее постройки ЦОД в округе, которые ссылаются на большое потребление воды и энергии, потенциальный рост цен на ресурсы, высокий уровень шума и др. По некоторым данным, ЦОД даже создают «острова тепла» вокруг себя, так что порой действительно луше было бы обогревать дома, а не отапливать атмосферу. Протесты против строительства ЦОД не только иногда приводят к смещению местных властей, но и заканчиваются насильственными акциями. Иногда представители властей идут навстречу гражданам — как в штате Мэн, хотя речь идёт скорее о показательной политической акции, не влияющей на окончательный результат. На этом фоне эксперты OCP, участвовавшие в группе, занимавшейся повторным использованием тепла, недавно опубликовали пост, в котором восхваляли достоинства ЦОД — там, где местные власти достаточно умны, чтобы пользоваться избыточным теплом от их работы. Сообщается, что использование тепла дата-центров открывает большие возможности для безуглеродного отопления в разных секторах, неся экологические, экономические и общественные выгоды. Действительно, о проектах использования «мусорного» тепла для выращивания растений, обогрева бассейнов и в других целях информация появляется регулярно. В публикации OCP выражено сожаление тем, что местные органы власти недостаточно осведомлены о возможностях использования тепла дата-центров. Эксперты указывают на отсутствие коммуникаций между ЦОД и близко расположенными потребителями тепла, а также политики, стимулирующей соответствующие проекты на местном, национальном и наднациональном уровнях. Предполагается, что компетентные власти должны сделать согласие на использование избыточного тепла обязательным условием для выдачи разрешений на строительство ЦОД. Впрочем, признаётся, что обосновать затраты на проекты использования такого тепла может быть довольно непросто. На вики-странице группы, занимающейся вопросами применения тепла ЦОД в OCP, размещаются образцы типовых писем и другие материалы, которые можно направлять регуляторам, чтобы стимулировать использование ими систем рекуперации тепловых ресурсов. Фактически это распространённая тактика лоббирования. Сам факт того, что OCP, преимущественно работающая в интересах Meta✴, Microsoft и Google, обращает внимание на подобные возможности ЦОД на фоне оппозиции их строительству, примечательнее, чем сами советы.

24.05.2026 [07:25], Сергей Карасёв

Dell анонсировала серверы PowerEdge на платформе AMD EPYC VeniceDell анонсировала серверы PowerEdge 18-го поколения, рассчитанные на различные рабочие нагрузки, включая ресурсоёмкие задачи ИИ. Утверждается, что прирост производительности по сравнению с предшественниками достигает 70 %. В частности, дебютировала модель PowerEdge M9825 с процессорами AMD EPYC Venice. Это устройство с жидкостным охлаждением ориентировано на платформы высокой плотности. Сервер может монтироваться в 21″ ORv3-стойки серии IR7000 мощностью до 480 кВт. Система PowerEdge M9825, предназначенная для ИИ-развёртываний, появится в продаже во II половине текущего года. Кроме того, представлены ИИ-серверы PowerEdge XE5845 и PowerEdge XE7845 с возможностью установки ускорителей на базе GPU. Эти машины оснащены воздушным охлаждением. Начало продаж намечено на I квартал 2027-го. В число новинок также вошли двухсокетный сервер PowerEdge R9825 формата 3U и односокетный вариант R9815 типоразмера 2U на базе AMD EPYC Venice. Данные модели отличаются высокой плотностью ядер — до 256 на сокет, а также увеличенной пропускной способностью подсистемы ввода-вывода. Устройства могут применяться для ресурсоёмких задач без необходимости внедрения СЖО или модернизации ЦОД. На рынке системы появятся во II полугодии 2026-го.

Источник изображения: Dell Анонсированы и компактные серверы Dell PowerEdge R8815 и R6815 в форм-факторе 1U с чипами AMD EPYC Venice. На платформе AMD также построены универсальные системы Dell PowerEdge R7815 с гибкими возможностями в плане конфигурации PCIe 6.0 и подсистемы хранения данных. Будут выпущены односокетная версия PowerEdge R7815xd и двухсокетная модель R7825, подходящая для задач виртуализации и аналитики. Эти решения выйдут в следующем году. Наконец, дебютировал сервер Dell PowerEdge R9810 типоразмера 2U. Основой данной односокетной машины послужат процессоры Intel следующего поколения с кодовым именем Diamond Rapids. Старт продаж намечен на 2027 год.

22.05.2026 [12:00], Сергей Карасёв

Представлен российский сервер Delta Orca на базе Intel Xeon 6 для работы с неструктурированными даннымиКомпания Delta Computers анонсировала однопроцессорный сервер Delta Orca, построенный на аппаратной платформе Intel Xeon 6. Новинка ориентирована на использование в инфраструктурах Lakehouse, объединяющих гибкость «озёр данных» (Data Lake) и надёжность централизованных хранилищ (Data Warehouse). Устройство выполнено в форм-факторе 2OU для монтажа в 21″ стойку. В зависимости от модификации задействуется процессор Granite Rapids-SP (до 80 P-ядер) или Sierra Forest-SP (до 96 E-ядер) с показателем TDP до 350 Вт. Доступны восемь слотов для модулей оперативной памяти RDIMM/LRDIMM DDR5-6400 (или MCRDIMM-8000) суммарным объёмом до 2 Тбайт. Сервер допускает установку до 20 NVM-накопителей SFF U.2 (PCIe 5.0) толщиной 7 мм или до 10 устройств такого же типа толщиной 15 мм во фронтальной части. Кроме того, есть два коннектора для NVME SSD формата M2.2280. Предусмотрены слот PCIe 5.0 x16 для карты расширения HHHL, по одному порту USB 3.0 Type-A, USB Type-C (сервисный разъем) и Mini DP, сетевой порт управления 1GbE. Говорится о поддержке сетевых адаптеров 400GbE. Питание осуществляется от централизованного шинопровода OCP. Применена система гибридного охлаждения Delta Hybrid Cooling для поддержания работы процессора в режиме Turbo Boost Max в течение продолжительного времени. Модель Delta Orca, по заявлениям производителя, оптимизирована для работы с неструктурированными данными и объектными хранилищами. Реализованы средства мониторинга и управления в собственной системе Delta BMC (внесено в реестр Минцифры и имеет сертификат ФСТЭК). Среди преимуществ новинки выделяются масштабируемость, высокая пропускная способность и надёжное хранение данных. Сервер уже доступен для предварительного заказа.

21.05.2026 [20:51], Сергей Карасёв

Представлен российский коммуникационный сервер Delta Octopus 6 на платформе Intel Xeon 6Delta Computers анонсировала отечественный коммуникационный сервер Delta Octopus 6, который продолжает развитие серии Octopus. В основу новинки положена аппаратная платформа Intel Xeon 6. В зависимости от модификации применяется процессор Xeon 6 Granite Rapids-SP (до 86 P-ядер) или Sierra Forest-SP (до 144 E-ядер) с показателем TDP до 350 Вт. Доступны 16 слотов для модулей оперативной памяти DDR5-6400/8000. Могут быть установлены два NVMe SSD типоразмера M2.22110. Благодаря наличию пяти слотов PCIe 5.0 x16 OCP 3.0 возможен монтаж до пяти сетевых адаптеров с пропускной способностью до 400 Гбит/с каждый. Присутствуют сетевой порт управления 1GbE (Delta BMC), разъём USB 3.0 и консольный порт RJ45. Предусмотрен датчик вскрытия корпуса. Устройство выполнено в форм-факторе 1U с габаритами 600 × 439 × 43 мм. При этом система может монтироваться как в стандартные 19″ стойки, так и в 21″ OCP-шасси. Питание может быть организовано от двух блоков мощностью 800/1300Вт, от централизованного шинопровода OCP (12 В) или от шины питания 48 В телеком-стандарта (Telco Rack). Платформа Delta Octopus 6 предназначена для использования в сценариях межсетевых экранов нового поколения (NGFW), балансировщиков сетевой нагрузки (Load Balancer), VPN-концентраторов, BRAS/BNG и различных крипто-аналитических приложений. Применяется собственное программное обеспечение Delta BMC и Delta BIOS. Сервер может использоваться на объектах КИИ.

15.05.2026 [08:38], Сергей Карасёв

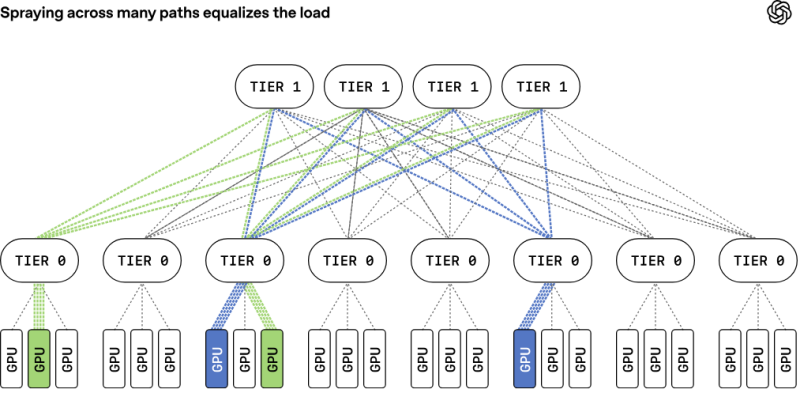

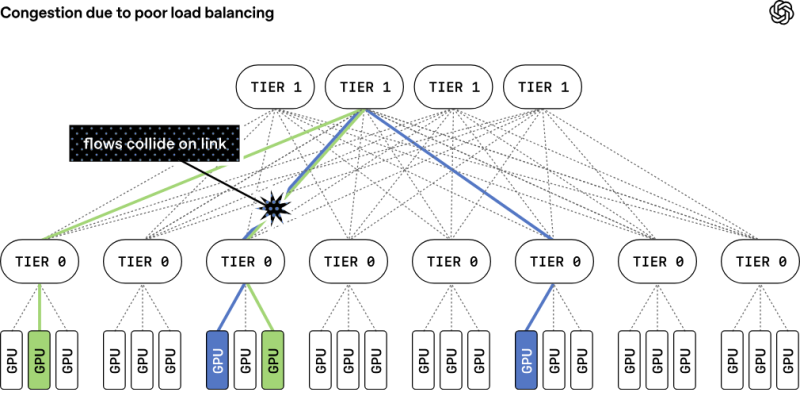

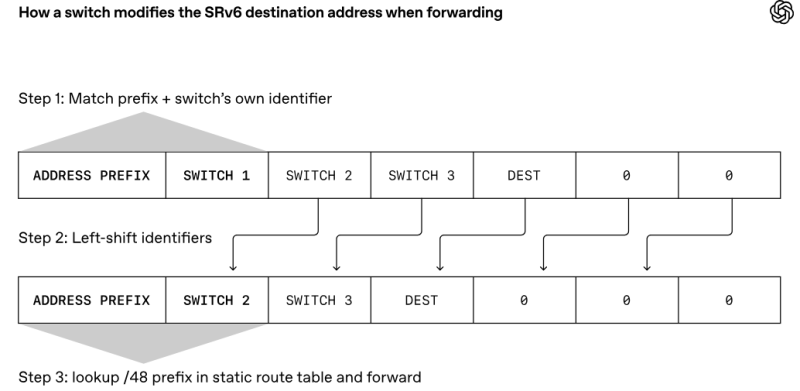

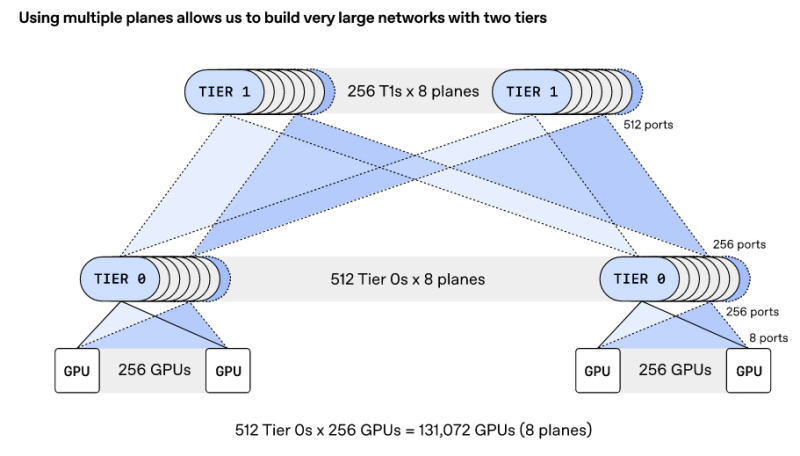

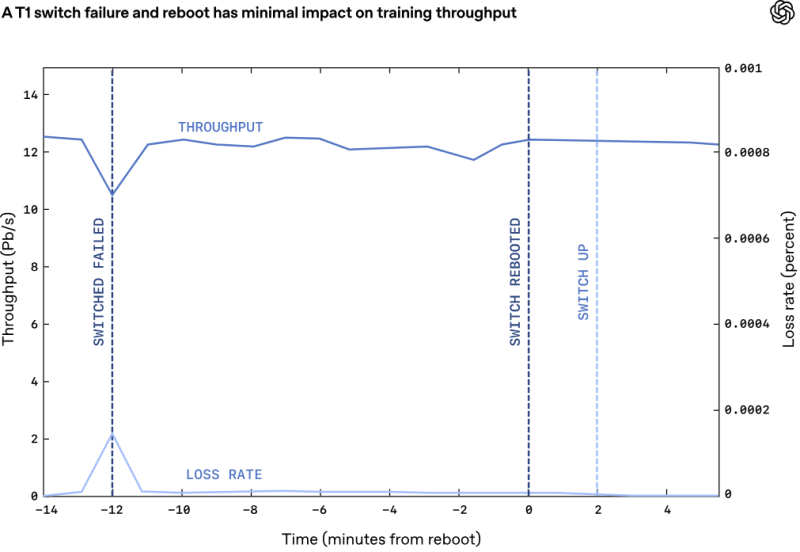

Сетевой протокол Multipath Reliable Connection (MRC) улучшит производительность и надёжность ИИ-кластеровOpenAI в партнёрстве с AMD, Broadcom, Intel, Microsoft и NVIDIA анонсировала технологию Multipath Reliable Connection (MRC) — сетевой протокол, призванный повысить производительность и отказоустойчивость масштабных GPU-кластеров, ориентированных на ресурсоёмкие задачи ИИ. MRC уже используется во всех крупных кластерах OpenAI c NVIDIA GB200, в том числе в первом ЦОД Stargate, а также в ЦОД Microsoft по проекту Fairwater. Отмечается, что при обучении больших языковых моделей (LLM) каждый этап предполагает огромное количество пересылок данных между узлами в кластере. При этом единственная задержка при подобных транзакциях может повлиять на весь процесс, потенциально провоцируя простои тысяч ИИ-ускорителей. Такие прерывания приводят к снижению эффективности использования имеющихся вычислительных мощностей и к увеличению временных затрат. Наиболее распространёнными причинами задержек и нестабильности при передаче данных являются перегрузка сети, сбои в работе каналов связи и коммутационных устройств. Причём по мере увеличения масштабов кластеров проблемы усугубляются: неполадки возникают всё чаще, а их устранение становится более затруднительным. Протокол MRC, как утверждается, устраняет ряд ключевых недостатков сетей Ethernet применительно к инфраструктурам ИИ. В частности, вводятся такие механизмы, как адаптивная многопутевая передача данных, многоканальные перекрёстные Ethernet-фабрики, «распыление» пакетов, быстрое восстановление после сбоев и пр. MRC коренным образом меняет способ передачи трафика по сети. Традиционные платформы RoCE обычно привязывают поток данных к одному сетевому пути, что может снижать эффективность при возникновении неполадок. MRC же распределяет пакеты из одной серии одновременно по сотням путей и нескольким физическим сетевым каналам. В пакетах содержатся сведения об их конечном назначении, что позволяет ускорителям размещать данные в нужной последовательности, даже если пакеты поступают не по порядку. MRC хранит информацию о состоянии множества используемых путей: если обнаруживается перегрузка какого-либо из них, выбирается альтернативный маршрут, что позволяет оперативно перераспределить нагрузку по всей сети. Ещё одной важной особенностью MRC является многоуровневая архитектура, которая изменяет саму физическую концепцию построения интерконнекта. Так, например, сетевой интерфейс 800GbE может быть разделён на 100GbE-каналы, связанные с восемью различными коммутаторами отдельными каналами. В результате можно построить восемь отдельных параллельных сетей. Такой подход оказывает значительное влияние на структуру кластера. В частности, коммутатор c 64 портами 800GbE можно использовать в конфигурации на 512 × 100GbE. И это позволяет построить сеть, объединяющую около 131 тыс. GPU, используя всего два уровня коммутации, против традиционных трёх- или четырёхуровневых топологий. В протоколе MRC также используется новый способ обработки перегрузок и потери пакетов в сетях Ethernet. Обычно применяется технология PFC (Priority Flow Control) — управление потоками на основе приоритетов: этот механизм предполагает приостановку передачи данных для конкретных классов трафика, а не для всего порта целиком. В случае MRC задействован иной подход, основанный на выборочных подтверждениях, явных запросах на повторную передачу и обрезке пакетов. Так, когда коммутатор сталкивается с перегрузкой, он может отрезать полезную нагрузку и переслать в пункт назначения только заголовок пакета, что позволяет получателю быстро идентифицировать отсутствующие данные и запросить повторную передачу. Утверждается, что это даёт возможность восстанавливаться после сбоев и перегрузок в течение микросекунд, что на порядки быстрее по сравнению с обычными архитектурами. С внедрением MRC сокращается необходимость в динамической маршрутизации. Если пакеты теряются на каком-либо пути, система на основе MRC просто перестаёт использовать этот путь. Вместо динамической маршрутизации применяется так называемая сегментная маршрутизация IPv6 (IPv6 Segment Routing, SRv6), которая позволяет отправителю напрямую задать путь прохождения пакета, прописав последовательность идентификаторов коммутаторов. При пересылке данных коммутатор проверяет наличие собственного идентификатора. Если он присутствует, он удаляет из пакета свой идентификатор и ищет следующий за ним идентификатор в статической таблице маршрутизации, которая указывает, куда необходимо отправить пакет данных. В отличие от динамической маршрутизации, такая статическая таблица формируется при первой настройке коммутатора и в дальнейшем не изменяется. MRC использует SRv6 для передачи пакетов по всем физическим каналам и уровням, а также по множеству путей в каждом из них. Если какой-либо путь становится недоступен, система игнорирует его. При этом коммутаторам не нужно пересчитывать маршруты или выполнять другие действия, кроме как строго следовать статическим маршрутам, заложенным в таблице. Протокол MRC выпущен в рамках проекта OCP. В целом, как отмечается, MRC обеспечивает три ключевых преимущества перед стандартными Ethernet-сетями для кластеров ИИ. Во-первых, MRC позволяет создавать многоуровневые высокоскоростные инфраструктуры для платформ с более чем 131 072 конечных точек, используя всего два уровня коммутаторов. Во-вторых, адаптивное распределение пакетов обеспечивает эффективную балансировку нагрузки, благодаря чему практически отсутствуют перегрузки в ядре сети. В-третьих, применение SRv6 обеспечивает быстрый обход сбоев и отправку пакетов только по работающим путям. Компания Broadcom заявила, что её сетевые адаптеры Thor Ultra, а также коммутаторы Tomahawk 5 и Tomahawk 6 изначально поддерживают функциональность MRC. В частности, Thor Ultra позволяет использовать 2, 4 или 8 параллельных сетей на одном порту и распределять трафик одновременно по 128 каналам. При этом Tomahawk 5 обеспечивает коммутационную способность до 51,2 Тбит/с, а Tomahawk 6 — до 102,4 Тбит/с. В свою очередь, NVIDIA отмечает, что протокол MRC, будучи расширением RoCE, совместим с решениями Spectrum-X Ethernet. OpenAI уже использовала MRC при обучении нескольких ИИ-моделей, задействовав коммутаторы Broadcom и NVIDIA. Конкуренцию MRC составляет схожий во многих аспектах Ultra Ethernet.

12.05.2026 [09:35], Сергей Карасёв

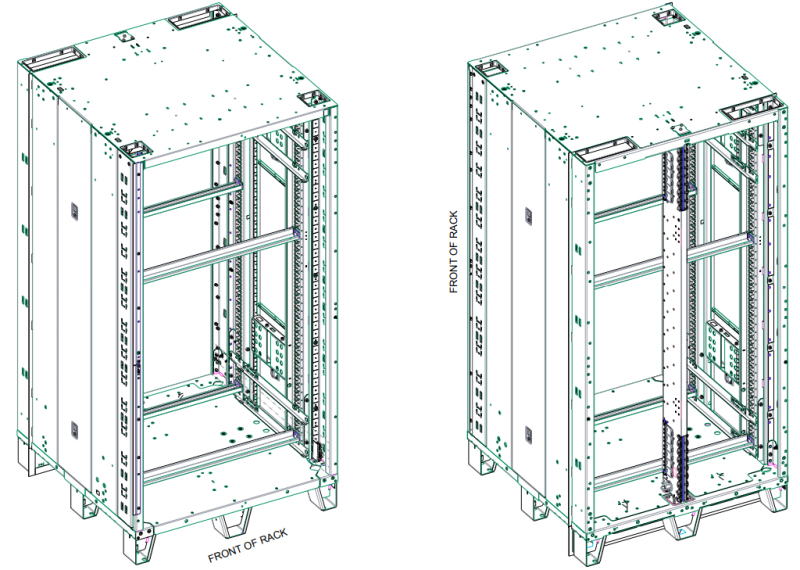

Meta✴ готовит пятитонные ИИ-стойки с чипами AMDНекоммерческая организация Open Compute Project (OCP) обнародовала спецификацию серверных стоек Open Rack Wide (ORW) от Meta✴, которая дополняет более общую базовую спецификацию. Стойки разработаны для дата-центров, ориентированных на ИИ и НРС, разработанную Meta✴ и дополняющую базовый вариант стандарта. Стандарт ORW положен в основу платформы AMD Helios. Габариты стоек ORW составляют 2390 мм в высоту, 1219 мм в глубину и 1200 мм в ширину. Таким образом, стойка ORW вдвое шире стандартных стоек Open Rack V3 (600 мм). Конструкция ORW рассчитана на плотное размещение тяжёлого оборудования — крупногабаритных серверов с GPU-ускорителями, мощных СХД и пр. Грузоподъёмность рамы должна составлять 4700 кг (без учёта массы собственно стойки). Подчёркивается, что на показатель влияет множество факторов, включая пространственное распределение IT-оборудования, количество и расположение поперечных распорок и пр. Любые дополнительные элементы, установленные в стойку, необходимо учитывать при расчёте максимальной грузоподъёмности. ORW-стойка рассчитана на 44OU-единицы для узлов удвоенной ширины или 47U для 19″ узлов. Возможно комбинирование различных типов оборудования — конструкция стойки предусматривает наличие вырезов для кронштейнов крепления серверов обоих типов. Также прописана поддержка обычных 21″ шасси, в этом случае ёмкость стойки составляет 88OU. Интересно, что NVIDIA в стойках Kyber перейдёт к вертикальным узлам. Впрочем, компания наверняка тоже отдаст спецификации OCP, как это было со стойкой Oberon. В стойках ORW обеспечивается циркуляция воздуха от фронтальной области к тыльной. В обычных условиях эксплуатации в верхней, нижней и боковых частях не предусмотрены отверстия, через которые горячий воздух может проникать в холодный коридор дата-центра. Конструкция должна включать передний и задний каналы для организации кабелей, которые могут укладываться вертикально во всех четырёх углах рамы. В спецификации сказано, что доступ к высоковольтным линиям на шине постоянного тока должен быть исключен, если она подключена к IT-оборудованию. Стойки ORW совместимы с различными конструкциями шин питания — как с воздушным, так и с жидкостным охлаждением. Интерфейс шинопровода аналогичен ORv3 HPR (High Power Rack). Предполагаемое номинальное входное напряжение, обеспечиваемое модулем питания ORv3, составляет 51 В DC. Вся подсистема питания IT-оборудования должна поддерживать входные напряжения в диапазоне от 46 В до 52 В. Требуются датчики напряжения и температуры, силовой (100 А) и обратный (100 А) каналы, а также заземление. Типовая мощность — до 4,8 кВт на коннектор (узел). Нужно отметить, что OCP продвигает перевод дата-центров на DC-питание. Предполагается, что такая архитектура позволит повысить плотность и энергоэффективность вычислений. Концепция предусматривает возможность выделение подсистемы питания в отдельную стойку и переход к 400/800 В DC с выносом AC/DC-преобразование AC/DC за пределы машинных залов. Передачу энергии планируется осуществлять через общую DC-шину, соединяющую все стойки, или по отдельным кабелям (либо комбинированно). Между тем перед операторами ИИ-дата-центров встаёт проблема, связанная с ростом массы IT-оборудования. Современные стойки 42U с набором серверов весят 680–1150 кг, а для ORW предусмотрена нагрузка до почти 5 т. Из-за этого возникают сложности с обустройством полов и перекрытий. Из-за большой массы оборудования многие операторы предпочитают строить одноэтажные дата-центры вместо многоэтажных. Хотя как раз для ИИ-кластеров с точки зрения интерконнекта эффективнее именно последние. Однако для Meta✴, возможно, важнее скорость развёртывания — она даже обходится без капитального строительства.

05.05.2026 [14:15], Руслан Авдеев

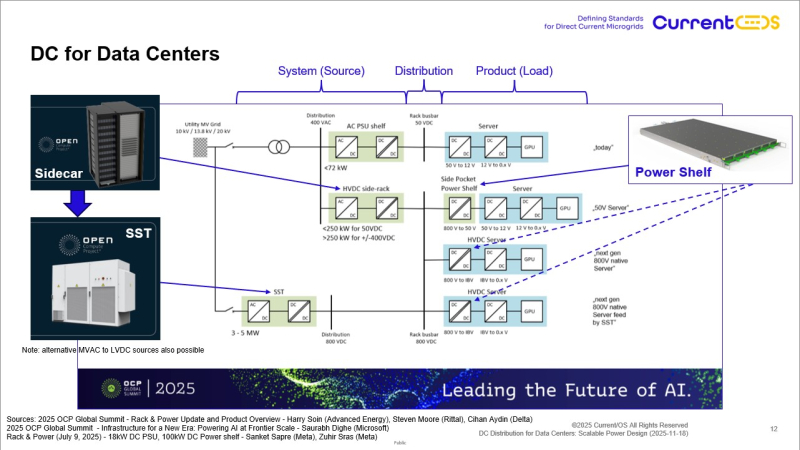

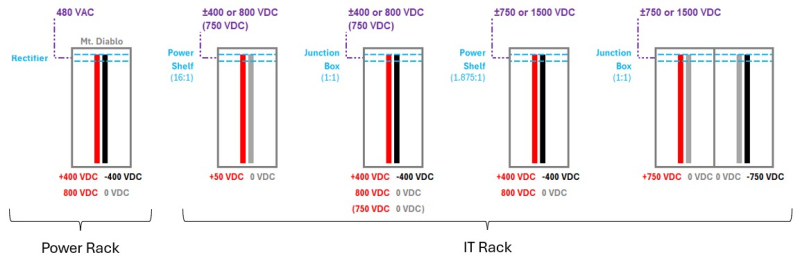

OCP продвигает переход ЦОД на DC-питание для повышения плотности и энергоэффективности вычисленийВходящие в состав Open Compute Project (OCP) компании призывают участников глобальной цифровой инфраструктуры присоединиться к своей инициативе, направленной на внедрение в ЦОД питания от постоянного тока (LVDC). Предполагается, что подобные решения станут основой интенсивных ИИ-вычислений, сообщает Datacenter Dynamics. Google, ABB и Siemens создали рабочую группу, изучающую стандартизацию LVDC-решений для дата-центров. В марте 2026 года опубликованы аргументы в пользу DC-питания машинных залов, а также обозначены ключевые вызовы для подобного перехода. Представители OCP подчеркнули необходимость более активного участия индустрии в стандартизации. Во всяком случае, с термином LVDC уже определились, поскольку некоторые компании называли такие системы HVDC. В классической архитектуре питания переменный ток (AC) поступает из сети, после чего он преобразуется в DC для энергохранилищ или ИБП, потом снова в AC для подачи к серверным стойкам, где для электроснабжения серверных компонентов снова происходит преобразование в DC. В результате происходит потеря энергии на всех этапах, из-за чего падает общая энергоэффективность системы.

Источник изображения: mostafa mahmoudi/unspalsh.com В индустрии давно обсуждают возможный переход на постоянный ток в качестве основного источника энергии в качестве более эффективной альтернативы AC. Тем не менее концепция пока не получила широкого распространения, хотя ситуация стремительно меняется на фоне быстрого роста энергопотребления ИИ-мощностями. Если традиционные серверные стойки потребляют считанные киловатты, то современные системы высокой плотности требуют около 120 кВт, а в скором будущем, по оценкам NVIDIA, речь может идти об 1 МВт на стойку. Первым шагом к внедрению DC называется проект Mount Diablo, разработанный участниками OCP — Microsoft, Meta✴ и Google. Концепция предусматривает вынос подсистемы питания в отдельную стойку и переход к 400 В DC, чего достаточно для ИИ-нагрузок. При этом подчёркивается, что это — лишь временное решение, усложняющее общую архитектуру, и в будущем необходимо перейти к стандартизированной архитектуре с возможностью масштабирования. Новая модель распределения энергии предполагает, что преобразование AC/DC вообще нужно вынести за пределы серверных, на уровень трансформаторов среднего напряжения, что позволит высвободить в ЦОД дополнительные площади. Передача энергии будет осуществляться либо через общую DC-шину, соединяющую все стойки, либо по отдельным кабелям, либо комбинированно. Потенциально такая архитектура позволяет подавать в серверные не только 800 В DC, но и до 1,5 кВ в будущем. Для преобразования тока рассматриваются как традиционные трансформаторно-выпрямительные установки (TRW), так и новые твердотельные трансформаторы (SST), значительно более эффективные, но пока не доросшие до гигаваттного уровня. Рабочая группа OCP намерена выпустить обновлённый план развития DC-архитектуры в этом году, и призывает участвовать в разработке стандартов больше компаний. При этом подчёркивается, что ни один поставщик технологических решений не сможет решить задачу самостоятельно. Эксперты уверяют, что будущее — за открытыми стандартами. В 2025 году сообщалось, что Google готовит мегаваттные стойки с питанием 400 В и СЖО для ИИ-платформ будущего, Infineon и NVIDIA разрабатывают архитектуру HVDC-питания для ИИ ЦОД на 800 В, а ABB поддержит NVIDIA в их внедрении. В октябре 2025 года OCP запустила инициативу Open Data Center for AI для стандартизации инфраструктуры передовых ИИ ЦОД с мегаваттными стойками.

04.05.2026 [09:14], Сергей Карасёв

Celestica представила коммутаторы DS6000 c 64 портами на 1,6 Тбит/сКомпания Celestica анонсировала коммутаторы семейства DS6000 для дата-центров: устройства ориентированы на ресурсоёмкие нагрузки, такие как обучение ИИ-моделей и инференс. В основу новинок положен чип Broadcom Tomahawk 6 (TH6), обеспечивающий коммутационную способность до 102,4 Тбит/с. Дебютировали модели DS6000 и DS6001. Первая выполнена в форм-факторе 3U для стандартной 19″ серверной стойки и оснащена воздушным охлаждением. Вторая модификация рассчитана на 21″ стойки OCP ORv3; при этом задействовано гибридное воздушно-жидкостное охлаждение. Коммутаторы оснащены 64 портами OSFP224 с пропускной способностью 1,6 Тбит/с. Возможна работа в режимах 50GbE/100GbE/200GbE/400GbE/800GbE. Кроме того, есть два порта управления 50GbE (SFP56), разъёмы RJ45 и OOB 1GbE для управления, консольные порты USB 3.0 Type-A и Type-C. В зависимости от комплектации устройства несут на борту процессор Intel Xeon-D с четырьмя, восемью или десятью ядрами. Объём оперативной памяти DDR4 достигает 64 Гбайт. Установлен SSD типоразмера M.2 вместимостью 512 Гбайт. Модель DS6000 оснащена четырьмя блоками питания с резервированием мощностью 3200 Вт (с возможностью горячей замены). Версия DS6001 использует шину 48 В DC. Габариты составляют соответственно 438 × 129,8 × 712,2 мм и 537 × 94 × 805 мм, масса — 35 и 30 кг. Диапазон рабочих температур — от 0 до +40 °C. Заявленный показатель MTBF (средняя наработка на отказ) превышает 150 тыс. часов. Упомянута поддержка платформы SONiC. Компания Celestica отмечает, что коммутаторы серии DS6000 спроектированы для устранения узких мест в масштабных ИИ-кластерах. Устройства, как ожидается, станут основой для ЦОД-инфраструктур следующего поколения, оптимизированных для генеративного ИИ и машинного обучения. Приём заказов на коммутаторы уже начался. |

|