Материалы по тегу: nvidia

|

23.04.2026 [11:38], Сергей Карасёв

Selectel представил российский «AI-Сервер» с поддержкой до 16 GPUРоссийский провайдер облачной инфраструктуры Selectel анонсировал «AI-Сервер» — высокопроизводительную систему формата 8U, ориентированную на ресурсоёмкие нагрузки, такие как обучение ИИ-моделей, инференс, рендеринг, финансовое моделирование, виртуальные рабочие столы и аналитика в реальном времени. В состав платформы входят плата Selectel SSE-MB-201 и специализированное шасси SSECH-812. Задействованы два процессора Intel Xeon 6 6500/6700 поколения Granite Rapids-SP. Поддерживается до 8 Тбайт оперативной памяти DDR5-6400 в виде 32 модулей. Могут быть установлены 12 накопителей с интерфейсом NVMe/SAS/SATA, а также два SSD типоразмера M.2 с интерфейсом PCIe 5.0. Упомянуты контроллер BMC AST2600, модуль TPM 2.0, 176 линий PCIe (PCIe 5.0 / CXL и OCP 3.0) и два сетевых порта 1GbE. Сервер допускает монтаж до 16 ускорителей на базе GPU формата FHFL двойной ширины или до восьми ускорителей FHFL тройной ширины. В частности, могут применяться карты NVIDIA H100, H200, RTX Pro 6000 Blackwell Server Edition и др. Питание обеспечивают семь блоков мощностью 2000 Вт с сертификатом 80 Plus Platinum. Selectel разрабатывает BIOS и BMC собственными силами: это, как утверждается, даёт полный контроль над процессом и возможность оперативно вносить изменения и дорабатывать функциональность в соответствии с запросами заказчиков. Подчёркивается, что усиленные подсистемы питания и охлаждения рассчитаны на высокую плотность ускорителей и длительную работу под нагрузкой. Конструкция упрощает обслуживание и эксплуатацию сервера в ЦОД. «Запуск нового AI-сервера является частью стратегии Selectel по формированию собственного портфеля серверных решений, включая специализированные инфраструктурные продукты для задач в сфере ИИ. Новая аппаратная платформа обеспечит стабильную, быструю и предсказуемую работу AI-моделей в реальных условиях с полным контролем над данными и производительностью», — говорит компания.

22.04.2026 [10:45], Сергей Карасёв

Foxconn наладит массовое производство CPO-коммутаторов в III квартале 2026 годаТайваньский контрактный производитель электроники Foxconn начал пробные поставки коммутаторов с интегрированной оптикой CPO (Co-Packaged Optics). Об этом, как сообщает DigiTimes, рассказал Брэнд Ченг (Brand Cheng), председатель совета директоров Foxconn Industrial Internet (FII) — подразделения, которое специализируется на сетевых продуктах для облачных платформ. По его словам, отгрузки образцов CPO-коммутаторов FII организовала в I квартале 2026-го, тогда как их массовое производство запланировано на III четверть текущего года. Ожидается, что спрос на такое оборудование будет стремительно расти. По данным отраслевых исследований, продажи CPO-коммутаторов увеличатся с примерно 23 тыс. единиц в 2026 году до более чем 200 тыс. штук в 2030-м. Таким образом, прогнозируемый показатель CAGR (среднегодовой темп роста в сложных процентах) составляет 144 %. Как отмечает Ченг, FII рассчитывает на годовой объём продаж CPO-коммутаторов более 10 тыс. штук. По оценкам компании, выпуск таких устройств обеспечит существенно более высокую валовую прибыль по сравнению с нынешними продуктами 400–800G. Подчёркивается, что экосистема технологий CPO развивается в комплексе с архитектурами NVIDIA QuantumX и SpectrumX, а также Broadcom Tomahawk. Речь идёт о проектировании специализированных чипсетов и оптических компонентов, внедрении передовых технологий упаковки, системной интеграции и пр. По сложности такие решения значительно превосходят традиционные сетевые устройства. Ченг также сообщил о масштабировании производства ИИ-ускорителей NVIDIA GB200 и GB300. Кроме того, наблюдается рост заказов на выпуск ASIC-изделий со стороны крупнейших облачных провайдеров: ожидается, что отгрузки таких продуктов значительно увеличатся во II половине года. Ченг подчеркнул, что более 60 % основных элементов серверных ИИ-стоек теперь производится собственными силами. Компания сформировала необходимые запасы компонентов, в том числе чипов памяти, для выполнения заказов в сфере ИИ, включая выпуск GB200 и GB300. В 2025 году выручка FII составила ¥902,89 млрд ($132,36 млрд), что на 48,2 % больше, чем годом ранее. При этом чистая прибыль поднялась на 51,99 %, достигнув ¥35,286 млрд ($5,17 млрд). Выручка в облачном сегменте составила ¥602,679 млрд ($88,35 млрд), увеличившись на 88,7 % в годовом исчислении: на неё пришлось почти 70 % от общего объёма поступлений.

21.04.2026 [21:56], Андрей Крупин

«Турбо облако» представило платформу для быстрого запуска ИИ-моделей с поминутной тарификацией и автоматическим масштабированиемОблачный провайдер «Турбо облако» (входит в коммерческий IT-кластер «Ростелекома»), запустил Inference Platform — платформу для развёртывания и эксплуатации моделей искусственного интеллекта, в основу которой положены ускорители NVIDIA H200 SXM с интерконнектом InfiniBand. Inference Platform поддерживает различные типы ИИ-моделей, включая open source-решения. Пользователи могут загружать собственные модели или использовать контейнерные образы, разворачивая их в облачной среде без дополнительных инфраструктурных настроек. Сервис обеспечивает автоматическое масштабирование ресурсов (автоскейлинг) в зависимости от нагрузки. Такой подход позволяет оптимизировать использование GPU и снизить затраты при нерегулярной нагрузке, говорит компания. Платформа поддерживает распределённый инференс, позволяя запускать модели объёмом до 1 тплн параметров с размещением на нескольких вычислительных узлах. Также доступно гибкое использование GPU-ресурсов, включая их дробление под задачи меньшего объёма. Дополнительным преимуществом является поминутная тарификация ресурсов, гарантирующая более точный контроль расходов по сравнению с почасовой оплатой.

Источник изображения: Omar Lopez-Rincon / unsplash.com В настоящее время новый продукт доступен для тестирования: компании могут оценить его возможности на собственных моделях.

21.04.2026 [18:29], Руслан Авдеев

Глава Microsoft пообещал досрочно ввести в эксплуатацию самый мощный в мире ИИ ЦОД проекта FairwaterМногоцелевой ИИ-кампус Microsoft Fairwater в Висконсине строится ускоренными темпами и будет введён в эксплуатацию раньше запланированного срока, сообщает Datacenter Dynamics. Об этом на днях упомянул глава Microsoft Сатья Наделла (Satya Nadella). По его словам, это самый мощный в мире ИИ ЦОД, объединяющий «сотни тысяч» NVIDIA GB200, а оптоволокна в нём хватит, чтобы «обернуть планету четыре раза». Пока нет данных, готова ли уже площадка Fairwater к эксплуатации или просто будет сдана несколько раньше. О том, что кампус в городке Маунт-Плезант (Mount Pleasant) будет вот-вот достроен, сообщалось ещё осенью 2025 года. Тогда же компания объявила, что суммарные инвестиции в площадку в течение нескольких лет составят $7,3 млрд. Строительство началось ещё в 2023 году на территории производственной площадки Foxconn. Первоначально планировалось застроить более 127 га. Впоследствии компания получила разрешение застроить ещё 405 га, а чуть позже она купила за $43 млн ещё 65 га. В январе 2026 года Microsoft дано разрешение на строительство на территории кампуса ещё 15 зданий ЦОД. На данный момент Fairwater включает три больших объекта общей площадью около 11,5 тыс. м2. Для строительства понадобилось 74,9 км глубоких свай для фундамента, более 12 тыс. т строительной стали, 193 км подземного кабеля среднего напряжения и 116,8 км трубопроводов.

Источник изображения: Microsoft Похожий кампус Fairwater в Атланте (Джорджия) заработал в ноябре 2025 года, он будет напрямую связан с кампусом в Висконсине. Есть и планы строительства ЦОД в Лидсе (Leeds, Великобритания). По имеющимся данным компания, «близка» к получению разрешения на строительство в Западном Йоркшире. Кампус планируется построить на территории бывшей электростанции, он будет включать три трёхэтажных ЦОД (LBA10, 11 и 12) объекта площадью около 39 тыс. м2 каждый. Также на территории комплекса разместится электроподстанция. Строительство может стартовать в начале 2027 года.

19.04.2026 [14:20], Владимир Мироненко

TD Synnex арендовала у Nebius кластеры NVIDIA B300, чтобы дать ИИ-мощности партнёрами и клиентамTD Synnex, американский дистрибьютор и агрегатор IT-решений, объявил о расширении своего портфеля услуг ИИ-инфраструктуры (AI Infrastructure-as-a-Service) в Северной Америке за счёт резервирования более тысячи ускорителей в составе выделенных кластеров NVIDIA HGX B300, развёрнутых в ИИ-облаке Nebius. Мощности в Nebius AI Cloud предназначены для партнёров и клиентов TD Synnex, и это, по словам компании, первая сделка такого рода. Дистрибьютор отметил, что заблаговременное выделение GPU-мощностей помогает партнёрам преодолеть один из наиболее существенных барьеров на пути внедрения ИИ в корпоративной среде: непостоянный доступ к вычислениям. Партнёры смогут напрямую выделять зарезервированные мощности для рабочих нагрузок клиентов, ускоряя переход от экспериментов в области ИИ к продуктовым решениям. Облачная платформа TD Synnex x Nebius AI Cloud соответствует эталонной архитектуре NVIDIA Enterprise Reference Architecture (Enterprise RA) и поддерживает непрерывные рабочие нагрузки обучения и инференса. Встроенные функции безопасности, изоляции и операционной надёжности обеспечивают готовую основу для партнёров, предоставляющих корпоративные решения в области ИИ. Благодаря партнёрской экосистеме TD Synnex, инфраструктура может быть объединена с ПО NVIDIA AI Enterprise и продуктами независимых поставщиков ПО (ISV) для предоставления комплексных, готовых к использованию в корпоративной среде решений на основе ИИ.

Источник изображения: TD Synnex «Спрос на ИИ в корпоративной среде реален, но реализация застопоривается, когда инфраструктура не гарантирована», — говорит вице-президент по глобальному партнёрству Nebius. Как сообщил ресурсу CRN старший вице-президент по облачным технологиям, безопасности и ИИ в TD Synnex, сделка с Nebius вызвала такой большой интерес у партнёров по каналу продаж, что, по его мнению, первая партия инстансов «вероятно, будет раскуплена довольно быстро», и компания уже думает о будущем расширении. В прошлом месяце было объявлено о стратегическом партнёрстве NVIDIA и Nebius, в рамках которого производитель чипов инвестирует в стартап $2 млрд для разработки и строительства ИИ ЦОД.

15.04.2026 [17:54], Руслан Авдеев

Microsoft получит 30 тыс. ИИ-ускорителей NVIDIA Vera Rubin, от которых отказалась OpenAI, отменившая проект Stargate NorwayКомпании Microsoft и Nscale расширили партнёрство. Техногигант арендует у Nscale 30 тыс. ИИ-ускорителей NVIDIA Vera Rubin в норвежском ЦОД, которые изначально предназначались для проекта OpenAI Stargate Norway. Дополнительные вычислительные мощности станут доступны в 2027 году. Это фактически второй значимый отказ от развития кампусов Stargate в Европе. Ранее OpenAI приостановила создание ИИ ЦОД в Великобритании. А кампус Stargate в ОАЭ и вовсе находится под угрозой атак со стороны Ирана.

Источник изображения: Nscale По имеющимся данным, ускорители для Microsoft разместят в 230-МВт дата-центре в Квандале (Kvandal) в непосредственной близости от Нарвика (Narvik) на севере Норвегии. Площадка строится усилиями совместного предприятия норвежской промышленной группы Aker и Nscale. По некоторым данным, уход OpenAI из Норвегии был обусловлен неспособностью компании заключить взаимовыгодное соглашение с Nscale, передаёт Bloomberg. Тем не менее, OpenAI всё равно получит доступ к ИИ-мощностям в Норвегии посредством Microsoft Azure — компания так или иначе обязана потратить $250 млрд на облако Microsoft. В США OpenAI тоже отказалась от расширения флагманского кампуса Stargate в Техасе, и эти мощности тоже достанутся Microsoft. Microsoft уже имеет договорённости с Nscale, связанные с использованием норвежской площадки, в сентябре 2025 года было подписано соглашение об аренде мощностей на $6,2 млрд. Во сколько обойдётся новое, будет объявлено позже. Также компании уже подписали соглашения в Великобритании, Техасе и Португалии. Британские ЦОД Nscale тоже простаивать не будут — по данным Datacenter Dynamics, Google заключила сделку об аренде мощностей в Лондоне. Правда, это не те мощности, что изначально создавались для OpenAI.

10.04.2026 [13:53], Руслан Авдеев

Bridge Data Centres выгнала из своих ЦОД сингапурское ИИ-неооблако Megaspeed, подозреваемое в нарушении антикитайских санкций СШАПодконтрольный американской инвесткомпании Bain Capital оператор ЦОД Bridge Data Centres (BDC) отказал в размещении на своём объекте в Малайзии облачному провайдеру Megaspeed из Юго-Восточной Азии, которого США подозревают в незаконном предоставлении чипов NVIDIA Китаю, сообщает Bloomberg. Как сообщают знакомые с ситуацией источники, компанию Megaspeed International на объекте в Малайзии заменит облачный провайдер Zenlayer. Об этом свидетельствует служебная записка, направленная Bridge Data Centres своим кредиторам в феврале. Причина замены не называется, но источники сообщают, что оператор ЦОД пошёл на разрыв отношений с Megaspeed после того, как США инициировали расследование относительно структуры собственности компании, желая выяснить, не занималась ли она организацией доступа к передовым ИИ-чипам NVIDIA для Китая в нарушение американских экспортных ограничений. Для Megaspeed одним из ключевых вопросов является судьба ИИ-серверов на основе ускорителей NVIDIA, обнаруженных на объектах Bridge Data Centres прошлой осенью. Сингапурская Megaspeed является неооблачным ИИ-провайдером, объект в Малайзии был её крупнейшим активом. Megaspeed была сформирована в 2023 году путём отделения от китайской игровой компании. NVIDIA отказалась сообщать, известно ли ей об инциденте с участием BDC и посещали ли её представители объекты Megaspeed в последние месяцы в этом регионе. В 2025 году производитель проводил выборочные проверки Megaspeed в Юго-Восточнйо Азии. В декабре сообщалось, что компания намерена снова проверить бизнес «в ближайшем будущем». BDC объявила, что все 68,4 МВт мощности ЦОД, зарезервированные для Megaspeed, передадут облачному провайдеру Zenlayer из Лос-Анджелеса. Он специализируется на обучении ИИ-моделей.

Источник изображения: Hongwei FAN/unspalsh.com BDC считается одним из крупнейших операторов ЦОД в Азии, куда, по прогнозам экспертов, к 2030 году инвестируют к 2030 году около $800 млрд. Кредиты — ключевое средство финансирования масштабирования BDC, поэтому компания должна демонстрировать кредиторам стабильный приток средств от арендаторов. Чтобы развиваться дальше, Bridge Data Centres нужны миллиарды долларов. Минувшей зимой она начала привлекать дополнительный капитал. В марте оператор ЦОД вёл переговоры о привлечении $6 млрд для выхода на рынок Таиланда, тогда же компания намеревалась удвоить существующий кредит для расширения в Малайзии до $5 млрд. По данным Datacenter Dynamics, Megaspeed отрицает участие в любом нелегальном трафике чипов и сдаче в аренду вычислительных мощностей киатйским структурам. По словам её представителей, компания неоднократно проходила проверки со стороны американских и малайзийских властей, а также NVIDIA. Ранее она подчёркивала, что информация СМИ вводит в заблуждение, а сама компания действует строго в рамках всех правил экспортного контроля, в соответствии с самыми высокими «юридическими и этическими стандартами». Ещё несколько лет назад сообщалось, что китайские компании нашли лазейку в законах США для доступа к передовым ИИ-ускорителям и моделям в облаках AWS и Azure, а позже появилась информация, что Alibaba и ByteDance начали тренировать передовые ИИ-модели в ЦОД Юго-Восточной Азии. Тем не менее, в начале 2026 года в США принят «Закон о безопасности удалённого доступа» (Remote Access Security Act), расширяющий действие «Закона о реформе экспортного контроля». Это позволяет федеральным властям США «ограничивать возможности иностранных противников получать удалённый доступ к технологиям, включая ИИ-чипы, через облачные вычислительные сервисы». Другими словами, китайским компаниям запрещён доступ к передовым ускорителям в ЦОД и облаках за пределами КНР.

09.04.2026 [12:22], Руслан Авдеев

TrendForce: начало поставок NVIDIA Rubin задержится, а Hopper для Китая выпустят меньше, чем ожидалосьВысока вероятность, что поставки ИИ-ускорителей семейства NVIDIA Rubin начнутся позже, чем планировалось и в меньших объёмах, чем рассчитывали ранее. По данным The Register, это связано с вероятными проблемами с цепочками поставок. По словам экспертов TrendForce, на долю Rubin придётся 22 % всех поставок передовых ускорителей NVIDIA в 2026 году, хотя раньше в прогнозах речь шла о 29 %. Причинами называются задержки с проверкой новейшей памяти HBM4, применяемой с ускорителями, трудности с переходом на адаптеры NVIDIA ConnectX‑9, а также увеличение энергопотребления ИИ-систем и повышение требований к СЖО. Более того, будут ниже прежних прогнозов поставки ускорителей на архитектуре Hopper, включая модели H200, предназначенные для поставок в Китай. В январе 2026 года одобрили поставки в обмен на 25 % от выручки от продаж этих изделий. Пришлось уговаривать и сам Пекин, который одобрил импорт H200 в КНР лишь недавно. В марте глава NVIDIA Дженсен Хуанг (Jensen Huang) сообщил, что компания наращивает производственные мощности по выпуску H200 для Китая, и уже имеются заказы. TrendForce прогнозирует, что в 2026 году доля поставок ускорителей Hopper составит 7 % от общего объёма поставок NVIDIA, это ниже 10 %, как ожидалось ранее. Впрочем, в TrendForce предполагают, что их место и место недопоставленных Rubin займут чипы Blackwell, включая Blackwell Ultra. На долю Blackwell, вероятно, придётся 71 % об общего объёма продаж ускорителей NVIDIA за 2026 год. Кроме того, TrendForce предрекает неплохие перспективы недавно анонсированным инференс-ускорителям NVIDIA LPU Groq, предназначенным для совместной работы с «классическими» GPU вроде Rubin. Впрочем, из-за ограничений встроенной SRAM-памяти такие модели понадобятся в больших количествах, говорит TrendForce, предрекая спрос в «сотни тысяч единиц» в 2026 году и приблизительно вдвое больше — в следующем. При этом эксперты подчёркивают, что во II квартале цены на DRAM могут вырасти на 45–50 % дополнительно, вдобавок к росту на 75–80 %, отмеченному в I квартале. В последние месяцы цена на память, включая продукты вроде DDR5 и SSD, стремительно растут, они более чем втрое дороже, чем стоили год назад. В значительной степени это обусловлено спросом на ИИ-инфраструктуру и высокой цикличностью ценообразования на рынках модулей памяти.

08.04.2026 [09:22], Владимир Мироненко

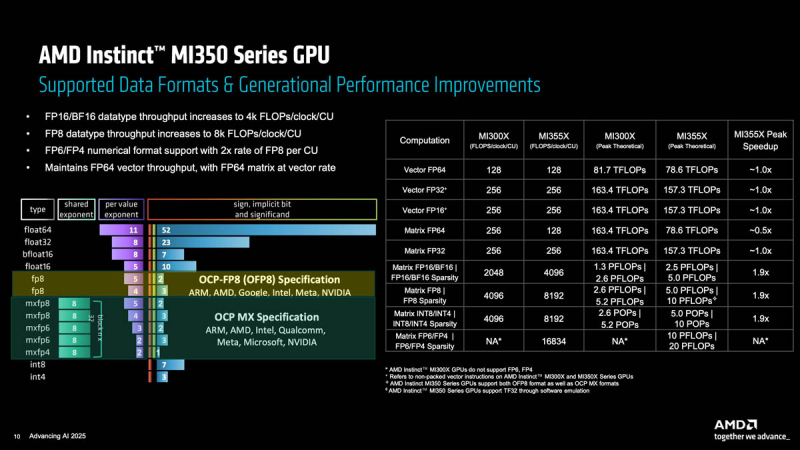

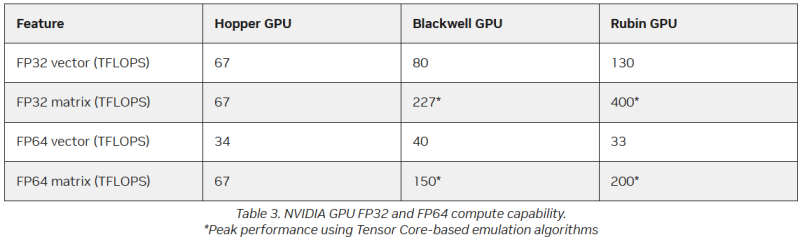

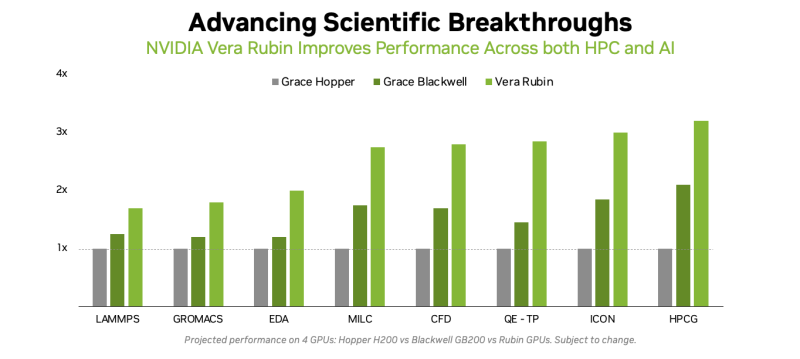

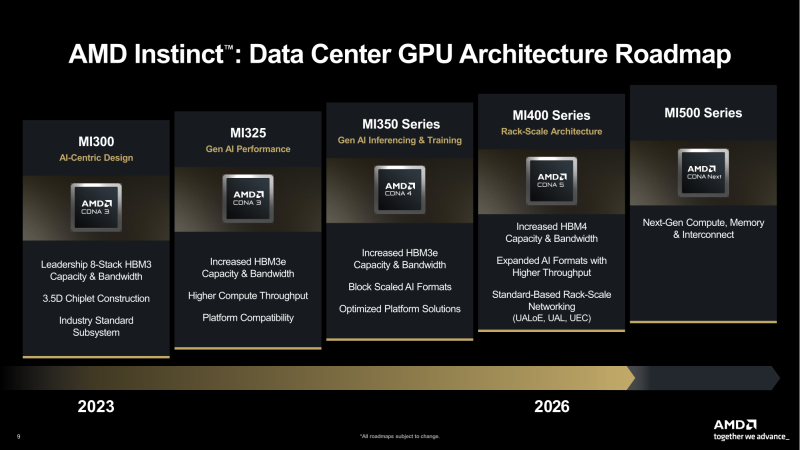

Стране нужен FP64: AMD пообещала повысить HPC-производительность ускорителей Instinct MI430XПосле анализа ограничений эмуляции FP64-вычислений с использованием схемы Озаки разработчики AMD пришли к выводу, что в настоящее время нет замены «сырой» производительности FP64. Как сообщил научный сотрудник AMD Николас Малайя (Nicholas Malaya) ресурсу HPCwire, чтобы обеспечить точность традиционных задач моделирования и симуляции, компания намерена нарастить нативную FP64-производительность ускорителя Instinct MI430X. Ускоритель станет основой суперкомпьютера Discovery, который будет установлен в Национальной лаборатории Ок-Ридж (ORNL) в 2028 году. Как отметил Кацухиса Озаки (Katsuhisa Ozaki) и два других японских исследователя, схема Ozaki — это многообещающая новая техника эмуляции, призванная позволить учёным выполнять высокоточные умножения матриц на оборудовании с поддержкой INT8/FP8, к которому относятся современные ИИ-ускорители, путём многократных вычислений с более низкой точностью. Текущие реализации Ozaki-I и Ozaki-II имеют ограничения, которые исключают их использование в реальных условиях, сообщил Малайя. Он указал на две основные проблемы. Во-первых, ПО не соответствует стандарту IEEE и не даёт того же результата, что и запуск кода на реальном оборудовании с поддержкой FP64. «В некоторых случаях это нормально, — сказал он. — Но во многих распространённых матрицах, которые мы наблюдали, влияние на точность довольно существенно.». Во-вторых, схема Озаки нацелена на квадратные матрицы. Если таковые в расчётах не используется, то итоговая производительность оказывается ниже, чем у нативного FP64-исполнения, говорит Малайя. Кроме того, HPC-приложения традиционно опираются на векторные вычисления, а не на тензорные или матричные, которые характерны для ИИ-нагрузок. Фактически ситуация ещё хуже — менее 10 % реальных HPC-приложений внесли изменения в DGEMM-коды, которые позволяют воспользоваться преимуществами Ozaki. «Насколько мне известно, с Ozaki-I, Ozaki-II или любой другой существующий метод нельзя применить к векторным инструкциям, — говорит Малайя. — Это ключевой нюанс, который, как мне кажется, упускается». На DGEMM действительно уходит много вычислительных ресурсов, что позволяет использовать схему Ozaki, «но она не решает 90 % HPC-задач». AMD собирается поддерживать эмуляцию Ozaki на своих чипах, сообщил Малайя. «Нет причин этого не делать. Это ПО. <…> И у вас могут быть библиотеки, которые позволяют динамически переключаться между нативными расчётами и Ozaki и, вероятно, оценивать его», — сказал он, добавив, что программную эмуляцию можно иметь в виду в качестве резервного варианта для FP64-вычислений. Но в конечном итоге Ozaki не является работоспособной альтернативой «железу» с FP64, сказал Малайя, уточнив, что не он один так считает. В настоящее время компания разрабатывает MI430X, специализированную версию ускорителя следующего поколения MI450, который будет обладать значительной FP64-производительностью. По словам Малайи, она будет значительно больше, чем у ускорителя MI355X, который обеспечивает 78,6 Тфлопс. По факту, это меньше, чем у предыдущей модели MI325X, которая обеспечивала 81,7 Тфлопс — в обоих случаях речь и про векторные, и про матричные FP64-вычисления. В любом случае, у всех этих чипов — от MI325 до MI430 — производительность больше, чем у чипов NVIDIA. И Hopper (34 Тфлопс), и Blackwell (40 Тфлопс) уже были медленнее в векторных FP64-вычислениях, но у Hopper хотя бы были нативные 67 Тфлопс в матричных расчётах, тогда как Blackwell в этом случае уже перешёл к схеме Озаки с «ненативными» 150 Тфлопс. Про Blackwell Ultra, где FP64-производительность упала до 1,3 Тфлопс, NVIDIA в данном контексте вообще не вспоминает, но обещает, что у Rubin будет 33 Тфлопс в векторных FP64-расчётах и 200 Тфлопс в матричных (тоже с Озаки). NVIDIA обосновывает отказ от развития аппаратных FP64-блоков тем, что увеличение собственно вычислительной мощности FP64 на самом деле не ускорит научные приложения, поскольку на практике они упрутся в возможности регистров, кешей и HBM. Rubin обеспечит пропускную способность HBM до 22 Тбайт/с, что в 2,8 раза больше, чем у Blackwell. Instinct MI325X предлагает 6 Тбайт/с, MI355X — 8 Тбайт/с, а у MI430X будет уже 19,6 Тбайт/с, сообщил Малайя. По словам Малайи, лучше всего синхронно «вкладываться» и в HBM, и в количество операций с плавающей запятой. «На самом деле важен коэффициент байт/флопс. С нашей точки зрения, необходимо поддерживать гораздо более близкое соотношение к тому, что мы видим в современных продуктах, — сказал он. — Необходимо значительно приблизиться к этому соотношению с точки зрения увеличения производительности FP64, чтобы сохранить тот же уровень, как это называют, арифметической интенсивности». Поскольку AMD обеспечит 2,5-кратное увеличение ПСП HBM от MI355 до MI430X, аналогичное 2,5-кратное увеличение производительности FP64 также будет оправдано. Таким образом можно примерно прикинуть, что MI430X может обеспечить производительность FP64 от 192 до 204 Тфлопс в зависимости от того, какой из них будет базовым: более новый MI355 или более быстрый MI325, сообщил HPCwire, добавив, что это всего лишь предположение, поскольку компания пока не сообщила точные характеристики будущих чипов. Кроме того, не до конца ясно, будет ли FP64-производительность одинакова для векторных и матричных расчётов. FP64-вычисления «очень важны» для «Миссии Генезис» (Genesis Mission), заявил ранее заместитель министра энергетики США (DoE) по науке и инновациям Дарио Гил (Darío Gil). Он отметил, что и глава AMD Лиза Су (Lisa Su), и глава NVIDIA Дженсен Хуанг (Jensen Huang), выразили твёрдую приверженность FP64, подтвердив, что поддержка формата будет продолжаться. «FP64 имеет решающее значение для поддержки рабочих нагрузок моделирования и симуляции, не только для дальнейшего развития традиционных научных исследований, но и для предоставления исходных данных для обучения новых ИИ-моделей», — добавил Гил. «Всегда существует баланс между тем, сколько требуется FP64- и FP16-вычислений», — сказал Малайя. «AMD утверждает, что нам необходимо поддерживать широкий спектр типов данных в зависимости от их потребностей. Не получится, чтобы всем были нужны FP64, которых хватит для всего.», — отметил он. Малайя сообщил, что всегда бывают исключения. Например, ИИ-симуляции сворачивания белков, такие как AlphaFold и Openfold, используют FP32. Да и некоторым традиционным HPC-задачам, таким как молекулярная динамика, не требуется FP64-точность. Тем не менее, сейчас существует значительный неудовлетворенный спрос на FP64, утверждает учёный. «Что касается высокопроизводительных вычислений, мы считаем, что им по-прежнему потребуется много FP64, — сказал он. — Будут использоваться некоторые коды, которые полностью ограничены пропускной способностью памяти, и им не нужно так много. Но есть, например, коды вычислительной химии и некоторые другие, которые действительно имеют высокую арифметическую интенсивность, и они будут использовать FP64».

07.04.2026 [17:25], Руслан Авдеев

Австралийское неооблако Firmus при поддержке NVIDIA привлекло $505 млн и нарастило капитализацию до $5,5 млрд в преддверии IPOСпециализирующаяся на строительстве и эксплуатации ИИ ЦОД австралийская Firmus Technologies, поддерживаемая NVIDIA, привлекла $505 млн инвестиции при оценке капитализации в $5,5 млрд. Средства получены в ходе нового раунда финансирования перед выходом на IPO на Австралийской фондовой бирже (ASX) в конце 2026 года, сообщает Silicon Angle. Основанная в 2019 году Firmus строит и эксплуатирует ИИ-инфраструктуру на базе кластеров ускорителей. Дата-центры компании оптимизированы для использования с аппаратными решениями NVIDIA. Это позволяет клиентам развёртывать стандартизированные среды как для обучения ИИ-моделей, так и для инференса. Системы распределения питания и охлаждения обеспечивают работу при высоких вычислительных нагрузках. Доступ к вычислительным мощностям Firmus обеспечен через управляемые инфраструктурные экосистемы, в которых развёртывание, настройка и текущая работа осуществляется в рамках единой платформы. Сегодня компания строит флагманский кампус за $1,37 млрд в Лонсестоне (Launceston) на севере Тасмании. Для ЦОД предусмотрено использование систем рециркуляции воды, АКБ, а также питание от местной ГЭС. Предполагается, что ЦОД получит 36 тыс. NVIDIA GB300.

Источник изображения: Michael Jerrard/unspalsh.com Раунд финансирования возглавила Coatue Management при поддержке NVIDIA, играющей активную роль инвестора и стратегического партнёра. Полученные средства используют для масштабирования мощностей ЦОД: строительства новых объектов, развёртывания ИИ-ускорителей и создания необходимой инфраструктуры для энергоснабжения и охлаждения. В 2025 году компания уже привлекла порядка $715 млн, включая раунд на $327 млн в ноябре. В феврале она привлекла $10 млрд в кредит на строительство ИИ-фабрик Project Southgate. Минувший раунд был третьим и последним перед IPO в июне или июле. Оператор рассчитывает привлечь около $2 млрд дополнительных средств. Morgans Financial и Morgan Stanley представят информацию потенциальным инвесторам в ближайшие дни. Если IPO состоится, оно станет одним из крупнейших в Австралии за текущее десятилетие, более того — одним из крупнейших в истории страны, если принимать в расчёт только технологические компании. Обычно австралийские технобизнесы предпочитают для IPO биржи вне континента. Firmus на этом фоне выглядит довольно белой вороной, решившей сделать ставку на Australian Stock Exchange. В конце марта сообщалось, что австралийские власти принимают меры по ужесточению контроля за развитием ИИ-инфраструктуры на территории страны. В частности, они внедряют новую систему, связывающую утверждение проектов новых ЦОД с вливаниями в энергетику, управлением ресурсами и влиянием дата-центров на внутреннюю экономику. |

|