Материалы по тегу: nebius

|

22.05.2026 [16:06], Руслан Авдеев

Дата-центры Nebius в США получат топливные элементы Bloom Energy

bloom energy

hardware

nebius

ии

сделка

сша

топливные элементы

цод

экология

электропитание

энергетика

Неооблачная компания Nebius заключила договор с американским производителем твёрдооксидных топливных элементов (SOFC) Bloom Energy. Предполагается, что внедрение этой технологии обеспечит электроэнергией ЦОД Nebius в США, сообщает Datacenter Dynamics. В рамках первого этапа проекта предполагается развернуть «за счётчиком» 328 МВт мощностей на неназванном объекте. Ввод в эксплуатацию запланировали до конца 2026 года. По словам Nebius, дефицит энергоснабжения остаётся ключевым фактором, ограничивающим развитие ИИ-инфраструктуры. Bloom выбрали, поскольку её элементы практически не загрязняют окружающую среду, энергообеспечение организовывается в требуемые сроки и в объёмах, необходимых для ИИ-нагрузок. Nebius намерена и далее использовать эти SOFC по мере наращивания мощностей. Bloom Energy является ведущим поставщиком решений на основе SOFC для индустрии ЦОД. Такие элементы используют электрохимические реакции для преобразования топлива в электричество без его сжигания. По данным Bloom, это обеспечивает более высокую эффективность использования топлива и меньшие выбросы. Платформа работает с природным газом, биогазом и водородом. Топливные элементы Bloom созданы для высокоплотных ИИ ЦОД, а технологическая платформа соответствует новым стандартам 800 В DC. Сделка с Nebius стала последней в череде соглашений Bloom на рынке ЦОД. В апреле компания расширила партнёрство с Oracle, обещав обеспечить ей до 2,8 ГВт мощностей для ЦОД OpenAI. Также Bloom договорилась развернуть решения в 19 ЦОД Equinix общей мощностью более 100 МВт. Энергетическая компания American Electric Power (AEP) должна получить до 1 ГВт SOFC для автономного электроснабжения ИИ ЦОД. В 2025 году Bloom Energy заключила инвестиционное соглашение с Brookfield на $5 млрд. Nebius имеет ЦОД в США, на Ближнем Востоке и в Европе. Помимо собственного дата-центра в Финляндии в Мянтсяля (Mäntsälä), который вскоре будет дополнен ещё одним объектом — крупнейшим в Европе, по словам компании — в Лаппеенранте (Lappeenranta), компания арендует или намерена арендовать мощности в Великобритании (ЦОД Ark Data Centers в Лондоне), Франции (ЦОД Equinix в Париже), Израиле (несколько площадок Mega Or), а также Исландии (ЦОД Verne в Кеблавике). В США речь идёт о ЦОД DataOne в Вайнленде (Нью-Джерси) и ЦОД Patmos в Канзас-Сити (Миссури). На днях компания сообщила о намерении построить гигаваттный кампус ЦОД в Индепенденсе (Миссури).

14.05.2026 [09:46], Руслан Авдеев

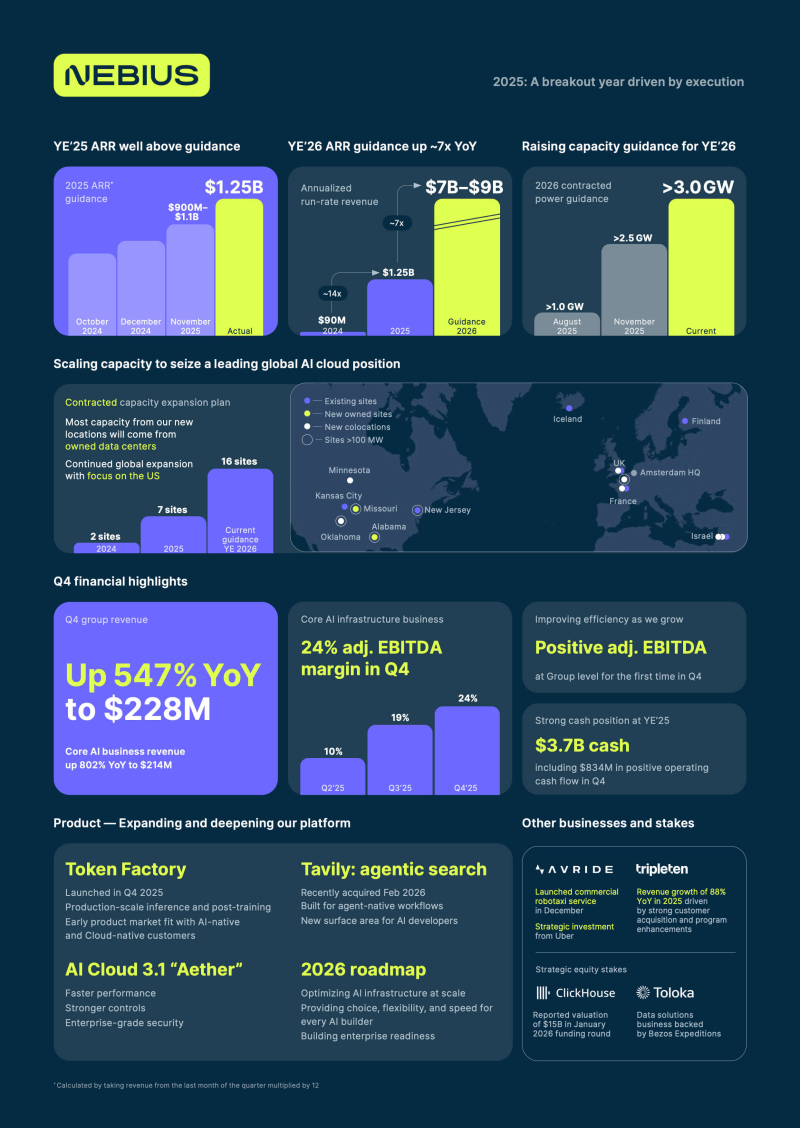

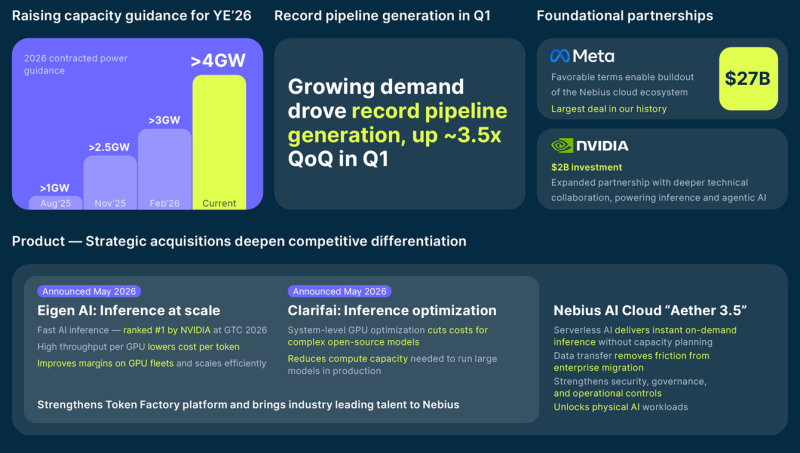

Квартальная выручка Nebius выросла на 684 % год к году, а облачного сегмента — на 841 %Базирующаяся в Нидерландах компания Nebius отчиталась о финансовых результатах I квартала 2026 года, параллельно объявив о проектах ускоренного строительства ИИ-инфраструктуры на основе гигаваттных ИИ-фабрик, масштабных кластерах ускорителей и вертикальной интегрированной платформы для инференса. В отчёте компании упоминается, что она уже имеет более 3,5 ГВт законтрактованных мощностей, к концу 2026 года этот показатель должен вырасти до более 4 ГВт. Дополнительно компания объявила о строительстве нового ИИ-кампуса мощностью 1,2 ГВт в Пенсильвании. Он станет дополнением ранее анонсированного объекта аналогичного масштаба в Индепенденсе (Independence, штат Миссури). Теперь более 75 % контрактной мощности Nebius приходится на собственную инфраструктуру, это отражает стремление к долгосрочному контролю энергоснабжения, земельных активов и операций ИИ ЦОД. Также Nebius раскрыла планы строительства ИИ-фабрики в Финляндии мощностью 310 МВт. Утверждается, что это один из крупнейших специализированных ИИ-объектов в Евросоюзе. Дополнительно объявлено новое расширение колокейшн-мощностей в Испании.

Источник изображения: Nebius На стадии активного строительства находятся ИИ-фабрики в Миссури и Алабаме, ввод в эксплуатацию запланирован на 2027 год. Всего принадлежащие компании мощности ИИ-фабрик оцениваются приблизительно в 3 ГВт на пяти площадках. Nebius продолжает реализовать модель «полностекового» облачного ИИ-провайдера, занимающегося ИИ-инфраструктурой, обучением моделей, инференсом, окрестрацией и агентными ИИ-сервисами. В отчётном квартале компания расширила программное портфолио благодаря сделкам с Tavily, Eigen AI и Clarifai. Также она укрепила взаимодействие с NVIDIA в сфере оптимизации инференса и архитектуры ИИ-фабрик. Ожидается, что к концу текущего года в эксплуатацию введут 0,8–1 ГВт подключённых мощностей, во II полугодии начнут развёртывать системы NVIDIA Vera Rubin NVL72 в ЦОД США и EMEA.

Источник изображения: Nebius В целом в I квартале выручка составила $399 млн (+684 % г/г), выручка облачного ИИ-бизнеса — $389,7 млн (+841 % г/г). Годовая регулярная выручка по подпискам и долгосрочным контрактам (ARR) на конец квартала составила $1,92 млрд, скорректированная EBITDA — $129,5 млн, рентабельность по EBITDA облачного ИИ-бизнеса — 45 %. В минувшем квартале капитальные затраты составили порядка $2,5 млрд, запас наличности — $9,3 млрд. Стратегические инвестиции NVIDIA в компанию составили $2 млрд. По словам главы компании Аркадия Воложа, строительство ведётся не только для удовлетворения текущих потребностей рынка, но и для будущего развития ИИ-индустрии. По мнению экспертов, компания всё активнее преобразуется из облачного стартапа, предоставляющего ИИ-ускорители, в вертикально интегрированного оператора ИИ-инфраструктуры, под контролем которого будут энергетика, земли, ИИ-фабрики и инференс-платформы, причём ставка делается на собственные гигаваттные кампусы с закреплением доступа к ключевым ресурсам для них до того, как ограничения доступа к ним усилятся.

03.05.2026 [12:26], Руслан Авдеев

Nebius купила стартап Eigen AI, повышающий производительность ИИ-моделейНеооблачная компания Nebius Group NV объявила о приобретении стартапа Eigen AI. Разработки последнего повышают эффективность использования ИИ-ускорителей благодаря оптимизации ПО. Покупатель готов потратить приблизительно $643 млн, сообщает Bloomberg: $98 млн наличными средствами и 3,8 млн акций Nebius. Оценка акций основана на их 30-дневной средневзвешенной цене. Соучредителями калифорнийской Eigen, насчитывающей 20 сотрудников, являются выпускники известной ИИ-лаборатории Массачусетского технологического института (MIT). Стартап специализируется на оптимизации открытых ИИ-моделей, предлагаемых OpenAI, Alibaba, Meta✴ и NVIDIA. Технология позволяет максимизировать количество токенов, генерируемых каждым из ускорителей NVIDIA. Это, как утверждает Nebius, позволяет предоставлять более качественные и недорогие услуги. Отделившаяся от российской Yandex компания Nebius относится к группе «неооблачных» бизнесов, обеспечивающих аренду ИИ-мощностей гигантам вроде Microsoft. В ноябре 2025 года Nebius представила продукт Token Factory для инференса, позволяющий конкурировать с ИИ-стартапами и облачными гиперскейлерами.

Источник изображения: Amina Atar/unsplash.com В условиях, когда мощности ЦОД в дефиците, Nebius резервирует часть собственных мощностей для нужд Token Factory, не передавая их клиентам в рамках долгосрочных контрактов. Это позволяет оптимизировать цены и расширить спектр предоставляемых компанией услуг. Цель Nebius — стать одним из ключевых игроков рынка инференса в следующие 18 мес. В Nebius сравнили получение максимального количества токенов с олимпийским видом спорта, а участников команды Eigen — с олимпийскими бегунами. Речь идёт уже о второй покупке Nebius за последние три месяца. В феврале компания заключила сделку по покупке Tavily и рассматривает и другие приобретения, хотя конкретные «кандидаты» пока не называются. В целом речь идёт о покупке компаний с командами и/или возможностями, ускоряющими реализацию анонсированной стратегии, либо добавляющих продукты и функции, доступные непосредственно клиентам. Компания подчёркивает, что не намерена выступать простым провайдером инфраструктуры, в то время как кто-то «сверху» будет работать с реальными клиентами.

19.04.2026 [14:20], Владимир Мироненко

TD Synnex арендовала у Nebius кластеры NVIDIA B300, чтобы дать ИИ-мощности партнёрами и клиентамTD Synnex, американский дистрибьютор и агрегатор IT-решений, объявил о расширении своего портфеля услуг ИИ-инфраструктуры (AI Infrastructure-as-a-Service) в Северной Америке за счёт резервирования более тысячи ускорителей в составе выделенных кластеров NVIDIA HGX B300, развёрнутых в ИИ-облаке Nebius. Мощности в Nebius AI Cloud предназначены для партнёров и клиентов TD Synnex, и это, по словам компании, первая сделка такого рода. Дистрибьютор отметил, что заблаговременное выделение GPU-мощностей помогает партнёрам преодолеть один из наиболее существенных барьеров на пути внедрения ИИ в корпоративной среде: непостоянный доступ к вычислениям. Партнёры смогут напрямую выделять зарезервированные мощности для рабочих нагрузок клиентов, ускоряя переход от экспериментов в области ИИ к продуктовым решениям. Облачная платформа TD Synnex x Nebius AI Cloud соответствует эталонной архитектуре NVIDIA Enterprise Reference Architecture (Enterprise RA) и поддерживает непрерывные рабочие нагрузки обучения и инференса. Встроенные функции безопасности, изоляции и операционной надёжности обеспечивают готовую основу для партнёров, предоставляющих корпоративные решения в области ИИ. Благодаря партнёрской экосистеме TD Synnex, инфраструктура может быть объединена с ПО NVIDIA AI Enterprise и продуктами независимых поставщиков ПО (ISV) для предоставления комплексных, готовых к использованию в корпоративной среде решений на основе ИИ.

Источник изображения: TD Synnex «Спрос на ИИ в корпоративной среде реален, но реализация застопоривается, когда инфраструктура не гарантирована», — говорит вице-президент по глобальному партнёрству Nebius. Как сообщил ресурсу CRN старший вице-президент по облачным технологиям, безопасности и ИИ в TD Synnex, сделка с Nebius вызвала такой большой интерес у партнёров по каналу продаж, что, по его мнению, первая партия инстансов «вероятно, будет раскуплена довольно быстро», и компания уже думает о будущем расширении. В прошлом месяце было объявлено о стратегическом партнёрстве NVIDIA и Nebius, в рамках которого производитель чипов инвестирует в стартап $2 млрд для разработки и строительства ИИ ЦОД.

31.03.2026 [14:57], Владимир Мироненко

Nebius построит в Финляндии крупнейший в Европе ИИ ЦОДПровайдер облачных ИИ-сервисов Nebius (ранее Yandex N.V.) объявил о строительстве новой «ИИ-фабрики» мощностью до 310 МВт в финском городе Лаппеенранта (Lappeenranta). Как сообщает Reuters, новый ИИ ЦОД стоимостью более $10 млрд станет крупнейшим на континенте. Это уже десятый объект компании, который финский девелопер Polarnode строит в Лаппеенранте. Ввод мощностей ИИ ЦОД будет производиться поэтапно, начиная с 2027 года. Сообщается, что он не будет привязан ни к одному из клиентов компании. Строительство ЦОД в Лаппеенранте следует за недавним расширением Nebius своего первого ЦОД в Финляндии в Мянтсяля (Mäntsälä) до 75 МВт, завершённым ранее в этом году. Компания планирует дальнейшее расширение в Финляндии, чему способствуют благоприятные условия — низкие цены на энергоносители, возобновляемые источники электроэнергии и прохладный климат, позволяющий снизить затраты на охлаждение. Компания отметила, что Лаппеенранта отвечает всем требованиям для строительства ИИ ЦОД, включая доступность оформления участка под объект и пропускную способность сетей. «Мы считаем, что и общая экосистема здесь очень благоприятна», — сказала компания агентству Reuters. ЦОД в Лаппеенранте станет крупнейшим объектом Nebius за пределами США, превзойдя недавно анонсированный проект мощностью 240 МВт невдалеке от Лилля (Lille, Франция). «Мы много лет работаем в Финляндии и рады расширению нашего присутствия здесь. Лаппеенранта станет значительным дополнением к нашей глобальной инфраструктуре ИИ и внесет существенный вклад в достижение наших целей по мощности», — заявил основатель и генеральный директор Nebius Аркадий Волож. ЦОД Nebius в Лаппеенранте представляет собой многокорпусный комплекс на промышленной площадке площадью около 40,5 га. Его строительство и дальнейшая эксплуатация создадут новые рабочие места в регионе Южная Карелия в Финляндии. Ожидается, что появится около 100 рабочих мест после ввода ЦОД в эксплуатацию, а также сотни косвенных вакансий в сфере эксплуатации и технического обслуживания. Ключевым принципом проектирования ЦОД в Лаппеенранте будет экологичность, как и в ЦОД в Мянтсяля, который входит в число самых энергоэффективных объектов в мире, сообщила Nebius. Серверы будут охлаждаться с помощью замкнутой СЖО, что исключит необходимость использования воды из местных источников. Как и в Мянтсяля, система охлаждения будет спроектирована с учётом системы рекуперации тепла, что позволит передавать избыточное тепло от серверов в местную теплосеть. В Мянтсяля такой подход позволил избежать выбросов примерно 4 тыс. т CO2-эквивалента, связанных с производством тепла, в 2025 году и снизить затраты на отопление для подключённых домохозяйств примерно на 10 %. Nebius сообщила, что создаёт одну из крупнейших в мире сетей специализированных вычислительных мощностей для ИИ и планирует к концу 2026 года обеспечить более 3 ГВт контрактной мощности. В рамках реализации этих планов компания недавно получила разрешение на строительство своей первой гигаваттной ИИ-фабрики в Индепенденсе (Independence, штат Миссури). В регионе EMEA компания законтрактовала более 750 МВт на своих собственных площадках и в других ЦОД. В ЦОД в Мянтсяля размещена платформа NVIDIA GB300 NVL72, позже в этом году Nebius предложит и Vera Rubin NVL72.

17.03.2026 [11:02], Руслан Авдеев

Meta✴ потратит до $27 млрд на ИИ-инфраструктуру NebiusMeta✴ Platforms в течение пяти лет намерена заплатить $27 млрд за ИИ-инфраструктуру, доступ к которой предоставит облачный провайдер Nebius Group, базирующийся в Нидерландах, сообщает Bloomberg. В Meta✴ подтвердили сделку с Nebius. Nebius — стратегический партнёр NVIDIA, с 2027 года предоставит Meta✴ мощности ЦОД на $12 млрд, ещё до $15 млрд Meta✴ потратит на покупку мощностей, которые облачный провайдер строит для сторонних клиентов. Это один из крупнейших «разовых» контрактов, заключенных Meta✴, что подчёркивает стремление компании развиваться в сфере ИИ. Недавно появилась информация, что компания сократит более 20 % штата из-за высоких затрат на ИИ-проекты. В 2025 году она уже заключила сделку с Nebius на $3 млрд. За последние 12 месяцев акции Nebius выросли в цене в четыре раза, а на фоне новостей подорожали на 15 %, а Meta✴ — на 2,8 %.

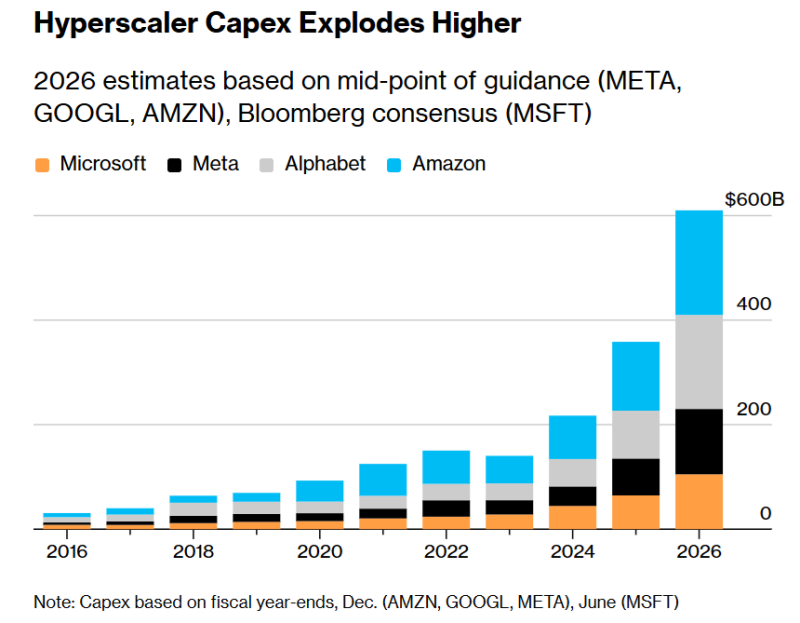

Источник изображения: Nebius Предполагается, что Meta✴ и её крупнейшие конкуренты потратят в 2026 году около $650 млрд на строительство ЦОД и покупку другой инфраструктуры на фоне взрывного роста спроса на ИИ-сервисы в ближайшие годы. Для Meta✴ ИИ в последнее время является ключевым приоритетом, и компания вкладывает значительные средства в конкуренцию с OpenAI, Google и др. С начала года заключены соглашения с NVIDIA и AMD о создании ИИ-инфраструктуры. Кроме того, Meta✴ разрабатывает и собственные ИИ-ускорители. В 2025 году заявлялось, что к 2028 году Meta✴ потратит на инфраструктурные инициативы в США $600 млрд. Для этого она будет использовать средства, вырученные от рекламного бизнеса и внешнее финансирование. Компания разрабатывает также и собственные ИИ-модели и др.

Источник изображения: Bloomberg Nebius, отделившаяся от «Яндекса» в 2024 году, — один из немногих новичков, очень успешно воспользовавшихся бумом ИИ-технологий. При этом немаловажную роль играет NVIDIA, активно инвестирующая в стартапы, конкурирующие с гиперскейлерами вроде Google и Amazon (AWS). На днях NVIDIA объявила о намерении инвестировать в Nebius $2 млрд, что привело к росту акций последней на 16 %. Значительная часть инвестиций NVIDIA была направлена компаниям, покупающим её собственные чипы. Это вызвало критику экспертов рынка, опасающихся, что такие инвестиции подпитывают создание ИИ-пузыря. Например, в январе NVIDIA сообщила об инвестициях $2 млрд в неооблачного провайдера CoreWeave, конкурирующего с Nebius, средства предназначались на внедрение ИИ-ускорителей самой NVIDIA. В 2026 году компания вложила $30 млрд в OpenAI, а также принимала участие в очередном раунде финансирования британской Nscale, желавшей привлечь $2 млрд. В январе сообщалось, что затраты Meta✴ на связанные с ИИ расходы в 2026 году составят от $115 до $135 млрд, это превышает прогнозы аналитиков в $110,7 млрд и почти вдвое больше, чем капитальные затраты компании в 2025 году, которые составили $72,2 млрд. Роста затрат направлен на поддержку подразделения Meta✴ Superintelligence Labs (MSL), а также основной повседневной деятельности компании.

12.03.2026 [10:05], Руслан Авдеев

NVIDIA инвестирует в Nebius $2 млрд в рамках стратегического партнёрства в сфере ИИ ЦОДNVIDIA объявила о намерении инвестировать $2 млрд в компанию Nebius Group в рамках стратегического партнёрства, предусматривающего разработку и строительство ИИ ЦОД, сообщает Bloomberg. В последние дни новости об очередных миллиардных инвестициях NVIDIA публикуются почти регулярно. В этот раз NVIDIA потратит средства на Nebius в рамках стратегического партнёрства — фактически компания нередко вкладывает средства в бизнесы, покупающие её ускорители. Базирующаяся в Амстердаме Nebius к концу 2030 года намерена внедрить более 5 ГВт систем на решениях NVIDIA. Речь идёт о сотрудничестве, касающемся полного стека ИИ-технологий — от разработки архитектуры ИИ-фабрик до взаимодействия в сфере программного обеспечения. Это позволит Nebius ускорить строительство передовой облачной платформы. Nebius активно внедряет технологии NVIDIA на глобальном уровне, включая строительство многочисленных ИИ-фабрик гигаваттного уровня в США. Чтобы Nebius смогла обеспечить более 5 ГВт к концу 2030 года, NVIDIA поддержит раннее внедрение компанией своих ИИ-ускорителей новейшего поколения.

Источник изображения: NVIDIA В рамках партнёрства предусмотрено несколько векторов взаимодействия:

NVIDIA нередко использует свои, почти неисчерпаемые финансовые ресурсы для финансирования расширения ИИ-инфраструктуры на своих чипах. Это уже вызвало критику экспертов, допускающих, что такие циркулярные инвестиции способствуют возникновению пузыря на рынке ИИ. В январе 2026 года NVIDIA анонсировала вложение $2 млрд в конкурента Nebius — компанию CoreWeave для внедрения своих продуктов, а совсем недавно NVIDIA поддержала развёртывание 1 ГВт мощностей стартапом Thinking Machines Lab. Неооблачный провайдер Nebius появился после раскола «Яндекса» и продажи его российской части бизнеса в 2024 году за $5,2 млрд российским покупателям. В конце того же года Nebius привлекла $700 млн от группы инвесторов, включавшей NVIDIA. По состоянию на конец 2024 года NVIDIA владела акциями компании на сумму $33 млн. Совсем недавно IT-гигант выделил ещё $4 млрд на связанные с ИИ проекты. NVIDIA инвестировала по $2 млрд в поставщиков лазеров и фотоники для ИИ ЦОД — компании Lumentum и Coherent.

05.03.2026 [19:48], Руслан Авдеев

Nebius одобрили строительство первой гигаваттной ИИ-фабрики в США — экологичной и малошумнойКомпания Nebius приветствовала решение городского совета Индепенденса (Independence, шт. Миссури), утвердившего план стимулов для промышленного развития города, который позволяет Nebius начать строительство ИИ-фабрики мощностью 1,2 ГВт — крупнейшей для компании в США. Подчёркивается, что это первый, но не последний проект такого масштаба. Кампус рассматривается в качестве ключевого этапа роста компании в США. Проект представляет собой многофункциональный кампус на территории более 160 га. Будет создано около 130 постоянных рабочих мест для обслуживания ЦОД после его полного ввода в эксплуатацию. ИИ-фабрику оснастят замкнутой системой охлаждения, поддерживающей потребление питьевой воды всего лишь на уровне среднестатистического ресторана или офисного здания. Сообщается, что механическая система охлаждения потребует единовременного заполнения в объёме 3785 м3 на 200 МВт, из которых надо будет обновлять ежегодно около 20 %. Ещё 1,5–2,4 тыс. м3/год потребуется на нужды сотрудников и прочие задачи. Кампус спроектирован так, чтобы минимально вмешиваться в повседневную жизнь граждан. В частности, предусмотрены системы снижения шума ЦОД. Кампус получит питание от муниципальной коммунальной компании Independence Power & Light (IPL), участвующей в региональной системе Southwest Power Pool (SPP). Утверждается, что кампус спроектирован таким образом, что использование ресурсов не вызовет роста тарифов на электричество для жителей и даже стабилизирует цены. Компания обязуется обеспечить строительство необходимой инфраструктуры и будет стимулировать развитие энергосети. Строительство кампуса должно начаться во II полугодии 2026 года и будет продолжаться минимум до 2029 года. К началу 2029 года будет инициировано изучение возможности получения дополнительной энергии. Дополнительно вероятно строительство генерирующих мощностей на месте. Так, уже на первом этапе будут развёрнуты четыре резервных генератора. Загрязнение воздуха, как обещает компания, будет «незначительным». Компания обязуется осуществлять т.н. платежи вместо налогов (Lieu of Taxes, PILOT) — такие нередко выплачиваются по договорённости вместо налога на имущество. Ожидается, что это принесёт местным властям более $650 млн за 20 лет. Также соглашение предусматривает участие в школьных программах повышения грамотности в области STEM-дисциплин и ИИ, развитие трудовых резервов, поддержку местных экстренных служб и даже формирование специальной группы для взаимодействия с жителями Индепенденса. Пока дела у Nebius идут почти блестяще. Выручка в IV квартале 2025 года выросла на 547 %, за весь год — на 479 % до $529,8 млн. Впрочем, квартальные показатели оказались немного ниже прогнозов экспертов. У компании имеются крупные контракты с Meta✴ и Microsoft. Компания развивает ЦОД во Франции, Финляндии, США, Исландии, Израиле и Великобритании.

05.03.2026 [09:36], Руслан Авдеев

National Grid и Emerald AI успешно умерили энергетические аппетиты британского ИИ ЦОД NebiusВедущий оператор электросетей Великобритании National Grid провёл первое в стране испытание «гибкой» системы электроснабжения дата-центров при участии Nebius и с использованием ИИ-системы управления нагрузками и питанием Emerald AI. По данным Computer Weekly, эксперимент проходил с использованием кластера из 96 ускорителей NVIDIA Blackwell Ultra. В декабре 2025 года в течение пяти дней были проведены более 200 симуляций «сетевых событий» для проверки способности ПО Emerald динамически оптимизировать энергопотребление дата-центра. Платформа Emerald AI смогла подогнать энергопотребление к заданному уровню, сократить спрос на энергию до −40 % и сохранить исполнение критических нагрузок в нормальном режиме. Система успешно реагировала на скачки спроса в энергосети в перерывах во время футбольных матчей, справилась с запросом на понижение энергопотребления продолжительностью до 10 часов и отработала резкое снижение потребление (30 %) — всё для сохранения стабильности работы энергосети. По оценкам исследователей, при таком подходе ИИ ЦОД по запросу могут «высвобождать» для энергосети до 2 ГВт. Если дата-центры перестанут быть просто крупными потребителями энергии и будут «вовлечены» в работу энергосети, это позволит лучше использовать существующую инфраструктуру и поддержит подключение к сети различных источников.

Источник изображения: Toolmash Expo/unsplash.com По словам National Grid Partners, большинство энергосистем используют, вероятно, 30 % от имеющейся мощности в течение года, а пиковые нагрузки случаются довольно редко. Если присоединённые объекты могут быстро и контролируемо снижать энергопотребление по запросу энергосети, сетевому оператору не нужно будет наращивать мощности. По словам Emerald AI, эксперимент показал способность ИИ-оборудования ЦОД Nebius гибко регулировать энергопотребление в любой момент времени. Даже после получения сигнала среди ночи удалось за 30 с снизить энергопотребление более чем на треть. Система отлично подходит при питании от источников возобновляемой энергии. Например, когда ветра мало в течение восьми часов, дата-центр может снизить потребление, на 100 % сохрание питание критически важных вычислительных нагрузок. По словам Emerald AI, есть три основных способа добиться «гибкости» энергопотребления для ИИ-задач. Во-первых, можно замедлить некоторые процессы или приостановить их. Напрмиер, тонкую настройку модели обычно можно отложить на час. Во-вторых, можно перемещать рабочие нагрузки. Так, компания уже протестировала перенос генерации ответа ИИ из одного ЦОД Oracle в другой, что вызвало не такую критичную для данной нагрузки задержку примерно в 10 мс. На самом деле гиперскейлеры, включая Google и Microsoft, уже давно используют перемещение нагрузок между регионами, хотя и не с такой скоростью и с другими целями. В-третьих, можно организовать мониторинг работы ЦОД. В этом случае Emerald AI управляет рабочими нагрузками с помощью ИИ, расставляя для них приоритеты. Это оптимальный способ обеспечить энергосистеме необходимые ресурсы, при этом сохраняя для пользователя целостность рабочих нагрузок, говорит компания.

26.02.2026 [00:30], Владимир Мироненко

Nebius увеличила квартальную выручку на 547 %, чуть не дотянув до прогноза Уолл-стритПровайдер облачных ИИ-сервисов Nebius (ранее Yandex N.V.) объявил неаудированные финансовые результаты за IV квартал и весь 2025 год, закончившийся 31 декабря 2025 года. Квартальная выручка компании выросла на 547 % до $227,7 млн, что оказалось немного ниже прогноза аналитиков размере $242,79 млн (по данным intellectia.ai). Как отметил ресурс MarketBeat, разница невелика и к тому же компенсируется прогнозом устойчивого роста. Тем не менее, после объявления финансовых результатов акции компании упали на 5 %. Значительный рост выручки обусловлен высокими показателями в основном облачном бизнесе компании в сфере ИИ благодаря массовому переходу на облачные ИИ-сервисы и контрактам с гиперскейлерами, включая Microsoft и Meta✴. Выручка от основного бизнеса выросла на 802 % до $214 млн. Росту способствовали высокий уровень загрузки мощностей, выгодные ценами и дисциплинированное исполнение заказов, подчеркнули аналитики Zacks Investment Research. Компания сообщила, что в IV квартале снова распродала все свои мощности, поскольку спрос продолжал опережать доступное предложение. Следует также отметить, что компания достигла положительной скорректированной EBITDA в размере $15 млн в IV квартале, тогда как годом ранее этот показатель составлял –$63,9 млн. Маржа скорректированной EBITDA выросла до 24 % с 19 % в III квартале. Nebius сообщила о скорректированном чистом убытке в IV квартале 2025 года в размере –$173 млн, что на 151 % больше, чем убыток в размере –$69 млн, понесенный годом ранее. Убытки компании увеличились, поскольку она активно инвестировала в расширение мощностей, разработку продуктов и приобретение ускорителей. Однако убытки обусловлены исключительно капитальными затратами и расширением, поскольку операционные показатели улучшились. Что касается показателей за весь 2025 год, то выручка Nebius выросла на 479 % до $529,8 млн. Убыток по скорректированной EBITDA сократился с –$226,3 млн до –$64,9 млн (–71 %). Скорректированные убытки увеличились на 87 % с –$238,5 млн в 2024 году до –$446,7 млн. В 2026 году компания прогнозирует выручку в пределах $3–$3,4 млрд. Прогноз по годовой регулярной выручке (ARR, Annual Recurring Revenue) к концу 2026 года составляет $7–$9 млрд. На 2026 год компания прогнозирует скорректированную маржу EBITDA на уровне примерно 40 %. Однако она ожидает, что показатель EBIT останется убыточным, поскольку компания продолжает реализацию планов расширения мощностей, развёртывания ускорителей и инвестиций в исследования и разработки для значительного укрепления своей технологической базы и будущих продуктов в области ИИ. Nebius считает, что эти инвестиции обеспечивают привлекательную доходность, и компания по-прежнему привержена своей среднесрочной целевой отметке EBIT в 20-30 % с потенциалом дальнейшего роста. В 2026 году компания планирует инвестировать от $16 до $20 млрд в капитальные затраты. Компания ускорила свои планы по наращиванию мощностей, объявив о строительстве 9 новых ЦОД и обеспечив более 2 ГВт законтрактованной электроэнергии с прогнозом превышения отметки в 3 ГВт. Nebius по-прежнему планирует обеспечить от 800 МВт до 1 ГВт доступной мощности ЦОД к концу 2026 года. |

|