Материалы по тегу: nvidia

|

04.04.2026 [00:24], Владимир Мироненко

Соучредитель Supermicro с соучастником отрицают участие в контрабанде ИИ-чипов NVIDIA в КитайНа прошедших слушаниях в окружном суде США Южного округа Нью-Йорка (Манхэттен) соучредитель Supermicro И-Шьян Лиау (Yih-Shyan Liaw) отказался признать свою вину по обвинению в содействии незаконной поставке серверов NVIDIA на миллиарды долларов в Китай, сообщил Bloomberg. Аналогичным образом поступил внешний подрядчик Тин-Вэй Сунь (Ting-Wei Sun). Оба были арестованы, но И-Шьян вскоре был освобождён под залог в $5 млн, а Сунь находится под стражей, пока его адвокат обсуждает с прокуратурой условия освобождения под залог. Третий фигурант дела — Руэй-Цанг Чанг (Ruei-Tsang Chang), генеральный директор тайваньского офиса Supermicro, пока скрывается от правосудия. Всем троим предъявлено обвинение в сговоре с целью с целью контрабанды передовых чипов NVIDIA в Китай, что является нарушением Закона о реформе экспортного контроля. Согласно обвинительному заключению прокуратуры Южного округа Нью-Йорка, обвиняемые незаконно переправили в Китай под видом продажи неназванной компании-посреднику из Юго-Восточной Азии подсанкционного оборудования на $2,5 млрд. Ранее стало известно, что четыре китайских университета, связанных с Народно-освободительной армией Китая, каким-то образом смогли приобрести подсанкционные ИИ-серверы Supermicro. Это дело представляет собой самую громкую операцию по борьбе с предполагаемой контрабандой запрещённых к экспорту ИИ-технологий в Китай, отметил Bloomberg. После обнародования обвинений 19 марта акции Supermicro рухнули более чем на четверть, и в результате она потеряла $6 млрд рыночной стоимости. Соучредителя Supermicro И-Шьян Лиау вывели из совета директоров, а акционеры подали на компанию в суд, обвинив её в мошенничестве с ценными бумагами в связи с сокрытием зависимости от незаконных поставок в Китай. Ранее компания попалась на незаконных поставках оборудования в Иран. Возглавляет судебный процесс «США против Лиау» окружной судья США Эдгардо Рамос (Edgardo Ramos), назначивший судебное заседания на 2 ноября. В случае признания виновными по обвинению в сговоре с целью нарушения Закона о реформе экспортного контроля фигурантом грозит максимальное тюремное заключение сроком на 20 лет. Также они обвиняются по одному пункту обвинения в сговоре с целью контрабанды товаров и по одному пункту в сговоре с целью обмана Соединённых Штатов, за каждый из которых предусмотрено максимальное тюремное заключение сроком на пять лет. Ни Supermicro, ни NVIDIA никаких обвинений не предъявлено.

03.04.2026 [16:28], Руслан Авдеев

От ИИ-стартапа Poolside разом отвернулись NVIDIA, CoreWeave и GoogleИИ-стартап Poolside пытается вести переговоры с облачными провайдерами, включая Google, в попытке найти нового партнёра для строительства 2-ГВт дата-центра Project Horizon в Техасе, сообщает Datacenter Dynamics. От компании отвернулись CoreWeave и NVIDIA, отказавшиеся финансировать развитие ИИ-инфраструктуры стартапа после срыва графиков. Poolside основана в 2023 году и разрабатывает ПО для автоматического написания кода, достаточно безопасного и корректного для использования государственными структурами. Также ведутся работы над созданием «общего искусственного интеллекта». Стартап является клиентом Fluidstack и Iren. В 2024 года стартап привлёк $500 млн при оценке капитализации на уровне $3 млрд. Project Horizon предполагал создание 2-ГВт кампуса ЦОД на участке площадью 230 га, запитанного от природного газа. Участок расположен в Пермском бассейне (США) и потенциально может обеспечить 10 ГВт. Также на территории кампуса планировалось развивать солнечную и ветряную энергетику, которые совокупно дали бы 2,5 ГВт.

Источник изображения: Austin Distel/unspalsh.com Основным арендатором должна была стать компания CoreWeave. На первом этапе планировалось предоставить последней 250 МВт в аренду на 15 лет с дальнейшим увеличением до 500 МВт. Тогда же NVIDIA выразила желание инвестировать в Poolside до $1 млрд в рамках раунда финансирования на сумму $2 млрд. CoreWeave разорвала отношения в конце 2025 года, поскольку стартап не смог обеспечить запуск первой партии ИИ-ускорителей в соответствии с графиком. По словам представителя CoreWeave, компании «избрали разные пути по собственным стратегическим причинам и в связи с временными ограничениями». Кроме того, по данным The Financial Times, стартапу не удалось убедить инвесторов в способности создавать конкурентные ИИ-модели. В результате Poolside обратилась к другим облачным провайдерам, включая Google, в надежде реанимировать проект в Техасе под гарантии клиентов на мощности до 400 МВт. Впрочем, источники сообщают, что и Google больше не желает вести переговоры с Poolside. NVIDIA также передумала инвестировать в Poolside.

31.03.2026 [20:09], Владимир Мироненко

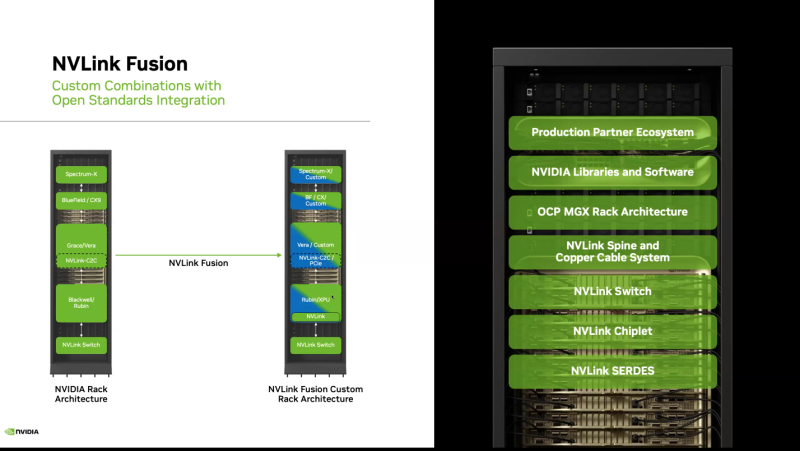

NVIDIA инвестировала $2 млрд в Marvell, приобщив её к своей ИИ-экосистеме и NVLink FusionАкции Marvell Technology подскочили более чем на 9 % на предрыночных торгах после объявления NVIDIA об инвестициях в размере $2 млрд в рамках стратегического партнёрства с интеграцией решений Marvell в экосистему NVIDIA. Это позволит Marvell подключиться к ИИ-фабрике NVIDIA и экосистеме AI-RAN посредством NVIDIA NVLink Fusion, предоставляя клиентам, использующим архитектуры NVIDIA, больший выбор и гибкость при разработке инфраструктуры следующего поколения. Marvell предоставит клиентам специализированные XPU и масштабируемые сетевые решения, совместимые с NVLink Fusion, а NVIDIA — вспомогательные технологии, включая процессоры Vera, сетевые решения ConnectX и Bluefield, интерконнект NVLink и коммутаторы Spectrum-X, а также вычислительные ИИ-мощности в стоечном исполнении. Для клиентов, разрабатывающих специализированные XPU, NVLink Fusion предлагает гетерогенную ИИ-инфраструктуру, полностью совместимую с системами NVIDIA, обеспечивая бесшовную интеграцию с платформами NVIDIA GPU, LPU, сетевыми и СХД-платформами, используя технологический стек NVIDIA и глобальную экосистему поставок. Ранее NVIDIA заключила похожие соглашения в отношении NVLink с SiFive, AWS, Arm, Fujitsu, Intel и MediaTek. Компании также будут сотрудничать в ключевых областях, таких как кремниевая фотоника и телекоммуникационные сети с целью преобразования сетей в инфраструктуру ИИ с помощью NVIDIA Aerial AI-RAN для 5G/6G и развития передовых решений для оптического интерконнекта. «Вместе с Marvell мы даём клиентам возможность использовать экосистему ИИ-инфраструктуры NVIDIA и масштабировать её для создания специализированных вычислительных ИИ-мощностей», — заявил гендиректор NVIDIA Дженсен Хуанг (Jensen Huang). Эта сделка является частью более широкой стратегии NVIDIA по инвестированию в ИИ-экосистему с целью укрепления своего лидерства на ИИ-рынке. Недавно NVIDIA инвестировала аналогичные суммы в несколько компаний, включая Synopsys, Nokia, CoreWeave, Coherent, Lumentum и Nebius, тем самым укрепляя свое влияние по всей цепочке создания стоимости. Таким образом NVIDIA стремится удовлетворить экспоненциальный рост спроса на вычислительные мощности, обусловленный ИИ-инференсом и генерацией контента. Используя стратегические партнёрства, NVIDIA намерена ускорить развёртывание специализированной инфраструктуры и обеспечить разработку необходимых технологий для роста сегмента.

30.03.2026 [11:59], Сергей Карасёв

ИИ-сервер Gigabyte G894-AD3 использует платформу NVIDIA HGX B300 и чипы Intel Xeon 6900Компания Gigabyte пополнила ассортимент серверов мощной моделью G894-AD3-AAX7, предназначенной для решения ресурсоёмких задач в сфере ИИ. Система выполнена на платформе NVIDIA HGX B300 с восемью SXM-ускорителями Blackwell Ultra. Допускается установка двух процессоров Intel Xeon 6900P поколения Granite Rapids-SP в исполнении LGA 7529 (Socket BR) с показателем TDP до 500 Вт. Доступны 24 слота для модулей DDR5-6400/8800 RDIMM/MRDIMM, два внутренних коннектора M.2 2280/22110 для SSD с интерфейсом PCIe 5.0 x4 и PCIe 5.0 x2, а также восемь отсеков для SFF-накопителей (NVMe) с доступом через фронтальную панель (возможна горячая замена). Реализованы четыре слота PCIe 5.0 x16 для карт расширения FHHL. В оснащение входят контроллер ASPEED AST2600, два сетевых порта 10GbE на основе Intel X710-AT2, выделенный сетевой порт управления 1GbE, а также восемь портов 800G OSFP InfiniBand XDR (NVIDIA ConnectX-8 SuperNIC). Подсистема питания включает 12 блоков мощностью 3000 Вт с сертификатом 80 PLUS Titanium. Реализовано воздушное охлаждение с 27 вентиляторами в следующей конфигурации: 6 × 60 мм в области материнской платы, 4 × 40 мм в зоне портов OSFP, 2 × 80 мм в секции PCIe-слотов и 15 × 80 мм в лотке GPU.

Источник изображения: Gigabyte Сервер выполнен в форм-факторе 8U с габаритами 447 × 351 × 923 мм, а масса составляет 91,6 кг. Диапазон рабочих температур — от +10 до +30 °C. Среди прочего упомянуты два порта USB 3.0 Type-A (5 Гбит/с), аналоговый интерфейс D-Sub, а также три гнезда RJ45 для сетевых кабелей. Опционально может быть добавлен модуль TPM 2.0 для обеспечения безопасности.

29.03.2026 [19:24], Сергей Карасёв

MSI XpertStation WS300 — рабочая станция для ИИ на базе NVIDIA GB300Компания MSI официально представила мощную рабочую станцию XpertStation WS300, ориентированную на задачи ИИ. Новинка построена на платформе NVIDIA DGX Station, сердцем которой является суперчип GB300. Утверждается, что устройство предлагает производительность уровня ЦОД в формате десктопа. Габариты системы составляют 247,8 × 527,9 × 567,7 мм. Задействованы процессор NVIDIA Grace с 72 ядрами Arm Neoverse V2 (Demeter) и ускоритель Blackwell Ultra. При этом CPU использует 496 Гбайт LPDDR5X с пропускной способностью до 396 Гбайт/с, а GPU — 252 Гбайт HBM3e (ПСП 7,1 Тбайт/с). Применён модуль жидкостного охлаждения (CPU+GPU). Доступны по два разъёма M.2 2280/22110 для SSD с интерфейсом PCIe 5.0 x4 и PCIe 6.0 x4, а также коннектор M.2 2230 для комбинированного адаптера Wi-Fi/Bluetooth. Есть один слот PCIe 5.0 x16 для карты расширения FHFL двойной ширины и два слота PCIe 5.0 x16 для карт FHFL одинарной ширины. В качестве опции предлагается установка ускорителей RTX PRO 6000 Blackwell Workstation Edition, RTX PRO 6000 Blackwell Max-Q Workstation Edition, RTX PRO 4000 Blackwell SFF Edition и RTX PRO 2000 Blackwell. В оснащение входят контроллер ASPEED AST2600 с выделенным портом управления 1GbE, сетевой адаптер NVIDIA ConnectX-8 SuperNIC с двумя портами QSFP112, а также 10GbE-контроллер Marvell AQC113. Есть четыре порта USB 3.1 Type-A, интерфейсы Mini-DP и Micro-USB (COM). Питание обеспечивает блок мощностью 1600 Вт с сертификатом 80 PLUS Titanium. За безопасность отвечает модуль TPM 2.0. Диапазон рабочих температур — от +10 до +35 °C.

27.03.2026 [21:04], Руслан Авдеев

«Не хотите ускорители? Возьмите хотя бы сеть!» — NVIDIA открыла свои ИИ-стойки для чужих чиповNVIDIA занялась разработкой серверных стоек, подходящих для решений на основе сторонних ИИ-ускорителей, сообщает The Information со ссылкой на знакомые с вопросом источники. Компания стремится остаться ключевым игроком на рынке ИИ-систем даже по мере того, как всё больше её клиентов разрабатывают решения, прямо конкурирующие с продуктами самой NVIDIA. На прошлой неделе компания представила новые стойки MGX ETL, специально разработанные для поддержки чипов как самой NVIDIA, так и поставщиков-конкурентов. Система основана на модульной архитектуре MGX (OCP), представленной в 2023 году и уже довольно распространённой. ETL предполагает использование сетевых решений NVIDIA Spectrum-X. Таким образом, «зелёные» чипы всё равно оказываются в инфраструктуре, даже если она базируется на сторонних решениях. Похожим образом компания развивает и фирменный интерконнект NVLink. NVLink Fusion можно интегрировать в другие чипы, что опять-таки даёт NVIDIA возможность заработать на чужих ИИ-системах. Но в случае ETL применяются широко поддерживаемые в индустрии стандарты Ethernet, что снижает для клиентов «порог вхождения» при внедрении оборудования NVIDIA. Модульный дизайн позволяет облачным гиперскейлерам одновременно использовать ускорители разных производителей, при этом оставаясь в сетевой и программной экосистемах NVIDIA. NVIDIA позиционировала MGX как открытую «эталонную» архитектуру, не мешающую партнёрам использовать альтернативные компоненты. Гибкость также позволяет NVIDIA «проложить дорогу» на китайский рынок, где компании смогут применять со стойками NVIDIA чипы домашней разработки. Новый дизайн стоек также может помочь NVIDIA устранить обеспокоенность регуляторов практикой, когда компания связывала использование сетевого оборудования с определёнными ИИ-чипами. На этом фоне происходит ужесточение конкуренции на рынке технологий интерконнектов. Открытый стандарт UALink позиционируется как альтернатива NVLink и призван обеспечить высокоскоростную связь между ИИ-чипами без применения проприетарных технологий. Параллельно развивается и открытый стандарт Ultra Ethernet, который призван конкурировать и с технологией Infiniband, фактически единолично контролируемой NVIDIA. Сетевые решения являются чрезвычайно важной частью бизнеса NVIDIA. По итогам последнего квартала выручка компании в этом сегменте достигла $10,98 млрд (а за год все $31 млрд) — она выросла год к году на 268 % и составила более 15 % от всей выручки компании. При этом значительная часть сетевого оборудования продаётся не сама по себе, а в составе платформенных решений NVIDIA.

26.03.2026 [23:43], Владимир Мироненко

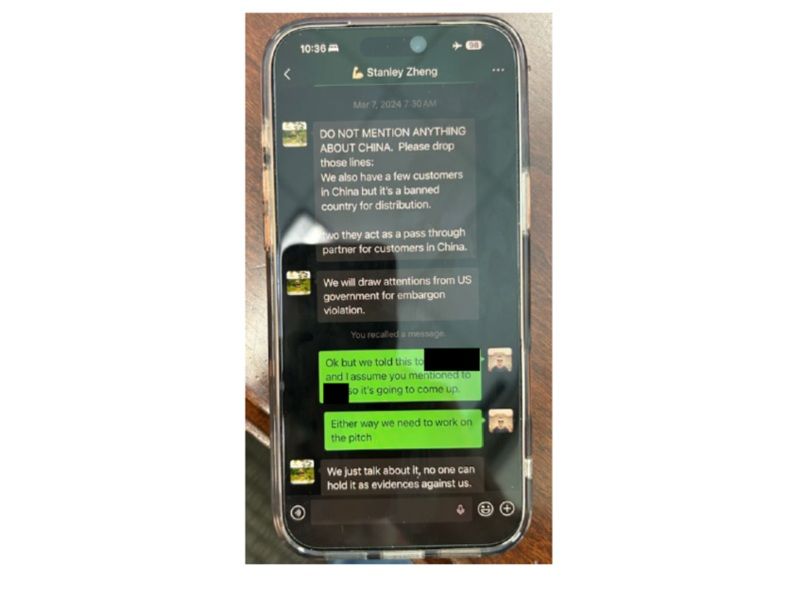

В США арестовали ещё трёх подозреваемых в контрабанде в Китай ИИ-серверов Supermicro с подсанкционными чипами NVIDIAСпустя несколько дней после ареста соучредителя Supermicro И-Шьян Лиау (Yih-Shyan Liaw) в США арестовали ещё трёх человек по обвинению в попытке контрабанды ускорителей NVIDIA в Китай, сообщил ресурс The Register со ссылкой на заявление Министерства юстиции США. Акционеры тем временем подали к Supermicro коллективный иск в связи с резким падением стоимости ценных бумаг компании. Они полагают, что компания не могла не знать, что заметная доля выручки приходится на незаконные поставки оборудования в КНР, хотя часть таких сделок была заблокирована. Министерство юстиции США предъявило обвинения гражданину Китая Стэнли И Чжэну (Stanley Yi Zheng) из Гонконга, а также гражданам США Мэтью Келли (Matthew Kelly) и Томми Шаду Инглишу (Tommy Shad English) в сговоре с целью нарушения экспортного контроля и законов о контрабанде. Они обвиняются в попытке купить ускорители на миллионы долларов у «калифорнийской компании по производству компьютерного оборудования» для незаконной поставки в Китай через предприятия в Таиланде. Название производителя не приводится, но в обнародованном в судебных документах заказе указан номер модели сервера SYS-821GE-TNHR, что соответствует 8U-системе Supermicro для NVIDIA H100 и H200. Согласно обвинительным заключениям, сговор начался ещё в мае 2023 года. В октябре того же года Инглиш, представившись сотрудником компании из Таиланда, заказал у компании, проходящей документах как «Компания-1» (Supermicro), 750 серверов на сумму около $170 млн. Из этих серверов 600 содержали GPU, находящийся под контролем Управления по контролю за экспортом США (TEC) и требующий лицензии для экспорта в Китай. Размещая заказ, Инглиш подписал «Сертификат передовых вычислительных систем», подтверждающий, что серверы не предназначены для Китая или любой другой страны, на которые распространяются экспортные ограничения. В январе 2024 года Инглиш перевел «Компании-1» более $20 млн в качестве частичной оплаты за заказ от октября 2023 года и, обсуждая по электронной почте предстоящую проверку соответствия заказу, попросил добавить Чжэна и Келли в переписку. «Компания-1» отметила в переписке, что компания Чжэна базируется в Китае и что «странно», что никто из компании, базирующейся в Таиланде, не был включен в список получателей копии письма. В начале февраля 2024 года калифорнийский производитель компьютерных чипов, указанный в документах как «Компания-2» (NVIDIA), провёл дополнительную проверку заказа от октября 2023 года, но не смог подтвердить конечного покупателя своей продукции в Таиланде. В конечном итоге этот заказ был заблокирован.

Источник изображения: U.S. Department of Justice В апреле 2024 года Инглиш снова предпринял попытку заказать у «Компании-1» 500 серверов с подсанкционными ускорителями, утверждая, что действует от имени другой тайской компании. При этом он снова подписал сертификат, подтверждающий, что конечным пользователем продукции является тайская компания. Эта сделка тоже не была завершена благодаря бдительности Supermicro и NVIDIA. Министерство юстиции США привело в качестве подтверждения обвинений переписку задержанных, свидетельствующую о том, что они знали, что конечным пунктом поставки серверов является Китай. Все трое находятся под стражей, а Чжэн уже предстал перед судьей Северного округа Калифорнии. Министерство юстиции США подчеркнуло, что на данном этапе обвинения являются лишь предположениями, и обвиняемые считаются невиновными, пока судебное разбирательство не докажет обратное.

26.03.2026 [14:33], Руслан Авдеев

ИИ от Microsoft и NVIDIA ускорит создание новых атомных реакторов

microsoft

microsoft azure

nvidia

software

аэс

документооборот

ии

строительство

сша

цифровой двойник

энергетика

Microsoft и NVIDIA сотрудничают в сфере атомной энергетики, но речь идёт не о непосредственном строительстве мощностей, а о «бумажной работе», которая будет выполняться с помощью ИИ-инструментов. Они должны помочь справиться с бюрократией, помогут в проектировании и оптимизации работы АЭС, сообщает The Register. По словам президента Microsoft Брэда Смита (Brad Smith), сотрудничество охватывает весь жизненный цикл АЭС, от получения разрешений и проектирования до строительства и эксплуатации. По словам Смита, атомная энергетика отлично зарекомендовала себя как источник безуглеродного электричества, и новая инициатива поможет масштабному вводу АЭС в эксплуатацию. Microsoft подчёркивает, что строительство АЭС — весьма сложный процесс, а приведение работы в соответствие с правилами регуляторов может занять годы, обойтись в сотни миллионов долларов и потребовать обработки огромных объёмов данных с последующим составлением отчётов. Администрация США стремится упростить делособственными методами — ослабить требования к безопасности, включая отказ от полной экологической экспертизы новых реакторов. Microsoft и NVIDIA считают, что ИИ поможет сократить сроки разработки, упростить выполнение сложных задач без ущерба безопасности и др. При этом система готовит и документацию, которую могут проверить регуляторы, где каждое инженерное решение обосновано в соответствии с правилами и готово для аудита.

Источник изображения: Energie-portal.sk/unsplash.com По данным Microsoft, предлагаемый компанией инструмент Generative AI for Permitting уже сократил работы по получению разрешений на 92 % для компании Aalo Atomics, готовящей создание массовых малых модульных реакторов (SMR). Southern Nuclear разработала и внедрила ИИ-агентов, применяющих Microsoft Copilot для оптимизации проектирования и лицензирования. NVIDIA будет способствовать развёртыванию АЭС с помощью технологии цифровых двойников и высокоточных симуляций. Рост использования атомной энергии рассматривается как решение проблемы увеличения спроса на электричества, вызванного бумом строительства ИИ ЦОД. При этом строительство АЭС обычно занимает не менее пяти лет, а вот больше энергии для ИИ требуется уже сейчас. Сама Microsoft заключила соглашение сроком на 20 лет о покупке энергии (PPA) с Constellation Energy для перезапуска АЭС Three Mile Island, но та вряд ли заработает раньше 2028 года. Новая инициатива по внедрению ИИ в ядерную энергетику объединяет решения Omniverse, Earth 2, CUDA-X, AI Enterprise, PhysicsNeMo, Isaac Sim и Metropolis компании NVIDIA с Generative AI for Permitting и Planetary Computer компании Microsoft. По данным последней, это позволяет сформировать цифровую ИИ-экосистему для ядерной энергетики на платформе Azure. Аналогичные платформы разрабатывают Google и Palantir.

26.03.2026 [11:10], Сергей Карасёв

HP представила рабочую станцию Z8 Fury G6i с поддержкой четырёх ускорителей NVIDIA RTX Pro 6000 Blackwell Max-Q Workstation EditionКомпания HP анонсировала настольную рабочую станцию Z8 Fury G6i, предназначенную для решения сложных задач в области моделирования, анализа данных, создания визуальных эффектов и разработки ИИ. Новинка построена на аппаратной платформе Intel Xeon 600. Максимальная конфигурация включает процессор Xeon 698X с P-ядрами (86C/172T, 2/4,8 ГГц). Применена материнская плата на наборе логики Intel W890. Объём оперативной памяти DDR5-6400 ECC может достигать 2 Тбайт (доступны 16 слотов для модулей DIMM). Суммарная вместимость подсистемы хранения данных составляет до 104 Тбайт. При этом допускается использование накопителей разных типов, включая HDD корпоративного класса с интерфейсом SATA-3 вместимостью до 12 Тбайт (7200 об/мин), SSD формата М.2 (например, HP Z Turbo Drive NVMe на 8 Тбайт), а также устройства U.2 и U.3. Во фронтальной части расположены посадочные места для четырёх NVMe-накопителей с возможностью горячей замены. Дополнительно может быть установлен оптический привод HP Slim DVD-ROM или HP Slim DVD-Writer. Рабочая станция может нести на борту до четырёх ускорителей NVIDIA RTX Pro 6000 Blackwell Max-Q Workstation Edition с 96 Гбайт памяти GDDR7 каждый (пропускная способность — 1792 Гбайт/с). Слоты расширения выполнены по схеме 4 × PCIe 5.0 x16, 3 × PCIe 5.0 x8,1 × PCIe 5.0 x4 и 1 × PCIe 4.0 x4. В оснащение включены сетевой контроллер Intel I219-LM PCIe стандарта 1GbE и звуковой кодек Realtek ALC3205-CG. Предлагаются гибкие опции по установке дополнительных сетевых адаптеров, включая 10GbE и 25GbE. Кроме того, упомянут модуль MediaTek MT7925 с поддержкой Wi-Fi 7 и Bluetooth 5.4. Габариты составляют 44,51 × 21,95 × 55,9 см, масса — 22,2 кг. На фронтальную панель выведены четыре порта USB 3.0 Type-A (5 Гбит/с), комбинированное аудиогнездо на 3,5 мм и SD-ридер. Сзади сосредоточены пять портов USB 3.0 Type-A (5 Гбит/с), разъём USB 3.2 Type-C (20 Гбит/с), гнездо RJ45 для сетевого кабеля и пр. Возможна установка одного или двух блоков питания мощностью 1350 или 1700 Вт. Говорится о совместимости с Windows 11 Pro for Workstations, Ubuntu 24.04 LTS, Red Hat Enterprise Linux.

25.03.2026 [14:49], Руслан Авдеев

Гагарин получил 512 ИИ-ускорителей B300 — Eleveight AI развернула чипы NVIDIA в 2-МВт ЦОД в АрменииБазирующаяся в Армении компания Eleveight AI развернула в местном дата-центре, расположенном в селе Гагарин, 512 ИИ-ускорителей NVIDIA B300. Строительство объекта должны закончить до конца марта, сообщает Datacenter Dynamics. ЦОД разработан для работы от комбинированных источников питания со значительной долей возобновляемой энергии. Стартап утверждает, что речь идёт о первом внедрении ускорителей NVIDIA B300 в Армении, и это важная веха в строительстве ИИ-инфраструктуры страны. В компании ожидают, что новые вычислительные мощности будут использоваться корпоративными клиентами, стартапами и исследовательскими организациями со II квартала 2026 года. Компания предупредила, что спрос уже превысил исходные 2 МВт мощности. Заявлено, что Армения выходит на мировой уровень в области ИИ-инфраструктуры, а проект Eleveight знаменует собой решающий шаг в этом направлении. С внедрением новейших ускорителей NVIDIA B300, компания «задаёт новые мировые стандарты производительности и возможностей».

Источник изображения: Aram/unspalsh.com Компания подчеркнула, что в первую очередь сосредоточилась на том, чтобы заложить основу, обеспечив электроснабжение, охлаждение и стабильность в долгосрочной перспективе. Речь идёт только о первом шаге, в следующем году планируется расширять как вычислительные мощности ИИ-проекта, так и его географию. Основанная в 2025 году компания Eleveight AI заявляет, что фокусирует внимание на строительстве инфраструктуры И ЦОД в Гагарине. Вычислительные ресурсы предназначены для коммерческих компаний, стартапов и исследований. В ноябре 2025 года США одобрили экспорт передовых ИИ-чипов в ряд стран, включая Армению. В феврале сообщалось, что страна получит ещё 41 тыс. NVIDIA GB300. Firebird намерена построить ИИ ЦОД на 100 МВт. |

|