Материалы по тегу: nvidia

|

06.06.2026 [21:50], Владимир Мироненко

Google будет выплачивать SpaceX ежемесячно $920 млн за аренду чипов NVIDIAGoogle заключила сделку с SpaceX по поводу аренды вычислительных мощностей ЦОД xAI, в рамках которой будет ежемесячно выплачивать $920 млн в период с октября 2026 года по июнь 2029 года, сообщил ресурс The Wall Street Journal. Согласно заявлению, поданному SpaceX в Комиссию по ценным бумагам и биржам США (SEC), её контрактом с Google предусмотрен доступ к 110 тыс. ускорителей NVIDIA и другим компонентам. Стоимость услуги — примерно $11 млрд в год до июня 2029 года. Если SpaceX не предоставит к 30 сентября 2026 года зарезервированные мощности, Google может расторгнуть договор после месячного льготного периода или принять предложение о любом доступном оборудовании по пропорционально сниженной цене. Также любая из сторон может расторгнуть соглашение, начиная со следующего года, уведомив об этом за 90 дней. «Это краткосрочное, своевременное соглашение, призванное обеспечить нам промежуточные мощности для удовлетворения растущего спроса клиентов на нашу агентскую платформу Gemini Enterprise, который оказался даже выше, чем мы ожидали», — заявил представитель Google Cloud. Google была одним из первых инвесторов SpaceX. Исполнительный директор Google Дональд Харрисон (Donald Harrison) входит в совет директоров SpaceX. Эксперты отмечают довольно высокую стоимость аренды и даже подозревают Google в том, что сделка призвана увеличить стоимость акций во время IPO SpaceX, поскольку Google принадлежит довольно значительная доля в SpaceX. Ранее компании обсуждали возможность сотрудничества по размещению ЦОД в космосе, пишет The Wall Street Journal. Google планирует запустить собственные орбитальные ЦОД к 2027 году в рамках проекта Project Suncatcher. Для создания этих спутников компания сотрудничает с Planet Labs. Как отметил ресурс TNW, сделка примечательна тем, что у Google есть собственные, двольно значительные вычислительные мощности. По некоторым оценкам, она является крупнейшим в мире владельцем вычислительных мощностей для ИИ, во многом благодаря своим ИИ-ускорителям TPU. Компания направит более $180 млрд на капитальные затраты в этом году и ожидает, что эта цифра «значительно увеличится» в 2027 году. Alphabet на этой неделе объявила о продаже акций на $85 млрд для финансирования этих расходов. Сделка с Alphabet по структуре похожа на соглашение, объявленное SpaceX и Anthropic в конце мая. Им предусмотрена выплата Anthropic $1,25 млрд в месяц до 2029 года за вычислительные мощности в ЦОД Colossus и Colossus II в Мемфисе (Memphis), причём точно так же предусмотрено досрочное расторжение договора. Сначала Anthropic объявила о планах арендовать 220 тыс. чипов NVIDIA у SpaceX, а затем расширила сделку до 325 тыс. чипов NVIDIA (по данным CNBC).

04.06.2026 [10:29], Сергей Карасёв

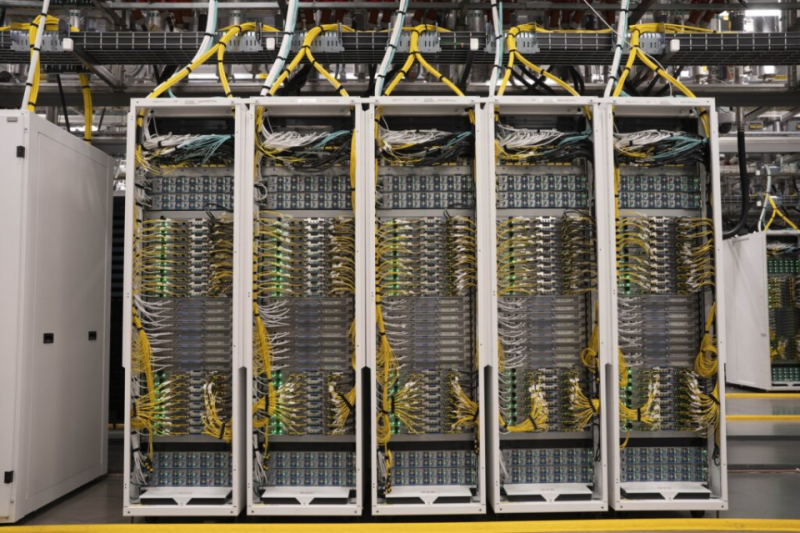

NVIDIA разработала CPO-коммутатор Quantum-X InfiniBand Photonics Q3450-LD со 144 портами 800GСтартап Lambda, развивающий неооблачную ИИ-платформу, поделился подробностями о коммутаторе Quantum-X InfiniBand Photonics Q3450-LD, разработанном компанией NVIDIA для крупных дата-центров, ориентированных на ресурсоёмкие нагрузки ИИ. Устройство, анонсированное в прошлом году, выполнено в форм-факторе 4U по технологии CPO (Co-Packaged Optics). Реализованы 144 порта 800G InfiniBand (коннекторы MPO — Multi-fiber Push-On). Заявленная неблокируемая коммутационная способность составляет 115,2 Тбит/с. Коммутаторы CPO не требуют традиционных подключаемых трансиверов. Применяются 18 съёмных внешних модулей источников света, каждый из которых обслуживает восемь портов MPO. Рич Андервуд (Rich Underwood), системный архитектор высокопроизводительных вычислений в компании Lambda, отмечает, что для традиционного 72-портового коммутатора необходимы 72 трансивера, каждый из которых потребляет примерно 25 Вт. Исключение этих компонентов из системы обеспечивает существенную экономию энергии. Коммутатор NVIDIA Photonics CPO потребляет 3,95 кВт против 7,0 кВт у стандартного устройства сопоставимого класса. Таким образом, достигается экономия 3,05 кВт на каждый коммутатор: эта мощность может быть перераспределена на другие задачи, в частности, на питание ИИ-ускорителей. Кроме того, использование CPO позволяет повысить надёжность. Для дата-центра со 128 тыс. GPU требуется приблизительно 655 тыс. дискретных модулей трансиверов. Каждый из них является потенциальной точкой отказа. Технология CPO полностью исключает этот класс компонентов, а следовательно, повышает стабильность работы и минимизирует количество сбоев. Устройство Quantum-X InfiniBand Photonics Q3450-LD оснащено двухконтурным жидкостным охлаждением. Для питания служит шина постоянного тока 48 В.

03.06.2026 [15:14], Руслан Авдеев

ЦОД проекта Microsoft Fairwater заработал в Висконсине, и он уже готов принять NVIDIA Vera RubinКомпания Microsoft запустила новую ИИ-фабрику проекта Fairwater в Висконсине. Ввод в эксплуатацию состоялся раньше запланированного срока, на объекте заработали сотни тысяч ИИ-систем NVIDIA Grace Blackwell, в частности NVIDIA GB200. Объект подключён к аналогичной ИИ-фабрике в Джорджии. В результате сформирована масштабируемая распределённая вычислительная система для самых требовательных передовых ИИ-моделей. Благодаря совместной работе над системами электроснабжения, охлаждения и сетевой инфраструктурой NVIDIA Spectrum-X Ethernet, а также новому сетевому протоколу Multipath Reliable Connection (MRC) с распределением пакетов данных по множественным маршрутам, архитектура Fairwater позволяет оптимизировать «экономику токенов» — стоимость обработки и генерации данных искусственным интеллектом. Дополнительно Microsoft завершила проверку платформы NVIDIA Vera Rubin. Облачный гигант подтвердил готовность платформы к развёртыванию в дата-центрах Microsoft Azure. NVIDIA Vera Rubin может использоваться наряду с системами Blackwell без необходимости модернизации инфраструктуры. Она обеспечивает производительность при инференсе до 10 раз выше на каждый затраченный мегаватт потребляемой мощности по сравнению с платформой-предшественницей. Интегрированная технология NVIDIA Confidential Computing защищает модели и данные в процессе работы ИИ-агентов. Платформа NVIDIA Dynamo представляет собой программное решение для высокопроизводительного инференса, ускоряющее запуск и эксплуатацию ИИ-моделей. Кроме того, она ускоряет запуск моделей в среде AKS (Azure Kubernetes Service). Технология NVIDIA Grove отвечает за распределённую оркестрацию инференса в инфраструктуре Kubernetes. Речь идёт о запуске новой ИИ-фабрики Fairwater в США. Не так давно в эксплуатацию ввели объект в Атланте, хотя строительство в Висконсине началось довольно давно. В конце апреля глава Microsoft Сатья Наделла (Satya Nadella) заявил, что кампус строится ударными темпами и будет введён в эксплуатацию раньше намеченного срока.

03.06.2026 [15:09], Руслан Авдеев

Ayar Labs присоединилась к экосистеме NVIDIA NVLink Fusion с собственной CPO-технологиейAyar Labs присоединилась к экосистеме NVIDIA NVLink Fusion. Технология Co-Packaged Optics (CPO), предлагаемая компанией, позиционируется как решение для подключения будущих стоечных ИИ-систем на основе масштабируемой гетерогенной вычислительной архитектуры NVIDIA, сообщает Converge! Digest. Новый шаг объединяет технологию оптических интерконнектов Ayar Labs с оптическими и SerDes-технологиями NVIDIA. Это позволит крупным компаниям и разработчикам ИИ-систем интегрировать оптические соединения в ИИ-инфраструктуру на базе NVLink Fusion. ИИ-кластерам нового поколения необходимо обеспечить эффективную передачу огромных объёмов информации по мере увеличения гетерогенности систем и количества используемых ускорителей. Обычные интерконнекты практически достигли предела в контексте плотности пропускной способности, дальности действия, задержек и энергопотребления. Ayar Labs пытается преодолеть эти ограничения, интегрируя оптические модули с вычислительными. Это позволит нарастить как пропускную способность, так и дальность действия, одновременно снизив потребление электроэнергии. В рамках партнёрства с NVIDIA компания Ayar Labs намерена сотрудничать с клиентами и партнёрами по экосистеме, чтобы поддержать развёртывание своих CPO-решений в архитектурах на основе NVLink Fusion. Такая платформа позволяет интегрировать специализированные процессоры и ИИ-ускорители в стоечные системы NVIDIA, сохраняя совместимость с более широкой экосистемой NVLink. Благодаря оптической связи архитекторы систем получат ещё один вариант для проектирования крупных ИИ-фабрик. Объявление последовало за раундом финансирования серии E, в котором Ayar Labs, с 2015 года занимающаяся оптическими IO-технологиями для ИИ и HPC, привлекла $500 млн. В раунде приняла участие и компания NVIDIA. По словам Converge!, речь идёт о новой вехе для рынка CPO-технологий, поскольку этот шаг Ayar Labs приближает массовое внедрение таких решений в ИИ-инфраструктуру. Технология CPO годами рассматривалась как преемник подключаемых оптических модулей с высоким энергопотреблением и медных интерконнектов, и именно сегодня кластеры ИИ-ускорителей достигли такой производительности, что CPO становится всё более привлекательным вариантом для ИИ-систем. Решение NVIDIA включить Ayar Labs в экосистему NVLink Fusion свидетельствует о признании в отрасли ИИ того факта, что будущие системы могут потребовать использования оптики не только между стойками, но и внутри них. NVIDIA NVLink Fusion позволяет создавать кастомные ИИ-платформы со сторонними чипами и другими компонентами. Ранее NVIDIA заключила соглашения в отношении NVLink с Arm, AWS, Fujitsu, Intel, Marvell, MediaTek и SiFive.

03.06.2026 [10:59], Сергей Карасёв

Dell представила серверы PowerEdge на базе NVIDIA Vera для агентного ИИКомпания Dell Technologies сообщила об обновлении семейства решений AI Factory with NVIDIA, ориентированных на внедрение ИИ. Дебютировали серверы PowerEdge R9822 и PowerEdge M9822 на аппаратной платформе NVIDIA Vera, предназначенные в том числе для развёртывания ИИ-агентов. Процессоры Vera содержат 88 ядер Olympus (176 потоков инструкций), совместимых с набором инструкций Arm v9.2. Возможно использование до 1,5 Тбайт LPDDR5X с пропускной способностью до 1,2 Тбайт/с. Сервер PowerEdge R9822 выполнен в форм-факторе 3U и оснащён воздушным охлаждением. Система подходит для различных сценариев использования — от агентных приложений и аналитики данных до задач общего назначения, обрабатываемых посредством CPU. Машина может интегрироваться в инфраструктуры существующих дата-центров. В свою очередь, модель PowerEdge M9822 наделена системой прямого жидкостного охлаждения. Этот сервер обеспечивает высокую плотность мощности в средах, оптимизированных для ИИ-агентов и НРС.

Источник изображения: Dell Прочие характеристики новинок пока не раскрываются. Но отмечается, что платформа Dell AI Factory with NVIDIA поддерживает такие сетевые технологии, как Spectrum-X Ethernet и Quantum-X800 InfiniBand. Могут использоваться программные решения NVIDIA AI Enterprise, мультимодальные языковые модели NVIDIA Nemotron, среда OpenShell и пр. В продажу по всему миру серверы PowerEdge R9822 и PowerEdge M9822 поступят в сентябре текущего года. Нужно отметить, что решения на платформе NVIDIA Vera готовят и другие ведущие поставщики серверного оборудования. В частности, такие системы недавно анонсировала компания HPE.

02.06.2026 [17:57], Владимир Мироненко

Intel с партнёрами разработает эталонный дизайн ИИ-стоек с чипами Xeon для ODM- и OEM-производителей

clearwater forest

foxconn

granite rapids

hardware

intel

nvidia

odm

oem

sambanova systems

xeon

ии

инференс

стойка

Intel совместно с SambaNova и Foxconn объявила о намерении создать референс-дизайн стоечной ИИ-инфраструктуры на базе процессоров Intel Xeon для ЦОД, гиперскейлеров и центров интеллектуального управления. Как сообщает The Register, подход основан на ранее разработанной Intel совместно с SambaNova концепции дезагрегированного ИИ. Архитектура распределяет ресурсоёмкие операции предварительного заполнения между ускорителями NVIDIA, используя чипы SambaNova для ресурсоёмких операций декодирования, что позволяет увеличить выход токенов для каждого пользователя в 2–3 раза. Генеральный директор Intel Лип-Бу Тан (Lip-Bu Tan) представил два примера таких проектов. Один предназначен для агентных нагрузок, чувствительных к задержкам, а другой — для обеспечения максимальной плотности вычислений. Обе конфигурации поддерживают до 128 процессоров Intel: либо 128-ядерных Granite Rapids-AP, либо 288-ядерных Clearwater Forest, что в сумме составляет от 16 384 P-ядер до 36 864 E-ядер, а также до 384 Тбайт DDR5 при энергопотреблении 100 кВт. Тан сообщил, что системы на основе этого референс-дизайна будут широко доступны у ODM- и OEM-партнёров компании. В рамках сотрудничества Foxconn предоставит возможности системной интеграции для новой стоечной ИИ-инфраструктуры. Компания также планирует выпускать вариант стоечной инфраструктуры с высокой плотностью процессоров для рабочих нагрузок, не требующих дополнительного ускорения, включая оптимизированные по стоимости задачи инференса, обработку данных и гибридный ИИ. Intel объявила, что облачный провайдер Vector Core Compute, созданный Vista Equity Partners и Cambium Capital, станет одним из первых, кто развернёт эту платформу, а Together.AI — её первым коммерческим клиентом. Также на выставке Computex 2026 компании Intel, SambaNova, Vista Equity Partners и Cambium Capital представили первую реальную демонстрацию дезагрегированной системы инференса, использующей процессоры Intel Xeon 6 для оркестрации, блоки RDU SambaNova SN40 для декодирования и NVIDIA Blackwell для предварительного заполнения, работающую в ЦОД Vector Core Compute в Лос-Анджелесе. Напомним, что ранее NVIDIA объявила о запуске аналогичной стоечной платформы, включающей 256 88-ядерных процессоров Vera, ускорители Rubin и LPU Groq 3. Arm также работает над парой референс-дизайнов стоечных систем для агентных рабочих нагрузок на основе своих новых процессоров Arm AGI: 36-кВт системой с воздушным охлаждением и 8160 ядрами, а также 200-кВт системой с жидкостным охлаждением и 45 696 ядрами.

02.06.2026 [11:12], Сергей Карасёв

HPE представила сервер ProLiant Compute DL394 Gen12 на платформе NVIDIA VeraКомпания HPE анонсировала сервер ProLiant Compute DL394 Gen12 для ресурсоёмких нагрузок в области ИИ и обработки данных. Система выполнена на аппаратной платформе NVIDIA Vera. Изделия Vera насчитывают 88 ядер Olympus, совместимых с набором инструкций Arm v9.2. Возможна одновременная обработка до 176 потоков инструкций. Поддерживается до 1,5 Тбайт LPDDR5X с пропускной способностью до 1,2 Тбайт/с. Характеристики ProLiant Compute DL394 Gen12 пока полностью не раскрываются. Известно, что новинка выполнена в форм-факторе 2U. HPE отмечает, что изделия Vera благодаря монолитной конструкции позволяют решить проблему неоднородного доступа к памяти, которая может наблюдаться при использовании традиционных чиплетных архитектур с большим количеством ядер. Эта особенность приводит к переменным задержкам и непредсказуемой производительности. В случае Vera каждому вычислительному ядру предоставляется полоса пропускания до 14 Гбайт/с, что даёт возможность обрабатывать данные на стабильно высокой скорости. В сервере реализованы средства управления HPE Integrated Lights-Out (HPE iLO 7). Говорится о защите от будущих кибератак, основанных на квантовых вычислениях, в соответствии с требованиями Национального института стандартов и технологий США (NIST). Средства HPE Compute Ops Management (COM) обеспечивают унифицированное управление серверной инфраструктурой из единой консоли. ProLiant Compute DL394 Gen12 может применяться для агентного ИИ, обработки больших объёмов транзакций и других задач. В продажу сервер поступит осенью текущего года.

02.06.2026 [10:04], Руслан Авдеев

NVIDIA усилила DPU BlueField-4 мониторингом работы ИИ-агентов в реальном времениNVIDIA Vera BlueField-4 STX (BF-4 STX) обеспечит ИИ-системам защиту ИИ-агентов, контекстной памяти и доступа к файлам непосредственно на аппаратном уровне, сообщает Blocks & Files. DPU поддерживает программную платформу DOCA (Data Center Infrastructure-on-a-Chip Architecture), обеспечивающую доступ по принципу Zero Trust, а также ведёт мониторинг и контроль деятельности ИИ-агентов для предотвращения утечки данных, несанкционированного доступа и других угроз. Решение разработано в рамках создания платформы NVIDIA Vera Rubin. Решение использует три интегрированные библиотеки безопасности и микросервисы DOCA, работающие в процессоре и памяти DPU. В частности, речь идёт о микросервисе DOCA Vault, благодаря которому доступ к нужным файлам с необходимыми правами получают только авторизованные ИИ-нагрузки. DOCA Argus обеспечивает прозрачность действий ИИ-агентов и рабочих нагрузок, а DOCA Flow помогает изолировать сетевой трафик и защитить конфиденциальные данные в экосистемах с многочисленными арендаторами ресурсов. Благодаря BF-4 STX серверы и СХД могут анализировать и контролировать взаимодействие ИИ-агентов, данных и контекстной памяти в потоке данных. По информации NVIDIA, обнаружение угроз происходит до 1000 раз быстрее, чем в существующих средах без агентного мониторинга, а контроль работы осуществляется на скоростях до 800 Гбит/с. Свои решения в сфере безопасности интегрируют с Vera BlueField-4 STX компании Akamai, Armis, Check Point, Cisco, CrowdStrike, EQTY, F5, Fortinet, Palo Alto Networks, TrendAI, Xage Security и Zscaler. Платформы на базе STX предлагают провайдеры систем хранения данных: Cloudian, DDN, Dell, Everpure, Hitachi Vantara, HPE, IBM, MinIO, NetApp, Nutanix, VAST Data и WEKA. Системы на базе STX уже разрабатывают Asus, Foxconn, Gigabyte Technology, Supermicro, Wistron и Wiwynn. Заказчикам помогают внедрять соответствующие решения интеграторы Accenture, Deloitte и World Wide Technology.

01.06.2026 [16:04], Руслан Авдеев

США принимают меры, чтобы заблокировать поставки ИИ-чипов NVIDIA китайским компаниямМинистерство торговли США в воскресенье приняло меры, чтобы закрыть потенциальную лазейку, потенциально позволяющую экспортировать компаниям передовые чипы NVIDIA подразделениям китайских техногигантов, находящимся за пределами КНР, сообщает Reuters. Предполагается, что лучшие американские чипы поступали филиалам китайских компаний, расположенным в странах вроде Малайзии, Индонезии и даже Японии. Новое руководство опубликовали на сайте Министерства торговли, после того как, по данным источников, в Вашингтоне появился документ, посвящённый данной лазейке. В документе, пока не имеющем авторства, сообщается, что «шлюзы незаметно открылись». Другими словами, постепенно снизилась эффективность ограничений. Пока нет данных, как много чипов экспортировали в год, когда, как пишет Reuters, «администрация Трампа оставила дверь открытой» Один из осведомлённых отраслевых источников сообщил, что речь идёт о сотнях тысяч ускорителей. В руководстве Бюро промышленности и безопасности (BIS) сообщило, что обеспечит обязательное лицензирование для структур со штаб-квартирами в Китае, даже если их подразделения расположены за его пределами. Фактически, как сообщает бюро, руководство разъясняет требования к лицензированию, действующие с 2023 года. Представитель NVIDIA заявил, что новое руководство ничего не изменит для компании, добавив, что не может поставлять чипы, поскольку Министерство торговли недвусмысленно установило в своём документе лицензионные ограничения для компании. Фактически Министерство торговли само создало лазейку, когда объявило в мае 2025 года, что не будет соблюдать правило AI Diffusion Rule, принятое в последние дни прошлой администрации США — оно фактически делило мир на страны, которым можно продавать ИИ-ускорители без ограничений и те, которым можно, но с оговорками или вовсе нельзя. По словам экспертов, оставленная лазейка позволяла зарубежным подразделениям китайских компаний покупать чипы NVIDIA Blackwell безо всяких лицензий. В результате китайские компании покупают эти чипы и, похоже, в больших масштабах. Эксперты уверены, что новое руководство закроет лазейку, но останется другая. В частности, к TSMC и другим контрактным производителям отсутствуют требования проверять, что заказываемые у них передовые ИИ-чипы не предназначены для подставных структур, работающих на китайских покупателей. Сообщается, что в новом руководстве этот недочёт по-прежнему не устранен. Кроме того, если чипы уже установлены, новый документ не требует от операторов ЦОД прекратить использование таких чипов или остановить обслуживание передового оборудования вроде серверов. Ранее сообщалось, что Китай довольно активно прибегает к контрабанде ИИ-ускорителей, а также пользуется услугами компаний за рубежом, чтобы обойти американские санкции. Кроме того, страна наращивает производство собственных ускорителей и достигла соглашения с США о поставках относительно устаревших NVIDIA H200.

01.06.2026 [12:35], Сергей Карасёв

Двухтонный ИИ: Dell начала поставки первых стоек NVIDIA Vera Rubin NVL72Компания Dell Technologies поставила свою первую стойку NVIDIA Vera Rubin NVL72. Получателем системы стала компания CoreWeave — неоооблачный провайдер, который активно расширяет инфраструктуру для ресурсоёмких нагрузок ИИ. Стойка содержит 72 ускорителя Rubin и 36 процессоров Vera на архитектуре Arm. Суммарный объём памяти HBM4 составляет 20,7 Тбайт, системной памяти LPDDR5X — 54 Тбайт. Реализовано жидкостное охлаждение горячей водой (+45 °C). Сама стойка в собранном виде весит около 1,8 т и потребляет до 230 кВт. Заявленная ИИ-производительность достигает 3,6 Эфлопс в режиме NVFP4 при инференсе, что примерно в пять раз превышает показатель Blackwell. На задачах обучения быстродействие NVFP4 составляет 2,5 Эфлопс. Отмечается, что Dell успешно провела все необходимые диагностические тесты Vera Rubin NVL72, по результатам которых система готова к дальнейшему развёртыванию на площадке заказчика. CoreWeave намерена использовать новый кластер для расширения своей инфраструктуры НРС. Масштабный вывод платформы на рынок намечен на II половину текущего года. Между тем сама NVIDIA объявила о начале массового производства решений поколения Vera Rubin. В числе партнёров, объявивших о поддержке этих систем, названы Dell Technologies, HPE, Lenovo и Supermicro, а также AIC, Aivres, ASRock Rack, ASUS, Cloudian, Compal, DDN, Everpure, Foxconn, GIGABYTE, Hitachi Vantara, Hyve Solutions, IBM, Inventec, MinIO, MiTAC Computing, MSI, NetApp, Nutanix, Pegatron, Quanta Cloud Technology (QCT), VAST Data, WEKA, Wistron и Wiwynn. Вместе с тем CoreWeave, а также Lambda и Oracle Cloud Infrastructure одними из первых начнут развёртывание стоек Vera Rubin в своих ИИ-инфраструктурах. |

|