Материалы по тегу: samsung

|

28.04.2026 [16:33], Руслан Авдеев

Samsung Heavy Industries займётся строительством плавучих ЦОД совместно с американской Mousterian CorporationОдин из крупнейших в мире судостроителей — южнокорейская Samsung Heavy Industries подписала меморандум с американским девелопером береговой цифровой инфраструктуры Mousterian Corporation (M3) о создании плавучих ЦОД (FDC) гиперскейл-класса для удовлетворения спроса ИИ-вычисления, сообщает Converge! Digest. Особенно потенциальным партнёрам интересны регионы с ограниченными земельными ресурсами и проблемами с подключением к местными электросетям. По словам Mousterian Corporation, привлечение к проекту Samsung Heavy Industries подтверждает институциональную жизнеспособность FDC как явления. В рамках нового партнёрства M3 возглавит подбор участков, строительство, взаимодействие с потенциальными арендаторами и привлечение капитала, а Samsung Heavy Industries обеспечит компетенции в области морского инжиниринга, изготовления различных конструкций и крупнотоннажного судостроения. Компании намерены заняться внедрением плавучих ЦОД в различных юрисдикциях с использованием промышленных методов морского строительства. Это позволит ускорить сроки развёртывания инфраструктуры в сравнении с традиционными наземными дата-центрами. Концепция плавучих ЦОД ориентирована на размещение вычислительной инфраструктуры рядом с действующими электростанциями, в том числе в локациях с недоиспользуемыми, невостребованными мощностями. Реализация проекта позволяет обойти традиционные ограничения, связанные с энергоснабжением, а также получением разрешений на застройку. Таким образом партнёры стремятся ускорить создание ИИ-инфраструктуры гигаваттного масштаба с применением морских систем для эффективного охлаждения и модульного масштабирования. Кроме того, упоминалось и совместное создание плавучих малых модульных реакторов (SMR). По мнению Converge!, жизнеспособность таких проектов во многом зависит от особенностей реализации и экономической целесообразности той или иной площадки. Близкое расположение от прибрежных электростанций, терминалов СПГ и морских энергетических установок упростит получение питания и ускорит развёртывание. Охлаждение забортной водой позволит эффективно отводить тепло от высокоплотных кластеров. Кроме того, изготовление на верфях обеспечивает повторяемую, модульную модель производства, при эффективном масштабировании способную оптимизировать сроки строительства и предсказуемость затрат. Тем не менее экономическая целесообразность носит скорее ситуативный характер. Морские и прибрежные проекты требуют более высоких капитальных затрат, связанных с проектированием морского оборудования, системами швартовки, защитой от коррозии и специализированным техническим обслуживанием. Из-за специфики логистики, нехватки рабочих руки и более суровых условий работы могут вырасти и эксплуатационные расходы. Финансирование также может усложниться, поскольку плавучие ЦОД представляют собой гибриды морской инфраструктуры и цифровых активов, что требует от кредиторов и страховых компаний разработки новых систем оценки рисков. Для успеха модели решающую роль играет стратегия энергоэффективности и энергоснабжения. Тем не менее, кабельные системы для таких ЦОД будут довольно сложны и дороги, это касается и ВОЛС. Поэтому проекты FDC, вероятно, останутся нишевым, но ценным вариантом, особенно для тех регионов, где энергия вблизи воды имеется в изобилии, а вот земли не хватает. К таковым относится, например, Сингапур и окрестности. В Японии тоже есть несколько аналогичных проектов, сразу два от Mitsui и ещё один от NYK Line. Часть проектов опирается на питание не с берега, а с плавающих электростанций. Морские проекты, связанные с цифровой инфраструктурой — не редкость. Так, Samsung подписала с OpenAI письмо о намерениях, предусматривавшее, в числе прочего, и совместную разработку плавучих ЦОД, а Aikido объединила морские ветряки с модульными дата-центрами. Впрочем, не все проекты заканчиваются успешно. Так, один из пионеров плавучих ЦОД Nautilus в итоге выставила на продажу свой дата-центр и переключилась на инфраструктурные решения для наземных ЦОД.

15.03.2026 [11:15], Сергей Карасёв

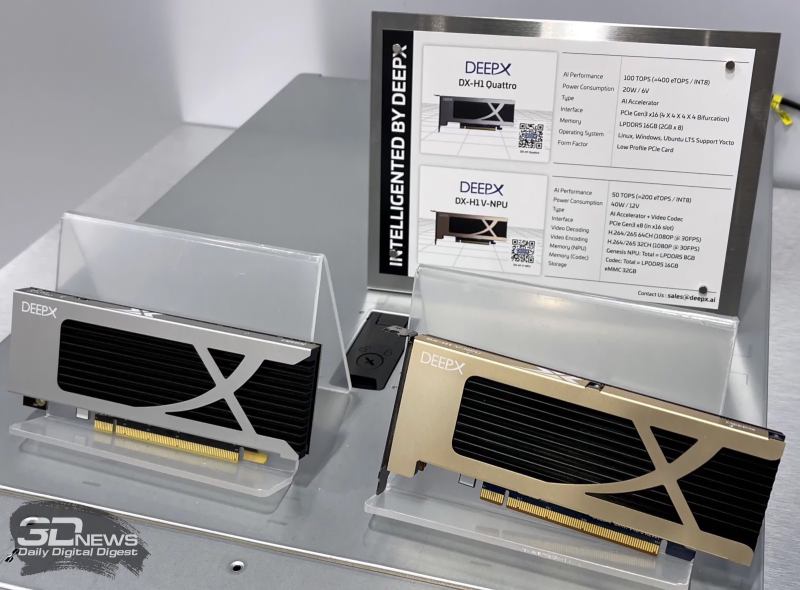

Выпуск ИИ-чипов DeepX DX-M2 отложен из-за проблем у TeslaИзменение графика разработки ИИ-ускорителя Tesla следующего поколения, по сообщению ресурса DigiTimes, привело к тому, что южнокорейская компания DeepX вынуждена отложить выпуск своих чипов DX-M2, массовое производство которых изначально было запланировано на II квартал 2027 года. Отмечается, что задержки возникли с разработкой изделия Tesla AI6. Предполагается, что это решение будет применяться для поддержания разнообразных нагрузок в инфраструктуре Tesla, включая платформы автономного вождения, системы человекоподобного робота Optimus и дата-центры для ИИ-задач. В 2025 году Tesla подписала контракт с Samsung на изготовление AI6 вплоть до декабря 2033-го: стоимость соглашения составляет $16 млрд. Первоначальный договор предусматривал производство около 16 тыс. пластин в месяц, однако затем Tesla запросила дополнительно 24 тыс. пластин, что в сумме предполагает объем до 40 тыс. пластин ежемесячно. Для Tesla AI6 планируется применение 2-нм техпроцесса Samsung. По такой же методике будут выпускаться чипы DeepX DX-M2. Для обоих этих изделий оговорено использование услуги Multi-Project Wafer (MPW), при которой на одной кремниевой пластине в рамках получения прототипов размещаются изделия нескольких разных заказчиков. Такой подход позволяет снизить затраты на разработку перед организацией массового производства. Однако, по информации DigiTimes, с выходом Tesla AI6 на этап MPW возникли задержки. С чем именно связаны сложности, не уточняется. Отраслевые эксперты полагают, что пересмотр графика может быть обусловлен изменением сроков инвестиций в автономные транспортные средства, роботизированные платформы и суперкомпьютеры с ИИ. Компания Samsung отказалась от комментариев, сославшись на конфиденциальность проектов заказчиков. Между тем из-за задержек Tesla выпуск чипов DeepX DX-M2 по программе MPW, который планировалось начать в апреле, переносится на более поздний срок. В соответствии с новым графиком, тестирование качества этих решений будет организовано не ранее III квартала текущего года. Ожидается, что DX-M2 обеспечит ИИ-производительность на уровне 80 TOPS при максимальном энергопотреблении примерно 5 Вт. Чип поддерживает память LPDDR5X. Утверждается, что процессор способен работать с ИИ-моделями, насчитывающими до 100 млрд параметров.

10.03.2026 [17:49], Владимир Мироненко

Groq увеличил заказ на производство ИИ-чипов у Samsung более чем в 1,5 разаИИ-стартап Groq, приобретённый NVIDIA за $20 млрд, направил Samsung Electronics запрос на увеличение производства своих чипов, сообщил Chosunbiz со ссылкой на информированные источники. Источники утверждают, что Groq недавно принял решение увеличить производство ИИ-чипов, которое в прошлом году было передано на аутсорсинг подразделению Samsung Electronics, с примерно 9 тыс. пластин до примерно 15 тыс. Если в прошлом году объём производства был ограничен изготовлением опытных образцов чипов для определения их эффективности при использовании для ИИ-инференса, то в этом году, судя по объёму, Groq находится на ранней стадии массового производства для выхода на коммерческие рельсы. Как отметил Chosunbiz, хотя объём поставок Groq для Samsung Electronics невелик, подразделение Samsung Electronics активно работает с потенциальными клиентами, чтобы заложить основу для получения крупных заказов на поставку ИИ-чипов. Помимо Groq, подразделение Samsung Electronics также производит весь ассортимент процессоров для HyperExcel — южнокорейского стартапа по разработке чипов для ИИ-инференса. Samsung Electronics производит ИИ-чипы для Groq и HyperExcel по 4-нм техпроцессу. По словам источника в полупроводниковой отрасли, «4-нм техпроцесс, используемый Samsung Electronics для массового производства чипов Groq для ИИ-нагрузок, включает ряд улучшенных процессов для повышения производительности чипа. Учитывая высокую стоимость процесса и самый высокий спрос в отрасли на 4–5-нм техпроцессы, это также имеет важное значение для обеспечения конкурентного преимущества перед TSMC». Собеседник ресурса Chosunbiz прогнозирует, что с учётом выхода NVIDIA на рынок ИИ-чипов и увеличения производства Groq ожидается бурный рост рынка чипов для ИИ-инференса. Ожидается, что на мероприятии GTC 2026 NVIDIA представит чип для ИИ-инференса на основе дизайна, разработанного Groq, в котором используется память SRAM вместо HBM. Как сообщают источники, одним из заказчиков нового чипа будет OpenAI.

18.11.2025 [16:01], Руслан Авдеев

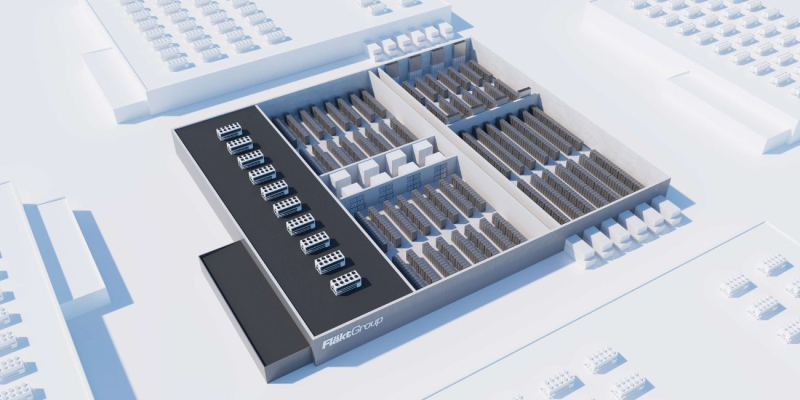

Samsung и Hyundai инвестируют $400 млрд в ИИ-проекты в Южной КорееКомпании Samsung и Hyundai объявили о масштабных инвестициях в размере $400 млрд в ИИ-проекты на территории Южной Кореи, сообщает Datacenter Dynamics. Анонс сделан вскоре после того, как США и Южная Корея договорились о торговой сделке, в рамках которой Южная Корея обязалась инвестировать $350 млрд в различные секторы американской экономики, в том числе полупроводниковую отрасль, энергетику и искусственный интеллект. На внутреннем рынке Samsung намерена инвестировать ₩450 трлн ($308 млрд). Значительная доля средств пойдёт на бизнес, связанный с ЦОД и производством полупроводников. В частности, к 2028 году будет построена пятая производственная линия на заводе в Пхёнтхэке (Pyeongtaek), где выпускаются чипы памяти HBM. Впрочем, практически ничего нового компания не сказала. О переносе строительства говорилось и ранее. Теперь компания добавила, что намерена вкладывать средства в обеспечение стабильного выпуска HBM. Также средства пойдут на строительство в Южной Корее производства для немецкой Flakt, выпускающей системы воздушного охлаждения, которую Samsung купила в начале ноября. Масштабы инвестиций особенно впечатляют, если учесть тяжёлый для выпускающей полупроводники «флагманской» дочерней структуры — Samsung Electronics. В III квартале наметились признаки восстановления бизнеса, и компания объявила о росте консолидированной выручки на 15,4 % квартал к кварталу, а также о рекордно высокой квартальной выручке подразделения, отвечающего за производство памяти. Тем не менее, ещё во II квартале компания столкнулась со значительным спадом, со снижением операционной прибыли на 94 % год к году.

Источник изображения: Yu Kato/unsplash.com Hyundai намерена инвестировать в отечественную экономику ₩125,2 трлн ($85 млрд) в течение пяти лет, начиная с 2026 года. При этом ₩50,5 трлн ($34,5 млрд) потратят на дата-центры, ИИ, электрификацию, робототехнику, водородные технологии и умный транспорт. Мощности ЦОД автопроизводителя будут использовать для обработки данных и эксплуатации ИИ, с особым упором на автономные транспортные средства и ИИ-роботов. По-видимому, именно об этом говорилось в соглашении с NVIDIA на поставку 50 тыс. ускорителей для создания ИИ-фабрики. Переговоры о тарифах между Южной Кореей и США оказались сложными. Президент США Дональд Трамп потребовал, чтобы Южная Корея вложила в экономику США $350 млрд. Депортация южнокорейских инженеров с аккумуляторного завода в США только подлила масла в огонь. Корейские власти заявили, что такой шаг поставит страну в положение, в котором она оказалась во время финансового кризиса 1997 года. Пока что американские пошлины на южнокорейские автомобили и автозапчасти снижены с 25 % до 15 %, а для полупроводников гарантируется режим не менее благоприятный, чем у других стран с развитой соответствующей отраслью.

01.11.2025 [01:07], Владимир Мироненко

NVIDIA продаст Южной Корее 260 тыс. ускорителей для создания суверенной ИИ-инфраструктуры

hardware

hyundai

kakao

lg

naver

nvidia

samsung

sk group

ии

медицина

производство

робототехника

сделка

суперкомпьютер

цифровой двойник

южная корея

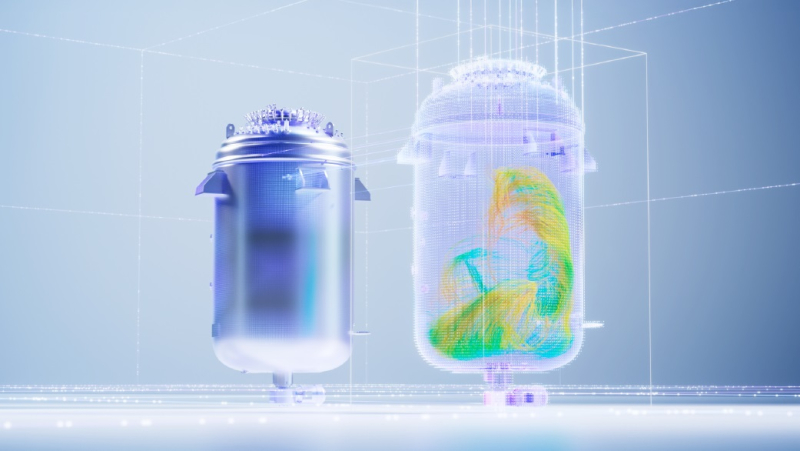

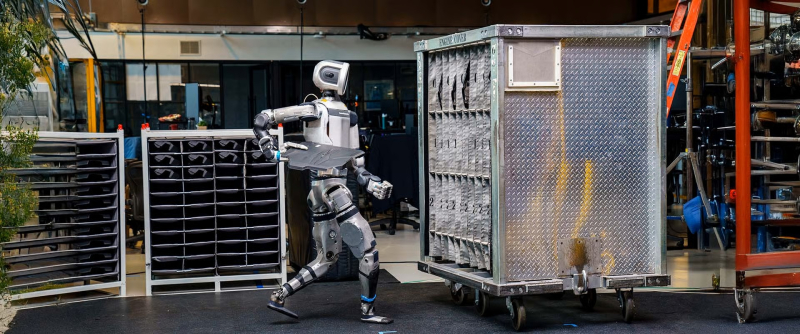

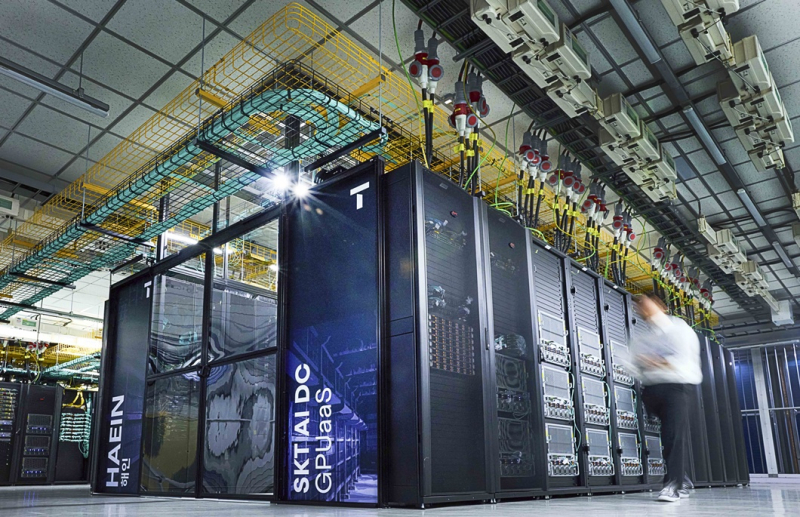

NVIDIA объявила на саммите АТЭС о стратегическом партнёрстве с рядом ведущих южнокорейских компаний и Министерством науки и ИКТ (MSIT) Южной Кореи, в рамках которого в стране будет развёрнута ИИ-инфраструктура с использованием 260 тыс. ИИ-ускорителей NVIDIA для поддержки суверенного ИИ, развития робототехники, производства и цифровой трансформации в различных отраслях. Как сообщается в пресс-релизе, масштабную инициативу поддержала коалиция крупнейших компаний Южной Кореи, включающая Samsung Electronics, SK Group, Hyundai Motor Group, NAVER Cloud, LG и т.д. Согласно соглашению, MSIT развернёт до 50 тыс. ускорителей NVIDIA у облачных провайдеров NHN Cloud, Kakao и NAVER Cloud, реализуя свою программу по созданию суверенной ИИ-инфраструктуры. На первом этапе буде установлено 13 тыс. ускорителей NVIDIA Blackwell с последующим наращиванием их количества в ближайшие годы. Samsung, SK Group и Hyundai Motor Group построят ИИ-фабрики, каждая из которых будет оснащена до 50 тыс. ускорителей NVIDIA; ещё 60 тыс. ускорителей развернёт NAVER. Samsung заявила, что использует ускорители NVIDIA для внедрения ИИ на всех этапах производства чипов, а также для разработки и проектирования микросхем, что позволит создать новое поколение полупроводников, мобильных устройств и робототехники с расширенными возможностями ИИ. Как сообщает SiliconANGLE, на планируемом Samsung заводе с «единой интеллектуальной сетью» ИИ будет непрерывно отслеживать и анализировать производственные условия, делать прогнозы, предоставлять информацию для технического обслуживания и оптимизировать все процессы для повышения производительности производства микросхем. Для этого компания будет активно использовать цифровых двойников на базе ИИ, или виртуальные копии своих микросхем, созданные с помощью NVIDIA CUDA-X, cuLitho, моделей Nemotron, а также Omniverse. Используя платформу NVIDIA Omniverse, компания создаст цифровые двойники каждого компонента, используемого в полупроводниках, включая память, логику, современную компоновку и т.д. Также компания планирует создать цифровых двойников своих производственных предприятий и дорогостоящего оборудования, что позволит моделировать процессы производства чипов в виртуальной среде, где она сможет проверить их работу до запуска реальных производственных линий. Это позволит выявлять отклонения и определять, где необходимо профилактическое обслуживание, как оптимизировать производство и многое другое, а затем применять полученные знания на своем реальном заводе. В свою очередь, SK Group разрабатывает ИИ-фабрику на базе до 60 тыс. ускорителей NVIDIA, включая ИИ-облако на базе ускорителей RTX PRO 6000 Blackwell Server Edition. После ввода в эксплуатацию (завершение заключительного этапа ожидается в конце 2027 года) она станет одной из крупнейших в стране ИИ-фабрик, которая будет обслуживать дочерние компании SK, включая SK Hynix и SK Telecom, а также внешние организации по модели GPUaaS. Сообщается, что SK Telecom предоставит отечественным производителям и стартапам суверенную инфраструктуру для создания цифровых двойников и ИИ-агентов, а также приложений для робототехники. Какие именно ускорители NVIDIA будут использовать Samsung и SK Group, пока не уточняется. Hyundai Motor Group сообщила, что совместно с MSIT и NVIDIA создаёт ИИ-фабрику с 50 тыс. ускорителей NVIDIA Blackwell, которая обеспечит обучение, валидацию и развёртывание ИИ-моделей для производства, автономного вождения и робототехники. Компания планирует использовать NVIDIA DRIVE AGX Thor, NeMo, Nemotron и Omniverse для моделирования заводских процессов. Партнёрство будет способствовать созданию Центра ИИ-приложений и Центра ИИ-технологий. Компания также заявила, что построит суперкомпьютер, пишет Data Center Dynamics. Компания NAVER добавит 60 тыс. ускорителей в свою инфраструктуру NVIDIA AI, ориентируясь на задачи суверенного и физического ИИ. Компания планирует разрабатываать отраслевые модели для судостроения, безопасности и услуг в сфере ИИ для граждан Южной Кореи. Также сообщается, что MSIT возглавляет проект Sovereign AI Foundation Models в сотрудничестве с LG AI Research, NAVER Cloud, NC AI, SK Telecom, Upstage и NVIDIA. В его реализации будут использоваться ПО NVIDIA NeMo и открытые наборы данных NVIDIA Nemotron, что позволит использовать локальные данные для разработки моделей с поддержкой корейского языка с функциями рассуждения и речи. NVIDIA и LG сотрудничают в поддержке академических кругов и стартапов, используя модели LG EXAONE, включая модель EXAONE Path в сфере здравоохранения для диагностики рака, созданную на основе фреймворка MONAI. Компания также сотрудничает с NVIDIA в поддержке стартапов в области физического ИИ и академических исследований. В свою очередь, Корейский институт научно-технической информации (KISTI) сотрудничает с NVIDIA с целью создания Центра передового опыта в области квантовых вычислений и научных исследований. Используя свой суперкомпьютер HANGANG шестого поколения и платформу NVIDIA CUDA-Q, KISTI будет изучать гибридные квантовые вычисления, физически информированные ИИ-модели (physics-informed AI models) и базовые SF-модели (Scientific Foundation Models), созданные с помощью фреймворка NVIDIA PhysicsNeMo.

01.10.2025 [18:15], Руслан Авдеев

OpenAI построит ИИ ЦОД Stargate в Южной Корее, а Samsung поможет ей создать плавучие дата-центрыOpenAI подписала с Samsung Electronics и SK hynix письмо о намерениях, предусматривающее поставку чипов памяти знаменитому ИИ-стартапу. Дополнительно сообщается о намерении построить ЦОД Stargate на юго-западе Южной Кореи при участии SK Group. Кроме того, SK Telecom создаёт независимую ИИ-компанию с инвестициями $3,5 млрд в течение пяти лет. В рамках сотрудничества южнокорейские компании планируют нарастить выпуск DRAM — до 900 тыс. пластин в месяц, которые понадобятся для передовых моделей OpenAI. Samsung и её дочерние структуры Samsung SDS, Samsung C&T (Construction and Trading) и Samsung Heavy Industries помогут в реализации проекта Stargate Korea, в том числе со строительством и эксплуатацией ЦОД, облачными сервисами, консалтингом, а также внедрением и управлением сервисами для бизнесов, желающих интегрировать ИИ-модели OpenAI в свои внутренние системы. Упоминаются даже судостроение и морское дело. В частности, сотрудничество предусматривает совместную разработку плавучих ЦОД. Подобные объекты имеют определённые преимущества перед традиционными, поскольку им не требуется свободных участков земли, лишних расходов на охлаждение и углеродные выбросы таких проектов обычно невелики. Компании также изучают возможности создания плавучих электростанций и центров управления.

Источник изображения: Mathew Schwartz/unsplash.com Проект Stargate был запущен OpenAI в январе, при содействии Oracle, SoftBank, и MGX из Абу-Даби и уже заработали его первые ЦОД. Планируется инвестировать $500 млрд в цифровую инфраструктуру в следующие четыре года для обслуживания вычислительных потребностей OpenAI. На прошлой неделе OpenAI анонсировала строительство новых ЦОД Stargate в США, включая дата-центры в Техасе, Нью-Мексико и на Среднем Западе. Планируется реализация проектов Stargate и в других странах помимо Южной Кореи, например — в Великобритании и Норвегии.

30.09.2025 [15:12], Сергей Карасёв

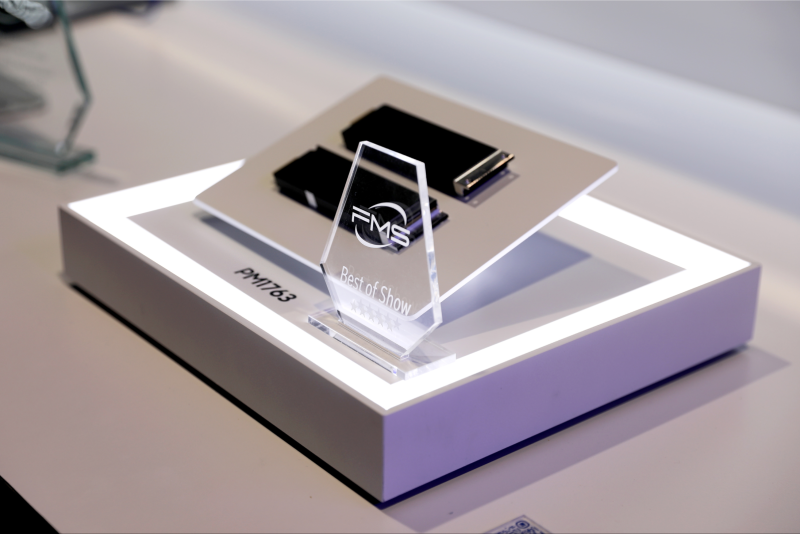

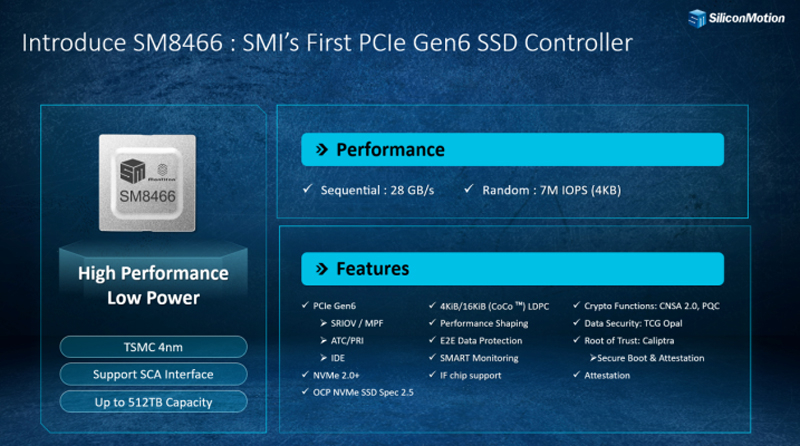

Samsung готовит SSD вместимостью 512 Тбайт с интерфейсом PCIe 6.0На мероприятии Global Memory Innovation Forum (GMIF) 2025 в Шэньчжэне (Китай) сразу несколько крупных компаний поделились планами по разработке SSD с интерфейсом PCIe 6.0, предназначенных для дата-центров и корпоративных инфраструктур. В частности, Samsung работает над продуктами CMM-D с CXL 3.1 и PCIe 6.0, выпуск которых запланирован на следующий год. Дебютируют SSD семейства PM1763 с интерфейсом PCIe 6.0, которые, по утверждениям южнокорейского производителя, обеспечат вдвое большую производительность и значительно более высокую энергоэффективность по сравнению с нынешними накопителями. Энергопотребление заявлено на уровне 25 Вт. Ориентировочно в 2027 году Samsung планирует выпустить SSD с интерфейсом PCIe 6.0 вместимостью до 512 Тбайт. Такие устройства будут предлагаться в форм-факторе EDSFF 1T. Кроме того, компания готовит флеш-память Z-NAND седьмого поколения с технологией GIDS (GPU-Initiated Direct Storage Access), которая позволит ИИ-ускорителям напрямую обращаться к устройствам хранения Z-NAND, минуя CPU и RAM. В свою очередь, Silicon Motion раскрыла дополнительную информацию о контроллере SM8466 с поддержкой PCIe 6.0, о разработке которого стало известно в январе нынешнего года. Это изделие обеспечит скорость последовательной передачи данных до 28 Гбайт/с и величину IOPS до 7 млн. Новый контроллер позволит создавать SSD ёмкостью до 512 Тбайт. Производиться решение будет на предприятии TSMC по 4-нм технологии. Выпуск первых SSD корпоративного класса на основе SM8466 намечен на 2026 год.

Источник изображения: Silicon Motion via Wccftech Накопители PCIe 6.0 также проектирует InnoGrit. Эта компания в 2026-м намерена представить устройства, у которых показатель IOPS (операций ввода/вывода в секунду) будет достигать 25 млн.

10.08.2025 [00:10], Владимир Мироненко

Samsung решила возродить сверхбыстрые SSD с памятью Z-NANDКомпания Samsung Electronics возрождает технологию памяти Z-NAND после семилетнего перерыва, позиционируя её как высокопроизводительное решение для ИИ-нагрузок. По данным DigiTimes, следующее поколение памяти Z-NAND получит 15-кратное увеличение производительности по сравнению с современными NVMe SSD и даст ускорителю возможность напрямую обращаться к накопителю Z-NAND с минимальными задержками. Как пишет Tom's Hardware, исполнительный вице-президент Samsung по производству памяти сообщил, что при значительном росте производительности с помощью технологии Z-NAND энергопотребление накопителей будет на 80 % ниже по сравнению с традиционной флеш-памятью NAND. Кроме того, в новом поколении упор сделан на минимизацию задержек. Для этого Samsung внедряет новую технологию GPU-Initiated Direct Storage Access (GIDS), которая позволит ускорителям напрямую обращаться к устройствам хранения Z-NAND, минуя CPU и RAM, тем самым значительно сокращая время доступа. Samsung представила технологию Z-NAND в 2016 году в качестве альтернативы памяти Intel 3D XPoint (Optane). Вышедший в 2018 году твердотельный накопитель Samsung 983 ZET на базе 64-слойной SLC 3D V-NAND предлагал значительно более низкую задержку и высокие скорости в сравнении с обычными NVMe SSD. По производительности он вплотную приблизился к Intel Optane SSD 900P. Обе технологии фактически относятся к SCM (Storage Class Memory), хотя только Intel предлагала PMem-модули в виде DIMM. Однако в итоге разработку 3D XPoint последняя (вместе с Micron) забросила, да и Samsung, ответив выпуском Z-SSD на появление Optane, решила свою технологию не развивать. Примерно в то же время Kioxia (тогда ещё Toshiba) представила свой вариант сверхбыстрой SLC NAND — XL-Flash. Её она тоже довольно долго особенно не развивала, но планирует уже в следующем году представить XL-Flash SSD с переработанным контроллером, который обеспечит более 10 млн IOPS, особенно на небольших транзакциях. Для точной настройки SSD с целью повышения производительности при запуске ресурсоёмких ИИ-приложений компания сотрудничает с ведущими производителями ускорителей. Phison также предлагает eSLC-накопители PASCARI с технологией aiDAPTIV+. SLC-накопители также есть у Solidigm и Micron. Впрочем, широкая востребованность Z-SSD может оказаться под вопросом. Уже анонсированы быстрые SSD с интерфейсом PCIe 6.0. CXL же позволяет относительно недорого наращивать объём памяти, хотя и в ущерб задержкам. Так что Samsung придётся сделать новые Z-SSD не только быстрыми, но и экономически эффективными.

21.07.2025 [16:08], Руслан Авдеев

Samsung начал поиск альтернатив VMwareОсновные компании, входящие в Samsung Group, начали искать альтернативы VMware в связи со значительным ростом цен на продукты последней, причём ПО, похоже, будут дорожать и дальше, передаёт ETNews. Как сообщают источники издания, Samsung Electronics, Samsung Display и другие подразделения Samsung Group уже реализуют либо готовятся к реализации проектов по постепенному отказу от VMware. Так, Samsung Electronics рассматривает альтернативные варианты с прошлого года. При этом компания не намерена немедленно отказываться от продуктов, пока заключён контракт на закупку ПО на сумму ₩40 млрд (около $29 млн). Параллельно компания участвует в проектах по разработке open source ПО. Цель состоит в том, чтобы разработать облачную среду, избегая коммерческих инструментов вроде продуктов VMware. Привлечены специалисты по виртуализации и облачным технологиям. В 2026 году будут определены направление и масштаб внедрения новых продуктов. Samsung Electronics намерена самостоятельно создать частное облако. Для работы над ним привлекут как сотрудников самой Samsung, так и специализированные компании. Проект планируется завершить в течение года. Samsung Display также готовит проект снижения зависимости от VMware. Компании Samsung Group являются одними из крупнейших заказчиков VMware в Южной Корее. Однако смена политики VMware привела к росту цен, так что дочерние структуры Samsung Group посчитали затраты слишком высокими в сравнении с выгодами от использования VMware. В 2023 году VMware была куплена Broadcom, а в 2024-м компания повысила цены на свою продукцию. По мнению экспертов, в ближайшие два-три года цена может значительно увеличиться в сравнении с текущей. Уже есть примеры пятикратного роста стоимости лицензий и обслуживания. Утверждается, что цены будут формироваться в индивидуальном порядке. Кроме того, постоянно меняются условия сделок. Есть претензии и к политике продаж. Флагманский продукт VMware Cloud Foundation (VCF) включает ПО для виртуализации, сетевые решения и решения для хранения данных единым пакетом. При этом многим корейским компаниям нужны только продукты для виртуализации, а переплачивать за ненужные продукты они не хотят. По словам одного из источников, большинство крупных компаний, включая производственные и финансовые, ускорят движение к отказу от VMware.

15.05.2025 [15:40], Руслан Авдеев

Samsung купила за €1,5 млрд поставщика систем охлаждения для ЦОД и предприятий FläktGroupSamsung Electronics приобрела за €1,5 млрд ($1,69 млрд) поставщика HVAC-систем FläktGroup. Последняя поставляет оборудования для охлаждения и CDU-модули для дата-центров и крупных промышленных площадок, сообщает Datacenter Dynamics. Пока компания принадлежит инвестиционным фондам под эгидой европейской компании Triton. Ожидается, что сделку закроют до конца года. FläktGroup основана в октябре 2016 года в результате слияния DencoHappel, ранее входившей в принадлежащую Triton группу специалистов по теплообменным решениям Galapagos, и разработчика систем охлаждения FläktWoods. После слияния FläktGroup расширила своё портфолио и вышла на рынки ЦОД, крупных производственных комплексов и фармацевтических компаний. В число клиентов FläktGroup, судя по данным на официальном сайте, входят дата-центры по всей Великобритании и даже штаб-квартира Microsoft в Дублине. По словам Triton, работать с компанией и её руководством было одновременно удовольствием и «привилегией». Команда компании вывела её на передовые позиции в своей отрасли и открыла пути для будущего роста. Сделка с Samsung позволит вывести FläktGroup на новый уровень развития, выразили уверенность в пресс-службе Triton. Samsung подчёркивает, что благодаря покупке ключевого игрока в области HVAC-решений она закладывает основу для того, чтобы самой стать лидером на мировом рынке HVAC, предлагающим полный спектр соответствующих решений. В компании намерены продолжать инвестировать в быстрорастущий бизнес HVAC, который станет одним из ключевых двигателей будущего роста. Ранее конкурирующая LG Electronics (LG) представила собственные комплексные решения для охлаждения ЦОД. |

|