Материалы по тегу: scm

|

10.08.2025 [00:10], Владимир Мироненко

Samsung решила возродить сверхбыстрые SSD с памятью Z-NANDКомпания Samsung Electronics возрождает технологию памяти Z-NAND после семилетнего перерыва, позиционируя её как высокопроизводительное решение для ИИ-нагрузок. По данным DigiTimes, следующее поколение памяти Z-NAND получит 15-кратное увеличение производительности по сравнению с современными NVMe SSD и даст ускорителю возможность напрямую обращаться к накопителю Z-NAND с минимальными задержками. Как пишет Tom's Hardware, исполнительный вице-президент Samsung по производству памяти сообщил, что при значительном росте производительности с помощью технологии Z-NAND энергопотребление накопителей будет на 80 % ниже по сравнению с традиционной флеш-памятью NAND. Кроме того, в новом поколении упор сделан на минимизацию задержек. Для этого Samsung внедряет новую технологию GPU-Initiated Direct Storage Access (GIDS), которая позволит ускорителям напрямую обращаться к устройствам хранения Z-NAND, минуя CPU и RAM, тем самым значительно сокращая время доступа. Samsung представила технологию Z-NAND в 2016 году в качестве альтернативы памяти Intel 3D XPoint (Optane). Вышедший в 2018 году твердотельный накопитель Samsung 983 ZET на базе 64-слойной SLC 3D V-NAND предлагал значительно более низкую задержку и высокие скорости в сравнении с обычными NVMe SSD. По производительности он вплотную приблизился к Intel Optane SSD 900P. Обе технологии фактически относятся к SCM (Storage Class Memory), хотя только Intel предлагала PMem-модули в виде DIMM. Однако в итоге разработку 3D XPoint последняя (вместе с Micron) забросила, да и Samsung, ответив выпуском Z-SSD на появление Optane, решила свою технологию не развивать. Примерно в то же время Kioxia (тогда ещё Toshiba) представила свой вариант сверхбыстрой SLC NAND — XL-Flash. Её она тоже довольно долго особенно не развивала, но планирует уже в следующем году представить XL-Flash SSD с переработанным контроллером, который обеспечит более 10 млн IOPS, особенно на небольших транзакциях. Для точной настройки SSD с целью повышения производительности при запуске ресурсоёмких ИИ-приложений компания сотрудничает с ведущими производителями ускорителей. Phison также предлагает eSLC-накопители PASCARI с технологией aiDAPTIV+. SLC-накопители также есть у Solidigm и Micron. Впрочем, широкая востребованность Z-SSD может оказаться под вопросом. Уже анонсированы быстрые SSD с интерфейсом PCIe 6.0. CXL же позволяет относительно недорого наращивать объём памяти, хотя и в ущерб задержкам. Так что Samsung придётся сделать новые Z-SSD не только быстрыми, но и экономически эффективными.

08.08.2025 [01:05], Владимир Мироненко

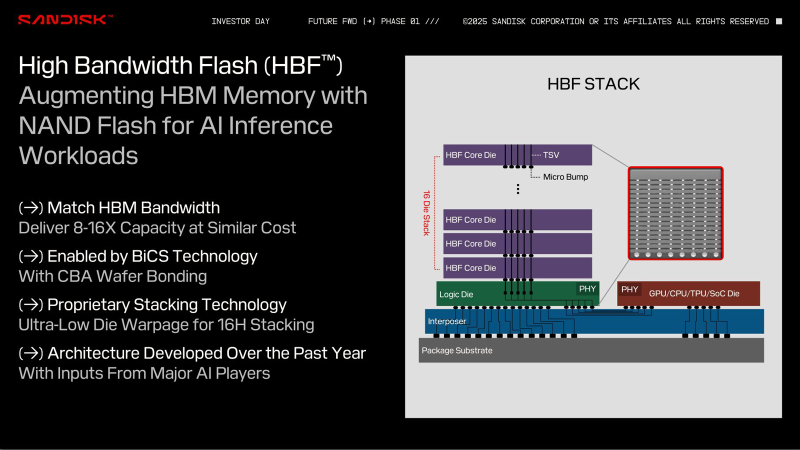

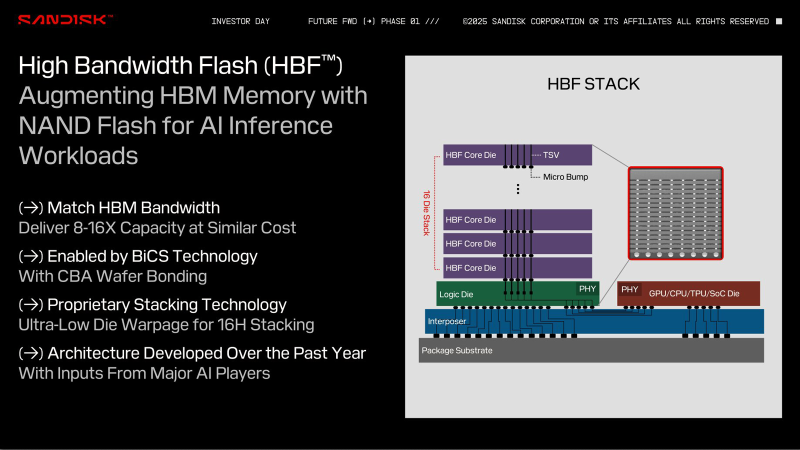

Sandisk и SK hynix разработают спецификации высокоскоростной флеш-памяти HBFSandisk объявила о подписании Меморандума о взаимопонимании (МОВ) с SK hynix, предусматривающего совместную разработку спецификации высокоскоростной флеш-памяти (HBF). В рамках сотрудничества компании планируют стандартизировать спецификацию, определить технологические требования и изучить возможность создания технологической экосистемы для высокоскоростной флеш-памяти. Технология HBF, анонсированная Sandisk в феврале этого года, обеспечит ускорители быстрым доступом к большим объёмам памяти NAND, что позволит ускорить обучение и инференс ИИ без длительных обращений к PCIe SSD. Как и HBM, чип HBF состоит из слоёв, в данном случае NAND, с TSV-каналами, соединяющими каждый слой с базовым интерпозером, что обеспечивает быстрый доступ к памяти — на порядки быстрее, чем в SSD. При сопоставимой с HBM пропускной способности и аналогичной цене HBF обеспечит в 8–16 раз большую, чем у HBM, ёмкость на стек. Вместе с тем HBF имеет более высокую задержку, чем DRAM, что ограничивает её применение определёнными рабочими нагрузками. На этой неделе Sandisk представила прототип памяти HBF, созданный с использованием фирменных технологий BiCS NAND и CBA (CMOS directly Bonded to Array). Меморандум о взаимопонимании подразумевает, что SK hynix может производить и поставлять собственные модули памяти HBF. Как отметил ресурс Blocks & Files, это подтверждает тот факт, что Sandisk осознаёт необходимость наличия рынка памяти HBF с несколькими поставщиками. Такой подход позволит гарантировать клиентам, что они не будут привязаны к одному поставщику. Также это обеспечит конкуренцию, которая ускорит разработку HBF. Sandisk планирует выпустить первые образцы памяти HBF во II половине 2026 года и ожидает, что образцы первых устройств с HBF для инференса появятся в продаже в начале 2027 года. Это могут быть как портативные устройства, так и ноутбуки, десктопы и серверы.

09.06.2025 [15:06], Владимир Мироненко

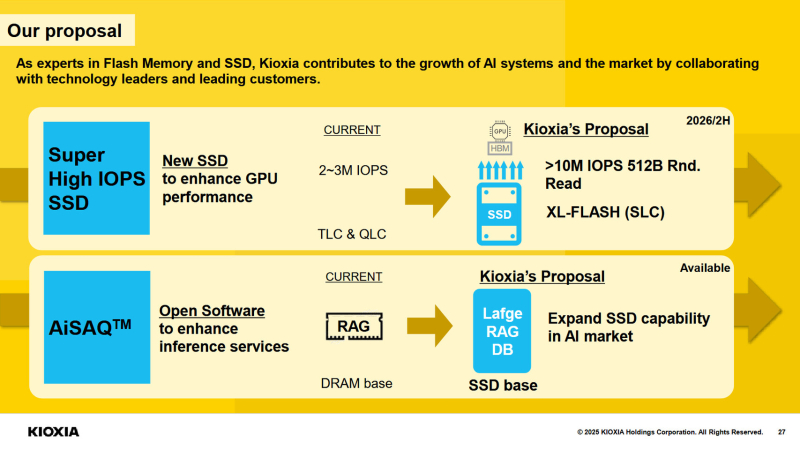

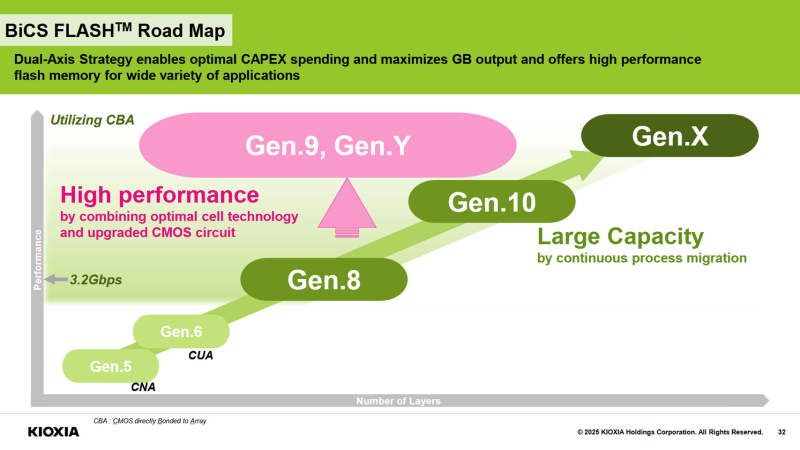

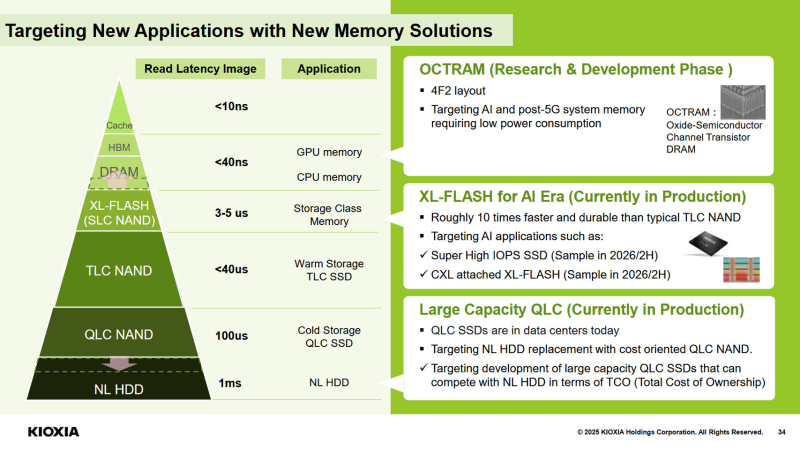

Kioxia готовит новое поколение XL-FLASH SSD с поддержкой 10 млн IOPSKioxia представила стратегию развития SSD в среднесрочной и долгосрочной перспективе с акцентом на инновации, направленные на повышение производительности и ёмкости хранилища. Одним из ключевых проектов Kioxia назвала создание SSD с использованием SLC-памяти XL-FLASH в сочетании с переработанным контроллером. Ожидается, что эта комбинация обеспечит более 10 млн IOPS, особенно для небольших транзакций данных. Образцы продвинутых SSD увидят свет ко II половине 2026 года. Kioxia сообщила, что тесно сотрудничает с основными производителями GPU для точной настройки SSD с целью повышения производительности в приложениях с интенсивным использованием ИИ и графики. Выпускаемые сейчас компанией SSD построены на чипах 3D NAND BiCS FLASH TLC 8-го поколения с использованием технологии CBA (CMOS directly Bonded to Array), обеспечивающей повышение энергоэффективности, производительности, плотности и стабильности по сравнению с решениями предыдущего поколения. Семейство SSD корпоративного класса CM9 нацелено на ИИ-системы, которым требуется как высокая скорость, так и высочайшая надёжность, чтобы максимально использовать дорогостоящее оборудование с ИИ-ускорителями. В свою очередь, семейство накопителей LC9 предлагает большую ёмкость, достигающую 122 Тбайт, для поддержания нагрузок, связанных с крупномасштабными базами данных для систем ИИ-инференса. Также чипы BiCS FLASH TLC 8-го поколения используются в смартфонах. Kioxia отметила, что в настоящее время увеличивает производство линейки продуктов BiCS FLASH 8-го поколения. Компания сообщила, что использует два подхода при разработке флеш-памяти. Один из них основан на традиционном методе увеличения количества слоев для создания более высокой ёмкости и производительности в таком продукте, как BiCS FLASH 10-го поколения. А при разработке флеш-памяти BiCS FLASH 9-го поколения компания использует преимущества технологии CBA, объединяя проверенные конструкции ячеек с передовой технологией CMOS. В целом, стратегия Kioxia направлена как на постепенное усовершенствование SSD, так и на инновации в архитектуре для удовлетворения меняющихся потребностей рынка в сфере ИИ и хранлищ. Так, для QLC-памяти компания ставит целью вытеснение Nearline HDD путём уменьшения стоимости SSD.

26.03.2025 [10:39], Сергей Карасёв

SMART Modular представила энергонезависимые CXL-модули памяти NV-CMM-E3SКомпания SMART Modular Technologies объявила о начале пробных поставок улучшенных энергонезависимых модулей памяти CXL (Non-Volatile CXL Memory Module, NV-CMM), соответствующих стандарту CXL 2.0. Изделия ориентированы на применение в дата-центрах, которые поддерживают такие нагрузки, как резидентные базы данных, аналитика в реальном времени и приложения НРС. Новинка (NV-CMM-E3S) объединяет память DDR4-3200 DRAM, флеш-память NAND и источник резервного питания в форм-факторе E3.S 2T (EDSFF). Задействован интерфейс PCIe 5.0 x8. Применяются контроллеры на базе ASIC и FPGA. Устройство NV-CMM имеет ёмкость 32 Гбайт, а максимальная пропускная способность заявлена на уровне 32 Гбайт/с. Поддерживается шифрование информации по алгоритму AES-256. Интегрированный источник аварийного питания обеспечивает сохранность критически важных данных при непредвиденных отключениях электроэнергии, что повышает надёжность и доступность системы в целом. В случае сбоя в центральной сети энергоснабжения производится копирование данных из DRAM в NAND, а после восстановления подачи энергии выполняется обратный процесс. Изделие обеспечивает более быструю перезагрузку виртуальных машин и сокращает время простоя в облачных инфраструктурах.

Источник изображения: SMART Modular Technologies Устройство имеет размеры 112,75 × 15 × 76 мм. Эксплуатироваться модуль может при температурах окружающей среды до +40 °C. Отмечается, что внедрение NV-CMM на основе стандарта CXL знаменует собой важную веху в удовлетворении растущих потребностей платформ ИИ, машинного обучения и аналитики больших данных.

16.02.2025 [00:22], Сергей Карасёв

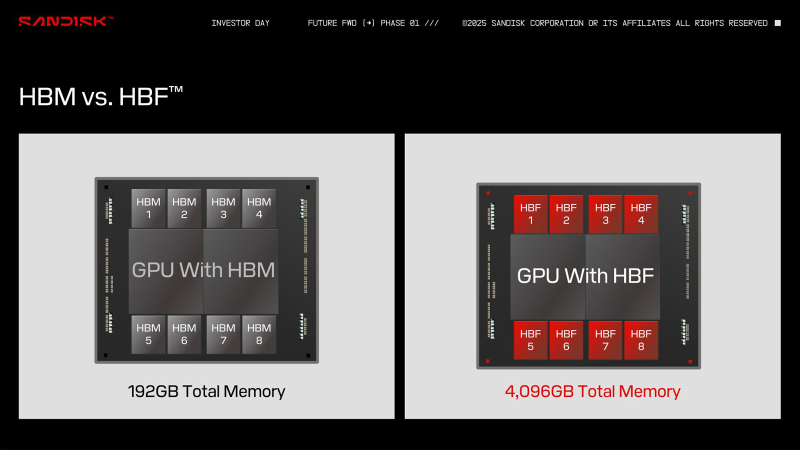

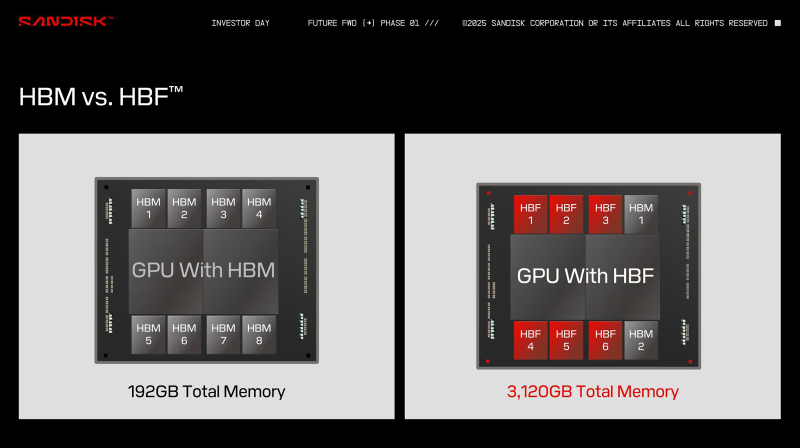

HBF вместо HBM: SanDisk предлагает увеличить объём памяти ИИ-ускорителей в 16 раз, заменив DRAM на сверхбыструю флеш-памятьКомпания SanDisk, которая вскоре станет независимой, отделившись от Western Digital, предложила способ многократного увеличения объёма памяти ИИ-ускорителей. Как сообщает ресурс ComputerBase.de, речь идёт о замене HBM (High Bandwidth Memory) на флеш-чипы с высокой пропускной способностью HBF (High Bandwidth Flash). На первый взгляд, идея может показаться абсурдной, поскольку флеш-память NAND значительно медленнее DRAM, которая служит основой HBM. Но, по заявлениям SanDisk, архитектура HBF позволяет обойти ограничения, присущие традиционным NAND-изделиям, что сделает память нового типа пригодной для применения в ИИ-ускорителях. При этом HBF планируется использовать прежде всего для задач инференса, а не обучения моделей ИИ. С каждым новым поколением HBM растёт объём памяти, которым оснащаются ИИ-карты: у современных ускорителей AMD и NVIDIA он достигает 192 Гбайт. Благодаря внедрению HBF компания SanDisk рассчитывает увеличить показатель в 8 или даже 16 раз при сопоставимой цене. Компания предлагает две схемы использования флеш-памяти с высокой пропускной способностью: одна предусматривает полную замену HBM на HBF, а другая — совмещение этих двух технологий. В качестве примера SanDisk приводит GPU со 192 Гбайт памяти HBM, которая разделена на восемь стеков по 24 Гбайт. В случае HBF каждый такой стек сможет иметь ёмкость 512 Гбайт. Таким образом, при полной замене HBM ускоритель сможет нести на борту 4 Тбайт памяти: это позволит полностью загрузить большую языковую модель Frontier с 1,8 трлн параметров размером 3,6 Тбайт. В гибридной конфигурации можно, например, использовать связку стеков 2 × HBM плюс 6 × HBF, что в сумме даст 3120 Гбайт памяти. Архитектура HBF предполагает монтаж кристаллов NAND друг над другом поверх логического кристалла. Вся эта связка располагается на интерпозере рядом с GPU, CPU, TPU или SoC — в зависимости от предназначения конечного изделия. Обычная флеш-память NAND приближается к DRAM по пропускной способности, но не может сравниться с ней по времени доступа. SanDisk предлагает решить проблему путём разделения HBF на массив областей с большим количеством линий данных: это позволит многократно увеличить скорость доступа. SanDisk разработала архитектуру HBF в 2024 году под «влиянием ключевых игроков в области ИИ». В дальнейшие планы входят формирование технического консультативного совета, включающего партнёров и лидеров отрасли, и создание открытого стандарта. Впрочем, есть и другие методы увеличения объёма памяти ускорителей. Один из них — использование CXL-пулов.

07.10.2024 [23:31], Владимир Мироненко

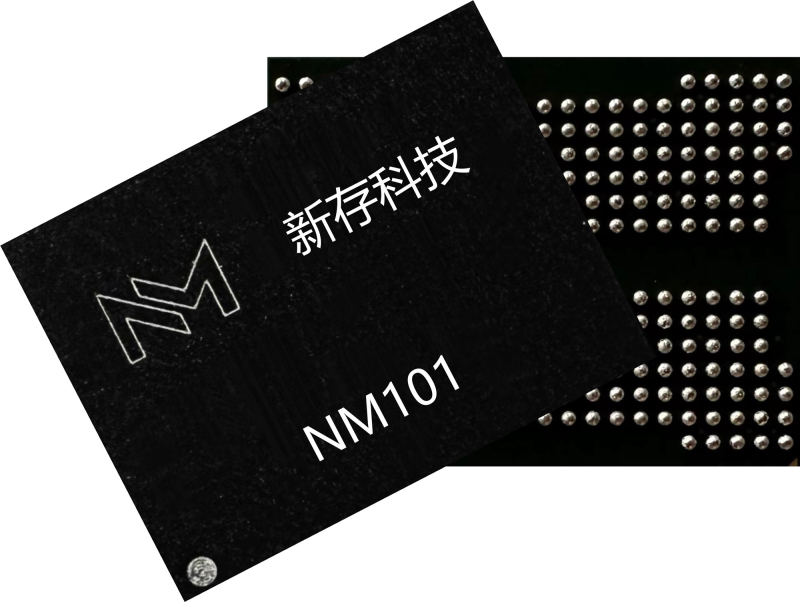

Optane на китайский лад: стартап Numemory создал 64-Гбит чип памяти типа SCMКитайский полупроводниковый стартап Numemory из Уханя, также известный как Xincun Technology, объявил о создании 64-Гбит чипа памяти NM101 типа SCM (Storage Class Memory). Новинка в 10 раз превышает чипы NAND по скорости чтения и записи и в 5 раз — по продолжительности службы, передаёт ресурс Blocks and Files. Скорость IO у чипа равна 3200 MT/с — такая же, как была у Intel Optane PMem 200. SCM в иерархии памяти занимает промежуточное место между NAND и DRAM, совмещая и плохие, и хорошие стороны обеих. Именно такой была память 3D XPoint, предлагавшаяся Intel под брендом Optane. Увы, Intel и Micron прекратили выпуск данного типа памяти, а оставшиеся альтернативы фактически являются разновидностью SLC NAND. Numemory была основана в июле 2022 года. Сейчас у неё около 180 сотрудников, 80 % которых занимаются исследованиями и разработками, и 60 % имеют степень магистра или более высокую квалификацию. В 2023 году Numemory заявила, что у неё есть в общей сложности 273 патента, включая 60 международных и 213 зарегистрированных в Китае. Numemory разработала технологию 3D Selector-Only Memory (SOM) с использованием памяти с изменением фазового состояния (Phase-change memory) с архитектурой Crossbar. Ровно на тех же принципах был построена и 3D XPoint, но Numemory заявляет, что её память значительно отличается. Numemory утверждает, что SOM имеет низкую задержку, хорошую масштабируемость (в том числе доступно вертикально стекирование), длительный срок жизни и т.д. По данным ресурса South China Morning Post, Numemory заявила, что накопители, созданные с использованием технологии SCM, могут предложить ЦОД и поставщикам услуг облачных вычислений решение для хранения данных с большой ёмкостью, высокой плотностью, высокой пропускной способностью и низкой задержкой.

23.09.2023 [22:13], Алексей Степин

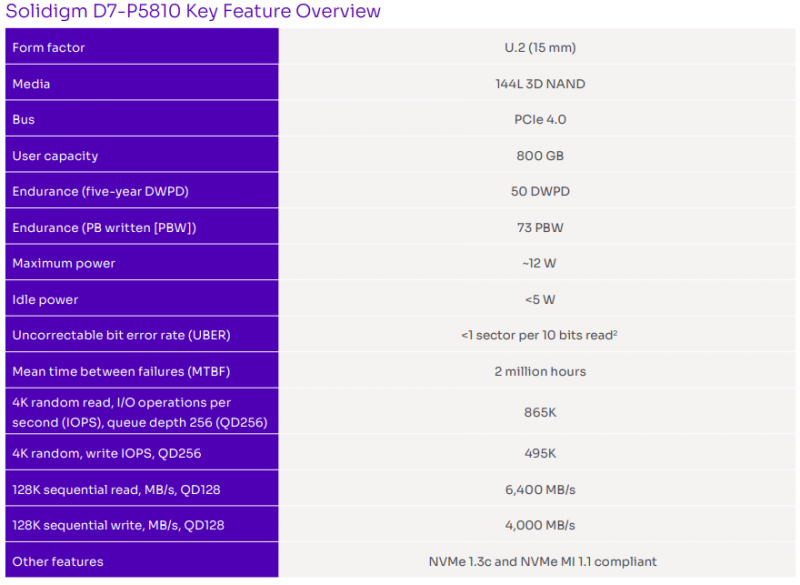

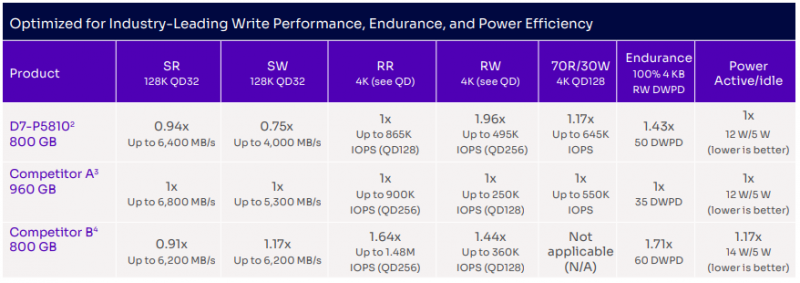

Solidigm представила SSD P5810 на памяти SLC для нагрузок с активной записью данныхСовременные твердотельные накопители хороши всем, но сами принципы, на которых строится NAND-память, наделяют их конечным ресурсом перезаписи, что в некоторых сценариях весьма критично. Специально для таких сценариев предназначен новый SSD Solidigm D7-P5810, анонсированный буквально на днях. Большая часть современных SSD использует многослойную память 3D TLC NAND, а в погоне за ёмкостью и плотностью упаковки данных практическими всеми производителями NAND-устройств и самих SSD активно осваиваются технологии QLC и PLC, с четырьмя и пятью битами на ячейку, соответственно. Но это означает пониженный ресурс записи и для использования в качестве устройств strorage class memory (SCM) такие SSD подходят не лучшим образом. Новый Solidigm D7-P5810, однако, использует 144-слойную память 3D NAND в режиме SLC, с одним битом на ячейку. За исключением экзотических технологий, вроде MRAM или почившего в бозе Optane это самый надёжный на сегодня вариант энергонезависимой памяти.

Источник изображений здесь и далее: Solidigm Именно использование SLC-памяти позволяет компании-производителю заявлять для P5810 общий ресурс записи в 73 Пбайт и 50 полных перезаписей в день в течение пятилетнего гарантийного срока. Наработка на отказ заявлена на уровне 2 млн часов, а показатель UBER не превышает 1 сектор на 1017 бит. Ёмкость при этом не слишком высока, что характерно для всех SLC-устройств: новинка представлена в вариантах 800 Гбайт и 1,6 Тбайт (появится в первой половине 2024 года). Solidigm D7-P5810 использует форм-фактор U.2 с интерфейсом NVMe (PCI Express 4.0 x4), что позволяет ему развивать линейные скорости 6400 и 4000 Мбайт/с при чтении и записи соответственно. На случайных операциях при максимальной глубине запроса накопитель обеспечивает 865 тысяч IOPS при чтении и 495 тысяч IOPS при записи. Латентность при этом находится в пределах 10–15 мкс, при случайном чтении она не превышает 53 мкс.

Solidigm D7-P5810 в сравнении с соперниками. Конкурент A — Micron XTR, конкурент B — Kioxia FL6. Источник: Solidigm Устройство достаточно экономично: в активном состоянии новый SSD потребляет не более 12 Вт, а в режиме простоя — не более 5 Вт. В качестве сценариев использования Solidigm называет кеширование в системах на базе QLC NAND, также он отлично подойдет для HPC-систем или систем сбора данных и логов. Правда, новый накопитель не уникален: на рынке ему придётся конкурировать с Kioxia FL6 или Micron XTR, также использующими SLC 3D NAND. Оба конкурента имеют варианты с большей ёмкостью (3,2 Тбайт у Kioxia, 1,92 Тбайт у Micron), но заметно уступают Solidigm D7-P5810 в производительности на случайных операциях записи.

17.05.2023 [09:22], Сергей Карасёв

Micron представила быстрые и надёжные SSD серий 6500 ION и XTR для дата-центровКомпания Micron Technology анонсировала SSD семейств 6500 ION и XTR, предназначенные для применения в ЦОД. Изделия используют для обмена данными интерфейс PCIe 4.0 x4 (спецификация NVMe 2.0), благодаря чему достигаются высокие скоростные показатели. При этом решения серии XTR отличаются улучшенной долговечностью. Накопители Micron 6500 ION выполнены на основе чипов памяти TLC NAND (Micron 232L Performance TLC). Разработчик утверждает, что по стоимости эти устройства сравнимы с SSD на базе QLC NAND. Вместимость составляет 30,72 Тбайт. Таким образом, операторы дата-центров получат эффективное решение для построения массивов хранения большой ёмкости. Заявленная скорость последовательного чтения данных достигает 6,8 Гбайт/с, скорость последовательной записи — 5,0 Гбайт/с. Показатель IOPS при произвольных чтении и записи информации блоками по 4 Кбайт — до 1 млн и 200 тыс. соответственно. Накопители могут выдерживать до одной полной перезаписи в сутки (показатель DWPD). Предусмотрены два варианта исполнения: SFF U.3 толщиной 15 мм и E1.L толщиной 9,5 мм.

Источник изображений: Micron  Решения Micron XTR, в свою очередь, используют чипы памяти Micron 176L SLC. SSD доступны в формате SFF U.3 толщиной 15 мм. Вместимость составляет 960 Гбайт и 1,92 Тбайт. Скорость последовательного чтения в обоих случаях достигает 6,8 Гбайт/с, скорость последовательной записи — 5,3 и 5,6 Гбайт/с соответственно. Величина IOPS при чтении — до 900 тыс., при записи — до 250 тыс. и 350 тыс. Эти накопители обеспечивают высочайшую надёжность: значение DWPD равно 60 при последовательной записи и 35 при произвольной записи.

24.03.2023 [20:28], Алексей Степин

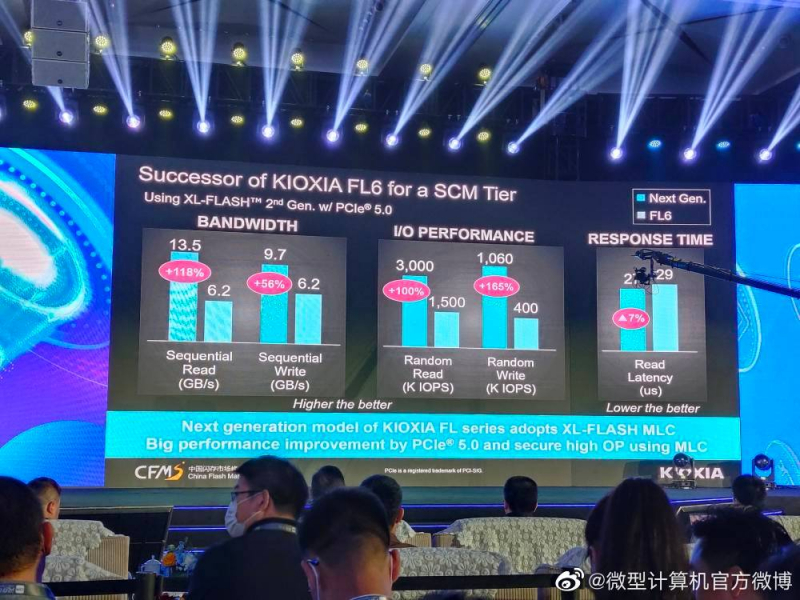

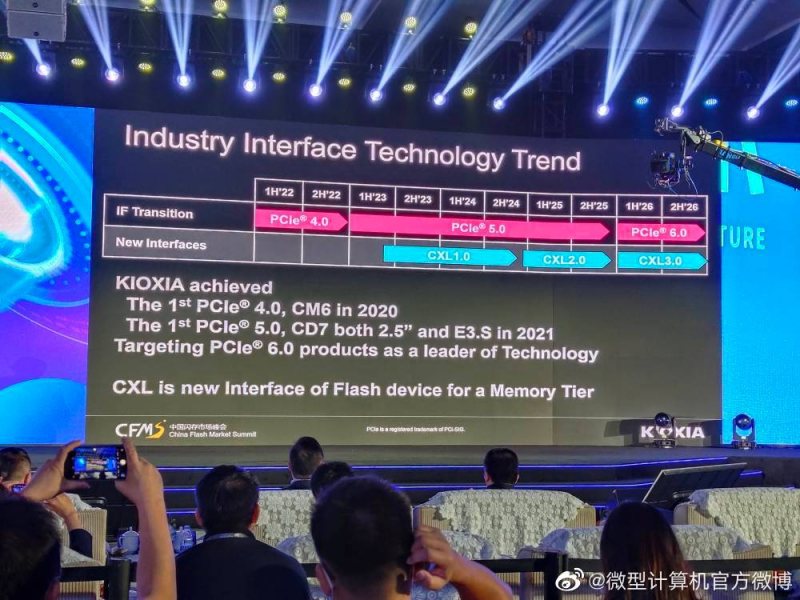

Kioxia анонсировала серверные SSD на базе XL-FLASH второго поколенияПо мере внедрения новых версий PCI Express растут и линейные скорости SSD. Не столь давно 3-4 Гбайт/с было рекордно высоким показателем, но разработчики уже штурмуют вершины за пределами 10 Гбайт/с. Компания Kioxia, крупный производитель флеш-памяти и устройств на её основе, объявила на конференции 2023 China Flash Market о новом поколении серверных накопителей, способных читать данные со скоростью 13,5 Гбайт/с. Новые высокоскоростные SSD будут построены на базе технологии XL-FLASH второго поколения. Первое поколение этих чипов компания (тогда Toshiba) представила ещё в 2019 году. В основе лежат наработки по BiCS 3D в однобитовом варианте, что позволяет устройствам на базе этой памяти занимать нишу Storage Class Memory (SCM) и служить заменой ушедшей с рынка технологии Intel Optane. Как уже сообщалось ранее, XL-FLASH второго поколения использует двухбитовый режим MLC, но в любом случае новые SSD Kioxia в полной мере раскроют потенциал PCI Express 5.0. Они не только смогут читать данные на скорости 13,5 Гбайт/с и записывать их на скорости 9,7 Гбайт/с, но и обеспечат высокую производительность на случайных операциях: до 3 млн IOPS при чтении и 1,06 млн IOPS при записи. Время отклика для операций чтения заявлено на уровне 27 мкс, против 29 мкс у XL-FLASH первого поколения. Kioxia полагает, что PCI Express 5.0 и CXL 1.x станут стандартами для серверных флеш-платформ класса SCM надолго — господство этих интерфейсов продлится минимум до конца 2025 года, лишь в 2026 году следует ожидать появления первых решений с поддержкой PCI Express 6.0. Активный переход на более новую версию CXL ожидается в течение 2025 года. Пока неизвестно, как планирует ответить на активность Kioxia другой крупный производитель флеш-памяти, Samsung Electronics, которая также располагает высокопроизводительной разновидностью NAND под названием Z-NAND.

15.01.2023 [01:14], Алексей Степин

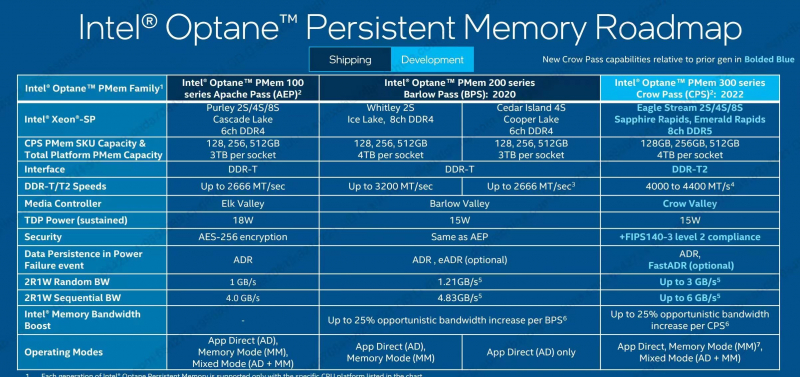

Последний Optane: Intel предложит модули PMem 300 для Xeon Sapphire Rapids и Emerald RapidsНесмотря на то, что страница истории, посвящённая созданию энергонезависимой памяти Optane, официально закрыта Intel, третье поколение модулей DCPMM всё-таки увидит свет и дополнит собой платформы Sapphire Rapids и Emerald Rapids (если к этому моменту они останутся в наличии). Об этом стало известно благодаря слайду, опубликованному в Twitter. Несмотря на принадлежность модулей PMem 300 (Crow Pass) к третьему поколению, в них используются кристаллы второго поколения, четырёхслойные Barlow Pass. В Crow Pass применён новый контроллер Crow Valley с интерфейсом DDR-T2. Этот интерфейс позволяет создавать пулы Optane PMem объёмом до 4 Тбайт на сокет (8 × 512 Гбайт). Кроме того, DDR-T2 шина функционирует на вдвое более высокой частоте, нежели у ячеек памяти. И если PMem 200 предлагали интерфейс 3200 МТ/с, то в PMem 300 будут реализованы скорости 4000-4400 МТ/с, что более-менее соответствует параметрам модулей DDR5 DRAM, которые в серверных системах обычно имеют скорость 4800 МТ/с. Соответствующим образом возрастёт производительность. Данные приводятся для режима 2RW1 (две операции чтения на одну операцию записи), и если первое поколение PMem ограничивается 4 Гбайт/с, а второе останавливается на отметке 4,83 Гбайт/с, то третье сможет развивать линейные скорости в районе 6 Гбайт/с. Ещё сильнее вырастет производительность в случайных операциях, с 1–1,2 Гбайт/с до 3 Гбайт/с. Кроме того, в Crow Pass будут дополнены протоколы сохранения данных в случае потери питания — в дополнение к обычному режиму ADR появится FastADR. Как и предыдущие поколения PMem, Optane PMem 300 смогут работать в режиме App Direct, в качестве дополнения обычной DRAM и в смешанном режиме. Теплопакет у новинок, к слову, не изменился и составляет те же 15 Вт с возможностью кратковременного увеличения для повышения производительности, если есть запас по охлаждению. |

|