Материалы по тегу: охлаждение

|

23.04.2026 [09:40], Руслан Авдеев

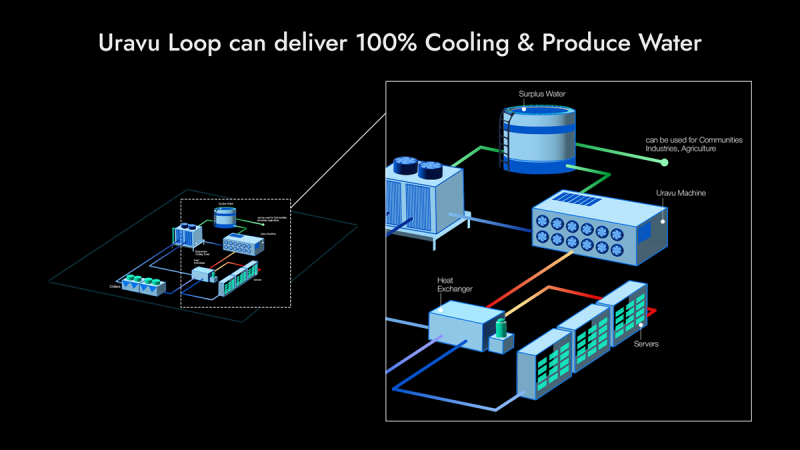

Как на Татуине: индийская Uravu будет добывать питьевую воду из воздуха с помощью «мусорного» тепла ЦОДИндийский стартап Uravu предложил систему, в которой соль является ключевым ингредиентом, способствующим эффективному охлаждению серверных стоек. Более того, метод позволяет получать воду непосредственно из тёплого воздуха, проходящего через системы охлаждения ЦОД, сообщает Datacenter Dynamics. Основанный в 2012 году стартап Uravu предложил добавить в контур охлаждения влагопоглотитель на основе солёной воды — благодаря этому можно будет извлекать воду из «отработанного» тёплого воздуха. Потом её можно повторно использовать для охлаждения оборудования, а излишки воды можно даже продавать. Разработчики явно вдохновлялись решениями с пустынной планеты Татуин, показанной во франшизе «Звёздные войны» — там вода тоже добывалась непосредственно из воздуха. Поэтому и свою установку они назвали Tatooine. Tatooine использует низкотемпературное (+35–65 °C) избыточное тепло, отдаваемое системами охлаждения. Модуль-абсорбент (поглотитель) забирает тёплый воздух, из части которого извлекается вода. Другая часть вступает в контакт с поглотителем на основе солёной воды, участвуя в процессах тепло- и массообмена. После солевой раствор передаётся в десорбер, где выделяет влагу в виде пара при помощи вакуумного насоса. Сконденсированная вода имеет на выход температуру +27–32 °C, что соответствует верхней границе рекомендаций ASHRAE. Гиперскейлеры допускают работу серверов и при таких температурах. Абсорбент Uravu начинает отбирать избыточное тепло при разнице с температурой окружающей среды в +4 °C. По оценке самой компании, Tatooine во многих сценариях позволят вообще не использовать традиционные чиллеры или драйкулеры, а на 1 МВт мощности ЦОД система способна отдавать до 30 м3/сут. чистой дистиллированной воды. Показатель может колебаться в зависимости от условий окружающей среды и уровня влажности, но как минимум 5 м3/сут. готовой для питья или других нужд воды она будет давать. Использование отработанного тепла позволяет улучшить показатели энергетической эффективности (PUE) и эффективности использования воды (WUE) дата-центров. Последний и вовсе достигает отрицательных значений — вода не просто восстанавливается, а извлекается в избытке, поэтому её можно продавать близлежащим потребителям. Уже сегодня Uravu имеет партнёрские соглашения с предприятиями других секторов, поставляя им «воду из воздуха». В частности, одна из её систем используется для производства бутилированной воды в Бангалоре, хотя и в скромных объёмах (всё те же 5 м3 /сут.). Компания начала взаимодействовать с участниками OCP и разработала 125-кВт демо-систему, подходящую для небольших и пилотных проектов. Следующая цель — блок на 1 МВт, с прицелом на создание модульного решения и стандартизацию производства. Разработка начнётся в 2026 году, условия проекта согласованы с неким «крупным провайдером». Также ведутся переговоры с пятью другими компаниями, занимающимися цифровой инфраструктурой. От венчурных фондов Uravu привлекла $4,7 млн и намерена инициировать раунд финансирования серии A до конца текущего года. Это не первые решения, использующие тепло ЦОД и сопутствующую воду. Так, в 2025 году появилась новость, что AirJoule разработала технологию «превращения» тепла дата-центров в дистиллированную воду, а в Нью-Йоркском университете (NYU) разработали необычную систему охлаждения на основе минералов. Благодаря им выделяемое на заводах тепло можно использовать для охлаждения дата-центров. Дефицит воды является большой проблемой для многих стран. В Индии проживают 18 % населения Земли, но на неё приходится лишь 4 % мировых водных ресурсов. По оценкам Всемирного банка, 600 млн жителей страны живут в районах, где воды не хватает, а, тем временем, потребление воды в стране к 2030 году может удвоиться, что только усугубит проблему. При этом ЦОД участвуют в конкуренции за воду наравне с людьми.

20.04.2026 [00:50], Владимир Мироненко

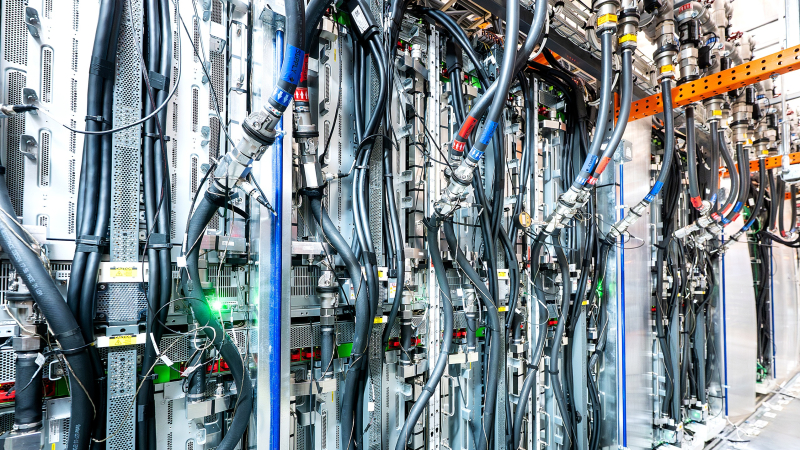

Строительство гигантского ИИ ЦОД им. Трампа застопорилось: заказчиков нет, гендиректор сбежал, акции падаютКрупнейший в мире проект по строительству кампуса ИИ ЦОД Project Matador (HyperGrid), поддерживаемый союзниками Трампа и формально носящий его имя (The President Donald J. Trump Advanced Energy and Intelligence Campus), застопорился из-за задержек в реализации и логистических проблем, сообщил ресурс Axios. Вдобавок в пятницу стало известно, что свой пост внезапно покинул генеральный директор стоящей за проектом компании Fermi America Тоби Нойгебаргер (Toby Neugebarger). Это привело к резкому падению акций компании на внебиржевых торгах, которые уже потеряли 75 % своей стоимости за последние шесть месяцев. За день до этого Нойгебаргер в интервью Axios защищал проект, признавая при этом существование некоторых недостатков, т.е. ничто не предвещало его скорого ухода. Он сообщил, что недооценил сложности реализации таких проектов, особенно систем охлаждения, необходимых для отвода тепла от ИИ-чипов. Также Нойгебаргер отметил, что, возможно, «неправильно понял, где находится цепочка поставок» оборудования для охлаждения: «Я приму это как неудачу». Одной из главных проблем, стоящих перед компанией, является отсутствие публично подтверждённого якорного арендатора — как правило, крупного провайдера, — наличие которого считается необходимым для дальнейшего развития проекта, в том числе и в отношении таких компонентов, как система охлаждения. Препятствия в продвижении проекта указаны в независимом отчёте аналитической компании Cleanview, предоставленном Axios, а также в финансовых отчётах, публичных документах и комментариях руководителей компании. Нойгебаргер признал в интервью Axios, что проект не может двигаться вперед без арендатора, вместе с тем отметив, что вопрос арендаторов «не является проблемой» для компании. Один из потенциальных арендаторов отказался от участия в проекте в декабре прошлого года, и инвесторы подали в связи с этим к компании коллективный иск. Вопрос об отсутствии публично объявленных арендаторов был снова поднят аналитиками во время годового финансового отчёта Fermi. Нойгебаргер тогда ответил, что компания подписывает новые письма о намерениях, но он не может публично разглашать подробности, пока не будет окончательного решения. При этом финансовый директор Майлз Эверсон (Miles Everson) сообщил аналитикам, что дальнейшее строительство не будет продолжено до тех пор, пока не будет заключено окончательное соглашение с арендатором и обеспечено финансирование проекта. Согласно отчёту Cleanview, даже если Fermi сейчас найдёт якорного арендатора и будет следовать другим аналогичным срокам строительства крупных ЦОД, первые здания в Амарилло (Amarillo, Техас) будут введены в эксплуатацию только в мае 2027 года — примерно на год позже, чем первоначально предполагалось. Ранее компания планировала ввести в эксплуатацию около 1,1 ГВт к концу 2026 года, но в недавнем заявлении для SEC она сообщила об отказе от этой цели. Компания преодолела ряд ключевых препятствий, в том числе получение разрешения на выбросы в атмосферу в начале этого года. Вместе с тем она столкнулась с задержкой с подтверждением систем охлаждения, которые обычно проектируются арендаторами и должны быть окончательно утверждены до начала строительства. «Я думаю, что это более серьёзное препятствие, чем мы первоначально предполагали», — сказал Нойгебаргер аналитикам. При этом компания уже заказала четыре ядерных реактора для питания своих дата-центров.

20.03.2026 [14:18], Руслан Авдеев

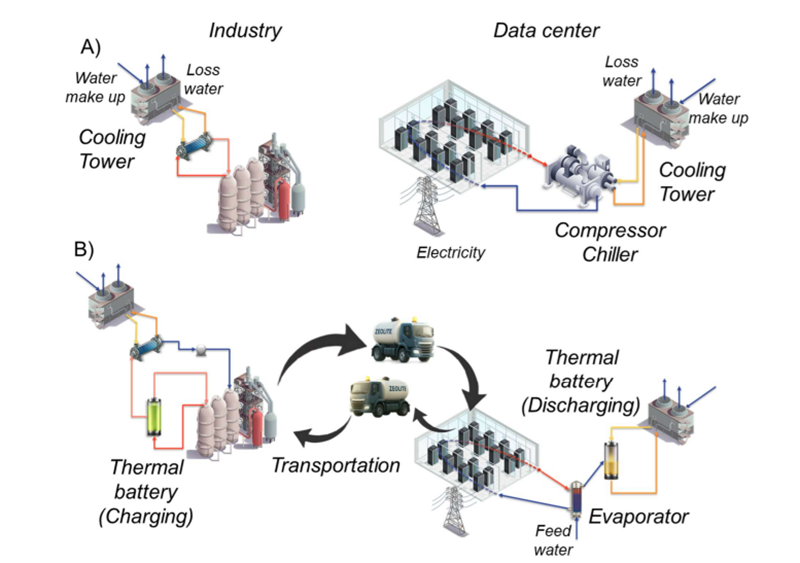

«Мусорное» тепло заводов охладит ЦОД благодаря цеолитовым блокамВ Нью-Йоркском университете (NYU) разработали необычную систему охлаждения на основе минералов. Благодаря им выделяемое на заводах тепло можно использовать для охлаждения дата-центров, сообщает Datacenter Dynamics. Эксперименты ведутся с цеолитами — эти минералы выступают своеобразными «тепловыми аккумуляторами». Они имеют множество микропор и в сухом виде активно поглощают водяной пар. При нагревании до достаточно высокой температуры цеолит отдаёт накопленную воду. Сушить цеолит можно на промышленных предприятиях с помощью выделяемого «мусорного» тепла с температурой ниже 200 °C. Это позволяет «заряжать» цеолитовый теплоаккумулятор, освобождая его от воды и приводя в состояние готовности к поглощению новой влаги в дата-центре. Исследователи утверждают, что такая технология может заменить компрессионные чиллеры, применяемые в классических системах охлаждения ЦОД. Цеолиты уже давно применяются для водоочистки, нефтепереработки и т.п. и стоят не очень дорого. Более того, они не теряют свойства и всегда готовы к поглощению воды. Учёные сравнили решение на основе цеолитовых теплоаккумуляторов с традиционными вариантами с компрессорными чиллерами и предприятиями, отводящими тепло с помощью градирен. Выяснилось, что использование тепла промышленных предприятий для «перезарядки» цеолита позволяет снизить совокупное потребление электричества у ЦОД и завода более чем на 75 %, а дата-центр отдельно может сократить расход электричества на охлаждение до 86 %. В результате показатель PUE улучшится приблизительно на 12 %. Утверждается, что комбинированная система охлаждения потребляет на 15–25 % больше воды, но учёные уверены, что в целом водные ресурсы даже экономятся, поскольку отработанное тепло тратится на «зарядку» теплоаккумуляторов, а не рассеивается в атмосфере. Даже с учётом энергии, расходуемой на перевоз тонн цеолитовых блоков, система всё равно позволяет экономить энергию во многих сценариях, в некоторых случаях — более чем на 40 % при использовании электрических грузовиков. Использование для перевозок железной дороги обеспечивает дополнительную экономию. Пока речь всё ещё идёт лишь о моделировании системы, предстоит решить ещё немало инженерных проблем. Исследователи сообщают, что необходимо создать долговечные, быстро работающие аккумуляторы с возможностью многократного циклического применения. Для координации действий между ЦОД и заводами потребуются новые бизнес-модели. Университет объявил, что уже начались переговоры с несколькими отраслевыми лидерами для возможного масштабирования решения. Согласно исследованиям Калифорнийского университета в Риверсайде без внедрения новых технологий к 2030 году дополнительно может потребоваться 2,6–5,49 млн м3 воды в дни пикового спроса ЦОД в США. Для сравнения: Нью-Йорк за сутки потребляет около 3,8 млн м3. Над альтернативными технологиями охлаждения работают и другие структуры. Так, Karman Industries представила систему охлаждения ИИ ЦОД с углекислым газом.

11.03.2026 [15:30], Руслан Авдеев

В жаркие дни ИИ ЦОД способны потреблять воды как весь Нью-Йорк за деньДаже если среднегодовое потребление чистой воды дата-центрами США будет относительно скромным, в самые жаркие дни оно окажется огромным. Для модернизации американской системы водоснабжения в соответствии с запросами в такие периоды потребуются миллиардные инвестиции, сообщает The Register. Исследование на соответствующую тему провели учёные Калифорнийского университета в Риверсайде. Результаты показали, что вода эффективно охлаждает ИИ-оборудование, но растущий спрос на неё приведёт к огромным расходам этого ресурса в отдельные дни — и современные системы водоснабжения не способны удовлетворить потребности, особенно в жаркую погоду. Без внедрения новых технологий к 2030 году дополнительно может потребоваться 2,6–5,49 млн м3 воды в дни пикового спроса. Для сравнения: Нью-Йорк за сутки потребляет около 3,8 млн м3. Даже при самых оптимистичных сценариях внедрения новых технологий, сокращающих водопотребление ЦОД, новые мощности могут тратить половину объёма водоснабжения Нью-Йорка в течение значительной части года.

Источник изображения: Matteo Catanese/unsplash.com В исследовании подчеркнули, что охлаждение ЦОД обычно происходит в два этапа. Во-первых, охлаждение на уровне серверов, когда тепло передаётся в промежуточный теплообменник на уровне объекта с помощью воздушного или жидкостного охлаждения (замкнутого контура). В обоих случаях вода обычно не расходуется. Второй этап — охлаждение на уровне объекта. Тепло передаётся во внешнюю среду, при этом не исключено потребление воды, в том числе в градирнях, функционирующих за счёт испарения. Используются и другие системы охлаждения. При этом крупный комплекс ЦОД с испарительным охлаждением использует тысячи кубометров воды ежедневно, особенно в самые жаркие дни года. Впрочем, часть воды может «возвращаться» в систему охлаждения. Тем не менее объёмы питьевой воды, забираемые ЦОД, становятся недоступны другим пользователям, поэтому с проблемами столкнутся уже другие потребители. Согласно отчёту, в США около 50 тыс. коммунальных систем водоснабжения. Из них около 40 тыс. — небольшие, обслуживающие не более 3,3 тыс. человек; около 9 тыс. — среднего размера; и лишь 708 — крупные, обслуживающие более 100 тыс. человек. Практически все ЦОД гиперскейлеров снабжаются водой из централизованных систем, и лишь немногие организовали снабжение из частных подземных источников. По расчётам учёных, в зависимости от климата и особенностей систем охлаждения IT-нагрузка в 100 МВт требует 1892–9463 м3 воды в день. При этом по всей Америке планируется развёртывание дата-центров гигаваттного масштаба. С учётом резерва надёжности многим публичным системам водоснабжения будет сложно обеспечить потребности даже 100-МВт кампусов, не говоря об объектах гигантского масштаба.

Источник изображения: Pawel Czerwinski/unsplash.com Фактически, по данным учёных, многие проекты ЦОД требовали существенной модернизации местной инфраструктуры водоснабжения даже тогда, когда пиковый спрос на воду составлял около 378 м3 в сутки. В целом исследователи пришли к выводу, что американским ЦОД потребуется дополнительно от 2,3 до 5,5 млн м3 воды ежесуточно. На модернизацию понадобится около $58 млрд — объёмы сопоставимы с суточным водопотреблением Нью-Йорка. Операторам дата-центров рекомендуется обнародовать информацию о пиковом потреблении воды, а не только средние показатели за год. Кроме того, они могли бы взаимодействовать с местными сообществами для финансирования модернизации локальной инфраструктуры водоснабжения, а также наладить контакты с коммунальными предприятиями, корректируя методы охлаждения. Например, при перегрузке электросетей можно было бы использовать водяное охлаждение, а при перегрузке системы водоснабжения — драйкулеры. Правда, можно предположить, что основная проблема возникнет именно в жаркие дни, когда обе системы будут использоваться по максимуму. Основная проблема с водопотреблением дата-центров в том, что для охлаждения требуется чистая питьевая вода, которой не всегда хватает. При этом испарительно охлаждение наиболее эффективно как раз в засушливых местах. Эксперты предлагают операторам дата-центров вкладывать средства в опреснительные установки, водопроводы, локальные очистные сооружения и другие решения. По некоторым расчётам, опреснение и транспортировка воды с морского побережья пока эффективнее, чем отказ от испарительных систем — даже с доставкой не по трубопроводам, а в цистернах. Впрочем, Microsoft готовит дата-центры с почти нулевым расходом воды, а ранее экспериментировала со сбором дождевой. AWS обещала перевести ещё 100 дата-центров на использование очищенных сточных вод для охлаждения.

06.03.2026 [14:36], Руслан Авдеев

Шведская Alfa Laval представила экологичную СЖО для ЦОД FreeWaterLoopШведская промышленная группа Alfa Laval выходит на рынок оборудования для дата-центров. Она анонсировала выпуск новую внешнюю систему жидкостного охлаждения FreeWaterLoop. По словам компании, в новой СЖО используется комбинация передовых инженерных решений с сфере насосостроения, высокопроизводительных технологий теплообмена и фильтрации — они объединены в единый, полностью интегрированный модуль. Alfa Laval сообщила, что система использует стабильные температуры и теплопроводность природных водоёмов и минимизирует водопотребление, возвращая чистую воду туда, откуда она была забрана. Кроме того, FreeWaterLoop позволяет уменьшить размер охладительных установок дата-центров, занимая меньше пространства, чем классические системы воздушного охлаждения оборудования. По словам Alfa Laval, наблюдаются беспрецедентные изменения на рынке ЦОД, поскольку развитие ИИ ведёт к росту тепловых нагрузок, заказчику тем временем требуют всё более устойчивую инфраструктуру. Alfa Laval использует свои сильные стороны для создания нового поколения эффективных и надёжных решений в сфере терморегулирования. Основанная в 1883 году шведская компания Alfa Laval занимается как разработкой, так и производством. Она поставляет бойлеры, вентили, насосы, теплообменники и прочие компоненты для судостроения, энергетики и пищевой промышленности. Компания заявила, что в случае с FreeWaterLoop речь идёт об одном из самых быстрых циклов разработки для решений такого масштаба. Это отражает общие амбиции Alfa Laval, свидетельствует о быстром процессе принятия решений в компании и активной поддержке ЦОД с помощью масштабируемых инноваций. Ещё в 2024 году сообщалось, что через несколько лет СЖО займут треть рынка систем охлаждения для ЦОД. Впрочем, новости февраля 2026 года свидетельствуют о том, что с повсеместным внедрением придётся повозиться. AWS резко сократила развёртывание СЖО для Trainium3, решив обойтись преимущественно воздушным охлаждением, хотя ранее сама с нуля разработала собственную систему жидкостного охлаждения в кратчайшие сроки.

02.03.2026 [14:52], Сергей Карасёв

В США появился Институт дата-центров следующего поколения для решения проблем питания и охлаждения ИИ ЦОД будущегоОкриджская национальная лаборатория (ORNL) Министерства энергетики США (DOE) объявила о создании Института дата-центров следующего поколения (NGDCI). Это подразделение объединит опыт и ресурсы лаборатории в области энергетических технологий, HPC и кибербезопасности для решения проблем, с которыми сталкиваются современные ИИ ЦОД. Речь идёт прежде всего о дефиците электроэнергии и стремительном увеличении нагрузки на энергосистему. На дата-центры, по оценкам, приходится более 4 % потребления электроэнергии в США. Согласно прогнозам Научно-исследовательского института электроэнергетики (EPRI), к 2030-му этот показатель может увеличиться до 17 %. Значительная часть роста обусловлена рабочими нагрузками ИИ: например, для обучения одной большой языковой модели (LLM) с огромным количеством параметров требуются сотни МВт·ч. Быстро повышающийся спрос со стороны ИИ и промышленных потребителей создаёт всё большие риски для надёжности энергосистемы. Кроме того, растут инвестиции в области ЦОД. По оценкам McKinsey, к 2030 году глобальные расходы на соответствующую инфраструктуру достигнут $7 трлн, причём более 40 % из них придётся на США. Директор ORNL Стивен Стрейффер (Stephen Streiffer) отмечает, что на фоне быстрого развития дата-центров всё более остро встают вопросы надёжного энергоснабжения и эффективного охлаждения. Специалистам NGDCI предстоит помочь в решении назревших проблем. Новый институт будет развивать интегрированный подход, предполагающий объединение технологий электропитания, охлаждения, терморегулирования, планирования рабочих нагрузок и прогнозирования с использованием ИИ. При этом планируется использовать наработки другого проекта ORNL — MEGA-DC (Modeling Energy Growth Associated with Data Centers): это платформа поддержки принятия решений с учётом множества критериев, которая моделирует и прогнозирует затраты и экономические выгоды от модернизации инфраструктуры. В целом, NGDCI сосредоточит работу на шести ключевых направлениях:

25.02.2026 [11:55], Сергей Карасёв

Akash Systems начала поставки первых в мире GPU-серверов с алмазным охлаждениемКомпания Akash Systems, базирующаяся в Сан-Франциско (Калифорния, США), объявила о начале поставок первых в мире ИИ-серверов, оснащённых системой алмазного охлаждения Diamond Cooling. Заказчиком выступил NxtGen AI PVT Ltd — крупнейший в Индии государственный облачный провайдер. Технология Diamond Cooling основана на применении синтетических алмазов. Этот материал обладает самой высокой теплопроводностью из всех известных соединений. Akash Systems подчёркивает, что синтетические алмазы способны отводить тепло от чипов в пять раз эффективнее по сравнению с медью, что открывает качественно новые возможности в плане охлаждения современного оборудования высокой плотности для дата-центров, ориентированных на задачи ИИ и НРС. Akash Systems поставляет серверы на базе NVIDIA H200, для охлаждения которых применяется система Diamond Cooling. В отличие от стандартных ЦОД, оборудование в которых функционирует при температурах от +24 до +29 °C, серверы с технологией Diamond Cooled способны обеспечивать максимальную производительность при температуре окружающей среды до +50 °C. Благодаря этому снижаются общие требования к системам охлаждения дата-центров, что позволяет уменьшить эксплуатационные расходы. Среди одного из ключевых преимуществ Diamond Cooling разработчики называют устранение теплового троттлинга: это обеспечивает наилучшее быстродействие при выполнении ресурсоёмких задач, таких как обучение больших языковых моделей (LLM) и инференс. Кроме того, достигается повышение производительности (Флопс/Вт) до 15 % на каждый сервер. Плюс к этому существенно сокращается общее энергопотребление ЦОД, поскольку отпадает необходимость в интенсивном охлаждении. «Система Diamond Cooling решает две самые сложные проблемы в гонке ИИ — повышение энергоэффективности и сокращение капиталовложений. В ситуации, когда увеличение вычислительной мощности на 1–2 % имеет большое значение, повышение на 15 % фактически меняет правила игры», — говорит доктор Феликс Эджекам (Felix Ejeckam), соучредитель и генеральный директор Akash Systems.

16.02.2026 [11:16], Руслан Авдеев

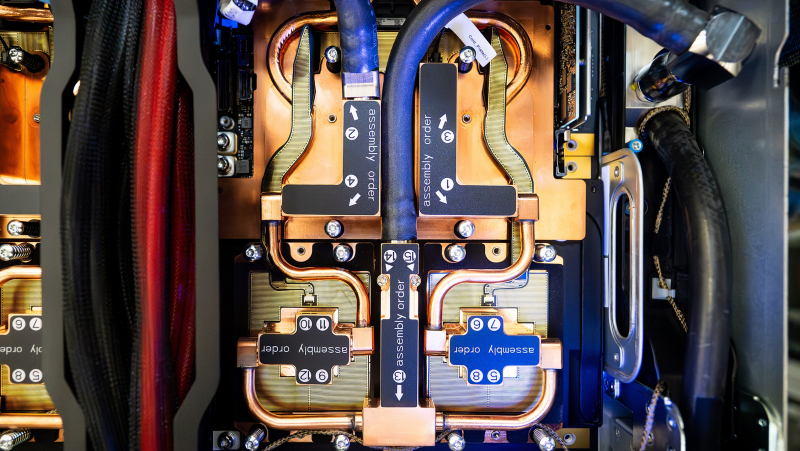

Попутного ветра: AWS резко сократила развёртывание СЖО для Trainium3, решив обойтись преимущественно воздушным охлаждениемAmazon Web Services (AWS) резко увеличит долю воздушного охлаждения в серверах на базе ускорителей Trainium3. Производство серверов намерены нарастить во II квартале 2026 года, но жидкостное охлаждение в них будут применять далеко не так активно, как ожидалось, сообщает DigiTimes. Если ранее планировалось применять системы жидкостного и воздушного охлаждения с соотношением 1:1, то теперь на первые будет приходиться лишь 10 % от общего числа, что способно замедлить внедрение СЖО в ЦОД. При этом ранее отраслевые эксперты прогнозировали, что проникновение СЖО на рынок ИИ-серверов вырастет с менее 20 % в 2025 году до более 50 % в 2026-м. Это должно было случиться за счёт расширения поставок GPU- и ASIC. AWS даже смогла разработать в рекордно короткие сроки собственную платформу СЖО, что привело к падению акций Vertiv, одного из бенефициаров ИИ-бума. Новый подход к оборудованию Trainium3 ставит под вопрос будущее и динамику перехода к жидкостному охлаждению. Тем не менее, рост производства Tranium 3 в любом случае поддержит спрос на продукцию ключевых партнёров AWS: Wiwynn, Accton, Auras, Taiwan Microloops и Nan Juen International (Repon). Вероятно, спрос позволит загрузить производственные мощности до конца 2026 года. По мнению аналитиков, решение AWS во многом связано с TDP ускорителей на уровне 800 Вт (хотя раньше говорили об 1000 Вт) — для них, вероятно, достаточно и для современного воздушного охлаждения, что снижает необходимость перехода на более дорогие и сложные СЖО. По данным AWS, Trainium3 приблизительно на 40 % производительнее в сравнении с ускорителями предыдущего поколения. Также компания объявила о капитальных затратах до $200 млрд на расширение ИИ-инфраструктуры, в т.ч. производство собственно ускорителей — на 2027 год запланированы поставки уже Trainium4. Так или иначе, даже после снижения доли СЖО спрос на компоненты у партнёров должен увеличиться за счёт роста производства в целом. Рост популярности жидкостного охлаждения в ИИ ЦОД в последние годы во многом обусловлен ростом TDP ускорителей NVIDIA. Если у H200 показатель был на уровне около 700 Вт, то у B200 — порядка 1000 Вт, а у B300 — уже 1400 Вт. Для будущих архитектур с двумя чипами значения будут ещё выше. В результате операторам ЦОД требуется эффективный отвод тепла, что могут обеспечить СЖО. Кроме того, это позволяет повысить плотность размещения оборудования. В сегменте ASIC рост TDP заметно ниже. Так, для Trainium2 речь шла об около 500 Вт, у Trainium3 — всего 800 Вт, поэтому воздушное охлаждение — вполне рабочий вариант, за исключением некоторых сценариев, например, с высокой плотностью размещения оборудования. Также источники в цепочке поставок подчёркивают, что жидкостные системы дороже устанавливать и обслуживать в сравнении с современными воздушными вариантами. При этом экосистема производства и обслуживания СЖО часто оценивается как «менее зрелая». Благодаря этому организовать поставки серверов с воздушным охлаждением можно быстрее, и они будут более стабильными. Беспокойство операторов ЦОД может вызывать и репутация жидкостных систем. Например, в конце января Wave Power объявила о том, что некоторые проданные компоненты СЖО для ИИ-систем привели к повреждению оборудования, поэтому компании пришлось выложить $4,5 млн, чтобы заключить мировое соглашение. По мнению экспертов, утечки в СЖО — довольно распространённое явление, не привязанное к конкретному вендору, но каждый подобный инцидент свидетельствует о потенциальных проблемах, которые заказчикам приходится принимать в расчёт. Хотя системы жидкостного охлаждения технически предпочтительнее для самых энергоёмких нагрузок благодаря высокой эффективности теплоотвода, потенциалу снижения показателя PUE и способности обеспечить экономию пространства, на примере Trainium3 можно оценить, как совокупность факторов, включая совокупную стоимость владения (TCO) и операционные риски влияют на сроки внедрения СЖО. Изменение планов AWS может повлиять на всю индустрию ИИ ЦОД, которая может замедлить повсеместный переход на жидкостное охлаждение, по крайней мере, в краткосрочной перспективе. Вместе с тем даже для ИИ-платформ нынешнего поколения гиперскейлеры разработали гибридные варианты охлаждения, позволяющие использовать современные системы в старых ЦОД, не рассчитанных изначально на крупномасштабные СЖО. Так, Meta✴ «растянула» суперускорители NVIDIA GB200 на шесть стоек вместо одной, чтобы разместить там теплообменники, а Microsoft с той же целью «пристроила» к стойке с оборудованием модуль шириной в ещё пару стоек. Google же предпочитает для своих TPU именно СЖО.

11.02.2026 [15:00], Руслан Авдеев

Trane Technologies приобрела поставщика СЖО для ЦОД LiquidStackИндустрия ИИ находится на пике популярности, стимулируя слияния и поглощения в сегменте продуктов для систем охлаждения ЦОД. Так, компания Trane Technologies, занимающаяся разработкой кондиционеров и смежных решений, приобрела стартап LiquidStack, специализирующийся на СЖО, сообщает The Register. Trane инвестировала в LiquidStack в 2023 году. Также в компанию инвестировали Tiger Global Management ($20 млн) и Wiwynn ($10 млн). LiquidStack была одной из первых компаний, разрабатывавших двухфазное иммерсионное охлаждение для систем майнинга криптовалюты. Фактически компания появилась в 2012 году в результате реорганизации Allied Control Limited (ACL, подразделение The Bitfury Group), которая изначально занималась созданием СЖО для майнинговых систем. Технологию LiquidStack протестировала в 2021 году Microsoft. С тех пор компания пополнила портфолио системами одно- и двухфазного погружного охлаждения, а также решениями прямого охлаждения чипов (DLC), в т.ч. CDU. Сообщается, что после закрытия сделки LiquidStack будет работать в составе подразделения Commercial HVAC. Технологии купленной компании пополнят портфолио продуктов Trane, предназначенных для дата-центров. По данным LiquidStack, покупка включает команду стартапа и производственные мощности, а также инженерные и научно-исследовательские подразделения в Техасе и Гонконге.

Источник изображения: LiquidStack По прогнозам экспертов Dell'Oro Group, к 2030 году рынок физической инфраструктуры ЦОД превысит $80 млрд. Одним из самых быстрорастущих сегментов в нём являются системы управления тепловыми режимами, среднегодовой темп прироста составит 20 %. Эксперты уверены, что к концу десятилетия рынок DLC СЖО достигнет оборота $8 млрд, во многом благодаря ИИ-технологиям. Жидкостное охлаждение сегодня перестало быть желательным дополнительным элементом и стало обязательным для получения максимальной отдачи от современного оборудования ИИ ЦОД. Покупка LiquidStack — не первая попытка Trane выйти на рынок технологий жидкостного охлаждения. Ещё в декабре 2025 года была куплена Stellar Energy, выпускавшая модульные охлаждающие решения и CDU, в том числе для ЦОД. Впрочем, это лишь последние из многих слияний и поглощений на рынке физической инфраструктуры для дата-центров, инициированных бумом ИИ-технологий. В конце 2024 года Schneider Electric купила контрольный пакет акицй Motivair. В декабре 2023 года Vertiv приобрела CoolTera. Почти сразу же после этого она запустила производство на полную мощность, увеличив выпуск CDU в 45 (!) раз.

04.02.2026 [12:11], Руслан Авдеев

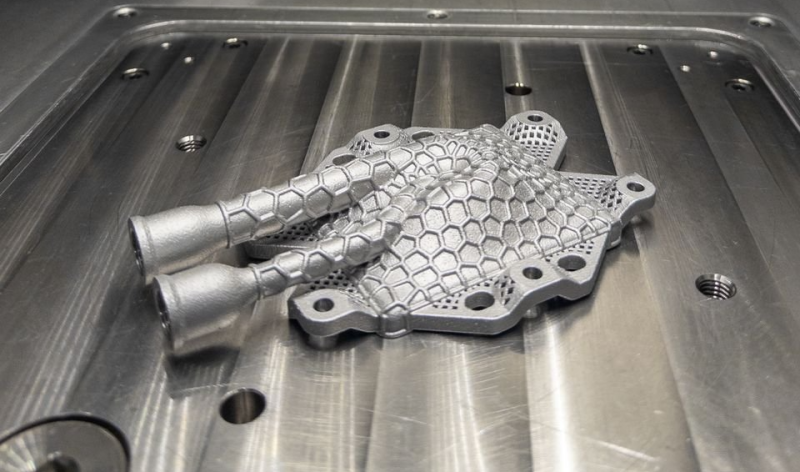

Датские исследователи напечатали в 3D испарительную камеру для пассивной двухфазной СЖОГруппа учёных создала один из ключевых компонентов системы жидкостного охлаждения (СЖО) дата-центров с использованием 3D-печати. В проекте приняли участие исследователи и специалисты практики из Дании, Бельгии и Германии, сообщает Datacenter Dynamics. Датский технологический институт (Danish Technological Institute) совместно с компанией Heatflow (Дания), бельгийской Open Engineering и занимающимся прикладными исследованиями немецким институтом Fraunhofer IWU разработали, напечатали на 3D-принтере и протестировали компонент системы охлаждения для дата-центров и высокопроизводительных компьютеров. В новом решении охлаждающая жидкость испаряется на горячей поверхности. Пар, отводя тепло, поднимается, а потом конденсируется и под действием силы тяжести возвращается к источнику тепла. Ключевой компонент — испарительная камера — изготовлена с помощью 3D-печати компанией Heatflow и Датским технологическим институтом. в ходе испытаний достигнута мощность охлаждения 600 Вт, это на 50 % больше, чем планировалось (400 Вт). Насосы этим элементом системы не используются, что снижает энергопотребление.

Источник изображения: Danish Research Institute Как заявили представители Датского технологического института, благодаря 3D-печати можно интегрировать необходимые функции в единую деталь. Благодаря этому отпадает надобность в узлах соединения, снижается риск протечек и повышается надёжность компонента. Кроме того, используется только один материал, поэтому переработка упрощается. Проект — часть европейской исследовательской инициативы AM2PC. Он поддерживается европейской сетью M-ERA.NET за счёт средств гранта Датского инновационного фонда (Danish Innovation Fund). Основной задачей проекта была разработка и производство испарительной камеры, а также проверка его рабочих характеристик. По словам Heatflow, наблюдается тенденция к беспрецедентному росту удельной мощности серверов, поэтому классического воздушного охлаждения уже недостаточно, а новое двухфазное решение позволяет пассивно отводить тепло без использования насосов и вентиляторов, это значительно снижает энергопотребление.

Источник изображения: Danish Research Institute Основанная в 2018 году Heatflow является поставщиком систем охлаждения для электроники. Компания специализируется на двухфазном охлаждении. Испарительная камера изготовлена благодаря лазерному спеканию порошковых слоёв (PBF-LB). При этом методе лазер используется для формирования металлических заготовок. Решение отводит тепло при температурах 60–80 °C и потенциально применимо в системах централизованного теплоснабжения, применяющих отработанное тепло дата-центров. Учёные подчёркивают, что не уделяли особого внимания интеграциям с системами центрального отопления, но наглядно продемонстрировали, что подобная технология обеспечивает такую возможность. Утверждается, что речь идёт о важном шаге на пути создания более энергоэффективных дата-центров, способных внести позитивный вклад в общий энергетический баланс. Развитие технологий охлаждения особенно важно, поскольку, по данным исследования Rest of World, около 80 % всех дата-центров мира построены в неподходящих климатических условиях, речь идёт о почти 7 тыс. объектов. |

|