Материалы по тегу: дефицит

|

07.02.2026 [17:23], Руслан Авдеев

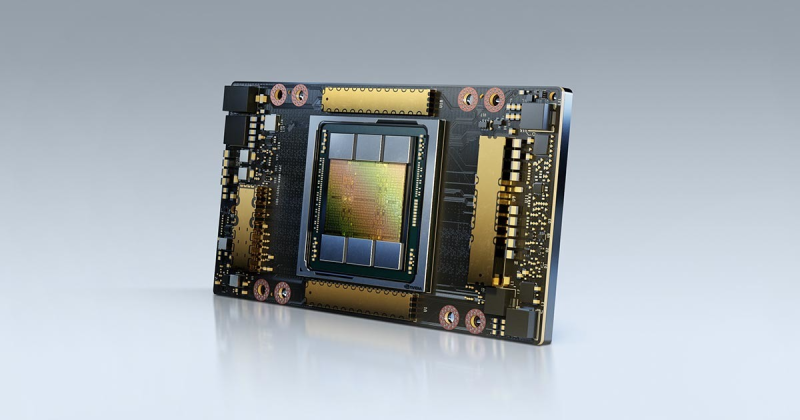

AWS: ни один сервер с NVIDIA A100 не выведен из эксплуатации, а некоторые клиенты всё ещё используют Intel Haswell — не всем нужен ИИПо словам главы AWS Мэтта Гармана (Matt Garman), клиенты до сих пор использует серверы на основе ИИ-ускорителей NVIDIA A100, представленных в 2020 году. Отчасти это происходит потому, что спрос на вычислительные ресурсы превышает предложение, так что устаревшие чипы по-прежнему востребованы, передаёт Datacenter Dynamics. По словам Гармана, все ресурсы фактически распроданы, а серверы с A100 из эксплуатации никогда не выводились. Комментарии Гармана перекликаются с прошлогодним заявлением Амина Вахдата (Amin Vahdat), отвечающего в Google за ИИ и инфраструктуру. По его словам, в Google одновременно работают семь поколений тензорных ускорителей (TPU). Ускорители возрастом семь-восемь лет загружены на 100 %, а спрос на TPU так высок, что Google вынуждена отказывать некоторым клиентам. Впрочем, оба топ-менеджера, возможно, несколько кривят душой и пытаются развеять опасения инвесторов относительно того, что ИИ-ускорители, на которые тратятся огромные деньги, через два-три года придётся выкинуть, чтобы купить более современные, энергоэффективные и, конечно же, дорогие. И что за это время они не успеют окупиться. Хотя Гарман назвал главной причиной сохранения работы серверов на A100 высокий спрос, он признал, что есть и другие причины. В частности, современные ИИ-чипы снижают точность вычислений с плавающей запятой. В результате некоторые клиенты попросту не могут перейти на Blackwell или вовсе вынуждены использовать Intel Xeon Haswell десятилетней давности для HPC-подобных вычислений, поскольку точности у современных ИИ-ускорителей недостаточно. В июне 2025 года AWS заявила о снижении цены доступа к устаревшим NVIDIA H100, H200 и A100 на своей платформе, причём для A100 стоимость снизилась на треть.

Источник изображения: NVIDIA Стоит отметить, что «устаревшие» ускорители долго остаются востребованными, поскольку всё равно обладают большой производительностью. Наиболее яркий пример — разрешение на поставку в Китай чипов NVIDIA H200. Хотя США и их союзники готовятся к внедрению ускорителей поколения Vera Rubin, китайский бизнес готов покупать H200, поскольку те значительно производительнее, экономически выгоднее и удобнее отечественных ускорителей.

05.02.2026 [13:54], Руслан Авдеев

В Москве закончилась электроэнергия для новых дата-центровОператоры ЦОД в Москве столкнулись с критической проблемой — управляющие энергосетями компании отказываются заключать договоры на подключение новых объектов, поскольку свободных мощностей в городе больше нет. Они или зарезервированы крупными игроками на 2026–2028 гг., или уже используются, сообщают «Ведомости». По данным экспертов, постановление правительства №861 гарантирует недискриминационный доступ к электросетям и, если энергии недостаточно, её должны предложить оператору дата-центра в меньшем объёме, но оператору меньший объём не нужен. Конкурентами ЦОД выступают и другие промышленные потребители энергии, имеющие равные права на подключение. Но и в случае одобрения нередко условием для подключения становятся неподъёмные для владельцев ЦОД расходы на самоподключение и затраты на реконструкцию высоковольтных сетей. «Порог вхождения» дополнительно поднимет ожидаемое введение правила «бери или плати», предполагающее оплату не по фактической нагрузке, а по максимальной выделенной мощности для новых потребителей 670+ кВт.

Источник изображения: Viktor SOLOMONIK/unsplash.com При этом новые мощности генерации в Москве и ближайшем Подмосковье появятся только в 2027–2030 гг. и даже в этом случае по мнению экспертов не исключаются задержки. Новые высоковольтные линии к действующим электростанциям должны быть построены в 2030–2032 гг., поэтому беспрепятственное подключение ЦОД к электросетям в Москве и окружающем регионе в кратко- и среднесрочной перспективе невозможно. По оценкам iKS-Consulting, летом прошлого года московские ЦОД были заполнены примерно на 95 %, а свободная мощность в столичном регионе не превышает 1,4 тыс. стоек. Избыток энергомощностей есть в других регионах, особенно в Сибири, но там в основном размещаются небольшие корпоративные ЦОД, а локальный спрос невелик — основная масса пользователей сосредоточена в Москве и Подмосковье, поэтому обслуживать их из, например, дальневосточного ЦОД нецелесообразно. По данным «Ведомостей», регионы сами жаловались на нежелание крупных игроков рынка выходить в регионы со своими ЦОД, поскольку для них это невыгодно. Кроме того, без значимых инвестиций в сетевую инфраструктуру трафик всё равно будет проходить через Москву, что только ухудшит ситуацию с задержками по сравнению с использованием столичных облаков. Вместе с тем, по словам экспертов, новые проекты начали реализовать в Екатеринбурге, Новосибирске, Казани, Самаре, Нижнем Новгороде и Ростове-на-Дону.

Источник изображения: Roman Purtov/unsplash.com В российском законодательстве уже есть механизмы, стимулирующие инвестиции в дата-центры, например, заключение соглашений о защите и поощрении капиталовложений (СЗПК). Механизм предусматривает возмещение указанных в 69-ФЗ «О защите и поощрении капиталовложений» фактических затрат на строительство обеспечивающих инфраструктурных объектов, а также на погашение процентов и купонных доходов в размере 50 %. Других значимых законодательных стимулов для построения ЦОД в регионах пока нет, а вот препятствия есть. По данным iKS-Consulting, в 2024 году введено в эксплуатацию более 11 тыс. стойко-мест в коммерческих ЦОД, в 2025 году — порядка 5 тыс. Шесть новых крупных объектов открыли в 2024 году, ещё три — в 2025-м. Всего на конец 2024 года насчитывалось около 200 ЦОД с 81,2 тыс. стойко-мест, на конец 2025 года, вероятно, насчитывалось около 85,8 тыс. стойко-мест. По прогнозам правительства России, к 2030 году энергопотребление дата-центров в стране вырастет не менее, чем в 2,5 раза до 2,5 ГВт.

05.02.2026 [12:31], Руслан Авдеев

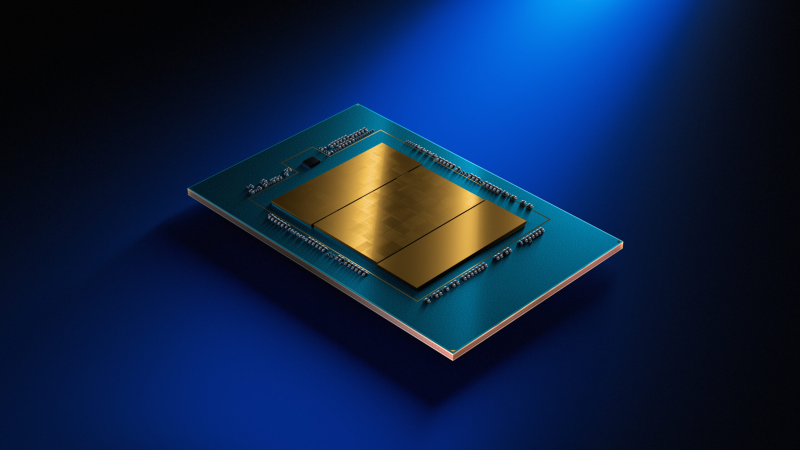

Omdia прогнозирует рост цен на всё более дефицитные серверные CPUВ 2026 году дата-центры могут столкнуться не только с уже имеющимся дефицитом памяти, но и не менее серьёзной проблемой, связанной с ограничением поставок классических серверных процессоров, сообщает The Register со ссылкой на аналитику Omdia. Тем не менее, эксперты ожидают, что поставки будут расти двузначными темпами. В обзоре Cloud and Datacenter Market Snapshot компания Omdia сообщила, что серверных CPU тоже не хватает и это, вероятно, приведёт к росту цен и увеличению общей стоимости вычислительных систем. По мнению экспертов, как минимум отчасти это связано со сложностью переноса объёмов производства между разными техпроцессами. По мере масштабирования планов производителям CPU приходится выпускать продукцию на разных техпроцессах, например 3 нм и 5 нм. При этом перераспределение объёмов производства между разными технологическими линиями — процесс довольно сложный и трудоёмкий. Дефициту может способствовать и более высокий, чем ожидалось, процент брака готовой продукции.

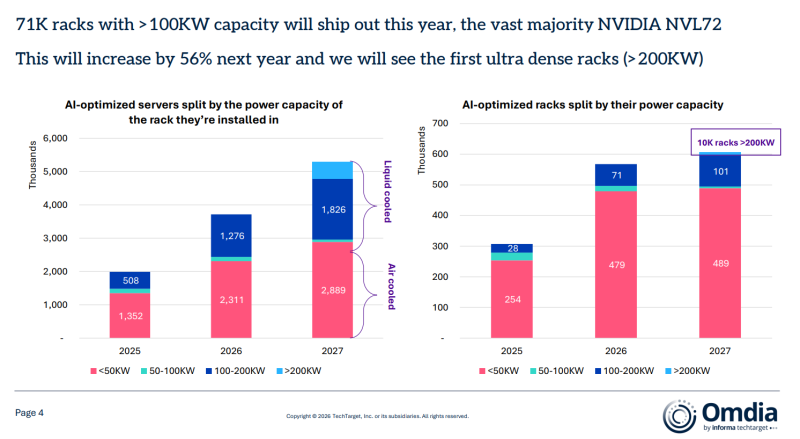

Источник изображения: Intel Как считает Omdia, в результате цены на серверные процессоры, возможно, вырастут на 10–15 % из-за дефицита предложения. Стоит учесть, что крупнейшие клиенты имеют долгосрочные соглашения с производителями с фиксированными ценами, иначе прогнозы были бы ещё хуже. Вместе с тем акции AMD и Intel упали из-за слабого, по мнению инвесторов, прогноза. Любые проблемы с CPU усугубят непростую ситуацию в цепочке поставок IT-оборудования. На фоне дефицита цены на DRAM-модули в данном квартале, вероятно, почти удвоятся, а цены на память NAND вырастут более чем на 30 %. Обычная DRAM оказалась в дефиците не в последнюю очередь потому, что производители перепрофилировали свои мощности на выпуск высокорентабельных продуктов — HBM-модулей для ИИ-ускорителей. Omdia обеспокоена тем, что дефицит оперативной памяти может сказаться на темпах производства серверов, что способно повлиять на сроки завершения уже реализуемых проектов ЦОД. Тем не менее, эксперты прогнозируют рост поставок серверов в 2026 году на 12 %. Основным драйвером выступает «цикл обновления» — необходимость закупки новых серверов общего назначения, что будет способствовать увеличению их поставок. При этом дефицит памяти называется большей угрозой, чем нехватка процессоров. Что касается стоек с серверами на базе ИИ-ускорителей, Omdia предполагает, что в 2026 году будет поставлено не менее 71 тыс. единиц с IT-нагрузкой более 100 кВт, в основном на базе систем NVIDIA NVL72. Благодаря высокому спросу на ИИ-инфраструктуру, Omdia ожидает, что в следующем году спрос увеличится ещё на 56 %, появятся и первые «сверхплотные» стойки мощностью более 200 кВт и дело на этом, вероятно, не закончится.

03.02.2026 [08:38], Владимир Мироненко

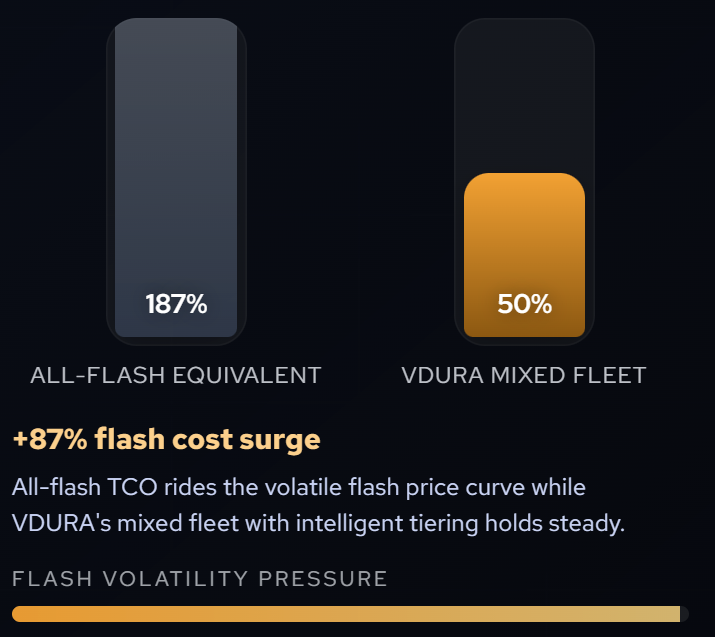

VDURA предложила программу Flash Relief Program для смягчения дефицита флеш-памятиVDURA, заявившая, что теперь SSD корпоративного класса уже в 16 раз дороже HDD аналогичной ёмкости, анонсировала программу Flash Relief Program, в рамках которой клиенты получат доступ к хранилищам, по ёмкости и быстродействию не уступающие массивам VAST Data и WEKA, но вполовину дешевле с точки зрения TCO. В условиях дефицита NAND-памяти цены на SSD выросли в два-три раза, а гибридная архитектура VDURA, использующая накопители разных типов, обеспечивает превосходную производительность и ёмкость при вдвое меньшей стоимости, заявила компания.

Источник изображения: VDURA Как сообщает VDURA, клиенту достаточно предоставить требования к конфигурации файлового хранилища VAST, WEKA или любой другой высокопроизводительной All-Flash СХД, включая требования по производительность (пропускная способность, IOPS, задержка) и требования к ёмкости (сырая, полезная, эффективная), а VDURA в течение 24 ч. предоставит конкурирующее предложение, которое:

VDURA называет следующие преимущества своего продукта:

Предложение VDURA заключается в том, что её гибридная параллельная ФС на основе SSD/HDD может компенсировать рост цен на SSD лучше, чем что-либо, предлагаемое производителями массивов All-Flash, отметил ресурс Blocks & Files. Если цены на SSD продолжат расти и не будет решена проблема дефицита, подобные заявления могут заставить потенциальных покупателей массивов All-Flash переключиться на гибридные системы СХД с автоматическим многоуровневым хранением данных. И даже использование б/у SSD, как предлагает VAST Data, вряд ли поможет в такой ситуации.

30.01.2026 [10:54], Владимир Мироненко

Спасите наши SSD: VAST Data запустила программу VAST Amplify для повышения эффективности использования имеющихся накопителейВ ответ на растущий дефицит флеш-памяти компания VAST Data, специализирующаяся на инфраструктуре для ИИ, представила программу VAST Amplify, разработанную для того, чтобы помочь организациям увеличить эффективную ёмкость имеющихся у них SSD. Взаимодействие компании с клиентом в рамках VAST Amplify проходит в несколько этапов. Сначала производится исследование инфраструктуры, в ходе которого VAST анализирует всю среду хранения данных клиента, чтобы выявить участки недоиспользуемых SSD, фрагментации между разрозненными системами и связанные с устаревшей архитектурой потери, которые снижают эффективную ёмкость. Затем следует быстрая квалификация платформы — процесс быстрой сертификации существующих серверов и SSD клиента для использования в экосистеме VAST, позволяющий обойти зависимость от новых окон распределения оборудования. После этого с помощью восстановления и интеграции мощностей перепрофилированное оборудование объединяется в единое унифицированное пространство имён на базе ОС VAST AI. Это преобразует фрагментированную, привязанную к серверам флеш-память в глобально доступный пул высокопроизводительного хранилища, где мощность может динамически распределяться для любого приложения, устраняя ограничения, связанные с серверными границами или устаревшими архитектурами. Защита данных осуществляется на уровне платформы с использованием высокоэффективного кодирования с исправлением ошибок, а не традиционных методов, требующих интенсивной репликации и потребляющих в два-три раза больше «сырого» места. Это увеличивает полезную ёмкость при сохранении отказоустойчивости в масштабе. Как сообщается, программа обеспечивает шестикратное увеличение эффективной ёмкости, благодаря использованию базовой архитектуры VAST Data — Disaggregated Shared Everything (DASE) — и набору передовых программных технологий. В отличие от традиционных систем, которые выполняют редукцию данных в изолированных узлах или томах, подход VAST является глобальным и всеобъемлющим. Одним из ключевых элементов является непрерывная глобальная редукция на основе сходства. Эта технология ищет и устраняет повторяющиеся паттерны данных по всему кластеру хранения, а не только в одном файле, наборе данных или томе. Это позволяет существенно увеличить эффективную ёмкость при фиксированном объёме флеш-памяти, особенно в ИИ-средах, где наборы обучающих данных могут содержать огромное количество похожей или дублирующейся информации. Большую роль играет архитектура записи, оптимизированная для SCM (Storage Class Memory). Все входящие данные сначала записываются в сверхбыстрый SCM-буфер, что позволяет системе «поглощать» случайные и «импульсные» записи, а затем интеллектуально организовывать и записывать данные на базовые SSD большими последовательными блоками, что снижает коэффициент усиления записи, повышает износостойкость и срок службы флеш-накопителей, поддерживая при этом низкую задержку без необходимости использования дорогостоящего оборудования с избыточным резервированием. Благодаря сочетанию этих методов, операционная система VAST AI OS позволяет значительно увеличить эффективную ёмкость при фиксированном объёме физической флеш-памяти, говорит компания. Впрочем, Dell, крупный поставщик более традиционных СХД, не одобряет подход VAST Data, который фактически подразумевает использование б/у SSD.

28.01.2026 [18:23], Руслан Авдеев

TD Cowen: американские банки расхотели давать в долг Oracle из-за её сделок с OpenAIСогласно докладу TD Cowen, возможность Oracle приобретать новые мощности ЦОД в США оказалась под вопросом из-за обязательства перед партнёром — компанией OpenAI. Банки начали сомневаться, что Oracle способна профинансировать все масштабные проекты, в которые она пытается ввязаться, сообщает Datacenter Dynamics. К Oracle уже подали иск держатели облигаций, обвиняющих компанию в сокрытии данных о том, сколько именно ей потребуется взять в долг для поддержки строительства ИИ-инфраструктуры в рамках сделки с OpenAI на $300 млрд. Компания привлекла около $58 млрд долгового финансирования для ИИ ЦОД в интересах OpenAI, включая $38 млрд для финансирования кампусов в Техасе (Frontier) и Висконсине (Lighthouse) и около $20 млрд — для кампуса в Нью-Мексико (Project Jupiter). Ещё $10 млрд займов ушло на первый кампус Stargate в Техасе. Тем не менее, в обновлении материалов Data Center Channel Checks, подготовленном TD Cowen, заявляется, что Oracle потребуется приобрести около 3 млн ИИ-ускорителей и прочего IT-оборудования для обеспечения уже действующих договорённостей. Это вызывает вопросы у инвесторов как в акционерный, так и в долговой капитал, которые сомневаются в возможности компании финансировать все стройки. TD Cowen сообщила о росте кредитно-дефолтных свопов (CDS), которые говорят о повышении ожиданий рынком риска дефолта. Также беспокойство вызывает одновременное снижение котировок акций и облигаций компании. TD Cowen добавляет, что теперь Oracle требует авансовые депозиты в объёме 40 %, чтобы компенсировать дополнительные капитальные затраты, необходимые для роста выручки, а также изучает другие возможности решения вопросов финансирования. Согласно TD Cowen, одним из вариантов может быть увольнение 20–30 тыс. сотрудкников, что даст $8–$10 млрд свободного денежного потока, и продажа Cerner, которую Oracle купила за $28,3 млрд в 2022 году. Потребность OpenAI в капитале, по расчётам, составляет $156 млрд, и это исходя из консервативной оценки в $30 млн/МВт с учётом IT-инфраструктуры. Ситуация усугубляется существующими обязательствами OpenAI — $1,4 трлн долгосрочных контрактов. Это привело к тому, что многие американские банки стали отказываться от финансирования Oracle из-за соглашений компании с OpenAI, а в случаях, если кредиты всё же готовы выделить, условия финансирования стали намного хуже. Азиатские банки, желающие получить доступ к рынку финансирования ИИ-индустрии, всё ещё готовы предоставлять средства операторам, арендующим мощности Oracle, но значительное сокращение денежных вливаний со стороны их американских коллег привело к существенному замедлению роста бизнеса Oracle и ставит под сомнение способность компании наращивать выручку. Также отмечается, что переговоры об аренде ЦОД Oracle находятся под угрозой из-за того, что стороны не смогли договориться об обеспечении финансирования, что затрудняет усилия техногиганта по наращиванию своих арендных мощностей. В более широком контексте, доклад свидетельствует о росте индустрии ЦОД, в 2025 году рынок аренды дата-центров составил рекордные 16,4 ГВт. 5,1 ГВт арендовали в IV квартале, 7,4 ГВт — в III, 2.0 ГВт — во II, 1,9 ГВт — в I. Инвестиционный банк отметил, что в IV квартале, исторически всегда считавшемся наиболее «медленным», показатели аренды были очень высокими. В числе лидеров рынка аренды 2025 года — гиперскейлеры, включая Oracle. На начало 2026 года TD Cowen ожидает «чрезвычайно активный» портфель заказов на аренду ЦОД в США, около 9,2 ГВт уже «в процессе», а среди гиперскейлеров отмечается «здоровое разнообразие». В отчёте также отмечается, что это свидетельствует о спросе со стороны американских ИИ-лабораторий и крупных облачных провайдеров. Meta✴ к 2028 году намерена обеспечить себе 15 ГВт мощностей в США, OpenAI — 10 ГВт к 2029 году, Microsoft — 10 ГВт к 2030 году. При этом ускорение спроса ведёт и к увеличению затрат на строительство ЦОД, а также оплату труда квалифицированных сотрудников. Всё это повышает стоимость аренды на «спотовом» рынке. Предполагается, что от этого выиграют при продлении контрактов такие компании, как Digital Realty и Equinix. Наконец, в отчёте отмечается умеренный рост сроков поставки оборудования для систем бесперебойного питания и распределения электроэнергии. По мнению экспертов, это в целом свидетельствует о росте сроков поставок из-за того, что спрос на оборудование превысил предложение. Также это привело к росту цен на оборудование, что выгодно для поставщиков вроде Vertiv.

21.01.2026 [13:49], Руслан Авдеев

SSD для корпоративных клиентов теперь в 16 раз дороже, чем HDDПоставщик СХД для HPC и ИИ ЦОД — компания VDURA заявила, что ценовая пропасть между SSD и HDD корпоративного уровня расширяется, поскольку цены на твердотельные накопители растут значительно быстрее, чем на жёсткие диски, сообщает Blocks & Files. Новая информация, в частности, должна положить конец рассуждениям о том, что SDD окончательно вытеснят HDD, о чём так мечтает Pure Storage, по крайней мере, до тех пор, пока цены на NAND-память значительно не упадут. VDURA полагает, что критические изменения рынка особенно отразятся на ИИ, HPC и других средах с интенсивным использованием данных, где требования к производительности памяти не изменятся даже по мере роста цен. Компания ежеквартально публикует т.н. Flash Volatility Index (FVI) и Storage Economics Optimizer Tool для мониторинга изменений цен на SSD и HDD и помогает клиентам хотя бы отчасти компенсировать стремительный рост цен на твердотельные накопители. По данным VDURA, со II квартала 2025 года по I квартал 2026 цена 30-Тбайт TLC SSD выросла на 257 %, с $3062 до $10 950, а цены на HDD за тот же период выросли на 35 %, что расширило ценовой разрыв. Так, разница в цене TLC SSD и HDD выросла с 6,2 раза во II квартале 2025 года до 16,4 раза в I квартале 2026-го, а в случае QLC SSD — в 14,2 раза. В результате значительно выросли риски для All-Flash архитектур. Утверждаются, что отправленные несколько месяцев назад коммерческие предложения теперь требуют полного пересмотра бюджетов. The Flash Volatility Index помогает отследить, как изменения в цепочке поставок флеш-накопителей ведут к изменению цен на реальном розничном рынке и как это сравнимо с рынком HDD. Storage Economics Optimizer Tool позволяет клиентам моделировать общую стоимость системы с учётом различных архитектур хранения, целевых показателей производительности и др. VDURA использовала Storage Economics Optimizer Tool для оценки воздействия волатильности цен флеш-накопителей для распространённых архитектур хранилищ на 25 Пбайт, обеспечивающих скорость передачи данных 1 Тбайт/с. По данным на II квартал 2025 года, хранилище, использовавшее исключительно SSD, предполагало годовые затраты в размере $8,50 млн. К I кварталу 2026 года та же конфигурация подорожала до $24,54 млн, рост составил 189 %, в основном из-за роста цен на SSD. При этом утверждается, что архитектуры, комбинирующие использование SSD и HDD, позволяют значительно снизить рост цен и эффект от возможного неожиданного скачка цен на рынке твердотельных накопителей, с сохранением необходимых уровней производительности. В докладе FVI отражается усугубляющееся ценовое давление по всем уровнями инфраструктурного стека. Со II квартала 2025 года по I квартал 2026 года цены на оперативную память (DRAM) взлетели на 205 %, рост обусловлен высоким спросом на системы на основе ИИ-ускорителей, требующие больших объёмов памяти. Высокоскоростные сетевые компоненты столкнулись с похожими ограничениями, что дополнительно сказывается на цене систем. Особенно это затратно для вариантов с большим количеством узлов. Согласно данным из доклада FVI, многолетние договоры о покупке компонентов гиперскейлерами фактически заблокировали значительную часть мощностей для производства SSD до конца 2026 г. В то же время крупномасштабные инфраструктурные ИИ-проекты продолжают «поглощать» оставшиеся поставки. По оценкам экспертов, ценовое давление может сохраниться и в 2027 году и позже. Как заявляют в VDURA, после десятилетия относительно стабильного ценообразования на NAND-память, правила изменились. Лидерам рынка инфраструктуры требуются реальные данные о том, что происходит и планировать деятельность в соответствии с существующими трендами.

19.01.2026 [10:43], Руслан Авдеев

США переживают крупнейший за четверть века период роста энергопотребления, обусловленный развитием ЦОДАмериканское Управление энергетической информации (US Energy Information Agency, EIA) отмечает рекордный рост спроса на электроэнергию на американском рынке с 2000 года. В основном это обусловлено ростом аппетитов ЦОД, сообщает Datacenter Dynamics. Wood Mackenzie сообщала в октябре 2025 года, что американские коммунальные компании обязались предоставить до 2037 года крупным потребителям энергии до 160 ГВт новых мощностей. В документе EIA January Short-Term Energy Outlook прогнозируется, что использование электричества в США в этом году вырастет на 1 % и на 3 % — в 2027 году. По данным EIA, речь идёт о первом периоде с 2007 года, когда потребление электричества последовательно росло четыре года подряд, это сильнейшая четырёхлетка роста с 2000 года. По данным IEA, генерация энергии в США по-прежнему занимает очень сильные позиции, добыча природного газа должна вырасти в 2026 году до более 3 млрд м3 в день. Поставки природного газа имеют критическое значение, поскольку прогнозируется рост экспорта СПГ из США, а спрос на электричество до 2027 года увеличится, в основном благодаря росту спроса со стороны больших вычислительных площадок, включая ЦОД.

Источник изображения: Untitled Photo/unsplash.com Согласно данным EIA, солнечная энергия покажет наибольший прирост генерации. Хотя сейчас отношении к ней стало весьма прохладным, перспективы у неё, вероятно, действительно есть. Прогнозируется рост на 21 % в 2026–2027 гг. после ввода в эксплуатацию почти 70 ГВт новых мощностей. Генерация за счёт природного газа должна остаться без изменений в 2026 году и вырасти на 1 % в следующем, а генерация за счёт угольных электростанций упадёт на 9 % в 2026 году и останется без изменений в 2027-м. Новая администрация США отдаёт приоритет газовой и угольной генерации перед возобновляемой энергетикой, обосновывая это необходимостью удовлетворить стремительно растущий спрос ИИ ЦОД. Министерство энергетики США очень благосклонно относится к угольным проектам и в октябре основало фонд на $625 млн для модернизации и восстановления работы старых угольных электростанций, а американские коммунальные компании всё чаще «забывают» под давлением властей об обязательствах закрывать угольные мощности. С другой стороны, спрос на возобновляемые источники сократился. В июле 2025 года Сенат США принял т.н. Big Beautiful Bill, который вводит пошлины в 50 % на ветряные проекты и 30 % — на солнечные, реализация которых завершится после декабря 2027 года — если те будут использовать китайские компоненты и не смогут доказать обратного. По оценкам Rhodium Group, это увеличит стоимость таких проектов на 10–20 %. Кроме того, эти отрасли теряют налоговые льготы, а дополнительные расходы лягут на конечных потребителей. Это может привести к тому, что до 4,5 тыс. «чистых» энергопроектов не будут реализованы, что, возможно, приведёт к увеличению ежегодных расходов американцев на электричество на миллиарды долларов.

17.01.2026 [13:25], Владимир Мироненко

Дефицит — не оправдание: Dell против б/у SSD в СХДDell предостерегла компании от повторного использования SSD на фоне острого дефицита флеш-памяти, связанного с бурным развитием ИИ-технологий. По словам компании, флеш-накопители изнашиваются со временем, а повторное использование старых носителей увеличивает вероятность ускоренного выхода из строя, недоступности, а в худшем случае катастрофической потери данных. В связи с тем, что ситуация с дефицитом SSD может продолжаться в течение ближайших 12 мес. и даже более, VAST Data стала придерживаться стратегии Flash Reclaim, в рамках которой предполагается повторное использование клиентами накопителей, перемещая SSD из СХД её конкурента, например, Dell PowerScale, в шасси под управлением ПО VAST. Как утверждает VAST, её ПО позволяет лучше справляться с сокращением объёма данных и требует меньше места на SSD при защите от сбоев, что обеспечивает возможность хранения большего объёма данных. Дэвид Ной (David Noy), вице-президент по управлению продуктами в Dell, ранее занимавший пост вице-президента по управлению продуктами в VAST Data, отметил, что предложенная VAST Data «переработка» флеш-накопителей как стратегия — отличный маркетинговый ход, но не более. «Это может звучать прагматично, но несёт в себе реальный риск. Для поставщиков ПО для хранения данных это признак того, что в отчаянные времена требуются отчаянные меры», — заявил он ресурсу Blocks & Files. В отличие от поставщиков AFA, таких как VAST и Pure, Dell поддерживает многоуровневое хранение данных на устройствах All-Flash, гибридных и дисковых массивах. Это даёт гибкость и возможность задействовать меньше SSD. Ной утверждает, что у компаний, специализирующихся только на поставках AFA, мало места для манёвра при изменении рыночной конъюнктуры. Нет многоуровневого хранения, нет гибкости и нет запаса прочности на случай роста цен на флеш-память или увеличения сроков поставки. «Мы не заставляем клиентов переходить на флеш-память. И это важно — особенно с учётом того, что цены на флеш-память растут быстрее, чем на жёсткие диски, в то время как дисковые накопители остаются в несколько раз более экономичными для больших объёмов данных», — заявил он.

16.01.2026 [16:57], Руслан Авдеев

Moody’s: несмотря на отсутствие явной прибыли, триллионные инвестиции в ИИ-инфраструктуру и не думают прекращатьсяВызванный развитием ИИ бум строительства ЦОД, похоже, не спешит идти на спад. При этом опасения возникновения «пузыря» на рынке и того, что вся «конструкция» рухнет от недостатка инвестиций, не особенно усиливаются, сообщает The Register со ссылкой на аналитику Moody’s. В отчёте Moody’s 2026 Outlook прогнозируется сохранение текущих тенденций. При этом спрос на вычислительные мощности продолжит расти из-за растущих же требований ИИ, облачных площадок и интернет-сервисов. Согласно имеющимся оценкам, чтобы обеспечить прогнозируемый рост вычислительных мощностей, до конца десятилетия потребуется не менее $3 трлн инвестиций (данные подтверждает JLL), включая расходы на строительство зданий, IT-инфраструктуры и реализацию связанных энергетических проектов, необходимых для обеспечения работы ЦОД. Тем не менее, эксперты обеспокоены ограниченными возможностями электросетей и проблемами со строительством новых ЦОД. Также отмечается, что получение реальных доходов становится «всё важнее в экосистеме ИИ» — это необходимо, чтобы слухи о возможных «пузырях» потеряли остроту. Поднятые вопросы далеко не новы. В мае 2025 года McKinsey & Company предупреждала, что огромные суммы на ИИ выделяются лишь на основе прогнозов спроса, т.е. всего лишь предположениях, пусть и обоснованных. Агентство прогнозировало, что к 2030 году инвестиции в ИИ ЦОД перевалят за $5 трлн. В MIT полагают, что 95 % корпоративных пользователей всё ещё не получили отдачи от вложений в ИИ, а Moody’s заявляет, что циклические сделки, при которых деньги циркулируют между ограниченным кругом компаний, включая OpenAI и Microsoft, уже пугают инвесторов.

Источник изображения: Arron Choi/unsplash.com Капитальные затраты шести крупнейших американских игроков — Microsoft, Amazon, Alphabet, Oracle, Meta✴ и CoreWeave — приблизились к $400 млрд в 2025 году и, вероятно, достигнут $500 млрд в 2026-м и $600 млрд в 2027-м. Пика общий объём инвестиций должен достигнуть в 2029 году, после чего в 2030 году вложения начнут сокращаться. Строительство новых ЦОД обходится всё труднее, во многом из-за ограниченного доступа к электроэнергии на большинстве рынков, не готовых удовлетворить такие скачки спроса. Moody’s отмечает, что в некоторых регионах общественность всё активнее противится строительству ЦОД, опасаясь, что те будут потреблять слишком много электричества и воды, а также повлияют на коммунальные платежи. При этом остаются регионы с «благоприятными законами», которые продолжат привлекать инвестиции. В 2025 году, например, Великобритания объявила о создании «зон роста» ИИ (AI Growth Zones) с упрощением бюрократических формальностей.

Источник изображения: Imagine Buddy/unsplash.com По мере того, как растут риски, от застройщиков требуют всё более быстрой реализации проектов, чтобы крупные арендаторы могли как можно быстрее наращивать IT-мощности. Этому мешает дефицит квалифицированных рабочих, строительных материалов и оборудования, из-за чего растут затраты. В отчёте подчёркивается, что некоторые арендаторы уже готовы к рискам, которых раньше старались избежать. Например, речь идёт о доступности электричества и коммунальных услуг и др. факторах. Moody's подчеркивает риски «круговых сделок» OpenAI, в ходе которых компания заключила соглашения на гигаватты новых мощностей ЦОД и другие активы стоимостью сотни миллиардов долларов. В основном финансирование этих активов зависит от долгосрочных договоров аренды с компаниями уровня Microsoft и Oracle, но растущая роль OpenAI в экосистеме ИИ создаёт нарастающий кредитный риск, зависящий от успеха компании. В своём последнем квартальном отчёте OpenAI сообщила о чистом убытке более $11,5 млрд. Недавно аналитики DC Byte назвали основные тренды рынка ЦОД в 2026 году: всё больше проектов ЦОД не доходят до стадии строительства, правительства всё активнее влияют на скорость реализации проектов, капитал всё больше расходуется на ранних стадиях реализации проектов, что повышает риски для инвесторов. Кроме того, рост рынка больше не завязан на крупнейшие ИИ-хабы вроде Северной Вирджинии или Сингапура и всё чаще участники рынка отдают предпочтение регионам с более стабильным энергоснабжением и прозрачными нормативами застройки. |

|