Материалы по тегу: s

|

28.04.2026 [14:15], Руслан Авдеев

МТС объявила о выходе на рынок модульных ЦОДПАО «МТС» вышла на рынок модульных дата-центров, рассчитывая предоставлять «комплексную инфраструктурную платформу полного цикла». Компания займётся полным циклом задач, от проектирования и поставки модулей ЦОД до интеграции оборудования с ИИ- и другими решениями, а также облачными сервисами. Модульный подход позволяет сократить сроки ввода ЦОД в эксплуатацию и обеспечить расширение инфраструктуры по мере необходимости без простоя оборудования в процессе масштабирования, говорит МТС. По словами компании, вычисления доступны заказчику сразу после того, как готов первый модуль крупного дата-центра. Благодаря модульной концепции можно в короткие сроки реализовать проекты, не опасаясь того, что оборудование подорожает или будет снято с производства ещё на этапе проектирования. Важным преимуществом называется возможность сборки и тестирования модулей на этапе производства, это даёт возможность снизить стоимость ошибок и риски.

Источник изображения: Armin Narimani/unsplash.com Традиционный модульный ЦОД МТС включает четыре модуля по 150 серверных стоек каждый, мощностью 4 МВт. Заявленный PUE — 1,15. Сообщается, что первый проект уже запустили для одного из крупных представителей пищевой промышленности. Ранее решение уже проверено в Хабаровске, Краснодаре, Санкт-Петербурге и Нижнем Новгороде — в разных климатических условиях. По данным компании, российский рынок ЦОД в 2025 году составлял 100 млрд руб., из них 10 % приходится на модульные дата-центры, сегмент которых каждый год растёт на 20 %. Основными драйверами роста спроса на новую цифровую инфраструктуру названы рост спроса на генеративный ИИ, цифровые сервисы и аналитику. Кроме того, повлиял и дефицит готовых серверных стоек и качественных комплектующих. МТС на рынок модульных дата-центров позиционирует себя в качестве «провайдера комплексной цифровой инфраструктуры». Если несколько лет назад востребованность модульных решений была на уровне 20 %, то сегодня 80 % запросов предусматривают обеспечение традиционных и модульных ЦОД одновременно. Предложение МТС предполагает создание платформы с единой точкой доступа к площадке, облачным средам, инфраструктуре для работы с ИИ, кибербезопасности и др. Сочетание инженерных компетенций, надёжности и «бесшовной» интеграции с сервисами компании даёт доступ к готовой платформе для роста с «понятной» экономической моделью и инструментами гибкого масштабирования, говорит МТС.

28.04.2026 [01:11], Владимир Мироненко

Microsoft и OpenAI пересмотрели «брачный договор»: эксклюзивных прав больше нет, но и выручкой делиться не надоMicrosoft и OpenAI объявили о пересмотре условий партнёрского соглашения, что некоторые эксперты рассматривают как победу разработчика ChatGPT, хотя многие считают, обе стороны остаются в выигрыше. Как отметили обе компании, обновлённое соглашение призвано упростить партнерство и способы совместной работы, обеспечивая большую предсказуемость. Согласно обновлённому соглашению, у Microsoft по-прежнему будет лицензия на интеллектуальную собственность OpenAI для моделей и продуктов, срок владения которой ограничен 2032 годом, однако теперь она будет неисключительной. До этого у Microsoft были эксклюзивные права на интеллектуальную собственность OpenAI до тех пор, пока та не создаст «общий ИИ» (AGI). Microsoft по-прежнему является «основным облачным партнёром» OpenAI, т.е. основная часть облачных ресурсов OpenAI, вероятно, будет обслуживаться Azure в течение шести лет, охватываемых этим соглашением, даже несмотря на то, что OpenAI спешит построить собственные ЦОД в сотрудничестве с другими партнёрами. В октябре OpenAI обязалась приобрести облачные ресурсы Microsoft на сумму ещё $250 млрд. Фраза о том, Microsoft по-прежнему является «основным облачным партнёром» — сигнал акционерам Microsoft о том, что OpenAI по-прежнему будет крупным клиентом Azure, отметил ресурс TechCrunch. В обновлённом соглашении указано, что «продукты OpenAI будут в первую очередь поставляться Azure, если только Microsoft не сможет и не решит отказаться от поддержки». Судя по всему, Microsoft теперь будет в числе поставщиков, предлагающих новейшие продукты OpenAI. Но что более важно, «теперь OpenAI может предоставлять все свои продукты клиентам у любого облачного провайдера». Это означает, что Microsoft теперь не сможет подать в суд на OpenAI из-за того, что та в рамках инвестиционного соглашения с Amazon на $50 млрд пообещала, что AWS получит эксклюзивные права на предоставление нового инструмента OpenAI для создания агентов — Frontier. Согласно первоначальному соглашению, OpenAI запрещалось предлагать Frontier эксклюзивно в AWS (или даже не эксклюзивно, а вообще). Когда OpenAI объявила о сделке с AWS, Microsoft публично опровергла эксклюзивные условия AWS, указав: «Microsoft сохраняет свою эксклюзивную лицензию и доступ к интеллектуальной собственности в отношении моделей и продуктов OpenAI. <…> Azure остаётся эксклюзивным поставщиком облачных услуг для stateless API-вызовов OpenAI. <…> Любые stateless-вызовы API к моделям OpenAI, являющиеся результатом сотрудничества OpenAI с любой третьей стороной, включая Amazon, будут размещаться в Azure. <…> Собственные продукты OpenAI, включая Frontier, будут по-прежнему размещаться в Azure». Microsoft также подчеркнула, что её условия действуют до тех пор, пока OpenAI не получит AGI. Financial Times тогда сообщила, что Microsoft даже рассматривала возможность подачи судебного иска по этому поводу. Комментируя заключение обновлённого соглашения, генеральный директор Amazon Энди Джасси (Andy Jassy), в частности, отметил, что это означает, что модели OpenAI станут доступны клиентам на AWS Bedrock. Хотя эта сделка выгодна для OpenAI, Microsoft тоже в выигрыше. Новое соглашение позволяет Microsoft прекратить выплату доли выручки OpenAI, в то время как OpenAI продолжит выплачивать долю выручки Microsoft до 2030 года, независимо от технологического прогресса OpenAI, хотя теперь эта сумма ограничена. В прошлом квартале Microsoft заработала $7,5 млрд благодаря инвестициям в OpenAI. Также Microsoft продолжает напрямую участвовать в развитии OpenAI в качестве крупного акционера. Владея примерно 27 % коммерческой компании, Microsoft будет иметь финансовую выгоду от роста OpenAI, даже в случае продаж её продуктов в AWS.

27.04.2026 [13:35], Сергей Карасёв

«Гравитон» представил российские серверы на базе Intel Xeon для облаков, виртуализации и ИИ

emerald rapids

gpu

granite rapids

hardware

intel

sapphire rapids

sierra forest

xeon

гравитон

сделано в россии

сервер

Российский разработчик и производитель вычислительной техники «Гравитон» представил шесть серверов на аппаратной платформе Intel, предназначенных для реализации масштабных IT-проектов в сегментах, где наличие техники в реестре Минпромторга РФ не является обязательным требованием. В зависимости от модификации устройства подходят для решения различных задач — от облачных сервисов и виртуализации до нагрузок ИИ и НРС. В частности, дебютировали модели СН2124И5 и СН2127И5 в форм-факторе 4U и 7U соответственно. Они рассчитаны на два процессора Xeon Sapphire Rapids или Xeon Emerald Rapids с TDP до 350 Вт. Поддерживается до 8 Тбайт оперативной памяти DDR5 в виде 32 модулей. У сервера СН2124И5 слоты расширения выполнены по схеме 10 × PCIe 5.0 х16 FHFL + 1 × OCP NIC. Есть 12 фронтальных отсеков для LFF-накопителей NVMe/SATA/SAS и два коннектора M.2 2280/22110 (PCIe 5.0). Возможна установка восьми GPU с энергопотреблением до 350 Вт. В свою очередь, система СН2127И5 имеет аналогичные характеристики, но позволяет использовать до восьми GPU с TDP до 600 Вт. Кроме того, анонсированы серверы СН2122И6 (2U), СН2242И6 (2U), СН2124И6 (4U) и СН2127И6 (7U) с поддержкой двух чипов Xeon 6 (Sierra Forest-SP/Granite Rapids-SP) с показателем TDP до 350 Вт. У первой из этих систем слоты расширения выполнены по схеме 6 × PCIe 5.0 х16 FHFL + 2 × OCP NIC (или 6 × PCIe 5.0 х16 FHFL + 2 × PCIe 5.0 х8 HHHL + 2 × OCP NIC), у трёх других — 10 × PCIe 5.0 х16 FHFL + 1 × OCP NIC. Во всех случаях возможно использование до 8 Тбайт памяти DDR5 (32 модуля).

Источник изображений: «Гравитон» Модель СН2122И6 поддерживает следующие накопители: 12 × LFF NVMe/SATA/SAS во фронтальной части, 2 × SFF SATA/SAS или 4 × SFF NVMe/SATA/SAS, а также 2 × M.2 2280/22110 (PCIe 5.0). Модификации СН2242И6, СН2124И6 и СН2127И6 рассчитаны на накопители в конфигурации 12 × LFF NVMe/SATA/SAS и 2 × M.2 2280/22110 (PCIe 5.0). Две старшие версии поддерживают восемь GPU с TDP до 350 и 600 Вт.  Все серверы располагают контроллером Aspeed AST2600 с выделенным сетевым портом управления 1GbE и воздушной системой охлаждения. Устанавливаются блоки питания мощностью до 3000 Вт с сертификатом 80 Plus Platinum. Заявлена совместимость с Windows и Linux. Гарантия производителя составляет три года.

25.04.2026 [13:55], Сергей Карасёв

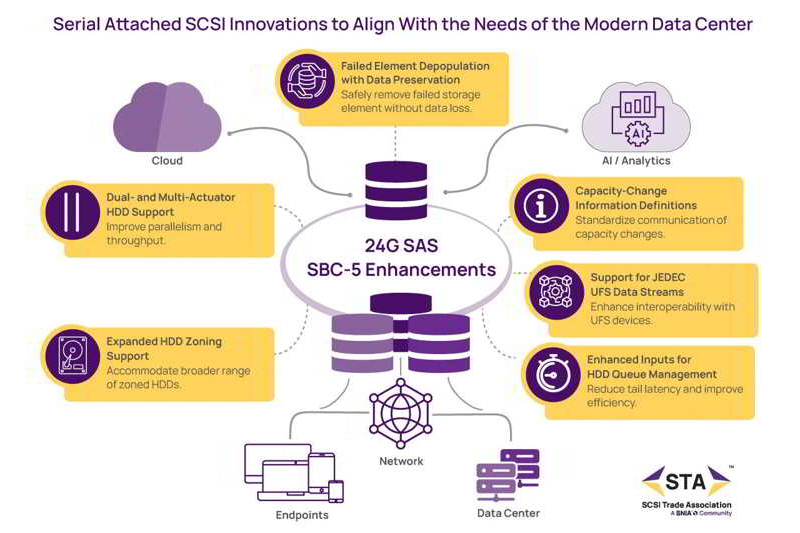

Новая версия набора команд SCSI улучшает масштабируемость и отказоустойчивость СХДТехнический комитет INCITS SCSI (T10), по сообщению ресурса StorageNewsletter, обнародовал пятую версию набора команд SCSI для блочных устройств хранения. Основное внимание в документе SCSI Block Commands — 5 (SBC-5) уделяется улучшению производительности и масштабируемости, а также повышению эффективности и отказоустойчивости сложных СХД. Стандарт является частью экосистемы Serial Attached SCSI (SAS). Одним из ключевых нововведений в SBC-5 стала функция устранения сбойных элементов с сохранением данных. Этот инструмент позволяет игнорировать вышедшую из строя область хранения без переформатирования накопителя и без потери существующей информации. В случае возникновения неполадок устройство предоставляет хосту уменьшенную ёмкость, что позволяет продолжить работу в обычном режиме. Эта функция в настоящее время реализована для HDD, а в перспективе может быть распространена и на SSD.

Источник изображения: StorageNewsletter Ещё одним изменением стала поддержка HDD с двумя и более актуаторами: это позволит повысить пропускную способность в системах с накопителями следующего поколения благодаря многопоточности. Расширены возможности управления очередью привода HDD на стороне хоста: путём оптимизации операций чтения/записи повышается эффективность и снижается задержка. Кроме того, улучшена поддержка зонирования жёстких дисков, выполненных по технологии черепичной магнитной записи (SMR). Усовершенствованы функции определения изменений вместимости в результате технического обслуживания, устранения сбоев или обновления конфигурации. Плюс к этому улучшена совместимость с устройствами Universal Flash Storage (UFS).

25.04.2026 [00:10], Владимир Мироненко

А король-то голый: VDURA уверена, что SSD не вытеснят HDD из ЦОДПо мнению гендиректора VDURA Кена Клаффи (Ken Claffey), рост цен на флеш-память и её дефицит покончили с прогнозами по поводу того, что SSD заменят HDD, подтверждая, что самое верное направление — многоуровневое хранение данных, как у гиперскейлеров, передаёт Blocks & Files. Клаффи в довольно язвительной форме прокомментировал обращение главы поставщика All-Flash СХД Everpure Чарльза Джанкарло (Charles Giancarlo) к клиентам: «Это… тот момент, когда флеш-император прошёлся по городу без одежды». Клаффи исходит из того, что шумиха вокруг неминуемой замены жёстких дисков была неоправданной. В мае 2023 года исполнительный директор Everpure (тогда ещё Pure Storage) предсказал, что после 2028 года HDD больше продаваться не будут из-за затрат на электроэнергию и доступности, а также из-за снижения стоимости NAND в пересчёте на Тбайт. Следует отметить, что с тех пор соотношение цены Гбайт SSD и жёсткого диска выросло с 4–5 раз до 22,6 раза. «Flash-накопитель — подходящий носитель для “горячих” данных, для производительности, для метаданных, для контрольных точек, и так будет всегда. Это критика архитектурного проекта, который ставит все ваши данные на кон против товара, который никогда не будет дешёвым и который люди, создающие проект, никогда не контролировали», — пишет Клаффи. Он считает, что идея Pure о том, что все данные должны храниться на флеш-накопителях, никогда не была верной; «и письмо Everpure, которая повышает цены на 70 % с начала года в дополнение к уже существующей большой разнице, просто сорвало последний фиговый листок. “Флеш-император” голый». Клаффи говорит, что гиперскейлеры никогда не верили в идею полного перехода на флеш-память, имея внутреннее трёхуровневое хранилище: SSD, HDD, LTO. Так устроены Google Colossus, внутренние хранилища Meta✴ и Microsoft Azure, Amazon S3 и большая часть EBS: «Каждый из гиперскейлеров использует программно-определяемую архитектуру со смешанной функциональностью. Достаточный объём NVMe, чтобы справиться с нагрузкой, затем жёсткий диск для всего, что не требует скорости флеш-памяти, и ленточный накопитель для архивов». Клаффи настаивает на том, что флеш-память — это высокопроизводительный носитель данных, а не высокоёмкий, и что ценообразование на инфраструктуру на основе стоимости товара, который вы сами не производите, — это стратегическая ошибка, которую можно совершить только один раз. Никто из поставщиков All-Flash СХД — ни Everpure, ни VAST, ни WEKA — не производит NAND-память, не контролирует её стоимость, поставки и распределение и не определяет её развитие. Флеш-память никогда не была достаточно дешёвой, чтобы заменить жёсткий диск и теперь «не будет дешёвой ещё много лет», говорит Клаффи. Будущее за платформами смешанного типа, с твердотельными накопителями и жёсткими дисками, «разработанными с нуля для использования разнородных носителей как единой системы». «Это архитектурный образец, на котором построены системы хранения данных Google, Meta✴ и Microsoft», а также VDURA, утверждает Клаффи, советуя другим компаниям следовать их примеру.

24.04.2026 [17:11], Сергей Карасёв

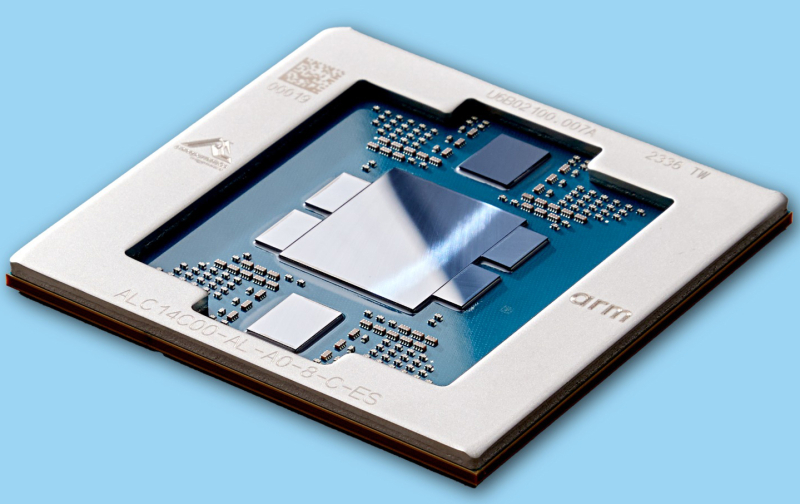

Meta✴ возьмёт на вооружение «десятки миллионов» Arm-ядер AWS Graviton5Компания Meta✴, по сообщению The Register, объявила о расширении сотрудничества с облаком AWS. Речь идёт об использовании Arm-процессоров Graviton5 для поддержания определённых ИИ-нагрузок, в частности, агентных систем. Сама AWS говорит о невероятном спросе на собственные процессоры. Крупным заказчиком является, например, Uber. AWS представила чипы Graviton5 в конце прошлого года. Эти изделия содержат 192 ядра Neoverse V3 (Poseidon), каждое из которых имеет 2 Мбайт кеша L2. Общий объём L3-кеша составляет 192 Мбайт. Присутствуют 12 каналов памяти DDR5-8800. Утверждается, что прирост производительности достигает 25 % по сравнению с процессорами Graviton предыдущего поколения. Meta✴ намерена использовать для своих задач «десятки миллионов» ядер Graviton5. Таким образом, компания станет одним из крупнейших клиентов, применяющих чипы собственной разработки AWS. Руководитель отдела инфраструктуры Meta✴, заявил, что сотрудничество с AWS направлено на диверсификацию вычислительных ресурсов. По его словам, это необходимо в свете реализации масштабных проектов в области ИИ. Ранее Meta✴ объявила о стратегическом партнёрстве с компанией Arm Holdings, которое направлено на «масштабирование эффективности ИИ на каждом уровне вычислений, охватывающем ПО и инфраструктуру ЦОД». В частности, Meta✴ намерена использовать чипы Arm AGI, специально оптимизированные для агентного ИИ. Однако, как уточняет The Register, эти изделия начнут поступать в дата-центры Meta✴ не ранее конца текущего года, поэтому компания пока будет разворачивать соответствующие нагрузки на базе Graviton5 в облаке AWS. Аналитики Counterpoint Research прогнозируют, что к 2029 году на Arm-решения будет приходиться до 90 % рынка серверных ASIC-изделий, ориентированных на ИИ. Между тем сама Meta✴ проектирует фирменные ИИ-ускорители MTIA, которые в зависимости от модификации могут применяться для обучения моделей, инференса и пр.

24.04.2026 [11:05], Сергей Карасёв

Гибридная СХД TrueNAS V160 обеспечивает пропускную способность до 60 Гбайт/сКомпания TrueNAS (ранее — iXsystems) анонсировала гибридную систему хранения V160, предназначенную для задач ИИ, машинного обучения и работы с базами данных. Новинка позволяет формировать платформы с оптимальным сочетанием производительности и стоимости, что важно в условиях стремительного роста цен на SSD. СХД выполнена в форм-факторе 4U. Применены два контроллера TrueNAS пятого поколения на основе неназванного 32-ядерного процессора AMD EPYC с 768 Гбайт оперативной памяти DDR5 каждый. Доступны 24 отсека для NVMe SSD или SAS HDD вместимостью соответственно до 122,8 Тбайт и 26 Тбайт (7200 об/мин). Система позволяет задействовать до 24 Тбайт адаптивного кеша. Заявленная пропускная способность в зависимости от выбранной конфигурации достигает 60 Гбайт/с. Допускается подключение до шести дисковых полок с NVMe SSD или до четырнадцати полок с SAS HDD на 102 отсека, что позволяет создавать конфигурации, насчитывающие более 1400 накопителей. При использовании исключительно SSD суммарная вместимость может достигать 20 Пбайт, в случае HDD — 35 Пбайт. Сетевые порты имеют следующую конфигурацию: 4 × 100/200GbE, 2 × 400GbE, 4 × FC16, 2 × FC32. Реализована поддержка протоколов SMBv2, SMBv3, NFSv3, NFSv4 w/RDMA, iSCSI, iSER, FC, NVMe-oF/RDMA, S3. Питание обеспечивают два блока с сертификатом 80 Plus Titanium, резервированием и возможностью горячей замены. Заявленная доступность СХД превышает 99,999 %. В качестве программной платформы применяется TrueNAS Enterprise 25.10 (используется файловая система OpenZFS). Доступны файловое, блочное и объектное хранилища со сжатием и дедупликацией. Говорится о совместимости с VMware, Proxmox, Hyper-V, Xen, OpenShift, Kubernetes.

24.04.2026 [10:30], Сергей Карасёв

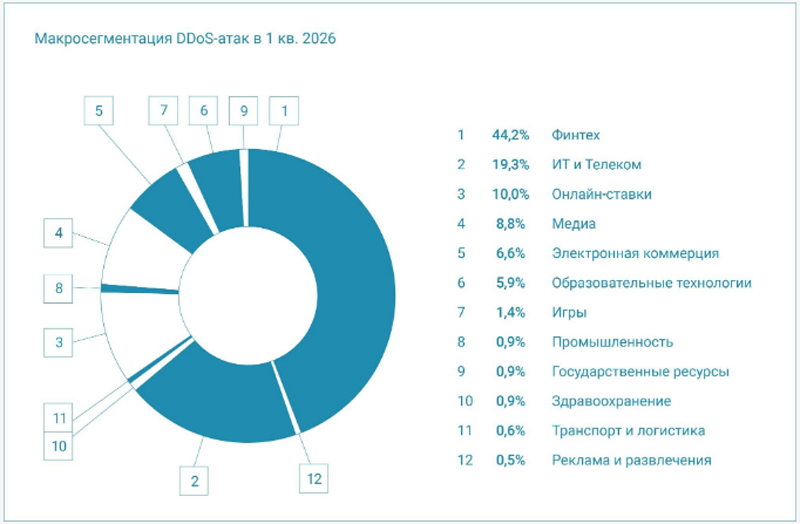

Curator: количество DDoS-атак интенсивностью более 1 Тбит/с выросло в разыКомпания Curator, специализирующаяся на обеспечении доступности интернет-ресурсов и нейтрализации DDoS-атак, фиксирует увеличение интенсивности, сложности и географического охвата кибервторжений. Наиболее часто злоумышленники атакуют финтех-организации, а также предприятия в сферах IT и телекоммуникаций. Отмечается, что самая интенсивная DDoS-атака в I квартале 2026 года была направлена на организацию, чья деятельность связана с онлайн-ставками. В пике она достигала более 2 Тбит/с и около 1 Bpps. При этом фаза высокой интенсивности продолжалась более 40 минут, что нетипично долго для настолько масштабных атак. За это время наблюдались 11 всплесков, причём атакующие пытались адаптировать тактику в режиме реального времени и поддерживать длительное давление на инфраструктуру. В целом, в январе–марте были зафиксированы четыре DDoS-атаки интенсивностью свыше 1 Тбит/с. Для сравнения, в течение аналогичного периода в 2025-м столь мощных нападений не наблюдалось. Авторы исследования также указывают на повышение сложности структуры атак: доля мультивекторных инцидентов выросла с 8,0 % до 10,7 %, а доля нападений, одновременно задействующих сетевой уровень и уровень приложений, увеличилась с 3,6 % до 6,2 %.

Источник изображений: Curator Наибольшее количество DDoS-атак в I квартале 2026 года было направлено на сегменты «Финтех» (44,2 %), «ИТ и Телеком» (19,3 %) и «Онлайн-ставки» (10,0 %): суммарно на эти три сектора пришлось почти три четверти всех зафиксированных киберкампаний. Далее идут «Медиа» (8,8 %), «Электронная коммерция» (6,6 %), «Образовательные технологии» (5,9 %) и «Игры» (1,4 %). В число микросегментов, которые чаще всего подвергались атакам, вошли «Банки» (22,8 %), «Платежные системы» (15,9 %), «Онлайн-букмекеры» (10,0 %), «Хостинговые платформы» (6,8 %) и «Системные интеграторы» (6,4 %). Особо выделяется стремительный рост крупнейшего DDoS-ботнета, который был обнаружен в марте 2025 года: за год количество входящих в его состав зараженных устройств подскочило с 1,33 млн до 13,5 млн. При этом изменилась география ботнета. Если год назад в нём преобладали устройства из Бразилии (51,1 %), то сейчас первое место занимают США (16,0 %). За ними следуют Бразилия (13,6 %), Индия (6,5 %), Великобритания (4,8 %) и Турция (3,2 %). Таким образом, операторы ботнета не только активно расширяют его за счёт новых заражённых устройств, но и диверсифицируют географию, из-за чего геоблокировки становятся неэффективными.  Самая продолжительная бот-атака в I квартале 2026 года длилась более двух недель: за это время были сгенерированы свыше 178 млн вредоносных запросов на ресурсы компании-жертвы, которая ведёт деятельность в области электронной коммерции. «К сожалению, терабитные атаки на наших глазах становятся обычной практикой — только в I квартале этого года на своей инфраструктуре мы зафиксировали несколько таких случаев. Картина такова: крупный ботнет за год увеличился на порядок, атаки стали продолжительнее и сложнее. В таких условиях вопрос уже не в том, случится ли инцидент, а в том, как быстро бизнес сможет его пережить без остановки операций. Киберустойчивость — это не альтернатива защите, это её логичное продолжение, и мы видим, что способность работать даже в момент атаки становится для бизнеса не опцией, а условием выживания», — отметил Дмитрий Ткачев, генеральный директор Curator.

23.04.2026 [11:38], Сергей Карасёв

Selectel представил российский «AI-Сервер» с поддержкой до 16 GPUРоссийский провайдер облачной инфраструктуры Selectel анонсировал «AI-Сервер» — высокопроизводительную систему формата 8U, ориентированную на ресурсоёмкие нагрузки, такие как обучение ИИ-моделей, инференс, рендеринг, финансовое моделирование, виртуальные рабочие столы и аналитика в реальном времени. В состав платформы входят плата Selectel SSE-MB-201 и специализированное шасси SSECH-812. Задействованы два процессора Intel Xeon 6 6500/6700 поколения Granite Rapids-SP. Поддерживается до 8 Тбайт оперативной памяти DDR5-6400 в виде 32 модулей. Могут быть установлены 12 накопителей с интерфейсом NVMe/SAS/SATA, а также два SSD типоразмера M.2 с интерфейсом PCIe 5.0. Упомянуты контроллер BMC AST2600, модуль TPM 2.0, 176 линий PCIe (PCIe 5.0 / CXL и OCP 3.0) и два сетевых порта 1GbE. Сервер допускает монтаж до 16 ускорителей на базе GPU формата FHFL двойной ширины или до восьми ускорителей FHFL тройной ширины. В частности, могут применяться карты NVIDIA H100, H200, RTX Pro 6000 Blackwell Server Edition и др. Питание обеспечивают семь блоков мощностью 2000 Вт с сертификатом 80 Plus Platinum. Selectel разрабатывает BIOS и BMC собственными силами: это, как утверждается, даёт полный контроль над процессом и возможность оперативно вносить изменения и дорабатывать функциональность в соответствии с запросами заказчиков. Подчёркивается, что усиленные подсистемы питания и охлаждения рассчитаны на высокую плотность ускорителей и длительную работу под нагрузкой. Конструкция упрощает обслуживание и эксплуатацию сервера в ЦОД. «Запуск нового AI-сервера является частью стратегии Selectel по формированию собственного портфеля серверных решений, включая специализированные инфраструктурные продукты для задач в сфере ИИ. Новая аппаратная платформа обеспечит стабильную, быструю и предсказуемую работу AI-моделей в реальных условиях с полным контролем над данными и производительностью», — говорит компания.

23.04.2026 [09:09], Руслан Авдеев

Войн нет, энергии хватает, народ дружелюбный: Scala Data Centers призвала присмотреться к ИИ ЦОД в БразилииБразилия стремится привлечь инвестиции ИИ-бизнесов, полагаясь на геополитические преимущества региона. В частности, местный строитель ЦОД Scala Data Centers предлагает свои объекты иностранным бизнесам, в первую очередь из США и Китая, сообщает Datacenter Knowledge. В конце 2026 года должно начаться строительство т.н. Scala AI City, проект уже одобрен властями. Поддерживаемая DigitalBridge Group компания начала переговоры с техногигантами из США и КНР, желая привлечь в «ИИ-суперкампус» размером с город крупного клиента. Как утверждает Scala, нестабильность на Ближнем Востоке подчёркивает привлекательность бразильского рынка, изолированного от зон крупных конфликтов. По данным Scala, первый этап строительства обойдётся приблизительно в $500 млн, которые пойдёт непосредственно на инфраструктуру. В несколько раз больше потратит сам арендатор — облачный провайдер на ИИ-оборудование. Предполагается, что американские и китайские провайдеры могли бы использовать в Scala AI City отдельные ЦОД, не рискуя безопасностью своих данных. Компания уже получила разрешение на получение до 5 ГВт электроэнергии в окрестностях Порту-Алегри (Porto Alegre) в штате Риу-Гранди-ду-Сул — приблизительно столько потребляет Сан-Паулу или Лондон.

Источник изображения: Scala Data Centers Наличие в Южной Америке многочисленных возобновляемых источников энергии и оптоволоконных магистралей, а также энергосеть с многочисленными перекрёстными подключениями делают Бразилию оптимальным региональным игроком в контексте бума ИИ ЦОД. Удары беспилотников по дата-центрам в ОАЭ и Бахрейне в целом заставляют компании переосмысливать принципы размещения в мире критической инфраструктуры. Власти штатов и муниципалитетов Бразилии всеми силами стремятся привлечь инвестиции в ЦОД, это должно стимулировать местную экономику и способствовать созданию технологических центров. Для сравнения, во многих штатах США бизнес и политики сталкиваются с недовольством общественности — иногда доходит до стрельбы и изгнания чиновников. Scala Data Centers была сформирована DigitalBridge в 2020 году после покупки ЦОД-активов у бразильской UOL Diveo. Японская SoftBank Group купила DigitalBridge приблизительно за $4 млрд в 2025 году. В текущем году компания планирует расширить и другие проекты ЦОД в Бразилии. Так, кампус в Сан-Паулу, куда уже инвестировано порядка R$12 млрд ($2,4 млрд), будет расширен до 600 МВт. |

|