Материалы по тегу: kubernetes

|

13.05.2026 [00:40], Владимир Мироненко

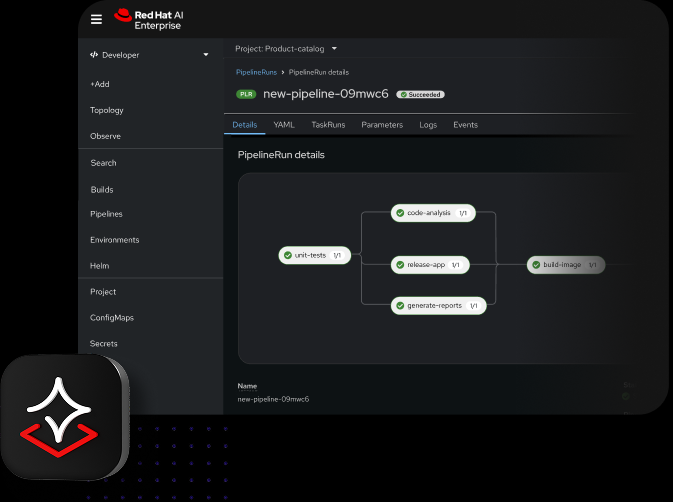

Red Hat анонсировала интегрированную ИИ-платформу Red Hat AI 3.4Red Hat представила Red Hat AI 3.4, обновлённую версию корпоративной ИИ-платформы, разработанную для поддержки крупномасштабного инференса и развёртывания агентного ИИ в гибридных облачных средах. В качестве комплексной платформы Red Hat AI 3.4 предлагает архитектурную основу и операционные инструменты, необходимые для масштабирования моделей и рабочих процессов агентов в гибридном облаке. Стратегия Red Hat в области ИИ разделена на четыре ключевых направления, заявил Джо Фернандес (Joe Fernandes), вице-президент и генеральный директор Red Hat AI. «Во-первых, мы помогаем клиентам быстро, гибко и эффективно выполнять инференс, предоставляя модели в их среде, — передаёт SiliconANGLE. — Во-вторых, мы подключаем их корпоративные данные к этим моделям и агентам. В-третьих, мы помогаем им ускорить развёртывание и управление агентами в гибридной облачной среде. В-четвёртых, мы объединяем всё это на нашей интегрированной ИИ-платформе, позволяя им запускать любую модель в любом агенте на любом оборудовании и в любой облачной среде». Как отметила компания, ключевым элементом этого релиза является предоставление модели как услуги (MaaS), которое обеспечивает единый управляемый интерфейс для разработчиков, позволяющий получать доступ к тщательно отобранным моделям, а администраторам — отслеживать их использование и применять политики. Разработчики получают доступ к моделям через стандартные OpenAI-совместимые API. Таким образом, единое управление применяется как к внутренним, так и к внешним моделям. А инструменты AutoRAG и AutoML автоматизируют сложные задачи ИИ, начиная с выбора наиболее эффективных стратегий извлечения данных для конкретных наборов и заканчивая построением и оптимизацией моделей. В основе системы лежит открытая библиотека vLLM. Её дополняет Kubernetes-нативный стек для инференса llm-d. Поддержка спекулятивного декодирования, которая в этом релизе стала общедоступной, повышает скорость ответа в два-три раза с минимальным влиянием на его качество и снижает стоимость взаимодействия. Кроме того, vLLM теперь поддерживает работу на CPU, что актуально для небольших языковых моделей. Для управления инструментами для агентов Red Hat представляет каталог серверов MCP и связанный с ним шлюз MCP. Новый инструментарий AgentOps даёт возможность управления агентами в масштабе, независимо от используемой платформы, на протяжении всего их жизненного цикла. Это включает в себя интегрированную трассировку вызовов LLM, вызовов инструментов и этапов рассуждений, а также управление криптографической идентификацией через SPIFFE/SPIRE. Последний позволяет организациям заменять статические, жёстко закодированные ключи кратковременными токенами. Это поддерживает операции с минимальными привилегиями для автономных агентов на всех уровнях стека и помогает подтвердить, что действия агентов связаны с проверенной личностью. Для обеспечения интеграции корпоративных данных с моделями и агентами Red Hat AI 3.4 представляет управление с помощью промптов и центр оценки точности, качества и безопасности моделей и агентов. Последний не зависит от фреймворков и заменяет разрозненные методы тестирования единым интегрированным подходом. Prompt Lab and Registry, централизованное хранилище промптов в виде полноценных информационных ресурсов, предоставляет разработчикам и администраторам единый источник достоверной информации о входных данных, управляющих моделями и агентами.

Источник изображения: Red Hat Новые возможности трассировки построены на основе MLflow. Интеграция MLflow обеспечивает прозрачность работы агента, позволяя осуществлять сквозную трассировку вызовов LLM, этапов рассуждений, запуска инструментов, ответов модели и использования токенов через OpenTelemetry. Это создаёт прозрачный журнал аудита для всего жизненного цикла подсказок, эмбеддингов и конфигураций RAG для поддержки отладки и аудита. MLflow также обеспечивает интегрированное отслеживание экспериментов и управление артефактами для сценариев использования генеративного ИИ и прогнозного ИИ. Платформа Red Hat AI позволяет пользователям проверять безопасность моделей и агентов с помощью автоматизированного сканирования на наличие угроз, которое теперь интегрировано непосредственно в цикл разработки. Используются инструменты Chatterbox Labs и Garak. Платформа проверяет модели и агентных систем на наличие таких рисков как взлом, промпт-инъекций и предвзятость, в сочетании с NVIDIA NeMo Guardrails для обеспечения безопасности во время выполнения. Сообщается, что Red Hat AI 3.4 изначально поддерживает ускорители NVIDIA Blackwell и AMD Instinct MI325X. Расширяя эту унифицированную архитектуру платформы для работы непосредственно в управляемых облаках сторонних разработчиков, в том числе посредством Red Hat AI Inference в IBM Cloud, Red Hat обеспечивает операционную согласованность на широком спектре оборудования и облачных провайдеров.

12.05.2026 [15:34], Владимир Мироненко

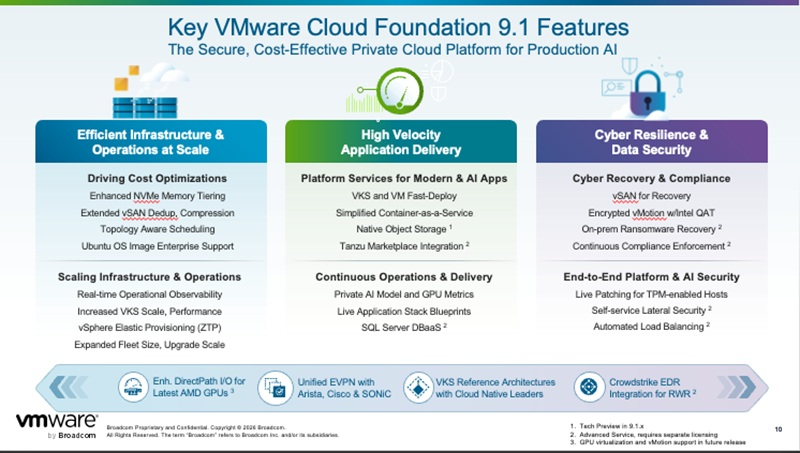

Broadcom обещает, что VMware Cloud Foundation 9.1 позволит значительно снизить расходы на ИИ-инфраструктуру

broadcom

kubernetes

software

vmware

виртуализация

ии

информационная безопасность

конфиденциальность

частное облако

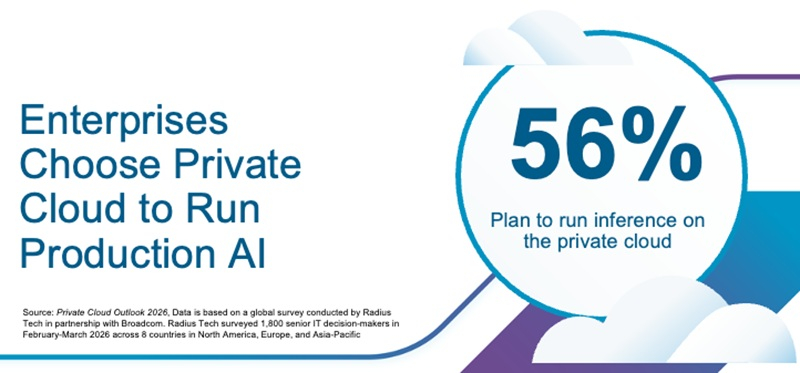

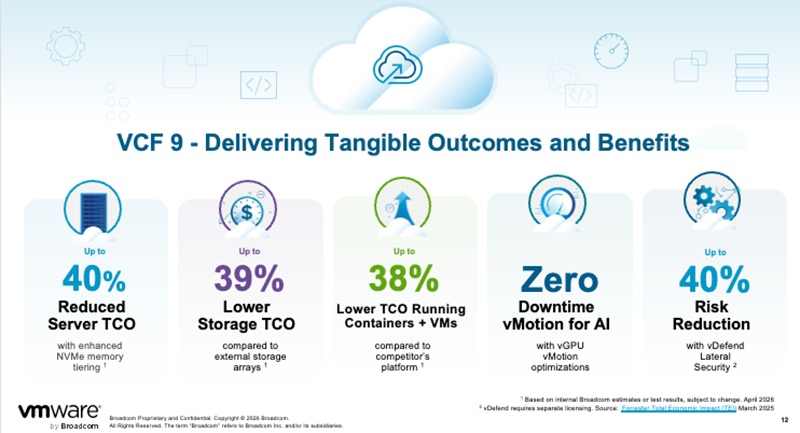

Компания Broadcom анонсировала VMware Cloud Foundation 9.1, позиционируя платформу как основу для частного облака, оптимизированную для ИИ-нагрузок ИИ и Kubernetes, с интегрированной безопасностью и поддержкой смешанной вычислительной инфраструктуры на базе AMD, Intel и NVIDIA. Broadcom отметила, что VCF 9.1 обеспечит предприятиям при запуске производственных рабочих нагрузок, включая инференс и агентный ИИ, ряд преимуществ. В частности, VCF 9.1 обеспечит снижение затрат на серверы до 40 % благодаря интеллектуальному многоуровневому распределению памяти. Эффективность хранения данных также повышается благодаря усовершенствованным методам сжатия и дедупликации в конвейерах обработки данных ИИ, что снижает общую стоимость владения до 39 %. Использование платформы позволяет сократить эксплуатационные расходы Kubernetes до 46 % при одновременном повышении масштабируемости и скорости развёртывания. Преимущества платформы также включают четырёхкратное ускорение обновления кластеров и удвоение мощности парка серверов, что позволяет предприятиям быстрее масштабировать инфраструктуру ИИ в распределённых средах. В VCF 9.1 сделан акцент на поддержке открытой экосистемы. Обеспечены выбор нескольких GPU AMD и NVIDIA, поддержка CPU AMD и Intel, а также совместимость со стандартными сетевыми технологиями, такими как EVPN и VXLAN, и с универсальной облачной сетью Arista Universal Cloud Network. Этот подход позволяет предприятиям комбинировать оборудование в зависимости от требований к рабочей нагрузке и доступности, что в условиях дефицита является важным фактором, отметил ресурс Storagereview.

Источник изображений: VMware Большое внимание в VCF 9.1 уделено автоматизации, благодаря которой обеспечивается удвоение возможностей управление — для 5 тыс. хостов и в четыре раза более быстрое обновление кластеров в распределённых и изолированных средах. Также была улучшена поддержка многопользовательского режима, позволяющая изолировать рабочие нагрузки ИИ между командами или клиентами на общей инфраструктуре со строгими ограничениями безопасности, максимизируя использование дорогостоящих ресурсов GPU и CPU, одновременно поддерживая суверенитет данных для конфиденциальных моделей. Это особенно актуально для поставщиков услуг и крупных предприятий, консолидирующих ИИ-инфраструктуру. Платформа устраняет необходимость во внешних устройствах для конечных точек ИИ-инференса и агентных приложений за счёт интеграции виртуализированных служб балансировки нагрузки и безопасности через VMware Avi Load Balancer и vDefend, позволяя снизить капитальные затраты, сохранив при этом отказоустойчивость приложений и автоматизацию жизненного цикла.  VCF 9.1 получила встроенную систему безопасности на уровне инфраструктуры для защиты рабочих нагрузок ИИ, проприетарных моделей и данных для обучения от гипервизора до приложения. Благодаря сегментации на основе принципа нулевого доверия (Zero Trust), суверенному восстановлению и непрерывному обновлению без дополнительных инструментов VCF обеспечивает уровень безопасности, необходимый для развёртывания ИИ в продуктовой среде. Система поддерживает восстановление после атак программ-вымогателей в локальной среде, обеспечивающее изолированные среды восстановления и интегрированные инструменты проверки, включая поддержку CrowdStrike Falcon Endpoint Security, защищающие ИИ-модели и данные от трансграничного перемещения, без высоких затрат на обеспечение пропускной способности во время восстановления в кризисных ситуациях.  Функции непрерывного соответствия автоматизируют мониторинг и устранение неполадок в соответствии с определёнными политиками, помогая организациям поддерживать готовность к аудиту без дополнительных инструментов. Обновление в режиме реального времени дополнительно снижает операционные риски, позволяя в большинстве случаев обновлять систему без простоев, поддерживая постоянно работающие ИИ-сервисы. Система безопасности с нулевым доверием, расширяющая защиту распределённых IDS/IPS на рабочие нагрузки Kubernetes AI, обеспечивает скорость проверки угроз до 9 Тбит/с для распределённого инференса и в пять раз более высокую идентификацию приложений для частных облачных и интернет-приложений. Как отметил Storagereview, с помощью VCF 9.1 компания пытается перепозиционировать VMware как жизнеспособную платформу для корпоративного ИИ. Акцент на частном облаке, интегрированной безопасности и унифицированных операциях между виртуальными машинами, контейнерами и GPU соответствует запросам многих крупных организаций, которые приближают рабочие нагрузки инференса к своим данным. Вместе с тем современные распределённые конвейеры ИИ строятся на основе архитектур, ориентированных на Kubernetes, со всё более модульными инфраструктурными решениями, которые отдают приоритет гибкости и прямому доступу к ускоренным вычислениям. В таких средах VMware обычно не является плоскостью управления, а во многих случаях становится дополнительным уровнем, а не основой. Кроме того, хотя Broadcom позиционирует VCF 9.1 как способ сократить расходы на инфраструктуру за счёт повышения эффективности, сохраняются обоснованные опасения корпоративных клиентов по поводу условий лицензирования VMware и общей стоимости владения.

06.05.2026 [14:06], Руслан Авдеев

Iren купит Mirantis за $625 млн, чтобы расширить свой ИИ-стекНеооблачная Iren Limited подписала соглашение о покупке компании Mirantis в рамках сделки, предусматривающей оплату обыкновенными акциями на сумму $625 млн. Это позволит добавить облачной платформе компетенции по оркестрации на основе Kubernetes, ПО для облачной инфраструктуры и сервисы корпоративной поддержки, сообщает Converge! Digest. Сделка даст Iren возможность расширить бизнес за пределы предоставления лишь масштабной инфраструктуры ИИ-ускорителей и перейти к развёртыванию ИИ с оркестрацией, мониторингом и управлением жизненным циклом рабочих нагрузок. После закрытия сделки Mirantis будет работать как самостоятельная дочерняя структура и продолжит поддержку существующих клиентов. Iren заявила, что покупка усилит ключевые векторы развития её платформы AI Cloud: от развёртывания и мониторинга до поддержки клиентов и доступа к рынку. На сегодня Mirantis обеспечит приток более 1,5 тыс. корпоративных клиентов и богатый опыт работы с Kubernetes, OpenStack и контейнеризированной инфраструктурой. Кроме того, у Mirantis имеется собственная платформа k0rdent AI для управления ИИ-инфраструктурой на физических и виртуальных серверах и в средах Kubernetes. Также компания — один из основателей инициативы NVIDIA AI Cloud Ready и разработчик ПО в её рамках. В результате сделки вертикально интегрированная модель Iren, включающая электроснабжение, земельные участки, ЦОД и кластеры ИИ-ускорителей, будет дополнена опытом Mirantis в сфере ПО и корпоративных операций.

Источник изображения: Mirantis Неооблачные провайдеры вроде Iren, CoreWeave и гиперскейлеры всё чаще нуждаются не только в масштабной физической инфраструктуре, но и оркестрации, мониторинге и управлении жизненным циклом для того, чтобы выделиться на рынке не только наличием ИИ-ускорителей. Покупка Mirantis позволит конкурировать за сложные многопользовательские ИИ-нагрузки. В марте сообщалось, что Iren объявила о заключении соглашения о покупке более 50 тыс. ускорителей NVIDIA B300. Эта сделка позволит компании расширить парк ускорителей примерно до 150 тыс. ед., что к концу 2026 года обеспечит доход от облачных ИИ-вычислений в размере свыше $3,7 млрд.

11.02.2026 [15:34], Андрей Крупин

MWS Cloud запустила сервис Managed Kubernetes в промышленную эксплуатациюКомпания MWS Cloud (входит в МТС Web Services) сообщила о запуске Managed Kubernetes — управляемого PaaS-сервиса для развёртывания и эксплуатации кластеров Kubernetes в облаке. Managed Kubernetes позволяет создавать кластеры Kubernetes в облачном окружении MWS Cloud Platform и берёт на себя большую часть работ по обслуживанию кластеров, в том числе: обновление операционных систем и программного обеспечения, обеспечение работоспособности и безопасности контейнерной инфраструктуры, мониторинг управляющих компонентов. Решение также предоставляет роли для управления доступом к кластерам и возможность интеграции с другими инструментами MWS Cloud Platform — например, с Artifact Registry для работы с образами и Helm-чартами. Сервис поддерживает Kubernetes версии 1.34.x.

Источник изображения: Luke Peters / unsplash.com В рамках сервиса также доступны автоматическое масштабирование рабочих узлов, гибкая настройка ресурсов, сервисные окна для плановых операций, интеграция с IAM и сетевой инфраструктурой облака. Поддерживаются подключения постоянных томов хранения данных с использованием CSI (Container Storage Interface) и управление сетевой балансировкой на уровне кластера при помощи Cloud Controller Manager (CCM). Managed Kubernetes подходит для использования в широком спектре отраслей — от информационных технологий и e‑commerce до финансового сектора, медиа и промышленности. Развёртывание кластера занимает несколько минут и доступно в режиме self‑service через консоль MWS Cloud Platform, а также с использованием CLI и API.

16.01.2026 [16:26], Владимир Мироненко

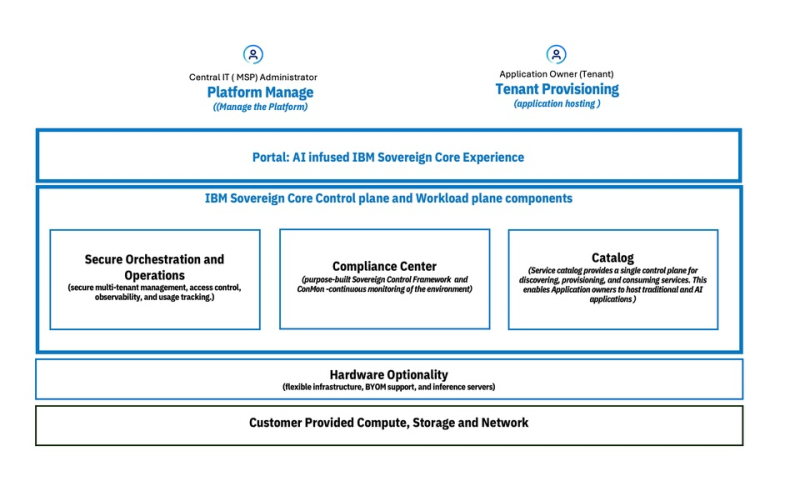

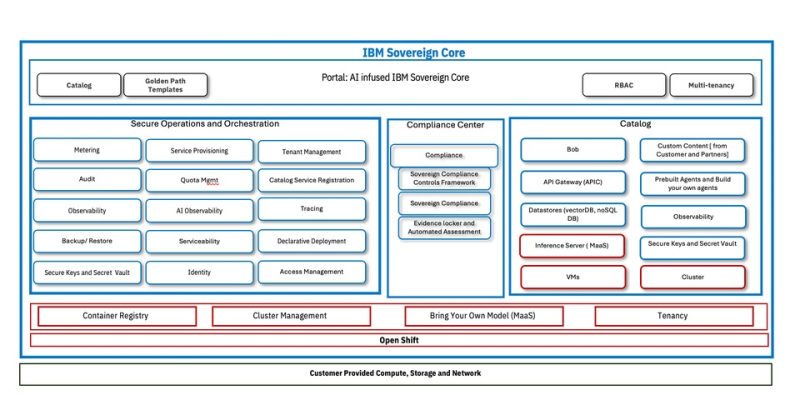

IBM представила облачную платформу IBM Sovereign Core для обеспечения непрерывного и проверяемого цифрового суверенитетаКомпания IBM представила программную платформу IBM Sovereign Core, разработанную для обеспечения более полного контроля обработки ИИ-приложений и облачных рабочих нагрузок на фоне дальнейшего ужесточения требований регулирующих органов к обеспечению цифрового суверенитета. IBM отметила, что цифровой суверенитет касается не только места размещения данных. Он также включает управление и контроль над технологической средой, контроль доступа и управление данными, управление исполнением рабочих нагрузок и юрисдикцию работы ИИ-моделей. Компания заявила, что организации при разработке инноваций испытывают всё большее давление в плане необходимости соответствия требованиям регуляторов, контроля операционной среды и хранения конфиденциальных данных в пределах национальных или региональных границ. IBM привела данные прогноза Gartner, согласно которому к 2030 году у более 75 % всех предприятий будет стратегия обеспечения цифрового суверенитета. IBM Sovereign Core — первое, по словам компании, в отрасли ПО с поддержкой суверенитета, предназначенное для создания, развёртывания и управления облачными и ИИ-нагрузками под собственным контролем организации в выбранных юрисдикциях. Оно базируется на открытых решениях Red Hat и, в отличие от предложений других провайдеров, предлагающих суверенные сервисы в виде наложения на существующие архитектуры политик или управляемых ими механизмов, предлагает суверенитет как встроенную функцию. Сачин Прасад (Sachin Prasad), программный директор по управлению продуктами в области ИИ и данных в IBM подчеркнул в интервью SiliconANGLE, что ИИ не относится к второстепенным элементам, он должен быть встроен в структуру. IBM сообщила, что при разработке IBM Sovereign Core основывалась на трёх фундаментальных принципах, которые формируют ПО от начала до конца. Во-первых, суверенитет — это возможность платформы, и он должен быть доказуемым. В IBM Sovereign Core суверенитет обеспечивается архитектурно, а не договорно. Управление основано не на наложении политик на существующие решения вендора, а на автоматизированных постоянно действующем контроле управления, принадлежащем пользователю. Платформа базируется на технологиях Red Hat OpenShift с изоляцией ПО, работающим как SaaS, но полностью находящимся под контролем компании и местных властей. Идентификация, ключи шифрования, журналы, телеметрия и аудиторские данные остаются полностью в пределах суверенных границ. Возможности постоянного соответствия требованиям встроены непосредственно в платформу, позволяя организациям по запросу получать готовые к проверке регуляторами доказательства суверенности. Во-вторых, платформа обеспечивает и суверенитет ИИ. В пределах суверенных границ организации могут развёртывать кластеры на базе CPU/GPU, использовать утверждённые открытые или проприетарные модели и управлять доступом к моделям, инструментам и источникам знаний через контролируемые шлюзы. Инференс и агенты работают локально, без экспорта данных или телеметрии внешним поставщикам. Что не менее важно, IBM Sovereign Core обеспечивает суверенитет во время выполнения, а не только во время конфигурации. Идентификация, доступ, использование моделей и активность постоянно отслеживаются и записываются, создавая чёткий аудиторский след для ИИ-систем, работающих в регулируемых областях. И в-третьих, суверенитет реализован не в ущерб производительности и масштабируемости. IBM Sovereign Core можно быстро развернуть и управлять тысячами ядер и сотнями узлов с различными требованиями и средствами контроля суверенности из единого центра. Автоматическая настройка идентификации, безопасности и соответствия требованиям заложена с самого начала, а самообслуживание для предоставления ресурсов CPU, GPU, ВМ и сред ИИ-инференса обеспечивает повторяемое развёртывание в корпоративных и многопользовательских моделях без ущерба для контроля — локально, в облаке или в партнёрских средах поставщиков услуг, где требуется лишь поддержка Kubernetes. Эта гибкость, по словам IBM, позволяет клиентам перемещать рабочие нагрузки не только между регионами, но и между различными инфраструктурами, что в сочетании с возможностью устанавливать уникальные параметры управления, позволит адаптироваться по мере изменения нормативных требований с развитием ИИ-технологий. Благодаря проверяемому аудиторскому следу, документирующему непрерывное соответствие требованиям, компания сможет в любой момент продемонстрировать соответствие нормам в области суверенитета и, таким образом, сократить расходы, связанные с аудитом. «Соответствие требованиям и аудит обходятся дорого с точки зрения времени и ресурсов, и ситуация только ухудшается», — сообщил главный аналитик Moor Insights and Strategy Джейсон Андерсен (Jason Andersen). «Всё, что упростит и оптимизирует этот процесс, принесёт большую пользу IT-специалистам и поставщикам управляемых услуг», — добавил он. Андерсен также отметил, что хотя на рынке предлагаются облачные решения для обеспечения суверенитета от AWS, Google и Microsoft, он «ещё не увидел ничего, созданного для гибридных сред, подобного тому, что предлагает IBM». По словам Прасада, при развёртывании новой платформы IBM первоначально сотрудничает с европейскими поставщиками услуг, прежде чем расширить сотрудничество на более широкий круг партнёров. Такой подход призван получить обратную связь, но не ограничит распространение. Он добавил, что IBM рассчитывает продавать пакет напрямую: «Он будет продаваться так же, как и любой другой продукт». Компания сообщила, что начиная с февраля, IBM Sovereign Core будет доступна в режиме предварительного тестирования, а выход полной общедоступной версии запланирован на середину 2026 года.

15.11.2025 [16:14], Владимир Мироненко

Broadcom упростила сертификацию оборудования для VCF для ускорения внедрения современных частных облаковBroadcom объявила о значительном обновлении VMware Cloud Foundation (VCF) 9.0 с целью предоставления компаниям более широкого выбора в области оборудования, сетевых решений и open source ПО с открытым исходным кодом. По словам компании, VCF представляет собой частную облачную платформу, открытую и адаптируемую ко всем уровням инфраструктуры. Изменения формируют открытую, гибкую экосистему, которая позволяет клиентам создавать, подключать, защищать и развивать современные частные облака в предпочитаемых ЦОД, периферийных локациях и хостинговых средах. VCF 9.0 теперь сочетает в себе эффективность облачной операционной модели с локальным управлением, расширяя совместимость с решениями разных провайдеров, возможности использования ИИ и преимущества в совокупной стоимости владения, отметил ресурс StorageReview.com. «Создавая открытую экосистему VCF, мы даём компаниям возможность создавать современные частные облака, соответствующие их стратегическим потребностям, гарантируя, что они смогут использовать технологии, необходимые для их уникальных сред», — заявил Пол Тернер (Paul Turner), директор по продуктам подразделения VMware Cloud Foundation компании Broadcom. Обновление включает расширение компанией программы открытой сертификации оборудования, чтобы расширить возможности OEM- и ODM-партнёров. В частности, программа VCF AI ReadyNodes (готовые к работе с VCF ИИ-узлы) призвана упростить процесс сертификации ИИ-узлов, позволяя заказчикам внедрять CPU, GPU и ускорители следующего поколения по мере их появления. VCF AI ReadyNodes будет использоваться для сертификации серверов, прошедших предварительную квалификацию для обучения ИИ-моделей и инференса. Сертифицированные согласно VCF AI ReadyNodes узлы представляют собой предварительно настроенное оборудование с ПО VMware с предсказуемой производительностью, простым управлением и гибкой виртуализацией со сквозным доступом к GPU, а также включают сетевые функции для минимизации задержки и масштабирования пропускной способности. Такие узлы снижают риски проблем при интеграции и сокращают время выхода продукта на рынок, предлагая предварительно проверенные ПАК для обучения и инференса. Они поддерживают плавное обновление через SDDC Manager, обеспечивая синхронизацию обновлений драйверов GPU, прошивок сетевых карт и VMware ESXi для поддержания стабильности в производственных ИИ-средах. Supermicro станет одним из первых OEM-партнёров, сертифицировавших свои серверы в рамках AI ReadyNode. Broadcom также расширила программу VCF ReadyNode, предоставив ODM-партнёрам возможность самостоятельно сертифицировать готовые узлы в рамках программы Broadcom Technology Alliance (TAP). Все сертифицированные системы будут проверены на полную совместимость с VMware Cloud Foundation с последовательным управлением жизненным циклом VCF. Это расширяет возможности поиска поставщиков и сокращает время выполнения заказов. Для узлов для периферийных вычислений компания предлагает вариант VCF Edge, ориентированный на надёжные и компактные серверы для промышленных, оборонных, розничных и др. нужд. Broadcom также сообщила о новой стратегии, направленной на унификацию сетевых инфраструктур и упрощение сетевых операций в современном частном облаке с помощью стандартизированных сетей с EVPN и BGP. Клиенты получат преимущества от защиты на уровне VPC, согласованных сетевых операций, маршрутизации и видимости во всех доменах VCF Networking (NSX) и сетевых решениях сторонних производителей, обеспечивающих унифицированные операции с помощью комплексной автоматизации. Этот подход согласует VCF со стратегией Cisco Nexus One Fabric, обеспечивая более согласованные и надёжные результаты работы для совместных клиентов Cisco и VMware. Cisco Nexus One Fabric расширяет возможности VCF, предоставляя современную, масштабируемую и автоматизированную сетевую архитектуру на основе VXLAN EVPN. VCF Networking (NSX) также теперь поддерживает популярную открытую NOS SONiC. SONiC обеспечивает клиентам снижение затрат за счёт использования стандартного коммутационного оборудования разных производителей, снижая как капитальные, так и эксплуатационные расходы. Кроме того, Broadcom продолжает участвовать в сообществе Kubernetes, являясь одним из пяти крупнейших участников CNCF (Cloud Native Computing Foundation) и работая над проектами Antrea, Cluster API, ContainerD, Contour, etcd, Harbor и т.д. Broadcom объявила, что VMware vSphere Kubernetes Service (VKS) был сертифицирован CNCF как платформа, соответствующая требованиям Kubernetes AI Conformant Platform. Как сообщает The Register, эта недавно запущенная программа соответствия призвана дать клиентам уверенность в том, что контейнерная платформа может надёжно выполнять реальные рабочие нагрузки ИИ. Программа определяет минимальный набор возможностей и конфигураций, необходимых для запуска широко распространенных фреймворков ИИ и машинного обучения в инфраструктуре Kubernetes.

31.10.2025 [01:02], Андрей Крупин

Positive Technologies выпустила Runtime Radar — Open Source-решение для защиты контейнеров

kubernetes

open source

positive technologies

software

информационная безопасность

контейнеризация

сделано в россии

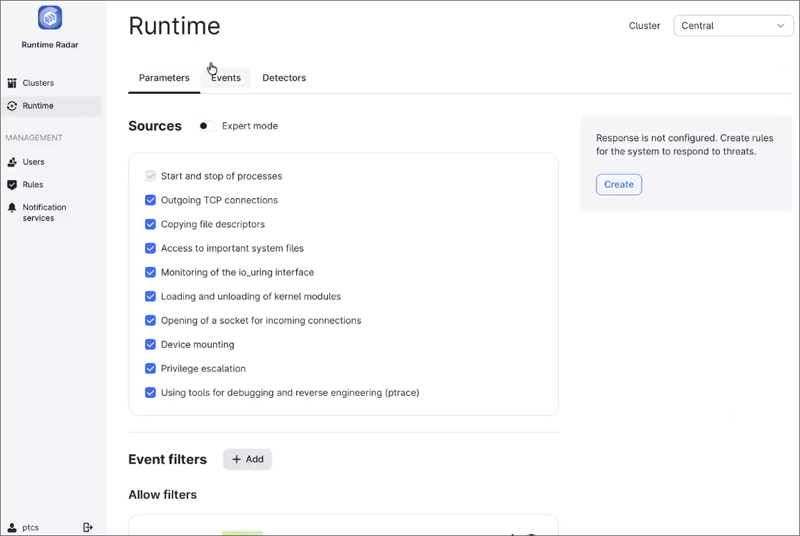

Компания Positive Technologies опубликовала на площадке GitHub открытое решение Runtime Radar, предназначенное для мониторинга безопасности и реагирования на инциденты в контейнерных средах. Продукт предназначен для работы с платформой Kubernetes в среде Linux. В основу Runtime Radar положены технологии eBPF и Tetragon для глубокого анализа событий, связанных с работой контейнеров, — процессов, сетевых соединений и изменений прав доступа, — что позволяет немедленно обнаруживать подозрительную активность. Инструмент предлагает централизованное управление всей инфраструктурой, включая работу с несколькими кластерами, и настраивается с помощью готовых политик безопасности. Для расследования инцидентов предусмотрен графический интерфейс, а для интеграции в существующие процессы мониторинга поддерживаются стандартные протоколы и механизмы, такие как syslog, SMTP и webhook.

Пользовательский интерфейс Runtime Radar (источник изображения: runtimeradar.com) По словам Positive Technologies, контейнерные технологии, в первую очередь платформа Kubernetes, стали отраслевым стандартом для развёртывания приложений и управления ими. Их повсеместное распространение сделало среду выполнения новой целью для атак злоумышленников. Существующие меры защиты часто сосредоточены на стадиях разработки и сборки, и запущенные контейнеры остаются уязвимыми для таких угроз, как несанкционированное использование ресурса, эскалация привилегий и утечка конфиденциальных данных. В результате многие компании сталкиваются с необходимостью мониторинга сложных инфраструктур в реальном времени, но не имеют для этого простых и доступных инструментов. Runtime Radar призван решить эту проблему. Подчёркивается, что запуск Runtime Radar — это ещё один вклад Positive Technologies в развитие отечественного Open Source-сообщества. Компания планирует и дальше активно развивать проект, дополняя его новыми функциями.

23.10.2025 [15:49], Андрей Крупин

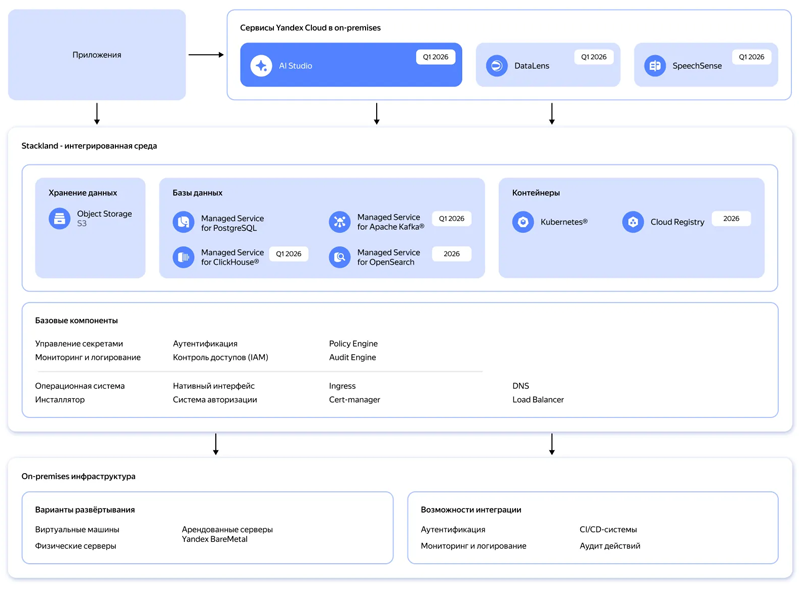

Yandex B2B Tech поможет компаниям быстро разворачивать инфраструктуру для ИИ-сервисов по модели On‑PremiseYandex B2B Tech (бизнес-группа «Яндекса», объединяющая технологии и инструменты компании для корпоративных пользователей, включая продукты Yandex Cloud и «Яндекс 360») сообщила о планах по запуску в первом квартале 2026 года нового инфраструктурного решения Yandex Cloud Stackland, с помощью которого организации смогут оперативно разворачивать инфраструктуру для управления ИИ‑нагрузками в закрытом контуре по модели on‑premise. Yandex Cloud Stackland предложит пользователям следующие компоненты для построения интегрированной ИИ-среды: платформу AI Studio для разработки ИИ-приложений и агентов, модуль речевой аналитики SpeechSense, BI-систему DataLens, контейнерный оркестратор, масштабируемое объектное S3-хранилище, управляемые СУБД PostgreSQL, ClickHouse, Kafka, а также векторные базы данных, которые распространены в RAG-решениях. В дополнение к этому будут представлены инструменты для обеспечения приложений доступом к графическим ускорителям и высокопроизводительным сетям, таким как InfiniBand, для задач распределённого инференса. Отдельное внимание будет уделено безопасности и защите обрабатываемых данных: Stackland получит встроенные средства IAM для гибкого разграничения доступов и инструменты для защищённого хранения паролей, токенов и сертификатов.

Архитектура Yandex Cloud Stackland (источник изображения: yandex.cloud/services/stackland) Stackland базируется на Kubernetes, что позволит компаниям применять привычные подходы и инструменты для управления микросервисными приложениями, а также управлять PaaS-сервисами Yandex Cloud через Kubernetes API. Ожидается, что интерес к Stackland проявят организации из сфер электронной коммерции, финтеха, ритейла и промышленного сектора, которые хотят использовать ИИ-решения на базе облачных технологий, но не могут сделать это из-за внутренних или регуляторных требований. Как передают «Ведомости», по оценке «Яндекса», в 2025 г. объём рынка контейнеризации составит 4–6 млрд руб., а к 2030 г. вырастет до 9–14 млрд руб. С новым решением компания планирует занять полоивину рынка инфраструктурного ПО для ИИ. Лицензирование Yandex Cloud Stackland будет производиться по количеству ядер CPU. Все инфраструктурные компоненты, в частности управляемые базы данных, будут включены в лицензию. Для отдельных сервисов, таких как AI Studio, DataLens и SpeechSense, нужно будет приобретать отдельные лицензии.

17.10.2025 [14:49], Андрей Крупин

VK Cloud, Yandex Cloud и «Флант» создадут первую в России некоммерческую ассоциацию по облачным технологиямКомпании VK Cloud, Yandex Cloud и «Флант» объявили о планах по созданию некоммерческой Ассоциации облачно-ориентированных технологий (АОТ) — первой в РФ организации, которая займётся развитием новых подходов, стандартов и архитектуры нативных облачных технологий без привязки к конкретному вендору. АОТ призвана объединить игроков отечественного облачного рынка для популяризации облачных технологий, таких как Kubernetes и Cloud-native. Ключевыми задачами ассоциации станут продвижение и внедрение Cloud-native-решений через стандартизацию подходов и компетенций в разработке ПО, поддержка и развитие Open Source-продуктов, а также их внедрение в бизнес-среде, популяризация облачных технологий и Kubernetes, а также развитие и объединение профессионального сообщества.

Источник изображения: Monisha Selvakumar / unsplash.com Стать партнёром АОТ сможет любая компания, использующая в работе облачные технологии, а участником — любой IT-специалист. Статус партнёра предполагает ежегодные взносы, которые идут на проекты ассоциации, и открывает доступ к проектам и ресурсам АОТ. «Мы считаем, что базовые облачные технологии должны быть доступны всем, и у каждого должна быть возможность вносить в них свой вклад. Наша совместная задача с партнёрами из Ассоциации облачно-ориентированных технологий — объединить усилия крупнейших организаций и всех инженеров, которым не безразличен Open Source, чтобы ускорить развитие индустрии в целом», — прокомментировали инициативу в компании «Флант».

23.06.2025 [14:46], Владимир Мироненко

Broadcom представила VMware Cloud Foundation 9 — основу основ для современного частного облака

broadcom

kubernetes

nvidia

software

vmware

виртуализация

ии

информационная безопасность

частное облако

Broadcom объявила о выходе платформы VMware Cloud Foundation (VCF) 9.0, которая предоставляет клиентам согласованную операционную модель для частного облака, охватывающую ЦОД, периферию и управляемую облачную инфраструктуру. VCF 9.0 сочетает в себе гибкость и масштабируемость публичных облаков с безопасностью, производительностью, архитектурным контролем и низкой совокупной стоимостью владения (TCO) локальных сред. VCF 9.0 является единой унифицированной платформой с поддержкой традиционных, современных и ИИ-приложений, говорит компания. Согласованные операции, управление и контроль в среде частного облака, а также возможность самообслуживания позволяет разработчикам сосредоточиться на своих приложениях, а не на инфраструктуре. Именно для этого при создании VCF 9.0 была выбрана совершенно новая архитектура. VCF 9.0 получила унифицированный интерфейс для администраторов облака, обеспечивающий целостное представление о его работе. Новое приложение Quick Start значительно сокращает время и сложность настройки. Встроенные политики управления и предварительно настроенные шаблоны помогают поддерживать соответствие требованиям всем развёртываниям, сокращая ручные задачи и гарантируя повторяемость инфраструктуры. Разработчики получают доступ к автоматизированным и эластичным самообслуживаемым IaaS.

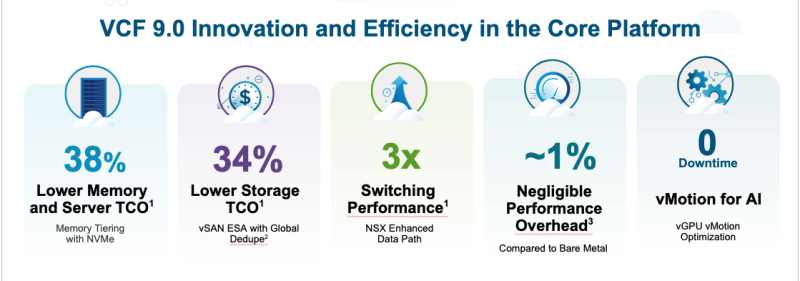

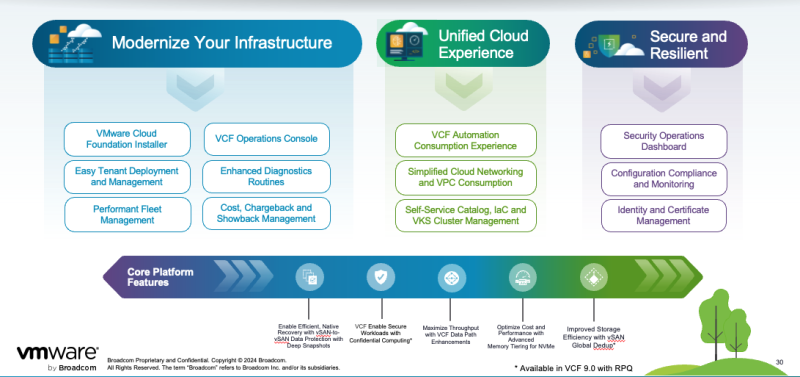

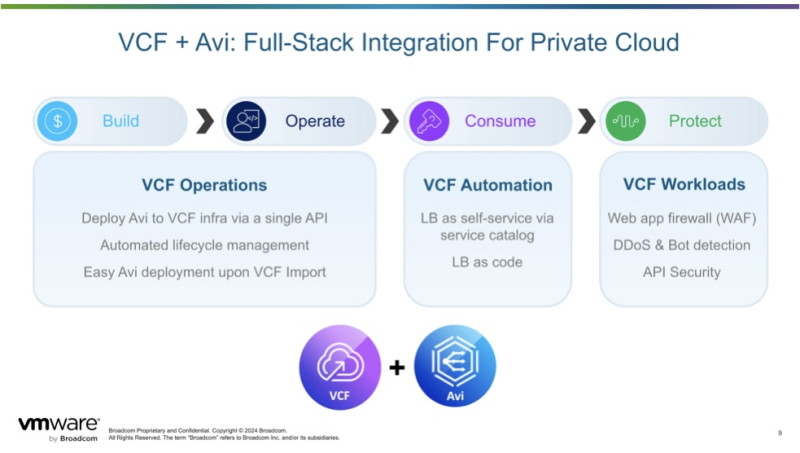

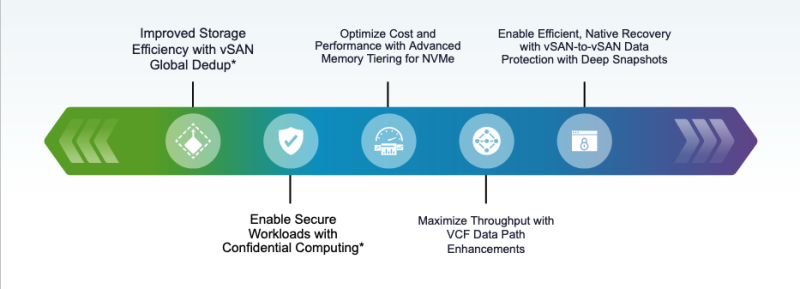

Источник изображений: Broadcom Встроенная службы vSphere Kubernetes Service (VKS) позволяет одинаково работать как с виртуальными машинами (ВМ), так и с контейнерами. Унифицированный подход позволяет клиентам создавать, развёртывать и запускать контейнеризированные и виртуализированные рабочие нагрузки вместе, снижая потребность в сложных стеках DevOps и интеграциях. VCF 9.0 предлагает явные преимущества в плане прогнозируемости и прозрачности затрат по сравнению с публичным облаком, позволяя организациям получить полное представление о совокупной стоимости владения и обеспечивая чёткую видимость рентабельности инвестиций в инфраструктуру, говорит Broadcom. Ключевой особенностью VCF 9.0 является и новая панель управления SecOps, обеспечивающая консолидированное представление безопасности платформы и управления данными, включая интегрированные политики соответствия и нормативные ограничения для согласованного управления. VMware vDefend обеспечивает встроенное обнаружение и реагирование на угрозы, микросегментацию на уровне зон и приложений, сокращение поверхности атак и принудительное применение принципа нулевого доверия в VCF. vDefend расширяет возможности как администраторов инфраструктуры, так и владельцев VPC, оптимизирует миграцию и обеспечивает последовательное предотвращение угроз в многоэкземплярных развёртываниях VCF. Обновления коснулись и подсистем хранения и сетей. Расширенное многоуровневое хранение для NVMe позволяет обеспечить снижение до 38 % совокупной стоимости владения, а VMware vSAN ESA с Global Dedupe позволяет на 34 % снизить совокупную стоимость владения хранилищем. Новая защита данных vSAN-to-vSAN с «глубокими» снапшотами обеспечивает более эффективное восстановление после сбоев или атак программ-вымогателей. VCF обеспечивает практически нулевую потерю производительности по сравнению с bare metal, поддерживая при этом vMotion без простоев для рабочих ИИ-нагрузок. VMware Live Recovery обеспечивает унифицированное управление кибер- и аварийным восстановлением во всех развертываниях VCF с повышенным суверенитетом данных за счёт локальных изолированных сред восстановления. Поддерживает до 200 неизменяемых снапшотов на ВМ и обеспечивает более эффективное масштабирование за счёт возможности расширения хранилища независимо от вычислений с помощью кластеров хранения vSAN. Наконец, в VMware NSX обеспечен трёхкратный рост производительности коммутации VMware Private AI Foundation с NVIDIA повышает кибербезопасность, позволяя развернуть облаки с поддержкой изоляции (air gap) и GPU-as-a-Service. В службе также появилась видимость профилей vGPU и новые инструменты мониторинга (v)GPU. А Model Runtime упрощает использование и масштабирование ИИ-моделей, в то время как Agent Builder Service обеспечивает более эффективное создание ИИ-агентов. VMware Data Services Manager (DSM) предлагает поддержку PostgreSQL и MySQL с Microsoft SQL Server в Tech Preview. Интеграция с VCF Automation позволяет ИТ-отделам предоставлять DBaaS, а дополнительные усовершенствования повышают эффективность для управления большими парками баз данных. Еще одним ключевым обновлением является интеграция балансировщика нагрузки VMware Avi с VMware Cloud Foundation (VCF) 9.0. Он обеспечивает единую облачную операционную модель для балансировки по всем рабочим нагрузкам, предлагает plug-and-play балансировку для ВМ и Kubernetes, а также единый API для администраторов и разработчиков инфраструктуры. |

|