Материалы по тегу: kubernetes

|

12.05.2025 [16:24], Татьяна Золотова

В 2025 году объем рынка коммерческих платформ контейнеризации вырастет на 30 %

kubernetes

open source

software

tadviser

анализ рынка

импортозамещение

контейнеризация

россия

финансы

В 2024 году доступный для монетизации объем рынка (Serviceable Addressable Market, SAM) коммерческих платформ контейнеризации, включающий on-premise решения и облачные сервисы, составил 1,5 млрд руб. (рост на 28 % по сравнению с годом ранее). В 2025 году этот показатель будет равен 2 млрд руб. (рост на 30 %). Об этом говорится в исследовании TAdviser «Объем российского рынка платформ контейнеризации и его лидеры». Общий объем рынка коммерческих платформ контейнеризации, включающий выручку от продаж лицензий и услуг поддержки on-premise-платформ, по итогам 2023 года составил 975 млн руб. С учетом выручки вендоров общий объем рынка оценивается в 3,9–5,7 млрд руб. Среди лидеров аналитики TAdviser называют решения Deckhouse Kubernеtes Platform от компании «Флант» (30 % рынка), Basis Digital Energy от «Базиса» (22 %), «Штурвал» от «Лаборатории числитель» (10 %), «Боцман» от «Платформы Боцман» (10 %) и Nova Container Platform от Orion soft (8 %). Так, в 2024 году Deckhouse Kubernetes Platform показала рост выручки в 170 %. Также на рынке присутствуют около 20 вендоров различного масштаба с малыми долями, которые в будущем могут быть поглощены более крупными игроками. По словам исполнительного директора «Лаборатории числитель», рынок коммерческих платформ контейнеризации только формируется, в ближайшие пару лет ожидаются слияния и поглощения нишевых решений. В структуре потребления лидируют самописные платформы на базе «ванильных» Kubernetes и коммерческие on-premise платформы, им незначительно уступают open-source платформы. На рост рынка контейнеризации закономерно повлияли уход зарубежных вендоров и политика импортозамещения, рост интереса к микросервисным архитектурам и Kubernetes, а также развитие облачных технологий и ML/AI-решений. Исследование проводилось с октября 2024 года по февраль 2025 года. В нем участвовали около 300 представителей заказчиков и более 30 вендоров платформ контейнеризации. Рынок платформ контейнеризации формируется из таких основных частей как компании, использующие коммерческие платформы (on-premise), коммерческие облачные сервисы (CaaS/KaaS), open-source платформы (например, OKD), самостоятельно разрабатывающие платформы контейнеризации на базе «ванильного» Kubernetes, и компании, не использующие платформы контейнеризации (потенциальный объем проектов).

04.05.2025 [08:49], Татьяна Золотова

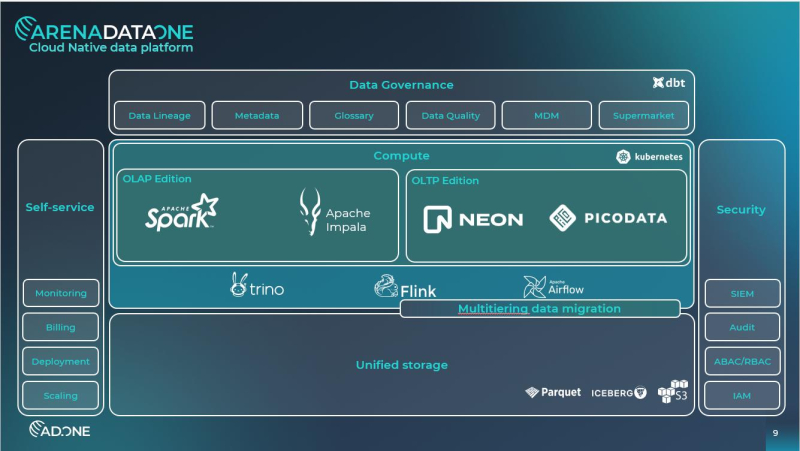

Arenadata запустила облачную платформу Arenadata OneArenadata представила Arenadata One (AD.One) — cloud-native-платформу для обработки и хранения данных. Она предназначена для работы в эластичной облачной инфраструктуре под управлением Kubernetes и совместима с объектным S3-хранилищем. AD.One решает такие задачи, как построение lakehouse, real-time-аналитика, хранение векторов и features, база данных по требованию. Согласно исследованиям Arenadata, в крупных компаниях аналитические СУБД простаивают 40–50 % рабочего времени. Разработчик объясняет это тем, что классические технологии для аналитических и транзакционных задач, размещенные на bare-metal для максимальной производительности при однородных спланированных нагрузках, требуют резервирования оборудования в кластере, чтобы была возможность справляться с пиковыми нагрузками. Это в свою очередь ведет к простоям «железа» и увеличению стоимости владения системой хранения. Arenadata One сочетает мультитенантную архитектуру с низким T2M (time-to-market) DBaaS. Платформа обеспечивает изолированное обслуживание различных групп пользователей в рамках единой инфраструктуры, одновременно предлагая технологии для быстрого развертывания баз данных «по требованию». При этом DBaaS-платформа может быть развёрнуты и на инфраструктуре заказчика. Среди основных особенностей Arenadata One ее разработчики называют архитектурное разделение слоёв выисления и хранения, интегрированное cloud-native OLTP- и AI-хранилище, уменьшение затрат на хранение и обработку данных, повышенная окупаемость инвестиций (ROI), снижение совокупной стоимости владения (TCO) и сокращение времени вывода продуктов на рынок (T2M). Кроме того, отмечаются такие функции как multi-tier-архитектура, Data Governance (интегрированное средство управления моделью, качеством и связанностью данных), и Hybrid Cloud для построения гибридного облачного хранения.

04.04.2025 [12:37], Руслан Авдеев

«Агрегатор ускорителей» Parasail анонсировал ИИ-гипероблакоСтартап Parasail привлёк $10 млн стартового капитала и выступил с необычным для рынка ИИ предложением. Компания стала своеобразным «агрегатором ускорителей», создав для инференса сеть, позволяющую свести вместе владельцев вычислительных мощностей и их клиентов с максимальной простотой, сообщает The Next Platform. Раунд финансирования возглавили Basis Set Ventures, Threshold Ventures, Buckley Ventures и Black Opal Ventures. Компанию основали Майк Генри (Mike Henry), ранее основавший производителя ИИ-решений Mythic и работавший одним из топ-менеджеров в Groq, и Тим Харрис (Tim Harris), генеральный директор Swift Navigation. Прежний опыт Майка Генри на рынке IT позволил заметить, что в последнее время ландшафт облачных сервисов стремительно меняется — если ранее на нём безраздельно доминировали гиперскейлеры вроде AWS, Microsoft Azure и Google Cloud, то с приходом ИИ они, казалось бы, сохраняют ведущие позиции, но на сцену выходят и новые облачные игроки, чья инфраструктура изначально рассчитана на ИИ-задачи, от обучения до инференса. В конце 2023 года бизнесмены основали компанию Parasail, которая совсем недавно заявила о себе, заодно собрав $10 млн финансирования. Фактически бизнес рассчитан на клиентов, которые заинтересованы в простом доступе к ИИ-технологиям — он будет связывать тех, кто располагает ими, и тех, кто в них нуждается.

Источник изображения: Campaign Creators/unsplash.com Parasail намеревается использовать рост облачных ИИ-провайдеров вроде CoreWeave (недавно вышедшей на IPO) и Lambda Labs. Для этого создана сеть AI Deployment Network, объединяющая их вычислительные ресурсы в единую инфраструктуру, которая масштабнее, чем Oracle Cloud Infrastructure (OCI). Компания применяет собственный «движок» для оркестрации процессов в этом гипероблаке. Ключевым преимуществом является низкая стоимость услуг — утверждается, что компании, желающие отказаться от сервисов вроде OpenAI и Anthropic, могут рассчитывать на экономию в 15–30 раз, а в сравнении с клиентами провайдеров open source моделей — в 2–5 раз. На настройку уходит несколько часов, а инференс после этого можно начать за считанные минуты. Сегодня Parasail предлагает в облаке ресурсы NVIDIA H200, H100 и A100, а также видеокарт NVIDIA GeForce RTX 4090. Цены составляют от $0,65 до $3,25 за час использования. Parasail столкнулась с проблемой несовместимости инфраструктур: разные облачные платформы используют уникальные подходы к вычислениям, хранению данных, сетевому взаимодействию, а также имеют различия в настройке, биллинге и автоматизации. Хотя Kubernetes и контейнеризация могли бы частично решить эти проблемы, их реализация у разных провайдеров сильно отличается, а Kubernetes изначально не предназначается для работы с несколькими кластерами, регионами или провайдерами одновременно. Чтобы обойти ограничения, Parasail разработала собственную систему, которая объединяет ускорители из разных облаков в единую глобальную сеть. Их решение позволяет централизованно управлять распределёнными узлами, игнорируя различия в инфраструктуре провайдеров. Если один облачный провайдер выйдет из строя, система автоматически заменяет его ресурсы другими, минимизируя простои. Дополняя эту систему автоматизированным динамическим выделением ускорителей, Parasail создаёт масштабируемую и эффективную глобальную инфраструктуру, способную оперативно адаптироваться к нагрузкам и сбоям. Оркестрация и оптимизация рабочих нагрузок в ИИ-инфраструктуре усложняются из-за огромного разнообразия моделей, архитектур, типов GPU и ASIC, а также множества способов их комбинирования. Parasail решает эту проблему с помощью гибридного подхода, сочетающего математическое моделирование, ИИ-алгоритмы и участие живых специалистов, что позволяет эффективно масштабироваться даже с небольшой командой.

Источник изображения: Campaign Creators/unsplash.com Закрытое бета-тестирование началось в январе, а позже спрос только вырос до той степени, что Parasail достигла семизначного ежегодного регулярного дохода (ARR). Теперь технология доступна всем, в числе клиентов — производитель чипов SambaNova, ИИ-платформа Oumi, ИИ-стартап Rasa и Elicit, позволяющий автоматизировать научные изыскания. В будущем стартап намерен быстро расширить штат из 12 работников, рассматриваются и варианты добавления в портфолио новых доступных ускорителей — сейчас там безусловно лидирует NVIDIA, но рынок вполне может измениться. В то же время отмечается парадоксальная ситуация, когда на рынке наблюдается и дефицит ускорителей, и простой мощностей в некоторых ЦОД одновременно. Предполагается, что дело в плохой оптимизации процессов на рынке ИИ. При этом в компании отмечают, что в данное время спрос на ИИ-приложения «почти бесконечен» и главная проблема — эффективно их использовать. Платформа Parasail для инференса максимально упрощает масштабное внедрение ИИ.

24.03.2025 [15:20], Андрей Крупин

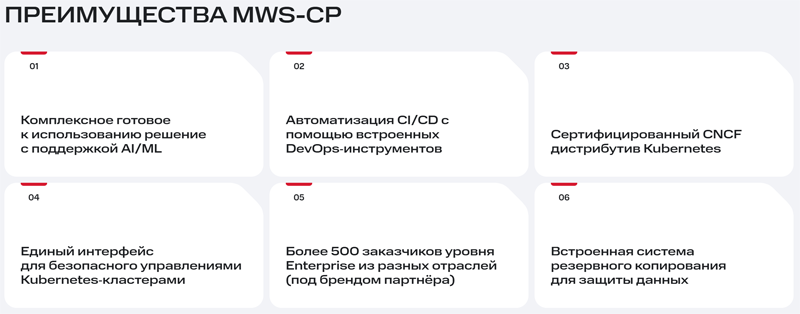

МТС Web Services запустила платформу контейнеризации масштаба EnterpriseМТС Web Services сообщила о расширении портфолио облачных служб и запуске нового продукта MWS Container Platform, предназначенного для разработки и эксплуатации контейнеризированных приложений в промышленных масштабах. MWS Container Platform объединяет Kubernetes, DevOps, AI и сервисы данных в одном решении. В составе платформы представлены средства централизованного управления Kubernetes-кластерами в любых средах — локальных, облачных и гибридных (включая закрытые контуры без доступа к интернету), инструменты DevOps для управления жизненным циклом приложений, а также наиболее востребованные в корпоративной инфраструктуре базы данных и брокеры сообщений (PostrgeSQL, MySQL, Redis, Kafka, RabbitMQ). Микросервисная архитектура обеспечивает высокую доступность и отказоустойчивость MWS Container Platform.

Источник изображения: mws.ru/services/mws-cp Платформа поддерживает работу с графическими ускорителями (GPU), включая их виртуализацию и балансировку нагрузки, а также предоставляет доступ к набору готовых инструментов для построения конвейеров MLOps и LLMOps, помогающих разработчикам автоматизировать весь цикл работы с ИИ-моделями — от обучения и тестирования до развёртывания и мониторинга. Отдельного упоминания заслуживают встроенные компоненты для управления сетью и настройками безопасности MWS Container Platform. MWS Container Platform развёртывается в любой инфраструктуре — на физических серверах (bare metal), в виртуализированных средах или в публичных облаках, предоставляя компаниям гибкость в выборе оптимальных сценариев размещения и снижая затраты на инфраструктуру. Поддержка закрытых контуров и встроенные инструменты защиты позволяют выполнять любые требования к безопасности обрабатываемых данных.

29.10.2024 [14:42], Владимир Мироненко

ГК «Солар» приобрела 10 % долю в Luntry, специализирующейся на контейнерной безопасности

kubernetes

software

инвестиции

информационная безопасность

контейнеризация

россия

ртк-солар

сделано в россии

сделка

финансы

Группа компаний «Солар» сообщила о завершении сделки по покупке 10 % доли разработчика решений контейнерной безопасности Luntry (ООО «Клаудран»). Сумма сделки не раскрывается. Как предположил один из опрошенных «Ведомостями» экспертов, стоимость Luntry исходя из публичной отчётности может составлять до 500 млн руб., а сумма сделки — порядка 50 млн руб. В ГК «Солар» отметили, что это была первая сделка в рамках недавно созданного фонда Solar Ventures, который нацелен на стимулирование роста отрасли ИБ. Согласно пресс-релизу, сделка позволит «Солару» «усилить компетенции по защите микросервисных архитектур и контейнеризации и сформировать дополнительный пакет сервисов и услуг для защиты таких инфраструктур». Luntry предлагает решение для комплексной защиты на всём жизненном цикле контейнерных приложений и средств оркестрации на базе Kubernetes. В числе клиентов компании, работающей на российском рынке с 2021 года, крупнейшие банки, страховые и ИТ-компании, ретейлеры федерального значения. Luntry обладает командой квалифицированных специалистов с более чем десятилетним опытом и широкой партнёрская сетью. Решение Luntry cлужит источником данных для SOC о Kubernetes и работающих контейнерах, помогает в расследовании инцидентов, обнаружении первопричин инцидентов и сбоев, обеспечивает высокий уровень защищённости в рамках быстрого цикла разработки, эффективное взаимодействие между командами для принятия решений и осведомленность о всех запретах и ограничениях ИБ. В Luntry отметили, что сделка с ГК «Солар» не изменит общей стратегии развития, но при этом позволит совместными усилиями обеспечивать защиту критичных государственных информационных систем, использующих контейнеризацию. В свою очередь, в ГК «Солар» сообщили, что данная сделка выполнена в рамках реализации инвестиционной стратегии, рассчитанной на период до конца 2025 года. Ранее ГК «Солар» приобрела доли в компаниях Digital Security, «Secure-T», «Элвис-Плюс» и «НТБ» и создала СП Солар-ТЗИ. По оценке ГК «Солар», российский рынок безопасности контейнеров составил в 2023 году 1,1 млрд руб., в том числе за счёт функциональности, реализованной на платформах управления контейнерами. К 2027 году его объём может достичь 2,0–2,5 млрд руб. и Luntry может занять до 20 % рынка.

14.10.2024 [18:25], Руслан Авдеев

Postgres Professional инвестирует 3 млрд рублей в развитие экосистемы Deckhouse

deckhouse

kubernetes

open source

postgres professional

software

инвестиции

россия

сделано в россии

сделка

финансы

Российские разработчики ПО Postgres Professional и АО «Флант» объявили о стратегическом партнёрстве для развития экосистемы решений Deckhouse. По данным пресс-службы АО «Флант», в рамках партнёрства Postgres Professional инвестирует 3 млрд руб. АО «Флант», по данным самой компании, является одним из ведущих контрибьюторов Kubernetes и лидеров DevOps в России, а Postgres Professional — это крупный и известный отечественный разработчик СУБД. Сегодня экосистема Deckhouse включает платформу контейнеризации Deckhouse Kubernetes Platform, платформу виртуализации Deckhouse Virtualization Platform, систему мониторинга Deckhouse Observability, менеджер кластеров Deckhouse Commander и другое ПО. Флагманом является продукт Deckhouse Kubernetes Platform. Платформа управляет более чем 600 кластерами в банковских структурах, ретейле, финтех- и нефтегазовых компаниях, а также других отраслях. Сотрудничество на стратегическом уровне обеспечит компаниям развитие ПО, экспертизу в области Cloud Native и технологиях больших данных. Условия партнёрства предусматривают получение Postgres Professional миноритарной доли «Фланта» до 2028 года, при этом действующие акционеры сохранят контроль над компанией. Доля будет определена с учётом финансовых показателей «Фланта» в последующие три года. За это время компания намерена увеличить портфолио заказчиков и выручку, а также втрое увеличить присутствие на рынке. Во «Фланте» заявляют, что партнёрство с крупными игроками вроде Postgres Professional открывает новые возможности для развития бизнеса. Партнёры заняты разработкой ПО с открытым кодом и заинтересованы в развитии сообщества. Инвестиции будут направлены на улучшение продуктов и оптимизацию клиентских сервисов. В Postgres Professional отметили, что поддерживают IT-бизнесы, не только предлагающие качественные продукты, но и отдающие разработки для свободного использования в соответствии с принципами open source. Утверждается, что сотрудничество поможет совершенствованию Cloud Native-технологий и предложить клиентам инструменты для удобной и надёжной работы с данными.

10.10.2024 [14:54], Владимир Мироненко

Selectel запустил бета-тестирование собственной инференс-платформы для ускорения запуска ИИ-моделейРоссийский провайдер сервисов IT-инфраструктуры Selectel приступил к бета-тестированию инференс-платформы собственной разработки, которая позволит упростить запуск ML-моделей в промышленную эксплуатацию и ускорить их работу. Как сообщается на сайте провайдера, с помощью нового сервиса можно всего за несколько минут развернуть готовую модель на вычислительных мощностях провайдера без привлечения разработчиков. Решение нацелено на компании, использующие в работе ИИ-модели для обеспечения функционирования голосовых роботов в колл-центрах, чат-ботов для консультаций сотрудников и клиентов, сервисов распознавания изображений и других задач. С помощью платформы можно загружать модели в объектное хранилище Selectel, а на выходе получить готовые API. Также с её помощью можно регулярно обновлять версии моделей без прекращения обработки поступающих пользовательских запросов. Selectel отметил, что благодаря инференс-платформе можно в несколько раз сократить время вывода ИИ-проектов на рынок, причём с учётом конкретных профилей нагрузок и требований к производительности, которые помогут подобрать и донастроить специалисты ML-команды провайдера. Платформа построена на базе GPU-кластеров Managed Kubernetes с использованием открытых инструментов NVIDIA Triton Inference Server, Ray Serve Cluster и Istio Ingress Controller. Решение полностью независимо от привязки к поставщику (vendor lock) и обеспечивает высокую производительность за счёт встроенных возможностей по повышению пропускной способности и максимальной утилизации ресурсов.

24.09.2024 [14:45], Андрей Крупин

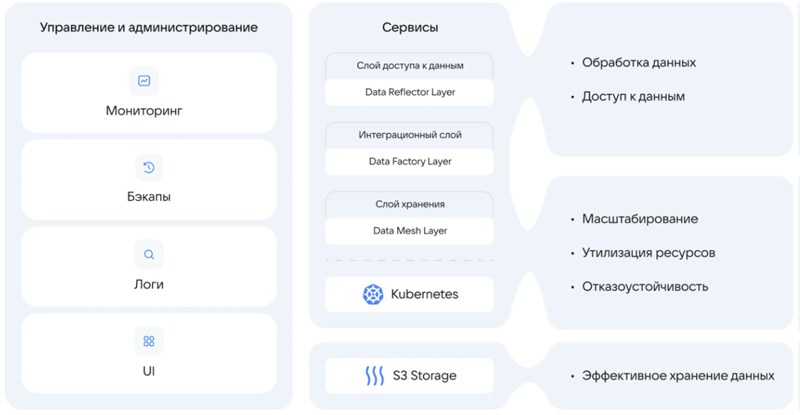

VK создала собственную платформу для работы с большими объёмами данных и машинным обучениемЗанимающаяся разработкой корпоративного ПО компания VK Tech (входит в экосистему VK) сообщила о запуске Data Platform — платформы для комплексной работы с большими объёмами данных, нейросетями и искусственным интеллектом. В течение трёх лет в VK намерены инвестировать в новое решение и связанные с ним сервисы до 4 млрд руб. VK Data Platform относится к категории универсальных инструментов Enterprise Data Platform (EDP) и позволяет решать широкий спектр задач: от хранения и обработки данных до выполнения аналитических процессов и разработки моделей машинного обучения. В основу платформы положены собственные разработки компании, в частности, Tarantool и S3-совместимое хранилище Cloud Storage, и доработанные VK технологии, среди которых Trino, PostgreSQL, Airflow и многие другие.

Функциональная архитектура VK Data Platform Компоненты VK Data Platform разворачиваются на основе Kubernetes. Это позволяет динамически распределять вычислительные мощности, эффективно утилизировать аппаратное обеспечение и предоставлять высокий уровень отказоустойчивости. Пользователям доступны централизованные инструменты мониторинга, создания резервных копий данных и графический интерфейс для управления платформой. Платформа может быть развёрнута на различных типах инфраструктуры, включая публичные и частные облака, а также собственные серверы заказчика. В ней предусмотрены типовые архитектуры на основе Data WareHouse, Data Lake, LakeHouse и Data Mesh, MLOps-конвейеров, а также конфигурации для систем с высокой транзакционной нагрузкой. По заверениям разработчика, это позволяет быстро адаптировать её под задачи любой компании и ускоряет интеграцию решения в корпоративный IT-ландшафт.

11.09.2024 [09:09], Владимир Мироненко

DevOps в России мигрирует на отечественные ОС, платформы и инструменты

devops

kubernetes

software

импортозамещение

исследование

контейнеризация

миграция

разработка

россия

сделано в россии

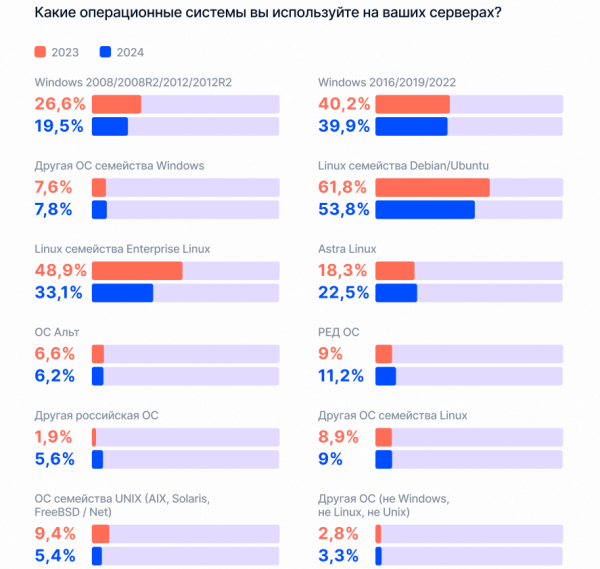

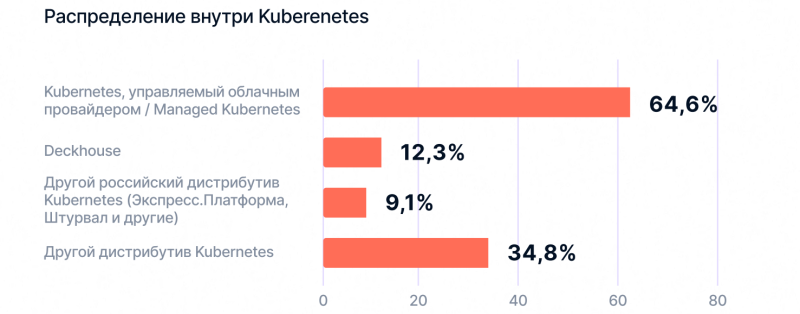

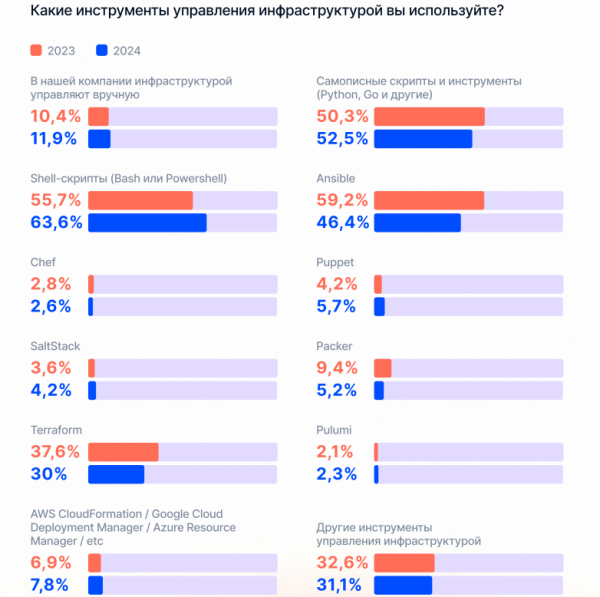

Компания «Экспресс 42» опубликовала результаты ежегодного исследования «Состояние DevOps в России», вышедшего при поддержке Deckhouse, Yandex Cloud, HeadHunter, «OTUS онлайн образование», JUG Ru Group, Avito Tech, «Т-Банк». Благодаря рекордному числу участников — более 4 тыс. человек — в исследовании удалось выявить ключевые закономерности и самые актуальные тренды развития DevOps в России. Исследование подтвердило рост интереса к DevOps, в том числе в новых отраслях. Хотя тройка лидеров сохраняется с 2020 года, доля ИТ уменьшилась с 45,5 до 36,2 %, доля финансового сектора упала на 2,4 % до 12,4 %, у ретейла равна 7,3 %. Суммарная доля отраслей за пределами ИТ-сферы и финтеха выросла с 39,7 % до 51,4 %. По сравнению с прошлым годом среди респондентов выросла доля работающих на российские компании — с 85,8 % до 89,4 %. Также увеличилось количество независимых специалистов — с 2,5 % до 3,8 %. Растущий интерес к DevOps отражает и рынок труда. По востребованности DevOps-специалисты уступают только разработчикам – 27,6 % против 40,6 % соответственно. Далее в рейтинге следуют системные аналитики (13,5 %). Вместе с тем бюджет на наём растёт, как и разрыв между количеством вакансий и резюме. То есть кадровый голод не утолён, но ключевые позиции, похоже, были закрыты, сделали вывод в «Экспресс 42». В числе самых востребованных навыков специалистов в этой сфере работодатели указывают работу с Linux (в 4 5% вакансий), Docker (37 %) и Kubernetes (35 %). Важны также компетенции DevOps (23 %), владение Ansible и Phyton (по 22 %), CI/СD и Bash (по 20 %), PostgreSQL (19 %), Git (17 %). Вместе с тем снизилась доля пользователей Debian/Ubuntu с 61,8 до 53,8 % и RHEL — с 49 до 33,1 %. Попутно растёт доля пользователей российских ОС Astra Linux — с 18,3 до 22,5 %; Ред ОС — с 9,1 до 11,2 %; других российских ОС — с 1,9 до 5,6%. Исключение составила ОС «Альт», доля которой упала с 6,6 до 6,2 %. Исследователи отметили, что большинство российских компаний адаптировалось к изменившимся за последние два года условиям работы. И их фокус смещается с нормализации состояния на развитие. Доля респондентов, выбравших вариант «Сохранить финансовую и операционную стабильность», сократилась с 23 до 19,4 %, в то время как доля выбравших варианты «Продолжить планомерное развитие» и «Воспользоваться появившимися новыми возможностями» увеличилась с 44 до 45,7 % и с 32 до 34,9 % соответственно. В числе первоочередных задач, которые компании ставят перед своими ИТ-департаментами — улучшение качества разрабатываемых продуктов (59,7 % респондентов), повышение скорости реагирования на запросы от бизнеса (43,6 %), создание новых технологий, которые обеспечивают конкурентное преимущество на рынке (42,1 %). Также отмечено увеличение средств, выделяемых на ИТ. 57,2 % опрошенных, которые ознакомлены с распределением, сообщили об увеличении бюджета на ИТ, а у 26,2 % он остался прежним. Исследователи отметили рост количества пользователей managed-решений и российских дистрибутивов Kubernetes. Аналитики расценивают это как начало тренда на переход на управляемые решения и российские дистрибутивы. Также отмечено, что классическими оркестраторами стали пользоваться меньше: доля Kubernetes снизилась с 58,3 до 54,4 %, OpenShift — с 15,1 % до 14,1 %, Rancher — с 9 % до 5,7 %. При этом доля отдельных оркестраторов выросла, больше всего у Docker Swarm — с 14,7 % до 18,6 %. Доля респондентов, которые не используют оркестраторы, увеличилась с 18,7 до 24 %, что объясняется распространением DevOps на новые отрасли, где работают с обычными виртуальными машинами без надобности в решениях уровня Kubernetes, поскольку достаточно Docker Swarm. В числе ключевых функций/компонентов платформ контейнеризации респонденты назвали возможность установки в закрытый контур (49,1 %), централизованное управление множеством кластеров (44,3 %), возможность беспростойных обновлений (41 %), графический интерфейс и удобство и максимальную автоматизацию всех процессов (38,3 %). Наиболее важными аспектами они назвали наличие экосистемы сопутствующего ПО, наличие совместимости с другим ПО и возможность влияния на план развития платформы. При выборе той или иной платформы контейнеризации респонденты руководствуются стоимостью (51,5 %), затратами на обслуживание и эксплуатацию (48,9 %), сложностью внедрения (45, 9%). Основной ценностью использования платформ респонденты считают сокращение вывода решения на рынок (52,4 %), сокращение затрат на поддержку технологических решений (49 %) и на владение инфраструктурой (44,2 %). В исследовании также была зафиксирована тенденция ухудшения ключевых метрик по всем профилям эффективности DevOps: частота релизов ПО, срок поставки, меньшее время восстановления после инцидентов и т.д. Самым популярным инструментом DevOps являются облачные решения. В числе ключевых преимуществ PaaS большинство респондентов назвали ускорение создания и масштабирование приложений (40 %), возможность использование всех сервисов у одного провайдера (37 %), гарантию соблюдения SLA (27 %). Вместе с тем треть респондентов предпочитает размещать данные на собственной инфраструктуре (33 %), чуть меньше трети пользуется гибридной средой (30 %). В основном компании используют управляемые сервисы для администрирования виртуальных машин и систем резервного копирования (4 %), развёртывания серверов (37 %), реже сервисы применяются для помощи с процессом миграции (14 %). В рейтинге популярности PaaS и управляемых сервисы лидируют управляемые SQL (45 %) и оркестраторы (38 %). По-прежнему наименьшее распространение имеют облачные ML-сервисы (8 %) и инструменты для синтеза и распознавания речи (7 %). Ключевые навыки для DevOps-специалиста в облаке включают знание специфики работы в контуре облачного провайдера: управления доступами и безопасностью (57 %), работы с API (62 %), работы с CLI (61 %). Также растёт использование ИИ — 44 % респондентов используют ML/AI-инструменты для решения DevOps-задач и 47 % отмечают их важность в повышении эффективности.

04.09.2024 [08:08], Владимир Мироненко

Broadcom анонсировала VMware Cloud Foundation 9 и Tanzu Platform 10

broadcom

kubernetes

software

vmware

виртуализация

гибридное облако

ии

контейнеризация

частное облако

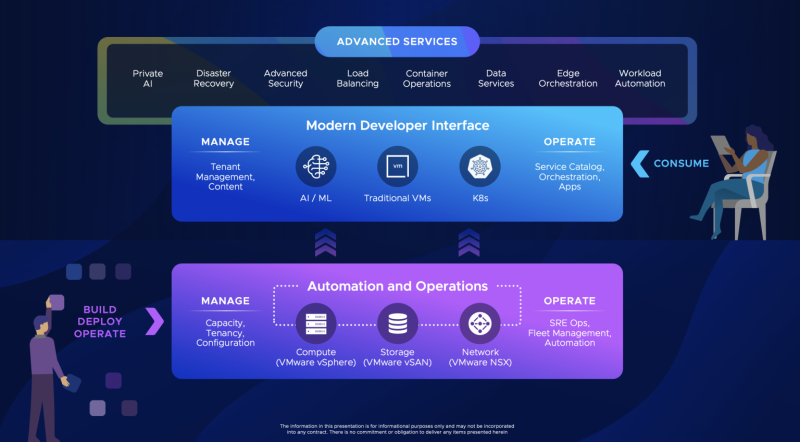

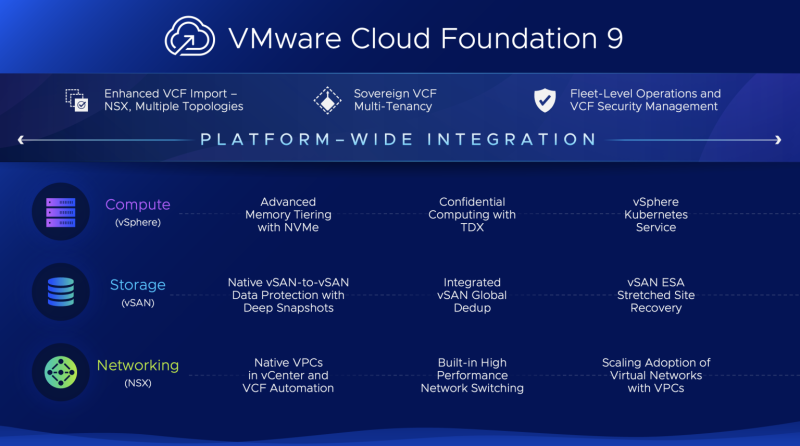

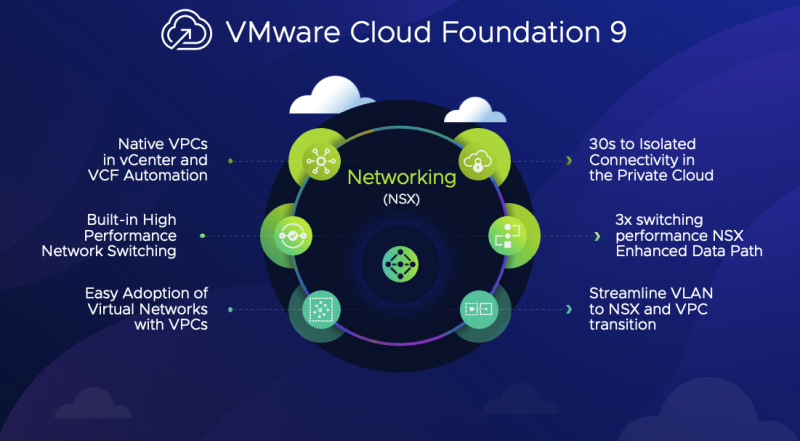

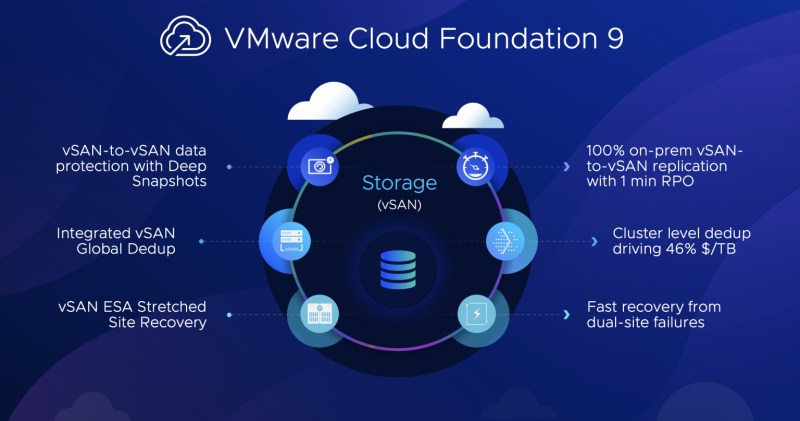

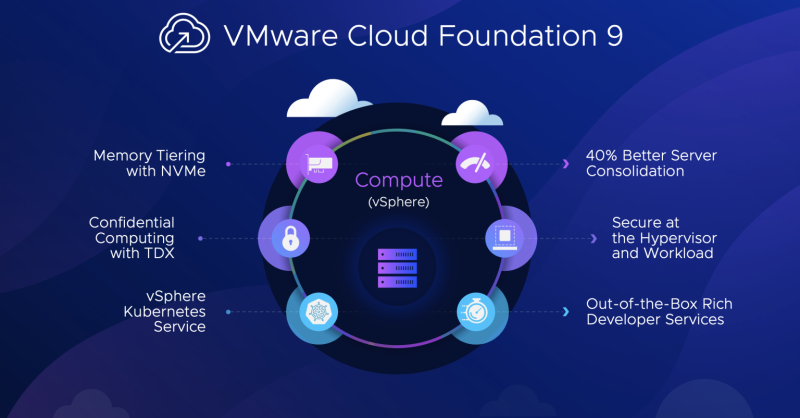

Broadcom представила новейшую версию платформы для управления виртуальными машинами и оркестрации контейнеров VMware Cloud Foundation (VCF) 9, назвав её «будущим» своей платформы частного облака, которая ускорит переход клиентов от разрозненных ИТ-архитектур к унифицированной и интегрированной частной облачной платформе с меньшими затратами и рисками. Основной упор в новой версии сделан на создание частных облаков и, конечно же, ИИ. Broadcom заявила, что VMware Cloud Foundation — первая в отрасли облачная платформа, сочетающая масштабируемость и гибкость публичного облака с безопасностью, устойчивостью и производительностью частного облака и низкой совокупной стоимостью владения. VCF поддержит цифровые инновации клиентов с более быстрой модернизацией инфраструктуры, унифицированным облачным опытом, а также лучшей киберустойчивостью и безопасностью, говорит Broadcom. Компания сослалась на спонсируемое ею исследование IDC, в котором сообщалось, что VCF обеспечивает в среднем на 34 % более низкие затраты на инфраструктуру, на 42 % более низкую общую стоимость эксплуатации и 564 % окупаемости инвестиций в течение трёх лет. VCF помогает организациям быстро перейти на современную и интегрированную инфраструктуру, снижая сложность и время простоя, связанные с ручной миграцией существующих сред в частную облачную платформу. С VMware Cloud Foundation 9 Broadcom добавила возможность клиентам импортировать конфигурации NSX, vDefend, Avi Load Balancer и сложные топологии хранения в существующие среды VCF, а также использовать и интегрировать старые версии существующей инфраструктуры. Этому будет способствовать новый интуитивно понятный пользовательский интерфейс — VCF 9 включает в себя портал самообслуживания с единой консолью управления (вместо десятка с лишним панелей ранее), которая упрощает операции и автоматизацию. Кроме того, компания представила VMware Cloud Foundation (VCF) Advanced Services, каталог готовых к развёртыванию решений, упрощающих работу клиентов в своих частных облачных средах. VMware Cloud Foundation 9Обновлений платформы целое множество. Так, расширение пула DRAM посредством NVMe SSD (CXL) в VCF 9 позволит значительно улучшить работу приложений с интенсивным использованием данных, такие как ИИ, СУБД и аналитика в реальном времени, а также сократит задержку и ускорит передачу информации, что имеет решающее значение для задач обучения и инференса. Также это позволяет масштабировать производительность без чрезмерных затрат. А удалённая репликация снимков между vSAN поддерживает глубокую историю неизменяемых снимков, сокращая время простоя и упрощая оркестрацию аварийного восстановления, в том числе в изолированных on-premise окружениях. Также в VCF 9 включена функциональность VMware Cloud Director, благодаря чему в рамках одной платформы можно поддерживать несколько организаций или, например, групп разработки, сегментируя инфраструктуру на основе их конкретных требований к доступу, управлению рабочими нагрузками, безопасности и конфиденциальности. Кроме того, значительно упростилось создание виртуальных частных облаков (VPC), которые теперь можно формировать буквально в один клик, не занимаясь ручной настройкой VLAN и интеграцией с существующими сетями. Возможности VPC можно расшириить службами VMware vDefend и VMware Avi Load Balancer, которые также получили существенные обновления. Например, Avi Load Balancer лучше оптимизирован для сред VCF и Kubernetes и интегрирован со службой Tanzu Application Service. По словам Broadcom, это сокращает время развёртывания с недель до минут и повышает прозрачность работы на уровне L4–L7. Kubernetes-системы получат расширенными возможности по управлению трафиком и конвейерами CI/CD. vDefend был расширен с помощью распределённого анализа влияния правил брандмауэра и распределённой же системы IPS. Он поддерживает крупные и сложные среды, позволяя провести быструю оценку и профилирование угроз, в том числе в изолированных (air-gapped) окружениях. А в рамках Project Cypress компания готовит для vDefent интеллектуального помощника на базе генеративного ИИ, который будет проактивно находить возможные вектора атак, предлагать возможные варианты защиты, выявлять малоэффектвные политики безопасности и т.д. Пообщаться с ним можно будет на естественном языке. А гипервизор VMware может выступать в качестве датчика угроз для быстрой оценки защиты инфраструктуры. Broadcom также сообщила об обновлении платформы VMware Private AI Foundation with NVIDIA, предназначенный для предприятий, которые хотят использовать возможности ИИ, сохраняя при этом преимущества частного облака, представляющей собой комплексное решение для безопасного и эффективного развёртывания, управления и масштабирования ИИ-приложений на базе VCF. В VCF 9 компания упростила развёртывания платформ генеративного ИИ, расширив возможности управления и мониторинга vGPU и GPU, добавив службу индексации и извлечения данных, а также службу создания ИИ-агентов. Tanzu 10На конференции также была представлена 10-я версия унифицированной платформы VMware Tanzu, с помощью котороый разработчики могут автоматизировать защищённые сборки контейнеров, привязывать сервисы к приложениям, развёртывать код одной командой и легко масштабировать приложения, заявила Broadcom. Tanzu 10 также автоматизирует задачи управления приложениями и платформами, такие как исправление уязвимостей, развёртывание непрерывных обновлений и применение политик. Tanzu предоставляет ряд пакетных сервисов для VCF для автоматизированной и защищённой работы с контейнерами и данными. Новые функции включают поддержку изолированных среды, глобальный балансирощик, расширенные сетевые возможности (Avi Load Balancer), защищённые виртуальные машины, каталог образов с open source ПО. Наконец, встроенная среда разработки ИИ платформы Tanzu позволяет разработчикам создавать приложения Python без знания языка. Решения Tanzu AI Solutions включают, в том числе, такие функции:

Поддержка VMware Private AI Foundation with NVIDIA встроена в сервис GenAI on Tanzu Platform. |

|