Материалы по тегу: i

|

22.04.2026 [13:12], Владимир Мироненко

xAI готова купить ИИ-стартап Cursor за $60 млрд или заплатить $10 млрд в рамках партнёрстваSpaceX, которая не так давно слилась с xAI, заявила, что заключила соглашение о сотрудничестве с ИИ-стартапом Cursor, получив право приобрести его за $60 млрд в конце этого года или заплатить $10 млрд за совместную работу. Компания Илона Маска сообщила в соцсети Х, что сейчас работает с Cursor над созданием «лучшего в мире ИИ для программирования и работы со знаниями». «Сочетание передового продукта Cursor и его распространения среди опытных инженеров-программистов с суперкомпьютером Colossus компании SpaceX, эквивалентным миллиону H100, позволит нам создать самые полезные в мире модели», — отметила SpaceX. Colossus — кластер суперкомпьютеров xAI в Мемфисе (Memphis), который компания позиционирует как крупнейший в мире. Илон Маск (Elon Musk), основатель и генеральный директор SpaceX, в феврале объединил компанию со своим ИИ-стартапом xAI в рамках сделки, оцененной им в $1,25 трлн. Эта сделка должна помочь в реализации планов компании по запуску ЦОД на орбите. Теперь он готовится вывести объединённую компанию на биржу в рамках рекордного IPO, которое, как ожидается, состоится в июне. Генеральный директор Cursor Майкл Труэлл (Michael Truell) заявил, что он «рад сотрудничать с командой SpaceX для масштабирования (ИИ-модели) Composer». «Значительный шаг на нашем пути к созданию лучшего места для программирования с использованием ИИ», — отметил он, сообщает CNBC. По данным источников CNBC, Cursor ведёт переговоры о привлечении финансирования в размере $2 млрд при её оценке более чем в $50 млрд. Ожидается, что одним из лидеров предстоящего раунда финансирования станет Andreessen Horowitz, также в нём примут участие NVIDIA и Thrive Capital. Andreessen и NVIDIA также ранее поддержали xAI. Для Маска эта сделка означает шанс догнать конкурентов в области ИИ — OpenAI, создавшую ИИ-агента Codex, и Anthropic, разработчика LLM Claude. Впрочем, некоторые эксперты отмечают, что фактическое использование вычислительных мощностей Colossus гораздо ниже, чем у конкурентов, поэтому такая сделка гораздо важнее для xAI, чем для Cursor.

22.04.2026 [12:55], Сергей Карасёв

MSI IPC выпустила индустриальный компьютер MS-C936 на базе Intel Raptor Lake-P Refresh для AIoT-приложенийКомпания MSI IPC объявила о выходе индустриального компьютера небольшого форм-фактора MS-C936. Устройство предназначено для AIoT-приложений, промышленной автоматизации, построения различных терминалов и пр. В основу новинки положена аппаратная платформа Intel Raptor Lake-P Refresh. Применён процессор Core i5-120U с 10 вычислительными ядрами (2Р+8Е/12T); максимальная тактовая частота составляет 5 ГГц в турбо-режиме. В состав чипа входит ускоритель Intel Graphics с частотой до 1,3 ГГц. Задействовано пассивное охлаждение. Компьютер может нести на борту до 96 Гбайт DDR5-5200 в виде двух модулей SO-DIMM. Допускается установка SFF-накопителя с интерфейсом SATA, а также SSD типоразмера M.2 2242/2280 с интерфейсом PCIe 4.0 x4 или SATA-3. Кроме того, предусмотрены коннектор M.2 B key 2242/3042 (PCIe x1, USB 3.2, USB 2.0, Nano-SIM) для сотового модема и слот M.2 E key 2230 (PCIe x1, USB 2.0, CNVi) для адаптера Wi-Fi. В оснащение входят звуковой кодек Realtek ALC897 HD Audio и двухпортовый сетевой контроллер 2.5GbE (Intel I226-LM). Кроме того, упомянут TPM-контроллер Infineon SLB9670VQ 2.0.

Источник изображения: MSI IPC Допускается вывод изображения одновременно на четыре независимых монитора через два выхода HDMI 2.0 (4096 × 2304 точки; 60 Гц) и два порта DP (7680 × 4320 пикселей; 60 Гц; USB Type-C). Предусмотрены два гнезда RJ45 для сетевых кабелей, два последовательных порта, аудиогнездо на 3,5 мм, шесть портов USB 2.0 Type-A, а также по два интерфейса USB 3.1 Type-A и USB 3.1 Type-С. Питание подаётся через DC-разъём. Устройство имеет размеры 196 × 285 × 29 мм и весит 2,22 кг. Говорится о защите от влаги и пыли по стандарту IP40. Диапазон рабочих температур простирается от -10 до +50 °C. Возможен монтаж посредством крепления VESA. Заявлена совместимость с Windows 10/11 IoT Enterprise и Linux.

17.04.2026 [22:53], Владимир Мироненко

ИИ-стартап Cerebras поставит OpenAI ускорители ещё на $20 млрдКомпания OpenAI заключила соглашение с ИИ-стартапом Cerebras, согласно которому она выплатит более $20 млрд в течение следующих трёх лет за поставку ИИ-ускорителей, сообщило издание The Information. В рамках сделки OpenAI получит варранты на миноритарную долю в Cerebras, при этом её доля может увеличиться по мере роста расходов, утверждают источники The Information. По их данным, OpenAI также согласилась предоставить Cerebras около $1 млрд для финансирования развёртывания ЦОД на базе её ИИ-ускорителей. До этого, в январе Cerebras договорилась с OpenAI о поставке в течение трёх лет своих ускорителей общей мощностью 750 МВт. Стоимость этой сделки оценивается в $10 млрд. Новое соглашение подчеркивает растущий интерес отрасли к вычислительным мощностям для инференса, отметило агентство Reuters. По его данным, Cerebras может раскрыть некоторые подробности своего соглашения с OpenAI, когда предоставит регулятору документы для проведения первичного публичного размещения (IPO). Исходя из общей суммы контрактов The Information допускает, что OpenAI может получить варранты, представляющие до 10 % доли в Cerebras. Сотрудничество с OpenAI является ключевым элементом в планах Cerebras по выходу на биржу, планирующего провести листинг во II квартале этого года. Cerebras, чья рыночная стоимость, по последним оценкам, составляет $23,1 млрд, планирует привлечь $3 млрд в ходе первичного публичного размещения акций в следующем месяце при оценке примерно в $35 млрд, сообщил The Information. Выход на биржу неоднократно откладывался. Сначала компанию подозревали в опосредованных связях с Китаем и зависимости от ближневосточных нефтедолларов, а потом компания дважды получила крупные инвестиции и нарастила капитализацию. Сделки с AWS и OpenAI укрепили её позиции и успокоили инвесторов. В пятницу Cerebras объявила о подаче заявки на первичное публичное размещение акций (IPO) в США. Компания планирует разместить свои акции на Nasdaq под тикером CBRS. Ведущими андеррайтерами размещения являются Morgan Stanley, Citigroup, Barclays и UBS. Ранее на этой неделе Morgan Stanley открыл Cerebras возобновляемую кредитную линию с доступом до $250 млн, с возможностью увеличения лимита до $850 млн после IPO, сообщил CNBC. Согласно документам, поданным в пятницу, среди инвесторов Cerebras — Alpha Wave, Benchmark, Eclipse, Fidelity и Foundation Capital. На сайте Cerebras также указан генеральный директор OpenAI Сэм Альтман (Sam Altman) в качестве инвестора. Cerebras указала в заявке, что не владеет ЦОД, которые использует для предоставления облачных услуг, но может построить собственные в будущем. В документе также сообщается, что чистая прибыль Cerebras за 2025 год составила $87,9 млн при выручке в $510 млн (рост год к году на 76 %). Компания получила прибыль в размере $1,38 на акцию, по сравнению с убытком в $9,90 на акцию годом ранее. По состоянию на 31 декабря 2025 года у Cerebras оставалось $24,6 млрд невыполненных обязательств, и ожидается, что 15 % этой суммы будет учтено в 2026 и 2027 годах.

17.04.2026 [08:43], Сергей Карасёв

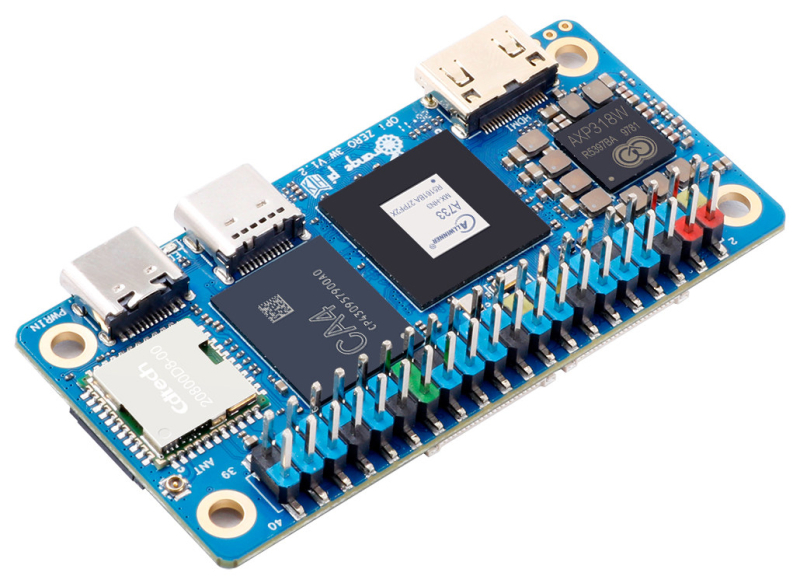

Одноплатный компьютер Orange Pi Zero 3W получил чип Allwinner A733 и до 16 Гбайт ОЗУСемейство одноплатных компьютеров Orange Pi пополнилось моделью Zero 3W, выполненной в форм-факторе Raspberry Pi Zero. Новинка построена на аппаратной платформе Allwinner, а в качестве ОС разработчики смогут использовать Orange Pi OS (Arch), Ubuntu, Debian и Android 15. Изделие имеет размеры 65 × 32 мм и весит 14 г. Установлен чип Allwinner A733, объединяющий два ядра Arm Cortex-A76 с частотой 2 ГГц, шесть ядер Arm Cortex-A55 с частотой 1,79 ГГц и ядро реального времени RISC-V E902 с частотой до 200 МГц. В состав изделия входят GPU Imagination Technologies BXM-4-64 MC1 с поддержкой OpenGL ES 3.2, Vulkan 1.3 и OpenCL 3.0, а также VPU-блок с возможностью декодирования видео 8Kp24 H.265/VP9/AVS2 и кодирования 4Kp30 H.265/H.264. Встроенный нейропроцессорный узел (NPU) обеспечивает быстродействие до 3 TOPS. В зависимости от модификации Orange Pi Zero 3W может нести на борту от 1 до 16 Гбайт LPDDR5-4800. Есть слот microSD, а опционально может быть добавлен флеш-модуль стандарта eMMC вместимостью 8–64 Гбайт или UFS 3.0 ёмкостью 32–128 Гбайт. В оснащение входят адаптеры Wi-Fi 6 и Bluetooth 5.4 (чип Cdtech 20800D8-00 плюс коннектор IPEX для антенны). Новинка располагает портами USB 3.1 OTG Type-C (DisplayPort 1.4 Alt. Mode) и USB 2.0 Type-C (служит для подачи питания), разъёмом Mini HDMI 2.0 с поддержкой 4Kp60, 40-контактной колодкой GPIO (UART, I2C, SPI, PWM), коннектором MIPI DSI (4 линии), двумя разъёмами MIPI CSI (4 линии), коннектором FPC (PCIe 3.0 x1) и 2-контактным разъёмом для вентилятора охлаждения. Цена начинается с $25 (в конфигурации с 1 Гбайт ОЗУ).

16.04.2026 [15:42], Руслан Авдеев

Правозащитники подали в суд на xAI, обвинив в незаконном использовании газовых турбинПравозащитная группа NAACP подала иск против компании xAI и её дочерней структуры MZX Tech, заявив, что подконтрольные компаниям газовые турбины в Южном Мемфисе используются незаконно. Утверждается, что 27 турбин, обеспечивающих энергей кампус Colossus 2, работают, нарушая Закон о чистом воздухе (Clean Air Act), сообщает Datacenter Dynamics. По оценкам NAACP, электростанция xAI в Саутхейвене (Southaven) способна выбрасывать более 1,7 тыс. т оксидов азота (NOx), 180 т мелкодисперсных частиц, 500 т окиси углерода и 19 т формальдегида ежегодно. xAI управляет дата-центрами в Мемфмсе и окрестностях с 2024 года, а для электроснабжения частично использует газовые турбины. По словам NAACP, неспособность компании получить разрешение на эксплуатацию того, что фактически является газовой электростанцией, расположенной вблизи жилых домов, школ и церквей, создаёт дополнительные риски для жителей Мемфиса и округи. Это нарушение Закона о чистом воздухе, в соответствии с которым крупные источники загрязнений должны получать разрешения на выбросы ещё до начала строительства и эксплуатации объектов. Интересы NAACP представляют юристы Southern Environmental Law Center (SELC) и Earthjustice. SELC заявила, что дальнейшая эксплуатация xAI турбин без разрешения и надлежащего контроля состояния окружающей среды — не просто незаконно, но и «безрассудно». xAI использует дата-центры в Теннесси и Миссисипи для обеспечения работы чат-бота Grok. В 2024 году в Мемфисе заработал суперкомпьютер Colossus в ЦОД, построенном на основе бывшего завода Electrolux. Площадку для Colossus 2 приобрели в марте 2025 года, а сам ЦОД ввели в эксплуатацию в январе 2026-го. Хотя заявлялось, что ЦОД Colossus 2 на момент запуска обеспечивал 1 ГВт мощности, спутниковые снимки показали, что система холодоснабжения объекта рассчитана лишь на 350 МВт. Уже ведутся работы по подготовке третьего кампуса ЦОД, расположенного в Саутхейвене. Ещё $659 млн компания потратит на строительство здания на соседнем земельном участке. Утверждается, что xAI, слившаяся со SpaceX, в конечном итоге получит 2 ГВт вычислительных мощностей, причём газовые турбины будут играть ключевую роль в питании ЦОД. В марте получено разрешение на установку 41 новой турбины. Новости о судебном иске появились спустя неделю после сообщения о прекращении строительства xAI водоочистной станции в Мемфисе. Ранее компания заявляла, что объект стоимостью $80 млн станет важным для города, он будет очищать воду для использования в дата-центрах xAI и на других предприятиях. Однако, по данным местных СМИ, работы приостановлены, а персонал направили на другие объекты. В ответ стоящий за проектами Илон Маск (Elon Musk) заявил о необходимости сосредоточиться на строительстве Colossus 2, а уже потом думать о переработке воды. Это уже второе сообщение об иске к xAI за последний год. На этот раз иск подан в штате Миссисипи. По-видимому, xAI попыталась повторить тот же трюк, что и в Теннеси, где формально турбины считаются временными источниками, для размещения которых не требуется разрешение, если они работают в течение 364 дней. При этом фактически объекты Colossus расположены на границе двух штатов.

16.04.2026 [09:36], Сергей Карасёв

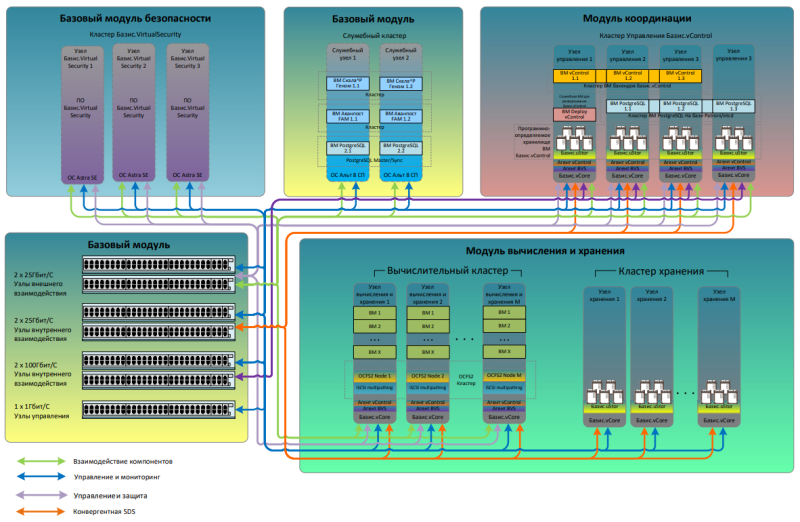

Представлен российский ПАК виртуализации «Скала^р МДИ.В» для высоконагруженных системГруппа Rubytech анонсировала программно-аппаратный комплекс (ПАК) «Скала^р МДИ.В» — это модульная платформа виртуализации для размещения высоконагруженных сервисов и бизнес-приложений, в том числе в доверенных защищённых контурах органов государственного управления. Система пришла на смену модели «Скала^р МВ.С». Новинка, как утверждается, обеспечивает производительность гиперконвергентной подсистемы хранения данных до 2 млн IOPS (операций в секунду) на один вычислительный узел. При этом допускается масштабирование без простоев — добавлять новые серверы и хранилища можно без остановки работы. Платформа совместима с разными типами хранилищ данных — как с классическими аппаратными СХД, так и с современными гиперконвергентными программно-определяемыми решениями. С аппаратной точки зрения «Скала^р МДИ.В» состоит из определённого набора различных функциональных блоков — базового модуля, а также модулей виртуализации, хранения, коммутации/вычисления/хранения, безопасности, координации и пр. Часть из них входят во все конфигурации, тогда как другие добавляются по требованию заказчика. Базовый модуль используется для обеспечения сетевой связанности между компонентами, служебных функций, а также для организации выделенной сети управления. Его типовые характеристики включают два процессора с 24 ядрами (2,1 ГГц), 512 Гбайт оперативной памяти, двенадцать SSD вместимостью 1,92 Тбайт каждый, порты 100GbE, 10/25GbE и пр.

Источник изображения: Rubytech Говорится о высокой надёжности: если один сервер выходит из строя, нагрузки автоматически переносятся на другой. Данные дублируются в разных местах, а в случае крупной аварии, например, отключения электричества в дата-центре, заказчик может быстро переключиться на резервные площадки в других регионах. Заявлено соответствие требованиям ФСТЭК России: новинка обеспечивает возможность хранения и обработки информации в государственных информационных системах до 1 класса защищённости включительно, в информационных системах при необходимости обеспечения 1 уровня защищённости персональных данных, значимых объектах критической информационной инфраструктуры 1-ой категории значимости. В составе программной части применяется платформа серверной виртуализации Basis Dynamix Standard. Все компоненты продукта протестированы на совместимость, а поддержка осуществляется по принципу «одного окна». Предусмотрены встроенные средства защиты «Базис.VirtualSecurity», Avanpost FAM и «Соболь». Управлять системой можно из единого центра через простой веб-интерфейс или программные инструменты «Скала^р Геном» и «Базис.vControl». Администраторы видят состояние всех серверов, хранилищ и виртуальных машин в одном окне и могут оперативно реагировать на любые изменения. Rubytech отмечает, что «Скала^р МДИ.В» функционирует в 5–6 раз быстрее аналогов при использовании современных технологий хранения данных (HCI-режим). ПАК подходит для работы с корпоративными системами, такими как ERP, CRM и базы данных. Кроме того, использовать решение можно для развёртывания ресурсоёмких сервисов и приложений, включая видеоаналитику и службы онлайн-трансляций.

15.04.2026 [17:54], Руслан Авдеев

Microsoft получит 30 тыс. ИИ-ускорителей NVIDIA Vera Rubin, от которых отказалась OpenAI, отменившая проект Stargate NorwayКомпании Microsoft и Nscale расширили партнёрство. Техногигант арендует у Nscale 30 тыс. ИИ-ускорителей NVIDIA Vera Rubin в норвежском ЦОД, которые изначально предназначались для проекта OpenAI Stargate Norway. Дополнительные вычислительные мощности станут доступны в 2027 году. Это фактически второй значимый отказ от развития кампусов Stargate в Европе. Ранее OpenAI приостановила создание ИИ ЦОД в Великобритании. А кампус Stargate в ОАЭ и вовсе находится под угрозой атак со стороны Ирана.

Источник изображения: Nscale По имеющимся данным, ускорители для Microsoft разместят в 230-МВт дата-центре в Квандале (Kvandal) в непосредственной близости от Нарвика (Narvik) на севере Норвегии. Площадка строится усилиями совместного предприятия норвежской промышленной группы Aker и Nscale. По некоторым данным, уход OpenAI из Норвегии был обусловлен неспособностью компании заключить взаимовыгодное соглашение с Nscale, передаёт Bloomberg. Тем не менее, OpenAI всё равно получит доступ к ИИ-мощностям в Норвегии посредством Microsoft Azure — компания так или иначе обязана потратить $250 млрд на облако Microsoft. В США OpenAI тоже отказалась от расширения флагманского кампуса Stargate в Техасе, и эти мощности тоже достанутся Microsoft. Microsoft уже имеет договорённости с Nscale, связанные с использованием норвежской площадки, в сентябре 2025 года было подписано соглашение об аренде мощностей на $6,2 млрд. Во сколько обойдётся новое, будет объявлено позже. Также компании уже подписали соглашения в Великобритании, Техасе и Португалии. Британские ЦОД Nscale тоже простаивать не будут — по данным Datacenter Dynamics, Google заключила сделку об аренде мощностей в Лондоне. Правда, это не те мощности, что изначально создавались для OpenAI.

15.04.2026 [09:16], Владимир Мироненко

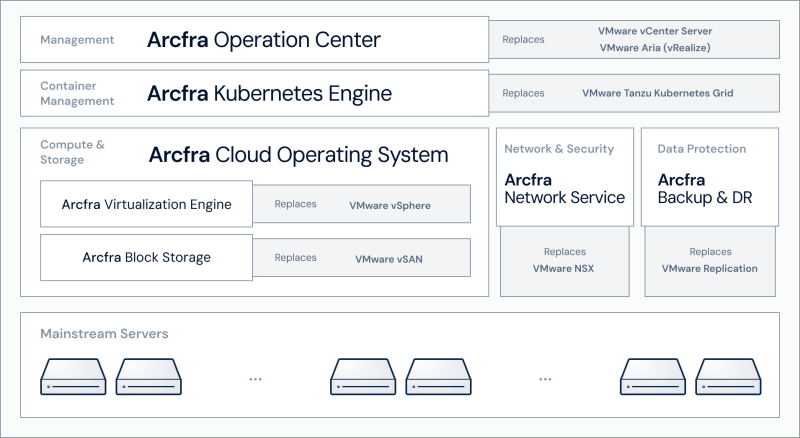

HCI-платформа Arcfra AECP обещает наполовину снизить TCO по сравнению с VMware VCFПосле приобретения VMware компанией Broadcom и последовавшим за этим изменением лицензионной политики, сопровождаемым ростом цен, компании начали отказываться от продуктов VMware, подыскивая более приемлемые по стоимости альтернативы. В качестве одной из них ресурс Blocks & Files назвал Arcfra Enterprise Cloud Platform (AECP) — полнофункциональное программно-определяемое инфраструктурное решение сингапурского стартапа Arcfra, которое даже успело попасть в подборку Market Guide for Full-Stack Hyperconverged Infrastructure Software от Gartner. Решение AECP ориентировано на корпоративные облачные платформы. Оно объединяет вычислительные ресурсы, хранилище данных, сети, виртуализацию, оркестрацию контейнеров (Kubernetes), безопасность и возможности аварийного восстановления в единый программный стек и поддерживает развёртывание в локальных ЦОД, на периферии, на колокейшн-площадках или в распределённых облаках. AECP построено на облачной операционной системе Arcfra (ACOS) с модульными компонентами, такими как Arcfra Virtualization Engine (AVE), Arcfra Network Storage (ABS) и Arcfra Kubernetes Engine. AECP версии 6.3 обеспечивает более 11 млн IOPS, более 130 ГиБ/с и задержку менее 100 мкс на кластере из трёх узлов. По словам компании, платформа позволяет снизить общую стоимость владения (TCO) более чем на 50 % по сравнению с решением VMware VCF. Blocks & Files полагает, что AECP и ACOS являются прямым развитием ПО компании SmartX, чей глобальный бизнес и интеллектуальную собственность приобрела Arcfra в 2024 году. SmartX продолжает работать в Китае, в то время как Arcfra фокусируется на деятельности за пределами Китая, в основном на Азиатско-Тихоокеанском регионе, предлагая клиентам альтернативу VMware, конкурирующую с решениями HPE Morpheus, Nutanix, Proxmox, Oracle Virtualization и Scale Computing. Среди её клиентов — Foxconn, платформы электронной коммерции Cafe24 и ConnectWave, а также банки, страховые компании и т.д. Arcfra также расширяет своё присутствие в Европе и Америке. В I квартале 2026 года Arcfra объявила о запуске Neutree, готовой к использованию open source платформы для организации MaaS (ИИ-модель как услуга). Эта платформа «объединяет управление моделями, инференс и рабочие процессы, чтобы сделать корпоративный ИИ более развёртываемым, управляемым и масштабируемым в реальных условиях».

12.04.2026 [17:47], Сергей Карасёв

Бизнес-компьютеры MSI Cubi NUC TWG с активным и пассивным охлаждением выполнены в 0,55-литровом корпусеКомпания MSI представила компьютеры небольшого форм-фактора Cubi NUC TWG, рассчитанные на использование в бизнес-сфере и коммерческом секторе. Устройства выполнены на аппаратной платформе Intel Twin Lake: покупателям будут предлагаться модификации с активным и пассивным (версия Cubi NUC TWG S) охлаждением. Новинки заключены в корпус объёмом всего 0,55 л с габаритами 135,6 × 112,6 × 40,1 мм. Предусмотрены конфигурации с чипом Intel Processor N150 (четыре ядра; до 3,6 ГГц; 6 Вт) и Intel Processor N250 (четыре ядра; до 3,8 ГГц; 6 Вт). Обе оборудованы одним слотом SO-DIMM для модуля оперативной памяти DDR5-4800 и одним коннектором M.2 2280 для SSD с интерфейсом PCIe 3.0 x4.

Источник изображений: MSI В оснащение входят сетевые контроллеры 1 GbE (Realtek RTL8111H) и 2.5GbE (Realtek RTL8125D), а также адаптер Intel WiFi 6E AX211 (плюс Bluetooth 5.3) или AzureWave AW-CB515NF Wi-Fi 5 (плюс Bluetooth 5.0). Питание обеспечивает внешний блок мощностью 65 Вт. Допускается монтаж посредством крепления VESA на стену или заднюю панель монитора.  Во фронтальной части Cubi NUC TWG расположены по два порта USB 3.1 Type-A и USB 2.0 Type-A, а также комбинированное аудиогнездо на 3,5 мм. Сзади находятся разъём USB 3.1 Type-C (DP 1.4 Alt. mode), два порта USB 2.0 Type-A, два гнезда RJ45 для сетевых кабелей, два интерфейса HDMI 2.1 с возможностью вывода изображения в формате 4K@60 и DC-гнездо. Устройства будут предлагаться в белом и чёрном вариантах цветового исполнения. Поддерживается технология MSI Power Link, которая позволяет включать мини-компьютер с помощью кнопки питания монитора: это особенно полезно в тех случаях, когда система закреплена на задней панели дисплея и дотянуться до её собственной кнопки питания непросто.

09.04.2026 [18:05], Владимир Мироненко

OpenAI приостановила проект Stargate в Великобритании из-за дорогой электроэнергию и неподходящих законовOpenAI приостановила проект Stargate в Великобритании, анонсированный в сентябре в партнёрстве с неооблаком Nscale и NVIDIA, поскольку нормативно-правовая среда страны и высокая стоимость электроэнергии не способствуют его реализации. Компания не отказывается от проекта Stargate UK целом, но ждёт, когда появятся «подходящие условия, которые позволят осуществить долгосрочные инвестиции в инфраструктуру», — заявил представитель OpenAI ресурсу CNBC. CNBC отметил, что цены на промышленную энергию в Великобритании — одни из самых высоких в мире, что наряду со сложностями с получением разрешения на подключение к национальной электросети является ключевым препятствием для развития ИИ-инфраструктуры в стране. К тому же местные законодатели стремятся разработать новые правила по поводу использования защищённого авторским правом контента в ИИ-моделях. Впрочем, по словам источника, непосредственно знакомого с ситуацией, OpenAI и Nscale всё ещё ведут переговоры о будущем проекте. В июле 2025 года OpenAI подписала меморандум о взаимопонимании (MOU) с правительством Великобритании, планируя разместить вычислительные мощности в нескольких локациях. Первый ЦОД компания хотела развернуть на территории бизнес-парка Cobalt Park в английском Ньюкасле (Newcastle), который относится к Зоне развития ИИ (AI Growth Zone). OpenAI намеревалась развернуть 8 тыс. ИИ-ускорителей в начале 2026 года, а затем увеличить их количество до 31 тыс. Этих мощностей было бы достаточно для использования ИИ-моделей OpenAI в работе критически важных государственных сервисов, в регулируемых отраслях, например, финансовой, и партнёрства в сфере национальной безопасности. В марте сообщалось, что Великобритания собиралась отложить изменения в своих правилах авторского права, которые упростили бы использование медиаконтента ИИ-компаниями, из-за возражений создателей контента. В опубликованном правительством докладе об авторском праве и ИИ было отмечено, что большинство респондентов, участвовавших в публичных консультациях, «отклонили первоначальное предпочтительное предложение: широкое исключение с возможностью отказа». «Многие отклики поступили от представителей креативных индустрий, которые опасались, что такой подход позволит генеративному ИИ учиться на их работах без компенсации и конкурировать с ними», — говорится в докладе. Несмотря на приостановку проекта, представитель OpenAI заявил об огромном потенциале для будущего ИИ в Великобритании. «В Лондоне находится наш крупнейший международный исследовательский центр, и мы поддерживаем стремление правительства стать лидером в области ИИ», — сообщил он, добавив, что компания продолжает расширять своё присутствие в стране, а также выполнять обязательства в рамках меморандума о взаимопонимании с правительством. Примечательно, что ранее OpenAI наняла бывшего канцлера британского Казначейства для глобального расширения проекта Stargate. |

|