Материалы по тегу: ff

|

12.05.2026 [09:35], Сергей Карасёв

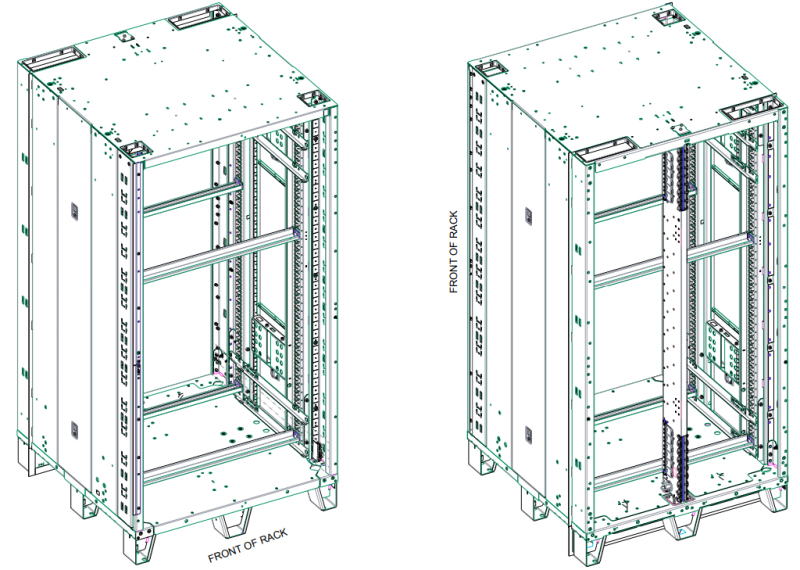

Meta✴ готовит пятитонные ИИ-стойки с чипами AMDНекоммерческая организация Open Compute Project (OCP) обнародовала спецификацию серверных стоек Open Rack Wide (ORW) от Meta✴, которая дополняет более общую базовую спецификацию. Стойки разработаны для дата-центров, ориентированных на ИИ и НРС, разработанную Meta✴ и дополняющую базовый вариант стандарта. Стандарт ORW положен в основу платформы AMD Helios. Габариты стоек ORW составляют 2390 мм в высоту, 1219 мм в глубину и 1200 мм в ширину. Таким образом, стойка ORW вдвое шире стандартных стоек Open Rack V3 (600 мм). Конструкция ORW рассчитана на плотное размещение тяжёлого оборудования — крупногабаритных серверов с GPU-ускорителями, мощных СХД и пр. Грузоподъёмность рамы должна составлять 4700 кг (без учёта массы собственно стойки). Подчёркивается, что на показатель влияет множество факторов, включая пространственное распределение IT-оборудования, количество и расположение поперечных распорок и пр. Любые дополнительные элементы, установленные в стойку, необходимо учитывать при расчёте максимальной грузоподъёмности. ORW-стойка рассчитана на 44OU-единицы для узлов удвоенной ширины или 47U для 19″ узлов. Возможно комбинирование различных типов оборудования — конструкция стойки предусматривает наличие вырезов для кронштейнов крепления серверов обоих типов. Также прописана поддержка обычных 21″ шасси, в этом случае ёмкость стойки составляет 88OU. Интересно, что NVIDIA в стойках Kyber перейдёт к вертикальным узлам. Впрочем, компания наверняка тоже отдаст спецификации OCP, как это было со стойкой Oberon. В стойках ORW обеспечивается циркуляция воздуха от фронтальной области к тыльной. В обычных условиях эксплуатации в верхней, нижней и боковых частях не предусмотрены отверстия, через которые горячий воздух может проникать в холодный коридор дата-центра. Конструкция должна включать передний и задний каналы для организации кабелей, которые могут укладываться вертикально во всех четырёх углах рамы. В спецификации сказано, что доступ к высоковольтным линиям на шине постоянного тока должен быть исключен, если она подключена к IT-оборудованию. Стойки ORW совместимы с различными конструкциями шин питания — как с воздушным, так и с жидкостным охлаждением. Интерфейс шинопровода аналогичен ORv3 HPR (High Power Rack). Предполагаемое номинальное входное напряжение, обеспечиваемое модулем питания ORv3, составляет 51 В DC. Вся подсистема питания IT-оборудования должна поддерживать входные напряжения в диапазоне от 46 В до 52 В. Требуются датчики напряжения и температуры, силовой (100 А) и обратный (100 А) каналы, а также заземление. Типовая мощность — до 4,8 кВт на коннектор (узел). Нужно отметить, что OCP продвигает перевод дата-центров на DC-питание. Предполагается, что такая архитектура позволит повысить плотность и энергоэффективность вычислений. Концепция предусматривает возможность выделение подсистемы питания в отдельную стойку и переход к 400/800 В DC с выносом AC/DC-преобразование AC/DC за пределы машинных залов. Передачу энергии планируется осуществлять через общую DC-шину, соединяющую все стойки, или по отдельным кабелям (либо комбинированно). Между тем перед операторами ИИ-дата-центров встаёт проблема, связанная с ростом массы IT-оборудования. Современные стойки 42U с набором серверов весят 680–1150 кг, а для ORW предусмотрена нагрузка до почти 5 т. Из-за этого возникают сложности с обустройством полов и перекрытий. Из-за большой массы оборудования многие операторы предпочитают строить одноэтажные дата-центры вместо многоэтажных. Хотя как раз для ИИ-кластеров с точки зрения интерконнекта эффективнее именно последние. Однако для Meta✴, возможно, важнее скорость развёртывания — она даже обходится без капитального строительства.

11.05.2026 [23:59], Руслан Авдеев

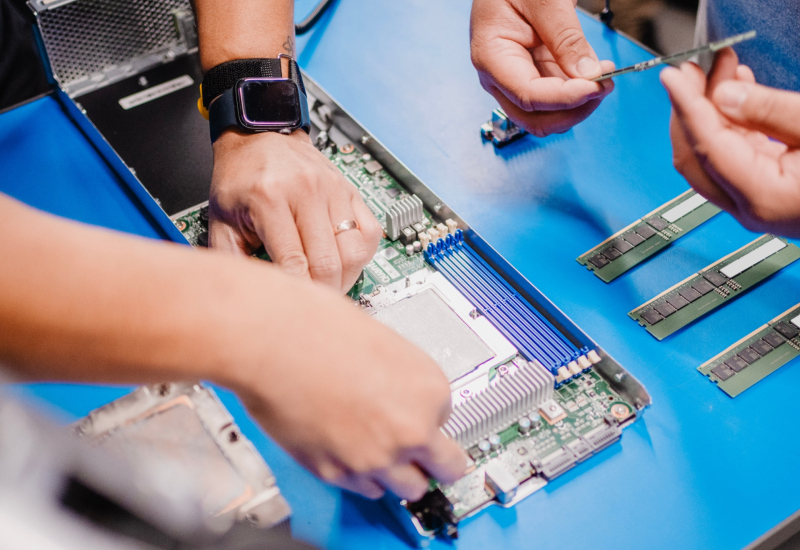

Meta✴ пришлось продлить срок службы серверов из-за дефицита памятиMeta✴ вынуждена продлить срок эксплуатации некоторых из своих серверов общего назначения из-за дефицита DRAM с шести до семи лет, сообщает The Wall Street Journal со ссылкой на внутреннюю документацию техногиганта, где говорится о том, что компания не ожидала существенного дефицита поставок оборудования, в основном именно из-за нехватки оперативной памяти, а также жёстких дисков. Предполагается, что дефицит продлится минимум до 2027 года. Ежегодно компания инвестирует огромные средства в инфраструктуру ЦОД и является одним из крупнейших заказчиков серверного оборудования в мире. Однако даже увеличение капзатрат до $125–$145 млрд в этом году не позволяет обновлять серверы прежними темпами. Внутренне моделирование Meta✴ показало, что увеличение срока эксплуатации серверов компании увеличит ожидаемую годовую интенсивность отказов (AFR) с 4,8 % до 7,4 % ежегодно. Такой риск считается приемлемым, хотя до восьми лет срок службы оборудования решили не продлевать. 95 % мирового выпуска DRAM приходится на Samsung Electronics, SK hynix и Micron Technology, которые в последние полтора года делают ставку на увеличение выпуска HBM для ИИ-ускорителей, поскольку такая память значительно маржинальнее обычной серверной DRAM. По оценкам IDC, речь может идти уже не о временном, «циклическом» дефиците, а о стратегическом перераспределении производственных ресурсов. Согласно прогнозам, на HBM в 2026 году придётся порядка 25 % выпуска всех пластин DRAM, спрос на неё растёт приблизительно на 70 % ежегодно.

Источник изображений: Meta✴ В результате цена DDR5 и других модулей резко выросла. Впрочем, с другими компонентами ситуация не лучше. Western Digital уже распродала даже не выпущенные HDD, у Seagate дела тоже идут отлично (для неё самой), а время поставок некоторых моделей серверных процессоров выросло до полугода. Таким образом, один из ключевых мировых покупателей серверного оборудования, в отличие от многих экспертов, не полагается на падение цен на память и другие компоненты к концу 2026 года, а предпочитает увеличить срок эксплуатации уже развёрнутого оборудования. Для более мелких покупателей это может служить сигналом всё более серьёзных проблем с закупками в обозримой перспективе. Если получить достаточно памяти по приемлемой цене не рассчитывает гиперскейлер, прочие могут столкнуться с более длительными сроками поставок, частичным выполнением заказов и значительным ростом цен. Вполне может оказаться, что продление сроков службы оборудования — оптимальный сценарий не только для Meta✴, что, помимо прочего, приведёт к переносу капитальных затрат и замедлению внедрения более энергоэффективных и высокопроизводительных платформ. Более того, дефициту HDD и SSD уделяется намного меньше внимания, чем нехватке DRAM, что, по-видимому, является ошибкой при планировании закупок. Массовая скупка HDD и рост цен на NAND оставляют всё меньше места для манёвра при формировании инфраструктуры для хранения данных. По мнению экспертов, новые производственные мощности для модулей памяти заработают ещё нескоро, и дефицит может постепенно снизиться в 2027–2028 гг., когда свои плоды начнут приносить инвестиции 2024–2025 гг. В качестве временной меры возможно повышение эффективности использования имеющегося оборудования программными средствами. Например, NVIDIA анонсировала новое ПО для мониторинга и продления жизни ИИ-ускорителей в ЦОД. С другой стороны, индустрия не в первый раз прибегает к увеличению сроков службы оборудования. Так поступали Microsoft, Google, CloudFlare, Scaleway и др.

05.05.2026 [23:05], Владимир Мироненко

Micron 6600 ION: самый ёмкий в мире QLC SSD вместимостью 245 ТбайтMicron объявила о начале поставок SSD Micron 6600 ION ёмкостью 245 Тбайт, который позиционируется компанией как самый ёмкий из доступных на рынке SSD в мире. Он предназначен для поддержки рабочих ИИ-нагрузок, облачных вычислений, корпоративных задач, включая хранилища данных следующего поколения для ИИ и облачные файловые и объектные хранилища. Новый SSD основан на фирменной 276-слойной памяти G9 QLC NAND. Он доступен в форматах U.2 и E3.L с ёмкостью 30,72/61,44/22,88/245,76 Тбайт, причём самый ёмкий вариант выпускается именно в формате E3.L. 245-Тбайт модель обеспечивает скорость последовательного чтения и записи до 13,7 Гбайт/с и 3,0 Гбайт/с соответственно, а также до 1,78 млн 48 тыс. IOPS при случайном чтении и записи соответственно. Накопитель использует однопортовый интерфейс PCIe 5.0 x4 и соответствует стандартам OCP 2.6, NVMe 2.0d, NVMe-MI 1.2d. Максимальное энергопотребление не превышает 30 Вт. Новинка в большей степени рассчитана на сценарии чтения, поскольку при последовательной записи заявленный уровень надёжности составляет 1 DPWD, а при случайной 4K-блоками — 0,075 DWPD. Впрочем, её сильная сторона — это как раз высокая ёмкость. Так, для достижения эквивалентной ёмкости хранения с использованием E3.L-версии на 245 Тбайт потребуется на 82 % меньше стоек, чем при использовании HDD. В 1U-шасси в этом случае можно получить более 3,9 Пбайт, а в 36U-стойке — 176,9 Пбайт. Как отметил ресурс Servethehome, преимущество нового SSD заключается не только в высокой ёмкости, но и в форм-факторе EDSFF, который делает практичными гораздо более плотные полки для хранения данных. В рекламных материалах Micron сообщается, что при развёртывании 1 Эбайт ёмкости с использованием 245,76-Тбайт E3.L-накопителей потребуется в 5,6 раза меньше места, чем для 44-Тбайт HDD. В итоге для одного и того же набора данных потребуется меньше шасси, меньше стоек и меньше вспомогательной инфраструктуры. По словам Micron, в сравнении с жёсткими дисками для ИИ-нагрузок Micron 6600 ION ёмкостью 245 Тбайт обеспечил до 84 раз лучшую энергоэффективность, в 8,6 раза более быструю предварительную обработку ИИ и в 3,4 раза большую пропускную способность при приёме данных, а также до 29 раз меньшую задержку. Для объектного хранения те же накопители продемонстрировали до 435 раз большую пропускную способность на Ватт, в 96 раз более быстрое время до первого байта и в 58 раз большую суммарную пропускную способность. А для развёртывания 1 Эбайт в случае HDD потребуется в 1,9 раза больше энергии по сравнению с накопителями 245-Тбайт SSD Micron. Хотя Micron утверждает, что Micron 6600 ION является самым ёмким коммерчески доступным SSD в мире, конкурентам есть что предложить. Так, Kioxia анонсировала SSD LC9 ёмкостью 245,76 Тбайт с интерфейсом PCIe 5.0, а Sandisk в августе прошлого года анонсировала UltraQLC SN670 объёмом до 256 Тбайт, поставки которого начнутся в I половине этого года. Как отметил ресурс Blocks & Files, ожидается, что Samsung и SK hynix/Solidigm представят сопоставимые по ёмкости накопители позже в этом году.

03.05.2026 [00:20], Владимир Мироненко

Meta✴ увеличила прогноз по капзатратам на год из-за роста цен и затрат на ЦОДАкции Meta✴ Platforms упали на 7 % на внебиржевых торгах после публикации отчёта о финансовых результатах за I квартал 2026 года, завершившийся 31 марта, несмотря на то что её показатели превысили прогнозы Уолл-стрит. Как полагают аналитики ресурса SiliconANGLE, инвесторов обеспокоило снижение ежедневной посещаемости сервисов, а также пересмотр в сторону увеличения капитальных затрат. Отчёт компании показал, что её капитальные расходы продолжают расти, без указания чёткого предела, а генеральный директор публично заявил о намерении предоставить «сверхинтеллект миллиардам пользователей». Снижение темпов роста числа пользователей, которое компания объяснила перебоями в работе интернета в Иране и ограничением доступа к мессенджеру WhatsApp в России, усилило опасения инвесторов.

Источник изображений: Meta✴ Meta✴ сообщила о выручке за I квартал в размере $56,31 млрд, что больше год к году на 33 %, и выше консенсус-прогноза аналитиков, опрошенных LSEG, в размере $55,45 млрд. Скорректированная прибыль на акцию составила $7,31 против $6,79 согласно прогнозу от LSEG (по данным CNBC). Капитальные затраты составили $19,84 млрд, что ниже среднего прогноза аналитиков, опрошенных StreetAccount, в $27,57 млрд. При этом компания повысила прогноз по капзатратам со $115–$135 млрд до диапазона $125–$145 млрд, объяснив корректировку ростом цен на компоненты и дополнительными затратами на ЦОД для поддержки будущих вычислительных мощностей. Расходы на R&D выросли на 46 %, до $17,70 млрд, что стало самым большим увеличением расходов, отражающим продолжающиеся инвестиции в ИИ-инфраструктуру и Meta✴ Superintelligence Labs, недавно созданное исследовательское подразделение компании в области ИИ. При этом Amazon, Google и Microsoft тоже тратят значительные средства на ИИ ЦОД, исследования и разработки, однако все она напрямую зарабатывают на этом, предлагая ИИ-сервисы и облачные мощности сторонним заказчикам. Прогноз выручки Meta✴ на II квартал примерно соответствует ожиданиям Уолл-стрит. Компания прогнозирует продажи в диапазоне от $58 до $61 млрд, в то время как аналитики ожидают выручку в $59,5 млрд. Средний показатель роста составит около 25 %. «У нас был знаменательный квартал с сильным ростом во всех наших приложениях и выпуском нашей первой модели от Meta✴ Superintelligence Labs, — сообщил основатель и генеральный директор Марк Цукерберг (Mark Zuckerberg) в пресс-релизе компании. — Мы на пути к тому, чтобы предоставить персональный сверхинтеллект миллиардам людей».

02.05.2026 [13:43], Руслан Авдеев

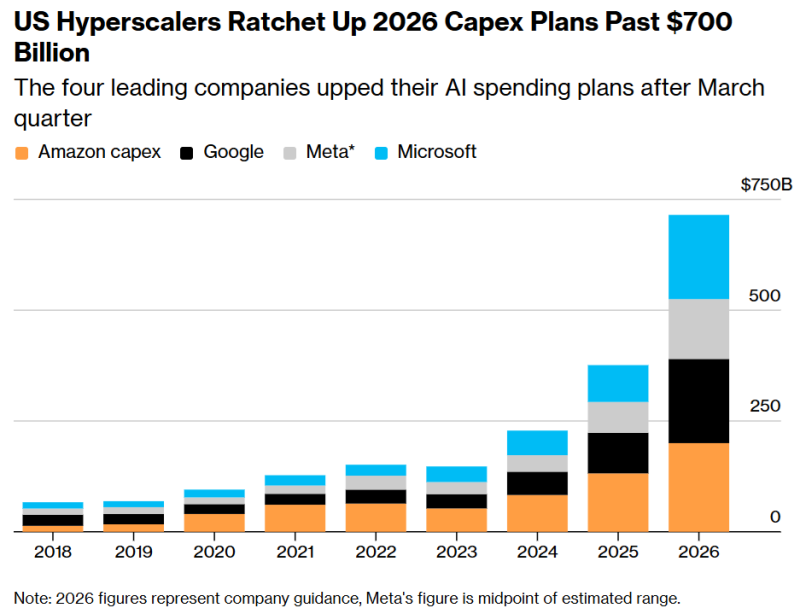

«Большая четвёрка» гиперскейлеров увеличит капзатраты до $725 млрдКапитальные вложения американских техногигантов, направленные на технологии и решения в сфере искусственного интеллекта, в 2026 году составят $725 млрд. В основном средства будут направлены на оборудование для ИИ ЦОД, сообщает Bloomberg. Так, Meta✴ Platforms и Alphabet повысили прогнозы капитальных затрат на год, а Microsoft дала прогноз оценки соответствующих расходов до конца декабря впервые, они должны составить $190 млрд, что сопоставимо с прогнозируемыми расходами Alphabet. Единственным из гиперскейлеров, оставившим прогнозы без изменений, оказалась компания Amazon. Её расходы останутся на уровне $200 млрд, хотя в I квартале компания сообщала о значительном росте расходов, сократившем её свободный денежный поток. По словам главы Meta✴ Марка Цукерберга (Mark Zuckerberg), компания повышает прогноз капитальных затрат на инфраструктуру на текущий год. По его словам, компания увеличила верхнюю границу планового диапазона расходов до $145 млрд. В основном это связано с более высокими затратами на комплектующие, в первую очередь — память. Тем не менее все признаки по словам Цукерберга в отрасли в целом и в компании в частности вселяют уверенность в инвестициях. Увеличение капитальных расходов подкрепляется финансовыми результатами четырёх гиперскейлеров — они соответствовали ожиданиям по ряду показателей или даже превосходили их. Однако у Amazon и Alphabet они оказались более впечатляющими, чем у Meta✴. Расходы последней эксперты также оценили как более рискованные, чем у конкурентов, предоставляющих доступ к облачным сервисам. Если те могут сдавать в аренду избыточные облачные мощности, у Meta✴ подобных доходов нет и не предвидится. Примечательно, что ещё в феврале цифры были намного скромнее. По данным Bloomberg, капитальные затраты на ИИ составят «всего» $650 млрд. В такой гонке кроется немалая опасность. По данным Bain Global Technology Report к 2030 году компаниям в сфере ИИ потребуется $2 трлн совокупной годовой выручки для покрытия затрат на вычислительные мощности, необходимые для удовлетворения прогнозируемого спроса. Но их выручка, вероятно, будет на $800 млрд меньше этой суммы.

24.04.2026 [18:10], Руслан Авдеев

Meta✴ уволит 8 тыс. человек, чтобы вложиться в ИИ — Microsoft попросит 9 тыс. уволиться добровольноТехногиганты тысячами сокращают сотрудников. Meta✴ рассчитывает уволить значительную часть персонала, а Microsoft предлагает уволиться самостоятельно. Это происходит на фоне ужесточения конкуренции за первенство на рынке ИИ-решений, стремительного роста зарплат специалистов в области ИИ и увеличения капитальных затрат на ИИ ЦОД, передаёт Bloomberg. Сокращения в Meta✴ коснутся приблизительно 8 тыс. сотрудников, это около 10 % штата компании. Meta✴ официально подтвердила давно ходившие слухи о сокращениях. Правда, в марте источники Reuters говорили о сокращении пятой части штата. Ожидается, что высвободившиеся средства потратят на приоритетные сферы деятельности, а агентство Bloomberg недавно сообщало, что компания не намерена заполнять около 6 тыс. вакантных должностей. Meta✴ уже проинформировала инвесторов, что в 2027 году её расходы составят $162–$169 млрд (€143-150 млрд), а капитальные затраты, связанные с ИИ, в 2026 году должны составить от $115 до $135 млрд. Это связано с тратами на инфраструктуру и растущими зарплатами, предлагаемыми специалистам по ИИ. По данным экспертов Wedbush, Meta✴ использует ИИ-инструменты для автоматизации задач, ранее требовавших больших команд, что даёт компании возможность оптимизировать операции с сокращением затрат и сохранением производительности. Также растёт потребность в «более компактной» рабочей инфраструктуре.

Источник изображения: Jon Tyson/unsplash.com В четверг о намерении избавиться от тысяч сотрудников в США объявила и компания Microsoft. Однако она предлагает выплату компенсаций за добровольные увольнения. По данным источников, знакомых с планом компании, в начале мая техногигант предложит уволиться приблизительно 8750 сотрудникам, это около 7 % американского персонала. По данным CNBC, уволиться будут предлагать тем, у кого сумма возраста и стажа составляет 70 и более лет, но на топ-менеджеров это не распространяется. Microsoft решила не прибегать к более «грубым» методам массовых увольнений, какие используют Meta✴ и Oracle, но даёт возможность покинуть компанию «на собственных условиях». Впрочем, необходимость сокращений, вероятно, и в этом случае обусловлена огромными затратами на создание ИИ-инфраструктуры. В 2026 финансовом году капитальные затраты компании должны составить $120 млрд, а то и $160 млрд. На содержание растущей сети ЦОД и сопутствующие расходы вроде инструментов вроде Copilot компания Microsoft потратила миллиарды долларов. По данным CNBC, получившего образцы внутренней переписки топ-менеджмента Microsoft, бизнес «желает предоставить имеющим на это право сотрудникам «возможность сделать новый шаг на своих собственных условиях при щедрой поддержке со стороны компании».

24.04.2026 [17:11], Сергей Карасёв

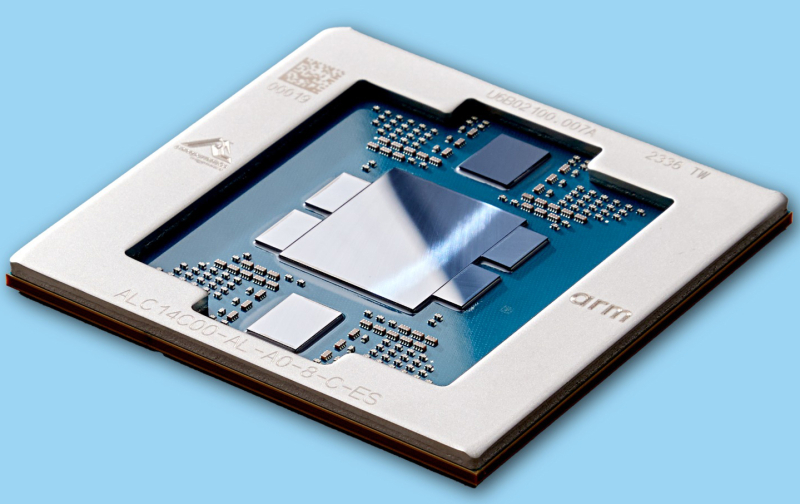

Meta✴ возьмёт на вооружение «десятки миллионов» Arm-ядер AWS Graviton5Компания Meta✴, по сообщению The Register, объявила о расширении сотрудничества с облаком AWS. Речь идёт об использовании Arm-процессоров Graviton5 для поддержания определённых ИИ-нагрузок, в частности, агентных систем. Сама AWS говорит о невероятном спросе на собственные процессоры. Крупным заказчиком является, например, Uber. AWS представила чипы Graviton5 в конце прошлого года. Эти изделия содержат 192 ядра Neoverse V3 (Poseidon), каждое из которых имеет 2 Мбайт кеша L2. Общий объём L3-кеша составляет 192 Мбайт. Присутствуют 12 каналов памяти DDR5-8800. Утверждается, что прирост производительности достигает 25 % по сравнению с процессорами Graviton предыдущего поколения. Meta✴ намерена использовать для своих задач «десятки миллионов» ядер Graviton5. Таким образом, компания станет одним из крупнейших клиентов, применяющих чипы собственной разработки AWS. Руководитель отдела инфраструктуры Meta✴, заявил, что сотрудничество с AWS направлено на диверсификацию вычислительных ресурсов. По его словам, это необходимо в свете реализации масштабных проектов в области ИИ. Ранее Meta✴ объявила о стратегическом партнёрстве с компанией Arm Holdings, которое направлено на «масштабирование эффективности ИИ на каждом уровне вычислений, охватывающем ПО и инфраструктуру ЦОД». В частности, Meta✴ намерена использовать чипы Arm AGI, специально оптимизированные для агентного ИИ. Однако, как уточняет The Register, эти изделия начнут поступать в дата-центры Meta✴ не ранее конца текущего года, поэтому компания пока будет разворачивать соответствующие нагрузки на базе Graviton5 в облаке AWS. Аналитики Counterpoint Research прогнозируют, что к 2029 году на Arm-решения будет приходиться до 90 % рынка серверных ASIC-изделий, ориентированных на ИИ. Между тем сама Meta✴ проектирует фирменные ИИ-ускорители MTIA, которые в зависимости от модификации могут применяться для обучения моделей, инференса и пр.

22.04.2026 [14:14], Сергей Карасёв

Meta✴ зарезервировала 100 ГВт·ч ёмкости для хранения энергии на базе инновационных накопителей Noon EnergyКомпания Meta✴, по сообщению Datacenter Dynamics, заключила соглашение о сотрудничестве с американской фирмой Noon Energy, специализирующейся на разработке систем долговременного хранения энергии нового поколения. По условиям договора, Meta✴ зарезервировала до 100 ГВт·ч ёмкости (1 ГВт мощности) для своих дата-центров. Технология Noon Energy предполагает использование системы твердооксидных топливных элементов (SOFC) с обратимым действием. Энергия, поступающая от возобновляемых источников, например, солнечной или ветровой станции, запасается в химическом накопителе. Затем при пиковых нагрузках или при падении генерации из-за погодных условий происходит обратное преобразование запасенной химической энергии в электрическую, которая подается в сеть. Решение Noon Energy обеспечивает ряд существенных преимуществ перед альтернативными методами. В частности, вместо дорогостоящих материалов, таких как литий, применяется углеродсодержащее вещество. Заявленная стоимость хранения составляет менее $20/кВт·ч. Накопители нового типа при сопоставимой ёмкости в три раза компактнее и легче, чем литий-ионные батареи, и занимают в 20–200 раз меньше площади, чем другие стационарные системы. При этом платформа Noon Energy обеспечивает 100 и более часов непрерывной генерации электричества. Более того, у некоторых прототипов этот показатель достигает 200 часов. В рамках соглашения Noon Energy на первом этапе предоставит компании Meta✴ систему хранения энергии ёмкостью 2,5 ГВт·ч и мощность 25 МВт: реализация этого проекта запланирована на 2028 год. В дальнейшем ресурсы будут постепенно наращиваться. Новая система дополнит другие энергетические ресурсы Meta✴, в число которых входят газовые генераторы, геотермальные источники, атомные станции, солнечные фермы и пр.

21.04.2026 [00:10], Владимир Мироненко

Meta✴ бесплатно обучит американцев работе с волоконно-оптическими сетями, чтобы побыстрее развернуть свои ИИ ЦОДMeta✴ объявила о запуске бесплатной четырёхнедельной программы LevelUp Fiber Technician Pathway по подготовке специалистов в сфере волоконно-оптических сетей, призванной восполнить критический дефицит квалифицированных кадров. Управлять реализацией многолетней инициативы будет CBRE, занимающаяся недвижимостью и услугами в сфере критической инфраструктуры. Ожидается, что первые специалисты начнут обучение этим летом. Кадры Meta✴ действительно нужны — на одни только оптоволоконные кабели Corning она потратит $6 млрд, и кто-то их должен проверить, проложить и подключить. Meta✴ отметила, что сфера специалистов по ВОЛС — и строительная отрасль в целом — сталкивается с общенациональным дефицитом в то время, когда спрос на ЦОД высок как никогда. Программа призвана помочь участникам получить необходимые технические навыки для успешной работы на востребованных должностях специалистов по ВОЛС как в строительной отрасли, так и в сфере ЦОД. После завершения обучения они получат возможность работать на строительных площадках компании в США через сеть её подрядчиков. Похожие программы есть у других гиперскейлеров. Например, Google в последнее время вкладывается в обучение электриков.

Источник изображения: Meta✴ «Будущее революции в области ИИ зависит от высококвалифицированной рабочей силы в США — той, которая способна справиться с созданием и поддержанием сложных систем, обеспечивающих инновации. Meta✴ гордится тем, что инвестирует в обучение технических специалистов для поддержки наших амбициозных целей в области инфраструктуры», — заявила Meta✴. В настоящее время Meta✴ эксплуатирует или строит 27 ЦОД в США. С 2010 года эти проекты обеспечили более 30 тыс. рабочих мест для квалифицированных специалистов на время строительства и более 5 тыс. постоянных рабочих мест.

15.04.2026 [16:37], Руслан Авдеев

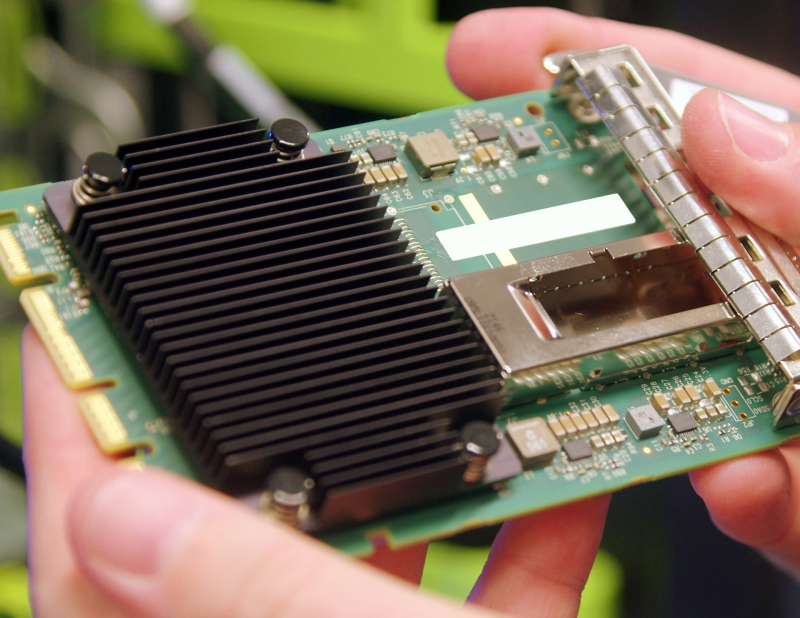

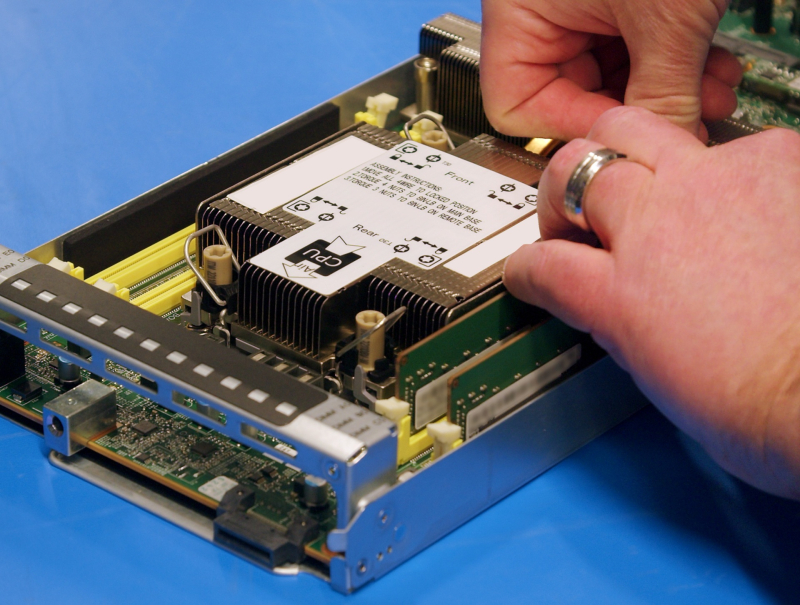

Broadcom поможет Meta✴ в создании нескольких поколений ИИ-ускорителейMeta✴ объявила о заключении нового соглашения с Broadcom. Оно расширяет уже имеющееся партнёрство, направленное на разработку собственных ИИ-ускорителей для IT-гиганта, сообщает Silicon Angle. На начальном этапе Meta✴ планирует развернуть собственные ускорители общей мощностью 1 ГВт для обучения ИИ-моделей и инференса. В конечном итоге партнёры планируют развернуть ускорители на основе технологий Broadcom совокупной мощностью несколько гигаватт. Отдельно Broadcom подчеркнула, что новые чипы MTIA — первые в ИИ-индустрии, использующие 2-нм техпроцесс. По словам главы Meta✴ Марка Цукерберга (Mark Zuckerberg), в MTIA будут использоваться наработки Broadcom в сфере проектирования, упаковки и сетевых решений. Ранее сообщалось, что Meta✴ столкнулась с трудностями при выпуске новых чипов MTIA, но Broadcom опровергла эту информацию, заявив, что поставки уже осуществляются, а для следующего поколения XPU планируется масштабировать производство.

Источник изображения: Meta✴ В марте Meta✴ объявила о разработке четырёх новых вариантов MTIA. Первую версию чипа представили ещё в 2023 году. MTIA дают определённую независимость от дорогостоящих и труднодоступных моделей NVIDIA и AMD. Как и чипы Google и AWS, они представляют собой специализированные ASIC, меньше и дешевле классических ИИ-ускорителей — но их вполне достаточно для выполнения узкого круга задач. Google представила свои первые TPU задолго до бума ИИ, ещё в 2015 году. В 2018 году Amazon представила первые чипы Trainium. Обе компании полагались на технологии Broadcom для разработки своих продуктов. В последние месяцы Broadscom анонсировала ряд сделок, касающихся своих кастомных XPU. Так, Anthropic получит Google TPU на 3,5 ГВт, часть чипов будет поставляться самой Broadcom. Кроме того, Broadcom помогает Fujitsu в создании 2-нм процессора MONAKA. В 2026 году Meta✴ анонсировала ряд многомиллиардных сделок по закупке ИИ-ускорителей в рамках обязательства выделить более $135 млрд на капитальные затраты в 2026 финансовом году. Ранее она обязалась использовать 6 ГВт ИИ-ускорителей AMD, миллионы чипов NVIDIA, а также чипы, совместно разработанные с Arm. Кроме того, компания намерена потратить миллиарды долларов на аренду ускорителей у CoreWeave и Nebius. |

|