Материалы по тегу: xeon

|

27.04.2026 [13:35], Сергей Карасёв

«Гравитон» представил российские серверы на базе Intel Xeon для облаков, виртуализации и ИИ

emerald rapids

gpu

granite rapids

hardware

intel

sapphire rapids

sierra forest

xeon

гравитон

сделано в россии

сервер

Российский разработчик и производитель вычислительной техники «Гравитон» представил шесть серверов на аппаратной платформе Intel, предназначенных для реализации масштабных IT-проектов в сегментах, где наличие техники в реестре Минпромторга РФ не является обязательным требованием. В зависимости от модификации устройства подходят для решения различных задач — от облачных сервисов и виртуализации до нагрузок ИИ и НРС. В частности, дебютировали модели СН2124И5 и СН2127И5 в форм-факторе 4U и 7U соответственно. Они рассчитаны на два процессора Xeon Sapphire Rapids или Xeon Emerald Rapids с TDP до 350 Вт. Поддерживается до 8 Тбайт оперативной памяти DDR5 в виде 32 модулей. У сервера СН2124И5 слоты расширения выполнены по схеме 10 × PCIe 5.0 х16 FHFL + 1 × OCP NIC. Есть 12 фронтальных отсеков для LFF-накопителей NVMe/SATA/SAS и два коннектора M.2 2280/22110 (PCIe 5.0). Возможна установка восьми GPU с энергопотреблением до 350 Вт. В свою очередь, система СН2127И5 имеет аналогичные характеристики, но позволяет использовать до восьми GPU с TDP до 600 Вт. Кроме того, анонсированы серверы СН2122И6 (2U), СН2242И6 (2U), СН2124И6 (4U) и СН2127И6 (7U) с поддержкой двух чипов Xeon 6 (Sierra Forest-SP/Granite Rapids-SP) с показателем TDP до 350 Вт. У первой из этих систем слоты расширения выполнены по схеме 6 × PCIe 5.0 х16 FHFL + 2 × OCP NIC (или 6 × PCIe 5.0 х16 FHFL + 2 × PCIe 5.0 х8 HHHL + 2 × OCP NIC), у трёх других — 10 × PCIe 5.0 х16 FHFL + 1 × OCP NIC. Во всех случаях возможно использование до 8 Тбайт памяти DDR5 (32 модуля).

Источник изображений: «Гравитон» Модель СН2122И6 поддерживает следующие накопители: 12 × LFF NVMe/SATA/SAS во фронтальной части, 2 × SFF SATA/SAS или 4 × SFF NVMe/SATA/SAS, а также 2 × M.2 2280/22110 (PCIe 5.0). Модификации СН2242И6, СН2124И6 и СН2127И6 рассчитаны на накопители в конфигурации 12 × LFF NVMe/SATA/SAS и 2 × M.2 2280/22110 (PCIe 5.0). Две старшие версии поддерживают восемь GPU с TDP до 350 и 600 Вт.  Все серверы располагают контроллером Aspeed AST2600 с выделенным сетевым портом управления 1GbE и воздушной системой охлаждения. Устанавливаются блоки питания мощностью до 3000 Вт с сертификатом 80 Plus Platinum. Заявлена совместимость с Windows и Linux. Гарантия производителя составляет три года.

23.04.2026 [11:38], Сергей Карасёв

Selectel представил российский «AI-Сервер» с поддержкой до 16 GPUРоссийский провайдер облачной инфраструктуры Selectel анонсировал «AI-Сервер» — высокопроизводительную систему формата 8U, ориентированную на ресурсоёмкие нагрузки, такие как обучение ИИ-моделей, инференс, рендеринг, финансовое моделирование, виртуальные рабочие столы и аналитика в реальном времени. В состав платформы входят плата Selectel SSE-MB-201 и специализированное шасси SSECH-812. Задействованы два процессора Intel Xeon 6 6500/6700 поколения Granite Rapids-SP. Поддерживается до 8 Тбайт оперативной памяти DDR5-6400 в виде 32 модулей. Могут быть установлены 12 накопителей с интерфейсом NVMe/SAS/SATA, а также два SSD типоразмера M.2 с интерфейсом PCIe 5.0. Упомянуты контроллер BMC AST2600, модуль TPM 2.0, 176 линий PCIe (PCIe 5.0 / CXL и OCP 3.0) и два сетевых порта 1GbE. Сервер допускает монтаж до 16 ускорителей на базе GPU формата FHFL двойной ширины или до восьми ускорителей FHFL тройной ширины. В частности, могут применяться карты NVIDIA H100, H200, RTX Pro 6000 Blackwell Server Edition и др. Питание обеспечивают семь блоков мощностью 2000 Вт с сертификатом 80 Plus Platinum. Selectel разрабатывает BIOS и BMC собственными силами: это, как утверждается, даёт полный контроль над процессом и возможность оперативно вносить изменения и дорабатывать функциональность в соответствии с запросами заказчиков. Подчёркивается, что усиленные подсистемы питания и охлаждения рассчитаны на высокую плотность ускорителей и длительную работу под нагрузкой. Конструкция упрощает обслуживание и эксплуатацию сервера в ЦОД. «Запуск нового AI-сервера является частью стратегии Selectel по формированию собственного портфеля серверных решений, включая специализированные инфраструктурные продукты для задач в сфере ИИ. Новая аппаратная платформа обеспечит стабильную, быструю и предсказуемую работу AI-моделей в реальных условиях с полным контролем над данными и производительностью», — говорит компания.

10.04.2026 [23:09], Владимир Мироненко

Intel поставит Google несколько поколений Xeon и IPUIntel и Google объявили об углублении многолетнего партнёрства в области инфраструктуры ИИ и облачных вычислений, охватывающего как развёртывание процессоров, так и совместную разработку специализированных чипов инфраструктуры (IPU). За два дня до этого компания стала партнёром по производству микрочипов для мегапроекта Tesla Terafab. В итоге акции Intel за неделю выросли на треть. Intel и Google отметили, что по мере ускорения внедрения ИИ-инфраструктура становится всё более сложной и гетерогенной, что приводит к увеличению зависимости от CPU для оркестрации, обработки данных и повышения производительности на системном уровне. В рамках сотрудничества с Intel компания Google планирует использовать несколько поколений процессоров Intel Xeon для улучшения производительности, энергоэффективности и TCO в своих инстансах. Intel уже делает кастомные Xeon для AWS. Стороны подчеркнули, что одних только ускорителей недостаточно для удовлетворения потребностей современной ИИ-инфраструктуры. «ИИ меняет подход к построению и масштабированию инфраструктуры. Масштабирование ИИ требует большего, чем просто ускорители — оно требует сбалансированных систем. CPU и IPU играют центральную роль в обеспечении производительности, эффективности и гибкости, необходимых для современных рабочих нагрузок ИИ», — сообщил генеральный директор Intel Лип-Бу Тан (Lip-Bu Tan). Как отметил ресурс The Next Web, Intel потратила последние два года на переориентацию с рынка универсальных вычислений, где она когда-то доминировала, на процессоры и специализированные инфраструктурные чипы, которые играют структурную роль в развёртывании ИИ и которые постоянно недооценивали в рамках концепций, ориентированных на GPU. Одновременно компания развивает бизнес по производству кастомных чипов для ИИ-рынка. Амин Вахдат (Amin Vahdat), старший вице-президент и главный технолог Google по инфраструктуре ИИ отметил: «Процессоры и инфраструктурное ускорение остаются краеугольным камнем систем ИИ — от организации обучения до инференса и развёртывания. Intel является надёжным партнёром уже почти два десятилетия, и её план развития Xeon даёт нам уверенность в том, что мы сможем и дальше удовлетворять растущие требования к производительности и эффективности наших рабочих нагрузок». Что важно, партнёрство охватывает несколько поколений Intel Xeon, а не текущий цикл обновления оборудования Google. Партнёрство также включает расширенную совместную разработку IPU (DPU) — специализированных программируемых ускорителей на базе ASIC, предназначенных для разгрузки сетевых функций, функций хранения, функций безопасности и т.п., которые на масштабах гиперскейлера позволяют существенно сэкономить и упростить управление инфраструктурой. Ранее компании совместно разработали свой первый IPU Mount Evans. Момент для анонса партнёрства выбран подходящий. Рабочие нагрузки ИИ смещаются от обучения на ускорителях, что позволить себе могут немногие, к масштабируемому инференсу, который является распределённым, чувствительным к задержкам, непрерывным и требовательным к ресурсам CPU для оркестрации, работы с данными и управления системой в целом. По-видимому, собственные процессоры Google Axion пока не слишком годятся на эту роль. Впрочем, для внешних заказчиков компания точно так же предлагает инстансы с чипами NVIDIA, хотя её собственные TPU пользуются огромным спросом. Впрочем, расширение сотрудничество можно объяснить и более прозаично — дефицит серверных процессоров на рынке усиливается, так что заранее договориться о поставках с крупным игроком, да ещё имеющим собственное производство на территории США, всегда выгодно.

30.03.2026 [11:59], Сергей Карасёв

ИИ-сервер Gigabyte G894-AD3 использует платформу NVIDIA HGX B300 и чипы Intel Xeon 6900Компания Gigabyte пополнила ассортимент серверов мощной моделью G894-AD3-AAX7, предназначенной для решения ресурсоёмких задач в сфере ИИ. Система выполнена на платформе NVIDIA HGX B300 с восемью SXM-ускорителями Blackwell Ultra. Допускается установка двух процессоров Intel Xeon 6900P поколения Granite Rapids-SP в исполнении LGA 7529 (Socket BR) с показателем TDP до 500 Вт. Доступны 24 слота для модулей DDR5-6400/8800 RDIMM/MRDIMM, два внутренних коннектора M.2 2280/22110 для SSD с интерфейсом PCIe 5.0 x4 и PCIe 5.0 x2, а также восемь отсеков для SFF-накопителей (NVMe) с доступом через фронтальную панель (возможна горячая замена). Реализованы четыре слота PCIe 5.0 x16 для карт расширения FHHL. В оснащение входят контроллер ASPEED AST2600, два сетевых порта 10GbE на основе Intel X710-AT2, выделенный сетевой порт управления 1GbE, а также восемь портов 800G OSFP InfiniBand XDR (NVIDIA ConnectX-8 SuperNIC). Подсистема питания включает 12 блоков мощностью 3000 Вт с сертификатом 80 PLUS Titanium. Реализовано воздушное охлаждение с 27 вентиляторами в следующей конфигурации: 6 × 60 мм в области материнской платы, 4 × 40 мм в зоне портов OSFP, 2 × 80 мм в секции PCIe-слотов и 15 × 80 мм в лотке GPU.

Источник изображения: Gigabyte Сервер выполнен в форм-факторе 8U с габаритами 447 × 351 × 923 мм, а масса составляет 91,6 кг. Диапазон рабочих температур — от +10 до +30 °C. Среди прочего упомянуты два порта USB 3.0 Type-A (5 Гбит/с), аналоговый интерфейс D-Sub, а также три гнезда RJ45 для сетевых кабелей. Опционально может быть добавлен модуль TPM 2.0 для обеспечения безопасности.

26.03.2026 [11:10], Сергей Карасёв

HP представила рабочую станцию Z8 Fury G6i с поддержкой четырёх ускорителей NVIDIA RTX Pro 6000 Blackwell Max-Q Workstation EditionКомпания HP анонсировала настольную рабочую станцию Z8 Fury G6i, предназначенную для решения сложных задач в области моделирования, анализа данных, создания визуальных эффектов и разработки ИИ. Новинка построена на аппаратной платформе Intel Xeon 600. Максимальная конфигурация включает процессор Xeon 698X с P-ядрами (86C/172T, 2/4,8 ГГц). Применена материнская плата на наборе логики Intel W890. Объём оперативной памяти DDR5-6400 ECC может достигать 2 Тбайт (доступны 16 слотов для модулей DIMM). Суммарная вместимость подсистемы хранения данных составляет до 104 Тбайт. При этом допускается использование накопителей разных типов, включая HDD корпоративного класса с интерфейсом SATA-3 вместимостью до 12 Тбайт (7200 об/мин), SSD формата М.2 (например, HP Z Turbo Drive NVMe на 8 Тбайт), а также устройства U.2 и U.3. Во фронтальной части расположены посадочные места для четырёх NVMe-накопителей с возможностью горячей замены. Дополнительно может быть установлен оптический привод HP Slim DVD-ROM или HP Slim DVD-Writer. Рабочая станция может нести на борту до четырёх ускорителей NVIDIA RTX Pro 6000 Blackwell Max-Q Workstation Edition с 96 Гбайт памяти GDDR7 каждый (пропускная способность — 1792 Гбайт/с). Слоты расширения выполнены по схеме 4 × PCIe 5.0 x16, 3 × PCIe 5.0 x8,1 × PCIe 5.0 x4 и 1 × PCIe 4.0 x4. В оснащение включены сетевой контроллер Intel I219-LM PCIe стандарта 1GbE и звуковой кодек Realtek ALC3205-CG. Предлагаются гибкие опции по установке дополнительных сетевых адаптеров, включая 10GbE и 25GbE. Кроме того, упомянут модуль MediaTek MT7925 с поддержкой Wi-Fi 7 и Bluetooth 5.4. Габариты составляют 44,51 × 21,95 × 55,9 см, масса — 22,2 кг. На фронтальную панель выведены четыре порта USB 3.0 Type-A (5 Гбит/с), комбинированное аудиогнездо на 3,5 мм и SD-ридер. Сзади сосредоточены пять портов USB 3.0 Type-A (5 Гбит/с), разъём USB 3.2 Type-C (20 Гбит/с), гнездо RJ45 для сетевого кабеля и пр. Возможна установка одного или двух блоков питания мощностью 1350 или 1700 Вт. Говорится о совместимости с Windows 11 Pro for Workstations, Ubuntu 24.04 LTS, Red Hat Enterprise Linux.

20.03.2026 [11:44], Сергей Карасёв

Платформа NVIDIA DGX Rubin NVL8 использует процессоры Intel Xeon 6Корпорация Intel сообщила о том, что в составе платформы NVIDIA DGX Rubin NVL8 для агентного ИИ применяются CPU поколения Xeon 6. Эти чипы отвечают за критически важные функции, такие как управление памятью, оркестрация задач и распределение рабочей нагрузки. Система DGX Rubin NVL8 несёт на борту два процессора Xeon 6776P семейства Granite Rapids. Изделия содержат 64 вычислительных ядра с возможностью одновременной обработки до 128 потоков инструкций. Базовая тактовая частота составляет 2,3 ГГц, максимальная — 3,9 ГГц. В режиме Priority Core Turbo (PCT) с восемью ядрами частота достигает 4,6 ГГц. Показатель TDP равен 350 Вт. CPU специально оптимизированы Intel для ИИ-узлов. «Intel Xeon 6 обеспечивает превосходную производительность, эффективность и совместимость с обширной экосистемой программного обеспечения x86, на которую полагаются клиенты при выполнении инференса в масштабе», — говорит Джефф Маквей (Jeff McVeigh), корпоративный вице-президент и генеральный директор стратегических ЦОД-программ Intel.

Источник изображения: NVIDIA В состав DGX Rubin NVL8 входят восемь ускорителей Rubin с суммарным объёмом памяти 2,3 Тбайт (пропускная способность — 160 Тбайт/с). Задействованы восемь однопортовых адаптеров NVIDIA ConnectX-9 VPI (до 800 Гбит/с NVIDIA Infiniband и Ethernet), а также два DPU NVIDIA BlueField-4. Общая пропускная способность шины NVIDIA NVLink достигает 28,8 Тбайт/с. Энергопотребление — приблизительно 24 кВт. Заявленное ИИ-быстродействие на задачах инференса NVFP4 составляет до 400 Пфлопс, при обучении моделей NVFP4 — 280 Пфлопс, при обучении FP8/FP6 — 140 Пфлопс. Среди поддерживаемого софта упомянуты NVIDIA DGX OS, Ubuntu, Red Hat Enterprise Linux, Rocky Linux.

02.03.2026 [22:50], Владимир Мироненко

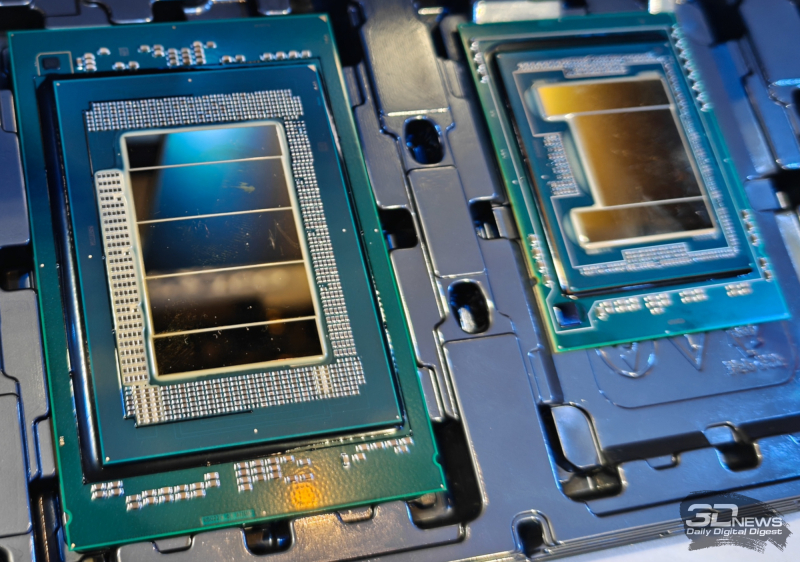

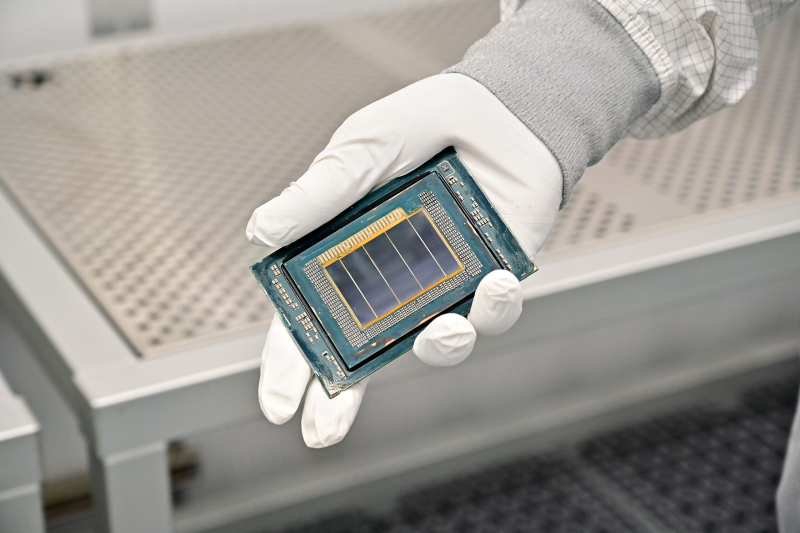

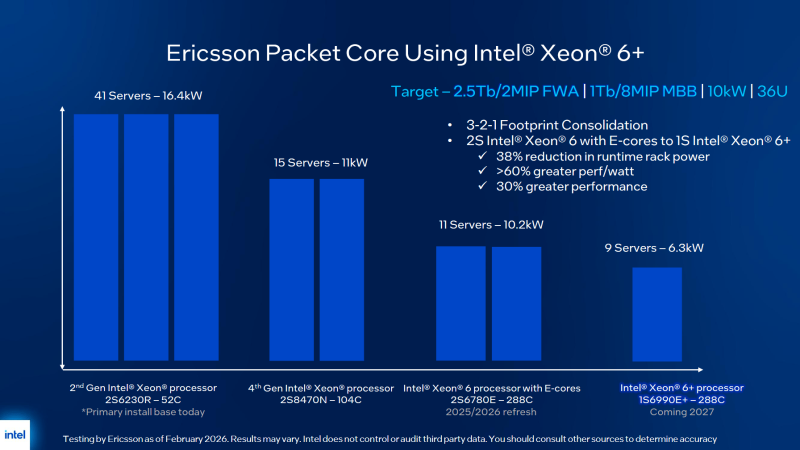

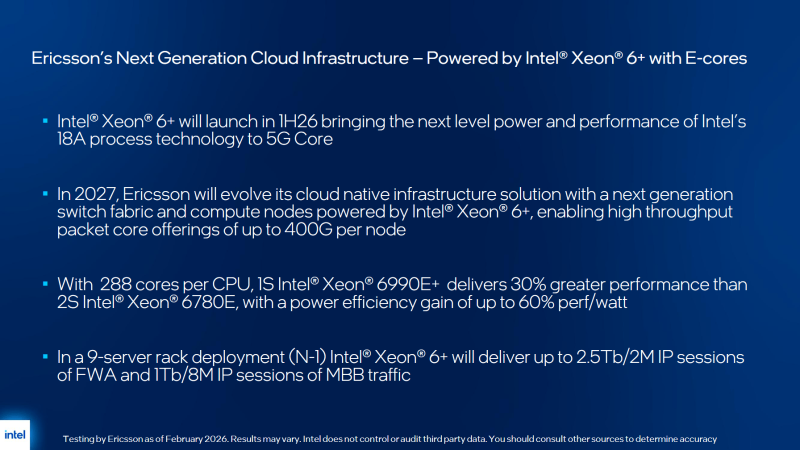

288-ядерные Xeon Clearwater Forest хороши для телекома, говорят Intel и EricssonIntel показала на MWC 2026 288-ядерные серверные процессоры Xeon 6+ (Clearwater Forest), а также совместно с Ericsson продемонстрировала их преимущества для телекоммуникационных решений. Новая платформа была значительно усовершенствована за последние шесть месяцев и приближается к выходу на рынок, который ожидается в I половине 2026 года, отметил ресурс ComputerBase. Производители телеком-оборудования полагаются на самые современные аппаратные средства в различных вариантах, включая процессоры Intel Xeon с ядрами серии E. Именно эта клиентская база уже может проводить тесты с почти готовыми к производству процессорами-преемниками и теперь представляет первые результаты. Напомним, что Xeon 6900E+ (CWF) объединяет 12 вычислительных чиплетов, изготовленных по техпроцессу Intel 18A, с тремя активными базовыми тайлами на техпроцессе Intel 3 и двумя чиплетами I/O на техпроцессе Intel 7. В этой конфигурации каждый вычислительный блок содержит шесть модулей с 4 Мбайт L2-кеша и четырьмя энергоэффективными ядрами Darkmont E-Core — 24 ядра на блок и максимум 288 на CPU. Таким образом, двухсокетная система может включать до 576 ядер Darkmont E-Core. Xeon 6+ поддерживает существующий сокет серверной платформы Xeon, 12 каналов памяти DDR5, 96 линий PCIe 5.0 и 64 линии CXL 2.0. Результаты тестов, представленные Ericsson, отражают несколько моментов. Во-первых, 288-ядерный Xeon 6990E+ Clearwater Forest быстрее двух процессоров Xeon 6780E (Sierra Forrest-SP), даже при одинаковом количестве ядер — прирост составляет 30 %. При этом потребление энергии на стойку ниже на 38 %, а прирост энергоэффектинвости составляет 60 %. Компания отметила, что Xeon 6+ предоставляет операторам платформу, которая агрессивно масштабирует рабочие нагрузки, сокращает энергопотребление и обеспечивает более интеллектуальные сетевые сервисы. Также она обеспечивает увеличение плотности ядер при одновременном снижении энергопотребления, что напрямую улучшает общую стоимость владения. Эти процессоры разработаны для оптимизации производительности, эффективности и стоимости, переосмысливая экономику ЦОД на пути к 6G, утверждает компания. Выход серверных процессоров Xeon 6+ запланирован на I половину 2026 года, подтвердила директор Intel по продуктам Xeon Кира Бойко (Kira Boyko) изданию ComputerBase. Но до их широкого внедрения могут пройти месяцы — Ericsson планирует начать использовать новые процессоры Xeon в 2027 году.

19.02.2026 [12:26], Сергей Карасёв

«НВБС» представила российские серверы «Необайт» на платформах Intel и AMDКомпания «НВБС», российский системный интегратор и производитель технологических решений, анонсировала собственные серверы семейства «Необайт». Дебютировали модели NeoByte NBR220 и NeoByte NBR680 на аппаратной платформе Intel, а также NeoByte NBR685 с процессорами AMD. По словам компании, новинки «сопоставимы с решениями ведущих компаний на рынке, но при этом в среднем стоят на 10–15 % дешевле за счёт широкого пула поставщиков и оптимизированной логистики». Система NeoByte NBR220 типоразмера 2U может нести на борту два чипа Intel Xeon Sapphire Rapids или Emerald Rapids с показателем TDP до 350 Вт. Доступны 32 слота для модулей оперативной памяти DDR5-4800. В зависимости от конфигурации во фронтальной части возможна установка 12 накопителей LFF/SFF или 24 устройств SFF с интерфейсом SATA/SAS/NVMe. В тыльной зоне корпуса расположены посадочные места ещё для четырёх накопителей LFF/SFF (SATA/SAS/NVMe), тогда как внутри есть два коннектора для SSD формата M.2 (SATA/NVMe). Реализована поддержка до 10 стандартных слотов PCIe и одного слота OCP 3.0. В оснащение входят контроллер AST2600, два сетевых порта 1GbE, выделенный сетевой порт управления 1GbE, четыре порта USB 3.0 (по два спереди и сзади), два интерфейса D-Sub (по одному спереди и сзади) и последовательный порт. Питание обеспечивают два блока с резервированием мощностью 800/1300/1600/2000 Вт. Сервер оптимизирован для ИИ-задач, виртуализации, баз данных и файловых хранилищ. Платформа практически идентична представленным ранее серверам «Аквариус» AQserv T50 D224RS и T50 D212RS. Модель NeoByte NBR680 стандарта 6U имеет аналогичные характеристики подсистем CPU, ОЗУ, хранения данных и интерфейсов ввода/вывода. При этом возможна установка до восьми GPU-ускорителей двойной ширины. Есть пять стандартных слотов PCIe и один слот OCP; передняя панель поддерживает до трёх стандартных слотов PCIe и один слот OCP. Мощность каждого из двух блоков питания — 2700 или 3200 Вт. Машина предназначена для научных исследований и крупных ИИ-проектов. В свою очередь, GPU-сервер NeoByte NBR685 формата 6U рассчитан на два процессора AMD EPYC 9005 Turin или EPYC 9004 Genoa с показателем TDP до 500 Вт. Предусмотрены 24 слота для модулей оперативной памяти DDR5-4800. Прочие характеристики идентичны версии NeoByte NBR680, включая поддержку восьми GPU-ускорителей двойной ширины. Система подходит для анализа больших данных в реальном времени, криптографии и блокчейна. Все новинки могут быть опционально укомплектованы контроллером SAS RAID/HBA. Заявлена совместимость с Windows Server 2022 SLES 12.5 и выше, RHEL7.8 и выше, Ubuntu18.04 и выше, CentOS7.6 и выше, Vmware ESXi 7.0 GA и выше. Гарантия производителя достигает пяти лет. Также «НВБС» говорит, что «не зависит от санкций, что снижает риски ограничения поставок».

16.02.2026 [10:11], Сергей Карасёв

Китайская Montage Technology выпустила серверные процессоры Jintide на базе Intel Xeon 6Китайская компания Montage Technology, на днях осуществившая первичное публичное размещение акций (IPO) на Гонконгской фондовой бирже, выпустила серверные процессоры Jintide следующего поколения, в основу которых положена архитектура Intel Xeon 6, доработанная под требования заказчиков в КНР. В частности, вышли изделия Jintide C6P, которые фактически представляют собой процессоры Intel Xeon 6 семейства Granite Rapids-SP на базе производительных ядер P-core. Их количество в китайских чипах достигает 86 с возможностью одновременной обработки до 172 потоков инструкций, а максимальный объем кеша L3 составляет 336 Мбайт. Реализована 8-канальная подсистема памяти DDR5 с поддержкой модулей RDIMM-6400 и MRDIMM-8000. Процессоры Jintide C6P могут применяться в одно- и двухсокетных конфигурациях. Говорится о поддержке 88 линий PCIe 5.0 и протокола CXL 2.0. Пропускная способность шины UPI достигает 24 ГТ/с. Обеспечивается полная совместимость с набором инструкций x86. Чипы ориентированы на дата-центры и облачные инфраструктуры с высокой вычислительной нагрузкой. Кроме того, дебютировали решения Jintide C6E — это модифицированные изделия Intel Xeon 6 Sierra Forest-SP с энергоэффективными ядрами E-core: их количество достигает 144. Размер кеша L3 составляет до 108 Мбайт. Процессоры имеют восемь каналов памяти DDR5-6400 и до 88 линий PCIe 5.0. Упомянута поддержка CXL 2.0 и шины UPI с пропускной способностью до 24 ГТ/с. Решения Jintide C6E могут устанавливаться в одно-и двухсокетные системы. Компания также анонсировала чип Jintide M88STAR5(N), на основе которого реализуются различные функции безопасности. Изделие, использующее технологию Mont-TSSE (Trust & Security System Extension), отвечает за аппаратное шифрование/дешифрование данных в соответствии с местными стандартами и доверенные вычисления. На кристалле присутствуют нескольких генераторов случайных чисел, а общая пропускная способность достигает 160 Гбит/с через PCIe 5.0 х8. Упомянута поддержка стандартов TPM, TCM и TPCM, а также интерфейсов SMBus, I3C, UART, SPI и GPIO. Наконец, Montage Technology представила чип Jintide M88IO3032 IOH (I/O Hub), предназначенный для использования с CPU нового поколения. Изделие обеспечивает поддержку PCIe 3.0, SATA 3.2 (до 20 портов; RAID 0/1/5/10), USB 3.2/2.0 и пр.

07.02.2026 [17:23], Руслан Авдеев

AWS: ни один сервер с NVIDIA A100 не выведен из эксплуатации, а некоторые клиенты всё ещё используют Intel Haswell — не всем нужен ИИПо словам главы AWS Мэтта Гармана (Matt Garman), клиенты до сих пор использует серверы на основе ИИ-ускорителей NVIDIA A100, представленных в 2020 году. Отчасти это происходит потому, что спрос на вычислительные ресурсы превышает предложение, так что устаревшие чипы по-прежнему востребованы, передаёт Datacenter Dynamics. По словам Гармана, все ресурсы фактически распроданы, а серверы с A100 из эксплуатации никогда не выводились. Комментарии Гармана перекликаются с прошлогодним заявлением Амина Вахдата (Amin Vahdat), отвечающего в Google за ИИ и инфраструктуру. По его словам, в Google одновременно работают семь поколений тензорных ускорителей (TPU). Ускорители возрастом семь-восемь лет загружены на 100 %, а спрос на TPU так высок, что Google вынуждена отказывать некоторым клиентам. Впрочем, оба топ-менеджера, возможно, несколько кривят душой и пытаются развеять опасения инвесторов относительно того, что ИИ-ускорители, на которые тратятся огромные деньги, через два-три года придётся выкинуть, чтобы купить более современные, энергоэффективные и, конечно же, дорогие. И что за это время они не успеют окупиться. Хотя Гарман назвал главной причиной сохранения работы серверов на A100 высокий спрос, он признал, что есть и другие причины. В частности, современные ИИ-чипы снижают точность вычислений с плавающей запятой. В результате некоторые клиенты попросту не могут перейти на Blackwell или вовсе вынуждены использовать Intel Xeon Haswell десятилетней давности для HPC-подобных вычислений, поскольку точности у современных ИИ-ускорителей недостаточно. В июне 2025 года AWS заявила о снижении цены доступа к устаревшим NVIDIA H100, H200 и A100 на своей платформе, причём для A100 стоимость снизилась на треть.

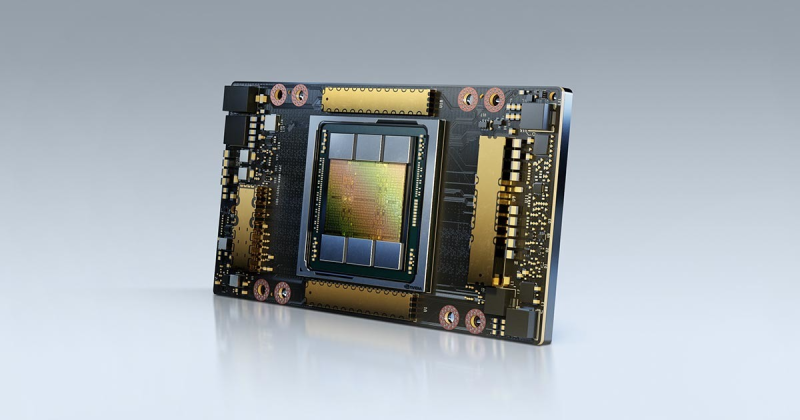

Источник изображения: NVIDIA Стоит отметить, что «устаревшие» ускорители долго остаются востребованными, поскольку всё равно обладают большой производительностью. Наиболее яркий пример — разрешение на поставку в Китай чипов NVIDIA H200. Хотя США и их союзники готовятся к внедрению ускорителей поколения Vera Rubin, китайский бизнес готов покупать H200, поскольку те значительно производительнее, экономически выгоднее и удобнее отечественных ускорителей. |

|