Материалы по тегу: x

|

31.03.2026 [17:55], Сергей Карасёв

«Альт Сервер» и «Альт Домен» 11.1: выбор редакции на этапе установки, улучшения цифровой среды, управление службами через приложения«Базальт СПО» выпустила обновление операционной системы «Альт Сервер» с программным комплексом «Альт Домен» 11.1. В новой версии на этапе установки можно выбрать редакцию: классический сервер («Альт Сервер») или контроллер домена («Альт Домен»). Также добавили приложение для настройки и управления сервисами «Альт Сервисы» и графические средства управления для среды GNOME. Выбор редакции на этапе установки системы и быстрое переключение между нимиВ установщике появилась возможность выбора редакции: «Альт Сервер» или «Альт Домен». Указанный вариант определяет состав программного обеспечения и условия лицензионного соглашения. Чтобы быстро переключаться между «Альт Сервером» и «Альт Доменом» без переустановки, в центре управления добавили раздел «Альт Системная информация». На одном из этапов установки системы можно загрузить дополнительные приложения, которые:

Управление программным обеспечениемВ приложениях для управления программным обеспечением «Альт Компоненты» и «Альт Пакеты» добавлена защита от случайного удаления критических файлов. Система будет запрашивать дополнительное подтверждение операции. «Альт Сервисы»: управление сервисами через приложенияСервисы (службы) — фоновые процессы, которые запускаются в операционной системе для предоставления определённых функций или ресурсов (веб‑сервер, SSH, база данных и т. д.). Для их работы требуются файлы с настройками, определяющие параметры работы сервиса без необходимости изменения его исходного кода (файлы конфигурации). Раньше их приходилось править вручную. Теперь эта задача автоматизирована. Настройки и управления сервисами выполняются через:

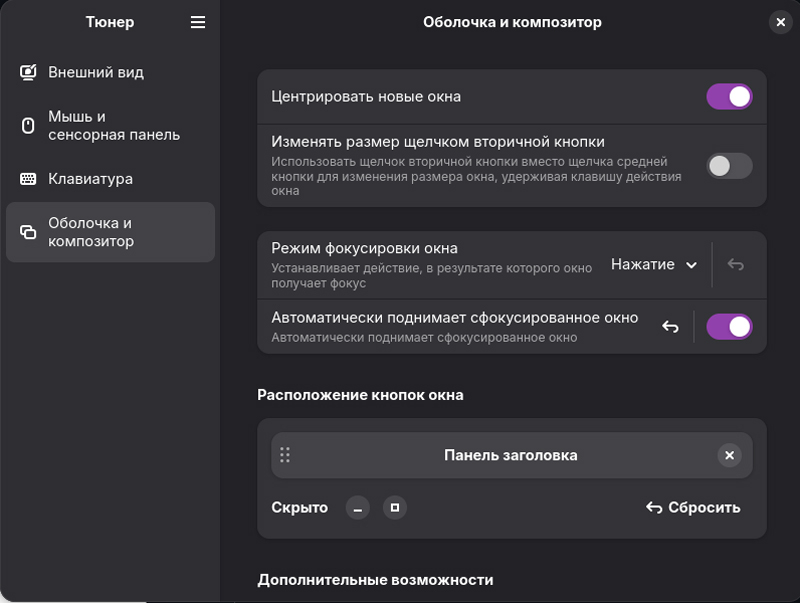

На данный момент реализовано управление службами Samba DC (контроллер домена) и Chrony (синхронизация времени). Со временем появится поддержка других сервисов. Установить «Альт Сервисы» (alt-services) можно через приложение для управления наборами приложений «Альт Пакеты». Тайминги межсайтовой репликации стали лучшеИзменились настройки тайминга межсайтовой репликации. Теперь можно четко прописать периодичность обмена данными между сайтами и выбрать время с наименьшей нагрузкой на каналы связи. Центр расширенных настроек и дополнительные расширения для оболочки GNOMEДобавлен центр расширенных настроек «Тюнер», обеспечивающий контроль над интерфейсом и функциями с помощью плагинов. Он содержит дополнительный набор настроек системы, компонентов, приложений и т. д.

Источник изображения: «Базальт СПО» Добавлены расширения для оболочки GNOME:

Безопасность и защита данныхДля контроллера домена добавлена технология LAPSv2. Она используется для автоматизированного управления и регулярного изменения паролей учётных записей локальных администраторов на компьютерах, входящих в домен. Резервное копированиеProxmox Backup Server обновлен до версии 4. Основные новшества:

Архитектуры«Альт Сервер» 11.1 совместим с процессорами на архитектурах x86_64 и AArch64. Идёт работа над обеспечением совместимости с Эльбрус V6.

30.03.2026 [11:59], Сергей Карасёв

ИИ-сервер Gigabyte G894-AD3 использует платформу NVIDIA HGX B300 и чипы Intel Xeon 6900Компания Gigabyte пополнила ассортимент серверов мощной моделью G894-AD3-AAX7, предназначенной для решения ресурсоёмких задач в сфере ИИ. Система выполнена на платформе NVIDIA HGX B300 с восемью SXM-ускорителями Blackwell Ultra. Допускается установка двух процессоров Intel Xeon 6900P поколения Granite Rapids-SP в исполнении LGA 7529 (Socket BR) с показателем TDP до 500 Вт. Доступны 24 слота для модулей DDR5-6400/8800 RDIMM/MRDIMM, два внутренних коннектора M.2 2280/22110 для SSD с интерфейсом PCIe 5.0 x4 и PCIe 5.0 x2, а также восемь отсеков для SFF-накопителей (NVMe) с доступом через фронтальную панель (возможна горячая замена). Реализованы четыре слота PCIe 5.0 x16 для карт расширения FHHL. В оснащение входят контроллер ASPEED AST2600, два сетевых порта 10GbE на основе Intel X710-AT2, выделенный сетевой порт управления 1GbE, а также восемь портов 800G OSFP InfiniBand XDR (NVIDIA ConnectX-8 SuperNIC). Подсистема питания включает 12 блоков мощностью 3000 Вт с сертификатом 80 PLUS Titanium. Реализовано воздушное охлаждение с 27 вентиляторами в следующей конфигурации: 6 × 60 мм в области материнской платы, 4 × 40 мм в зоне портов OSFP, 2 × 80 мм в секции PCIe-слотов и 15 × 80 мм в лотке GPU.

Источник изображения: Gigabyte Сервер выполнен в форм-факторе 8U с габаритами 447 × 351 × 923 мм, а масса составляет 91,6 кг. Диапазон рабочих температур — от +10 до +30 °C. Среди прочего упомянуты два порта USB 3.0 Type-A (5 Гбит/с), аналоговый интерфейс D-Sub, а также три гнезда RJ45 для сетевых кабелей. Опционально может быть добавлен модуль TPM 2.0 для обеспечения безопасности.

27.03.2026 [21:04], Руслан Авдеев

«Не хотите ускорители? Возьмите хотя бы сеть!» — NVIDIA открыла свои ИИ-стойки для чужих чиповNVIDIA занялась разработкой серверных стоек, подходящих для решений на основе сторонних ИИ-ускорителей, сообщает The Information со ссылкой на знакомые с вопросом источники. Компания стремится остаться ключевым игроком на рынке ИИ-систем даже по мере того, как всё больше её клиентов разрабатывают решения, прямо конкурирующие с продуктами самой NVIDIA. На прошлой неделе компания представила новые стойки MGX ETL, специально разработанные для поддержки чипов как самой NVIDIA, так и поставщиков-конкурентов. Система основана на модульной архитектуре MGX (OCP), представленной в 2023 году и уже довольно распространённой. ETL предполагает использование сетевых решений NVIDIA Spectrum-X. Таким образом, «зелёные» чипы всё равно оказываются в инфраструктуре, даже если она базируется на сторонних решениях. Похожим образом компания развивает и фирменный интерконнект NVLink. NVLink Fusion можно интегрировать в другие чипы, что опять-таки даёт NVIDIA возможность заработать на чужих ИИ-системах. Но в случае ETL применяются широко поддерживаемые в индустрии стандарты Ethernet, что снижает для клиентов «порог вхождения» при внедрении оборудования NVIDIA. Модульный дизайн позволяет облачным гиперскейлерам одновременно использовать ускорители разных производителей, при этом оставаясь в сетевой и программной экосистемах NVIDIA. NVIDIA позиционировала MGX как открытую «эталонную» архитектуру, не мешающую партнёрам использовать альтернативные компоненты. Гибкость также позволяет NVIDIA «проложить дорогу» на китайский рынок, где компании смогут применять со стойками NVIDIA чипы домашней разработки. Новый дизайн стоек также может помочь NVIDIA устранить обеспокоенность регуляторов практикой, когда компания связывала использование сетевого оборудования с определёнными ИИ-чипами. На этом фоне происходит ужесточение конкуренции на рынке технологий интерконнектов. Открытый стандарт UALink позиционируется как альтернатива NVLink и призван обеспечить высокоскоростную связь между ИИ-чипами без применения проприетарных технологий. Параллельно развивается и открытый стандарт Ultra Ethernet, который призван конкурировать и с технологией Infiniband, фактически единолично контролируемой NVIDIA. Сетевые решения являются чрезвычайно важной частью бизнеса NVIDIA. По итогам последнего квартала выручка компании в этом сегменте достигла $10,98 млрд (а за год все $31 млрд) — она выросла год к году на 268 % и составила более 15 % от всей выручки компании. При этом значительная часть сетевого оборудования продаётся не сама по себе, а в составе платформенных решений NVIDIA.

26.03.2026 [13:15], Руслан Авдеев

SanDisk стратегически вложила $1 млрд в тайваньского производителя памяти NanyaАкции тайваньского производителя памяти Nanya Technology подорожали на 10 % после того, как в среду компания в частном порядке продала свои акции на сумму $2,5 млрд компаниям SanDisk, Solidigm (SK hynix), Cisco и Kioxia для расширения производства передовых чипов, сообщает Reuters. Новый раунд финансирования был организован на фоне желания компании и её клиентов нарастить производственные мощности, поскольку покупателям очень нужен доступ к передовым чипам на фоне глобального дефицита, вызванного бумом ИИ. При этом пострадал не только рынок ИИ-решений, но и другие отрасли, требующие электронных компонентов, включая производство смартфонов, компьютеров и автомобилей. Быстрое развитие ИИ-инфраструктуры требует гигантских объёмов DRAM, NAND и HDD. В компании подчеркнули, что привлечённые средства будут потрачены на инвестиции в производственные мощности для выпуска передовой памяти. Ключевым инвестором является компания SanDisk, в среду заявившая о намерении купить приблизительно 139 млн акций. По данным The Wall Street Journal, это около 3,9 % с учётом всех «разводнений». Всего компания вложила в покупку около NT$31 млрд ($969,69 млн), остальные компании — по NT$16 млрд.

Источник изображения: Nanya Помимо инвестиций в ценные бумаги, SanDisk заключила с Nanya и многолетнее стратегическое соглашение, в рамках которого тайваньский производитель будет поставлять американской компании DRAM-модули памяти. Также долгосрочное соглашение о поставке DRAM заключила и Kioxia, сославшись на рост бизнеса, связанного с ростом спроса ИИ-проектов на SSD и необходимость обеспечить себе стабильные поставки DRAM-модулей, играющих в твердотельных накопителях вспомогательное значение. Раунд финансирования состоялся вскоре после объявления SK Hynix, в среду заявившей о намерении выйти на IPO в США позже в 2026 году. Компания потенциально поможет привлечь $14 млрд. В марте Sandisk порекомендовала клиентам заключать долгосрочные контракты с предсказуемыми поставками памяти и, похоже, сама следует своим рекомендациям в делах с поставщиками.

25.03.2026 [12:08], Сергей Карасёв

ZutaCore представила водоблок для NVIDIA RTX Pro 6000 Blackwell Server EditionРазработчик систем прямого безводного двухфазного жидкостного охлаждения ZutaCore анонсировал водоблок OmniTherm для ускорителя NVIDIA RTX Pro 6000 Blackwell Server Edition. Новинка позволяет повысить плотность монтажа ИИ-карт в составе серверов, ориентированных на корпоративные и облачные среды. Решение OmniTherm обеспечивает возможность применения двухфазного охлаждения. При этом используется герметичная конструкция с диэлектрической жидкостью. Теплоноситель при контакте с чипом закипает и превращается в пар, который конденсируется в отдельном контуре. Блок OmniTherm позволяет реализовать однослотовую систему охлаждения, благодаря чему достигается экономия пространства внутри сервера. Переход на СЖО также помогает повысить энергетическую эффективность оборудования, снизить уровень шума и вибрации (благодаря отсутствию вентиляторов). ZutaCore отмечает, что OmniTherm отводит тепло не только от кристалла GPU, но и от других расположенных рядом дорогостоящих компонентов, включая чипы памяти НВМ. Снижение тепловой нагрузки на эти элементы может повысить долговременную стабильность и минимизировать вероятность сбоев. Кроме того, ZutaCore представила облачную платформу HyperCool Cloud, предназначенную для управления системами жидкостного охлаждения в комплексных средах. Эта платформа практически в режиме реального времени предоставляет информацию о работе различного оборудования, включая блоки распределения охлаждающей жидкости (CDU).

24.03.2026 [10:59], Руслан Авдеев

SpaceX нажаловалась FCC на Blue Origin в ответ на жалобу AmazonВ ответ на жалобу Amazon, поданную в Федеральную комиссию по связи США (FCC) против размещения миллиона спутников SpaceX на орбите, последняя направила регулятору собственное заявление, требуя обратить внимание на заявку Blue Origin, недавно подавшей заявку на вывод на орбиту 51,56 тыс. спутников-ЦОД, сообщает The Register. Blue Origin принадлежит Джеффу Безосу (Jeff Bezos) — основателю Amazon, по-прежнему имеющему с техногигантом весьма тесные связи. Представитель SpaceX подчеркнул, что заявка Blue Origin ничуть не хуже заявки компании Маска и с «безупречной логикой» доказывает, что FCC должна отнестись к обеим заявкам одинаково. Ранее Amazon раскритиковала заявку SpaceX, назвав её «неполной, спекулятивной и нереалистичной», заявив, что в документе содержатся лишь самые общие данные относительно того, как последняя намерена реализовать планы по выводу ЦОД в космос. В письме Amazon говорится, что заявка SpaceX, вероятно, описывает «амбициозные планы, а не реальный замысел». Компания требует отклонить её как «спекулятивную», не соответствующую правилам FCC. В ответ SpaceX направила в FCC ходатайство, предлагающее комиссии «рассмотреть те же содержательные и процессуальные аргументы, но в отношении заявки Blue Origin». Недавно Gartner назвала разговоры о выводе огромного числа ЦОД на орбиту «апофеозом безумия». По словам её экспертов, компании тратят на «модные» проекты деньги впустую, поскольку выводить на орбиту что-то, напоминающее дата-центр, будет непомерно дорого. Кроме того, желающих развернуть ЦОД в космосе ожидают и огромные технические трудности, связанные с эксплуатацией объектов. Впрочем, помимо SpaceX и Blue Origin, над проектами усиленно работают и другие компании, в том числе крупные. Так, с собственной инициативой Project Suncatcher аналогичного толка выступает и Google.

23.03.2026 [09:31], Сергей Карасёв

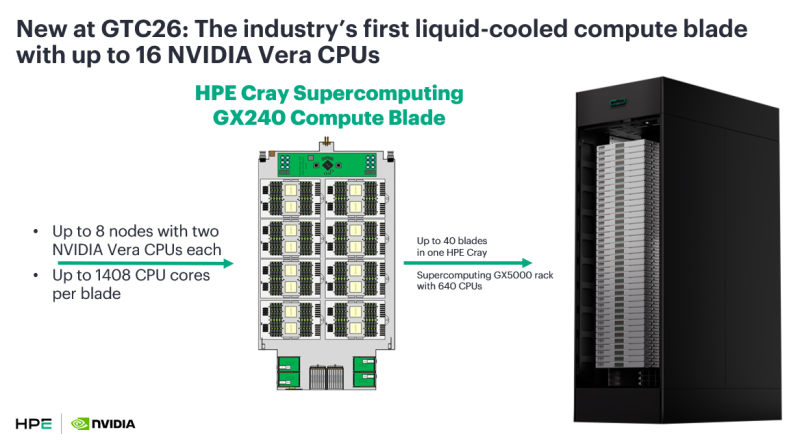

HPE представила узлы на базе NVIDIA Vera для платформы Cray Supercomputing GX5000Компания HPE анонсировала новые решения семейства NVIDIA AI Computing by HPE, ориентированные на крупномасштабные ИИ-платформы и суперкомпьютерные системы. О намерении использовать такие инфраструктурные продукты в числе прочих сообщили Аргоннская национальная лаборатория (ANL) Министерства энергетики США (DOE), Hudson River Trading (HRT), Корейский институт научно-технической информации (KISTI) и Центр высокопроизводительных вычислений HLRS при Штутгартском университете в Германии. В частности, представлены новые узлы для суперкомпьютерной платформы HPE Cray Supercomputing GX5000 — blade-серверы HPE Cray Supercomputing GX240. Эти устройства могут нести на борту до 16 процессоров NVIDIA Vera (88C/176T). В одной стойке могут быть размещены до 40 узлов, что в сумме даёт 640 чипов Vera и 56 320 ядер Olympus. Реализовано жидкостное охлаждение. Система предназначена для решения наиболее ресурсоёмких вычислительных задач в области ИИ. Новые серверы появятся на рынке в следующем году. Для платформы HPE Cray Supercomputing GX5000 также будут доступны коммутаторы NVIDIA Quantum-X800 InfiniBand, предоставляющие 144 порта с пропускной способностью до 800 Гбит/с. В этих устройствах реализованы развитые функции снижения энергопотребления. Кроме того, HPE готовит OCP-серверы высокой плотности Compute XD700 для обучения LLM и инференса. В основу данной системы положена платформа NVIDIA HGX Rubin NVL8, а одна стойка может насчитывать до 128 ускорителей Rubin. Данное решение появится в начале 2027-го. Помимо этого, анонсирована стоечная система нового поколения NVIDIA Vera Rubin NVL72 by HPE — это флагманская ИИ-платформа, разработанная для моделей с более чем 1 трлн параметров. Конфигурация включает 36 процессоров Vera, 72 чипа Rubin, интерконнект NVIDIA NVLink шестого поколения, сетевые адаптеры NVIDIA ConnectX-9 SuperNIC и DPU NVIDIA BlueField-4. Система поступит в продажу в декабре 2026 года.

20.03.2026 [11:44], Сергей Карасёв

Платформа NVIDIA DGX Rubin NVL8 использует процессоры Intel Xeon 6Корпорация Intel сообщила о том, что в составе платформы NVIDIA DGX Rubin NVL8 для агентного ИИ применяются CPU поколения Xeon 6. Эти чипы отвечают за критически важные функции, такие как управление памятью, оркестрация задач и распределение рабочей нагрузки. Система DGX Rubin NVL8 несёт на борту два процессора Xeon 6776P семейства Granite Rapids. Изделия содержат 64 вычислительных ядра с возможностью одновременной обработки до 128 потоков инструкций. Базовая тактовая частота составляет 2,3 ГГц, максимальная — 3,9 ГГц. В режиме Priority Core Turbo (PCT) с восемью ядрами частота достигает 4,6 ГГц. Показатель TDP равен 350 Вт. CPU специально оптимизированы Intel для ИИ-узлов. «Intel Xeon 6 обеспечивает превосходную производительность, эффективность и совместимость с обширной экосистемой программного обеспечения x86, на которую полагаются клиенты при выполнении инференса в масштабе», — говорит Джефф Маквей (Jeff McVeigh), корпоративный вице-президент и генеральный директор стратегических ЦОД-программ Intel.

Источник изображения: NVIDIA В состав DGX Rubin NVL8 входят восемь ускорителей Rubin с суммарным объёмом памяти 2,3 Тбайт (пропускная способность — 160 Тбайт/с). Задействованы восемь однопортовых адаптеров NVIDIA ConnectX-9 VPI (до 800 Гбит/с NVIDIA Infiniband и Ethernet), а также два DPU NVIDIA BlueField-4. Общая пропускная способность шины NVIDIA NVLink достигает 28,8 Тбайт/с. Энергопотребление — приблизительно 24 кВт. Заявленное ИИ-быстродействие на задачах инференса NVFP4 составляет до 400 Пфлопс, при обучении моделей NVFP4 — 280 Пфлопс, при обучении FP8/FP6 — 140 Пфлопс. Среди поддерживаемого софта упомянуты NVIDIA DGX OS, Ubuntu, Red Hat Enterprise Linux, Rocky Linux.

18.03.2026 [08:44], Сергей Карасёв

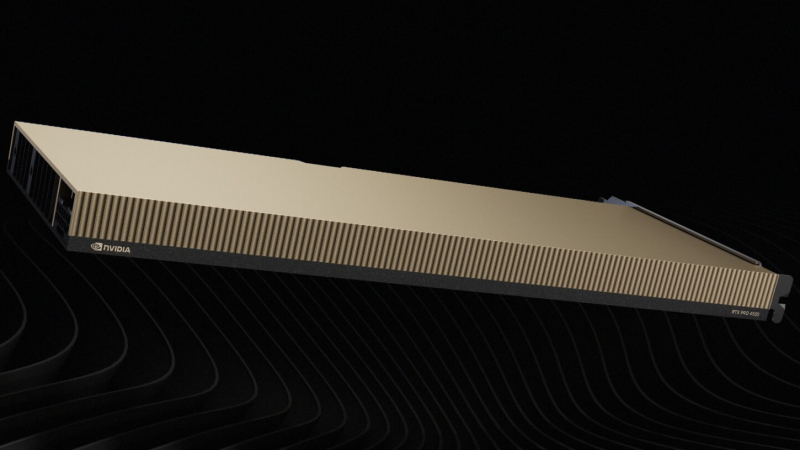

NVIDIA выпустила однослотовый ускоритель RTX Pro 4500 Blackwell Server Edition с 32 Гбайт памяти GDDR7Компания NVIDIA анонсировала ускоритель RTX Pro 4500 Blackwell Server Edition, подходящий для решения таких задач, как ИИ-инференс, анализ данных, обработка видеоматериалов и пр. Новинка ориентирована на дата-центры, облачные платформы и периферийные инфраструктуры. Решение выполнено на архитектуре Blackwell. Конфигурация включает 10 496 ядер CUDA, 82 ядра RT четвёртого поколения, а также 32 Гбайт GDDR7 с 256-бит шиной и пропускной способностью 800 Гбайт/с. Задействованы тензорные ядра пятого поколения, которые обеспечивают до трёх раз более высокую производительность по сравнению с более ранними изделиями и предлагают поддержку режима FP4. Карта получила однослотовое исполнение FHFL и пассивное охлаждение. Заявленное энергопотребление составляет 165 Вт. Для подключения служит интерфейс PCIe 5.0 x16. ИИ-быстродействие на операциях FP4 (Tensor Core) достигает 1,6 Пфлопс, FP8 (Tensor Core) — 811 Тфлопс, FP16/BF16 (Tensor Core) — 406 Тфлопс, TF32 (Tensor Core) — 203 Тфлопс. Как отмечает NVIDIA, по сравнению с системами, работающими только на основе CPU, ускоритель RTX Pro 4500 Blackwell Server Edition обеспечивает до 100 раз более высокую производительность при анализе видеоматериалов с помощью алгоритмов ИИ. Благодаря этому компании могут извлекать данные из видеопотока в режиме реального времени, ускоряя работу приложений компьютерного зрения — как в ЦОД, так и на периферии. Предусмотрены три аппаратных движка NVIDIA NVENC девятого поколения. Они имеют поддержку кодирования 4:2:2 H.264 и HEVC, а также улучшают качество при работе с HEVC и AV1. Вместе с тем три движка NVIDIA NVDEC шестого поколения демонстрируют вдвое более высокую пропускную способность при декодировании материалов H.264, а также поддерживают 4:2:2 H.264 и HEVC.

17.03.2026 [02:00], Владимир Мироненко

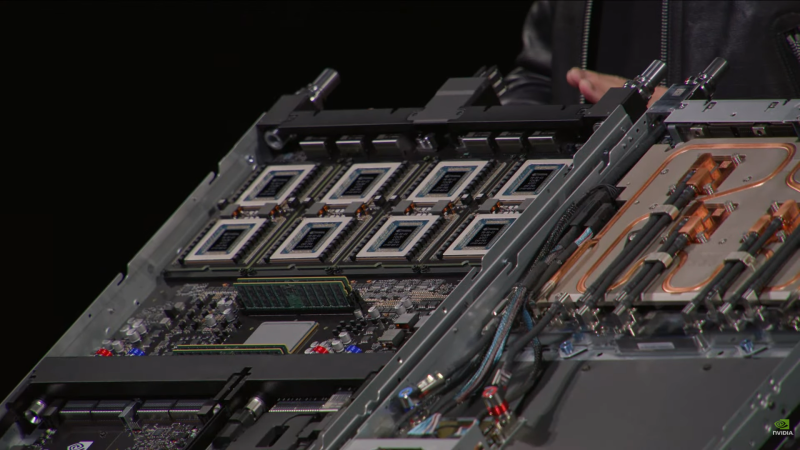

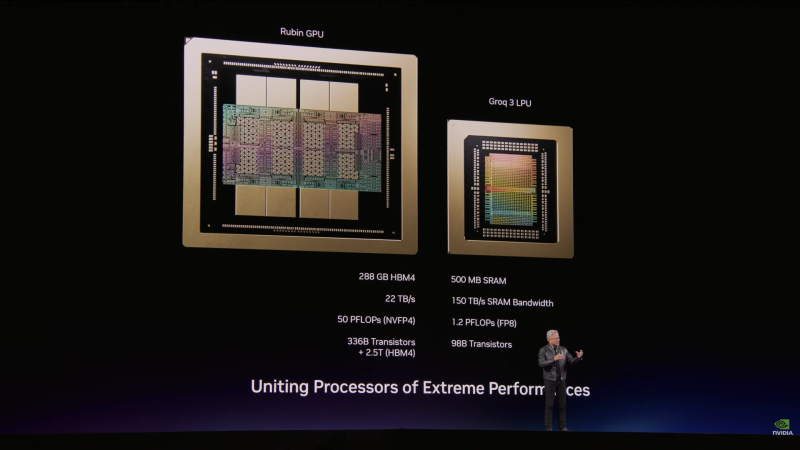

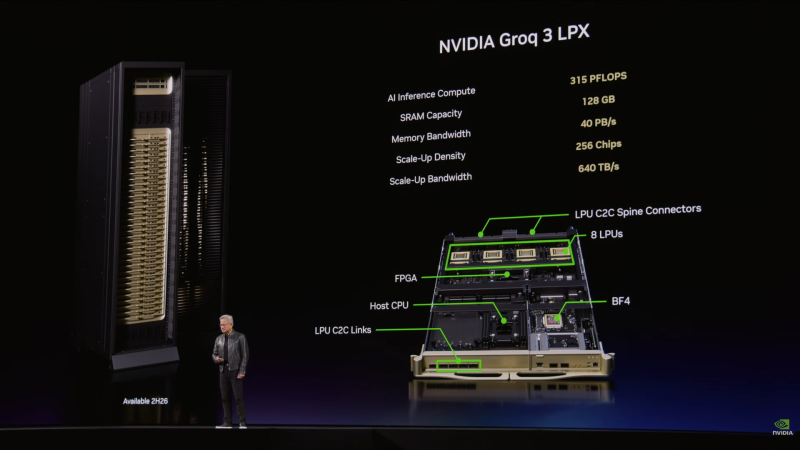

ИИ-ускорители Groq прописались в платформе NVIDIA Vera RubinNVIDIA объявила о том, что платформа Vera Rubin, объединяющая теперь уже семь различных чипов (ещё в январе их было шесть), которые вместе откроют новые горизонты агентного ИИ, запущена в производство. Платформа включает Arm-процессоры Vera, ускорители Rubin, интерконнект NVLink 6, адаптеры ConnectX-9 SuperNIC и DPU BlueField-4, а также Ethernet-коммутаторы Spectrum/Quantum-6. Седьмым чипом стал LPU Groq 3 — NVIDIA купила Groq за рекордные $20 млрд всего три месяца назад и активно наращивает производство LPU. Благодаря такому сочетанию компонентов платформа обеспечивает обработку ИИ-нагрузок на всех этапах — от масштабного предварительного обучения, постобучения и масштабирования во время тестирования до инференса агентных задач в реальном времени, говорит NVIDIA. «Vera Rubin — это скачок в развитии — семь прорывных чипов, пять стоек, один гигантский суперкомпьютер — созданный для обеспечения всех этапов работы ИИ», — сообщил Дженсен Хуанг (Jensen Huang), основатель и генеральный директор NVIDIA. Он отметил, что с появлением Vera Rubin в развитии агентного ИИ наступил переломный момент, положившей начало «крупнейшему в истории развёртыванию инфраструктуры». «Платформа NVIDIA Vera Rubin предоставляет нам вычислительные ресурсы, сетевые возможности и системную архитектуру, позволяющие продолжать работу, одновременно повышая безопасность и надёжность, на которые полагаются наши клиенты», — подтвердил Дарио Амодеи (Dario Amodei), генеральный директор и соучредитель Anthropic. «Инфраструктура NVIDIA — это основа, которая позволяет нам расширять границы ИИ, — заявил Сэм Альтман (Sam Altman), генеральный директор OpenAI. — С NVIDIA Vera Rubin мы будем запускать более мощные модели и агентов в огромных масштабах и предоставлять более быстрые и надёжные системы сотням миллионов людей». Как отметила компания, Vera Rubin предлагает самую обширную комплексную ИИ-платформу — суперкомпьютер с множеством стоек, специально разработанных для ИИ, работающих как одна массивная, целостная система. NVIDIA Vera Rubin NVL72 обеспечивает высокую эффективность в обучение больших MoE-моделей с использованием вчетверо меньшего количества ускорителей по сравнению с платформой Blackwell и достижение до 10 раз большей пропускной способности инференса на ватт при в десять раз меньшей стоимости токена. CPU-стойка Vera — это высокоплотная MGX-платформа с СЖО, объединяющая 256 процессоров Vera для обеспечения масштабируемой, энергоэффективной производительности с первоклассной однопоточной обработкой, что обеспечивает возможности для масштабируемого агентного ИИ. Стойки Vera имеют тесную синхронизацию сред во всей ИИ-фабрике. Вместе со стойками Rubin они обеспечивают основу крупномасштабных систем агентного ИИ и обучения с подкреплением — при этом Vera обеспечивает результаты в два раза эффективнее и наполовину быстрее, чем традиционные CPU (впрочем, в NVL8 по-прежнему будут Intel Xeon). Стойки Groq 3 LPX (тоже с СЖО и тоже на базе MGX) и Vera Rubin, разработанные для обеспечения низкой задержки и обработки больших контекстов, необходимых для агентных систем, обеспечивают до 35 раз более высокую пропускную способность инференса на мегаватт и до 10 раз больший потенциал дохода для моделей с триллионами параметров. В масштабе предприятия парк LPU функционирует как единый гигантский процессор для быстрого и детерминированного ускорения инференса. Стойка LPX с 256 LPU-чипами имеет 128 Гбайт SRAM с агрегированной пропускной способностью 640 Тбайт/с. В сочетании с Vera Rubin NVL72 чипы LPU повышают эффективность декодирования, совместно вычисляя каждый слой модели ИИ для каждого выходного токена. Всё это позволяет работать с моделями с триллионами параметров и контектсным окном в миллионы токенов, сохраняя максимальную эффективность по энергопотреблению, памяти и вычислительным ресурсам. Любопытно, что Rubin CPX в этот раз NVIDIA решила особо не упоминать. Анонсированная вместе с Vera Rubin СХД BlueField-4 STX разработана специально для ИИ-нагрузок, обеспечивая бесперебойное расширение памяти GPU по всему POD-кластеру. Впрочем, теперь компания говорит, что BlueField-4 включает CPU Vera, а не Grace, и ConnectX-9 SuperNIC. STX обеспечивает высокоскоростной общий слой данных, оптимизированный для хранения и извлечения больших объёмов KV-кеша, генерируемых LLM и рабочими процессами агентного ИИ. А программная платформа DOCA Memos позволяет использовать выделенное KV-хранилище для увеличения пропускной способности инференса до пяти раз, также повышая энергоэффективность по сравнению с архитектурами хранения общего назначения. Также NVIDIA совместно с более чем 200 партнёрами анонсировала платформу NVIDIA DSX для Vera Rubin, которая включает технологию DSX Max-Q, позволяющую динамически управлять питанием всей ИИ-фабрики целиком, позволяя увеличить на 30 % ИИ-инфраструктуру в ЦОД при том же энергопотреблении. ПО DSX Flex обеспечивает ИИ-фабрикам гибкость в работе с энергосетями, позволяя освоить до 100 ГВт неиспользуемой мощности сетей. Кроме того, NVIDIA выпустила эталонный проект Vera Rubin DSX AI Factory — схему для совместно разработанной ИИ-инфраструктуры, которая максимизирует количество токенов на ватт и общую пропускную способность, повышая отказоустойчивость системы и ускоряя развётывание. Продукты на базе Vera Rubin будут доступны у партнёров NVIDIA, начиная со II половины этого года. В их число входят гиперскейлеры AWS, Google Cloud, Microsoft Azure и Oracle Cloud, а также партнёры NVIDIA Cloud — CoreWeave, Crusoe, Lambda, Nebius, Nscale и Together AI. Ожидается, что широкий спектр серверов на базе продуктов Vera Rubin будут поставлять глобальные производители систем Cisco, Dell Technologies, HPE, Lenovo и Supermicro, а также Aivres, ASUS, Foxconn, GIGABYTE, Inventec, Pegatron, Quanta Cloud Technology (QCT), Wistron и Wiwynn. |

|