Материалы по тегу: x

|

17.03.2026 [00:52], Владимир Мироненко

TrueNAS Connect обеспечит пользователям Community Edition и сторонних СХД бесплатный доступ к продвинутым функциям TrueNAS EnterpriseКомпания TrueNAS (ранее — iXsystems) объявила о доступности сервиса TrueNAS Connect, который позиционируется как своего рода мост для доступа к корпоративным функциям хранения данных TrueNAS без необходимости приобретения её оборудования. TrueNAS Enterprise отличается от бесплатной TrueNAS Community Edition для NAS-устройств и других систем хранения данных, основанной на Linux, расширенными возможностями, включая проактивное оповещение, расширенное управление, безопасность уровня оборонных стандартов, повышение производительности, интеграцию со сторонним программным обеспечением и т. д. Доступ к этим функциям ранее можно было получить только через коммерческие партнёрские отношения с TrueNAS в рамках бизнес-модели Open-Core, например приобретая устройства TrueNAS Enterprise — различные серверы и решения для хранения данных с предустановленной TrueNAS Enterprise, предоставляющей самый продвинутый набор функций для этой открытой платформы. «TrueNAS Connect был представлен в начале 2026 года как решение для мониторинга и управления, расширяющее и улучшающее вашу установку TrueNAS за счёт дополнительных веб-функций, а также упрощающее процесс развёртывания для новых пользователей. В течение 2026 года TrueNAS Connect также станет мостом между нашей бесплатной версией Community Edition и нашими корпоративными устройствами Enterprise», — отметила компания. Новое решение позволяет клиентам пользоваться расширенными функциями без необходимости приобретения устройств TrueNAS Enterprise. Это является подходящим вариантом для тех, кто уже инвестировал в другое оборудование или вынужден использовать его в соответствии с требованиями организации, но хочет максимально использовать возможности TrueNAS в корпоративной среде, отметил ресурс Phoronix. Компания пояснила, что Community Edition предназначена для энтузиастов, домашних лабораторий, студентов и самостоятельных технических команд, которым нужна мощная платформа хранения данных без лицензионных сборов. Она включает в себя полноценную OpenZFS с поддержкой файловых, блочных и объектных протоколов, виртуальных машин, Docker, приложений и многим другим. Версия будет оставаться бесплатной — ничего не удаляется, и постоянно добавляются новые open source функции. В свою очередь, TrueNAS Enterprise предназначена для ИТ-руководителей и профессиональных организаций, которым нужны готовые к использованию высокодоступные устройства, безопасность уровня оборонного предприятия, выделенная поддержка и глубокая интеграция с такими платформами, как VMware, Proxmox и Veeam. TrueNAS Connect предоставляет новые возможности для опытных пользователей: профессионалов, малых предприятий и т. д. «Это мост, обеспечивающий возможности корпоративного класса, такие как расширенный мониторинг, веб-доступ, проактивные оповещения, управление несколькими системами и защита от программ-вымогателей, для вашего собственного оборудования», — сообщила TrueNAS, добавив, что планирует в ближайшие годы предложить больше дополнительных функций для опытных пользователей. TrueNAS Connect включает бесплатный уровень Foundation, который охватывает базовую функциональность, а также платные уровни Plus и Business. Последний появится в будущем, он ориентирован на команды, которым требуется больше возможностей. Он также значительно упрощает установку Community Edition на оборудование bare metal. Компания отметила, что бизнес-модель Open-Core не меняется. ПО TrueNAS остаётся основой для всех трёх версий. Многие новые функции будут автоматически включены в бесплатную версию Community Edition. TrueNAS Connect управляет лицензированием и разрешениями, которые обеспечивают возможности Enterprise, выходящие за рамки бесплатного уровня.

16.03.2026 [10:45], Владимир Мироненко

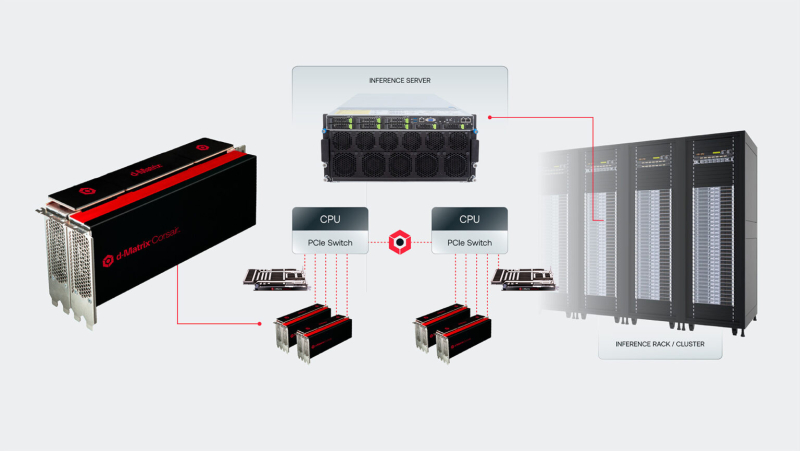

ASIC + GPU: d-Matrix и Gimlet Labs в 10 раз ускорят инференс агентного ИИКомпании d-Matrix и Gimlet Labs сообщили о решении объединить усилия с целью повышения производительности и энергоэффективности инференса для задач агентного ИИ в режиме реального времени. В рамках партнёрства Gimlet интегрирует ускорители d-Matrix Corsair в облако Gimlet Cloud наряду с традиционными GPU. В гибридной архитектуре GPU будут отвечать за ресурсоёмкие этапы инференса, в то время как операции, чувствительные к работе с памятью и задержкам, будут обрабатывать Corsair. Компании сообщили, что совместное решение может обеспечить десятикратное улучшение задержки и пропускной способности на ватт по сравнению с использованием только GPU. Согласно пресс-релизу, решение «идеально подходит для рабочих нагрузок, чувствительных к задержке, включая спекулятивное декодирование, которое часто используется в крупномасштабных развёртываниях ИИ для снижения задержки». Corsair поставляется в виде стандартной карты PCIe с воздушным охлаждением, что позволяет быстро устанавливать решение в ЦОД внутри существующих серверов с GPU без специальных корпусов или нестандартных систем трубопроводов. Сетевые карты d-Matrix Jetstream передают данные между Corsair и GPU посредством стандартного Ethernet, упрощая интеграцию в масштабах инфраструктуры и повышая эффективность использования. Заин Асгар (Zain Asgar), сооснователь и генеральный директор Gimlet Labs, заявил, что «аппаратное обеспечение d-Matrix — идеальное решение для тех этапов инференса, на которых GPU тратят энергию впустую». «Используя Corsair для таких сценариев использования, как спекулятивное декодирование, мы можем обеспечить нашим клиентам значительно более высокую производительность при тех же габаритах», — добавил он. Программный стек Gimlet интеллектуально распределяет и сопоставляет рабочие нагрузки агентов между различными ускорителями разных производителей, поколений и архитектур, запуская каждый сегмент на наиболее оптимальном оборудовании. ЦОД Gimlet включают в себя различные типы оборудования и высокоскоростные интерконнекты для обслуживания передовых лабораторий и других компаний, занимающихся разработкой ИИ. Аналитик Мэтт Кимбалл (Matt Kimball) из Moor Insights & Strategy сообщил ресурсу Data Center Knowledge, что ключевым моментом является сочетание специализированного оборудования и программной оркестрации. «Архитектура d-Matrix разработана с учётом эффективности инференса, а не масштабируемости обучения, что соответствует рынку в ходе внедрения приложений ИИ в производство, — сказал Кимбалл. — Но одного оборудования недостаточно — такие платформы, как Gimlet, стремятся упростить развёртывание и легко интегрироваться в существующие рабочие процессы. Именно это делает данное решение привлекательным». Аналитик добавил, что реальная ценность решения заключается в уровне абстракции, который предоставляет Gimlet, позволяя запускать рабочие нагрузки на гетерогенных чипах без переписывания кода. «Рабочие нагрузки в области ИИ становятся всё более гетерогенными, но большая часть инфраструктуры по-прежнему оптимизирована под один тип ускорителя», — отметил он. По его словам, если Gimlet сможет упростить разработчикам развёртывание на нескольких чипах, это обеспечит реальное повышение эффективности системы. «Успешные платформы — это те, которые разработчики могут использовать, не задумываясь об оборудовании», — считает Кимбалл. Компании планируют предоставить своё объединённое решение отдельным клиентам в рамках Gimlet Cloud во II половине 2026 года. Data Center Knowledge отметил, что это также подчёркивает более широкую тенденцию в инфраструктуре ИИ: гетерогенные системы, вероятно, будут доминировать на следующем этапе развёртывания ИИ, и успех будет зависеть как от оркестрации ПО, так и от производительности оборудования. NVIDIA тоже добавил к своим GPU Rubin новые ASIC Groq.

15.03.2026 [11:15], Сергей Карасёв

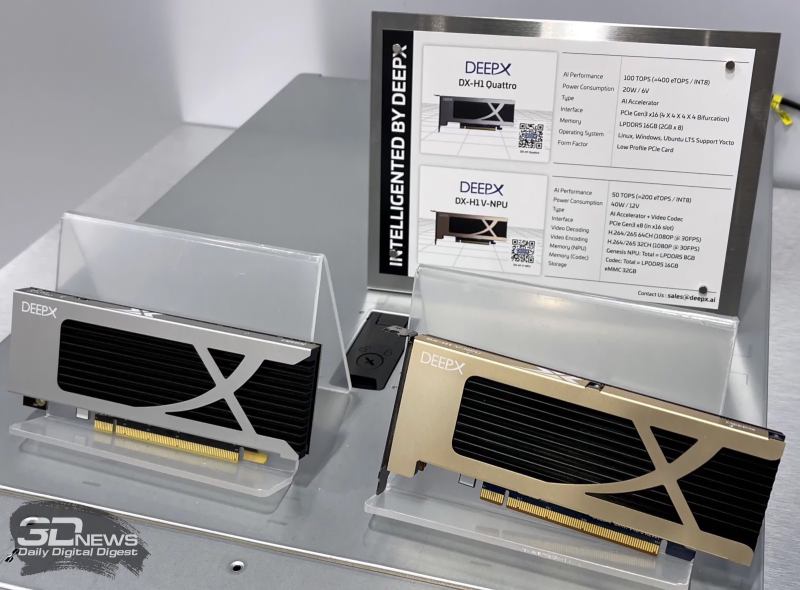

Выпуск ИИ-чипов DeepX DX-M2 отложен из-за проблем у TeslaИзменение графика разработки ИИ-ускорителя Tesla следующего поколения, по сообщению ресурса DigiTimes, привело к тому, что южнокорейская компания DeepX вынуждена отложить выпуск своих чипов DX-M2, массовое производство которых изначально было запланировано на II квартал 2027 года. Отмечается, что задержки возникли с разработкой изделия Tesla AI6. Предполагается, что это решение будет применяться для поддержания разнообразных нагрузок в инфраструктуре Tesla, включая платформы автономного вождения, системы человекоподобного робота Optimus и дата-центры для ИИ-задач. В 2025 году Tesla подписала контракт с Samsung на изготовление AI6 вплоть до декабря 2033-го: стоимость соглашения составляет $16 млрд. Первоначальный договор предусматривал производство около 16 тыс. пластин в месяц, однако затем Tesla запросила дополнительно 24 тыс. пластин, что в сумме предполагает объем до 40 тыс. пластин ежемесячно. Для Tesla AI6 планируется применение 2-нм техпроцесса Samsung. По такой же методике будут выпускаться чипы DeepX DX-M2. Для обоих этих изделий оговорено использование услуги Multi-Project Wafer (MPW), при которой на одной кремниевой пластине в рамках получения прототипов размещаются изделия нескольких разных заказчиков. Такой подход позволяет снизить затраты на разработку перед организацией массового производства. Однако, по информации DigiTimes, с выходом Tesla AI6 на этап MPW возникли задержки. С чем именно связаны сложности, не уточняется. Отраслевые эксперты полагают, что пересмотр графика может быть обусловлен изменением сроков инвестиций в автономные транспортные средства, роботизированные платформы и суперкомпьютеры с ИИ. Компания Samsung отказалась от комментариев, сославшись на конфиденциальность проектов заказчиков. Между тем из-за задержек Tesla выпуск чипов DeepX DX-M2 по программе MPW, который планировалось начать в апреле, переносится на более поздний срок. В соответствии с новым графиком, тестирование качества этих решений будет организовано не ранее III квартала текущего года. Ожидается, что DX-M2 обеспечит ИИ-производительность на уровне 80 TOPS при максимальном энергопотреблении примерно 5 Вт. Чип поддерживает память LPDDR5X. Утверждается, что процессор способен работать с ИИ-моделями, насчитывающими до 100 млрд параметров.

12.03.2026 [11:38], Руслан Авдеев

Amazon потребовала заблокировать запуск миллиона спутников-ЦОД SpaceX — и сама попала под критикуКомпания Amazon потребовала от американских регуляторов отклонить поданную SpaceX заявку на одобрение миллионной группировки спутников для ЦОД. Компания назвала идею «спекулятивной» и «нереалистичной», сообщает The Register. Тем временем она сама столкнулась с критикой со стороны Федеральной комиссии по связи США (FCC). Недавно SpaceX предложила создать орбитальную группировку спутников-ЦОД, подав соответствующую заявку в FCC. Amazon Leo, управляющая спутниковой сетью связи, конкурирующей со Starlink компании SpaceX, немедленно выступила с возражениями. Leo объявила, что в заявке есть лишь самые общие сведения о том, как SpaceX намерена реализовать свои планы. Последняя запрашивает разрешение для вывода на низкую околоземную орбиту миллиона спутников. Для сравнения, сейчас вблизи Земли находится около 15 тыс. аппаратов. SpaceX заявляет, что создание такой группировки станет первым шагом на пути создания т.н. «цивилизации второго типа» по шкале Кардашева, способной использовать все энергетические ресурсы родной звезды. Amazon подчёркивает, что в заявке не указаны ни конструкция спутников, ни радиочастотные характеристики устройств, ни планы контроля сближений космических аппаратов и борьбы с помехами в подобном масштабе. Другими словами, сообщается о «завышенных амбициях», а не о реальном плане. Критики утверждают, что речь идёт о спекуляциях, по форме не соответствующих правилам FCC. Вопросы по поводу возможного внесения помех астрономическим наблюдениям имеются и к группировке Amazon Leo. Кроме того, компанию и саму обвиняют в загрязнении окружающей среды из-за массовых ракетных пусков и сгорания спутников по мере их схода с орбиты. Ещё в 2025 году основатель Amazon Джефф Безос (Jeff Bezos) с удовлетворением прогнозировал, что гигаваттные ЦОД на солнечной энергии за два десятка лет заполнят орбиту Земли, поэтому жалобы на SpaceX вряд ли вызваны заботой об окружающей среде.

Источник изображения: David Clode/unsplash.com Более того, заявку требуют отклонить с довольно странной формулировкой — как «формально неполную». В любом случае, если FCC решит дать жалобе ход, Amazon просит «в полной мере разобраться» с проблемами, связанными с развёртыванием группировки подобного масштаба, и потребовать от SpaceX конкретных технических подробностей. Также Amazon предупреждает, что компания-конкурент фактически добивается разрешения на «орбитальную монополию», превращающую SpaceX в эксклюзивного «привратника» в космосе — вероятно, в этом и заключаются основные опасения. Не так давно эксперты Gartner скептически отнеслись к идее размещения в космосе дата-центров, буквально назвав её «вершиной безумия». По их мнению, эксплуатация таких объектов никогда не будет рентабельной и не сможет удовлетворить спрос на вычислительные мощности на Земле. По имеющимся данным, группировка Amazon Leo (ранее Project Kuiper) насчитывает на орбите более 200 спутников, тогда как у Starlink их более 9,9 тыс. FCC в ответ на жалобу Amazon посоветовала сосредоточиться на собственных планах запуска, поскольку компания на 1 тыс. спутников отстаёт от собственного проекта по выводу на орбиту спутников связи — к июлю 2026 года она собиралась вывести 1,6 тыс. аппаратов, но в конце января попросила FCC продлить срок их вывода до июля 2028 года по разным причинам, включая нехватку ракет в краткосрочной перспективе. При этом в отдельной заявке Amazon просит разрешение вывести на орбиту в общей сложности 4,5 тыс. интернет-спутников. Заявка на вывод миллиона спутников — рекордная из числа дошедших до стадии подачи. Планы развёртывания ЦОД в космосе имеют многие IT-бизнесы, включая Axiom Space, NTT, Ramon.Space, Aetherflux и Sophia Space, а Starcloud (ранее Lumen Orbit) уже вывела в космос микро-ЦОД на основе одного ИИ-ускорителя для тестов. Один из основателей Google Эрик Шмидт (Eric Schmidt) говорил, что купил компанию Relativity Space для вывода в космос собственных ЦОД. Наконец, Google в конце 2025 года анонсировала Project Suncatcher, предусматривающий создание в космосе совместно с компанией Planet дата-центров на основе тензорных ускорителей самой Google.

06.03.2026 [08:58], Руслан Авдеев

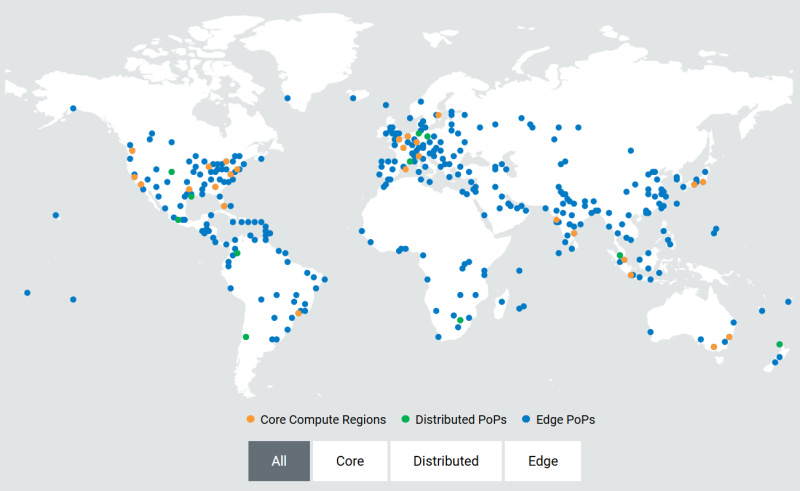

Akamai развернёт тысячи ускорителей NVIDIA RTX Blackwell для распределённого инференсаОблачный провайдер Akamai анонсировал покупку «тысяч» ИИ-ускорителей для развития своей распределённой облачной инфраструктуры по всему миру. Развёртывание новых чипов позволит создать единую оптимизированную ИИ-платформу для быстрого и распределённого инференса в глобальной сети Akamai. По словам компании, она готовит базовую инфраструктуру для «физического» и «агентного» ИИ, где решения необходимо принимать в режиме реального времени. Ранее компания анонсировала проект Akamai Inference Cloud. Как заявляет Akamai, пока крупные облачные бизнесы расширяют проекты обучения ИИ, компания сосредоточилась на удовлетворении потребностей эпохи инференса. Централизованные ИИ-фабрики имеют важное значение для создания моделей, но для их масштабной эксплуатации необходима децентрализованная «нервная система». Внедрение NVIDIA Blackwell в распределённая инфраструктуру, как ожидается, позволит ИИ взаимодействовать с «физическим» миром на местах — с системами автономной доставки, умными энергосетями, роботами-хирургами, антифрод-системами т.п. — без географических и финансовых ограничений, характерных для классических облаков. Интеграция ускорителей Blackwell обеспечит:

Предоставляя инструментарий для выполнения задач ближе к конечным пользователям, Akamai обеспечивает высокую пропускную способность и, как утверждается, одновременно снижает задержку до 2,5 раз. Это позволит бизнесам экономить до 86 % на инференсе в сравнении с обычными облачными компаниями-гиперскейлерами. Платформа объединяет серверы на основе ускорителей NVIDIA RTX Pro 6000 Blackwell Server Edition с DPU NVIDIA BlueField-3 и распределённую облачную инфраструктуру Akamai с 4,4 тыс. точек присутствия. Cloudflare применяет платформу с «бессерверным» инференсом в более чем 200 городах. Её Workers AI обеспечивают глобальный инференс с задержкой менее 100 мс без специального выделения кластеров ускорителей. Fastly применяет платформу периферийных вычислений, но предлагает меньшее количество локальных точек присутствия (PoP) для выполнения задач на GPU/CPU.

05.03.2026 [22:49], Андрей Крупин

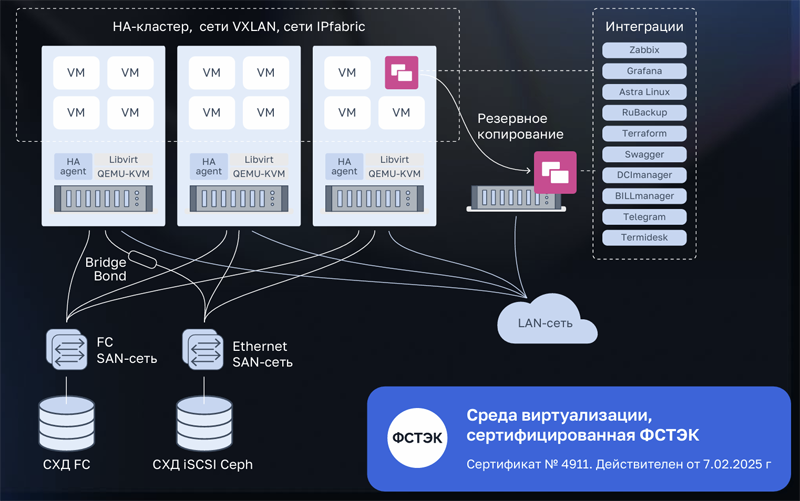

Платформа серверной виртуализации VMmanager дополнилась инструментами резервного копирования RuBackup«Группа Астра» объявила о выпуске комплексного решения, объединяющего платформу серверной виртуализации VMmanager и систему резервного копирования RuBackup. Платформа VMmanager предназначена для решения задач серверной виртуализации и построения отказоустойчивых кластеров — в её составе представлены все необходимые инструменты для создания отказоустойчивой среды виртуализации, включая High Availability, живую миграцию, автоматическую балансировку и поддержку аппаратных систем хранения данных. В свою очередь, RuBackup обеспечивает защиту обрабатываемой информации. Интеграция продуктов выполнена на системном уровне: копирование выполняется безагентно через API гипервизора без остановки приложений, с поддержкой полных, инкрементальных и дифференциальных копий при минимальном влиянии на производительность.

Архитектура платформы серверной виртуализации VMmanager (источник изображения: astra.ru) По словам разработчиков, объединение VMmanager с RuBackup даёт заказчику комплексный эффект. С одной стороны, это операционная и коммерческая эффективность: единая закупка, общая техническая поддержка и снижение совокупной стоимости владения. С другой — технологическая синергия: платформы развиваются с учётом друг друга, а их взаимодействие реализовано до уровня, когда защита данных становится естественной функцией виртуальной среды. Обе разработки имеют сертификаты ФСТЭК России и включены в реестр отечественного ПО Минцифры, что гарантирует соответствие требованиям безопасности и готовность к использованию в государственных и корпоративных проектах.

03.03.2026 [14:27], Руслан Авдеев

Сделано в США: Flex начала выпуск американских ИИ-серверов с AMD InstinctАмериканская производственная компания Flex, поставляющая решения для дата-центров, анонсировала расширение стратегического сотрудничества с AMD для выпуска решений на платформе Instinct. По словам Flex, это важная веха на пути укрепления локального производства на территории США, в том числе передовых ИИ- и HPC-продуктов. В рамках партнёрства выпуск платформы AMD Instinct MI355X организован на территории головного подразделения Flex в Остине (Техас). В следующем квартале объёмы выпуска должны увеличиться. Речь идёт не только о платформе текущего поколения, компания намерена поддержать выпуск и новых платформ Instinct для удовлетворения спроса со стороны крупномасштабных ИИ-проектов. Сейчас Flex выпускает высокоплотные системы с восемью ускорителями и сопутствующей обвязкой. Каждая платформа, как утверждают в компании, проходит строгие заводские испытания и оценку. Системы оснащаются СЖО JetCool, принадлежащей Flex. По данным производителя, комбинация передовых индустриальных мощностей Flex, надёжной цепочки поставок и производственных мощностей в США с передовыми позициями AMD в HPC-сегменте позволяет клиентам масштабировать свои ИИ-проекты быстрее и с повышенной надёжностью. Головная структура Flex в Техасе занимает площадь более 130 тыс. м2 и создана для поддержки комплексного производства в больших объёмах. Всего у Flex в США есть более 650 тыс. м2 площадей на 17 объектах.

Источник изображения: Flex Планы AMD по локализации производства включают и выпуск чипов на американских фабриках TSMC. NVIDIA идёт по тому же пути, но в части выпуска или хотя бы сборки серверов на территории США, в том числе для обслуживания гиперскейлеров, у неё гораздо больше возможностей. Но и AMD укрепила свои позиции в этой области в результате сделки с ZT Systems и Sanmina. США всеми силами стремятся локализовать производство и разработки на своей территории. В декабре 2025 года было объявлено о заключении партнёрских отношений с 24 ведущими IT-компаниями в рамках «Миссии Генезис», призванной стимулировать ИИ-разработки и производство на американской территории. Например, в конце января 2026 года сообщалось, что Corning построит крупнейшее в мире производство оптоволоконного кабеля для ЦОД в рамках сделки с Meta✴ на $6 млрд.

01.03.2026 [18:15], Руслан Авдеев

CPP Investments и Equinix купили за $4 млрд оператора экологичных ИИ ЦОД atNorthКанадский пенсионный фонд Canada Pension Plan Investment Board (CPP Investments) и Equinix анонсировали соглашение о покупке у Partners Group компании atNorth за $4 млрд, специализирующейся на предоставлении колокейшн-площадок для HPC/ИИ-нагрузок и провайдере ЦОД «под ключ», сообщает HPC Wire. Digital Realty, тоже пытавшаяся купить atNorth, осталась не у дел. CPP и Equinix предварительно согласовали финансирование в объёме $4,2 млрд (€3,6 млрд) как для закрытия самой сделки, так и для расширения бизнеса atNorth. CPP Investments намерена вложить около $1,6 млрд, получив долю в 60 % компании, а Equinix — около 40 %. Сообщается, что сразу после закрытия сделка, которая ещё ожидает одобрение регуляторов, окажет положительное действие на скорректированный денежный поток от операционной деятельности (AFFO) Equinix. Сделка укрепляет долговременное сотрудничество между Equinix и CPP Investments — в 2024 году было создано совместное предприятие с сингапурской GIC для расширения портфоли ЦОД xScale. У atNorth есть восемь действующих дата-центров, ещё несколько строятся в Дании, Финляндии, Исландии, Норвегии и Швеции — общий объём портфолио составляет 800 МВт. Кроме того, компания уже зарезервировала поставки 1 ГВт энергии. Некоторые объекты, разработанные для ИИ и HPC, поддерживают жидкостное охлаждение. Также компания активно внедряет возобновляемую энергетику, инициативы по использованию избыточного тепла от оборудования, в том числе для выращивания овощей, и модульный дизайн для минимизации ущерба окружающей среде и продвижению экономики замкнутого цикла. atNorth заявляет, что компания по-прежнему будет придерживаться работы в северном регионе и продолжит независимую работу под собственным брендом, сохраняя приверженность культуре и ценностям, которые она продвигает. В CPP Investments подчеркнули, что сделка основана на уже имеющемся долгосрочном сотрудничестве с Equinix. Фонд намерен и далее наращивать бизнес в быстрорастущем секторе ЦОД. Equinix подчеркнула, что для клиентов, нуждающихся в надёжном масштабировании, компания предлагает готовую к будущим задачам инфраструктуру с сохранением юридического и информационного суверенитета. Северная Европа укрепляет статус критически важного хаба для следующего этапа цифрового роста. Он имеет сильную и надёжную экономику, активно внедряет инновации, делает ставку на исследования и техническую экспертизу, а также экоустойчивые проекты. Здесь есть много источников возобновляемой энергии и оптимальный для ЦОД климат. Equinix располагает восемью ЦОД на севере Европы: пять в Хельсинки и три в Стокгольме. Всего же в ведении компании есть более 100 объектов в 20 странах. В Европе компания на 100 % компенсирует энергопотребление своих дата-центров за счёт покупок возобновляемой энергии. Это вполне соответствует «зелёному» курсу atNorth и, как ожидается, Equinix добьётся нулевых выбросов к 2040 году.

27.02.2026 [09:30], Владимир Мироненко

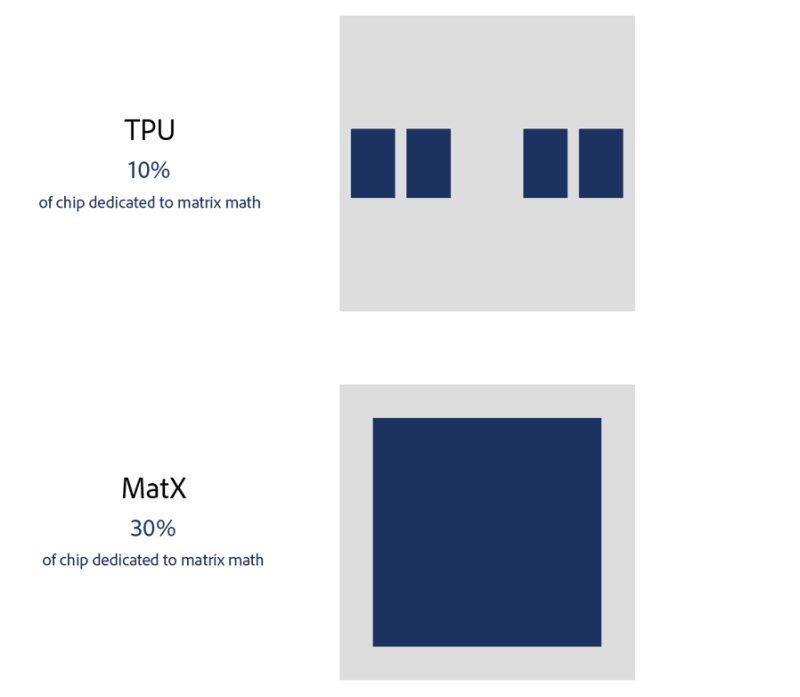

Стартап MatX, намеренный конкурировать с NVIDIA, привлёк $500 млн инвестицийСтартап MatX в сфере разработки ИИ-чипов, основанный бывшими сотрудниками Google, сообщил, что привлёк $500 млн в рамках раунда финансирования серии B для завершения разработки и быстрого масштабирования производства чипа для обучения больших языковых моделей (LLM), с выпуском готовой продукции менее чем за год. Раунд возглавили Jane Street и Situational Awareness, инвестиционная фирма, основанная бывшим исследователем OpenAI Леопольдом Ашенбреннером (Leopold Aschenbrenner). Среди других инвесторов — Marvell Technology, венчурные фирмы NFDG и Spark Capital, а также соучредители Stripe Патрик и Джон Коллисон (Patrick, John Collison), Triatomic Capital, Harpoon Ventures, Андрей Карпати (Andrej Karpathy), Дваркеш Патель (Dwarkesh Patel) и т.д. Компания отказалась раскрыть точную оценку, но заявила, как сообщает Bloomberg, что теперь её стоимость оценивается в несколько миллиардов долларов. Нынешний раунд финансирования состоялся более чем через год после раунда серии А, в котором было привлечено около $100 млн и который возглавила компания Spark Capital, сообщил TechCrunch. Тогда, в 2024 году, компания была оценена более чем в $300 млн.

Источник изображения: MatX «Мы разрабатываем LLM-чип, который обеспечивает гораздо более высокую пропускную способность, чем любой другой чип, и при этом достигает минимальной задержки. Мы называем его MatX One», — сообщила компания. MatX One основан на разделяемом систолическом массиве, сочетая низкую задержку, характерную для SRAM-ориентированных разработок, с поддержкой длительных контекстов HBM. Компания отметила, что конструкция чипа, а также новый подход к численным вычислениям, обеспечивают более высокую пропускную способность при работе с LLM, чем любая ИИ-система на рынке. «Более высокая пропускная способность и меньшая задержка позволяют создавать более интеллектуальные и быстрые модели за ваши деньги, потраченные на подписку», — сообщила MatX. Компания рассчитывает завершить разработку чипа в этом году и начать поставки в следующем. MatX планирует выпускать чип на мощностях TSMC. Новое финансирование призвано помочь компании зарезервировать производственные мощности и комплектующие, чтобы обеспечить быструю отгрузку после завершения разработки, сообщил соучредитель Майк Гюнтер (Mike Gunter). «Это позволяет нам конкурировать на равных с крупнейшими компаниями, поскольку они могут очень быстро масштабироваться, — сказал он. — Этот раунд ставит нас практически на один уровень с игроками, обладающими огромными финансовыми ресурсами».

26.02.2026 [23:11], Владимир Мироненко

AMD инвестирует в Nutanix $250 млн и создаст совместную платформу для агентного ИИAMD и Nutanix объявили о заключении соглашения о многолетнем стратегическом партнёрстве с целью разработки открытой инфраструктурной платформы для корпоративных приложений в области агентного ИИ, первая версия которой должна появиться к концу этого года. В рамках соглашения AMD инвестирует $150 млн в обыкновенные акции Nutanix по цене $36,26/шт. и предоставит до $100 млн дополнительного финансирования для совместных инженерных и маркетинговых инициатив, а также сотрудничества в области выхода на рынок с целью ускорения внедрения совместной платформы агентного ИИ. Ожидается, что сделка по инвестиции в акционерный капитал будет завершена во II квартале 2026 года после получения необходимых разрешений регулирующих органов. Совместно разработанная платформа агентного ИИ предназначена для обеспечения ускорения инференса на базе ускорителей Instinct и процессоров EPYC, HPC и оркестрации с использованием EPYC, а также унифицированного управления жизненным циклом с помощью Nutanix Enterprise AI, что позволит развёртывать открытые и коммерческие ИИ-модели без зависимости от вертикально интегрированных стеков ИИ. В рамках сделки Nutanix также интегрирует ПО AMD ROCm и Enterprise AI в свою облачную платформу Nutanix Cloud и платформу Nutanix Kubernetes, отметил ресурс SiliconANGLE. В настоящее время Nutanix поддерживает только ускорители NVIDIA. Благодаря этой сделке Nutanix будет поддерживать и ускорители AMD, что, как ожидается, позволит AMD расширить круг клиентов. «Наша цель — предоставить клиентам выбор, — заявил глава Nutanix Раджив Рамасвами (Rajiv Ramaswami) изданию The Register. — NVIDIA — лидер рынка, а AMD — ещё одна крупная компания, владеющая платформой». О сделке было объявлено после того, как Nutanix сообщила о финансовых результатах за II квартал 2026 финансового года. Выручка компании выросла год к году на 10 % до $723 млн. Скорректированная прибыль на акцию составила 56¢. Оба показателя превысили прогнозы аналитиков, ожидавших $710,35 млн выручки и 44¢ на акцию скорректированной прибыли. Высокие показатели были достигнуты благодаря росту клиентской базы: годовой доход от регулярных платежей по состоянию на конец января составил $2,36 млрд, что на 16 % больше, чем годом ранее. Рамасвами сообщил, что за прошедший квартал компания заключила 1000 новых контрактов с клиентами, и большинство из них намерены перейти с VMware на Nutanix. Вместе с тем дефицит в цепочках поставок процессоров и комплектующих, включая память и накопители, привёл к тому, что компания снизила свой прогноз на весь год с $2,82–$2,86 млрд до $2,80–$2,84 млрд. После объявления о сделке AMD и Nutanix акции Nutanix выросли в цене на 15 %. |

|