Материалы по тегу: ии

|

07.01.2026 [12:23], Руслан Авдеев

xAI привлекла $20 млрд в раунде финансирования, возглавленном NVIDIA и CiscoИИ-стартап xAI, основанный и поддерживаемой Илоном Маском (Elon Musk), объявил о том, что привлёк $20 млрд в ходе раунда позднего финансирования. В раунде серии E приняли участие NVIDIA и Cisco, сообщает Silicon Angle. К ним присоединились Valor Equity Partners, Stepstone Group, Fidelity Management & Research, Qatar Investment Authority, MGX, Baron Capital Group и другие инвестиционные структуры. В ноябре сообщалось, что следующий раунд финансирования позволит оценить компанию в $230 млрд. Компания намерена использовать капитал для расширения своей ИИ-инфраструктуры. Она обучает флагманские ИИ-модели серии Grok с использованием суперкомпьютеров Colossus. Недавно Маск анонсировал, что компания приобрела новый дата-центр для увеличения вычислительной мощности. По слухам, ЦОД находится недалеко от электростанции, которую xAI строит, чтобы удовлетворить растущие потребности Colossus в энергии. По данным Маска, запланированные доработки Colossus увеличат энергопотребление до 2 ГВт. Маск уже похвалил недавно представленные ускорители NVIDIA Rubin. Судя по новостям об участии NVIDIA в финансировании xAI, высока вероятность, что новые чипы будут активно применяться для расширения проекта Colossus. Помимо строительства новой инфраструктуры, xAI будет использовать собранные средства для запуска новых продуктов. Компания объявила, что речь идёт о разработках как для пользовательского, так и для корпоративного рынков. В декабре 2025 года xAI представила корпоративную версию Grok, предусматривающую интеграцию Google Drive. Сотрудники компаний могут использовать чат-бот для поиска материалов, хранящихся в облачном хранилище. Тариф Grok Enterprise также предусматривает доступ к инструментам по обеспечению кибербезопасности. Использующие его организации могут задавать настройки доступа и использовать собственные ключи шифрования для защиты бизнес-данных. В ближайшие месяцы xAI намерена обеспечить интеграцию со сторонними сервисами помимо Google Drive. Компания также добавит и новые функции, включая возможность создания кастомных ИИ-агентов. Обновления должны выйти одновременно с премьерой флагманской ИИ-модели Grok 5. Компания сообщила, что её обучение уже началось. Последний раунд финансирования состоялся всего через неделю после того, как OpenAI, по слухам, получила $22,5 млрд от ключевого инвестора SoftBank Group. Средства поступили в рамках раунда финансирования на $40 млрд, объявленного ещё в марте 2025 года. Как и xAI, компания OpenAI активно строит инфраструктуру ИИ ЦОД для поддержки обучения ИИ-моделей нового поколения.

07.01.2026 [07:01], Владимир Мироненко

Lenovo показала концепт ИИ-хаба Lenovo Personal AI Hub Concept для обработки ИИ-приложений в экосистеме устройств пользователяLenovo продемонстрировала на выставке CES 2026 концепт ИИ-хаба Lenovo Personal AI Hub Concept, получивший кодовое название Project Kubit. Как сообщает компания, персональный ИИ-хаб — периферийное облачное устройство для поддержки ИИ-приложений в экосистеме потребителя, включающей ПК, смартфоны, носимые устройства и решения для умного дома. В частности, Lenovo Personal AI Hub собирает данные с различных платформ, предоставляя пользователю доступ к новым уровням аналитики и ИИ-приложениям, обеспечивая высокопроизводительные персональные вычисления с использованием ИИ.

Источник изображения: Lenovo Lenovo Personal AI Hub Concept представляет собой систему из двух рабочих станций Lenovo ThinkStation PGX, соединённых с помощью адаптера NVIDIA ConnectX-7. Lenovo ThinkStation PGX использует для вычислений суперчип NVIDIA GB10, включающий ускоритель с архитектурой Blackwell и 20-ядерный Arm-процессор. Объём унифицированной оперативной памяти LPDDR5X-9400 составляет 128 Гбайт, ёмкость накопителя NVMe M.2 составляет до 4 Тбайт. Станция обеспечивает производительность 1 PFLOPS в вычислениях FP4. Система из двух станций поддерживает работу с ИИ-моделями размером до 405 млрд параметров. ИИ-хаб Lenovo Personal AI Hub поддерживает управление как с помощью касаний сенсорного экрана, так и с использованием голосовых команд.

06.01.2026 [22:15], Владимир Мироненко

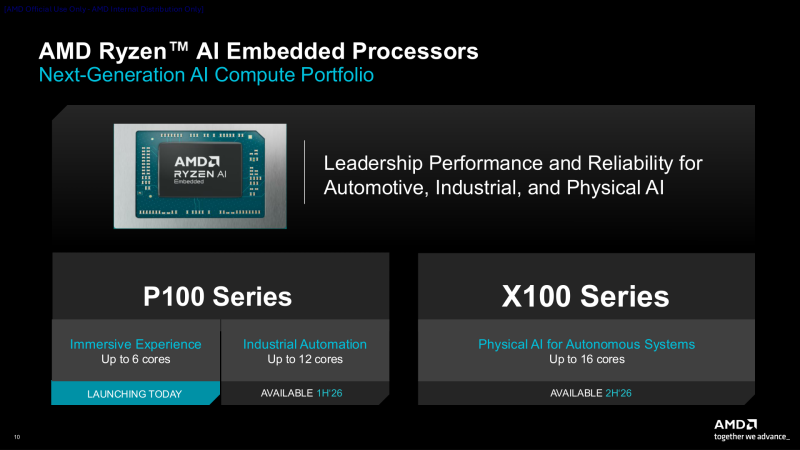

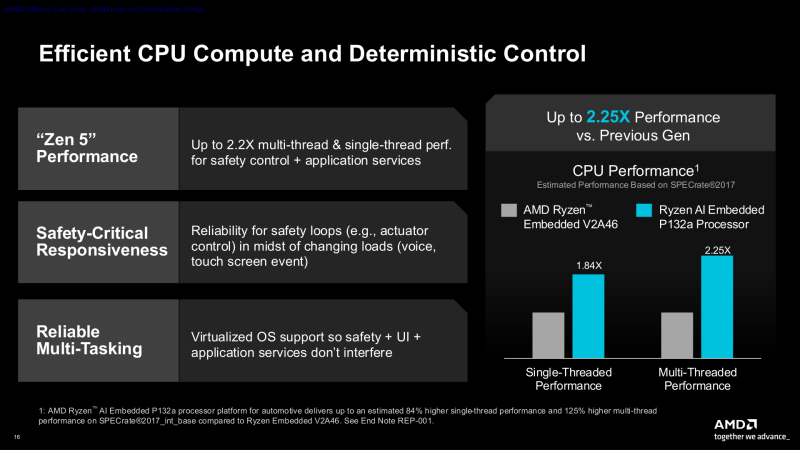

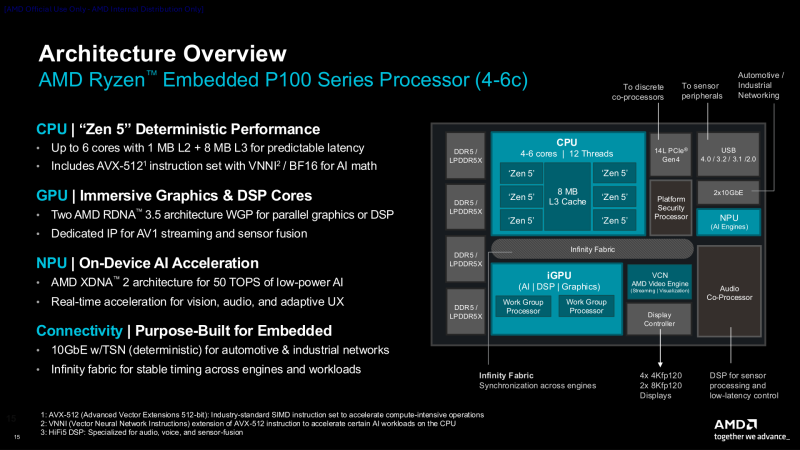

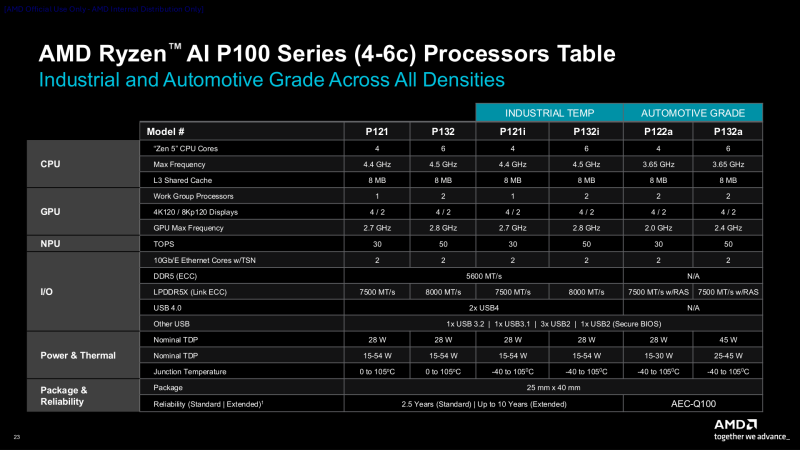

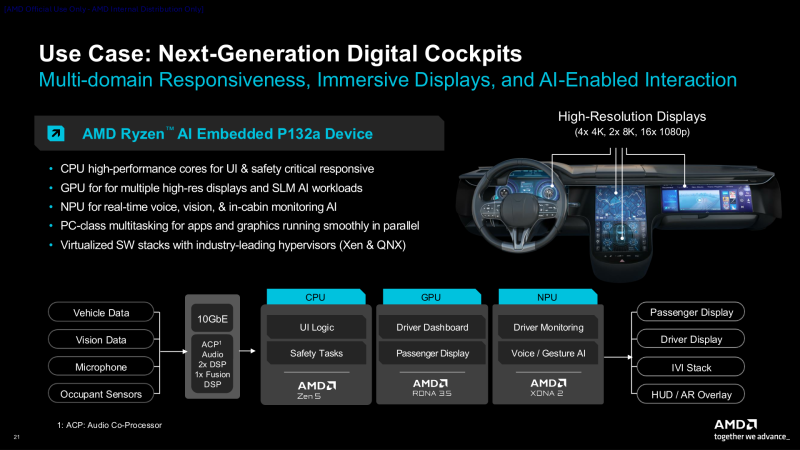

AMD анонсировала чипы Ryzen AI Embedded серий P100 и X100AMD представила процессоры AMD Ryzen AI Embedded серий P100 и X100, сочетающие высокопроизводительные ядра Zen 5, GPU RDNA 3.5 и NPU XDNA 2 для энергоэффективного ускорения ИИ. Процессоры серии P100 ориентированы на автомобильные решения и промышленную автоматизацию, а процессоры серии X100 с большим количеством ядер и повышенной ИИ-производительностью предназначены для более требовательных физических и автономных систем. Процессоры серии P100 с 4–6 ядрами, оптимизированные для цифровых кабин следующего поколения и HMI (человеко-машинных интерфейсов), обеспечивают рендеринг графики в реальном времени для автомобильных информационно-развлекательных дисплеев, взаимодействие на основе ИИ и быстродействие в многодоменных средах. Они обеспечивают до 2,2-кратное повышение производительности в многопоточных и однопоточных задачах по сравнению с предыдущим поколением. Чипы P100 имеют диапазон TDP от 15 Вт до 54 Вт, поддерживают память LPDDR5X и выполнены в BGA-корпусе размером 25 × 40 мм (FP8). Новые чипы с поддержкой работы при температуре от –40 °C до +105 °C созданы для сложных условий эксплуатации в ограниченном пространстве, включая безвентиляторные или полузащищённые конструкции, и рассчитаны на 10 лет работы в режиме 24/7. Чипы поддерживают память DDR5-5600 (ECC) и LPDRR5x-7500/8000 (Link ECC), а также имеют поддержку двух 10GbE-интерфейсов и двух USB4-подключений. AMD утверждает, что серия P100 обеспечивает до трёх раз большую ИИ-производительность (AI TOPS) по сравнению с серией Ryzen Embedded 8000. Это имеет важное значение для клиентов, модернизирующих существующие системы для достижения более высокой производительности ИИ на Ватт и на плату в целом, отметил ресурс Storagereview. Помимо автомобильного применения компания также ориентирует свои процессоры на вещательное оборудование, промышленные ПК, киоски, медицинские устройства и даже аэрокосмическую отрасль. Процессоры Ryzen AI Embedded обеспечивают согласованную среду разработки с унифицированным программным стеком, охватывающим CPU, GPU и NPU. Разработчики получат преимущества от оптимизированных библиотек CPU, открытых стандартных API GPU и архитектуры XDNA. Весь программный стек построен на базе открытой платформы виртуализации Xen, которая обеспечивает безопасную изоляцию нескольких доменов. Это позволяет использовать Yocto или Ubuntu для HMI, FreeRTOS для задач реального времени и Android или Windows для поддержки многофункциональных приложений, которые безопасно работают параллельно. Процессоры AMD Ryzen AI Embedded P100 с 4–6 ядрами, а также инструменты разработки и документация уже доступны для ознакомления избранным клиентам. Начало серийного производства чипов намечено на II квартал, а референсные платы появятся во II половине 2026 года. Процессоры серии P100 с 8–12 ядрами, предназначенные для приложений промышленной автоматизации, начнут поставляться в I квартале. Предоставление образцов процессоров серии X100 с до 16 ядер начнётся в I половине этого года.

06.01.2026 [14:28], Владимир Мироненко

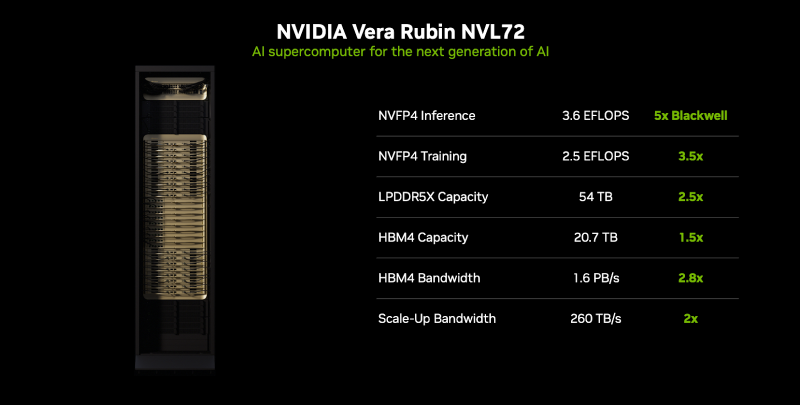

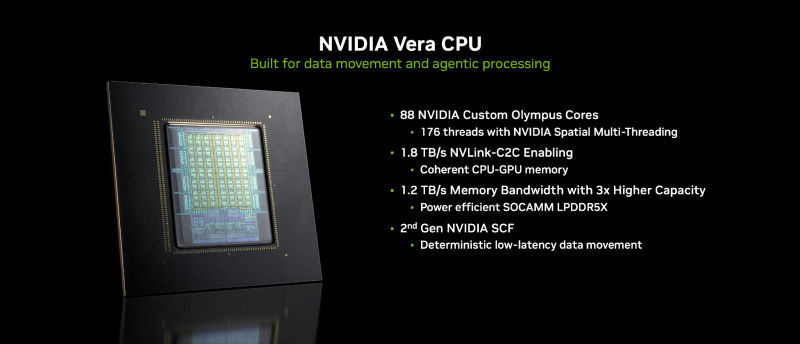

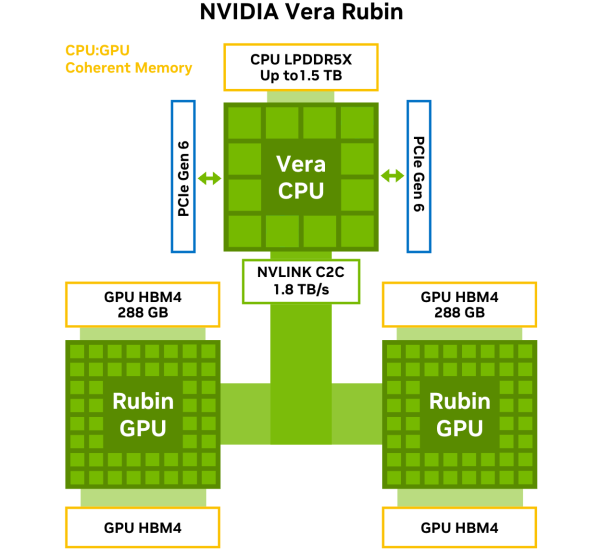

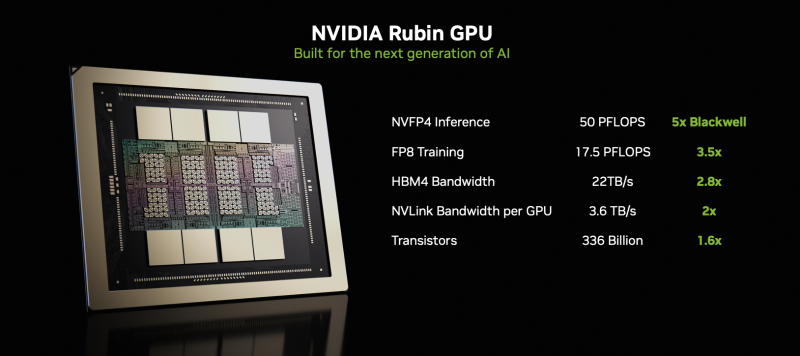

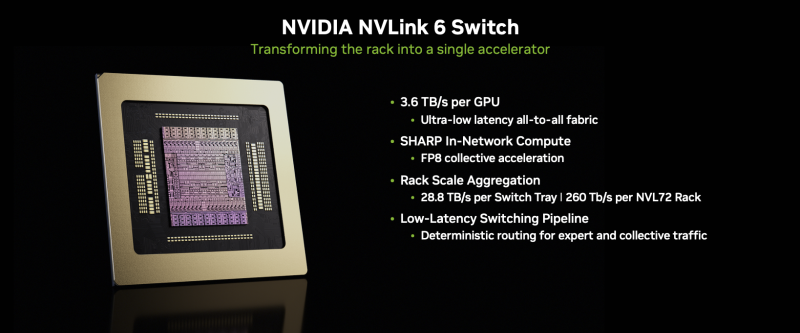

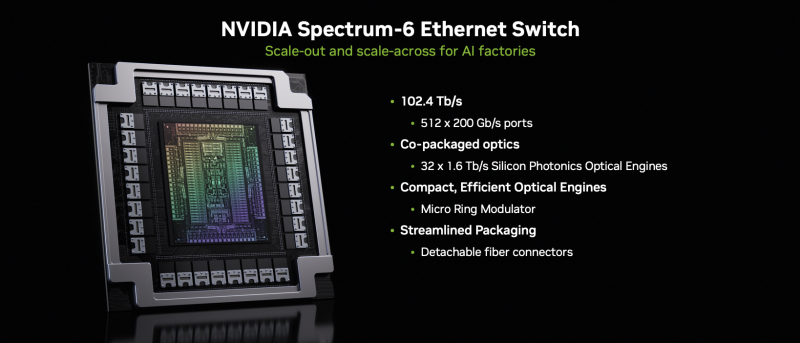

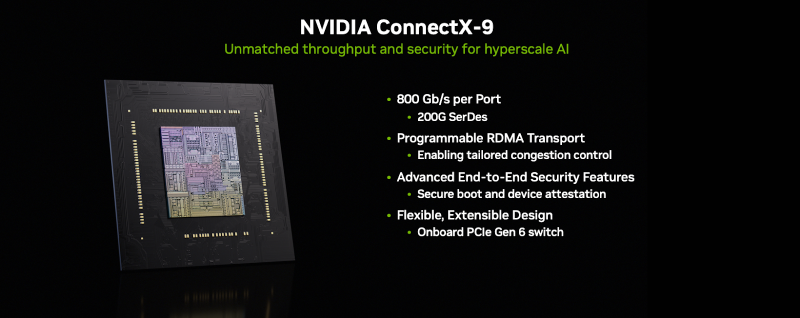

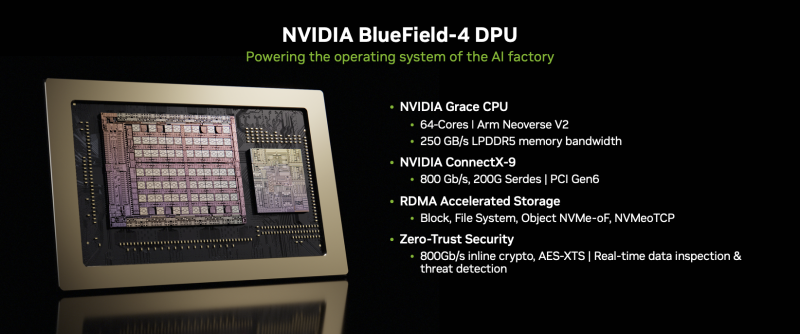

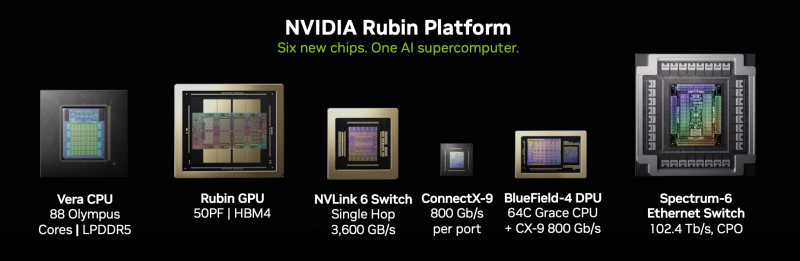

NVIDIA объявила о запуске платформы Vera Rubin NVL72NVIDIA объявила о запуске платформы следующего поколения Rubin, которая приходит на смену Blackwell Ultra. Компания отметила, что платформа Rubin объединяет сразу пять инноваций, включая новейшие поколения интерконнекта NVIDIA NVLink, Transformer Engine, Confidential Computing и RAS Engine, а также процессор NVIDIA Vera. Примечательно, что NVIDIA снова решила вернуться к именованию на основе количества суперчипов (NVL72), а не ускорителей (NVL144), как обещала в прошлом году. Созданная с использованием экстремального совместного проектирования на аппаратном и программном уровнях, NVIDIA Vera Rubin обеспечивает десятикратное снижение стоимости токенов для инференса и четырёхкратное сокращение количества ускорителей для обучения моделей MoE по сравнению с платформой NVIDIA Blackwell. Коммутационные системы NVIDIA Spectrum-X Ethernet Photonics обеспечивают пятикратное повышение энергоэффективности и времени безотказной работы. Платформа Rubin построена на шести чипах — Arm-процессоре Vera, ускорителе Rubin, коммутаторе NVLink 6, адаптере ConnectX-9 SuperNIC, DPU BlueField-4 и Ethernet-коммутаторе NVIDIA Spectrum-6. Ускорители Rubin поначалу будут доступны в двух форматах. В первом случае — в составе стоечной платформы DGX Vera Rubin NVL72, которая объединяет 72 ускорителя Rubin и 36 процессоров Vera, NVLink 6, ConnectX-9 SuperNIC и BlueField-4. Также ускорители Rubin будут доступны в составе платформы DGX/HGX Rubin NVL8 на базе x86-процессоров. Обе платформы будут поддерживаться кластерами NVIDIA DGX SuperPod, сообщил ресурс CRN. Как отметила NVIDIA, разработанный для агентного мышления, процессор NVIDIA Vera является самым энергоэффективным процессором для крупномасштабных ИИ-фабрик. Он оснащён 88 кастомными Armv9.2-ядрами Olympus с 176 потоками с новой технологией пространственной многопоточности NVIDIA, 1,5 Тбайт системной памяти SOCAMM LPDDR5x (1,2 Тбайт/с), возможностями конфиденциальных вычислений и быстрым интерконнектом NVLink-C2C (1,8 Тбайт/с в дуплексе). NVIDIA Rubin с аппаратным адаптивным сжатием данных обеспечивает до 50 Пфлопс (NVFP4) для инференса, что в пять раз быстрее, чем Blackwell. Он также обеспечивает до 35 Пфлопс (NVFP4) в режиме, что в 3,5 раза быстрее, чем его предшественник. Пропускная способность 288 Гбайт HBM4 составляет 22 Тбайт/с, что в 2,8 раза быстрее предшественника, а пропускная способность NVLink на один ускоритель вдвое выше — 3,6 Тбайт/с (в дуплексе). NVIDIA также сообщила, что Vera Rubin NVL72 обладает 54 Тбайт памяти LPDDR5x, что в 2,5 раза больше, чем у Blackwell, и 20,7 Тбайт памяти HBM4, что на 50 % больше, чем у предшественника. Агрегированная пропускная способность HBM4 достигает 1,6 Пбайт/с, что в 2,8 раза больше, а скорость интерконнекта составляет 260 Тбайт/с, что вдвое больше, чем у платформы Blackwell NVL72, и «больше, чем пропускная способность всего интернета». Ожидаемый уровень энергопотребления составит от 190 до 230 кВт на стойку. Компания отметила, что Vera Rubin NVL72 — первая стоечная платформа, обеспечивающая конфиденциальные вычисления, которая поддерживает безопасность данных на уровне доменов CPU, GPU и NVLink. Коммутатор NVLink 6 с жидкостным охлаждением оснащён 400G-блоками SerDes, обеспечивает пропускную способность 3,6 Тбайт/с на каждый GPU для связи между всеми GPU, общую пропускную способность 28,8 Тбайт/с и 14,4 Тфлопс внутрисетевых вычислений в формате FP8. Хотя NVIDIA заявила, что Rubin находится в «полномасштабном производстве», аналогичные продукты от партнёров появятся только во II половине этого года. Среди ведущих мировых ИИ-лабораторий, поставщиков облачных услуг, производителей компьютеров и стартапов, которые, как ожидается, внедрят Rubin, компания назвала Amazon Web Services (AWS), Anthropic, Black Forest Labs, Cisco, Cohere, CoreWeave, Cursor, Dell Technologies, Google, Harvey, HPE, Lambda, Lenovo, Meta✴, Microsoft, Mistral AI, Nebius, Nscale, OpenAI, OpenEvidence, Oracle Cloud Infrastructure (OCI), Perplexity, Runway, Supermicro, Thinking Machines Lab и xAI. ИИ-лаборатории, включая Anthropic, Black Forest, Cohere, Cursor, Harvey, Meta✴, Mistral AI, OpenAI, OpenEvidence, Perplexity, Runway, Thinking Machines Lab и xAI, рассматривают платформу NVIDIA Rubin для обучения более крупных и мощных моделей, а также для обслуживания мультимодальных систем с длинным контекстом с меньшей задержкой и стоимостью по сравнению предыдущими поколениями ускорителей. Партнёры по инфраструктурному ПО и хранению данных AIC, Canonical, Cloudian, DDN, Dell, HPE, Hitachi Vantara, IBM, NetApp, Nutanix, Pure Storage, Supermicro, SUSE, VAST Data и WEKA работают с NVIDIA над разработкой платформ следующего поколения для инфраструктуры Rubin. В связи с тем, что рабочие нагрузки агентного ИИ генерируют огромные объёмы контекстных данных, NVIDIA также представляла новую платформу хранения контекста инференса NVIDIA Inference Context Memory Storage Platform — новый класс инфраструктуры хранения, разработанной для масштабирования контекста инференса. Сообщается, что платформа, работающая на базе BlueField-4, обеспечивает эффективное совместное использование и повторное применение данных KV-кеша в рамках всей ИИ-инфраструктуры, повышая скорость отклика и пропускную способность, а также обеспечивая предсказуемое и энергоэффективное масштабирование агентного ИИ. Дион Харрис (Dion Harris), старший директор NVIDIA по высокопроизводительным вычислениям и решениям для ИИ-инфраструктуры, сообщил, что по сравнению с традиционными сетевыми хранилищами для данных контекста инференса, новая платформа обеспечивает до пяти раз больше токенов в секунду, в пять раз лучшую производительность на доллар и в пять раз лучшую энергоэффективность.

05.01.2026 [18:25], Владимир Мироненко

Anthropic купит сотни тысяч ИИ-ускорителей Google TPU напрямую у BroadcomAnthropic приобретёт около 1 млн Google TPU v7 (Ironwood) с тем, чтобы запустить их на контролируемых ею объектах, сообщил в соцсети Х ресурс SemiAnalysis. Ранее сообщалось, что примерно 400 тыс. компания купит напрямую у Broadcom в стойках за примерно $10 млрд, а остальные 600 тыс. единиц TPU v7 будут доступны посредством Google Cloud Platform (GCP) в рамках сделки на сумму около $42 млрд, что составляет большую часть увеличения портфеля заказов GCP на $49 млрд или на 46 %, о котором сообщалось в отчёте за III квартал 2025 года. В случае с закупаемыми напрямую ускорителями TeraWulf и Cipher Mining будут ответственны за инфраструктуру ЦОД, а европейское неооблако Fluidstack будет заниматься настройкой оборудования на месте, прокладкой кабелей, первичным тестированием, испытаниями при приёмке и удалённым обслуживанием, освободив Anthropic от бремени управления физическими серверами. По слухам, эти системы получат упрощённую топологию интерконнекта. Сделки Fluidstack с обоими операторами ЦОД, ранее ориентированными на криптомайнинг, финансово застрахованы Google, которая к тому же является совладельцем TeraWulf и может получить долю в Cipher Mining. Любопытно, что оба оператора частично связаны и с AWS. Хотя Google закупает TPU через Broadcom, которая тоже хочет свою маржу, это всё равно лучше, чем та маржа, что требует NVIDIA не только за продаваемые ускорители, но и за всю систему целиком, включая процессоры, коммутаторы, сетевые карты, системную память, кабели, разъёмы и т.п. По оценкам, SemiAnalysis, совокупная стоимость владения (TCO) на один чип Ironwood для полной конфигурации с топологией 3D-тор примерно на 44 % ниже, чем у серверов GB200, что с лихвой компенсирует примерно 10-% отставание TPU от GB200 по пиковым производительности и пропускной способности памяти. При этом реальная, а не теоретическая производительность (Model FLOP Utilization, MFU) у TPU, по мнению SemiAnalysis, может быть выше, чем у конкурентов. Основная причина заключается в том, что заявляемые NVIDIA и AMD показатели производительности (Флопс) значительно завышены. Даже в синтетических тестах, значительно отличающиеся от реальных рабочих нагрузок, Hopper достиг лишь около 80 % пиковой производительности, Blackwell — около 70 %, а серия MI300 от AMD — 50–60 %. Как полагают в SemiAnalysis, даже сдача ускорителей на сторону выгодна Google за счёт того, что TCO в пересчёте на час аренды может быть примерно на 30 % ниже, чем у GB200, и примерно на 41 % ниже, чем у GB300. Несмотря на высокий спрос, Google не может поставлять TPU в желаемом темпе, отметил SemiAnalysis, полагая, что основная проблема заключается в бюрократии Google — от первоначальных обсуждений до подписания генерального соглашения об оказании услуг (Master Services Agreement) проходит до трёх лет. Неооблака, включая Fluidstack, отличаются гибкостью и оперативностью, что облегчает им взаимодействие с новыми поставщиками услуг дата-центров, например, с реорганизованными криптомайнерами. Однако у неооблаков, среди инвесторов которых числится NVIDIA, таких как CoreWeave, Nebius, Crusoe, Together, Lambda, Firmus и Nscale, есть существенный стимул не внедрять конкурирующие технологии в своих дата-центрах: TPU, ускорители AMD и даже коммутаторы Arista — всё это под запретом. Это оставляет огромную нишу на рынке хостинга TPU, которая в настоящее время заполняется комбинацией майнеров криптовалют и Fluidstack, сообщил SemiAnalysis. По мнению SemiAnalysis, в ближайшие месяцы всё большему числу компаний-неооблаков предстоит принимать непростое решение между развитием возможностей хостинга TPU и получением квот на новейшие и лучшие системы NVIDIA Rubin.

03.01.2026 [15:08], Руслан Авдеев

Brookfield готова побороться с гиперскейлерами, запустив облако Radiant с «бюджетной» ИИ-инфраструктуройОдин из крупнейших управляющих инвестициями в альтернативные активы — компания Brookfield Asset Management может стать неожиданным соперником гиперскейлерам. Она намерена предложить собственные, недорогие облачные сервисы, сообщает Silicon Angle. Как свидетельствует доклад в The Information, компания планирует запустить облачный бизнес, который будет сдавать в аренду ИИ-чипы напрямую клиентам. Компания предложит бизнес-модель, которая позволит снизить стоимость строительства и эксплуатации ИИ ЦОД. Новый бизнес будет управляться подразделением Brookfield Radiant в связке с новой инфраструктурной программой стоимостью $100 млрд, анонсированной в ноябре 2025 года. Brookfield Artificial Intelligence Infrastructure Fund уже выделил на инициативу $10 млрд, половина из которых поступит от отраслевых партнёров, включая NVIDIA и Kuwait Investment Authority (KIA). Ранее Brookfield и Qatar Investment Authority (QIA) объявили о создании совместного предприятия на $20 млрд для инвестиций в ИИ-инфраструктуру в Катаре и на других международных рынках.

Источник изображения: Adeolu Eletu/unsplash.com Фонд поддерживает новые проекты ЦОД во Франции, Катаре и Швеции, а Radiant, как ожидается, первой получит право получить эти мощности. Если мощности не будут освоены, Brookfield планирует сдавать их в аренду сторонним операторам в рамках более традиционных схем. Если планы Brookfield действительно будут реализованы, Radiant теоретически сможет конкурировать с AWS и Microsoft Azure. Правда, основное преимущество Radiant перед остальными гиперскейлерами связано с многомиллиардными инвестициям Brookfield в энергетический сектор. В компании заявили, что такие актив смогли бы помочь контролировать ключевые элементы цепочки создания стоимости в сфере ИИ, что недоступно обычным облачным соперникам. Поскольку AWS, Microsoft и другим гиперскейлерам необходимо продемонстрировать отдачу от своих инвестиций в ИИ, запуск сервисов Radiant, вероятно, заставит их оптимизировать свою энергетическую логистику для своих дата-центров — для того, чтобы оставаться конкурентоспособными.

01.01.2026 [22:53], Владимир Мироненко

xAI купил ещё одно здание для ИИ ЦОД и планирует довести мощность кампуса Colossus до 2 ГВтИлон Маск (Elon Musk) сообщил о приобретении его ИИ-стартапом xAI ещё одного здания для расширения своего кластера Colossus, что позволит увеличить его вычислительную мощность до 2 ГВт. Маск не стал раскрывать местоположение объекта. Вполне возможно, что речь идёт о том же здании, о покупке которого сообщил в этот же день ресурс The Information, ссылаясь на данные о недвижимости и источник, знакомый с проектом. По его данным, приобретённое здание было раньше складом, и оно находится недалеко от Саутхейвена (Southaven, штат Миссисипи). xAI уже построил в Мемфисе (Memphis) ЦОД Colossus, и в настоящее время ведёт строительство второго ЦОД, расположенного неподалеку, под названием Colossus 2. Маск заявил ранее в этом году, что Colossus 2 в конечном итоге будет оснащён 550 тыс. чипов NVIDIA, что обойдётся стартапу в $18 млрд без учёта стоимости сопутствующего оборудования и систем охлаждения.

Источник изображения: xAI Невдалеке от Colossus 2 расположен приобретённый участок со складскими помещениями, которые стартап начнёт переоборудовать в ЦОД в этом году. Рядом с ними находится бывшая электростанция, которая принадлежит xAI. Также будущий ЦОД будет иметь доступ к другим источникам энергии. Планы Маска по расширению ИИ-инфраструктуры подвергаются сильной критике со стороны защитников окружающей среды из-за огромного энергопотребления, а также большого расхода воды, необходимой для охлаждения оборудования ЦОД. По данным The Information, для нового объекта потребуются тысячи кубометров питьевой воды ежедневно. В связи с этим xAI предпринял шаги по уменьшению вредного воздействия на окружающую среду, пишет SiliconANGLE. В феврале компания объявила о планах строительства нового центра очистки сточных вод рядом с Colossus стоимостью около $80 млн. Этот объект позволит xAI повторно использовать около 59 тыс. м3 сточных вод в день. Для реализации своих планов xAI занимается привлечением заёмных средств. В июле стартап объявил о привлечении $10 млрд капитала в виде акционерного финансирования и кредитов. Также xAI провёл в октябре ещё один раунд финансирования, позволивший привлечь $20 млрд инвестиций.

31.12.2025 [18:30], Владимир Мироненко

Потребность китайских компаний в H200 в несколько раз выше запасов NVIDIAПосле того, как США дали NVIDIA добро на поставку ИИ-ускорителей H200 в Китай, выяснилось, что потребности ключевого для компании рынка в этих чипах гораздо выше имеющихся у неё запасов. По данным источников Reuters, компания уже обратилась к TSMC с запросом на увеличение производства H200. Однако существует определённый риск, что правительство КНР может не дать разрешение на ввоз в страну H200, хотя и официального заявления по поводу запрета пока тоже не поступало. Как сообщают источники, сейчас у NVIDIA насчитывается на складах порядка 700 тыс. ускорителей H200, включая 100 тыс. суперчипов GH200, в то время как поступило заказов от китайских технологических компаний более чем на 2 млн ускорителей. Газета South China Morning Post сообщила со ссылкой на источники, что только ByteDance планирует потратить в 2026 году около ¥100 млрд (около $14,3 млрд) на чипы NVIDIA, по сравнению с примерно ¥85 млрд (около $12,2 млрд) в 2025 году, если, опять же, Китай разрешит поставки H200. Власти КНР пока не определились с тем, стоит ли разрешать ли импорт H200, опасаясь, что доступ к передовым зарубежным чипам может замедлить развитие местной полупроводниковой промышленности в ИИ-сфере. Один из рассматриваемых вариантов предполагает, что могут в качестве условия поставки потребовать комплектовать закупки H200 определённым количеством чипов китайского производства. Ранее сообщалось, что первая партия NVIDIA H200 может поступить в Китай в середине февраля. По данным источников Reuters, NVIDIA уже решила, какие варианты H200 она будет предлагать китайским клиентам, установив цену около $27 тыс./шт.. При этом цена будет зависеть от объёма закупок и конкретных договорённостей с клиентами. Сообщается, что восьмичиповый модуль с H200 будет стоить около ¥1,5 млн (около $214 тыс.), что немного дороже, чем поставлявшийся до введения запрета Китаем по цене ¥1,2 млн (около $172 тыс.) модуль с ускорителями H20. Однако, с учётом того, что H200 обеспечивает примерно в шесть раз большую производительность, чем H20, китайские интернет-компании считают цену привлекательной, отметили источники. Также это дешевле цены серого рынка примерно на 15 %. Хотя потенциальный заказ означает значительное расширение производства H200, в комментарии для Reuters в NVIDIA сообщили, что «лицензионные продажи H200 авторизованным клиентам в Китае никак не повлияют на способность компании поставлять продукцию клиентам в США». «Китай — это высококонкурентный рынок с быстрорастущими местными поставщиками чипов. Блокировка всего экспорта из США подорвала нашу национальную и экономическую безопасность и лишь пошла на пользу иностранным конкурентам», — отметили в компании.

31.12.2025 [10:17], Владимир Мироненко

SoftBank успела завершить рекордные инвестиции в OpenAI на $40 млрд и стать одним из крупнейших акционеровЯпонская холдинговая компания SoftBank Group Corp. объявила в среду, 31 декабря, что полностью выполнила обязательство инвестировать в OpenAI $40 млрд в рамках сделки, заключённой в марте этого года. Структура сделки включает прямые инвестиции SoftBank в сочетании с синдицированными совместными инвестициями от других инвесторов. Согласно заявлению SoftBank, она направила стартапу 26 декабря в рамках второго этапа закрытия инвестиционной сделки сумму в размере $22,5 млрд, в результате чего её доля в OpenAI теперь составляет приблизительно 11 %. На первом этапе японская компания инвестировала в OpenAI в апреле 2025 года $7,5 млрд через свой венчурный фонд SoftBank Vision Fund 2, занимающийся инвестициями в ИИ-компании. SoftBank сообщила, что OpenAI также получил синдицированные соинвестиции от других инвесторов на сумму $11 млрд, в результате чего общая сумма её инвестиций в стартап из Сан-Франциско (США) составила $41 млрд. Как отметило агентство Reuters, после объявления о сделке с SoftBank рыночная стоимость OpenAI составила, по оценкам PitchBook, $300 млрд, а после вторичного размещения акций в октябре его капитализация выросла до $500 млрд. SoftBank на протяжении многих лет активно инвестирует в технологические компании и ИТ-инфраструктуру. Она одной из первых вложилась в производителя ИИ-ускорителей NVIDIA. На этой неделе SoftBank также объявила о покупке инвестиционной компании DigitalBridge, специализирующейся на финансировании строительства центров обработки данных.

30.12.2025 [22:09], Сергей Карасёв

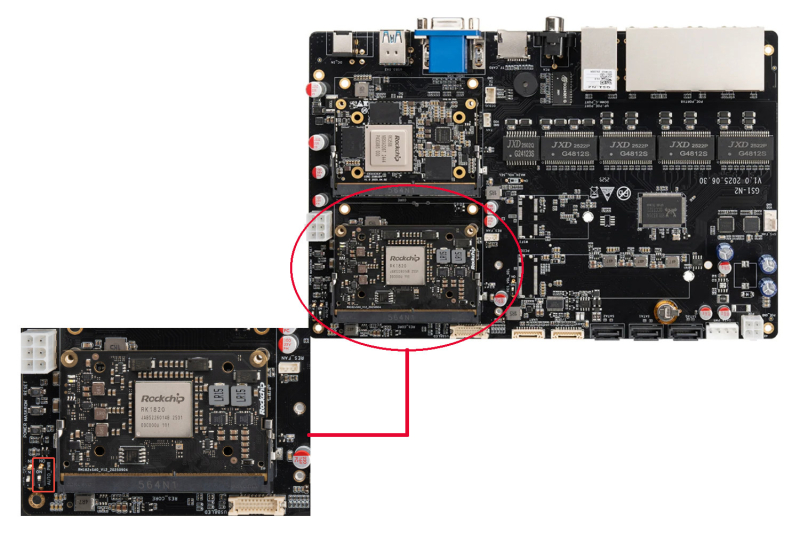

Rockchip представила комплекты для разработчиков с ИИ-модулями RK1820/RK1828 в формате SO-DIMMКомпания Rockchip, по сообщению ресурса CNX Software, анонсировала комплекты серии RK182X 3D RAM Stacking Development Kit, ориентированные на разработчиков систем с ИИ-функциями. В основу изделий положена интерфейсная плата AIO-GS1N2, на которую устанавливаются различные вычислительные и вспомогательные модули. Доступны варианты с основными модулями Core-3588JD4, Core-3588SJD4 AI и Core-3576JD4. Первый содержит процессор Rockchip RK3588 с восемью ядрами (квартеты Cortex-A76 и Cortex-A55), графическим блоком Arm Mali-G610 и нейроузлом (NPU) с ИИ-производительностью до 6 TOPS. Объём оперативной памяти LPDDR4/LPDDR4x варьируется от 4 до 32 Гбайт, вместимость флеш-модуля eMMC — от 32 до 256 Гбайт. Решение Core-3588SJD4 AI использует процессор Rockchip RK3588S со схожими характеристиками, но при этом работает только с памятью LPDDR5 (4–32 Гбайт), а ёмкость чипа eMMC составляет от 32 до 128 Гбайт. Наконец, версия Core-3576JD4 получила процессор Rockchip RK3576 с восемью ядрами (по четыре Cortex-A72 и Cortex-A53), графическим блоком Arm Mali-G52 и NPU с ИИ-производительностью до 6 TOPS. Поддерживается 2–16 Гбайт памяти LPDDR4/LPDDR4x и 16–256 Гбайт eMMC. В качестве вспомогательных модулей выступают ИИ-ускорители Rockchip RK1820 и RK1828 в форм-факторе SO-DIMM: первый содержит 2,5 Гбайт памяти DRAM, второй — 5 Гбайт. Возможна работа с LLM, насчитывающими соответственно до 3 и 7 млрд параметров. ИИ-производительность в обоих случаях достигает 20 TOPS (INT8). В оснащение входят слот microSD, порты SATA-3 для подключения накопителей, разъём M.2 2280 Key-M для SSD (NVMe), интерфейсы HDMI 2.0 и D-Sub, два порта USB 3.0, аудиогнёзда, девять портов 1GbE (RJ45) и выделенный порт управления 1GbE. Опционально может быть добавлен адаптер Wi-Fi (2,4/5 ГГц) в виде изделия M.2 E-Key. Имеются две 10-контактные колодки с поддержкой RS485, UART, GPIO. Питание может подаваться через DC-коннектор (24 В / 5 A), 6- или 4-контактный разъём ATX. Габариты составляют 231,27 × 164,13 × 33,57 мм, масса — 350 г. Диапазон рабочих температур простирается от -20 до +60 °C. |

|