Материалы по тегу: ии

|

17.12.2025 [16:18], Владимир Мироненко

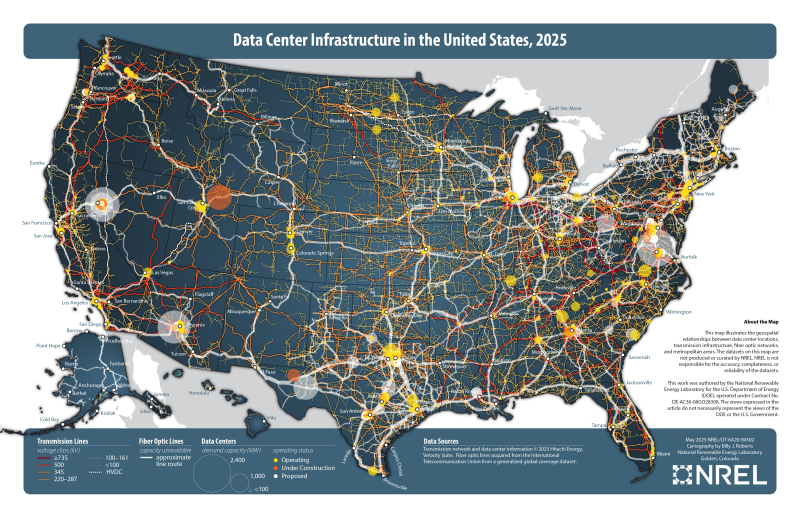

В США начали расследование по поводу влияния ИИ ЦОД на рост тарифов на электроэнергиюТри сенатора США — Элизабет Уоррен (Elizabeth Warren), Крис Ван Холлен (Chris Van Hollen) и Ричард Блюменталь (Richard Blumenthal) — сообщили о начале расследования по поводу того, каким образом деятельность технологических компаний, в частности, в сфере облачных технологий, влияет на рост счетов за электроэнергию для потребителей, пишет The Register. В начале недели сенаторы направили семи компаниям, включая Google, Microsoft, Amazon, Meta✴, CoreWeave, Digital Realty и Equinix, письма с требованием ответить на вопросы о влиянии их проектов по строительству ИИ ЦОД на рост тарифов на коммунальные услуги. Чтобы удовлетворить растущий спрос на вычислительные мощности, технологические компании наращивают строительство ЦОД. Лишь за первые девять месяцев года капитальные затраты Microsoft, Meta✴, Google и Amazon превысили $360 млрд. «Мы пишем в свете тревожных сообщений о том, что технологические компании перекладывают затраты на строительство и эксплуатацию своих ЦОД на обычных американцев, поскольку потребление энергии в ИИ ЦОД привело к резкому росту счетов за электроэнергию в близлежащих населённых пунктах», — заявили сенаторы. Они отметили, что технологические компании «лишь на словах заявляют о готовности покрывать расходы на электроэнергию своих ЦОД, но на деле их действия показывают обратное». В связи со строительством ЦОД энергетические компании занялись расширением местных электросетей, которые во многих регионах не были рассчитаны на сотни мегаватт, а в некоторых случаях и на гигаватты, которые будут потреблять современные дата-центры. Для этого им приходится инвестировать в новые генерирующие мощности, линии электропередачи и модернизацию электросетевой инфраструктуры. «Когда коммунальные предприятия расширяют свою сетевую инфраструктуру, они включают стоимость расширения в свои тарифы, перекладывая дополнительные расходы на своих клиентов», — пишут сенаторы, отметив, что обещания операторов ЦОД о том, что они компенсируют повышение тарифов, вызванное развитием энергетической инфраструктуры, постоянно оказываются невыполненными. В своих письмах законодатели ссылаются на ряд исследований. В частности, на исследование Гарвардской юридической школы, которое показало, что коммунальные компании заинтересованы в перекладывании повышения тарифов на электроэнергию на потребителей, чтобы затем предлагать скидки на электроэнергию для проектов ИИ ЦОД. В ходе анализа 50 регулирующих процедур, касающихся тарифов на электроэнергию для ЦОД, было установлено, что технологические компании постоянно находят способы избежать уплаты своей доли в строительство энергетической инфраструктуры. Законодатели также ссылаются на публикацию Bloomberg, согласно которой стоимость электроэнергии за последние пять лет выросла на 267 % в регионах США, расположенных вблизи крупных ЦОД. После примерно 20 лет стагнации или минимального роста спроса на электроэнергию в США потребности в электроэнергии стали расти и, как ожидается, резко возрастут в ближайшие несколько десятилетий, пишет The New York Times. Росту тарифов на электроэнергию способствуют многие факторы, включая замену старых электростанций и укрепление ЛЭП для защиты от лесных пожаров. Но ЦОД являются особенно актуальной проблемой, учитывая ожидаемый рост спроса на них. К тому же ИИ ЦОД потребляют гораздо больше электроэнергии, чем те, которые используются для популярных интернет-сервисов. Если в 2023 году на ЦОД приходилось немногим более 4 % потребления электроэнергии страны, то, согласно прогнозу аналитиков, этот показатель вырастет до 12 % всего за три года. Сенаторы отметили, что растущее стремление к строительству новых ядерных реакторов, требующему значительных капложений, может ещё больше повысить стоимость электроэнергии. Согласно недавнему опросу, 70 % американских домохозяйств за последний год столкнулись с ростом расходов на электроэнергию, причём, многие связывают это с энергопотреблением из-за использования ИИ, пишет PCMag. По данным Управления энергетической информации США (EIA), средняя стоимость электроэнергии для домохозяйства в сентябре выросла год к году на 7 %, с ¢16,82/кВт·ч до ¢18,07/кВт·ч. Сенаторы отметили, что контракты между операторами ЦОД и коммунальными компаниями, как правило, являются конфиденциальными, поэтому отследить то, как затраты компаний перекладываются на потребителя, сложно. В своих письмах они потребовали, чтобы компании предоставили к 12 января подробную информацию о соглашениях с местными поставщиками электроэнергии, текущем и прогнозируемом потреблении энергии ЦОД, средней ставке за электроэнергию и о том, используются ли ЦОД преимущественно для обработки ИИ-нагрузок. «Какие меры предприняла ваша компания, чтобы предотвратить перекладывание ваших расходов на электроэнергию на счета потребителей? — спрашивают сенаторы в разосланных письмах. — Как ваша компания планирует компенсировать влияние будущего энергопотребления ваших ЦОД на коммунальные расходы домохозяйств?».

17.12.2025 [10:11], Сергей Карасёв

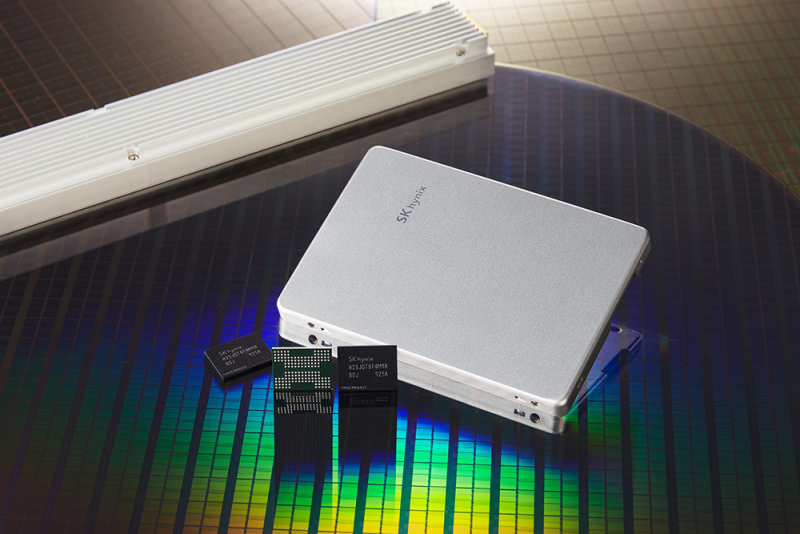

SK hynix и NVIDIA объединили усилия для создания сверхбыстрых SSD для ИИ-системКомпании SK hynix и NVIDIA, по сообщениям сетевых источников, занимаются совместной разработкой сверхбыстрых SSD, которые, как ожидается, помогут устранить узкие места современных ИИ-платформ. Проект получил название Storage Next: он предполагает создание чипов флеш-памяти NAND и сопутствующих контроллеров следующего поколения. По информации ресурса ZDNet, первые прототипы изделий партнёры намерены представить к концу следующего года. Речь идёт о накопителях с интерфейсом PCIe 6.0, которые смогут демонстрировать показатель IOPS (операций ввода/вывода в секунду) на уровне 25 млн. Более того, в 2027-м, как ожидается, будет выпущено устройство с величиной IOPS до 100 млн. Для сравнения, современные высокопроизводительные SSD корпоративного класса имеют значение IOPS на уровне 2–3 млн. В основу накопителей Storage Next лягут наработки SK hynix в области памяти AI-N (AI-NAND), оптимизированной для ИИ. В частности, упоминаются решения AI-N P: предполагается, что такие устройства будут выполнены в форм-факторе EDSFF E3.x. Они получат контроллер, предназначенный для выполнения как обычных рабочих нагрузок, так и с высоким показателем IOPS. По мере того, как ИИ-платформы переходят от обучения к инференсу, возможностей памяти HBM с высокой пропускной способностью оказывается недостаточно: наблюдается разрыв между объёмом и производительностью HBM и вычислительными возможностями ИИ-ускорителей на базе GPU. Цель проекта Storage Next состоит в том, чтобы решить эту проблему путём использования инноваций в области NAND. По сравнению с современными SSD накопители Storage Next смогут демонстрировать увеличение показателя IOPS в 30–50 раз. Кроме того, SK hynix разрабатывает память AI DRAM (AI-D) для ИИ-платформ: эти изделия, как предполагается, помогут справиться с нехваткой памяти.

17.12.2025 [09:16], Руслан Авдеев

Oracle готова размещать чужое оборудование в своих ЦОДOracle заявила, что рассматривает различные модели заработка на своих дата-центрах. В числе прочего не исключена возможность размещения в её ЦОД собственного оборудования клиентов, передаёт Datacenter Dynamics. Кроме того, компания намерена расширить предложение Oracle Database@Google Cloud. По словам руководства компании, в некоторых случаях клиенты желают использовать собственное оборудование в её дата-центрах, и в таких случаях компания не несёт капитальные затраты на закупку «железа» компания тогда не несёт, а расходы сводятся к содержанию непосредственно ЦОД, сети и персонала. Но компания рассматривает и другие варианты, в том числе авансовые платежи за оборудование из собственных средств или даже сдача в аренду поставщикам чипов их же собственного оборудования в дата-центрах Oracle. Для Oracle последняя модель в новинку, однако у «неооблачных» провайдеров уже есть такие сделки. Так, NVIDIA заключила с CoreWeave соглашение об аренде вычислительных мощностей на сумму около $6,3 млрд, будучи при этом и так крупным клиентом компании, а также с Lambda на $1,5 млрд. Инвесторам и акционерам такие циклические сделки не всегда по нраву, но NVIDIA это даёт определённую гибкость в доступе к вычислительным мощностям. Кроме того, у NVIDIA имеется собственный облачный маркетплейс Lepton для перепродажи ресурсов ИИ-ускорителей.

Источник изображения: Oracle Oracle отметила изменение запросов клиентов, связанных с предоставлением ИИ-сервисов. Так, есть много заказчиков, которые могут подписаться на тысячи ускорителей одного типа, а потом отказаться, желая получить больше мощностей в другом месте. Из-за этого компания вынуждена постоянно перераспределять ускорители между клиентами, попутно наращивая общую мощность. На наращивание мощности для крупного провайдера ИИ-моделей обычно уходит два-три дня. Также Oracle рассказала о добавлении новых регионов Database@Google Cloud. В данном случае уже сама Oracle размещает своё оборудование в ЦОД партнёров. Новые регионы, общее количество которых выросло до 12, появились в Мумбаи, Монреале и Торонто. В следующие 12 мес. компания намерена добавить регионы в Сеуле, Осаке, Дели, Мадриде, Париже, Милане, Турине, Даммаме, Мехико и Сантьяго.

17.12.2025 [09:00], Владимир Мироненко

«Базис» завершил перевод на свою экосистему ИТ-инфраструктуры правительства Московской областиРоссийский разработчик ПО управления динамической ИТ-инфраструктурой ПАО «Группа компаний «Базис» объявил о завершении проекта по внедрению виртуальной инфраструктуры на базе экосистемы решений «Базис» для информационных систем региональных министерств и ведомств правительства Московской области, персонал которых насчитывает более 100 тыс. сотрудников. Решения «Базис» развёрнуты в составе программно-аппаратных комплексов (ПАК). Платформа виртуализации Basis Dynamix Enterprise обеспечивает стабильную работу основных вычислительных мощностей информационных систем подразделений и министерств правительства Московской области, говорится в пресс-релизе. Basis Dynamix Cloud Control отвечает за управление облачной частью инфраструктуры. Basis Virtual Protect обеспечивает интеграцию инструментов для резервного копирования виртуальных сред. Basis Guard поддерживает высокий уровень доступности и отказоустойчивость инфраструктуры. Действуя в рамках единой экосистемы решения «Базиса» позволяют выполнять все задачи, связанные с работой инфраструктуры IT-подразделений администрации региона, и оказывать услуги потребителям.

Источник изображения: mosreg.ru Работа над проектом стартовала в прошлом году. Всего в работе информационных систем администрации региона задействовано 480 серверов-узлов виртуальной инфраструктуры. Генеральный директор ПАО ГК «Базис» Давид Мартиросов отметил, что замена ИТ-инфраструктуры правительства одного из крупнейших по численности населения российских регионов оказалась сложной и масштабной задачей. Впрочем, у группы уже есть опыт успешного выполнения сопоставимых по сложности проектов как для госструктур, так для крупного бизнеса, добавил он.

16.12.2025 [17:50], Владимир Мироненко

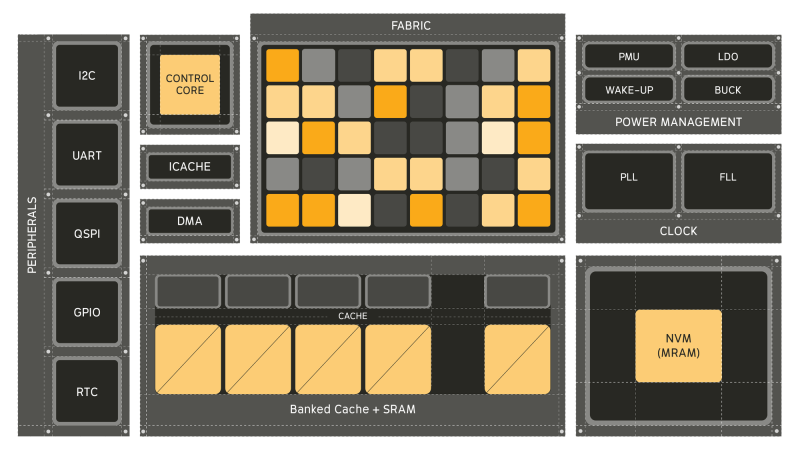

Универсальный ИИ-процессор Electron E1 в 100 раз энергоэффективнее традиционных CPUСтартап из Питтсбурга (Pittsburgh) Efficient Computer выпустил оценочный набор универсального процессора Electron E1 (EVK). Как сообщает компания, Electron E1 представляет собой настоящую альтернативу чипам с использованием традиционной архитектуры фон Неймана, способную обеспечить значительно более высокую энергоэффективность, в 100 раз превышающую показатели обычных маломощных процессоров, таких как Arm Cortex-M33 и Cortex-M85. Electron E1 предназначен для выполнения сложных задач обработки сигналов и инференса. Он основан на т.н. Efficient Fabric, разработанной компанией запатентованной архитектуре пространственного потока данных, которая позволяет снизить «чрезмерное» энергопотребление, связанное с перемещением данных между памятью и вычислительными ядрами, характерное для традиционных систем фон Неймана. При этом «разработчики по-прежнему получают привычный опыт программирования, но с существенно более высокой энергоэффективностью». Генеральный директор Efficient Брэндон Лючия (Brandon Lucia) в интервью EE Times заявил, что предыдущие попытки отойти от подхода фон Неймана так и не были полностью реализованы: «Были мимолётные альтернативы, которые появлялись и исчезали». Он отметил, что одним из ограничений во многих альтернативах был отказ от универсальности вычислений: «Это действительно критически важно». Нечто похожее предлагает и NextSilicon Maverick. Процессор включает 128 Кбайт сверхэкономичной кеш-памяти, 3 Мбайт SRAM и 4 Мбайт энергонезависимой MRAM, а его производительность может достигать 21,6 GOPS (млрд операций в секунду) при 200 МГц в высоковольтном режиме и 5,4 GOPS при 50 МГц в низковольтном режиме. Архитектура Fabric коренным образом переосмысливает способ выполнения вычислений, уменьшая необходимость в перераспределении данных между памятью и процессорами, говорит Лючия. Это достигается за счёт пространственного отображения операций по сетке вычислительных элементов, каждый из которых активируется только тогда, когда доступны его входные данные в отличие от непрерывного цикла инструкций и косвенной адресации данных, которые доминируют в традиционных конвейерах CPU. Лючия отметил, что универсальный процессор важен для ИИ-технологий, поскольку он представляет собой нечто гораздо большее, чем просто алгоритмы в физическом мире — он обеспечивает, в том числе, интеграцию данных с датчиков, цифровую обработку сигналов, шифрование и преобразование: «Если ваша архитектура специализируется только на одном типе вычислений, все остальные функции остаются невостребованными». По словам главы Efficient, Electron E1 разработан для поддержки всего кода, необходимого для работы приложения, что делает его идеальным для периферийных вычислений, встроенных систем и ИИ-приложений: «Разработчики могут использовать уже имеющийся у них код». Лючия отметил, что процессор лучше всего подходит для устройств, требующих длительного времени автономной работы, а также условий ограниченного энергопотребления, например, для использования в дронах и промышленных датчиках. Чип уже используется в устройствах партнёра Efficient, компании BrightAI, позволяя обрабатывать ИИ-нагрузки в реальном времени на периферии и снижая потребность в энергоемких облачных вычислениях для таких задач, как обработка сигналов и инференс. Лючия сообщил, что компания видит большие перспективы для использования чипа в робототехнике, автомобилестроении, космосе и оборонных приложениях, которые имеют ограничения по размерам и мощности. Что касается E1 EVK, то он, по словам компании, разработан для того, чтобы максимально упростить изучение потенциала нового процессора. Независимо от того, разрабатываете ли вы новое ПО, проводите анализ энергопотребления или портируете существующее ПО, EVK предоставляет:

В случае отсутствия оборудования можно использовать решение Electron E1 Cloud EVK, которое предоставляет размещённую среду со всеми возможностями физической платы. Как физический EVK, так и облачный EVK доступны в рамках программы раннего доступа Efficient Computer.

16.12.2025 [17:07], Руслан Авдеев

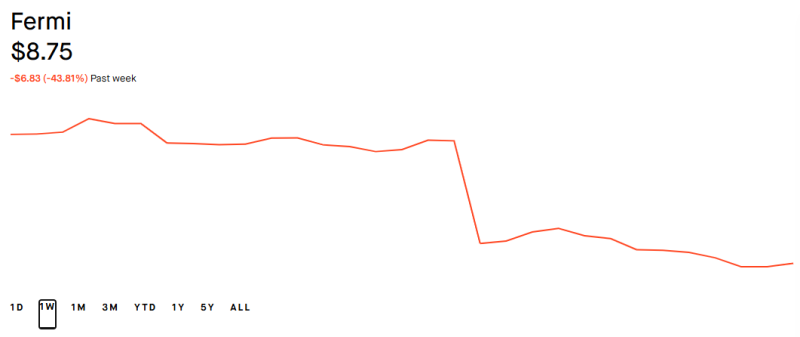

Акции Fermi рухнули почти наполовину после отказа клиента от аренды несуществующего ЦОДВ прошлую пятницу акции Fermi America стремительно упали после того, как было объявлено о выходе из совместного проекта с компанией крупного арендатора. Потенциальный арендатор запланированного кампуса на 11 ГВт в Техасе отказался от соглашения на $150 млн, сообщает Datacenter Dynamics. После появления новости акции компании рухнули в цене на 46 %. В сентябре Fermi сообщила о неназванном арендаторе с «рейтингом инвестиционного класса», подписавшим не имеющее обязательной силы письмо о намерениях (LOI) — он должен был стать первым клиентом ЦОД в новом гигантском кампусе Project Matador. Предполагалось, что компания, вероятно, является одним из крупнейших игроков на рынках облачных вычислений или ИИ. Она должна была обеспечить $150 млн финансирования для покрытия огромных строительных затрат Fermi, связанных с проектом, но деньги так и не поступили. Срок эксклюзивной возможности заключения соглашения об аренде истёк 9 декабря, и потенциальный арендатор расторг соглашение, хотя по-прежнему ведёт переговоры о том или ином виде аренды ЦОД на территории кампуса.

Источник изображения: Fermi America После того, как Fermi сообщила о первоначальном провале, она уточнила, что начаты переговоры с другими потенциальными арендаторами, связанные с обеспечением энергией площадки Project Matador в 2026 году. Также Fermi утверждает, что по-прежнему уверена в своей способности обеспечить поставки энергии для Matador в соответствии с графиком. По словам экспертов Cantor Fitzgerald, сделка сорвалась из-за разногласий, связанных с ценообразованием. Эксперты утверждают, что Fermi придерживается «ценовой дисциплины» и ни в чём не желает уступать в вопросе цен, поскольку это «создало бы плохой прецедент для будущих гигаватт». Fermi, одним из учредителей которой является бывший губернатор Техаса и министр энергетики США Рик Перри (Rick Perry), рассчитывает построить масштабный кампус ЦОД на 11 ГВт с энергогенерирующими мощностями. Строительство планируется неподалёку от Амарилло (Amarillo) на земле, входящей в экосистему Техасского технологического университета (Texas Tech University). В случае, если проект будет успешно реализован, кампус займёт площадь 1,67 млн м2 и будет использовать местные источники энергии, включая природный газ, солнечную, ветровую и атомную энергию. Fermi представляет собой феномен. Компания ещё не построила ни одного ЦОД и имеет очень небольшой опыт работ в данной сфере, но это не помешало ей успешно подготовиться к выходу на IPO и выйти на биржу — бизнес привлёк $682 млн, капитализация составила огромные для столь неоднозначного проекта $15 млрд. Хотя $150 млн — сумма немалая, для полного запуска проекта нужно несоизмеримо больше. Первые два этапа, в ходе которых компания построит ЦОД мощностью 1,1 ГВт, вероятно, обойдутся в $2 млрд. По имеющимся данным, компания уже заказала четыре больших ядерных реактора для своих ИИ ЦОД в Техасе — это крупнейший проект АЭС в США в XXI веке. Ранее потенциальным арендатором называлась компания Palantir, занятая в сфере обработки больших данных и систем наблюдения.

16.12.2025 [14:40], Сергей Карасёв

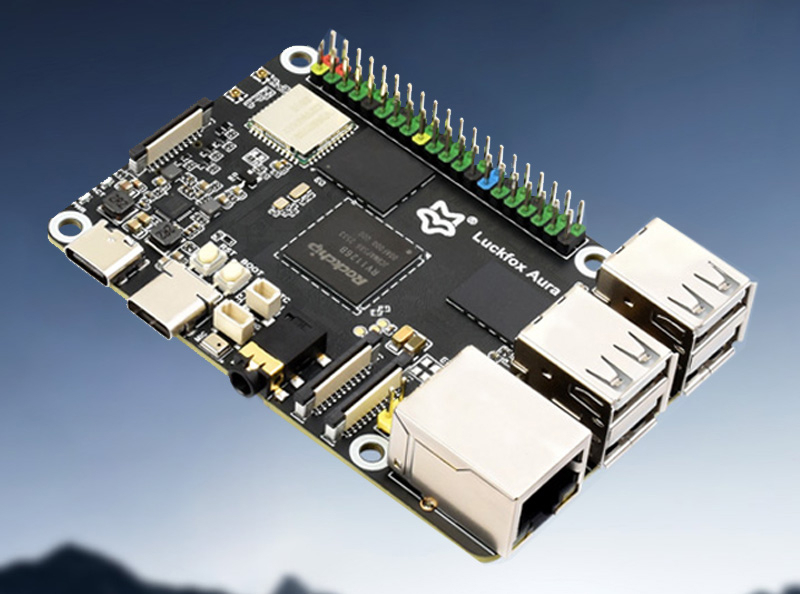

Одноплатный компьютер Luckfox Aura в стиле Raspberry Pi получил процессор Rockchip RV1126B с ИИ-быстродействием до 3 TOPSВ продажу поступил одноплатный компьютер Luckfox Aura в стиле Raspberry Pi, использующий аппаратную платформу Rockchip и ОС на ядре Linux. Новинка подходит для создания различных периферийных устройств с ИИ-функциями, включая машинное зрение. Применён процессор Rockchip RV1126B, который содержит четыре вычислительных ядра Arm Cortex-A53 с тактовой частотой до 1,6 ГГц и движок 2D Graphics Engine. Встроенный VPU-блок обеспечивает возможность декодирования материалов H.265/H.264 с разрешением до 3840 × 2160 точек (30 к/с), а также кодирования видео H.265/H.264. Имеется нейропроцессорный узел (NPU) с производительностью до 3 TOPS на операциях INT8 и поддержкой TensorFlow, Caffe, Tflite, Pytorch, Onnx NN, Android NN.

Источник изображения: CNX Software В зависимости от модификации Luckfox Aura несёт на борту 2 или 4 Гбайт LPDDR4X, а также опциональный модуль eMMC вместимостью 64 Гбайт (плюс карта microSD). В оснащение входят адаптеры Wi-Fi 6 (2,4/5 ГГц) и Bluetooth 5.4 BLE, контроллер 1GbE (с дополнительной поддержкой PoE). В набор разъёмов входят четыре порта USB 2.0 Type-A, гнездо RJ45 для сетевого кабеля, порт USB 3.0 OTG Type-C, отдельный коннектор USB Type-C для подачи питания, аудиогнездо на 3,5 мм. Кроме того, упомянуты два интерфейса MIPI CSI (по 4 линии) для камер, интерфейс MIPI DSI (4 линии) для вывода изображения (до 1920 × 1080 пикселей; 60 Гц) и 40-контактная колодка GPIO, совместимая с некоторыми модулями Raspberry Pi HAT. Одноплатный компьютер имеет размеры 85 × 56 мм. Приобрести новинку можно по ориентировочной цене от $50 в варианте с 2 Гбайт ОЗУ и без встроенного eMMC-накопителя.

16.12.2025 [01:05], Владимир Мироненко

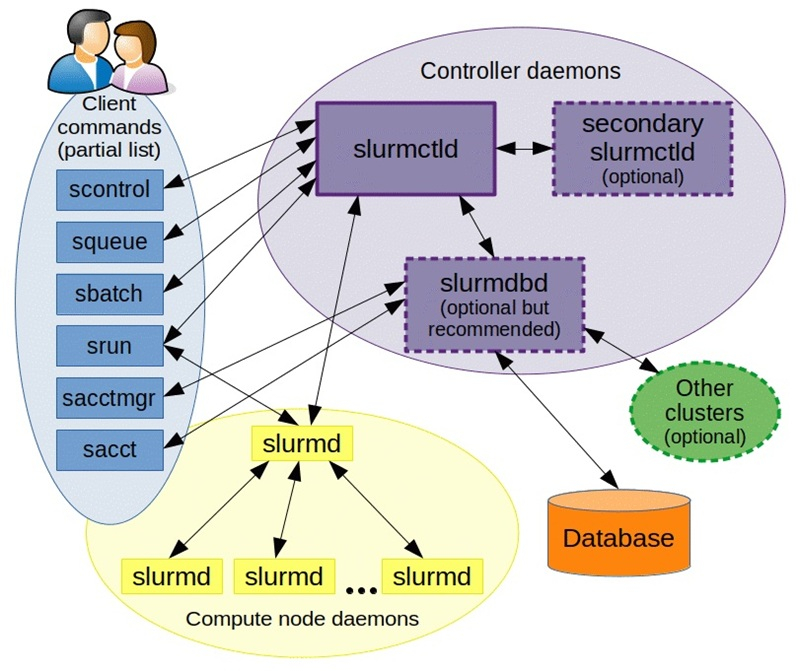

NVIDIA купила разработчика Slurm, пообещав не забрасывать open source решениеNVIDIA объявила о приобретении SchedMD — ведущего разработчика открытой системы оркестрации Slurm для высокопроизводительных вычислений (HPC) и ИИ. Финансовые условия сделки не разглашаются. Созданная SchedMD система Slurm обеспечивает планирование и управление большими вычислительными задачами в ЦОД, позволяя уменьшить количество ошибок, ускорить вывод продукции на рынок и снизить затраты. Как сообщает NVIDIA, сделка поможет укрепить экосистему ПО с открытым исходным кодом и стимулировать инновации в области ИИ для исследователей, разработчиков и предприятий. Компания отметила, что рабочие нагрузки HPC и ИИ включают сложные вычисления с выполнением параллельных задач на кластерах, для чего требуется организация очередей, планирование и распределение вычислительных ресурсов. По мере увеличения размеров и мощности кластеров HPC и ИИ задача эффективного использования ресурсов становится критически важной.

Источник изображения: SchedMD SchedMD была основана в 2010 году разработчиками ПО Slurm Моррисом «Мо» Джеттом (Morris «Moe» Jette) и Дэнни Оублом (Danny Auble) в Ливерморе (Livermore, штат Калифорния). В настоящее время персонал компании насчитывает 40 человек. Сейчас Slurm — ведущий менеджер рабочих нагрузок и планировщик заданий по масштабируемости, пропускной способности и управлению сложными политиками, который используется более чем в половине из десяти и ста лучших систем в списке TOP500 суперкомпьютеров. NVIDIA сообщила, что сотрудничает с SchedMD более десяти лет и продолжит инвестировать в разработку Slurm, чтобы сохранить его поизиции как ведущего планировщика с открытым исходным кодом для HPC и ИИ. NVIDIA обеспечит доступ SchedMD к новым системам, чтобы клиенты могли запускать гетерогенные кластеры с использованием последних инноваций Slurm. Также NVIDIA пообещала и далее поддерживать open source ПО, вкладываться в разработку Slurm и обучение. NVIDIA делает ставку на технологии с открытым исходным кодом и наращивает инвестиции в ИИ-экосистему, чтобы противостоять растущей конкуренции, отметил ресурс Reuters. В конце прошлого года NVIDIA завершила приобретение стартапа Run:ai, разрабатывающего ПО для управления рабочими нагрузками ИИ и оркестрации на базе Kubernetes. А в 2022 году она купила фирму Bright Computing, ещё одного известного разработчика инструментов оркестрации и управления кластерами.

14.12.2025 [19:14], Руслан Авдеев

Oracle опровергла сообщения о задержке строительства ИИ ЦОД для OpenAIВ пятницу агентство Bloomberg сообщило, что Oracle перенесла сроки завершения строительства некоторых ЦОД для OpenAI на 2028 год по причине нехватки рабочей силы и материалов — на год позже, чем планировалось. Позже информацию опровергла сама Oracle, попытавшись развеять опасения инвесторов, сообщило агентство Reuters. В компании объявили, что на всех площадках, необходимых для выполнения обязательств, задержек не наблюдалось, а работы на всех этапах выполняются в соответствии с графиком. Oracle утверждает, что полностью уверена в своей способности выполнять договоры и планы дальнейшего расширения. После публикации отчёта Bloomberg акции Oracle упали на 3,6 % после и так рекордного падения ранее, но позже частично компенсировали потери. Акции других ИИ-компаний тоже подешевели, в том числе пострадали ценные бумаги NVIDIA, AMD и Micron, в среднем на 2–4,5 %. Инвесторы опасаются роста расходов и слабых перспектив компании, всё больше попадающей в зависимость от OpenAI. Oracle, один из «малых гиперскейлеров», в 2025 году включилась в гонку по созданию ИИ-инфраструктуры благодаря сделке с OpenAI, предусматривавшей создание дата-центров на $300 млрд. При этом проект вынудил компанию активно привлекать заёмные средства. По данным Reuters, в последнее время инвесторы напуганы тем, что в гонке ИИ вперёд вырывается Google, а также растущей долговой нагрузкой Oracle, распродали часть акций и облигаций компании. В прошлый четверг стоимость страхования долгов Oracle от дефолта достигла самого высокого уровня за пять лет, в пятницу она снова подросла. С начала года цена акций компании выросла всего на 13 %, ценные бумаги полностью «растеряли» достижения сентября, когда отчёт о рекордном портфеле заказов на сумму более $450 млрд, в основном связанных с OpenAI, привёл к взлёту цены акций на 36 %. После публикации Bloomberg некоторые эксперты заявили, что новость свидетельствует о появлении проблем, выходящих за рамки только лишь проблем и задержке при выпуске чипов. Как заявили в TECHnalysis Research, опасения, связанные с задержками строительства ЦОД, доступностью электроэнергии и др. факторами становятся всё более значимыми. В компании заявляют, что рынок более чувствителен к новостям о задержках при реализации ИИ-проектов, поскольку инвесторы тщательно анализируют отдачу от инвестиций. На днях сообщалось, что рекордная выручка и оптимистичный прогноз NVIDIA снизили опасения по поводу роста ИИ-пузыря. Впрочем, эксперты Omdia не исключают того, что рынок ИИ может «лопнуть» — хотя вероятность этого считается не слишком высокой. Инвесторы стали всё более разборчивы в том, что касается ИИ-проектов, и всё реже готовы поощрять необдуманные траты на ИИ, даже с учётом того, что они делают ставку на долгосрочный потенциал соответствующих проектов.

14.12.2025 [14:40], Руслан Авдеев

NVIDIA рассматривает увеличение выпуска ускорителей H200 из-за большого спроса на них в КитаеПо данным отраслевых источников, NVIDIA сообщила клиентам в Китае, что уже рассматрвиает возможность нарастить производство ИИ-ускорителей H200. По данным Reuters, объёмы заказов уже превышают доступный сегодня уровень производства. Ранее сообщалось, что руководство США рассматривает разрешение поставок H200 в КНР, а в минувший вторник президент страны объявил о том, что этот вопрос решён положительно. При этом власти будут получать комиссию в 25 % с продаж ускорителей в Китай. Спрос на современные ИИ-чипы в Китае столь высок, что NVIDIA допускает расширение их производства. В самой NVIDIA прокомментировали слух, заявив, что управляют цепочкой поставок таким образом, чтобы продажи авторизованным клиентам в Китае не повлияли на способность поставлять продукцию покупателям из США. Пока чипов H200 производится очень немного, поскольку NVIDIA сосредоточилась на выпуске передовых ускорителей Blackwell, а также будущего семейства — Rubin. Крупные китайские компании, включая Alibaba и ByteDance уже связались с NVIDIA на днях по поводу закупок H200 и, как утверждается, заинтересованы в размещении крупных заказов. Впрочем, пока неопределённость сохраняется, поскольку закупки H200 не одобрили в самом Китае. По словам источников, в прошлую среду китайские чиновники провели ряд экстренных совещаний для обсуждения вопроса и принятия решения о том, стоит ли в принципе разрешать поставки H200.

Источник изображения: bruce mars/unsplash.com H200 поступили в массовое производство в 2024 году и являются самыми быстрыми ускорителями NVIDIA поколения Hopper. Высокий спрос на H200 в Китае обусловлен тем, что это самый производительный чип, который будет доступен китайскому бизнесу на данный момент. Он приблизительно вшестеро производительнее «урезанной» модели H20. Решение США принято на фоне стремления Китая активно развивать собственную полупроводниковую индустрию для ИИ-проектов. Поскольку продукция, сопоставимая с H200 в продаже пока отсутствует, в Китае уже возникли опасения, что выход американских чипов на локальный рынок может затормозить развитие местной отрасли. По мнению некоторых китайских экспертов, вычислительная мощность H200 в два-три раза выше, чем у самых передовых чипов из КНР — многие поставщики облачных услуг и корпоративные клиенты активно размещают заказы и лоббируют ослабление ограничений. При этом отмечается, что спрос в Китае в любом случае превышает возможности местного производства. По сведениям источников, в ходе экстренных совещаний предлагалось разрешить покупать каждый ускоритель H200 только при условии покупки определённого количества чипов китайского производства. При этом у китайских IT-гигантов теоретически остаётся запасной вариант — размещение H200 в собственных ЦОД за пределами Китая. Они и так обучают модели в дата-центрах вне КНР, пусть и не своих. Для NVIDIA же наращивать производственные мощности тоже непросто, поскольку она занята наладкой массового производства Rubin и конкурирует за мощности TSMC с компаниями уровня Google. |

|