Материалы по тегу: ии

|

19.12.2025 [15:35], Игорь Осколков

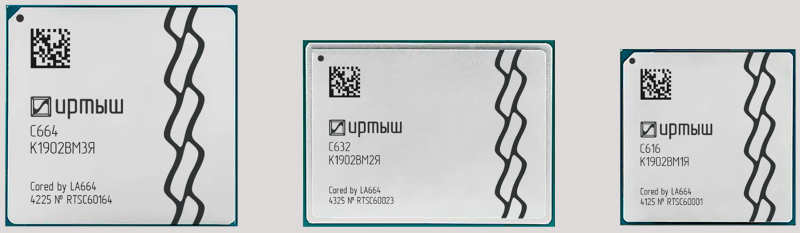

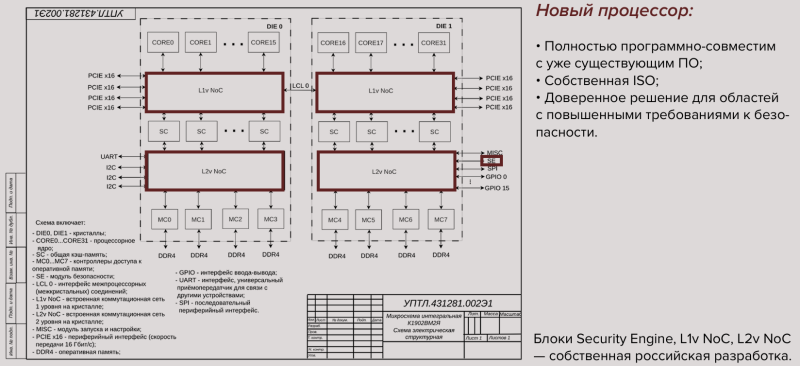

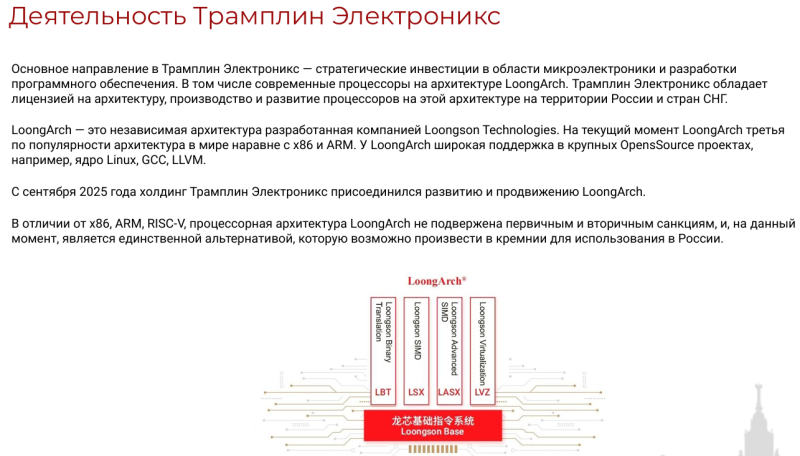

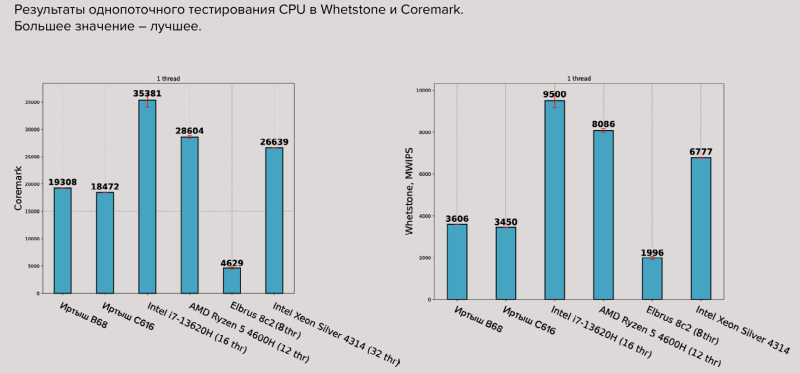

Ишь какой «Иртыш»: анонсированы российские 64-ядерные серверные процессоры C664 на китайской архитектуре LoongArchРоссийская компания «Трамплин Электроникс» готовит отечественные 12-нм серверные процессоры «Иртыш» C616, C632 и C664 с 16, 32 и 64 ядрами LAA64 на китайской архитектуре LoongArch. Это последнее поколение ядер Loongson, которые используются в похожих по характеристикам процессорах серии 3C6000. Название CPU выбрано, по-видимому, неспроста, поскольку р. Иртыш берёт своё начало в Китае, а заканчивает свой путь в России. В данном случае ядра лицензированы, топология чипов собственная, имеется конструкторская и прочая документация, что вкупе позволяет записать «Иртыш» в отечественные микросхемы второго уровня. Кроме того, несмотря на уже имеющуюся относительно широкую поддержку LoongArch в популярных открытых проектах, включая ядро Linux и GCC, — в том числе благодаря стараниями и намерением Loongson сделать свою архитектуру третьей по популярности после x86 и Arm, — «Трамплин Электроникс» хочет развивать российское сообщество вокруг LoongArch и всячески популяризировать её, предоставляя техническую и методическую поддержку процессора на русском языке. Компания готовит технологическую ОС и SDK, весь базовый набор для разработки системного ПО, в том числе окружение для кросс-компиляции. На данный момент «Трамплин Электроникс» разработала топологию и низкоскоростные ядра. В разработке находится модуль безопасности, а уже в I квартале следующего года компания намерена передать партнёрам первую партию инженерных образцов новых чипов. Процессоры будут выпускаться на «дружественной фабрике, которая не попадает под санкции», а их корпусировка пока будет производиться в Китае, но со временем этот этап может быть перенесён на территорию РФ. Параллельно компания занимается референсным дизайном плат, в первую очередь для серверов, СХД и т.п., на которые и ориентированы первые чипы. Собственно LA664 являются 64-бит суперскалярными двухпоточными (SMT2) ядрами с внеочередным исполнением и возможностью обработки до шести инструкций за такт. Каждое ядро содержит четыре целочисленных блока, четыре блока векторных операций (128/256 бит), четыре модуля генерации адресов для доступа к памяти и аппаратный ускоритель фирменных китайских алгоритмов шифрования SM2/3/4. Объём L1i- и L1d-кеша составляет 64 Кбайт, L2-кеша — 256 Кбайт. L3-кеш общий для всех ядер и размер его неизменно составляет 32 Мбайт на чиплет. В UEFI Tianocore EDK2 имеется поддержка Loongarch, так что именно «Трамплин Электроникс» и будет дорабатывать. Самый младший процессор «Иртыш» C616 (К1902ВМ1Я) как раз и состоит из одного чиплета с 16 ядрами (16C/32T) на борту и четырьмя каналами памяти DDR4-3200 ECC (до 256 Гбайт), дополненных сопроцессором безопасности на ядре LA264 (Loongson SE). Высокоскоростные интерфейсы включают межпроцессорную когерентную шину DragonChain и 64 линии PCIe 4.0 (четыре x16), низкоскоростные интерфейсы представлены традиционными SPI, UART, S2C, GPIO. При TDP на уровне 100–120 Вт и пиковой частотой 2,2 ГГц (есть динамическое управление питанием и частотой) заявленный уровень FP64-производительности составляет 844,8 Гфлопс. «Иртыш» C632 (К1902ВМ2Я) состоит из двух чиплетов, включает 32 ядра (32C/64T), 128 линий PCIe 4.0, восемь каналов DDR4-3200 ECC (до 1 Тбайт) и имеет TDP 180–200 Вт. При пиковой частоте 2,1 ГГц его быстродействие составляет до 1612,8 Гфлопс. Наконец, «Иртыш» C664 (К1902ВМ3Я) состоит из четырёх чиплетов, включает 64 ядра (64C/128T), имеет TDP 250–300 Вт, а при пиковой частоте 2 ГГц он «выдаёт» до 3072 Гфлопс. Количество каналов памяти и PCIe-линий у него такое же, как у C632. С C616 и C632 возможно формирование 1S, 2S- и 4S-систем, с C664 — только 1S и 2S. Приведённые характеристики являются предварительными и фактически совпадают с таковыми у Loongson 3C6000 серий S, D и Q соответственно, хотя NoC, связывающая компоненты заявляется как собственная разработка «Трамплин Электроникс». Также утверждается, что «Иртыш» C616, C632 и C664 сравнимы с Intel Xeon Ice Lake-SP Silver 4314, Gold 6338 и Platinum 8380 соответственно (или с их аналогами поколения AMD EPYC Milan). В ноябре «Трамплин Электроникс» совместно с «АСКОН» анонсировали создание первого отечественного ПАК на базе CPU «Иртыш» при участии «Норси-Транс». Ранее «АСКОН» уже портировала свою систему проектирования КОМПАС-3D на процессоры Loongson, а «Базальт СПО» адаптировала ОС «Альт» под архитектуру LoongArch64. Также для LoongArch были сборки ОС «РОСА».

19.12.2025 [15:20], Владимир Мироненко

США объявили о заключении партнёрских отношений с 24 ведущими IT-компаниями в рамках «Миссии Генезис»В четверг в Белом доме США состоялся круглый стол с участием представителей администрации президента США и 24 ведущих технологических компаний страны, в ходе которого было объявлено о заключении Министерством энергетики США (DoE) партнёрских соглашений с компаниями с целью продвижения «Миссии Генезис» (Genesis Mission) — национальной инициативы для ускорения научных открытий, повышения национальной безопасности и стимулирования инноваций в энергетике с помощью ИИ. Об этом сообщил Bloomberg. Президент подписал указ о запуске «Миссии Генезис» 24 ноября 2025 года, поставив задачу удвоить производительность и повысить влияние американских исследований в течение десяти лет, предоставляя учёным и инженерам инструменты для разработки, обучения и эксплуатации ИИ-систем следующего поколения с большей скоростью, эффективностью и надёжностью. В мероприятии в четверг приняли участие министр энергетики Крис Райт (Chris Wright), заместитель министра энергетики по науке и директор миссии Genesis д-р Дарио Гил (Darío Gil) и директор Управления научно-технической политики Белого дома (OSTP) Майкл Крациос (Michael Kratsios). В число 24 организаций, подписавших меморандумы о взаимопонимании, входят такие крупные технологические компании, как Microsoft, Google, AWS, IBM, NVIDIA, Intel, AMD и OpenAI. Также к инициативе присоединились Anthropic, Accenture, Armada, Cerebras, CoreWeave, Dell, DrivenData, Groq, HPE, Oracle, Periodic Labs, Palantir, Project Prometheus, Radical AI, xAI и XPRIZE.

Источник изображения: CoreWeave «Сегодняшнее объявление о 24 новых исследовательских партнёрствах — это только начало, поскольку мы выполняем указ президента Трампа по вовлечению всего научного сообщества, включая компании, университеты, некоммерческие организации и федеральные агентства, в “Миссию Генезис”», — сказал Крациос. Он добавил, что «Миссия Генезис» поможет американским учёным и исследователям автоматизировать разработку экспериментов, ускорить моделирование и создать прогностические модели, которые приведут к прорывам в энергетике, производстве, разработке лекарств и многом другом. Компания NVIDIA объявила на своём сайте о присоединении к инициативе и планах увеличить инвестиции в ИИ-инфраструктуру и научные исследования и разработки. Также компания сообщила, что в рамках партнёрства с DoE уже «добивается прорывных результатов в ключевых областях». В частности, упомянуты:

Другие компании, присоединившиеся к «Миссии Генезис», тоже выступили с заявлениями. Например, Google сообщила, что DeepMind предоставит учёным всех 17 национальных лабораторий DoE программу ускоренного доступа к передовым моделям ИИ для науки и агентным инструментам, начиная с AI co-scientist в Google Cloud. AI co-scientist — это многоагентный виртуальный научный сотрудник, построенный на платформе Gemini. Он разработан для того, чтобы помочь учёным синтезировать огромные объёмы информации для ускорения разработки научных и биомедицинских открытий. В начале 2026 года компания планирует расширить программу ускоренного доступа для национальных лабораторий, включив в нее AlphaEvolve — программный агент на базе Gemini для разработки сложных алгоритмов, AlphaGenome — ИИ-модель, помогающую учёным лучше понимать ДНК, ускоряя исследования в области геномной биологии и улучшая понимание заболеваний, и WeatherNext — современное семейство моделей прогнозирования погоды. Министерство энергетики и все национальные лаборатории также получат доступ к Gemini for Government. В свою очередь, AWS отметила, что прошлом месяце объявила об инвестициях в размере до $50 млрд в инфраструктуру ИИ и суперкомпьютеров, специально созданную для государственных учреждений США. Инвестиции добавят почти 1,3 ГВт мощности в её регионах Top Secret, Secret и GovCloud. По словам компании, этого достаточно для одновременного запуска тысяч моделей и симуляций ИИ, а также обработки научных данных за десятилетия в режиме реального времени. «Эта инфраструктура обеспечит доступ к вычислительным мощностям по запросу, что позволит государственным заказчикам запускать сложные ИИ-задачи и обрабатывать огромные массивы данных для критически важных приложений — от разработки автономных систем и энергетических инноваций до обработки геномных данных, — подчеркнула Amazon. Компания сообщила, что через Amazon Bedrock организации смогут получить доступ к базовым моделям, таким как Amazon Nova — новейшее семейство современных, экономически эффективных моделей, предлагающих многомодальное понимание, разработку пользовательских моделей и возможности агентного управления, — наряду с моделями от ведущих компаний, таких как Anthropic. Это обеспечит исследователям гибкость в выборе подходящей модели для каждой научной задачи, от анализа сложных геномных данных до создания синтетических обучающих наборов данных для автономных систем.

19.12.2025 [13:24], Сергей Карасёв

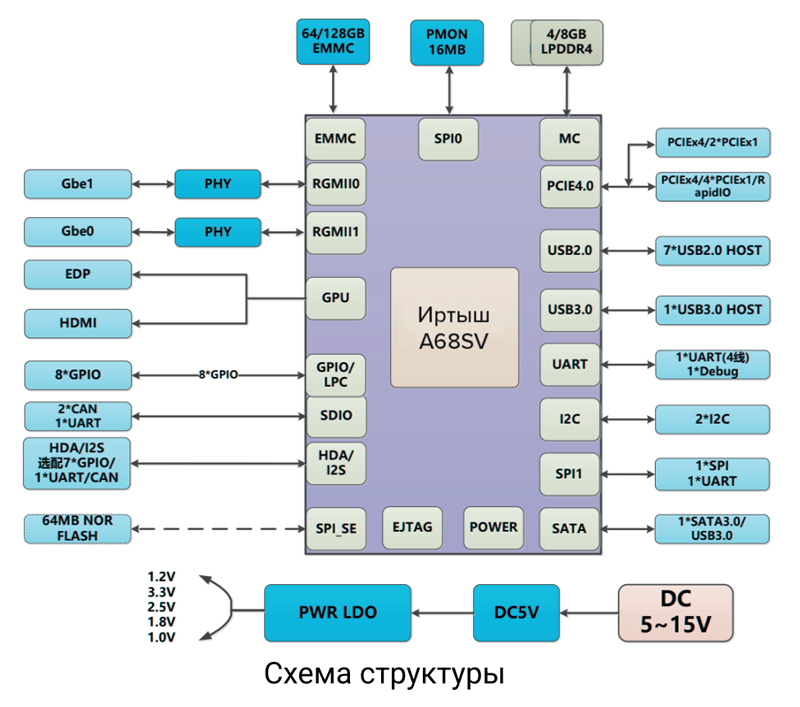

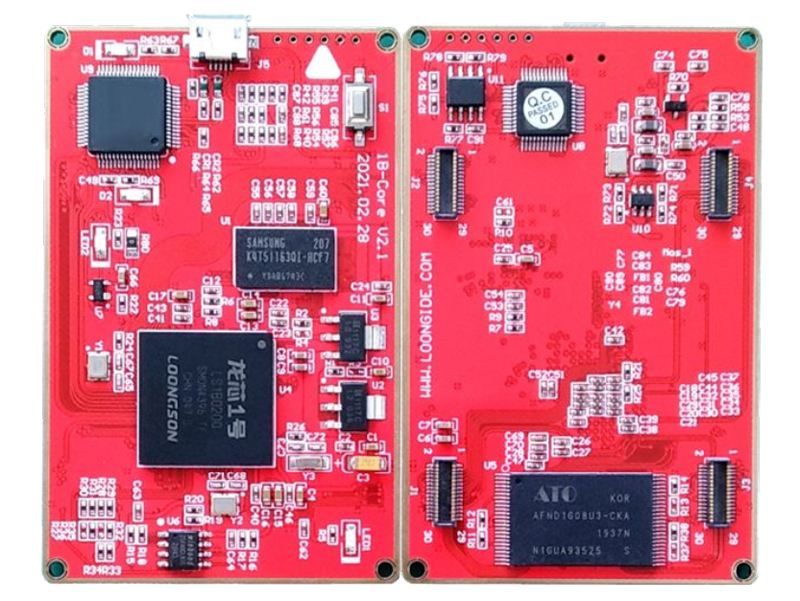

«Трамплин Электроникс» представила российскую SoC «Иртыш A68SV» с китайской архитектурой LoongArchРоссийская компания «Трамплин Электроникс» представила отечественную «систему на кристалле» (SoC) под названием «Иртыш A68SV». Изделие может применяться для создания систем промышленного управления, коммуникационного оборудования, устройств интернета вещей (IoT) и пр. Новинка выполнена на китайской архитектуре LoongArch (LA364). Задействованы два вычислительных ядра с максимальной тактовой частотой 2 ГГц. Каждое ядро содержит по 64 Кбайт кеша инструкций и данных L1 и 2 Мбайт кеша L2. Поддерживается оперативная память DDR4-2400 ECC. Упомянуты интерфейсы USB 3.0/2.0, HDMI, DVO, Gnet, GMAC, SDIO, EMMC, САМ, PCIe 3.0 и SATA 3.0. Типовое энергопотребление находится в диапазоне от 3 до 9 Вт. Кроме того, «Трамплин Электроникс» анонсировала плату для разработчиков Devboard на базе архитектуры LoongArch LA364E. Используются восемь ядер с частотой до 2 ГГц и поддержкой 128-битных операций с плавающей точкой. Объём памяти DDR4 может достигать 64 Гбайт. Имеется интегрированное графическое ядро с поддержкой OpenGL 3.3, OpenGL ES 3.1 и OpenCL 1.1. Возможна обработка видео в формате 4K с частотой до 60 к/с. В число доступных интерфейсов входят PCIe 3.0, SATA 3.0, USB 3.1, RapidIO 2.0, USB 2.0, GMAC, SDIO, eMMC, CANFD и аудио.

Источник изображений: «Трамплин Электроникс» Плата Devboard соответствует стандарту COM Express. Среди её сфер использования названы контроллеры для промышленной автоматизации и IoT-оборудования, бортовые вычислители для транспортных средств и беспилотных летательных аппаратов, измерительная техника и др. Плата позволит упростить знакомство с возможностями архитектуры LoongArch.  Как отмечается, на текущий момент LoongArch является третьей по популярности CPU-архитектурой в мире после x86 и Arm. LoongArch поддерживается крупными open source проектами, включая ядро Linux, GCC, LLVM. Эта архитектура не подвержена первичным и вторичным санкциям, а поэтому в сформировавшейся геополитической обстановке является единственной альтернативой популярным зарубежным решениям, которую возможно произвести в «кремнии» для использования в России.

18.12.2025 [16:20], Сергей Карасёв

IXcellerate разработала собственное решение для эффективного охлаждения высоконагруженных ЦОДРоссийский оператор коммерческих дата-центров IXcellerate сообщил о разработке передового решения для охлаждения высоконагруженных машинных залов. Компания уже получила патент на изобретение, которое прошло независимую экспертизу Федеральной службы по интеллектуальной собственности. Целью исследовательского проекта являлось создание технологии для увеличения мощности системы кондиционирования при неизменной площади помещения. При этом требовалось решить проблемы неравномерного распределения воздуха, обеспечив возможность размещать стойки в любой точке машинного зала без изменения конфигураций инженерных систем. В процессе разработки специалисты использовали CFD-инструменты. В результате, была получена специальная формула для расчёта объёма расходуемого воздуха, температурного режима и суммарной площади теплообменников для оптимального подбора мощности и количества вентиляторов. Формула позволила сконструировать новую воздухоохладительную камеру статического давления: она обеспечивает равномерное распределение воздушных потоков на все теплообменные аппараты. Инновационное решение внедрено в действующих машинных залах Южного кампуса IXcellerate с общей нагрузкой более 30 МВт. По заявлениям компании, применённая технология обеспечивает ряд преимуществ по сравнению с другими системами. В частности, благодаря оптимизации повышена энергоэффективность ЦОД и снижено потребление электроэнергии. Количество стойко-мест удалось увеличить на 15 % при сохранении прежней площади машинного зала. Исключены риски перегрева высоконагруженного IT-оборудования. Кроме того, достигнут оптимальный температурный график теплоносителя, благодаря чему дата-центр работает в энергосберегающем режиме фрикулинга. Разработка новой технологии особенно важна в свете сформировавшейся геополитической обстановки, из-за которой поставки импортной продукции в Россию ограничены. Предложенное решение позволяет поддерживать параметры климата по стандарту ASHRAE, обеспечивает отказоустойчивость и сервисное обслуживание оборудования без перерывов на ремонты. Система подходит для любых дата-центров и помещений с серверным оборудованием.

18.12.2025 [16:19], Руслан Авдеев

OpenAI наняла бывшего канцлера британского Казначейства Джорджа Осборна для глобального расширения проекта StargateБывший глава Казначейства Его Величества (Великобритания) Джордж Осборн (George Osborne) возглавит подразделение OpenAI, отвечающее за развёртывание дата-центров Stargate по всему миру, сообщает Datacenter Dynamics. Также за пределами США он будет помогать местным правительствам в освоении инструментов OpenAI. В мае OpenAI запустила программу расширения Stargate за пределами США. В ОАЭ она объединилась с Oracle, Cisco, NVIDIA и SoftBank для создания инфраструктуры мощностью до 5 ГВт в рамках проекта, возглавленного местной G42, имеющей теснейшие связи с государством. В Европе Nscale и Aker реализуют проект Stargate Norway со 100 тыс. ИИ-ускорителей. Nscale ответственна и за проект Stargate с 8 тыс. ускорителями в Великобритании. В Южной Корее OpenAI договорилась с SK Telecom о строительстве ИИ ЦОД на юго-западе страны, а руководители OpenAI замечены в поездках по Азии для поиска потенциальных площадок в Индии, Японии и др. странах. Также подписан меморандум с NextDC об открытии объекта Stargate в Австралии. Объект на 500 МВт планируют построить и в Аргентине. Также рассматривается реализация проекта в Канаде. Дополнительно OpenAI участвует в ряде сделок с другими технологическими компаниями. Так, в сентябре NVIDIA объявила о том, что направит OpenAI до $100 млрд, а последняя согласилась приобрести системы NVIDIA мощностью не менее 10 ГВт для своих ЦОД. В октябре AMD сообщила, что подписала обязательство поставить OpenAI ускорители на 6 ГВт в обмен на 160 млн обыкновенных акций компании. Наконец, Amazon ведет переговоры с OpenAI об инвестициях более $10 млрд, предоставлении ускорителей Trainium и сдаче в аренду дополнительных вычислительных мощностей. Джордж Осборн родом из богатой и знатной семьи. Он был назначен канцлером казначейства в 2010 году. Время его работы на должности отмечено жёсткой экономией средств на британских социальных службах, также были снижены налоги для лиц с высокими доходами. По оценкам некоторых экспертов, такая политики оказалась совершенно неэффективной и даже ухудшила экономическое положение страны. По некоторым данным, к 2019 году объём экономики Великобритании сократился на £100 млрд, а Институт исследований государственной политики (Institute for Public Policy Research, IPPR) заявил, что с 2012 года принятые меры и вовсе стали причиной 130 тыс. предотвратимых смертей.

Источник изображения: Invest Europe/unspalsh.com После голосования по Brexit и отставки премьер-министра в 2016 году Осборн был уволен. В 2017 году он устроился на высокооплачиваемую должность в BlackRock, а чуть позже стал работать и редактором газеты Evening Standard, оставаясь при этом парламентарием. Позже Осборн покинул местный парламент и работал ещё в нескольких должностях, в т.ч. в венчурной компании 9Yards, на посту председателя Британского музея, преподавателя в Стэнфордском университете и др., а также был партнёром в небольшом инвестиционном банке Robey Warshaw. Осборн намерен покинуть пост в Robey Warshaw (ныне Evercore), но останется ли он на других должностях, не уточняется. Также он является советником криптовалютной биржи Coinbase, в совет директоров которой входит вице-президент OpenAI по глобальной политике Крис Лехейн (Chris Lehane). В октябре пост советника Microsoft «на неполный день» занял бывший премьер Великобритании Риши Сунак (Rishi Sunak), который также участвует в деятельности Anthropic. Политик по-прежнему является депутатом парламента от округа Ричмонд и Норталлертон (Richmond and Northallerton).

18.12.2025 [13:41], Руслан Авдеев

Blue Owl отказалась финансировать $10-млрд ЦОД Oracle для OpenAI Stargate — теперь Oracle надеется, что заплатит BlackstoneИнвестиционная группа Blue Owl Capital не намерена финансировать проект строительства ЦОД Oracle в городке Салин (Saline Township) в Мичигане. Проект создания кампуса дата-центров оценивается в $10 млрд, за строительство отвечают Oracle, Related Digital и OpenAI в рамках проекта Stargate, сообщает Datacenter Dynamics. Кампус The Barn обеспечит IT-мощность в 1 ГВт, площадь составит более 100 га. Он будет включать три одноэтажных здания совокупной площадью более 51 тыс. м2. Предполагается использование системы охлаждения замкнутого цикла, чтобы сократить потребление воды. Строительство должно стартовать в начале 2026 года, хотя проект столкнулся с сопротивлением местных жителей. Отказался поддерживать его и крупнейший партнёр Oracle в сфере строительства дата-центров — компания Blue Owl. По данным The Financial Times, Blue Owl вела переговоры с кредиторами и самой Oracle об инвестициях в ЦОД, но они зашли в тупик. По имеющимся сведениям, кредиторы настаивали на более жёстких условиях аренды и кредитования из-за «изменения рыночных настроений» в связи с масштабными инвестициями в ИИ-инфраструктуру. Также имелись опасения, связанные с растущим долгом Oracle. На конец ноября долг компании составлял $105 млрд, это почти на $78 млрд больше, чем годом ранее. В сентябре Oracle искала кредиты на сумму порядка $38 млрд, в том же месяце она продала облигации на сумму около $18 млрд. По мнению экспертов KeyBanc Capital Markets, компании может потребоваться в долг до $100 млрд для финансирования строительства. Последние данные свидетельствуют, что в ситуацию вмешалась Blackstone, которая уже ведёт переговоры о вхождении в число финансовых партнёров проекта, но соглашение пока не подписано. Сама Oracle сообщает, что партнёр по строительству Related Digital выбирал партнёра-инвестора из нескольких вариантов. Итоговые переговоры по сделке идут в соответствии с графиком и планом. Ранее Blue Owl уже поддержала проект строительства ЦОД Crusoe в Абилине (Abilene, Техас), он тоже сдаётся Oracle, а та, в свою очередь, предоставляет вычислительные мощности OpenAI. Также компания приняла участие в строительстве кампуса в Нью-Мексико. Декабрь стал непростым месяцем для Oracle. После публикации финансовых результатов за последний квартал, недостаточно впечатливших инвесторов, стоимость акций компании упала приблизительно на 10 %. Вскоре появились данные о задержках некоторых проектов ЦОД для Stargate, хотя Oracle и опровергала данные. По информации Bloomberg, облачные компании, включая Oracle, Microsoft и Meta✴ Platforms обязались потратить в совокупности $500 млрд на аренду ЦОД в ближайшие годы, астрономическая сумма, свидетельствующая о вере в ИИ-индустрию, причём в последние кварталы обязательства только росли. Будущие расходы по новым договорам аренды не будут отражаться в отчётах компаний, пока они не начнут платить по ним. В целом речь идёт о расходах на дата-центры, но также речь может идти об объектах вроде офисов и складов. Только за три осенних месяца Oracle подписала договоры на $150 млрд, общие обязательства составили $248 млрд. После публикации планов Oracle инвесторы стали продавать её акции, считая, что компании скоро будет не хватать капитала. Хотя инвестиции в ИИ-индустрию растут, по мнению некоторых экспертов, Oracle служит исключением — её облачный бизнес довольно мал в сравнении с Amazon (AWS), Microsoft или Google, а сделка на $300 млрд с OpenAI в текущем году в некотором смысле ослабила компанию, поскольку теперь она стала отчасти зависима от одного крупного клиента. При этом аренда дата-центра или вычислительных мощностей вместо строительства позволяет избежать многих выплат «вперёд». Например, Meta✴ арендует свой флагманский ЦОД Hyperion в Луизиане у специальной компании, которая и возьмёт на себя кредиты на многомиллиардное строительство, которое профинансирует в том числе и Blue Owl. Meta✴ обязалась потратить $58 млрд на аренду, которая ещё не стартовала. Это втрое больше, чем годом ранее. Расходы на аренду воспринимаются иначе, чем капитальные затраты. Многие компании также готовятся потратить десятки миллиардов долларов на аренду, но их устойчивые денежные потоки позволяют инвесторам чувствовать себя увереннее. Так, ещё в 2023 году расходы Microsoft на аренду взлетели на фоне огромного спроса на вычисления со стороны партнёра компании — OpenAI. Google традиционно предпочитала иметь дата-центры в собственности, но в последние кварталы компания изменила планы, желая арендовать всё больше объектов. На сентябрь 2025 года она имела «портфолио» из будущих арендных обязательств на $42,6 млрд, в семь раз выше, чем в тот же период годом ранее.

18.12.2025 [12:00], Владимир Мироненко

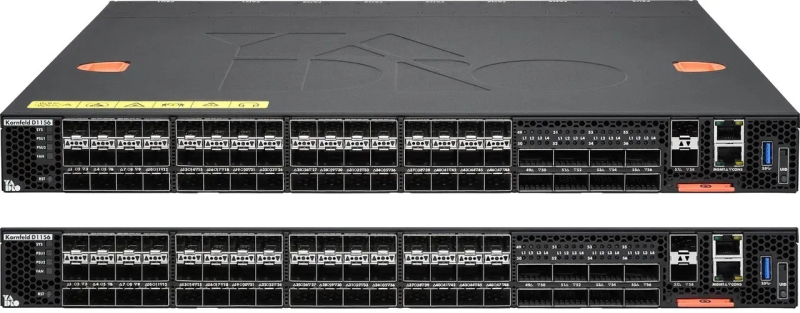

Совместные испытания YADRO и «Т1 Интеграции» подтвердили высокую надёжность и производительность коммутаторов YADRO KORNFELD DCКомпания YADRO (входит в «ИКС Холдинг») подвела итоги комплексного тестирования линейки коммутаторов KORNFELD DC для ЦОД, проведенного совместно с Центром компетенций сетевых технологий «Т1 Интеграция». Как сообщается, результаты испытаний подтвердили соответствие KORNFELD DC эксплуатационным требованиям по надёжности, масштабируемости и управлению сетью в инфраструктурах дата-центров, включая объекты критической информационной инфраструктуры (КИИ). Высокопроизводительные коммутаторы серии KORNFELD DC обеспечивают построение масштабируемых сетей ЦОД с CLOS-архитектурой благодаря, в том числе, расширенным функциям L2/L3, поддержке технологии EVPN/VXLAN и протоколов резервирования. Линейка оптимизирована для использования в классических сетях ЦОД, рассчитанных на масштабирование и балансировку нагрузки между узлами, а также в сетевых инфраструктурах облачных провайдеров и гиперскейлеров. Программа тестирования включала основные сетевые сценарии, максимально приближённые к реальным условиям эксплуатации. Коммутаторы продемонстрировали стабильную работу и эффективность реализованных механизмов отказоустойчивости и резервирования, обеспечивая гарантированную производительность и масштабирование сети по мере роста нагрузки, с поддержкой аппаратным резервированием питания и охлаждения высокого уровня доступности и бесперебойной работы. По словам Павла Егорова, директора по продуктам YADRO, компания последовательно развивает серию коммутаторов KORNFELD DC, получившую в этом году новые ключевые функции, в том числе, поддержку EVPN/VXLAN. Также большое внимание уделяется развитию сетевой ОС Kornfeld OS. В свою очередь, Алексей Изосимов, технический директор «Т1 Интеграция» подчеркнул, что тестирование коммутаторов KORNFELD DC было проведено в ключевых сетевых сценариях, «чтобы заказчики могли уверенно внедрять отечественные решения и развивать инфраструктуру без зависимости от решений зарубежных поставщиков». «Испытания продемонстрировали высокий уровень надёжности и производительности оборудования, необходимый для промышленных ИТ-сред», — отметил он. Коммутаторы линейки KORNFELD DC входят в экосистему корпоративных решений YADRO наряду с серверами VEGMAN, СХД TATLIN и платформой управления YADRO СУПРИМ. Единый технологический стек и централизованное управление унифицируют эксплуатационные процессы, снижают совокупную стоимость владения и упрощают обеспечение сервисной поддержки клиентов. Линейка KORNFELD DC включена в Единый реестр радиоэлектронной продукции Минпромторга РФ. Благодаря подтверждённому соответствию международным стандартам по уровню функциональности, надёжности и управляемости сетью коммутаторы KORNFELD DC могут использоваться в масштабных проектах по построению современной сетевой инфраструктуры ЦОД.

18.12.2025 [09:50], Владимир Мироненко

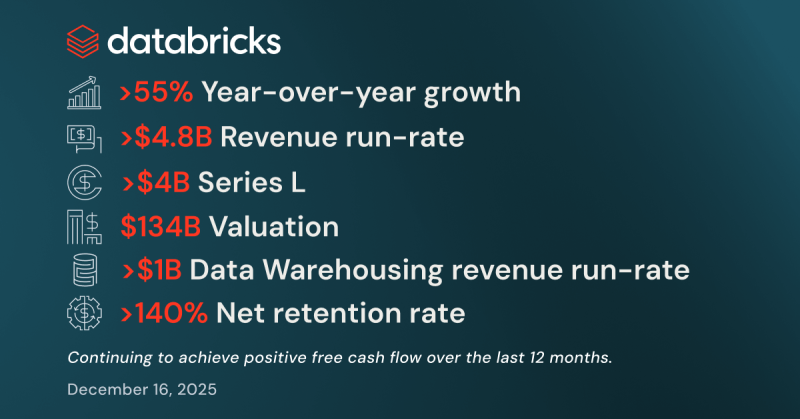

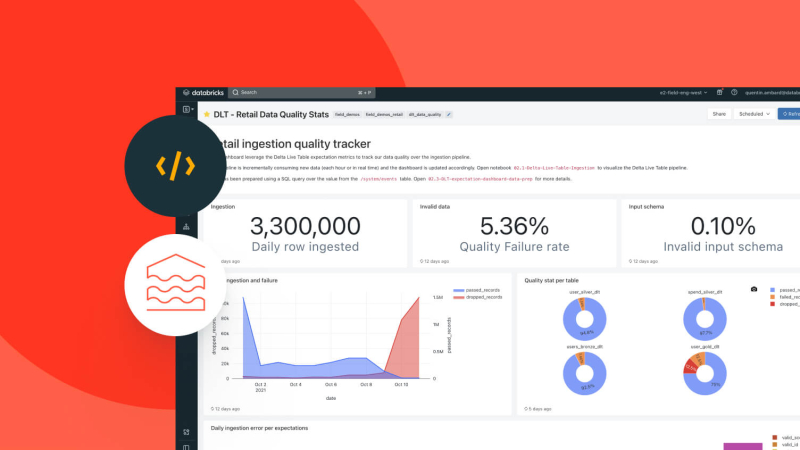

Databricks привлекла $4 млрд, увеличив рыночную стоимость до $134 млрдDatabricks объявила о завершении раунда финансирования серии L, в ходе которого она привлекла более $4 млрд с оценкой рыночной стоимости в $134 млрд. Это на $34 млрд больше её оценки после предыдущего раунда финансирования в августе этого года. С момента основания в 2013 году Databricks провела 12 раундов финансирования, в ходе которых привлекла $19 млрд инвестиций. Из них $14 млрд — в течение последних двух лет. Раунд финансирования возглавили Insight Partners, Fidelity Management & Research Company и JP Morgan Asset Management при участии Andreessen Horowitz, фондов и счетов под управлением BlackRock, Blackstone, Coatue, GIC, MGX, NEA, Ontario Teachers Pension Plan, Robinhood Ventures, а также счетов, управляемых T. Rowe Price Associates, Inc., Temasek, Thrive Capital и Winslow Capital. Резкому росту оценки компании способствовал быстрый рост её выручки. Databricks сообщила, что её расчётная годовая выручка (Revenue Run Rate, RRR) в III квартале превысила $4,8 млрд (рост год к году на 55 %), причём более $1 млрд приходится на ИИ-решения и ещё $1 млрд — на платформу для хранения данных Data Warehousing. В прошлом году, когда компания привлекла $10 млрд в рамках раунда J, у неё было более 500 клиентов с ежегодным регулярным доходом (ARR) более $1 млрд, сообщил ресурс Blocks & Files. Сейчас таких клиентов более 700. Коэффициент удержания клиентов составляет более 140 %, поскольку существующие клиенты со временем тратят больше денег на услуги Databricks. Компания также отметила популярность Lakebase, управляемой базы данных на основе PostgreSQL, запущенной компанией в июне. Компания сообщила, что сервис уже используют тысячи клиентов и и наращивает выручку вдвое быстрее, чем её решение для хранилищ данных. Привлечённые инвестиции Databricks планирует направить на дальнейшую разработку трёх «стратегических продуктов». Первый из них — Lakebase, «первая бессерверная база данных Postgres, специально разработанная для эпохи ИИ». Lakebase идеально подходит для хранения точек данных, которые ИИ-модели используют для принятия решений, пишет SiliconANGLE. Сервис работает со сжатыми версиями бизнес-данных, которые нейронной сети проще обрабатывать, чем исходную информацию, и регулярно обновляет их по мере появления новой информации Например, магазин может преобразовать статистику об активности посетителей веб-сайта в высокоуровневые данные о том, какие товарные объявления вызывают наибольший интерес. Lakebase использует технологии приобретённого за $1 млрд стартапа Neon. Lakebase может предоставлять функции нейронным сетям, развёрнутым как на платформе Databricks, так и во внешней инфраструктуре. Ещё одно направление инженерных разработок компании — решение Agent Bricks, которое упрощает создание и масштабирование высококачественных агентов на основе их данных. Инструмент генерирует синтетические обучающие данные, которые можно использовать для оптимизации агентов для конкретных задач. Кроме того, он создаёт эталонные тесты для измерения эффективности обучения ИИ и упрощает связанные задачи, такие как разработка системных подсказок. Компании могут превратить ИИ-агентов, созданных с помощью Lakebase и Agent Bricks, в приложения, используя Databricks Apps, третий продукт, который компания планирует усовершенствовать. Databricks Apps ускоряет разработку приложений за счет автоматизации ряда ручных задач. Это включает в себя процесс внедрения функций аутентификации, контроля доступа и других мер кибербезопасности. «Благодаря интеграции транзакционных данных в Lakebase, интуитивно понятному интерфейсу и возможности создания передовых многоагентных систем с помощью Agent Bricks, мы предоставляем клиентам единую основу для построения надёжных, высокопроизводительных приложений для обработки данных в масштабе предприятия», — заявил соучредитель и генеральный директор Databricks Али Годси (Ali Ghodsi).  Компания сообщила, что будет использовать новый капитал, чтобы помочь клиентам создавать приложения и агентов на основе ИИ, используя Lakebase в качестве системы учёта, Databricks Apps в качестве уровня пользовательского интерфейса и Agent Bricks для работы с многоагентными системами. Также сообщается, что новое финансирование позволит обеспечить ликвидность для сотрудников, чтобы они могли реализовать свои акции, и, как ожидается, будет способствовать дальнейшим приобретениям и исследования в области ИИ.

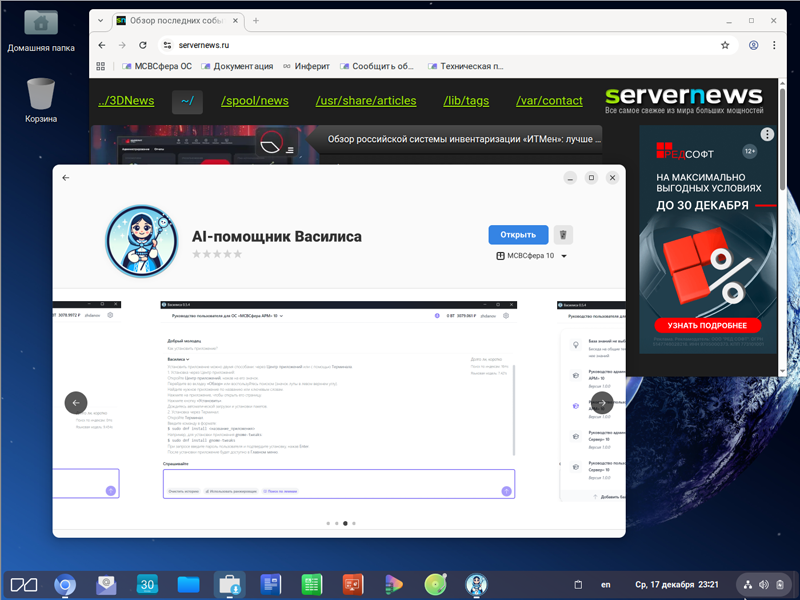

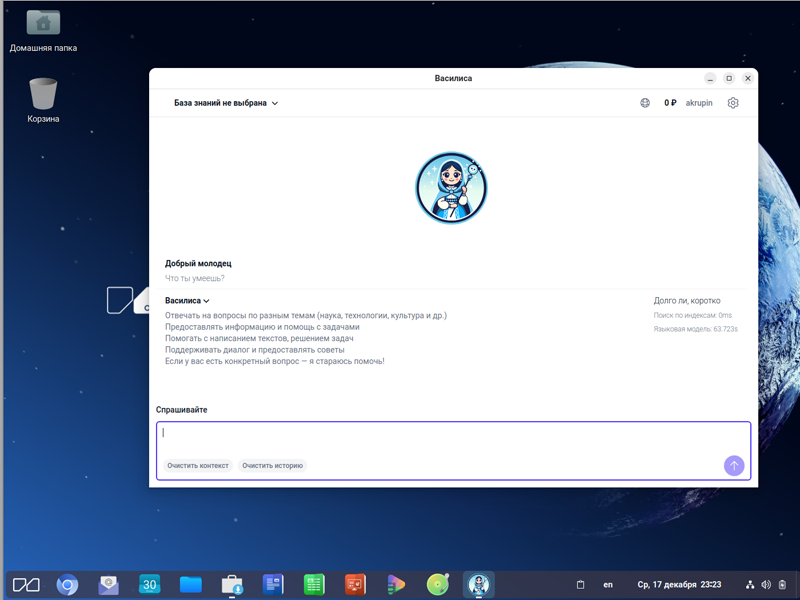

18.12.2025 [00:08], Андрей Крупин

Состоялся релиз российской ОС «МСВСфера» 10.1 со встроенным ИИ-ассистентом «Василиса»Разработчик «Инферит ОС» (входит в группу компаний Softline) сообщил о выпуске версии 10.1 операционной системы «МСВСфера», ключевым нововведением которой стал умный помощник «Василиса», реализованный с использованием технологий машинного обучения и искусственного интеллекта на базе нейронных сетей. Инструмент «Василиса» разработан новосибирской компанией «Сибирские нейросети», построен на основе открытой ИИ-модели Qwen3 от китайской компании Alibaba и производит все вычисления локально, без передачи данных вовне, что делает его оптимальным решением для применения в корпоративной среде с высокими требованиями к безопасности обрабатываемой информации (госсектор, финтех, оборонно-промышленный комплекс). Помощник выполняет умный поиск по локальным документам и базам знаний, умеет решать аналитические задачи и обрабатывать данные, поддерживает работу с файлами форматов PDF, DOCX, PPTX, TXT, может использоваться для оперативного разрешения возникающих вопросов, генерации идей и получения консультаций.  Для работы ИИ-ассистента «Василиса» в локальном режиме необходим компьютер с конфигурацией от 16 Гбайт оперативной памяти и процессором уровня Intel Core i5 (6 ядер). Для слабых машин компанией «Сибирские нейросети» предлагается возможность подключения помощника к облачным вычислительным ресурсам. По заверениям разработчика, при использовании такого сценария ИИ-помощник не отправляет в интернет полные данные из файлов пользователя — передаются только релевантные фрагменты, необходимые для ответа на конкретный запрос. Это обеспечивает баланс между мощностью внешней ИИ-модели и безопасностью корпоративной информации.  Помимо ИИ-ассистента «Василиса» в состав релиза ОС «МСВСфера» 10.1 вошли аудио- и видеоконвертер, корпоративный менеджер Compass, пакет офисных программ «Р7-Офис», обновлённый «Центр приложений», а также расширенная административная панель Cockpit.  Платформа «МСВСфера» построена на базе ядра Linux, зарегистрирована в реестре отечественного программного обеспечения Минцифры и является альтернативой зарубежным ОС уровня Enterprise Linux. Операционная система представлена в редакциях для рабочих станций и серверов и подходит для использования как в государственных, так и в коммерческих организациях. Продукт содержит встроенные инструменты миграции с Red Hat Enterprise Linux, CentOS, AlmaLinux, Rocky Linux, Oracle Enterprise Linux и поддерживается производителем в рамках десятилетнего жизненного цикла, включая выпуск обновлений и исправлений безопасности, что гарантирует стабильность и защищённость IT-инфраструктуры клиента. Для физических лиц дистрибутив ОС «МСВСфера» (в исполнении для рабочих станций) предоставляется бесплатно, для корпоративных заказчиков стоимость платформы варьируется в зависимости от количества приобретаемых лицензий.

17.12.2025 [16:41], Владимир Мироненко

Amazon не прочь инвестировать $10 млрд в OpenAI и дать стартапу фирменные ИИ-ускорители TrainiumAmazon ведет переговоры с OpenAI о возможных инвестициях более $10 млрд в стартап, предоставлении ему ускорителей серии Trainium и сдаче в аренду дополнительных вычислительных мощностей, сообщила газета The Financial Times. По словам её источников, знакомых с ситуацией, в случае заключения сделки капитализация OpenAI может превысить $500 млрд. Впрочем, переговоры находятся на ранней стадии и говорить об этом пока рано. Переговоры проходят после пересмотра первоначальной сделки стартапа с его ранним инвестором Microsoft. Компании реструктурировали свои отношения, что позволило OpenAI заключить соглашения об использовании вычислительных мощностей конкурирующих с Microsoft облачных провайдеров. В частности, стартап подписал сделку с Amazon, обязавшись потратить $38 млрд на аренду ИИ-ускорителей NVIDIA в течение семи лет. Обсуждаемое сейчас соглашение об инвестициях и облачных сервисах будет заключено в дополнение к этому соглашению. Ранее OpenAI обязался использовать сервисы Azure на $250 млрд. Microsoft сохраняет эксклюзивные права на передовые модели OpenAI до 2032 года. На данный момент стартапом заключены соглашения на сумму $1,5 трлн с NVIDIA, Oracle, AMD и Broadcom на поставку чипов и услуги вычислительной инфраструктуры. Циклический характер заключённых OpenAI сделок, а также отсутствие понятных механизмов коммерциализации ИИ и обоснованных расчётов стартапа по обеспечению окупаемости инвестиций, вызывает обеспокоенность некоторых инвесторов, считающих, что ИИ-индустрия находится на пути к формированию пузыря. OpenAI не единственная, кто заключает сделки с поставщиками. Например, разработчик ИИ-моделей Anthropic, привлёк в общей сложности около $26 млрд инвестиций от Amazon, Google, Microsoft и NVIDIA, используя их оборудование и сервисы. Amazon является одним из крупнейших инвесторов Anthropic. С 2023 года она вложила в стартап около $8 млрд. Обсуждаемая с Amazon сделка также знаменует собой еще один шаг в попытках OpenAI диверсифицировать чипы, используемые для обучения и запуска своих моделей. Источники сообщили, что Amazon и OpenAI также обсуждают коммерческое сотрудничество, связанное с маркетплейсом технологического гиганта. Стартап стремится закрепиться в сфере электронной коммерции и уже заключил сделки с Etsy, Shopify и Instacart с целью создания новых источников дохода. |

|