Материалы по тегу: x

|

22.12.2025 [12:18], Сергей Карасёв

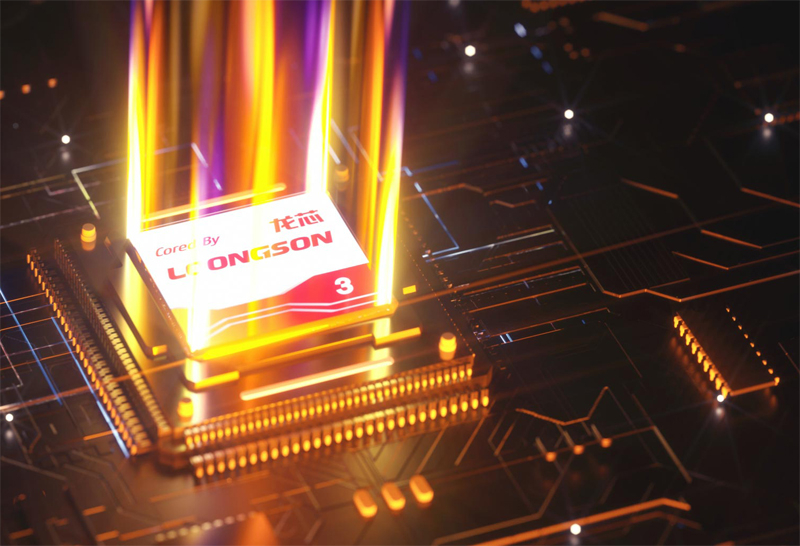

В Debian 14 появится официальная поддержка китайской CPU-архитектуры LoongArchУчастники проекта Debian объявили о том, что в следующем релизе этой операционной системы появится официальная поддержка процессорной архитектуры LoongArch, разработанной китайской компанией Loongson, которая намерена сделать свою ISA третьей по популярности после Arm и x86. Данная аппаратная платформа, вдохновлённая MIPS и RISC-V, в условиях сформировавшейся геополитической обстановки набирает популярность. В августе 2023-го разработчики Debian сообщили о реализации порта «Loong64» для систем, оснащённых CPU с архитектурой LoongArch. Отмечается, что поддержка LoongArch реализована в основных компиляторах и внедряется в различных областях экосистемы open source. Официально LoongArch будет поддерживаться в Debian 14 с кодовым именем Forky. Релиз этой ОС запланирован на 2027 год. Участники проекта Debian отмечают, что на текущий момент в рамках интеграции поддержки LoongArch вручную собран и импортирован начальный набор из 112 пакетов.

Источник изображения: Loongson Архитектуру LoongArch берут на вооружение российские компании в связи с западными санкциями. В частности, на днях отечественная компания «Трамплин Электроникс» раскрыла информацию о 12-нм серверных процессорах «Иртыш» C616, C632 и C664 с 16, 32 и 64 ядрами LAA64 на базе LoongArch. Кроме того, к выпуску готовятся SoC «Иртыш A68SV» и плата для разработчиков Devboard на базе архитектуры LoongArch LA364E. Ранее российская «Аскон» представила инженерный программно-аппаратный комплекс (ПАК), построенный на чипе семейства LoongArch: система выполнена в виде настольной рабочей станции. В качестве программной платформы применяется «Альт» разработки «Базальт СПО».

20.12.2025 [15:09], Сергей Карасёв

Вот на эти два процента Linux и живёт: Linux Foundation получила в 2025 году $311,3 млн, но на ядро потратила лишь $8,4 млнОрганизация Linux Foundation опубликовала финансовые показатели деятельности в 2025 году. Общие поступления достигли $311,3 млн, что на 6,5 % больше по сравнению с предыдущим годом, когда они составляли $292,2 млн. При этом расходы сократились на 5 % — с $299,7 млн до $284,8 млн. В общем объёме выручки на пожертвования и взносы, а также средства участников организации в 2025-м пришлось $133,3 млн. Ещё $83,6 млн составила целевая поддержка проектов, $58,6 млн — спонсорство мероприятий и регистрационные взносы на конференциях. Поступления от обучающих курсов и выдачи сертификатов оцениваются в $29,6 млн. Все прочие виды деятельности вместе взятые принесли $6,2 млн. Крупнейшей статьёй расходов является поддержка проектов — $181,8 млн. На программы обучения в 2025 году потрачено $21,6 млн, на инфраструктуру — $17,7 млн, на проведение мероприятий — $16,8 млн. Приблизительно $15,8 млн израсходовано на поддержание корпоративных операций, $15,7 млн — на сопровождение сообщества. На проекты, связанные непосредственно с ядром Linux, затрачено $8,4 млн (менее 3 % от всего бюджета). Примерно $6,8 млн пришлось на международные операции. В отчете говорится, что по итогам 2025 года Linux Foundation курировала почти 1500 проектов против примерно 1300 годом ранее. Их наибольшая доля связана с облачными технологиями, контейнерами и виртуализацией — 23 %. На втором месте находятся сетевые и периферийные решения с 14 %, а замыкают тройку проекты в области искусственного интеллекта, машинного обучения и аналитики данных с 12 %. Около 12 % приходится также на кроссплатформенные решения, 10 % — на разработку веб-сервисов и приложений, 5 % — на безопасность. Суммарный вклад всех прочих проектов (блокчейн, интернет вещей, встраиваемые системы, DevOps и др.) оценивается в 24–25 %.

18.12.2025 [00:08], Андрей Крупин

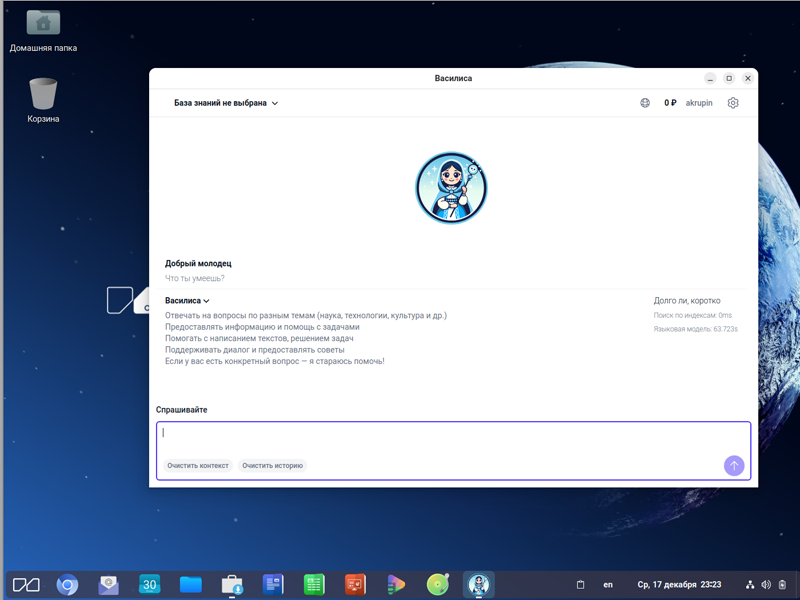

Состоялся релиз российской ОС «МСВСфера» 10.1 со встроенным ИИ-ассистентом «Василиса»Разработчик «Инферит ОС» (входит в группу компаний Softline) сообщил о выпуске версии 10.1 операционной системы «МСВСфера», ключевым нововведением которой стал умный помощник «Василиса», реализованный с использованием технологий машинного обучения и искусственного интеллекта на базе нейронных сетей. Инструмент «Василиса» разработан новосибирской компанией «Сибирские нейросети», построен на основе открытой ИИ-модели Qwen3 от китайской компании Alibaba и производит все вычисления локально, без передачи данных вовне, что делает его оптимальным решением для применения в корпоративной среде с высокими требованиями к безопасности обрабатываемой информации (госсектор, финтех, оборонно-промышленный комплекс). Помощник выполняет умный поиск по локальным документам и базам знаний, умеет решать аналитические задачи и обрабатывать данные, поддерживает работу с файлами форматов PDF, DOCX, PPTX, TXT, может использоваться для оперативного разрешения возникающих вопросов, генерации идей и получения консультаций.  Для работы ИИ-ассистента «Василиса» в локальном режиме необходим компьютер с конфигурацией от 16 Гбайт оперативной памяти и процессором уровня Intel Core i5 (6 ядер). Для слабых машин компанией «Сибирские нейросети» предлагается возможность подключения помощника к облачным вычислительным ресурсам. По заверениям разработчика, при использовании такого сценария ИИ-помощник не отправляет в интернет полные данные из файлов пользователя — передаются только релевантные фрагменты, необходимые для ответа на конкретный запрос. Это обеспечивает баланс между мощностью внешней ИИ-модели и безопасностью корпоративной информации.  Помимо ИИ-ассистента «Василиса» в состав релиза ОС «МСВСфера» 10.1 вошли аудио- и видеоконвертер, корпоративный менеджер Compass, пакет офисных программ «Р7-Офис», обновлённый «Центр приложений», а также расширенная административная панель Cockpit.  Платформа «МСВСфера» построена на базе ядра Linux, зарегистрирована в реестре отечественного программного обеспечения Минцифры и является альтернативой зарубежным ОС уровня Enterprise Linux. Операционная система представлена в редакциях для рабочих станций и серверов и подходит для использования как в государственных, так и в коммерческих организациях. Продукт содержит встроенные инструменты миграции с Red Hat Enterprise Linux, CentOS, AlmaLinux, Rocky Linux, Oracle Enterprise Linux и поддерживается производителем в рамках десятилетнего жизненного цикла, включая выпуск обновлений и исправлений безопасности, что гарантирует стабильность и защищённость IT-инфраструктуры клиента. Для физических лиц дистрибутив ОС «МСВСфера» (в исполнении для рабочих станций) предоставляется бесплатно, для корпоративных заказчиков стоимость платформы варьируется в зависимости от количества приобретаемых лицензий.

17.12.2025 [10:11], Сергей Карасёв

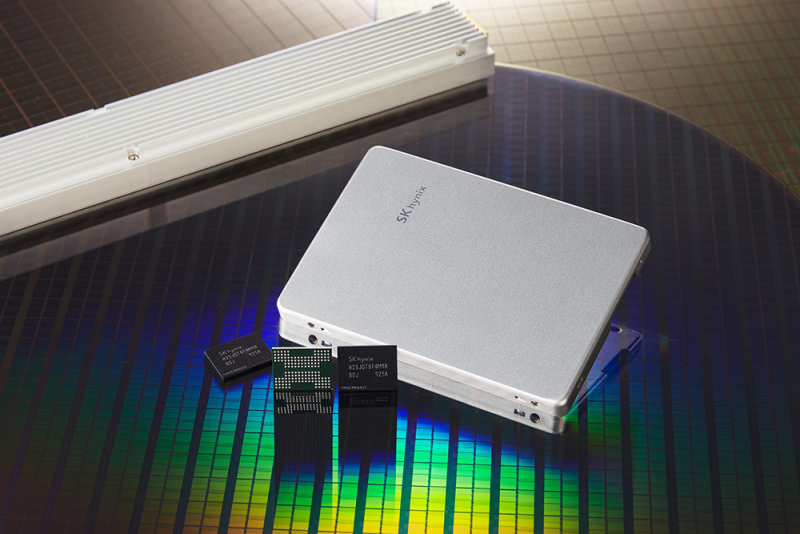

SK hynix и NVIDIA объединили усилия для создания сверхбыстрых SSD для ИИ-системКомпании SK hynix и NVIDIA, по сообщениям сетевых источников, занимаются совместной разработкой сверхбыстрых SSD, которые, как ожидается, помогут устранить узкие места современных ИИ-платформ. Проект получил название Storage Next: он предполагает создание чипов флеш-памяти NAND и сопутствующих контроллеров следующего поколения. По информации ресурса ZDNet, первые прототипы изделий партнёры намерены представить к концу следующего года. Речь идёт о накопителях с интерфейсом PCIe 6.0, которые смогут демонстрировать показатель IOPS (операций ввода/вывода в секунду) на уровне 25 млн. Более того, в 2027-м, как ожидается, будет выпущено устройство с величиной IOPS до 100 млн. Для сравнения, современные высокопроизводительные SSD корпоративного класса имеют значение IOPS на уровне 2–3 млн. В основу накопителей Storage Next лягут наработки SK hynix в области памяти AI-N (AI-NAND), оптимизированной для ИИ. В частности, упоминаются решения AI-N P: предполагается, что такие устройства будут выполнены в форм-факторе EDSFF E3.x. Они получат контроллер, предназначенный для выполнения как обычных рабочих нагрузок, так и с высоким показателем IOPS. По мере того, как ИИ-платформы переходят от обучения к инференсу, возможностей памяти HBM с высокой пропускной способностью оказывается недостаточно: наблюдается разрыв между объёмом и производительностью HBM и вычислительными возможностями ИИ-ускорителей на базе GPU. Цель проекта Storage Next состоит в том, чтобы решить эту проблему путём использования инноваций в области NAND. По сравнению с современными SSD накопители Storage Next смогут демонстрировать увеличение показателя IOPS в 30–50 раз. Кроме того, SK hynix разрабатывает память AI DRAM (AI-D) для ИИ-платформ: эти изделия, как предполагается, помогут справиться с нехваткой памяти.

12.12.2025 [15:43], Владимир Мироненко

В МФТИ изучили альтернативы ИИ-ускорителям NVIDIA — китайские Moore Threads и MetaX оказались неплохиВ связи с прекращением поставок в Россию ускорителей NVIDIA, ограничениями на загрузку драйверов и отсутствием их техподдержки Институт искусственного интеллекта МФТИ провёл исследование рынка альтернативных ускорителей, включая продукты китайских производителей Moore Threads и MetaX с целью оценки их способности обеспечить полный цикл работы современных ИИ-моделей. Исследование включало анализ архитектурных особенностей ускорителей, драйверов, совместимости с фреймворками и тестирование под нагрузкой при работе с LLM, инференсом, задачами компьютерного зрения и распределённых вычислений. Проведена оценка скорости и воспроизводимости вычислений, устойчивости при росте нагрузки и стабильности поведения моделей на разных типах ускорителей. Исследователи пришли к выводу, что ускорители Moore Threads s4000 и MetaX C500 могут применяться в широком спектре сценариев, обеспечивая стабильный запуск популярных LLM, корректную работу современных фреймворков, предсказуемую производительность и устойчивость работы при длительных нагрузках. В отдельных типах вычислений альтернативные ускорители не уступали или даже обгоняли NVIDIA A100. Особое внимание было уделено возможности работы альтернативных ускорителей в составе вычислительных узлов и кластеров. Разработанный стек ПО позволяет эффективно распределять ресурсы, объединять мощности для работы с крупными моделями и создавать кластерные конфигурации, сообщили в МФТИ. В МФТИ планируют и дальше тестировать новые поколения ускорителей, расширив перечень поддерживаемых моделей, а также намерены подготовить отраслевые рекомендации для создания автономной ИИ-инфраструктуры. На основе исследования в МФТИ был создан Центр компетенций по решениям, не зависящим от NVIDIA, который объединяет лучшие инженерные практики, методики тестирования, оптимизированные конфигурации и опыт взаимодействия с поставщиками. Он будет оказывать помощь компаниям в подборе оборудования, проведении нагрузочного тестирования под конкретные задачи, настройке вычислительных цепочек, а также может сопровождать платформы в процессе эксплуатации.

12.12.2025 [12:44], Сергей Карасёв

Чипы-коммутаторы Xsight Labs X2 пропишутся в спутниках SpaceX Starlink V3Компания Xsight Labs объявила о том, что её программируемые чипы-коммутаторы X2 будут использоваться в составе космических аппаратов SpaceX Starlink V3, предназначенных для организации высокоскоростного спутникового интернет-доступа в глобальном масштабе. Изделия Xsight X2 изготавливаются по техпроцессу TSMC N5. Они обеспечивают пропускную способность до 12,8 Тбит/с. Возможно использование до 128 портов; поддерживаются режимы 100GbE, 200GbE и 400GbE. Заявленное энергопотребление составляет менее 200 Вт. Задержка при работе на скорости 100GbE — менее 700 нс. Чипы выполнены в корпусе с размерами 55 × 55 мм. Каждый спутник Starlink V3 обеспечивает пропускную способность канала связи свыше 1 Тбит/с, что более чем в 10 раз превышает показатель Starlink V2. При этом скорость передачи данных по восходящему каналу составляет около 160 Гбит/с. Решения Xsight X2 помогут в обеспечении надёжной связи при больших нагрузках. Отмечается, что работа глобальной инфраструктуры Starlink зависит от передачи больших объёмов данных в реальном времени, включая трафик, передаваемый по оптическим каналам между спутниками. При этом задействованы технологии адаптивного управления лучом. В такой ситуации полностью программируемая архитектура чипа Xsight X2 позволяет динамически адаптироваться к меняющимся требованиям орбитальных линий связи, обеспечивая оптимальную производительность в различных условиях. В результате, для конечных потребителей услуг обеспечивается скорость интернет-доступа, сопоставимая с оптическими каналами. Утверждается, что изделия Xsight X2 прошли комплексные испытания на соответствие требованиям, предъявляемым к компонентам для работы в экстремальных условиях космического пространства. Речь идет об устойчивости к вибрации, радиации, низким температурам и пр.

11.12.2025 [17:33], Андрей Крупин

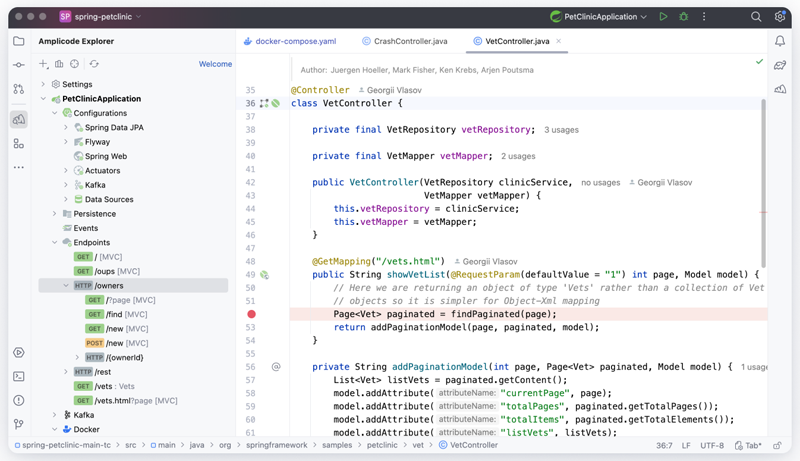

Состоялся анонс OpenIDE Pro — корпоративной версии российской интегрированной среды разработки«Группа Астра», Axiom JDK и Haulmont анонсировали выпуск корпоративной версии отечественной интегрированной среды разработки OpenIDE Pro. Релиз решения ожидается в первом квартале 2026 года. Продукт создаётся как расширенная платформа для компаний, которым необходимы расширенная функциональность, обслуживание по SLA и выделенная техническая поддержка. OpenIDE Pro станет дальнейшим развитием открытой версии Community Edition, которая была выпущена в апреле 2025 года. Особенностью корпоративной редакции среды разработки станет расширенная поддержка языков и платформ. Продукт получит углубленную поддержку Go, охватывающую анализ кода, навигацию, рефакторинг и интеграцию со сборочными инструментами. Для Java станут доступными дополнительные возможности профилирования и анализа приложений. Существенно улучшится работа с JavaScript и TypeScript, что сделает среду удобной для мультистековых команд. В области фронтенд- и веб-разработки OpenIDE Pro обеспечит улучшенную поддержку современных фреймворков, включая React, Vue и Angular, а также предложит встроенные инструменты для Next.js. Разработчики смогут запускать и отлаживать фронтенд-приложения непосредственно из IDE, без дополнительных внешних инструментов.

Источник изображения: openide.ru В составе OpenIDE Pro также будут представлены Database Client для работы с запросами, схемами и данными и HTTP Client — для тестирования API и интеграционных сценариев. Для JVM-процессов будет реализовано встроенное профилирование, позволяющее анализировать поведение приложений в реальном времени. Отдельное внимание будет уделено расширению поддержки Spring на базе Amplicode Pro, которая позволит генерировать Spring Boot-проекты по корпоративным шаблонам, проектировать доменную модель в визуальной форме, автоматически создавать сущности, сервисы, DTO, контроллеры и CRUD-функциональность, а также значительно улучшит навигацию по JPA-сущностям и интеграцию со Spring-инфраструктурой. OpenIDE создаётся с учётом требований по локальному исполнению и отсутствию зависимости от зарубежной инфраструктуры. Все процессы сборки, обновления и хранения данных полностью локализованы. Исходный код пользователей не передаётся во внешние облака, что актуально для организаций с повышенными требованиями к информационной безопасности. Разработка ведётся на базе доверенной российской сборки Java Axiom JDK с помощью российской платформы работы с кодом GitFlic.

04.12.2025 [15:21], Андрей Крупин

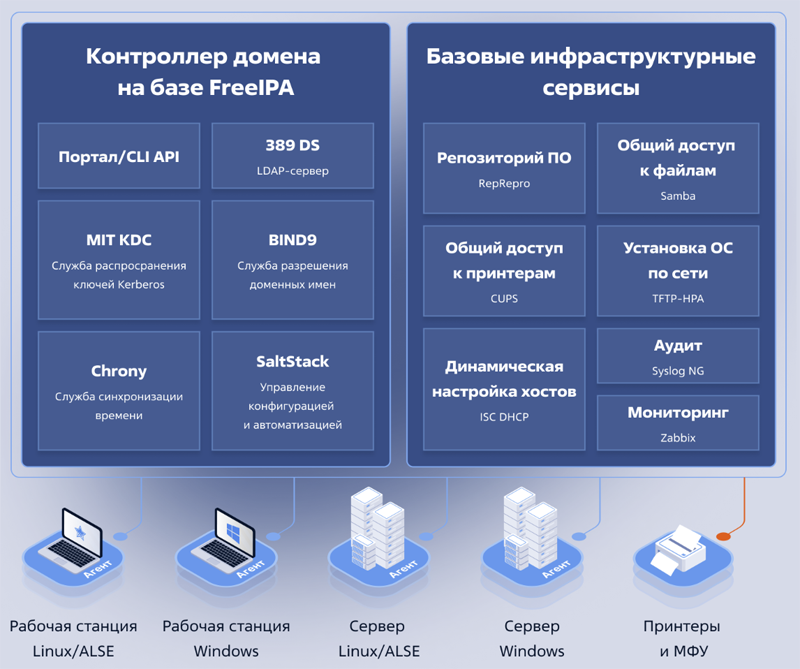

Российская служба каталогов ALD Pro дополнилась редакциями для малого и среднего бизнеса«Группа Астра» объявила о выпуске двух новых версий службы каталогов ALD Pro — Lite и Lite Plus. Обе редакции предназначены для предприятий малого и среднего бизнеса и различаются лимитом управляемых устройств: в пакет ALD Pro Lite входят до 50 устройств, в ALD Pro Lite Plus — до 100 устройств. В состав каждой версии продукта входят контроллер домена, операционная система Astra Linux Server с уровнем защиты «Смоленск», а также набор базовых IT‑сервисов: репозиторий пакетов, файловый сервер, сервер печати, DHCP, инструменты для установки операционной системы по сети, аудита и мониторинга. Все ограничения и условия использования зафиксированы в лицензионном соглашении (EULA).

Архитектура платформы ALD Pro (источник изображений: astra.ru) Программный комплекс ALD Pro предназначен для автоматизации и централизованного управления рабочими станциями, иерархией подразделений и групповыми политиками, а также прикладными сервисами для IT-инфраструктур организаций различного масштаба. Продукт может использоваться в качестве замены Microsoft Active Directory и учитывает интересы администраторов и пользователей компаний, переходящих на отечественный софт. ALD Pro включён в дорожную карту «Новое общесистемное программное обеспечение»; решению присвоен статус «особо важного продукта» в рамках программы Минцифры России. Система соответствует требованиям Федеральной службы по техническому и экспортному контролю по 2-му уровню доверия и может использоваться в организациях, предъявляющих высокие требования к безопасности корпоративного ПО.

03.12.2025 [01:28], Владимир Мироненко

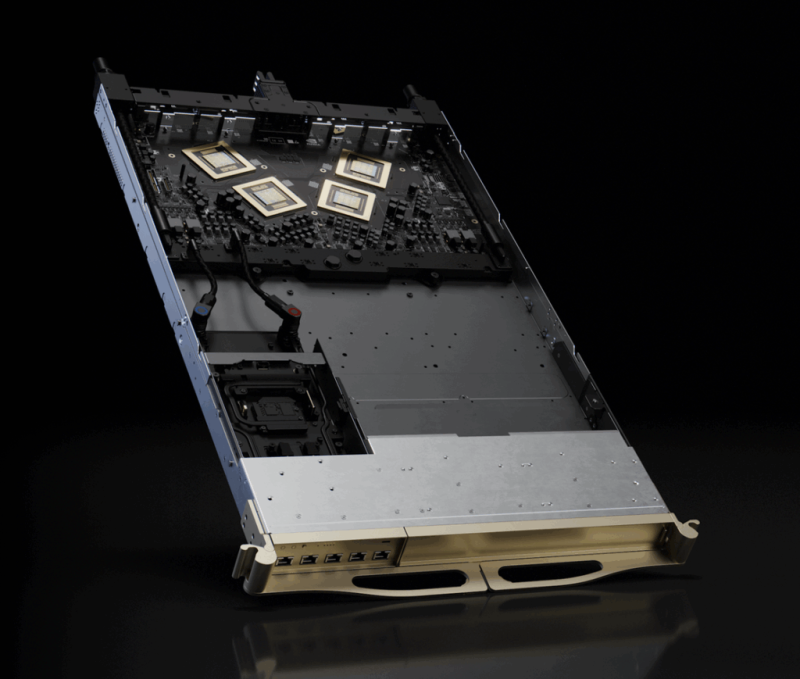

AWS «сдалась на милость» NVIDIA: анонсированы ИИ-ускорители Trainium4 с шиной NVLink FusionAWS готовит Arm-процессоры Graviton5, которые составят компанию ИИ-ускорителям Trainium4 с интерконнектом NVLink Fusion, фирменными EFA-адаптерам и DPU Nitro 6 с движком Nitro Isolation Engine. Но что более важно, все они будут «упакованы» в стойки стандарта NVIDIA MGX. Amazon и NVIDIA объявили о долгосрочном партнёрстве, в рамках которого ИИ-ускорители Trainium4 получит шину NVIDIA NVLink Fusion шестого поколения (по-видимому, 3,6 Тбайт/с в дуплексе), которая позволит создать стоечную платформу нового поколения, причём, что интересно, на базе архитектуры NVIDIA MGX, которая передана в OCP. Пикантность ситуации в том, что AWS годами практически игнорировала OCP, самостоятельно создавая стойки, их компоненты, включая СЖО, и архитектуру ИИ ЦОД в целом. Даже в нынешнем поколении стоек с GB300 NVL72 отказалась от референсного дизайна NVIDIA. NVIDIA же напирает на то, что для гиперскейлерам крайне трудно заниматься кастомными решениями — циклы разработки стоечной архитектуры занимают много времени, поскольку помимо проектирования специализированного ИИ-чипа, гиперскейлеры должны озаботиться вертикальным и горизонтальным масштабированием, интерконнектами, хранилищем, а также самой конструкцией стойки, включая лотки, охлаждение, питание и ПО.

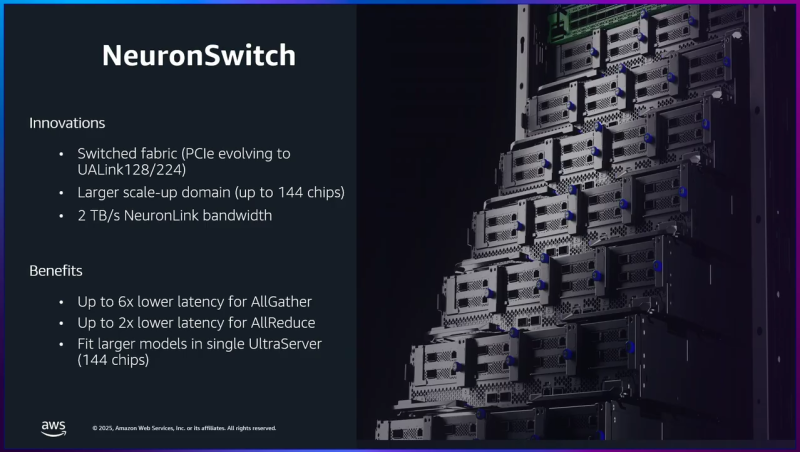

Источник изображения: NVIDIA Вместе с тем управление цепочкой поставок отличается высокой сложностью, так как требуется обеспечить согласованную работу десятков поставщиков, ответственных за десятки тысяч компонентов. И даже одна задержка поставки или замена одного компонента может поставить под угрозу весь проект. Платформа NVIDIA если не устраняет целиком, то хотя бы смягчает эти проблемы, предлагая готовые стандартизированные решения, которые могут поставлять множество игроков рынка. По словам NVIDIA, в отличие от других подходов к масштабированию сетей, NVLink — проверенная и широко распространённая технология. В сочетании с фирменным ПО NVLink Switch обеспечивает увеличение производительности и дохода от ИИ-инференса до трёх раз, объединяя 72 ускорителя в одном домене. Пользователи, внедрившие NVLink Fusion, могут использовать любую часть платформы — каждый компонент может помочь им быстро масштабироваться для удовлетворения требований интенсивного инференса и обучения моделей агентного ИИ, говорит NVIDIA. Что касается самих ускорителей Trainium4, то в сравнении с Trainium3 они будут вшестеро быстрее в FP4-расчётах, втрое быстрее в FP8-вычислениях, а пропускная способность памяти будет увеличена вчетверо. Впрочем, пока собственные ускорители Amazon не всегда могут составить конкуренцию чипам NVIDIA. Любопытно и то, что в рассказе о Trainium3 компания отметила о переходе от PCIe к UALink в коммутаторах NeuronSwitch для фирменного интерконнекта NeuronLink, объединяющего до 144 чипов Trainium. Однако после крупных инвестиций NVIDIA в Synopsys развитие UALink как открытой альтернативы NVLink теперь под вопросом.

02.12.2025 [18:20], Сергей Карасёв

Российская ИИ-система Delta Sprut XL поддерживает до 25 GPU

delta computers

gpu

granite rapids

h200

hardware

intel

nvidia

ocp

rtx

sierra forest

xeon

ии

сделано в россии

сервер

Российская компания Delta Computers представила OCP-систему Delta Sprut XL, предназначенную для ресурсоёмких нагрузок, таких как обучение ИИ-моделей, инференс, научное моделирование и задачи HPC. В основу новинки положена аппаратная платформа Intel Xeon 6. CPU-секция допускает установку двух процессоров Sierra Forest-SP или Granite Rapids-SP с показателем TDP до 330 и 350 Вт соответственно: в первом случае могут быть задействованы в общей сложности до 288 E-ядер, во втором — до 172 P-ядер. Доступны 32 слота для модулей оперативной памяти DDR5-6400 RDIMM или DDR5-8000 MRDIMM суммарным объёмом до 8 Тбайт. Могут быть установлены четыре SFF-накопителя U.2 толщиной 15 мм с интерфейсом PCIe 5.0 (NVMe) или восемь таких SSD толщиной 7 мм. Кроме того, есть два коннектора M2.2280 (PCIe). Реализованы четыре слота PCIe 5.0 x16 для карт типоразмера HHHL и слот OCP 3.0 (PCIe 5.0). Присутствуют разъёмы USB 3.0 Type-A и miniDP, а также выделенный сетевой порт управления 1GbE. В системе Delta Sprut XL ускорители на базе GPU устанавливаются в отдельные модули. В общей сложности могут использоваться до 20 карт NVIDIA H200 или до 25 экземпляров NVIDIA RTX Pro 6000 Blackwell Server Edition. Каждый квартет NVIDIA H200 объединён при помощи NVLink. «Delta Computers представляет GPGPU-платформу, способную консолидировать до 20 ускорителей NVIDIA H200 в одном кластере. При этом необходимость использования InfiniBand или 400GbE появляется лишь в случае потребности у заказчика в ещё большем количестве ускорителей — при таком сценарии предусмотрены отдельные слоты расширения для объединения нескольких платформ Delta Sprut XL в единый кластер», — отмечает компания. Питание обеспечивается посредством централизованного шинопровода OCP на 12 или 48 В. Применено встроенное ПО Delta BMC, предназначенное для мониторинга (сбор телеметрии, отслеживание состояния платформы, её модулей и компонентов) и удалённого администрирования серверного оборудования. Эта прошивка включена в реестр Минцифры РФ и сертифицирована ФСТЭК. |

|