Материалы по тегу: x

|

01.02.2026 [20:43], Руслан Авдеев

SpaceX попросила разрешение запустить 1 млн спутников для формирования космических ЦОД на сотни гигаваттSpaceX направила в Федеральную комиссию связи США (FCC) планы создания группировки, включающей до миллиона спутников, из которых будет сформирован орбитальный ЦОД, сообщает Datacenter Dynamics. Компания сообщает, что намерена организовать эксплуатацию группировки с «беспрецедентными» вычислительными мощностями для ИИ-моделей. Предполагается, что спутники заработают на высоте 500–2000 км, с наклонением от 30 ° до 97–98 ° (характерных для солнечно-синхронных орбит). Кластеры будут работать на расстоянии 50 км друг от друга. Действующая группировка Starlink размещена на высоте около 550 км, но в 2026 году высоту снизят до 480 км, чтобы быстрее сводить их с орбиты и уменьшить задержку. Пока запущено 9,5 тыс. спутников Starlink, из них в рабочем состоянии находятся около 8 тыс. В конечном счёте компания рассчитывает развернуть сеть из более 40 тыс. спутников, тогда как сейчас на орбите находятся примерно 14 тыс. аппаратов. Предлагаемая система орбитальных ЦОД SpaceX Orbital Data Center System будет подключена к Starlink с помощью широкополосной оптической связи, а с наземными станциями Starlink будет взаимодействовать с помощью лазерной сети. Современные модели спутников Starlink получили по три лазера и обеспечивают скорость передачи данных до 200 Гбит/с, следующее поколение будет поддерживать и 1 Тбит/с. После того, как Blue Origin анонсировала систему спутниковой связи TeraWave для наземных ЦОД со скоростью до 6 Тбит/с, Илон Маск (Elon Musk), заявил, что его лазерные решения для связи космоса с Землёй будут ещё эффективнее. Дополнительно спутники-ЦОД SpaceX будут использовать Ka-диапазон для телеметрии, отслеживания и управления.

Источник изображения: SpaceX Компания утверждает, что орбитальные ЦОД сегодня являются наиболее эффективным путём удовлетворения растущего спроса на вычислительные мощности для ИИ. Запуск группировки из миллиона аппаратов, способных работать, как орбитальные ЦОД — первый шаг к созданию «цивилизации II типа» по шкале Кардашёва, способной использовать все ресурсы Солнца. В то же время они смогут поддерживать работу ИИ-приложений для миллиардов людей уже сегодня. А в перспективе будут способствовать расселению человечества по многим планетам, говорит Маск. В зависимости от плоскости орбиты система сможет до 99 % времени полагаться на солнечную энергию. Наиболее полно освещённые орбиты предлагается использовать для постоянных вычислений, а орбиты с меньшим наклонением — для компенсации пиковых нагрузок. Охлаждение, естественно, исключительно путём излучения. Ожидаемый срок службы аппаратов составит пять лет. Впрочем, конкретные сроки запуска не называются. SpaceX попросила освободить её от требований FCC, обычно предполагающих, что половина группировки будет развёрнута в течение шести лет, а система полностью — за девять. Обязательным условием SpaceX называет готовность к коммерческой эксплуатации ракеты Starship — только она позволит снизить стоимость вывода аппаратов на орбиту и создавать спутники больших размеров, чем раньше. Ожидается, что после ввода многоразового Starship в эксплуатацию можно будет запускать «миллион тонн спутников в год» вычислительной мощностью до 100 кВт/т. Это позволит ежегодно добавлять 100 ГВт вычислительных мощностей для ИИ. А поскольку на космос не распространяются земные ограничения для ЦОД, уже через несколько лет вывод на орбиту станет самым дешёвым вариантом для их развёртывания. В 2025 году SpaceX утверждала, что начнёт запускать спутники третьего поколения в I полугодии 2026 года, для чего необходим полностью функционирующий корабль Starship. При этом компания часто нарушает собственные «дедлайны». SpaceX также планирует выйти в 2026 году на IPO при оценке капитализации не менее $1 трлн. По словам Маска, вырученные средства помогут покрыть расходы на проекты в области космических ЦОД. В то же время есть данные о том, что SpaceX рассматривает слияние с xAI. Также обсуждалось слияние и с другим детищем Маска — компанией Tesla.

Источник изображения: NASA/unsplash.com В 2025 году Starlink запросила разместить в космосе 22 тыс. Starlink нового поколения, но получила частичную лицензию — на 7,5 тыс. аппаратов. Текущая допустимая «вместимость» компании на орбите пока составляет 19,4 тыс. спутников. Хотя Китай и подал заявку в Международный союз электросвязи (ITU) заявку на создание двух группировок общей сложностью на 200 тыс. спутников, эксперты предполагают, что пока он просто резервирует орбитальные плоскости и спектр для будущих гигаваттных проектов. Предложение о выводе миллиона спутников — рекордное из числа дошедших до стадии подачи заявки. Планы развёртывания ЦОД в космосе имеют многие компании, включая Axiom Space, NTT, Ramon.Space, Aetherflux и Sophia Space, а Starcloud (ранее Lumen Orbit) уже вывела в космос микро-ЦОД на основе одного ИИ-ускорителя для тестов. Пор словам основателя Amazon и Blue Origin Джеффа Безоса (Jeff Bezos), через 10 с небольшим лет в космосе заработают гигаваттные ЦОД, а один из основателей Google Эрик Шмидт (Eric Schmidt) говорил, что купил компанию Relativity Space для вывода в космос собственных ЦОД. Google в конце 2025 года анонсировала Project Suncatcher, предусматривающий создание в космосе совместно с компанией Planet дата-центров на основе тензорных ускорителей самой Google. В теории вычислительные мощности можно масштабировать до тераватт. Если создатели Starship смогут добиться многоразового использования суперкорабля, а потом увеличат частоту запусков и будут снижать их стоимость, то к 2035 году, по прогнозам Google, космические ЦОД могут стать дешевле в эксплуатации, чем наземные благодаря «условно-бесплатному» электропитанию и охлаждению.

28.01.2026 [23:51], Владимир Мироненко

SK hynix создала на базе Solidigm американскую «дочку» для инвестиций в ИИ-решенияЮжнокорейская компания SK hynix объявила о создании в США новой компании, специализирующейся на решениях в сфере ИИ с предварительным названием AI Company (AI Co.). Новая компания будет сформирована путём реструктуризации Solidigm (SK hynix NAND Product Solutions Corp.), калифорнийской «дочки» SK hynix по производству SSD корпоративного класса, образованной в 2021 году в результате покупки NAND-бизнеса Intel за $9 млрд. При этом её бизнес-операции будут переданы новой дочерней компании, которая будет называться Solidigm Inc., «для обеспечения преемственности бренда». Новая структура призвана укрепить конкурентоспособность SK hynix в области технологий памяти для ИИ-платформ, включая высокоскоростную память (HBM). Компания заявила, что эта инициатива знаменует собой переход от традиционной роли производителя памяти к роли ключевого партнёра в решениях для ИИ ЦОД. Полученные в этой роли возможности будут объединены для создания синергии с дочерними компаниями и филиалами SK Group. SK hynix отметила, что благодаря своему бизнесу по производству SSD корпоративного класса, Solidigm уже является ключевым игроком в экосистеме ИИ ЦОД. Включение Solidigm в состав AI Company направлено на поиск возможностей для сотрудничества и развития бизнеса, которые могут создать синергию с различными направлениями бизнеса в ИИ-индустрии. Официальное название AI Company будет объявлено в феврале. Сначала будет сформирована временная управленческая команда и совет директоров, после чего запланирован переход к постоянной управленческой группе, состоящей из местных экспертов с глубокими знаниями рынка США. Для обеспечения первоначального финансирования SK hynix инвестирует в AI Company $10 млрд. Причём эта сумма будет структурирована как резерв на привлечение капитала, в рамках которого средства будут использоваться по запросу AI Co. для финансирования инвестиций. SK hynix планирует осуществлять через AI Co. стратегические инвестиции в ИИ-компании и расширять сотрудничество с американскими новаторами в сфере ИИ. SK hynix стремится укрепить своё лидерство в области производства памяти, одновременно развивая возможности решений по всей цепочке создания стоимости в ИИ ЦОД, поскольку растёт спрос на оптимизацию на системном уровне для решения проблем с узкими местами в передаче данных, отметил ресурс Korea IT Times. Первоначально SK hynix планирует сосредоточиться на ПО для оптимизации ИИ-систем, а затем постепенно расширять инвестиции в экосистему ИИ ЦОД. Недавно сообщалось о том, что SK hynix на три месяца ускорила график запуск завода по производству микросхем в южнокорейском Йонъине (Yongin), поскольку компания вкладывает большие деньги в освоение ИИ-волны. На поставках для ЦОД можно заработать ещё больше, поскольку, по крайней мере в краткосрочной перспективе, это создало дефицит памяти в потребительском секторе, отметил ресурс Hothardware. Также в этом месяце стало известно, что SK hynix инвестирует ₩19 трлн ($12,9 млрд) в строительство нового завода по упаковке и тестированию чипов для ИИ-технологий в Чхонджу (Cheongju). Планы по созданию нового предприятия в США также соответствуют политике США, стимулирующей размещение производства в стране с помощью регулирования пошлин на поставки извне. SK hynix уже строит в Индиане научно-исследовательский центр по производству современных микросхем и их упаковке стоимостью $3,87 млрд, о котором было объявлено ещё в 2024 году. Завод будет производить HBM для ИИ-ускорителей, начало его работы запланировано на 2028 год, пишет ресурс CNBC.

19.01.2026 [10:09], Сергей Карасёв

DeepX представила ИИ-ускорители DX-H1 V-NPU, DX-H1 Quattro и DX-M1 М.2Южнокорейский стартап Deepx, специализирующийся на разработке чипов для задач ИИ, анонсировал ускорители DX-H1 V-NPU, DX-H1 Quattro и DX-M1 М.2. В основу решений, которые демонстрировались на недавней выставке CES 2026 в Лас-Вегасе (Невада, США), положен нейропроцессорный узел Genesis NPU. Устройство DX-H1 V-NPU предназначено для выполнения операций, связанных с обработкой видеоматериалов: это может быть декодирование, кодирование, перекодирование и пр. Утверждается, что новинка обеспечивает снижение стоимости оборудования примерно на 80 % и сокращение энергопотребления на 85 % по сравнению с решениями на базе GPU при той же плотности каналов. Ускоритель выполнен в виде низкопрофильной карты расширения PCIe 3.0 x16 (x8 на уровне сигналов). Он оснащён двумя аппаратными видеокодеками и двумя NPU с общей производительностью до 50 TOPS (INT8) при инференсе в реальном времени. Возможно декодирование 64 каналов H.264/265 (1080р; 30 к/с) и кодирование 32 каналов H.264/265 (1080р; 30 к/с). Секция кодирования имеет доступ к 16 Гбайт памяти LPDDR5, секция NPU — к 8 Гбайт. Упомянуты интерфейс HDMI 2.0 и флеш-модуль eMMC вместимостью 32 Гбайт. Максимальное энергопотребление составляет 40 Вт. Решение DX-H1 Quattro, в свою очередь, оснащено четырьмя NPU с суммарной производительностью до 100 TOPS (INT8). В оснащение входят 16 Гбайт памяти LPDDR5. Ускоритель, выполненный в виде карты PCIe 3.0 x16, предназначены для выполнения ИИ-задач в дата-центрах и на периферии. Энергопотребление равно 20 Вт, диапазон рабочих температур простирается от -25 до +85 °C. Говорится о совместимости с Windows и различными вариантами Linux, включая Ubuntu. Изделие DX-M1 М.2 представляет собой ИИ-ускоритель в виде модуля М.2 2280, выполненный на чипе DX-M1. ИИ-производительность — до 25 TOPS, а энергопотребление не превышает 5 Вт. Используется интерфейс PCIe 3.0 x4. Говорится о возможности применения устройства в системах с архитектурой х86 и Arm. Диапазон рабочих температур — от -25 до +85 °C. Упомянута совместимость с Windows 11 и Ubuntu 22.04.

13.01.2026 [13:47], Сергей Карасёв

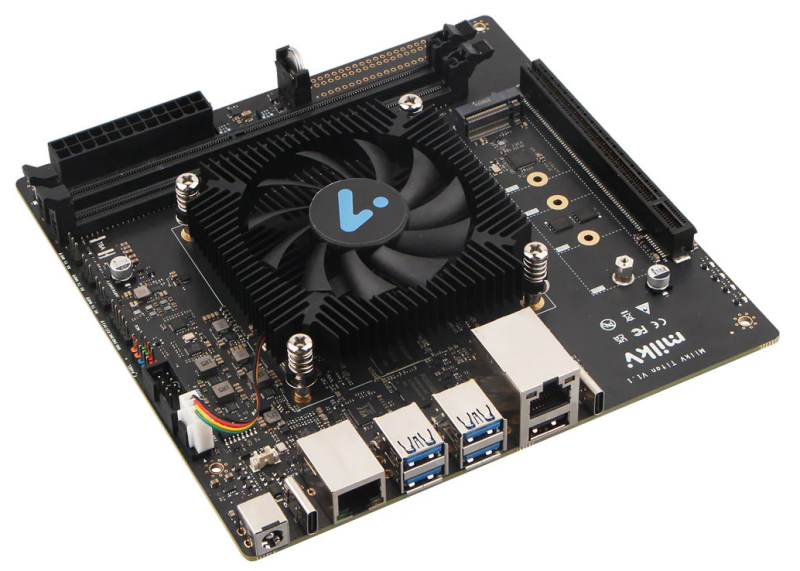

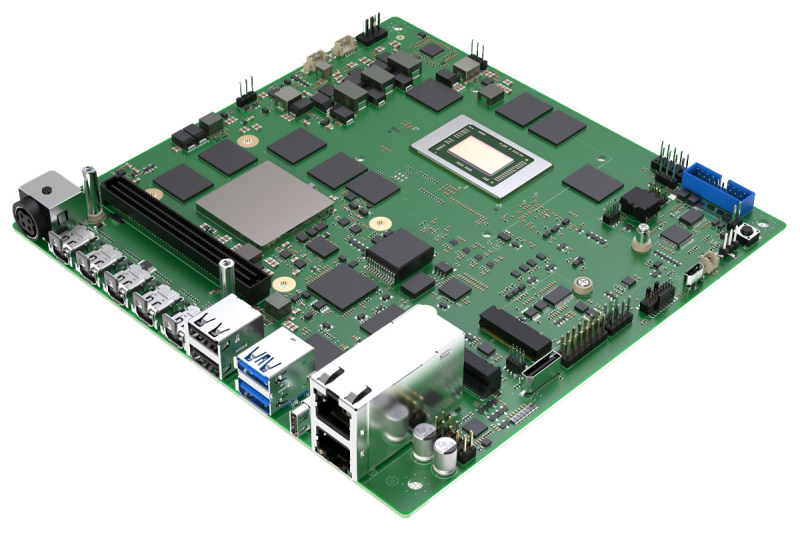

8 ядер RISC-V и слот PCIe 4.0 x16: вышла плата Milk-V Titan формата Mini-ITXКомпания Shenzhen MilkV Technology (Milk-V), по сообщению ресурса CNX Software, начала приём заказов на плату Milk-V Titan. Особенностью новинки является наличие полноценного слота PCIe 4.0 x16, в который может быть установлен дискретный графический ускоритель. Изделие выполнено в форм-факторе Mini-ITX с размерами 170 × 170 мм. Применён процессор UltraRISC UR-DP1000 с восемью ядрами UR-CP100 (RV64GCBHX) с архитектурой RISC-V, работающими на частоте до 2 ГГц. Говорится о поддержке аппаратной виртуализации и расширений RISC-V RV64 ISA H (v1.0), а также о полной совместимости со стандартом RVA22. Возможно подключение вентилятора охлаждения с ШИМ-управлением. Предусмотрены два слота для модулей оперативной памяти DDR4-3200 ECC суммарным объёмом до 64 Гбайт. Имеется коннектор M.2 M-Key для SSD с интерфейсом PCIe 4.0 x4 (NVMe). Плата получила сетевой порт 1GbE RJ45 и дополнительный порт управления 100MbE RJ45 (плюс разъёмы USB Type-C и USB 2.0 Type-A для BMC-накопителя). Есть четыре порта USB 3.0 Type-A и отладочный порт USB Type-C. Питание (12 В) подаётся через DC-коннектор 5,5/2,5 мм или разъём АТХ. Энергопотребление при полной нагрузке составляет около 30 Вт, в режиме простоя — приблизительно 14 Вт. У платы Milk-V Titan нет собственного видеовыхода, поэтому для подключения мониторов необходимо установить видеокарту: говорится, что новинка протестирована на работу с адаптерами AMD RX 9070 XT, RX 580, RX 550 и R5 230. Заявлена совместимость с Ubuntu, Debian и Fedora. Приобрести решение можно по ориентировочной цене $330.

13.01.2026 [09:03], Руслан Авдеев

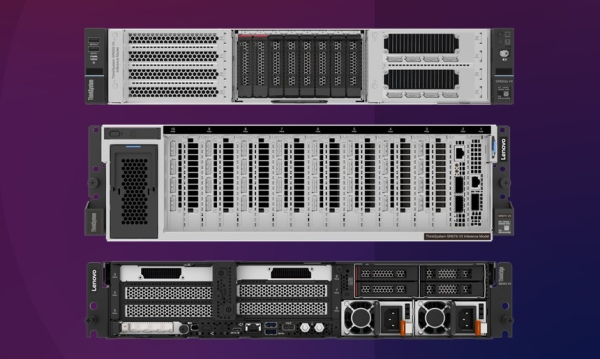

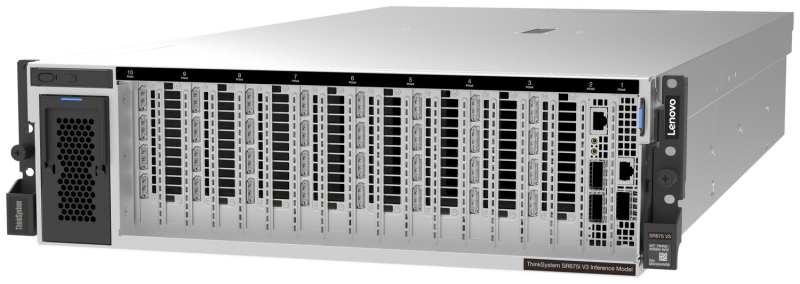

Lenovo представила серверы для ИИ-инференса: ThinkSystem SR675i V3/SR650i V4 и ThinkEdge ThinkEdge SE455i V4Lenovo представила новые серверные системы серии Lenovo Hybrid AI Advantage, оптимизированные для ИИ-инференса: ThinkSystem SR675i V3, ThinkSystem SR650i V4 и ThinkEdge SE455i V4. Если ранее акцент делался на решениях для обучения всё более производительных ИИ-моделей, то теперь бизнес обращает всё больше внимания на продукты для инференса. Новинки предлагаются параллельно с ПО для оптимизации инференса — для унификации и получения данных из разных источников для использования ИИ-моделями. Флагманской версией серии является ThinkSystem SR675i V3 в исполнении 3U на платформе AMD EPYC Turin 9535 (64C/128T, 2,4 ГГц, TDP 300 Вт). Сервер получил 1,5 Тбайт DDR5-6400 (24 × 64 Гбайт). За хранение данных отвечают до двух E3.S NVMe SSD по 3,84 Тбайт (PCIe 5.0 x4) и до двух M.2 NVMe SSD по 960 Гбайт (PCIe 4.0 x4). Возможна установка восьми ускорителей NVIDIA RTX PRO 6000 Blackwell Server Edition, а также пяти DPU NVIDIA BlueField-3 (4 × 400G, 1 × 200G). IPMI в данной модели не доступен. Для карт расширения доступно до шести слотов PCIe 5.0 х16 и один слот OCP 3.0 x8/x16. За питание отвечают четыре блока Titanium второго поколения (по 2300 Вт), а за охлаждение — пять вентиляторов. ThinkSystem SR650i V4 позиционируется в качестве системы для инференса и корпоративных рабочих нагрузок. Этот 2U-сервер получил два Intel Xeon Granite Rapids-SP 6530P (32C/64T, 2,3 ГГц, TDP 225 Вт), 512 Гбайт DDR5-6400 (8 × 64 Гбайт), два ускорителя RTX PRO 6000 Blackwell Server Edition. За хранение отвечают два 3,84-Тбайт U.2 NVMe SSD (PCIe 5.0 x4), хотя всего таких слотов восемь, а также RAID1-массив из пары 960-Гбайт M.2 SATA SSD. Всего доступно шесть слотов расширения PCIe 5.0 x16 и два слота OCP 3.0 x8/x16. Имеется двухпортовый 25GbE-адаптер Broadcom 57414 (SFP28). За питание отвечают два Titanium-блока мощностью 2700 Вт каждый, а за охлаждение шесть вентиляторов, но есть и опция установки фирменной СЖО Neptune. Наконец, Lenovo ThinkEdge SE455i V3 (2U) глубиной всего 440 мм представляет собой компактную модель, предназначенную для периферийного инференса — в ретейле, телекоммуникациях и промышленности. Сервер имеет защищённую конструкцию и может работать при температурах от -5 до +40 °C. Сервер построен на базе одного процессора AMD EPYC Embedded 8534P (64C/128T, 2,3 ГГц, TDP 200 Вт), дополненного 576 Гбайт DDR5-4800 (6 × 96 Гбайт) и двумя ускорителями NVIDIA L4 24 Гбайт (PCIe 4.0 x16). В комплекте идёт один 3,84-Тбайт NVMe SSD и один 960-Гбайт SATA SSD. Имеется два блока питания Platinum второго поколения с возможностью горячей замены. Для карт расширения есть до двух слотов PCIe 5.0 x16 и до четырёх слотов PCIe 4.0 x8, а также один слот OCP 3.0 (PCIe 5.0 x16). Установлен двухпортовый OCP-адаптер Broadcom 57416 (10GbE). IPMI отключён. Фактически компания предлагает готовые конфигурации, которые можно переконфигурировать лишь слегка, чаще всего добавив накопители и/или сетевые адаптеры. Платформы будут доступны в рамках подписки TruScale. Также компания анонсировала новые сервисы Hybrid AI Factory Services, в том числе консультации по инференсу, которые помогают развёртывать оборудование и управлять им для оптимизации ИИ-производительности.

12.01.2026 [14:41], Сергей Карасёв

ASRock Rack показала ИИ-сервер на базе NVIDIA HGX B300 с СЖО ZutaCore HyperCoolКомпания ASRock Rack на выставке CES 2026 продемонстрировала ИИ-сервер 4U16X-GNR2/ZC, первая информация о котором была раскрыта в октябре прошлого года. Новинка создана в партнёрстве с разработчиком систем жидкостного охлаждения ZutaCore. Устройство выполнено в форм-факторе 4U. Возможна установка двух процессоров Intel Xeon 6700E (Sierra Forest-SP) или Xeon 6500P/6700P (Granite Rapids-SP). Доступны 32 слота для модулей оперативной памяти DDR5, три разъёма PCIe 5.0 x16 для карт FHHL и два сетевых порта 1GbE на базе контроллера Intel I350-AM2. Задействована аппаратная платформа NVIDIA HGX B300. Для отвода тепла используется система прямого жидкостного охлаждения ZutaCore HyperCool. Это двухфазное решение основано на применении специальной диэлектрической жидкости, которая не вызывает коррозии. Утверждается, что конструкция HyperCool безопасна для IT-оборудования и гарантирует сохранение работоспособности даже в случае утечки. СЖО поставляется в полностью собранном виде, что сокращает время монтажа в стойку. Сервер 4U16X-GNR2/ZC оборудован 12 фронтальными отсеками для SFF-накопителей с интерфейсом PCIe 5.0 x4 (NVMe); допускается горячая замена. Кроме того, есть внутренний разъём для одного SSD типоразмера М.2 (PCIe 5.0 x2). За питание отвечают десять блоков мощностью 3000 Вт с сертификатом 80 Plus Titanium. Габариты машины составляют 900 × 448 × 175 мм. Отмечается, что в стандартной стойке 42U могут быть размещены до восьми подобных серверов, что обеспечивает высокую плотность вычислительной мощности для наиболее ресурсоёмких нагрузок ИИ.

12.01.2026 [12:59], Сергей Карасёв

Sapphire представила Mini-ITX-плату EDGE+VPR-7P132 с чипом AMD Ryzen AI Embedded P132 и FPGA Versal AI Edge Gen2 VE3558Компания Sapphire Technology анонсировала плату EDGE+VPR-7P132 на платформе AMD Embedded+, предназначенную для построения различных периферийных устройств с ИИ-функциями. В новинке соседствуют процессор AMD Ryzen AI Embedded и адаптивная «система на чипе» AMD Versal AI Edge Gen 2. Решение выполнено в форм-факторе Mini-ITX с размерами 170 × 170 мм. Задействовано FPGA-решение Versal AI Edge Gen 2 VE3558 с восемью ядрами Arm Cortex-A78AE, десятью ядрами реального времени Arm Cortex-R52, графическим блоком Arm Mali-G78AE. Программируемая часть содержит 492 тыс. логических ячеек и 225 тыс. LUT. Чип обеспечивает ИИ-производительность до 123 TOPS на операциях INT8. Есть 16 Гбайт памяти LPDDR5-4266, флеш-модуль UFS 3.1 вместимостью 256 Гбайт, интерфейс Mini DisplayPort, а также модуль TPM 2.0 (Infineon OPTIGA TPM SLM 9672) и 250-контактный коннектор для плат расширения. CPU-секция получила процессор Ryzen AI Embedded P132 (V4526iX), который объединяет шесть ядер с архитектурой Zen 5 (12 потоков) с тактовой частотой до 4,5 ГГц, графический ускоритель AMD Radeon (RDNA 3.5) и нейропроцессорный блок с ИИ-производительностью до 50 TOPS в режиме INT8. Чип функционирует в тандеме с 64 Гбайт памяти LPDDR5-4266 (впаяна на плату). Предусмотрены коннектор M.2 Key M 2280 для SSD (PCIe 4.0 x4), слот M.2 Key E 2230 (PCIe 4.0 x1, I2S, USB 2.0) для адаптера Wi-Fi/Bluetooth и разъём OCulink x4. Плата получила два сетевых порта 10GbE, по два порта USB 3.2 Gen 2 Type-A и USB 2.0 Type-A, коннектор USB4 Type-C, четыре интерфейса Mini DisplayPort. Через внутренние разъёмы можно использовать аудиоинтерфейсы. Питание (12 В) подаётся через DC-коннектор. Диапазон рабочих температур простирается от 0 до +60 °C. Заявлена совместимость с RHEL/CentOS 7.9, RHEL 8.2-8.6 и Ubuntu 22.04. В качестве платы расширения упомянут модуль с поддержкой 12 камер для автомобильных систем и робототехники.

06.01.2026 [14:28], Владимир Мироненко

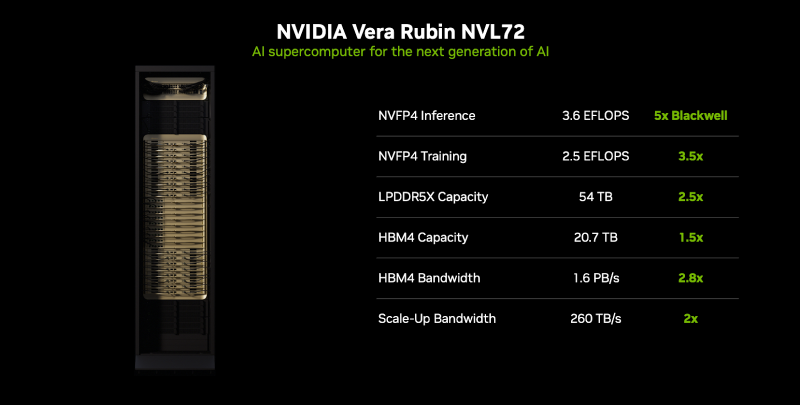

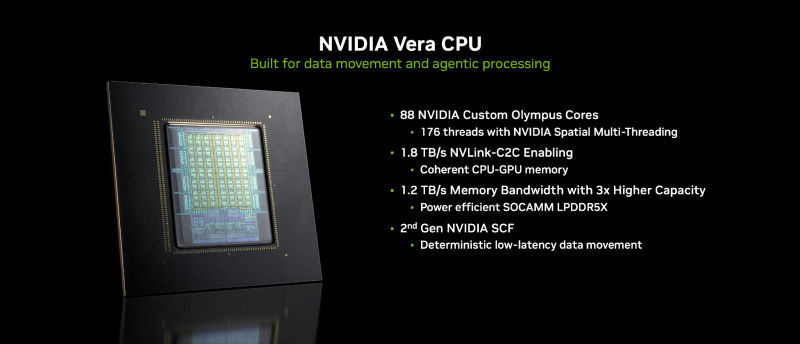

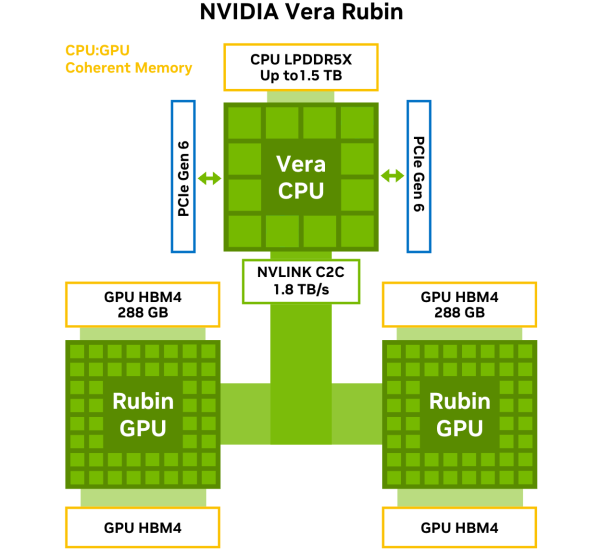

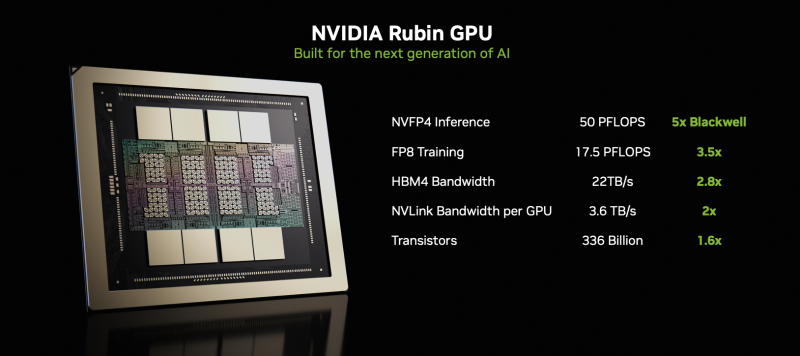

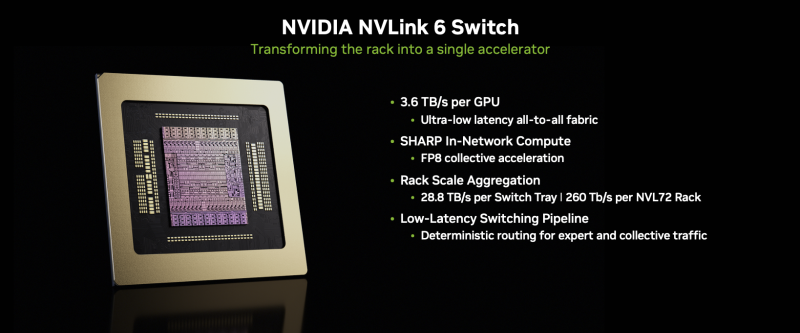

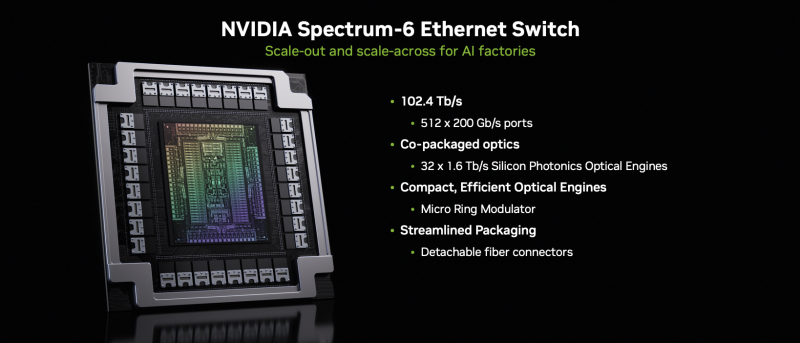

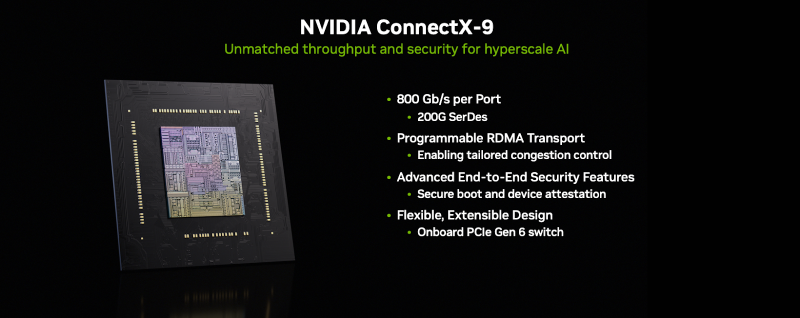

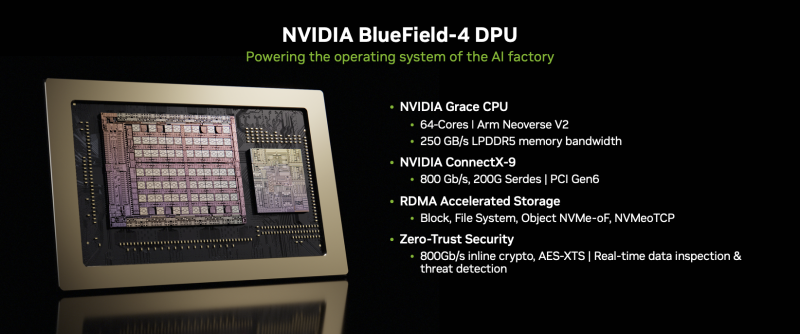

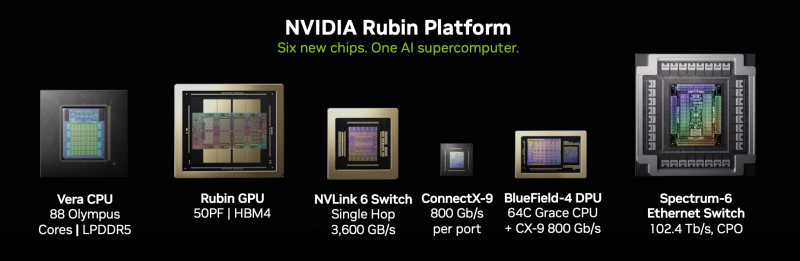

NVIDIA объявила о запуске платформы Vera Rubin NVL72NVIDIA объявила о запуске платформы следующего поколения Rubin, которая приходит на смену Blackwell Ultra. Компания отметила, что платформа Rubin объединяет сразу пять инноваций, включая новейшие поколения интерконнекта NVIDIA NVLink, Transformer Engine, Confidential Computing и RAS Engine, а также процессор NVIDIA Vera. Примечательно, что NVIDIA снова решила вернуться к именованию на основе количества суперчипов (NVL72), а не ускорителей (NVL144), как обещала в прошлом году. Созданная с использованием экстремального совместного проектирования на аппаратном и программном уровнях, NVIDIA Vera Rubin обеспечивает десятикратное снижение стоимости токенов для инференса и четырёхкратное сокращение количества ускорителей для обучения моделей MoE по сравнению с платформой NVIDIA Blackwell. Коммутационные системы NVIDIA Spectrum-X Ethernet Photonics обеспечивают пятикратное повышение энергоэффективности и времени безотказной работы. Платформа Rubin построена на шести чипах — Arm-процессоре Vera, ускорителе Rubin, коммутаторе NVLink 6, адаптере ConnectX-9 SuperNIC, DPU BlueField-4 и Ethernet-коммутаторе NVIDIA Spectrum-6. Ускорители Rubin поначалу будут доступны в двух форматах. В первом случае — в составе стоечной платформы DGX Vera Rubin NVL72, которая объединяет 72 ускорителя Rubin и 36 процессоров Vera, NVLink 6, ConnectX-9 SuperNIC и BlueField-4. Также ускорители Rubin будут доступны в составе платформы DGX/HGX Rubin NVL8 на базе x86-процессоров. Обе платформы будут поддерживаться кластерами NVIDIA DGX SuperPod, сообщил ресурс CRN. Как отметила NVIDIA, разработанный для агентного мышления, процессор NVIDIA Vera является самым энергоэффективным процессором для крупномасштабных ИИ-фабрик. Он оснащён 88 кастомными Armv9.2-ядрами Olympus с 176 потоками с новой технологией пространственной многопоточности NVIDIA, 1,5 Тбайт системной памяти SOCAMM LPDDR5x (1,2 Тбайт/с), возможностями конфиденциальных вычислений и быстрым интерконнектом NVLink-C2C (1,8 Тбайт/с в дуплексе). NVIDIA Rubin с аппаратным адаптивным сжатием данных обеспечивает до 50 Пфлопс (NVFP4) для инференса, что в пять раз быстрее, чем Blackwell. Он также обеспечивает до 35 Пфлопс (NVFP4) в режиме, что в 3,5 раза быстрее, чем его предшественник. Пропускная способность 288 Гбайт HBM4 составляет 22 Тбайт/с, что в 2,8 раза быстрее предшественника, а пропускная способность NVLink на один ускоритель вдвое выше — 3,6 Тбайт/с (в дуплексе). NVIDIA также сообщила, что Vera Rubin NVL72 обладает 54 Тбайт памяти LPDDR5x, что в 2,5 раза больше, чем у Blackwell, и 20,7 Тбайт памяти HBM4, что на 50 % больше, чем у предшественника. Агрегированная пропускная способность HBM4 достигает 1,6 Пбайт/с, что в 2,8 раза больше, а скорость интерконнекта составляет 260 Тбайт/с, что вдвое больше, чем у платформы Blackwell NVL72, и «больше, чем пропускная способность всего интернета». Ожидаемый уровень энергопотребления составит от 190 до 230 кВт на стойку. Компания отметила, что Vera Rubin NVL72 — первая стоечная платформа, обеспечивающая конфиденциальные вычисления, которая поддерживает безопасность данных на уровне доменов CPU, GPU и NVLink. Коммутатор NVLink 6 с жидкостным охлаждением оснащён 400G-блоками SerDes, обеспечивает пропускную способность 3,6 Тбайт/с на каждый GPU для связи между всеми GPU, общую пропускную способность 28,8 Тбайт/с и 14,4 Тфлопс внутрисетевых вычислений в формате FP8. Хотя NVIDIA заявила, что Rubin находится в «полномасштабном производстве», аналогичные продукты от партнёров появятся только во II половине этого года. Среди ведущих мировых ИИ-лабораторий, поставщиков облачных услуг, производителей компьютеров и стартапов, которые, как ожидается, внедрят Rubin, компания назвала Amazon Web Services (AWS), Anthropic, Black Forest Labs, Cisco, Cohere, CoreWeave, Cursor, Dell Technologies, Google, Harvey, HPE, Lambda, Lenovo, Meta✴, Microsoft, Mistral AI, Nebius, Nscale, OpenAI, OpenEvidence, Oracle Cloud Infrastructure (OCI), Perplexity, Runway, Supermicro, Thinking Machines Lab и xAI. ИИ-лаборатории, включая Anthropic, Black Forest, Cohere, Cursor, Harvey, Meta✴, Mistral AI, OpenAI, OpenEvidence, Perplexity, Runway, Thinking Machines Lab и xAI, рассматривают платформу NVIDIA Rubin для обучения более крупных и мощных моделей, а также для обслуживания мультимодальных систем с длинным контекстом с меньшей задержкой и стоимостью по сравнению предыдущими поколениями ускорителей. Партнёры по инфраструктурному ПО и хранению данных AIC, Canonical, Cloudian, DDN, Dell, HPE, Hitachi Vantara, IBM, NetApp, Nutanix, Pure Storage, Supermicro, SUSE, VAST Data и WEKA работают с NVIDIA над разработкой платформ следующего поколения для инфраструктуры Rubin. В связи с тем, что рабочие нагрузки агентного ИИ генерируют огромные объёмы контекстных данных, NVIDIA также представляла новую платформу хранения контекста инференса NVIDIA Inference Context Memory Storage Platform — новый класс инфраструктуры хранения, разработанной для масштабирования контекста инференса. Сообщается, что платформа, работающая на базе BlueField-4, обеспечивает эффективное совместное использование и повторное применение данных KV-кеша в рамках всей ИИ-инфраструктуры, повышая скорость отклика и пропускную способность, а также обеспечивая предсказуемое и энергоэффективное масштабирование агентного ИИ. Дион Харрис (Dion Harris), старший директор NVIDIA по высокопроизводительным вычислениям и решениям для ИИ-инфраструктуры, сообщил, что по сравнению с традиционными сетевыми хранилищами для данных контекста инференса, новая платформа обеспечивает до пяти раз больше токенов в секунду, в пять раз лучшую производительность на доллар и в пять раз лучшую энергоэффективность.

25.12.2025 [22:52], Сергей Карасёв

Это вам не игрушки: Linux-планировщик, разработанный для Valve Steam Deck, оказался хорош и для серверов Meta✴Компания Meta✴, по сообщению ресурса Phoronix, использует на своих серверах планировщик задач Linux, который изначально был разработан для портативной игровой консоли Valve Steam Deck. Об этом инженеры гиперскейлера рассказали на мероприятии Linux Plumbers Conference в Токио. Речь идёт о решении SCX-LAVD, созданием которого по контракту с Valve занималась фирма Igalia, специализирующейся на Linux. Ранее планировщик SCX-LAVD уже применялся в различных проектах по разработке игрового софта для Linux, включая CachyOS Handheld Edition, Bazzite и др. Оказалось, что SCX-LAVD эффективно работает не только на портативных устройствах, но и на полноценных серверах. В Meta✴ рассматривали это решение в качестве «планировщика по умолчанию» для Linux-серверов с различным аппаратным оснащением и в разных сценариях использования, при которых не требуется специализированный планировщик. Специалисты Meta✴ пришли к выводу, что SCX-LAVD хорошо функционирует на серверах при наращивании ресурсов CPU и RAM. При этом обеспечивается необходимая балансировка нагрузки.

Источник изображения: Meta✴ В целом, как подчеркивается, SCX-LAVD демонстрирует производительность, аналогичную или даже превосходящую показатели EEVDF (Earliest Eligible Virtual Deadline First) — нового алгоритма планирования задач в ядре Linux, который заменяет старый планировщик CFS (Completely Fair Scheduler).

25.12.2025 [09:23], Владимир Мироненко

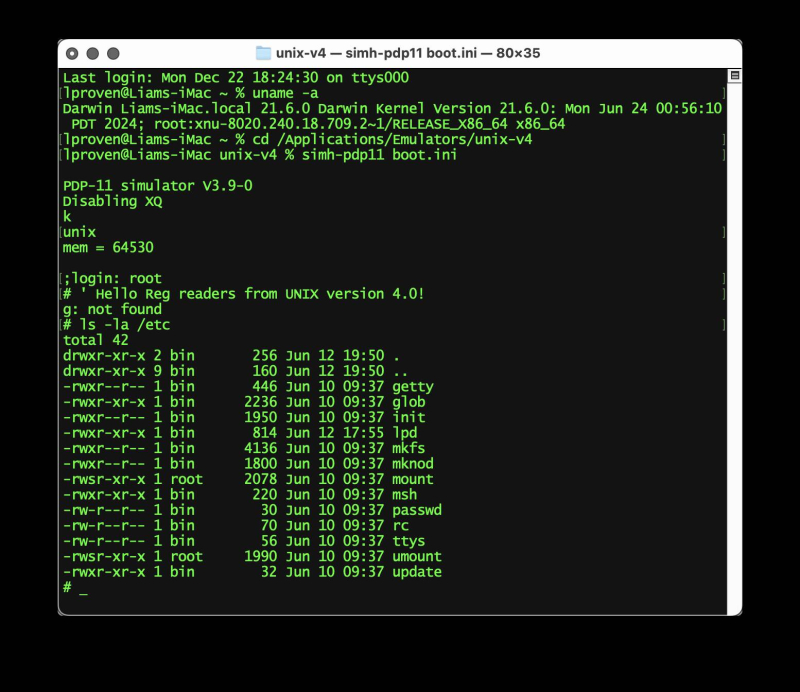

Считавшаяся утерянной легендарная ОС UNIX V4 по случайности была найдена в архивах, восстановлена и запущена полвека спустяПрофессору Роберту Риччи (Robert Ricci) из Школы вычислительной техники Калерта при Университете Юты (Kahlert School of Computing) удалось восстановить хранившуюся на ленточном накопителе выпуска 1970-х годов UNIX V4, первую в истории версию операционной системы UNIX, ядро которой было написано на новом на тот момент языке программирования C. Как сообщает ресурс The Register, её можно скачать с Internet Archive и запустить в SimH. Для восстановления данных Риччи воспользовался программой readtape, разработанной Леном Шустеком (Len Shustek) из Музея компьютерной истории (Computer History Museum). Как и более известный инструмент Greaseweazle для архивирования старых дискет эта программа вместо того, чтобы пытаться скопировать байты или секторы с носителя — другими словами, обработанные цифровые данные — напрямую работает с магнитным слоем накопителя, что делает возможным исправление некоторых ошибок. В данном случае только два блока не считывались должным образом, но и собранных данных оказалось достаточно для восстановления их содержимого. На Internet Archive хранится «сырой» образ размером 1,6 Гбайт, хотя сама лента имеет ёмкость 40 Мбайт. Анджело Папенхофф (Angelo Papenhoff) предложил более компактную версию, дополненную файлом README с объяснением, как её запустить. Восстановленные данные содержат всего лишь около 55 тыс. строк кода Version 4 Unix, из которых около 25 тыс. строк написаны на C, и менее тысячи строк комментариев. По-настоящему Unix начала разрастаться с седьмым изданием — Unix V7. Она стала вирусной, а её преемники, форки и переписанные версии были широко приняты в индустрии и академических кругах. |

|