Материалы по тегу: 400gbe

|

25.03.2026 [11:46], Сергей Карасёв

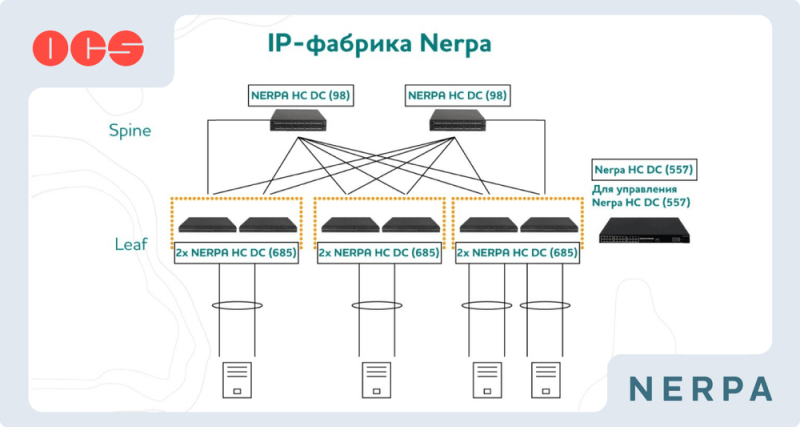

Nerpa разработала новую IP-фабрику для ЦОД и облаковРоссийский IT-бренд Nerpa, созданный в 2020 году компанией OCS Distribution, анонсировал новую IP-фабрику — современную архитектуру для построения высокопроизводительных сетей в дата-центрах и облачных инфраструктурах. Она позволяет объединять различные устройства, серверы и СХД в единую производительную экосистему. В основу решения положена архитектура Clos — многоступенчатая топология сети, разработанная для обеспечения высокой пропускной способности без блокировок. Подчёркивается, что в отличие от традиционной трёхуровневой схемы «ядро — агрегация — доступ», такая модель обеспечивает равномерное распределение нагрузки и устойчивую работу сети даже при росте трафика и масштабировании инфраструктуры. В состав IP-фабрики входят коммутаторы Nerpa HC DC (98), HC DC (685) и HC DC (557). Две первые модели спроектированы для работы в дата-центрах и облачных инфраструктурах. В свою очередь, изделие HC DC (557) играет роль управляющего элемента фабрики. Устройство на базе ASIC поддерживает двухстековое управление, статическую маршрутизацию и расширенные функции безопасности. Все коммутаторы оснащены uplink-портами с пропускной способностью до 400 Гбит/с. Разработчик отмечает, что IP-фабрика упрощает управление адресацией, позволяет гибко сегментировать трафик и ускоряет развёртывание виртуальных сервисов. Говорится о совместимости с серверами Nerpa, оснащёнными Ethernet-адаптерами. Упомянута поддержка протоколов VXLAN, EVPN и MLAG. На IP-фабрику Nerpa предоставляется гарантия сроком 1 год с возможностью расширения до 3 лет. Среди потенциальных заказчиков названы операторы связи, облачные провайдеры, владельцы корпоративных ЦОД и интеграторы, реализующие проекты по строительству дата-центров, говорит компания.

16.03.2026 [00:10], Владимир Мироненко

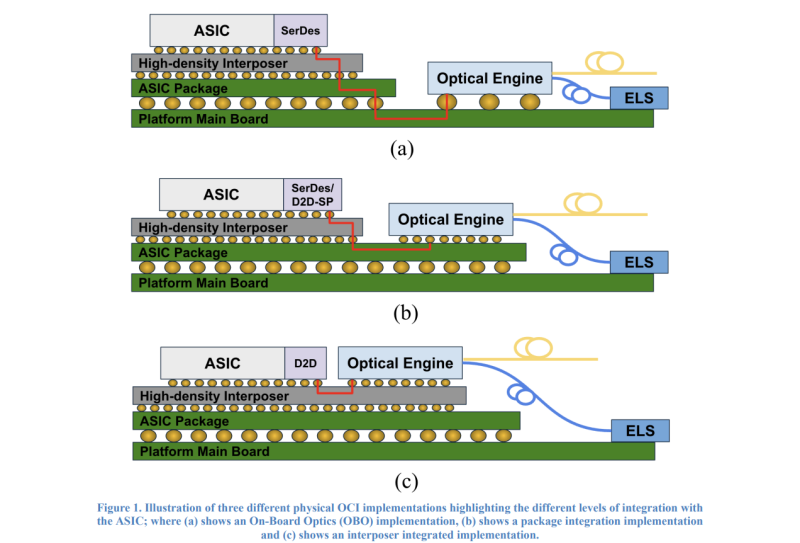

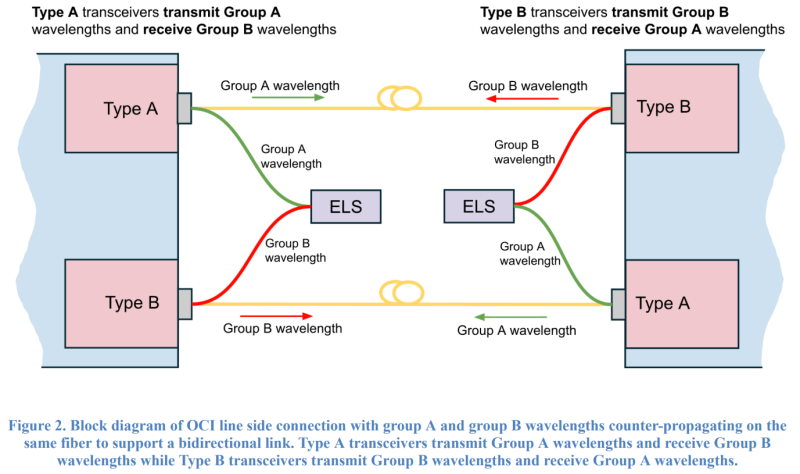

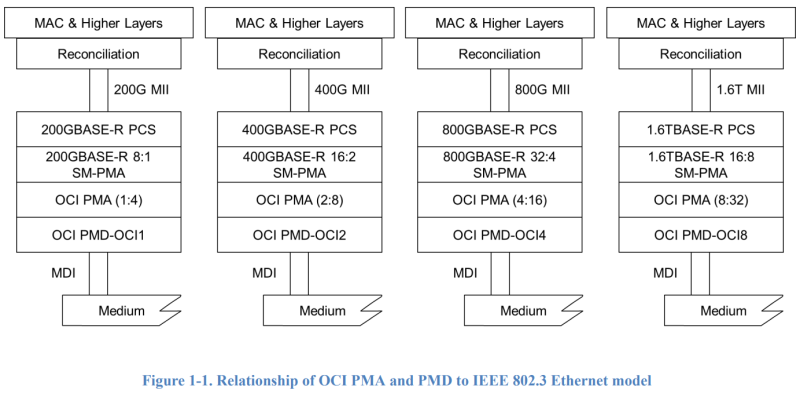

Гиперскейлеры и разработчики чипов создали консорциум OCI MSA для внедрения масштабируемого оптического интерконнекта для ИИГруппа компаний, включая AMD, Broadcom, Meta✴, Microsoft, NVIDIA и OpenAI, объявила о создании отраслевого консорциума OCI (Optical Compute Interconnect) Multi-Source Agreement (MSA) с целью формирования открытой экосистемы, управляемой гиперскейлерами, для обеспечения развития многовендорной цепочки поставок для масштабируемых оптических интерконнектов, отвечающих потребностям современной ИИ-инфраструктуры. Компании отметили, что по мере совершенствования LLM традиционные медные интерконнекты достигают физических пределов с точки зрения пропускной способности, энергоэффективности и дальности. Оптические соединения позволяют передавать данные на большие расстояния, сохраняя при этом более предсказуемое энергопотребление. Поэтому многие компании рассматривают их как решение для расширения ИИ-инфраструктуры. До сих пор в отрасли отсутствовал единый стандарт для реализации оптических каналов связи в крупномасштабных ИИ-системах. Спецификация OCI разработана с учетом оптимизации энергопотребления, задержки и стоимости. Она основана на NRZ-модуляции с WDM-мультиплексированием. Кроме того, она отражает смещение фокуса подключения с «модульно-ориентированной» к «кремниево-ориентированной» модели. Благодаря более тесной интеграции оптики с вычислительными и сетевыми компонентами, OCI обеспечивает значительное увеличение плотности полосы пропускания и масштабируемости системы, обеспечивая энергопотребление на уровне медных линий связи. Как сообщает консорциум, открытая и совместимая спецификация позволяет гиперскейлерам дезагрегировать любые XPU и коммутаторы на основе общего оптического физического уровня (PHY), обеспечивая соответствие лучших в своём классе вычислительных мощностей самым современным оптическим решениям. Консорциум опубликовал первоначальную спецификацию оптического интерфейса 200G, разработанного для масштабных сетей ИИ:

В спецификации также подробно описаны требования к мощности сигнала, чувствительности приеъёмника, устойчивости к шуму и коррекции ошибок для поддержания стабильности сигнала на экстремальных скоростях. Стандартизированный подход и совместный план развития значительно снижают риски интеграции, сокращают циклы разработки и обеспечат всей цепочке поставок стоек для ИИ чёткий, безопасный путь для развёртывания многопоколенных оптических межсоединений от разных производителей. Как отметил ресурс The Technology Express, консорциум выделяется тем, что объединяет компании, выступающие конкурентами в разработке аппаратного обеспечения для ИИ. Например, собственная разработка NVLink одной компании доминирует в высокопроизводительных кластерах GPU. В то же время другие игроки отрасли поддерживают конкурирующий открытый стандарт UALink. Однако протокол OCI MSA фокусируется на PHY, а не на протоколах. Поэтому он потенциально может поддерживать трафик NVLink и UALink по оптическому волокну вместо медных кабелей.

18.01.2026 [13:05], Сергей Карасёв

Компактный коммутатор MikroTik CRS804 DDQ для ИИ-платформ получил четыре порта 400GbEКомпания MikroTik расширила ассортимент коммутаторов, анонсировав компактную модель CRS804 DDQ, ориентированную на сравнительно небольшие по масштабу инфраструктуры ИИ. Новинка выполнена в форм-факторе 1U половинной ширины, благодаря чему в серверной стойке бок о бок могут размещаться два устройства. L3-коммутатор CRS804 DDQ построен на чипе Marvell 98DX7335, который функционирует в тандеме с четырёхъядерным Arm-процессором Annapurna Labs AL52400 с тактовой частотой до 2 ГГц. Объём оперативной памяти составляет 4 Гбайт. Предусмотрено 512 Мбайт флеш-памяти NAND. В качестве программной платформы применяется RouterOS v7. Во фронтальной части расположены четыре порта QSFP56-DD с пропускной способностью 400 Гбит/с каждый. Кроме того, есть два порта 10GbE (RJ45) и консольный порт RJ45. Установлены два вентилятора и два блока питания (100–240 В) с возможностью горячей замены. Максимальное заявленное энергопотребление — 123 Вт. Диапазон рабочих температур простирается от -10 до +60 °C. Величина MTBF (средняя наработка на отказ) достигает примерно 200 тыс. часов при температуре +25 °C. Коммутатор, как утверждается, обеспечивает стабильную работу в условиях интенсивных сетевых нагрузок. Реализованы инструменты мониторинга напряжения, а также температуры процессора и основной платы. Решение имеет класс защиты IP20. В комплект поставки входит монтажный набор RMK-2x10/19, позволяющий установить два коммутатора в один слот 1U стандартной 19″ серверной стойки. Коммутатор MikroTik CRS804 DDQ предлагается по ориентировочной цене $1300.

12.12.2025 [12:44], Сергей Карасёв

Чипы-коммутаторы Xsight Labs X2 пропишутся в спутниках SpaceX Starlink V3Компания Xsight Labs объявила о том, что её программируемые чипы-коммутаторы X2 будут использоваться в составе космических аппаратов SpaceX Starlink V3, предназначенных для организации высокоскоростного спутникового интернет-доступа в глобальном масштабе. Изделия Xsight X2 изготавливаются по техпроцессу TSMC N5. Они обеспечивают пропускную способность до 12,8 Тбит/с. Возможно использование до 128 портов; поддерживаются режимы 100GbE, 200GbE и 400GbE. Заявленное энергопотребление составляет менее 200 Вт. Задержка при работе на скорости 100GbE — менее 700 нс. Чипы выполнены в корпусе с размерами 55 × 55 мм. Каждый спутник Starlink V3 обеспечивает пропускную способность канала связи свыше 1 Тбит/с, что более чем в 10 раз превышает показатель Starlink V2. При этом скорость передачи данных по восходящему каналу составляет около 160 Гбит/с. Решения Xsight X2 помогут в обеспечении надёжной связи при больших нагрузках. Отмечается, что работа глобальной инфраструктуры Starlink зависит от передачи больших объёмов данных в реальном времени, включая трафик, передаваемый по оптическим каналам между спутниками. При этом задействованы технологии адаптивного управления лучом. В такой ситуации полностью программируемая архитектура чипа Xsight X2 позволяет динамически адаптироваться к меняющимся требованиям орбитальных линий связи, обеспечивая оптимальную производительность в различных условиях. В результате, для конечных потребителей услуг обеспечивается скорость интернет-доступа, сопоставимая с оптическими каналами. Утверждается, что изделия Xsight X2 прошли комплексные испытания на соответствие требованиям, предъявляемым к компонентам для работы в экстремальных условиях космического пространства. Речь идет об устойчивости к вибрации, радиации, низким температурам и пр.

05.12.2025 [12:15], Сергей Карасёв

HPE представила 102,4-Тбит/с коммутатор Juniper Networking QFX5250 с СЖОКомпания HPE анонсировала производительный коммутатор Juniper Networking QFX5250, ориентированный на ИИ-инфраструктуры следующего поколения. В устройстве применяется технология прямого жидкостного охлаждения Direct-To-Chip (DTC), благодаря чему достигается высокая энергоэффективность. В основу решения положен чип Broadcom Tomahawk 6, который поддерживает коммутационную способность до 102,4 Тбит/с. Возможны следующие конфигурации портов: 64 × 1,6 Тбитс, 128 × 800 Гбит/с, 256 × 400 Гбит/с, 512 × 200 Гбит/с, 512 × 100 Гбит/с и 512 × 50 Гбит/с. Новинка выполнена в форм-факторе 2U с габаритами 92,7 × 537 × 805 мм, а масса составляет 48 кг. Коммутатор может монтироваться в 21″ серверную стойку стандарта ORv3. Применена программная платформа Junos OS, оптимизированная для задач ИИ. Эта ОС, как утверждается, обеспечивает максимальную производительность с улучшенными функциями контроля, управления и предотвращения перегрузок. Кроме того, доступен набор API для автоматизации с помощью Terraform и Ansible. Кроме того, HPE объявила о выходе маршрутизатора Juniper Networking MX301 для ИИ-систем. Это устройство, рассчитанное на использование на периферии, обеспечивает пропускную способность до 1,6 Тбит/с. Решение предлагает 16 портов 1/10/25/50GbE, 10 портов 100GbE и 4 порта 400 GbE. Форм-фактор — 1U с размерами 440 × 450 × 44,5 мм. Применено воздушное охлаждение. Маршрутизатор Juniper Networking MX301 уже доступен для заказа. Коммутатор Juniper Networking QFX5250 поступит в продажу в I квартале наступающего года.

14.11.2025 [09:36], Сергей Карасёв

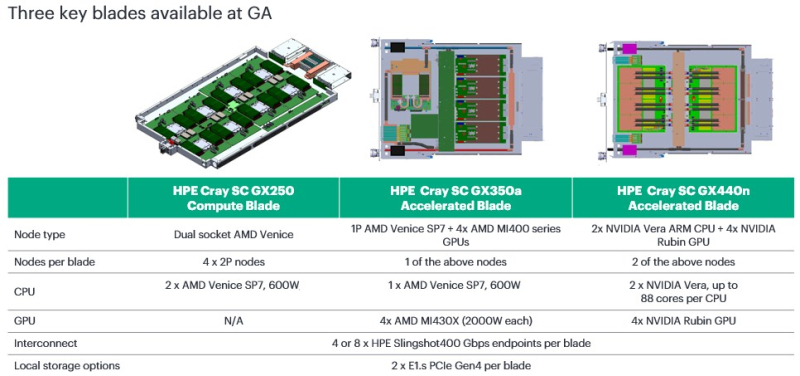

HPE представила CPU- и GPU-узлы суперкомпьютерной платформы Cray Supercomputing GX5000Компания HPE анонсировала новые решения для НРС-задач, являющиеся частью суперкомпьютерной платформы Cray Supercomputing GX5000. В частности, дебютировали узлы GX250 Compute Blade, GX350a Accelerated Blade и GX440n Accelerated Blade, а также высокопроизводительная СХД Storage Systems K3000. Устройство HPE Cray Supercomputing GX250 Compute Blade представляет собой CPU-сервер, оснащённый восемью процессорами AMD EPYC Venice (появятся во II половине 2026 года). В одной стойке могут быть размещены до 40 таких серверов, что обеспечивает самую высокую в отрасли плотность компоновки x86-ядер следующего поколения, говорит компания. В паре с CPU-узлами могут функционировать новые GPU-модули. Так, изделие HPE Cray Supercomputing GX350a Accelerated Blade несёт на борту один чип AMD EPYC Venice и четыре ускорителя AMD Instinct MI430X. В стойку могут устанавливаться до 28 таких серверов, что даёт в сумме 112 ускорителей MI430X. В свою очередь, HPE Cray Supercomputing GX440n Accelerated Blade содержит четыре NVIDIA Vera CPU и восемь NVIDIA Rubin GPU. Допускается монтаж до 24 подобных серверов на стойку, что обеспечивает 192 ускорителя Rubin. Все новинки оборудованы жидкостным охлаждением. СХД HPE Cray Supercomputing Storage Systems K3000 выполнена на сервере HPE ProLiant Compute DL360 Gen12. Могут устанавливаться 8, 12, 16 или 20 накопителей NVMe вместимостью 3,84, 7,68 или 15,36 Тбайт каждый. Объём памяти DRAM — 512 Гбайт, 1 или 2 Тбайт. Применяется платформа DAOS, разработанная для требовательных рабочих нагрузок, таких как анализ данных и машинное обучение. Поддерживаются технологии HPE Slingshot 200, HPE Slingshot 400, InfiniBand NDR и 400GbE. Кроме того, HPE сообщила о том, что для платформы HPE Cray Supercomputing GX5000 доступен интерконнект HPE Slingshot 400. Соответствующие коммутаторы с прямым жидкостным охлаждением наделены 64 портами на 400 Гбит/с. Возможны конфигурации с 8, 16 и 32 коммутаторами, что в сумме позволяет использовать до 512, 1024 и 2048 портов соответственно. О выборе платформы HPE Cray Supercomputing GX5000 для НРС-комплексов нового поколения уже объявили Центр высокопроизводительных вычислений Штутгартского университета (HLRS) и Центр суперкомпьютеров имени Лейбница (LRZ) Баварской академии естественных и гуманитарных наук (BADW). Кроме того, новая платформа является основой суперкомпьютера Discovery Министерства энергетики США (DOE).

30.09.2025 [10:26], Сергей Карасёв

MikroTik выпустила коммутатор CRS812 DDQ с поддержкой 400GbEКомпания MikroTik начала продажи коммутатора CRS812 DDQ (модель CRS812-8DS-2DQ-2DDQ-RM), поддерживающего стандарт 400GbE. Новинка, выполненная в форм-факторе 1U, доступна для заказа по ориентировочной цене $1300. В устройстве задействованы коммутационный чип Marvell 98DX7335 и процессор Annapurna Labs AL52400, который содержит четыре вычислительных Arm-ядра с тактовой частотой до 2 ГГц. Объём оперативной памяти DDR4 составляет 4 Гбайт, вместимость встроенного флеш-модуля — 512 Мбайт. Коммутатор оборудован двумя портами 400G QSFP56-DD и двумя разъёмами 200G QSFP56, восемью портами 50G SFP56, а также двумя портами 1/2.5/5/10GbE RJ45. Кроме того, имеется консольный порт RJ45. Все гнёзда для подключения сетевых кабелей сосредоточены на фронтальной панели. Габариты новинки составляют 443 × 268 × 44 мм. Установлены два блока питания и четыре вентиляторных модуля с возможностью горячей замены. Максимальное заявленное энергопотребление — 134 Вт. Диапазон рабочих температур простирается от -10 до +50 °C. Показатель MTBF (средняя наработка на отказ) достигает 200 тыс. часов при температуре 25 °C. На коммутаторе применяется программная платформа RouterOS v7. В комплект поставки входят кабели питания и крепёж для монтажа в серверную стойку. Дополнительно можно приобрести оптический трансивер DDQ+85MP01D стандарта 400G стоимостью около $160, также кабели DDQ+DA0001 и DDQ+DA0003 длиной 1 и 3 м соответственно по цене примерно $80 и $110.

09.09.2025 [15:46], Сергей Карасёв

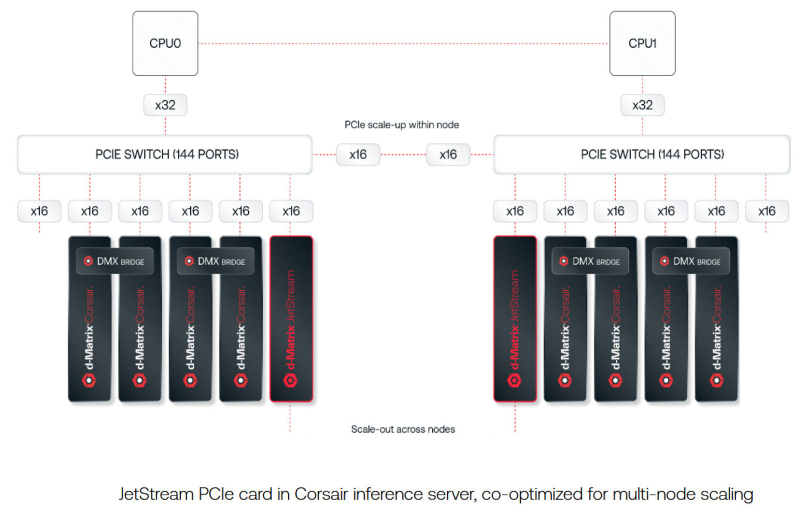

d-Matrix представила 400GbE-адаптер JetStream для объединения своих ИИ-ускорителейСтартап d-Matrix анонсировал специализированную IO-карту JetStream, предназначенную для распределения нагрузок ИИ-инференса между серверами в дата-центре. Устройство ориентировано на использование в связке с ускорителями d-Matrix Corsair, архитектура которых основана на модифицированных ячейках SRAM для вычислений в памяти (DIMC). JetStream использует стандарт Ethernet, благодаря чему обладает совместимостью с уже существующими коммутаторами. Новинка выполнена в виде платы расширения с интерфейсом PCIe 5.0 х16. Используются корзины QSFP-DD. Могут быть задействованы два 200GbE-порта со скоростью 200 Гбит/с или один 400GbE-порт. Архитектура серверов d-Matrix для ИИ-инференса предполагает установку ускорителей Corsair с DMX-мостом между каждыми двумя такими картами для обеспечения высокой пропускной способности без использования PCIe. Затем пары ускорителей объединяются посредством коммутатора PCIe. В эталонном дизайне один NIC JetStream обслуживает до четырёх экземпляров Corsair. d-Matrix утверждает, что сетевую задержку в такой конфигурации удалось сократить до 2 мкс. По заявлениям d-Matrix, карты JetStream могут применяться в существующих ЦОД без необходимости замены дорогостоящих инфраструктурных компонентов. В связке с ИИ-ускорителями Corsair и ПО d-Matrix Aviator решения JetStream способны справляться с ИИ-моделями, насчитывающими более 100 млрд параметров. При этом, как утверждает разработчик, обеспечивается в 10 раз более высокая производительность, в три раза лучшая экономическая эффективность и втрое большая энергоэффективность по сравнению с решениями на базе GPU. Энергопотребление JetStream составляет около 150 Вт. Адаптер оснащён системой охлаждения с радиатором и тепловыми трубками, которые охватывают зону QSFP-DD. Пробные поставки новинки уже начались, а массовое производство запланировано на конец текущего года.

02.09.2025 [10:14], Владимир Мироненко

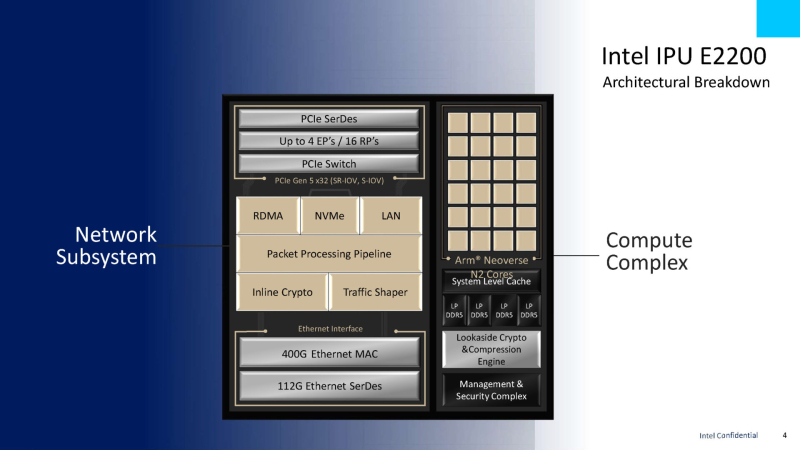

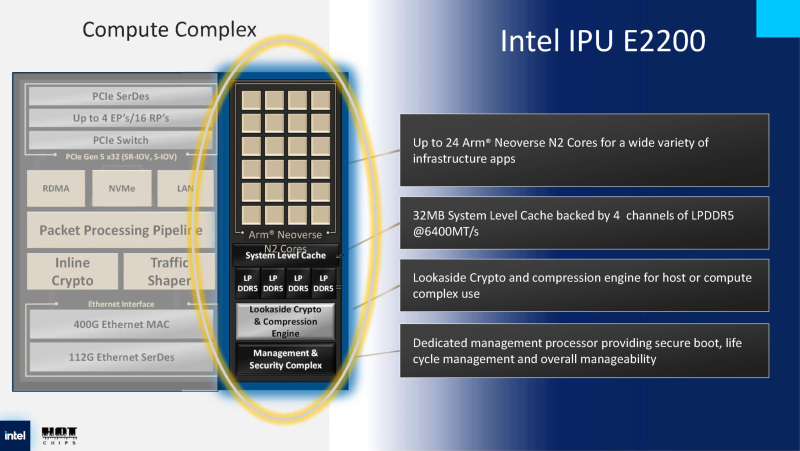

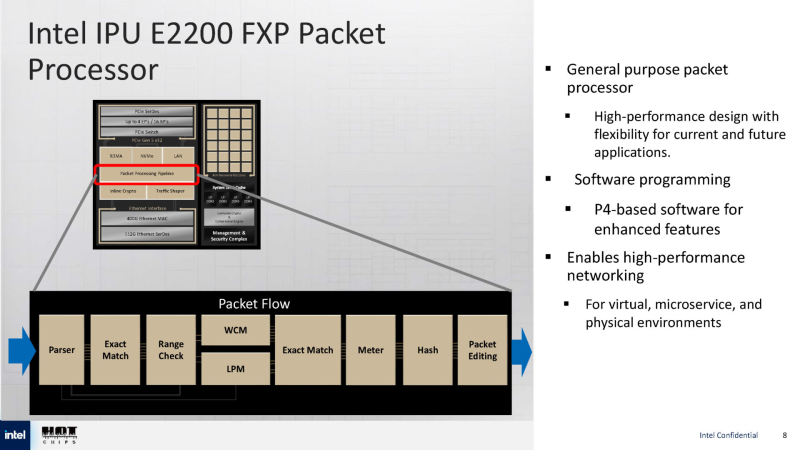

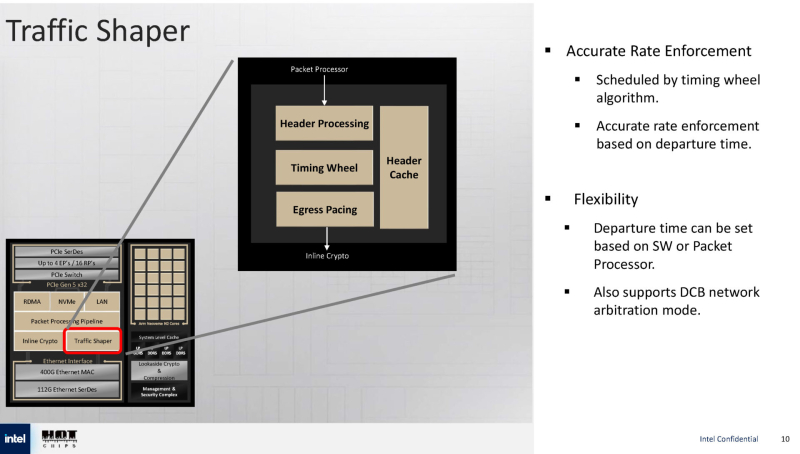

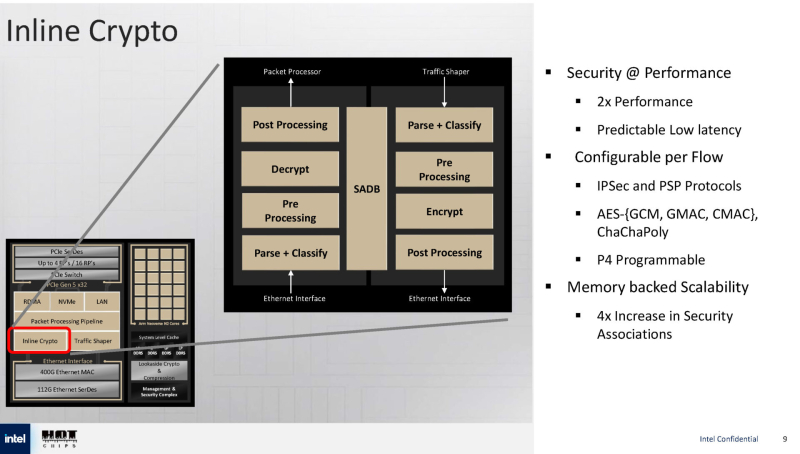

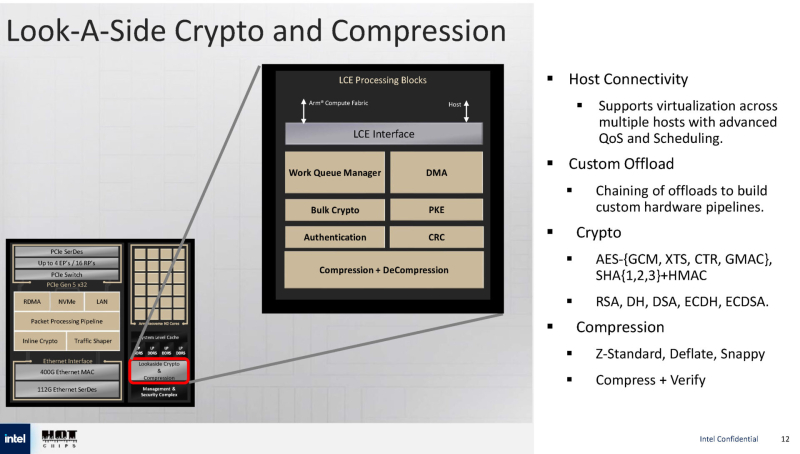

Intel анонсировала IPU E2200 — 400GbE DPU семейства Mount MorganIntel анонсировала DPU Intel IPU E2200 под кодовым названием Mount Morgan, представляющий собой обновление 200GbE IPU E2100 (Mount Evans), разработанного при участии Google для использования в ЦОД последней, причём не слишком удачного, как отмечают некоторые аналитики. Как сообщает ресурс ServeTheHome, Intel E2200 производится по 5-нм техпроцессу TSMC. Он базируется на той же архитектуре, что и предшественник, но предлагает более высокую производительность. Вычислительный блок включает до 24 ядер Arm Neoverse N2 с 32 Мбайт кеша, четырьмя каналами LPDDR5-6400 и выделенным сопроцессором безопасности. Сетевая часть представлена 400GbE-интерфейсом с RDMA, а хост-подключение — подсистемой PCIe 5.0 x32 со встроенным коммутатором PCIe. Для обработки пакетов используется P4-программируемый процессор FXP — модуль обработки трафика с алгоритмом синхронизации и настраиваемыми параметрами разгрузки, что позволяет распределять задачи между сетевыми ускорителями и Arm-ядрами. Также имеется встроенный криптографический модуль для шифрования на лету (inline) с поддержкой протоколов IPsec и PSP, настраиваемый для каждого потока. Для управления потоками данных используется модуль Traffic Shaper с поддержкой алгоритма Timing Wheel. Кроме того, есть и Look-Aside-блок для компрессии и шифрования. Как и в IPU E2100, у IPU E2200 имеется выделенный модуль для независимого внешнего управления. Также поддерживаются программируемые параметры разгрузки с использованием различных ускорителей и IP-блоков.

20.08.2025 [09:34], Владимир Мироненко

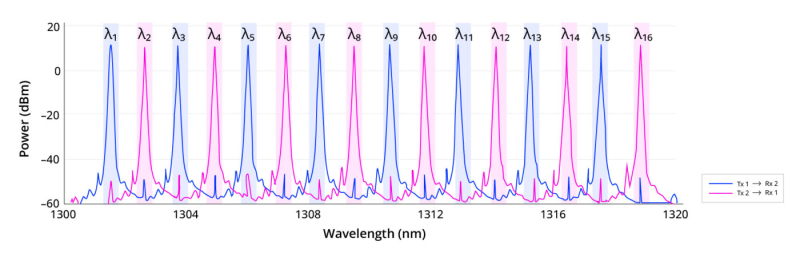

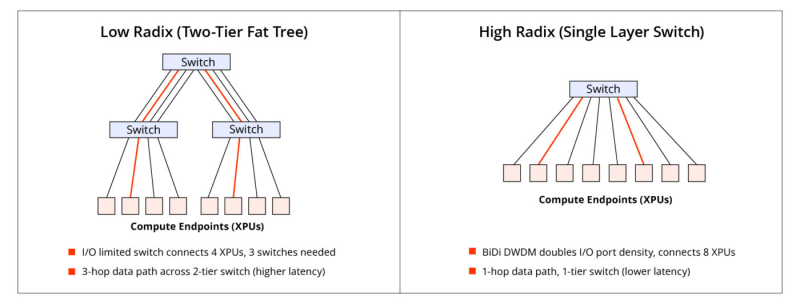

Lightmatter «упаковала» 16 длин волн в одномодовое волокноLightmatter объявила о новом достижении в области оптической связи: двунаправленном оптическом канале связи Lightmatter Passage 3D CPO с 16 λ и DWDM, работающем на одном одномодовом оптоволокне. Как сообщает компания, решение, основанное на интерконнекте Lightmatter Passage и лазерной технологии Lightmatter Guide, устраняет прежние ограничения по плотности полосы пропускания волокна и использованию спектра, устанавливая новый стандарт для высокопроизводительных и отказоустойчивых интерконнектов в ЦОД. Lightmatter отметила, что с ростом числа сложности MoE-моделей с триллионами параметров масштабирование ИИ-нагрузок будет ограничено количеством портов и их пропускной способности. Lightmatter Passage 3D обеспечивает «беспрецедентную» двунаправленную пропускную способность 800 Гбит/с (по 400 Гбит/с для передачи и для приёма) для одномодового оптоволокна на расстоянии до 1 км. Это восьмикратный скачок пропускной способности на волокно по сравнению с традиционными решениями, говорится в блоге Lightmatter. При этом не требуется более дорогостоящее волокно с поддержкой поляризации (PM). Как и прежде, решение Lightmatter относится к системам интегрированной фотоники (CPO). Оно объединяет восемь сверхэффективных кольцевых микромодуляторов (MRM), фотодетекторы и аналоговые схемы на одном монолитном кремниевом кристалле с запатентованной системой термической стабилизации. Замкнутая система цифровой стабилизации активно компенсирует любой тепловой дрейф, обеспечивая непрерывную передачу данных с низким уровнем ошибок даже при заметных колебаниях температуры кристалла. В решении компании чередуются нечётные и чётные длины волн в диапазоне 1310 нм: восемь нечётных каналов передают в одном направлении, а восемь чётных — в противоположном. Каждый канал работает со скоростью 50 Гбит/с с интервалом 200 ГГц между соседними каналами передачи/приёма и 400 ГГц между каналами, передающими данные в одном направлении. Удваивая количество I/O-портов на коммутатор или XPU, технология сокращает количество сетевых переходов, снижает задержку и энергопотребление, а также минимизирует затраты в крупных ИИ-кластерах. В крупных MoE-моделях интерконнект с большим радиксом обеспечивают взаимодействие «экспертов» с высокой пропускной способностью, что позволяет избежать узких мест при масштабировании и сократить время обучения. Lightmatter позиционирует новое решение как естественную эволюцию технологии CPO для создания ИИ-суперкомпьютеров следующего поколения. Развитием направления CPO также активно занимаются ведущие разработчики ИИ-ускорителей. AMD недавно приобрела стартап Enosemi, который специализируется на разработке фотонных чипов. NVIDIA в марте нынешнего года анонсировала 800G-коммутаторы Spectrum-X и Quantum-X, в которых применены новые ASIC, объединяющие на одной подложке чип-коммутатор и фотонные модули. |

|