Материалы по тегу: s

|

28.05.2026 [09:13], Руслан Авдеев

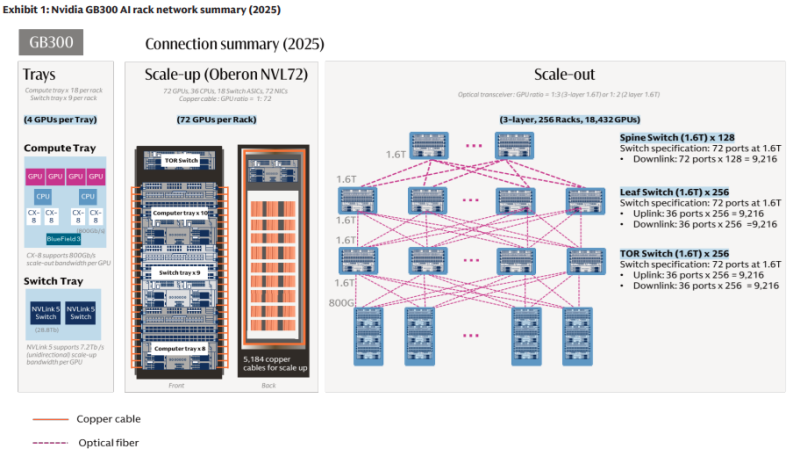

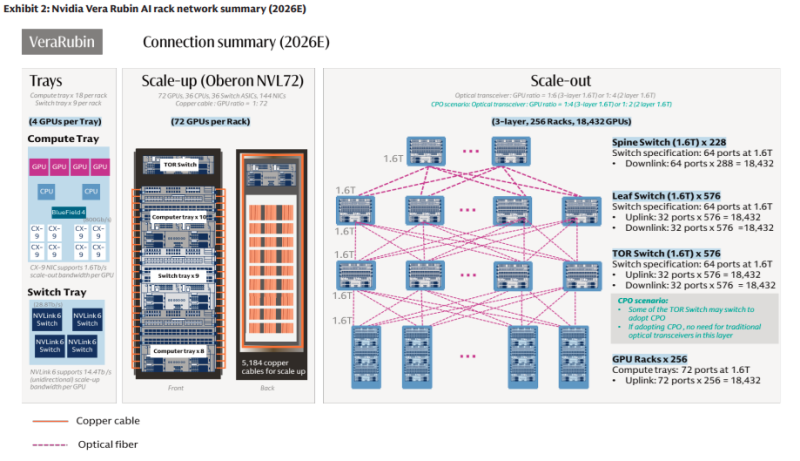

ИИ осветят путь: Goldman Sachs прогнозирует резкий рост рынка оптических сетейПо прогнозам Goldman Sachs, рынок оптических сетевых решений для ИИ-инфраструктуры увеличится до $154 млрд на фоне роста спроса со стороны облачных гиперскейлеров и ИИ-кластеров, сообщает блог IEEE ComSoc. Техногиганты стремятся эффективно объединить как можно больше чипов, что приведёт к росту рынка волоконно-оптических соединений в ИИ ЦОД в девять раз. В Goldman Sachs отмечают, что показатели ИИ-систем теперь зависят не только от производительности GPU и HBM, но и от того, насколько быстро данные передаются между чипами и стойками. Аналитики подчёркивают, что именно оптические сетевые решения «разблокируют» вычислительные мощности, с чем уже не особенно эффективно справляются медные интерконнекты. В докладе рынок делится на решения для вертикального (scale-up) и горизонтального (scale-out) масштабирования. Примечательно, что на первые, как ожидается, придётся около $106 млрд из $154 млрд, т.е. 69 % рынка. Рынок оптических интерфейсов CPO составит порядка $91 млрд (59 %), т.е. большая часть затрат пойдёт на сети внутри ИИ-кластеров. По прогнозам Goldman Sachs, при переходе от систем NVIDIA GB300 NVL72 к Rubin Ultra NVL576 рост долларового содержания на вычислительную единицу вырастет в 16 раз в сегменте scale-out и в 45 раз — в сегменте scale-up. Рост связан с увеличением спроса на подключаемые оптические модули, оптические «движки», медные кабели и др. Рынок подключаемых оптических модулей и оптических «движков» вырастет в 13 раз при переходе от scale-out (как в случае GB300 NVL72/Oberon) к scale-up (Rubin Ultra NVL576/Kyber) в расчёте на вычислительную единицу.

Источник изображения: Goldman Sachs Рынок подключаемых оптических модулей в сегменте scale-out вырастет в 10 раз на вычислительную единицу при переходе с GB300 NVL72 на Rubin Ultra NVL576, даже при проникновении CPO на уровне 29 %. Количество оптических модулей (в эквиваленте 1.6TbE) в одной вычислительной единице увеличится с 216 шт. в GB300 NVL72 до приблизительно 2,5 тыс. в Rubin Ultra NVL576. Банк прогнозирует, что долларовое содержание на вычислительную единицу в сегментах scale-up и scale-out увеличится в 20 раз с $315 тыс. в GB300 NVL72 до $9,4 млн в Rubin Ultra NVL576. При этом прогнозируется, что за полный жизненный цикл продукта будет поставлено 48 тыс. стоек GB300 NVL72 и 16,5 тыс. систем Rubin Ultra NVL576. Совокупный адресуемый рынок (TAM) для вертикальных и горизонтальных решений вырастет в 9 раз, с $15 млрд в случае с GB300 NVL72 (преимущественно в 2026 году) до $154 млрд для Rubin Ultra NVL576 (в основном в 2028 году).

Источник изображения: Goldman Sachs Одним из ключевых выводов является то, что ИИ-кластеры становятся всё более насыщенными на разных уровнях стека оптическими системами, а не только на уровне подключения между стойками. Более всего от ситуации выиграют поставщики, способные снизить энергопотребление, повысить плотность и упростить упаковку для сверхскоростных интерконнектов. Чаще всего в числе основных бенефициаров упоминаются Coherent, Lumentum и Fabrinet, занятых в индустрии производства оптических компонентов и модулей, которое растёт вместе со спросом на ИИ-интерконнекты. Наилучшие перспективы у производителей специализированных оптических решений, а не у игроков более широкого профиля, включая Ciena, Nokia/Infinera, Cisco/Acacia, ADVA или Calix. В целом в Goldman Sachs считают, что оптические решения более не являются вспомогательным элементом инфраструктуры и становятся ключевым фактором для масштабирования инвестиций в ИИ. В результате инвесторы всё активнее интересуются производителями оптических компонентов, кремниевой фотоники, трансиверов и смежных технологий упаковки и пр. Ключевой вывод — по мере развития ИИ-кластеров сетевая инфраструктура становится одним из главных потенциальных ограничений, а оптика — наиболее вероятным решением этой проблемы.

27.05.2026 [15:41], Сергей Карасёв

Bull поставила Финляндии суперкомпьютер Roihu с производительностью до 49 ПфлопсКомпания Bull, специализирующаяся на высокопроизводительных вычислениях, поставила Финляндии новейший национальный суперкомпьютер Roihu для ресурсоёмких задач, в том числе связанных с ИИ. Система позволит утроить доступные в стране вычислительные мощности. Соглашение о создании Roihu было заключено между компанией Eviden (дочерняя структура Atos) и Финским научным IT-центром CSC в конце 2024 года. Комплекс Roihu смонтирован в дата-центре в Каяани рядом с действующим суперкомпьютером LUMI. Новая НРС-система построена на гибридной платформе Eviden BullSequana XH3000. В общей сложности задействованы 486 узлов на основе CPU и 132 узла на базе GPU. Каждый CPU-узел несёт на борту два 192-ядерных процессора AMD EPYC 9965 поколения Turin, что в сумме даёт 186 624 ядра. При этом 414 узлов располагают 768 Гбайт памяти, а оставшиеся 72 — 1536 Гбайт. В свою очередь, каждый GPU-узел оснащён четырьмя суперчипами NVIDIA GH200. Общее количество GPU в составе суперкомпьютера составляет 528. Все эти CPU и GPU узлы комплектуются локальным SSD вместимостью 960 Гбайт. Кроме того, в состав Roihu входят четыре узла визуализации с двумя процессорами AMD EPYC Turin 9335 (32 ядра) и двумя ускорителями NVIDIA L40 в каждом, а также четыре высокопроизводительных узла с двумя чипами AMD EPYC Turin 9555 (64 ядра) и 6 Тбайт памяти. В комплектацию данных узлов включены два SSD ёмкостью 7,68 Тбайт каждый. Сетевая инфраструктура базируется на 200G-интерконнекте Infiniband NDR. Для Roihu предусмотрено использование двух независимых хранилищ DDN EXAScaler Lustre на основе SSD: это раздел Scratch вместимостью 6 Пбайт и дополнительная секция объёмом 0,5 Пбайт для проектных приложений и личных каталогов пользователей. Пиковая скорость передачи данных у Scratch достигает 560 Гбайт/с при чтение и 280 Гбайт/с при записи. У второй секции эти значения составляют до 120 и 100 Гбайт/с соответственно. Общая FP64-производительность CPU-узлов оценивается в 10,5 Пфлопс, GPU — в 23,4 Пфлопс: в сумме это даёт 33,9 Пфлопс. Пиковое быстродействие достигает 49 Пфлопс. Суперкомпьютер Roihu станет доступен пользователям в июне нынешнего года. При этом действующие в Финляндии НРС-системы Puhti и Mahti будут полностью выведены из эксплуатации в августе 2026-го.

27.05.2026 [10:21], Руслан Авдеев

Безумству храбрых: французский инженер троллит IT-гигантов сатирическими ИИ-нарезками с индюкомФранцузский разработчик и SRE (Site Reliability Engineer) Амин Раити (Amine Raiti) объявил настоящую войну облачным гиперскейлерам, включая AWS, Google Cloud и Microsoft Azure. Он потребовал от них отказа от огромных комиссий за прекращение использования услуг. В противном случае гиперскейлерам грозит бесконечный поток сгенерированного ИИ сатирического музыкального контента, сообщает The Register. Раити, работающий в некой финансовой организации, находящейся под надзором европейского центробанка, выбрал оружием генерируемые ИИ песни, сатирические стихи и музыкальные пародии, от K-pop до финской польки и музыки в стиле Шопена, назвав свою кампанию «Операция индюк» (Operation Dindon). Идея появилась, когда Раити работал управленцем в одной из французских Adtech-компаний. Бизнес был связан многолетними облачными договорами, которые действовали даже на фоне падения выручки компании и сокращения штата. Хотя конкретные облачные провайдеры в тех увольнениях не обвиняются, именно тогда привязка к вендору якобы перестала быть для Раити абстрактной технической проблемой. Требования организатора интернет-протеста чрезвычайно просты: гиперскейлеры должны дать клиентам возможность отказаться от многолетних соглашений, если бизнес заходит в финансовый тупик, прекратить взимать огромные средства за выгрузку данных из своих облаков и обеспечить отказ от проприетарных сервисов гиперскейлеров без огромных трат на миграцию. Журналистам Раити привёл вопиющие примеры. По его словам, одна конфигурация AWS NAT Gateway может обойтись в €6,7 тыс. ($7777) ежегодно за функциональность, которую, по его словам, администраторы Linux-систем обеспечивали ещё в конце 1990-х гг. Управляемые Kubernetes-сервисы могут обходиться ежегодно в €14 тыс. ($16251) и более. В отличие от обычных разговоров, не уходящих дальше отдельных IT-команд или публикации постов в LinkedIn, Раити превратил свой протест в настоящее представление, создав сатирический музыкальный сериал «Легенда об индюке» (The Legend of Dindon). Главный герой — вымышленный индюк, регулярно попадающий в зависимость от облачных сервисов и не способный выбраться из ловушек. Каждая серия посвящена отдельной проблеме: скрытым расходам, юридическим привязкам к вендорам или, например, завышенным тарифам. В начале мая Раити опубликовал т.н. «Железный ультиматум» (Iron Ultimatum) на 11 языках, адресовав его AWS, Google и Microsoft. Организатор музыкальных протестов готов даже выпустить хвалебный поэтический сборник с похвалами в адрес облачных компаний, если те проведут значимые реформы. Если нет — операция продлится бессрочно, благо, создание одного трека занимает около двух минут, а обойдётся это не дороже €50/мес. «Коллекция» Раити уже включает порядка 50 сгенерированных ИИ треков. Сами облачные гиганты пока не ответили на ультиматум и до объявленного «дедлайна» в сентябре остаётся довольно много времени. Впрочем, нередко они и сами обвиняют друг друга в огромных платежах за отказ от сервисов и выгрузку данных.

25.05.2026 [21:15], Руслан Авдеев

Accenture и OneView Commerce получили контракт на замену скандально известного ПО Fujitsu Horizon для Почты ВеликобританииПочтовая служба Великобритании Royal Mail заключила с Accenture и OneView Commerce контракт на £410 млн для замены проблемного ПО Horizon, ставшего причиной одной из крупнейших судебных ошибок в истории страны, сообщает The Register. Accenture стала победителем тендера на замену ПО компании Fujitsu, с 1996 года отвечавшего за работу POS-системы и финансовой отчётности почты в соответствии с принципом Walk In Take Over (WITO). Это означает, что подрядчик берёт под контроль действующую систему, обслуживая её, но параллельно внедряя новую — готовится полная трансформация делопроизводства. В частности, будет обеспечено управление миграцией на новое SaaS-решение, сумма сделки составит £269 млн на пять лет (с возможностью дважды дополнительно продлять контракт на год). Менее известная OneView Commerce выступает поставщиком SaaS-решений для розничной торговли. Эта компания также выиграла тендер на поставку ПО стоимостью £141 млн. Программное обеспечение должно «трансформировать технологическую платформу розничной торговли почты в соответствии с меняющимися бизнес-требованиями, операционными процессами и потребностями клиентов». Новую систему поместят в облако с возможностью отладки под нужды почты. Ожидается, что она будет включать POS-терминалы для обслуживания посетителей, мобильные сервисы, службы взаимодействия с клиентами и аналитические сервисы, а также киоски самообслуживания и т.п.

Источник изображения: Federico Di Dio photography/unsplash.com В 1999 году Почта Великобритании начала внедрять систему Horizon компании Fujitsu для бухгалтерского учёта и дважды обновляла это ПО. Со временем выяснилось, что с 1999 по 2015 гг. более 700 сотрудников почты неправомерно привлекли к ответственности из-за ошибок в Horizon, в том числе уголовной. Расследование уже показало, высокопоставленные сотрудники почты и представители подрядчиков — Fujitsu и ICL должны были знать о дефектах в Horizon. При этом представители Почты и Fujitsu пытаются переложить вину друг на друга, а многие пострадавшие до сих пор не могут дождаться компенсаций. Попутно выяснилось, что и прошлые версии ПО для Почты, Capture и ECCO/ECCO+, также содержали аналогичные ошибки. В мае 2025 года Почта Великобритании отказалась от планов создания собственной замены ПО компании Fujitsu и объявила тендер на £410 млн, победителями которого и стали Accenture и OneView Commerce. В числе не прошедших конкурсный отбор — IBM и Escher Software. Последняя занимается поставками ПО для розничной торговли и электронной коммерции.

22.05.2026 [16:06], Руслан Авдеев

Дата-центры Nebius в США получат топливные элементы Bloom Energy

bloom energy

hardware

nebius

ии

сделка

сша

топливные элементы

цод

экология

электропитание

энергетика

Неооблачная компания Nebius заключила договор с американским производителем твёрдооксидных топливных элементов (SOFC) Bloom Energy. Предполагается, что внедрение этой технологии обеспечит электроэнергией ЦОД Nebius в США, сообщает Datacenter Dynamics. В рамках первого этапа проекта предполагается развернуть «за счётчиком» 328 МВт мощностей на неназванном объекте. Ввод в эксплуатацию запланировали до конца 2026 года. По словам Nebius, дефицит энергоснабжения остаётся ключевым фактором, ограничивающим развитие ИИ-инфраструктуры. Bloom выбрали, поскольку её элементы практически не загрязняют окружающую среду, энергообеспечение организовывается в требуемые сроки и в объёмах, необходимых для ИИ-нагрузок. Nebius намерена и далее использовать эти SOFC по мере наращивания мощностей. Bloom Energy является ведущим поставщиком решений на основе SOFC для индустрии ЦОД. Такие элементы используют электрохимические реакции для преобразования топлива в электричество без его сжигания. По данным Bloom, это обеспечивает более высокую эффективность использования топлива и меньшие выбросы. Платформа работает с природным газом, биогазом и водородом. Топливные элементы Bloom созданы для высокоплотных ИИ ЦОД, а технологическая платформа соответствует новым стандартам 800 В DC. Сделка с Nebius стала последней в череде соглашений Bloom на рынке ЦОД. В апреле компания расширила партнёрство с Oracle, обещав обеспечить ей до 2,8 ГВт мощностей для ЦОД OpenAI. Также Bloom договорилась развернуть решения в 19 ЦОД Equinix общей мощностью более 100 МВт. Энергетическая компания American Electric Power (AEP) должна получить до 1 ГВт SOFC для автономного электроснабжения ИИ ЦОД. В 2025 году Bloom Energy заключила инвестиционное соглашение с Brookfield на $5 млрд. Nebius имеет ЦОД в США, на Ближнем Востоке и в Европе. Помимо собственного дата-центра в Финляндии в Мянтсяля (Mäntsälä), который вскоре будет дополнен ещё одним объектом — крупнейшим в Европе, по словам компании — в Лаппеенранте (Lappeenranta), компания арендует или намерена арендовать мощности в Великобритании (ЦОД Ark Data Centers в Лондоне), Франции (ЦОД Equinix в Париже), Израиле (несколько площадок Mega Or), а также Исландии (ЦОД Verne в Кеблавике). В США речь идёт о ЦОД DataOne в Вайнленде (Нью-Джерси) и ЦОД Patmos в Канзас-Сити (Миссури). На днях компания сообщила о намерении построить гигаваттный кампус ЦОД в Индепенденсе (Миссури).

22.05.2026 [12:00], Сергей Карасёв

Представлен российский сервер Delta Orca на базе Intel Xeon 6 для работы с неструктурированными даннымиКомпания Delta Computers анонсировала однопроцессорный сервер Delta Orca, построенный на аппаратной платформе Intel Xeon 6. Новинка ориентирована на использование в инфраструктурах Lakehouse, объединяющих гибкость «озёр данных» (Data Lake) и надёжность централизованных хранилищ (Data Warehouse). Устройство выполнено в форм-факторе 2OU для монтажа в 21″ стойку. В зависимости от модификации задействуется процессор Granite Rapids-SP (до 80 P-ядер) или Sierra Forest-SP (до 96 E-ядер) с показателем TDP до 350 Вт. Доступны восемь слотов для модулей оперативной памяти RDIMM/LRDIMM DDR5-6400 (или MCRDIMM-8000) суммарным объёмом до 2 Тбайт. Сервер допускает установку до 20 NVM-накопителей SFF U.2 (PCIe 5.0) толщиной 7 мм или до 10 устройств такого же типа толщиной 15 мм во фронтальной части. Кроме того, есть два коннектора для NVME SSD формата M2.2280. Предусмотрены слот PCIe 5.0 x16 для карты расширения HHHL, по одному порту USB 3.0 Type-A, USB Type-C (сервисный разъем) и Mini DP, сетевой порт управления 1GbE. Говорится о поддержке сетевых адаптеров 400GbE. Питание осуществляется от централизованного шинопровода OCP. Применена система гибридного охлаждения Delta Hybrid Cooling для поддержания работы процессора в режиме Turbo Boost Max в течение продолжительного времени. Модель Delta Orca, по заявлениям производителя, оптимизирована для работы с неструктурированными данными и объектными хранилищами. Реализованы средства мониторинга и управления в собственной системе Delta BMC (внесено в реестр Минцифры и имеет сертификат ФСТЭК). Среди преимуществ новинки выделяются масштабируемость, высокая пропускная способность и надёжное хранение данных. Сервер уже доступен для предварительного заказа.

21.05.2026 [20:51], Сергей Карасёв

Представлен российский коммуникационный сервер Delta Octopus 6 на платформе Intel Xeon 6Delta Computers анонсировала отечественный коммуникационный сервер Delta Octopus 6, который продолжает развитие серии Octopus. В основу новинки положена аппаратная платформа Intel Xeon 6. В зависимости от модификации применяется процессор Xeon 6 Granite Rapids-SP (до 86 P-ядер) или Sierra Forest-SP (до 144 E-ядер) с показателем TDP до 350 Вт. Доступны 16 слотов для модулей оперативной памяти DDR5-6400/8000. Могут быть установлены два NVMe SSD типоразмера M2.22110. Благодаря наличию пяти слотов PCIe 5.0 x16 OCP 3.0 возможен монтаж до пяти сетевых адаптеров с пропускной способностью до 400 Гбит/с каждый. Присутствуют сетевой порт управления 1GbE (Delta BMC), разъём USB 3.0 и консольный порт RJ45. Предусмотрен датчик вскрытия корпуса. Устройство выполнено в форм-факторе 1U с габаритами 600 × 439 × 43 мм. При этом система может монтироваться как в стандартные 19″ стойки, так и в 21″ OCP-шасси. Питание может быть организовано от двух блоков мощностью 800/1300Вт, от централизованного шинопровода OCP (12 В) или от шины питания 48 В телеком-стандарта (Telco Rack). Платформа Delta Octopus 6 предназначена для использования в сценариях межсетевых экранов нового поколения (NGFW), балансировщиков сетевой нагрузки (Load Balancer), VPN-концентраторов, BRAS/BNG и различных крипто-аналитических приложений. Применяется собственное программное обеспечение Delta BMC и Delta BIOS. Сервер может использоваться на объектах КИИ.

21.05.2026 [14:55], Руслан Авдеев

Armada привлекла $230 млн на расширение производства модульных ИИ ЦОДArmada Inc., поставляющая контейнерные дата-центры и ПО для спутниковых интернет-технологий, привлекла $230 млн инвестиций, повысив оценку капитализации до $2 млрд, сообщает Silicon Angle. Ведущими инвесторами выступили BlackRock, Overmatch и 8090 Industries. Также в раунде приняли участие другие компании, в т.ч. крупный поставщик промышленного оборудования Johnson Controls, заключивший с Armada сделку о промышленном партнёрстве. Armada предлагает серию портативных ЦОД Galleon. Самый компактный вариант Beacon размером всего с чемодан, самый большой обеспечивает вычислительную мощность в несколько мегаватт. ЦОД поставляются в защищённых контейнерах, способных выдержать высокие температуры, удары и прочие внешние воздействия. Встроенные в корпус датчики позволяют своевременно выявлять попытки взлома. Прочность таких ЦОД позволяет работать даже в нетипичных условиях. По словам Armada, дата-центры можно вводить в эксплуатацию за несколько дней, поскольку им не нужна специальная энергетическая инфраструктура. Johnson Controls тоже выпускает модульные ЦОД и имеет подразделение Silent-Aire для производства систем воздушного охлаждения серверных. Недавно компания также приобрела купила разработчика СЖО Alloy Enterprises. Johnson Controls поможет Armada построить производство площадью 37 тыс. м2 для выпуска модульных дата-центров. Уже летом компании рассчитывают начать производство, первоначально приоритете будет отдаваться самому крупному варианту ЦОД Armada — Leviathan.

Источник изображения: Armada Компания также предлагает маркетплейс, позволяя предустановить сторонние ИИ-системы на оборудование Galleon, а платформа Bridge позволяет монетизировать ИИ-инфраструктуру, сдавая вычислительные мощности в аренду. Сервис Atlas позволяет клиентам приобретать спутниковые терминалы Starlink за «кредиты» Microsoft Azure, управлять ими и отслеживать использование интернета. Наконец, ПО Drones добавляет функциональность, позволяющую управлять БПЛА. Armada заявляет, что ПО позволяет собирать телеметрию состояния компонентов беспилотников и отслеживать их полёт, а встроенный ИИ-ассистент ускоряет выполнение некоторых задач, вроде составления графиков техобслуживания.

18.05.2026 [15:55], Сергей Карасёв

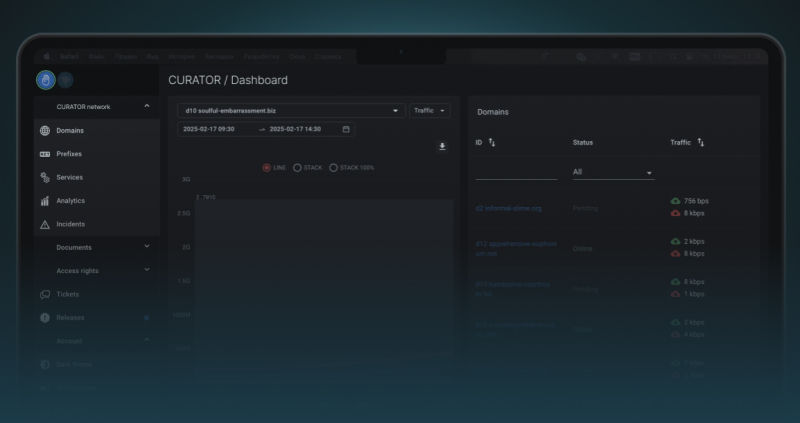

Curator внедряет централизованную аутентификацию пользователей через SSOКомпания Curator, специализирующаяся на обеспечении доступности интернет-ресурсов и нейтрализации DDoS-атак, реализовала поддержку Single Sign-On (SSO, единый вход) в личном кабинете платформы. Новая функциональность позволяет клиентам использовать корпоративные системы аутентификации и авторизации для централизованного управления доступом пользователей. При использовании SSO аутентификация пользователей производится на стороне внешнего identity-провайдера. Это позволяет компаниям использовать уже существующую корпоративную систему управления доступом без создания отдельных учётных записей в личном кабинете Curator. Curator поддерживает федерацию удостоверений с использованием протоколов OAuth 2.0 и OpenID Connect. Это позволяет интегрировать личный кабинет платформы с популярными identity-провайдерами, включая Keycloak, Avanpost IDM, Yandex Identity Hub, Blitz Identity Provider, Indeed AM и другими решениями, совместимыми с этими стандартами. Для централизации управления правами доступа используется маппинг внешних групп пользователей на внутренние группы личного кабинета. Функциональность SSO уже доступна всем клиентам Curator. «Компании с развитой ИТ-инфраструктурой всё чаще стремятся централизовать управление аутентификацией и авторизацией пользователей, а также минимизировать количество отдельных учётных записей в используемых сервисах. Реализация SSO в Curator позволяет упростить управление доступами без изменения внутренних процессов клиентов», — отметил Дмитрий Ткачев, генеральный директор Curator.

18.05.2026 [14:58], Сергей Карасёв

Kaytus представила All-Flash СХД вместимостью до 7 ПбайтКомпания Kaytus, базирующаяся в Сингапуре, анонсировала системы хранения KR1180 (1U10), KR2280 (2U24) и KR4266 (4U60) типа All-Flash, рассчитанные на применение в инфраструктурах ИИ. Утверждается, что при построении платформ экзабайтного масштаба суммарная пропускная способность достигает 10 Тбайт/с, а показатель IOPS при чтении — 100 млн. Для новинок предусмотрено применение SSD с интерфейсом PCIe 5.0 на основе чипов флеш-памяти QLC NAND. Kaytus подчёркивает, что такие накопители по сравнению с традиционными продуктами на основе TLC NAND позволяют снизить общую стоимость владения на 70 % в течение пяти лет. Могут устанавливаться SSD вместимостью до 122,88 Тбайт. Модель KR1180 выполнена в форм-факторе 1U: она оснащена десятью отсеками для SFF-накопителей SAS/SATA/NVMe. Общая ёмкость может составлять до 1 Пбайт; пропускная способность — 140 Гбайт/с. В зависимости от модификации устанавливается один процессор Intel Xeon 6 (Sierra Forest-SP/Granite Rapids-SP) или AMD EPYC 9005 Turin. Доступны соответственно 16 и 24 слота для модулей DDR5. Есть два внутренних коннектора для SSD типоразмера M.2, три слота PCIe 5.0 x8 для карт расширения HHHL, а также разъём PCIe 5.0 x8/x16 OCP 3.0 NIC. Питание обеспечивают два блока мощностью до 2000 Вт с сертификатом 80 Plus Platinum/Titanium. Применено воздушное охлаждение. Версия KR2280 стандарта 2U рассчитана на 24 накопителя SFF SAS/SATA/NVMe. Могут быть задействованы один или два процессора Intel Xeon 6 или AMD EPYC 9005. Упомянуты соответственно 32 и 24 слота DDR5. В зависимости от конфигурации доступны до семи слотов PCIe 5.0. Используются два блока питания мощностью до 3200 Вт с сертификатом 80 Plus Platinum/Titanium. Предлагаются опции воздушного и жидкостного охлаждения. Вариант KR4266 формата 4U позволяет установить в общей сложности 60 накопителей QLC SSD, а суммарная вместимость достигает 7 Пбайт. Пропускная способность — до 260 Гбайт/с, величина IOPS — до 20 млн. Поддерживаются один или два процессора Intel Xeon 6 и до 32 модулей DDR5-6400. Могут быть задействованы до 12 слотов PCIe 5.0, включая два разъёма для карт OCP 3.0 NIC. Применены блоки питания мощностью до 2700 Вт с сертификатом 80 Plus Platinum/Titanium. |

|