Материалы по тегу: s

|

16.05.2026 [23:23], Владимир Мироненко

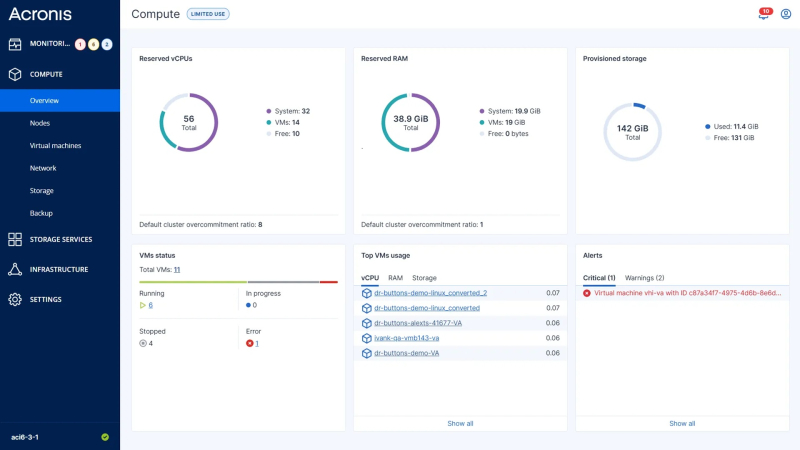

Acronis представила платформу Cyber Frame — альтернативу продуктам VMwareКомпания Acronis объявила о запуске Acronis Cyber Frame — HCI-платформы IaaS, разработанной для поставщиков управляемых услуг (MSP), поставщиков облачных услуг (CSP), хостинг-провайдеров и телекоммуникационных компаний. Acronis Cyber Frame позволяет партнёрам предоставлять, защищать, управлять и автоматизировать создание, предоставление и монетизацию инфраструктурных услуг на своих условиях, объединяя виртуальные машины, сети и хранилища с интегрированными в Acronis средствами киберзащиты, управления и автоматизации. Как утверждает разработчик, в условиях деградации устаревшей виртуализации, растущего давления на затраты со стороны гиперскейлеров и увеличения спроса на региональные и суверенные облачные решения, Acronis Cyber Frame предоставляет поставщикам услуг новый путь к восстановлению контроля над своей инфраструктурной стратегией и маржой. Acronis подчеркнула, что с помощью платформы можно осуществить модернизацию устаревших кластеров VMware vSphere и снять риски, связанных с лицензированием, после изменений цен, инициированных Broadcom. «Cyber Frame позволяет мигрировать в облачную инфраструктуру, размещённую партнером, через Cyber Frame Local или Cyber Frame Cloud, размещённую Acronis, — заявила компания. — В типичной конфигурации из пяти узлов Cyber Frame Local обеспечивает валовую прибыль около 65% и рентабельность инвестиций за три года в размере 183 %, по сравнению с примерно 84 % у VMware». Acronis Cyber Frame предлагает две модели развёртывания. Вариант Cyber Frame Cloud обеспечивает партнёрам возможность быстро начать работу с размещённой на серверах Acronis платформой, предоставляя IaaS из региональных ЦОД Acronis без приобретения оборудования или эксплуатации собственной инфраструктуры. Благодаря вариантам развёртывания на серверах Acronis и поставщиков услуг, Cyber Frame помогает партнёрам решать вопросы размещения данных, локального контроля и обеспечения суверенитета. Версия Cyber Frame Cloud уже развёрнута в более чем 30 ЦОД Acronis по всему миру, и планируется расширение сети. Компании также могут развернуть Cyber Frame Local в своём собственном ЦОД или среде колокации, чтобы получить полный контроль над инфраструктурой, экономикой, производительностью и местоположением данных. Cyber Frame поддерживает многопользовательский режим, самообслуживание клиентов, доставку под собственной торговой маркой, рабочие процессы PSA и интегрированное управление через облако Acronis Cyber Protect. Платформа построена в сотрудничестве с Virtuozzo на основе оптимизированных технологий OpenStack и KVM, без привязки к проприетарному гипервизору. Раннее Virtuozzo представила платформу V/IS для ИИ, которая поможет справиться с ростом цен на ПО VMware. Что не менее важно, Cyber Frame имеет встроенную защиту по умолчанию, то есть заказчики получают виртуальные машины со встроенным резервным копированием и аварийным восстановлением, защитой от угроз, а также возможностью удалённого мониторинга и управления (RMM) без необходимости использования для этих целей отдельных инструментов.

15.05.2026 [12:34], Руслан Авдеев

Великобритания инициировала антимонопольное расследование практик лицензирования ПО в экосистеме Microsoft

aws

google cloud platform

microsoft

microsoft azure

software

великобритания

конкуренция

лицензия

облако

Британский антимонопольный регулятор — Управление по конкуренции и рынкам (CMA) занялся изучением экосистемы Microsoft на предмет присвоения компании «стратегического рыночного статуса» (Strategic Market Status, SMS). Очередное расследование инициировано после введения в Великобритании режима контроля конкуренции на цифровых рынках. В случае, если компанию признают подпадающей под режим SMS, регулятор сможет применять в отношении неё специальные меры для поддержки конкуренции на рынке, сообщает The Register. О грядущем расследовании CMA заявило в конце марта. Регулятора беспокоила практика лицензирования Microsoft программного обеспечения, мешающая конкуренции на рынке облачных сервисов. Сегодня CMA объявило, что «слышало» о том, что британские клиенты не всегда способны эффективно использовать ПО Microsoft с продуктами других вендоров. Это ограничивает возможности доступа к лучшим продуктам по самым конкурентоспособным ценам. В 2025 году AWS и Google призывали (и не в первый раз) регулятора вмешаться в политику Microsoft и ограничить «экстраординарные и беспрецедентные» цены, взимаемые с клиентов за использование продуктов компании на сторонних облачных платформах. Ещё два года назад Google прямо назвала практику запретительного лицензирования по таким ценам «налогом» или «штрафом», который платят клиенты за то, что ПО Microsoft не используется в инфраструктуре Azure. Например, запуск Windows Server в облаке Google обходится до четырёх раз дороже, чем в Azure. С похожими жалобами выступала и AWS.

Источник изображения: UX Indonesia/unspalsh.com CMA оценит, использует ли Microsoft монопольное положение, чтобы ограничить клиентам финансовые возможности выбора, и насколько успешно конкуренты на рынке ИИ могут интегрировать свои сервисы с ПО компании (дело касается агрессивного внедрения Copilot). По словам представителя Open Cloud Coalition, созданной под патронажем Google и раскритикованной Microsoft, новое расследование должно быть «быстрым и окончательным». Утверждается, что оно должно навсегда устранить несправедливые практики лицензирования Microsoft, обеспечив на британском облачном рынке равные условия конкуренции и уверенность в том, что можно будет внедрять инновации и инвестировать в долгосрочной перспективе. Впрочем, результатов не стоит ждать в ближайшее время. Например, CMA потребовался 21 месяц, чтобы опубликовать результаты расследования на облачном рынке услуг Великобритании — утверждалось, что Microsoft и AWS пользуются доминирующим положением, фактически нанося ущерб британским клиентам облачных сервисов. В частности, в нём утверждалось, что Microsoft, возможно, взяла с корпоративных клиентов в Великобритании на £500 млн больше за размещение в облаках AWS и Google, чем если бы они платили за размещение в Azure. В основе того расследования был вопрос, не мешают ли меры лицензирования ПО Microsoft конкуренции на рынке облачных сервисов. Он стал основой и для нынешнего. Последнее расследование должны завершить за девять месяцев, а решение о присвоении компании статуса SMS должны принять к февралю 2027 года. Сама Microsoft заявляет, что полна решимости «оперативно и конструктивно» сотрудничать с CMA. Всестороннее расследование будет касаться ПО для повышения производительности, ОС, СУБД и ИБ-инструментов. В CMA утверждают, что намерены понять, как развиваются соответствующие рынки, какова на них роль Microsoft и какие целенаправленные действия могут потребоваться для того, чтобы у британских клиентов был выбор, доступ к инновациям и конкурентоспособные цены. Стоит отметить, что за лицензионной политикой Microsoft уже следят власти США, Европы, Бразилии, Южной Африки и Японии.

15.05.2026 [12:23], Сергей Карасёв

Cerebras провела крупнейшее IPO в США в 2026 году, получив $5,55 млрдАмериканская компания Cerebras Systems, специализирующаяся на разработке ИИ-ускорителей, провела первичное публичное размещений акций (IPO) на бирже Nasdaq. В ходе процедуры привлечено $5,55 млрд, что стало крупнейшим размещением в США в нынешнем году. Cerebras намеревалась предложить 28 млн обыкновенных акций класса А. Предполагалось, что стоимость бумаг во время IPO составит от $115 до $125. Позднее стало известно, что будут выпущены 30 млн акций по цене $185. Кроме того, Cerebras предоставила андеррайтерам 30-дневный опцион на приобретение до 4,5 млн дополнительных акций класса А по цене IPO за вычетом комиссий. В число организаторов размещения вошли Morgan Stanley, Citigroup, Barclays, UBS Investment Bank, Mizuho, TD Cowen, Needham & Company, Craig-Hallum, Wedbush Securities, Rosenblatt, Academy Securities, Credit Agricole CIB, MUFG и First Citizens Capital Securities. Торги бумагами начались 14 мая 2026 года под тикером CBRS: сразу же после этого их стоимость подскочила на 108% — до $385. Рыночная капитализация Cerebras в первый день торгов превысила $66 млрд. Отраслевые эксперты полагают, что после проведения IPO компания Cerebras сосредоточится на обновлении своего продуктового семейства. Ускорители Cerebras Wafer Scale Engine третьего поколения (WSE-3), дебютировавшие в марте 2024 года, уже изрядно устарели, а конкуренция со стороны других игроков рынка усиливается. Ожидается, что изделия Cerebras WSE-4 обеспечат значительный прирост производительности по сравнению с предшественниками, которые демонстрируют показатель на уровне 125 Пфлопс в разреженных FP16-вычислениях. Предполагается также, что Cerebras увеличит объём памяти SRAM, который у WSE-3 составляет 44 Гбайт. Отмечается, что именно размер памяти является ограничивающим фактором при работе с LLM, оперирующими огромным количеством параметров. Так, для моделей с триллионами параметров, например, Kimi K2, требуется от 12 до 48 ускорителей WSE-3 — в зависимости от способа хранения весов и других характеристик. Таким образом, любое увеличение объёма SRAM позволит значительно повысить эффективность работы ускорителей. На фоне IPO компания Cerebras также может упрочить партнёрские отношения с ведущими облачными провайдерами и разработчиками ИИ-моделей. Напомним, ранее компания заключила соглашение о сотрудничестве с Amazon Web Services (AWS). Вместе с тем OpenAI намерена закупить ускорители Cerebras на $20 млрд.

14.05.2026 [10:00], Владимир Мироненко

«Группа Астра» запустила отечественное облако Astra Cloud на российских Arm-процессорах Baikal-S

arm

astra linux

baikal-s

iaas

software

байкал электроникс

импортозамещение

кии

облако

сделано в россии

частное облако

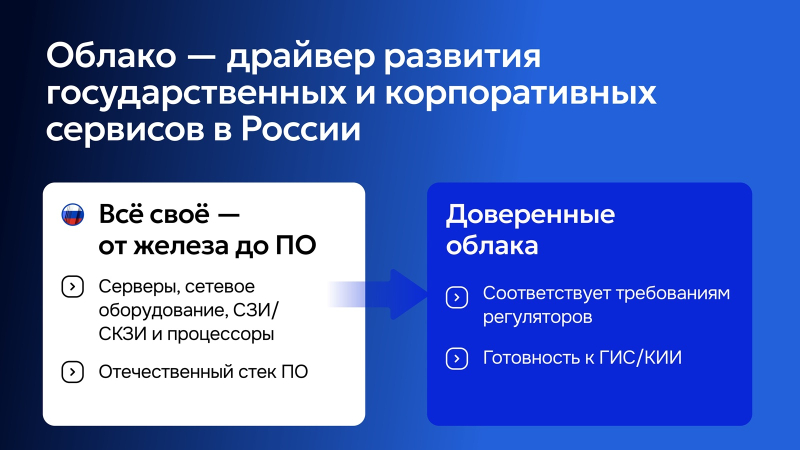

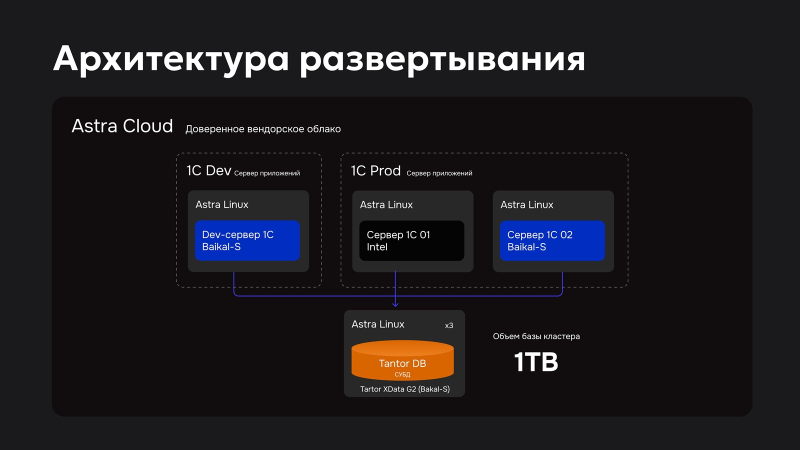

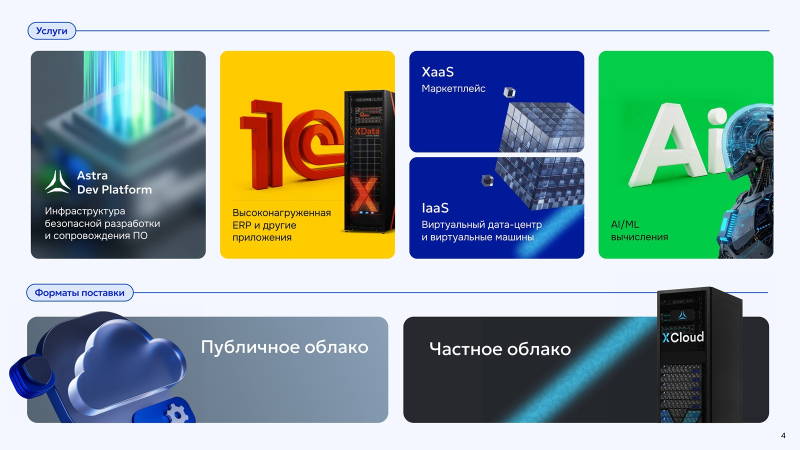

«Группа Астра» объявила о запуске облачного сервиса Astra Cloud, построенного на российских процессорах Baikal-S от компании «Байкал Электроникс» и ориентированного, в первую очередь, на критическую информационную инфраструктуру. Компания подчеркнула, что это первое в стране коммерческое облако, весь технологический стек которого, начиная от чипа и заканчивая конечным сервисом, разработан в России. «Группа Астра» отметила, что ключевым условием формирования суверенной и безопасной среды для субъектов КИИ является использование экосистемного и платформенного подхода, при котором контролируется каждый технологический слой, включая низкоуровневое аппаратное обеспечение. Astra Cloud на Baikal-S призвано обеспечить такую среду российским предприятиям: полная импортонезависимость с полным соответствием на уровне архитектуры регуляторным требованиям, которые вступают в силу с января 2028 года. Генеральный директор Astra Cloud заявил, что компания нацелена на создание сквозной технологию в облаке — от российского центрального процессора до конечного сервиса для использования заказчиком. «Для нас здесь нет выбора между “российским” и “эффективным”. Облако Astra Cloud на Baikal-S — это прямое и честное соответствие мировому Arm-стандарту, и мы даём бизнесу инструмент для спокойного перехода на доверенную инфраструктуру уже сегодня, а не в последнюю ночь перед дедлайном», — сообщил он. Также это один из первых в России облачных сервисов с использованием Arm-архитектуры, отличающейся высокой энергоэффективностью, что снижает операционные расходы, обеспечивая высокую производительность обработки современных облачных нагрузок (AI/ML, СУБД или веб-сервисы) и более низкую совокупную стоимость владения (TCO) по сравнению с x86-решениями, говорит компания. Она отмечает, что Arm-архитектура получила признание среди гиперскейлеров, которые используют её в своих собственных CPU, что в целом укрепляет программную экосистему. У Microsoft есть Arm-процессоры Cobalt 200, у AWS — Graviton 5, у Alibaba Cloud — Yitian 710, а у Google — Axion. Среди крупных независимых поставщиков серверных процессоров можно выделить Ampere Computing (активно используется Oracle), которая теперь принадлежит SoftBank, и Huawei, активно использующую процессоры Kunpeng в своей продукции, в том числе в облаке. Собственные процессоры также готовят сама Arm, Qualcomm и Fujitsu. Последние, как и чипы NVIDIA Vera, ориентированы в первую очередь на ИИ. Компания «Байкал электроникс» поставила в Россию не менее 85 тыс. процессоров собственной разработки, включая модели Baikal-T, Baikal-M и Baikal-S, но из-за санкций производство чипов пришлось прекратить, а также отменить выпуск Baikal-S. Также пришлось отменить планы по старту серийного производства в 2025–2026 гг. 128-ядерных серверных Arm-процессоров второго поколения Baikal-S2. Однако вскоре будут доступны и они. «Группа Астра» также готовит для партнёров и интеграторов совместные пакеты поставки, чтобы обеспечить их не только технологией, но и отлаженными коммерческими сценариями её внедрения. Например, в публичном облаке Astra Cloud с Baikal-S заказчик получит защищённую аттестованную инфраструктуру и приложения в ЦОД Astra Cloud, предоставляемые как сервис, для использования под конкретные бизнес-задачи (от пилота до промышленной нагрузки) без надобности в создании собственной аппаратной площадки. В свою очередь, частное облако на Baikal-S — это выделенная инфраструктура в контуре заказчика для тех, кому важен контроль с максимальной изоляцией данных. Также предлагается ПАК XCloud на Baikal-S — готовая облачная платформа «под ключ», которая разворачивается либо в контуре заказчика по лицензии, либо в ЦОД Astra Cloud по подписке. Пока что предоставляется IaaS (узлы 2 × 48 ядер, 128–768 Гбайт RAM, 1 Тбайт системный диск + HDD/SSD), а в будущем появятся VDI, Kubernets, почтовая служба и т.д. — всё, что запланировано к реализации в платформе Astra Cloud, будет доступно и на Baikal S. В настоящее время облако Astra Cloud на Baikal-S проходит финальную доработку на реальных нагрузках в «Группе Астра». Речь, в частности, о полноценном развёртывании платформы 1С. Ожидается, что до конца июля для избранных клиентов будет открыт пилотный доступ в неаттестованном сегменте с возможностью бесплатного тестирования до конца года. Также в этом году будет запущен аттестованный сегмент с дальнейшим расширением сервисов для разработчиков и коммерческой подписки. Одновременно с облачной инфраструктурой Astra Cloud предоставит готовую платформу разработки, включающую репозитории кода, CI/CD-конвейеры и инструменты безопасной разработки, что позволит заказчикам существенно ускорить адаптацию приложений под архитектуру Baikal-S без необходимости в самостоятельном построении DevOps-цепочек. Также компания планирует в течение этого года дополнить облако Astra Cloud на Baikal-S GPU-серверами для ИИ- и HPC-задач, чтобы позволит запускать ИИ-нагрузки на полностью отечественном стеке без необходимости параллельного использования зарубежных ИИ-облаков для машинного обучения. Для участия в пилоте Astra Cloud на Baikal-S компаниям необходимо заполнить заявку на предтестирование и предзаказ IaaS на Baikal-S, указав планируемые сценарии использования — например, перенос продуктивных нагрузок, разработка и CI/CD, запуск ИИ-задач или отработка сценариев отказоустойчивости. Это позволит компании заранее подобрать конфигурацию ресурсов под реальный профиль заказчика и сопроводить пилот методически. «Группа Астра» выразила уверенность в том, что облако на Baikal-S в ближайшем будущем станет «стандартом для российских значимых объектов, а в горизонте двух-пяти лет — основой для экспорта доверенной инфраструктуры». Компания приглашает к сотрудничеству разработчиков, вендоров в сфере информационной безопасности и облачных интеграторов, которые «видят в технологическом суверенитете пространство для качественного рывка».

14.05.2026 [09:46], Руслан Авдеев

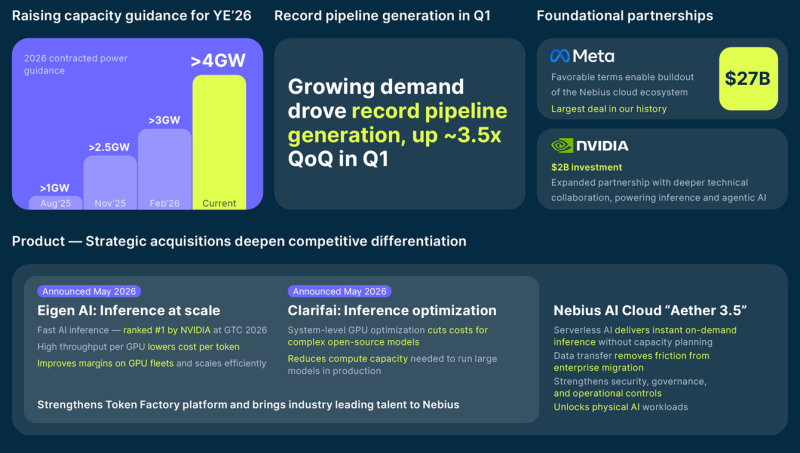

Квартальная выручка Nebius выросла на 684 % год к году, а облачного сегмента — на 841 %Базирующаяся в Нидерландах компания Nebius отчиталась о финансовых результатах I квартала 2026 года, параллельно объявив о проектах ускоренного строительства ИИ-инфраструктуры на основе гигаваттных ИИ-фабрик, масштабных кластерах ускорителей и вертикальной интегрированной платформы для инференса. В отчёте компании упоминается, что она уже имеет более 3,5 ГВт законтрактованных мощностей, к концу 2026 года этот показатель должен вырасти до более 4 ГВт. Дополнительно компания объявила о строительстве нового ИИ-кампуса мощностью 1,2 ГВт в Пенсильвании. Он станет дополнением ранее анонсированного объекта аналогичного масштаба в Индепенденсе (Independence, штат Миссури). Теперь более 75 % контрактной мощности Nebius приходится на собственную инфраструктуру, это отражает стремление к долгосрочному контролю энергоснабжения, земельных активов и операций ИИ ЦОД. Также Nebius раскрыла планы строительства ИИ-фабрики в Финляндии мощностью 310 МВт. Утверждается, что это один из крупнейших специализированных ИИ-объектов в Евросоюзе. Дополнительно объявлено новое расширение колокейшн-мощностей в Испании.

Источник изображения: Nebius На стадии активного строительства находятся ИИ-фабрики в Миссури и Алабаме, ввод в эксплуатацию запланирован на 2027 год. Всего принадлежащие компании мощности ИИ-фабрик оцениваются приблизительно в 3 ГВт на пяти площадках. Nebius продолжает реализовать модель «полностекового» облачного ИИ-провайдера, занимающегося ИИ-инфраструктурой, обучением моделей, инференсом, окрестрацией и агентными ИИ-сервисами. В отчётном квартале компания расширила программное портфолио благодаря сделкам с Tavily, Eigen AI и Clarifai. Также она укрепила взаимодействие с NVIDIA в сфере оптимизации инференса и архитектуры ИИ-фабрик. Ожидается, что к концу текущего года в эксплуатацию введут 0,8–1 ГВт подключённых мощностей, во II полугодии начнут развёртывать системы NVIDIA Vera Rubin NVL72 в ЦОД США и EMEA.

Источник изображения: Nebius В целом в I квартале выручка составила $399 млн (+684 % г/г), выручка облачного ИИ-бизнеса — $389,7 млн (+841 % г/г). Годовая регулярная выручка по подпискам и долгосрочным контрактам (ARR) на конец квартала составила $1,92 млрд, скорректированная EBITDA — $129,5 млн, рентабельность по EBITDA облачного ИИ-бизнеса — 45 %. В минувшем квартале капитальные затраты составили порядка $2,5 млрд, запас наличности — $9,3 млрд. Стратегические инвестиции NVIDIA в компанию составили $2 млрд. По словам главы компании Аркадия Воложа, строительство ведётся не только для удовлетворения текущих потребностей рынка, но и для будущего развития ИИ-индустрии. По мнению экспертов, компания всё активнее преобразуется из облачного стартапа, предоставляющего ИИ-ускорители, в вертикально интегрированного оператора ИИ-инфраструктуры, под контролем которого будут энергетика, земли, ИИ-фабрики и инференс-платформы, причём ставка делается на собственные гигаваттные кампусы с закреплением доступа к ключевым ресурсам для них до того, как ограничения доступа к ним усилятся.

13.05.2026 [19:15], Сергей Карасёв

Curator вошла в число крупнейших ИБ-компаний РоссииРоссийский провайдер облачной защиты от киберугроз Curator вошёл в число крупнейших по выручке ИБ-компаний страны, заняв 31-е место в рейтинге, составленном изданием SecPost. В рейтинге приняли участие более 130 игроков отрасли — разработчики ПО, провайдеры ИБ-сервисов и системные интеграторы. Как показывает статистика участников рейтинга, рынок кибербезопасности в России продолжает расти примерно на 12% в год, однако темпы оказались ниже ожиданий предыдущих лет. Интересная тенденция: компании за пределами топ-10 в среднем растут быстрее лидеров, что свидетельствует об усилении конкуренции в среднем эшелоне рынка. Curator специализируется на облачной защите от DDoS-атак, фильтрации вредоносного бот-трафика и мониторинге BGP-маршрутизации. По собственным данным компании, только в первом квартале 2026 года было зафиксировано четыре атаки мощностью свыше 1 Тбит/с — год назад подобных инцидентов не было вовсе.

13.05.2026 [00:40], Владимир Мироненко

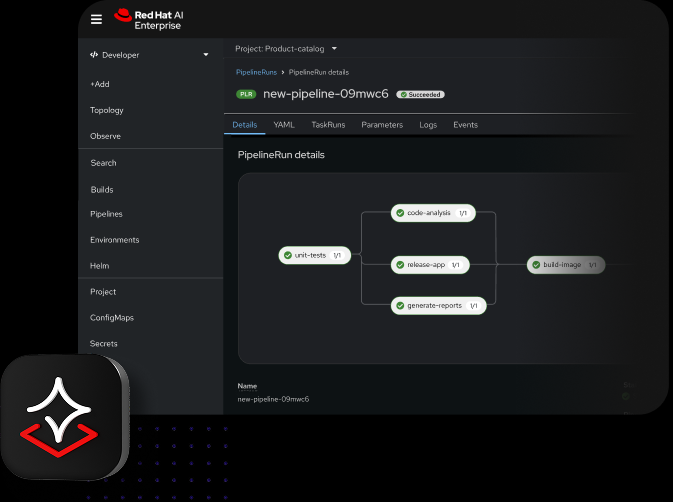

Red Hat анонсировала интегрированную ИИ-платформу Red Hat AI 3.4Red Hat представила Red Hat AI 3.4, обновлённую версию корпоративной ИИ-платформы, разработанную для поддержки крупномасштабного инференса и развёртывания агентного ИИ в гибридных облачных средах. В качестве комплексной платформы Red Hat AI 3.4 предлагает архитектурную основу и операционные инструменты, необходимые для масштабирования моделей и рабочих процессов агентов в гибридном облаке. Стратегия Red Hat в области ИИ разделена на четыре ключевых направления, заявил Джо Фернандес (Joe Fernandes), вице-президент и генеральный директор Red Hat AI. «Во-первых, мы помогаем клиентам быстро, гибко и эффективно выполнять инференс, предоставляя модели в их среде, — передаёт SiliconANGLE. — Во-вторых, мы подключаем их корпоративные данные к этим моделям и агентам. В-третьих, мы помогаем им ускорить развёртывание и управление агентами в гибридной облачной среде. В-четвёртых, мы объединяем всё это на нашей интегрированной ИИ-платформе, позволяя им запускать любую модель в любом агенте на любом оборудовании и в любой облачной среде». Как отметила компания, ключевым элементом этого релиза является предоставление модели как услуги (MaaS), которое обеспечивает единый управляемый интерфейс для разработчиков, позволяющий получать доступ к тщательно отобранным моделям, а администраторам — отслеживать их использование и применять политики. Разработчики получают доступ к моделям через стандартные OpenAI-совместимые API. Таким образом, единое управление применяется как к внутренним, так и к внешним моделям. А инструменты AutoRAG и AutoML автоматизируют сложные задачи ИИ, начиная с выбора наиболее эффективных стратегий извлечения данных для конкретных наборов и заканчивая построением и оптимизацией моделей. В основе системы лежит открытая библиотека vLLM. Её дополняет Kubernetes-нативный стек для инференса llm-d. Поддержка спекулятивного декодирования, которая в этом релизе стала общедоступной, повышает скорость ответа в два-три раза с минимальным влиянием на его качество и снижает стоимость взаимодействия. Кроме того, vLLM теперь поддерживает работу на CPU, что актуально для небольших языковых моделей. Для управления инструментами для агентов Red Hat представляет каталог серверов MCP и связанный с ним шлюз MCP. Новый инструментарий AgentOps даёт возможность управления агентами в масштабе, независимо от используемой платформы, на протяжении всего их жизненного цикла. Это включает в себя интегрированную трассировку вызовов LLM, вызовов инструментов и этапов рассуждений, а также управление криптографической идентификацией через SPIFFE/SPIRE. Последний позволяет организациям заменять статические, жёстко закодированные ключи кратковременными токенами. Это поддерживает операции с минимальными привилегиями для автономных агентов на всех уровнях стека и помогает подтвердить, что действия агентов связаны с проверенной личностью. Для обеспечения интеграции корпоративных данных с моделями и агентами Red Hat AI 3.4 представляет управление с помощью промптов и центр оценки точности, качества и безопасности моделей и агентов. Последний не зависит от фреймворков и заменяет разрозненные методы тестирования единым интегрированным подходом. Prompt Lab and Registry, централизованное хранилище промптов в виде полноценных информационных ресурсов, предоставляет разработчикам и администраторам единый источник достоверной информации о входных данных, управляющих моделями и агентами.

Источник изображения: Red Hat Новые возможности трассировки построены на основе MLflow. Интеграция MLflow обеспечивает прозрачность работы агента, позволяя осуществлять сквозную трассировку вызовов LLM, этапов рассуждений, запуска инструментов, ответов модели и использования токенов через OpenTelemetry. Это создаёт прозрачный журнал аудита для всего жизненного цикла подсказок, эмбеддингов и конфигураций RAG для поддержки отладки и аудита. MLflow также обеспечивает интегрированное отслеживание экспериментов и управление артефактами для сценариев использования генеративного ИИ и прогнозного ИИ. Платформа Red Hat AI позволяет пользователям проверять безопасность моделей и агентов с помощью автоматизированного сканирования на наличие угроз, которое теперь интегрировано непосредственно в цикл разработки. Используются инструменты Chatterbox Labs и Garak. Платформа проверяет модели и агентных систем на наличие таких рисков как взлом, промпт-инъекций и предвзятость, в сочетании с NVIDIA NeMo Guardrails для обеспечения безопасности во время выполнения. Сообщается, что Red Hat AI 3.4 изначально поддерживает ускорители NVIDIA Blackwell и AMD Instinct MI325X. Расширяя эту унифицированную архитектуру платформы для работы непосредственно в управляемых облаках сторонних разработчиков, в том числе посредством Red Hat AI Inference в IBM Cloud, Red Hat обеспечивает операционную согласованность на широком спектре оборудования и облачных провайдеров.

12.05.2026 [15:34], Владимир Мироненко

Broadcom обещает, что VMware Cloud Foundation 9.1 позволит значительно снизить расходы на ИИ-инфраструктуру

broadcom

kubernetes

software

vmware

виртуализация

ии

информационная безопасность

конфиденциальность

частное облако

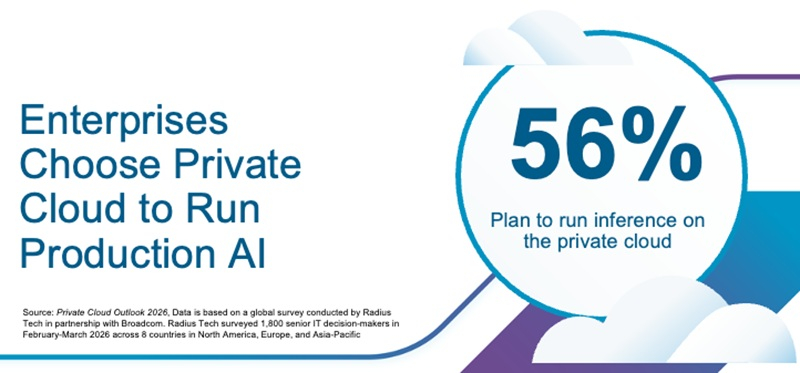

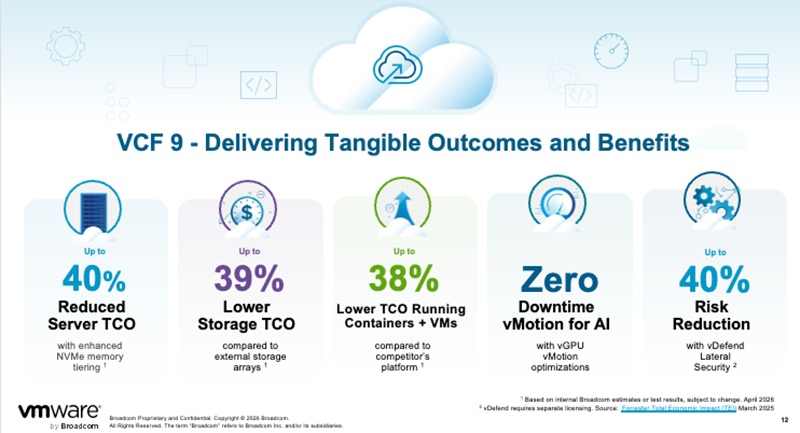

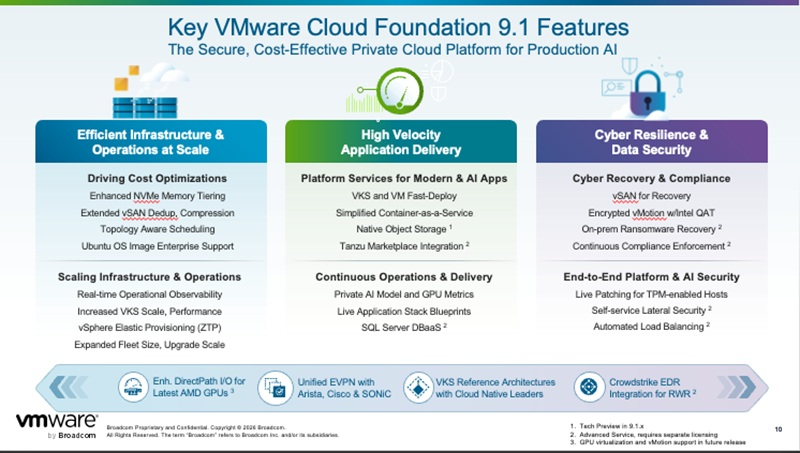

Компания Broadcom анонсировала VMware Cloud Foundation 9.1, позиционируя платформу как основу для частного облака, оптимизированную для ИИ-нагрузок ИИ и Kubernetes, с интегрированной безопасностью и поддержкой смешанной вычислительной инфраструктуры на базе AMD, Intel и NVIDIA. Broadcom отметила, что VCF 9.1 обеспечит предприятиям при запуске производственных рабочих нагрузок, включая инференс и агентный ИИ, ряд преимуществ. В частности, VCF 9.1 обеспечит снижение затрат на серверы до 40 % благодаря интеллектуальному многоуровневому распределению памяти. Эффективность хранения данных также повышается благодаря усовершенствованным методам сжатия и дедупликации в конвейерах обработки данных ИИ, что снижает общую стоимость владения до 39 %. Использование платформы позволяет сократить эксплуатационные расходы Kubernetes до 46 % при одновременном повышении масштабируемости и скорости развёртывания. Преимущества платформы также включают четырёхкратное ускорение обновления кластеров и удвоение мощности парка серверов, что позволяет предприятиям быстрее масштабировать инфраструктуру ИИ в распределённых средах. В VCF 9.1 сделан акцент на поддержке открытой экосистемы. Обеспечены выбор нескольких GPU AMD и NVIDIA, поддержка CPU AMD и Intel, а также совместимость со стандартными сетевыми технологиями, такими как EVPN и VXLAN, и с универсальной облачной сетью Arista Universal Cloud Network. Этот подход позволяет предприятиям комбинировать оборудование в зависимости от требований к рабочей нагрузке и доступности, что в условиях дефицита является важным фактором, отметил ресурс Storagereview.

Источник изображений: VMware Большое внимание в VCF 9.1 уделено автоматизации, благодаря которой обеспечивается удвоение возможностей управление — для 5 тыс. хостов и в четыре раза более быстрое обновление кластеров в распределённых и изолированных средах. Также была улучшена поддержка многопользовательского режима, позволяющая изолировать рабочие нагрузки ИИ между командами или клиентами на общей инфраструктуре со строгими ограничениями безопасности, максимизируя использование дорогостоящих ресурсов GPU и CPU, одновременно поддерживая суверенитет данных для конфиденциальных моделей. Это особенно актуально для поставщиков услуг и крупных предприятий, консолидирующих ИИ-инфраструктуру. Платформа устраняет необходимость во внешних устройствах для конечных точек ИИ-инференса и агентных приложений за счёт интеграции виртуализированных служб балансировки нагрузки и безопасности через VMware Avi Load Balancer и vDefend, позволяя снизить капитальные затраты, сохранив при этом отказоустойчивость приложений и автоматизацию жизненного цикла.  VCF 9.1 получила встроенную систему безопасности на уровне инфраструктуры для защиты рабочих нагрузок ИИ, проприетарных моделей и данных для обучения от гипервизора до приложения. Благодаря сегментации на основе принципа нулевого доверия (Zero Trust), суверенному восстановлению и непрерывному обновлению без дополнительных инструментов VCF обеспечивает уровень безопасности, необходимый для развёртывания ИИ в продуктовой среде. Система поддерживает восстановление после атак программ-вымогателей в локальной среде, обеспечивающее изолированные среды восстановления и интегрированные инструменты проверки, включая поддержку CrowdStrike Falcon Endpoint Security, защищающие ИИ-модели и данные от трансграничного перемещения, без высоких затрат на обеспечение пропускной способности во время восстановления в кризисных ситуациях.  Функции непрерывного соответствия автоматизируют мониторинг и устранение неполадок в соответствии с определёнными политиками, помогая организациям поддерживать готовность к аудиту без дополнительных инструментов. Обновление в режиме реального времени дополнительно снижает операционные риски, позволяя в большинстве случаев обновлять систему без простоев, поддерживая постоянно работающие ИИ-сервисы. Система безопасности с нулевым доверием, расширяющая защиту распределённых IDS/IPS на рабочие нагрузки Kubernetes AI, обеспечивает скорость проверки угроз до 9 Тбит/с для распределённого инференса и в пять раз более высокую идентификацию приложений для частных облачных и интернет-приложений. Как отметил Storagereview, с помощью VCF 9.1 компания пытается перепозиционировать VMware как жизнеспособную платформу для корпоративного ИИ. Акцент на частном облаке, интегрированной безопасности и унифицированных операциях между виртуальными машинами, контейнерами и GPU соответствует запросам многих крупных организаций, которые приближают рабочие нагрузки инференса к своим данным. Вместе с тем современные распределённые конвейеры ИИ строятся на основе архитектур, ориентированных на Kubernetes, со всё более модульными инфраструктурными решениями, которые отдают приоритет гибкости и прямому доступу к ускоренным вычислениям. В таких средах VMware обычно не является плоскостью управления, а во многих случаях становится дополнительным уровнем, а не основой. Кроме того, хотя Broadcom позиционирует VCF 9.1 как способ сократить расходы на инфраструктуру за счёт повышения эффективности, сохраняются обоснованные опасения корпоративных клиентов по поводу условий лицензирования VMware и общей стоимости владения.

12.05.2026 [14:47], Сергей Карасёв

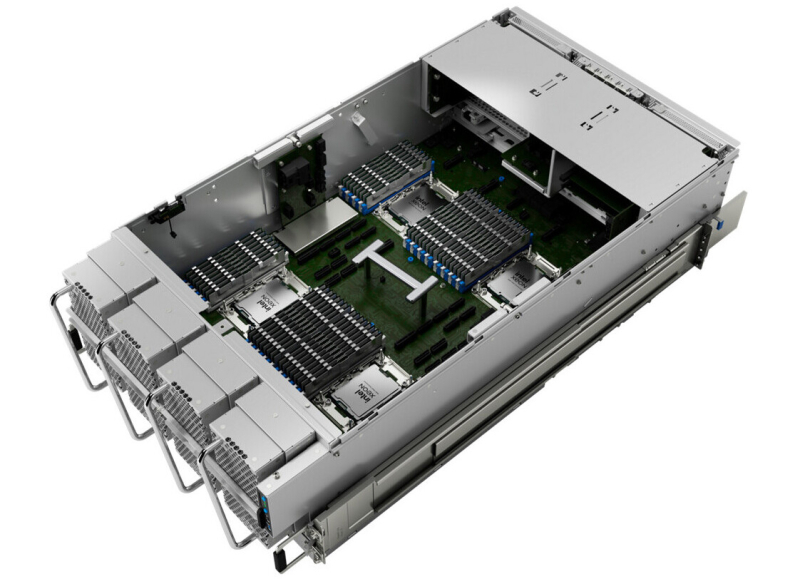

До 64 Тбайт RAM: HPE представила модульный суперсервер Compute Scale-up Server 3250Компания HPE анонсировала сервер Compute Scale-up Server 3250 на аппаратной платформе Intel для нагрузок, которым требуется большой объём оперативной памяти. Это могут быть резидентные базы данных, аналитические приложения, транзакционные платформы и пр. Новинка выполнена на модульной архитектуре, обеспечивающей гибкое масштабирование. Шасси стандарта 5U рассчитано на четыре процессора Intel Xeon 6700P (до 86 ядер). Доступны 64 слота для модулей оперативной памяти DDR5 ёмкостью до 256 Гбайт каждый: таким образом, суммарный объём ОЗУ может достигать 16 Тбайт. В одну систему могут быть объединены до четырёх серверов, что даст 16 CPU и 64 Тбайт RAM. Платформа управляется внешним контроллером узлов, который отвечает за интерконнект. Доступны различные конфигурации слотов PCIe 5.0 для карт расширения: 4 × FH + 2 × LP, 8 × FH + 4 × LP или 16 × LP. В оснащение входят сетевые контроллеры 1GbE и 10GbE/25GbE (SFP28), оптический привод DVD-RW (опционально) и вентиляторы охлаждения с возможностью горячей замены. Подсистема хранения данных базируется на накопителях E3.S (NVMe), количество которых может достигать 24. Есть три порта USB 3.0 Type-A (один располагается во фронтальной части, два — сзади). Габариты сервера составляют 905 × 445 × 219,2 мм, масса — от 40,82 до 56,7 кг в зависимости от комплектации. Диапазон рабочих температур простирается от +5 до +35 °C. Задействованы блоки питания мощностью 2400 Вт с сертификатом 80 Plus Titanium. Реализованы средства управления HPE Integrated Lights-Out (HPE iLO). Отмечается, что Compute Scale-up Server 3250 — это первый масштабируемый сервер HPE на платформе Xeon 6, имеющий модульную архитектуру, оптимизированную для ресурсоёмких вычислительных задач и агентного ИИ. Кроме того, по словам компании, это первая в своём класса система, прошедшая валидацию в бенчмарках SAP BW для платформ с 48+ Тбайт RAM. Приём заказов на новинку уже начался. Производитель предоставляет на систему трёхлетнюю гарантию.

07.05.2026 [17:01], Руслан Авдеев

Iridium анонсировала PNT-решение для безошибочного позиционирования и синхронизации времени Project AuthenticОператор спутниковой связи Iridium готовит новое решение Project Authentic, обеспечивающее точные и устойчивые позиционирование, навигацию и синхронизацию времени (PNT). В данном случае технология предназначена и для дата-центров, сообщает Datacenter Dynamics. Решение объединяет новый метод определения и подтверждения местоположения пользователя с помощью его электронного устройства, сети спутников Iridium и установленного в дата-центре сервера аутентификации. По словам представителя Iridium, новый продукт способен выступить доверенным источником геолокации и аутентификации — пока в этой инновационной сфере конкуренты просто отсутствуют. У компании появилась возможность развивать направление после поглощения за $115 млн бизнеса Satelles в 2024 году — лидера в сфере защищённых спутниковых PNT-решений и технологий защиты GPS/GNSS-систем. Благодаря сделке Iridium получила контроль над продуктом Satellite Time and Location (STL), рассчитанным на цифровую инфраструктуру, включая базовые станции 5G и ЦОД. Относительно недорогое оборудование без внешних антенн даёт возможность защититься от уязвимостей и вмешательств в работу систем спутникового позиционирования. Специальный ASIC не просто обеспечивает синхронизацию времени и определяет геопозицию — с помощью специального сервера можно «аутентифицировать» реальное местоположение устройства и корректно синхронизировать время. Подчёркивается, что ЦОД весьма зависимы от технологии точной синхронизации времени, поскольку высокая точность необходима как для внешних коммуникаций, так и для оркестрации вычислений внутри ЦОД. Крупные дата-центры для это цели используют атомные часы, однако для синхронизации с внешним миром используются сигналы GNSS, которые могут изменены или заглушены. По словам Iridium, с этим уже столкнулись дата-центры в Персидском заливе, которые пострадали не только от физических атак. Iridium подчёркивает, что PNT-решение представляет собой экономически эффективный «резервный источник» точного времени. Нечто подобное используется ключевыми мировыми фондовыми биржами. Компания уверена, что дата-центрам нужен тот же уровень резервирования систем. |

|