Материалы по тегу: nvidia

|

18.02.2026 [18:50], Владимир Мироненко

Власти Индии закупят ещё 20 тыс. ускорителей NVIDIA для ускорения развития ИИ в странеНа проходящем в Нью-Дели саммите India AI Impact Summit министр электроники и информационных технологий Индии Ашвини Вайшнау (Ashwini Vaishnaw) заявил, что Индия расширит свои вычислительные мощности для ИИ-нагрузок свыше имеющихся 38 тыс. ускорители, добавив еще 20 тыс. еди. в ближайшее время в рамках программы «Миссия ИИ 2.0». Вайшнау сообщил ресурсу EE Times, что заказы на новые GPU будут размещены в течение недели, и ожидается, что они будут развёрнуты в течение следующих шести месяцев. Расширение вычислительных мощностей происходит в ходе реализации рамочного соглашения между Индией и США на 2026 год, в соответствии с которым две страны договорились значительно увеличить торговлю технологическими продуктами, включая ускорители и другие компоненты для ЦОД. Соглашение предусматривает намерение Индии закупить в течение пяти лет американские энергоносители, самолёты, технологические товары и критически важные материалы на сумму $500 млрд, расширяя при этом совместное технологическое сотрудничество. Заявление Вайшнау говорит о дальнейшем развитии программы IndiaAI Mission, утверждённой в марте 2024 года с бюджетом около $1,14 млрд на пять лет. Первоначально программой планировалось развёртывание 10 тыс. GPU, но их количество уже достигло 38 тыс. Ускорители предоставляются местным компаниям по субсидированной ставке ₹65/час (около $0,72/час). С момента запуска в рамках программы IndiaAI Mission разрабатывались семь основных направлений, включая субсидированные вычислительные ресурсы, разработку базовых моделей, финансирование стартапов и безопасное управление ИИ. Двенадцать стартапов уже были отобраны для разработки отечественных многомодальных базовых моделей с использованием специфических для Индии наборов данных. NVIDIA сообщила о поддержке приоритетов IndiaAI Mission, включая, расширение вычислительных мощностей благодаря поставке ускорителей NVIDIA, разработку передовых ИИ-моделей и исследования и инновации в области ИИ. В рамках программы IndiaAI Mission компания сотрудничает с поставщиками облачных услуг Yotta, L&T и E2E Networks для создания передовых ИИ-фабрик. Yotta — поставщик облачных услуг, создающий крупномасштабную суверенную ИИ-инфраструктуру для Индии под брендом Shakti Cloud, работающую на базе более чем 20 тыс. ускорителей NVIDIA Blackwell Ultra. Его кампусы в Нави Мумбаи (Navi Mumbai) и Большой Нойде (Greater Noida) предоставляют индийским предприятиям и госсектору услуги облачных ИИ-сервисов с высокой пропускной способностью и большим количеством GPU с оплатой по мере использования. В свою очередь, компания E2E Networks создаёт кластер ускорителей NVIDIA Blackwell на своей платформе TIR, размещённый в ЦОД L&T Vyoma в Ченнаи (Chennai). Облачная платформа TIR будет включать системы NVIDIA HGX B200 и корпоративное ПО NVIDIA, а также открытые модели NVIDIA Nemotron для ускорения развития ИИ в таких областях, как агентный ИИ, здравоохранение, финансы, производство и сельское хозяйство. Третий индийский партнёр NVIDIA на ИИ-рынке — компания Netweb Technologies, которая запускает суперкомпьютерные системы Tyrone Camarero AI, построенные на узлах NVIDIA GB200 NVL4, произведённых в рамках государственной программы «Сделано в Индии». Сообщается, что облачная ИИ-инфраструктура в Индии будет размещать рабочие нагрузки, а также обеспечивать интеллектуальные возможности для обучения моделей, тонкой настройки и масштабного инференса. Мощности в этих ЦОД будут зарезервированы для разработчиков моделей, стартапов, исследователей и предприятий для создания, тонкой настройки и развёртывания ИИ в Индии. Ранее глава OpenAI Сэм Альтман (Sam Altman) заявил, что Индия способна стать одним из мировых ИИ-лидеров, особенно в создании малых рассуждающих моделей (SLM).

18.02.2026 [09:19], Сергей Карасёв

Meta✴ развернёт ИИ-инфраструктуру на «миллионах ускорителей NVIDIA Blackwell и Rubin», а также Arm-чипах GraceКомпании NVIDIA и Meta✴ объявили о многолетнем стратегическом партнёрстве, охватывающем локальную, облачную и ИИ-инфраструктуры. В частности, Meta✴ будет использовать в своих дата-центрах решения NVIDIA как для обучения больших языковых моделей (LLM), так и для инференса. Сообщается, что Meta✴ возьмёт на вооружение чипы NVIDIA Grace, которые будут использоваться в серверах, основанных исключительно на CPU-архитектуре (без ускорителей на основе GPU). Изделия Grace, напомним, объединяют 72 вычислительных ядра Armv9 Neoverse V2 (Demeter) с тактовой частотой до 3,35 ГГц и до 480 Гбайт памяти LPDDR5x. Доступна также сборка Grace Superchip, которая состоит из двух кристаллов Grace и чипов памяти LPDDR5x общим объёмом до 960 Гбайт. Meta✴ намерена применять изделия Grace для решения общих задач, а также поддержания работы ИИ-агентов, которым не требуются ИИ-ускорители. Вице-президент NVIDIA Иэн Бак (Ian Buck) отмечает, что решения Grace способны обеспечить вдвое большую производительность на 1 Вт при выполнении операций общего назначения по сравнению с альтернативными платформами. В дальнейшем Meta✴ планирует использовать Arm-процессоры NVIDIA следующего поколения — решения Vera. Крупномасштабные развёртывания систем на базе Vera намечены на 2027 год, что поможет Meta✴ в развитии энергоэффективных вычислений и формировании широкой экосистемы Arm.

Источник изображения: Meta✴ Кроме того, в рамках партнёрства Meta✴ будет использовать «миллионы ускорителей NVIDIA Blackwell и Rubin». Так, на основе изделий NVIDIA GB300 компании создадут единую среду, охватывающую локальные дата-центры и облачные ресурсы, что позволит упростить операции при одновременном улучшении производительности и масштабируемости. Среди прочего Meta✴ будет применять сетевую платформу NVIDIA Spectrum-X Ethernet и технологию NVIDIA Confidential Computing для защиты данных. «Мы рады расширить партнёрство с NVIDIA с целью создания передовых кластеров на основе платформы Vera Rubin — это позволит предоставить персональный суперинтеллект каждому человеку в мире», — говорит Марк Цукерберг (Mark Zuckerberg), основатель и генеральный директор Meta✴. Нужно отметить, что среди гиперскейлеров только Meta✴ и Oracle используют в своих инфраструктурах сторонние чипы с архитектурой Arm. В то же время AWS, Google и Microsoft развивают собственные Arm-проекты — изделия Graviton, Axion и Cobalt соответственно.

14.02.2026 [12:45], Владимир Мироненко

NVIDIA арендует «подсудный» ЦОД, строящийся на средства от продажи «мусорных» облигацийNVIDIA собирается арендовать дата-центр, который будут строить на средства, полученные от продажи «мусорных» облигаций (junk bond — высокодоходные ценные бумаги компании с кредитным рейтингом ниже инвестиционного уровня или без рейтинга), сообщил Bloomberg со ссылкой на информированные источники. NVIDIA не смущает даже то, что этот проект был предметом судебных разбирательств на протяжении всего 2025 года. Согласно документам, с которыми ознакомилось агентство Bloomberg, договор аренды NVIDIA рассчитан на 16 лет с возможностью продления ещё на два периода по 10 лет каждый. Речь идёт о кампусе мощностью 200 Вт, строящемся компанией Fleet Data Centers, входящей в состав Tract Capital, в округе Стори (штат Невада). Fleet Data Centers продаст облигации на сумму $3,8 млрд для финансирования части строительства ЦОД. Сообщается, что в четверг объём сделки по облигациям был увеличен на $150 млн, что свидетельствует о высоком спросе. По словам источников, обсуждается возможность получения доходности около 6%. Из-за низкого рейтинга, обуславливающего высокий риск, связанный с покупкой таких ценных бумаг, продавец вынужден повышать доходность, чтобы привлечь покупателей. Fleet Data Centers была основана в январе 2026 года с целью создания крупномасштабных кампусов с приоритетом на проекты с одним заказчиком мощностью 500 МВт и более, сообщил Data Center Dynamics. Fleet 1 — это первый фонд компании, созданный в рамках SV RNO Property Owner 1. Ожидалось, что Fleet 1 внесет в проект около $620 млн, а средства от продажи облигаций в размере $3,8 млрд будут использованы для финансирования строительства. Как сообщает Bloomberg, средства от дополнительного заёмного капитала по облигационной сделке будут использованы для уменьшения суммы собственного капитала Fleet 1. В сделке также участвуют JPMorgan Chase & Co., возглавляющая сделку, совместно с Morgan Stanley и другими банками. В состав Tract Capital входит компания Tract, базирующаяся в Колорадо и основанная бывшим генеральным директором Cologix Грантом ван Ройеном (Grant van Rooyen). Tract приобретает, зонирует, получает разрешения и развивает «комплексно спланированные» кампусы ЦОД. Компания объявила о планах по развитию территории в округе Стори в октябре 2023 года, а в июне 2024 года приобрела дополнительные участки земли, в результате чего общая площадь её земельных владений в этом регионе превысила 4,45 га. Проект стал предметом судебного спора со Switch из-за его близости к её кампусу. Согласно соглашению Switch с властями, в этом районе запрещается строительство колокейшн-ЦОД. Tract утверждает, что строящийся ЦОД представляет собой объект для одного арендатора, облачного клиента или оптовой продажи мощностей, и, следовательно, не нарушает условий соглашения. NVIDIA управляет собственными ЦОД, а также арендует вычислительные мощности у облачных провайдеров, таких как AWS и Microsoft Azure. Компания также заключила соглашения аренды с неооблаками, включая CoreWeave и Lambda.

11.02.2026 [13:38], Руслан Авдеев

Армения получит ещё 41 тыс. NVIDIA GB300 для ИИ ЦОД Firebird за $4 млрдАмериканская компания Firebird, специализирующаяся на облачных и инфраструктурных решениях для ИИ, объявила о реализации второго этапа суперкомпьютерного мегапроекта в Армении. Она получила экспортные лицензии США и разрешения регуляторов на поставку в страну ещё 41 тыс. ускорителей NVIDIA GB300, сообщает HPC Wire. Расширение вычислительного кластера в Армении знаменует собой важную веху. Предполагается, что страна войдёт в пятёрку мест размещения крупнейших кластеров ИИ-ускорителей. Проект стоимостью $4 млрд — одно из крупнейших капиталовложений в технологическую сферу в истории страны. Подробности в ходе визита в Ереван раскрыл вице-президент США Джей Ди Вэнс (JD Vance) при участии вице-президента NVIDIA. По словам Вэнса, США «с гордостью» одобрили замечательное техническое соглашение с NVIDIA. Речь идёт об открытии новых рынков и новых рабочих мест как для американских работников, так и для армянских. 8 августа прошлого года Армения и США подписали меморандум в сфере ИИ и полупроводников. Выданная США экспортная лицензия свидетельствует о том, что проект полностью соответствует американским требованиям. Второй этап — продолжение реализации плана Firebird, выделившей $500 млн на создание в Армении первого ИИ-кластера. Реализация двух этапов обеспечит качественный скачок в технологической инфраструктуре страны. Он позволит проводить исследования в биологии, робототехнике, космической сфере и в сфере ИИ нового поколения. По словам представителей Firebird, новый кластер превращает Армению в глобальный центр суперкомпьютерных вычислений.

11.02.2026 [08:42], Руслан Авдеев

Австралийское неооблако Firmus привлекло $10 млрд в кредит для строительства ИИ-фабрик Project SouthgateАвстралийский неооблачный провайдер Firmus привлёк в кредит $10 млрд. Главными участниками кредитного соглашения стали инвестиционные компании Blackstone и Coatue, сообщает Datacenter Dynamics. По словам Firmus, финансирование позволит развернуть ИИ-фабрики на основе эталонной архитектуры NVIDIA по всей Австралии. Новый план — часть проекта Southgate, реализуемого Firmus в рамках стратегического партнёрства с CDC Data Centres и NVIDIA. Firmus была основана в 2019 году и поначалу специализировалась на криптовалютах и HPC, а также системах иммерсионного охлаждения. Неооблачная компания заявила, что речь идёт об одной из «крупнейших частных сделок по привлечению заёмных средств» за всю историю Австралии. Представитель Blackstone сообщил, что инструменты, стоящие за революцией в сфере ИИ — одно из наиболее перспективных инвестиционных направлений, и Австралия сможет сыграть центральную роль в развитии ИИ-инфраструктуры. Firmus подчеркнула, что благодаря Blackstone и Coatue она поможет удовлетворить растущий спрос на вычислительные мощности для ИИ в мире и создать долгосрочные выгоды как для клиентов, так и для местной экономики в целом. Стоит отметить, что Blackstone владеет крупным региональным оператором ЦОД AirTrunk.

Источник изображения: Firmus Firmus впервые упомянула Project Southgate в сентябре 2025 года в описании ИИ-кампуса в городе Лонсестон (Launceston, Тасмания). На тот момент компания заявляла, что совместный с правительством Тасмании проект к 2026 году обеспечит создание ИИ-инфраструктуры мощностью 90 МВт. Месяцем позже Firmus сообщила, что проекта расширят и на материковую Австралию при содействии CDC Data Centres. Предполагается развёртывание дополнительных объектов в Сиднее, Канберре, Мельбурне и Перте. В ноябре 2025 года сообщалось о привлечении для Project Southgate AU$500 млн ($351 млн). В последнем заявлении Firmus объявила о строительстве нескольких ИИ-фабрик в Австралии, где планируется развернуть тысячи ИИ-ускорителей — общая мощность к 2028 году должна достигнуть 1,6 ГВт. Каждая ИИ-фабрика будет учитывать современные требования к энергоэффективности и параметрам генерации токенов, чтобы удовлетворять потребности самых требовательных клиентов со всего мира. Подчёркивается, что Австралия имеет конкурентоспособный «энергетический профиль» и квалифицированные кадры.

10.02.2026 [13:01], Руслан Авдеев

Tower Semiconductor и NVIDIA объединились для создания 1,6-Тбит/с трансиверов на основе кремниевой фотоникиTower Semiconductor объявила, что работает с NVIDIA над созданием оптических модулей, предназначенных для ИИ-инфраструктуры нового поколения и способных передавать данные со скоростью до 1,6 Тбит/с. Для этого будет применяться производственная платформа Tower Semiconductor для кремниевой фотоники (SiPho), сообщает Converge! Digest. Взаимодействие ориентировано на обеспечение высокоскоростных оптических подключений в комбинации с сетевыми протоколами NVIDIA. Tower Semiconductor объявила, что её платформа SiPho может обеспечивать показатели вдвое лучшие, чем предыдущие решения на основе кремниевой фотоники, для обучения ИИ и инференса. Компания позиционирует свою технологию производства как основу для оптических трансиверов и сетевых компонентов, используемых в крупных ЦОД, где оптические решения всё активнее заменяют электрические кабели и применяются на более коротких расстояниях. Источник изображения: Igor Omilaev/unsplash.com По словам Tower Semiconductor, компания продолжает инвестиции в кремний-германиевые решения (SiGe) и кремниевую фотонику в целом. ИИ-решения уже требуют внедрения 800G-интерконнектов, поэтому нужны готовые технологии на основе кремниевой фотоники для выпуска 1,6-Тбит/с решений. Стоит отметить, что в декабре 2025 года появилась новость о том, что NVIDIA в рамках своей стратегии развития зарезервировала крупные объёмы продукции у ключевых поставщиков EML-лазеров, что привело к увеличению сроков их поставки другим клиентам — не ранее 2027 года. В связи с этим производители оптических модулей и облачные провайдеры вынуждены заниматься поиском вторичных поставщиков и альтернативных решений.

07.02.2026 [17:23], Руслан Авдеев

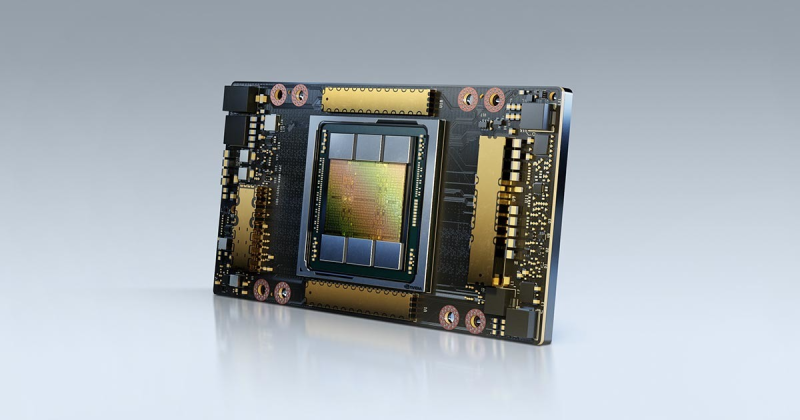

AWS: ни один сервер с NVIDIA A100 не выведен из эксплуатации, а некоторые клиенты всё ещё используют Intel Haswell — не всем нужен ИИПо словам главы AWS Мэтта Гармана (Matt Garman), клиенты до сих пор использует серверы на основе ИИ-ускорителей NVIDIA A100, представленных в 2020 году. Отчасти это происходит потому, что спрос на вычислительные ресурсы превышает предложение, так что устаревшие чипы по-прежнему востребованы, передаёт Datacenter Dynamics. По словам Гармана, все ресурсы фактически распроданы, а серверы с A100 из эксплуатации никогда не выводились. Комментарии Гармана перекликаются с прошлогодним заявлением Амина Вахдата (Amin Vahdat), отвечающего в Google за ИИ и инфраструктуру. По его словам, в Google одновременно работают семь поколений тензорных ускорителей (TPU). Ускорители возрастом семь-восемь лет загружены на 100 %, а спрос на TPU так высок, что Google вынуждена отказывать некоторым клиентам. Впрочем, оба топ-менеджера, возможно, несколько кривят душой и пытаются развеять опасения инвесторов относительно того, что ИИ-ускорители, на которые тратятся огромные деньги, через два-три года придётся выкинуть, чтобы купить более современные, энергоэффективные и, конечно же, дорогие. И что за это время они не успеют окупиться. Хотя Гарман назвал главной причиной сохранения работы серверов на A100 высокий спрос, он признал, что есть и другие причины. В частности, современные ИИ-чипы снижают точность вычислений с плавающей запятой. В результате некоторые клиенты попросту не могут перейти на Blackwell или вовсе вынуждены использовать Intel Xeon Haswell десятилетней давности для HPC-подобных вычислений, поскольку точности у современных ИИ-ускорителей недостаточно. В июне 2025 года AWS заявила о снижении цены доступа к устаревшим NVIDIA H100, H200 и A100 на своей платформе, причём для A100 стоимость снизилась на треть.

Источник изображения: NVIDIA Стоит отметить, что «устаревшие» ускорители долго остаются востребованными, поскольку всё равно обладают большой производительностью. Наиболее яркий пример — разрешение на поставку в Китай чипов NVIDIA H200. Хотя США и их союзники готовятся к внедрению ускорителей поколения Vera Rubin, китайский бизнес готов покупать H200, поскольку те значительно производительнее, экономически выгоднее и удобнее отечественных ускорителей.

03.02.2026 [17:15], Руслан Авдеев

OpenAI не устроили чипы NVIDIA для инференса, теперь она ищет альтернативыПо данным многочисленных отраслевых источников, компания OpenAI недовольна некоторыми ИИ-чипами NVIDIA и с прошлого года ищет им альтернативы. Потенциально это усложнит отношения между крупнейшими игроками рынка на фоне бума ИИ, сообщает Reuters. Изменения стратегии OpenAI связаны с усилением акцента на инференсе. NVIDIA доминирует в нише ускорителей для обучения ИИ-моделей, но теперь инференс стал отдельным рынком с сильной конкуренцией. Решение OpenAI — вызов доминированию NVIDIA в сфере ИИ и препятствие $100-млрд сделки между компаниями, обеспечивающей разработчику чипов долю в ИИ-стартапе в обмен на доступ к передовым ускорителям. Предполагалось, что сделка будет закрыта за недели, но вместо этого переговоры ведутся месяцами. В то же время OpenAI заключила соглашение с AMD и Cerebras (её в своё время даже хотели купить) для получения «альтернативных» чипов, а также разрабатывает собственный ИИ-ускоритель при участии Broadcom. Amazon тоже не прочь предоставить OpenAI собственные ускорители, равно как и Google. Изменение планов OpenAI изменило и потребности в вычислительных мощностях и замедлило переговоры с NVIDIA. В минувшую субботу глава NVIDIA Дженсен Хуанг (Jensen Huang) опроверг слухи о проблемах с OpenAI, назвав их «чепухой» и подчеркнув, что клиенты продолжают выбирать NVIDIA для инференса, поскольку компания обеспечивает наилучшее соотношение производительности и совокупной стоимости владения, причём в больших масштабах. Отдельно представитель OpenAI заявлял, что компания полагается на NVIDIA для поставок большинства чипов для инференса, причём именно NVIDIA обеспечивает наилучшую производительность на каждый вложенный доллар. Глава OpenAI Сэм Альтман (Sam Altman) отметил, что NVIDIA выпускает «лучшие чипы в мире» и есть надежда, что OpenAI останется её «гигантским» клиентом очень долгое время. При этом, как сообщает Reuters со ссылкой на семь источников, OpenAI не удовлетворена производительностью инференса, на которую способны чипы NVIDIA. В частности, речь идёт о специализированных задачах вроде разработки ПО с помощью ИИ и коммуникаций ИИ с другим ПО. По данным одного из источников, компании понадобится новое аппаратное обеспечение, которое в конечном счёте обеспечит в будущем порядка 10 % вычислительных мощностей для инференса. OpenAI обсуждала возможности работы с ИИ-стартапами, включая Cerebras и Groq для обеспечения чипов с более быстрым инференсом, но NVIDIA фактически поглотила Groq на $20 млрд, что привело к прекращению переговоров с компанией. Хотя формально речь идёт неэксклюзивном лицензировании технологий Groq, что в теории позволяет сторонним компаниям получить доступ к решениям Groq, фактически все разработчики перешли в NVIDIA, а оставшаяся небольшая команда отвечает за выполнение облачных контрактов с имеющимися заказчиками. Чипы NVIDIA хорошо подходят для обработки больших объёмов данных при обучении больших ИИ-моделей вроде тех, что стоят за ChatGPT. Тем не менее прогресс требует массового использования уже обученных моделей для дальнейшего инференса и ИИ-рассуждений. Как сообщается, OpenAI с 2025 года ищет альтернативы ускорителям NVIDIA с упором на компании, создающие чипы с большими объёмами интегрированной SRAM. Maia 200 от Microsoft, по-видимому, компании не очень подходит. Инференс моделей более требователен к памяти, чем обучение, а вычислительная нагрузка, наоборот, не так велика. В тоге нередко на доступ к данным уходит больше времени, чем на расчёты. NVIDIA и AMD полагаются на внешнюю память, что замедляет соответствующие процессы общения с чат-ботами. В OpenAI проблемы отметили при эксплуатации системы Codex, активно продвигаемой компанией для создания кода. В компании считают, что некоторые слабости системы связаны именно с оборудованием NVIDIA. Конкуренты OpenAI полагаются на альтернативное оборудование. Anthropic активно использует AWS Trainium и Google TPU, а Google уже много лет использует свои TPU, которые с недавних пор готова отдавать на сторону. TPU оптимизированы в том числе для инференса и в некоторых отношениях более производительны, чем GPU общего назначения AMD и NVIDIA. Когда OpenAI недвусмысленно выразила отношение к технологиям NVIDIA, та предложила компаниям, создающим ускорители с упором на SRAM, включая Cerebras и Groq, купить их бизнес. Cerebras отказалась и заключила прямую сделку с OpenAI. Groq вела переговоры с OpenAI о предоставлении вычислительных мощностей, что вызвало интерес у инвесторов, оценивших капитализацию компании на уровне $14 млрд.

29.01.2026 [10:39], Руслан Авдеев

NVIDIA, Microsoft и Amazon ведут переговоры об инвестициях до $60 млрд в OpenAINVIDIA, Microsoft и Amazon ведут переговоры о новых инвестициях в OpenAI. Предполагается, что компании готовы вложить в бизнес партнёра до $60 млрд, сообщает The Information. Как заявляет The Information со ссылкой на «лицо, знакомое с ситуацией», NVIDIA — действующий инвестор, чьи чипы активно используются для работы с ИИ-моделями OpenAI, ведёт переговоры о том, чтобы вложить до $30 млрд. Microsoft, давно поддерживающая OpenAI, также ведёт переговоры, но готова потратить лишь менее $10 млрд. При этом Amazon (AWS), готовая стать новым инвестором, обсуждает о вложении значительно больше $10 млрд, потенциально — даже более $20 млрд. Сообщается, что OpenAI близка к тому, чтобы получить юридически не обязывающие меморандумы о договорённостях (term sheets) или инвестиционные обязательства от названных компаний. NVIDIA, Microsoft, Amazon и OpenAI пока новости не комментируют. Ранее сообщалось, что SoftBank Group ведёт переговоры об инвестициях дополнительных $30 млрд в OpenAI. Масштаб инвестиций Amazon может зависеть от отдельных переговоров, предусматривающих возможное расширение сделки по аренде облачных серверов у Amazon компанией OpenAI и заключение коммерческого соглашения о продаже OpenAI своих продуктов — Amazon может оформить корпоративные подписки на ChatGPT. Сейчас OpenAI пытается бороться с ростом цен на обучение и эксплуатацию своих ИИ-моделей на фоне ужесточающейся конкуренцией с компанией Google и более мелкими игроками. Впрочем, плохо контролируемые инвестиции могут быть весьма опасными. Так, американские банки уже крайне неохотно дают деньги Oracle, из-за уже имеющихся обязательств последней перед OpenAI. На днях сообщалось, что OpenAI готовит крупнейший в своей истории раунд финансирования на $50 млрд при участии инвесторов Ближнего Востока.

29.01.2026 [10:20], Руслан Авдеев

Конец неопределённости: Пекин одобрил импорт NVIDIA H200Китайские власти начали выдавать разрешения на импорт в страну ИИ-ускорителей NVIDIA H200. Это положит конец неопределённости, царившей после того, как поставки второго по производительности чипа NVIDIA в Поднебесную одобрили представители американских властей, сообщает гонконгская SCMP. Первая партия, как сообщают источники, поступит местным техногигантам, остро нуждающимся в передовых ускорителях. Впрочем, ожидается, что поддерживаемые государством компании вроде телеком-операторов, смогут покупать такие чипы только под жёстким контролем. Пока одобрены поставки более 400 тыс. ускорителей компаниям ByteDance, Alibaba Group Holding и Tencent Holdings, прочие бизнесы продолжают ожидать получения разрешений. В самой NVIDIA новости не комментируют. Это важные изменения китайской политики после того, как Пекин временно придержал поставки H200 ранее в январе 2026 года уже после того, как Вашингтон одобрил экспорт. Это отражает желание китайских властей сохранить баланс между необходимостью покупать передовые ИИ-чипы и стремлением добиться самодостаточности в этой сфере.

Источник изображения: NVIDIA По мнению экспертов, неограниченный доступ к закупкам чипов NVIDIA нанёс бы удар местной китайской индустрии ИИ-полупроводников. Поэтому регуляторам необходимо установить некоторые рамки для ограничения доли использования ИИ-ускорителей иностранного производства и управления спросом. Ранее допускалось, что китайские компании обяжут закупать определённое количество чипов местного производства при покупке H200 у NVIDIA. По мнению экспертов Национального университета Сингапура, одобрение Пекином импорта H200 вызвано стратегическими мотивами — это обеспечит дальнейшее ускоренное развитие китайских ИИ-технологий. Стоит отметить, что разрешение на поставки H200 довольно прохладно принято многочисленными политическими и бизнес-группами в США. Например, глава компании Anthropic сравнил такие продажи с поставками ядерного оружия Северной Корее. |

|