Материалы по тегу: ии

|

20.01.2026 [17:15], Сергей Карасёв

«Базальт СПО» приглашает на XXI ежегодную конференцию «Свободное программное обеспечение в высшей школе»«Базальт СПО» совместно с Институтом программных систем им. А.К. Айламазяна РАН проводит XXI Ежегодную конференцию «Свободное программное обеспечение в высшей школе» (OSEDUCONF). Мероприятие пройдёт 6–8 февраля 2026 года в г. Переславле-Залесском на базе ИПС РАН. Ведущие учёные, педагоги, разработчики и администраторы расскажут об опыте внедрения СПО и организации образовательного процесса, создания благоприятных условий для вовлечения студентов в реальные проекты разработки свободных программных продуктов. Оргкомитет принимает заявки на доклады по следующим темам:

Сроки подачи заявок Для слушателей:

Участие бесплатное. Онлайн-трансляция конференции будет доступна на VK Видео и странице конференции. Зарегистрироваться на конференцию и ознакомиться с информацией о форматах и шаблонах тезисов можно на сайте. По вопросам, связанным с докладами, тезисами, программой конференции, регистрацией, размещением, трансфером можно обратиться к организаторам по электронной почте conference@lists.altlinux.org.

20.01.2026 [13:02], Руслан Авдеев

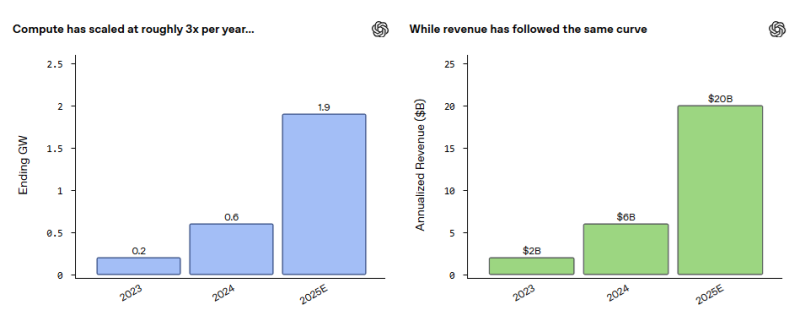

Мощность ИИ ЦОД OpenAI утроилась в 2025 году, достигнув 1,9 ГВтOpenAI Group PBC раскрыла информацию о финансовых показателях и ходе строительства дата-центров. По последним данным, её годовой регулярный доход (ARR), поступающий в основном от подписок, достиг в 2025 году $20 млрд. Для сравнения, в 2024 году он составлял $6 млрд, а годом ранее — $2 млрд. Мощность ЦОД выросла с 200 МВт до 1,9 ГВт, сообщает Silicon Angle. Синхронный рост доходов и вычислительных мощностей приблизительно на порядок за последние три года — не случайность. Представитель компании объявил, что OpenAI увязывает инвестиции в ЦОД по мере роста OpenAI с учётом достигнутых результатов и показателей спроса. Это позволяет избежать инвестиций в будущее, не обеспеченных реальными доходами.

Источник изображения: Jonathan Kemper/unsplash.com В OpenAI заявили, что компания работает не только над расширением ИИ-инфраструктуры, но и над тем, чтобы сделать её более экономически эффективной. Так, OpenAI снизила стоимость инференса до менее $1 за миллион токенов, отчасти благодаря комбинированному использованию оборудования разных типов. Сообщается, что передовые модели обучаются на наиболее производительном оборудовании, а масштабные нагрузки инференса приходятся на более дешёвую инфраструктуру. О каких именно чипах для недорогой инфраструктуры идёт речь, пока не сообщалось, но не исключено, что компания на деле использует такие же дорогие новейшие ускорители, как и при обучении. Дело в том, что самые производительные ИИ-чипы являются и самыми экономически эффективными. Поиск способов снизить стоимость оборудования в будущем, вероятно, станет даже большим приоритетом для OpenAI. В сентябре появилась информация, что компания закончит 2025 год с убытками $8 млрд, на $1,5 млрд выше, чем ожидалось изначально. В 2026 году, по некоторым оценкам, убытки составят $17 млрд. Некоторые источники свидетельствуют, что попытки компании разработать кастомные чипы и строить дата-центры — часть плана по снижению стоимости инфраструктуры. В 2025 году OpenAI подписала соглашение с Broadcom на $10 млрд о разработке собственных ИИ-ускорителей. Отдельно компания работает с подконтрольным SoftBank Group бизнесом SB Energy над строительством дата-центров Stargate на основе индивидуального проекта. Последние данные топ-менеджеров компании позволяют составить представление о долгосрочных планах обеспечения роста выручки. В частности предполагается, что на рынке ИИ будут развиваться новые модели монетизации. Речь идёт о «лицензировании, соглашениях на основе интеллектуальной собственности и ценообразовании, ориентированном на результат». Ещё один важнейший компонент стратегии роста OpenAI — реклама. В OpenAI подчёркивают, что планы развития компании также отдают приоритет использованию ИИ-агентов и прочим инструментам автоматизации рабочих процессов. Компания, как утверждается, акцентирует внимание на помощи пользователям в автоматизации задач в самых разных сферах. Ещё один приоритет — обеспечение моделям более длинного контекста диалогов.

20.01.2026 [12:12], Сергей Карасёв

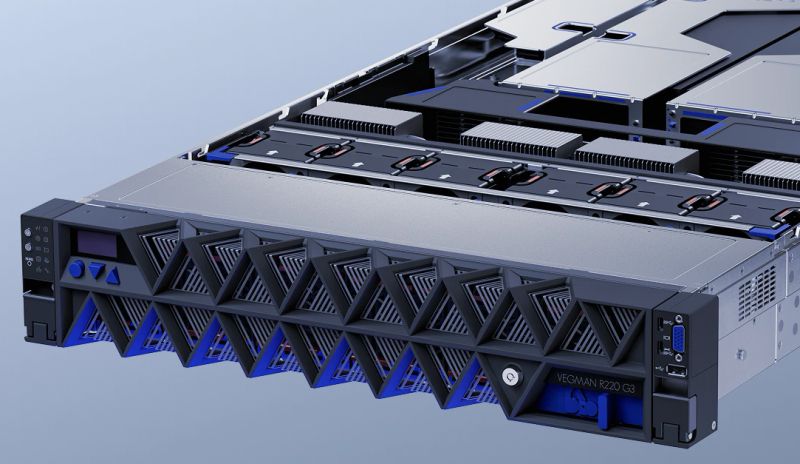

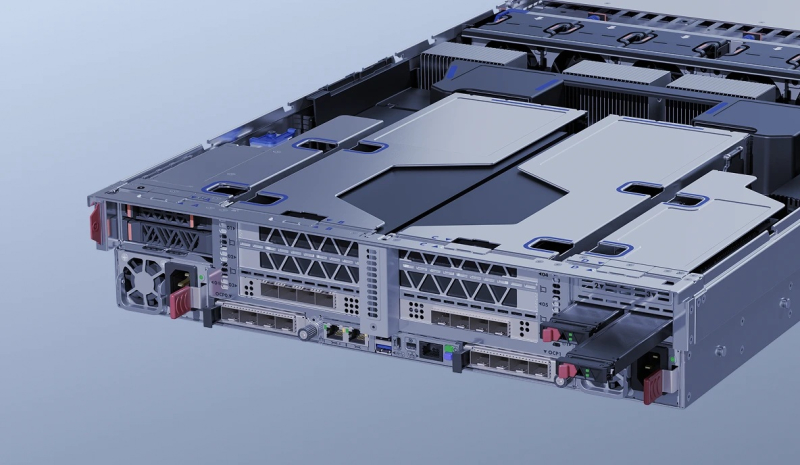

YADRO выпустила отечественные серверы Vegman R220 G3 на базе Intel Xeon Emerald RapidsКомпания YADRO, входящая в «ИКС Холдинг», объявила о доступности универсальных серверов Vegman R220 G3 на аппаратной платформе Intel. Устройства подходят для широкого спектра задач — от хранения и аналитики данных до НРС-приложений и нагрузок ИИ, говорит компания. Новинки выполнены в форм-факторе 2U. Допускается установка двух процессоров Xeon Sapphire Rapids или Xeon Emerald Rapids с показателем TDP до 350 Вт. Возможно использование до 8 Тбайт оперативной памяти DDR5-4400/5600 RDIMM в конфигурации 32 × 256 Гбайт. Во фронтальной части в зависимости от модификации могут быть установлены до 12 накопителей LFF (SAS/SATA/NVMe) или до 24 накопителей SFF (SAS/SATA плюс 16 × NVMe). Сзади предусмотрены посадочные места для четырёх изделий SFF (или 2 × SFF и 2 × M.2/E1.S). Допускается формирование массивов RAID 0/1/10/5/50/6/60. Реализована поддержка CXL 1.1. Есть два сетевых порта 1GbE и выделенный сетевой порт управления 1GbE (все с разъёмами RJ45). Доступны до 11 слотов PCIe 5.0 с учетом OCP 3.0 SFF и гнезда под контроллер RAID/HBA. Спереди находятся два порта USB 3.1 Type-C, по одному разъёму USB 2.0 Type-A и D-Sub, сзади — два порта USB 3.1 Type-A, последовательный интерфейс (разъём USB Type-C) и коннектор Mini DisplayPort (BMC). Питание обеспечивают два блока мощностью до 2700 Вт с сертификатом 80 PLUS Platinum. Применено воздушное охлаждение с шестью вентиляторами диаметром 60 мм с возможностью горячей замены. Диапазон рабочих температур — от +10 до +35 °C при относительной влажности от 20 % до 80 %. Заявлена совместимость с Astra Linux, ALT Linux, RED OS, zVirt и пр. С серверами поставляется ПО управления «YADRO Суприм» и набор инструментов Vegman Satellites. Реализована поддержка доступа через IPMI 2.0, WebUI, CLI, SNMP, Redfish. Устройства Vegman R220 G3 включены в Единый реестр российской радиоэлектронной продукции Минпромторга, что подтверждает соблюдение требований локализации.

20.01.2026 [10:02], Владимир Мироненко

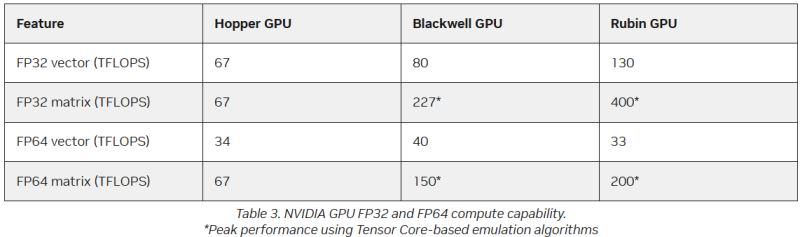

FP64 у вас ненастоящий: AMD сомневается в эффективности эмуляции научных расчётов на тензорных ядрах NVIDIAВместо создания специализированных чипов для аппаратных FP64-вычислений NVIDIA использует эмуляцию для повышения производительности HPC на ИИ-ускорителях, пишет The Register. Компания отказалась от развития FP64-блоков в поколении Blackwell Ultra, а в новейших ускорителях Rubin пиковая заявленная производительность векторных FP64-вычислений составляет 33 Тфлопс, тогда как у H100, вышедшего четыре года назад, она была равна 34 Тфлопс, а у Blackwell — около 40 Тфлопс. Если включить программную эмуляцию в библиотеках CUDA от NVIDIA, ускоритель, как утверждается, может достичь производительности до 200 Тфлопс в матричных FP64-вычислениях. Впрочем, и Blackwell с эмуляций способен выдать в этом случае до 150 Тфлопс, тогда как у Hopper были «честные» 67 Тфлопс. «В ходе многочисленных исследований с партнёрами и собственных внутренних изысканий мы обнаружили, что точность, достигаемая с помощью эмуляции, как минимум не уступает точности, получаемой от аппаратных тензорных ядер», — сообщил ресурсу The Register Дэн Эрнст (Dan Ernst), старший директор по суперкомпьютерным продуктам NVIDIA. В свою очередь, в AMD считают, что это утверждение справедливо не для всех сценариев. «В некоторых бенчмарках она показывает довольно хорошие результаты, но в реальных физических научных симуляциях это не очевидно», — говорит Николас Малайя (Nicholas Malaya), научный сотрудник AMD. Он выразил мнение, что, хотя эмуляция FP64, безусловно, заслуживает дальнейших исследований и экспериментов, такое решение ещё не готово к широкому применению. AMD и сама изучает возможность программной эмуляции FP64 на Instinct MI355X, чтобы определить области её возможного применения. Хотя чипы всё чаще используют типы данных с более низкой точностью, FP64 остаётся золотым стандартом для научных вычислений, и на то есть веские причины — FP64 не имеет себе равных по динамическому диапазону. Современные же LLM обучаются с использованием FP8-вычислений, а компактные типы данных MXFP8/MXFP4 или NVFP4 позволяют получить достаточный для ИИ диапазон значений. Это хорошее решение для нечёткой математики больших языковых моделей, но это не замена FP64 для HPC. ИИ-нагрузки обладают высокой устойчивостью к ошибкам, а HPC-задачи требуют высокой точности. AMD указала на то, что эмуляция FP64 у NVIDIA не совсем соответствует стандарту IEEE. Алгоритмы NVIDIA не учитывают такие понятия, как положительные и отрицательные нули, ошибки NaN (Not a Number) и ошибки infinite number (бесконечное число). Из-за этого небольшие ошибки в промежуточных вычислениях, используемых для эмуляции более высокой точности, могут привести к искажениям, способным повлиять на точность конечного результата, пояснил Малайя. По его словам, целесообразность использования эмуляции FP64 зависит от конкретного приложения. Эмуляция FP64 лучше всего работает для хорошо обусловленных проблем, где малые изменения «на входе» приводят к малым же изменениям в конечном результате. Ярким примером такой задачи является бенчмарк Linpack (HPL). «Но если вы посмотрите на материаловедение, коды для расчёта процессов горения, системы ленточых матриц и т.п., то увидите, что это гораздо менее обусловленные системы, и внезапно всё начинает давать сбои», — сказал он. Точность можно повысить, увеличив количество используемых операций, однако после определённого предела никаких преимуществ от эмуляции уже не будет. Вдобавок все эти операции требуют память. «У нас есть данные, которые показывают, что алгоритму Озаки требуется примерно вдвое больше памяти для эмуляции матриц FP64», — сказал Малайя. Поэтому компания готовит специализированные ускорители MI430X c повышенной FP64/FP32-производительностью, но, как опасаются учёные, она может оказаться не слишком в них заинтересована, поскольку ИИ-ускорители приносят больше денег. Эрнст утверждает, что для большинства специалистов в области HPC неполное соответствие стандарту IEEE не представляет большой проблемы. Всё во многом зависит от конкретного приложения. Тем не менее, NVIDIA разработала дополнительные алгоритмы для обнаружения и смягчения указанных выше ошибок и неэффективных операций эмуляции. Эрнст также признал, что использование памяти при эмуляции может быть несколько выше, но подчеркнул, что эти накладные расходы относятся к расчётам, а не к самому приложению — в большинстве случаев речь идёт о матрицах размером не более нескольких Гбайт. Впрочем, всё это не меняет того, что эмуляция полезна только для подмножества HPC-задач, которые полагаются на операции умножения плотных матриц (DGEMM). По словам Малайи, для 60–70 % рабочих нагрузок HPC эмуляция дает незначительные преимущества или ничего не меняет. «По нашим оценкам, подавляющее большинство реальных рабочих нагрузок HPC полагаются на векторное умножение (FMA), а не на DGEMM», — сказал он, отметив, что это действительно нишевый сегмент, хотя и не крошечная доля рынка. Для рабочих нагрузок, интенсивно использующих векторы, таких как вычислительная гидродинамика (CFD), ускорители Rubin по-прежнему будут полагаться на медленные векторные FP64-блоки.

19.01.2026 [14:16], Руслан Авдеев

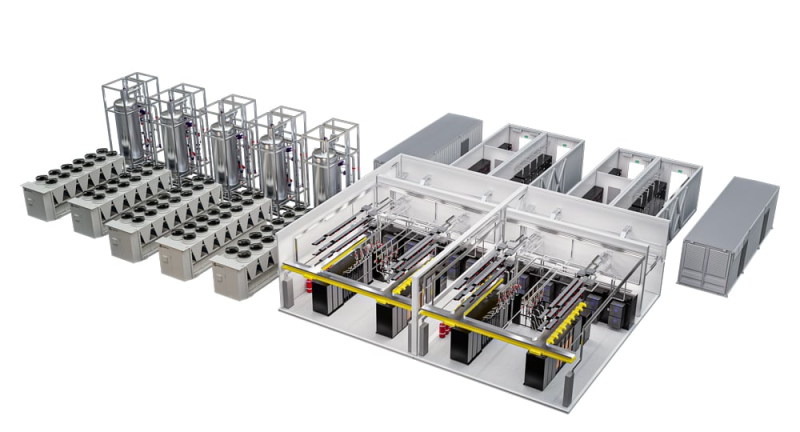

100+ кВт на стойку с СЖО: Vertiv обновила модульную инфраструктуру MegaMod HDX для ИИ и HPCVertiv анонсировала новые конфигурации MegaMod HDX. Это модульное силовое и охлаждающее решение, разработанное для вычислительных сред высокой плотности. Новые конфигурации обеспечивают гибкую адаптацию к растущим требованиям к питанию и охлаждению, занимают меньше места, требуют меньше времени на развёртывание и обеспечивают воспроизводимость благодаря заранее собранным на заводе конструкциям, прошедшим интеграцию и тестирование компонентов. Vertiv MegaMod HDX сочетает прямое жидкостное охлаждение чипов и воздушное охлаждение — это помогает справиться с интенсивными ИИ-нагрузками, поддерживая модульные среды для ИИ и передовые кластеры ускорителей. Базовый модуль стандартной высоты поддерживает до 13 стоек и мощность до 1,25 МВт. Комбинированное решение отличается большей высотой и поддерживает уже до 144 стоек и мощность до 10 МВт. Оба варианта обеспечивают плотность от 50 кВт до 100+ кВт на стойку с возможностью оптимизации системы охлаждения под актуальные запросы и с возможностью масштабирования.

Источник изображения: Vertiv Новые решения используют распределённую силовую архитектуру с резервированием. Для СЖО предусмотрен буфер, который обеспечит поддержку стабильной работы кластеров ускорителей во время техобслуживания. Обе конфигурации основаны на этом обширном портфолио, включающем, например, ИБП Vertiv Liebert APM2, блок распределения жидкости Vertiv CoolChip CDU, а также шинопровод Vertiv PowerBar и систему мониторинга инфраструктуры Vertiv Unify. Также Vertiv предлагает инфраструктуру IT-стоек, разработанную для беспрепятственной интеграции и поддержки IT-систем. В том числе речь идёт о стойках Vertiv и OCP-совместимых стойках, теплообменниках задней двери Vertiv CoolLoop RDHx, PDU и DC-системах Vertiv PowerDirect и т.п. Летом 2025 года сообщалось, что выручка Vertiv выросла на 35 % на фоне «беспрецедентного роста ЦОД», но новые тарифы, введённые США, не дают бизнесу развиваться активнее.

19.01.2026 [10:09], Сергей Карасёв

DeepX представила ИИ-ускорители DX-H1 V-NPU, DX-H1 Quattro и DX-M1 М.2Южнокорейский стартап Deepx, специализирующийся на разработке чипов для задач ИИ, анонсировал ускорители DX-H1 V-NPU, DX-H1 Quattro и DX-M1 М.2. В основу решений, которые демонстрировались на недавней выставке CES 2026 в Лас-Вегасе (Невада, США), положен нейропроцессорный узел Genesis NPU. Устройство DX-H1 V-NPU предназначено для выполнения операций, связанных с обработкой видеоматериалов: это может быть декодирование, кодирование, перекодирование и пр. Утверждается, что новинка обеспечивает снижение стоимости оборудования примерно на 80 % и сокращение энергопотребления на 85 % по сравнению с решениями на базе GPU при той же плотности каналов. Ускоритель выполнен в виде низкопрофильной карты расширения PCIe 3.0 x16 (x8 на уровне сигналов). Он оснащён двумя аппаратными видеокодеками и двумя NPU с общей производительностью до 50 TOPS (INT8) при инференсе в реальном времени. Возможно декодирование 64 каналов H.264/265 (1080р; 30 к/с) и кодирование 32 каналов H.264/265 (1080р; 30 к/с). Секция кодирования имеет доступ к 16 Гбайт памяти LPDDR5, секция NPU — к 8 Гбайт. Упомянуты интерфейс HDMI 2.0 и флеш-модуль eMMC вместимостью 32 Гбайт. Максимальное энергопотребление составляет 40 Вт. Решение DX-H1 Quattro, в свою очередь, оснащено четырьмя NPU с суммарной производительностью до 100 TOPS (INT8). В оснащение входят 16 Гбайт памяти LPDDR5. Ускоритель, выполненный в виде карты PCIe 3.0 x16, предназначены для выполнения ИИ-задач в дата-центрах и на периферии. Энергопотребление равно 20 Вт, диапазон рабочих температур простирается от -25 до +85 °C. Говорится о совместимости с Windows и различными вариантами Linux, включая Ubuntu. Изделие DX-M1 М.2 представляет собой ИИ-ускоритель в виде модуля М.2 2280, выполненный на чипе DX-M1. ИИ-производительность — до 25 TOPS, а энергопотребление не превышает 5 Вт. Используется интерфейс PCIe 3.0 x4. Говорится о возможности применения устройства в системах с архитектурой х86 и Arm. Диапазон рабочих температур — от -25 до +85 °C. Упомянута совместимость с Windows 11 и Ubuntu 22.04.

18.01.2026 [16:14], Руслан Авдеев

От телекома до солнечной энергетики: Евросоюз собирается изгнать китайские технологии из своей критической инфраструктурыБрюссельские бюрократы предлагают постепенно вытеснить оборудование китайского производства из критической инфраструктуры Евросоюза. Для этого компаниям из КНР вроде Huawei и ZTE намерены запретить участвовать в создании телекоммуникационных сетей, солнечных электростанций и сканеров систем безопасности, сообщает The Financial Times. Новые меры планируют принять в рамках обновлённой политики, касающейся безопасности и технологий, в попытке снизить зависимости от компаний США и «высокорисковых» бизнесов Китая — некоторые политики считают, что те могут поставить под угрозу конфиденциальные данные европейцев. В США использование оборудования Huawei и других компаний в телеком-сетях давно запрещено, тогда как в странах Евросоюза отказ носит скорее добровольный характер. В сопровождении к раннему проекту предложенного закона Cybersecurity Act (он всё ещё может быть изменён) ранее подчёркивалось, что «фрагментированные» национальные решения доказали свою неэффективность в масштабах всего европейского рынка. Точные сроки теперь уже принудительного вытеснения китайского бизнеса будет зависеть от оценки сопутствующих рисков. В расчёт также примут стоимость и доступность альтернативных решений. Прежние рекомендации принимались к исполнению в ЕС весьма неравномерно, некоторые страны Евросоюза по-прежнему полагаются на «высокорисковых» поставщиков. Так, в 2025 году Испания подписала контракт на €12 млн с Huawei на поставки оборудования для хранения материалов прослушки, одобренной местными судебными органами, правоохранительными органами или спецслужбами. Еврокомиссия инициировала расследования в отношении производителей поездов и ветрогенераторов, а в 2024 году провела рейды в офисах компании Nuctech, занимающейся производством охранного оборудования. Стоит отметить, что сегодня более 90 % установленных в Евросоюзе солнечных панелей — китайского производства. Представители индустрии также отмечают отсутствие приемлемых альтернатив с учётом того, что ЕС одновременно должен снизить зависимость как от китайских, так и от американских поставщиков. Телеком-операторы уже предупредили о росте цен для клиентов, который будет вызван новыми запретами. Законопроект будет рассмотрен Европарламентом и странами ЕС по отдельности. Высока вероятность, что предложенные временные рамки внедрения запретов вызовут негативную реакцию некоторых членов союза. Более того, предложение может столкнуться с противодействием групп лоббистов. Так, в SolarPower Europe, представляющей европейскую «солнечную» промышленность, Huawei является полноправным участником благодаря производству инверторов. В ноябре Пекин заявил, что попытка Еврокомиссии отказаться от использования технологий Huawei и ZTE нарушит «рыночные принципы и правила честной конкуренции». Министерство иностранных дел отметило, что факты свидетельствуют, что в нескольких странах отказ от качественного и безопасного оборудования из КНР не только сдерживает развитие технологий в самих странах, но и привозит к большим финансовым потерям.

18.01.2026 [15:09], Руслан Авдеев

BlackRock привлекла $12,5 млрд для инвестиций в ИИ-инфраструктуру, но это лишь часть масштабного планаBlackRock привлекла $12,5 млрд на инвестиции в ИИ-инфраструктуру совместно с Microsoft и MGX, сообщает Datacenter Dynamics. При этом BlackRock намерена в общей сложности привлечь на такие проекты в рамках фонда AIP $30 млрд акционерного капитала и ещё $70 млрд долгового финансирования. В сентябре 2024 года сообщалось, что MGX, Microsoft и BlackRock совместно инвестируют $100 млрд в ИИ-инфраструктуру. В ходе финансового отчёта за IV квартал 2025 года компания объявила, что сформированный для этих целей фонд Global AI Infrastructure Investment Partnership (AIP), к которому присоединились NVIDIA и xAI, а также Кувейтский фонд благосостояния (KIA), продолжает привлекать значительный капитал, в данном случае речь о $12,5 млрд, полученных благодаря партнёрству AIP с основателями и клиентами. По словам компании, партнёрство «разблокирует» возможности для «многотриллионных» инвестиций. Ранее фонд приобрёл за $40 млрд оператора ЦОД Aligned Data Center, это крупнейшая покупка такого рода в сфере цифровой инфраструктуры. В ноябре 2025 года Global Infrastructure Partners (GIP), принадлежащая BlackRock, объединилась с ACS для создания предприятия стоимостью €2 млрд ($2,33 млрд) для строительства ЦОД и управления ими. Предприятие будет курировать портфолио проектов цифровой инфраструктуры ACS, состоящее из инициатив по строительству ЦОД в США, Европе, Азии и Австралии, запланированная мощность — 1,7 ГВт. Ранее Blackeock также инвестировала в занимающуюся системами охлаждения компания Xnrgy, британский строительный бизнес Gravity Edge и разработчика ИИ-чипов Groq. Последний был приобретён NVIDIA за $20 млрд.

17.01.2026 [23:37], Владимир Мироненко

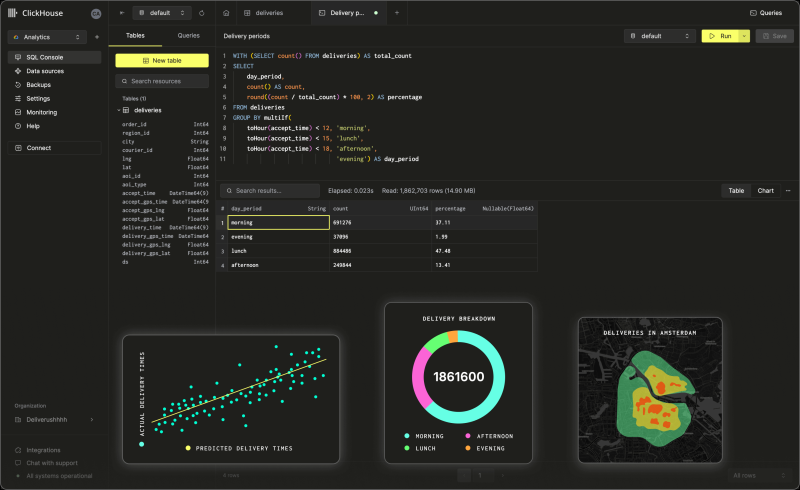

Капитализация ClickHouse после очередного раунда финансирования достигла $15 млрдClickHouse, разработчик колоночной СУБД с открытым исходным кодом, отделившийся более четырёх лет назад от Yandex NV, сообщил об успешном завершении раунда финансирования серии D, в ходе которого он привлёк $400 млн при оценке рыночной стоимости в $15 млрд. В предыдущем раунде, прошедшем в мае, оценка рыночной стоимости компании составила $6,35 млрд. Раунд возглавила инвестиционная группа Dragoneer Investment Group при участии Bessemer Venture Partners, GIC, Index Ventures, Khosla Ventures, Lightspeed Venture Partners, консультантов T. Rowe Price Associates и WCM Investment Management. Соучредитель и генеральный директор ClickHouse Аарон Кац (Aaron Katz) сообщил агентству Bloomberg, что компания планирует использовать полученные средства для ускорения разработки продукта, а также для увеличения продаж и маркетинга. ClickHouse отметила, что финансирование было получено на фоне продолжительного периода устойчивого роста компании. Её годовой регулярный доход (ARR) вырос более чем на 250 % в годовом исчислении. В настоящее время у её полностью управляемого сервиса ClickHouse Cloud насчитывается более 3 тыс. клиентов, включая Meta✴, Cursor, Sony и Tesla. Кац заявил, что ClickHouse была создана для обеспечения исключительной производительности и экономичности при работе с самыми требовательными рабочими нагрузками по обработке данных. Сейчас компания занимается внедрением унифицированной поддержой транзакционных и аналитических рабочих нагрузок, чего давно не хватало, а также наблюдаемостью (observability) LLM, чтобы разработчики ИИ-приложений могли оценивать качество результатов и поведение ИИ-моделей по мере их развёртывания. «Дополнительное финансирование в сочетании с продолжающимся развитием продукта позволяет нам предоставлять лидирующую платформу для сбора данных и мониторинга LLM в эпоху ИИ», — подчеркнул гендиректор ClickHouse. Инвестиционная компания Dragoneer отметила, что по мере того, как ИИ-системы переходят от экспериментов к продуктовому развёртыванию, требования, предъявляемые к базовой инфраструктуре обработки данных, возрастают, и всё большую ценность приобретают инфраструктурные платформы, которые обеспечивают крупномасштабные производственные нагрузки с большим объёмом данных: «По мере того, как модели становятся более функциональными, узкое место перемещается в инфраструктуру данных. ClickHouse выделяется тем, что обеспечивает производительность, экономичность и надёжность, необходимые для ИИ-систем, работающих в больших масштабах». ClickHouse также сообщила о приобретении стартапа Langfuse GmbH, разрабатывающего открытый инструмент для мониторинга LLM. Как сообщает SiliconANGLE, компании используют ПО Langfuse для отслеживания задержки и использования инфраструктуры своих приложений, работающих на основе LLM, что упрощает выявление первопричины сбоев и поиска решения. Эта сделка позволит ClickHouse улучшить интеграцию двух платформ. ClickHouse заявила, что цель состоит в том, чтобы сделать свою СУБД более конкурентоспособной среди разработчиков ИИ-приложений.

17.01.2026 [13:07], Сергей Карасёв

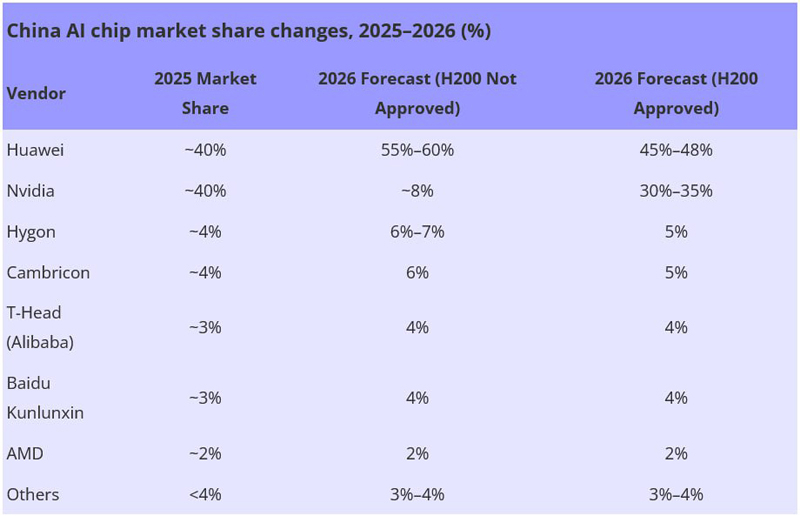

Huawei сравняла долю с NVIDIA на китайском рынке ИИ-чиповРезкий рост спроса на вычислительные мощности, геополитическое давление и ограничения в цепочках поставок приводят к трансформации китайского рынка ИИ-ускорителей. По оценкам Bernstein, которые приводит ресурс DigiTimes, позиции в КНР резко укрепила компания Huawei, которой удалось сравнять свою долю с NVIDIA. Объём сектора ИИ-чипов в Китае по итогам 2025 года достиг приблизительно $20,4 млрд. Примерно по 40 % от этой суммы, или по $8,16 млрд, приходится на Huawei и NVIDIA. Годом ранее доля Huawei составляла одну треть от показателей NVIDIA. Таким образом, сообща эти две компании контролируют около 80 % китайского рынка ИИ-ускорителей, что эквивалентно $16,32 млрд. Если не рассматривать двух лидеров, рынок ИИ-чипов в КНР является сильно фрагментированным. Так, Hygon и Cambricon занимают примерно по 4 %, при этом Hygon выигрывает от совместимости с архитектурой x86. T-Head Semiconductor, принадлежащая Alibaba, и Kunlunxin (Baidu) занимают по 3 % отрасли. Ещё около 2 % приходится на AMD. Все прочие игроки вместе взятые, включая Zixiao (Tencent), MetaX, Moore Threads и Biren, контролируют менее 4 % отрасли.

Источник изображения: DigiTimes Аналитики полагают, что в случае запрета поставок в Китай ускорителей H200 доля NVIDIA на местном рынке в 2026 году может сократиться до 8 %. При этом Huawei, как ожидается, укрепит позиции до 55–60 %. Если же поставки H200 в КНР будут одобрены, NVIDIA может занять 30–35 %, а Huawei — 45–48 %. При этом суммарная доля всех прочих игроков будет колебаться в пределах 24–27 %. По словам самой NVIDIA, запрет поставок ускорителей в Китай был большой ошибкой. В целом, считают эксперты, китайский рынок ИИ-чипов в период с 2023-го по 2028 году будет демонстрировать среднегодовой темп роста в сложных процентах (CAGR) на уровне 50 %. В результате, его объём за этот период увеличится с $11 млрд до $88 млрд. |

|