Материалы по тегу: x

|

12.11.2025 [23:23], Владимир Мироненко

От ИИ ЦОД до роботов: AMD анонсировала долгосрочную стратегию роста

amd

cpu

dpu

epyc

hardware

instinct

mi400

mi500

ocp

pensando systems

ualink

ultra ethernet

venice

verano

xilinx

ии

ускоритель

финансы

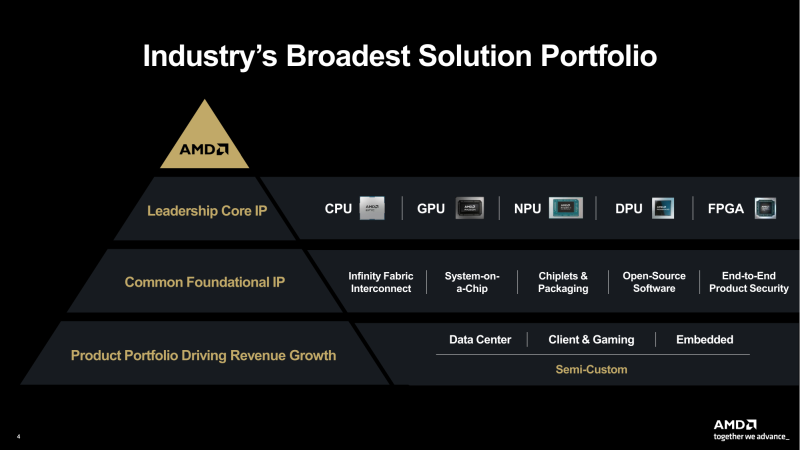

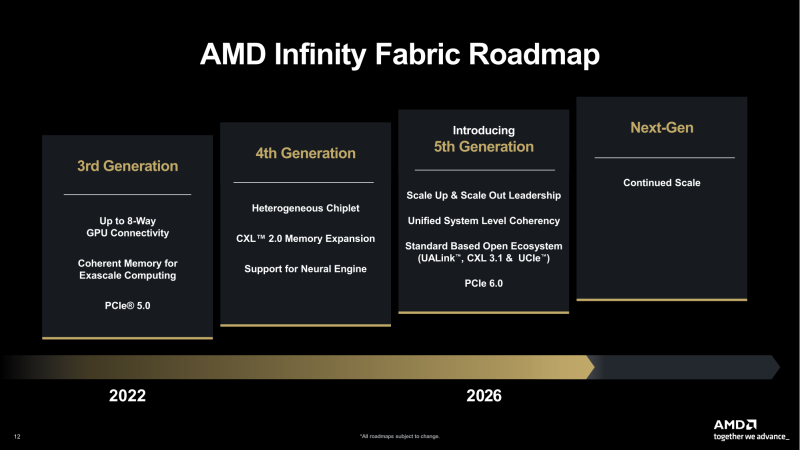

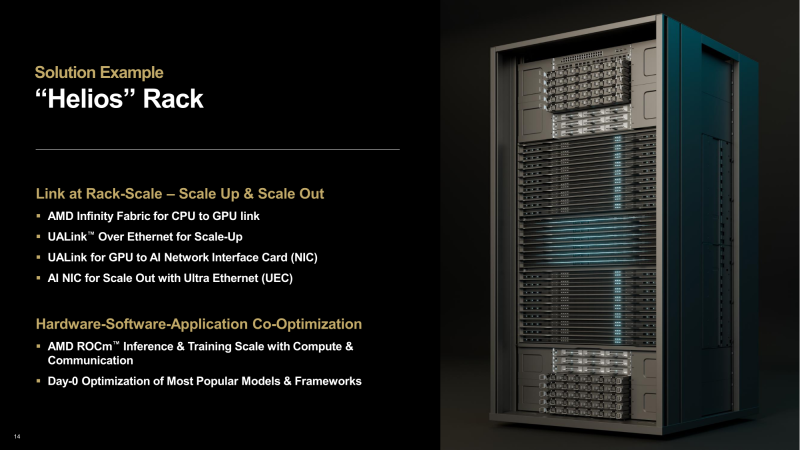

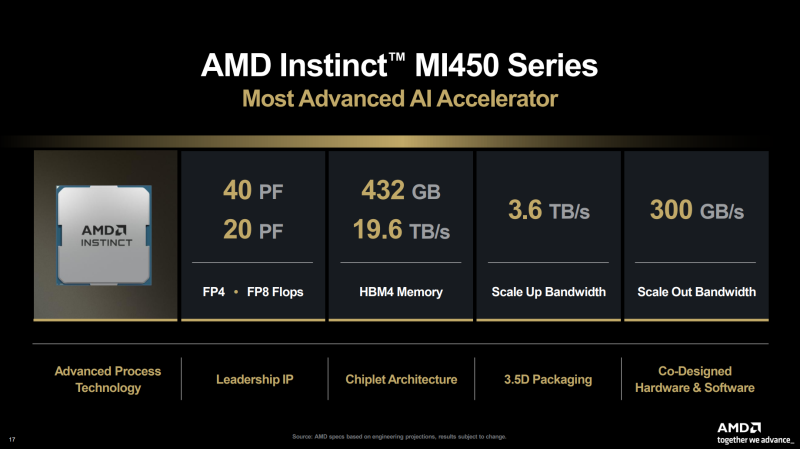

AMD представила на мероприятии Financial Analyst Day 2025 план по достижению лидерства на рынке вычислительных технологий объёмом $1 трлн. Долгосрочная стратегия роста AMD построена на четырех столпах: лидерство в сфере ЦОД, повышение производительности ИИ, открытое ПО и расширение присутствия на рынках встраиваемых и полукастомных кремниевых решений. AMD ожидает, что только её бизнес в сфере ЦОД будет приносить более $100 млрд годовой выручки, с увеличением совокупного среднегодового темпа роста (CAGR) до более чем 60 %, при этом CAGR дохода от ИИ-решений увеличится до более чем 80 %. Генеральный директор AMD Лиза Су (Lisa Su) заявила, что следующий этап будет основан на унифицированной вычислительной платформе AMD, объединяющей процессоры EPYC, ускорители Instinct, сетевые решения Pensando и ПО ROCm. Новый план развития AMD призван обеспечить ей конкуренцию с NVIDIA и Intel на корпоративных рынках и в борьбе за заказы гиперскейлеров. Ускорители серии Instinct MI350, уже развёрнутые Oracle (ещё 50 тыс. MI450 будут развёрнуты во II половине 2026 г.), являются самыми популярными ускорителями AMD на сегодняшний день. Следующей платформой станет серия MI450, которая будет запущена вместе со стоечной платформой Helios в III квартале 2026 года. Helios обеспечит пропускную способность интерконнекта 3,6 Тбайт/с на каждый ускоритель и до 72 ускорителей на стойку с совокупной пропускной способностью 260 Тбайт/с, соединённых между собой посредством UALink и Ultra Ethernet (UEC). Система поддерживает разделяемую память между ускорителями, что обеспечивает обучение крупномасштабных моделей с бесперебойным доступом к памяти и отказоустойчивой сетью с шестью плоскостями. AMD характеризует Helios как свою первую ИИ-платформу стоечного масштаба — полностью интегрированную систему с открытой архитектурой, которая объединяет вычислительные мощности, ускорение, сетевые технологии и ПО в единую структуру. В отличие от традиционных серверных кластеров, Helios реализует всю стойку как единый высокопроизводительный вычислительный домен. Каждая стойка объединяет процессоры AMD EPYC Venice, CDNA5-ускорители Instinct MI450X (будет и вариант MI430X с полноценными FP64-блоками) и 400G/800G-карты Pensando Vulcano, связанные Infinity Fabric пятого поколения (PCIe 6.0, CXL 3.1, UCIe) и UALink. Эта архитектура минимизирует накладные расходы на перемещение данных, увеличивает пропускную способность между ускорителями и обеспечивает эффективность класса экзафлопсных вычислений в компактном корпусе. Helios фактически представляет собой проект AMD для ИИ-фабрики будущего с возможностью модульного расширения, позволяя объединять сотни стоек в одну систему в ЦОД. В 2027 году AMD планирует выпустить ускорители серии MI500 и процессоры EPYC Verano, продолжая тем самым ежегодный цикл совместной разработки процессоров, ускорителей и сетей. AMD заявила, что EPYC Venice, намеченные к выпуску в 2026 году, будут обладать лучшими в отрасли показателями плотности (1,3x по количеству потоков в сравнении с текущими решениями) и энергоэффективности (1,7x). Они пополнятся оптимизированными для ИИ наборами инструкций для обработки инференса и выполнения вычислений общего назначения. Указанные компоненты станут основой ИИ-фабрики, способной масштабироваться от одной стойки до глобально распределённых кластеров. Исполнительный вице-президент AMD Форрест Норрод (Forrest Norrod) подчеркнул в своём выступлении, что производительность ИИ всё больше зависит от сети. Сетевые карты AMD Pensando Pollara и Vulcano для ИИ образуют связующую ткань архитектуры Helios. Сетевая карта Pollara 400 обеспечивает пропускную способность 400 Гбит/с, а готовящаяся к выходу сетевая карта Vulcano удвоит её до 800 Гбит/с, обеспечивая связь Ultra Ethernet между крупными кластерами ускорителей. AMD представила четырёхуровневую архитектуру сети для масштабных ИИ-инфраструктур. Front-End часть обслуживает пользователей, хранилище и приложения. Она опирается на DPU Pensando и P4-движки, отвечающие за разгрузку сетевых функций, функции безопасности и шифрования, и работу с СХД. Вертикальное масштабирование в пределах стойки обеспечивает 3,6-Тбайт/с подключение на каждый GPU. Горизонтальное масштабирование реализуется благодаря UEC — внутренние тесты показали снижение затрат на коммутацию до 58 % по сравнению с традиционными сетями типа Fat-Tree. Наконец, Scale-Across (пространственное масштабирование) позволит объединить географически распределённые ЦОД в кластеры с интеллектуальным управлением трафиком и адаптивной балансировкой нагрузки. AMD отметила, что открытый программный стек ROCm (Radeon open compute) по-прежнему лежит в основе её стратегии в области ИИ-платформ. По сравнению с прошлым годом число его загрузок выросло в десять раз и теперь на HuggingFace поддерживается более 2 млн моделей. ROCm интегрируется с ведущими фреймворками, включая PyTorch, TensorFlow, JAX, Triton, vLLM, ComfyUI и Ollama, и поддерживает проекты с открытым исходным кодом, такие как Unsloth. AMD также расширила своё видение «физического ИИ», когда вычисления выходят за рамки облака и охватывают роботов, транспортные средства и промышленные системы. Подразделение встраиваемых систем, усиленное приобретением Xilinx в 2022 году, превратилось из бизнеса, ориентированного на FPGA, в многоплатформенный двигатель роста, охватывающий адаптивные системы на кристалле (SoC), встраиваемые x86-процессоры и заказные кремниевые решения. По словам компании, с 2022 года решения в этой области принесли более $50 млрд. AMD рассчитывает превысить 70 % доли рынка адаптивных вычислений. Говоря о перспективах, компания отметила, что ЦОД остаются основным драйвером роста, но наряду с этим она будет диверсифицировать свою деятельность по всем сегментам. Финансовые цели AMD включают:

11.11.2025 [17:14], Андрей Крупин

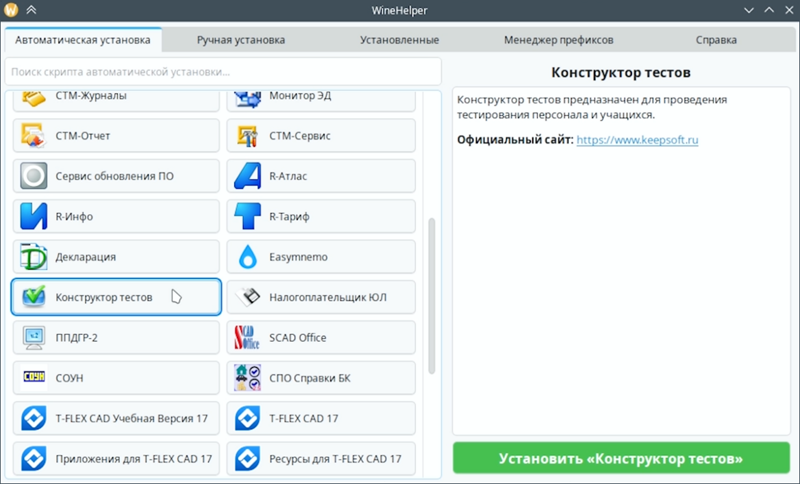

Вышла новая версия WineHelper — программы для запуска Windows-приложений в ОС «Альт» LinuxКомпания «Базальт СПО» представила новую версию WineHelper — программного решения для установки и запуска Windows-приложений в операционных системах семейства «Альт». Инструмент WineHelper построен на базе портативной сборки Wine, дополненной набором скриптов, автоматизирующих развёртывание ПО Windows в среде Linux. Обновлённая редакция WineHelper получила графический пользовательский интерфейс и возможность запуска программы непосредственно из меню приложений ОС «Альт». В дополнение к этому появились два режима установки Windows-программ — автоматический и ручной, новая вкладка «Менеджер префиксов» с расширенными настройками Wine, а также инструменты резервного копирования созданных префиксов.

Источник изображения: basealt.ru WineHelper поддерживает автоматическое развёртывание более 40 программных продуктов Windows, в числе которых T-Flex CAD, «Декларация», «СТМ-Финансы», «R-Инфо», SCAD Offce, «Налогоплательщик ЮЛ», «Монитор ЭД» и многие другие востребованные в корпоративной среде решения. Программы добавляются в WineHelper по запросам заказчиков.

09.11.2025 [13:38], Сергей Карасёв

Nebius Аркадия Воложа развернула в Великобритании платформу AI Cloud на базе NVIDIA HGX B300Компания Nebius (бывшая материнская структура «Яндекса» Yandex N.V.) объявила о своём первом развёртывании ИИ-инфраструктуры в Великобритании. Кластер Nebius AI Cloud расположен в кампусе Longcross Park на площадке Ark Data Centres недалеко от Лондона. Как отмечает основатель и генеральный директор Nebius Аркадий Волож, Великобритания является одним из ведущих ИИ-центров в мире. Поэтому для компании создание кластера на территории этой страны имеет большое значение. Кластер состоит из 126 стоек с оборудованием, размещённых в трёх машинных залах. В рамках первой фазы проекта установлены 4 тыс. ускорителей NVIDIA HGX B300 (Blackwell Ultra) в составе серверов пятого поколения (Gen5) собственной разработки Nebius. Вторая фаза предполагает монтаж ещё 3 тыс. ускорителей B300. Общая мощность системы — 16 МВт. По заявлениям Nebius, британский кластер AI Cloud использует передовые энергоэффективные технологии охлаждения, сетевое подключение NVIDIA Quantum-X800 InfiniBand с низкой задержкой и надёжную локальную систему генерации электроэнергии. Говорится о полной интеграции с программной платформой NVIDIA AI Enterprise, предназначенной для разработки и развёртывания ИИ-приложений. Объединяя нашу облачную инфраструктуру с новейшими технологиями NVIDIA, мы предоставляем организациям по всей Великобритании возможность обучать, развёртывать и масштабировать модели и приложения ИИ быстрее, безопаснее и эффективнее, чем когда-либо», — говорит Волож. Британский кластер использует облачную платформу Nebius AI Cloud 3.0 Aether, которая разработана специально для создания и использования ИИ в таких областях, как здравоохранение, финансы, науки о жизни, корпоративный сектор и государственная сфера. Говорится о поддержке сквозного шифрования и о полном соответствии стандартам защиты данных GDPR и CCPA. Ранее Nebius сообщила о запуске своего первого кластера AI Cloud в Израиле, который расположился на площадке в Модиине (Modiin). У Nebius также имеются дата-центры в Финляндии, Франции и США.

05.11.2025 [14:10], Сергей Карасёв

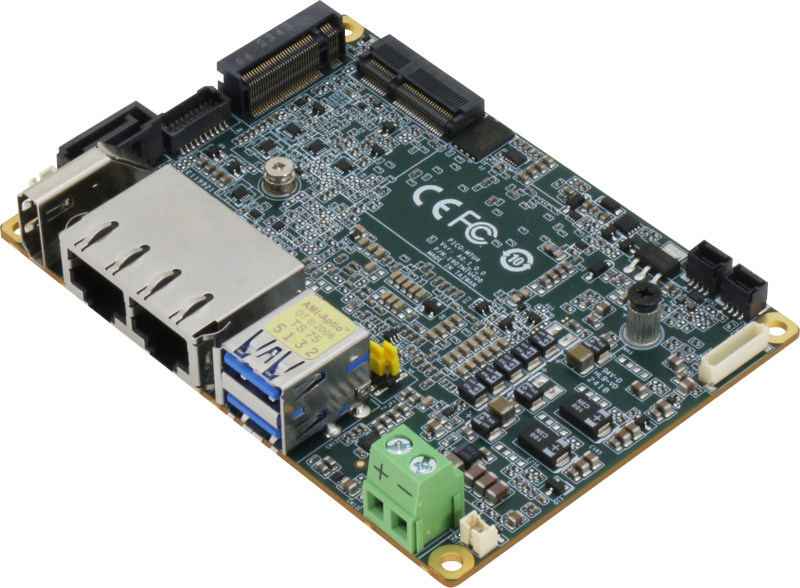

AAEON представила Pico-ARU4 — первый в мире одноплатный компьютер формата Pico-ITX на чипе Intel Arrow LakeКомпания AAEON анонсировала одноплатный компьютер Pico-ARU4, предназначенный для создания различных устройств с ИИ-функциями. Утверждается, что это первое изделие в форм-факторе Pico-ITX, оснащённое процессором Intel Core Ultra Series 2 поколения Arrow Lake. Решение имеет размеры 100 × 72 мм. В зависимости от модификации применяется процессор Core Ultra 7 255U (2P+8E+2LPE; 14 потоков; до 5,2 ГГц) или Core Ultra 5 225U (2P+8E+2LPE; 14 потоков; до 4,8 ГГц). В состав этих чипов входит ускоритель Intel Graphics. Показатель TDP равен 15 Вт. Одноплатный компьютер может нести на борту до 32 Гбайт оперативной памяти LPDDR5-6400. Есть порт SATA-3 для подключения накопителя и коннектор M.2 2280 M-Key для SSD с интерфейсом PCIe 4.0 x4 или SATA. Кроме того, предусмотрен разъём M.2 2230 E-Key (PCIe 4.0 x1 + USB 2.0) для адаптера Wi-Fi. В оснащение входят сетевые контроллеры 2.5GbE (Intel I226) и 1GbE (Intel I219). Возможен вывод изображения одновременно на два дисплея через интерфейсы HDMI 1.4 (3840 × 2160 пикселей; 30 Гц) и eDP 1.4. Присутствуют два гнезда RJ45 для сетевых кабелей и два порта USB 3.2 Gen2 Type-A. Через разъёмы на плате могут быть задействованы два порта USB 2.0 и два последовательных порта (RS-232/422/485). Питание подаётся через 2-контактный коннектор Phoenix. Имеется встроенный модуль TPM 2.0 для обеспечения безопасности. Диапазон рабочих температур простирается от 0 до +60 °C. Заявлена совместимость с Windows 10/11 и Ubuntu 22.04.2 (kernel 5.19.0 32 generic). Модель Pico-ARU4 доступна для заказа по ориентировочной цене $890.

05.11.2025 [10:16], Владимир Мироненко

NVIDIA и Deutsche Telekom строят в Германии ИИ-фабрику стоимостью €1 млрд

b200

deutsche telekom

dgx

hardware

nvidia

omniverse

германия

ии

конфиденциальность

промышленность

цод

NVIDIA и Deutsche Telekom представили первое в мире промышленное ИИ-облако (Industrial AI Cloud) — суверенную корпоративную платформу, запуск которой запланирован на начало 2026 года в рамках совместного проекта стоимостью €1 млрд. Платформа использует передовое оборудование NVIDIA, включая системы DGX B200 и серверы RTX PRO, а также ПО, в том числе NVIDIA AI Enterprise, CUDA-X и Omniverse, полностью интегрированное в облачную и сетевую экосистему Deutsche Telekom. Deutsche Telekom сообщила, что NVIDIA поставит более тысячи систем NVIDIA DGX B200 и серверов NVIDIA RTX PRO с 10 тыс. ускорителей NVIDIA Blackwell. Оборудование уже устанавливается в модернизированном дата-центре в Мюнхене. Объект начнёт работу в I квартале 2026 года, ИИ-производительность его систем составит 500 Пфлопс (точность вычислений не указана). Сообщается, что благодаря запуску этой ИИ-фабрики вычислительная мощность ИИ-решений в Германии увеличится сразу на 50 %. Управление объектом площадью в несколько тысяч квадратных метров будет осуществлять Deutsche Telecom, а компания SAP, занимающаяся разработкой корпоративного программного обеспечения, предоставит свою платформу SAP Business Technology Platform и соответствующие приложения. Европейская компания Polarise, занимающаяся разработкой ЦОД, также будет участвовать в проекте, пишет DataCenter Dynamics. «Благодаря этим вычислительным мощностям Германия станет ведущей в Европе суверенной точкой ИИ-доступа, созданной в рамках исключительно частной инициативы», — отметила Deutsche Telekom. Сообщается, что Industrial AI Cloud — один из первых флагманских проектов инициативы Made for Germany («Сделано для Германии»), в которой участвуют более 100 компаний. Цель инициативы — укрепить позиции Германии как бизнес-площадки и ускорить цифровизацию экономики и управления страны. Компании смогут резервировать вычислительные мощности для разработки промышленных приложений ИИ. Облако также будет обслуживать государственные службы и оборонный сектор, пишет Reuters. Deutsche Telekom сообщила, что среди первых партнёров проекта — Agile Robots, чьи роботы, по слухам, будут использоваться для установки серверных стоек на объекте. Благодаря использованию NVIDIA Omniverse она расширит свои возможности по обучению, тестированию и валидации базовых моделей робототехники для целых парков роботов. Также в числе первых партнёров компания Perplexity, которая будет использовать новый ИИ ЦОД для предоставления услуг ИИ-инференса немецким пользователям и компаниям. Siemens сообщила, что будет использовать облачную платформу для ускорения внедрения промышленного ИИ, в том числе для собственных сервисов и для предложения решений на базе ИИ клиентам и партнёрам. По данным Siemens, такие автопроизводители, как Mercedes-Benz и BMW, будут использовать Industrial AI Cloud для проведения сложных симуляций с использованием цифровых двойников на базе ИИ, что значительно ускорит разработку автомобилей.

04.11.2025 [20:35], Сергей Карасёв

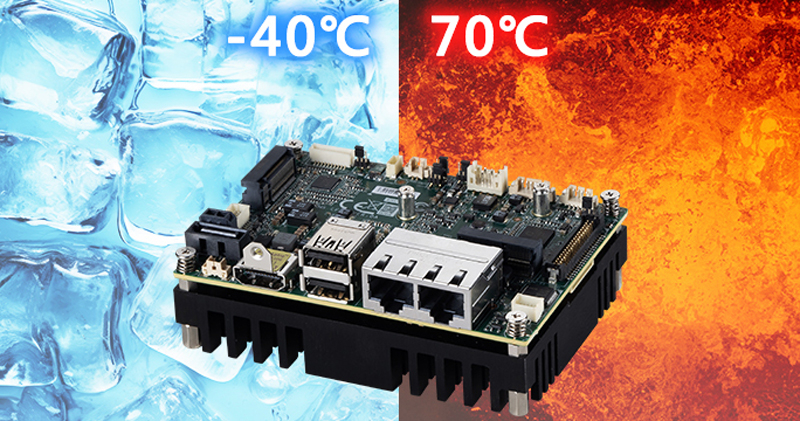

От -40 до +70 °C: MSI выпустила одноплатный Pico-ITX-компьютер MS-CF16 V3.0 для экстремальных условийКомпания MSI IPC анонсировала одноплатный компьютер MS-CF16 V3.0, предназначенный для использования в неблагоприятных условиях. Новинка подходит для построения систем промышленной автоматизации, периферийного оборудования, автомобильных вычислительных комплексов и пр. В зависимости от модификации устройство комплектуется чипом Intel Processor N97 поколения Alder Lake-N (до 3,6 ГГц; 12 Вт), Atom X7433RE семейства Amston Lake (до 3,4 ГГц; 9 Вт) или Processor N150 серии Twin Lake-N (до 3,6 ГГц; 6 Вт). Все эти изделия содержат четыре вычислительных ядра (четыре потока) и графический ускоритель Intel HD Graphics. Одноплатный компьютер поддерживает до 16 Гбайт LPDDR5-4800. Есть порт SATA 3.0 для накопителя, коннектор М.2 E key 2230 (PCIe x1 + USB 2.0) для адаптера Wi-Fi / Bluetooth и разъём М.2 B key 2242/3042 (PCIe x1/SATA 3.0 + USB 3.2 Gen 2 + USB 2.0) для сотового модема. В оснащение входят сетевые контроллеры 2.5GbE и 1GbE, звуковой кодек Realtek ALC897, IO-чип Fintek F81966AB-I и ТРМ-контроллер Infineon SLB 9672VU2.0 (SLB 9672XU2.0 у варианта с процессором Amston Lake).

Источник изображения: MSI Новинка допускает вывод изображения одновременно на два дисплея через интерфейсы HDMI (до 3840 × 2160 пикселей; 30 Гц) и eDP / LVDS (до 1920 × 1200 точек; 60 Гц). Предусмотрены два гнезда RJ45 для сетевых кабелей и два порта USB 3.2. Через разъёмы на плате могут быть задействованы два последовательных порта (RS-232/422/485) и два порта USB 2.0. Модель MS-CF16 V3.0 выполнена в форм-факторе Pico-ITX с размерами 101 × 73 мм. Диапазон рабочих температур простирается от -10 до +60 °C (от -40 до +70 °C у модификации на основе Amston Lake). Питание подаётся через DC-разъём (12 В). Обеспечивается совместимость с Windows 11 IoT Enterprise 24H2 LTSC и Linux.

04.11.2025 [16:35], Сергей Карасёв

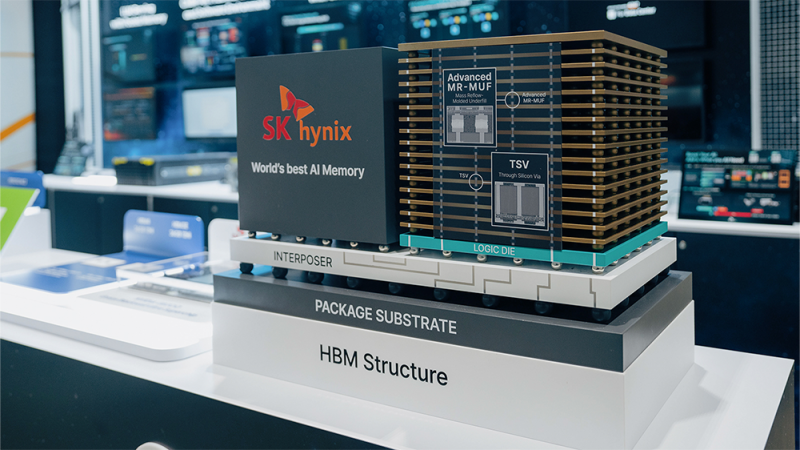

SK hynix разрабатывает AI-D — память для устранения узких мест в ИИ-системахКомпания SK hynix, по сообщению ресурса Blocks & Files, проектирует память нового типа AI DRAM (AI-D) для высокопроизводительных ИИ-платформ. Изделия нового типа будут предлагаться в трёх модификациях — AI-D O (Optimization), AI-D B (Breakthrough) и AI-D E (Expansion), что, как ожидается, позволит устранить узкие места современных систем. SK hynix является одним из лидеров рынка памяти HBM (Hgh Bandwidth Memory) для ИИ-ускорителей. Однако достижения в данной сфере отстают от развития GPU, из-за чего возникает препятствие в виде «стены памяти»: наблюдается разрыв между объёмом и производительностью HBM и вычислительными возможностями ускорителей. Проще говоря, GPU простаивают в ожидании данных. Одним из способов решения проблемы является создание кастомизированных чипов HBM, предназначенных для удовлетворения конкретных потребностей клиентов. Вторым вариантом SK hynix считает выпуск специализированной памяти AI-D, спроектированной для различных ИИ-нагрузок. В частности, вариант AI-D O предполагает разработку энергосберегающей высокопроизводительной DRAM, которая позволит снизить общую стоимость владения ИИ-платформ. Для таких изделий предусмотрено применение технологий MRDIMM, SOCAMM2 и LPDDR5R. Продукты семейства AI-D B помогут решить проблему нехватки памяти. Такие изделия будут отличаться «сверхвысокой ёмкостью с возможностью гибкого распределения». Упомянуты технологии CMM (Compute eXpress Link Memory Module) и PIM (Processing-In-Memory). Это означает интеграцию вычислительных возможностей непосредственно в память, что позволит устранить узкие места в перемещении данных и повысить общее быстродействие ИИ-систем. Ёмкость AI-D B составит до 2 Тбайт — в виде массива из 16 модулей SOCAMM2 на 128 Гбайт каждый. Причём память отдельных ускорителей сможет объединяться в общее адресное пространство объёмом до 16 Пбайт. Любой GPU сможет заимствовать свободную память из этого пула для расширения собственных возможностей по мере роста нагрузки. Наконец, архитектура AI-D E подразумевает использование памяти, включая HBM, за пределами дата-центров. SK hynix планирует применять DRAM в таких областях, как робототехника, мобильные устройства и платформы промышленной автоматизации.

04.11.2025 [09:57], Руслан Авдеев

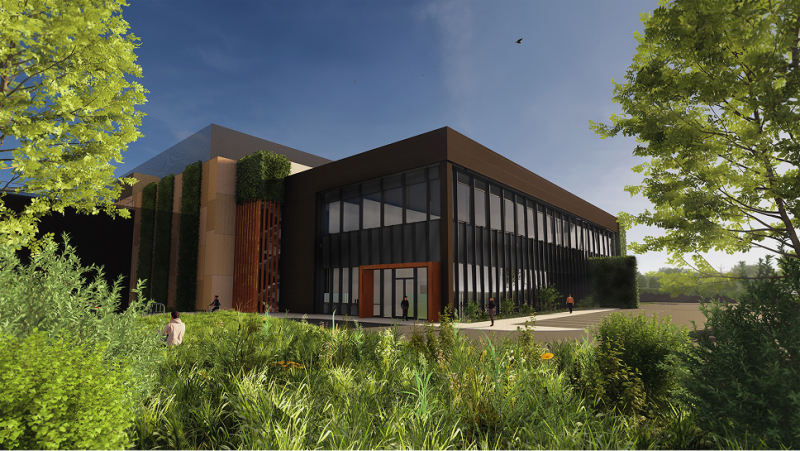

ЦОД с парком: гигантский «зелёный» кампус DC01UK в Хартфордшире достался Equinix, которая вложит в него £3,9 млрдКомпания DC01UK объявила, что колокейшн-гигант Equinix приобрёл в Хартфордшире (Великобритания) кампус площадью более 34 га. Для него предыдущий владелец уже получил в январе 2025 года разрешение на строительство кампуса гиперскейл-уровня, а также предварительно договорился о поставках 400 МВА, сообщает Computer Weekly. Покупка, по данным DC01UK, является одной из крупнейших сделок по передаче инфраструктуры и недвижимости в мире. Equinix подтвердила, что намерена инвестировать £3,9 млрд ($5,1 млрд) в строительство. На площадке компания намерена возвести ЦОД общей площадью более 185 тыс. м2 и IT-мощностью более 250 МВт. Площадка, переименованная Equinix в Hertfordshire Campus, создаст более 200 постоянных рабочих мест после сдачи объекта. Сегодня компания уже управляет 14 объектами в Великобритании, на неё в стране работает более 1,2 тыс. человек. DC01UK в 2022 году основали специалисты в области возобновляемой энергетики Chiltern Green Energy и строительная компания Griggs Home. В сентябре 2024 года компания подала заявку на строительство нового кампуса с намерением продать впоследствии участок оператору ЦОД для завершения работ с учётом конкретных технических требований последнего. В DC01UK заявляют, что компания продолжит развивать в Великобритании другие проекты ЦОД. Стоит отметить, что, хотя её проект в Хартфордшире получил поддержку правительства, нашлись и противники. Даже заявка на строительство получила более 900 возражений в ходе рассмотрения. Equinix заявляет, что намерена работать в тесном сотрудничестве с местными жителями и бизнесами, чтобы те ощутили на себе все выгоды инвестиций в территорию, включая программы обучения и трудоустройства и др. Кампус будет снабжаться возобновляемой энергией и получит драйкулеры, так что ЦОД будут потреблять не больше воды, чем обычные офисные здания, говорит компания. Более того, Equinix выразила готовность сохранить 54 % территории незастроенной, а также повысить её биоразнообразие минимум на 10 %. По словам представителя Equinix, речь идёт о крупнейшей на данный момент инвестиции компании в Европе, которая пойдёт на пользу и стране, и местным жителям. Кроме того, компания рассмотрит возможность использования тепла ЦОД для отопления, расширит инфраструктуру велодорожек в районе, построит дренажную систему для предотвращения наводнений и защиты водных угодий, организует образовательные программы, а также расширит местную автобусную сеть. По данным Datacenter Dynamics, Хартфордшир и соседний Эссекс становятся всё популярнее среди операторов дата-центров. Google открыла объект в Уолтем-Кроссе (Waltham Cross) в рамках инвестиционной программы объёмом £5 млрд ($6,81 млрд), а Microsoft намерена развернуть в Лоутоне (Loughton, Эссекс) суперкомпьютер в дата-центре Nscale, который пока не достроен.

31.10.2025 [13:49], Сергей Карасёв

NVIDIA представила платформу IGX Thor для «физического ИИ» на периферииКомпания NVIDIA анонсировала аппаратную платформу IGX Thor, предназначенную для «переноса» ИИ из цифрового мира в физический. Решение разработано специально для промышленных, робототехнических и медицинских сред. IGX Thor позволяет проектировать периферийные устройства с ИИ-функциями, поддерживающие получение информации от различных датчиков. В семейство IGX Thor входят комплекты для разработчиков IGX Thor Developer Kit и IGX Thor Developer Kit Mini, а также решения IGX T7000 (плата Micro-ATX) и IGX T5000 («система на модуле»). Комплекты IGX Thor Developer Kit, в свою очередь, представлены в версиях с ускорителем NVIDIA RTX PRO 6000 Blackwell Max-Q Workstation Edition и NVIDIA RTX Pro Blackwell 5000. Вариант IGX Thor Developer Kit Mini не предполагает наличие дискретного GPU. Старшая из новинок, IGX Thor Developer Kit с ускорителем NVIDIA RTX PRO 6000 Blackwell Max-Q Workstation Edition, содержит GPU на архитектуре Blackwell с 24 064 ядрами. Предусмотрено 96 Гбайт памяти GDDR7 с пропускной способностью до 1792 Гбайт/с. Заявленная ИИ-производительность достигает 5581 Тфлопс в режиме FP4-Sparse. Модификация IGX Thor Developer Kit на базе NVIDIA RTX Pro Blackwell 5000 несёт на борту GPU поколения Blackwell с 14 080 ядрами. Объём встроенной памяти составляет 48 Гбайт, её пропускная способность — 1344 Гбайт/с. Быстродействие ИИ достигает 4293 Тфлопс (FP4-Sparse). Все три новинки, включая версию Mini (обладает ИИ-быстродействием 2070 Тфлопс), располагают интегрированным GPU на архитектуре Blackwell с 2560 ядрами и максимальной частотой 1,57 ГГц. Присутствует CPU с 14 ядрами Arm Neoverse-V3AE с частотой до 2,6 ГГц. Изделия оборудованы 128 Гбайт памяти LPDDR5X с пропускной способностью 273 Гбайт/с, а также накопителем M.2 NVMe (PCIe 5.0 x2) вместимостью 1 Тбайт. Старшие модели наделены двумя слотами PCIe 5.0 (x8 и x16), младшая — разъёмом M.2 Key E, в который установлен комбинированный адаптер Wi-Fi 6e / Bluetooth. Изделия поддерживают различные интерфейсы, включая (в зависимости от модели) USB 3.2 Gen2 Type-C, USB-3.2 Gen2 Type-A, DisplayPort 1.4a, HDMI 2.0b, 1/5GbE (RJ45), 25GbE (QSFP28), 100GbE (QSFP28) и пр. Для новинок гарантированы 10-летний жизненный цикл и долгосрочная поддержка программного стека NVIDIA AI. В продажу все изделия поступят в декабре нынешнего года.

31.10.2025 [10:24], Сергей Карасёв

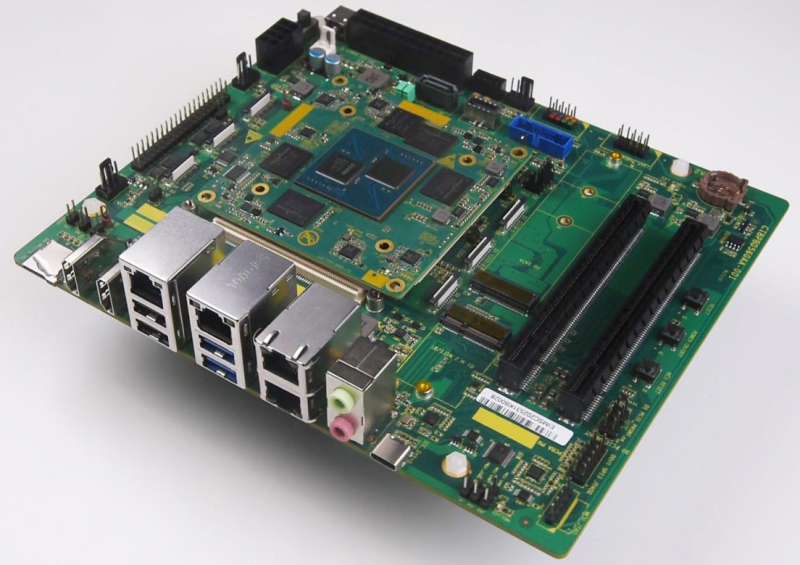

Eswin выпустила плату EBC7702 формата Mini-DTX с процессором RISC-VКомпания Eswin Computing в партнёрстве с Canonical, по сообщению CNX Software, подготовила к выпуску компактную плату для разработчиков EBC7702. Новинка подходит для работы с ИИ-задачами и приложениями, предполагающими локальную обработку данных. Решение выполнено в форм-факторе Mini-DTX с размерами 203 × 170 мм. Основой служит двухкристальная SoC Eswin EIC7702X, в состав которой входит процессор с восемью ядрами RV64GC на архитектуре RISC-V с частотой 1,4–1,8 ГГц. Предусмотрен встроенный нейропроцессорный модуль (NPU), обеспечивающий производительность до 40 TOPS на операциях INT8, до 20 TOPS в режиме INT16 и до 20 Тфлопс FP16. Графический движок обеспечивает поддержку OpenGL ES 3.2, OpenCL 1.2/2.1 EP2, Vulkan 1.2, EGL 1.4 и Android NN HAL. Возможно декодирование видеоматериалов в формате H.265 до 8K (100 к/с) или 64 потоков 1080p30, а также кодирование видео H.265 до 8K (50 к/с) или 26 потоков 1080p30. Плата может нести на борту 32 или 64 Гбайт памяти LPDDR5-6400. В оснащение входят флеш-модуль eMMC вместимостью 32 Гбайт, 16 Мбайт памяти SPI Flash, слот microSD, коннектор M.2 M-Key для SSD с интерфейсом SATA, порт SATA, разъём M.2 E-Key M2230 для адаптера Wi-Fi / Bluetooth и два слота PCIe 3.0 x16. Присутствуют четыре сетевых порта 1GbE и контроллер Wi-Fi 5 (802.11ac) с частотными диапазонами 2,4/5 ГГц. Модель EBC7702 получила по два порта USB 3.0 Type-A и USB 2.0 Type-A, четыре гнезда RJ45 для сетевых кабелей, два интерфейса HDMI, порт USB 2.0 Type-C, стандартные аудиогнёзда на 3,5 мм. Есть два интерфейса MIPI DSI (4 линии), четыре интерфейса MIPI CSI (4 линии) и 40-контактная колодка GPIO с поддержкой I2C, I2S, SPI, UART. Для подачи питания предусмотрены 24-контактный разъём ATX и 8-контактный разъём ARX. Плата будет поставляться с предустановленной ОС Ubuntu 24.04 LTS. Приём предварительных заказов начнётся в ближайшее время. Ориентировочная цена — $700 за вариант с 32 Гбайт ОЗУ. |

|