Материалы по тегу: hardware

|

08.06.2026 [15:33], Руслан Авдеев

Стартап Windrose Electric, разрабатывающий электрические грузовики, представил концепцию ИИ ЦОД на колёсах

hardware

автомобиль

аккумулятор

ии

инференс

контейнер

микро-цод

модульный

цод

электропитание

энергетика

Бельгийский стартап, занимающийся разработкой и выпуском электромобилей, представил концепцию контейнерных мобильных ЦОД. Ранее в этом году компания уже озвучила планы по созданию контейнерных ИИ- и энергетических решений на колёсах, которые можно будет легко доставлять туда, где они необходимы, с использованием её электрогрузовика с полуприцепом — R700, сообщает Datacenter Dynamics. Windrose Electric заявила о премьере новой продуктовой линейки «ИИ в коробке» для хранения электроэнергии, а также «модульного» решения для ИИ-инференса в отдельном контейнере. Сообщалось, что контейнер с вычислительным оборудованием может обеспечить инференс-нагрузки мощностью 500 кВт, а аккумуляторный контейнер способен хранить до 4 МВт·ч. Контейнерные дата-центры и соответствующая инфраструктура уже широко представлены в отрасли ИИ-решений, но обычно они перевозятся на крупных бортовых грузовиках с последующей разгрузкой, тогда как решения Windrose не предусматривают разгрузки и остаются в кузове или на колёсной платформе. Насколько практично подобное решение, пока не вполне понятно. Вычислительный модуль мощностью 500 кВт с питанием только от аккумуляторов ёмкостью 4 МВт·ч израсходует весь запас энергии в течение одного дня, после чего ему потребуется либо новое энергохранилище, либо подключение к внешнему источнику питания.

Источник изображения: Windrose Electric В этом месяце было объявлено, что Windrose работает с китайской энергетической компанией LiFe-Younger над мобильным контейнером для обеспечения ЦОД электроэнергией. В частности, сообщалось о планах разработать контейнерный аккумуляторный модуль с грузовиком-тягачом, обеспечивающим 2 МВт мощности в 20′ контейнере, который способен помочь справиться с нехваткой энергии в электросетях. В качестве энергетического модуля будет использоваться разработка iMContainer компании LiFe-Younger. Основанная в Китае в 2022 году, компания Windrose переместила штаб-квартиру в Бельгию и выпускает мощные электрические грузовики с большим запасом хода для коммерческой логистики. В настоящее время они способны проехать более 670 км без подзарядки с грузом массой 49 т. Основанная в 2016 году компания LiFe-Younger предлагает мобильные и стационарные решения для зарядки электромобилей и системы хранения энергии.

08.06.2026 [09:41], Сергей Карасёв

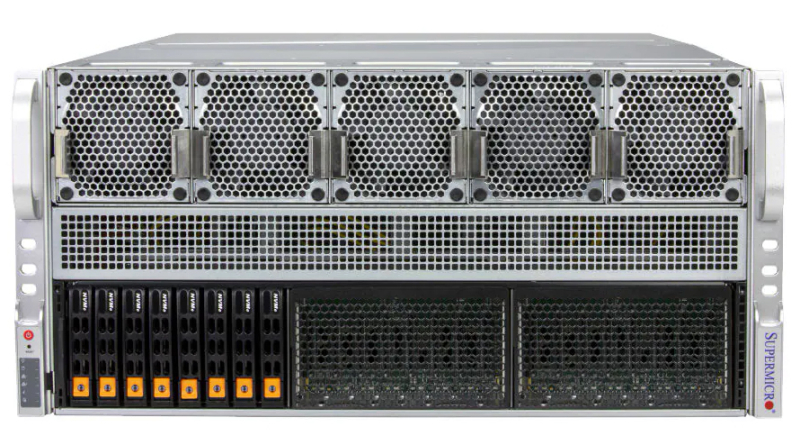

Supermicro представила Arm-серверы для агентного ИИКомпания Supermicro анонсировала серверы с Arm-процессорами, оптимизированные для агентного ИИ. Устройства обеспечивают высокую энергоэффективность и масштабируемость, позволяя формировать стойки высокой плотности. Представлены модели с воздушным и жидкостным охлаждением. В частности, дебютировал сервер ARS-222H-NR типоразмера 2U, допускающий установку двух процессоров Arm AGI с 64, 128 или 136 вычислительными ядрами. Предусмотрены 24 слота для модулей DDR5-8800 суммарным объёмом до 6 Тбайт. Во фронтальной части расположены восемь отсеков для SFF-накопителей (NVMe). Есть пять слотов PCIe 6.0 x16 для карт FHHL, по одному разъёму PCIe 6.0 x8 FHHL и PCIe 6.0 x8 AIOM (OCP 3.0), а также коннектор M.2 22110/2280 для SSD с интерфейсом PCIe 4.0 x1. Применено воздушное охлаждение. Питание обеспечивают два блока мощностью 2700 Вт с сертификатом 80 Plus Titanium. Кроме того, представлен GPU-сервер ARS-522GP-NR формата 5U с поддержкой двух чипов Arm AGI. Эта машина позволяет задействовать до восьми ИИ-ускорителей двойной ширины (восемь слотов PCIe 5.0 x16). Конфигурация включает 24 разъёма для модулей DDR5-8800 (до 6 Тбайт), четыре слота PCIe 5.0 x16 FHHL, по одному слоту PCIe 6.0 x16 FHFL и PCIe 5.0 x8 AIOM (OCP 3.0). Доступны восемь фронтальных отсеков для SFF-накопителей (NVMe) и коннектор M.2 22110/2280 (PCIe 4.0 x1). Задействованы шесть блоков питания мощностью 2700 Вт с сертификатом 80 Plus Titanium и воздушное охлаждение. В свою очередь, модель ARS-242TP-QNR-LCC стандарта 2OU использует четырёхузловую конфигурацию с прямым жидкостным охлаждением D2C (Direct to Chip). Каждый узел рассчитан на два чипа Arm AGI, 24 модуля DDR5-8800 (до 6 Тбайт) и два накопителя M.2 22110/2280 (PCIe 6.0 x4). Кроме того, имеются два слота PCIe 6.0 x16 AIOM (OCP 3.0) и два опциональных фронтальных отсека для накопителей E1.S (PCIe 5.0 x4). Питание осуществляется от централизованного шинопровода. Наконец, анонсирован сервер ARS-212HE-FNR формата 2U с поддержкой одного процессора Arm AGI (до 136 ядер) и 12 модулей DDR5-8800 (до 3 Тбайт). Возможны различные варианты исполнения подсистемы хранения данных, включая четыре или шесть фронтальных отсеков E1.S и шесть тыльных посадочных мест SFF. Стандартная конфигурация предлагает три слота PCIe 6.0 x16 FHFL, по одному слоту PCIe 6.0 x8 FHFL и PCIe 6.0 x16 AIOM (OCP 3.0). Реализован один слот M.2 22110/2280 (PCIe 4.0 x1). Применено воздушное охлаждение. Мощность двух установленных блоков питания с сертификатом 80 Plus Titanium достигает 3200 Вт. У всех новинок диапазон рабочих температур простирается от +10 до +35 °C. Помимо Arm-серверов, компания Supermicro представила 12 новых систем серии X14 на аппаратной платформе Intel Xeon 6+ Clearwater Forest, включая модели ультравысокой плотности. Устройства входят в различные семейства — Hyper, SuperBlade, FlexTwin и GrandTwin. В зависимости от варианта используется форм-фактор 1U, 2U или 6U; доступны версии с воздушным и жидкостным охлаждением.

08.06.2026 [09:35], Владимир Мироненко

Folio Photonics привлёк $8 млн и планирует начать продажи многослойных оптических дисков в 2027 годуРазработчик многослойных оптических дисков Folio Photonics успешно завершил раунд финансирования серии A, в рамках которого привлёк $8 млн инвестиций, сообщил ресурс Blocks & Files. В числе инвесторов — Material Impact и The O.H.I.O. Fund, а также JumpStart Ventures, Pavey Investments, Refinery Ventures и JobsOhio Ventures Fund. В 2019 году Folio Photonics провела посевной раунд, сумев привлечь $8 млн. Альфа-версия оптического дисковода была разработана в 2024 году, а бета-версия второго поколения была представлена в прошлом году. В феврале этого года компания привлекла ещё $2,56 млрд в рамках посевного раунда. Теперь разработка продвинулась достаточно далеко, чтобы убедить инвесторов вложить средства в её дальнейшее развитие в рамках первого полноценного раунда финансирования. Полученные средства компания планирует направить на ускорение перехода от разработки технологий к коммерциализации, в том числе на расширение инженерной и операционной команд в Огайо, где находится её штаб-квартира. Также компания планирует активизировать взаимодействие с крупными партнёрами-гиперскейлерами, обеспечить коммерциализацию платформы архивного хранения и слоя знаний, а также масштабировать подготовку к производству и расширить стратегические отраслевые партнёрства. Накопитель и носители информации разработаны с учётом возможности интеграции с существующими производственными экосистемами, что позволит ускорить коммерциализацию решения, запланированную на 2027 год. Разрабатываемые Folio Photonics оптические диски содержат до 32 слоёв при стоимости хранения от $3/Тбайт данных. Данные хранятся в точках нанофотонной оптической среды в виде флуоресцентных сигналов, генерируемых лазерными импульсами. Диски класса WORM (Write Once, Read Many) с поддержкой чтения без возможности изменения или удаления данных могут хранить информацию от 50 до 100 лет. Оптические диски Folio Photonics первого поколения могут вмещать от 1 до 2 Тбайт данных, при этом несколько дисков можно устанавливать в один картридж. Компания запатентовала базовую технологию и три года назад привлекла специалистов к разработке собственного оптического дисковода. В Folio считают, что компания сможет изменить текущий рынок архивирования данных, объём которого, по прогнозам, превысит $12 млрд к 2028 году, благодаря превосходству её решения по экономической эффективности и скорости по сравнению с ленточными накопителями. Ожидается, что ИИ будет генерировать огромные объёмы данных, которые необходимо будет архивировать, что значительно увеличит рынок архивирования в будущем. Folio называет это инфраструктурой уровня знаний для эпохи ИИ — фундаментальной инфраструктурой, которая хранит данные, на основе которых обучаются ИИ-модели. Генеральный директор Стивен Сантамария (Steven Santamaria) отметил, что сейчас генерируется больше данных, чем существующая инфраструктура может вместить. «Сегодня существует большой и растущий потенциальный рынок традиционного архивного хранения — и мы намерены занять на нем лидирующие позиции. Но ещё большая возможность заключается в том, что будет дальше: слой знаний, который потребуется искусственному интеллекту. Старые данные — это будущая интеллектуальная информация. GPU генерируют интеллектуальную информацию — Folio сохраняет её», — заявил он. Помимо Folio Photonics также занимаются разработкой решений в сфере архивного хранения данных такие компании, как Archiflix, Biomemory, Cerabyte, Ewigbyte, Holomem, Microsoft (Project Silica), Optera, Piql, SPhotonix и Optera.

08.06.2026 [09:33], Сергей Карасёв

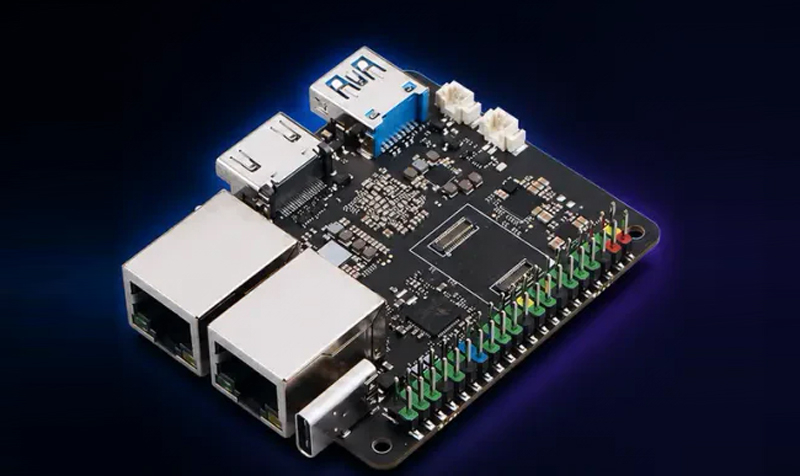

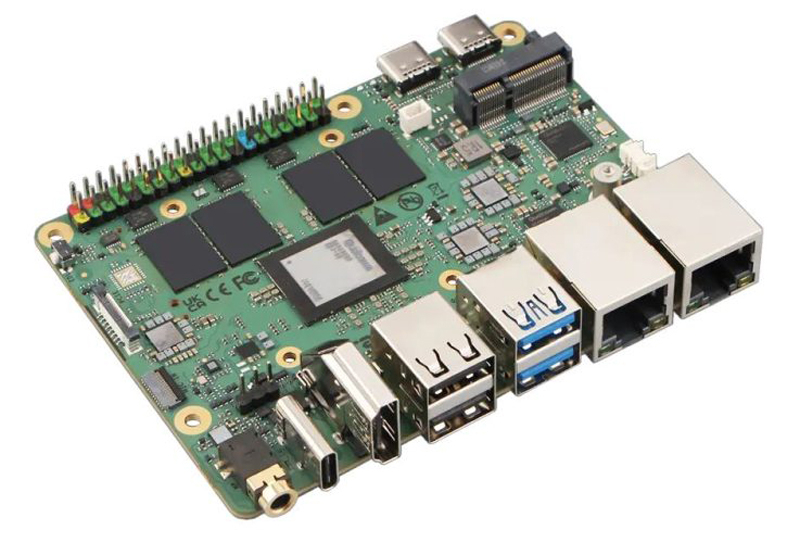

Чип Qualcomm и два порта 2.5GbE: вышел крошечный одноплатный компьютер Radxa Dragon Q5EКомпания Radxa пополнила ассортимент одноплатных компьютеров моделью Dragon Q5E, выполненной на аппаратной платформе Qualcomm. Новинка может использоваться для построения компактных устройств с ИИ-возможностями, функционирующих под управлением Radxa OS (на основе Debian) или Ubuntu. Изделие имеет размеры всего 65 × 56 мм. Применён процессор Qualcomm Dragonwing QCS6690 с восемью ядрами в конфигурации 1 × Kryo Prime с частотой 2,0 ГГц, 3 × Kryo Gold с частотой 2,0 ГГц и 4 × Kryo Silver с частотой 1,8 ГГц. В состав чипа входят графический ускоритель Qualcomm Adreno GPU 7-Series (1,15 ГГц) и нейропроцессорный узел с ИИ-производительностью до 6 TOPS. Интегрированный VPU-блок обеспечивает возможность кодирования видео 4Kр60 в форматах H.264/H.265 и декодирования материалов 4Kр120 в форматах H.264/HEVC. Реализована поддержка Wi-Fi 7 и Bluetooth 6, а также PCIe 3.0.

Источник изображения: Radxa Одноплатный компьютер может нести на борту до 16 Гбайт LPDDR5. Есть слот для карты microSD и коннектор для подключения флеш-накопителя UFS. Новинка располагает двумя сетевыми портами 2.5GbE RJ45 с опциональной поддержкой PoE, интерфейсом HDMI (1080p90), коннекторами MIPI DSI (4 линии) и MIPI CSI (4 линии, возможно подключение камер с разрешением до 32 Мп), портом USB 3.0 Type-A, а также 40-контактной колодкой GPIO с поддержкой UART, SPI, I2C, I3C и пр. Устройство получает питание через разъём USB Type-C (5 В). Имеется коннектор для подключения вентилятора охлаждения с ШИМ-управлением. Для новинки будет доступен корпус с ребристой верхней поверхностью, выполняющей функции радиатора для отвода тепла.

08.06.2026 [09:00], Владимир Мироненко

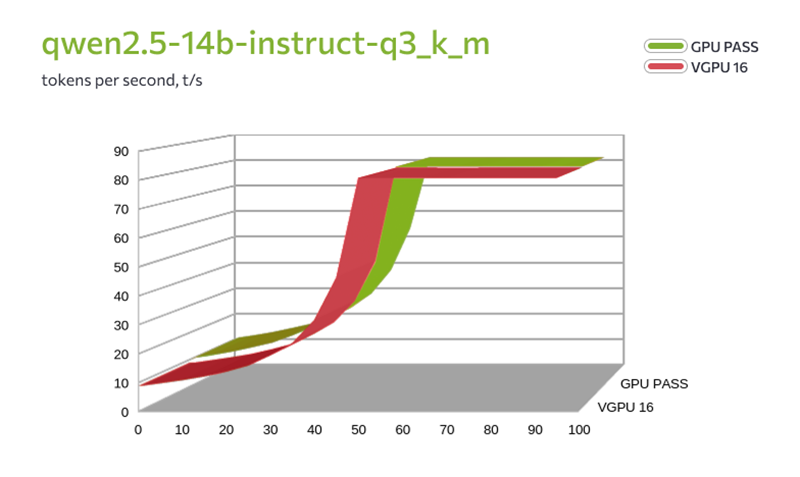

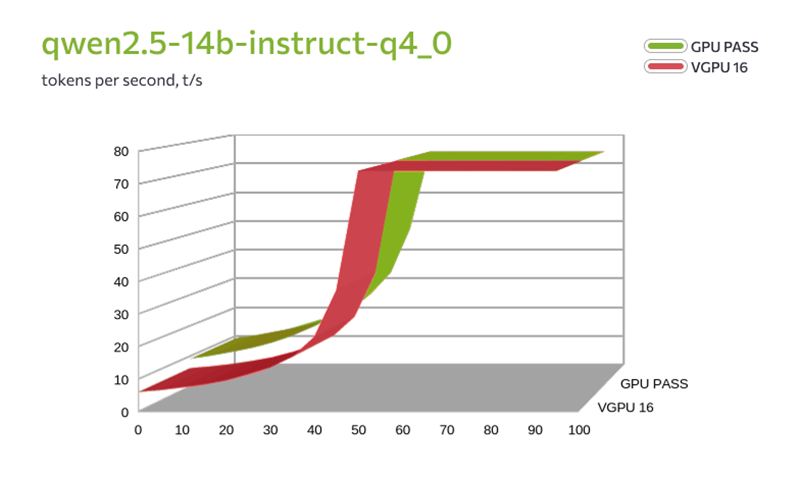

FirstVDS запустил vGPU-серверы на базе NVIDIA L40S и сравнил их с физическими GPU в реальных тестахПровайдер FirstVDS запустил тарифы с виртуальными GPU (vGPU) на базе NVIDIA L40S. Теперь в линейке два варианта: можно арендовать физическую видеокарту целиком (доступно с ноября 2025 года) или получить гарантированную долю виртуальной видеокарты. Компания также сравнила обе технологии в тестах и опубликовала результаты: скорость инференса LLM, генерацию видео и потребление видеопамяти. Доступны четыре тарифа vGPU — от 4 до 16 Гбайт видеопамяти. Технология vGPU делит физическую видеокарту на несколько профилей с фиксированной долей ресурсов. Серверы работают на виртуализации KVM с процессорами AMD EPYC. Стоимость — от 299 рублей в сутки. Для сравнения: тарифы с физическим GPU (Passthrough) стартуют от 1150 руб./сутки. В них доступны RTX 4090 и 5090, L4 и L40S — вся видеокарта полностью закрепляется за одной виртуальной машиной. За последние полгода спрос на GPU-серверы вырос кратно — в первую очередь из-за задач, связанных с LLM, генерацией изображений и видео. Но не каждому проекту нужна 100 % мощность физической карты. Разработчики, Data Science-команды и небольшие студии часто ищут более доступный вход с предсказуемой долей ресурсов. vGPU как раз закрывает этот запрос. Никита Попов, директор по продукту FirstVDS: «В ноябре мы закрыли потребность в сырой мощности, запустив GPU Passthrough. Но рынку нужен не только потолок производительности, но и адекватная юнит-экономика. vGPU закрывает именно этот сегмент — снижает порог входа до 300 руб. в сутки. Мы прогнали бенчмарки. Сравнивать виртуалку с выделенной картой в лоб бессмысленно — физика берет свое, чудес не бывает. Наша цель была другой: четко очертить границы применимости. Показать механику, при которой vGPU вытягивает нагрузку, и где проходит черта, за которой пора брать полноценное железо». Что показало тестированиеКомпания протестировала две конфигурации: GPU Passthrough (L40S, 48 Гбайт, 16 ядер CPU) и vGPU 16 Гбайт (8 ядер CPU). В сценариях использовались инференс LLM через llama.cpp (модели Qwen 2.5 и 3.6) и генерация видео через ComfyUI с шаблоном Wan2.2 TI2V 5B Hybrid. Результаты в целом предсказуемы: физическая карта ожидаемо обгоняет виртуальные GPU по производительности. Но обнаружилось два важных нюанса. Во-первых, при тестировании моделей среднего размера (qwen2.5-14b в двух вариантах квантизации — q3_k_m и q4_0) на vGPU-16 и Passthrough оказалось, что при полной загрузке модели в видеопамять скорость генерации токенов практически не отличается. Разница возникает только в смешанном режиме CPU+GPU (до 30–40 слоёв), где vGPU-16 сдерживает вдвое меньшее количество ядер процессора.

Сравнение скорости генерации токенов (qwen2.5-14b) в зависимости от количества слоёв, загруженных в GPU. Passthrough vs vGPU 16 Гбайт Во-вторых, более крупные модели (Qwen3.6-35B) в vGPU-16 полностью не загружаются — памяти не хватает, они работают только в смешанном режиме CPU+GPU со снижением скорости. Генерация видео (ComfyUI) на vGPU-16 тоже работает, но с оговорками: пришлось отключать часть функций и добавлять swap — иначе приложение аварийно завершалось. Время генерации на vGPU-16 ожидаемо выше, чем на Passthrough (для 5-секундного ролика — 293 с против 144). Таким образом, несмотря на общее преимущество физической карты, виртуальный GPU способен решать определённые задачи — например, инференс средних языковых моделей при полной загрузке в видеопамять. Это делает vGPU осмысленным выбором, когда важнее доступная цена. Для более тяжёлых сценариев (крупные модели, комфортная генерация видео без доработок) производительности vGPU может не хватить. Подробные результаты тестирования — в отдельной статье. О компанииFirstVDS — российский провайдер виртуальных серверов. В портфеле — готовые и гибкие конфигурации VPS/VDS: от высокопроизводительных CPU-серверов (линейка «CPU.Турбо 2.0» до 5,7 ГГц) до GPU-решений (Passthrough и vGPU). Также доступны S3-хранилище, домены, SSL и техподдержка 24/7. Дата-центры в Москве, Нидерландах и Казахстане. Более 20 лет на рынке.

07.06.2026 [10:31], Руслан Авдеев

МИФИ и «Росатом» разработают малые ядерные реакторы для дата-центровВ России ведутся разработки сверхмалых ядерных реакторов для ЦОД. В проекте участвуют Национальный исследовательский ядерный университет МИФИ, «Росатом» и консорциум «Большой МИФИ», сообщают «Ведомости». По словам президента «Большого МИФИ» Валерия Романюка, существует подпрограмма создания сверхмалых реакторов для ЦОД. Речь идёт об объектах мощностью от 5 до 50 МВт. Отмечается, что нагрузка на оборудование ЦОД растёт во всём мире, в связи с чем создаётся новое специализированное подразделение. Оно займётся оптимизацией работы ЦОД с применением систем искусственного интеллекта и развитием сетевой инфраструктуры. Консорциум «Большой МИФИ» объединяет как сам «ядерный университет», так и крупные компании, желающие принять участие в работах над ядерными, квантовыми и IT-проектами. В последние дни стало известно и о других проектах, связанных с индустрией ЦОД. Так, видеохостинг Rutube, входящий в «Газпром-медиа», должен обзавестись собственным ЦОД — строительство начнётся уже в конце 2026 года в Ленинградской области. ВТБ рассчитывает выделить средства на строительство неподалёку от Донецка дата-центра на 500 стоек. Его ввод в эксплуатацию запланирован на 2030 год, а эксплуатировать объект будет телеком-компания «АйСи Групп».

Источник изображения: Hal Gatewood/unsplash.com Появились новые данные и о возможном международном сотрудничестве. Так, на фоне энергодефицита в России белорусские мощности готовы обеспечить электроэнергией российские дата-центры. Не исключался даже перенос на территорию Беларуси целых кластеров ЦОД. В конце 2025 года ВТБ прогнозировал, что к 2030 году энергопотребление дата-центров в России вырастет вдвое.

07.06.2026 [10:23], Сергей Карасёв

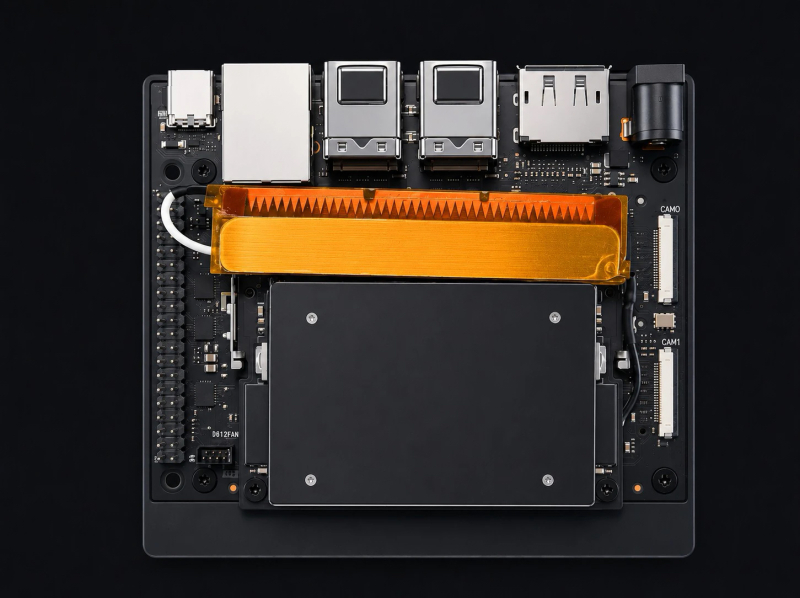

Одноплатный компьютер Radxa Dragon Q8B получил чип Snapdragon 8cx Gen3 и два порта 2.5GbEКомпания Radxa представила одноплатный компьютер Dragon Q8B, предназначенный для построения периферийных устройств с поддержкой ИИ. Это могут быть маломощные edge-серверы, робототехнические платформы, IoT-оборудование, дроны, системы видеонаблюдения и пр. В основу новинки положен процессор Qualcomm Snapdragon 8cx Gen3 с восемью ядрами в конфигурации 4 × Kryo Prime с частотой до 3 ГГц и 4 × Kryo Gold с частотой до 2,4 ГГц. В состав изделия входят графический ускоритель Adreno 690 с поддержкой DirectX 12 и нейропроцессорный блок Qualcomm AI Engine с ИИ-производительностью более 29 TOPS. Объём оперативной памяти LPDDR4Х-4266 может достигать 32 Гбайт. Поддерживается декодирование видеоматериалов в формате до 4K@120 и кодирование 4K@60.

Источник изображения: Radxa Одноплатный компьютер располагает слотами M.2 Key-M 2280 (PCIe 3.0 x4) и M.2 Key-M 2280 (PCIe 3.0 x2) для SSD, коннектором M.2 Key-E 2230 для комбинированного адаптера Wi-Fi/Bluetooth, слотом для карты microSD и разъёмом для подключения флеш-модуля UFS 3.1. Есть два сетевых порта 2.5GbE с гнёздами RJ45, по два порта USB 3.1 Type-C (DisplayPort 1.4b Alt Mode), USB 3.1 Type-A и USB 2.0 Type-A, интерфейс HDMI 2.1, 3,5-мм аудиогнездо, порт USB Type-C для подачи питания. Предусмотрены также 40-контактная колодка GPIO (с поддержкой UART, I2C, SPI и пр.), 16-контактный FPC-коннектор PCIe 3.0 и разъем для подключения вентилятора охлаждения. Изделие имеет размеры 100 × 75 мм. Заявлена совместимость с программными платформами Radxa OS, Windows, Ubuntu, Armbian, Arch Linux и Nix OS.

07.06.2026 [10:22], Руслан Авдеев

У Rutube появится первый собственный ЦОД стоимостью до 5–7 млрд рублейВходящий в «Газпром-медиа» (ГПМ) видеохостинг Rutube до конца 2026 года начнёт строить первый собственный ЦОД. Работы будут вестись в Ленинградской области, сообщают «Ведомости». Планируемый показатель PUE должен составить не более 1,3. По данным представителя ГПМ, ввод в эксплуатацию запланирован на 2028 год, «вводная мощность» ЦОД составит от 3 МВт, на первом этапе будет использоваться более 160 стоек и 2 тыс. серверов. При этом ожидается использование «импортозамещённого» серверного оборудования. По расчётам iKS-Consulting, сам объект на 3 МВт обойдётся в $20–$30 млн, причём стоимость серверов и оборудования может оказаться в 10 раз выше стоимости самого объекта. По словам экспертов, подходящие аппаратные решения есть у российских вендоров YADRO, «Аквариус», Delta Computers и др., а для работы с ИИ могут применяться ускорители NVIDIA или китайские чипы — на первом этапе мощности в 3 МВт для таких задач, вероятно, будет достаточно. Совокупная стоимость проекта, по некоторым оценкам, может составить 5–7 млрд руб. Предполагается, что новый ЦОД поможет расширить вычислительные мощности Rutube для хранения и обработки видео, а также развивать новые ИИ-направления и работать с инструментами на основе машинного обучения. По имеющимся данным, в настоящее время инфраструктура платформы размещена в арендованных или партнёрских ЦОД, поэтому появление собственного дата-центра в конечном итоге может помочь сэкономить средства и ускорить развитие сервиса.

Источник изображения: Acton Crawford/unspalsh.com Новый ЦОД может стать ключевым узлом CDN для всего Северо-Западного федерального округа. Впрочем, полного отказа от сторонних площадок в обозримой перспективе ожидать не приходится. Даже крупнейшие цифровые сервисы часто обращаются к смешанной модели, что позволяет быстро резервировать мощности, масштабировать инфраструктуру и запускать новые решения.

07.06.2026 [10:09], Владимир Мироненко

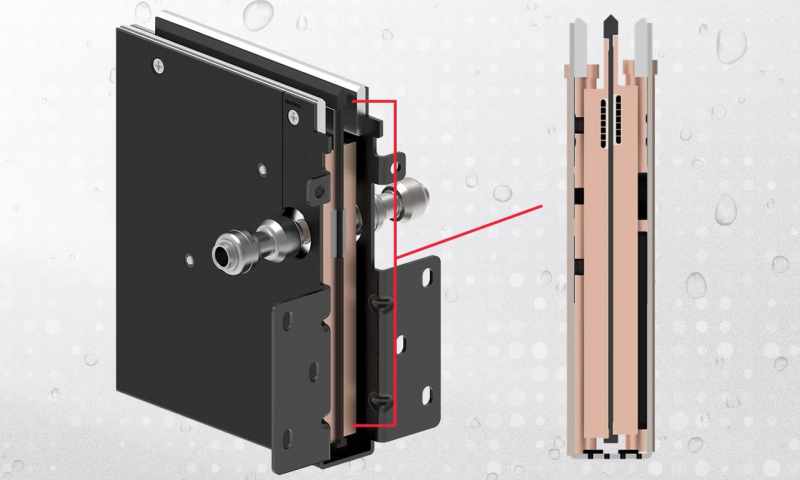

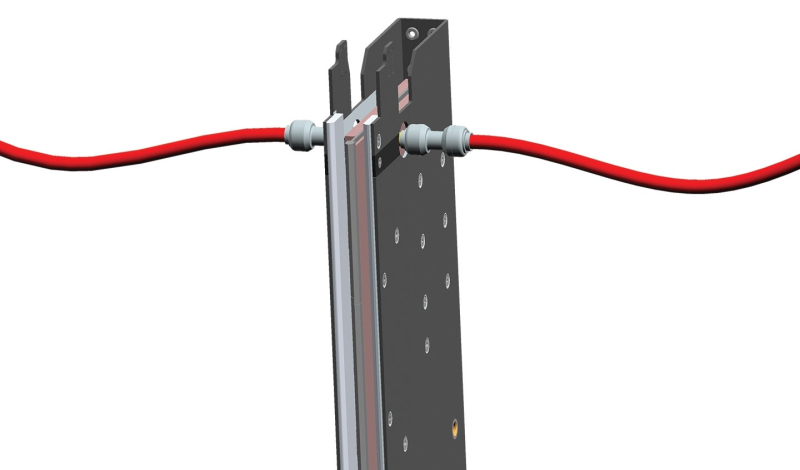

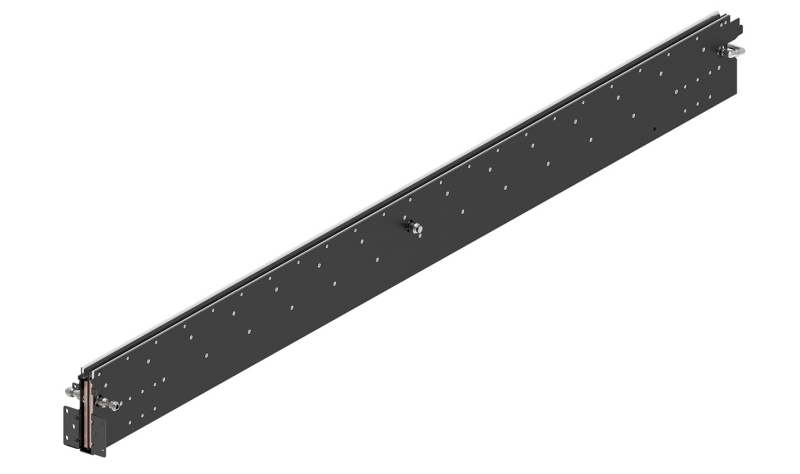

15 тыс. ампер на стойку: Molex представила шину питания с многоканальным жидкостным охлаждением для ИИ ЦОДКомпания Molex представила шину питания с многоканальным жидкостным охлаждением, предназначенную для использования в ИИ ЦОД. Как сообщает компания, предложенная технология объединяет распределение электроэнергии и жидкостное охлаждение в единый инфраструктурный компонент, предназначенный для поддержки ИИ-систем следующего поколения. Molex отметила, что с ростом интенсивности ИИ-нагрузок требования к мощности стоек приближаются к порогу в 1 МВт, в связи с чем традиционная инфраструктура с воздушным охлаждением достигла физического предела. Компания попыталась решить эту проблему, распространив жидкостное охлаждение на уровень распределения питания, обеспечив поддержку силы тока до 15 тыс. А и планируя в будущем достичь 25 тыс. А. Вместо одного канала, используемого в традиционной конструкции с жидкостным охлаждением, Molex предложила архитектуру с семью отдельными каналами СЖО. Многоканальная структура призвана уменьшить количество зон перегрева, а также обеспечить более равномерное и эффективное отведение тепла и более стабильную работу электрооборудования при высоких токах. По данным моделирования Molex, эффективность охлаждения повышается до 20 % по сравнению с одноканальной конструкцией. При этом растёт показатель тепловой эффективности — до 15 °C T-Rise при токе 15 тыс. А. Возможность максимизировать отведение тепла при тех же габаритах позволяет архитекторам ЦОД масштабировать мощность без ущерба для ценного пространства в стойке, отметила компания. Шины могут быть сконфигурированы по длине, глубине, а также по положению входного и выходного отверстий для жидкости. Эта гибкость в сочетании со стандартным интерфейсом plug-and-play обеспечивает плавный переход к жидкостному охлаждению без необходимости перепроектирования инфраструктуры стойки. Благодаря совместимости габаритов с механическими стандартами ORV3 и HPR упрощается интеграция в стоечные архитектуры, которые уже разрабатываются с учётом всё более высоких токовых нагрузок и более высокой тепловой плотности. Совместимость с диэлектрическими и недиэлектрическими жидкостями гарантирует беспрепятственную интеграцию технологии в различные существующие контуры охлаждения объектов. Развёртывание ИИ-инфраструктуры изменило роль оборудования распределения питания. Ускорители и высокоскоростная память повышают плотность размещения оборудования в стойках, в то время как прямое охлаждение чипов уже вошло в состав основных высокопроизводительных систем. Проводники, разъёмы и шины, передающие питание по стойке, теперь подвергаются тому же тепловому и механическому воздействию, что и вычислительный слой, который они питают, отметил ресурс IN Electronics. Распределение более высокого напряжения предлагает один из способов снижения нагрузки на медь и ограничения потерь при преобразовании. Работа Infineon с экосистемой стоек NVIDIA на 800 В DC показывает, как архитектуры на уровне стойки отходят от постепенных изменений в системе питания в сторону более масштабной электрической модернизации. Разработка Molex решает ту же проблему масштаба стойки со стороны проводников и охлаждения. Жидкостно-охлаждаемые шины питания не устранят необходимость в эффективных преобразовательных каскадах или надёжной защите, но они решают проблему обеспечения температурного режима для стоек с высокими токами. По мере повышения силы тока, силовая магистраль становится одновременно и электрическим каналом, и тепловой структурой, а её конструкция все больше влияет на плотность размещения оборудования в стойках, надёжность, удобство обслуживания и циклы модернизации.

06.06.2026 [11:27], Сергей Карасёв

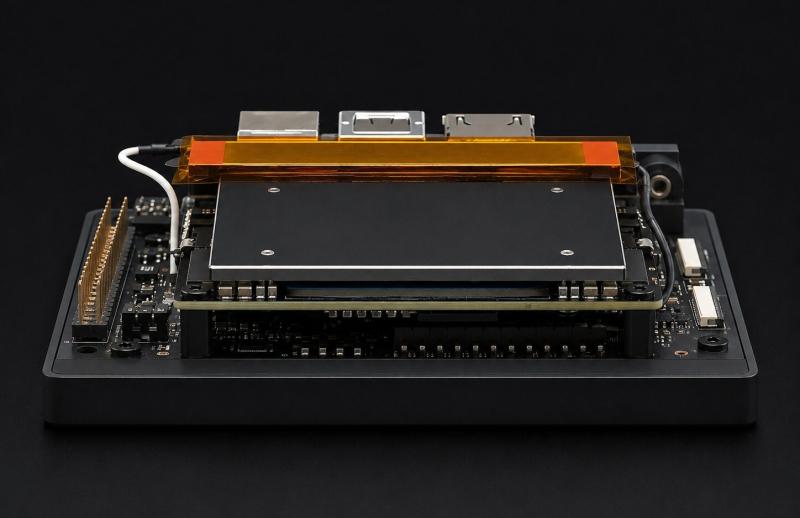

YPlasma создала твердотельный модуль охлаждения на основе ионного ветра для NVIDIA Jetson Orin NanoКомпания YPlasma представила инновационный твердотельный модуль охлаждения для одноплатного компьютера NVIDIA Jetson Orin Nano. Необычный кулер не создаёт практически никакого шума или вибраций, обеспечивая при этом стабильную работу устройства в круглосуточном режиме. В основу охладителя положена технология плазменного актуатора с диэлектрическим барьерным разрядом (DBD). Вместо обычного вентилятора задействована особая гибкая плёнка толщиной 200 мкм, которая генерирует ионный ветер: воздух перемещается с помощью электрических полей высокого напряжения, но низкого тока. В результате достигается эффективное охлаждение ключевых компонентов одноплатного компьютера, заявляет компания. В составе кулера YPlasma плёнка-актуатор заключена в корпус с размерами 100 × 30 × 4,5 мм. Дополнительно применяется проводящая пластина с габаритами 87 × 60 × 2 мм. Таким образом, толщина всей конструкции составляет около 6 мм, что меньше по сравнению с существующими микровентиляторами, у которых это значение варьируется от 8 до 12 мм. Пиковое напряжение (kVpp) заявлено на отметке 16 кВ (50 Гц), а энергопотребление актуатора находится ниже 1 Вт. Уровень производимого при работе шума — менее 20 дБА. Отсутствие движущихся частей, подшипников и прочих механических компонентов, характерных для традиционных активных кулеров, обеспечивает высокую надёжность. Новое решение может применяться в герметичных корпусах в различных условиях эксплуатации — на производствах, открытых пространствах и т. д. После 10 мин. работы решение YPlasma обеспечивает стабилизацию температуры на поверхности одноплатного компьютера NVIDIA Jetson Orin Nano (при мощности 15 Вт) на уровне 85 °C. |

|