Материалы по тегу: hardware

|

10.06.2026 [13:42], Руслан Авдеев

Китай готовится потратить $295 млрд на строительство ИИ-инфраструктуры по всей странеВ следующие пять лет Китай рассчитывает потратить ¥2 трлн ($295 млрд) на строительство ИИ ЦОД по всей стране. Это поддержит стратегию Пекина, направленную на то, чтобы превзойти США в технологиях, которые могут определить мирового технологического лидера на десятилетия вперёд, сообщает Bloomberg. Источники сообщают, что ключевые государственные ведомства, включая Государственный комитет по развитию и реформам КНР, работают над проектом создания сети вычислительных хабов. В основном их будут использовать государственные компании вроде China Mobile и China Telecom. Предполагается, что не менее 80 % технологий, включая ИИ-чипы, будет поставляться китайскими производителями уровня Huawei и др., что фактически вытеснит с местного рынка продукцию NVIDIA и AMD. Это амбициозная попытка Пекина создать основу для будущего развития ИИ в КНР. Проект напоминает инициативы прошлых лет, когда госструктуры мобилизовали ресурсы для замещения американских технологий. Кроме того, он, вероятно, является ключевой частью анонсированной ранее в этом году программы «Шесть сетей», посвящённой строительству критически важной инфраструктуры — от объектов водоснабжения и электроэнергетики до мощностей ЦОД. По словам источников, пожелавших остаться анонимными, проект строительства ИИ-хабов пока находится на ранней стадии реализации. Тем не менее Пекин решительно настроен развивать передовые технологии даже на фоне сокращения расходов в других сферах. В основном финансирование будет осуществляться за счёт роста госдолга, в том числе выпуска сверхдолгосрочных государственных облигаций сроком обращения более 10 лет. Кроме того, участие в финансировании примут государственные фонды, инвестирующие в стратегически важные отрасли. Помогут и банковские кредиты, а также частный капитал в том или ином виде. По словам экспертов, единая вычислительная сеть позволит объединить разрозненные ресурсы в регионах и предоставить бизнесу более широкий доступ к высокопроизводительным вычислениям. Также она будет способствовать распространению агентного и физического ИИ.

Источник изображения: Simone Dinoia/unspalsh.com Идея строительства единой вычислительной сети была изложена в последнем пятилетнем плане Китая, действующем до 2030 года, в рамках которого власти намеревались уделить первоочередное внимание развитию инфраструктуры данных. Так или иначе, инвестиционная инициатива выглядит весьма скромно в сравнении с планом американских IT-гигантов выделить $725 млрд на развитие ИИ только в текущем году. Впрочем, ЦОД в Китае обходятся дешевле благодаря меньшим затратам на кадры, инфраструктуру и строительство, а названная сумма не включает частные инвестиции компаний вроде Alibaba Group и Tencent Holdings. Пока нет данных о том, как вычислительная сеть будет взаимодействовать с уже действующими частными площадками. Общая цель заключается в объединении разрозненных объектов в единую сеть, что поможет распространению ИИ в здравоохранении, транспортной сфере, управлении городами и других областях. Помимо ИИ-объектов, включая ЦОД и телеком-инфраструктуру, Китай планирует интегрировать в проект и энергетическую сеть страны. В этом случае общий объём инвестиций может достичь как минимум ¥5 трлн. Не так давно Вашингтон согласился продавать относительно устаревшие ИИ-чипы NVIDIA H200 китайским покупателям, фактически стремясь затормозить технологическое развитие КНР, которая пытается нагнать США в сфере разработки и производства ИИ-ускорителей, пока уступая системам Blackwell минимум на одно поколение. Впрочем, поставки чипов ещё не начались, что косвенно свидетельствует о намерении Пекина заменить некоторые ИИ-мощности оборудованием отечественного производства. В мае проверку безопасности прошли девять типов ИИ-чипов китайского происхождения, включая модели, разработанные Huawei, Alibaba, Shanghai Biren Technology и Moore Threads Technology. Это даёт им «зелёный свет» для более широкого использования в отраслях с повышенными требованиями к защите данных. Кроме того, доступ к более гибким ИИ-ресурсам получат компании из финансового сектора, промышленности, здравоохранения, логистики и других отраслей. По мнению экспертов Bloomberg Intelligence, перспективы монетизации китайского ИИ-сектора по-прежнему остаются под вопросом. Тем не менее такие масштабные вложения будут способствовать развитию экономики страны в целом, а не только отдельных частных компаний, включая Tencent, Alibaba, Baidu, MiniMax и Zhipu AI. Больше всего выиграют местные поставщики чипов, включая Huawei, а NVIDIA, вероятно, останется в стороне.

10.06.2026 [11:40], Руслан Авдеев

Crusoe набрала контрактов почти на 5 ГВт ИИ ЦОД, хотя один из крупных проектов поставлен на паузуСтроитель дата-центров для компаний уровня OpenAI и Microsoft — компания Crusoe заявила, что располагает контрактами на ЦОД общей мощностью почти 5 ГВт, даже с учётом приостановки работ на важной для неё площадке в Вайоминге, сообщает Bloomberg. Crusoe работала с поддерживаемой Blackstone компанией Tallgrass над строительством 1,8-ГВт кампуса в Шайенне (Cheyenne, Вайоминг) для неназванного арендатора. Во вторник она заявила, что по запросу клиента приостановила строительные работы на площадке. Законтрактованные мощности объёмом 4,9 ГВт включают флагманскую площадку проекта Stargate компаний OpenAI и Oracle в Абилине (Abilene, Техас). Первые два здания кампуса ЦОД уже функционируют, ещё шесть находятся в стадии строительства. Общая мощность объекта составит 1,2 ГВт.

Источник изображения: Amina Atar/unsplash.com В марте сообщалось, что ещё один клиент Crusoe — компания Microsoft, договорилась арендовать добавочные мощности на площадке Stargate в Техасе, от которых отказались Oracle и OpenAI. Будут арендованы 700 МВт дополнительных мощностей на новой площадке общей мощностью в 900 МВт. По данным Crusoe, строительные работы на объекте недавно начались. Crusoe также заключила контракты на строительство двух других крупных кампусов в Техасе. Речь идёт об объекте в Клоде неподалёку от Амарилло, где, по некоторым данным, заказчиком выступает Google. При этом Crusoe отказалась называть арендаторов обоих этих проектов, а также арендатора площадки в Вайоминге. Основанная в 2018 году компания специализируется на проектах крупных ЦОД для ИИ-вычислений. В показатель 4,9 ГВт входят мощности для её собственного облачного сервиса. В целом же портфель проектов компании, включая уже заключённые контракты, обсуждаемые с арендаторами проекты строительства площадок и объекты на стадии активного строительства, превышает 40 ГВт.

10.06.2026 [10:54], Руслан Авдеев

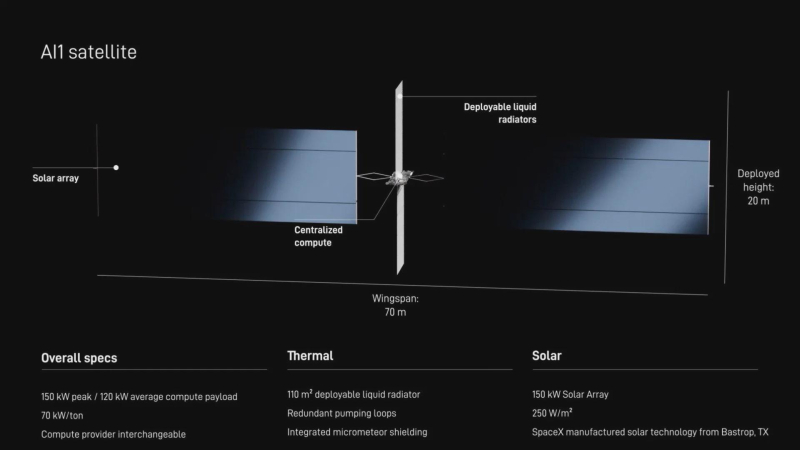

SpaceXAI раскрыла подробности будущих ЦОД на околоземной орбитеКомпания SpaceX изучает амбициозную концепцию развёртывания вычислительной ИИ-инфраструктуры на низкой околоземной орбите с учётом использования возможностей Starship для доставки спутников-ЦОД, сетевых технологий Starlink и спутниковых платформ с питанием от солнечной энергии. Всё это планируется применить для создания «ИИ-спутников», действующих в качестве орбитальных ЦОД, сообщает Converge Digest. В недавно опубликованных материалах компания обнародовала план, который позволит в перспективе перейти от развёртывания отдельных ЦОД с ИИ-возможностями, несущих ускорители на борту, к многогигаваттной орбитальной вычислительной инфраструктуре. Концепция основана на размещении ИИ-нагрузок непосредственно в космосе, где в избытке имеется солнечная энергия, а терморегуляцию можно организовать с помощью специальных радиаторов. По имеющимся данным, изначально ИИ-спутникам будет обеспечено по 120–150 кВт вычислительных мощностей — это приблизительный эквивалент одной современной стойки на основе систем класса NVIDIA GB300. Размах крыльев спутника составит 70 м, высота в развёрнутом состоянии — 20 м, солнечные элементы обеспечат мощность 250 Вт/м2, а двусторонние радиаторы — 1400 Вт/м2. Спутники будут использовать большие солнечные панели, основанные на технологиях, изначально разрабатывавшихся для нового поколения спутников Starlink. Платформы-ЦОД предназначены не для обеспечения связи — они будут состоять из солнечных батарей, радиаторов, вычислительного оборудования и оптических интерконнектов. По словам Илона Маска (Elon Musk), радиатор площадью 110 м2 будет использовать систему жидкостного охлаждения с «резервными насосными контурами», вероятно для поддержания циркуляции жидкости. Какой именно, не указывается, но эксперты уверены, что это не вода, поскольку темературы её замерзания и кипения для систем в вакууме вряд ли оптимальны. Эксперты предполагают, что будет использоваться аммиак, как на МКС, который не замерзает даже при низких температурах и оптимально подходит для сбора тепла и рассеивания его в космос. Вполне возможно, что спутники SpaceX будут использовать именно такую технологию с радиаторами, направленными в сторону от Земли и от Солнца. По мнению Маска, для ИИ-спутников не требуется «никакой магии». В основе технологии для спутников Starlink V3, которые отправятся в космос в конце 2026 года. При этом Маск подчеркнул, что ИИ-спутник намного проще, чем спутник Starlink, имеющий гигантские фазированные антенные решётки, параболические антенны, множественные лазерные каналы связи и пр.

Источник изображения: SpaceX По словам представителей SpaceX, аппараты будут работать на высотах 600–800 км и окажутся связаны как напрямую друг с другом с помощью лазеров, так и через возможности группировки Starlink. По оценкам компании, задержка для наземных пользователей может оказаться довольно низкой из-за относительной близости спутников к земной поверхности. Потенциально размещение вычислительных мощностей в космосе добавит лишь несколько миллисекунд к задержке. Подчёркивается, что ключевые аппаратные средства уже разрабатываются в недрах SpaceX. Starship позволит значительно увеличить объёмы доставки грузов на орбиту, а Starlink обеспечивает рабочую модель для взаимодействия больших группировок спутников и их оптической связи в космосе. Компания отметила, что планирует создать мощности для производства солнечных панелей и ИИ-спутников в Техасе. По мнению Маска, инициатива является частью более масштабного плана по использованию солнечной энергии за пределами поверхности Земли. По его словам, ограниченная доступность земельных участков, погодные условия и дефицит энергетических мощностей не позволяют в достаточной мере масштабировать ИИ-инфраструктуру непосредственно на планете. Полный переход в космос должен обеспечить ИИ-системам значительно больше солнечной энергии, одновременно избавив их от многих ограничений наземной инфраструктуры. Не так давно SpaceX подала заявку на размещение в космосе миллион спутников-ЦОД. При этом компания столкнулась с противодействием AWS, которая, в лице связанной Blue Origin, похоже, сама имеет схожие планы.

09.06.2026 [18:19], Руслан Авдеев

NVIDIA поможет SK hynix, Naver, Doosan, SK Telecom и LG расширить ИИ-инфраструктуру Южной КореиNVIDIA анонсировала новые партнёрства с южнокорейскими технологическими гигантами. В их числе — поставщик чипов памяти SK hynix, интернет-гигант Naver, транснациональный конгломерат Doosan Group, а также SK Telecom и LG, сообщает Silicon Angle. Сделки последовали за поездкой в Южную Корею главы NVIDIA Дженсена Хуанга (Jensen Huang). Прибыв в конце прошлой недели, он провёл выходные за встречами с руководителями южнокорейских технологических компаний. SK hynix подписала с NVIDIA соглашение о многолетнем технологическом партнёрстве, основное внимание в рамках которого уделяется совершенствованию чипов памяти нового поколения для использования в передовых ИИ ЦОД. В рамках договора компания будет взаимодействовать с NVIDIA для обеспечения стабильных поставок памяти для ИИ-индустрии. Кроме того, она попытается расширить присутствие в смежных нишах «персонального ИИ» и «физического ИИ» — например, в сфере автономной робототехники и транспорта. По словам Хуанга, стабильные поставки памяти имеют ключевое значение для ускорения строительства и масштабирования ИИ-фабрик, которые возглавят новую промышленную революцию под предводительством ИИ. Также партнёры намерены сотрудничать в области «технологий симуляции» для разработки полупроводников. SK hynix будет применять библиотеку NVIDIA CUDA-X и фреймворк PhysicsNeMo для повышения скорости и эффективности симуляций, используемых при разработке и производстве передовых чипов. Это включает технологии автоматизированного проектирования (т. н. Technology Computer-Aided Design, TCAD) для анализа характеристик полупроводниковых техпроцессов и технологии вычислительной литографии для создания схем микрочипов.

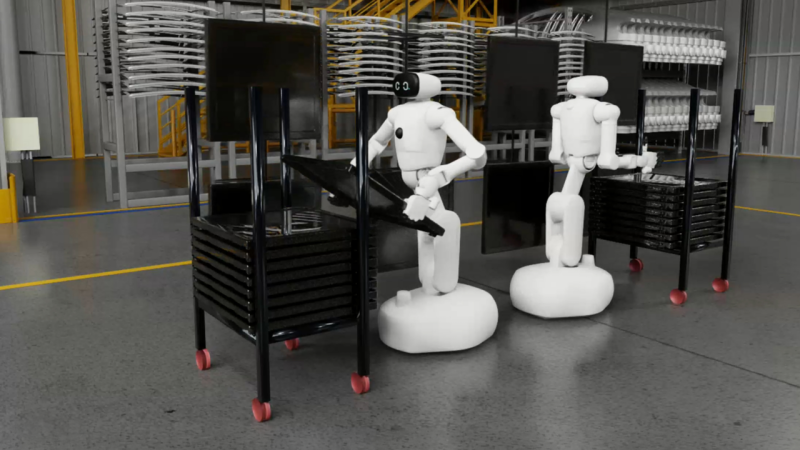

Источник изображения: NVIDIA Дополнительно родственная SK hynix компания SK Telecom рассчитывает построить в Южной Корее новое ИИ-облако гигаваттного масштаба на основе ИИ-ускорителей и инфраструктурных решений NVIDIA. Первый из нескольких ИИ ЦОД в составе этого облака должен быть введён в эксплуатацию в начале следующего года. С Naver и Doosan компания тоже договорилась о дополнительных проектах в сфере ИИ ЦОД. В случае с Naver взаимодействие стартует в Седжоне (Sejong), где расположен один из крупнейших в Азии ИИ ЦОД — Naver GAK Sejong. Компании намерены нарастить возможности объекта, а позже заняться строительством дополнительных ИИ-фабрик гигаваттного уровня, хотя будущее этих планов зависит от того, сможет ли Naver обеспечить необходимые закупки оборудования и доступ к электроэнергии. Doosan, разрабатывающая интеллектуальную робототехнику и выпускающая компоненты для GPU NVIDIA, поможет последней задействовать её энергетические решения в своих платформах для ЦОД. Doosan же рассчитывает применять технологии физического ИИ NVIDIA в своих роботах. Наконец, NVIDIA и LG Group строят ИИ-фабрику для ускорения развития нового поколения бизнесов LG, драйвером которых выступит ИИ, — от робототехники до автономного вождения, технологий ЦОД и облачных GPU-сервисов. ИИ-фабрика обеспечит LG инфраструктурой для обучения ИИ, симуляций, оценки и внедрения ИИ-приложений в ключевых сегментах бизнеса. Совместно компании объединят разработку ИИ-моделей, генерацию данных для физического ИИ, моделирование и обучение робототехники, развёртывание решений на периферии и создание цифровых двойников в масштабах целых предприятий в единый рабочий процесс для создания систем физического ИИ. Партнёрство с южнокорейскими компаниями должно помочь расширить присутствие NVIDIA в Южной Корее — одном из мировых технологических лидеров. Кстати, SK hynix и её конкурент Samsung Electronics являются двумя из трёх крупнейших производителей чипов памяти в мире, продукция которых имеет жизненно важное значение для ИИ ЦОД. В ноябре 2025 года сообщалось, что NVIDIA продаст Южной Корее 260 тыс. ускорителей для создания суверенной ИИ-инфраструктуры.

09.06.2026 [13:58], Руслан Авдеев

AMD поддержит суверенный ИИ в Великобритании, инвестировав в ИИ-отрасль страны £2 млрд

amd

dell

epyc

hardware

hpc

instinct

великобритания

ии

инвестиции

инференс

суперкомпьютер

финансы

фотоника

В следующие пять лет AMD рассчитывает инвестировать в усиление ИИ-экосистемы Великобритании до £2 млрд ($2,7 млрд), создав новую инфраструктуру, программы совместных исследований и подготовки кадров. По словам представителя техногиганта, новая стратегия согласуется с правительственным проектом AI Opportunities Action Plan и стратегией AI Hardware Strategy, с основным акцентом на суверенные ИИ-возможности, научные вычисления и передовые исследования, сообщает Converge! Digest. Ключевой компонент инициативы — расширение вычислительной ИИ-инфраструктуры. AMD и Dell Technologies поддерживают две новые суперкомпьютерные системы в Кембриджском университете. Суперкомпьютер Zenith AI, финансирование которого осуществляется Министерством науки, инноваций и технологий (DSIT) и структурой UK Research and Innovation (UKRI), строится как платформа для использования ИИ в науке. Система Sunrise создаётся совместно с Управлением по атомной энергии Великобритании для поддержки исследований в сфере термоядерных технологий. Оба суперкомпьютера будут использовать ускорители AMD Instinct, процессоры EPYC и ПО AMD для решения задач в сфере здравоохранения, климатологии, материаловедения, разработки научных ИИ-моделей и др. Также AMD анонсировала исследовательские партнёрства с Имперским колледжем Лондона и компанией Oriole Networks. В первом случае взаимодействие сосредоточено на вычислительных дисциплинах, здравоохранении, моделировании климата, ИИ-оптимизации, обработке значительных объёмов данных и др. В то же время AMD и Oriole Networks принимают участие в проекте Scaling Inference Lab британского агентства ARIA (Advanced Research and Invention Agency). Проект стоимостью £50 млн направлен на устранение ряда проблем современной ИИ-инфраструктуры. Он объединяет фотонную сетевую архитектуру PRISM компании Oriole, ускорители AMD Instinct, а также процессоры EPYC для оценки новых подходов к масштабированию задач ИИ-инференса с меньшей задержкой и повышенной энергоэффективностью.

Источник изображения: Robert Bye/unsplash.com По словам Converge!, лондонский стартап Oriole Networks намерен преодолеть традиционные ограничения классических ИИ-кластеров. Если в стандартных сетях на основе InfiniBand или Ethernet многократные преобразования оптического сигнала в электрический и обратно создают дополнительные задержки, то архитектура PRISM (Photonic Routing Infrastructure for Scalable Models) заменяет активные электронные коммутаторы «пассивным» оптическим ядром маршрутизации. Прямые оптические соединения узлов позволяют сократить время простоя GPU, связанное с ожиданием обмена данными, что мешает масштабным ИИ-нагрузкам. PRISM обеспечивает обработку динамического ИИ-трафика без использования электрических буферов пакетов данных. Многомерная коммутация каналов позволяет перенастраивать соединения в режиме реального времени и оптимизировать сеть под интенсивный обмен данными, характерный для больших языковых моделей. Кроме того, Oriole утверждает, что её технология позволяет объединять до миллиона оконечных устройств. В конечном счёте сокращение энергопотребления сетевого ядра может составить до 81 %. Ключевым элементом архитектуры PRISM является независимость от конкретного типа используемых процессоров и ускорителей. Вместо использования проприетарных интерконнектов, «привязывающих» операторов к определённой аппаратной платформе, Oriole разделяет транспортный и вычислительный уровни инфраструктуры. Компания заявляет, что её технологии интегрируются в существующие стеки ПО через стандартные драйверы PCIe и специализированные библиотеки ускорения вроде NCCL для NVIDIA или RCCL для AMD. Благодаря этому можно поддерживать разные аппаратные платформы без трансформации базовых ИИ-фреймворков. Будущее внедрение технологии в рамках ARIA Scaling Inference Lab станет значимой проверкой её жизнеспособности для отрасли и продемонстрирует, способны ли полностью фотонные сети гарантировать предсказуемую производительность и обеспечивать открытость проприетарных вычислительных систем в промышленных масштабах.

09.06.2026 [11:00], Руслан Авдеев

Сначала энергия: Google внедряет в Техасе бизнес-модель Power-First в ответ на дефицит электричества для ЦОДНа фоне того, что гиперскейлеры всё чаще сталкиваются с дефицитом электроэнергии для своих ЦОД, техасский кампус Google должен получить дата-центр с готовыми генерирующими мощностями в рамках бизнес-модели Power-First («сначала энергия»), сообщает Datacenter Knowledge. В гонке ИИ хороши все средства, и компании отходят от устаревшей модели ведения бизнеса, при которой новые нагрузки подключаются к энергосетям до того, как будут обеспечены новые генерирующие мощности. Google в своём ИИ-кампусе в Техасе рассчитывает обеспечить свой 1-ГВт ЦОД выделенной генерацией электроэнергии. Совместно с энергокомпанией Intersect реализуется план, при котором приоритет отдаётся созданию генерирующих мощностей параллельно со строительством вычислительной инфраструктуры. Инициатива появилась в критически важный момент — беспрецедентный дефицит электроэнергии испытывают энергокомпании и операторы ЦОД по всей территории США. На обновление линий электропередачи нередко уходят годы, а новые генерирующие объекты сталкиваются со сложностями при подключении к сетям даже при получении необходимых разрешений. Во многих регионах именно доступность электроэнергии определяет, где именно и когда гиперскейлеры смогут расширить свои мощности. Проблема столь серьёзна, что правительство США планирует выделить $700 млн на поддержку угольной энергетики для ИИ-инфраструктуры. По данным Google и Intersect, площадка Meitner Energy Center будет обеспечена от более 1 ГВт мощности от близлежащих новых ветровых и солнечных электростанций, а также аккумуляторных энергохранилищ в округах Грей и Робертс (Gray, Roberts). Компании заявили, что такая генерация поможет удовлетворить спрос ЦОД, снижая потребность в дополнительных поставках энергии из локальных электросетей. Наибольшая доля электроэнергии должна поступать из «чистых» источников, которые будут дополняться генераторами на самой площадке.

Источник изображения: Mick Haupt/unsplash.com Meitner — не первый проект ЦОД, взявший на вооружение модель Power-First. Google и Intersect ранее анонсировали совместное строительство в округе Хаскелл (Haskell, Техас), где объект Google возводится параллельно с так называемым Quantum Clean Energy Project компании Intersect — солнечной электростанцией мощностью 640 МВт, объединённой с аккумуляторным хранилищем ёмкостью 1,3 ГВт·ч. Энергетический проект должны ввести в эксплуатацию до конца текущего месяца, а строительство объекта Google уже ведётся. Оба проекта были анонсированы через считаные месяцы после того, как Google завершила сделку по покупке Intersect. Последняя специализируется на подключении к крупным промышленным потребителям генерирующих мощностей на основе «чистой» или газовой энергетики. Эти проекты демонстрируют стремление партнёров изменить подход к обеспечению дата-центров электроэнергией. Впрочем, вопрос о том, получит ли модель Power-First повсеместное распространение, остаётся открытым. Регулятор ERCOT (Electric Reliability Council of Texas) отказался комментировать детали, касающиеся проекта Meitner, но отметил ряд реформ в сфере присоединения к энергосетям крупных потребителей, а также наличие инициатив по планированию энергосистемы, сочетающих потребление больших объёмов электроэнергии с обязательной собственной генерацией. Ранее в этом месяце регулятор утвердил механизм Batch Zero, призванный упростить распределение пропускной способности электросетей для проектов с большими нагрузками. При этом даже объекты с собственной генерацией не могут полагаться исключительно на неё и требуют подключения к магистральным сетям и региональным системам обеспечения надёжности.

09.06.2026 [10:45], Руслан Авдеев

Как в «Безумном Максе»: Meta✴ строит в США «палаточные» ЦОД для ИИ-серверов на миллиарды долларовВместо традиционных капитальных зданий для своих ЦОД Meta✴ начала возводить в США «палатки», размещая в них чрезвычайно дорогое ИИ-оборудование. По некоторым данным, компания уже построила или находится в процессе строительства трёх дата-центров в рамках подобной концепции, уже вызвавшей ряд саркастических комментариев экспертов, сообщает Tom's Hardware. Площадка в Нью-Олбани (New Albany, Огайо) уже имеет пять зданий, на строительство которых ушло примерно 2–3 года. После этого компания решила сменить концепцию, начав устанавливать на территории пять тентов площадью более 11,6 тыс. м² каждый. Согласно местным муниципальным документам, работы стартовали в апреле 2026 года, а недавние спутниковые снимки показывают, что объекты фактически уже готовы. Технология доказала свою эффективность и сегодня применяется на двух площадках, включая одну в Теннесси. О стратегии установки «палаток» для размещения ИИ-оборудования глава Meta✴ Марк Цукерберг (Mark Zuckerberg) объявил ещё в 2025 году, вероятно, стремясь ускорить развёртывание инфраструктуры на фоне растущего спроса. Предполагается, что Meta✴ могла вдохновиться опытом xAI, построившей в 2024 году ЦОД на 100 тыс. ускорителей за 19 дней. Обычно на проекты подобного масштаба уходят годы, но в данном случае xAI задействовала помещения бывшего завода Electrolux.

Источник изображения: Cindy Chen/unsplash.com Размещение серверов «быстровозводимых структурах», которые в целом не совсем корректно называть обычными палатками — один из самых экзотических подходов к строительству ИИ-инфраструктуры. Они не так прочны, как конструкции из бетона и стали, и некоторые сравнивают такой подход с «защитой» гоночного велосипеда за $10 тыс. с помощью замка за $9. Тем не менее компания, вероятно, предварительно оценила связанные риски и сочла их приемлемыми по сравнению с потенциальными преимуществами в гонке ИИ. Ещё одним фактором, позволившим Meta✴ быстро развёртывать ЦОД, стала локальная генерация энергии «за счётчиком» с использованием собственных газовых турбин вместо подключения к магистральным электросетям. Примерно то же сделал Илон Маск (Elon Musk) с кластером Colossus в Мемфисе, изначально оснастив его газовыми генераторами, что вызвалов протесты активистов). Впрочем, в случае с Meta✴ речь идёт о постоянных установках на площадке в Огайо — она должна работать независимо от энергосетей. По имеющимся данным, сейчас ЦОД с собственной генерацией располагают приблизительно 2 ГВт энергетических мощностей, ещё 1 ГВт находится на подходе и станет доступен в текущем году. По информации Cleanview, если текущие проекты будут реализованы по графику, к концу 2027 года мощность подобных объектов может увеличиться до 13 ГВт. Сочетание временных (на первый взгляд) сооружений и генераторов на основе авиационных турбин выглядит довольно необычно и, как заявил один из журналистов, «напоминает сцену из фильма „Безумный Макс“». Стоит отметить, что Meta✴ буквально вынуждена ударными темпами строить собственную ИИ-инфраструктуру. В конце мая появилась новость, что Meta✴, возможно, сама начнёт предоставлять сторонним клиентам облачные сервисы, особенно, если у неё появятся избыточные мощности.

09.06.2026 [10:00], Сергей Карасёв

InnoGrit представила контроллер для SSD с интерфейсом PCIe 6.0 вместимостью до 256 ТбайтКитайская компания InnoGrit представила свой первый контроллер для SSD с интерфейсом PCIe 6.0 x4. Изделие IG5686 Crestone предназначено для построения накопителей для дата-центров и облачных платформ, ориентированных ресурсоёмкие ИИ-нагрузки. Контроллер поддерживает стандарт NVMe 2.3. Допускается использование чипов флеш-памяти SLC/MLC/TLC/QLC NAND и SCM. При этом сами SSD могут выполняться в различных форм-факторах, включая E1.S и E3.S. Решение IG5686 Crestone обеспечивает скорость чтения информации до 28 Гбайт/с и скорость записи до 22 Гбайт/с. Величина IOPS при произвольном чтении данных теоретически достигает 7 млн, при произвольной записи — 5 млн. Максимально допустимая вместимость накопителей — 256 Тбайт. Помимо этого, компания InnoGrit разработала контроллер Cascade IG5676 для устройств CXL 3.1 Type-3. Это решение поддерживает высокоскоростную память с низкой задержкой XL-Flash. Возможно создание накопителей ёмкостью до 2 Тбайт. В дальнейшем InnoGrit планирует повышать производительность своих контроллеров. Так, к 2027 году компания рассчитывает довести показатель IOPS в передовых устройствах до 25–50 млн путём оптимизации и более глубокой интеграции стандартов PCIe 6.0 и CXL. В 2028 году величина IOPS, как предполагается, приблизится к 100 млн. Это позволит вывести на новый уровень быстродействие платформ хранения данных для ИИ. Нужно отметить, что контроллеры для SSD с интерфейсом PCIe 6.0 проектируют и другие участники рынка. В частности, такое решение недавно продемонстрировала компания Phison. Кроме того, соответствующими разработками занимается Silicon Motion.

09.06.2026 [00:29], Владимир Мироненко

Google заказала у Intel упаковку 3 млн TPU — у TSMC спрос превысил возможности производстваХолдинг Alphabet, материнская структура Google, заключил сделку с Intel, в рамках которой та изготовит для него в 2028 году более 3 млн кастомных TPU. Сообщивший об этом ресурс The Information добавил, что Google в течение нескольких месяцев тестировала технологии Intel, прежде чем принять решение о сделке. The Information отметил, что Intel получает заказы от таких компаний, как Google, в то время как тайваньский производитель микросхем TSMC испытывает трудности с удовлетворением спроса на выпускаемую им продукцию из-за нехватки производственных мощностей. Как пишет Bloomberg, акции Intel недавно достигли рекордного уровня после того, как её прогноз продаж превзошёл ожидания Уолл-стрит, показав, что компания наконец-то извлекает выгоду из бума инвестиций в ИИ. Оптимистичный прогноз свидетельствует о том, что генеральный директор Лип-Бу Тан (Lip-Bu Tan) добился успеха в стремлении вывести компанию из стагнации. После крупных инвестиций в Intel в прошлом году, которые помогли укрепить баланс компании, он теперь выполняет обещание улучшить её операционную деятельность. По данным The Information, NVIDIA также тестирует возможность использования технологии Intel для создания будущего процессора, объединяющего четыре графических чипа в одном блоке. Однако NVIDIA никак не прокомментировала эту публикацию. Ранее стало известно о планах Илона Маска (Elon Musk) использовать техпроцесс Intel следующего поколения 14A для производства чипов на будущем заводе Terafab в Остине (Austin). Вместе с тем остаётся неясным, насколько Google и другие компании будут полагаться на бизнес Intel по производству полупроводников, по сравнению с услугой упаковки, пишет Bloomberg. Последняя услуга включает в себя помещение чипов в корпус и подготовку их к подключению к другим схемам. Intel сообщила инвесторам, что накопила многомиллиардный портфель заказов на работы по упаковке микросхем. Этот этап в производстве полупроводников традиционно имеет меньшее значение и обходится дешевле, чем процесс создания электронных компонентов из кремниевых пластин. Но его важность возросла, поскольку объединение микросхем в одном корпусе всё чаще рассматривается как способ достижения лучшей производительности, особенно в случае компонентов для ЦОД. Как отметил Bloomberg, заказ на 3 млн чипов не изменит финансовое состояние убыточного производственного бизнеса Intel в одночасье. Это эквивалентно объёму производства крупного завода за месяц или даже меньше. Тем не менее обращения крупных компаний, свидетельствующие о готовности доверять Intel реализацию важных задач, помогут укрепить позиции её технологий и повысить шансы на привлечение других клиентов.

08.06.2026 [16:06], Руслан Авдеев

Эстонская Skeleton Technologies представила суперконденсаторные ИБП GrapheneUPS для ИИ ЦОДЭстонский поставщик энергетической инфраструктуры и силовых решений различного назначения — Skeleton Technologies — представил новые ИБП на основе графеновых суперконденсаторов, разработанные специально для ИИ ЦОД, сообщает Datacenter Dynamics. Система GrapheneUPS предназначена для долговременной защиты работы дата-центров. При этом она соответствует требованиям регуляторов к подключению дата-центров к электросети. По данным компании, в отличие от традиционных ИБП, система GrapheneUPS с двойным преобразованием энергии непрерывно преобразует поступающий переменный ток (380–480 В, 50/60 Гц) в постоянный и обратно с использованием SiC/GaN-компонетов, изолируя критически важное ИИ-оборудование от помех в энергосети. Кроме того, ИБП компании способны активно стабилизировать напряжение, например при его падении, перебоях с электроснабжением и других нештатных ситуациях, обеспечивая соответствие требованиям к состоянию сети без необходимости использования дополнительных сетевых стабилизаторов. Skeleton утверждает, что использование новых ИБП благоприятно скажется на эффективности дата-центров. Компания заявляет, что система позволяет на 40 % увеличить вычислительные мощности и значительно сократить требования к энергосети. Стабилизируя кратковременные сбои и компенсируя резкие изменения нагрузки, система способна помочь снизить риск перебоев в работе, защитить чувствительное к перепадам энергии оборудование и оптимизировать энергоснабжение всё более динамичных ИИ-нагрузок. Кроме того, новинка отличается высокой энергетической плотностью — до 242 кВт/м2.

Источник изображения: Skeleton Technologies Skeleton утверждает, что система отличается гибкостью внедрения, может использоваться в «белом» и «сером» пространствах ЦОД, а также за пределами объекта в контейнерном исполнении. Кроме того, она дополняет аккумуляторные энергохранилища ЦОД, обеспечивая дополнительный уровень энергобезопасности в случае сбоев электроснабжения. Система компании способна сглаживать колебания нагрузки в электросетях и ИИ ЦОД менее чем за миллисекунду. Компания заявляет, что её решения позволяют дата-центрам выравнивать спрос на электроэнергию и снижать её потребление. Компания Skeleton была основана в 2009 году в Тарту (Tartu, Эстония). Её первым клиентом стало Европейское космическое агентство (ESA), а впоследствии решения компании стали применять в немецкой автомобильной промышленности, в том числе в автомобилях BMW серий M и i7. Своё первое производство в США компания открыла в Хьюстоне (Houston, штат Техас) ранее в этом году, а в Европе два её завода появились ещё в ноябре 2025 года — объект стоимостью $270 млн в Германии и объект стоимостью $60 млн в Финляндии. В прошлом месяце появились данные о том, что компания привлекла €33 млн ($39 млн) в преддверии планируемого IPO в США в 2027 году. |

|