Материалы по тегу: hardware

|

02.06.2026 [11:12], Сергей Карасёв

HPE представила сервер ProLiant Compute DL394 Gen12 на платформе NVIDIA VeraКомпания HPE анонсировала сервер ProLiant Compute DL394 Gen12 для ресурсоёмких нагрузок в области ИИ и обработки данных. Система выполнена на аппаратной платформе NVIDIA Vera. Изделия Vera насчитывают 88 ядер Olympus, совместимых с набором инструкций Arm v9.2. Возможна одновременная обработка до 176 потоков инструкций. Поддерживается до 1,5 Тбайт LPDDR5X с пропускной способностью до 1,2 Тбайт/с. Характеристики ProLiant Compute DL394 Gen12 пока полностью не раскрываются. Известно, что новинка выполнена в форм-факторе 2U. HPE отмечает, что изделия Vera благодаря монолитной конструкции позволяют решить проблему неоднородного доступа к памяти, которая может наблюдаться при использовании традиционных чиплетных архитектур с большим количеством ядер. Эта особенность приводит к переменным задержкам и непредсказуемой производительности. В случае Vera каждому вычислительному ядру предоставляется полоса пропускания до 14 Гбайт/с, что даёт возможность обрабатывать данные на стабильно высокой скорости. В сервере реализованы средства управления HPE Integrated Lights-Out (HPE iLO 7). Говорится о защите от будущих кибератак, основанных на квантовых вычислениях, в соответствии с требованиями Национального института стандартов и технологий США (NIST). Средства HPE Compute Ops Management (COM) обеспечивают унифицированное управление серверной инфраструктурой из единой консоли. ProLiant Compute DL394 Gen12 может применяться для агентного ИИ, обработки больших объёмов транзакций и других задач. В продажу сервер поступит осенью текущего года.

02.06.2026 [01:04], Владимир Мироненко

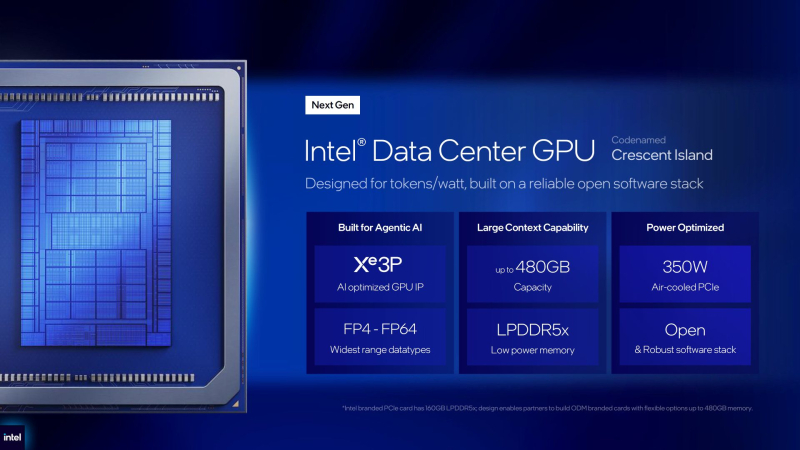

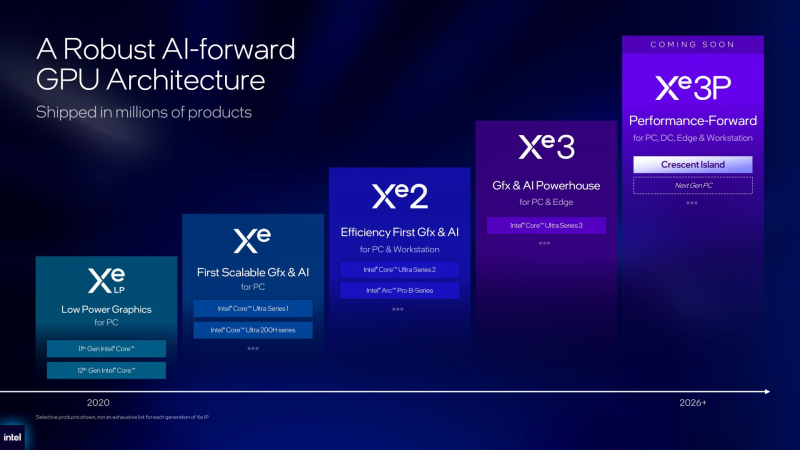

ИИ-ускоритель Intel Crescent Island получит до 480 Гбайт LPDDR5XIntel сообщила новые подробности о своём будущем ИИ-ускорителе для ЦОД с кодовым именем Crescent Island, который был анонсирован в прошлом году. Новый GPU основан на архитектуре Xe3P, представляющей усовершенствованную версию Xe3, которая используется в процессорах Core Ultra 300 семейства Panther Lake. Ожидается, что Xe3P также будет использоваться в GPU Intel серии Arc-C для клиентских устройств. Компания отметила, что чип разработан специально для рабочих нагрузок агентного ИИ. В то время как традиционные ИИ-ускорители от NVIDIA и AMD полагаются на дорогую память HBM, в новом чипе Intel используется LPDDR5X, и он предназначен для работы в серверах с воздушным охлаждением, а не с жидкостным. Crescent Island будет поддерживать до 480 Гбайт памяти LPDDR5X, хотя базовая эталонная конфигурация рассчитана на 160 Гбайт. Intel заявила, что Crescent Island оптимизирован по производительности на Вт — до TDP 350 Вт в версии с воздушным охлаждением и интерфейсом PCIe. Сообщается, что GPU будет поддерживать широкий спектр форматов данных от FP4 до FP64, а также полностью открытый программный стек oneAPI, что идеально подходит для поставщиков услуг «токены как услуга» и сценариев использования для инференса. Intel уже оценивает свой открытый унифицированный программный стек для гетерогенных систем ИИ с помощью существующей линейки Arc Pro B-серии, поэтому будущие версии чипов получат доступ к этим оптимизациям на ранних этапах. Intel планирует начать тестирование GPU Crescent Island для клиентов во II половине 2026 года с общей доступностью в 2027 году.

01.06.2026 [21:33], Владимир Мироненко

Intel выпустит 192-ядерные процессоры Xeon Diamond Rapids на техпроцессе 18A-P в 2027 годуВместе с объявлением о выходе серии чипов Xeon 6+ (Clearwater Forest) компания Intel предоставила некоторые подробности о Xeon Diamond Rapids, выход которых намечен на 2027 год. Новый процессор будет выпускаться по техпроцессу 18A-P, усовершенствованной версии 2-нм техпроцесса. Компания сообщила, что Xeon Diamond Rapids получит на 50 % больше ядер, чем Granite Rapids-AP (6900P), т.е. 192 P-ядра. Это значительный прирост, но всё же меньше, чем у AMD, которая, как ожидается, уже в этом году предложит до 256 ядер Zen 6C в EPYC Venice. При этом Diamond Rapids не будет поддерживать Hyper-Threading (SMT). Эта технология вновь появится в Xeon Coral Rapids в 2028 году. Как сообщает The Register, на рендерах, представленных в пресс-релизе Intel, видно, что два I/O-чиплета обслуживают четыре вертикально расположенных вычислительных блока, собранных с использованием упаковки Foveros. Аналогичная компоновка используется в Clearwater Forest. Перенос L3-кеша на базовый тайл освобождает значительную площадь вычислительного чиплета. Здесь таковых четыре, по 48 ядер в каждом. The Register отметил, что в этом отношении Diamond Rapids похож на Fujitsu Monaka, который использует почти идентичную компоновку и 3.5D-упаковку Broadcom, хотя и с одним чиплетом I/O. А вот контроллеры памяти могут оказаться и на базовых тайлах, и в составе I/O-чиплетов. В отличие от Granite Rapids-SP, не стоит ожидать широкого распространения Diamond Rapids в корпоративных системах виртуализации или СХД. Как сообщила Intel, Diamond Rapids «оптимизирован для высоконагруженных IaaS-систем с высокой производительностью на поток», что ставит его в один ряд с процессорами 6900P, больше ориентированными на HPC-нагрузки. Intel уже говорила, что новинки получат 16-канальный контроллер памяти с поддержкой MRDIMM, что важно для таких задач. Чипы также будут поддерживать PCIe 6.0, предлагая высокую скорость и масштабируемость для сценариев с интенсивным использованием I/O. Далее Intel представит Coral Rapids, вернув P-ядрам поддержку SMT. Ожидается, что линейка будет запущена в середине 2028 года с 8-канальными платформами, но, судя по недавним заявлениям генерального директора Лип-Бу Тана (Lip-Bu Tan), её выпуск, вероятно, будет ускорен из-за возросшего спроса на процессоры для рабочих нагрузок агентного ИИ.

01.06.2026 [16:41], Руслан Авдеев

SoftBank намерена вложить €75 млрд в 5 ГВт ИИ ЦОД и совместное производство с Schneider Electric во ФранцииЯпонская SoftBank Group обнародовала планы строительства и эксплуатации во Франции ИИ ЦОД совокупной мощностью 5 ГВт. Это одна из крупнейших из объявленных инвестиций в европейскую ИИ-инфраструктуру на сегодня. Проект предполагает инвестиции в объёме €75 млрд ($81 млрд), сообщает Converge Digest. На первом этапе планируется потратить €45 млрд ($48,6 млрд) на постройку в О-де-Франс (Hauts-de-France) 3,1 ГВт мощностей ЦОД. Новый проект подчёркивает стремление Франции стать стратегически важным европейским хабом в сфере ИИ, цифровой инфраструктуры и промышленного производства. Первоначально будут развёрнуты площадки в Дюнкерке (Dunkirk, район Лун-Плаж), Боскеле (Bosquel) и Бушене (Bouchain). Полное завершение проекта запланировано на 2031 год. По данным SoftBank, проект должен будет способствовать локализации цепочек поставок для ИИ ЦОД в Европе, а то же время ускорятся циклы развёртывания ИИ-объектов следующего поколения. По словам SoftBank, инфраструктура будет соответствовать потребностям ИИ-разработчиков, облачных гиперскейлеров, исследовательских институтов, организаций государственного сектора — всем кому необходимы масштабные вычисления. В рамках проекта будут использоваться преимущества Франции — доступ к низкоуглеродному электричеству АЭС, землям промышленного назначения, а также близость к ключевым европейским экономическим маршрутам, связывающим Париж, Брюссель, Амстердам, Лондон и Франкфурт.

Источник изображения: Pascal Bernardon/unsplash.com В основе стратегии SoftBank лежит промышленное взаимодействие со Schneider Electric для создания крупного производственного кластера в порту Дюнкерка. Там разместится предприятие SoftBank для выпуска готовых модулей для ЦОД, а Schneider Electric займётся интеграцией сборных силовых модулей для ИИ-инфраструктуры. Отдельно SoftBank совместно с французской Sesterce, специализирующейся на ИИ-инфраструктуре, подтвердили планы создания кампуса ИИ ЦОД мощностью 1 ГВт в Боскеле в рамках «расширенного проекта» на 5 ГВт. Для Европы проект может стать очередным шагом по обеспечению цифрового суверенитета, причём Франция нередко позиционирует себя как оптимальное место для строительства ИИ-инфраструктуры благодаря наличию развитой атомной энергетики, зон промышленной реконструкции и поддержке стратегически важных вычислительных мощностей со стороны государства. Благодаря взаимодействию со Schneider Electric, SoftBank расширяет инвестиции за пределы вычислительных мощностей, включаясь и в физическую цепочку поставок, лежащую в основе ИИ-инфраструктуры. Пока неизвестно, хватит ли у SoftBank средств на вложение €75 млрд в Европе наряду с гигантскими инвестициями в США, в т.ч. в OpenAI. Эксперты полагают, что собственных средств у компании недостаточно. Её чистая прибыль значительно выросла в последние годы, но сама компания обычно располагает всего около $30 млрд ликвидных денежных средств. Почти наверняка её придётся создать новый фонд для их сбора или привлекать заёмные деньги и партнёров. Впрочем, компания и не думает останавливаться в своей экспансии на рынке ИИ. На днях сообщалось о вероятном выходе дочерней структуры — SB Energy на IPO в США, а сама SoftBank готовит японское GPU-облако AI Data Center GPU Cloud. Кроме того, недавно сообщалось, что в США при участии SoftBank намерены построить 10-ГВт кампус ЦОД.

01.06.2026 [16:04], Руслан Авдеев

США принимают меры, чтобы заблокировать поставки ИИ-чипов NVIDIA китайским компаниямМинистерство торговли США в воскресенье приняло меры, чтобы закрыть потенциальную лазейку, потенциально позволяющую экспортировать компаниям передовые чипы NVIDIA подразделениям китайских техногигантов, находящимся за пределами КНР, сообщает Reuters. Предполагается, что лучшие американские чипы поступали филиалам китайских компаний, расположенным в странах вроде Малайзии, Индонезии и даже Японии. Новое руководство опубликовали на сайте Министерства торговли, после того как, по данным источников, в Вашингтоне появился документ, посвящённый данной лазейке. В документе, пока не имеющем авторства, сообщается, что «шлюзы незаметно открылись». Другими словами, постепенно снизилась эффективность ограничений. Пока нет данных, как много чипов экспортировали в год, когда, как пишет Reuters, «администрация Трампа оставила дверь открытой» Один из осведомлённых отраслевых источников сообщил, что речь идёт о сотнях тысяч ускорителей. В руководстве Бюро промышленности и безопасности (BIS) сообщило, что обеспечит обязательное лицензирование для структур со штаб-квартирами в Китае, даже если их подразделения расположены за его пределами. Фактически, как сообщает бюро, руководство разъясняет требования к лицензированию, действующие с 2023 года. Представитель NVIDIA заявил, что новое руководство ничего не изменит для компании, добавив, что не может поставлять чипы, поскольку Министерство торговли недвусмысленно установило в своём документе лицензионные ограничения для компании. Фактически Министерство торговли само создало лазейку, когда объявило в мае 2025 года, что не будет соблюдать правило AI Diffusion Rule, принятое в последние дни прошлой администрации США — оно фактически делило мир на страны, которым можно продавать ИИ-ускорители без ограничений и те, которым можно, но с оговорками или вовсе нельзя. По словам экспертов, оставленная лазейка позволяла зарубежным подразделениям китайских компаний покупать чипы NVIDIA Blackwell безо всяких лицензий. В результате китайские компании покупают эти чипы и, похоже, в больших масштабах. Эксперты уверены, что новое руководство закроет лазейку, но останется другая. В частности, к TSMC и другим контрактным производителям отсутствуют требования проверять, что заказываемые у них передовые ИИ-чипы не предназначены для подставных структур, работающих на китайских покупателей. Сообщается, что в новом руководстве этот недочёт по-прежнему не устранен. Кроме того, если чипы уже установлены, новый документ не требует от операторов ЦОД прекратить использование таких чипов или остановить обслуживание передового оборудования вроде серверов. Ранее сообщалось, что Китай довольно активно прибегает к контрабанде ИИ-ускорителей, а также пользуется услугами компаний за рубежом, чтобы обойти американские санкции. Кроме того, страна наращивает производство собственных ускорителей и достигла соглашения с США о поставках относительно устаревших NVIDIA H200.

01.06.2026 [15:26], Владимир Мироненко

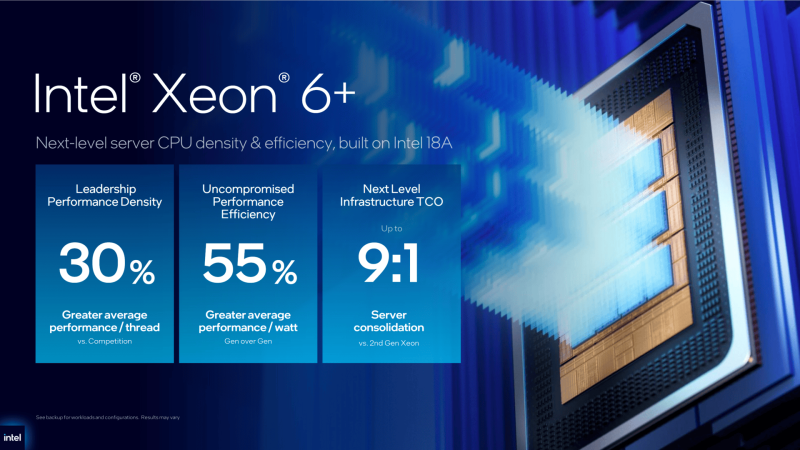

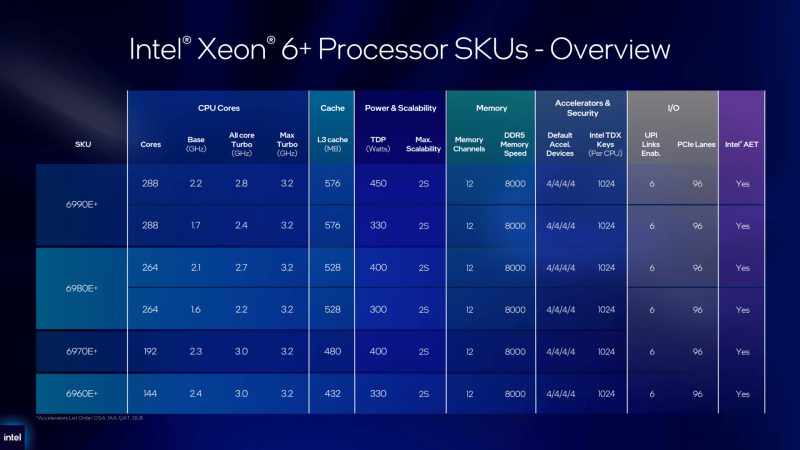

Intel объявила о выходе Xeon 6+ Clearwater Forest — первых 2-нм серверных процессоровIntel объявила о выходе серии чипов Xeon 6+ (Clearwater Forest), первых процессоров для ЦОД, созданных на основе Intel 18A, самого передового технологического процесса компании. Как отметил ресурс The Register, процессоры Intel Xeon Clearwater Forest изначально были разработаны для телекоммуникационных приложений, SaaS и высокопроизводительных веб-приложений. Но с расширением использования агентных решений, как OpenClaw, роль процессоров в ИИ-инфраструктуре значительно возросла. В такой же мере вырос на них спрос. При выполнении задачи эти чипы могут отправлять множество запросов для сбора информации из интернета, запуска и отладки кода, запросов к базам данных и взаимодействия с API. Все эти запросы выполняются на ядрах CPU, количество которых у Intel Xeon 6+ составляет до 288. Это на 200 ядер больше на сокет, чем у новых процессоров NVIDIA Vera, и более чем в два раза больше, чем у недавно анонсированного Arm AGI — оба ориентированы непосредственно на агентный ИИ. В максимальной конфигурации 6900E+ включает 12 чиплетов E-Core (Intel 18A с RibbonFET и PowerVia), 3 базовых тайла (Intel 3) и 2 чиплета I/O (Intel 7). 12 EMIB-тайлов объединяют все чиплеты в единую 2.5D-упаковку с использованием технологии Foveros Direct 3D, обеспечивая сверхнизкую задержку передачи данных по всему чипу. Совместимость с существующими платформами Xeon 6900P/6900E (Granite Rapids-AP/Sierra Forest-AP) означает, что Clearwater не потребует от OEM-производителей разработки совершенно новой платформы. Чип может быть установлен в существующие плат, что упрощает его внедрение. Применение архитектуры E-ядер свидетельствует о сосредоточенности Clearwater Forest на повышении энергоэффективности. Новая функция Intel AET («Телеметрия энергопотребления приложений») позволяет операторам ЦОД отслеживать энергопотребление каждого ядра и каждого приложения на аппаратном уровне. Это упрощает системным администраторам выявление проблемных рабочих нагрузок и повышение энергоэффективности путём оптимизации ПО или просто модификации окружения. E-ядра Darkmont нового чипа работают на более низких частотах, чем P-ядра чипа Intel Xeon 6, и в отличие от них не имеют поддержки AVX-512, AMX и Hyper-Threading. Но по сравнению с первым поколением E-ядер Intel Xeon, представленных на два года назад, ядра Clearwater обеспечивают на 17 % больше инструкций за такт в дополнение к более высокой частоте в режиме Boost. Также рабочим нагрузкам агентного ИИ может пойти на пользу обилие выделенных ускорителей. В чиплеты I/O встроены 16 ускорителей (по 8 на чиплет), предназначенных для криптографических операций, перемещения данных, сжатия/распаковки, балансировки и т.д. Доступны четыре варианта Xeon 6+ в шести конфигурациях, причем две топовые модели выпускаются в конфигурациях с ограниченным энергопотреблением, более низкими базовыми и турбо-частотами всех ядер, но с идентичными характеристиками. Сравнивая новинки с процессорами Sierra Forest предыдущего поколения, Intel сообщила, что 6900E+ обеспечивают прирост производительности на 126 %. При этом производительность на Вт увеличивается на 55 %, что, по оценкам Hot Hardware, означает, что они также потребляют примерно на 46 % больше энергии. Это вполне приемлемо с учётом того, ядер стало в два раза больше, а L3-кеш вырос в пять раз. Также Intel заявила, что процессоры Xeon 6990E+ обеспечивают в 1,3 раза более высокую среднюю производительность на поток и в 1,3 раза более высокую среднюю производительность/поток/Вт по сравнению с AMD EPYC 9965 (Turin), сообщил Data Center Dynamics. Ранее Intel сообщила, что тесты Clearwater Forest в реальных условиях эксплуатации показали, что Ericsson благодаря их использованию получит 30-% увеличение производительности при том же количестве ядер, 60-% повышение производительности на Вт и 38-% снижение энергопотребления в стойке во время работы. Новые процессоры будут поддерживаться крупными производителями серверов, включая Amax, ASRock, ASUS, Dell, Foxconn, Giga Computing, Gigabyte, HPE, Inventec, Lenovo, Mitac, MSI, Pegatron, QCT и Supermicro. «Мы наблюдаем значительный спрос на все большее количество процессоров», — отметил в ходе пресс-конференции Кеворк Кечичян (Kevork Kechichian), исполнительный вице-президент и генеральный менеджер Intel Data Center Group.

01.06.2026 [12:35], Сергей Карасёв

Двухтонный ИИ: Dell начала поставки первых стоек NVIDIA Vera Rubin NVL72Компания Dell Technologies поставила свою первую стойку NVIDIA Vera Rubin NVL72. Получателем системы стала компания CoreWeave — неоооблачный провайдер, который активно расширяет инфраструктуру для ресурсоёмких нагрузок ИИ. Стойка содержит 72 ускорителя Rubin и 36 процессоров Vera на архитектуре Arm. Суммарный объём памяти HBM4 составляет 20,7 Тбайт, системной памяти LPDDR5X — 54 Тбайт. Реализовано жидкостное охлаждение горячей водой (+45 °C). Сама стойка в собранном виде весит около 1,8 т и потребляет до 230 кВт. Заявленная ИИ-производительность достигает 3,6 Эфлопс в режиме NVFP4 при инференсе, что примерно в пять раз превышает показатель Blackwell. На задачах обучения быстродействие NVFP4 составляет 2,5 Эфлопс. Отмечается, что Dell успешно провела все необходимые диагностические тесты Vera Rubin NVL72, по результатам которых система готова к дальнейшему развёртыванию на площадке заказчика. CoreWeave намерена использовать новый кластер для расширения своей инфраструктуры НРС. Масштабный вывод платформы на рынок намечен на II половину текущего года. Между тем сама NVIDIA объявила о начале массового производства решений поколения Vera Rubin. В числе партнёров, объявивших о поддержке этих систем, названы Dell Technologies, HPE, Lenovo и Supermicro, а также AIC, Aivres, ASRock Rack, ASUS, Cloudian, Compal, DDN, Everpure, Foxconn, GIGABYTE, Hitachi Vantara, Hyve Solutions, IBM, Inventec, MinIO, MiTAC Computing, MSI, NetApp, Nutanix, Pegatron, Quanta Cloud Technology (QCT), VAST Data, WEKA, Wistron и Wiwynn. Вместе с тем CoreWeave, а также Lambda и Oracle Cloud Infrastructure одними из первых начнут развёртывание стоек Vera Rubin в своих ИИ-инфраструктурах.

01.06.2026 [12:20], Сергей Карасёв

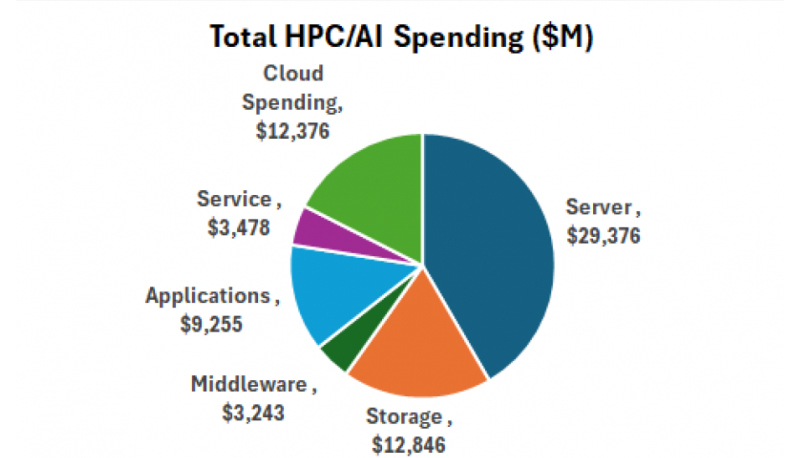

Hyperion Research: объём мирового рынка НРС в 2025 году превысил $70 млрд, но темп роста замедлилсяПо оценкам компании Hyperion Research, глобальные расходы в области ИИ и НРС в 2025 году превысили $70 млрд, что примерно на $10 млрд больше по сравнению с предыдущим годом. Однако темпы роста замедлились до 16,9 % против 23,5 % в 2024-м, когда этот показатель оказался самым высоким за последние три десятилетия. Аналитики учитывают затраты на серверы, хранилища данных, программное обеспечение, услуги и облачные ресурсы, связанные с ИИ и НРС. В частности, в 2025 году на локальные серверы были потрачены $29,4 млрд, что на 16,7 % больше, чем годом ранее, когда продажи такого оборудования оценивались в $25,2 млрд при росте 23,4 % в годовом исчислении. В сегменте HPC-решений для локального развёртывания на долю HPE пришлось около 22,1 % продаж — $6,5 млрд против $7,2 млрд в 2024 году. У Dell отгрузки в денежном выражении за год поднялись с $3,9 млрд до $5,3 млрд, в результате чего доля составила 18,2 %. Lenovo и Inspur получили $1,8 млрд и $1,2 млрд соответственно. Далее в рейтинге ведущих игроков указанного сегмента находятся Sugon, Penguin, Atos, IBM, Fujitsu и NEC.

Источник изображения: Hyperion Research Системы хранения данных в 2025 году принесли поставщикам около $12,8 млрд — плюс 27,5 % по отношению к предыдущему году. Расходы в облачном сегменте оцениваются в $12,4 млрд, что на 29,7 % больше, чем в 2024-м. Приложения обеспечили $9,3 млрд, связующее ПО — $3,2 млрд, услуги — $3,5 млрд. Отмечается, что в 2021 году во всём мире были отгружены примерно 2,2 млн НРС-узлов. В 2024-м и 2025 годах показатель снизился до 500 тыс. узлов. При этом выручка в пересчёте на один узел резко возросла: в среднем с $10 тыс. до более чем $50 тыс. По прогнозам, общие затраты на локальные серверы составят около $32 млрд в 2026 году и достигнут примерно $54 млрд к 2030-му.

01.06.2026 [12:15], Сергей Карасёв

ADATA представила решение TRUSTA AI Scaler Extended Memory Solution для расширения памяти в ИИ-системахБренд TRUSTA, принадлежащий компании ADATA Technology, анонсировал программно-аппаратную платформу AI Scaler Extended Memory Solution. Она нацелена на решение проблемы нехватки памяти в ускорителях на базе GPU в таких сценариях, как ИИ-инференс и точная настройка больших языковых моделей (LLM). По оценкам аналитиков, мировой рынок ИИ-инфраструктур будет расти в среднем на 26 % в год до 2034-го. Причём ИИ-нагрузки всё чаще переносятся из традиционных облаков в локальный контур и на периферию. При таких подходах компаниям приходится решать вопросы, связанные с конфиденциальностью данных, соответствием нормативным требованиям и оптимизацией затрат. Новая архитектура TRUSTA призвана помочь организациям уменьшить расходы при внедрении ИИ в собственной среде. В отличие от традиционных ИИ-систем, которые полностью полагаются на память GPU-ускорителей, платформа TRUSTA AI Scaler Extended Memory Solution, как и Phison aiDAPTIV+, предполагает распределение нагрузки между памятью GPU, DRAM и SSD-накопителями, что позволяет более эффективно использовать доступные ресурсы. Утверждается, что задачи инференса, которые обычно требуют наличия нескольких GPU-карт, могут быть оптимизированы для работы на одном ускорителе в сочетании с использованием других типов памяти. При этом нагрузки динамически перераспределяются между высокоскоростной памятью GPU, оперативной памятью и твердотельными накопителями. В результате, как отмечается, затраты на развёртывание ИИ могут быть снижены более чем на 50 % по сравнению с обычными инфраструктурами.

Источник изображения: ADATA Для новой программно-аппаратной платформы создан набор инструментов TRUSTA AI Scaler Toolkit. Это бесплатный продукт с открытым исходным кодом, не привязанный к конкретным аппаратным конфигурациям. С его помощью компании, исследовательские организации и независимые разработчики смогут настраивать ресурсы в соответствии со своими потребностями и выполняемыми задачами. Заявлена совместимость с такими LLM, как Llama, Qwen, Mistral, Mixtral, GPT-OSS, DeepSeek, Phi и Gemma, а дальнейшем список будет расширяться. Кроме того, поддерживаются различные приложения для ИИ-агентов, включая OpenClaw, NemoClaw и Hermes Agentic. Набор инструментов TRUSTA AI Scaler Toolkit уже доступен для загрузки. Кроме того, TRUSTA представила SSD корпоративного класса TD7P51 ECO с интерфейсом PCIe 5.0. Он имеет вместимость до 15,36 Тбайт. Заказчикам будут предлагаться варианты в трёх форм-факторах — U.2, E1.S и E3.S.

01.06.2026 [10:00], Руслан Авдеев

Ampere Computing: экстремальная жара в мире потребует больше энергии, повышения эффективности вычислений и сокращения количества ЦОД

ampere

arm

hardware

дефицит

ии

инференс

метео

охлаждение

прогноз

цод

экология

энергетика

энергоэффективность

Наступившее лето обещает быть чрезвычайно жарким, похожим на прошлогоднее, когда среднемировая температура достигла исторического максимума. Жара и засухи вынуждают индустрию и власти принимать трудные решения на фоне растущего расширения ЦОД, сообщил директор по продуктам Ampere Computing Джефф Виттич (Jeff Wittich). Согласно прогнозу AccuWeather на 2026 год, счета за электричество могут взлететь текущим летом из-за вероятной повсеместной жары по всей территории США. По оценкам отвечающей за надёжность электроснабжения в стране North American Electric Reliability Corporation, летний пиковый спрос на энергию вырастет на 224 ГВт за следующие 10 лет. Это более чем на 69 % выше прогноза 2024 года и на 24 % — пикового спроса 2025-го. В первую очередь ожидаемый рост спроса обусловлен потреблением электричества новыми ЦОД. В 2023 году в США дата-центры потребляли 4,4 % всей электроэнергии, а к 2028 году будут потреблять 12 %. Из-за роста спроса на электричество многим странам пришлось ужесточить правила для снижения нагрузки на энергосистемы и население. Во многом проблема в том, что энергосистемы не справляются с колебаниями энергопотребления в связи с экстремальной погодой. В июле прошлого года сообщалось, что аномальная жара привела к сбоям в лондонских дата-центрах Google и Oracle. Более того, согласно исследованию Rest of World, около 80 % всех дата-центров в мире построены в не особенно подходящих для них климатических условиях. Так, в 2025 году в США было внесено более 200 законопроектов, направленных на регулирование работы ЦОД, и по меньшей мере в 18 штатах предложены специальные тарифы для крупных потребителей электричества, а в Мэне предпринята пока не увенчавшаяся успехом попытка вовсе запретить строительство новых ЦОД. В некоторых законопроектах от желающих строить ЦОД требуют инвестиций в модернизацию инфраструктуры и обеспечение преимуществ для рядовых потребителей энергии.

Источник изображения: Ant Rozetsky/unsplash.com В 2025 году в Амстердаме продлили мораторий на строительство новых ЦОД и расширение в столичном муниципалитете уже действующих. Приоритет отдан жилью, а новые дата-центры появятся не раньше 2030 года. Во Франкфурте на ЦОД приходится до 40 % от всего потребления городской агломерации, что создаёт непосильную нагрузку местной энергосистеме. В некоторых районах введены временные моратории на подключение новых «индустриальных» объектов, строительство новых не ожидают до II квартала 2027 года. В условиях развития ИИ-проектов дефицит ресурсов будет всё ощутимее. Поддержать этот рост без ущерба окружающей среде можно, повысив эффективность вычислений каждого отдельного ЦОД. Это позволит строить меньше дата-центров для удовлетворения спроса на вычисления или уменьшать их сами по себе, чтобы снизить энергопотребление. Кроме того, потребуется модернизация систем охлаждения. Пока же бум ИИ подталкивает отрасль к экстенсивному развитию, тогда как необходимо максимизировать реальную производительность не только на уровне чипов, но и на остальных уровнях тоже. Для этого необходимы более энергоэффективные чипы, чем сейчас. Виттич подчёркивает, что мощные ИИ-ускорители на основе GPU стоит использовать только там, где это действительно необходимо. Если для обучения и масштабного инференса без них не обойтись, то для многих других задач они избыточны. Оптимизируя вычисления для каждой задачи, следует использовать энергоёмкую инфраструктуру только там, где это действительно необходимо.

Источник изображения: Peter Herrmann/unsplash.com Более эффективные системы охлаждения необходимо использовать независимо от снижения энергопотребления. При этом рекомендуется сочетать разные варианты охлаждения. Например, жидкостное всё чаще используется с энергоёмким ИИ-оборудованием. К сожалению для операторов ЦОД, модернизация систем охлаждения требует серьёзного изменения инфраструктуры, а на старых объектах модернизация сложна и дорога или вовсе невозможна. В существующих ЦОД нередко выгоднее использовать маломощные чипы с воздушным охлаждениями, размещая новые компоненты только там, где они действительно нужны. Фактически это означает переосмысление вычислительных архитектур для получения максимальной производительности на ватт за счёт использования современных чипов. Кроме того, придётся перераспределить рабочие нагрузки и проектировать системы, в которых производительность соответствует требованиям к допустимому тепловыделению и энергосбережению. В конечном итоге, чем больше вычислительных возможностей можно «извлечь» из каждого Вт и м2, тем меньше ЦОД нужно будет строить в будущем. Чем меньше ЦОД придётся строить, тем ниже нагрузка на водные и энергетические ресурсы в конкретных локациях. По словам представителя Ampere, для удовлетворения растущих энергетических потребностей потребуется не просто расширять инфраструктуру, но и оптимизировать её, начиная с вычислительных мощностей. И хотя Виттич прямо об этом не говорит, Ampere видит себя как раз-таки поставщиком энергоэффективных чипов, в том числе CPU для инференса. Однако на практике компания задержала выпуск AmpereOne M, была продана SoftBank и рискует лишиться одного из крупнейших заказчиков в лице Oracle, которая весьма заинтересована в NVIDIA Vera. Ей же приходится конкурировать с собственными Arm-процессорами AWS, Google, Microsoft и Alibaba, а также теперь уже и с самой Arm, Fujitsu и Qualcomm. |

|