Материалы по тегу: облако

|

24.04.2026 [18:23], Руслан Авдеев

Microsoft вложит $18 млрд в ЦОД, ИИ и облака в АвстралииMicrosoft объявила о намерении инвестировать в расширение инфраструктуры и работы в сфере ИИ и облачных технологий в Австралии AU$25 млрд ($18 млрд) до конца 2029 года, сообщает Datacenter Dynamics. По словам главы компании Сатьи Наделы (Satya Nadela), выступавшего в Сиднее, это позволит расширить инфраструктуру Azure в стране более чем на 140 %. Новые инвестиции — продолжение политики Microsoft, в конце 2023 года пообещавшей вложить AU$5 млрд ($3,18 млрд). Тогда заявлялось, что это крупнейшая инвестиция компании за всю 40-летнюю историю её присутствия на континенте. С правительством страны подписан меморандум о взаимопонимании, в соответствии с которым Microsoft намерена соответствовать недавно названных официальным «ожиданиям» властей в отношении ЦОД и строителей ИИ-инфраструктуры, предполагающим приоритет национальных интересов Австралии, поддержку «зелёного перехода», ответственное использование воды, создание рабочих мест и др. В рамках «зелёного перехода» Microsoft увеличит мощности возобновляемой энергетики в стране с учётом собственных целей по достижению «углеродного нейтралитета» к 2030 году. Дополнительно компания намерена расширить сотрудничество с госструктурами в области КИИ и обучить к 2028 году 3 млн жителей Австралии навыкам работы с ИИ. Также в июле 2025 года Microsoft подписано пятилетнее соглашение с местным Министерством обороны на сумму AU$495 млн ($324,71 млн). Военные намерены использовать облачные мощности компании. К концу 2025 года Microsoft владела и управляла тремя дата-центрами на континенте и строила ещё три объекта в окрестностях Сиднея и Мельбурна. У компании имеются облачные регионы в Канберре, Новом Южном Уэльсе и провинции Виктория — необходимые мощности арендуются у сторонних провайдеров. Ранее появилась информация, что Google рассматривает возможность инвестировать в Австралию AU$20 млрд ($14,2 млрд), но компанию беспокоят высокие налоги. AWS строит ЦОД для австралийского правительства — в июле 2024 года было объявлено, что он предназначен для обработки совершенно секретной информации. Правительство намерено инвестировать в новые системы в следующие десять лет AU$2 млрд ($1,3 млрд). Летом 2025 года сообщалось, что в ближайшие четыре года AWS потратит AU$20 млрд (US$13 млрд) на инфраструктуру дата-центров в Австралии. Тогда это была крупнейшая публичная инвестиция в технологическую сферу страны за всю её историю.

24.04.2026 [17:11], Сергей Карасёв

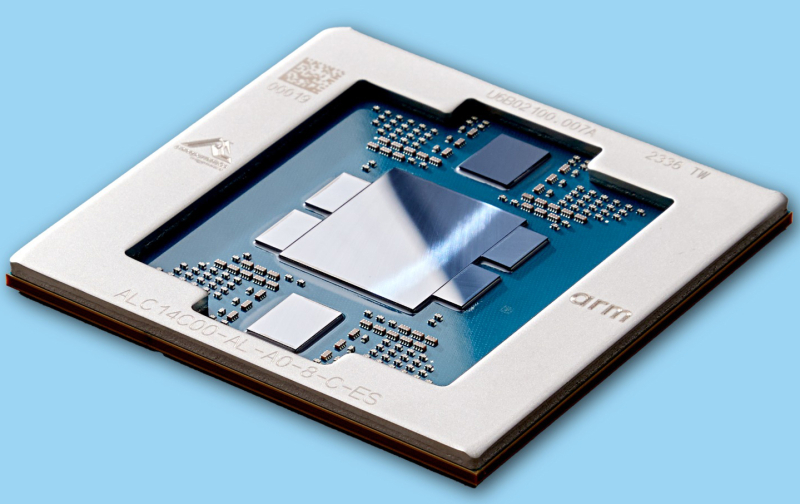

Meta✴ возьмёт на вооружение «десятки миллионов» Arm-ядер AWS Graviton5Компания Meta✴, по сообщению The Register, объявила о расширении сотрудничества с облаком AWS. Речь идёт об использовании Arm-процессоров Graviton5 для поддержания определённых ИИ-нагрузок, в частности, агентных систем. Сама AWS говорит о невероятном спросе на собственные процессоры. Крупным заказчиком является, например, Uber. AWS представила чипы Graviton5 в конце прошлого года. Эти изделия содержат 192 ядра Neoverse V3 (Poseidon), каждое из которых имеет 2 Мбайт кеша L2. Общий объём L3-кеша составляет 192 Мбайт. Присутствуют 12 каналов памяти DDR5-8800. Утверждается, что прирост производительности достигает 25 % по сравнению с процессорами Graviton предыдущего поколения. Meta✴ намерена использовать для своих задач «десятки миллионов» ядер Graviton5. Таким образом, компания станет одним из крупнейших клиентов, применяющих чипы собственной разработки AWS. Руководитель отдела инфраструктуры Meta✴, заявил, что сотрудничество с AWS направлено на диверсификацию вычислительных ресурсов. По его словам, это необходимо в свете реализации масштабных проектов в области ИИ. Ранее Meta✴ объявила о стратегическом партнёрстве с компанией Arm Holdings, которое направлено на «масштабирование эффективности ИИ на каждом уровне вычислений, охватывающем ПО и инфраструктуру ЦОД». В частности, Meta✴ намерена использовать чипы Arm AGI, специально оптимизированные для агентного ИИ. Однако, как уточняет The Register, эти изделия начнут поступать в дата-центры Meta✴ не ранее конца текущего года, поэтому компания пока будет разворачивать соответствующие нагрузки на базе Graviton5 в облаке AWS. Аналитики Counterpoint Research прогнозируют, что к 2029 году на Arm-решения будет приходиться до 90 % рынка серверных ASIC-изделий, ориентированных на ИИ. Между тем сама Meta✴ проектирует фирменные ИИ-ускорители MTIA, которые в зависимости от модификации могут применяться для обучения моделей, инференса и пр.

23.04.2026 [15:19], Руслан Авдеев

Британские антимонопольщики дали ход коллективному «облачному» иску к Microsoft на £2 млрдВ Великобритании продолжается судебное разбирательство по иску от имени 59 тыс. компаний и организаций, использующих ОС Windows Server в публичных облаках, не связанных с Microsoft. Апелляционный трибунал по вопросам конкуренции решил признать иск на сумму £2 млрд обоснованным, сообщает Computer Weekly. Иск связан с практикой Microsoft, обвиняемой в завышении цен для британских предприятий и организаций, использующих Windows Server на альтернативных облачных серверах в обход облака Azure или связанных с Microsoft площадок. CAT отклонил доводы Microsoft, пытавшейся добиться отклонения дела на раннем этапе, поэтому спор, вероятно, перейдёт к полноценному судебному разбирательству. В марте 2025 года Управление по вопросам конкуренции и рынков Великобритании (CMA) объявила о старте расследования в отношении Microsoft, касающегося лицензирования ПО на рынке облачных вычислений. В конце 2025 года представитель истцов заявил, что Microsoft доминирует в некоторых сферах IT-инфраструктуры и злоупотребляет этим для навязывания пользователям бизнес-процессов, которые в ином случае сочли бы неприемлемыми. Компания просто делает это, поскольку может делать, ограничивая выбор людей. Утверждается, что действия Microsoft годами оказывали негативный финансовый эффект как на государственные, так и на частные организации и теперь представители истца ожидают возможности вернуть деньги.

Источник изображения: Benjamin Brunner/unsplash.com Коллективный иск касается двух аспектов лицензирования компанией. Во-первых, её обвиняют в злоупотреблении ценообразованием в рамках лицензионного соглашения Microsoft Service Provider License Agreement (SPLA). Утверждается, что оптовые цены, которые запрашивает Microsoft, выше, чем цены на такие же лицензии для пользователей облака Azure. Кроме того, если клиент использует Windows Server на собственных мощностях и решает перенести лицензию в облако с помощью программы Azure Hybrid Benefit, дополнительная плата не взимается, но если речь идёт о выборе альтернативного облачного провайдера, платить придётся, что предоставляет Azure неконкурентные преимущества. По словам представителей юридической компании Scott+Scott, ведущей дело против Microsoft, подтверждение судом дальнейшего расследования является «ключевым шагом на пути к получению компенсаций для тысяч предприятий и организаций», в качестве потребителей нуждающихся и заслуживающих доступа к правосудию. В своём решении суд отклонил доводы Microsoft и разрешил передать дело на рассмотрение по существу. Также суд подчеркнул, что иск с очевидным запасом преодолевает порог «наличия реальных перспектив на успех». К концу 2025 года с Microsoft в Великобритании стали требовать уже почти $3 млрд за завышение расценок для клиентов облачных конкурентов. Попутно давление оказывают прямые конкуренты компании в лице AWS и Google Cloud. Аналогичную тактику они избрали и в Евросоюзе. Кроме того, Microsoft Azure грозит получение статуса стратегического рыночного игрока, что позволит CMA применять к компании адресные меры.

23.04.2026 [15:04], Андрей Крупин

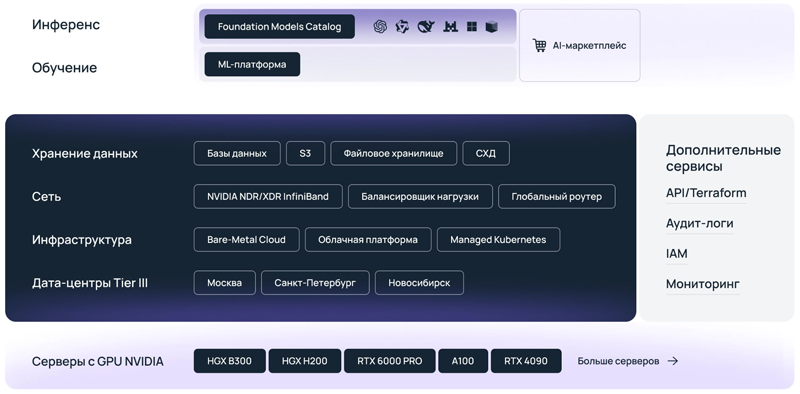

Selectel выпустила обновлённую ИИ-платформу с расширенными возможностями масштабирования моделей и внедрения в бизнес-процессыКомпания Selectel, являющаяся специализированным поставщиком IT-решений на базе собственной сети дата-центров, сообщила об обновлении собственной ИИ-платформы, упрощающей внедрение искусственного интеллекта в корпоративные процессы и позволяющей организациям быстро разворачивать и масштабировать ИИ-модели в облаке без необходимости самостоятельно настраивать IT-инфраструктуру для работы с ними. Ключевым изменением ИИ-платформы Selectel стала обновлённая версия Foundation Models Catalog — сервиса для тестирования, запуска и интеграции больших языковых моделей (LLM) в приложения и бизнес-процессы, дополненного средствами управления ИИ-моделями через REST API и пользовательский интерфейс, а также инструментами мониторинга и автоматизации, помогающими отслеживать работу моделей и улучшать их производительность.

Как устроена ИИ-инфраструктура Selectel (источник изображения: selectel.ru/solutions/ai-infrastructure) Среди прочих обновлений в продукте разработчик отмечает следующие:

Оплата за пользование ИИ-платформой Selectel осуществляется за фактически используемые вычислительные ресурсы. В ближайшее время заказчикам станет доступна новая модель тарификации по количеству токенов.

22.04.2026 [10:30], Сергей Карасёв

РТК-ЦОД внедрил обновлённые решения Basis Dynamix и Basis Virtual Security в «Облаке КИИ»ИТ-сервис-провайдер полного цикла РТК-ЦОД сообщил о масштабном обновлении ПО «Базиса» в своих дата-центрах. В частности, установлены сертифицированные апдейты для платформы управления динамической инфраструктурой Basis Dynamix и средства защиты виртуальных сред Basis Virtual Security. Названные продукты являются основой «Облака КИИ». Это, как утверждается, первое в России мультитенантное защищённое облако, построенное на отечественных программных и аппаратных решениях. Безопасность «Облака КИИ» подтверждена аттестатом соответствия требованиям приказа ФСТЭК №239, что позволяет размещать в нём объекты критической информационной инфраструктуры до 2 категории значимости включительно и обеспечивать защищённое подключение пользователей. «Облако КИИ» аттестовано в соответствии с требованиями по обработке персональных данных 1 уровня защищённости, а также требованиями по защите данных государственных информационных систем 1 класса. Благодаря обновлению софта «Базиса» пользователям «Облака КИИ» стали доступны дополнительные возможности. Среди них упомянуты гибкое управление размером хранилища, перемещение виртуальных машин между узлами средствами платформы для балансировки нагрузки, новые функции межсетевого экрана, в том числе управление его политиками, и пр. Облако подходит как субъектам КИИ, так и крупным коммерческим компаниям, которые уделяют особое внимание защите своих информационных систем. «Мы были первыми, кто в конце 2024 года предложил государственным организациям и крупному бизнесу защищённую облачную инфраструктуру, построенную полностью на российских решениях. Но на этом рынке мало быть первым, нужно быть лидером — а это значит постоянно расширять спектр предлагаемых заказчикам возможностей и поддерживать качество оказываемых услуг. Первую задачу нам помогает решать платформа Basis Dynamix, лидер на рынке серверной виртуализации, а вторую — слаженная работа инженерных команд "РТК-ЦОД" и "Базиса"», — говорит Алексей Суравикин, директор продуктового офиса «РТК-ЦОД».

21.04.2026 [21:56], Андрей Крупин

«Турбо облако» представило платформу для быстрого запуска ИИ-моделей с поминутной тарификацией и автоматическим масштабированиемОблачный провайдер «Турбо облако» (входит в коммерческий IT-кластер «Ростелекома»), запустил Inference Platform — платформу для развёртывания и эксплуатации моделей искусственного интеллекта, в основу которой положены ускорители NVIDIA H200 SXM с интерконнектом InfiniBand. Inference Platform поддерживает различные типы ИИ-моделей, включая open source-решения. Пользователи могут загружать собственные модели или использовать контейнерные образы, разворачивая их в облачной среде без дополнительных инфраструктурных настроек. Сервис обеспечивает автоматическое масштабирование ресурсов (автоскейлинг) в зависимости от нагрузки. Такой подход позволяет оптимизировать использование GPU и снизить затраты при нерегулярной нагрузке, говорит компания. Платформа поддерживает распределённый инференс, позволяя запускать модели объёмом до 1 тплн параметров с размещением на нескольких вычислительных узлах. Также доступно гибкое использование GPU-ресурсов, включая их дробление под задачи меньшего объёма. Дополнительным преимуществом является поминутная тарификация ресурсов, гарантирующая более точный контроль расходов по сравнению с почасовой оплатой.

Источник изображения: Omar Lopez-Rincon / unsplash.com В настоящее время новый продукт доступен для тестирования: компании могут оценить его возможности на собственных моделях.

21.04.2026 [11:19], Сергей Карасёв

Anthropic получит от AWS до 5 ГВт ИИ-мощностей и до $25 млрд инвестицийКомпании Anthropic и Amazon объявили о расширении сотрудничества в области облачной инфраструктуры и технологий ИИ. В рамках партнёрства Anthropic получит до 5 ГВт мощностей в инфраструктуре AWS для обучения и поддержания работы своих передовых ИИ-моделей семейства Claude. В ответ Amazon инвестирует в Anthropic дополнительные $5 млрд, а в будущем — ещё до $20 млрд в зависимости от достижения определённых коммерческих целей. Ранее Amazon уже вложила $8 млрд в Anthropic. Отмечается, что Anthropic и Amazon тесно работают с 2023 года. В настоящее время более 100 тыс. клиентов используют модели Claude на платформе Amazon Bedrock. Партнёры также запустили Project Rainier — крупнейший в истории AWS и один из самых масштабных вычислительных кластеров в мире. На сегодняшний день Anthropic использует более 1 млн ускорителей AWS Trainium2 для обучения и обслуживания Claude. В рамках расширенного соглашения Anthropic обязуется потратить более $100 млрд в течение следующих десяти лет на вычислительные мощности AWS. Речь идёт об использовании изделий Trainium текущих и будущих поколений, включая Trainium4. Кроме того, будут использоваться «десятки миллионов» ядер Graviton. В общей сложности это даст до 5 ГВт вычислительной мощности. Так, к концу 2026 года будет введено в эксплуатацию около 1 ГВт ресурсов на базе Trainium.

Источник изображения: Amazon Договор предполагает использование дата-центров в Азии и Европе, что поможет повысить качество обслуживания растущей международной клиентской базы Claude. При этом пользователи смогут получить доступ к полнофункциональной консоли Claude (биллинг, безопасность, управление) непосредственно в облаке AWS — без необходимости управления дополнительными учётными данными или контрактами. Нужно отметить, что Anthropic сотрудничает и с другими поставщиками облачных услуг. В частности, недавно компания объявила о расширении использования инфраструктуры Google Cloud, а также ускорителей Google TPU. Кроме того, Anthropic взяла на себя обязательство приобрести вычислительные мощности Microsoft Azure стоимостью $30 млрд и заключить контракт на поставку дополнительных мощностей объёмом до 1 ГВт.

20.04.2026 [17:14], Андрей Крупин

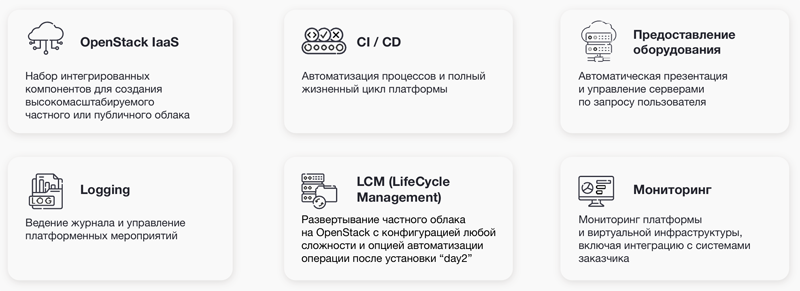

Релиз российской облачной платформы KeyStack 2026.1: расширенная Enterprise-функциональность и архитектура Secure by DefaultКомпания «Ключевые ИТ-решения» (ITKey) объявила о выходе релиза KeyStack 2026.1 — платформы для построения частных и публичных облаков в корпоративном и государственном сегментах. Ключевой особенностью KeyStack версии 2026.1 стало использование OpenStack Epoxy как базового слоя. Это обеспечило продукту поддержку технологии GPU passthrough (прямое подключение к GPU-устройству) для ИИ-нагрузок без дополнительных расходов ресурсов гипервизора, поддержку OVN Southbound Relay для построения масштабируемых SDN-сетей между географически распределёнными центрами обработки данных, а также возможность обновления программного комплекса без остановки сервисов. Дополнительно платформа получила ряд доработок, усиливающих контроль, мониторинг и безопасность облачной инфраструктуры. В KeyStack 2026.1 реализован сквозной аудит с передачей реального IP-адреса пользователя в SIEM, детализированная история операций в AdminUI с возможностью фильтрации и экспорта, централизованный планировщик задач, а также механизм резервного копирования с автоматической проверкой восстановления и SHA256-валидацией.

Основные компоненты, на которых базируется KeyStack (источник изображения: keystack.ru) Отдельное внимание специалистами ITKey было уделено интеграции с системами Prometheus, Grafana и AlertManager, позволяющими расширить возможности мониторинга облачных сред и оптимизировать потребление вычислительных ресурсов. С точки зрения информационной безопасности в новой версии платформы реализован комплексный подход Secure by Default, подразумевающий использование строгих настроек и протоколов сразу после установки платформы. В систему встроены механизмы автоматической ротации mTLS-сертификатов и учётных данных, контроль выполнения задач через белые списки, а также сквозной аудит в формате CADF. Это снижает риски утечек данных, несанкционированных действий и ошибок эксплуатации без усложнения управления системой. По словам разработчика, новая функциональность KeyStack ориентирована на крупные организации с распределённой IT-инфраструктурой и повышенными требованиями к надёжности и защите данных. В числе таковых называются банки, государственные структуры, телеком-операторы, ритейл и промышленные предприятия.

20.04.2026 [10:46], Руслан Авдеев

Еврокомиссия выбрала поставщиков суверенных облачных услуг, которые разделят €180 млнЕврокомиссия отобрала поставщиков облачных услуг на сумму €180 млн ($212 млн). В октябре 20265 года она объявила тендер на предоставление локальных сервисов, способных обеспечить суверенные облачные услуги сроком на шесть лет агентствам и ведомствам ЕС, сообщает Datacenter Dynamics. На днях Еврокомиссия сообщила о заключении контракта с Post Telecom (при участии партнёров CleverCloud и OVHcloud), StackIT, Scaleway и Proximus, взаимодействующей с S3NS, Clarence и Mistral. Сделка должна поддержать «более масштабные усилия Еврокомиссии по укреплению собственного суверенитете, укреплению стратегического контроля над ключевыми технологиями и инфраструктурой». Соглашение о поставке услуг заключены с учётом стратегических, юридических, операционных и экологических соображений. Кроме того, в расчёт принималась прозрачность цепочки поставок, технологическая открытость, безопасность и соответствие законодательству Евросоюза. Сейчас Еврокомиссия завершает разработку обновлённого варианта Cloud Sovereignty Framework — рамочной программы обеспечения суверенитета облачных технологий, включающей поддающиеся контролю критерии оценки суверенитета. Параллельно комиссия внедряет критерии внутри собственных структур, чтобы оценивать и укреплять суверенитет цифровых сервисов, используемых её департаментами и иными ведомствами Евросоюза.

Источник изображения: George Liapis/unsplash.com Как заявили в Scaleway, на каждый €1, потраченный вместе с компанией, €0,68 реинвестируется в Европейскую экономику, тогда как в случае с международными гиперскейлерами речь идёт лишь о €0,20. При этом европейские поставщики облачных услуг вкладывают средства в местные проекты и гарантируют, что активы, опыт и инновации останутся в Европе. При этом ситуация с импортозамещением остаётся печальной — доля локальных облачных игроков не европейском рынке годами остаётся на уровне 15 %, и никакие инициативы не помогли увеличить её. В последние годы вопросы цифрового суверенитета обсуждаются всё активнее, особенно в европейском государственном секторе. Многие местные правительства нередко зависят от американских облачных провайдеров, их данные подпадают под действие Закона об облачных технологиях (CLOUD Act), позволяющего американским властям запрашивать у американских компаний доступ к любым данным в их хранилищах. В 2025 году Microsoft признала, что не может обеспечить настоящий суверенитет данных в Европе. Впрочем, Google, AWS и Microsoft неоднократно пытались заверить клиентов из Европы в суверенитете их данных. Также Еврокомиссия готовит пакет Tech Sovereignty — он включает стратегию, касающуюся Open Source-разработок, закон Chips Act 2, план Strategic Roadmap for Digitalisation and AI in Energy, а также закон Cloud and AI Development Act (CADA), посвящённый развитию облаков и ИИ. Последний предполагает «гармонизацию» понятий суверенитета для облаков и ИИ-сервисов означает на едином рынке. Предполагается расширить возможности для суверенных облачных предложений, в том числе через госзакупки, а также поддержать выход на рынок расширенного круга поставщиков облачных и ИИ-сервисов. UPD 21.04.2026: к списку поставщиков облачнух услуг присоединились DEEP (POST Luxembourg Group), OVHcloud и Clever Cloud.

19.04.2026 [14:20], Владимир Мироненко

TD Synnex арендовала у Nebius кластеры NVIDIA B300, чтобы дать ИИ-мощности партнёрами и клиентамTD Synnex, американский дистрибьютор и агрегатор IT-решений, объявил о расширении своего портфеля услуг ИИ-инфраструктуры (AI Infrastructure-as-a-Service) в Северной Америке за счёт резервирования более тысячи ускорителей в составе выделенных кластеров NVIDIA HGX B300, развёрнутых в ИИ-облаке Nebius. Мощности в Nebius AI Cloud предназначены для партнёров и клиентов TD Synnex, и это, по словам компании, первая сделка такого рода. Дистрибьютор отметил, что заблаговременное выделение GPU-мощностей помогает партнёрам преодолеть один из наиболее существенных барьеров на пути внедрения ИИ в корпоративной среде: непостоянный доступ к вычислениям. Партнёры смогут напрямую выделять зарезервированные мощности для рабочих нагрузок клиентов, ускоряя переход от экспериментов в области ИИ к продуктовым решениям. Облачная платформа TD Synnex x Nebius AI Cloud соответствует эталонной архитектуре NVIDIA Enterprise Reference Architecture (Enterprise RA) и поддерживает непрерывные рабочие нагрузки обучения и инференса. Встроенные функции безопасности, изоляции и операционной надёжности обеспечивают готовую основу для партнёров, предоставляющих корпоративные решения в области ИИ. Благодаря партнёрской экосистеме TD Synnex, инфраструктура может быть объединена с ПО NVIDIA AI Enterprise и продуктами независимых поставщиков ПО (ISV) для предоставления комплексных, готовых к использованию в корпоративной среде решений на основе ИИ.

Источник изображения: TD Synnex «Спрос на ИИ в корпоративной среде реален, но реализация застопоривается, когда инфраструктура не гарантирована», — говорит вице-президент по глобальному партнёрству Nebius. Как сообщил ресурсу CRN старший вице-президент по облачным технологиям, безопасности и ИИ в TD Synnex, сделка с Nebius вызвала такой большой интерес у партнёров по каналу продаж, что, по его мнению, первая партия инстансов «вероятно, будет раскуплена довольно быстро», и компания уже думает о будущем расширении. В прошлом месяце было объявлено о стратегическом партнёрстве NVIDIA и Nebius, в рамках которого производитель чипов инвестирует в стартап $2 млрд для разработки и строительства ИИ ЦОД. |

|