Материалы по тегу: ии

|

26.10.2025 [23:55], Владимир Мироненко

Amazon проморгала рынок и теперь её клиенты бегут за ИИ в облака конкурентовAmazon, стоящая у истоков облачного бизнеса, уже не первый год отстаёт от конкурентов по темпам его роста. И на ИИ-рынке, по общему мнению, она оказалась в роли догоняющей на фоне стремительного роста конкурентов, пишет агентство Bloomberg. На прошлой неделе стало известно, что Google Cloud предоставит Anthropic до 1 млн своих ИИ-чипов TPU, что свидетельствует об углублении партнёрства Google с быстрорастущим ИИ-стартапом и наносит удар по Amazon, инвестировавшей в Anthropic миллиарды долларов. AWS по-прежнему лидирует на облачном рынке, но Microsoft наращивает объём корпоративных продаж быстрее, чем Amazon. В прошлом году, по оценке Gartner, облачное AWS заняла 38 % корпоративных расходов на услуги облачной инфраструктуры, тогда как ещё в 2018 году, по данным компании, у «дочки» Amazon было почти 50 % этого рынка. Чтобы выяснить причины сложившейся ситуации, агентство Bloomberg провело опрос аналитиков в области облачных вычислений и финансов, а также у компаний, которые используют или перепродают облачные решения Amazon, и среди 23 нынешних и бывших сотрудника AWS, работающих в сфере разработки, управления продуктами, маркетинга, продаж и поддержки. Одной из главных причин, тормозящих работу AWS, а также влияющих на гибкость, они назвали внутреннюю бюрократию. Респонденты отметили слабый старт компании в области ИИ, а также то, что она стала менее привлекательной для стартапов. Вместе с тем AWS верна своей давней стратегии на фоне быстро меняющегося рынка. Участники опроса признают, что AWS сохраняет значительные преимущества и лояльность клиентов, но опасаются, что компания теряет свои позиции в погоне за конкурентами, которых когда-то опережала. На следующей неделе Amazon объявит квартальные финансовые результаты, которые, как ожидается, покажут рост облачного бизнеса на 18 % до $32 млрд, что уступает показателю роста годом ранее (19 %). Сказался и серьёзный рост конкуренции на облачном рынке в последние пару лет. Oracle, которую когда-то считали аутсайдером в облачной индустрии, теперь заключает многомиллиардные контракты в области ИИ, хотя и не все верят в её успех. Также наращивают мощности Google и неооблака. Дэйв Маккарти (Dave McCarthy), консультант IDC, отметил, что выбор облачных предложений, ранее ограничивавшийся сервисами Amazon и Microsoft, стал гораздо больше, и это не сулит ничего хорошего Amazon. «Это создаёт новое конкурентное давление, которого раньше не было», — подчеркнул он. Стремясь вернуть себе инициативу, AWS реорганизовала команды по инжинирингу и продажам, провела кадровые перестановки в руководстве, а также отказалась от некоторых собственных правил разработки ради ускорения вывода продуктов на рынок и попыталась сократить бюрократию, возникшую после масштабного набора сотрудников во время пандемии. Кроме того, в этом месяце AWS выпустила Quick Suite, призванный заменить её предыдущий основной ИИ-инструмент для корпоративных клиентов, и в декабре ожидается запуск ряда новых и обновлённых ИИ-сервисов. Представитель Amazon Селена Шен (Selena Shen) сообщила в электронном письме Bloomberg, что AWS по-прежнему лидирует на рынке облачных технологиях с большим отрывом, а её ИИ-сервисы, такие как Amazon Bedrock, SageMaker и Kiro, пользуются спросом у клиентов, в том числе из-за выгодного соотношении цены и производительности фирменных ИИ-ускорителей Trainium2. Amazon заключила за последнее время крупные сделки с широким кругом клиентов, включая Delta Air Lines, Volkswagen, Управление общих служб США (GSA) и State Farm, отметила Шен. «Если вы посмотрите на любой список самых инновационных или быстрорастущих стартапов мира, вы обнаружите, что подавляющее большинство из них в значительной степени разворачивают рабочие нагрузки в AWS», — добавила она, ссылаясь, среди прочего, на списки Forbes и CNBC. Тем не менее, по общему мнению, оставаясь лидером в области облачной инфраструктуры, AWS отстаёт от своих конкурентов в плане привлечения бизнеса, создающего или использующего ИИ-модели. В частности, AWS не поверила в то, что Anthropic сможет монетизировать свои разработки, поэтому стартап в поисках необходимых вычислительных мощностей обратился к Google Cloud. Когда стартап привлёк инвестиции в начале 2023 года, среди инвесторов была и Google. Лишь в сентябре Amazon спохватилась и инвестировала в Anthropic первый из двух запланированных траншей в размере $4 млрд, обязав Anthropic использовать AWS и собственные чипы Amazon, а также предлагать клиентам Amazon модели Claude. Объём инвестиций шокировал ветеранов Amazon, знавших, что компания крайне не любит платить за что-либо по рыночным ценам. Некоторые посчитали это отчаянием, пишет Bloomberg. Amazon долгое время гордилась тем, что работает в режиме стартапа, предоставляя свободу независимым командам. Но этот принцип оказался неэффективным при разработке ИИ-моделей, поскольку научные и инженерные подразделения AWS, розничный отдел Amazon и группы Alexa и устройств занимались схожей, иногда дублирующей работой по обучению собственных ИИ-моделей. На конференции AWS re:Invent в ноябре 2023 года компания сделала упор на ИИ, а чуть позже развернула собственного ИИ-ассистента Amazon Q, который, по словам аналитиков, не принёс ничего революционного рынку, уже переполненному чат-ботами. Amazon провела реорганизацию и централизовала большинство работ по разработке передовых моделей, однако развитие AWS замедлилось. В том числе из-за усложнения иерархии после всплеска найма в результате пандемии. В условиях растущей бюрократии принятие решений происходило не так быстро, как раньше. Кроме того, поскольку ПО AWS стало критически важным для крупных корпоративных и государственных клиентов, в компании установили процедуры, призванные снизить риск того, что невнимательный или недовольный сотрудник может сломать что-то важное — это тоже замедляет работу. В некоторых случах часть сотрудников даже заставили получать разрешения на отправку писем высшему руководству. Шен сообщила, что с 2024 года AWS наняла множество новых руководителей и продвигает по службе тех, кто «демонстрирует производительность и готовность к следующему уровню», и что культура AWS остаётся сильной. Сменивший Адама Селипски (Adam Selipsky) на посту гендиректора AWS Мэтт Гарман (Matt Garman), пользующийся большим доверием разработчиков, частично вернул культуру прошлого. От руководителей продуктов требуется открытое признание ошибок и извлечённых уроков, идеи сотрудников принимаются в виде коротких питчей, а сами разработчики ПО работают посменно, обрабатывая запросы поддержки и инциденты по своим продуктам, чтобы понять потребности клиентов. Кроме того, Гарман завершил или прекратила разработку около трёх десятков устаревших и непопулярных продуктов, перенаправив силы на разработку ИИ-инструментов. Тем не менее, сотрудники выражают обеспокоенность тем, что Amazon теряет привлекательность для стартапов. AWS, как известно, помогла зарождению Netflix, но в последние годы порой отдавала приоритет корпорациям с большими расходами, не желая тратить силы на стартапы, которые могут и не стать долгосрочными богатыми клиентами. По словам аналитиков и стартап-консультантов, Google, используя свою известность, инженеров и навыки в передовых ИИ-инструментах, смогла привлечь многих ведущих стартапов в этой сфере. «Если вы сегодня не привлекаете местные стартапы в сфере ИИ, которые в ближайшие пару лет вырастут в пять-десять раз, это может стать реальной проблемой для бизнеса», — сказал Джош Бек (Josh Beck), аналитик Raymond James. Шен же назвала AWS «лучшим выбором для стартапов», приведя в пример Perplexity и Cursor. Но, к примеру, Пит Шваб (Pete Schwab), основатель стартапа Stronghold Labs в области ИИ-анализа видео, выбрал для своего детища площадку Google из-за её ориентации на небольших разработчиков и качества внутренних ИИ-моделей, хотя сам до этого 10 лет проработал в Amazon. AWS «раньше гораздо лучше привлекала таких людей, как мы», — сказал Шваб. Существующие клиенты AWS сейчас также обращаются к услугам её конкурентов, особенно в ИИ-сфере. Например, Grammarly, пользуется AWS, но для ИИ-решений использует модели OpenAI, в том числе в Microsoft Azure, а также Meta✴ Llama, поскольку AWS Bedrock не отвечает ценовым и другим потребностям компании, заявил технический директор стартапа. В начале этого месяца компания представила Quick Suite — чат-бот и набор ИИ-агентов, предназначенных для анализа данных, создания отчётов или резюмирования веб-контента, которые ориентированы на офисных сотрудников. В этой области компания не добилась особого успеха. Руководители в частном порядке признают, что, в отличие от Google и Microsoft, которые могут демонстрировать свои ИИ-инструменты миллиардам клиентов поисковой системы или пользователей ПК, естественный охват AWS ограничен гораздо более узким сообществом разработчиков. Для этой аудитории AWS продолжает расширять возможности Bedrock. Bedrock считается самым успешным ИИ-продуктом компании, число пользователей которого исчисляется десятками тысяч. По словам клиентов и партнёров, отделы продаж сделали увеличение их количества приоритетом. Однако Amazon может преуспеть в эпоху ИИ, просто выступая в качестве поставщика инфраструктуры для других компаний и управляя ею экономически эффективно. По мнению аналитиков, большая часть корпоративных проектов в области ИИ носит экспериментальный характер. Если проект получит более широкую поддержку, экономия средств и надёжная инфраструктура (если не учитывать недавний сбой) — два основных преимущества AWS — станут ещё важнее, утверждают руководители компании.

26.10.2025 [14:20], Сергей Карасёв

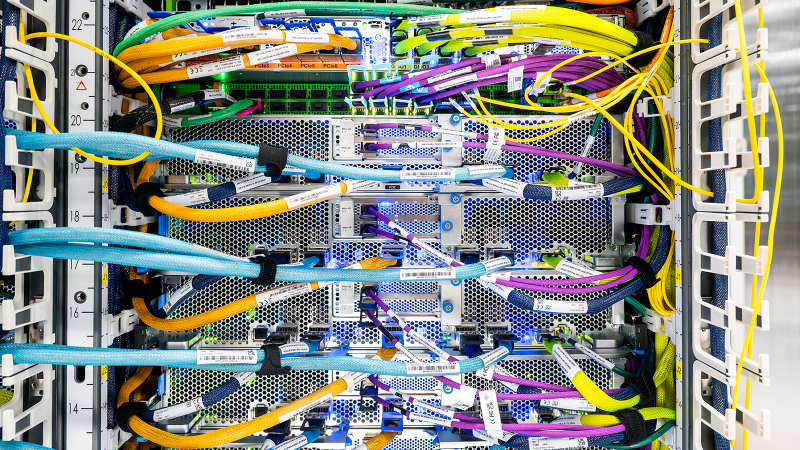

d-Matrix представила систему SquadRack для ИИ-инференса со сверхнизкой задержкойКомпания d-Matrix анонсировала систему SquadRack — стоечное решение для пакетного инференса со сверхнизкой задержкой. Это, как утверждается, первый в отрасли продукт данного класса. В его разработке приняли участие специалисты Arista, Broadcom и Supermicro. В основу SquadRack положена серверная платформа Supermicro X14 AI. Судя по изображениям, используется модель SYS-522GA-NRT, которая допускает установку двух процессоров Intel Xeon 6900 (Granite Rapids) и 24 модулей оперативной памяти DDR5-8800. Доступны 24 фронтальных отсека для SFF-накопителей U.2/U.3 (NVMe). Устройство выполнено в форм-факторе 5U. Система SquadRack предусматривает использование ускорителей d-Matrix Corsair. Их архитектура основана на модифицированных ячейках SRAM для вычислений в памяти (DIMC), работающих на скорости около 150 Тбайт/с. По заявлениям d-Matrix, решение обеспечивает непревзойдённую производительность ИИ-инференса: быстродействие достигает 2,4 Пфлопс (8-бит вычисления). Кроме того, задействованы IO-карты d-Matrix JetStream, предназначенные для распределения нагрузок инференса. Одна такая карта может обслуживать до четырёх экземпляров Corsair, обеспечивая сетевую задержку на уровне 2 мкс. Решение SquadRack также оборудовано PCIe-коммутаторами Broadcom для масштабирования в пределах одного узла. В свою очередь, связь между узлами обеспечивают коммутаторы Arista Leaf Ethernet, подключённые к картам JetStream. Применяется программный стек d-Matrix Aviator. В одну стойку могут быть установлены до восьми экземпляров SquadRack, что позволяет с высокой скоростью обрабатывать модели ИИ, насчитывающие до 100 млрд параметров. В целом, возможно масштабирование до сотен узлов в нескольких серверных стойках.

24.10.2025 [22:50], Владимир Мироненко

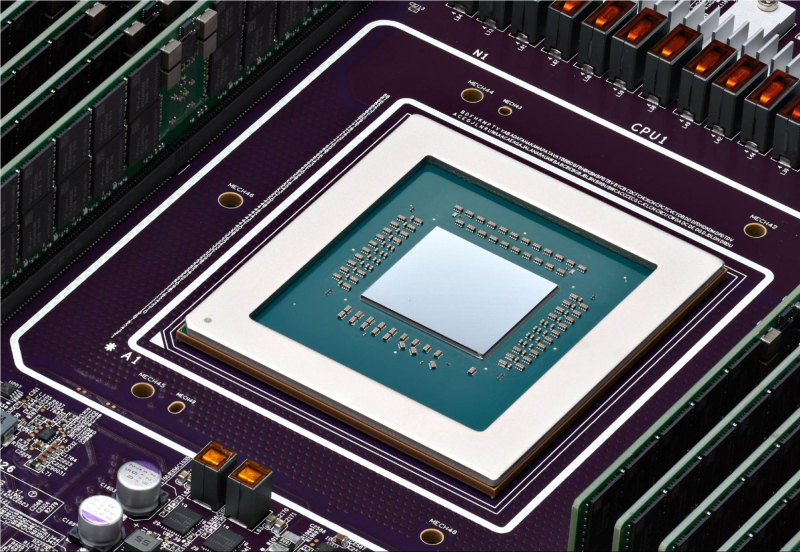

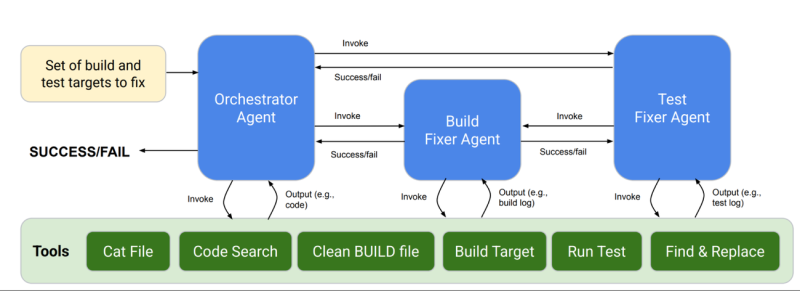

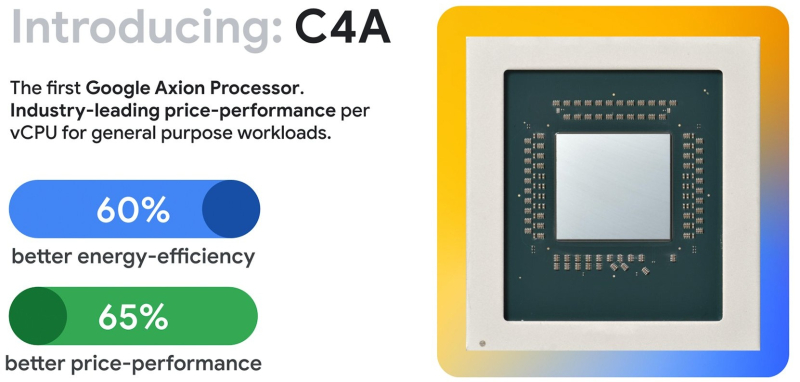

ИИ помог Google перенести 30 тыс. внутренних нагрузок на Arm-процессоры Axion, на очереди ещё 70 тыс.Google объявила, что портировала около 30 тыс. внутренних нагрузок на Arm-архитектуру и планирует перенести ещё порядка 70 тыс. Помогает ей в этом ИИ, но пока не слишком успешно. При этом целиком отказываться от x86-процессоров в пользу собственных Arm-чипов Axion компания пока не планирует. YouTube, Gmail и BigQuery уже работают как на системах с x86, так и c Arm. В процессе портирования приходится уделять внимание архитектурным различиям, таким как особенности работы с числами с плавающей запятой, параллелизм, платформенно-зависимые технологии и производительность. Специалисты Google рассказали, что сначала они перенесли некоторые из ключевых задач, такие как F1, Spanner и Bigtable, используя стандартные методы разработки ПО с привлечением инженеров. Оказалось, что современные компиляторы и инструменты, такие как санитайзеры и фаззеры, избавили разработчиков от множества сюрпризов. Большая часть времени по факту ушла на исправление тестов, обновление сложных систем сборки и развёртывания, как правило, для самых старых и самых нагруженных сервисов, устранение проблем с массовым развёртыванием в рабочих средах и принятие мер по предотвращению дестабилизации критически важных систем. 30 тыс. приложений — это достаточно большой объём кода для того, чтобы задуматься об автоматизации задач. Поэтому компания создала новый мультиагентный ИИ-инструмент CogniPort для исправления ошибок сборки и тестирования. Он успешно справлялся с проблемами примерно в 30 % случаев и лучше всего — с исправлениями тестов, платформенно-зависимыми особенностями и особенностями представления данных. Эффективность не впечатляет, но Google предстоит портировать ещё десятки тысяч нагрузок. пакетов. Кроме того, компания внедрила новую систему непрерывного мониторинга и развёртывания мультиархитектурных нагрузок CHAMP (Continuous Health Monitoring Platform), которая автоматически отбрасывает задачи, работа которых на Arm сопровождается проблемами вроде циклических сбоев или недостаточной производительности, для последующих отладки и профилирования. Чем больше будет запущено нагрузок, тем лучше Borg, управляющий кластерами внутри Google, сможет распределять задачи таким образом, чтобы эффективно использовать Arm-серверы. Это позволит сэкономить затраты, поскольку по словам Google, системы на базе Axion обеспечивают на 65 % лучшее соотношение цены и производительности, чем экземпляры на базе x86, а также на 60 % более высокую энергоэффективность. Ранее Google, по неофициальным данным, высказывала недовольство показателем TCO последних поколений Intel Xeon. Возможно, это побудило компанию заняться созданием собственного процессора. Первой на этот путь, тоже ради улучшения TCO, ступила Amazon, которая разработала уже четыре поколения Arm-процессоров Graviton. В прошлом году компания похвасталась, что у неё есть уже 2 млн этих чипов. Alibaba Cloud в 2021 году представила свой первый Arm-процессор Yitian 710. У Microsoft с прошлого года есть собственные Arm-чипы Cobalt 100, на которые также возложена часть внутренних нагрузок. Наконец, Oracle два года назад сообщила о завершении миграции всех своих облачных сервисов на Arm, включая флагманскую СУБД. Oracle использует процессоры компании Ampere Computing, в которой она владела заметной долей до сделки с SoftBank. Все эти процессоры позволили Arm занять четверть рынка серверных CPU, однако решающую роль сыграло внедрение NVIDIA GB200/GB300. Arm также заключила стратегическое соглашение с Meta✴, чтобы помочь последней с оптимизацией ПО.

24.10.2025 [20:32], Андрей Крупин

Компания «Хоулмонт» представила xDbStream — инструмент для синхронизации данных между СУБД любого типаРоссийская компания «Хоулмонт», специализирующаяся на разработке корпоративного ПО для коммерческого сектора и государственных структур, выпустила на рынок xDbStream — продукт для универсальной синхронизации данных между любыми СУБД. Решение позволяет проводить миграцию критически важных ERP-систем по методологии Parallel Running без остановки бизнес-процессов. Инструмент xDbStream построен на базе Java-платформы Jmix и включает два компонента: сервер для однонаправленной отложенной репликации между СУБД различного типа и модуль мониторинга консистентности данных. Программа позволяет настраивать потоки репликации, вести мониторинг производительности, обнаруживать и разрешать конфликты репликации, синхронизировать часть данных в случае сбоя. Доступны различные способы поиска изменений (чтение журналов транзакций, сканирование по меткам времени, сравнение образов, обработка событий/триггеров), маппинга (простой SQL, Groovy-скрипты, вызовы внешних сервисов для преобразования данных «на лету») и репликации (обработка простых таблиц, сложных графов, M:N-связей).

Источник изображения: «Хоулмонт» / haulmont.ru Продукт поддерживает стандартные JDBC-драйверы для подключения к большинству современных и устаревших СУБД, а также многопоточную обработку данных. Кроме того, он позволяет в режиме реального времени анализировать расхождения между старой и новой базами данных на основании правил и настроек пользователя. Утверждается, что xDbStream обеспечивает 100-процентную совместимость с любыми типами СУБД и автоматическое разрешение 95 % конфликтов репликации. По словам разработчика, с помощью xDbStream можно не только заменить устаревшую ERP-систему, но и разработать композитную платформу управления ресурсами предприятия из модулей от разных поставщиков, провести начальную миграцию данных или поддерживать консистентность данных в системах разных подразделений, например, головного офиса и филиалов. Также продукт может использоваться для решения задач по замене иностранного и устаревшего ПО, которые сейчас очень актуальны для многих организаций.

24.10.2025 [15:14], Сергей Карасёв

«Аквариус» представил стоечный компьютер AQdesk K740 формата 2UРоссийская компания «Аквариус» анонсировала компьютер AQdesk K740, предназначенный для использования в инфраструктуре дата-центров. Устройство, выполненное в форм-факторе 2U на платформе Intel, может монтироваться в серверную стойку. В основу новинки положена материнская плата Aquarius AQB760M, разработанная и произведенная «Аквариусом» . Допускается использование процессоров Intel Core 12-, 13- и 14-го поколений. Система может нести на борту до 96 Гбайт оперативной памяти DDR5. Во фронтальной части расположены отсеки для SFF/LFF-накопителей с возможностью горячей замены. Кроме того, есть два внутренних коннектора для SSD типоразмера M.2. В оснащение включён сетевой контроллер 2,5GbE, а опционально могут быть добавлены адаптеры Wi-Fi/Bluetooth. Доступны слоты расширения, в которые можно установить дополнительные сетевые карты, дискретные графические ускорители или специализированные контроллеры. На лицевую панель выведены порты USB 2.0 Type-A и USB 3.2 Gen1 Type-A. Сзади сосредоточены интерфейсы USB 2.0 Type-A, USB 3.2 Gen1 Type-A, D-Sub, HDMI, DisplayPort, гнёзда PS/2 и RJ45, а также аудиоразъём. При необходимости может быть добавлен последовательный порт. Допускается вывод изображения одновременно на три монитора. Компьютер предлагается в вариантах с блоком питания на 220 В переменного тока или 24 В постоянного тока, что удобно для интеграции в АСУ ТП. Ещё одная опция — аппаратно-программный модуль доверенной загрузки. Габариты составляют 485 × 530 × 90 мм. На устройство предоставляется трёхлетняя гарантия.

24.10.2025 [14:40], Руслан Авдеев

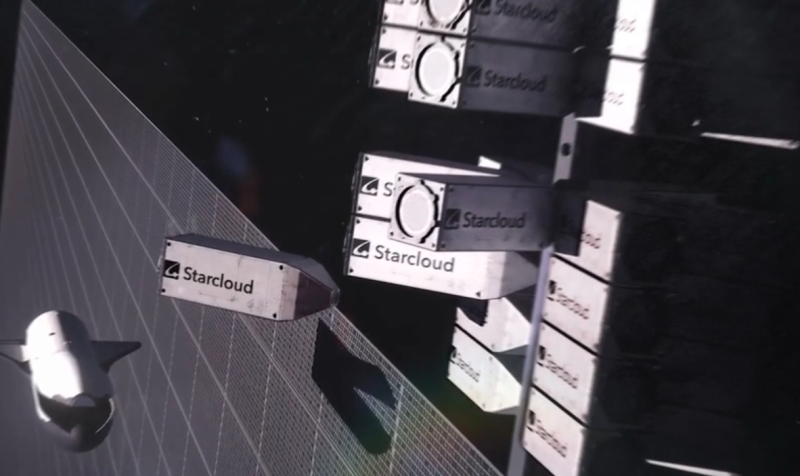

Crusoe развернёт облачную ИИ-платформу на спутнике StarcloudCrusoe, известная в качестве застройщика первого ИИ-кампуса OpenAI Stargate. намерена развернуть свою облачную платформу на спутнике Starcloud (бывшей Lumen Orbit), запуск которого запланирован на конец 2026 года. Ограниченный доступ к ИИ-мощностям в космосе должен появиться к началу 2027 года, сообщает Datacenter Dynamics. Соглашение о партнёрстве заключено незадолго до запуска спутника Starcloud-1. Starcloud-1 на платформе Corvus-Micro компании Astro Digital размером с небольшой холодильник (60 кг) будет оснащён ИИ-ускорителем NVIDIA H100 и позволит на практике оценить концепцию космических вычислений. После примерно 11 месяцев службы он сойдёт с орбиты на высоте 325 км и сгорит в атмосфере. Если тестирование признают успешным, Crusoe рассмотрит создание более крупного ЦОД в космосе — мощностью до 5 ГВт и с солнечными панелями площадью 4 км2. По словам Starcloud, Crusoe станет основным поставщиком облачных услуг на её. Подчёркивается, что опыт Crusoe в создании надёжных, эффективных и масштабируемых вычислительных решений делает компанию идеальным партнёром для пионеров новой космической эры. В Crusoe считают, что космос сыграет важную роль в будущем облачных вычислений, поскольку позволяет практически неограниченно масштабировать ИИ-инфраструктуру благодаря доступу к безлимитной солнечной энергии. Как будут решаться вопросы охлаждения космических ЦОД и защиты от радиации, которая не позволяет надёжно использовать в течение длительного времени современные чипы с тонкими техпроцессами, пока не уточняется.

Источник изображения: Starcloud В космосе намерены развернуть свои дата-центры многие компании, включая Axiom Space, NTT, Ramon.Space и Sophia Space. Ранее в 2025 году стартап Lonestar успешно разместил небольшой тестовый ЦОД даже на Луне, хотя тот проработал не очень долго. В октябре основатель Amazon Джефф Безос (Jeff Bezos) уже прогнозировал появление гигаваттных ЦОД в космосе через десять лет, а один из основателей Google Эрик Шмидт (Eric Schmidt) объявил, что именно поэтому им куплена авиакосмическая компания Relativity Space. Также появились сообщения о том, что Crusoe привлекла $1,4 млрд в ходе раунда финансирования, возглавленного Mubadala Capital и Valor Equity Partners, в результате оценка компании выросла до $10 млрд.

24.10.2025 [13:15], Руслан Авдеев

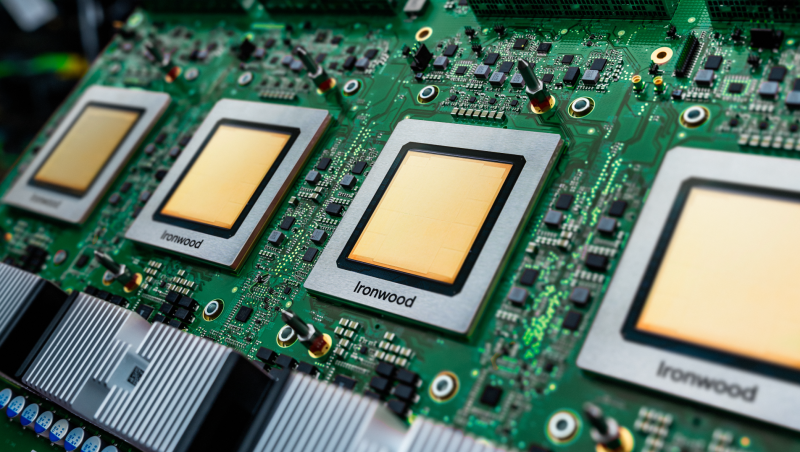

1 млн TPU и 1 ГВт: Anthropic расширит использование ИИ-ускорителей и сервисов Google CloudКомпания Anthropic объявила о знаковом расширении использования чипов TPU Google Cloud. Это обеспечит компании доступ к вычислительным ресурсам, необходимым для обучения и обслуживания ИИ-моделей Claude новых поколений. В 2026 году Anthropic рассчитывает получить доступ к мощностям, превышающим 1 ГВт, сообщает пресс-служба Google Cloud. Речь идёт о крупнейшем увеличении использования TPU компанией Anthropic за всё время использования ей тензорных ускорителей Google. Она получит доступ к 1 млн чипов, а также дополнительным сервисам Google Cloud. По оценкам некоторых экспертов, это примерная пятая часть всех TPU Google, но в 2026 году компания намерена развернуть ещё 2,5 млн TPU. Предполагается, что сделка обеспечит R&D-группы Anthropic передовой инфраструктурой, оптимизированной для ИИ-проектов, на годы вперёд. Как сообщают в Google, Anthropic выбрала TPU из-за привлекательного соотношения цены и производительности, а также благодаря имеющемуся опыту обучения и эксплуатации ИИ-моделей именно с помощью TPU. О стратегическом партнёрстве Anthropic и Google Cloud объявили в 2023 году. На сегодняшний день моделями семейства Claude компании Anthropic в Google Cloud активно пользуются тысячи компаний, включая Figma, Palo Alto Networks, Cursor и др. В Anthropic подчеркнули, что с Google компания давно сотрудничает, а последнее расширение поможет и дальше наращивать вычислительные мощности, необходимые для наращивания возможностей ИИ-систем. В числе клиентов — как компании из списка Fortune 500, так и ИИ-стартапы, которые полагаются на Claude. Расширение вычислительных возможностей гарантирует, что компания сможет удовлетворить стремительно растущий спрос, сохраняя актуальность ИИ-продуктов. В Google Cloud отметили, что Anthropic использует TPU уже несколько лет с оптимальным для неё соотношением цены и производительности, в Google продолжают инновации, опираясь на «зрелое» портфолио ИИ-ускорителей, включая TPU седьмого поколения — Ironwood.

24.10.2025 [11:41], Руслан Авдеев

Vantage построит для OpenAI в Висконсине кампус Stargate Lighthouse стоимостью более $15 млрдОчередной кампус Stargate появится в США. Компании OpenAI, Oracle и Vantage Data Centers намерены построить площадку Lighthouse в штате Висконсин, на реализацию проекта уйдёт более $15 млрд, сообщает Silicon Angle. В кампусе разместятся четыре ЦОД с общей вычислительной мощностью почти 1 ГВт. Vantage, занимающаяся строительством ЦОД, основана в 2010 году инвестиционной компанией Silver Lake. В прошлом году Vantage привлекла $6,4 млрд на развитие своей инфраструктуры, по состоянию на январь 2024 года в её портфолио насчитывалось более 30 действующих и запланированных дата-центров. Lighthouse будет расположен в пригороде Милуоки (Milwaukee) на берегу озера Мичиган. В Vantage намерены создать «водно-положительный» кампус, который будет восстанавливать больше питьевой воды, чем потреблять. Для этого планируется использовать замкнутую систему жидкостного охлаждения для минимизации потерь воды. Также компания вложит средства в очистные сооружения, модернизацию водопровода и сопутствующие проекты. Новую инфраструктуру планируется построить в рамках программы объёмом в $175 млн. Также программа предусматривает реализации проектов в сфере производства электроэнергии. Vantage намерена поддержать развитие возобновляемой энергетики в Висконсине — солнечной и ветряной, а также создание аккумуляторных накопителей. Предполагается, что 70 % энергии будет выделяться проекту Lighthouse, а остальная часть будет доступна потребителям из Висконсина. Как заявил представитель OpenAI, проект позволит создать «хорошие» рабочие места, развивать энергетику с нулевыми выбросами и стимулировать местную экономику. При этом мощности будут расширяться без повышения тарифов для местных клиентов энергокомпаний. Vantage намерена начать строительство в ближайшее время, завершиться оно должно в 2028 году. В Vantage считают, что вклад в ВВП региона составит $2,7 млрд. Lighthouse — один из двух кампусов Stargate, строительство которых осуществляется при участии OpenAI и Oracle. В Техасе рядом с уже начавшим работу кампусом Stargate от Crusoe также строится кампус Frontier, рассчитанный на 10 дата-центров общей вычислительной мощностью более 1,4 ГВт. Vantage намерена инвестировать в проект более $25 млрд. На две площадки Vantage придётся около четверти мощностей ЦОД, которые OpenAI рассчитывает построить в США в рамках проекта Stargate. Общая стоимость проекта оценивается в $500 млрд до 2029 года. $300 млрд получить от партнёрства с OpenAI планирует Oracle.

23.10.2025 [23:43], Владимир Мироненко

Инвесторы остались недовольны замедлением роста выручки от ПО IBM — акции упали, несмотря на рост показателейКорпорация IBM опубликовала финансовые результаты за III квартал 2025 года, завершившийся 30 сентября, которые превзошли ожидания Уолл-стрит, и повысила свой прогноз в связи с благоприятными условиями для развития ИИ-технологий. Однако акции компании упали на 5 %, поскольку инвесторы остались недовольны замедлением роста выручки от продаж в ключевом сегменте облачного ПО, пишет Reuters, Выручка IBM выросла за отчётный период год к году на 9 % до $16,33 млрд, что выше консенсус-прогноза аналитиков, опрошенных LSEG, равного $16,09 млрд. Скорректированная прибыль (Non-GAAP) на акцию равняется $2,65 при целевом показателе аналитиков от LSEG в размере $2,45 на акцию. Чистая прибыль (GAAP) за квартал составила $1,74 млрд, тогда как годом ранее у компании были убытки в $330 млн, обусловленные пенсионными выплатами в размере $2,7 млрд. Глава IBM Арвинд Кришна (Arvind Krishna) охарактеризовал минувший квартал как успешный: благодаря росту показателей во всех сегментах компания превзошла прогнозы экспертов по выручке, прибыли и свободному денежному потоку. «Клиенты по всему миру продолжают использовать наши технологии и экспертные знания для повышения производительности своих операций и создания реальной бизнес-ценности с помощью ИИ», — отметил он. Кришна сообщил, что портфель заказов компании в сфере ИИ, объединяющий бронирование с фактическими продажами различных продуктов и услуг на базе ИИ, вырос по сравнению с предыдущим кварталом на $7,5 млрд, превысив $9,5 млрд. Выручка IBM от разработки ПО выросла год к году на 10 % до $7,21 млрд, что соответствует прогнозу StreetAccount. При этом выручка в категории гибридного облачного ПО, включающей Red Hat, увеличилась на 14 %, тогда как в предыдущем квартале её рост составил 16 %. Замедление роста выручки стало поводом для недовольства инвесторов. Кришна заверил аналитиков в ходе телефонной конференции, что подразделение гибридного облака вернется к росту в среднем на 15 % или близко к этому уровню к началу 2026 года. «Замедление роста выручки и продаж Red Hat… разочарует тех, кто надеялся на ускорение роста в этом высокорентабельном сегменте», — заявил Майкл Эшли Шульман (Michael Ashley Schulman), директор по инвестициям Running Point Capital. Как пишет SiliconANGLE, с его мнением совпало мнение аналитика Evercore ISI Амита Дарьянани (Amit Daryanani) и аналитика Jeffries Брента Тилла (Brent Thill), который в своей записке для инвесторов сообщил, что перспективы софтверного бизнеса IBM в значительной степени зависят от того, сможет ли Red Hat найти способ возобновить рост: «Ускорение роста бизнеса IBM в сфере ПО в ближайшие несколько кварталов будет зависеть от динамики развития Red Hat, которая остаётся краеугольным камнем стратегии роста IBM в сфере ПО, и руководство подтверждает уверенность в сохранении роста на уровне около 15 %». Выручка подразделения по автоматизации увеличилась год к году на 24 %, выручка подразделения по обработке данных и ИИ — на 8 %. Выручка от обработки транзакций снизилась на 1 % год к году. Выручка от консалтинговых услуг составила $5,3 млрд, превысив прогноз Уолл-стрит в $5,24 млрд. В сегменте инфраструктуры выручка увеличилась на 17 % до $3,56 млрд. При этом продажи мейнфреймов IBM Z выросли на 61 %. Новый мейнфрейм z17, ориентированный на ИИ, широко используется в финансовой отрасли, позволяя поддерживать строгие правила хранения и шифрования данных в процессе внедрения ИИ-технологий, сообщил агентству Reuters финансовый директор IBM Джим Кавано (Jim Kavanaugh). ИИ также внёс свой вклад в рост выручки, поскольку, как отметил Кришна, СХД являются ключевой частью ИИ-инфраструктуры, поэтому у IBM их активно покупают, пишет The Register. IBM повысила свой прогноз выручки и заявила, что теперь ожидает её роста «более чем» на 5 % по сравнению с «как минимум» 5 %, ожидавшимся ранее. Также ожидается, что свободный денежный поток за год составит $14 млрд, что выше прогноза в $13,5 млрд, сделанного в предыдущем квартале. Кришна cообщил, что IBM сотрудничает с гиперскейлерами, а также является одним из крупных клиентов CoreWeave. «Мы также часто используем инфраструктуру AWS, Azure и GCP, — сказал он. — У нас есть прекрасная возможность выполнять как консалтинговые проекты, так и развёртывать наше ПО на этих инфраструктурах для наших клиентов». Он рассказал, что один из «очень крупных клиентов в сфере медицинского страхования» предпочитает не использовать публичное облако, «но его вполне устраивает возможность использовать частные инстансы в облаке и разворачивать там модели, разворачивать там наши программные стеки и добиваться роста. Поэтому мы, как правило, так и поступаем». По мнению The Register, это свидетельствует в пользу того, что IBM не собирается закупать ускорители в больших количествах или состязаться с гиперскейлерами в объёме капвложений, предпочитая брать вычислительные мощности в аренду.

23.10.2025 [15:49], Андрей Крупин

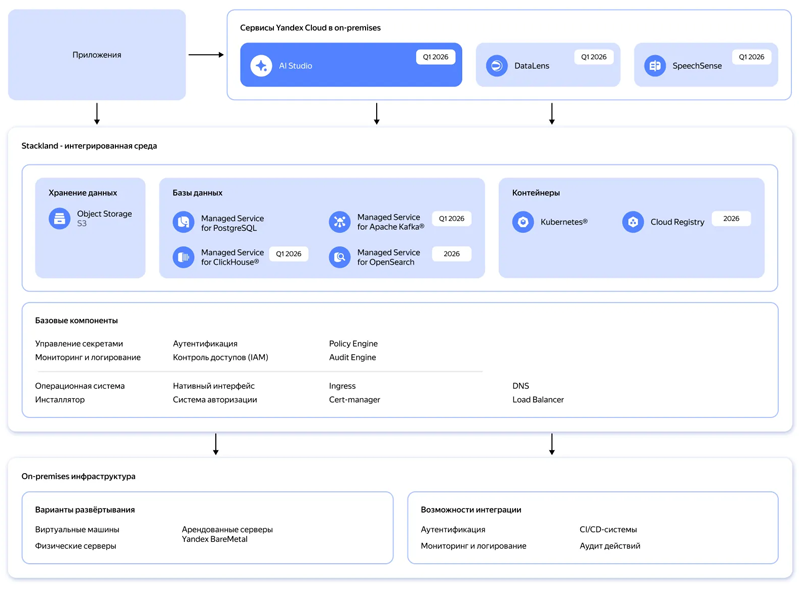

Yandex B2B Tech поможет компаниям быстро разворачивать инфраструктуру для ИИ-сервисов по модели On‑PremiseYandex B2B Tech (бизнес-группа «Яндекса», объединяющая технологии и инструменты компании для корпоративных пользователей, включая продукты Yandex Cloud и «Яндекс 360») сообщила о планах по запуску в первом квартале 2026 года нового инфраструктурного решения Yandex Cloud Stackland, с помощью которого организации смогут оперативно разворачивать инфраструктуру для управления ИИ‑нагрузками в закрытом контуре по модели on‑premise. Yandex Cloud Stackland предложит пользователям следующие компоненты для построения интегрированной ИИ-среды: платформу AI Studio для разработки ИИ-приложений и агентов, модуль речевой аналитики SpeechSense, BI-систему DataLens, контейнерный оркестратор, масштабируемое объектное S3-хранилище, управляемые СУБД PostgreSQL, ClickHouse, Kafka, а также векторные базы данных, которые распространены в RAG-решениях. В дополнение к этому будут представлены инструменты для обеспечения приложений доступом к графическим ускорителям и высокопроизводительным сетям, таким как InfiniBand, для задач распределённого инференса. Отдельное внимание будет уделено безопасности и защите обрабатываемых данных: Stackland получит встроенные средства IAM для гибкого разграничения доступов и инструменты для защищённого хранения паролей, токенов и сертификатов.

Архитектура Yandex Cloud Stackland (источник изображения: yandex.cloud/services/stackland) Stackland базируется на Kubernetes, что позволит компаниям применять привычные подходы и инструменты для управления микросервисными приложениями, а также управлять PaaS-сервисами Yandex Cloud через Kubernetes API. Ожидается, что интерес к Stackland проявят организации из сфер электронной коммерции, финтеха, ритейла и промышленного сектора, которые хотят использовать ИИ-решения на базе облачных технологий, но не могут сделать это из-за внутренних или регуляторных требований. Как передают «Ведомости», по оценке «Яндекса», в 2025 г. объём рынка контейнеризации составит 4–6 млрд руб., а к 2030 г. вырастет до 9–14 млрд руб. С новым решением компания планирует занять полоивину рынка инфраструктурного ПО для ИИ. Лицензирование Yandex Cloud Stackland будет производиться по количеству ядер CPU. Все инфраструктурные компоненты, в частности управляемые базы данных, будут включены в лицензию. Для отдельных сервисов, таких как AI Studio, DataLens и SpeechSense, нужно будет приобретать отдельные лицензии. |

|