Лента новостей

|

09.12.2025 [16:39], Руслан Авдеев

Великобритания и Норвегия защитят подводные кабели от недругов с помощью ИИ и автономных кораблейВласти Великобритании заявили о намерении усилить защиту подводных кабелей, использовав подводные автономные суда. Помимо этого, в организации «обороны» будут участвовать корабли ВМС и самолёты, сообщает The Register. Программа Министерства обороны Великобритании «Атлантический бастион» (Atlantic Bastion) связывается с якобы возросшей активностью иностранных судов, включая российский исследовательский корабль «Янтарь». По словам главы Министерства обороны Джона Хили (John Healey), тот занимался составлением карт подводной кабельной инфраструктуры Соединённого Королевства. В своём заявлении Хили подчеркнул, что «Атлантический бастион» — проект будущего ВМС Великобритании. Программа сочетает новейшие технологии автономных систем и ИИ с боевыми кораблями и самолётами мирового класса. Сообщается, что недавний аудит сил обороны Великобритании показал необходимость устранения уязвимостей на море. Отмечена и модернизация вооружённых сил противников, в ответ на которую формируется революционная подводная сеть, от Срединно-Атлантического хребта до Норвежского моря. Она будет «более автономной, более устойчивой, более смертоносной» — и что немаловажно, построенной именно британцами, говорит Хили. В её реализации примут участие американская Anduril и немецкая Helsing, специализирующиеся на автономных оборонных комплексах, а также британская BAE Systems. В мае британские военные опубликовали информацию о закупках на сумму £24 млн в рамках инициативы «Атлантическая сеть» — подрядчики будут владеть и управлять системами с небольшими экипажами, автономными или же дистанционно управляемыми. Они будут предоставлять Королевским ВМС акустические данные, подвергнутые анализу с помощью ИИ.

Источник изображения: Lincoln Holley/unsplash.com Великобритания чрезвычайно зависима от подводных кабелей. Недавний парламентский отчёт показал, что страна располагает 64 кабелями подобного типа. При этом ¾ трансатлантического трафика проходят всего по двум кабелям, посадочные станции для которых расположены в Бьюд (Bude, графство Корнуолл). По данным военных, хотя национальная связь «не подвергается непосредственной опасности», необходимо быть готовым к тому, что кабели могут оказаться под угрозой при тех или иных обстоятельствах. Как сообщает Datacenter Dynamics, Великобритания таже подписала с Норвегией соглашение о совместной защите подводных кабелей и иных объектов от ВМС недружественных государств. Предполагается, что в Северной Атлантике будут действовать 13 военных судов. Утверждается, что за последние пару лет активность зарубежных ВМС в районе британских территориальных вод выросла на 30 %. Новые суда будут патрулировать британские и норвежские территориальные воды, а также плавать вблизи Исландии и Гренландии. В сентябре сообщалось, что Великобритания поставит ВМС Норвегии не менее пяти новых кораблей общей стоимостью £10 млрд ($13 млрд). Сотрудничество предусматривает круглогодичное обучение британцев в Норвегии, приём на вооружение передовых норвежских систем, совместную разработку оружия и участие в совместных учениях. Также Великобритания присоединится к норвежской программе разработки «материнских» кораблей для беспилотной охоты на мины и подводных боевых систем. Великобритания и Норвегия возглавят внедрение НАТО подобных решений на Крайнем Севере. Летом 2025 года НАТО анонсировала программу Baltic Sentry по защите подводных кабелей на Балтике, в которой задействуют корабли, самолёты, беспилотники и пр.

09.12.2025 [15:45], Андрей Крупин

МТС построила новый модуль на 125 серверных стоек в своём ЦОД в Ленинградской областиМТС ввела в эксплуатацию четвёртый модуль в центре обработки данных в посёлке Фёдоровское Ленинградской области. Новый модуль ЦОД оснащён 125 серверными стойками и позволил довести общую ёмкость вычислительного комплекса до 500 стойко-мест. Модуль, как и весь дата-центр, будет задействован для размещения корпоративных систем МТС, а также облачных мощностей MWS Cloud. Первые два модуля центра обработки данных МТС в посёлке Фёдоровское были введены в эксплуатацию осенью 2020 года. Третий — осенью 2024 года. ЦОД имеет сертификат надёжности Tier III, общая мощность, подведённая к объекту, составляет 16 МВт. Особенностью дата-центра является система адиабатического охлаждения, что позволяет снизить годовой показатель PUE до 1,15.

09.12.2025 [15:33], Руслан Авдеев

SoftBank ведёт переговоры о покупке DigitalBridge, крупного инвестора в ЦОДЯпонская SoftBank Group ведёт переговоры о покупке частной инвестиционной компании, вкладывающей средства в цифровую инфраструктуры, в том числе в ЦОД — DigitalBridge Group. Потенциальный покупатель стремится воспользоваться всеми преимуществами, которые даёт бум на рынке цифровой инфраструктуры на фоне развития ИИ-проектов, сообщает Bloomberg. По данным источников, SoftBank предполагает приобретение котирующейся на нью-йоркской бирже компании для последующего преобразования её в частный бизнес. На фоне новостей, акции DigitalBridge, упавшие на 13 % с начала года до прошедшей пятницы, выросли на 45 %, продемонстрировав самый высокий дневной прирост в истории компании. Сделка может состояться в ближайшие недели. Сами компании от комментариев отказываются. Согласно данным на сайте DigitalBridge, на конец сентября компания управляла активами на сумму порядка $108 млрд. В портфолио инвестора входят операторы ЦОД AIMS, AtlasEdge, DataBank, Scala Data Centers, Switch, Vantage Data Centers и Yondr. По мнению экспертов, DigitalBridge рассматривает возможность продажи, но только по «правильной» цене и на «правильных» условиях.

Источник изображения: Kanchanara/unsplash.com Ранее SoftBank уже пыталась освоить рынок инвестиций в инфраструктуру и недвижимость, приобретя в 2017 году Fortress Investment Group более чем за $3 млрд. В итоге в 2024 году она активы группе, включающей суверенный фонд благосостояния Абу-Даби Mubadala Investment Co. и руководство Fortress. В январе SoftBank сообщила об участии совместно с OpenAI, Oracle и MGX в проекте Stargate стоимостью $500 млрд, предполагавшему строительство ИИ ЦОД в США. Хотя SoftBank обещала выделить $100 млрд «немедленно», реализация проекта идёт не так быстро, как планировалось, во многом из-за разногласий по поводу мест размещения дата-центров. В мае сообщалось, что SoftBank пыталась привлечь финансирование от внешних инвесторов, включая страховые компании, пенсионные и инвестиционные фонды. Тем не менее некоторые переговоры замедлились из-за волатильности рынка, неопределённости в торговой политике США и вопросов к финансовым оценкам ИИ-оборудования. В сентябре OpenAI, Oracle и SoftBank объявили о намерении построить пять новых площадок в Техасе, Нью-Мексико и Огайо с общей мощностью 7 ГВт, это сопоставимо с мощностью некоторых городов. Для высвобождения капитала SoftBank потребовалось перераспределение части средств. При этом руководство очень переживало из-за необходимости продать долю в NVIDIA за $5,8 млрд чтобы получить деньги для других ИИ-проектов. По данным Datacenter Dynamics, компания Vantage из портфолио DigitalBridge стоит за ЦОД для Stargate. Инвестор в альтернативные активы — компания 26North вела переговоры о покупке DigitalBridge в мае 2025 года. В ноябре текущего года DigitalBridge завершила формирование инвестиционного фонда DigitalBridge Partners III (DBP III) стоимостью $11,7 млрд для инвестиций в ЦОД, ВОЛС и инфраструктуру мобильной связи. UPD 12.12.2025: по данным Bloomberg, SoftBank также интересуется покупкой оператора ЦОД Switch. Владельцы оператора рассчитывают оценивают компанию приблизительно в $50 млрд с учётом долговых обязательств. Попутно они также рассматривают возможность IPO в начале 2026 года, рассчитывая на оценку в районе $60 млрд. Switch был приобретён DigitalBridge Group и IFM Investors за $11 млрд в конце 2022 года и покинул NYSE (тикер SWCH). Это одна из крупнейших сделок на рынке ЦОД.

09.12.2025 [13:05], Сергей Карасёв

Сандийские национальные лаборатории запустили суперкомпьютер Spectra с ускорителями NextSilicon Maverick-2Сандийские национальные лаборатории (SNL) Министерства энергетики США (DOE) объявили о создании суперкомпьютера Spectra с нестандартной архитектурой. В его основу положены изделия Maverick-2 — интеллектуальные вычислительные ускорители (Intelligent Compute Accelerator, ICA), разработанные компанией NextSilicon. Система Spectra спроектирована по программе Vanguard, цель которой заключается в исследовании потенциала передовых компьютерных архитектур применительно к проектам в сфере национальной безопасности. Первой платформой Vanguard стал комплекс Astra, запущенный в 2018 году: на момент анонса это был самый быстрый в мире суперкомпьютер на базе Arm-чипов. Среди других примечательных машин SNL можно отметить Kingfisher на ИИ-чипах Cerebras WSE-3, а также две нейроморфные системы: на базе SpiNNaker2 и на базе Loihi II (Hala Point). Spectra объединяет 64 вычислительных узла, каждый из которых оснащён двумя двухкристальными ОАМ-модулями Maverick-2: эти изделия содержат 64 управляющих ядра RISC-V, 192 Гбайт памяти HBM3E и два интерфейса 100GbE. В общей сложности задействованы 128 экземпляров Maverick-2. Особенностью ускорителей является возможность динамической реконфигурации оборудования на основе данных, получаемых непосредственно во время выполнения задачи. Такой подход позволяет устранять узкие места, присущие традиционным CPU и GPU. Подробнее об архитектуре Maverick-2 можно узнать в нашем материале. За монтаж суперкомпьютера Spectra отвечала компания Penguin Solutions. Она разработала специализированный сервер, поддерживающий до четырёх ОАМ-модулей Maverick-2, хотя в текущей конфигурации используются два. Применены передовая СЖО с отрицательным давлением Chilldyne и платформа Penguin Tundra, что обеспечивает оптимизацию управления температурой и распределения питания, а также возможности масштабирования.

09.12.2025 [11:48], Руслан Авдеев

США разрешили продавать ИИ-ускорители NVIDIA H200 в Китай, но с пошлиной 25 %Президент США Дональд Трамп (Donald Trump) разрешил NVIDIA поставлять ИИ-ускорители H200 в Китай, но в обмен на дополнительный сбор в пользу США в размере 25 % от их стоимости. Это потенциально позволит NVIDIA вернуть многомиллиардный бизнес в КНР — одном из ключевых рынков для продукции компании в мире, сообщает Bloomberg. Трамп сообщил, что уже уведомил руководство КНР об изменениях и что новость была воспринята положительно. Поставки будут осуществляться только «одобренным клиентам», право на экспорт некоторых своих продуктов также получат AMD и Intel. После заявления Трампа акции NVIDIA и AMD выросли приблизительно на 2 % в конце торгов. Intel, вероятно, не особенно выиграет от изменений в обозримом будущем, поэтому её ценные бумаги подорожали менее чем на 1 %. При этом акции китайских SMIC и Hua Hong Semiconductor упали на торгах в Гонконге более чем на 2 %. Речь идёт о победе NVIDIA в стремлении компании убедить правительство США в необходимости ослабить экспортный контроль, мешавший компании продавать в Китай её продукцию. Глава компании Дженсен Хуанг (Jensen Huang) неоднократно говорил, что ограничения только способствуют развитию китайского производства ИИ-полупроводников. По мнению некоторых экспертов, решение рискует подорвать лидерство США в сфере ИИ. Впрочем, NVIDIA пока не уверена, готовы ли в КНР покупать H200. В августе NVIDIA получила разрешение на продажу чипов H20, а AMD — MI308, разработанных с учётом экспортных ограничений, в обмен на выплату США 15 % от продаж в Китае. Впрочем, эта схема так и не заработала. Решение Трампа вызвало критику со стороны части сенаторов, обвинивших президента в предоставлении Пекину инструментов для создания ИИ нового поколения. Формально H200 минимум на поколение опережает все китайские ИИ-чипы Huawei, Cambricon Technologies, Moore Threads и пр. Последняя после успешного IPO на днях объявила о своих глобальных амбициях. Так или иначе, Пекин, желая снизить зависимость от американских технологий, ранее решительно препятствовал внедрению в ЦОД чипов NVIDIA, особенно государственными структурами. Сам Трамп подчёркивает, что защищает национальную безопасность, создаст рабочие места в Америке и сохранит лидерство в сфере ИИ. В октябре Трамп допускал поставки в Китай «урезанных» вариантов Blackwell, но идея так и не получила развития. При этом Хуанг отмечал, что потенциальный рынок для его компании в Китае оценивается в $50 млрд. Нынешние послабления Blackwell и Rubin не касаются. По данным источников, ранее NVIDIA пыталась продавить продажи в Китай чипов B30 или B40, т.ч. экспорт H200 является компромиссным вариантом. В Министерстве торговли сообщают, что оплата американскому правительству будет осуществляться в виде пошлины в размере 25 %, которую будут взимать при поставке чипов с Тайваня в США, только после этого их будут отправлять в Китай. H20 и H200 принадлежат к одному поколению устаревающих ускорителей Hopper. Тем не менее, H200 значительно производительнее H20 и, по некоторым данным, их производительность почти на порядок выше ранее разрешённого для экспорта в КНР максимума производительности чипов. Так или иначе, ранее власти КНР фактически заблокировали импорт H20 в страну, порекомендовав китайским структурам полагаться на ускорители местных компаний и фактически остановив выход на огромный рынок продукции NVIDIA и AMD. На прошлой неделе в Конгрессе заблокировали инициативу, которая ограничила бы продажу в Китай и некоторые другие страны передовых ИИ-чипов. Закон GAIN AI Act обязал бы производителей, включая NVIDIA и AMD, предоставлять преимущественное право на покупку чипов покупателям из США. Американские законодатели уже работают над т.н. SAFE Act, новый закон должен систематизировать действующие в США ограничения на экспорт полупроводников на китайский рынок.

09.12.2025 [11:17], Сергей Карасёв

«Карманный» NAS Youyeetoo NestDisk для четырёх М.2 SSD оснащён парой портов 2.5GbEКомпания Youyeetoo выпустила компактное сетевое хранилище NestDisk на аппаратной платформе Intel Alder Lake-N. Устройство, заключенное в корпус с размерами 146 × 97,5 × 32 мм, может использоваться для создания частного облака в офисных или домашних условиях. Базовая конфигурация предусматривает использование чипа Intel Processor N150 (4C/4T; до 3,6 ГГц; 6 Вт) с графическим ускорителем Intel UHD Graphics. В наиболее мощном варианте применяется процессор Core 3 N355 (8C/8T; до 3,9 ГГц; 15 Вт). Объём оперативной памяти LPDDR5 может составлять 6, 12 или 16 Гбайт. В оснащение входит флеш-модуль eMMC вместимостью 64 Гбайт. Внутри есть место для четырёх NVMe SSD формата M.2 2280 с интерфейсом PCIe 3.0 x2 (один из слотов также поддерживает установку SATA-накопителя) суммарной вместимостью до 16 Тбайт. Скорость передачи данных достигает 1969 Мбайт/с. Допускается формирование массивов RAID 0/1/5/6. Устройство располагает двумя сетевыми портами 2.5GbE RJ45 на базе контроллера Intel I226V, тремя портами USB 3.1 Type-A и аудиогнездом на 3,5 мм. Возможен вывод изображения одновременно на три дисплея через два интерфейса HDMI 2.0 и разъём USB 3.2 Gen2 Type-C (DisplayPort). Присутствуют адаптеры Wi-Fi 6 и Bluetooth 5.2. Питание подаётся через дополнительный коннектор USB Type-C от сетевого блока мощностью 65 Вт. Для охлаждения задействован вентилятор диаметром 30 мм с низким уровнем шума. NAS использует программную платформу OpenMediaVault на ядре Linux. Но при необходимости можно загрузить TrueNAS, Unraid, Ubuntu и даже Windows. Цена начинается со €170 в варианте с чипом Intel Processor N150 и 12 Гбайт ОЗУ.

09.12.2025 [11:15], Сергей Карасёв

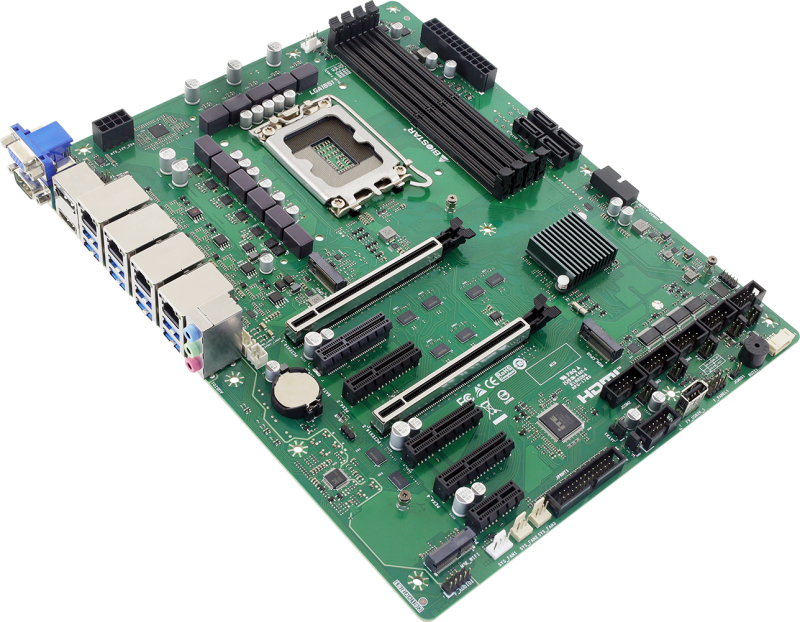

Biostar выпустила материнскую плату BIW88-AHS для индустриальных ИИ-систем на базе Intel Arrow LakeКомпания Biostar анонсировала материнскую плату BIW88-AHS на базе чипсета Intel W880, предназначенную для построения различных индустриальных систем с ИИ-функциями. Это могут быть платформы автоматизации, оборудование промышленного интернета вещей (AIoT), комплексы управления процессами и мониторинга и пр. Новинка выполнена на наборе логики Intel W880 с возможностью установки чипа Intel Core Ultra 200 (Arrow Lake) в исполнении LGA1851. Доступны четыре слота для модулей оперативной памяти DDR5-5600 U-DIMM (ECC / Non-ECC) суммарным объёмом до 192 Гбайт. Плата располагает двумя слотами M.2 M-Key 2242/2280 для NVMe SSD с интерфейсом PCIe 5.0 x4 и PCIe 4.0 x4, а также четырьмя портами SATA-3 для накопителей. Есть коннектор M.2 E-Key 2230 (PCIe 4.0 x1 + USB 2.0) для адаптера Wi-Fi/Bluetooth, два слота PCIe 5.0 x16 (в конфигурации x16+NA или x8+x8), четыре слота PCIe 4.0 x4 и один слот PCIe 4.0 x1. В оснащения входят сетевые контроллеры Intel I226-V (три порта 2.5GbE) и I226-LM с поддержкой Intel vPro (один порт 2.5GbE), звуковой кодек Realtek ALC897, а также чип ввода/вывода IT8786E-I. Решение выполнено в форм-факторе ATX с размерами 305 × 244 мм. Интерфейсный блок содержит разъёмы HDMI 2.0 (4096 × 2160@60), DisplayPort++ 1.4 (4096 × 2160@60) и D-Sub (1920 × 1200@60 Гц), четыре гнезда RJ45 для сетевых кабелей, восемь портов USB 3.1 Type-A, последовательный порт RS-232/422/485, а также набор аудиогнёзд. Через разъёмы на плате можно задействовать порты USB 2.0 и дополнительные последовательные порты. Диапазон рабочих температур простирается от 0 до +60 °C. Гарантирована совместимость с Windows 11 и Ubuntu 24.04.

09.12.2025 [10:10], Владимир Мироненко

YADRO начала приём заказов на первую отечественную All-NVMe СХД TATLIN.AFAКомпания YADRO (входит в «ИКС Холдинг») объявила о старте приёма заказов на серийное производство первой в России All-NVMe СХД TATLIN.AFA, созданной для решения задач крупных корпоративных клиентов с максимальными требованиями к скорости обработки больших массивов данных. Новое решение YADRO уже внесено в Единый реестр российской радиоэлектронной продукции Минпромторга. Флагманская СХД TATLIN.AFA компании YADRO отличается рекордной производительностью и максимальной отказоустойчивостью, позволяя решать наиболее сложные задачи корпоративного уровня и обеспечивая работу с высоконагруженными критически важными приложениями, требующими непрерывной доступности и мгновенного отклика. Система поддерживает хранение и обработку сотен терабайт аналитических данных, а также подходит для задач машинного обучения и ИИ. Благодаря высокой вычислительной производительности СХД уверенно справляется с пиковыми рабочими нагрузками, обеспечивая до 2 млн IOPS и пропускную способность до 50 Гбайт/с. В основу решения положена модульная платформа YADRO TATLIN.X, обеспечивающая гибкое масштабирование, объединяя два контроллера хранения и 24 NVMe-накопителя в 2U форм-факторе. Собственная аппаратная платформа YADRO гарантирует максимальный уровень надежности и отказоустойчивости. В ней сочетаются проверенные временем технологии защиты, такие как режим работы контроллеров Symmetric Active-Active, в TATLIN.AFA с новыми решениями — дублированием аккумуляторных батарей, резервированием системных накопителей в контроллерах и поддержкой адаптеров ввода-вывода в форм-факторе OCP3. Программная часть TATLIN.AFA основана на TATLIN.OS, получившей обновление специально для нового поколения СХД. В частности, обновлённая версия T-RAID поддерживает схемы защиты до 14+2, обеспечивая высокую полезную ёмкость и надёжную работу. Егор Литвинов, директор продуктового направления TATLIN YADRO отметил, что TATLIN.AFA выводит отечественные решения в области СХД на принципиально новый уровень. Отвечая самым строгим требованиям сегодняшнего дня, система закладывает основу для масштабируемого развития наиболее требовательной ИТ-инфраструктуры в стратегически важных отраслях. Он добавил, что после запуска серийного производства компания будет последовательно развивать программные возможности флагманской СХД, чтобы максимально реализовать её преимущества для корпоративных заказчиков. Согласно утверждённой программе дальнейшего развития TATLIN.AFA, компания планирует расширение функциональности СХД, включая внедрение технологии компрессии данных, увеличение ёмкости хранения за счет добавления интеллектуальных дисковых модулей расширения с NVMe-накопителями, поддержку нового высокоскоростного протокола доступа NVMe/RoCE, а также реализацию асинхронной репликации внутри линейки систем TATLIN под управлением TATLIN.OS. Ознакомиться с техническими характеристиками новой СХД можно на официальном сайте YADRO. Реклама | ООО «КНС ГРУПП» ИНН 7701411241 erid: F7NfYUJCUneTTUCHVvto

09.12.2025 [09:15], Руслан Авдеев

Базовая станция Huawei RuralCow поможет быстро и недорого обеспечить мобильной связью разбросанные по Африке деревушкиТелеком-компания MTN Nigeria и Huawei завершили первое в мире коммерческое развёртывание RuralCow — универсальных мобильных базовых станций для обеспечения связью удалённых районов. Платформа RuralCow, дополняющая решения RuralLink и RuralStar, помогает сократить цифровое неравенство между городскими и сельскими жителями и удовлетворить «скрытый» спрос на мобильную связь в сельской местности. Кроме того, технология должна придать важный импульс технологическому развитию Нигерии. Нигерия — это самая населённая страна Африки, причём половина населения (≈105 млн человек) живёт в сельской местности, где установка базовых станций обычно значительно дороже, чем в городах из-за отсутствия надёжных источников электроэнергии и опорной сети ВОЛС. Более того, большинство деревень с населением менее 3 тыс. человек, по данным Huawei, удалены друг от друга, а средний доход на пользователя (ARPU) весьма низок, из-за чего инвестиции в БС окупаются долго, что тормозит их массовое развёртывание.

Источник изображения: Namnso Ukpanah/unsplash.com Именно для таких случаев и создано решение RuralCow, которое объединяет baseband-модуль, радиоблок и прочее оборудование, охватывающие сразу несколько диапазонов частот и технологий радиосвязи. В сравнении с традиционными БС общее энергопотребление сокращается приблизительно на 85 %, а количество единиц оборудования — на 70 %. Для установки не требуется привлекать тяжёлую технику. Станция работает без использования традиционных оптоволоконной или микроволновой связи и может передавать данные на расстояние до 30 км вне зоны прямой видимости. Умные функции удалённого управления и обслуживания сводят количество выездов на объект к минимуму. Для деревень с населением 1–3 тыс. человек период окупаемости инвестиций сокращается с 5–10 лет до приблизительно трёх лет. По словам Huawei, RuralCow является сверхпростым, экологичным и экономичным решением для обеспечения покрытия мобильной связью сельской местности. Компания продолжит миссию Connecting the Unconnected («Подключение неподключенных») для создания инклюзивного цифрового мира.

Источник изображения: Huawei Работа над цифровизацией африканских стран ведут и другие игроки. Так, Microsoft и Tarana Wireless предложили подключать африканские деревни к быстрому беспроводному интернету посредством ngFWA. Беспроводные системы Terragraph успешно работают в нескольких странах, но для Африки, по-видимому, они оказались дороги. Liquidstar пошла другим путём, предложив комплексное решение — микро-ЦОД Waypoint, способный заряжать аккумуляторы, а также раздавать чистую воду и интернет.

09.12.2025 [00:17], Владимир Мироненко

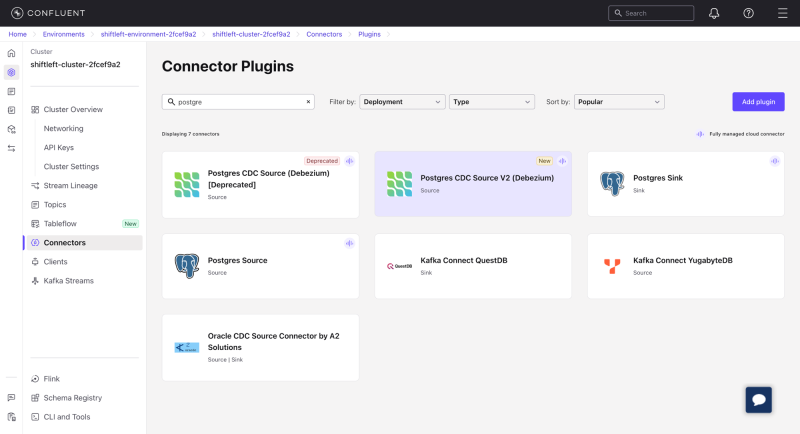

IBM купила Confluent за $11 млрд, чтобы побольше заработать на ИИIBM объявила о приобретении поставщика инфраструктуры для обработки потоковых данных Confluent. Согласно соглашению, IBM приобретает все выпущенные и находящиеся в обращении обыкновенные акции Confluent по цене $31/ед., что на 25,5 % превышает текущую цену акций в $23,14 и соответствует общей стоимости предприятия в $11 млрд. Оплата будет произведена IBM за счёт имеющихся денежных средств. Покупка Confluent станет крупнейшей сделкой для IBM за последнее время, поскольку компания переориентирует свой бизнес на ИИ, пишет The Wall Street Journal. После объявления о сделке акции Confluent взлетели более чем на 25 % на премаркете, в то время как акции IBM немного упали в цене. В июне 2021 года Confluent вышла на биржу, получив в ходе первичного размещения $828 млн при оценке рыночной стоимости в $4,5 млрд. В настоящее время рыночная капитализация Confluent составляет $8,09 млрд. Confluent была основана в 2014 году тремя бывшими инженерами LinkedIn, разработавшими ПО Apache Kafka. В 2015 году компания запустила самоуправляемую платформу Confluent, а в 2020 году — полностью управляемое SaaS-решение Confluent Cloud. У компании насчитывается более 6500 клиентов в основных отраслях промышленности. Более 40 % из них входят в список Fortune 500. Confluent сотрудничает в технологической отрасли с такими компаниями, как Anthropic, AWS, GCP, Microsoft, Snowflake и т.д. Сделка уже одобрена советом директоров IBM, а также советом директоров и независимым специальным комитетом Confluent. Теперь дело за одобрением акционерами Confluent и получением разрешений регулирующих органов. IBM сообщила, что заключила соглашение с крупнейшими акционерами и инвесторами Confluent, которым в совокупности принадлежит около 62 % голосующих акций, находящихся в обращении. Согласно этому соглашению, они будут голосовать за одобрение сделки только с IBM. Как ожидается, с учётом необходимых процедур, сделка будет закрыта к середине 2026 года.

Источник изображения: Confluent Confluent является разработчиком корпоративной open source платформы для работы с потоками данных в режиме реального времени. IBM отметила, что Confluent «превосходно» справляется с подготовкой данных для ИИ, поддерживая их чистоту и связность и устраняя разрозненность, присущую агентному ИИ. За последние четыре года общий объём доступного рынка Confluent (TAM) удвоился с $50 до $100 млрд. Возможности Confluent в сочетании с ПО IBM для ИИ-инфраструктуры и решениями IBM для автоматизации обеспечат более эффективную работу компаний в сфере ИИ. Благодаря сделке IBM получит мощный механизм и платформу для стриминговой обработки данных в режиме реального времени, которые она сможет интегрировать в свои решения для ИИ-конвейеров, в том числе в агентов watsonx, отметил ресурс Blocks & Files. В мае 2025 года IBM приобрела примерно за $3 млрд DataStax, разработчика AstraDB — облачной NoSQL-СУБД на базе Apache Cassandra, интеграция технологий которой в IBM watsonx поможет управлять и упрощать доступ к огромным объёмам данных, которые необходимы для генеративного ИИ. В свою очередь, Salesforce в мае приобрела компанию Informatica, занимающуюся инфраструктурой данных, примерно за $8 млрд, а Databricks в октябре анонсировала продукт для стриминговой работы с данными, что может ограничить рынок Confluent, пишет Blocks & Files. |

|