Материалы по тегу:

|

07.06.2026 [10:31], Руслан Авдеев

МИФИ и «Росатом» разработают малые ядерные реакторы для дата-центровВ России ведутся разработки сверхмалых ядерных реакторов для ЦОД. В проекте участвуют Национальный исследовательский ядерный университет МИФИ, «Росатом» и консорциум «Большой МИФИ», сообщают «Ведомости». По словам президента «Большого МИФИ» Валерия Романюка, существует подпрограмма создания сверхмалых реакторов для ЦОД. Речь идёт об объектах мощностью от 5 до 50 МВт. Отмечается, что нагрузка на оборудование ЦОД растёт во всём мире, в связи с чем создаётся новое специализированное подразделение. Оно займётся оптимизацией работы ЦОД с применением систем искусственного интеллекта и развитием сетевой инфраструктуры. Консорциум «Большой МИФИ» объединяет как сам «ядерный университет», так и крупные компании, желающие принять участие в работах над ядерными, квантовыми и IT-проектами. В последние дни стало известно и о других проектах, связанных с индустрией ЦОД. Так, видеохостинг Rutube, входящий в «Газпром-медиа», должен обзавестись собственным ЦОД — строительство начнётся уже в конце 2026 года в Ленинградской области. ВТБ рассчитывает выделить средства на строительство неподалёку от Донецка дата-центра на 500 стоек. Его ввод в эксплуатацию запланирован на 2030 год, а эксплуатировать объект будет телеком-компания «АйСи Групп».

Источник изображения: Hal Gatewood/unsplash.com Появились новые данные и о возможном международном сотрудничестве. Так, на фоне энергодефицита в России белорусские мощности готовы обеспечить электроэнергией российские дата-центры. Не исключался даже перенос на территорию Беларуси целых кластеров ЦОД. В конце 2025 года ВТБ прогнозировал, что к 2030 году энергопотребление дата-центров в России вырастет вдвое.

07.06.2026 [10:23], Сергей Карасёв

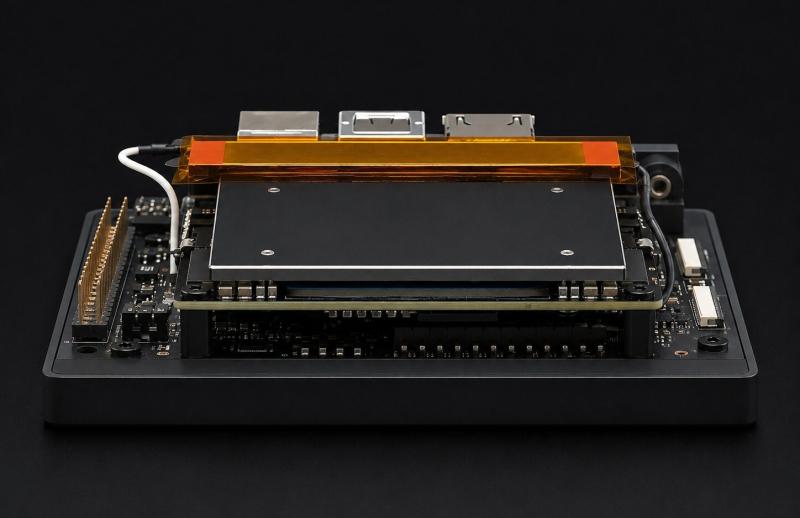

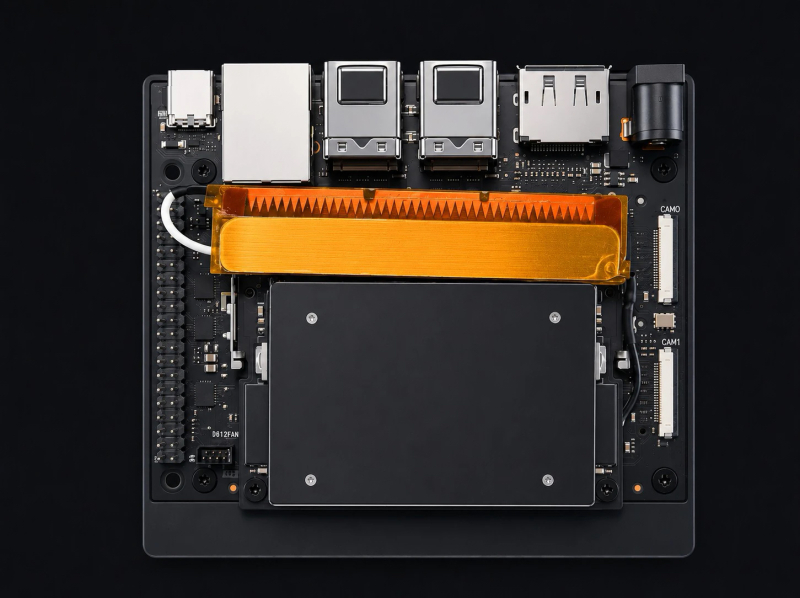

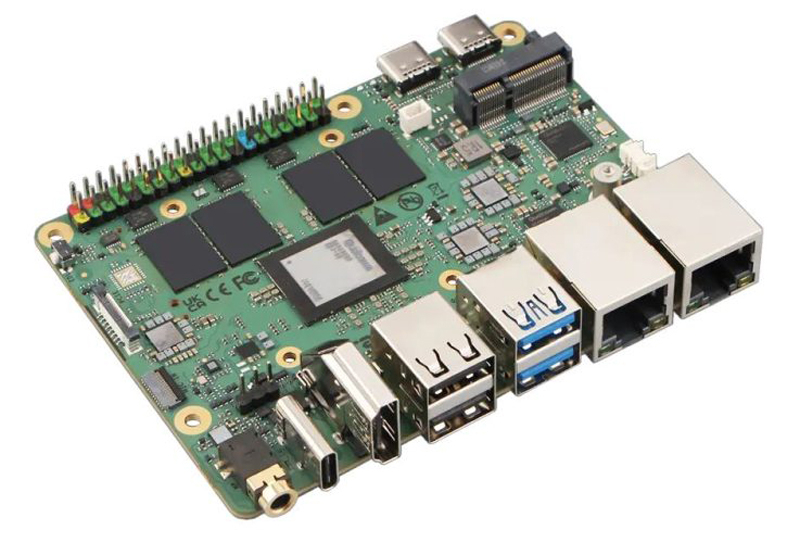

Одноплатный компьютер Radxa Dragon Q8B получил чип Snapdragon 8cx Gen3 и два порта 2.5GbEКомпания Radxa представила одноплатный компьютер Dragon Q8B, предназначенный для построения периферийных устройств с поддержкой ИИ. Это могут быть маломощные edge-серверы, робототехнические платформы, IoT-оборудование, дроны, системы видеонаблюдения и пр. В основу новинки положен процессор Qualcomm Snapdragon 8cx Gen3 с восемью ядрами в конфигурации 4 × Kryo Prime с частотой до 3 ГГц и 4 × Kryo Gold с частотой до 2,4 ГГц. В состав изделия входят графический ускоритель Adreno 690 с поддержкой DirectX 12 и нейропроцессорный блок Qualcomm AI Engine с ИИ-производительностью более 29 TOPS. Объём оперативной памяти LPDDR4Х-4266 может достигать 32 Гбайт. Поддерживается декодирование видеоматериалов в формате до 4K@120 и кодирование 4K@60.

Источник изображения: Radxa Одноплатный компьютер располагает слотами M.2 Key-M 2280 (PCIe 3.0 x4) и M.2 Key-M 2280 (PCIe 3.0 x2) для SSD, коннектором M.2 Key-E 2230 для комбинированного адаптера Wi-Fi/Bluetooth, слотом для карты microSD и разъёмом для подключения флеш-модуля UFS 3.1. Есть два сетевых порта 2.5GbE с гнёздами RJ45, по два порта USB 3.1 Type-C (DisplayPort 1.4b Alt Mode), USB 3.1 Type-A и USB 2.0 Type-A, интерфейс HDMI 2.1, 3,5-мм аудиогнездо, порт USB Type-C для подачи питания. Предусмотрены также 40-контактная колодка GPIO (с поддержкой UART, I2C, SPI и пр.), 16-контактный FPC-коннектор PCIe 3.0 и разъем для подключения вентилятора охлаждения. Изделие имеет размеры 100 × 75 мм. Заявлена совместимость с программными платформами Radxa OS, Windows, Ubuntu, Armbian, Arch Linux и Nix OS.

07.06.2026 [10:22], Руслан Авдеев

У Rutube появится первый собственный ЦОД стоимостью до 5–7 млрд рублейВходящий в «Газпром-медиа» (ГПМ) видеохостинг Rutube до конца 2026 года начнёт строить первый собственный ЦОД. Работы будут вестись в Ленинградской области, сообщают «Ведомости». Планируемый показатель PUE должен составить не более 1,3. По данным представителя ГПМ, ввод в эксплуатацию запланирован на 2028 год, «вводная мощность» ЦОД составит от 3 МВт, на первом этапе будет использоваться более 160 стоек и 2 тыс. серверов. При этом ожидается использование «импортозамещённого» серверного оборудования. По расчётам iKS-Consulting, сам объект на 3 МВт обойдётся в $20–$30 млн, причём стоимость серверов и оборудования может оказаться в 10 раз выше стоимости самого объекта. По словам экспертов, подходящие аппаратные решения есть у российских вендоров YADRO, «Аквариус», Delta Computers и др., а для работы с ИИ могут применяться ускорители NVIDIA или китайские чипы — на первом этапе мощности в 3 МВт для таких задач, вероятно, будет достаточно. Совокупная стоимость проекта, по некоторым оценкам, может составить 5–7 млрд руб. Предполагается, что новый ЦОД поможет расширить вычислительные мощности Rutube для хранения и обработки видео, а также развивать новые ИИ-направления и работать с инструментами на основе машинного обучения. По имеющимся данным, в настоящее время инфраструктура платформы размещена в арендованных или партнёрских ЦОД, поэтому появление собственного дата-центра в конечном итоге может помочь сэкономить средства и ускорить развитие сервиса.

Источник изображения: Acton Crawford/unspalsh.com Новый ЦОД может стать ключевым узлом CDN для всего Северо-Западного федерального округа. Впрочем, полного отказа от сторонних площадок в обозримой перспективе ожидать не приходится. Даже крупнейшие цифровые сервисы часто обращаются к смешанной модели, что позволяет быстро резервировать мощности, масштабировать инфраструктуру и запускать новые решения.

07.06.2026 [10:09], Владимир Мироненко

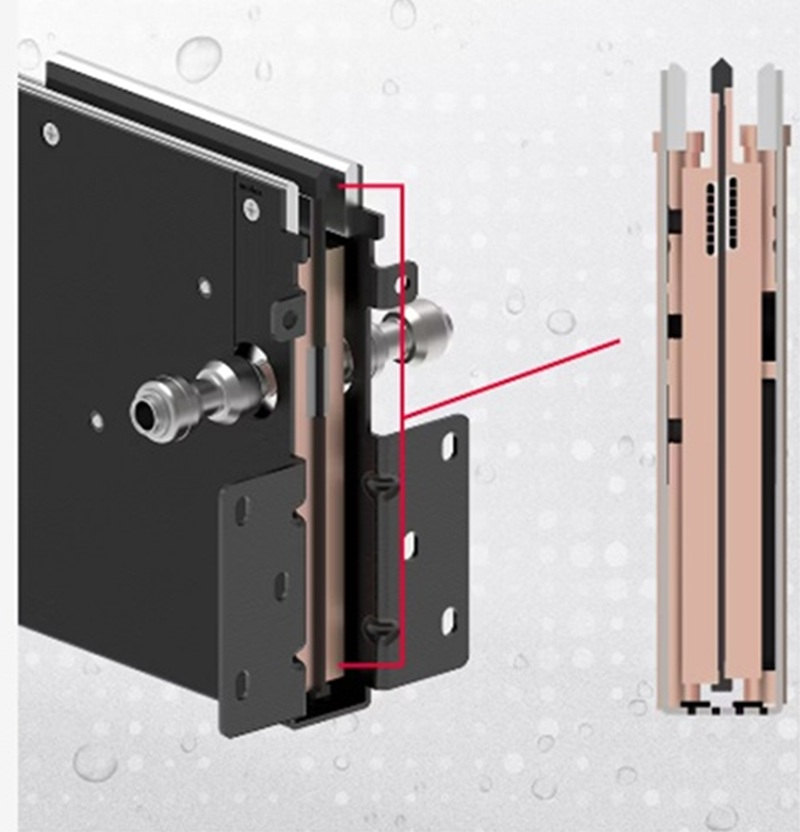

Molex представила многоканальную шину с жидкостным охлаждением для ИИ ЦОДКомпания Molex представила многоканальную шину с жидкостным охлаждением, предназначенную для использования в ИИ ЦОД. Как сообщает компания, предложенная технология объединяет распределение электроэнергии и жидкостное охлаждение в единый инфраструктурный компонент, предназначенный для поддержки ИИ-систем следующего поколения. Molex отметила, что с ростом интенсивности ИИ-нагрузок требования к мощности стоек приближаются к порогу в 1 МВт, в связи с чем традиционная инфраструктура с воздушным охлаждением достигла физического предела. Компания попыталась решить эту проблему, распространив жидкостное охлаждение на уровень распределения питания, обеспечив поддержку силы тока до 15 тыс. А и планируя в будущем достичь 25 тыс. А.

Источник изображения: Molex Вместо одного канала, используемого в традиционной конструкции с жидкостным охлаждением, Molex предложила архитектуру с семью отдельными каналами для охлаждающей жидкости. Многоканальная структура призвана уменьшить количество зон перегрева, а также обеспечить более равномерное и эффективное отведение тепла и более стабильную работу электрооборудования при высоких токах. По данным моделирования Molex, эффективность охлаждения повышается до 20 % по сравнению с одноканальной конструкцией. При этом растёт показатель тепловой эффективности — до 15 °C T-Rise при токе 15 тыс. А. Возможность максимизировать отведение тепла при тех же габаритах позволяет архитекторам ЦОД масштабировать мощность без ущерба для ценного пространства в стойке, отметила компания. Шины могут быть сконфигурированы по длине, глубине, а также по положению входного и выходного отверстий для жидкости. Эта гибкость в сочетании со стандартным интерфейсом plug-and-play обеспечивает плавный переход к жидкостному охлаждению без необходимости перепроектирования инфраструктуры стойки. Благодаря совместимости габаритов с механическими стандартами ORV3 и HPR упрощается интеграция в стоечные архитектуры, которые уже разрабатываются с учётом всё более высоких токовых нагрузок и более высокой тепловой плотности. Совместимость с диэлектрическими и недиэлектрическими жидкостями гарантирует беспрепятственную интеграцию технологии в различные существующие контуры охлаждения объектов. Развёртывание ИИ-инфраструктуры изменило роль оборудования распределения питания. Ускорители и высокоскоростная память повышают плотность размещения оборудования в стойках, в то время как прямое охлаждение чипов уже вошло в состав основных высокопроизводительных систем. Проводники, разъёмы и шины, передающие питание по стойке, теперь подвергаются тому же тепловому и механическому воздействию, что и вычислительный слой, который они питают, отметил ресурс IN Electronics. Распределение более высокого напряжения предлагает один из способов снижения нагрузки на медь и ограничения потерь при преобразовании. Работа Infineon с экосистемой стоек NVIDIA на 800 В показывает, как архитектуры на уровне стойки отходят от постепенных изменений в системе питания в сторону более масштабной электрической модернизации. Разработка Molex решает ту же проблему масштаба стойки со стороны проводников и охлаждения. Жидкостно-охлаждаемые шины не устранят необходимость в эффективных преобразовательных каскадах или надёжной защите, но они решают проблему обеспечения температурного режима для стоек с высокими токами. По мере повышения силы тока, силовая магистраль становится одновременно и электрическим каналом, и тепловой структурой, а её конструкция все больше влияет на плотность размещения оборудования в стойках, надёжность, удобство обслуживания и циклы модернизации.

07.06.2026 [10:06], Сергей Карасёв

MediaTek продемонстрировала оптический интерконнект на основе MicroLEDКомпания MediaTek показала оптический интерконнект нового поколения, построенный на основе микроскопических светодиодов (MicroLED). Решение ориентировано на дата-центры для ресурсоёмких нагрузок ИИ с высокой интенсивностью обмена информацией. MediaTek отмечает, что в современных ЦОД при построении сетей разработчики вынуждены идти на компромисс между дальностью действия, энергопотреблением и надёжностью. В частности, традиционные медные соединения обеспечивают высокую энергоэффективность, однако имеют ограниченную длину (обычно менее двух метров). В свою очередь, оптические подключения на базе лазеров предлагают значительную дальность действия, но потребляют гораздо больше энергии и подвержены сбоям. Новая конструкция активных кабелей MicroLED, как утверждается, позволяет устранить перечисленные недостатки. Вместо использования каналов с высокой пропускной способностью, как в случае стандартного оптического интерконнекта, технология предполагает разделение потока данных на сотни параллельных линий с меньшей скоростью передачи информации. В результате достигаются высокая плотность полосы пропускания, небольшие задержки и улучшенная энергоэффективность. В ходе мероприятия Computex 2026 компания MediaTek продемонстрировала оптические компоненты на основе MicroLED в виде СРО-изделий (Co-Packaged Optics) со скоростью передачи данных до 400 Гбит/с на одно волокно. Отмечается, что у этих решений энергопотребление на 50 % ниже, чем у обычных активных оптических кабелей на базе VCSEL (поверхностно-излучающий лазер с вертикальным резонатором). Кроме того, «стараниями» NVIDIA на рынке лазеров для оптических сетей наблюдается дефицит. MicroLED-интерконнект разрабатывается в партнёрстве с подразделением Microsoft Research в рамках проекта MOSAIC. В перспективе MediaTek намерена создать изделия с пропускной способностью 800 Гбит/с, 1,6 Тбит/с и 3,2 Тбит/с. Технология предусматривает интеграцию излучателей MicroLED непосредственно в КМОП-трансиверы. При этом заявлено сохранение совместимости с существующей инфраструктурой ЦОД.

06.06.2026 [21:50], Владимир Мироненко

Google будет выплачивать SpaceX ежемесячно $920 млн за аренду чипов NVIDIAGoogle заключила сделку с SpaceX по поводу аренды вычислительных мощностей ЦОД xAI, в рамках которой будет ежемесячно выплачивать $920 млн в период с октября 2026 года по июнь 2029 года, сообщил ресурс The Wall Street Journal. Согласно заявлению, поданному SpaceX в Комиссию по ценным бумагам и биржам США (SEC), её контрактом с Google предусмотрен доступ к 110 тыс. ускорителей NVIDIA и другим компонентам. Стоимость услуги — примерно $11 млрд в год до июня 2029 года. Если SpaceX не предоставит к 30 сентября 2026 года зарезервированные мощности, Google может расторгнуть договор после месячного льготного периода или принять предложение о любом доступном оборудовании по пропорционально сниженной цене. Также любая из сторон может расторгнуть соглашение, начиная со следующего года, уведомив об этом за 90 дней. «Это краткосрочное, своевременное соглашение, призванное обеспечить нам промежуточные мощности для удовлетворения растущего спроса клиентов на нашу агентскую платформу Gemini Enterprise, который оказался даже выше, чем мы ожидали», — заявил представитель Google Cloud. Google была одним из первых инвесторов SpaceX. Исполнительный директор Google Дональд Харрисон (Donald Harrison) входит в совет директоров SpaceX. Эксперты отмечают довольно высокую стоимость аренды и даже подозревают Google в том, что сделка призвана увеличить стоимость акций во время IPO SpaceX, поскольку Google принадлежит довольно значительная доля в SpaceX. Ранее компании обсуждали возможность сотрудничества по размещению ЦОД в космосе, пишет The Wall Street Journal. Google планирует запустить собственные орбитальные ЦОД к 2027 году в рамках проекта Project Suncatcher. Для создания этих спутников компания сотрудничает с Planet Labs. Как отметил ресурс TNW, сделка примечательна тем, что у Google есть собственные, двольно значительные вычислительные мощности. По некоторым оценкам, она является крупнейшим в мире владельцем вычислительных мощностей для ИИ, во многом благодаря своим ИИ-ускорителям TPU. Компания направит более $180 млрд на капитальные затраты в этом году и ожидает, что эта цифра «значительно увеличится» в 2027 году. Alphabet на этой неделе объявила о продаже акций на $85 млрд для финансирования этих расходов. Сделка с Alphabet по структуре похожа на соглашение, объявленное SpaceX и Anthropic в конце мая. Им предусмотрена выплата Anthropic $1,25 млрд в месяц до 2029 года за вычислительные мощности в ЦОД Colossus и Colossus II в Мемфисе (Memphis), причём точно так же предусмотрено досрочное расторжение договора. Сначала Anthropic объявила о планах арендовать 220 тыс. чипов NVIDIA у SpaceX, а затем расширила сделку до 325 тыс. чипов NVIDIA (по данным CNBC).

06.06.2026 [11:27], Сергей Карасёв

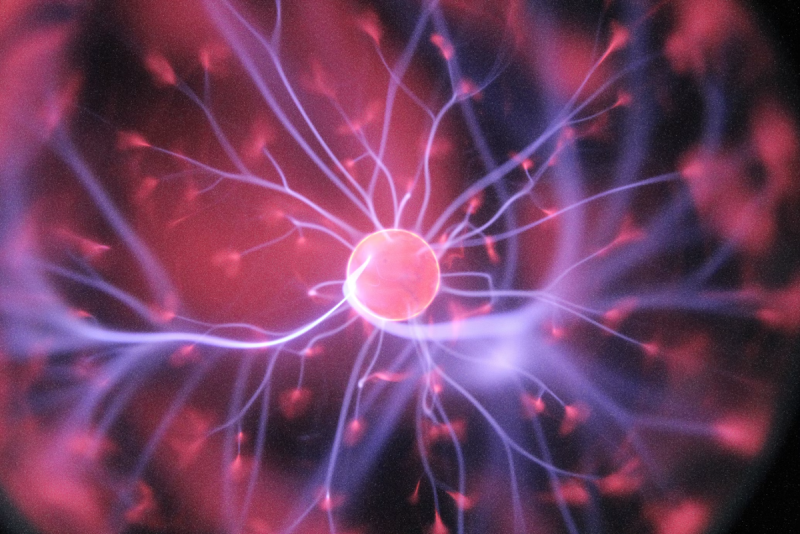

YPlasma создала твердотельный модуль охлаждения на основе ионного ветра для NVIDIA Jetson Orin NanoКомпания YPlasma представила инновационный твердотельный модуль охлаждения для одноплатного компьютера NVIDIA Jetson Orin Nano. Необычный кулер не создаёт практически никакого шума или вибраций, обеспечивая при этом стабильную работу устройства в круглосуточном режиме. В основу охладителя положена технология плазменного актуатора с диэлектрическим барьерным разрядом (DBD). Вместо обычного вентилятора задействована особая гибкая плёнка толщиной 200 мкм, которая генерирует ионный ветер: воздух перемещается с помощью электрических полей высокого напряжения, но низкого тока. В результате достигается эффективное охлаждение ключевых компонентов одноплатного компьютера, заявляет компания. В составе кулера YPlasma плёнка-актуатор заключена в корпус с размерами 100 × 30 × 4,5 мм. Дополнительно применяется проводящая пластина с габаритами 87 × 60 × 2 мм. Таким образом, толщина всей конструкции составляет около 6 мм, что меньше по сравнению с существующими микровентиляторами, у которых это значение варьируется от 8 до 12 мм. Пиковое напряжение (kVpp) заявлено на отметке 16 кВ (50 Гц), а энергопотребление актуатора находится ниже 1 Вт. Уровень производимого при работе шума — менее 20 дБА. Отсутствие движущихся частей, подшипников и прочих механических компонентов, характерных для традиционных активных кулеров, обеспечивает высокую надёжность. Новое решение может применяться в герметичных корпусах в различных условиях эксплуатации — на производствах, открытых пространствах и т. д. После 10 мин. работы решение YPlasma обеспечивает стабилизацию температуры на поверхности одноплатного компьютера NVIDIA Jetson Orin Nano (при мощности 15 Вт) на уровне 85 °C.

06.06.2026 [11:24], Сергей Карасёв

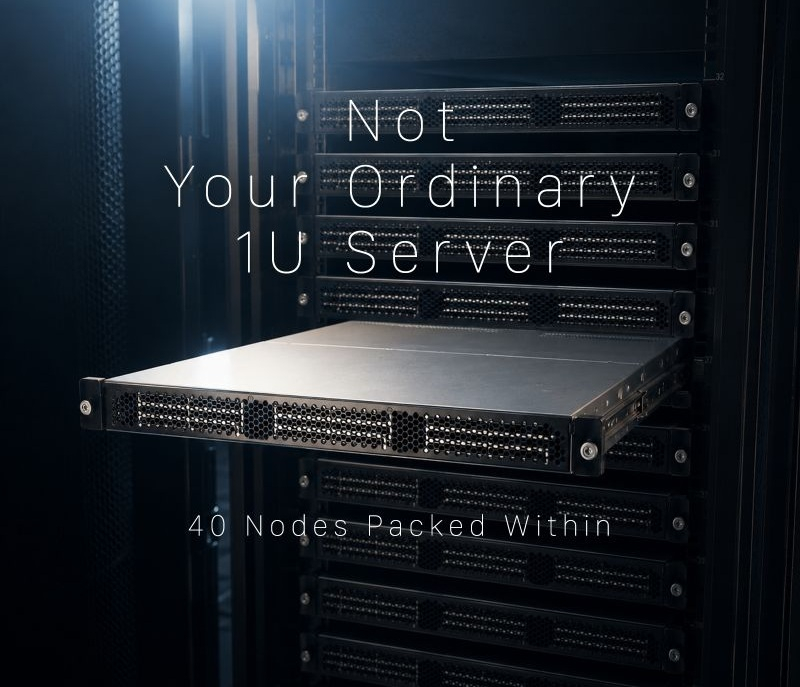

Gigabyte показала 40-узловой сервер на платформе Intel Lunar LakeКомпания Gigabyte, по сообщению The Register, продемонстрировала на выставке Computex 2026 сервер высокой плотности R1C7-K0A-AS1. Его конструкция включает 40 компактных маломощных вычислительных узлов на аппаратной платформе Intel Lunar Lake, заключённых в корпус формата 1U. Каждый узел несёт на борту процессор Intel Core Ultra 7 258V с восемью ядрами: это четыре производительных ядра Lion Cove P с максимальной тактовой частотой 4,8 ГГц и четыре энергоэффективных ядра Skymont E с частотой до 3,7 ГГц. В состав чипа входят графический ускоритель Intel Arc 140V с восемью ядрами Xe (до 1,95 ГГц) и нейропроцессорный блок Intel AI Boost с ИИ-производительностью до 47 TOPS (INT8). Каждый процессор работает в тандеме с 32 Гбайт оперативной памяти LPDDR5Х-8533. Таким образом, вся система оперирует 320 вычислительными ядрами и 1,28 Тбайт ОЗУ. Узлы наделены двумя SSD типоразмера М.2 с интерфейсом PCIe 5.0. Общее ИИ-быстродействие достигает 1880 TOPS. Шасси сервера содержит пять несущих модулей, на которые установлены по восемь вычислительных узлов. Система располагает двумя сетевыми портами QSFP28 с пропускной способностью 100 Гбит/с. Кроме того, доступен порт CMC LAN. За питание отвечают два блока мощностью 3200 Вт с сертификатом 80 Plus Titanium.

Источник изображения: Gigabyte Новинка позиционируется в качестве платформы для микросервисных рабочих нагрузок, таких как Kubernetes. Кроме того, сервер может стать основой VDI-инфраструктур. Наличие интегрированной графики в каждом CPU означает, что клиентам не придётся беспокоиться о стоимости лицензирования vGPU.

05.06.2026 [15:58], Сергей Карасёв

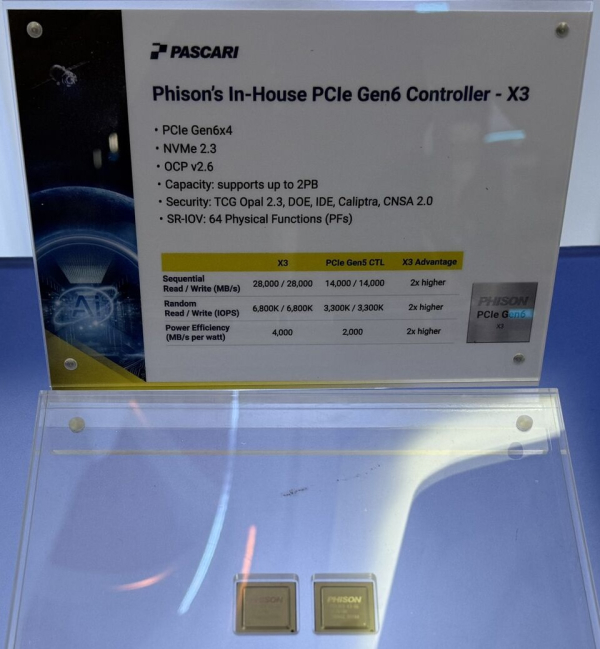

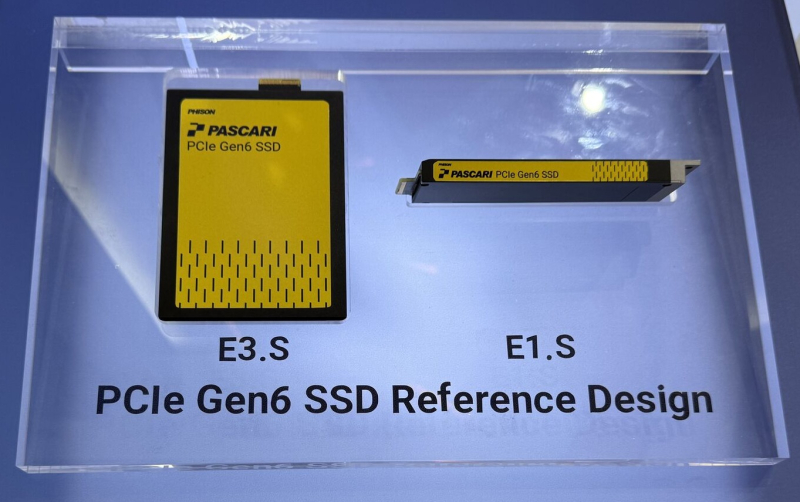

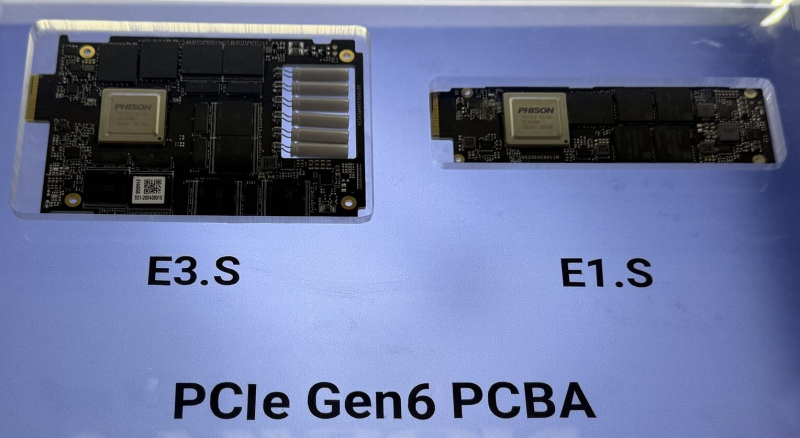

Phison представила SSD-контроллер с поддержкой PCIe 6.0Компания Phison продемонстрировала SSD-контроллер следующего поколения PS5303-X3-66. Изделие предназначено для построения высокопроизводительных накопителей корпоративного класса с интерфейсом PCIe 6.0 х4. Контроллер соответствует спецификациям NVMe 2.3 и OCP v2.6. Говорится о поддержке средств безопасности TCG Opal 2.3, DOE, IDE, Caliptra и CNSA 2.0. Решение теоретически позволяет создавать SSD вместимостью до 2 Пбайт. Чип PS5303-X3-66 обеспечивает производительность до 28 000 Мбайт/с в режимах последовательного чтения и записи. Величина IOPS (операций ввода/вывода в секунду) при произвольных чтении и записи достигает 6,8 млн. Энергетическая эффективность находится на уровне 4000 Мбайт/с/Вт. По всем этим показателям новый контроллер в два раза превосходит решения предыдущего поколения с поддержкой PCIe 5.0. Кроме того, Phison показала новые накопители на основе PS5303-X3-66 — устройства Pascari. Они будут предлагаться в различных вариантах исполнения, включая E3.S и E1.S. В конструкцию этих SSD входят модули DRAM-памяти производства SK Hynix (Hynix H25T3TG88G). В дополнение к новому контроллеру Phison готовит другие решения с поддержкой PCIe 6.0, включая ретаймеры и редрайверы. Кроме того, компания разработала собственный нейропроцессор (AI NPU) с кодовым именем Topaz, который содержит четыре специализированных ядра. Заявленная ИИ-производительность достигает 40 TOPS. Реализована поддержка памяти LPDDR5/5X-8533. При изготовлении применяется 6-нм технология TSMC. Восемь таких NPU положены в основу карты расширения с интерфейсом PCIe 6.0 x4, которая обеспечивает суммарное быстродействие на уровне 320 TOPS.

05.06.2026 [15:40], Руслан Авдеев

Правительство США планирует выделить $700 млн на поддержку угольной энергетики для ИИ-инфраструктурыАмериканское правительство намерено выделить до $700 млн на поддержку угольных электростанций и импорта электроэнергии. Это необходимо для того, чтобы удовлетворить растущий спрос на электричество, в первую очередь со стороны ИИ ЦОД, сообщает Datacenter Dynamics. Поддержка, как ожидается, будет осуществляться в рамках «Закона об оборонном производстве» (Defense Production Act) времён Холодной войны, который даёт исполнительной власти полномочия поддерживать частную промышленность, жизненно важную для безопасности Соединённых Штатов. В июле 2025 года администрация президента США Дональда Трампа (Donald Trump) объявила ЦОД объектами критически важной для национальной безопасности инфраструктуры. Трамп издал указ, призванный упростить получение разрешений на строительство ЦОД. Для удовлетворения растущего спроса на электричество власти активно поддержали угольную энергетику, хотя её доля в энергопотреблении страны уже достигла исторически низкого уровня — упала до 15 % от общего объёма производства электроэнергии. По имеющимся данным, из $700 млн более 50 % направят на модернизацию 13 угольных электростанций, ещё $185 млн — на софинансирование частных корпоративных проектов угольной генерации на Аляске, в Мэриленде и Западной Вирджинии, а $75 млн потратят на поддержку предложенного экспортного терминала West Gateway в Северной Калифорнии.

Источник изображения: Tim van der Kuip/unsplash.com За последний год в США объявили о ряде мер поддержки угольного сектора. Ранее Трамп подписал указы, призванные «оживить» угольную отрасль, чтобы она помогла удовлетворить растущий спрос ИИ ЦОД на электричество. В числе прочего было принято решение отказаться от федеральных нормативов, ограничивающих добычу угля, а также поощрять использование угля для удовлетворения спроса на энергию в США и его экспорт. Кроме того, было объявлено о борьбе с «дискриминацией» добычи угля и генерации энергии на угольных электростанциях. Позже представитель Министерства энергетики США (DoE) объявил, что администрация Трампа рассчитывает на то, что вывод угольных электростанций из эксплуатации в стране будет отложен, чтобы удовлетворить спрос со стороны ИИ ЦОД. В октябре сообщалось, что американские ЦОД активно переходят на электричество с угольных объектов. По имеющимся данным, Министерство энергетики уже использовало делегированные чрезвычайные полномочия для продления срока службы угольных электростанций. В августе 2025 года компанию Consumers Energy и оператора энергосистемы Среднего Запада MISO (Midcontinent Independent System Operator) два раза обязали поддержать продолжение работы угольной электростанции J.H. Campbell в Мичигане, ссылаясь на закон, принятый почти столетие назад. В октябре Министерство энергетики выделило $625 млн на поддержку модернизации и повторного ввода в эксплуатацию угольных электростанций. Возрождение угольной энергетики, вероятно, приведёт к значительному увеличению выбросов, поскольку именно электростанции на таком топливе считаются самыми «грязными». Так, по сравнению с генерирующими мощностями, работающими на природном газе, при использовании угля выделяется вдвое больше CO2, а для выработки аналогичного количества энергии требуется значительно больше топлива. |

|