Материалы по тегу: ускоритель

|

25.05.2026 [09:20], Владимир Мироненко

Аппаратный «ZIP-ускоритель» Huawei сжимает архивные данные в 90 разHuawei анонсировала аппаратный ускоритель для СХД для резервного копирования Huawei OceanProtect, который использует «алгоритмы HZU для глубокого сжатия с коэффициентом до 90:1», что, как утверждает производитель, на 20 % выше, чем у лучшего аналога, передаёт Blocks & Files. Кроме того, по словам Huawei, она имеет единственную в отрасли эффективную гарантию ёмкости, «исключая необходимость в оценке коэффициента компрессии». Huawei использует комбинацию многоуровневой, встроенной дедупликации данных с блоками переменной длины (VLD) с сжатием на основе свойств и компактизацией на уровне байтов, применяемой к резервным копиям. Как правило, они отличаются высокой избыточностью данных. Особенно это касается таких операций, как ежедневное полные снимки виртуальных машин. Семейство алгоритмов сжатия HZU (HZBC), разработанных Huawei, включает в себя «быстрое нелинейное преобразование и упрощённый метод прогнозирования контекста». Как утверждает Huawei эти алгоритмы могут обеспечить результаты, превосходящие результаты LZ-алгоритмов и повысить коэффициент сжатия примерно на 30 %». Как полагает Blocks & Files, используется четырёхэтапная схема компрессии:

Huawei запатентовала используемые алгоритмы дедупликации и сжатия. Технология включает выбор алгоритмов сжатия, наиболее подходящих для резервного копирования конкретных типов данных, а фактический коэффициент сжатия зависит от типа приложения и политики резервного копирования. Утверждается, что аппаратный ускоритель разгружает основной процессор СХД до 22 %. Поскольку системы OceanProtect используют All-Flash-накопители, а не более дешёвые диски, то чем эффективнее компрессии, тем лучше. Huawei использует QLC-накопители с выделенной адаптивной SLC-зоной для обработки «горячих» данных и более быстрого восстановления данных. У Everpure также есть аппаратный ускоритель DirectCompress Accelerator на базе FPGA для сжатия данных на лету и разгрузки CPU хранилища. Портфолио Huawei включает системы OceanProtect X3000, X6000 и E8000. Недавно были анонсированы также Huawei X8100 и X9100. Более ранние системы, использующие технологии сжатия предыдущих поколений, поддерживали коэффициент сжатия до 72:1. А новые системы к тому же работают до 50 % быстрее. Также отмечается, что OceanProtect X8100 обеспечивает защиту от программ-вымогателей на 99,99 %.

20.05.2026 [20:05], Владимир Мироненко

Alibaba представила ИИ-ускоритель Zhenwu M890, который втрое быстрее предшественникаAlibaba Group представила ИИ-ускоритель Zhenwu M890, разработанный её подразделением T-Head Semiconductor (Pingtouge Semiconductor), сообщило агентство Reuters. Согласно опубликованным сведениям о Zhenwu M890, это самый высокопроизводительный продукт, созданный T-Head на сегодняшний день. Он позиционируется как конкурент ускорителю NVIDIA H100, хотя и уступает ему по ряду показателей. Чип поддерживает форматы FP32/BF16/FP16 для обучения и FP8/FP4/INT8/INT4 — для инференса. Новый ускоритель был специально разработан для новой волны ИИ-агентов. Сообщается, что новинка примерно в три раза превосходит предшественника Zhenwu 810E по производительности, но точные характеристики не приводятся. Ускоритель имеет 144 Гбайт HBM и интерфейс PCI 5.0 x16. Каждый M890 имеет 8 портов интерконнекта ICN (800 Гбайт/с) и поддерживает бесшовное объединение до 64 карт. Также была представлена серверная система Panjiu AL128, которая объединяет 128 ускорителей Zhenwu M890 в одной стойке. Система вместе с фирменным стеком T-SAIL уже сейчас доступна китайским корпоративным клиентам через платформу Alibaba Cloud для внутреннего рынка, известную как Bailian. По словам компании, новый чип хорошо подходит для обработки больших объёмов памяти и коммуникационных нагрузок агентских приложений, для которых модели должны сохранять длительные периоды контекста и координировать свои действия в реальном времени. T-Head сообщила, что на сегодняшний день отгрузила более 560 тыс. ускорителей семейства Zhenwu, и более 400 внешних клиентов из 20 отраслей, включая автопроизводителей и финансовые компании, уже их внедрили. В начале апреля Alibaba и оператор China Telecom заявили о запуске ЦОД на юге Китая, работающего на собственных чипах компании. Alibaba также представила план разработки чипов на несколько лет вперёд, согласно которому в III квартале 2027 года выйдет преемник под названием V900, а в III квартале 2028 года — чип следующего поколения — J900. Согласно заявлению Alibaba, запланированный к выпуску в следующем году V900 обеспечит примерно трёхкратное увеличение производительности по сравнению с M890. По имеющейся информации, ускорители Alibaba Group производятся по техпроцессам, которые китайские заводы могут использовать без контролируемого США литографического оборудования, что является ограничивающим фактором, определяющим весь цикл производства микросхем в Китае. Поскольку ни один экземпляр H200 из одобренных США для поставки десяти китайским покупателям так и не был отгружен, китайские клиенты ускоряют переход к альтернативам местных компаний: Alibaba Zhenwu, Huawei Ascend, Cambricon Siyuan и др. По мнению Counterpoint Research, Zhenwu даст местным компаниям ещё один вариант для их ИИ-инфраструктуры, хотя остаются вопросы о том, сколько чипов Alibaba сможет выпустить на местных полупроводниковых заводах (SMIC): «M890 — это небольшой, но реальный вклад в самодостаточность Китая в области ИИ… С точки зрения чистой производительности кремния, M890 не является настоящим конкурентом H200. Но в этом и нет нужды. Для китайского рынка это достойная замена H200».

20.05.2026 [10:31], Сергей Карасёв

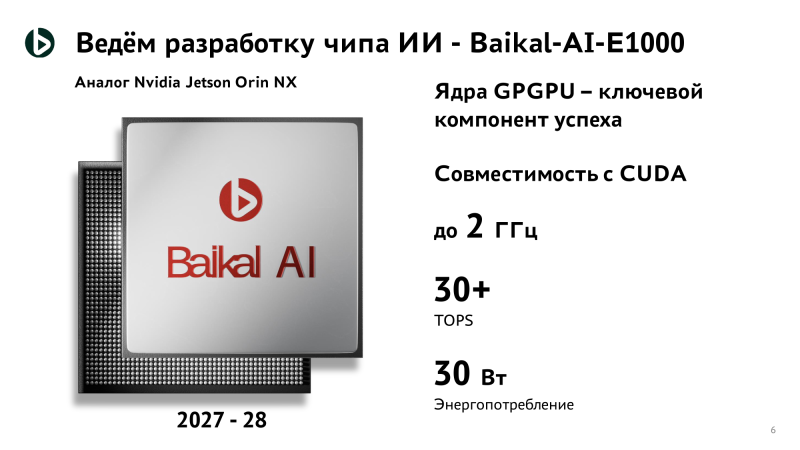

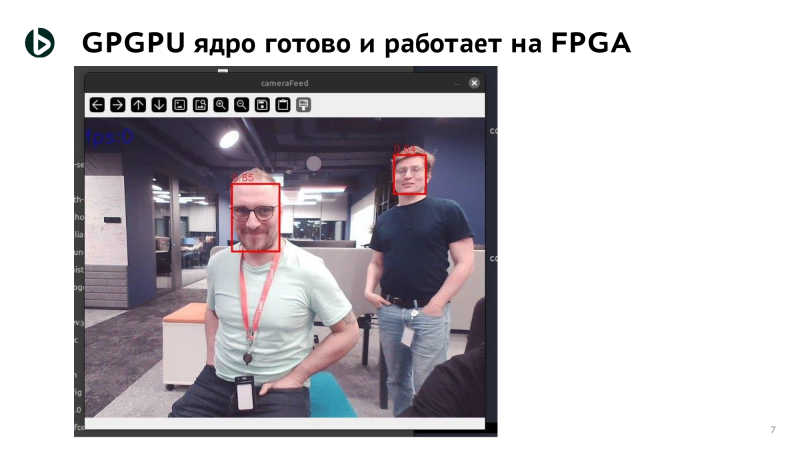

«Байкал Электроникс» готовит ИИ-ускорители с FP8-производительностью до 1 Пфлопс и совместимостью с CUDAРоссийская компания «Байкал Электроникс» на конференции ЦИПР 2026 в Нижнем Новгороде раскрыла информацию о собственных ИИ-ускорителях Baikal-AI-E1000 и Baikal-AI-D1000. Первый ориентирован на выполнение задач на периферии, второй — в дата-центрах. Известно, что изделие Baikal BE-AI-D1000 получит от 48 до 64 Гбайт памяти типа GDDR. Производительность в режиме FP8 заявлена на уровне 1000 Тфлопс (1 Пфлопс), на операциях FP16 — 500 Тфлопс. Таким образом, новинка сможет составить конкуренцию решениям NVIDIA L40S. Ориентировочная цена составит $10 тыс. Для ускорителя Baikal BE-AI-D1000 планируется реализовать совместимость с экосистемой CUDA. По заявлениям «Байкал Электроникс», устройство рассматривается в качестве компонента суверенных дата-центров, ориентированных на ИИ-нагрузки. Вывести устройство на коммерческий рынок компания рассчитывает в 2029–2030 гг. В свою очередь, Baikal-AI-E1000 станет альтернативой модулю NVIDIA Jetson Orin NX. Указываются тактовая частота и энергопотребление — до 2 ГГц и не более 30 Вт. Для решений уже разработано GPGPU-ядро, построенное на базе FPGA. Кроме того, «Байкал Электроникс» представила архитектуру ИИ ЦОД с серверами, оснащёнными отечественными комплектующими. Помимо ускорителя Baikal BE-AI-D1000, в таких системах предлагается задействовать процессор Baikal S2, выполненный на архитектуре Neoverse-N2 (ARMv9). Ранее говорилось, что чип получит 128 ядер с частотой на уровне 3 ГГц, 8 каналов DDR5, 192 линии PCIe 5.0, поддержку CXL 2.0 и CCIX 2.0. Нужно также отметить, что «Байкал Электроникс» столкнулась с трудностями при производстве своих процессоров из-за сформировавшейся геополитической обстановки. В результате, компания была вынуждена отменить выпуск и продажи изделий Baikal-S. Позднее появилась информация, что отгрузки этих чипов будут возобновлены.

07.05.2026 [16:26], Владимир Мироненко

200 Тфлопс в FP64: AMD поделилась первыми подробностями об Instinct MI430XAMD поделилась информацией о производительности Instinct MI430X. Это не ИИ-ускоритель — чип ориентирован на задачи в сегменте высокопроизводительных вычислений (HPC): вычисления с двойной точностью (FP64) остаются чрезвычайно важными в науке, моделировании и многих других приложениях, пишет ресурс ComputerBase. AMD официально подтвердила выпуск чипа прошлой осенью, когда уже получила первые крупные заказы. Теперь компания демонстрирует первые показатели решения с 432 Гбайт HBM4. Обладая производительностью более 200 TFLOPS в нативном режиме FP64, он будет «более чем в шесть раз быстрее» ускорителя NVIDIA Rubin. Однако следует отметить, что сравнение несколько некорректно. Во-первых, Rubin — это чистый ИИ-ускоритель, ориентированный на FP4 и аналогичные форматы, а не на FP64. Во-вторых, AMD прямо не уточняет, идёт ли речь о векторных и/или матричных вычислениях. Хотя, вероятно, речь всё-таки о векторных расчётах, поскольку в режиме эмуляции со схемой Озаки Rubin, как обещает NVIDIA, будет выдавать те же 200 Тфлопс в FP64. При этом реального конкурента, кроме Instinct M430X, у Rubin в FP64 нет. С другой стороны, Rubin, в свою очередь, по всей видимости, превосходит MI430X в приложениях FP4 — AMD пока не раскрыла его возможности в таких вычислениях. Кроме того, компания сама говорила о возможности поддержки схемы Озаки (Ozaki) для чипов Instinct. Фактически AMD в своих же чипах «отклонилась от курса», решив наращивать ИИ-производительность. В Instinct MI355X FP64-производительность и векторных, и матричных вычислений была на уровне 78,6 Тфлопс, тогда как вышедший ранее MI325X выдавал 81,6 Тфлопс, а ещё более «древний» MI300X — 81,7 Тфлопс. О решении AMD нарастить нативную FP64-производительность ускорителя Instinct MI430X стало известно этой весной. До этого компания усомнилась в эффективности эмуляции научных расчётов на тензорных ядрах NVIDIA. NVIDIA же давно сделала ставку исключительно на ИИ, отказавшись от развития в новейших ускорителях FP64-блоков, но учёные указывают на то, что отказ от поддержки этого направления грозит лидерству США в HPC и дальнейшим инновациям. В Министерстве энергетики США (DoE) также отметили, что FP64-вычисления по-прежнему «очень важны» для «Миссии Генезис» (Genesis Mission) и для реализации её цели — ускорения научных открытий с помощью ИИ. AMD добилась больших успехов в сегменте HPC, поставляя оборудование для самых быстрых в мире суперкомпьютеров. Именно этот рынок является целевым для Instinct MI430X, о чем свидетельствуют первые заказы, включая машину Discovery Национальной лаборатории Ок-Ридж (ORNL) в США и Alice Recoque во Франции. Как сообщается, производительность Alice Recoque составит более 1 Эфлопс в FP64, что сделает его одной из самых быстрых HPC-систем в Европе.

30.04.2026 [15:18], Владимир Мироненко

Lumai анонсировала «оптические» ИИ-серверы Iris с фотонными ускорителями инференсаБританский ИИ-стартап Lumai анонсировал семейство серверов для инференса Lumai Iris с использованием оптических вычислений, предназначенное для исполнения в реальном времени больших языковых моделей (LLM) с миллиардами параметров. Семейство Lumai Iris включает серверы Nova, Aura и Tetra. Lumai Iris Nova уже доступен для оценки гиперскейлерами, неооблачными платформами, предприятиями и исследовательскими институтами. Lumai заявил, что использование Lumai Iris позволяет ускорить выполнение задач инференса, используя свет вместо кремниевой обработки. Оптическая вычислительная система Lumai обеспечивает более быстрый инференс, более высокую эффективность выполнения и до 90 % меньшее энергопотребление по сравнению с традиционными архитектурами, при этом являясь более экологичными по сравнению с традиционными системами на базе GPU. Впрочем, технические детали оптических ИИ-ускорителей пока не раскрыты.

Источник изображений: Lumai Компания отметила, что спрос на вычисления для ИИ смещается от обучения моделей к крупномасштабному инференсу, когда модели используются в реальных приложениях. По мере роста объёмов вычислительных задач ЦОД сталкиваются с жёсткими ограничениями по энергопотреблению и масштабируемости, с которыми традиционные кремниевые архитектуры с трудом справляются. Компания заявила, что семейство Iris призвано решить проблемы с энергопотреблением и стоимостью ИИ-инфраструктуры за счёт повышения производительности на киловатт. Традиционные кремниевые архитектуры сталкиваются с фундаментальными физическими ограничениями в масштабируемости, энергопотреблении и тепловой эффективности. Каждое новое поколение кремниевых чипов предлагает небольшие улучшения, но при этом требует значительно больше энергии и средств для масштабирования. «По мере перехода отрасли в эру инференса мы одновременно пересекаем порог посткремниевой эры, — сказал Сяньсинь Го (Xianxin Guo), генеральный директор и соучредитель Lumai. — Переходя от электронно-фотонной вычислительной парадигмы к фотонной, Lumai может обеспечить увеличение производительности на порядок при значительной экономии энергии».  Lumai отметила, что оптические вычисления позволяют значительно повысить эффективность выполнения обработки ИИ-нагрузок. Технология оптических вычислений Lumai, разработанная на основе исследований в Оксфордском университете, использует свет в трёхмерном среде, тогда как обычные чипы «живут» в 2D. Благодаря использованию массового пространственного параллелизма, миллионы операций выполняются одновременно, обеспечивая низкую стоимость и высокую пропускную способность токенов при выполнении ресурсоёмких вычислительных задач. Технология Lumai также показала свою эффективность на этапе предварительного заполнения дезагрегированных архитектур инференса, обрабатывая токены с максимальной эффективностью и масштабированием. Iris Nova выполняет инференс в реальном времени моделей Llama 8B и 70B с помощью гибридного процессора. Его гибридная архитектура сочетает цифровую обработку для управления системой и ПО с оптическим тензорным движком для основных математических операций. Такой подход обеспечивает бесшовную интеграцию серверов в ЦОД.

23.04.2026 [01:20], Владимир Мироненко

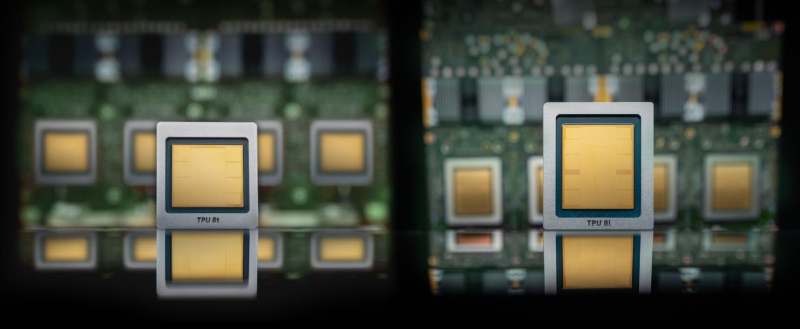

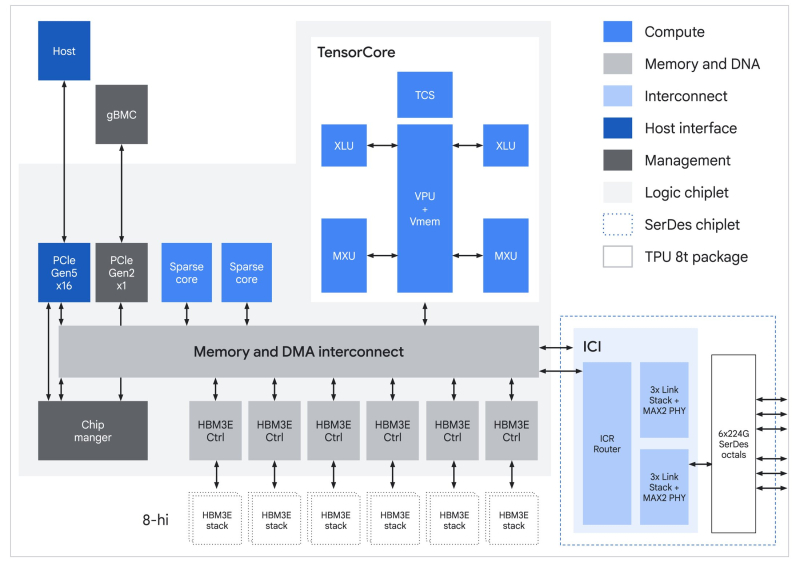

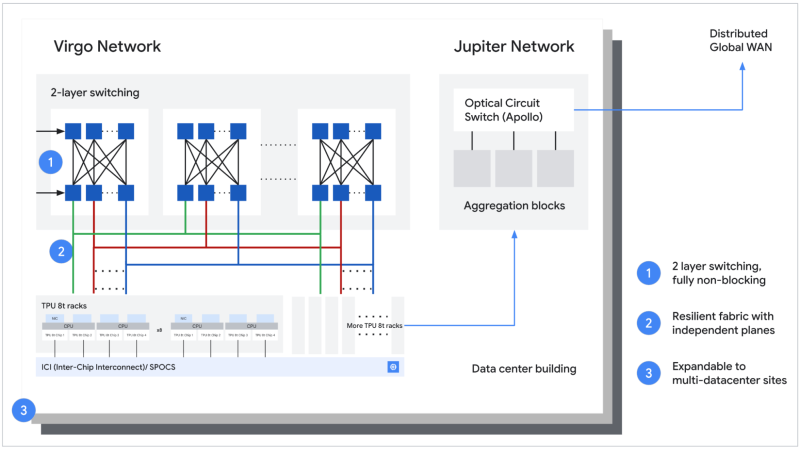

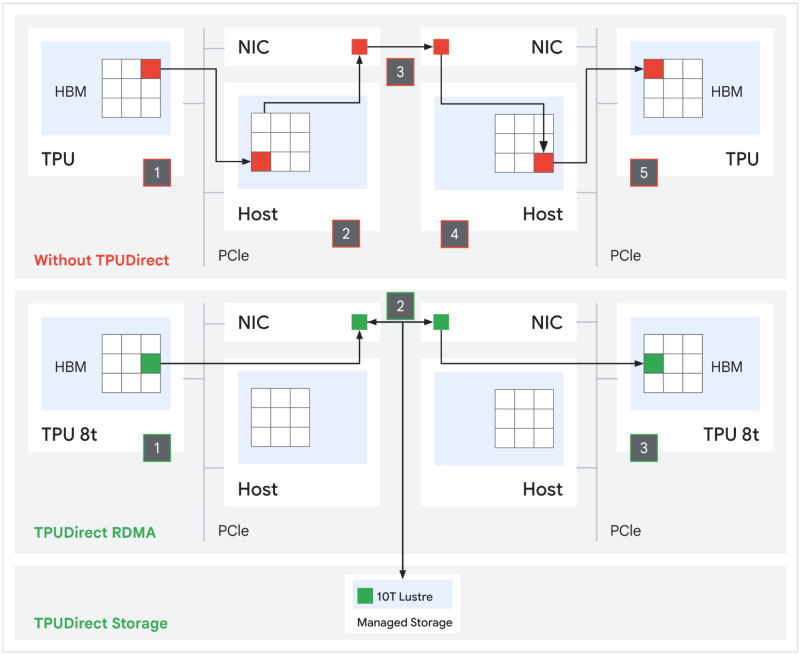

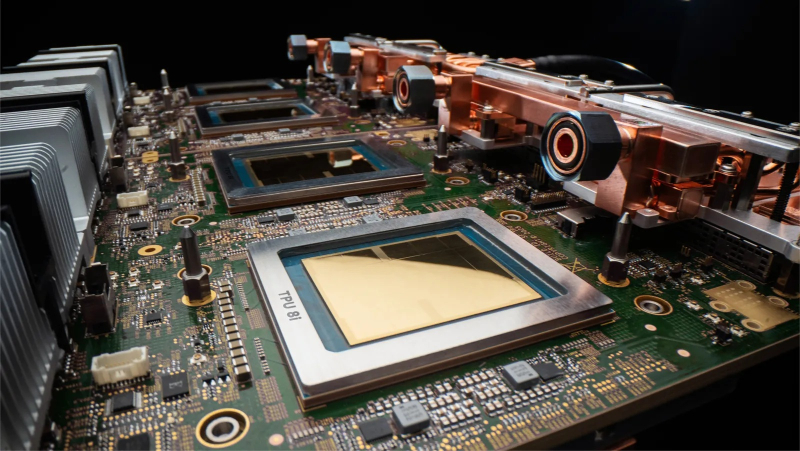

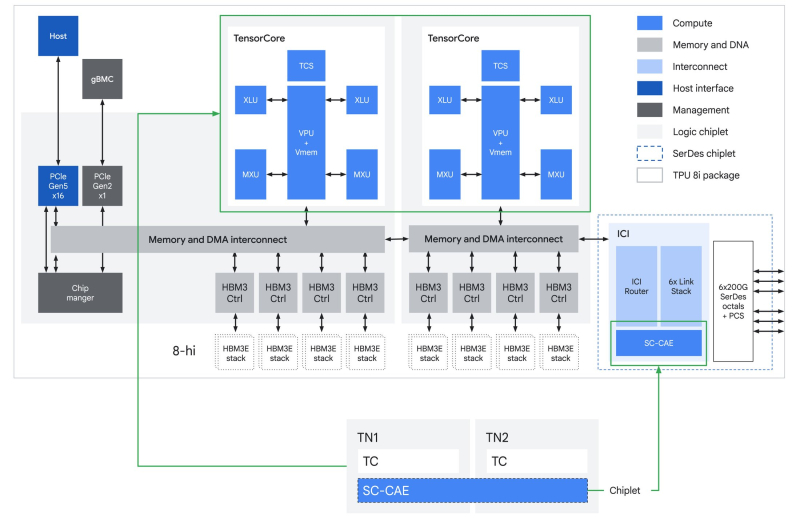

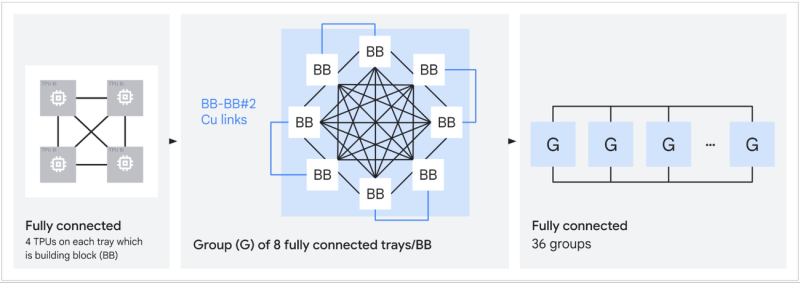

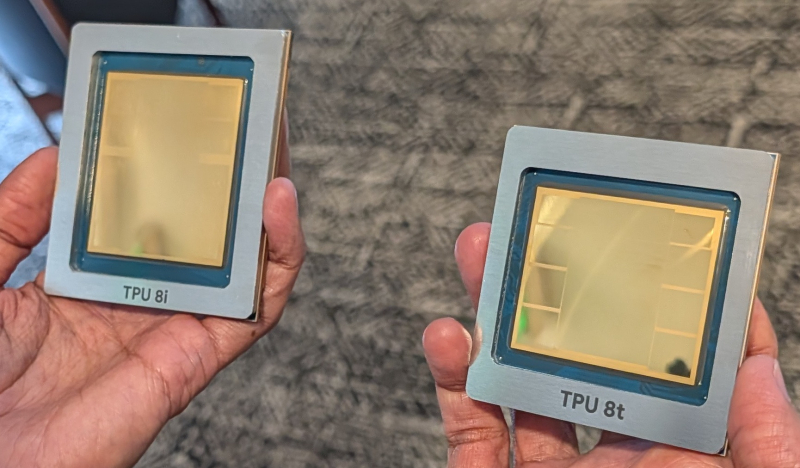

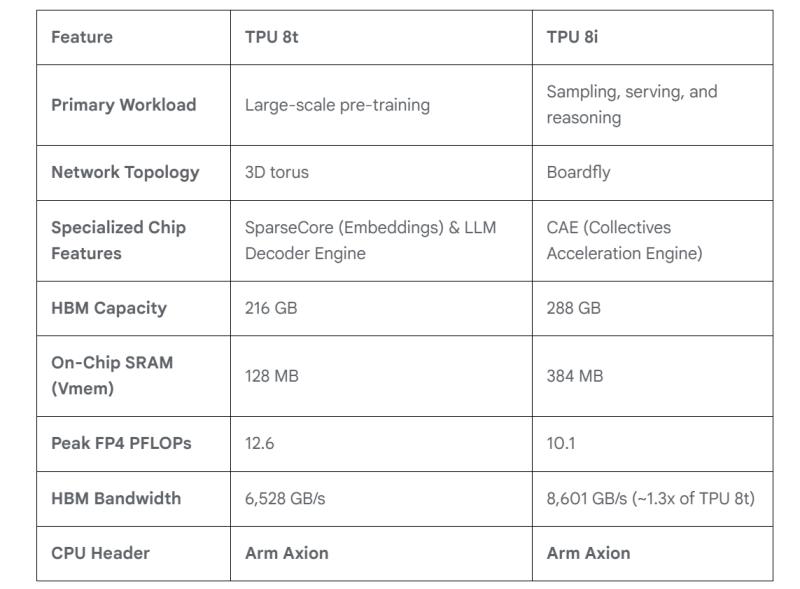

Для обучения и инференса — Google анонсировала ИИ-ускорители TPU 8t и TPU 8iGoogle представила два TPU восьмого поколения: TPU 8t (Sunfish) для обучения ИИ и TPU 8i (Zebrafish) для ИИ-инференса. Компания и раньше экспериментировала с различными вариантами TPU, в частности, со своими чипами пятого поколения V5p и V5e, но последние поколения, такие как Trillium и Ironwood, в основном следовали единому подходу. По словам Амина Вахдата (Amin Vahdat), старшего вице-президента и главного технолога Google по ИИ и инфраструктуре, TPU 8t и TPU 8i — результат десятилетней разработки (первые TPU были анонсированы в мае 2016 г.), специально созданные для обеспечения работы суперкомпьютеров следующего поколения с высокой эффективностью и масштабируемостью. Вахдат описывает TPU 8t как «мощную платформу для обучения», созданную для «сокращения цикла разработки моделей с месяцев до недель». Она предлагает в 2,8 раза лучшее соотношение цены и производительности, чем предыдущее поколение. В TPU 8t используются векторные, матричные и SparseCore-ядра, дополненные 128 Мбайт SRAM и 216 Гбайт HBM3e (6,5 Тбайт/с). FP4-производительность составляет до 12,6 Пфлопс (также поддерживаются BF16/FP8/INT8). Для вертикального масштабирования используется межчиповый интерконнект (ICI) со скоростью 19,2 Тбит/с (в каждую сторону), для горизонтального — 400 Гбит/с. Кластер с TPU 8t может масштабироваться до 9,6 тыс. чипов, предлагая 2 Пбайт памяти HBM, 121 Эфлопс и вдвое большую межчиповую пропускную способность по сравнению с Ironwood, позволяя самым сложным моделям использовать единый, огромный пул памяти. 8t-кластеры объдиняет сеть Virgo Network, которая использует плоскую двухуровневую неблокирующую топологию, обеспечивает четырёхкратное увеличение пропускной способности в ЦОД и построена на коммутаторах с высокой степенью защиты, что сокращает количество сетевых уровней. В рамках одного ЦОД Virgo Network позволяет объединить до 134 тыс. чипов, что даёт до 47 Пбит/с неблокирующих соединений и более 1,6 Ифлопс с почти линейным масштабированием. А в рамках нескольких ЦОД в единый кластер можно объединить более 1 млн TPU. В TPU 8t используются технологии TPUDirect RDMA и TPUDirect Storage. TPU Direct RDMA обеспечивает прямую передачу данных между HBM и NIC, минуя CPU и DRAM хоста, а TPUDirect Storage напрямую связывает память TPU и СХД, таким как 10T Lustre, которая обеспечивает до 10 Тбайт/с, что даёт на порядок более быстрый доступ к хранилищу в сравнении с Ironwood и позволяет доставлять петабайты данных к ускорителям. Кроме того, TPU 8t получили расширенные возможности RAS. К ним относятся телеметрия в реальном времени для десятков тысяч чипов, автоматическое обнаружение неисправных каналов ICI и перенаправление трафика без прерывания задания, а также оптическая коммутация каналов (OCS), которая перенастраивает оборудование в случае сбоев без участия человека. Всё это позволяет довести уровень утилизации чипа до 97 %. В свою очередь, TPU 8i создан для обработки «сложной, совместной, итеративной работы множества специализированных агентов», которые появляются с развитием агентного ИИ. TPU 8i использует 288 Гбайт памяти HBM (8,6 Тбайт/с) в паре с 384 Мбайт SRAM — втрое больше, чем в предыдущем поколении. По словам Google, такой объём SRAM помогает TPU 8i удерживать большую часть KV-кеша на кристалле, что значительно сокращает время простоя ядер во время декодирования длинных контекстов. Компания отказалась от SparseCores в пользу нового встроенного механизма ускорения коллективных операций (CAE), снижая задержки на уровне кристалла и разгружая коллективные коммуникации, которые в противном случае привели бы к простою тензорных ядер чипа, отметил The Register. TPU 8i масштабируется до 1152 чипов в одном кластере (впрочем, в каждый момент активно не более 1024): 11,6 Эфлопс и 331,8 Тбайт HBM. ICI у 8i такой же, что у 8t, однако для объединения чипов используется топология Boardfly вместо 3D-тора, поскольку для MoE-инференса важно меньшее количество сетевых переходов между чипами. Эти инновации обеспечивают на 80 % лучшую производительность на доллар по сравнению с предыдущим поколением, позволяя предприятиям обслуживать почти вдвое больше клиентов при тех же затратах, сообщила компания. Как TPU 8t, так и 8i работают на базе собственного Arm-процессора Axion и поддерживают СЖО. Компания также заявила, что оптимизировала эффективность всей системы для обеспечения интегрированного управления питанием, которое может регулировать потребление энергии в зависимости от спроса в реальном времени, что приводит к повышению производительности на ватт до двух раз по сравнению с Ironwood. TPU 8 станут общедоступными на Google Cloud Platform позже в этом году в виде отдельных инстансов или как часть полнофункциональной платформы AI Hypercomputer, которая объединяет все сетевые ресурсы, хранилище, вычислительные мощности и ПО, необходимые для развёртывания или обучения LLM в масштабе. Также ожидается, что вскоре Google представит TPU v8e (Humufish).

15.04.2026 [16:37], Руслан Авдеев

Broadcom поможет Meta✴ в создании нескольких поколений ИИ-ускорителейMeta✴ объявила о заключении нового соглашения с Broadcom. Оно расширяет уже имеющееся партнёрство, направленное на разработку собственных ИИ-ускорителей для IT-гиганта, сообщает Silicon Angle. На начальном этапе Meta✴ планирует развернуть собственные ускорители общей мощностью 1 ГВт для обучения ИИ-моделей и инференса. В конечном итоге партнёры планируют развернуть ускорители на основе технологий Broadcom совокупной мощностью несколько гигаватт. Отдельно Broadcom подчеркнула, что новые чипы MTIA — первые в ИИ-индустрии, использующие 2-нм техпроцесс. По словам главы Meta✴ Марка Цукерберга (Mark Zuckerberg), в MTIA будут использоваться наработки Broadcom в сфере проектирования, упаковки и сетевых решений. Ранее сообщалось, что Meta✴ столкнулась с трудностями при выпуске новых чипов MTIA, но Broadcom опровергла эту информацию, заявив, что поставки уже осуществляются, а для следующего поколения XPU планируется масштабировать производство.

Источник изображения: Meta✴ В марте Meta✴ объявила о разработке четырёх новых вариантов MTIA. Первую версию чипа представили ещё в 2023 году. MTIA дают определённую независимость от дорогостоящих и труднодоступных моделей NVIDIA и AMD. Как и чипы Google и AWS, они представляют собой специализированные ASIC, меньше и дешевле классических ИИ-ускорителей — но их вполне достаточно для выполнения узкого круга задач. Google представила свои первые TPU задолго до бума ИИ, ещё в 2015 году. В 2018 году Amazon представила первые чипы Trainium. Обе компании полагались на технологии Broadcom для разработки своих продуктов. В последние месяцы Broadscom анонсировала ряд сделок, касающихся своих кастомных XPU. Так, Anthropic получит Google TPU на 3,5 ГВт, часть чипов будет поставляться самой Broadcom. Кроме того, Broadcom помогает Fujitsu в создании 2-нм процессора MONAKA. В 2026 году Meta✴ анонсировала ряд многомиллиардных сделок по закупке ИИ-ускорителей в рамках обязательства выделить более $135 млрд на капитальные затраты в 2026 финансовом году. Ранее она обязалась использовать 6 ГВт ИИ-ускорителей AMD, миллионы чипов NVIDIA, а также чипы, совместно разработанные с Arm. Кроме того, компания намерена потратить миллиарды долларов на аренду ускорителей у CoreWeave и Nebius.

08.04.2026 [17:04], Владимир Мироненко

ВТБ заменит ИИ-ускорители NVIDIA на китайские решенияБанк ВТБ будет использовать GPU китайских производителей вместо ИИ-ускорителей NVIDIA для работы внутрибанковских сервисов на основе ИИ, сообщил «Ведомостям» зампред правления ВТБ Вадим Кулик. По его словам, GPU будут использоваться для работы с компьютерным зрением, обработки, анализа текста и распознаванием речи, а также для моделей генеративного ИИ банка. Топ-менеджер отметил, что в ходе тестирования китайские чипы показали стабильную производительную работу с существующими IT-системами банка. «Внедрение китайских GPU проходит без существенных доработок и с высокой производительностью. Это ускорит развитие ИИ-технологий, включая цифровых помощников и ИИ-агентов», — сообщил он. Замена ускорителей NVIDIA на китайские GPU проводится в рамках совместной работы в центре компетенций ВТБ по ИИ в Китае. Центр представляет собой площадку для прикладных совместных исследований российских и китайских специалистов и быстрого тестирования устройств с ИИ без необходимости их поставки в Россию. Здесь и проходило тестирование GPU из КНР в марте. Зампред отметил, что Китай богат на технологии, но существуют сложности с их поиском, апробацией и доставкой в Россию в промышленных масштабах. «Центр создан для того, чтобы помочь компаниям из России и Китая совместно внедрять новейшие технологии. Сейчас мы сконцентрированы на поиске партнёров, заинтересованных в применении ИИ-технологий», — рассказал он. Согласно исследованию IT-холдинга Т1, совокупный рынок российских GPU в 2025 году вырос на 21 % до около 63 млрд руб. Доля NVIDIA на мировом рынке оценивается в исследовании в 80 %. По его оценкам, с учётом дополнительных затрат на серверные платформы, сетевое оборудование, ПО и обслуживание, капитальные вложения на замещение чипов NVIDIA могут составить порядка 2–5 млрд руб. Ранее «Ведомости» сообщали, что китайские серверы тестируют «Сбер» и Т-банк, а Альфа-банк тоже рассматривает возможность их использования. Среди поставщиков ИИ-ускорителей в Китае есть Huawei, Alibaba, MetaX, Moore Threads, Cambricon, Iluvatar, Biren, Sophgo и др. Собеседник «Ведомостей» в одном из топ-20 банков России считает, что реальных альтернатив чипам NVIDIA для банковской сферы всё же нет, ни сейчас, ни в обозримом будущем. Даже самые сильные китайские GPU пока уступают решениям американской компании не только по «железу», но и по зрелости программной среды, под которую уже разработано множество банковских решений. Переход на альтернативные GPU потребует серьезных вложений в адаптацию и переработку программных продуктов, а проведенные испытания показывают, что такие решения пока заметно проигрывают по скорости обработки запросов и обучению классических ML-моделей, отметил собеседник издания.

02.04.2026 [11:50], Руслан Авдеев

Китайские ИИ-ускорители заняли почти половину местного рынка на фоне снижения доли NVIDIAКитайские производители видеокарт и ИИ-чипов заняли около 41 % локального рынка ИИ-ускорителей в 2025 году. Это сказалось на позициях NVIDIA, некогда занимавшей на этом, одном из ключевых рынков за пределами США, доминирующее положение, сообщает Reuters со ссылкой на аналитику IDC. Местные производители наращивают свою долю по мере того, как Пекин всё больше внимания уделяет вопросу обеспечения независимости от иностранных чипов. Власти стимулируют использование государственными ведомствами и компаниями китайских альтернатив после того, как США несколько раз инициировали ужесточение экспортного контроля в Поднебесную. Общие поставки ИИ-ускорителей NVIDIA, AMD и китайских производителей в 2025 году достигли в КНР приблизительно 4 млн единиц. NVIDIA сохранила позицию лидера рынка, поставив около 2,2 млн ускорителей, доля компании на рынке составляет 55 %. Тем не менее назвать это успехом американского вендора нельзя, поскольку раньше компания тотально доминировала на рынке. AMD поставила скромные 160 тыс. ускорителей (доля 4 %).

Источник изображения: James Lo/unsplash.com Китайские вендоры в совокупности поставили 1,65 млн ускорителей — 41 % рынка. Это свидетельствует о том, насколько агрессивно местные игроки действуют для компенсации дефицита ускорителей, ужесточившегося из-за американского экспортного контроля. Среди китайских производителей особенно выделяется Huawei Technologies, поставившая около 812 тыс. чипов, приблизительно половину от общих объёмов местной продукции. Второе место занимает T-Head — занимающееся разработкой чипов подразделение Alibaba, поставившее приблизительно 265 тыс. ускорителей. Kunlunxin (Baidu) и Cambricon поставили приблизительно по 116 тыс. чипов каждая, поделив третье место среди китайских вендоров. На Hygon, MetaX и Iluvatar CoreX пришлось 5 %, 4 % и 3 % соответственно. В 2025 году китайские власти инициировали новый раунд расходов на ИИ-инфраструктуру, руководство в провинциях ускорило развёртывание вычислительных центров. Многие их таких кампусов ЦОД, по данным Reuters, получили негласное указание «покупать китайское». Тем не менее, в начале 2026 года США одобрили поставки относительно современных ускорителей NVIDIA H200 в КНР, после чего поставки были официально одобрены и Пекином. В марте глава NVIDIA Дженсен Хуанг (Jensen Huang) объявил, что начат выпуск H200 для китайского рынка — это может изменить позиции NVIDIA уже в обозримом будущем.

22.03.2026 [13:10], Сергей Карасёв

Почти втрое быстрее NVIDIA H20: Huawei представила ИИ-ускоритель Atlas 350 для инференсаКомпания Huawei Technologies, по сообщению газеты South China Morning Post (SCMP), представила ускоритель Atlas 350, предназначенный для ИИ-инференса. Утверждается, что в таких задачах новинка обеспечивает прирост производительности до 2,8 раза по сравнению с NVIDIA H20. Известно, что решение Atlas 350 выполнено на чипе Ascend 950PR. Заявленная ИИ-производительность в формате FP4 достигает 1,56 Пфлопс. Показатели быстродействия в других режимах пока не раскрываются, но ранее говорилось об 1 Пфлопс в FP8. Как отмечается, Huawei использует собственную память HBM. Её объём в зависимости от конфигурации ускорителя составляет до 128 Гбайт, пропускная способность — 1,6 Тбайт/с. Прочие технические характеристики не приводятся. Ускоритель Atlas 350 оптимизирован для предварительного заполнения (Prefill) в ходе инференса — это наиболее ресурсоёмкая фаза работы больших языковых моделей (LLM) в рамках процесса генерации контента: на данном этапе производится обработка входного запроса пользователя. Скорость выполнения предварительного заполнения напрямую влияет на показатель TTFT (Time To First Token), то есть, на время, прошедшее с момента ввода запроса до начала ответа. Таким образом, решение Atlas 350 подходит для ИИ-приложений реального времени и агентных систем.

Источник изображения: Huawei Huawei также заявила о планах масштабного обновления своих СХД, включая решения OceanStor Dorado и Pacific 9926 класса All-Flash. Кроме того, компания готовит платформу FusionCube A1000, которая поможет малым и средним предприятиям быстро разворачивать ИИ-системы. «Если первая половина эпохи ИИ была сосредоточена на вычислительной мощности, то вторая половина будет определяться данными. В 2026 году Huawei продолжит модернизацию своих СХД и будет активно участвовать в крупных национальных проектах по формированию соответствующей инфраструктуры», — говорит Юань Юань (Yuan Yuan), президент подразделения по хранению данных Huawei. |

|