Материалы по тегу: ии

|

13.03.2025 [23:41], Татьяна Золотова

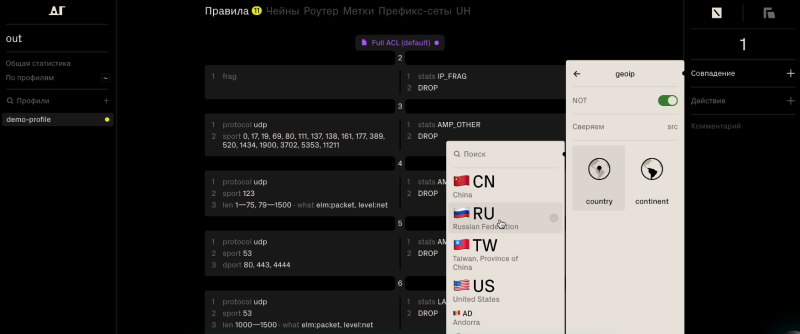

Быстрее и удобнее: Servicepipe модернизировал ядро системы сетевой защиты DosGateРоссийский разработчик решений для анализа и фильтрации нежелательного трафика Servicepipe обновил ядро DosGate, адаптивной системы защиты ИТ-инфраструктуры от DDoS-атак и сетевых угроз, доступной в виде ПО и ПАК. Разработчики провели масштабный рефакторинг формирования сетевых инструкций внутри BPF-программ. В результате фактический прирост производительности составил 15 %. Кроме того, теперь в дампах (создаваемых в сессионном модуле) можно увидеть, каким правилом был сброшен пакет. Это позволяет легко определить, какие контрмеры отфильтровывают конкретный трафик. Также теперь можно использовать отрицание для протокола непосредственно в правиле, что позволяет сбрасывать весь трафик, за исключением выбранного протокола. Ранее для этой задачи требовалось применение локальных меток. При поиске по IP-адресам в метках теперь автоматически отображается географический регион адреса, что облегчает анализ и реагирование на угрозы. В DosGate появилась валидация IPv4-опций «из коробки», что обеспечивает автоматическую блокировку множества IP-атак, таких как некорректная IP-фрагментация. Обновление ядра не только увеличивает производительность решения, но и упрощает интеграцию DosGate в современные системы безопасности, включая NGFW и WAF, для которых DosGate с его пакетным и сессионным фильтрами может выполнять предварительную очистку трафика. Особенно актуально подобное внедрение DosGate в системах, где требуется комплексная, многоуровневая защита, и необходима гарантированная устойчивость к сложным киберугрозам.

13.03.2025 [23:30], Владимир Мироненко

Бывший глава Google предупредил об опасности стремления США к доминированию в области ИИ

software

безопасность

ии

информационная безопасность

китай

прогноз

разработка

санкции

сша

ускоритель

цод

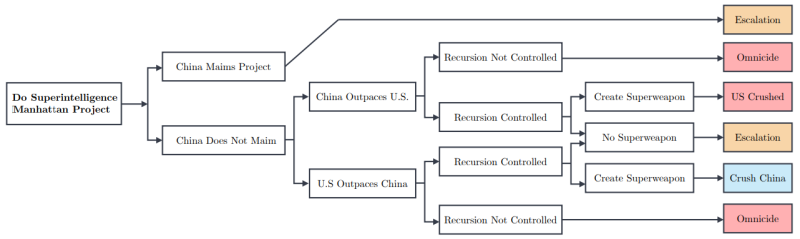

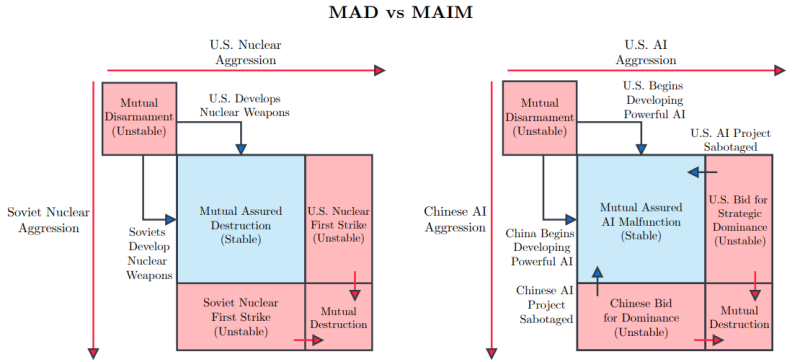

Бывший глава Google Эрик Шмидт (Eric Schmidt) опубликовал статью «Стратегия сверхразума» (Superintelligence Strategy), написанную в соавторстве с Дэном Хендриксом (Dan Hendrycks), директором Центра безопасности ИИ, и Александром Вангом (Alexandr Wang), основателем и генеральным директором Scale AI, в которой высказывается мнение о том, что США следует воздержаться от реализации аналога «Манхэттенского проекта» для достижения превосходства в области ИИ, поскольку это спровоцирует упреждающие киберответы со стороны, например, Китая, пишет The Register. Авторы статьи утверждают, что любое государство, которое создаст супер-ИИ, будет представлять прямую угрозу для других стран, и они, стремясь обеспечить собственное выживание, будут вынуждены саботировать такие проекты ИИ. Любая «агрессивная попытка одностороннего доминирования в области ИИ приведёт к превентивному саботажу со стороны конкурентов», который может быть реализован в виде шпионажа, кибератак, тайных операций по деградации обучения моделей и даже прямого физического удара по ИИ ЦОД. Авторы считают, что в области ИИ мы уже близки к доктрине взаимного гарантированного уничтожения (Mutual Assured Destruction, MAD) времён Холодной войны. Авторы дали нынешнему положению название «гарантированное взаимное несрабатывание ИИ» (Mutual Assured AI Malfunction, MAIM), при котором проекты ИИ, разрабатываемые государствами, ограничены взаимными угрозами саботажа. Вместе с тем ИИ, как и ядерные программы в своё время, может принести пользу человечеству во многих областях, от прорывов в разработке лекарств до автоматизации процессов производства, использование ИИ важно для экономического роста и прогресса в современном мире. Согласно статье, государства могут выбрать одну из трех стратегий.

Комментируя предложение Комиссии по обзору экономики и безопасности США и Китая (USCC) о госфинансирования США своего рода «Манхэттенского проекта» по созданию суперинтеллекта в какому-нибудь укромном уголке страны, авторы статьи предупредили, что Китай отреагирует на этот шаг, что приведёт лишь к длительному дисбалансу сил и постоянной нестабильности. Авторы статьи считают, что государства должны отдавать приоритет доктрине сдерживания, а не победе в гонке за искусственный сверхразум. MAIM подразумевает, что попытки любого государства достичь стратегической монополии в области ИИ столкнутся с ответными мерами со стороны других стран, а также приведут к соглашениям, направленным на ограничение поставок ИИ-чипов и open source моделей, которые по смыслу будут аналогичны соглашениям о контроле над ядерным оружием. Чтобы обезопасить себя от атак на государственном уровне с целью замедлить развитие ИИ, в статье предлагается строить ЦОД в удалённых местах, чтобы минимизировать возможный ущерб, пишет Data Center Dynamics. Тот, кто хочет нанести ущерб работе других стран в сфере ИИ, может начать с кибератак: «Государства могут “отравить” данные, испортить веса и градиенты моделей, нарушить работу ПО, которое обрабатывают ошибки ускорителей и управляет питанием и охлаждением…». Снизить вероятность атак поможет и прозрачность разработок. ИИ можно использовать для оценки безопасности других ИИ-проектов, что позволит избежать атак на «гражданские» ЦОД. Вместе с тем не помешает и прозрачность цепочек поставок. Поскольку ИИ-ускорители существуют в реальном, а не виртуальном мире, отследить их перемещение не так уж трудно. Таким образом, даже устаревшие или признанные негодными чипы не смогут попасть на чёрный рынок — их предлагается утилизировать с той же степенью ответственности, что и химические или ядерные материалы. Впрочем, соблюдение всех этих рекомендаций не устранит главную проблему — зависимость от Тайваня в плане производства передовых чипов, которая является критической для США, говорят авторы статьи. Поэтому западным странам следует разработать гарантированные цепочки поставок ИИ-чипов. Для этого потребуются значительные инвестиции, но это необходимо для обеспечения конкурентоспособности.

13.03.2025 [15:55], Руслан Авдеев

ESA запустила суперкомпьютер Space HPC для европейских космических исследованийЕвропейское космическое агентство (ESA) запустило суперкомпьютерную платформу ESA Space HPC, специально разработанную для развития космических исследований и технологий в Евросоюзе. Открытие нового объекта состоялось на территории принадлежащего ESA центра ESRIN в Италии, сообщает HPC Wire. ESA Space HPC обеспечит поддержку исследований и развития технологий в рамках всех программ ESA, обеспечивая учёным и малому и среднему бизнесу из стран Евросоюза доступ к вычислительным мощностям. Инициатива призвана развить использование высокопроизводительных вычислений (HPC) в аэрокосмическом секторе ЕС, она станет основой для более масштабных инициатив в будущем. Как сообщается на сайте проекта, Space HPC построен при участии HPE. Суперкомпьютер включает порядка 34 тыс. ядер процессоров Intel и AMD последних поколений, 156 Тбайт RAM, 108 ускорителей NVIDIA H100, All-Flash подсистему хранения ёмкостью 3,6 Пбайт и пропускной способностью 500 Гбайт/с, а также 400G-интерконнект InfiniBand. Общая пиковая производительность кластера составляет 5 Пфлопс (FP64). Space HPC использует прямое жидкостное охлаждение, а PUE системы не превышает 1,09. Избыточное тепло отправляется на нужды отопления кампуса. Локальная солнечная электростанция обеспечивает более половины энергетических нужд кластера. Представители итальянских властей заявили, что технологические инновации в космическом секторе являются приоритетом для обеспечения безопасности и «стратегической автономии», а также будут способствовать конкурентоспособности европейской промышленности. Также отмечено, что местный аэрокосмический хаб Lazio стал домом для 250 компаний и играет ключевую роль в развитии авионики, электроники, радаров, спутниковых технологий и материаловедения. В руководстве ESA отметили потенциал Space HPC для инноваций в космической индустрии Евросоюза. Новый объект обеспечит агентству гибкую суперкомпьютерную инфраструктуру для исследований и разработок, тестирования и бенчмаркинга, поддержки программ ESA и промышленных предприятий. Доступ к вычислениям будет иметь и малый и средний бизнес, стартапы и т.п. Также отмечается, что дебют Space HPC наглядно продемонстрировал, ESA не только берёт ресурсы у государств-участников, но и много может дать им взамен. Утверждается, что одной из ключевых сфер деятельности, где требуются HPC-платформы, для ESA является наблюдение за Землёй. Новые мощности обеспечат управление наблюдениями, разработку новых приложений и сервисов. Space HPC будет поддерживать сложные нагрузки, включая моделирование, инженерные симуляции, обучение ИИ-моделей, аналитику данных и визуализацию, а также прочие эксперименты, которые помогут снизить риски будущих космических проектов. Это позволит ESA повысить финансовую эффективность проектов и обеспечит возможность обмена данными между разными программами агентства. В конце 2024 года сообщалось, что в 2025 году в Евросоюзе появится сразу семь ИИ-фабрик EuroHPC, а в середине минувшего февраля появилась информация, что Евросоюз направит €200 млрд на развитие ИИ, чтобы не отстать от США и Китая в этой сфере. В прошлом году было отмечено, что реализация миссий NASA задерживается из-за устаревших и перегруженных суперкомпьютеров.

13.03.2025 [08:50], Руслан Авдеев

Cerebras развернёт царь-ускорители WSE-3 ещё в шести ЦОД во Франции, США и КанадеКомпания Cerebras начала установку более тысячи ИИ-систем CS-3 на базе гигантских ускорителей WSE-3 по всей Северной Америке и во Франции. Компания стремится зарекомендовать себя как поставщика одной из крупнейших и быстрейших облачных инференс-платформ, сообщает The Register. Кроме того, компания объявила о расширении сотрудничества с Hugging Face. К концу 2025 года развернёт свои ускорители в дата-центрах в Техасе, Миннесоте, Оклахоме и Джорджии, а также в Канаде и во Франции. Cerebras будет целиком владеть площадками в Оклахома-Сити (Оклахома) и Монреале (Канада), а оставшиеся объекты будут эксплуатироваться в рамках соглашения с G42 из ОАЭ. Крупнейший в США новый кластер CS-3 разместится в Миннеаполисе (Миннесота), его оснастят 512 CS-3 с общим быстродействием 64 Эфлопс (FP16). Он заработает уже во II квартале 2025 года. Cerebras давно сотрудничает с фондом G42, который активно спонсирует ИИ-стартап и является его якорным заказчиком — на G42 пришлось 83 % от всей выручки Cerebras за 2023 календарный год. Однако именно это сотрудничество привело к тому, что Cerebras вынужденно отложила IPO — власти США опасаются, что Китай получит доступ к ИИ-суперчипам Cerebras при посредничестве ОАЭ. По слухам, G42 заключила сделку с США, отказавшись от работы с Китаем в обмен на инвестиции.

Источник изображения: SNL В ближайшее время Cerebras также намерена расширить API-доступ к своим ускорителям для разработчиков, договорившись с репозиторием моделей Hugging Face. Также Cerebras выиграла контракты с Mistral AI и Perplexity. Недавно объявлено о намерении аналитической платформы AlphaSense заменить трёх поставщиков моделей с закрытым кодом на модель open source, работающую на CS-3. Летом прошлого года было объявлено о партнёрстве с Dell.

12.03.2025 [20:37], Владимир Мироненко

Евросоюз потратит €240 млн на создание трёх RISC-V чиплетов для суперкомпьютеров в рамках проекта DARE

eurohpc

hardware

hpc

risc-v

европа

ии

импортозамещение

инвестиции

суперкомпьютер

ускоритель

финансы

чиплеты

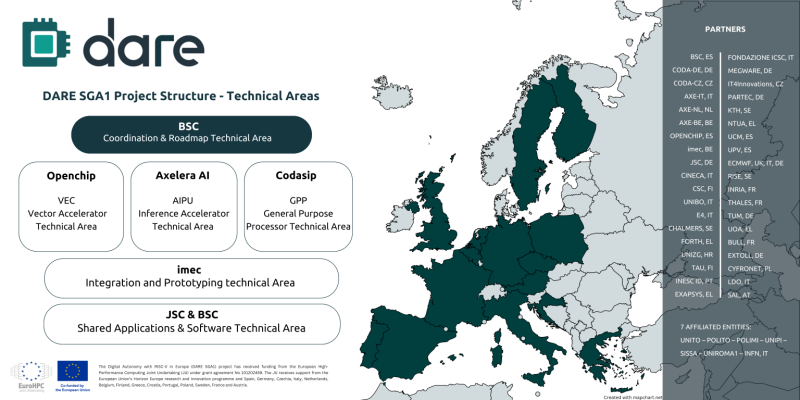

Digital Autonomy with RISC-V in Europe (DARE), крупнейший проект по разработке чипов из когда-либо финансируемых Европейским союзом, созданный с целью укрепления технологического суверенитета Европы в области высокопроизводительных вычислений (HPC) и искусственного интеллекта (ИИ), официально начал первый этап DARE SGA1, на реализацию которого выделено €240 млн ($262 млн), сообщается на сайте проекта. Европа и Китай делают ставку на RISC-V. Финансирование инициативы обеспечат 38 участников, включая ИТ-компании, исследовательские институты и университеты по всей Европе. Проект поддерживается EuroHPC JU и координируется Барселонским суперкомпьютерным центром (BSC-CNS). Последний имеет богатый опыт разработки чипов RISC-V и суперкомпьютерных систем. Половина инвестиций в проект DARE будет предоставлена Европейской комиссией через EuroHPC, а другая половина поступит напрямую от европейских партнёров, включая €34 млн от Министерства науки, инноваций и университетов Испании. Рассчитанный на три года DARE SGA1 является первым этапом шестилетней инициативы DARE. Цель — создание полноценного независимого европейского суперкомпьютерного программно-аппаратного стека для HPC и ИИ, включая чипы, системы на основе чиплетов и ПО. Инициатива направлена на удовлетворение стратегической потребности Европы в цифровом суверенитете и получения полного контроля над критической вычислительной инфраструктурой. Проектом DARE SGA1 предусмотрена разработка трёх чиплетов на основе архитектуры RISC-V, каждый из которых будет выполнять критически важную функцию в вычислениях HPC и ИИ:

В дополнение к указанным компаниям в качестве технических лидеров названы imec и Юлихский исследовательский центр (JÜLICH Supercomputing centre, JSC), которые будут продвигать ключевые инновации в рамках проекта. Помимо координации усилий, BSC также возглавит разработку планов и будет участвовать в разработке программных и аппаратных решений. Изготавливаться чиплеты будут по технологии CMOS с использованием современных техпроцессов. Axelera получит на разработку до €61 млн при условии выполнения различных задач в течение следующих трёх лет, рассказал ресурсу EE Times генеральный директор Axelera Фабрицио дель Маффео (Fabrizio del Maffeo). Хотя нынешний чип Axelera Metis AIPU предназначен для периферийных систем, дель Маффео сказал, что разрабатываемый в рамках DARE продукт на основе чиплетов не несёт кардинальные изменения, речь скорее о масштабировании. Codasip в прошлом году анонсировала 64-бит чип X730 на базе RISC-V с архитектурной защитой CHERI. По данным The Next Platform, за последнее десятилетие компания привлекла $34,6 млн общего финансирования, включая средства в рамках различных инициатив ЕС, а также посевной раунд в размере $2,5 млн в 2016 году и раунд A в размере $10 млн в 2018 году.

12.03.2025 [15:31], Руслан Авдеев

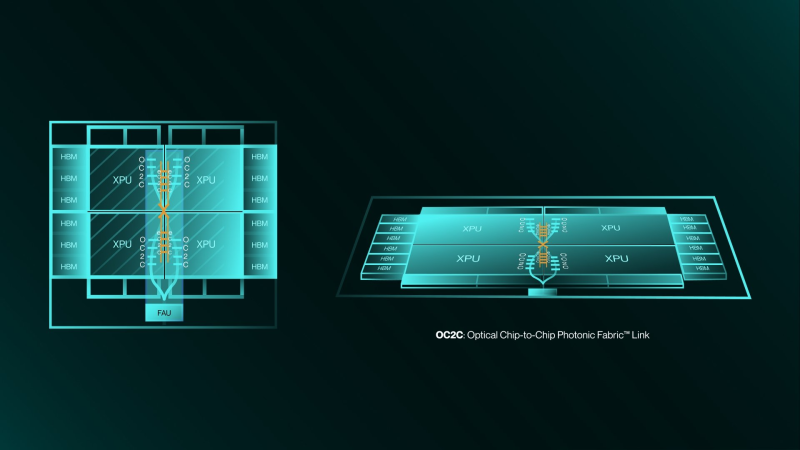

Разработчик фотонного интерконнекта для ИИ-инфраструктур Celestial AI привлёк ещё $250 млн инвестицийCelestial AI, разрабатывающая платформу оптического интерконнекта Photonic Fabric, объявила о привлечении $250 млн в ходе раунда финансирования серии C1. Раунд возглавила Fidelity Management & Research Company, общий объём привлечённого бизнесом капитала за всё время достиг $515 млн, сообщает пресс-служба компании. В числе новых инвесторов — фонды, контролируемые BlackRock, Maverick Silicon, Tiger Global Management и Лип-Бу Таном (Lip-Bu Tan). Участвовали и прежние инвесторы, включая AMD Ventures, Koch Disruptive Technologies (KDT), Temasek, принадлежащая последней Xora Innovation, а также Porsche Automobil Holding SE и The Engine Ventures. Как заявляют в Celestial AI, появление «рассуждающих» ИИ-моделей и автономных ИИ-агентов, выросли и требования к инфраструктуре. Современные ИИ-кластеры уже включают десятки тысяч ускорителей, а со временем они станут ещё больше. Для них требуется эффективная во всех отношениях система передачи данных. Photonic Fabric, по словам Celestial AI, представляет собой «единственную» технологическую платформу, отвечающую всем требованиям таких систем, задавая новые стандарты пропускной способности, задержек, энергоэффективности и совокупной стоимости владения. Для того, чтобы справиться с быстрыми изменениями ИИ-инфраструктуры, платформа Photonic Fabric обеспечит объединение в единую сеть вычислительных ИИ-мощностей, от кластеров чипов до групп серверов в разных стойках. Предлагается полный набор продуктов для передачи данных, коммутации и упаковки, которые послужат основой оптических масштабируемых сетей. Photonic Fabric полностью совместима со стандартными для индустрии процессами производства и 2.5D-упаковки. Тесное сотрудничество с гиперскейлерами, производителями и упаковщиками чипов и новые средства позволят компании масштабировать производство своих решений для удовлетворения спроса со стороны клиентов. На рынке уже есть сходные решения вроде Lightmatter Passage или Ayar Labs TeraPhy. В 2024 году Celestial AI предлагала связать оптикой HBM, DDR5 и процессоры. Ранее компания уже привлекла $100 млн и $175 млн в ходе двух раундов финансирования.

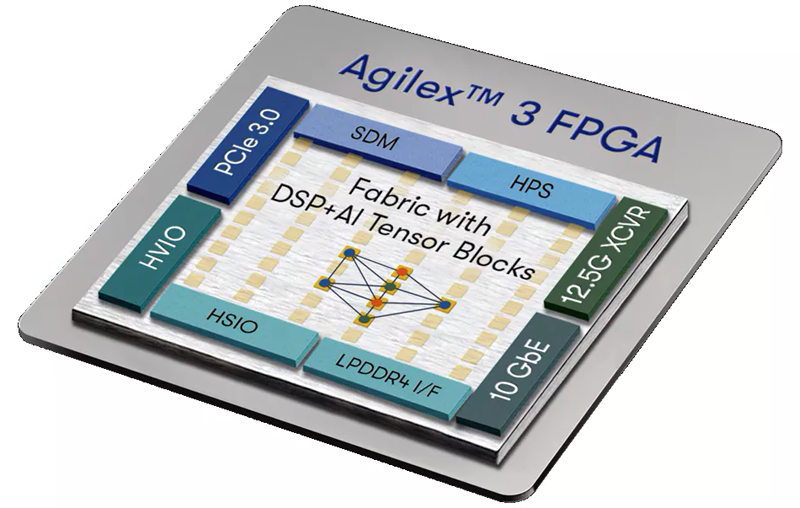

12.03.2025 [14:57], Сергей Карасёв

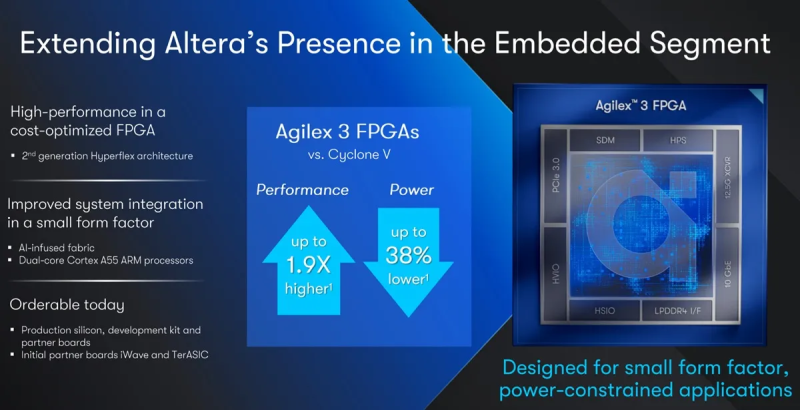

Altera представила малые FPGA семейства Agilex 3 для энергоэффективных системКомпания Altera, сформированная на базе выделенной из Intel группы программируемых решений (PSG), анонсировала FPGA семейства Agilex 3 для маломощных и экономичных систем. Среди сфер применения изделий названы автоматизация производственных процессов, медицинская визуализация, видеонаблюдение, мониторинг транспортных систем, периферийные ИИ-вычисления и пр. О подготовке Agilex 3 сообщалось в сентябре прошлого года. Задействована архитектура HyperFlex второго поколения. В состав решений входят ПЛИС с возможностями ИИ и два ядра Arm Cortex-A55 с тактовой частотой 800 МГц. По заявлениям Altera, чипы Agilex 3 обеспечивают 1,9-кратный рост производительности по сравнению Cyclone V при снижении энергопотребления до 38 %. Для трансиверов Agilex 3 заявлена скорость передачи данных до 12,5 Гбит/с. Говорится о поддержке интерфейсов PCIe 3.0 x4 и 10GbE. Усовершенствованный цифровой сигнальный процессор с блоком AI Tensor Block обеспечивает пиковую ИИ-производительность 2,8 TOPS на операциях INT8. Реализованы различные средства обеспечения безопасности, включая защищённую загрузку, шифрование AES и управление конфигурацией FPGA.  В семейство Agilex 3 вошли модели A3C025, A3C050, A3C065, A3C100 и A3C135, насчитывающие от 25 075 до 135 110 логических элементов. Поддерживается работа с памятью LPDDR4-2133. Изделия могут быть выполнены в корпусе с размерами 12 × 12, 16 × 16 или 18 × 18 мм. В качестве примеров использования Agilex 3 компания Altera приводит роботизированные системы, где FPGA обеспечивают управление в реальном времени для многоосевых манипуляторов. В составе промышленных камер чипы улучшают обнаружение дефектов. Приём предварительных заказов на изделия уже начался.

12.03.2025 [14:45], Сергей Карасёв

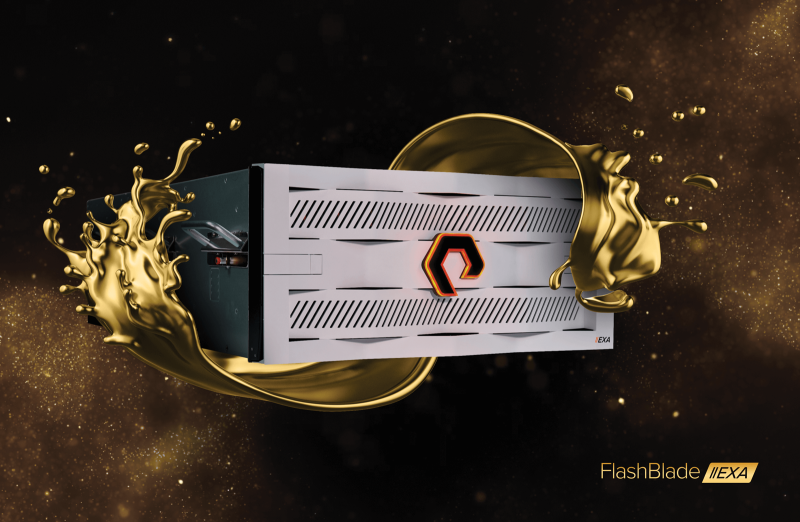

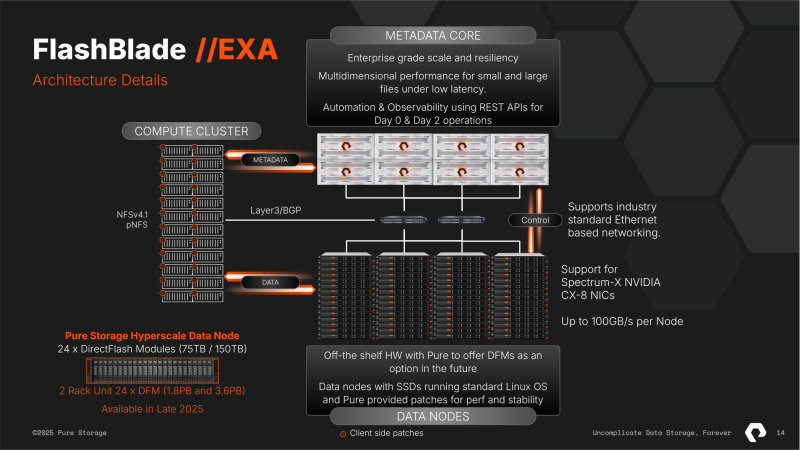

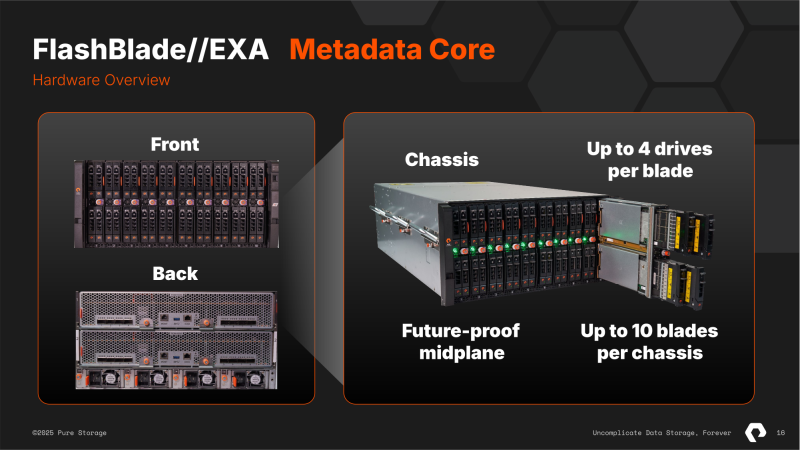

10+ Тбайт/с: Pure Storage представила высокопроизводительную All-Flash СХД FlashBlade//EXA для ИИ и НРСКомпания Pure Storage анонсировала систему FlashBlade//EXA: это, как утверждается, самая производительная на сегодняшний день платформа хранения данных, разработанная специально для наиболее требовательных нагрузок ИИ и HPC. Отмечается, что стандартные СХД оптимизированы для традиционных сред HPC с предсказуемыми операциями. Такие системы разрабатываются с прицелом на масштабирование «чистой производительности». Однако современные нагрузки ИИ являются гораздо более сложными и многомодальными: они предусматривают обработку данных разного типа — текстов, изображений и видео — одновременно на десятках тысяч ускорителей. Из-за этого возникает необходимость в оптимизации обработки метаданных наряду с масштабированием производительности. FlashBlade//EXA, по заявлениям Pure Storage, устраняет узкие места традиционных СХД в плане работы с метаданными. Архитектура новой платформы даёт возможность масштабировать ресурсы для обработки обычных данных и метаданных независимо друг от друга. Эффективная обработка метаданных имеет решающее значение для поддержания высокой производительности, надёжности и эффективности в крупномасштабных средах ИИ. Сегмент метаданных Metadata Core в составе FlashBlade//EXA может объединять от 1 до 10 5U-шасси с десятью blade-узлами в каждом. В каждом узле размещается от одного до четырёх фирменных 37.5-Тбайт модуля DFM. Ещё 2U приходится на пару XFM (External Fabric Modules), которые дают 16 подключений 400GbE. Metadata Core работает с фирменной ОС Purity//FB, общается напрямую с GPU-кластером (NFSv4.1 over TCP) и управляет потоками данных между узлами хранения и кластером (NFSv3 over RDMA). Узлы хранения Data Node обладают неограниченной масштабируемостью. Причём эти узлы могут быть самыми обычными x86-серверами любых вендоров. Каждый такой узел должен содержать 32-ядерный CPU, 192 Гбайт RAM, от 12 до 16 NVMe SSD (PCIe 4.0/5.0) вместимостью до 61,44 Тбайт, а также пару 400GbE NIC. Архитектура платформы предусматривает использование сетевых адаптеров NVIDIA ConnectX, коммутаторов Spectrum, компонентов LinkX и пр. Система FlashBlade//EXA обеспечивает производительность свыше 10 Тбайт/с на операциях чтения в одном пространстве имён. В результате, организации могут значительно ускорить процессы обучения ИИ-моделей и инференса, максимально используя потенциал GPU-ускорителей. Это также способствует снижению временных и финансовых затрат на решение ресурсоёмких задач. По-видимому, именно это решение компания и предлагает гиперскейлерам. У самой Pure Storage есть тестовая конфигурация из 300 узлов, которая показывает производительность на уровне 30 Тбайт/с.

12.03.2025 [00:25], Владимир Мироненко

Meta✴ начала тестирование собственного ускорителя для обучения ИИ-моделейMeta✴ Platforms приступила к тестированию ИИ-ускорителя собственной разработки, который, в случае успеха, позволит ей снизить зависимость от поставок чипов NVIDIA, пишет Reuters со ссылкой на информированные источники. По словам одного из источников, новый чип Meta✴ представляет собой специализированный ускоритель, то есть ASIC, предназначенный для обработки только ИИ-нагрузок. Небольшую пробную партию чипов Meta✴ изготовила тайваньская TSMC. По словам собеседника Reuters, тестирование началось после завершения фазы Tape-out — это заключительный этап разработки чипов перед началом производства, что является значительным маркером успеха в их разработке, отметило Reuters. Обычно этап Tape-out занимает от трёх до шести месяцев, причём без гарантии, что всё пройдёт успешно, и обходится в десятки миллионов долларов. В случае неудачи Meta✴ потребуется диагностировать проблему и начать всё заново. Этот чип представляет собой новое поколение ИИ-ускорителей, разработанных в рамках программы Meta✴ Training and Inference Accelerator (MTIA). Разработка продвигается с переменным успехом уже много лет. В прошлом году Meta✴ добилась определённых успехов — второе поколение ИИ-ускорителей Meta✴ MTIA оказалось втрое быстрее первого. В прошлом году Meta✴ начала использовать MTIAv2 для инференса рекомендательных систем Facebook✴ и Instagram✴.

Источник изображения: Meta✴ Meta✴ сообщила, что планирует к 2026 году начать использовать собственные ИИ-чипы для обучения моделей. Как и в случае с чипом для инференса, новый ИИ-ускоритель сначала пройдёт проверку в работе с рекомендательными системами, после чего его задействуют для приложений генеративного ИИ, таких как чат-бот Meta✴ AI, заявили в Meta✴. Крис Кокс (Chris Cox), директор по продуктам Meta✴, сообщил, что разработка чипов идёт с переменным успехом, отметив, что руководство компании посчитала ИИ-ускоритель для инференса первого поколения «большим успехом». Однако тестовые испытания он провалил, так что в 2022 году компания стала заказывать ускорители NVIDIA. С тех она остаётся крупным клиентом NVIDIA, используя её чипы как для обучения своих моделей, так и для инференса. Meta✴ прогнозирует общие расходы в 2025 году в размере от $114 до $119 млрд, в том числе до $65 млрд капитальных затрат, в основном связанных с расширением ИИ-инфраструктуры. Использование собственных чипов позволит компании значительно снизить затраты на это направление.

11.03.2025 [18:31], Владимир Мироненко

Oracle построит ИИ-кластер из 30 тыс. ускорителей AMD Instinct MI355X и вдвое увеличит мощность ЦОДКорпорация Oracle сообщила результаты работы в III квартале 2025 финансового года, закончившемся 28 февраля 2025 года. Прибыль и выручка Oracle за квартал оказались ниже прогнозов Уолл-стрит, в связи с чем акции компании упали более чем на 5 %, несмотря на имеющееся большое количестве крупных контрактов на облачные вычисления на будущее, пишет MarketWatch. Выручка Oracle выросла за квартал на 6 % до $14,13 млрд при консенсус-прогнозе аналитиков, опрошенных LSEG, в размере $14,39 млрд. Скорректированная прибыль (Non-GAAP) на акцию тоже оказалась ниже прогноза аналитиков от LSEG — $1,47 против ожидаемых $1,49. Чистая прибыль (GAAP) за отчётный квартал составила $2,94 млрд или $1,02 на разводнённую акцию, по сравнению с $2,40 млрд или $0,85 на разводнённую акцию в III квартале 2024 финансового года. Облачные услуги и поддержка лицензий принесли компании $11,01 млрд (рост год к году на 10 %), что составляет 78 % от её общей выручки. Выручка от лицензирования облачных и локальных продуктов упала на 10 % до $1,13 млрд. Также упали продажи оборудования — на 7 % год к году до $703 млн, и выручка от сервисов — на 1 % до $1,29 млрд. Выручка облачной инфраструктуры (IaaS) выросла на 49 % до $2,7 млрд. За последние три месяца доход от Database MultiCloud на платформах Microsoft, Google и Amazon вырос на 92 %. Потребление ускорителей для обучения ИИ выросло на 244 % за последние 12 месяцев. Эллисон сообщил, что на фоне огромного спроса на инференс компания интегрировала модели OpenAI ChatGPT, xAI Grok и Meta✴ Llama непосредственно с СУБД Oracle 23ai. Этот новый продукт под названием Oracle AI Data Platform позволяет клиентам использовать любую из ведущих в мире ИИ-моделей для анализа всех своих данных, сохраняя при этом их в безопасности. Генеральный директор Oracle Сафра Кац (Safra Catz) сообщила, что в III финансовом квартале Oracle подписала контракты на продажу на рекордную сумму более $48 млрд, увеличив оставшиеся обязательства к исполнению (RPO) на 63 % до более чем $130 млрд, что позволит увеличить общий доход Oracle на 15 % в следующем финансовом году. Следует отметить, что согласно FactSet, аналитики ранее прогнозировали для Oracle в 2026 финансовом году рост продаж на 12,5 %. Вместе с тем капитальные затраты по итогам 2025 финансового года, как ожидается, удвоятся по сравнению с прошлым годом и составят около $16 млрд.

Источник изображения: Oracle По словам Кац, были подписаны облачные соглашения с несколькими ведущими мировыми технологическими компаниями, включая OpenAI, xAI, Meta✴, NVIDIA и AMD, и в ближайшем будущем ожидается подписание первого контракта в рамках проекта Stargate, что позволит Oracle расширить как обучение, так и инференс. Председатель и технический директор Oracle Ларри Эллисон (Larry Ellison) отметил, что спрос со стороны клиентов находится на рекордном уровне и в 2025 календарном году компания удвоит свои мощности ЦОД. Компания находится в процессе развёртывания гигантского ИИ-кластера из 64 тыс. NVIDIA GB200 с жидкостным охлаждением. Кроме того, Oracle построит кластер из 30 тыс. AMD Instinct MI355X. В текущем квартале Oracle ожидает увеличить выручку на 8–10 %. Аналитики ожидали роста примерно на 11 % до $15,91 млрд, согласно LSEG. Компания заявила, что ожидает скорректированную прибыль в размере $1,61–1,65 на акцию. Аналитики прогнозируют скорректированную прибыль на акцию в размере $1,79. Кац также сообщила, что капзатраты Oracle в этом году составят $16 млрд, что более, чем вдвое превышает показатель прошлого года. |

|