Материалы по тегу: cerebras

|

06.05.2026 [17:08], Сергей Карасёв

Президент OpenAI оказался владельцем долей в Cerebras и CoreWeave, у которых миллиардные сделки с самой OpenAIСоучредитель и президент OpenAI Грег Брокман (Greg Brockman), по сообщению ресурса Datacenter Dynamics, владеет долями в ряде технологических компаний: Cerebras, CoreWeave, Stripe и Helion. С дувмя из них OpenAI имеет контракты на десятки миллиардов долларов. Об этом стало известно в ходе судебного разбирательства, инициированного миллиардером Илоном Маском (Elon Musk). В декабре 2015 года Брокман вместе с Маском, Сэмом Альтманом (Sam Altman) и др. основали некоммерческую организацию OpenAI с целью разработки безопасного и самодостаточного ИИ. После того, как Маск в 2019 году покинул компанию, Альтман стал генеральным директором, и OpenAI сформировала дочернюю коммерческую структуру для привлечения средств. В тот момент Брокман получил крупную долю в OpenAI, оцениваемую сейчас примерно в $30 млрд. В своём иске Маск пытается получить от OpenAI крупную материальную компенсацию, добиться отстранения Альтмана и Брокмана от управления компанией и трансформировать её обратно исключительно в некоммерческую организацию. Примечательно, что Брокман в момент основания OpenAI пообещал пожертвовать организации $100 тыс., но так этого и не сделал.

Источник изображения: персональный сайт Брокмана В том же 2019 году, как стало известно, Брокман начал покупать акции CoreWeave: его доля по состоянию на апрель 2026 года оценивается в $817,37 тыс. Между тем сама OpenAI заключила ряд соглашений по аренде ИИ-инфраструктуры у CoreWeave, обязавшись потратить на услуги этой компании в общей сложности $22,4 млрд. В ходе более раннего судебного разбирательства, инициированного Маском в 2024 году, выяснилось, что OpenAI рассматривала возможность приобретения компании Cerebras — разработчика ИИ-ускорителей. С этим стартапом OpenAI недавно заключила соглашение на приобретение оборудования стоимостью более $20 млрд. Выяснилось, что по состоянию на конец 2025 года стоимость доли Брокмана в Cerebras составляет $2,82 млн. В 2023 году Брокман также начал скупать акции Helion Energy, которая занимается разработкой термоядерных реакторов: на конец прошлого года его доля в деньгах составляла $433,58 тыс. Любопытно, что Альтман инвестирует в эту компанию с 2015-го и до нынешнего года входил в совет её директоров. При этом OpenAI намерена закупать термоядерную энергию у Helion в «огромных объёмах». Что касается компании Stripe (создаёт решения для приёма и обработки электронных платежей), то в ней Брокман получил долю ещё до начала работы в OpenAI. В Stripe он трудился на позиции технического директора, а его доля в этой фирме составляет в акциях $471,26 млн. Stripe обрабатывает часть платежей OpenAI. В 2023 году было объявлено о трёхлетнем контракте стоимостью $60 млн.

05.05.2026 [00:15], Владимир Мироненко

Cerebras объявила о запуске IPO с оценкой капитализации в $26 млрдКомпания Cerebras Systems объявила о планах начать так называемое роуд-шоу — серию встреч с потенциальными инвесторами — в рамках подготовки в первичному публичному размещению (IPO) своих акций. Заявку в Комиссию по ценным бумагам и биржам США (SEC) на размещение 28 млн своих обыкновенных акций класса А на бирже Nasdaq Global Select Market под тикером CBRS компания подала 17 апреля. Cerebras также сообщила о планах предоставить андеррайтерам 30-дневный опцион на приобретение до 4,2 дополнительных акций своих обыкновенных акций класса А. Ожидается, что цена акции во время IPO составит от $115,00 до $125,00. При верхней границе диапазона Cerebras будет оцениваться до $26,62 млрд, что сделает ее крупнейшей компанией, специализирующейся исключительно на чипах для ИИ, на бирже за последнее время. Это размещение также рассматривается как важный барометр для оценки рыночного энтузиазма в отношении инвестиций в ИИ-инфраструктуру. В качестве ведущих андеррайтеров, несущих основную ответственность за заполнение книги заявок при размещении, выступят банки Morgan Stanley, Citigroup, Barclays и UBS Investment Bank. Им окажут помощь Mizuho и TD Cowen. А Needham & Company, Craig-Hallum, Wedbush Securities, Rosenblatt, Academy Securities, Credit Agricole CIB, MUFG и First Citizens Capital Securities выступят в качестве соорганизаторов. Размещение будет осуществляться только посредством проспекта. Заявление о регистрации ценных бумаг было подано в SEC, но ещё не вступило в силу. Cerebras пользуется поддержкой серьёзных инвесторов. Ранее в этом году компания завершила раунд финансирования в размере $1 млрд, возглавляемый технологическим инвестиционным гигантом Tiger Global при участии Benchmark, Fidelity Management, Altimeter, AMD и Coatue, а также других известных институциональных инвесторов. После его проведения оценка рыночной капитализации Cerebras составляет $23 млрд. Следует отметить, что это вторая попытка Cerebras провести первичное публичное размещение акций. Компания отозвала свою предыдущую заявку на IPO в октябре прошлого года. Её возвращение сейчас — на фоне усиливающегося интереса к инвестициям в ИИ и более широкого восстановления рынка IPO — привлекло значительно большее внимание рынка. В отличие от прошлогоднего незаметного отзыва, Cerebras возвращается с высокими финансовыми показателями и крупными клиентскими контрактами. В частности, она заключила соглашение с OpenAI на сумму $20 млрд на поставку в течение следующих трёх лет ИИ-ускорителей в дополнение к предыдущей сделке на $10 млрд. UPD 12.05.2026: Cerebras подняла оценку стоимости акций до $150–$160/шт., что позволит получить ей во время IPO не $3,5 млрд, как ожидалось ранее, а около $4,8 млрд.

17.04.2026 [22:53], Владимир Мироненко

ИИ-стартап Cerebras поставит OpenAI ускорители ещё на $20 млрдКомпания OpenAI заключила соглашение с ИИ-стартапом Cerebras, согласно которому она выплатит более $20 млрд в течение следующих трёх лет за поставку ИИ-ускорителей, сообщило издание The Information. В рамках сделки OpenAI получит варранты на миноритарную долю в Cerebras, при этом её доля может увеличиться по мере роста расходов, утверждают источники The Information. По их данным, OpenAI также согласилась предоставить Cerebras около $1 млрд для финансирования развёртывания ЦОД на базе её ИИ-ускорителей. До этого, в январе Cerebras договорилась с OpenAI о поставке в течение трёх лет своих ускорителей общей мощностью 750 МВт. Стоимость этой сделки оценивается в $10 млрд. Новое соглашение подчеркивает растущий интерес отрасли к вычислительным мощностям для инференса, отметило агентство Reuters. По его данным, Cerebras может раскрыть некоторые подробности своего соглашения с OpenAI, когда предоставит регулятору документы для проведения первичного публичного размещения (IPO). Исходя из общей суммы контрактов The Information допускает, что OpenAI может получить варранты, представляющие до 10 % доли в Cerebras. Сотрудничество с OpenAI является ключевым элементом в планах Cerebras по выходу на биржу, планирующего провести листинг во II квартале этого года. Cerebras, чья рыночная стоимость, по последним оценкам, составляет $23,1 млрд, планирует привлечь $3 млрд в ходе первичного публичного размещения акций в следующем месяце при оценке примерно в $35 млрд, сообщил The Information. Выход на биржу неоднократно откладывался. Сначала компанию подозревали в опосредованных связях с Китаем и зависимости от ближневосточных нефтедолларов, а потом компания дважды получила крупные инвестиции и нарастила капитализацию. Сделки с AWS и OpenAI укрепили её позиции и успокоили инвесторов. В пятницу Cerebras объявила о подаче заявки на первичное публичное размещение акций (IPO) в США. Компания планирует разместить свои акции на Nasdaq под тикером CBRS. Ведущими андеррайтерами размещения являются Morgan Stanley, Citigroup, Barclays и UBS. Ранее на этой неделе Morgan Stanley открыл Cerebras возобновляемую кредитную линию с доступом до $250 млн, с возможностью увеличения лимита до $850 млн после IPO, сообщил CNBC. Согласно документам, поданным в пятницу, среди инвесторов Cerebras — Alpha Wave, Benchmark, Eclipse, Fidelity и Foundation Capital. На сайте Cerebras также указан генеральный директор OpenAI Сэм Альтман (Sam Altman) в качестве инвестора. Cerebras указала в заявке, что не владеет ЦОД, которые использует для предоставления облачных услуг, но может построить собственные в будущем. В документе также сообщается, что чистая прибыль Cerebras за 2025 год составила $87,9 млн при выручке в $510 млн (рост год к году на 76 %). Компания получила прибыль в размере $1,38 на акцию, по сравнению с убытком в $9,90 на акцию годом ранее. По состоянию на 31 декабря 2025 года у Cerebras оставалось $24,6 млрд невыполненных обязательств, и ожидается, что 15 % этой суммы будет учтено в 2026 и 2027 годах.

14.03.2026 [18:42], Владимир Мироненко

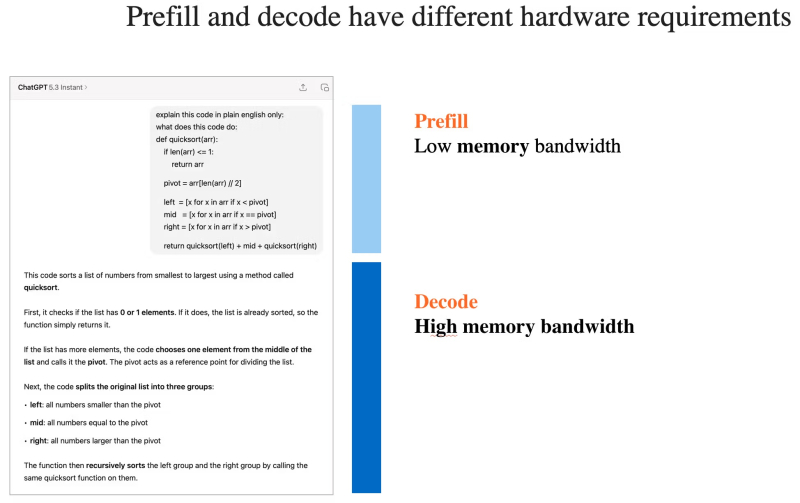

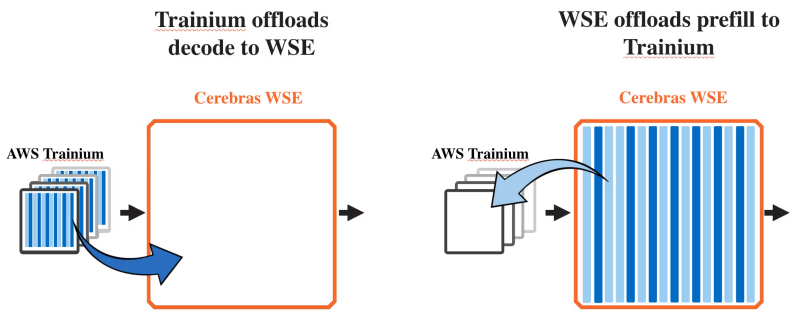

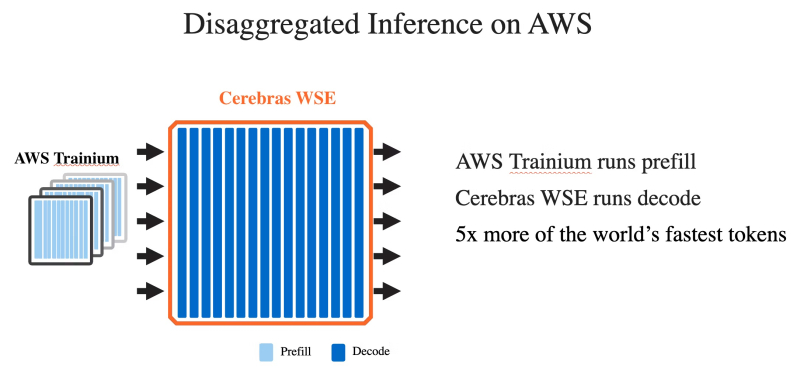

Царь-ускорители Cerebras в облаке AWS пятикратно ускорят инференс ИИAmazon Web Services (AWS) и Cerebras Systems объявили о сотрудничестве, «которое позволит создать в ближайшие месяцы самые быстрые решения для инференса в системах генеративного ИИ и рабочих нагрузок машинного обучения». Решение, которое будет развёрнуто на платформе Amazon Bedrock в ЦОД AWS, объединяет серверы на базе ускорителей Trainium, системы Cerebras CS-3 на базе царь-чипов WSE-3 и DPU EFA. Ожидается, что эта технология увеличит скорость генерации результатов ИИ-моделями в пять раз. Позже в этом году AWS предложит ведущие open source решения машинного обучения и собственные ИИ-модели Amazon Nova, использующие оборудование Cerebras. Как отметил Дэвид Браун (David Brown), вице-президент по вычислительным и машинным сервисам AWS, при инференсе критическим узким местом для ресурсоёмких рабочих нагрузок, таких как помощь в кодировании в реальном времени и интерактивные приложения, остаётся скорость: «Решение, которое мы разрабатываем совместно с Cerebras, решает эту проблему: разделяя нагрузку по инференсу между Trainium и CS-3 и соединяя их с помощью EFA, каждая система делает то, что у неё лучше всего получается. В результате инференс будет на порядок быстрее и производительнее, чем сегодня». Совместное решение использует «дезагрегацию вывода» — метод, который разделяет ИИ-инференс на два этапа: этап интенсивной обработки подсказок, или «предварительного заполнения» (процесс обработки запроса LLM), и этап генерации выходных данных, известный как «декодирование», на котором модель формирует ответ на вопрос пользователя. Предварительное заполнение является параллельным, вычислительно интенсивным процессом и не требует большой пропускной способности памяти. Декодирование, с другой стороны, является последовательным процессом с минимальными требованиями к вычислительным ресурсам, но интенсивно использует пропускную способность памяти. Декодирование обычно занимает большую часть времени при инференсе, поскольку каждый выходной токен должен генерироваться последовательно, отметила AWS. Задачи предварительного заполнения и декодирования обычно выполняются одним и тем же чипом. В дезагрегированной архитектуре AWS чипы Trainium обеспечивают этап предварительного заполнения, а чипы WSE-3 выполняют декодирование. «Дезагрегированный подход идеален, когда у вас большие, стабильные рабочие нагрузки, — сообщил в блоге директор по маркетингу продукции Cerebras Джеймс Ванг (James Wang). — Большинство клиентов используют смешанные рабочие нагрузки с различными коэффициентами предварительного заполнения/декодирования, где традиционный агрегированный подход по-прежнему идеален. Мы ожидаем, что большинство клиентов захотят иметь доступ к обоим вариантам». Одним из главных преимуществ WSE-3 является то, что он может передавать данные между своими логическими схемами и цепями памяти быстрее, чем многие другие чипы. По данным Cerebras, WSE-3 обеспечивает внутреннюю пропускную способность памяти в 21 Пбайт/с, что значительно превышает пропускную способность NVLink для ускорителей от NVIDIA. Впрочем, у NVIDIA теперь есть ускорители Groq, которые тоже помогают ускорить инференс. Несколько недель назад Cerebras заключила с OpenAI сделку на $10 млрд по поставке чипов общей мощностью 750 МВт до 2028 года. Сделка была объявлена в период между двумя раундами финансирования, которые в совокупности принесли Cerebras более $2 млрд. Ожидается, что компания подаст заявку на IPO уже во II квартале 2026 года. Сделки с AWS и OpenAI могут способствовать повышению интереса инвесторов к листингу, отметил SiliconANGLE.

21.02.2026 [15:03], Сергей Карасёв

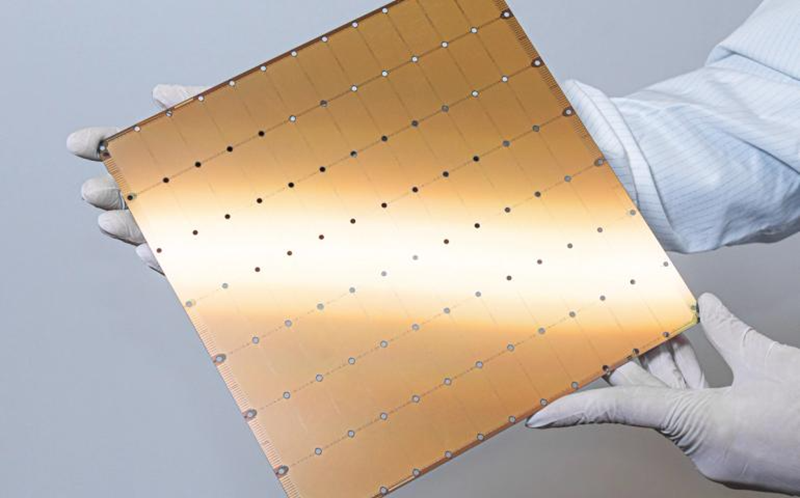

G42 из ОАЭ и Cerebras построят в Индии национальный ИИ-суперкомпьютер с царь-ускорителями WSE-3Холдинг G42 из Абу-Даби (ОАЭ) и компания Cerebras в партнёрстве с Университетом искусственного интеллекта им. Мохаммеда бин Зайеда (MBZUAI) и Индийским центром развития передовых вычислительных технологий (C-DAC) развернут в Индии национальный ИИ-суперкомпьютер. Технические подробности проекта не раскрываются. Отмечается лишь, что система обеспечит ИИ-производительность на уровне 8 Эфлопс (точность вычислений не указана). Комплекс, размещённый на территории Индии, будет эксплуатироваться в соответствии с местными требованиями к безопасности, а все обрабатываемые данные останутся в национальной юрисдикции. Иными словами, речь идёт о формировании суверенной вычислительной платформы. Как отмечает The Register, в основу суперкомпьютера лягут ускорители Cerebras WSE-3. Эти изделия содержат 4 трлн транзисторов, 900 тыс. ядер и 44 Гбайт SRAM. Суммарная пропускная способность встроенной памяти достигает 21 Пбайт/с. Производительность составляет до 125 Пфлопс на операциях FP16. Таким образом, в составе НРС-системы могут быть задействованы 64 экземпляра Cerebras WSE-3.

Источник изображения: G42 После ввода в эксплуатацию новый суперкомпьютер станет доступен широкому кругу пользователей в Индии — от ведущих научных организаций, институтов и государственных структур до стартапов, малых и средних предприятий. Ожидается, что появление системы позволит ускорить инновации в области ИИ. «Суверенная инфраструктура ИИ становится важнейшим компонентом национальной конкурентоспособности. Новый проект предоставит Индии такую платформу, позволив местным исследователям и предприятиям внедрять ИИ, обеспечивая при этом полную безопасность данных», — заявил Ману Джайн (Manu Jain), генеральный директор G42 India. Нужно отметить, что в Индии активно развивается инфраструктуры для ИИ-вычислений. В частности, индийские Tata Group, Tata Consultancy Services (TCS) и OpenAI намерены развернуть в стране ИИ ЦОД мощностью до 1 ГВт. Вместе с тем индийский конгломерат Adani вложит $100 млрд в создание ЦОД общей мощностью 5 ГВт, снабжаемых возобновляемой энергией.

06.02.2026 [11:04], Руслан Авдеев

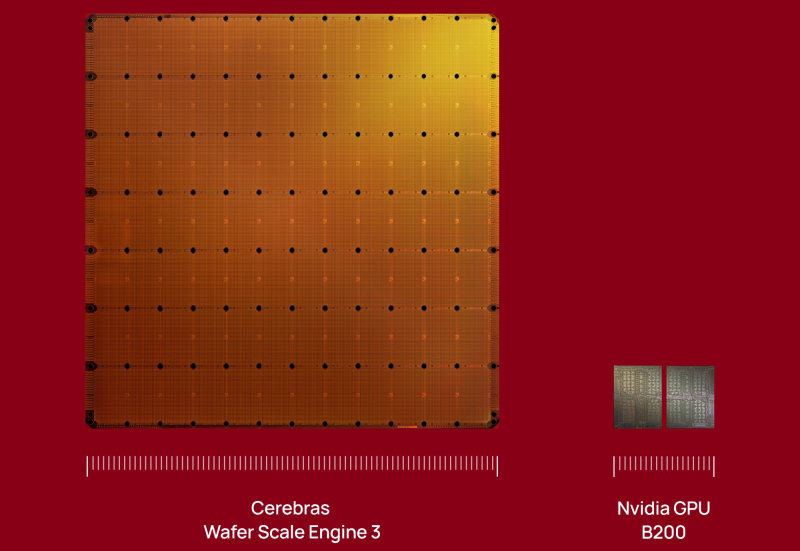

Cerebras привлекла ещё $1 млрд инвестиций после сделки с OpenAIЧерез четыре месяца после завершения раунда финансирования в объёме $1,1 млрд Cerebras Systems заявила о привлечении ещё $1 млрд, во многом от прежних инвесторов, сообщает Datacenter Dynamics. Сделку серии H возглавила Tiger Global, к ней присоединились AMD, Fidelity Management, Atreides Management, Alpha Wave Global, Altimeter, Coatue, 1789 Capital и другие компании. Сегодня оценка рыночной капитализации Cerebras составляет $23 млрд. Новый раунд привлечения средств объявлен через несколько недель после того, как компания заключила с OpenAI сделку на $10 млрд. Cerebras сегодня предлагает суперчип WSE-3 с 4 трлн транзисторов, это в 19 раз больше, чем может обеспечить NVIDIA Blackwell B200. Чип включает 44 Гбайт SRAM, что, как считается, позволяет добиться большей скорости инференса и меньше зависеть от поставок всё более дефицитных HBM и DDR.

Источник изображения: Cerebras В сентябре 2024 года Cerebras подала заявку на IPO. Тогда компания сообщала, что в I полугодии 2024 года её выручка составила $136,4 млн, это более чем в 10 раз выше год к году. Убытки за тот же период сократились с $77,8 млн до $66,6 млн. В 2025 году компания отозвала заявку на IPO, посчитав, что документ более не отражает состояние бизнеса. В частности, в 2025 году значительно выросла выручка и теперь компания рассчитывает повторно подать документы для выхода на биржу уже во II квартале 2026 года.

03.02.2026 [17:15], Руслан Авдеев

OpenAI не устроили чипы NVIDIA для инференса, теперь она ищет альтернативыПо данным многочисленных отраслевых источников, компания OpenAI недовольна некоторыми ИИ-чипами NVIDIA и с прошлого года ищет им альтернативы. Потенциально это усложнит отношения между крупнейшими игроками рынка на фоне бума ИИ, сообщает Reuters. Изменения стратегии OpenAI связаны с усилением акцента на инференсе. NVIDIA доминирует в нише ускорителей для обучения ИИ-моделей, но теперь инференс стал отдельным рынком с сильной конкуренцией. Решение OpenAI — вызов доминированию NVIDIA в сфере ИИ и препятствие $100-млрд сделки между компаниями, обеспечивающей разработчику чипов долю в ИИ-стартапе в обмен на доступ к передовым ускорителям. Предполагалось, что сделка будет закрыта за недели, но вместо этого переговоры ведутся месяцами. В то же время OpenAI заключила соглашение с AMD и Cerebras (её в своё время даже хотели купить) для получения «альтернативных» чипов, а также разрабатывает собственный ИИ-ускоритель при участии Broadcom. Amazon тоже не прочь предоставить OpenAI собственные ускорители, равно как и Google. Изменение планов OpenAI изменило и потребности в вычислительных мощностях и замедлило переговоры с NVIDIA. В минувшую субботу глава NVIDIA Дженсен Хуанг (Jensen Huang) опроверг слухи о проблемах с OpenAI, назвав их «чепухой» и подчеркнув, что клиенты продолжают выбирать NVIDIA для инференса, поскольку компания обеспечивает наилучшее соотношение производительности и совокупной стоимости владения, причём в больших масштабах. Отдельно представитель OpenAI заявлял, что компания полагается на NVIDIA для поставок большинства чипов для инференса, причём именно NVIDIA обеспечивает наилучшую производительность на каждый вложенный доллар. Глава OpenAI Сэм Альтман (Sam Altman) отметил, что NVIDIA выпускает «лучшие чипы в мире» и есть надежда, что OpenAI останется её «гигантским» клиентом очень долгое время. При этом, как сообщает Reuters со ссылкой на семь источников, OpenAI не удовлетворена производительностью инференса, на которую способны чипы NVIDIA. В частности, речь идёт о специализированных задачах вроде разработки ПО с помощью ИИ и коммуникаций ИИ с другим ПО. По данным одного из источников, компании понадобится новое аппаратное обеспечение, которое в конечном счёте обеспечит в будущем порядка 10 % вычислительных мощностей для инференса. OpenAI обсуждала возможности работы с ИИ-стартапами, включая Cerebras и Groq для обеспечения чипов с более быстрым инференсом, но NVIDIA фактически поглотила Groq на $20 млрд, что привело к прекращению переговоров с компанией. Хотя формально речь идёт неэксклюзивном лицензировании технологий Groq, что в теории позволяет сторонним компаниям получить доступ к решениям Groq, фактически все разработчики перешли в NVIDIA, а оставшаяся небольшая команда отвечает за выполнение облачных контрактов с имеющимися заказчиками. Чипы NVIDIA хорошо подходят для обработки больших объёмов данных при обучении больших ИИ-моделей вроде тех, что стоят за ChatGPT. Тем не менее прогресс требует массового использования уже обученных моделей для дальнейшего инференса и ИИ-рассуждений. Как сообщается, OpenAI с 2025 года ищет альтернативы ускорителям NVIDIA с упором на компании, создающие чипы с большими объёмами интегрированной SRAM. Maia 200 от Microsoft, по-видимому, компании не очень подходит. Инференс моделей более требователен к памяти, чем обучение, а вычислительная нагрузка, наоборот, не так велика. В тоге нередко на доступ к данным уходит больше времени, чем на расчёты. NVIDIA и AMD полагаются на внешнюю память, что замедляет соответствующие процессы общения с чат-ботами. В OpenAI проблемы отметили при эксплуатации системы Codex, активно продвигаемой компанией для создания кода. В компании считают, что некоторые слабости системы связаны именно с оборудованием NVIDIA. Конкуренты OpenAI полагаются на альтернативное оборудование. Anthropic активно использует AWS Trainium и Google TPU, а Google уже много лет использует свои TPU, которые с недавних пор готова отдавать на сторону. TPU оптимизированы в том числе для инференса и в некоторых отношениях более производительны, чем GPU общего назначения AMD и NVIDIA. Когда OpenAI недвусмысленно выразила отношение к технологиям NVIDIA, та предложила компаниям, создающим ускорители с упором на SRAM, включая Cerebras и Groq, купить их бизнес. Cerebras отказалась и заключила прямую сделку с OpenAI. Groq вела переговоры с OpenAI о предоставлении вычислительных мощностей, что вызвало интерес у инвесторов, оценивших капитализацию компании на уровне $14 млрд.

15.01.2026 [09:09], Владимир Мироненко

Инвесторы вкладывают сотни миллионов долларов в Etched и Cerebras в надежде, что они потеснят NVIDIA на рынке ИИЛидирующие позиции NVIDIA на рынке ИИ-ускорителей кажутся незыблемыми на долгие годы, но, как полагает ресурс SiliconANGLE, ей следует присмотреться к ближайшим конкурентам, которые пока не «дышат в спину», но стремительно наращивают свои возможности, получая солидную финансовую поддержку для роста. Согласно данным источников Bloomberg (официального сообщения пока не поступало), стартап Etched, занимающийся разработкой ИИ-чипов, привлёк около $500 млн в новом раунде финансирования, благодаря чему оценка его рыночной стоимости составила $5 млрд. Ещё более крупный конкурент NVIDIA, компания Cerebras Systems, по данным The Information, ведёт переговоры о привлечении $1 млрд инвестиций в рамках очередного раунда финансирования при оценке капитализации в $22 млрд. Всего лишь три месяца назад она уже получила $1,1 млрд при оценке в $8,1 млрд, в очередной раз перенеся IPO. По данным источников The Information, компания всё же выйдет на биржу в ближайшие месяцы. Сделка с OpenAI снизит её зависимость от базирующейся в ОАЭ компании G42. Как сообщают источники, нынешний раунд финансирования Etched возглавила компания Stripes при участии миллиардера Питера Тиля (Peter Thiel), а также компаний Positive Sum и Ribbit Capital. Ранее в инвестировании стартапа принимали участие Primary Venture Partners и известные бизнес-ангелы, такие как генеральный директор GitHub Томас Домке (Thomas Dohmke) и бывший руководитель Coinbase Баладжи Сринивасан (Balaji Srinivasan). По словам источников, с учётом этого раунда общая сумма привлечённых средств Etched приблизилась к $1 млрд. Это довольно внушительный финансовый резерв для стартапа, существующего всего два года. Etched создал Sohu — узкоспециализированный ASIC разработанный специально для инференса ИИ-моделями на архитектуре трансформеров. При разработке чипа Etched сотрудничала с группой Emerging Businesses компании TSMC, что свидетельствует как о технических амбициях, так и о производственной надёжности. Также к участию в проекте привлекли специалистов, ранее работавших в таких компаниях, как Cypress Semiconductor и Broadcom. В свою очередь, Cerebras Systems получила известность благодаря своим царь-чипам WSE, которые, по словам компании, значительно быстрее и энергоэффективнее решений NVDIA в ИИ-задачах. В отличие от Etched, Cerebras активно наращивает клиентскую базу, не только развёртывая оборудование, но и предоставляя услуги облачных ИИ-вычислений. Среди её клиентов — Meta✴, IBM и Mistral AI.

15.01.2026 [01:05], Игорь Осколков

$10 млрд за 750 МВт ИИ-мощностей: OpenAI подписала сделку с CerebrasOpenAI подписала многолетнее соглашение с разработчиком царь-ускорителей Cerebras, который до 2028 поставит 750 МВт вычислительных мощностей. По данным CNBC, сумма сделки превышает $10 млрд. Идёт ли речь о продаже ИИ-ускорителей или предоставлении сервисов инференса, пока не уточняется. «Вычислительная стратегия OpenAI заключается в создании отказоустойчивого портфеля, в рамках которого для различных рабочих нагрузок подбираются подходящие системы», — сообщила OpenAI, отметив высокую скорость инференса решений Cerebras, что ускорит генерацию ответов, обеспечит более естественное взаимодействие и позволит масштабировать использование ИИ в реальном времени для гораздо большего числа людей. OpenAI использует комбинацию ускорителей AMD и NVIDIA, а также строит гигантские ЦОД на базе решений последней в рамках проекта Stargate. Кроме того, OpenAI сотрудничает с Google, у которой есть ускорители TPU, а также разрабатывает собственные ИИ-чипы в партнёрстве с Broadcom. Наконец, компания может повлиять на разработку нового поколения фирменных ускорителей Microsoft Maia. AWS тоже не прочь дать OpenAI свои ИИ-ускорители Trainium, но пока компании договорились лишь о масштабной аренде чипов NVIDIA. Примечательно, что OpenAI ещё в 2017 году раздумывала, не купить ли Cerebras при участии Tesla, глава которой Илон Маск (Elon Musk) тогда всё ещё работал в OpenAI. На тот момент Cerebras было всего два года, а свой первый ускоритель WSE она представила только в 2019 году. Серьёзную поддержку компании оказала G42 из ОАЭ, но в итоге Cerebras оказалась от неё слишком зависима, так что сделка с OpenAI сыграет компании на руку в преддверии всё откладывающегося выхода на биржу.

06.10.2025 [14:41], Руслан Авдеев

Разработчик царь-ускорителей Cerebras Systems отозвал заявку на IPOCerebras Systems решила отозвать заявку о выходе на публичные торги — информация об IPO компании впервые появилась около года назад. Оператор ЦОД и разработчик ИИ-чипов сообщил, что документы об IPO ещё не были одобрены регуляторами, сообщает Bloomberg. Всего несколько дней назад компания закрыла раунд финансирования G на $1,1 млрд, что подняло её стоимость до $8,1 млрд. На тот момент руководство заявляло, что привлечённые средства никак не скажутся на планах выхода на публичные торги. Сообщалось, что они будет потрачены на расширение технологического портфолио, включая разработку ИИ-ускорителей, упаковку, создание ИИ-суперкомпьютеров и др. Раунд финансирования Cerebras стал последним в череде инвестиций в технологическую индустрию, которая тратит миллиарды на новую ИИ-инфраструктуру, призванную преобразить мировую экономику. В последние недели на рынке IPO в США наблюдается оживление. В частности, успешно дебютировали технологические компании Netskope и Figure Technology Solutions, акции которых выросли более чем на 20 % от цены размещения.

Источник изображения: Cerebras Cerebras подала заявку о выходе на IPO в сентябре 2024 года, но выход на биржу так и не состоялся. Это связывается с позицией американских регуляторов, занявшихся расследованием инвестиций G42 из Абу-Даби на $335 млн. 87 % выручки Cerebras за первые шесть месяцев 2024 года поступили от G42, а строящиеся в США дата-центры предназначены для использования именно компанией из ОАЭ, имеющей связи с Китаем. Впрочем, в марте Cerebras объявила, что разрешила все спорные вопросы с регулятором CFIUS. Последний раунд финансирования возглавили Fidelity Management & Research и Atreides Management. В числе инвесторов — Tiger Global, Valor Equity Partners и венчурный капиталист 1789 Capital, также приняли участие и прежние инвесторы, включая Altimeter Capital Management and Benchmark. На днях Cerebras запустила новый ЦОД в Оклахома-Сити (Oklahoma City, Оклахома) при сотрудничестве со Scale Datacenters. Также компания имеет действующие кластеры для инференса в Санта-Кларе (Santa Clara) и Стоктоне (Stockton) в Калифорнии (последний в плавучем ЦОД Nautilus), а также в Далласе (Dallas, Техса). Также компания создаёт кластеры в Миннеаполисе (Миннесота), Монреале (Канада) на объекте Bit Digital, а также в некоторых локациях на Среднем Западе США и в Европе. Компания внедрила оборудование в Эдинбургском университете (University of Edinburgh), Сандийскийх национальных лабораториях (Sandia National Labs), в лабораториях Лос-Аламоса (Los Alamos Labs), на мощностях G42/Core42 и др. |

|